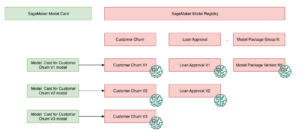

Parfois, il peut être très avantageux d'utiliser des outils tels que des compilateurs qui peuvent modifier et compiler vos modèles pour des performances d'inférence optimales. Dans cet article, nous explorons TensorRT et comment l'utiliser avec Amazon Sage Maker inférence à l'aide Serveur d'inférence NVIDIA Triton. Nous explorons le fonctionnement de TensorRT et comment héberger et optimiser ces modèles pour des performances et une rentabilité sur SageMaker. SageMaker fournit points de terminaison de modèle unique (PME), qui vous permettent de déployer un seul modèle de ML, ou points de terminaison multimodèle (MME), qui vous permettent de spécifier plusieurs modèles à héberger derrière un point de terminaison logique pour une meilleure utilisation des ressources.

Pour servir les modèles, Triton prend en charge divers backends en tant que moteurs pour prendre en charge l'exécution et le service de divers modèles ML pour l'inférence. Pour tout déploiement Triton, il est crucial de savoir comment le comportement du backend affecte vos charges de travail et à quoi s'attendre pour que vous puissiez réussir. Dans cet article, nous vous aidons à comprendre Backend TensorRT qui est pris en charge par Triton sur SageMaker afin que vous puissiez prendre une décision éclairée pour vos charges de travail et obtenir d'excellents résultats.

Plongez dans le backend TensorRT

TensorRT vous permet d'optimiser l'inférence à l'aide de techniques telles que la quantification, la fusion de couches et de tenseurs, le réglage du noyau et d'autres sur les GPU NVIDIA. En adoptant et en compilant des modèles pour utiliser TensorRT, vous pouvez optimiser les performances et l'utilisation de vos charges de travail d'inférence. Dans certains cas, il existe des compromis, ce qui est typique de techniques telles que la quantification, mais les résultats peuvent être spectaculaires en termes de performances, de latence et de nombre de transactions pouvant être traitées.

Le backend TensorRT est utilisé pour exécuter des modèles TensorRT. TensorRT est un SDK développé par NVIDIA qui fournit une bibliothèque d'inférence d'apprentissage en profondeur hautes performances. Il est optimisé pour les GPU NVIDIA et offre un moyen d'accélérer l'inférence d'apprentissage en profondeur dans les environnements de production. TensorRT prend en charge les principaux frameworks d'apprentissage en profondeur et comprend un optimiseur d'inférence d'apprentissage en profondeur hautes performances et un environnement d'exécution qui offre une inférence à faible latence et à haut débit pour les applications d'IA.

TensorRT est capable d'accélérer les performances du modèle en utilisant une technique appelée optimisation graphique pour optimiser le graphe de calcul généré par un modèle de deep learning. Il optimise le graphique pour minimiser l'empreinte mémoire en libérant de la mémoire inutile et en la réutilisant efficacement. La compilation TensorRT fusionne les opérations éparses à l'intérieur du graphe du modèle pour former un noyau plus grand afin d'éviter la surcharge de plusieurs lancements de petits noyaux. Avec le réglage automatique du noyau, le moteur sélectionne le meilleur algorithme pour le GPU cible, optimisant ainsi l'utilisation du matériel. De plus, TensorRT utilise des flux CUDA pour permettre le traitement parallèle des modèles, améliorant encore l'utilisation et les performances du GPU. Enfin, grâce à la quantification, TensorRT peut utiliser une accélération à précision mixte des cœurs Tensor, permettant au modèle de s'exécuter en précision FP32, TF32, FP16 et INT8 pour les meilleures performances d'inférence. Cependant, bien que la précision réduite puisse généralement améliorer les performances de latence, elle peut entraîner une instabilité et une dégradation de la précision du modèle. Dans l'ensemble, la combinaison de techniques de TensorRT se traduit par une inférence plus rapide et une latence plus faible par rapport aux autres moteurs d'inférence.

Le backend TensorRT pour Triton Inference Server est conçu pour tirer parti des puissantes capacités d'inférence des GPU NVIDIA. Pour utiliser TensorRT comme backend pour Triton Inference Server, vous devez créer un moteur TensorRT à partir de votre modèle entraîné à l'aide de l'API TensorRT. Ce moteur est ensuite chargé dans Triton Inference Server et utilisé pour effectuer des inférences sur les requêtes entrantes. Voici les étapes de base pour utiliser TensorRT comme backend pour Triton Inference Server :

- Convertissez votre modèle formé en ONNX format. Triton Inference Server prend en charge ONNX comme format de modèle. ONNX est une norme de représentation des modèles d'apprentissage en profondeur, permettant leur transfert entre les frameworks. Si votre modèle n'est pas déjà au format ONNX, vous devez le convertir à l'aide de l'outil spécifique au framework approprié. Par exemple, dans PyTorch, cela peut être fait en utilisant le

torch.onnx.exportméthode. - Importez le modèle ONNX dans TensorRT et générez le moteur TensorRT. Pour TensorRT, il existe plusieurs façons de créer un TensorRT à partir de votre modèle ONNX. Pour ce post, nous utilisons le

trtexecOutil CLI.trtexecest un outil pour utiliser rapidement TensorRT sans avoir à développer votre propre application. Letrtexecoutil a trois objectifs principaux :- Analyse comparative des réseaux sur des données d'entrée aléatoires ou fournies par l'utilisateur.

- Génération de moteurs sérialisés à partir de modèles.

- Génération d'un cache de synchronisation sérialisé à partir du générateur.

- Chargez le moteur TensorRT dans Triton Inference Server. Une fois le moteur TensorRT généré, il peut être chargé dans Triton Inference Server en créant un configuration du modèle déposer. La configuration du modèle (

config.pbtxt) doit inclure le chemin d'accès au fichier du moteur TensorRT et les formes d'entrée et de sortie du modèle.

Chaque modèle dans un référentiel de modèles doit inclure une configuration de modèle qui fournit des informations obligatoires et facultatives sur le modèle. Généralement, cette configuration est fournie dans un config.pbtxt fichier spécifié comme Protobuf ModelConfig. Il y a plusieurs points clés à noter dans ce fichier de configuration :

- prénom – Ce champ définit le nom du modèle et doit être unique dans le référentiel de modèles.

- plateforme – Ce champ définit le type du modèle : moteur TensorRT, PyTorch, ou autre chose.

- max_batch_size – Cela spécifie la taille de lot maximale qui peut être transmise à ce modèle. Si la dimension de lot du modèle est la première dimension et que toutes les entrées et sorties du modèle ont cette dimension de lot, alors Triton peut utiliser son doseur dynamique or doseur de séquence pour utiliser automatiquement le traitement par lots avec le modèle. Dans ce cas,

max_batch_sizedoit être défini sur une valeur supérieure ou égale à 1, qui indique la taille de lot maximale que Triton doit utiliser avec le modèle. Pour les modèles qui ne prennent pas en charge le traitement par lots ou qui ne prennent pas en charge le traitement par lots de la manière spécifique que nous avons décrite,max_batch_sizedoit être réglé sur 0. - Entrée et sortie – Ces champs sont obligatoires car NVIDIA Triton a besoin de métadonnées sur le modèle. Essentiellement, il nécessite les noms des couches d'entrée et de sortie de votre réseau et la forme desdites entrées et sorties.

- groupe_instance – Cela détermine combien d'instances de ce modèle seront créées et si elles utiliseront le GPU ou le CPU.

- dynamique_batching - Mise en lots dynamique est une fonctionnalité de Triton qui permet aux requêtes d'inférence d'être combinées par le serveur, de sorte qu'un lot soit créé dynamiquement. Le

preferred_batch_sizeLa propriété indique les tailles de lot que le doseur dynamique doit tenter de créer. Pour la plupart des modèles,preferred_batch_sizene doit pas être spécifié, comme décrit dans Processus de configuration recommandé. Une exception concerne les modèles TensorRT qui spécifient plusieurs profils d'optimisation pour différentes tailles de lot. Dans ce cas, étant donné que certains profils d'optimisation peuvent apporter une amélioration significative des performances par rapport à d'autres, il peut être judicieux d'utiliserpreferred_batch_sizepour les tailles de lot prises en charge par ces profils d'optimisation plus performants. Vous pouvez également référencer la taille de lot qui était précédemment utilisée lors de l'exécutiontrtexec. Vous pouvez également configurer le délai pour permettre aux demandes d'être retardées pendant une durée limitée dans le planificateur afin de permettre à d'autres demandes de rejoindre le lot dynamique.

Le backend TensorRT est amélioré pour avoir des performances nettement meilleures. Les améliorations incluent la réduction des conflits de threads, l'utilisation de la mémoire épinglée pour des transferts plus rapides entre le CPU et le GPU, et l'augmentation du chevauchement des copies de calcul et de mémoire sur les GPU. Il réduit également l'utilisation de la mémoire des modèles TensorRT dans de nombreux cas en partageant les poids entre plusieurs instances de modèle. Dans l'ensemble, le backend TensorRT pour Triton Inference Server fournit un moyen puissant et flexible de servir des modèles d'apprentissage en profondeur avec une inférence TensorRT optimisée. En ajustant les options de configuration, vous pouvez optimiser les performances et contrôler le comportement en fonction de votre cas d'utilisation spécifique.

SageMaker fournit Triton via les PME et les MME

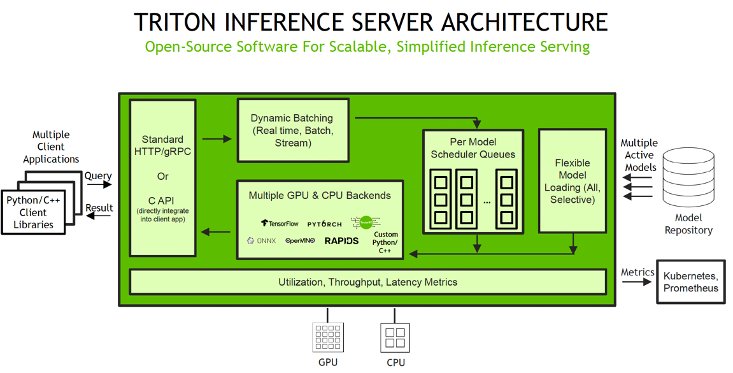

SageMaker vous permet de déployer tous les deux unique et les multi-modèle terminaux avec Triton Inference Server. Triton prend en charge un cluster hétérogène avec à la fois des GPU et des CPU, ce qui permet de normaliser l'inférence entre les plates-formes et de s'adapter dynamiquement à n'importe quel CPU ou GPU pour gérer les pics de charge. Le diagramme suivant illustre l'architecture du serveur d'inférence Triton. Les requêtes d'inférence arrivent au serveur via soit HTTP / REST ou par le API C, et sont ensuite acheminés vers le planificateur approprié par modèle. Outils Triton plusieurs algorithmes de planification et de traitement par lots qui peut être configuré sur une base modèle par modèle. Le planificateur de chaque modèle effectue éventuellement un traitement par lots des demandes d'inférence, puis transmet les demandes au backend correspondant au type de modèle. Le backend de la structure effectue une inférence à l'aide des entrées fournies dans les requêtes par lots pour produire les sorties demandées. Les sorties sont ensuite formatées et renvoyées dans la réponse. Le référentiel de modèles est un référentiel basé sur le système de fichiers des modèles que Triton mettra à disposition pour l'inférence.

SageMaker s'occupe de la mise en forme du trafic vers le point de terminaison MME et maintient des copies de modèles optimales sur les instances GPU pour des performances tarifaires optimales. Il continue d'acheminer le trafic vers l'instance où le modèle est chargé. Si les ressources de l'instance atteignent leur capacité en raison d'une utilisation élevée, SageMaker décharge les modèles les moins utilisés du conteneur afin de libérer des ressources pour charger les modèles les plus fréquemment utilisés. Les MME SageMaker offrent des capacités pour exécuter plusieurs modèles d'apprentissage en profondeur ou ML sur le GPU, en même temps, avec Triton Inference Server, qui a été étendu pour implémenter le Contrat API MME. Les MME permettent de partager des instances GPU derrière un point de terminaison sur plusieurs modèles, et de charger et décharger dynamiquement des modèles en fonction du trafic entrant. Avec cela, vous pouvez facilement obtenir des performances de prix optimales.

Lorsqu'un MME SageMaker reçoit une demande d'invocation HTTP pour un modèle particulier à l'aide de TargetModel dans la demande avec la charge utile, il achemine le trafic vers la bonne instance derrière le point de terminaison où le modèle cible est chargé. SageMaker s'occupe de la gestion des modèles derrière le point de terminaison. Il télécharge dynamiquement des modèles à partir de Service de stockage simple Amazon (Amazon S3) au volume de stockage de l'instance si le modèle invoqué n'est pas disponible sur le volume de stockage de l'instance. Ensuite, SageMaker charge le modèle dans la mémoire du conteneur NVIDIA Triton sur une instance accélérée par GPU et sert la demande d'inférence. Le cœur du GPU est partagé par tous les modèles d'une instance. Pour plus d'informations sur les MME SageMaker sur GPU, voir Exécutez plusieurs modèles d'apprentissage en profondeur sur GPU avec les points de terminaison multimodèles d'Amazon SageMaker.

Les MME SageMaker peuvent évoluer horizontalement à l'aide d'une politique de mise à l'échelle automatique et provisionner des instances de calcul GPU supplémentaires en fonction de métriques spécifiées. Lors de la configuration de vos groupes de mise à l'échelle automatique pour les points de terminaison SageMaker, vous pouvez envisager SageMakerVariantInvocationsPerInstance comme critères principaux pour déterminer les caractéristiques de mise à l'échelle de vos groupes de mise à l'échelle automatique. De plus, selon que vos modèles fonctionnent sur GPU ou CPU, vous pouvez également envisager d'utiliser CPUUtilization or GPUUtilization comme critères supplémentaires. Pour les points de terminaison à modèle unique, étant donné que les modèles déployés sont tous identiques, il est assez simple de définir des politiques appropriées pour respecter vos SLA. Pour les points de terminaison multimodèles, nous vous recommandons de déployer des modèles similaires derrière un point de terminaison donné pour obtenir des performances plus stables et prévisibles. Dans les cas d'utilisation où des modèles de tailles et d'exigences différentes sont utilisés, vous souhaiterez peut-être séparer ces charges de travail sur plusieurs points de terminaison multimodèles ou passer du temps à affiner votre stratégie de groupe de mise à l'échelle automatique pour obtenir le meilleur équilibre entre les coûts et les performances.

Vue d'ensemble de la solution

Avec la NVIDIA Triton image de conteneur sur SageMaker, vous pouvez désormais utiliser le backend TensorRT de Triton, qui vous permet de déployer des modèles TensorRT. Le TensorRT_backend repo contient la documentation et la source du backend. Dans les sections suivantes, nous vous expliquons exemple de cahier qui montre comment utiliser NVIDIA Triton Inference Server sur les MME SageMaker avec la fonction GPU pour déployer un modèle de traitement du langage naturel (NLP) BERT.

Mettre en place l'environnement

Nous commençons par configurer l'environnement requis. Nous installons les dépendances nécessaires pour empaqueter notre pipeline de modèles et exécuter des inférences à l'aide de Triton Inference Server. Nous définissons également la Gestion des identités et des accès AWS (IAM) qui permet à SageMaker d'accéder aux artefacts du modèle et au NVIDIA Triton Registre des conteneurs élastiques Amazon (Amazon ECR). Vous pouvez utiliser l'exemple de code suivant pour récupérer l'image Triton ECR prédéfinie :

Ajouter des méthodes utilitaires pour préparer la charge utile de la requête

Nous créons les fonctions pour transformer l'exemple de texte que nous utilisons pour l'inférence en charge utile qui peut être envoyée pour inférence à Triton Inference Server. Le tritonclient package, qui a été installé au début, fournit des méthodes utilitaires pour générer la charge utile sans avoir à connaître les détails de la spécification. Nous utilisons les méthodes créées pour convertir notre demande d'inférence dans un format binaire, qui fournit des latences plus faibles pour l'inférence. Ces fonctions sont utilisées lors de l'étape d'inférence.

Préparer le modèle TensorRT

Dans cette étape, nous chargeons le modèle BERT pré-formé et convertir en représentation ONNX en utilisant l'exportateur torche ONNX et le onnx_exporter.py scénario. Une fois le modèle ONNX créé, nous utilisons le TensorRT trtexec commande pour créer le plan modèle à héberger avec Triton. Ceci est exécuté dans le cadre du generate_model.sh script de la cellule suivante. Notez que la cellule prend environ 30 minutes à remplir.

En attendant la fin de l'exécution de la commande, vous pouvez vérifier les scripts utilisés à cette étape. Dans le onnx_exporter.py script, nous utilisons le torch.onnx.export fonction de création de modèle ONNX :

La ligne de commande du fichier generate_model.sh crée le plan de modèle TensorRT. Pour plus d'informations, reportez-vous au outil de ligne de commande trtexec.

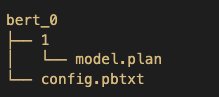

Créer un référentiel de modèles TensorRT NLP BERT

L'utilisation de Triton sur SageMaker nous oblige à configurer d'abord un référentiel de modèles dossier contenant les modèles que nous voulons servir. Pour chaque modèle, nous devons créer un répertoire de modèle composé de l'artefact de modèle et définir le config.pbtxt fichier pour spécifier la configuration du modèle que Triton utilise pour charger et servir le modèle. Pour en savoir plus sur les paramètres de configuration, reportez-vous à Configuration du modèle. La structure du référentiel de modèles pour le modèle BERT est la suivante :

Notez que Triton a des exigences spécifiques pour la disposition du référentiel de modèles. Dans le répertoire du référentiel de modèles de niveau supérieur, chaque modèle possède son propre sous-répertoire contenant les informations du modèle correspondant. Chaque répertoire de modèle dans Triton doit avoir au moins un sous-répertoire numérique représentant une version du modèle. Ici, le dossier 1 représente la version 1 du modèle BERT. Chaque modèle est exécuté par un backend spécifique, donc dans chaque sous-répertoire de version, il doit y avoir les artefacts de modèle requis par ce backend. Ici, nous utilisons le backend TensorRT, qui nécessite le fichier de plan TensorRT utilisé pour le service (pour cet exemple, model.plan). Si nous utilisions un backend PyTorch, un model.pt fichier serait nécessaire. Pour plus de détails sur les conventions de dénomination des fichiers de modèle, reportez-vous à Fichiers modèles.

Chaque modèle TensorRT doit fournir un config.pbtxt fichier décrivant la configuration du modèle. Pour utiliser ce backend, vous devez définir le backend champ de votre modèle config.pbtxt déposer à tensorrt_plan. La section de code suivante montre un exemple de définition du fichier de configuration pour le modèle BERT servi via le backend TensorRT de Triton :

SageMaker s'attend à ce qu'un fichier .tar.gz contenant chaque référentiel de modèles Triton soit hébergé sur le point de terminaison multimodèle. Pour simuler plusieurs modèles similaires hébergés, vous pourriez penser qu'il suffit de tarer le référentiel de modèles que nous avons déjà construit, puis de le copier avec des noms de fichiers différents. Cependant, Triton nécessite des noms de modèle uniques. Par conséquent, nous copions d'abord le référentiel de modèle N fois, en modifiant les noms de répertoire de modèle et leurs correspondants config.pbtxt des dossiers. Vous pouvez modifier le nombre de N pour avoir plus de copies du modèle qui peuvent être chargées dynamiquement sur le point de terminaison d'hébergement pour simuler l'action de chargement/déchargement du modèle gérée par SageMaker. Voir le code suivant :

Créer un point de terminaison SageMaker

Maintenant que nous avons chargé les artefacts de modèle sur Amazon S3, nous pouvons créer l'objet de modèle SageMaker, la configuration du point de terminaison et le point de terminaison.

Tout d'abord, nous devons définir le conteneur de service. Dans la définition du conteneur, définissez le ModelDataUrl pour spécifier le répertoire S3 qui contient tous les modèles que le point de terminaison multimodèle SageMaker utilisera pour charger et diffuser les prédictions. Ensemble Mode à MultiModel pour indiquer que SageMaker créera le point de terminaison avec les spécifications du conteneur MME. Voir le code suivant :

Ensuite, nous créons l'objet modèle SageMaker en utilisant le create_model boto3 API en spécifiant le ModelName et définition de conteneur :

Nous utilisons ce modèle pour créer un configuration du point de terminaison où nous pouvons spécifier le type et le nombre d'instances que nous voulons dans le point de terminaison. Ici, nous déployons sur une instance de GPU NVIDIA g5.xlarge :

Avec cette configuration de point de terminaison, nous créons un nouveau point de terminaison SageMaker et attendons la fin du déploiement. Le statut passera à InService lorsque le déploiement est réussi.

Appelez votre modèle hébergé sur le point de terminaison SageMaker

Lorsque le point de terminaison est en cours d'exécution, nous pouvons utiliser des exemples de données brutes pour effectuer une inférence en utilisant JSON ou binaire + JSON comme format de charge utile. Pour le format de demande d'inférence, Triton utilise la norme communautaire KFServing protocoles d'inférence. Nous pouvons envoyer la demande d'inférence au point de terminaison multimodèle à l'aide de la invoke_enpoint API. Nous précisons le TargetModel dans l'appel d'invocation et transmettez la charge utile pour chaque type de modèle. Ici, nous invoquons le point de terminaison dans une boucle for pour demander au point de terminaison de charger ou décharger dynamiquement des modèles en fonction des demandes :

Vous pouvez surveiller l'état de chargement et de déchargement du modèle à l'aide de Amazon Cloud Watch métriques et journaux. Les points de terminaison multimodèles SageMaker fournissent des métriques au niveau de l'instance à surveiller ; pour plus de détails, reportez-vous à Surveillez Amazon SageMaker avec Amazon CloudWatchL’ LoadedModelCount La métrique indique le nombre de modèles chargés dans les conteneurs. Le ModelCacheHit La métrique indique le nombre d'appels au modèle qui sont déjà chargés dans le conteneur pour vous aider à obtenir des informations au niveau de l'invitation du modèle. Pour vérifier si les modèles sont déchargés de la mémoire, vous pouvez rechercher les entrées de journal déchargées avec succès dans les journaux CloudWatch du point de terminaison.

Le cahier se trouve dans le GitHub référentiel.

des pratiques d’excellence;

Avant de commencer tout effort d'optimisation avec TensorRT, il est essentiel de déterminer ce qui doit être mesuré. Sans mesures, il est impossible de faire des progrès fiables ou de mesurer si le succès a été atteint. Voici quelques bonnes pratiques à prendre en compte lors de l'utilisation du backend TensorRT pour Triton Inference Server :

- Optimisez votre modèle TensorRT – Avant de déployer un modèle sur Triton avec le backend TensorRT, assurez-vous d'optimiser le modèle en suivant le TensorRT les meilleures pratiques guide. Cela vous aidera à obtenir de meilleures performances en réduisant le temps d'inférence et la consommation de mémoire.

- Utilisez TensorRT au lieu d'autres backends Triton lorsque cela est possible - TensorRT est conçu pour optimiser les modèles d'apprentissage en profondeur pour le déploiement sur les GPU NVIDIA, de sorte que son utilisation peut améliorer considérablement les performances d'inférence par rapport à l'utilisation d'autres backends Triton pris en charge.

- Utiliser la bonne précision – TensorRT prend en charge plusieurs précisions (FP32, FP16, INT8), et la sélection de la bonne précision pour votre modèle peut avoir un impact significatif sur les performances. Envisagez d'utiliser une précision inférieure lorsque cela est possible.

- Utilisez des tailles de lot adaptées à votre matériel – Assurez-vous de choisir des tailles de lot adaptées à la mémoire et aux capacités de calcul de votre GPU. L'utilisation de tailles de lot trop grandes ou trop petites peut avoir un impact négatif sur les performances.

Conclusion

Dans cet article, nous avons approfondi le backend TensorRT que Triton Inference Server prend en charge sur SageMaker. Ce backend fournit à la fois l'accélération CPU et GPU de vos modèles TensorRT. Il existe de nombreuses options à prendre en compte pour obtenir les meilleures performances d'inférence, telles que la taille des lots, les formats d'entrée de données et d'autres facteurs qui peuvent être ajustés pour répondre à vos besoins. SageMaker vous permet de tirer parti de cette capacité en utilisant des points de terminaison à modèle unique pour des performances garanties et des points de terminaison multimodèles pour obtenir un meilleur équilibre entre performances et économies de coûts. Pour commencer avec la prise en charge de MME pour GPU, consultez Algorithmes, cadres et instances pris en charge.

Nous vous invitons à essayer les conteneurs Triton Inference Server dans SageMaker et à partager vos commentaires et questions dans les commentaires.

À propos des auteurs

Mélanie Li est un TAM spécialiste principal de l'IA/ML chez AWS basé à Sydney, en Australie. Elle aide les entreprises clientes à créer des solutions tirant parti des outils d'IA/ML de pointe sur AWS et fournit des conseils sur l'architecture et la mise en œuvre de solutions d'apprentissage automatique avec les meilleures pratiques. Dans ses temps libres, elle aime explorer la nature à l'extérieur et passer du temps avec sa famille et ses amis.

Mélanie Li est un TAM spécialiste principal de l'IA/ML chez AWS basé à Sydney, en Australie. Elle aide les entreprises clientes à créer des solutions tirant parti des outils d'IA/ML de pointe sur AWS et fournit des conseils sur l'architecture et la mise en œuvre de solutions d'apprentissage automatique avec les meilleures pratiques. Dans ses temps libres, elle aime explorer la nature à l'extérieur et passer du temps avec sa famille et ses amis.

James Park est architecte de solutions chez Amazon Web Services. Il travaille avec Amazon pour concevoir, créer et déployer des solutions technologiques sur AWS, et s'intéresse particulièrement à l'IA et à l'apprentissage automatique. Dans ses temps libres, il aime découvrir de nouvelles cultures, de nouvelles expériences et se tenir au courant des dernières tendances technologiques.

James Park est architecte de solutions chez Amazon Web Services. Il travaille avec Amazon pour concevoir, créer et déployer des solutions technologiques sur AWS, et s'intéresse particulièrement à l'IA et à l'apprentissage automatique. Dans ses temps libres, il aime découvrir de nouvelles cultures, de nouvelles expériences et se tenir au courant des dernières tendances technologiques.

Jia Hong Liu est architecte de solutions au sein de l'équipe Cloud Service Provider de NVIDIA. Il aide les clients à adopter des solutions d'apprentissage automatique et d'IA qui tirent parti de l'informatique accélérée de NVIDIA pour relever leurs défis de formation et d'inférence. Dans ses temps libres, il aime l'origami, les projets de bricolage et jouer au basket.

Jia Hong Liu est architecte de solutions au sein de l'équipe Cloud Service Provider de NVIDIA. Il aide les clients à adopter des solutions d'apprentissage automatique et d'IA qui tirent parti de l'informatique accélérée de NVIDIA pour relever leurs défis de formation et d'inférence. Dans ses temps libres, il aime l'origami, les projets de bricolage et jouer au basket.

Kshitiz Gupta est architecte de solutions chez NVIDIA. Il aime éduquer les clients du cloud sur les technologies GPU AI que NVIDIA a à offrir et les aider à accélérer leurs applications d'apprentissage automatique et d'apprentissage en profondeur. En dehors du travail, il aime courir, faire de la randonnée et observer la faune.

Kshitiz Gupta est architecte de solutions chez NVIDIA. Il aime éduquer les clients du cloud sur les technologies GPU AI que NVIDIA a à offrir et les aider à accélérer leurs applications d'apprentissage automatique et d'apprentissage en profondeur. En dehors du travail, il aime courir, faire de la randonnée et observer la faune.

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- PlatoAiStream. Intelligence des données Web3. Connaissance Amplifiée. Accéder ici.

- Frapper l'avenir avec Adryenn Ashley. Accéder ici.

- Achetez et vendez des actions de sociétés PRE-IPO avec PREIPO®. Accéder ici.

- La source: https://aws.amazon.com/blogs/machine-learning/host-ml-models-on-amazon-sagemaker-using-triton-tensorrt-models/

- :possède

- :est

- :ne pas

- :où

- $UP

- 1

- 10

- 100

- 11

- 12

- 13

- 23

- 30

- 7

- 8

- a

- Capable

- A Propos

- accélérer

- accéléré

- accélérer

- accès

- précision

- atteindre

- atteint

- à travers

- Action

- ajout

- Supplémentaire

- En outre

- propos

- adresser

- L'adoption d'

- Avantage

- Après

- AI

- AI / ML

- algorithme

- algorithmes

- Tous

- permettre

- permet

- le long de

- déjà

- aussi

- Bien que

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- an

- et les

- tous

- api

- Application

- applications

- approprié

- architecture

- SONT

- autour

- AS

- aide

- At

- Australie

- auto

- automatiquement

- disponibles

- éviter

- AWS

- backend

- Balance

- base

- basé

- Essentiel

- base

- Basketball

- BE

- car

- était

- before

- commencer

- Début

- derrière

- va

- avantageux

- bénéficier

- LES MEILLEURS

- les meilleures pratiques

- Améliorée

- jusqu'à XNUMX fois

- corps

- tous les deux

- construire

- constructeur

- construit

- mais

- by

- Cache

- Appelez-nous

- appelé

- CAN

- capacités

- Compétences

- les soins

- maisons

- cas

- globaux

- Change

- en changeant

- caractéristiques

- vérifier

- Selectionnez

- client

- CLIENTS

- le cloud

- Grappe

- code

- COM

- combinaison

- combiné

- comment

- commentaires

- Communautés

- par rapport

- complet

- calcul

- calcul

- informatique

- configuration

- Considérer

- Qui consiste

- consommation

- Contenant

- Conteneurs

- contient

- continue

- des bactéries

- convertir

- Core

- Correspondant

- Prix

- les économies de coûts

- engendrent

- créée

- crée des

- La création

- création

- critères

- crucial

- Clients

- données

- Date

- décision

- profond

- l'apprentissage en profondeur

- Définit

- retarder

- différé

- offre

- démontre

- déployer

- déployé

- déployer

- déploiement

- décrit

- Conception

- un

- détails

- Déterminer

- détermine

- développer

- développé

- différent

- Dimension

- Bricolage

- Documentation

- fait

- Ne pas

- où

- téléchargements

- véritable

- deux

- pendant

- Dynamic

- dynamiquement

- chacun

- même

- Edge

- l'éducation

- efficace

- efficacement

- effort

- non plus

- emploie

- permettre

- permet

- permettant

- Endpoint

- Moteur

- Moteurs

- Entreprise

- Environment

- environnements

- égal

- essential

- essentiellement

- exemple

- exception

- attendre

- attend

- Expériences

- explorez

- facteurs

- équitablement

- famille

- plus rapide

- Fonctionnalité

- Réactions

- champ

- Des champs

- Déposez votre dernière attestation

- Fichiers

- ailette

- finalement

- finition

- Prénom

- s'adapter

- flexible

- Abonnement

- suit

- numérique

- Pour

- formulaire

- le format

- trouvé

- Framework

- cadres

- gratuitement ici

- fréquemment

- amis

- De

- fonction

- fonctions

- plus

- la fusion

- généralement

- générer

- généré

- obtenez

- Donner

- donné

- donne

- GPU

- GPU

- graphique

- l'

- plus grand

- Réservation de groupe

- Groupes

- garantie

- l'orientation

- guide

- manipuler

- Matériel

- Vous avez

- ayant

- he

- vous aider

- aide

- ici

- ici

- Haute

- haute performance

- augmentation

- sa

- horizontalement

- hôte

- organisé

- hébergement

- Comment

- How To

- Cependant

- HTML

- http

- HTTPS

- i

- ID

- Identite

- if

- illustre

- image

- Impact

- Impacts

- Mettre en oeuvre

- la mise en œuvre

- met en oeuvre

- importer

- impossible

- améliorer

- amélioré

- amélioration

- améliorations

- l'amélioration de

- in

- comprendre

- inclut

- Nouveau

- croissant

- incrément

- indiquer

- indique

- d'information

- Actualités

- contribution

- entrées

- idées.

- instabilité

- installer

- Installé

- instance

- plutôt ;

- intérêt

- développement

- nous invitons les riders XCO et DH à rouler sur nos pistes haute performance, et leurs supporters à profiter du spectacle. Pour le XNUMXe anniversaire, nous visons GRAND ! Vous allez vouloir être là ! Nous accueillerons la légendaire traversée de l'étant avec de la musique en direct ! Nous aurons également des divertissements pour les jeunes et les jeunes de cœur pendant l'après-midi. Vous ne voudrez pas manquer ça !

- invoqué

- IT

- SES

- rejoindre

- jpg

- json

- ACTIVITES

- Genre

- Savoir

- langue

- gros

- plus importantes

- Latence

- Nouveautés

- lance

- couche

- poules pondeuses

- Disposition

- APPRENTISSAGE

- apprentissage

- au

- Levier

- en tirant parti

- Bibliothèque

- limité

- Gamme

- charge

- chargement

- charges

- enregistrer

- logique

- Style

- Faible

- baisser

- click

- machine learning

- Entrée

- maintient

- majeur

- a prendre une

- gérés

- gestion

- de nombreuses

- Match

- maximisant

- maximales

- Mai..

- mesurer

- des mesures

- Découvrez

- Mémoire

- Métadonnées

- méthode

- méthodes

- métrique

- Métrique

- pourrait

- Minutes

- ML

- Mode

- modèle

- numériques jumeaux (digital twin models)

- modifier

- Surveiller

- PLUS

- (en fait, presque toutes)

- Point de terminaison multimodèle

- plusieurs

- must

- prénom

- noms

- nommage

- Nature

- Traitement du langage naturel

- Nature

- Besoin

- Besoins

- négativement

- réseaux

- Nouveauté

- nlp

- cahier

- maintenant

- nombre

- Nvidia

- objet

- obtenir

- of

- code

- on

- ONE

- ouvert

- Opérations

- optimaux

- à mettre en œuvre pour gérer une entreprise rentable. Ce guide est basé sur trois décennies d'expérience

- Optimiser

- optimisé

- Optimise

- Options

- or

- de commander

- OS

- Autre

- Autres

- nos

- ande

- l'extérieur

- sortie

- au contrôle

- global

- propre

- paquet

- Parallèle

- partie

- particulier

- pass

- passé

- passes

- chemin

- Courant

- Effectuer

- performant

- effectue

- pipeline

- plan

- plateforme

- Plateformes

- Platon

- Intelligence des données Platon

- PlatonDonnées

- jouer

- des notes bonus

- politiques

- politique

- possible

- Post

- solide

- pratiques

- La précision

- Prévisible

- Prédictions

- en train de préparer

- précédent

- précédemment

- prix

- primaire

- Traité

- traitement

- produire

- Vidéo

- Profils

- Progrès

- projets

- correct

- propriété

- Proto

- fournir

- à condition de

- de voiture.

- fournit

- disposition

- des fins

- pytorch

- fréquemment posées

- vite.

- augmenter

- aléatoire

- raw

- nous joindre

- reçoit

- recommander

- Prix Réduit

- réduit

- réduire

- région

- fiable

- dépôt

- représentation

- représentation

- représente

- nécessaire

- demandes

- conditions

- Exigences

- a besoin

- ressource

- Resources

- réponse

- Résultats

- Rôle

- Itinéraire

- routes

- rt

- Courir

- pour le running

- s

- sagemaker

- Saïd

- même

- Épargnez

- Épargnes

- Escaliers intérieurs

- Balance

- mise à l'échelle

- ordonnancement

- scripts

- Sdk

- Section

- les sections

- sur le lien

- recherche

- la sélection

- envoyer

- supérieur

- sens

- séparé

- besoin

- sert

- service

- Prestataire de services

- Services

- service

- set

- mise

- Paramétres

- plusieurs

- Forme

- formes

- mise en forme

- Partager

- commun

- partage

- elle

- devrait

- Spectacles

- significative

- de façon significative

- similaires

- étapes

- unique

- Taille

- tailles

- petit

- PME

- So

- sur mesure

- Solutions

- quelques

- quelque chose

- Identifier

- spécialiste

- groupe de neurones

- spécification

- caractéristiques

- spécifié

- passer

- Standard

- j'ai commencé

- Commencez

- state-of-the-art

- Statut

- stable

- étapes

- Étapes

- storage

- simple

- flux

- structure

- succès

- réussi

- tel

- Combinaison

- Support

- Appareils

- Les soutiens

- sydney

- Prenez

- prend

- Target

- équipe

- techniques

- Les technologies

- Technologie

- que

- qui

- Le

- Le graphique

- les informations

- leur

- Les

- puis

- Là.

- donc

- Ces

- l'ont

- penser

- this

- ceux

- trois

- Avec

- fiable

- fois

- timing

- à

- trop

- outil

- les outils

- haut niveau

- torche

- circulation

- qualifié

- Formation

- Transactions

- transféré

- transferts

- Transformer

- transformateurs

- Trends

- Triton

- type

- débutante

- typiquement

- comprendre

- expérience unique et authentique

- téléchargé

- us

- Utilisation

- utilisé

- cas d'utilisation

- d'utiliser

- en utilisant

- utilitaire

- utiliser

- Plus-value

- divers

- version

- très

- via

- le volume

- attendez

- Attendre

- souhaitez

- était

- personne(s) regarde(nt) cette fiche produit

- Façon..

- façons

- we

- web

- services Web

- ont été

- Quoi

- quand

- que

- qui

- sera

- comprenant

- dans les

- sans

- activités principales

- vos contrats

- pourra

- Vous n'avez

- Votre

- zéphyrnet