Chaque organisation possède son propre ensemble de normes et de pratiques qui assurent la sécurité et la gouvernance de son environnement AWS. Amazon Sage Maker est un service entièrement géré pour préparer les données et créer, former et déployer des modèles d'apprentissage automatique (ML) pour tous les cas d'utilisation avec une infrastructure, des outils et des flux de travail entièrement gérés. SageMaker fournit un ensemble de modèles pour les organisations qui souhaitent démarrer rapidement avec les flux de travail ML et les pipelines d'intégration et de livraison continues DevOps (CI/CD).

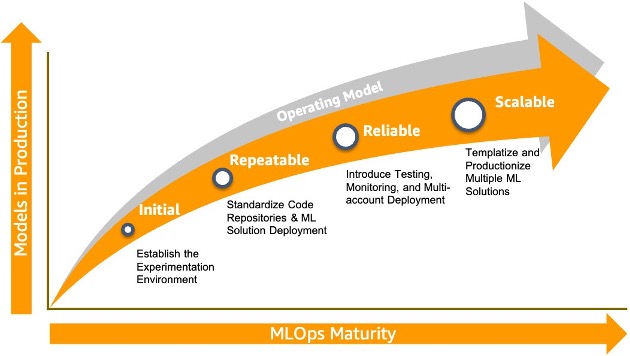

La majorité des entreprises clientes ont déjà une pratique MLOps bien établie avec un environnement standardisé en place (par exemple, un référentiel, une infrastructure et des garde-corps de sécurité standardisés) et souhaitent étendre leur processus MLOps aux outils AutoML sans code et à faible code. aussi. Ils ont également de nombreux processus qui doivent être respectés avant de promouvoir un modèle en production. Ils recherchent un moyen simple et rapide de passer de la phase initiale à une phase d'exploitation reproductible, fiable et éventuellement évolutive, comme indiqué dans le schéma suivant. Pour plus d'informations, reportez-vous à Feuille de route de la fondation MLOps pour les entreprises avec Amazon SageMaker.

Bien que ces entreprises disposent de solides équipes de science des données et de MLOps pour les aider à créer des pipelines fiables et évolutifs, elles souhaitent que leurs utilisateurs d'outils AutoML low-code produisent du code et des artefacts de modèle d'une manière qui puisse être intégrée à leurs pratiques standardisées, en respectant leurs structure de référentiel de code et avec les validations, tests, étapes et approbations appropriés.

Ils recherchent un mécanisme permettant aux outils low-code de générer tout le code source pour chaque étape des tâches AutoML (prétraitement, formation et post-traitement) dans une structure de référentiel standardisée qui puisse fournir à leurs spécialistes des données la possibilité de visualiser , valider et modifier le flux de travail selon leurs besoins, puis générer un modèle de pipeline personnalisé qui peut être intégré dans un environnement standardisé (où ils ont défini leur référentiel de code, leurs outils de génération de code et leurs processus).

Cet article montre comment avoir un processus reproductible avec des outils low-code comme Pilote automatique Amazon SageMaker afin qu'il puisse être intégré de manière transparente dans votre environnement, vous n'avez donc pas à orchestrer ce flux de travail de bout en bout par vous-même. Nous montrons comment utiliser CI/CD le code des outils low-code/no-code pour l'intégrer dans votre environnement MLOps, tout en respectant les meilleures pratiques MLOps.

Vue d'ensemble de la solution

Pour démontrer le flux de travail orchestré, nous utilisons le public disponible Ensemble de données sur le revenu du recensement des adultes de l'UCI de 1994 pour prédire si une personne a un revenu annuel supérieur à 50,000 50,000 $ par année. Il s'agit d'un problème de classification binaire ; les options pour la variable cible de revenu sont soit supérieures à 50,000 XNUMX $, soit inférieures à XNUMX XNUMX $.

Le tableau suivant résume les éléments clés de l'ensemble de données.

| Caractéristiques de l'ensemble de données | Multivarié | Nombre d'instances | 48842 | Région | Réseaux sociaux |

| Caractéristiques des attributs : | Catégoriel, Entier | Nombre d'attributs : | 14 | Date du don | 1996-05-01 |

| Tâches associées : | Classification | Valeurs manquantes ? | Oui | Nombre de visites Web | 2749715 |

Le tableau suivant résume les informations d'attribut.

| Nom de colonne | Description |

| Âge | Cyber reconnaissance |

| classe ouvrière | Privé, Auto-emploi-pas-inc, Auto-emploi-inc, Fédéral-gouvernement, Local-gouvernement, État-gouvernement, Sans salaire, N'a jamais travaillé |

| fnlwgt | continu |

| l'éducation | Licence, Some-collège, 11ème, HS-grad, Prof-école, Assoc-acdm, Assoc-voc, 9ème, 7ème-8ème, 12ème, Master, 1ère-4ème, 10ème, Doctorat, 5ème-6ème, Préscolaire. |

| éducation-num | continu |

| état civil | Marié-civ-conjoint, Divorcé, Célibataire, Séparé, Veuf, Marié-conjoint-absent, Marié-AF-conjoint. |

| occupation | ech-support, Craft-reparation, Other-service, Sales, Exec-managerial, Prof-specialty, Handlers-cleaners, Machine-op-inspct, Adm-clerical, Farming-fishing, Transport-moving, Priv-house-serv, Service de protection, Forces armées |

| relation amoureuse | Épouse, propre enfant, époux, hors famille, autre parent, célibataire. |

| breed | Blanc, Asiatique-Pac-Insulaire, Amer-Indien-Esquimau, Autre, Noir |

| sexe | Femelle mâle |

| plus-value | Cyber reconnaissance |

| capital perte | Cyber reconnaissance |

| heures par semaine | Cyber reconnaissance |

| pays d'origine | États-Unis, Cambodge, Angleterre, Porto-Rico, Canada, Allemagne, Périphérie des États-Unis (Guam-USVI-etc), Inde, Japon, Grèce, Sud, Chine, Cuba, Iran, Honduras, Philippines, Italie, Pologne, Jamaïque , Vietnam, Mexique, Portugal, Irlande, France, République-Dominicaine, Laos, Equateur, Taïwan, Haïti, Colombie, Hongrie, Guatemala, Nicaragua, Ecosse, Thaïlande, Yougoslavie, El-Salvador, Trinité-et-Tobago, Pérou, Hong, Hollande-Pays-Bas . |

| classe | Catégorie de revenu, soit <=50K ou >=50K |

Dans cet article, nous montrons comment utiliser Amazon SageMaker Projects, un outil qui aide les organisations à configurer et à standardiser des environnements pour MLOps avec des outils AutoML à faible code comme Autopilot et Gestionnaire de données Amazon SageMaker.

Le pilote automatique élimine les tâches lourdes liées à la construction de modèles ML. Il vous suffit de fournir un ensemble de données tabulaires et de sélectionner la colonne cible à prédire, et Autopilot explorera automatiquement différentes solutions pour trouver le meilleur modèle. Vous pouvez ensuite déployer directement le modèle en production en un seul clic ou itérer sur les solutions recommandées pour améliorer encore la qualité du modèle.

Data Wrangler fournit une solution de bout en bout pour importer, préparer, transformer, caractériser et analyser des données. Vous pouvez intégrer un flux de préparation de données Data Wrangler dans vos flux de travail ML pour simplifier et rationaliser le prétraitement des données et l'ingénierie des fonctionnalités en utilisant peu ou pas de codage. Vous pouvez également ajouter vos propres scripts et transformations Python pour personnaliser les workflows. Nous utilisons Data Wrangler pour effectuer un prétraitement sur l'ensemble de données avant de soumettre les données à Autopilot.

SageMaker Projects aide les organisations à configurer et à standardiser des environnements pour automatiser différentes étapes impliquées dans un cycle de vie ML. Bien que les blocs-notes soient utiles pour la création de modèles et l'expérimentation, une équipe de scientifiques des données et d'ingénieurs ML partageant du code a besoin d'un moyen plus évolutif pour maintenir la cohérence du code et un contrôle strict des versions.

Pour vous aider à démarrer avec les paradigmes courants de création et de déploiement de modèles, SageMaker Projects propose un ensemble de modèles propriétaires (modèles 1P). Les modèles 1P se concentrent généralement sur la création de ressources pour la création de modèles et la formation de modèles. Les modèles incluent des projets qui utilisent des services natifs AWS pour CI/CD, tels que Création de code AWS et les AWS CodePipeline. Les projets SageMaker peuvent prendre en charge des offres de modèles personnalisés, où les organisations utilisent un AWS CloudFormation modèle pour exécuter une pile Terraform et créer les ressources nécessaires à un flux de travail ML.

Les organisations peuvent souhaiter étendre les modèles 1P pour prendre en charge des cas d'utilisation au-delà de la simple formation et du déploiement de modèles. Modèles de projets personnalisés sont un moyen pour vous de créer un flux de travail standard pour les projets ML. Vous pouvez créer plusieurs modèles et utiliser Gestion des identités et des accès AWS (IAM) pour gérer l'accès à ces modèles sur Amazon SageMakerStudio, garantissant que chacun de vos utilisateurs accède à des projets dédiés à ses cas d'utilisation.

Pour en savoir plus sur les projets SageMaker et sur la création de modèles de projet personnalisés alignés sur les meilleures pratiques, reportez-vous à Créer des modèles de projet SageMaker personnalisés – Meilleures pratiques.

Ces modèles personnalisés sont créés en tant que Catalogue de services AWS produits et provisionnés en tant que modèles d'organisation sur l'interface utilisateur de Studio. C'est là que les scientifiques des données peuvent choisir un modèle et faire démarrer et préconfigurer leur flux de travail ML. Les projets sont provisionnés à l'aide des produits AWS Service Catalog. Les modèles de projet sont utilisés par les organisations pour provisionner des projets pour chacune de leurs équipes.

Dans cet article, nous montrons comment créer un modèle de projet personnalisé pour avoir un flux de travail MLOps de bout en bout à l'aide de projets SageMaker, AWS Service Catalog et Pipelines Amazon SageMaker intégrer Data Wrangler et Autopilot avec des humains dans la boucle afin de faciliter les étapes de formation et de déploiement du modèle. Les humains impliqués dans la boucle sont les différentes personnes impliquées dans une pratique MLOps travaillant en collaboration pour un workflow de création et de déploiement ML réussi.

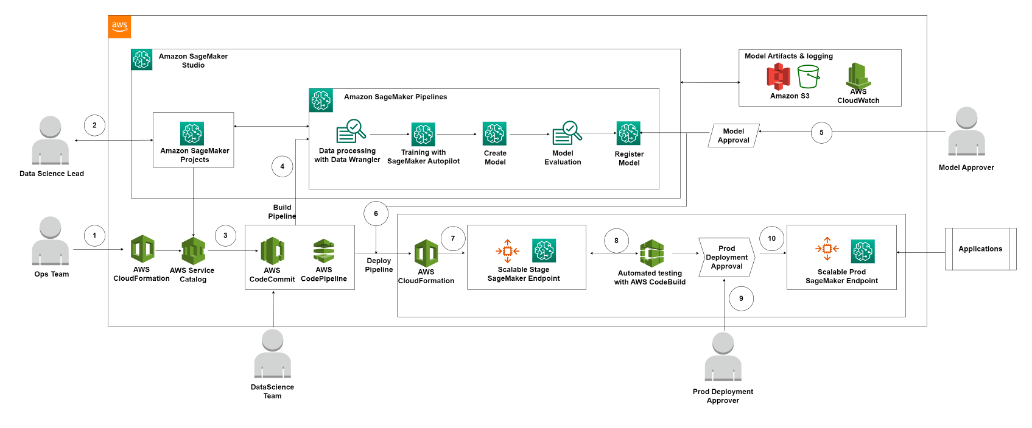

Le diagramme suivant illustre le workflow d'automatisation low-code/no-code de bout en bout.

Le workflow comprend les étapes suivantes:

- L'équipe Ops ou l'équipe Platform lance le modèle CloudFormation pour configurer les prérequis requis pour provisionner le modèle SageMaker personnalisé.

- Lorsque le modèle est disponible dans SageMaker, le Data Science Lead utilise le modèle pour créer un projet SageMaker.

- La création du projet SageMaker lancera un produit AWS Service Catalog qui ajoute deux codes de départ au Code AWSCommit référentiels :

- Le code source du pipeline de création de modèle inclut un pipeline qui prétraite le Jeu de données UCI Machine Learning Adulte à l'aide de Data Wrangler, crée automatiquement un modèle ML avec une visibilité complète à l'aide d'Autopilot, évalue les performances d'un modèle à l'aide d'une étape de traitement et enregistre le modèle dans un registre de modèles en fonction des performances du modèle.

- Le code de départ pour le déploiement du modèle inclut une étape CodeBuild pour rechercher le dernier modèle qui a été approuvé dans le registre de modèles et créer des fichiers de configuration pour déployer les modèles CloudFormation dans le cadre des pipelines CI/CD à l'aide de CodePipeline. Le modèle CloudFormation déploie le modèle dans des environnements intermédiaires et de production.

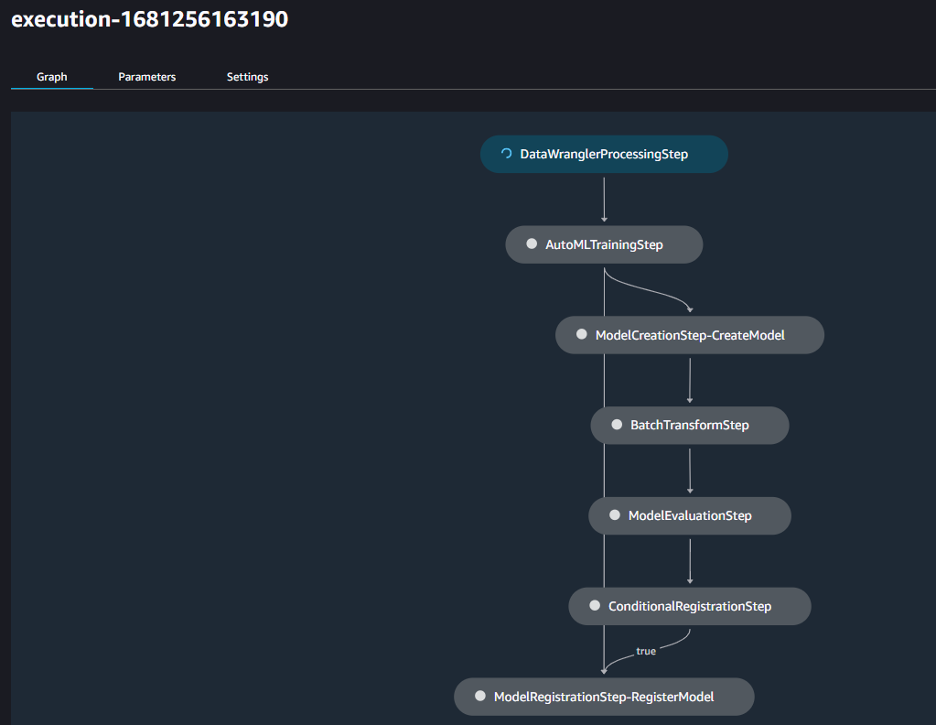

- La première validation de code de départ démarre un pipeline CI/CD à l'aide de CodePipeline qui déclenche un pipeline SageMaker, qui est une série d'étapes interconnectées codées à l'aide d'un graphe acyclique dirigé (DAG). Dans ce cas, les étapes à suivre sont informatique en utilisant un flux Data Wrangler, former le modèle à l'aide du pilote automatique, création du modèle, l'évaluation du modèle, et si l'évaluation est réussie, enregistrement du modèle.

Pour plus de détails sur la création de pipelines SageMaker à l'aide d'Autopilot, reportez-vous à Lancez des expériences Amazon SageMaker Autopilot directement depuis Amazon SageMaker Pipelines pour automatiser facilement les workflows MLOps.

- Une fois le modèle enregistré, l'approbateur du modèle peut approuver ou rejeter le modèle dans Studio.

- Lorsque le modèle est approuvé, un pipeline de déploiement CodePipeline intégré au deuxième code de départ est déclenché.

- Ce pipeline crée un point de terminaison évolutif sans serveur SageMaker pour l'environnement intermédiaire.

- Il existe une étape de test automatisée dans le pipeline de déploiement qui sera testée sur le point de terminaison intermédiaire.

- Les résultats des tests sont stockés dans Service de stockage simple Amazon (Amazon S3). Le pipeline s'arrêtera pour un approbateur de déploiement en production, qui pourra examiner tous les artefacts avant d'approuver.

- Une fois approuvé, le modèle est déployé en production sous la forme d'un point de terminaison sans serveur évolutif. Les applications de production peuvent désormais utiliser le point de terminaison pour l'inférence.

Les étapes de déploiement consistent en les éléments suivants :

- Créez le modèle de projet SageMaker personnalisé pour Autopilot et d'autres ressources à l'aide d'AWS CloudFormation. Il s'agit d'une tâche de configuration unique.

- Créez le projet SageMaker à l'aide du modèle personnalisé.

Dans les sections suivantes, nous procédons à chacune de ces étapes plus en détail et explorons la page des détails du projet.

Pré-requis

Cette procédure pas à pas inclut les prérequis suivants :

Créer des ressources de solution avec AWS CloudFormation

Vous pouvez télécharger et lancer le Modèle CloudFormation via la console AWS CloudFormation, le Interface de ligne de commande AWS (AWS CLI), le SDK, ou en choisissant simplement Lancer la pile:

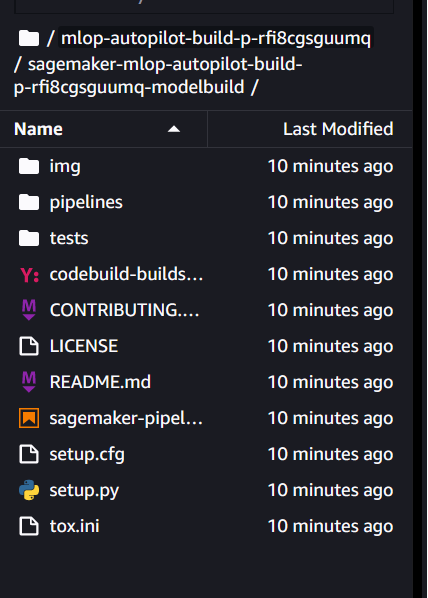

Le modèle CloudFormation est également disponible dans le Référentiel AWS Samples GitHub Code. Le référentiel contient les éléments suivants :

- A Modèle CloudFormation pour configurer le modèle de projet SageMaker personnalisé pour Autopilot

- Code de semence avec le code ML pour configurer les pipelines SageMaker afin d'automatiser les étapes de traitement des données et de formation

- A dossier de projet pour le modèle CloudFormation utilisé par AWS Service Catalog mappé au modèle de projet SageMaker personnalisé qui sera créé

Le modèle CloudFormation prend plusieurs paramètres en entrée.

Voici les paramètres d'informations sur les produits AWS Service Catalog :

- Nom du produit – Le nom du produit AWS Service Catalog auquel le modèle MLOps personnalisé du projet SageMaker sera associé

- Déscription – La description du produit AWS Service Catalog

- CPO – Le propriétaire du produit Service Catalog

- Distributeur de produits – Le distributeur du produit Service Catalog

Voici les paramètres d'informations de support produit AWS Service Catalog :

- Description de l'assistance produit – Une description de support pour ce produit

- E-mail d'assistance produit – Une adresse e-mail de l'équipe prenant en charge le produit AWS Service Catalog

- URL d'assistance produit – Une URL de support pour le produit AWS Service Catalog

Voici les paramètres de configuration du référentiel de code source :

- URL vers la version compressée de votre référentiel GitHub – Utilisez les valeurs par défaut si vous ne bifurquez pas le référentiel AWS Samples.

- Nom et branche de votre référentiel GitHub – Ceux-ci doivent correspondre au dossier racine du zip. Utilisez les valeurs par défaut si vous ne bifurquez pas le référentiel AWS Samples.

- StudioUserExecutionRoleStudioUserExecutionRole – Fournissez l'ARN du rôle IAM d'exécution de l'utilisateur Studio.

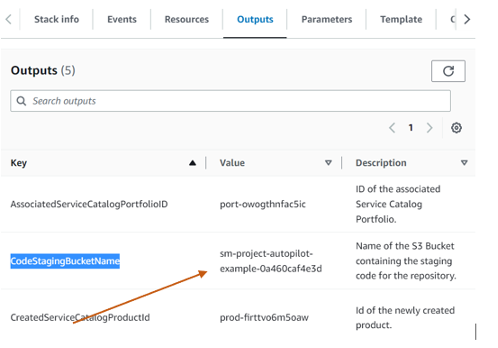

Après avoir lancé la pile CloudFormation à partir de ce modèle, vous pouvez surveiller son état sur la console AWS CloudFormation.

Lorsque la pile est complète, copiez la valeur du CodeStagingBucketName clé sur le Sortie de la pile CloudFormation et enregistrez-le dans un éditeur de texte pour l'utiliser ultérieurement.

Créer le projet SageMaker à l'aide du nouveau modèle personnalisé

Pour créer votre projet SageMaker, procédez comme suit :

- Connectez-vous à Studio. Pour plus d'informations, voir Intégration au domaine Amazon SageMaker.

- Dans la barre latérale de Studio, choisissez l'icône d'accueil.

- Selectionnez Déploiements dans le menu, puis choisissez Projets.

- Selectionnez Créer un projet.

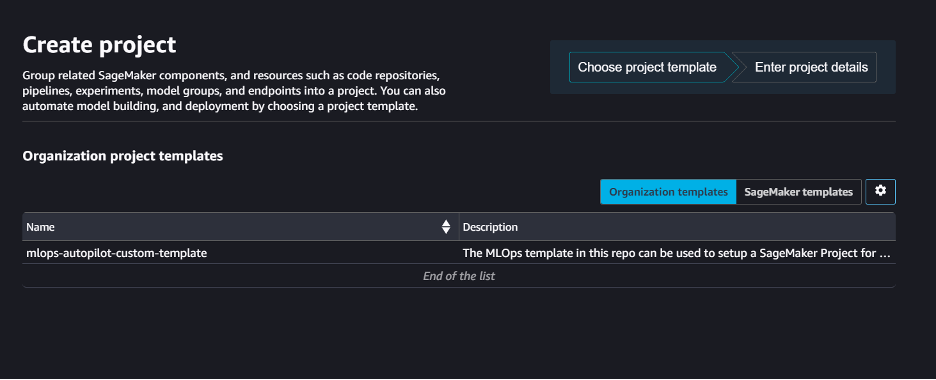

- Selectionnez Modèles d'organisation pour afficher le nouveau modèle MLOps personnalisé.

- Selectionnez Sélectionnez un modèle de projet.

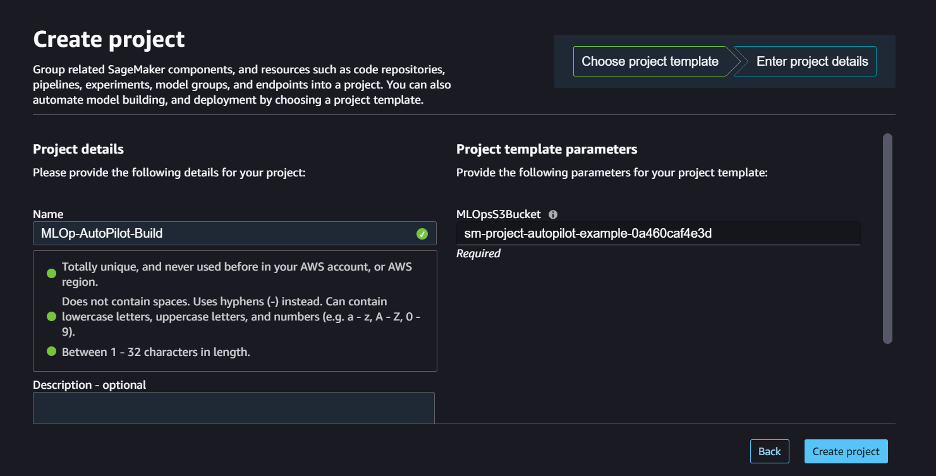

- Pour Détails du projet, entrez un nom et une description pour votre projet.

- Pour MLOpsS3Bucket, entrez le nom du compartiment S3 que vous avez enregistré précédemment.

- Selectionnez Créer un projet.

Un message s'affiche indiquant que SageMaker provisionne et configure les ressources.

Lorsque le projet est terminé, vous recevez un message de réussite et votre projet est maintenant répertorié sur le Projets liste.

Explorer les détails du projet

Sur la page des détails du projet, vous pouvez afficher divers onglets associés au projet. Plongeons en détail dans chacun de ces onglets.

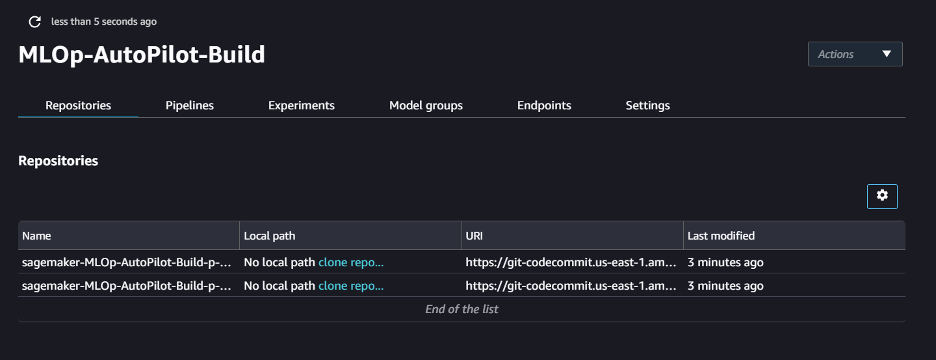

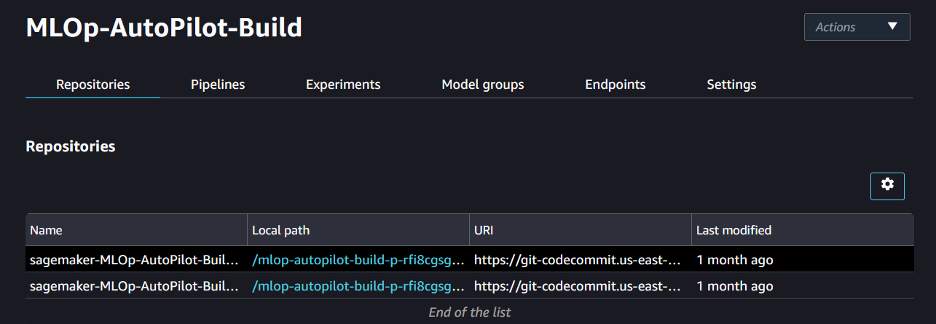

Dépôts

Cet onglet répertorie les référentiels de code associés à ce projet. Tu peux choisir dépôt de clonage sous Chemin local pour cloner les deux référentiels de code source créés dans CodeCommit par le projet SageMaker. Cette option vous fournit un accès Git aux référentiels de code du projet SageMaker lui-même.

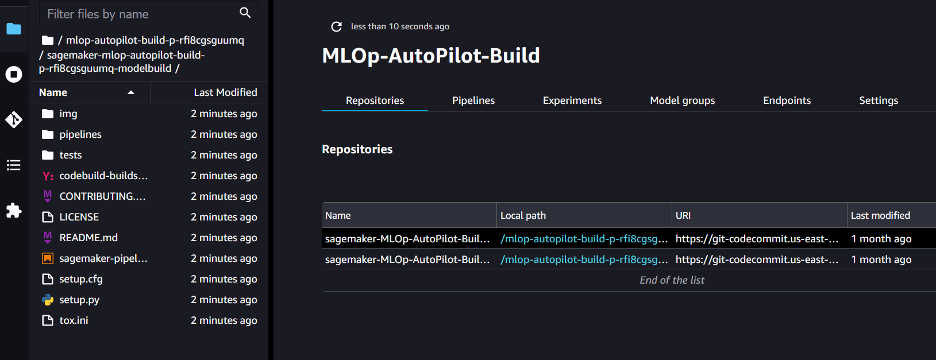

Lorsque le clonage du référentiel est terminé, le chemin local apparaît dans le Chemin local colonne. Vous pouvez choisir le chemin pour ouvrir le dossier local qui contient le code du référentiel dans Studio.

Le dossier sera accessible dans le volet de navigation. Vous pouvez utiliser l'icône du navigateur de fichiers pour masquer ou afficher la liste des dossiers. Vous pouvez apporter les modifications de code ici ou choisir l'icône Git pour mettre en scène, valider et pousser la modification.

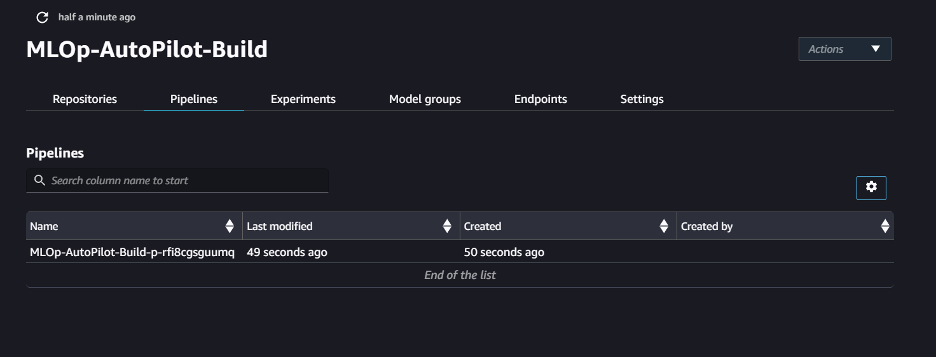

Pipelines

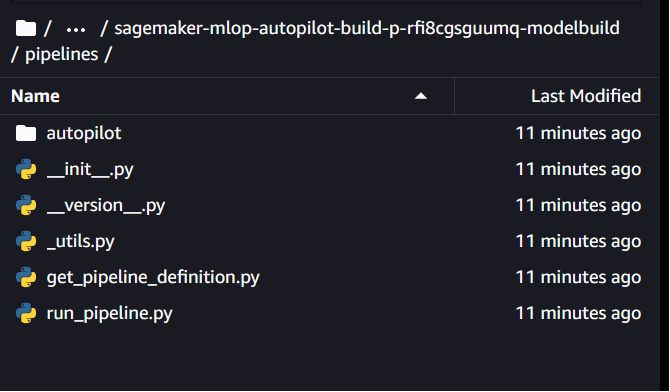

Cet onglet répertorie les pipelines SageMaker ML qui définissent les étapes de préparation des données, de formation des modèles et de déploiement des modèles. Pour plus d'informations sur les pipelines SageMaker ML, voir Créer et gérer des pipelines SageMaker.

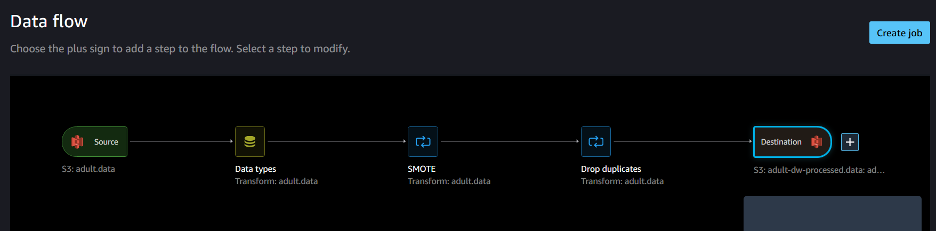

Vous pouvez choisir le pipeline en cours d'exécution pour voir son dernier état. Dans l'exemple suivant, l'étape DataProcessing est effectuée à l'aide d'un flux de données Data Wrangler.

Vous pouvez accéder au flux de données à partir du chemin local du référentiel de code que nous avons cloné précédemment. Choisissez l'icône du navigateur de fichiers pour afficher le chemin, qui est répertorié dans le pipelines dossier du référentiel de construction du modèle.

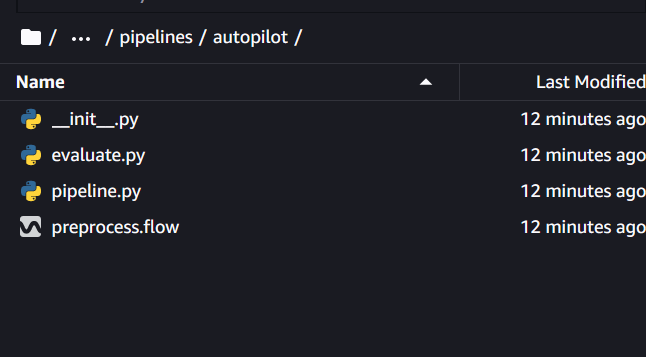

Dans le pipelines dossier, ouvrez le dossier du pilote automatique.

Dans le autopilot dossier, ouvrez le preprocess.flow fichier.

L'ouverture du flux Data Wrangler prendra un moment.

Dans cet exemple, trois transformations de données sont effectuées entre la source et la destination. Vous pouvez choisir chaque transformation pour voir plus de détails.

Pour savoir comment inclure ou supprimer des transformations dans Data Wrangler, reportez-vous à Transformer les données.

Pour plus d'informations, reportez-vous à Préparation unifiée des données et formation des modèles avec Amazon SageMaker Data Wrangler et Amazon SageMaker Autopilot - Partie 1.

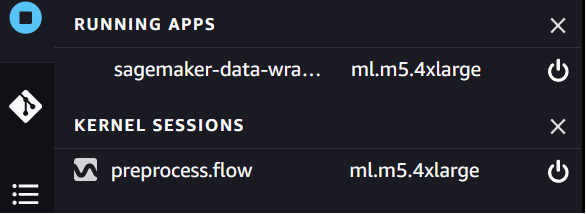

Lorsque vous avez terminé l'examen, choisissez l'icône d'alimentation et arrêtez les ressources Data Wrangler sous Applications en marche et les Sessions du noyau.

Expériences

Cet onglet répertorie les expériences Autopilot associées au projet. Pour plus d'informations sur le pilote automatique, consultez Automatisez le développement de modèles avec Amazon SageMaker Autopilot.

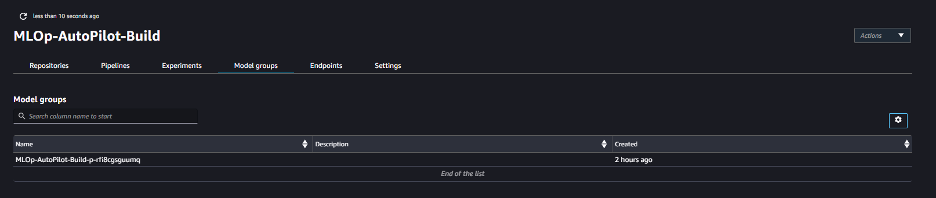

Groupes de modèles

Cet onglet répertorie les groupes de versions de modèle qui ont été créés par des exécutions de pipeline dans le projet. Lorsque l'exécution du pipeline est terminée, le modèle créé à partir de la dernière étape du pipeline sera accessible ici.

Vous pouvez choisir le groupe de modèles pour accéder à la dernière version du modèle.

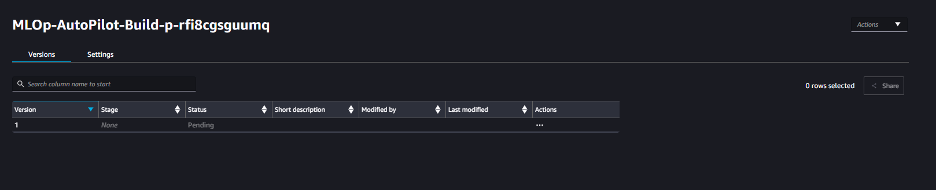

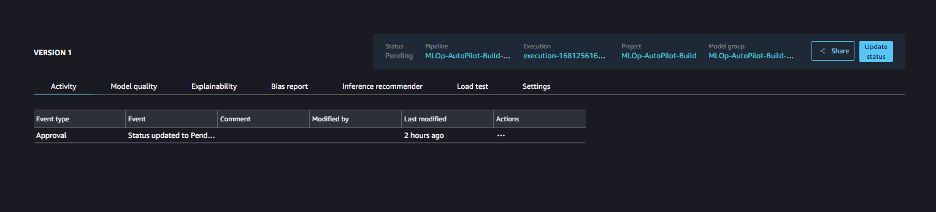

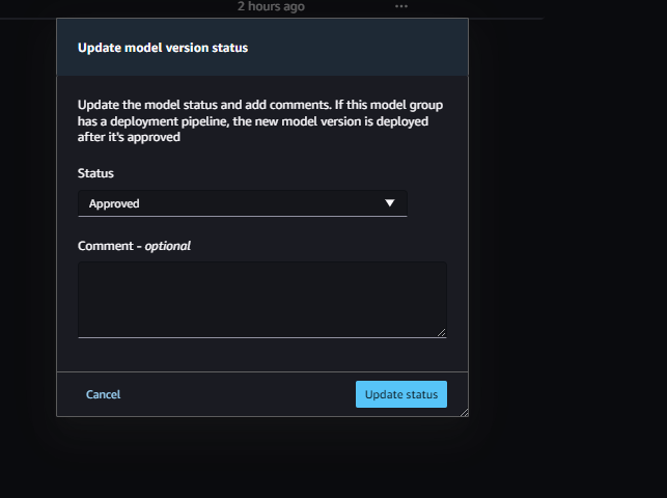

Le statut de la version du modèle dans l'exemple suivant est En Attente. Vous pouvez choisir la version du modèle et choisir État de mise à jour pour mettre à jour le statut.

Selectionnez A approuvé et choisissez État de mise à jour pour approuver le modèle.

Une fois le statut du modèle approuvé, le pipeline CI/CD de déploiement du modèle dans CodePipeline démarre.

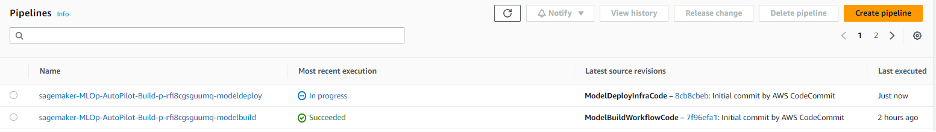

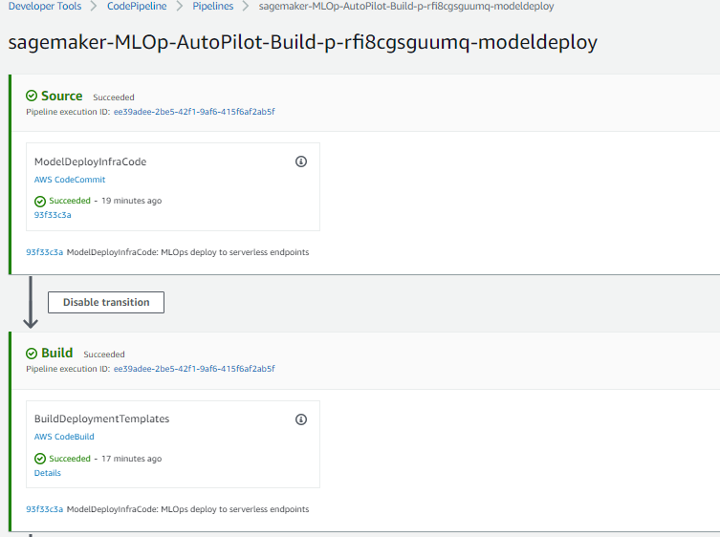

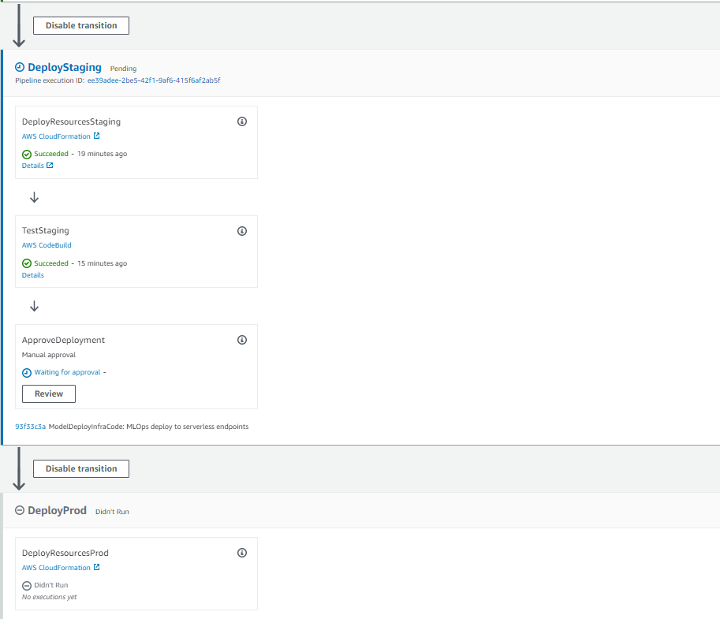

Vous pouvez ouvrir le pipeline déployé pour voir les différentes étapes du dépôt.

Comme illustré dans la capture d'écran précédente, ce pipeline comporte quatre étapes :

- Identifier – À cette étape, CodePipeline vérifie le code du référentiel CodeCommit dans le compartiment S3.

- Développer – À cette étape, les modèles CloudFormation sont préparés pour le déploiement du code modèle.

- Déployer la mise en scène – Cette étape se compose de trois sous-étapes :

- DéployerRessourcesStaging – Dans la première sous-étape, la pile CloudFormation est déployée pour créer un point de terminaison SageMaker sans serveur dans l'environnement de mise en scène.

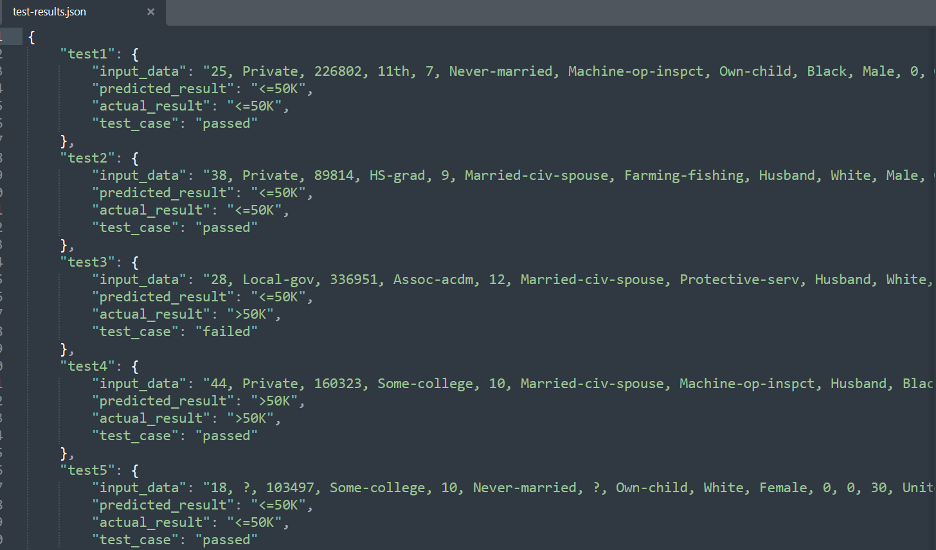

- Mise en scène des tests – Dans la deuxième sous-étape, des tests automatisés sont effectués à l'aide de CodeBuild sur le point de terminaison pour vérifier si l'inférence se produit comme prévu. Les résultats du test seront disponibles dans le compartiment S3 avec le nom

sagemaker-project-<project ID of the SageMaker project>.

Vous pouvez obtenir l'ID du projet SageMaker sur le Paramètres onglet du projet SageMaker. Dans le compartiment S3, choisissez le dossier du nom du projet (par exemple, sagemaker-MLOp-AutoP) et dans celui-ci, ouvrez le dossier TestArtifa/. Choisissez le fichier objet dans ce dossier pour voir les résultats du test.

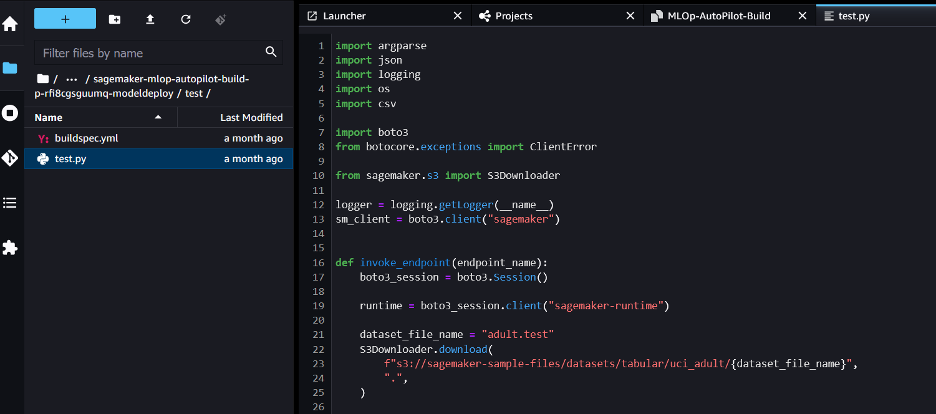

Vous pouvez accéder au script de test à partir du chemin local du référentiel de code que nous avons cloné précédemment. Choisissez l'icône du navigateur de fichiers pour afficher le chemin. Notez que ce sera le référentiel de déploiement. Dans ce référentiel, ouvrez le dossier de test et choisissez le test.py Fichier de code Python.

Vous pouvez apporter des modifications à ce code de test selon votre cas d'utilisation.

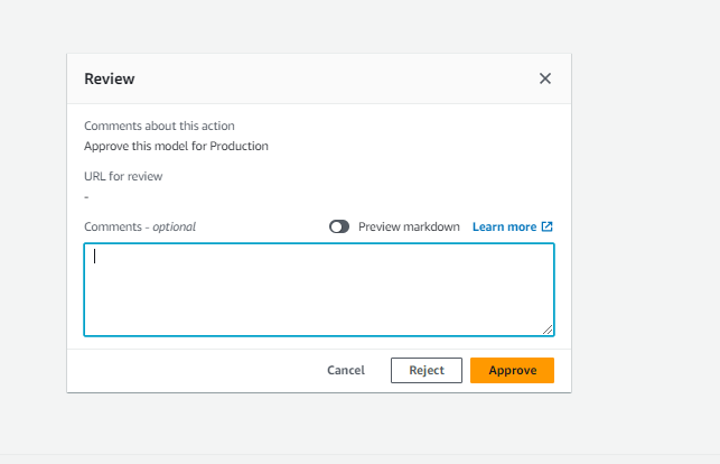

- ApprouverDéploiement – Dans la troisième sous-étape, il y a un processus d'approbation supplémentaire avant la dernière étape de déploiement en production. Tu peux choisir Avis et l'approuver pour continuer.

- DéployerProd – À cette étape, la pile CloudFormation est déployée pour créer un point de terminaison SageMaker sans serveur pour l'environnement de production.

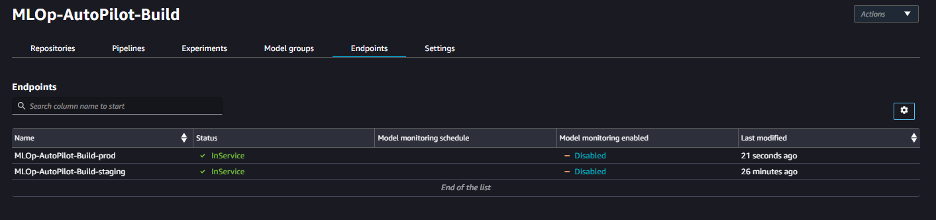

Endpoints

Cet onglet répertorie les points de terminaison SageMaker qui hébergent des modèles déployés pour l'inférence. Lorsque toutes les étapes du pipeline de déploiement de modèle sont terminées, les modèles sont déployés sur les points de terminaison SageMaker et sont accessibles dans le projet SageMaker.

Paramètres

Il s'agit du dernier onglet de la page du projet et répertorie les paramètres du projet. Cela inclut le nom et la description du projet, des informations sur le modèle de projet et SourceModelPackageGroupName, et des métadonnées sur le projet.

Nettoyer

Pour éviter les coûts d'infrastructure supplémentaires associés à l'exemple de cet article, veillez à supprimer les piles CloudFormation. Assurez-vous également de supprimer les points de terminaison SageMaker, tous les blocs-notes en cours d'exécution et les compartiments S3 qui ont été créés lors de la configuration.

Conclusion

Cet article décrit une approche de pipeline ML facile à utiliser pour automatiser et standardiser la formation et le déploiement de modèles ML à l'aide de SageMaker Projects, Data Wrangler, Autopilot, Pipelines et Studio. Cette solution peut vous aider à effectuer des tâches AutoML (prétraitement, formation et post-traitement) dans une structure de référentiel standardisée qui peut fournir à vos spécialistes des données la possibilité d'afficher, de valider et de modifier le flux de travail selon leurs besoins, puis de générer un pipeline personnalisé. modèle pouvant être intégré à un projet SageMaker.

Vous pouvez modifier les pipelines avec vos étapes de prétraitement et de pipeline pour votre cas d'utilisation et déployer notre workflow de bout en bout. Faites-nous savoir dans les commentaires comment le modèle personnalisé a fonctionné pour votre cas d'utilisation respectif.

À propos des auteurs

Vishal Naik est architecte principal de solutions chez Amazon Web Services (AWS). C'est un constructeur qui aime aider les clients à répondre à leurs besoins commerciaux et à résoudre des défis complexes avec les solutions et les meilleures pratiques AWS. Son principal domaine d'intérêt comprend l'apprentissage automatique, le DevOps et les conteneurs. Dans ses temps libres, Vishal aime faire des courts métrages sur les voyages dans le temps et les thèmes de l'univers alternatif.

Vishal Naik est architecte principal de solutions chez Amazon Web Services (AWS). C'est un constructeur qui aime aider les clients à répondre à leurs besoins commerciaux et à résoudre des défis complexes avec les solutions et les meilleures pratiques AWS. Son principal domaine d'intérêt comprend l'apprentissage automatique, le DevOps et les conteneurs. Dans ses temps libres, Vishal aime faire des courts métrages sur les voyages dans le temps et les thèmes de l'univers alternatif.

Shikhar Kwatra est un architecte de solutions spécialisé en IA/ML chez Amazon Web Services, travaillant avec un intégrateur de systèmes mondial de premier plan. Il a obtenu le titre de l'un des plus jeunes maîtres inventeurs indiens avec plus de 500 brevets dans les domaines AI/ML et IoT. Shikhar aide à l'architecture, à la création et à la maintenance d'environnements cloud rentables et évolutifs pour l'organisation, et aide le partenaire GSI à créer des solutions sectorielles stratégiques sur AWS. Shikhar aime jouer de la guitare, composer de la musique et pratiquer la pleine conscience pendant son temps libre.

Shikhar Kwatra est un architecte de solutions spécialisé en IA/ML chez Amazon Web Services, travaillant avec un intégrateur de systèmes mondial de premier plan. Il a obtenu le titre de l'un des plus jeunes maîtres inventeurs indiens avec plus de 500 brevets dans les domaines AI/ML et IoT. Shikhar aide à l'architecture, à la création et à la maintenance d'environnements cloud rentables et évolutifs pour l'organisation, et aide le partenaire GSI à créer des solutions sectorielles stratégiques sur AWS. Shikhar aime jouer de la guitare, composer de la musique et pratiquer la pleine conscience pendant son temps libre.

Janisha Anand est chef de produit senior au sein de l'équipe SageMaker Low/No Code ML, qui comprend SageMaker Canvas et SageMaker Autopilot. Elle aime le café, rester active et passer du temps avec sa famille.

Janisha Anand est chef de produit senior au sein de l'équipe SageMaker Low/No Code ML, qui comprend SageMaker Canvas et SageMaker Autopilot. Elle aime le café, rester active et passer du temps avec sa famille.

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- Financement EVM. Interface unifiée pour la finance décentralisée. Accéder ici.

- Groupe de médias quantiques. IR/PR amplifié. Accéder ici.

- PlatoAiStream. Intelligence des données Web3. Connaissance Amplifiée. Accéder ici.

- La source: https://aws.amazon.com/blogs/machine-learning/bring-sagemaker-autopilot-into-your-mlops-processes-using-a-custom-sagemaker-project/

- :possède

- :est

- :ne pas

- :où

- $UP

- 000

- 1

- 10

- 100

- 10ème

- 12

- 17

- 1994

- 214

- 220

- 30

- 500

- 7

- 9

- 9ème

- a

- A Propos

- accès

- accessible

- accès

- accomplir

- infection

- acyclique

- ajouter

- Supplémentaire

- propos

- Ajoute

- Adulte

- AI / ML

- SIDA

- aligné

- Tous

- déjà

- aussi

- Bien que

- Amazon

- Amazon Sage Maker

- Pilote automatique Amazon SageMaker

- Gestionnaire de données Amazon SageMaker

- Pipelines Amazon SageMaker

- Amazon Web Services

- Amazon Web Services (AWS)

- an

- il analyse

- et les

- annuel

- tous

- apparaît

- applications

- une approche

- approprié

- approbation

- approbations

- approuver

- ,

- SONT

- Réservé

- AS

- associé

- At

- attributs

- automatiser

- Automatisation

- automatiquement

- automatiser

- Automation

- AutoML

- disponibles

- éviter

- AWS

- AWS CloudFormation

- basé

- BE

- était

- before

- LES MEILLEURS

- les meilleures pratiques

- jusqu'à XNUMX fois

- Au-delà

- Branche

- apporter

- navigateur

- construire

- constructeur

- Développement

- la performance des entreprises

- by

- Cambodge

- CAN

- Peut obtenir

- Canada

- la toile

- maisons

- cas

- catalogue

- Recensement

- globaux

- Change

- Modifications

- caractéristiques

- vérifier

- Contrôles

- Chine

- Selectionnez

- choose

- classe

- classification

- cliquez

- le cloud

- code

- codes

- Codage

- Café

- COLUMBIA

- Colonne

- commentaires

- commettre

- Commun

- Sociétés

- complet

- complexe

- composants électriques

- configuration

- consiste

- Console

- consommer

- Conteneurs

- contient

- continu

- des bactéries

- Core

- Costs

- engendrent

- créée

- crée des

- La création

- création

- Cuba

- Lecture

- Customiser

- Clients

- personnaliser

- JOUR

- données

- Préparation des données

- informatique

- science des données

- dévoué

- profond

- par défaut

- défini

- page de livraison.

- démontrer

- déployer

- déployé

- déployer

- déploiement

- déploie

- décrit

- la description

- destination

- détail

- détails

- Développement

- différent

- directement

- domaines

- fait

- Ne pas

- download

- pendant

- chacun

- Plus tôt

- Notre expertise

- même

- Easy

- facile à utiliser

- Équateur

- éditeur

- non plus

- élimine

- end-to-end

- Endpoint

- ENGINEERING

- Les ingénieurs

- de l'Angleterre

- assurer

- assurer

- Entrer

- Entreprise

- entreprises

- Environment

- environnements

- évaluer

- évaluation

- faire une éventuelle

- exemple

- exécution

- attendu

- expériences

- expert

- explorez

- étendre

- faciliter

- famille

- Fonctionnalité

- Déposez votre dernière attestation

- Fichiers

- BOPP

- Trouvez

- Prénom

- flux

- Focus

- Abonnement

- Pour

- formulaire

- Fondation

- quatre

- France

- De

- plein

- d’étiquettes électroniques entièrement

- plus

- généralement

- générer

- Allemagne

- obtenez

- Git

- GitHub

- Global

- gouvernance

- diplôme

- graphique

- plus grand

- Grèce

- Réservation de groupe

- Groupes

- Guatemala

- EN COURS

- Vous avez

- he

- lourd

- levage de charges lourdes

- aider

- utile

- aider

- aide

- ici

- ici

- Cacher

- sa

- Accueil

- HONDURAS

- Hong

- hôte

- Comment

- How To

- HTML

- http

- HTTPS

- Les êtres humains

- Hongrie

- ICON

- ID

- Identite

- if

- illustre

- importer

- améliorer

- in

- comprendre

- inclut

- passif

- Inde

- Indian

- industrie

- d'information

- Infrastructure

- initiale

- contribution

- Des instructions

- intégrer

- des services

- Intégration

- l'intégration

- interconnecté

- développement

- Inventeurs

- impliqué

- IOT

- l'Iran

- Irlande

- IT

- Italie

- SES

- lui-même

- Jamaïque

- Japon

- jpg

- juste

- juste un

- ACTIVITES

- Savoir

- Nom

- plus tard

- Nouveautés

- lancer

- lance

- conduire

- conduisant

- APPRENTISSAGE

- apprentissage

- laisser

- vos produits

- lifting

- comme

- Gamme

- Liste

- Listé

- Liste

- peu

- locales

- recherchez-

- Lot

- aime

- click

- machine learning

- maintenir

- Maintenir

- Majorité

- a prendre une

- Fabrication

- gérer

- gérés

- manager

- manière

- maître

- Match

- Mai..

- mécanisme

- Menu

- message

- Métadonnées

- Mexique

- Pleine conscience

- ML

- MLOps

- modèle

- numériques jumeaux (digital twin models)

- modifier

- moment

- Surveiller

- PLUS

- Musique

- prénom

- Navigation

- Besoin

- nécessaire

- Besoins

- Nouveauté

- aucune

- maintenant

- objet

- of

- Offrandes

- Offres Speciales

- on

- ONE

- ouvert

- d'exploitation

- Option

- Options

- or

- orchestrée

- de commander

- organisation

- organisations

- Autre

- nos

- décrit

- plus de

- propre

- propriétaire

- page

- pain

- paramètres

- partie

- les partenaires

- passé

- Brevets

- chemin

- Effectuer

- performant

- effectué

- personne

- Pérou

- phase

- Philippines

- pipeline

- plateforme

- Platon

- Intelligence des données Platon

- PlatonDonnées

- jouer

- Pologne

- politiques

- Portugal

- Post

- power

- pratique

- pratiques

- prévoir

- préparation

- Préparer

- préparé

- conditions préalables

- Problème

- processus

- les process

- traitement

- produire

- Produit

- Des informations de produit

- chef de produit

- Vidéo

- Produits

- Projet

- Détails du projet

- projets

- la promotion de

- fournir

- fournit

- disposition

- publiquement

- Push

- Python

- qualité

- Rapide

- vite.

- recevoir

- recommandé

- inscrit

- registres

- enregistrement

- fiable

- supprimez

- répétable

- dépôt

- conditions

- Resources

- ceux

- Résultats

- Avis

- examen

- feuille de route

- robuste

- Rôle

- racine

- Courir

- pour le running

- sagemaker

- Pipelines SageMaker

- vente

- Épargnez

- évolutive

- Sciences

- scientifiques

- scripts

- Sdk

- de façon transparente

- Deuxièmement

- les sections

- sécurité

- sur le lien

- seed

- supérieur

- Série

- Sans serveur

- service

- Services

- set

- Paramétres

- installation

- plusieurs

- partage

- elle

- Shorts

- devrait

- montrer

- vitrine

- montré

- étapes

- simplifier

- simplement

- So

- sur mesure

- Solutions

- RÉSOUDRE

- Identifier

- code source

- Région Sud

- spécialiste

- Dépenses

- empiler

- Combos

- Étape

- étapes

- mise en scène

- Standard

- Normes

- Commencer

- j'ai commencé

- départs

- Statut

- étapes

- Étapes

- Arrêter

- storage

- stockée

- Stratégique

- rationaliser

- Strict

- structure

- studio

- succès

- réussi

- tel

- Support

- Appuyer

- Les soutiens

- combustion propre

- table

- Taïwan

- Prenez

- prend

- Target

- Tâche

- tâches

- équipe

- équipes

- modèle

- modèles

- Terraform

- tester

- examiné

- Essais

- tests

- Thaïlande

- que

- qui

- Le

- La Source

- leur

- Les

- puis

- Là.

- Ces

- l'ont

- Troisièmement

- this

- ceux

- trois

- fiable

- voyage dans le temps

- Titre

- à

- Tobago

- outil

- les outils

- Train

- Formation

- Transformer

- De La Carrosserie

- transformations

- Voyage

- déclenché

- deux

- ui

- sous

- Univers

- Mises à jour

- URL

- us

- utilisé

- cas d'utilisation

- d'utiliser

- Utilisateur

- utilisateurs

- Usages

- en utilisant

- VALIDER

- Plus-value

- Valeurs

- divers

- version

- via

- Vietnam

- Voir

- vishal

- définition

- walkthrough

- souhaitez

- Façon..

- we

- web

- services Web

- WELL

- ont été

- quand

- qui

- tout en

- WHO

- sera

- comprenant

- dans les

- travaillé

- workflow

- workflows

- de travail

- yaml

- an

- Vous n'avez

- Le plus jeune

- Votre

- zéphyrnet

- Zip