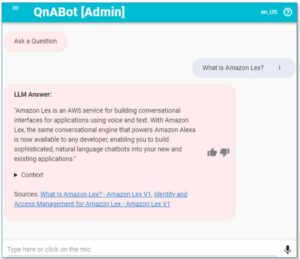

Vous pouvez désormais enregistrer des modèles d'apprentissage automatique (ML) intégrés Toile Amazon SageMaker d'un simple clic vers Registre de modèles Amazon SageMaker, vous permettant d'opérationnaliser les modèles de ML en production. Canvas est une interface visuelle qui permet aux analystes commerciaux de générer eux-mêmes des prédictions ML précises, sans nécessiter d'expérience en ML ni avoir à écrire une seule ligne de code. Bien qu'il s'agisse d'un endroit idéal pour le développement et l'expérimentation, pour tirer de la valeur de ces modèles, ils doivent être opérationnalisés, c'est-à-dire déployés dans un environnement de production où ils peuvent être utilisés pour faire des prédictions ou prendre des décisions. Désormais, grâce à l'intégration avec le registre de modèles, vous pouvez stocker tous les artefacts de modèle, y compris les références des métadonnées et des métriques de performances, dans un référentiel central et les intégrer à vos processus CI/CD de déploiement de modèles existants.

Le registre de modèles est un référentiel qui catalogue les modèles ML, gère diverses versions de modèle, associe des métadonnées (telles que des métriques de formation) à un modèle, gère le statut d'approbation d'un modèle et les déploie en production. Après avoir créé une version de modèle, vous souhaitez généralement évaluer ses performances avant de la déployer sur un point de terminaison de production. S'il répond à vos exigences, vous pouvez mettre à jour le statut d'approbation de la version du modèle sur Approuvé. Définir le statut sur Approuvé peut lancer le déploiement CI/CD pour le modèle. Si la version du modèle ne répond pas à vos exigences, vous pouvez mettre à jour le statut d'approbation sur rejeté dans le registre, ce qui empêche le modèle d'être déployé dans un environnement escaladé.

Un registre de modèles joue un rôle clé dans le processus de déploiement du modèle car il regroupe toutes les informations du modèle et permet l'automatisation de la promotion du modèle vers les environnements de production. Voici quelques façons dont un registre de modèles peut aider à opérationnaliser les modèles de ML :

- Contrôle de version – Un registre de modèles vous permet de suivre différentes versions de vos modèles ML, ce qui est essentiel lors du déploiement de modèles en production. En gardant une trace des versions de modèle, vous pouvez facilement revenir à une version précédente si une nouvelle version pose des problèmes.

- Coopération – Un registre de modèles permet la collaboration entre les scientifiques des données, les ingénieurs et d'autres parties prenantes en fournissant un emplacement centralisé pour le stockage, le partage et l'accès aux modèles. Cela peut aider à rationaliser le processus de déploiement et garantir que tout le monde travaille avec le même modèle.

- Gouvernance – Un registre de modèles peut contribuer à la conformité et à la gouvernance en fournissant un historique auditable des modifications et des déploiements de modèles.

Dans l'ensemble, un registre de modèles peut aider à rationaliser le processus de déploiement de modèles ML en production en fournissant le contrôle de version, la collaboration, la surveillance et la gouvernance.

Présentation de la solution

Pour notre cas d'utilisation, nous assumons le rôle d'un utilisateur professionnel dans le service marketing d'un opérateur de téléphonie mobile, et nous avons créé avec succès un modèle ML dans Canvas pour identifier les clients présentant un risque potentiel de désabonnement. Grâce aux prédictions générées par notre modèle, nous voulons maintenant déplacer cela de notre environnement de développement vers la production. Cependant, avant que notre modèle ne soit déployé sur un point de terminaison de production, il doit être examiné et approuvé par une équipe MLOps centrale. Cette équipe est responsable de la gestion des versions de modèle, de l'examen de toutes les métadonnées associées (telles que les métriques de formation) avec un modèle, de la gestion du statut d'approbation de chaque modèle ML, du déploiement des modèles approuvés en production et de l'automatisation du déploiement du modèle avec CI/CD. Pour rationaliser le processus de déploiement de notre modèle en production, nous profitons de l'intégration de Canvas avec le registre des modèles et enregistrons notre modèle pour examen par notre équipe MLOps.

Les étapes du flux de travail sont les suivantes :

- Téléchargez un nouvel ensemble de données avec la population actuelle de clients dans Canvas. Pour la liste complète des sources de données prises en charge, reportez-vous à Importer des données dans Canvas.

- Créez des modèles ML et analysez leurs métriques de performance. Reportez-vous aux instructions pour créer un modèle ML personnalisé dans Canvas ainsi que évaluer les performances du modèle.

- Enregistrez les versions les plus performantes au registre modèle pour examen et approbation.

- Déployer la version de modèle approuvée à un point de terminaison de production pour l'inférence en temps réel.

Vous pouvez effectuer les étapes 1 à 3 dans Canvas sans écrire une seule ligne de code.

Pré-requis

Pour cette procédure pas à pas, assurez-vous que les conditions préalables suivantes sont remplies :

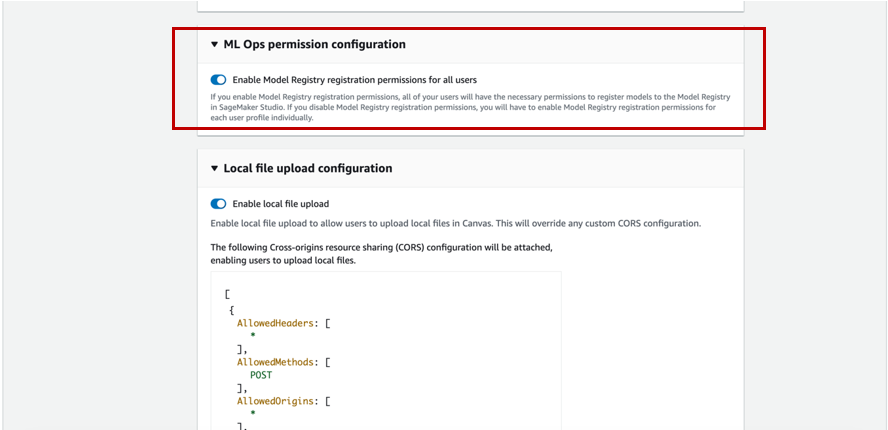

- Pour enregistrer des versions de modèle dans le registre de modèles, l'administrateur Canvas doit accorder les autorisations nécessaires à l'utilisateur Canvas, que vous pouvez gérer dans le domaine SageMaker qui héberge votre application Canvas. Pour plus d'informations, reportez-vous au Guide du développeur Amazon SageMaker. Lorsque vous accordez des autorisations à votre utilisateur Canvas, vous devez choisir d'autoriser ou non l'utilisateur à enregistrer ses versions de modèle dans le même compte AWS.

- Mettre en œuvre les prérequis mentionnés dans Prévoyez l'attrition des clients grâce à l'apprentissage automatique sans code à l'aide d'Amazon SageMaker Canvas.

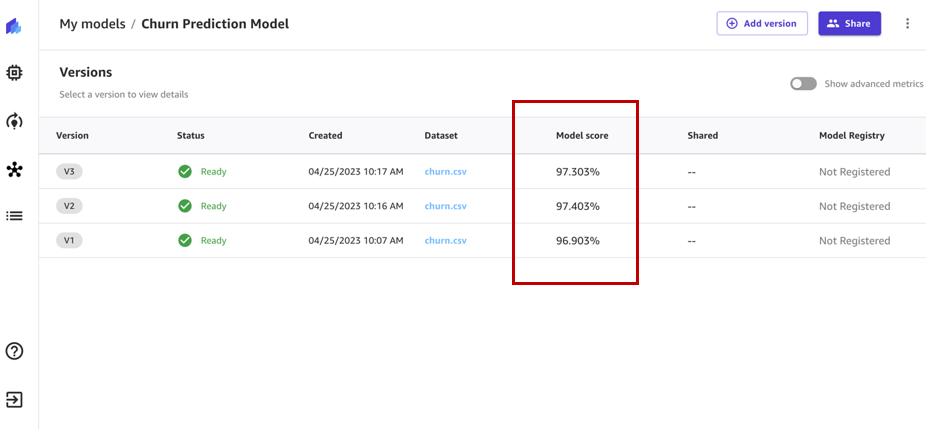

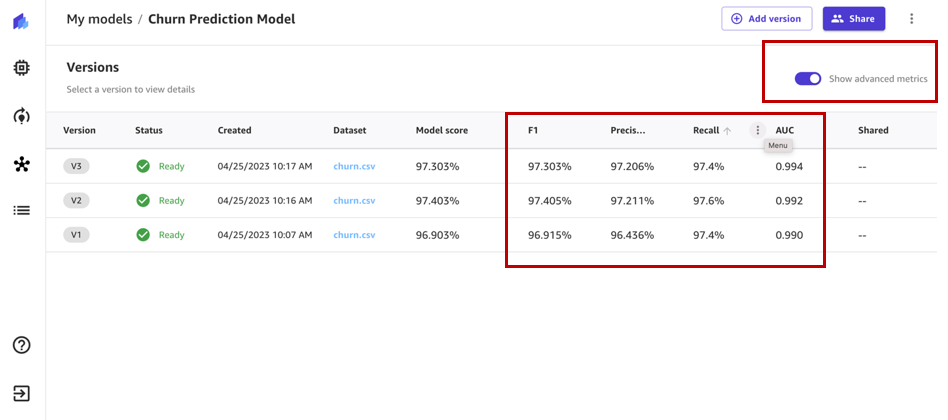

Vous devriez maintenant avoir trois versions de modèle entraînées sur les données historiques de prédiction de l'attrition dans Canvas :

- V1 formé avec les 21 fonctionnalités et une configuration de construction rapide avec un score de modèle de 96.903 %

- V2 formé avec les 19 fonctionnalités (fonctionnalités de téléphone et d'état supprimées) et configuration de construction rapide et précision améliorée de 97.403 %

- V3 formé avec une configuration de construction standard avec un score de modèle de 97.03 %

Utiliser le modèle de prédiction de l'attrition client

Activer Afficher les métriques avancées et passer en revue les métriques objectives associées à chaque version de modèle afin que nous puissions sélectionner le modèle le plus performant pour l'enregistrement dans le registre des modèles.

Sur la base des mesures de performance, nous sélectionnons la version 2 à enregistrer.

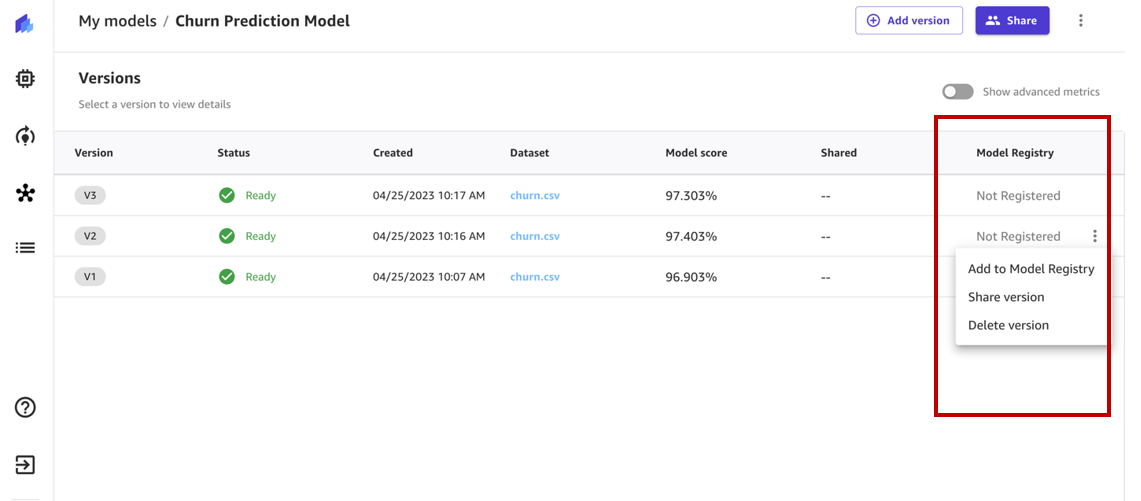

Le registre de modèles suit toutes les versions de modèle que vous entraînez pour résoudre un problème particulier dans un groupe de modèles. Lorsque vous formez un modèle Canvas et que vous l'enregistrez dans le registre de modèles, il est ajouté à un groupe de modèles en tant que nouvelle version de modèle.

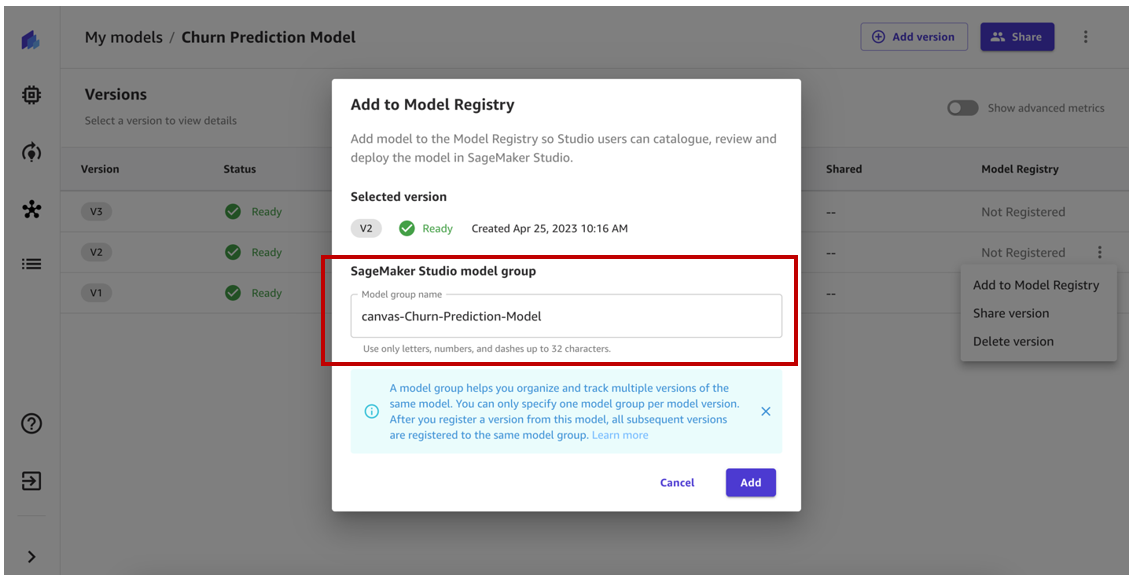

Au moment de l'enregistrement, un groupe de modèles dans le registre des modèles est automatiquement créé. Si vous le souhaitez, vous pouvez le renommer avec le nom de votre choix ou utiliser un groupe de modèles existant dans le registre de modèles.

Pour cet exemple, nous utilisons le nom du groupe de modèles généré automatiquement et choisissons Ajouter.

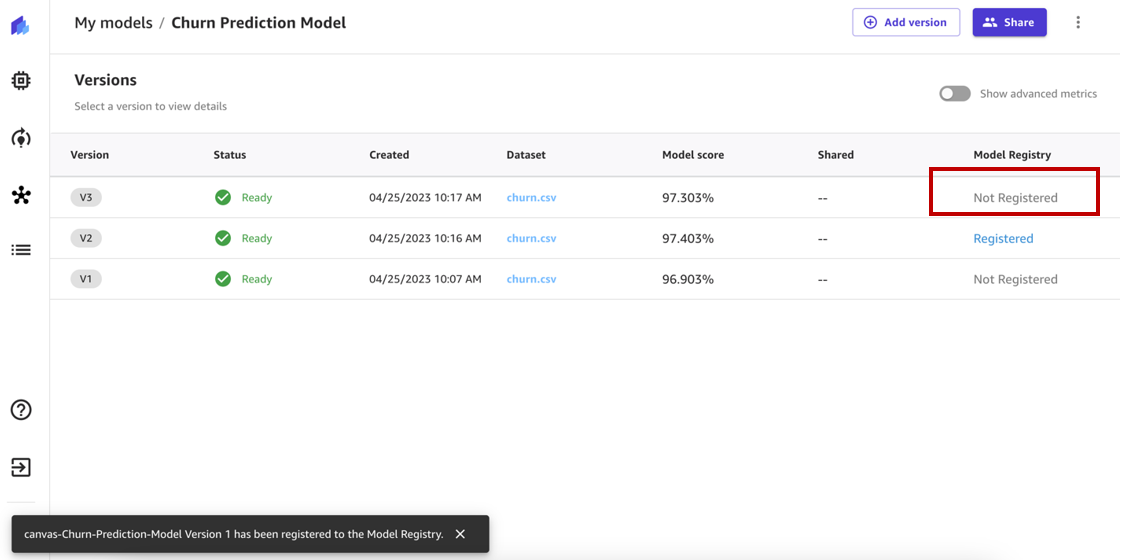

Notre version de modèle doit maintenant être enregistrée dans le groupe de modèles du registre de modèles. Si nous devions enregistrer une autre version de modèle, elle serait enregistrée dans le même groupe de modèles.

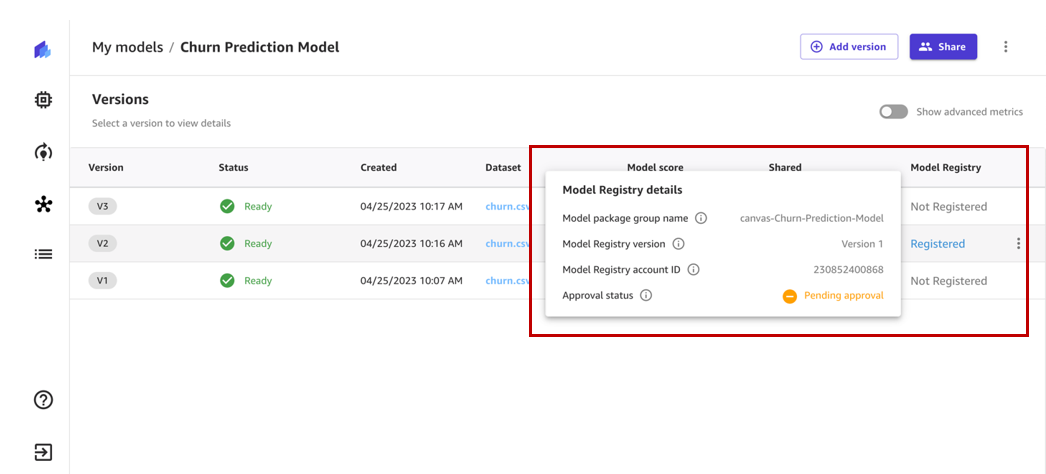

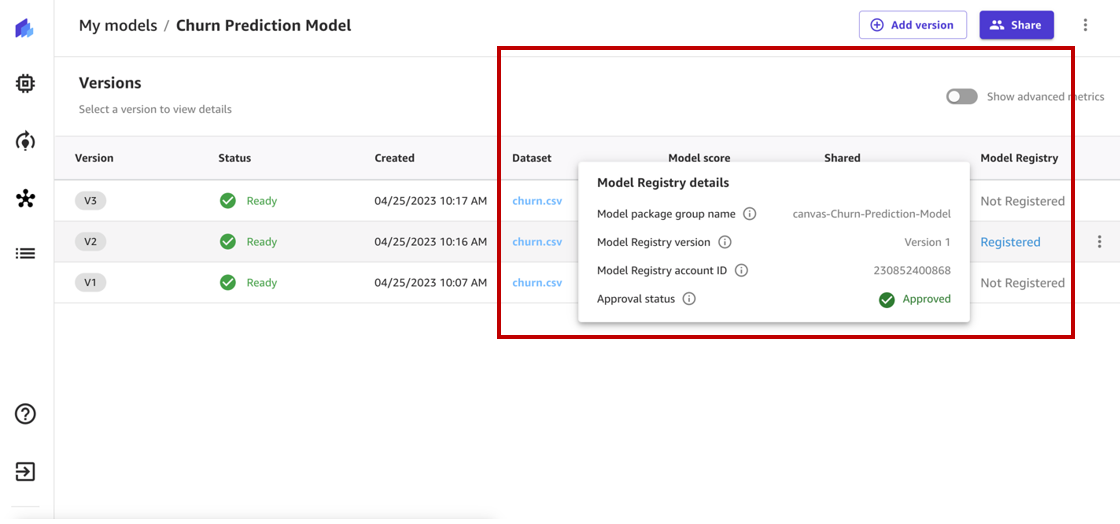

Le statut de la version du modèle devrait avoir changé de Non enregistré à Membres .

Lorsque nous survolons l'état, nous pouvons examiner les détails du registre de modèles, qui incluent le nom du groupe de modèles, l'ID de compte de registre de modèles et l'état d'approbation. Juste après l'enregistrement, le statut passe à Validation en attente, ce qui signifie que ce modèle est enregistré dans le registre des modèles, mais qu'il est en attente d'examen et d'approbation par un scientifique des données ou un membre de l'équipe MLOps et qu'il ne peut être déployé sur un point de terminaison que s'il est approuvé.

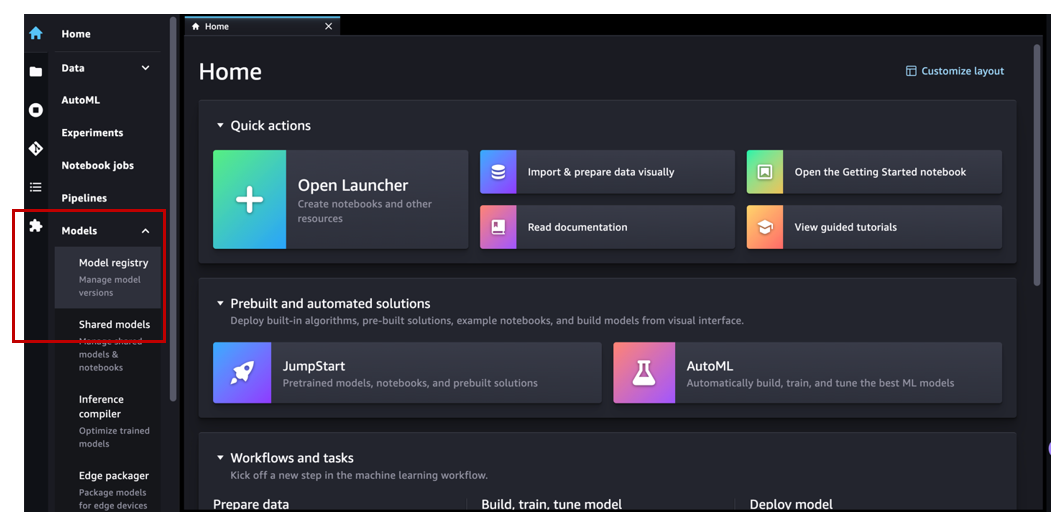

Naviguons maintenant vers Amazon SageMakerStudio et assumer le rôle d'un membre de l'équipe MLOps. Sous Des modèles photo dans le volet de navigation, choisissez Registre des modèles pour ouvrir la page d'accueil du registre de modèles.

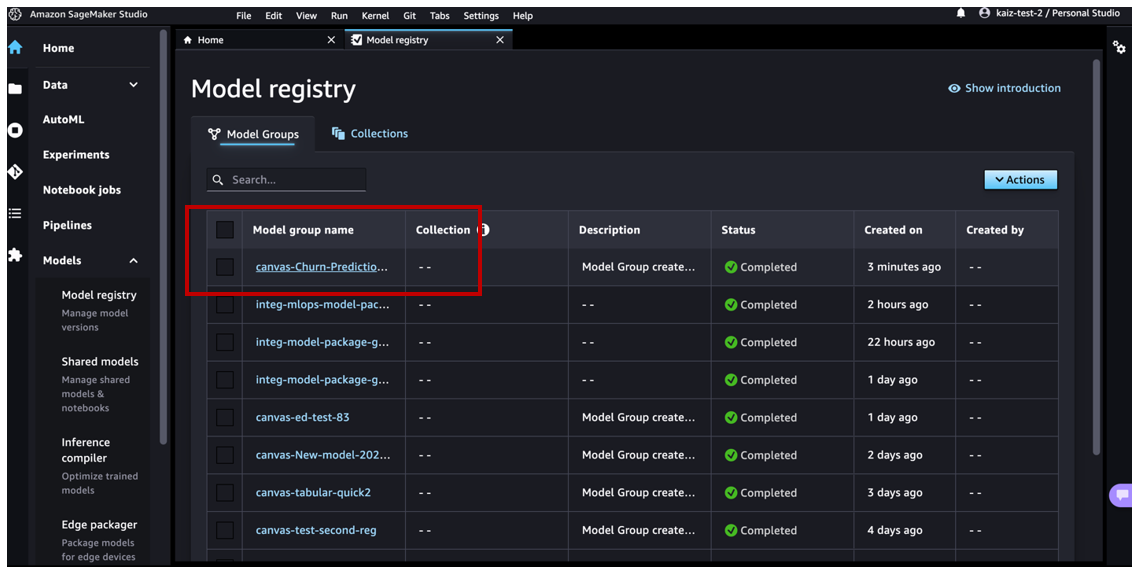

Nous pouvons voir le modèle group canvas-Churn-Prediction-Model ce canevas créé automatiquement pour nous.

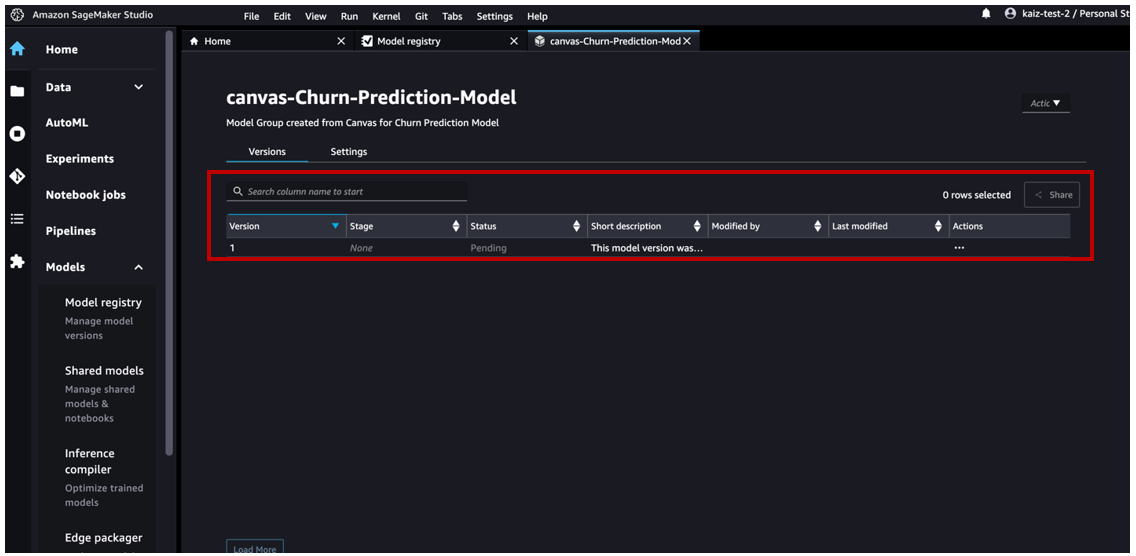

Choisissez le modèle pour passer en revue toutes les versions enregistrées dans ce groupe de modèles, puis passez en revue les détails du modèle correspondant.

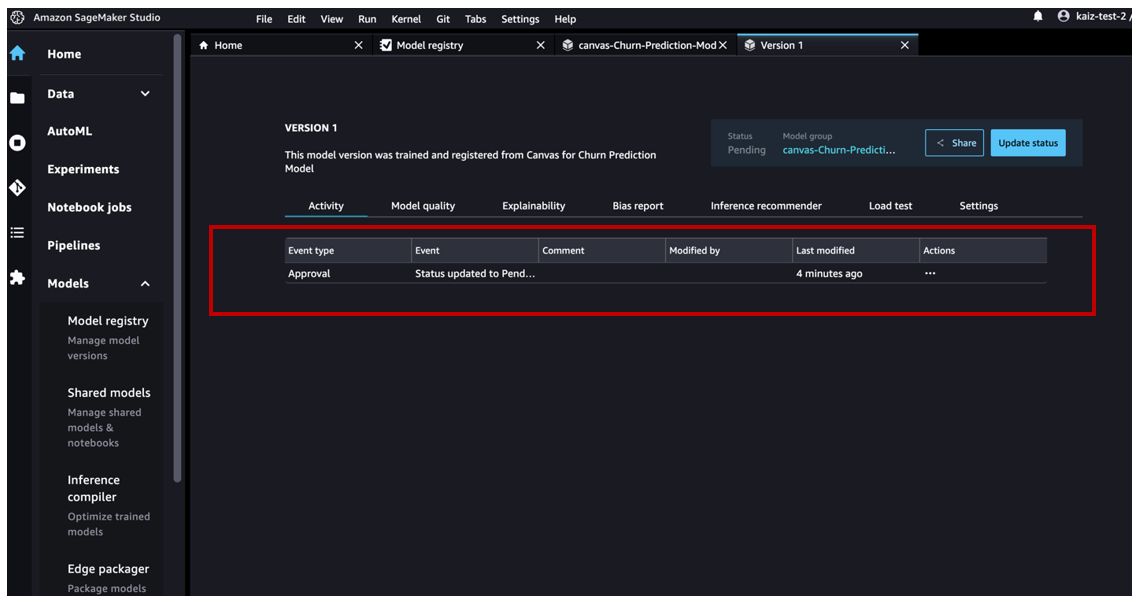

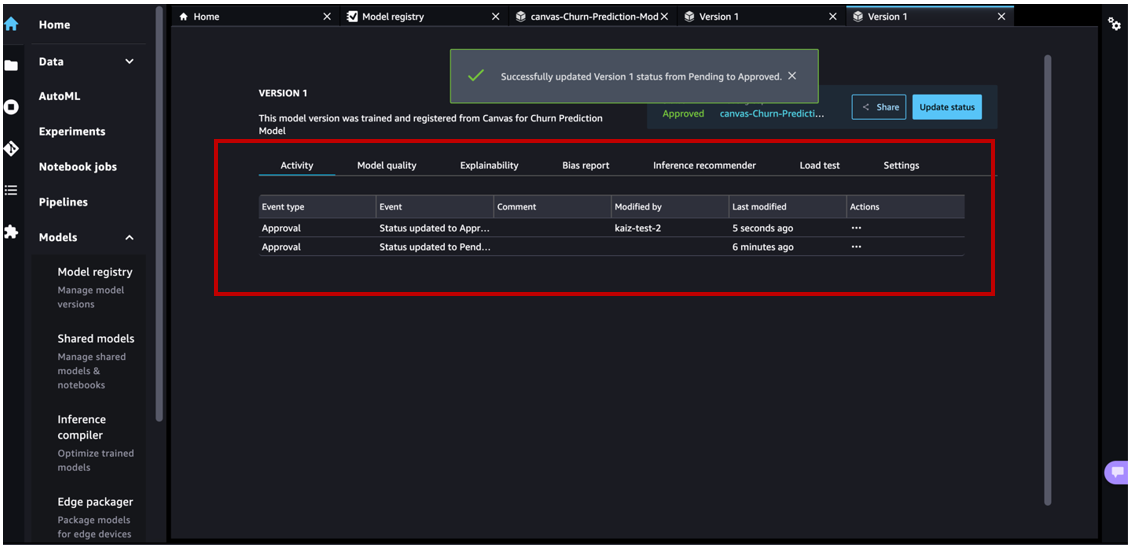

Si vous ouvrez les détails de la version 1, nous pouvons voir que le Activités L'onglet garde une trace de tous les événements qui se produisent sur le modèle.

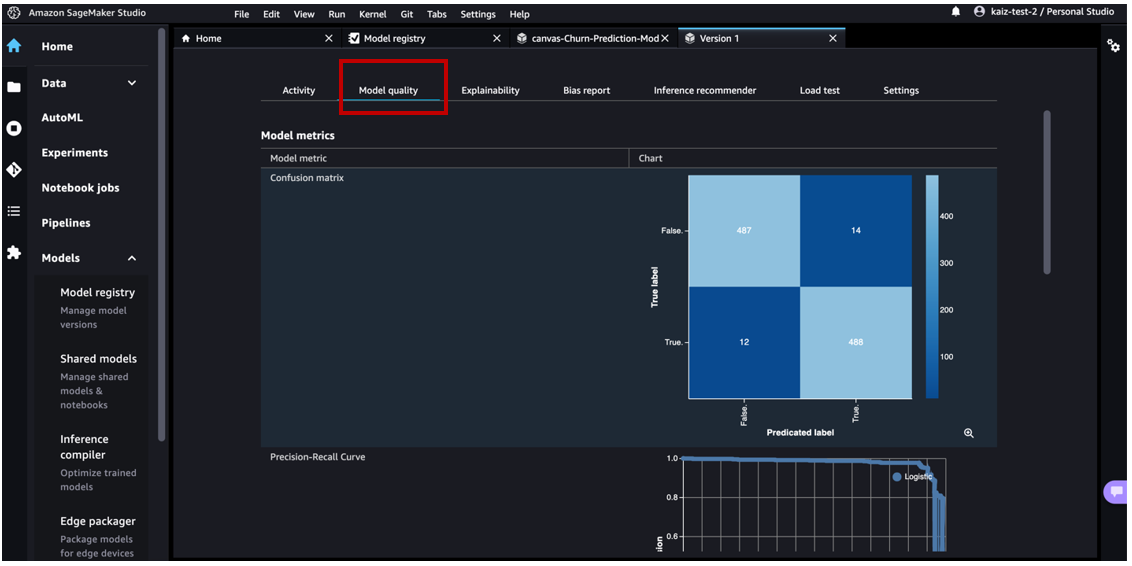

Sur le Qualité du modèle , nous pouvons examiner les métriques du modèle, les courbes de précision/rappel et les tracés de la matrice de confusion pour comprendre les performances du modèle.

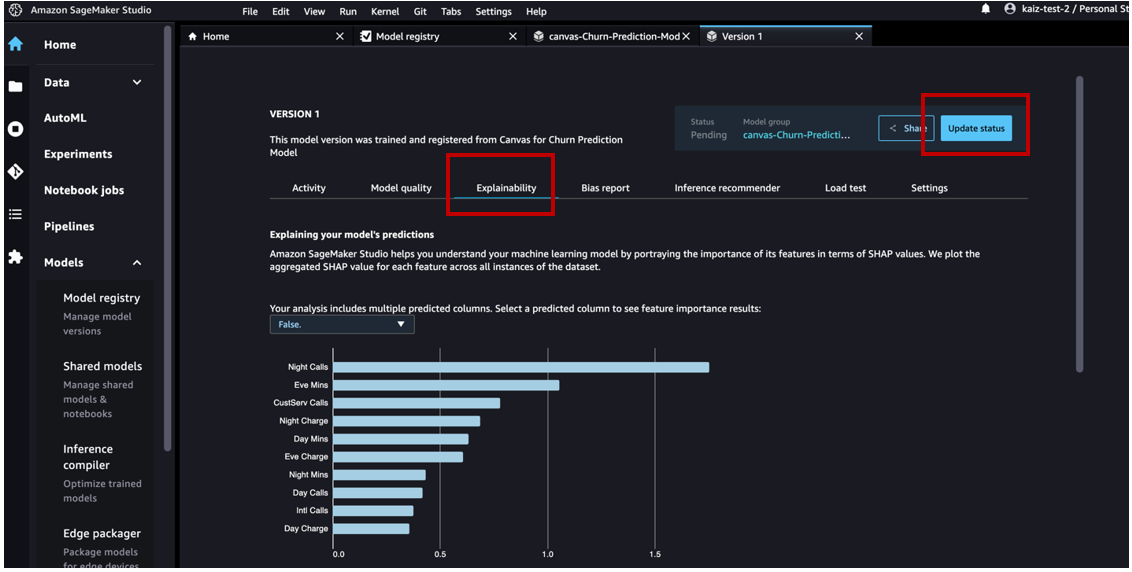

Sur le Explicabilité onglet, nous pouvons passer en revue les fonctionnalités qui ont le plus influencé les performances du modèle.

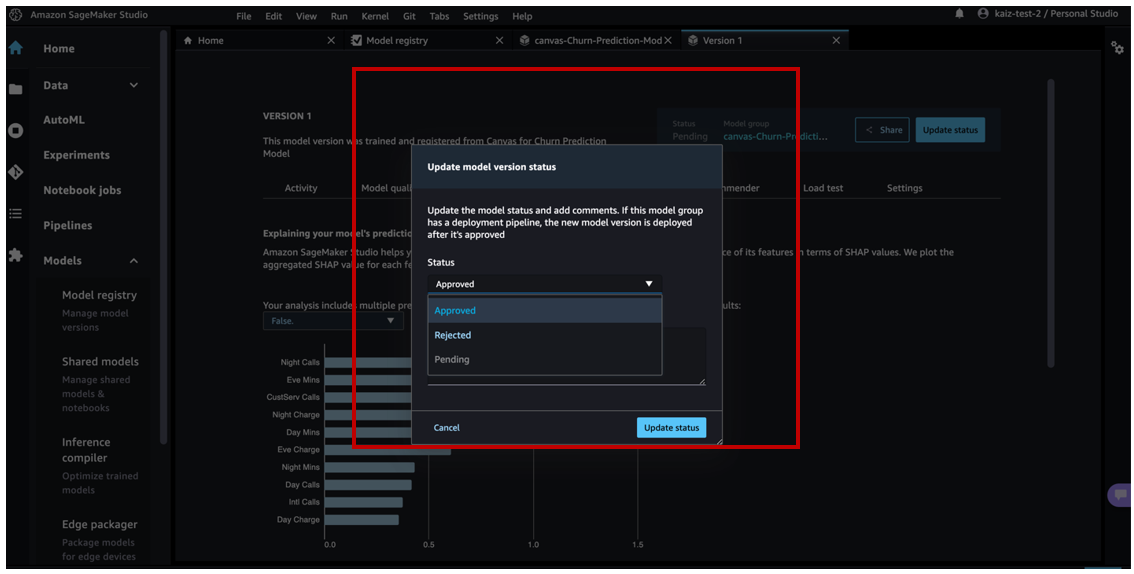

Après avoir examiné les artefacts du modèle, nous pouvons changer le statut d'approbation de En Attente à A approuvé.

Nous pouvons maintenant voir l'activité mise à jour.

L'utilisateur professionnel de Canvas pourra désormais voir que le statut du modèle enregistré est passé de Validation en attente à A approuvé.

En tant que membre de l'équipe MLOps, puisque nous avons approuvé ce modèle ML, déployons-le sur un point de terminaison.

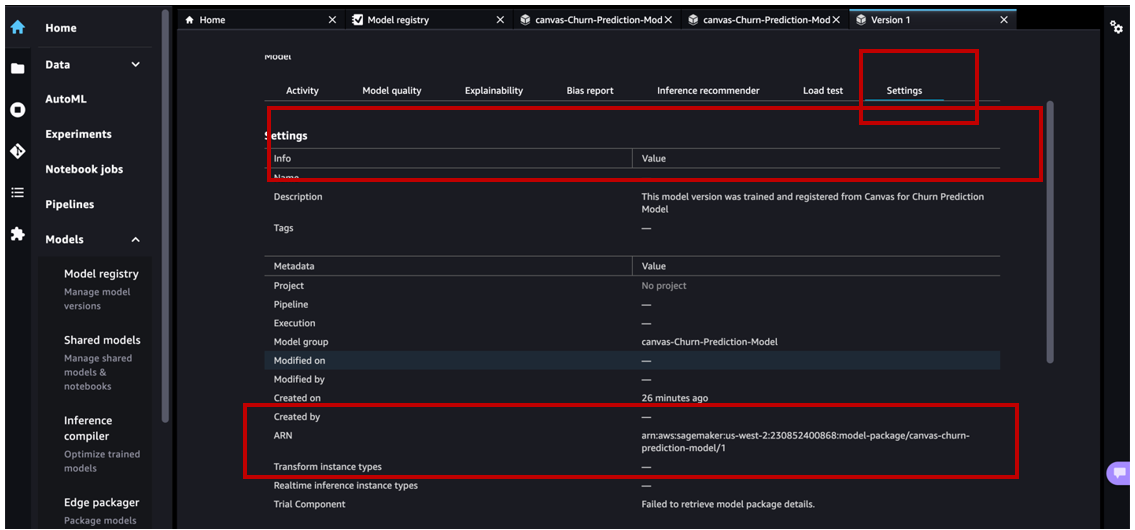

Dans Studio, accédez à la page d'accueil du registre de modèles et choisissez l'option canvas-Churn-Prediction-Model groupe modèle. Choisissez la version à déployer et accédez à la Paramètres languette.

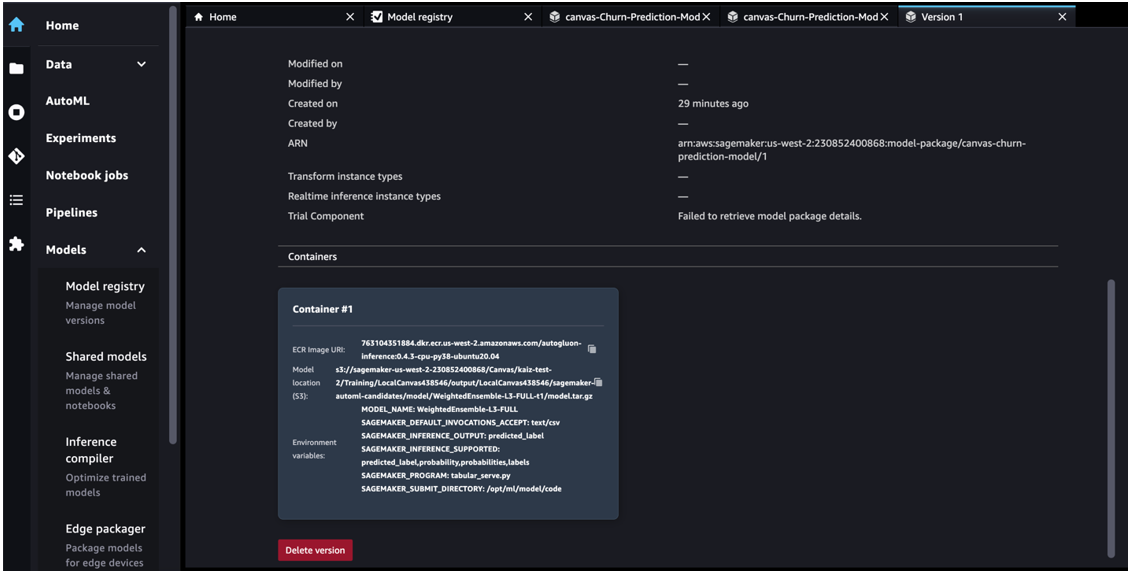

Parcourez pour obtenir les détails de l'ARN du package de modèle à partir de la version de modèle sélectionnée dans le registre de modèles.

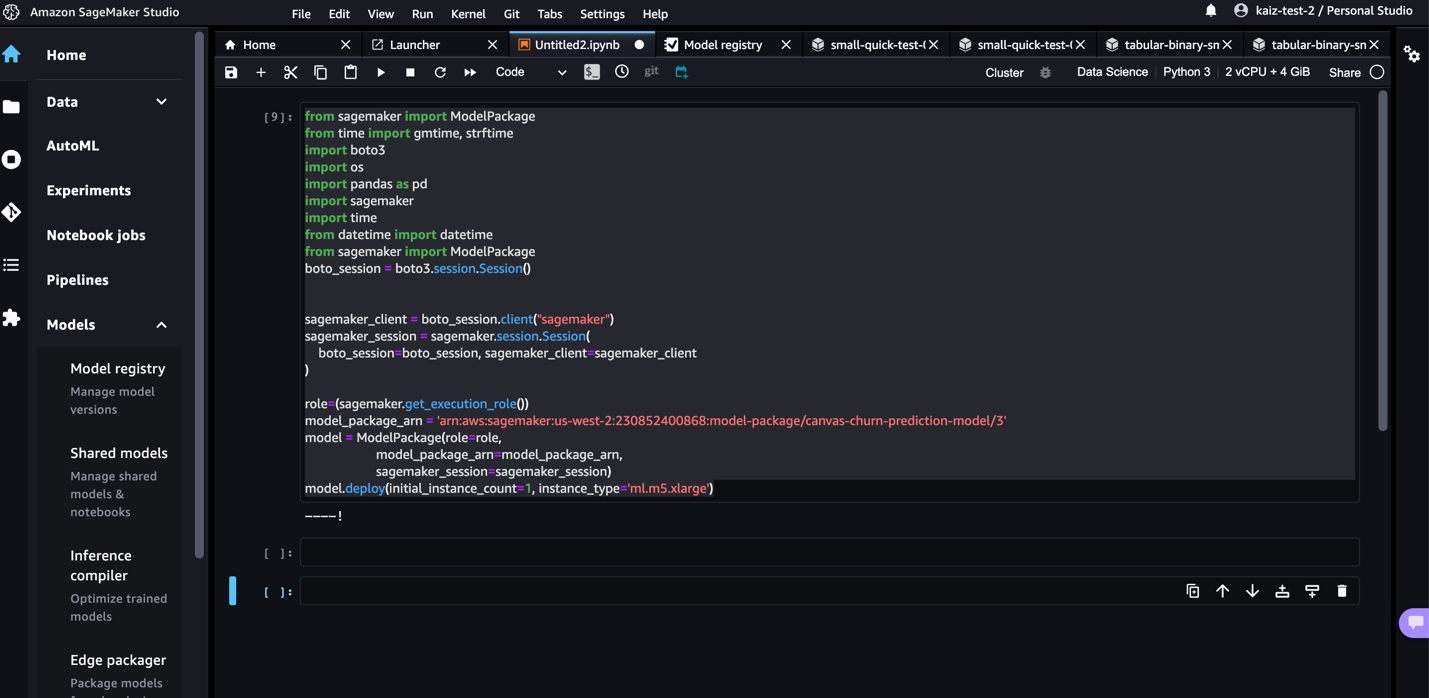

Ouvrez un notebook dans Studio et exécutez le code suivant pour déployer le modèle sur un point de terminaison. Remplacez l'ARN du package de modèle par votre propre ARN de package de modèle.

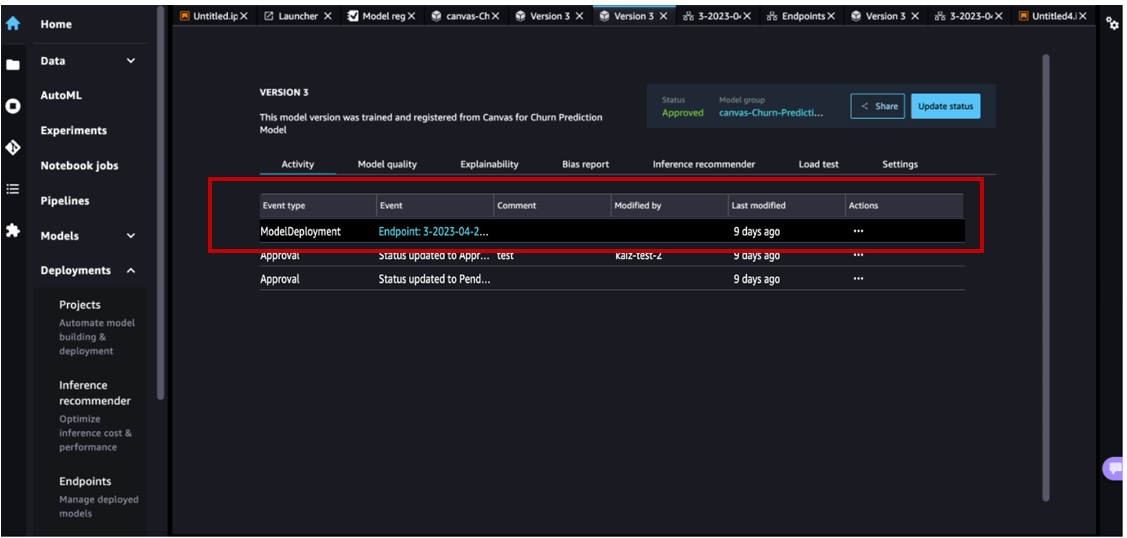

Une fois le point de terminaison créé, vous pouvez le voir suivi en tant qu'événement sur le Activités onglet du registre des modèles.

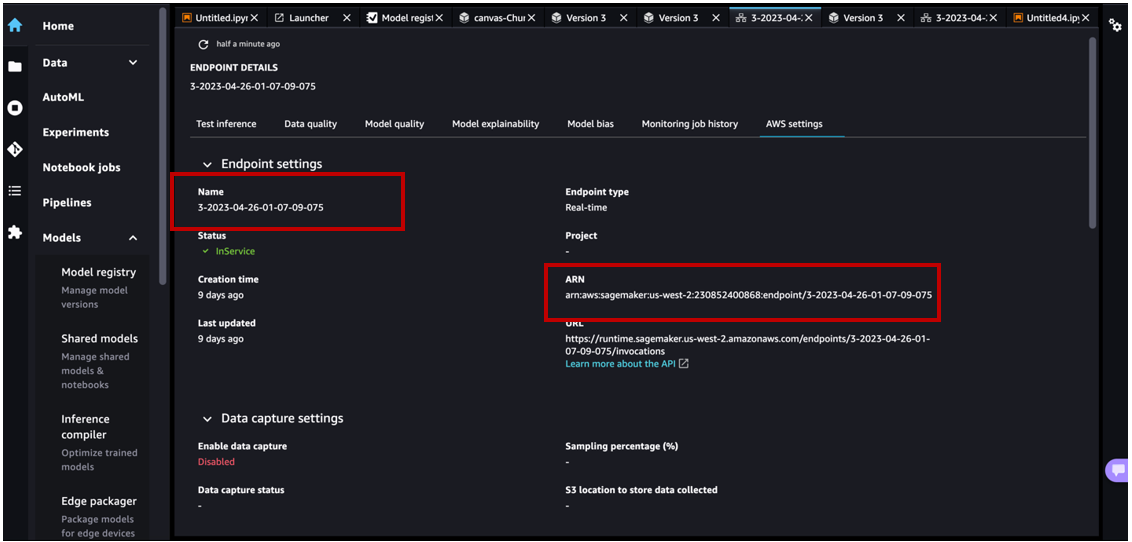

Vous pouvez double-cliquer sur le nom du point de terminaison pour obtenir ses détails.

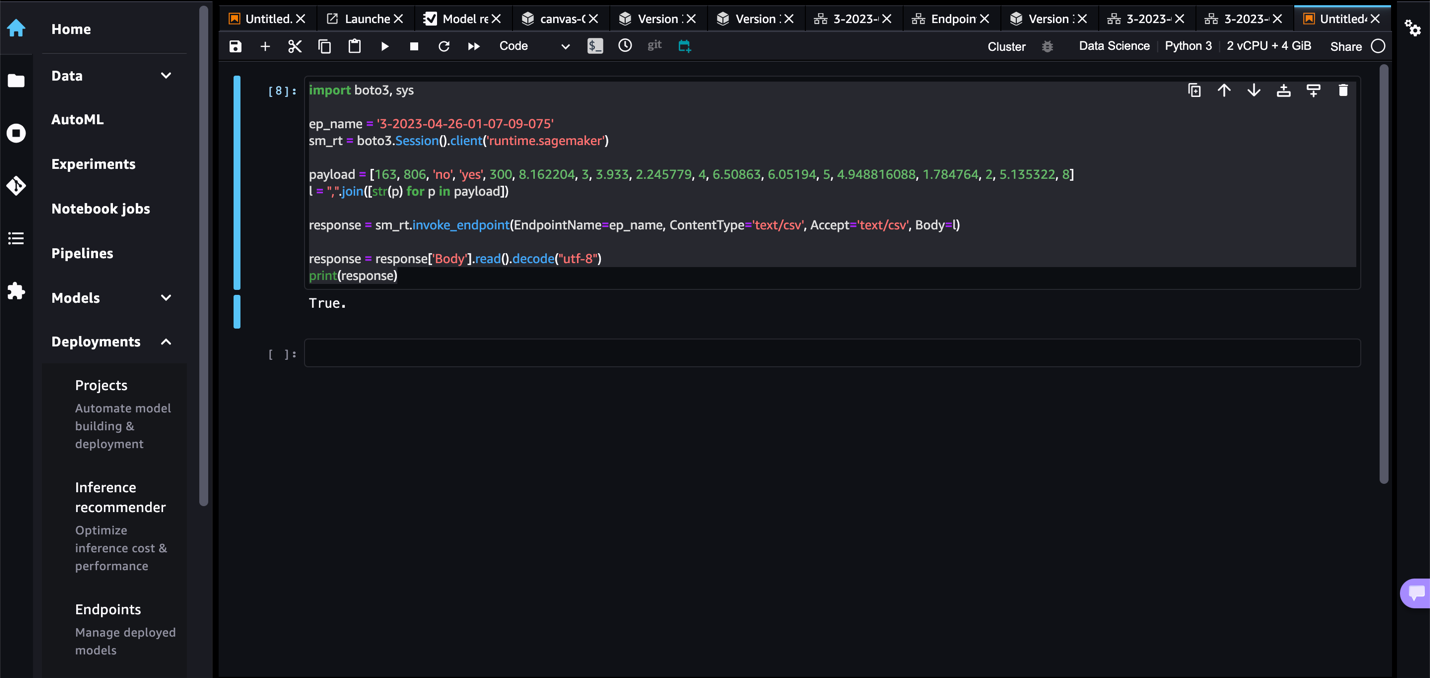

Maintenant que nous avons un point de terminaison, invoquons-le pour obtenir une inférence en temps réel. Remplacez le nom de votre point de terminaison dans l'extrait de code suivant :

Nettoyer

Pour éviter d'encourir des frais futurs, supprimez les ressources que vous avez créées en suivant ce message. Cela inclut la déconnexion de Canvas et suppression du point de terminaison SageMaker déployé. Canvas vous facture pour la durée de la session et nous vous recommandons de vous déconnecter de Canvas lorsque vous ne l'utilisez pas. Faire référence à Déconnexion d'Amazon SageMaker Canvas pour plus de détails.

Conclusion

Dans cet article, nous avons expliqué comment Canvas peut aider à opérationnaliser des modèles ML dans des environnements de production sans nécessiter d'expertise en ML. Dans notre exemple, nous avons montré comment un analyste peut rapidement créer un modèle ML prédictif très précis sans écrire de code et l'enregistrer dans le registre des modèles. L'équipe MLOps peut ensuite l'examiner et soit rejeter le modèle, soit approuver le modèle et lancer le processus de déploiement CI/CD en aval.

Pour commencer votre parcours ML low-code/no-code, reportez-vous à Toile Amazon SageMaker.

Remerciements particuliers à tous ceux qui ont contribué au lancement :

Backend:

- Huayuan (Alice) Wu

- Krittaphat Pugdeethosapol

- Yanda Hu

- Jean il

- Esha Dutta

- Prasanth

L'extrémité avant:

- Marchand Kaiz

- Ed Cheung

À propos des auteurs

Janisha Anand est chef de produit senior au sein de l'équipe SageMaker Low/No Code ML, qui comprend SageMaker Autopilot. Elle aime le café, rester active et passer du temps avec sa famille.

Janisha Anand est chef de produit senior au sein de l'équipe SageMaker Low/No Code ML, qui comprend SageMaker Autopilot. Elle aime le café, rester active et passer du temps avec sa famille.

Krittaphat Pugdeethosapol est ingénieur en développement logiciel chez Amazon SageMaker et travaille principalement avec les produits low-code et no-code de SageMaker.

Krittaphat Pugdeethosapol est ingénieur en développement logiciel chez Amazon SageMaker et travaille principalement avec les produits low-code et no-code de SageMaker.

Huayuan (Alice) Wu est ingénieur en développement logiciel chez Amazon SageMaker. Elle se concentre sur la création d'outils et de produits ML pour les clients. En dehors du travail, elle aime le plein air, le yoga et la randonnée.

Huayuan (Alice) Wu est ingénieur en développement logiciel chez Amazon SageMaker. Elle se concentre sur la création d'outils et de produits ML pour les clients. En dehors du travail, elle aime le plein air, le yoga et la randonnée.

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- PlatoAiStream. Intelligence des données Web3. Connaissance Amplifiée. Accéder ici.

- Frapper l'avenir avec Adryenn Ashley. Accéder ici.

- Achetez et vendez des actions de sociétés PRE-IPO avec PREIPO®. Accéder ici.

- La source: https://aws.amazon.com/blogs/machine-learning/operationalize-ml-models-built-in-amazon-sagemaker-canvas-to-production-using-the-amazon-sagemaker-model-registry/

- :est

- :ne pas

- :où

- ][p

- 1

- 100

- 15%

- 420

- 7

- 8

- a

- Capable

- accès

- Compte

- précision

- Avec cette connaissance vient le pouvoir de prendre

- infection

- activité

- ajoutée

- admin

- Avancée

- Avantage

- Après

- Tous

- permettre

- permet

- Bien que

- Amazon

- Amazon Sage Maker

- Toile Amazon SageMaker

- parmi

- an

- analyste

- Analystes

- il analyse

- ainsi que

- Une autre

- tous

- Application

- approbation

- approuver

- ,

- SONT

- AS

- associé

- At

- vérifiable

- automatiquement

- automatiser

- Automation

- éviter

- AWS

- BE

- car

- before

- va

- LES MEILLEURS

- Billets

- corps

- construire

- Développement

- construit

- la performance des entreprises

- mais

- by

- CAN

- la toile

- maisons

- catalogues

- les causes

- central

- centralisée

- Change

- modifié

- Modifications

- des charges

- le choix

- Selectionnez

- cliquez

- code

- Café

- collaboration

- conformité

- configuration

- confusion

- contribué

- des bactéries

- Correspondant

- engendrent

- créée

- Courant

- Customiser

- des clients

- Clients

- données

- Data Scientist

- datetime

- décisions

- Département

- déployer

- déployé

- déployer

- déploiement

- déploiements

- déploie

- détails

- Développeur

- Développement

- différent

- discuté

- Ne fait pas

- domaine

- durée

- chacun

- même

- non plus

- permet

- permettant

- fin

- Endpoint

- ingénieur

- Les ingénieurs

- assurer

- Environment

- environnements

- essential

- évaluer

- événement

- événements

- Chaque

- tout le monde

- exemple

- existant

- d'experience

- nous a permis de concevoir

- famille

- Fonctionnalités:

- se concentre

- Abonnement

- suit

- Pour

- De

- plein

- avenir

- générer

- généré

- obtenez

- Donner

- Go

- gouvernance

- octroi

- l'

- Réservation de groupe

- EN COURS

- Vous avez

- ayant

- vous aider

- ici

- très

- historique

- Histoire

- Accueil

- hôtes

- flotter

- Comment

- Cependant

- HTML

- HTTPS

- ID

- identifier

- if

- importer

- amélioré

- in

- comprendre

- inclut

- Y compris

- influencé

- d'information

- initier

- Des instructions

- l'intégration

- Interfaces

- développement

- vous aider à faire face aux problèmes qui vous perturbent

- IT

- SES

- chemin

- jpg

- en gardant

- ACTIVITES

- lancer

- apprentissage

- Gamme

- Liste

- emplacement

- enregistrement

- click

- machine learning

- principalement

- a prendre une

- gérer

- manager

- gère

- les gérer

- Stratégie

- Matrice

- veux dire

- membre

- mentionné

- Métadonnées

- Métrique

- ML

- MLOps

- Breeze Mobile

- téléphone mobile

- modèle

- numériques jumeaux (digital twin models)

- Stack monitoring

- PLUS

- (en fait, presque toutes)

- Bougez

- must

- prénom

- NAVIGUER

- Navigation

- nécessaire

- Besoin

- Besoins

- Nouveauté

- aucune

- cahier

- maintenant

- objectif

- of

- on

- uniquement

- ouvert

- opérateur

- or

- OS

- Autre

- nos

- ande

- l'extérieur

- au contrôle

- plus de

- propre

- paquet

- Forfaits

- page

- pandas

- pain

- particulier

- En attente

- Effectuer

- performant

- effectuer

- effectue

- autorisations

- Téléphone

- Place

- Platon

- Intelligence des données Platon

- PlatonDonnées

- joue

- fiche

- population

- Post

- défaillances

- prédiction

- Prédictions

- conditions préalables

- empêche

- précédent

- Problème

- processus

- les process

- Produit

- chef de produit

- Vidéo

- Produits

- promotion

- aportando

- Rapide

- vite.

- en temps réel

- recommander

- vous inscrire

- inscrit

- Inscription

- enregistrement

- Supprimé

- remplacer

- dépôt

- Exigences

- Resources

- réponse

- responsables

- revenir

- Avis

- examiné

- examen

- bon

- Analyse

- Rôle

- Courir

- sagemaker

- même

- Scientifique

- scientifiques

- But

- sur le lien

- choisi

- supérieur

- Session

- mise

- partage

- elle

- devrait

- montré

- unique

- So

- Logiciels

- développement de logiciels

- RÉSOUDRE

- quelques

- Sources

- Dépenses

- parties prenantes

- Standard

- Commencer

- Région

- Statut

- Étapes

- Boutique

- stockage

- rationaliser

- studio

- Avec succès

- tel

- Appareils

- SYS

- Prenez

- équipe

- Merci

- qui

- La

- leur

- Les

- puis

- Ces

- l'ont

- this

- trois

- fiable

- à

- les outils

- suivre

- Train

- qualifié

- Formation

- typiquement

- sous

- comprendre

- Mises à jour

- a actualisé

- us

- utilisé

- cas d'utilisation

- d'utiliser

- Utilisateur

- en utilisant

- Plus-value

- divers

- version

- walkthrough

- souhaitez

- façons

- we

- ont été

- quand

- que

- qui

- tout en

- WHO

- sera

- comprenant

- dans les

- sans

- activités principales

- de travail

- vos contrats

- pourra

- écrire

- écriture

- Oui

- Yoga

- Vous n'avez

- Votre

- zéphyrnet