In Partie 1 de cette série, nous avons présenté une solution utilisant le Intégrations multimodales Amazon Titan modèle pour convertir des diapositives individuelles d’un jeu de diapositives en intégrations. Nous avons stocké les plongements dans une base de données vectorielles, puis utilisé le Grand assistant de langage et de vision (LLaVA 1.5-7b) modèle pour générer des réponses textuelles aux questions des utilisateurs en fonction de la diapositive la plus similaire extraite de la base de données vectorielles. Nous avons utilisé les services AWS, notamment Socle amazonien, Amazon Sage Makeret la Amazon OpenSearch sans serveur dans cette solution.

Dans cet article, nous démontrons une approche différente. Nous utilisons le Anthropique Claude 3 Sonnet modèle pour générer des descriptions textuelles pour chaque diapositive du diaporama. Ces descriptions sont ensuite converties en intégrations de texte à l'aide du Intégrations de texte Amazon Titan modèle et stocké dans une base de données vectorielles. Ensuite, nous utilisons le modèle Claude 3 Sonnet pour générer des réponses aux questions des utilisateurs basées sur la description textuelle la plus pertinente extraite de la base de données vectorielles.

Vous pouvez tester les deux approches pour votre ensemble de données et évaluer les résultats pour voir quelle approche vous donne les meilleurs résultats. Dans la troisième partie de cette série, nous évaluons les résultats des deux méthodes.

Vue d'ensemble de la solution

La solution fournit une implémentation permettant de répondre aux questions à l'aide d'informations contenues dans le texte et les éléments visuels d'un diaporama. La conception s'appuie sur le concept de Retrieval Augmented Generation (RAG). Traditionnellement, RAG a été associé à des données textuelles pouvant être traitées par de grands modèles de langage (LLM). Dans cette série, nous étendons RAG pour inclure également des images. Cela fournit une puissante capacité de recherche pour extraire du contenu contextuellement pertinent à partir d'éléments visuels tels que des tableaux et des graphiques ainsi que du texte.

Cette solution comprend les composants suivants :

- Amazon Titan Text Embeddings est un modèle d'intégration de texte qui convertit le texte en langage naturel, y compris des mots simples, des phrases ou même des documents volumineux, en représentations numériques pouvant être utilisées pour alimenter des cas d'utilisation tels que la recherche, la personnalisation et le clustering basés sur la similarité sémantique.

- Claude 3 Sonnet est la nouvelle génération de modèles de pointe d'Anthropic. Sonnet est un outil polyvalent capable de gérer un large éventail de tâches, depuis le raisonnement et l'analyse complexes jusqu'aux résultats rapides, ainsi que la recherche et la récupération efficaces parmi de grandes quantités d'informations.

- OpenSearch Serverless est une configuration sans serveur à la demande pour Amazon OpenSearch Service. Nous utilisons OpenSearch Serverless comme base de données vectorielle pour stocker les intégrations générées par le modèle Amazon Titan Text Embeddings. Un index créé dans la collection OpenSearch Serverless sert de magasin de vecteurs pour notre solution RAG.

- Ingestion d'Amazon OpenSearch (OSI) est un collecteur de données sans serveur entièrement géré qui fournit des données aux domaines OpenSearch Service et aux collections OpenSearch Serverless. Dans cet article, nous utilisons une API de pipeline OSI pour fournir des données au magasin de vecteurs OpenSearch Serverless.

La conception de la solution se compose de deux parties : l'ingestion et l'interaction de l'utilisateur. Lors de l'ingestion, nous traitons le jeu de diapositives d'entrée en convertissant chaque diapositive en image, en générant des descriptions et des intégrations de texte pour chaque image. Nous remplissons ensuite le magasin de données vectorielles avec les intégrations et la description textuelle de chaque diapositive. Ces étapes sont terminées avant les étapes d'interaction avec l'utilisateur.

Dans la phase d'interaction avec l'utilisateur, une question de l'utilisateur est convertie en intégrations de texte. Une recherche de similarité est effectuée sur la base de données vectorielles pour trouver une description textuelle correspondant à une diapositive pouvant potentiellement contenir des réponses à la question de l'utilisateur. Nous fournissons ensuite la description de la diapositive et la question de l'utilisateur au modèle Claude 3 Sonnet pour générer une réponse à la requête. Tout le code de cet article est disponible dans le GitHub dépôt.

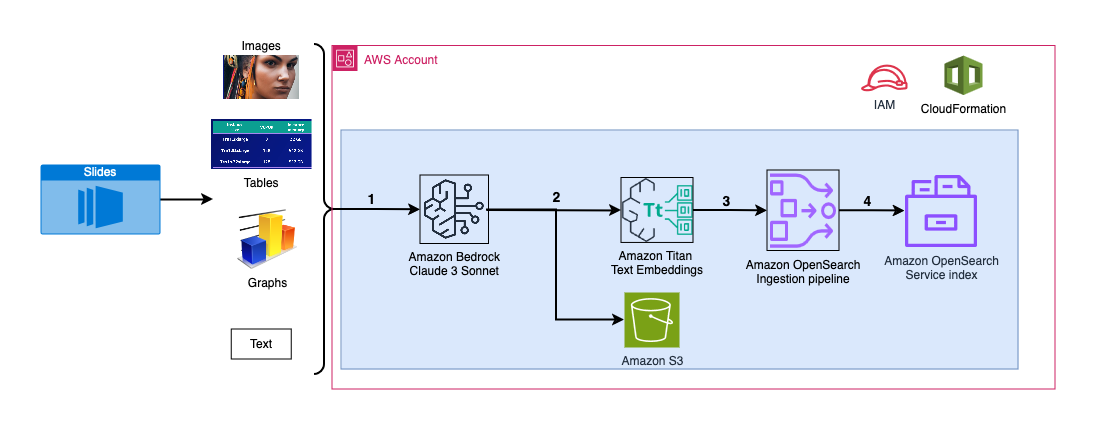

Le diagramme suivant illustre l’architecture d’ingestion.

Le flux de travail comprend les étapes suivantes :

- Les diapositives sont converties en fichiers image (une par diapositive) au format JPG et transmises au modèle Claude 3 Sonnet pour générer une description textuelle.

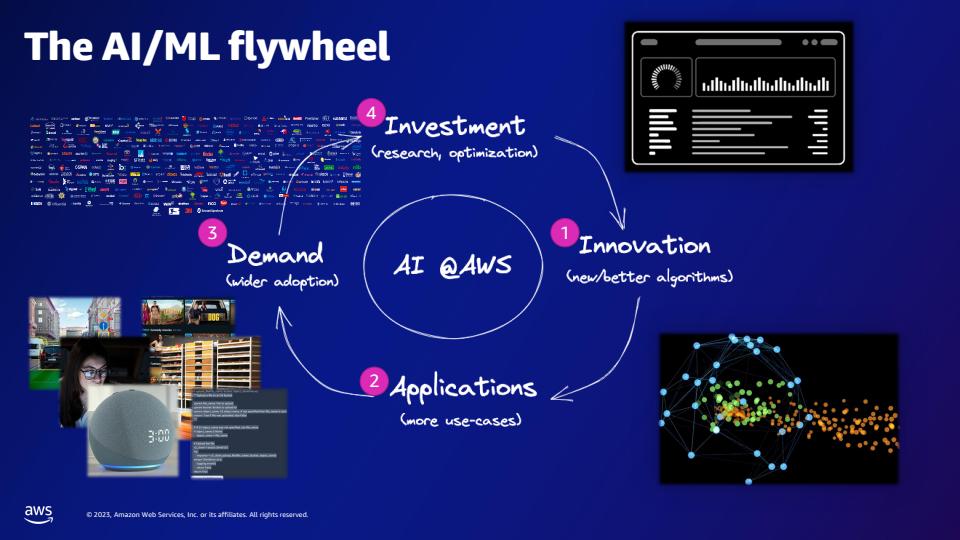

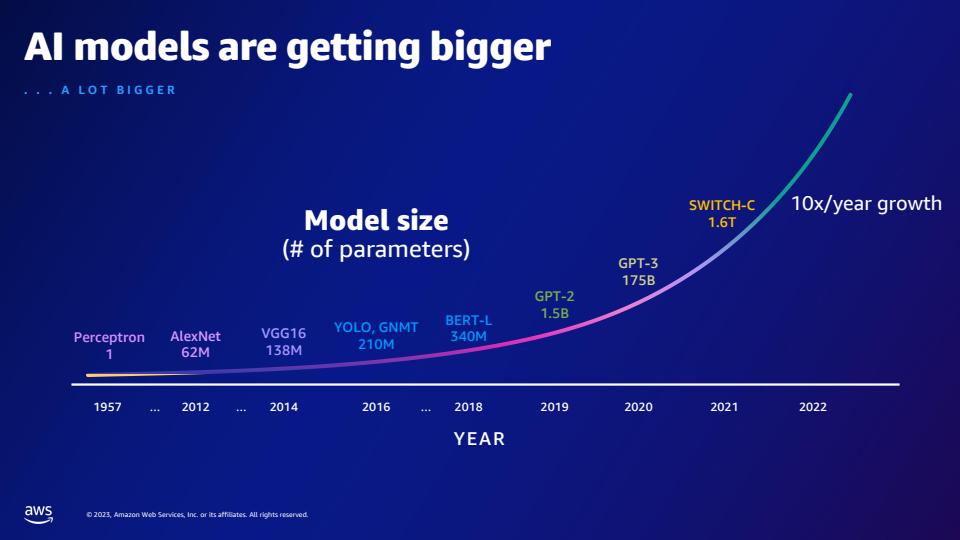

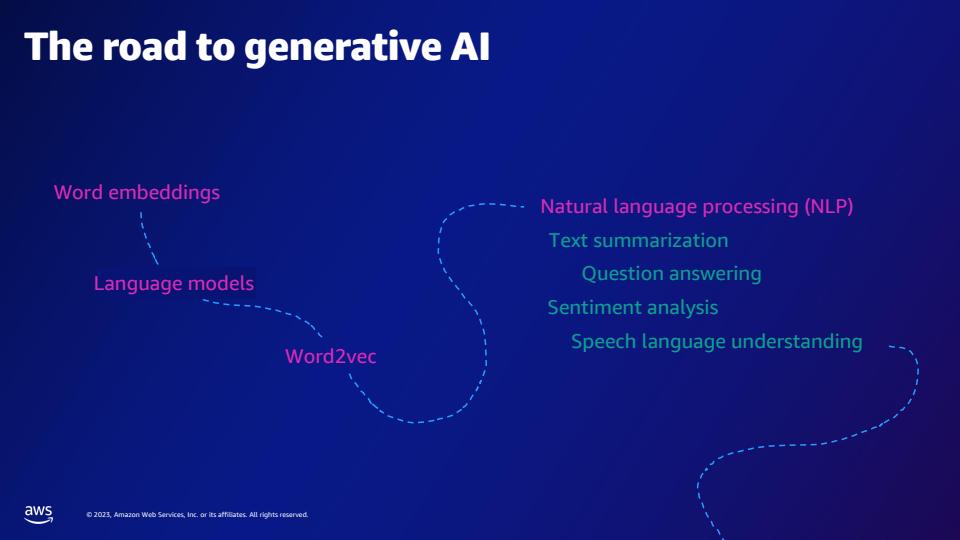

- Les données sont envoyées au modèle Amazon Titan Text Embeddings pour générer des intégrations. Dans cette série, nous utilisons le diaporama Former et déployer Stable Diffusion à l'aide d'AWS Trainium et AWS Inferentia du sommet AWS à Toronto, en juin 2023, pour démontrer la solution. La banque d'échantillons comporte 31 diapositives, nous générons donc 31 ensembles d'intégrations vectorielles, chacune avec 1536 XNUMX dimensions. Nous ajoutons des champs de métadonnées supplémentaires pour effectuer des requêtes de recherche riches en utilisant les puissantes capacités de recherche d'OpenSearch.

- Les intégrations sont ingérées dans un pipeline OSI à l'aide d'un appel API.

- Le pipeline OSI ingère les données sous forme de documents dans un index OpenSearch Serverless. L'index est configuré comme récepteur pour ce pipeline et est créé dans le cadre de la collection OpenSearch Serverless.

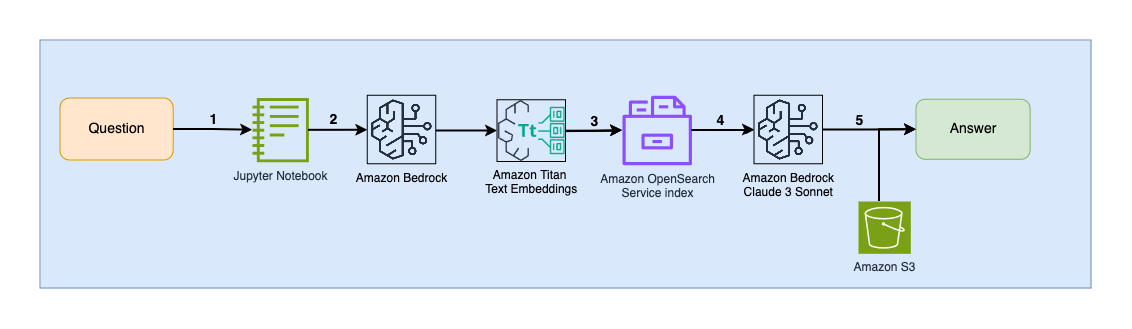

Le diagramme suivant illustre l'architecture d'interaction utilisateur.

Le flux de travail comprend les étapes suivantes :

- Un utilisateur soumet une question relative au diaporama qui a été ingéré.

- L'entrée de l'utilisateur est convertie en intégrations à l'aide du modèle Amazon Titan Text Embeddings accessible à l'aide d'Amazon Bedrock. Une recherche vectorielle OpenSearch Service est effectuée à l’aide de ces intégrations. Nous effectuons une recherche du k-voisin le plus proche (k-NN) pour récupérer les intégrations les plus pertinentes correspondant à la requête de l'utilisateur.

- Les métadonnées de la réponse d'OpenSearch Serverless contiennent un chemin vers l'image et une description correspondant à la diapositive la plus pertinente.

- Une invite est créée en combinant la question de l'utilisateur et la description de l'image. L'invite est fournie à Claude 3 Sonnet hébergé sur Amazon Bedrock.

- Le résultat de cette inférence est renvoyé à l'utilisateur.

Nous discutons des étapes des deux étapes dans les sections suivantes et incluons des détails sur le résultat.

Pré-requis

Pour mettre en œuvre la solution fournie dans cet article, vous devez disposer d'un Compte AWS et familiarité avec FMs, Amazon Bedrock, SageMaker et OpenSearch Service.

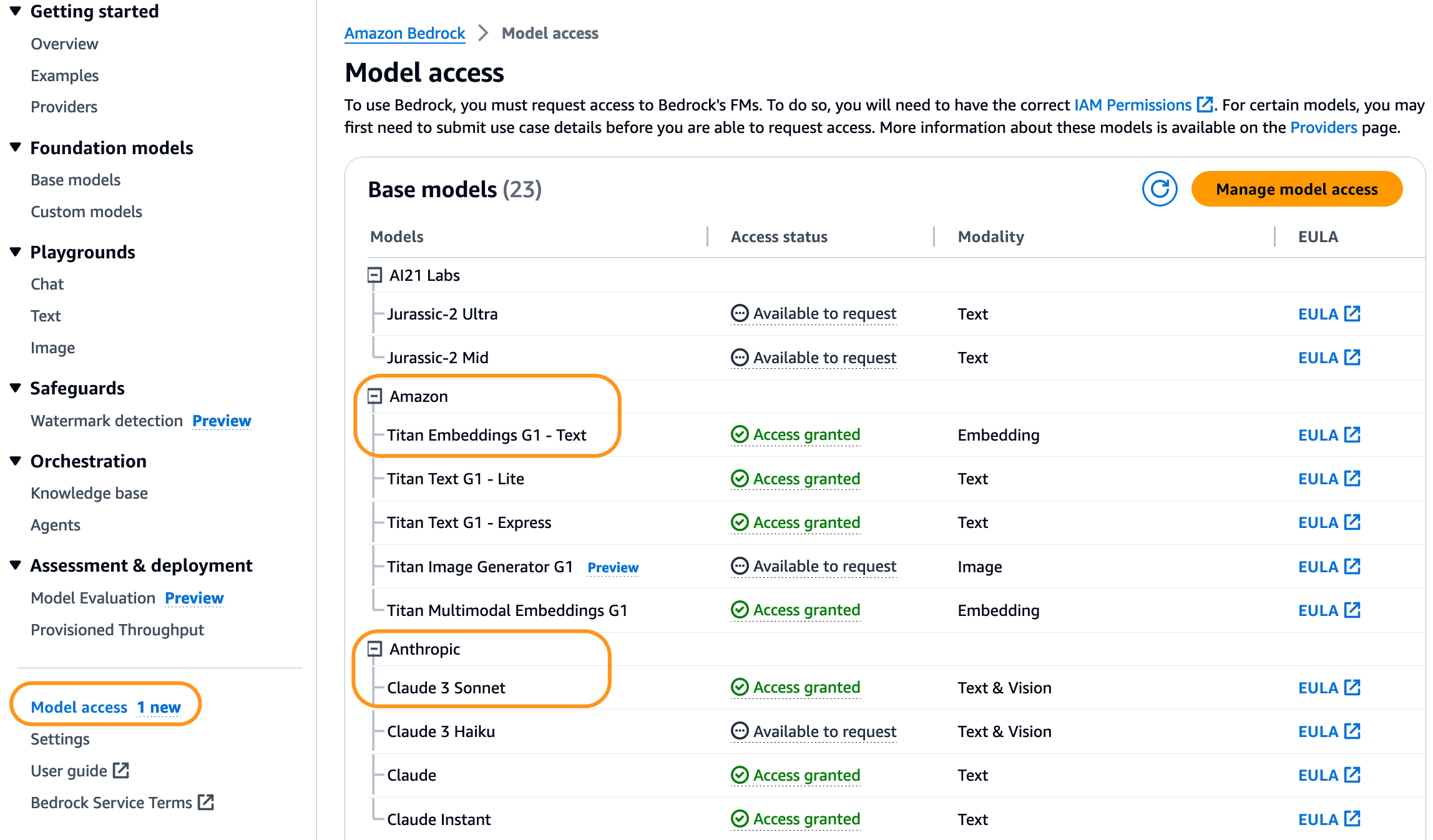

Cette solution utilise les modèles Claude 3 Sonnet et Amazon Titan Text Embeddings hébergés sur Amazon Bedrock. Assurez-vous que ces modèles sont activés pour une utilisation en accédant au Accès au modèle page sur la console Amazon Bedrock.

Si les modèles sont activés, le Statut d'accès déclarera Accès accordé.

Si les modèles ne sont pas disponibles, activez l'accès en choisissant Gérer l'accès au modèle, sélection des modèles et choix Demander l'accès au modèle. Les modèles sont activés pour une utilisation immédiate.

Utilisez AWS CloudFormation pour créer la pile de solutions

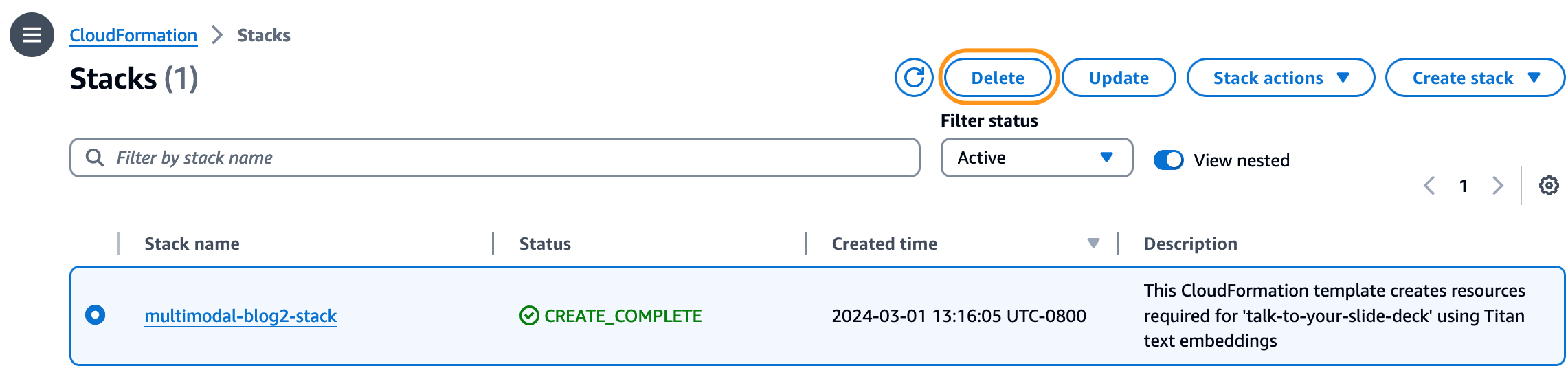

Vous pouvez utiliser AWS CloudFormation pour créer la pile de solutions. Si vous avez créé la solution pour la partie 1 dans le même compte AWS, veillez à la supprimer avant de créer cette pile.

| Région AWS | Lien |

|---|---|

us-east-1 |

|

us-west-2 |

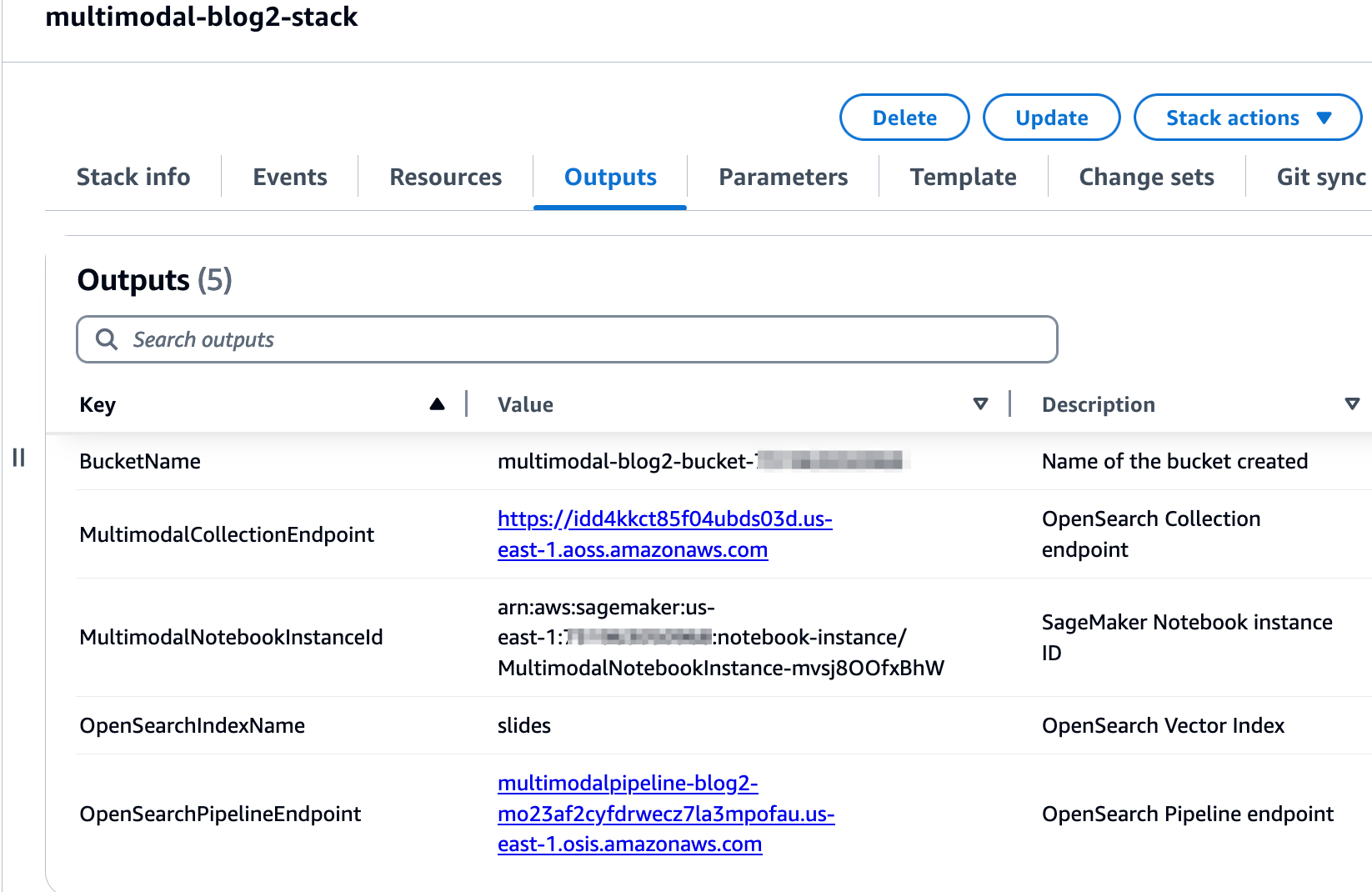

Une fois la pile créée avec succès, accédez à l'onglet Sorties de la pile sur la console AWS CloudFormation et notez les valeurs pour MultimodalCollectionEndpoint ainsi que les OpenSearchPipelineEndpoint. Vous les utiliserez dans les étapes suivantes.

Le modèle CloudFormation crée les ressources suivantes :

- Rôles IAM - Ce qui suit Gestion des identités et des accès AWS (IAM) sont créés. Mettez à jour ces rôles pour appliquer les autorisations de moindre privilège, comme indiqué dans Meilleures pratiques de sécurité.

SMExecutionRolecomprenant Service de stockage simple Amazon (Amazon S3), SageMaker, OpenSearch Service et accès complet à Amazon Bedrock.OSPipelineExecutionRoleavec accès au compartiment S3 et aux actions OSI.

- Bloc-notes SageMaker – Tout le code de cet article est exécuté à l’aide de ce notebook.

- Collection sans serveur OpenSearch – Il s’agit de la base de données vectorielles pour stocker et récupérer les intégrations.

- Pipeline OSI – Il s’agit du pipeline permettant d’ingérer des données dans OpenSearch Serverless.

- Seau S3 – Toutes les données de cette publication sont stockées dans ce compartiment.

Le modèle CloudFormation configure la configuration de pipeline requise pour configurer le pipeline OSI avec HTTP comme source et l'index OpenSearch Serverless comme récepteur. Le cahier SageMaker 2_data_ingestion.ipynb affiche comment ingérer des données dans le pipeline à l'aide de l'outil Demandes Bibliothèque HTTP.

Le modèle CloudFormation crée également réseau et, chiffrement ainsi que les accès aux données politiques requises pour votre collection OpenSearch Serverless. Mettez à jour ces stratégies pour appliquer les autorisations de moindre privilège.

Le nom du modèle CloudFormation et le nom de l'index OpenSearch Service sont référencés dans le bloc-notes SageMaker. 3_rag_inference.ipynb. Si vous modifiez les noms par défaut, assurez-vous de les mettre à jour dans le bloc-notes.

Testez la solution

Après avoir créé la pile CloudFormation, vous pouvez tester la solution. Effectuez les étapes suivantes :

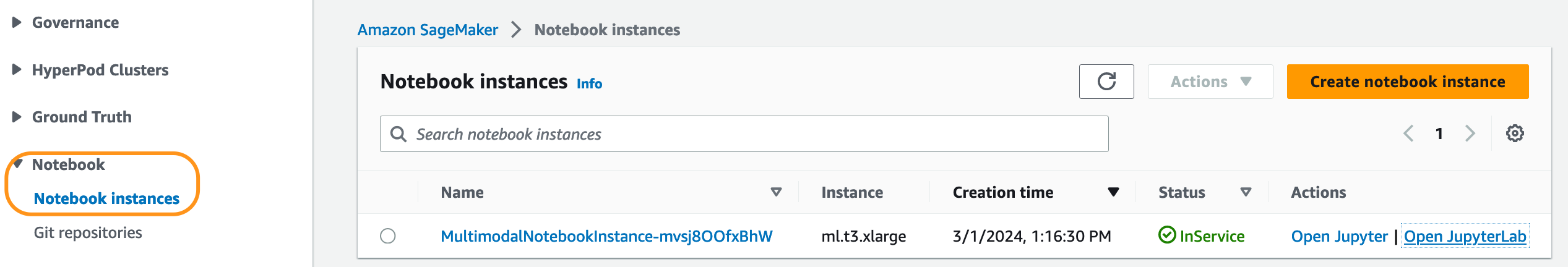

- Sur la console SageMaker, choisissez Carnets dans le volet de navigation.

- Sélectionnez

MultimodalNotebookInstanceet choisissez Ouvrez JupyterLab.

- In Navigateur de fichiers, accédez au dossier notebooks pour voir les notebooks et les fichiers de support.

Les cahiers sont numérotés dans l'ordre dans lequel ils sont exécutés. Les instructions et les commentaires dans chaque bloc-notes décrivent les actions effectuées par ce bloc-notes. Nous exécutons ces cahiers un par un.

- Selectionnez

1_data_prep.ipynbpour l'ouvrir dans JupyterLab. - Sur le Courir menu, choisissez Exécuter toutes les cellules pour exécuter le code dans ce notebook.

Ce bloc-notes téléchargera un fichier accessible au public jeu de diapositives, convertissez chaque diapositive au format de fichier JPG et téléchargez-les dans le compartiment S3.

- Selectionnez

2_data_ingestion.ipynbpour l'ouvrir dans JupyterLab. - Sur le Courir menu, choisissez Exécuter toutes les cellules pour exécuter le code dans ce notebook.

Dans ce bloc-notes, vous créez un index dans la collection OpenSearch Serverless. Cet index stocke les données d'intégration pour le diaporama. Voir le code suivant :

Vous utilisez les modèles Claude 3 Sonnet et Amazon Titan Text Embeddings pour convertir les images JPG créées dans le bloc-notes précédent en intégrations vectorielles. Ces intégrations et métadonnées supplémentaires (telles que le chemin S3 et la description du fichier image) sont stockées dans l'index avec les intégrations. L'extrait de code suivant montre comment Claude 3 Sonnet génère des descriptions d'images :

Les descriptions d'images sont transmises au modèle Amazon Titan Text Embeddings pour générer des intégrations vectorielles. Ces intégrations et métadonnées supplémentaires (telles que le chemin S3 et la description du fichier image) sont stockées dans l'index avec les intégrations. L'extrait de code suivant montre l'appel au modèle Amazon Titan Text Embeddings :

Les données sont ingérées dans l'index OpenSearch Serverless en effectuant un appel API au pipeline OSI. L'extrait de code suivant montre l'appel effectué à l'aide de la bibliothèque HTTP Requests :

- Selectionnez

3_rag_inference.ipynbpour l'ouvrir dans JupyterLab. - Sur le Courir menu, choisissez Exécuter toutes les cellules pour exécuter le code dans ce notebook.

Ce notebook implémente la solution RAG : vous convertissez la question de l'utilisateur en intégrations, trouvez une description d'image similaire dans la base de données vectorielles et fournissez la description récupérée à Claude 3 Sonnet pour générer une réponse à la question de l'utilisateur. Vous utilisez le modèle d'invite suivant :

L'extrait de code suivant fournit le workflow RAG :

Résultats

Le tableau suivant contient quelques questions et réponses des utilisateurs générées par notre implémentation. Le Question La colonne capture la question de l'utilisateur et la Compagnie de Solution column est la réponse textuelle générée par Claude 3 Sonnet. Le Image(s) La colonne affiche la correspondance de diapositive k-NN renvoyée par la recherche vectorielle OpenSearch Serverless.

Résultats RAG multimodaux

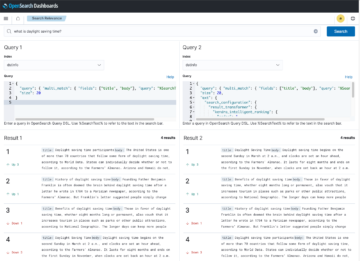

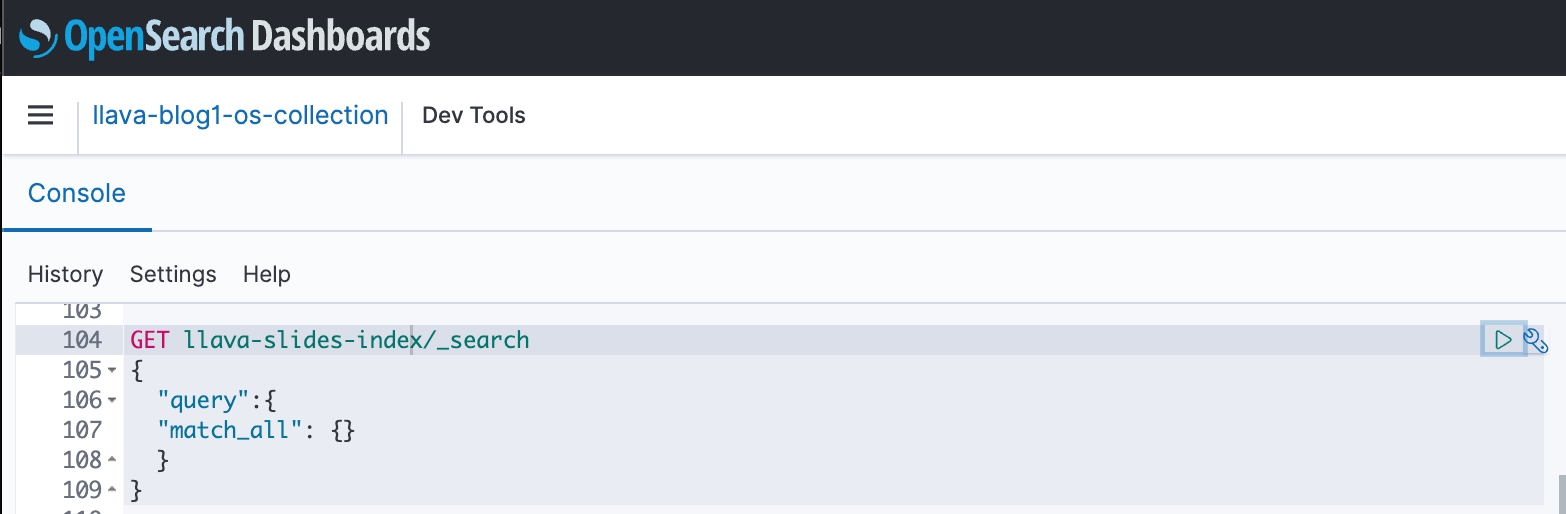

Interrogez votre index

Vous pouvez utiliser les tableaux de bord OpenSearch pour interagir avec l'API OpenSearch afin d'exécuter des tests rapides sur votre index et vos données ingérées.

Nettoyer

Pour éviter de devoir payer des frais futurs, supprimez les ressources. Vous pouvez le faire en supprimant la pile à l'aide de la console AWS CloudFormation.

Conclusion

Les entreprises génèrent constamment du nouveau contenu et les présentations de diapositives constituent un moyen courant de partager et de diffuser des informations en interne au sein de l'organisation et en externe avec les clients ou lors de conférences. Au fil du temps, des informations riches peuvent rester enfouies et cachées dans des modalités non textuelles comme les graphiques et les tableaux de ces diaporamas.

Vous pouvez utiliser cette solution et la puissance des FM multimodaux tels que Amazon Titan Text Embeddings et Claude 3 Sonnet pour découvrir de nouvelles informations ou découvrir de nouvelles perspectives sur le contenu des diaporamas. Vous pouvez essayer différents modèles Claude disponibles sur Amazon Bedrock en mettant à jour le CLAUDE_MODEL_ID dans les globals.py fichier.

Il s'agit de la deuxième partie d'une série en trois parties. Nous avons utilisé les intégrations multimodales Amazon Titan et le modèle LLaVA dans la partie 2. Dans la partie 1, nous comparerons les approches de la partie 3 et de la partie 1.

Des parties de ce code sont publiées sous le Licence Apache 2.0.

À propos des auteurs

Amit Arora est un architecte spécialiste de l'IA et du ML chez Amazon Web Services, aidant les entreprises clientes à utiliser des services d'apprentissage automatique basés sur le cloud pour faire évoluer rapidement leurs innovations. Il est également chargé de cours auxiliaire dans le cadre du programme de science et d'analyse des données MS à l'Université de Georgetown à Washington DC.

Amit Arora est un architecte spécialiste de l'IA et du ML chez Amazon Web Services, aidant les entreprises clientes à utiliser des services d'apprentissage automatique basés sur le cloud pour faire évoluer rapidement leurs innovations. Il est également chargé de cours auxiliaire dans le cadre du programme de science et d'analyse des données MS à l'Université de Georgetown à Washington DC.

Manju Prasad est architecte de solutions senior chez Amazon Web Services. Elle se concentre sur la fourniture de conseils techniques dans une variété de domaines techniques, y compris l'IA/ML. Avant de rejoindre AWS, elle a conçu et construit des solutions pour des entreprises du secteur des services financiers ainsi que pour une startup. Elle est passionnée par le partage des connaissances et la stimulation de l’intérêt pour les talents émergents.

Manju Prasad est architecte de solutions senior chez Amazon Web Services. Elle se concentre sur la fourniture de conseils techniques dans une variété de domaines techniques, y compris l'IA/ML. Avant de rejoindre AWS, elle a conçu et construit des solutions pour des entreprises du secteur des services financiers ainsi que pour une startup. Elle est passionnée par le partage des connaissances et la stimulation de l’intérêt pour les talents émergents.

Archana Inapudi est architecte de solutions senior chez AWS, aidant un client stratégique. Elle possède plus d’une décennie d’expertise intersectorielle dans la direction d’initiatives techniques stratégiques. Archana est un aspirant membre de la communauté technique IA/ML chez AWS. Avant de rejoindre AWS, Archana a dirigé une migration de sources de données traditionnelles cloisonnées vers Hadoop au sein d'une entreprise de soins de santé. Elle est passionnée par l'utilisation de la technologie pour accélérer la croissance, apporter de la valeur aux clients et obtenir des résultats commerciaux.

Archana Inapudi est architecte de solutions senior chez AWS, aidant un client stratégique. Elle possède plus d’une décennie d’expertise intersectorielle dans la direction d’initiatives techniques stratégiques. Archana est un aspirant membre de la communauté technique IA/ML chez AWS. Avant de rejoindre AWS, Archana a dirigé une migration de sources de données traditionnelles cloisonnées vers Hadoop au sein d'une entreprise de soins de santé. Elle est passionnée par l'utilisation de la technologie pour accélérer la croissance, apporter de la valeur aux clients et obtenir des résultats commerciaux.

Antara Raïsa est un architecte de solutions IA et ML chez Amazon Web Services, qui soutient des clients stratégiques basés à Dallas, au Texas. Elle possède également une expérience de travail avec de grandes entreprises partenaires chez AWS, où elle a travaillé en tant qu'architecte de solutions de réussite partenaire pour des clients centrés sur le numérique.

Antara Raïsa est un architecte de solutions IA et ML chez Amazon Web Services, qui soutient des clients stratégiques basés à Dallas, au Texas. Elle possède également une expérience de travail avec de grandes entreprises partenaires chez AWS, où elle a travaillé en tant qu'architecte de solutions de réussite partenaire pour des clients centrés sur le numérique.

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- PlatoData.Network Ai générative verticale. Autonomisez-vous. Accéder ici.

- PlatoAiStream. Intelligence Web3. Connaissance Amplifiée. Accéder ici.

- PlatonESG. Carbone, Technologie propre, Énergie, Environnement, Solaire, La gestion des déchets. Accéder ici.

- PlatoHealth. Veille biotechnologique et essais cliniques. Accéder ici.

- La source: https://aws.amazon.com/blogs/machine-learning/talk-to-your-slide-deck-using-multimodal-foundation-models-hosted-on-amazon-bedrock-and-amazon-sagemaker-part-2/

- :possède

- :est

- :ne pas

- :où

- $UP

- 1

- 10

- 100

- 12

- 15%

- 17

- 173

- 175

- 20

- 2019

- 2020

- 2023

- 23

- 24

- 27

- 30

- 31

- 7

- 8

- 9

- a

- capacités

- Qui sommes-nous

- accélérer

- accès

- accédé

- Compte

- atteindre

- à travers

- actes

- ajouter

- Supplémentaire

- adjoint

- Adoption

- avantages

- AI

- Modèles AI

- AI / ML

- algorithmes

- Tous

- le long de

- aussi

- Amazon

- Amazon EC2

- Service Amazon OpenSearch

- Amazon Web Services

- quantités

- an

- selon une analyse de l’Université de Princeton

- analytique

- ainsi que les

- et infrastructure

- répondre

- répondre

- réponses

- Anthropique

- tous

- quoi que ce soit d'artificiel

- api

- Application

- Le développement d'applications

- applications

- Appliquer

- une approche

- approches

- d'environ

- architecture

- SONT

- artificiel

- intelligence artificielle

- L'INTELLIGENCE ARTIFICIELLE ET LE MACHINE LEARNING

- AS

- demander

- en herbe

- Assistante gérante

- associé

- At

- augmentée

- Auth

- disponibles

- éviter

- AWS

- AWS CloudFormation

- basé

- BE

- était

- before

- LES MEILLEURS

- Améliorée

- jusqu'à XNUMX fois

- Milliards

- corps

- tous les deux

- construit

- la performance des entreprises

- mais

- by

- Appelez-nous

- CAN

- ne peut pas

- capacités

- aptitude

- captures

- cas

- Change

- des charges

- Selectionnez

- choose

- client

- regroupement

- code

- collection

- collections

- collectionneur

- Colonne

- combinant

- commentaires

- Commun

- Communautés

- Sociétés

- Société

- comparable

- comparer

- par rapport

- comparant

- Comparaison

- complet

- Complété

- complexe

- composants électriques

- concept

- concis

- conférences

- configuration

- configurée

- consiste

- Console

- contiennent

- contenu

- contient

- contenu

- contexte

- continu

- convertir

- converti

- conversion

- Correspondant

- pourriez

- engendrent

- créée

- crée des

- La création

- Lettres de créance

- des clients

- Clients

- cycle

- Dallas

- tableaux de bord

- données

- science des données

- Base de données

- décennie

- pont

- Réglage par défaut

- livrer

- offre

- Demande

- démontrer

- déployer

- décrire

- décrit

- la description

- Conception

- un

- détails

- développement

- Développement

- diagramme

- DICT

- différence

- différent

- La diffusion

- Dimension

- dimensions

- découvrez

- discuter

- discuté

- Commande

- affiche

- do

- INSTITUTIONNELS

- domaines

- download

- motivation

- conduite

- pendant

- e

- chacun

- efficace

- éléments

- enrobage

- économies émergentes.

- permettre

- activé

- permettant

- Moteur

- Entreprise

- erreur

- évaluer

- Pourtant, la

- Sauf

- exception

- d'experience

- nous a permis de concevoir

- étendre

- extérieurement

- extrait

- Familiarité

- champ

- Des champs

- Déposez votre dernière attestation

- Fichiers

- la traduction de documents financiers

- services financiers

- Trouvez

- se concentre

- Abonnement

- Pour

- le format

- favoriser

- Fondation

- de

- Carburant

- plein

- d’étiquettes électroniques entièrement

- plus

- avenir

- générer

- généré

- génère

- générateur

- génération

- génératif

- IA générative

- georgetown

- GitHub

- donné

- donne

- aller

- graphiques

- Croissance

- l'orientation

- ait eu

- manipuler

- Vous avez

- he

- la médecine

- aider

- caché

- augmentation

- Faits saillants

- Hits

- hôte

- organisé

- hôtes

- Comment

- How To

- Cependant

- HTML

- http

- HTTPS

- humain

- i

- Identite

- if

- illustre

- image

- satellite

- immédiatement

- Mettre en oeuvre

- la mise en oeuvre

- met en oeuvre

- améliorations

- in

- comprendre

- inclut

- Y compris

- indice

- Indices

- individuel

- d'information

- Infrastructure

- les initiatives

- Innovation

- innovations

- contribution

- instance

- Des instructions

- Intelligence

- interagir

- l'interaction

- intérêt

- intérieurement

- développement

- un investissement

- IT

- joindre

- jpg

- json

- juin

- ACTIVITES

- Savoir

- spécialisées

- langue

- gros

- Latence

- conduisant

- Conduit

- apprentissage

- LED

- Bibliothèque

- Licence

- comme

- locales

- baisser

- click

- machine learning

- LES PLANTES

- Entrée

- a prendre une

- Fabrication

- gérés

- de nombreuses

- Match

- assorti

- max

- membre

- mentionner

- Menu

- messages

- Métadonnées

- méthode

- méthodes

- migration

- ML

- modèle

- numériques jumeaux (digital twin models)

- PLUS

- (en fait, presque toutes)

- MS

- prénom

- noms

- Nature

- Traitement du langage naturel

- NAVIGUER

- navigation

- Navigation

- Besoin

- Nouveauté

- next

- Aucun

- noter

- cahier

- numéroté

- numéros

- of

- code

- on

- À la demande

- ONE

- ouvert

- à mettre en œuvre pour gérer une entreprise rentable. Ce guide est basé sur trois décennies d'expérience

- or

- organisation

- OS

- Autre

- nos

- ande

- les résultats

- sortie

- sorties

- plus de

- page

- pain

- paramètre

- paramètres

- partie

- les partenaires

- partenaires,

- les pièces

- passé

- passionné

- chemin

- /

- Effectuer

- performant

- effectué

- autorisations

- Personnalisation

- perspectives

- phase

- les expressions clés

- Physique

- pipeline

- Platon

- Intelligence des données Platon

- PlatonDonnées

- politiques

- Post

- l'éventualité

- power

- solide

- présenté

- précédent

- Avant

- processus

- Traité

- traitement

- Programme

- progression

- propriétés

- fournir

- à condition de

- fournit

- aportando

- publiquement

- Les quarks

- requêtes

- question

- question

- fréquemment posées

- Rapide

- R

- chiffon

- gamme

- Nos tests de diagnostic produisent des résultats rapides et précis sans nécessiter d'équipement de laboratoire complexe et coûteux,

- rapidement

- Lire

- reçu

- référencé

- en relation

- libéré

- pertinent

- repose

- rester

- demandes

- conditions

- un article

- Resources

- réponse

- réponses

- résultat

- Résultats

- récupération

- retourner

- Rich

- Rôle

- rôle

- Courir

- pour le running

- sagemaker

- même

- échantillon

- dire

- Escaliers intérieurs

- Sciences

- Rechercher

- les sections

- secteur

- sur le lien

- sembler

- la sélection

- sémantique

- supérieur

- envoyé

- Séquence

- Série

- Sans serveur

- sert

- service

- Services

- Session

- Sets

- Paramétres

- Partager

- partage

- elle

- devrait

- Spectacles

- en silo

- similaires

- étapes

- unique

- Taille

- Glissement

- Mules

- Fragment

- sur mesure

- Solutions

- quelques

- Identifier

- Sources

- spécialiste

- groupe de neurones

- stable

- empiler

- étapes

- Commencez

- Région

- state-of-the-art

- Étapes

- storage

- Boutique

- stockée

- STORES

- stockage

- Stratégique

- ultérieur

- succès

- Avec succès

- tel

- RÉSUMÉ

- Sommet

- Support

- Appareils

- Appuyer

- sûr

- table

- Talent

- discutons-en

- tâches

- Technique

- Les technologies

- Technologie

- modèle

- tester

- tests

- Texas

- texte

- textuel

- que

- qui

- Les

- les informations

- leur

- Les

- puis

- donc

- Ces

- l'ont

- this

- débit

- fiable

- fois

- Titan

- à

- outil

- les outils

- toronto

- traditionnel

- traditionnellement

- traverser

- oui

- Essai

- TOUR

- deux

- type

- types

- devoiler

- sous

- université

- Mises à jour

- la mise à jour

- utilisé

- cas d'utilisation

- d'utiliser

- Utilisateur

- Usages

- en utilisant

- Plus-value

- Valeurs

- variété

- Vaste

- polyvalente

- visuel

- Washington

- Façon..

- we

- web

- services Web

- WELL

- Quoi

- Qu’est ce qu'

- qui

- tout en

- large

- Large gamme

- plus large

- sera

- comprenant

- dans les

- des mots

- travaillé

- workflow

- de travail

- Vous n'avez

- Votre

- zéphyrnet