Amazon SageMaker JumpStart est le centre d'apprentissage automatique (ML) de SageMaker qui fournit des modèles préformés et accessibles au public pour un large éventail de types de problèmes pour vous aider à démarrer avec l'apprentissage automatique.

Comprendre le comportement des clients est aujourd'hui une priorité pour toutes les entreprises. Comprendre pourquoi et comment les clients achètent peut contribuer à augmenter les revenus. Le taux de désabonnement des clients est un problème auquel sont confrontés un large éventail d'entreprises, des télécommunications aux banques, où les clients sont généralement perdus au profit des concurrents. Il est dans l'intérêt d'une entreprise de fidéliser les clients existants au lieu d'en acquérir de nouveaux, car il en coûte généralement beaucoup plus pour attirer de nouveaux clients. Lorsqu'elles tentent de fidéliser leurs clients, les entreprises concentrent souvent leurs efforts sur les clients les plus susceptibles de partir. Le comportement des utilisateurs et les journaux de chat du support client peuvent contenir des indicateurs précieux sur la probabilité qu'un client mette fin au service. Dans cette solution, nous formons et déployons un modèle de prédiction de désabonnement qui utilise un modèle de traitement du langage naturel (NLP) de pointe pour trouver des signaux utiles dans le texte. En plus des entrées textuelles, ce modèle utilise des entrées de données structurées traditionnelles telles que des champs numériques et catégoriels.

La multimodalité est un domaine de recherche multidisciplinaire qui répond à certains des objectifs originaux de l'intelligence artificielle en intégrant et en modélisant plusieurs modalités. Cet article vise à créer un modèle capable de traiter et de relier des informations à partir de plusieurs modalités telles que des fonctionnalités tabulaires et textuelles.

Nous vous montrons comment former, déployer et utiliser un modèle de prédiction de désabonnement qui a traité des caractéristiques numériques, catégorielles et textuelles pour faire sa prédiction. Bien que nous approfondissions un cas d'utilisation de prédiction de désabonnement dans cet article, vous pouvez utiliser cette solution comme modèle pour généraliser le réglage fin des modèles pré-formés avec votre propre ensemble de données, puis exécuter l'optimisation des hyperparamètres (HPO) pour améliorer la précision. Vous pouvez même remplacer l'exemple de jeu de données par le vôtre et l'exécuter de bout en bout pour résoudre vos propres cas d'utilisation. La solution décrite dans le message est disponible sur GitHub.

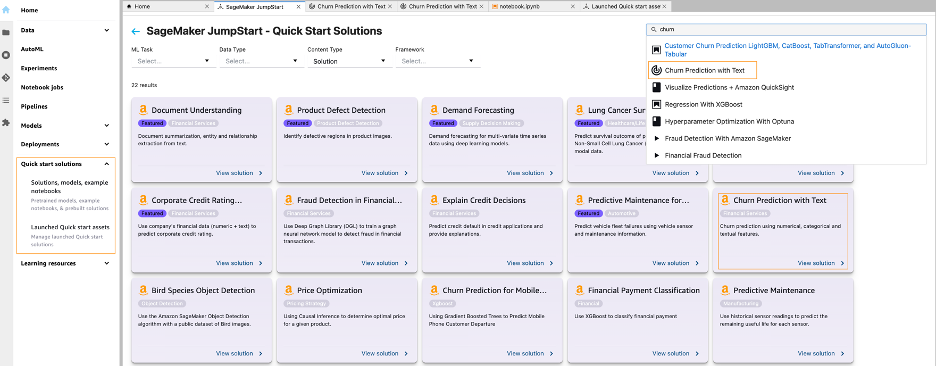

Modèles de solution JumpStart

Amazon SageMaker JumpStart fournit des solutions de bout en bout en un clic pour de nombreux cas d'utilisation courants du ML. Explorez les cas d'utilisation suivants pour plus d'informations sur les modèles de solution disponibles :

Les modèles de solution JumpStart couvrent une variété de cas d'utilisation, sous chacun desquels plusieurs modèles de solution différents sont proposés (cette solution Document Understanding est sous le cas d'utilisation "Extraire et analyser les données des documents").

Choisissez le modèle de solution qui correspond le mieux à votre cas d'utilisation sur la page d'accueil JumpStart. Pour plus d'informations sur les solutions spécifiques à chaque cas d'utilisation et sur la façon de lancer une solution JumpStart, voir Modèles de solutions.

Vue d'ensemble de la solution

La figure suivante montre comment vous pouvez utiliser cette solution avec Amazon Sage Maker Composants. Les tâches de formation SageMaker sont utilisées pour former les différents modèles NLP, et les points de terminaison SageMaker sont utilisés pour déployer les modèles à chaque étape. Nous utilisons Service de stockage simple Amazon (Amazon S3) aux côtés de SageMaker pour stocker les données de formation et les artefacts de modèle, et Amazon Cloud Watch pour consigner les sorties de formation et de point de terminaison.

Nous abordons la résolution du problème de prédiction de désabonnement avec les étapes suivantes :

- Exploration de données pour préparer les données à être prêtes pour le ML.

- Former un modèle multimodal avec un Transformateur de phrase étreignant le visage ainsi que le Classificateur de forêt aléatoire Scikit-learn.

- Améliorez encore les performances du modèle avec HPO en utilisant Réglage automatique du modèle SageMaker.

- Former deux Modèles multimodaux AutoGluon: un modèle d'ensemble multimodal pondéré/empilé AutoGluon et un modèle de fusion multimodal AutoGluon.

- Évaluez et comparez les performances du modèle sur les données de test retenues.

Pré-requis

Pour essayer le sur mesure dans votre propre compte, assurez-vous que les éléments suivants sont en place :

- Un compte AWS. Si vous n'avez pas de compte, vous pouvez inscrivez-vous pour un.

- La solution décrite dans le message fait partie de SageMaker JumpStart. Pour exécuter cette solution JumpStart et déployer l'infrastructure sur votre compte AWS, vous devez créer un Amazon SageMakerStudio exemple (voir Intégration à Amazon SageMaker Studio). Lorsque votre instance Studio est prête, suivez les instructions de JumpStart pour lancer la solution.

- Lors de l'exécution de ce cahier sur Studio, vous devez vous assurer que Python 3 (PyTorch 1.10 Python 3.8 CPU optimisé) image/noyau est utilisé.

Vous pouvez installer les packages requis comme indiqué dans la solution pour exécuter ce notebook :

Ouvrir le cas d'utilisation de la prédiction d'attrition

Sur la console Studio, choisissez Solutions, modèles, exemples de cahiers sous Solutions de démarrage rapide dans le volet de navigation. Naviguez vers le Prédiction de désabonnement avec texte solution dans JumpStart.

Nous pouvons maintenant examiner de plus près certains des actifs inclus dans cette solution.

Exploration de données

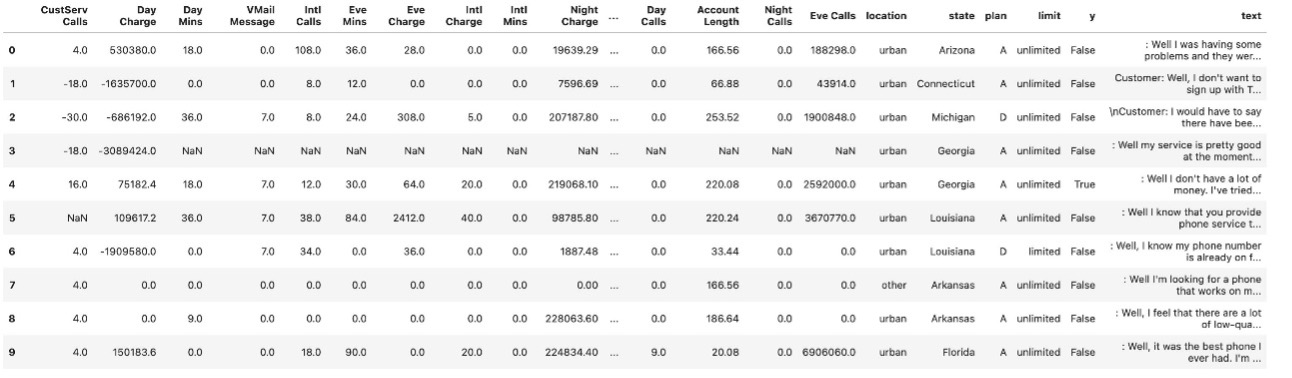

Commençons par télécharger l'ensemble de données de test, de validation et d'entraînement à partir du compartiment S3 source et chargeons-le dans notre compartiment S3. La capture d'écran suivante nous montre 10 observations des données d'entraînement.

Commençons à explorer l'ensemble de données d'entraînement et de validation.

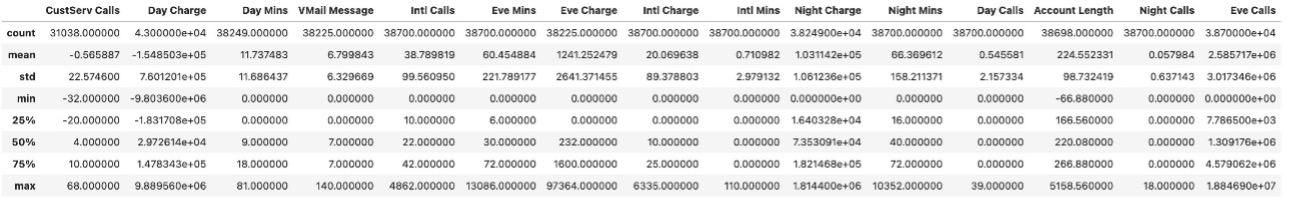

Comme vous pouvez le voir, nous avons différentes fonctionnalités telles que CustServ Calls, Day Chargeet une Day Calls que nous utilisons pour prédire la colonne cible y (si le client a quitté le service).

y qui est connu comme le attribut cible: l'attribut que nous voulons que le modèle ML prédise. Étant donné que l'attribut cible est binaire, notre modèle effectue une prédiction binaire, également appelée classement binaire.

Il existe 21 fonctionnalités, y compris la variable cible. Le nombre d'exemples de données de formation et de validation est de 43,000 5,000 et XNUMX XNUMX, respectivement.

La capture d'écran suivante montre les statistiques récapitulatives de l'ensemble de données d'entraînement.

Nous avons exploré l'ensemble de données et l'avons divisé en ensembles d'entraînement, de validation et de test. L'ensemble de formation et de validation est utilisé pour la formation et HPO. L'ensemble de test est utilisé comme ensemble d'exclusion pour l'évaluation des performances du modèle. Nous effectuons maintenant les étapes d'ingénierie des fonctionnalités, puis nous adaptons le modèle.

Ajuster un modèle multimodal avec un transformateur de phrase Hugging Face et un classificateur de forêt aléatoire Scikit-learn

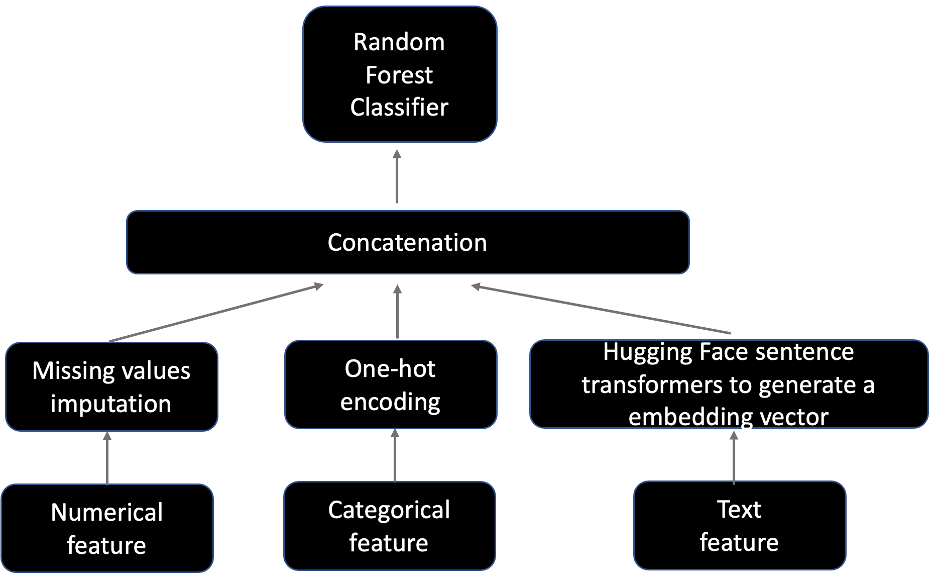

La formation du modèle se compose de deux composants : une étape d'ingénierie des fonctionnalités qui traite les fonctionnalités numériques, catégorielles et textuelles, et une étape d'ajustement du modèle qui adapte les fonctionnalités transformées dans un Classificateur de forêt aléatoire Scikit-learn.

Pour l'ingénierie des fonctionnalités, nous effectuons les étapes suivantes :

- Remplissez les valeurs manquantes pour les caractéristiques numériques.

- Encodez les fonctionnalités catégorielles en valeurs uniques, où les valeurs manquantes sont comptées comme l'une des catégories pour chaque fonctionnalité.

- Utiliser un Transformateur de phrase étreignant le visage pour coder la caractéristique de texte pour générer un vecteur dense de dimension X, où la valeur de X dépend d'un transformateur de phrase particulier.

Nous choisissons les trois modèles de transformateurs de phrases les plus téléchargés et les utilisons dans l'ajustement de modèle et le HPO suivants. Plus précisément, nous utilisons tout-MiniLM-L6-v2, multi-qa-mpnet-base-dot-v1et une paraphraser-MiniLM-L6-v2. Pour les hyperparamètres du classificateur de forêt aléatoire, reportez-vous au GitHub repo.

La figure suivante illustre le diagramme d'architecture du modèle.

Il existe de nombreux hyperparamètres que vous pouvez régler, tels que les estimateurs n, la profondeur maximale et le bootstrap. Pour plus de détails, reportez-vous au GitHub repo.

À des fins de démonstration, nous n'utilisons que des caractéristiques numériques CustServ Calls ainsi que le Account Length, caractéristiques catégorielles planet une limit, et fonctionnalité de texte text pour s'adapter au modèle. Les fonctionnalités multiples doivent être séparées par ,.

Nous déployons le modèle une fois la formation terminée :

Lors de l'appel de notre nouveau point de terminaison à partir du bloc-notes, nous utilisons un SDK SageMaker Predictor. A Predictor est utilisé pour envoyer des données à un point de terminaison (dans le cadre d'une demande) et interpréter la réponse. JSON est utilisé comme format pour les données d'entrée et la réponse de sortie, car il s'agit d'un format de point de terminaison standard et la réponse du point de terminaison peut contenir des structures de données imbriquées.

Avec notre modèle déployé avec succès et notre prédicteur configuré, nous pouvons essayer le modèle de prédiction de désabonnement sur un exemple d'entrée :

Le code suivant montre la réponse (probabilité d'attrition) suite à l'interrogation du point de terminaison :

Notez que la probabilité renvoyée par ce modèle n'a pas été calibrée. Lorsque le modèle donne une probabilité de churn de 20 %, par exemple, cela ne signifie pas nécessairement que 20 % des clients avec une probabilité de 20 % ont entraîné un churn. L'étalonnage est une propriété utile dans certaines circonstances, mais n'est pas nécessaire dans les cas où la discrimination entre les cas de désabonnement et de non-désabonnement est suffisante. CalibréClassificateurCV De Scikit-apprendre peut être utilisé pour calibrer un modèle.

Maintenant, nous interrogeons le point de terminaison à l'aide des données de test retenues, qui se composent de 1,939 XNUMX exemples. Le tableau suivant résume les résultats de l'évaluation de notre modèle multimodal avec un transformateur de phrase Hugging Face et un classificateur de forêt aléatoire Scikit-learn.

| Métrique | BERT + Forêt aléatoire |

| Précision | 0.77463 |

| AUC ROC | 0.75905 |

Les performances du modèle dépendent des configurations d'hyperparamètres. L'entraînement d'un modèle avec un ensemble de configurations d'hyperparamètres ne garantira pas un modèle optimal. Par conséquent, nous exécutons le processus HPO dans la section suivante pour améliorer encore les performances du modèle.

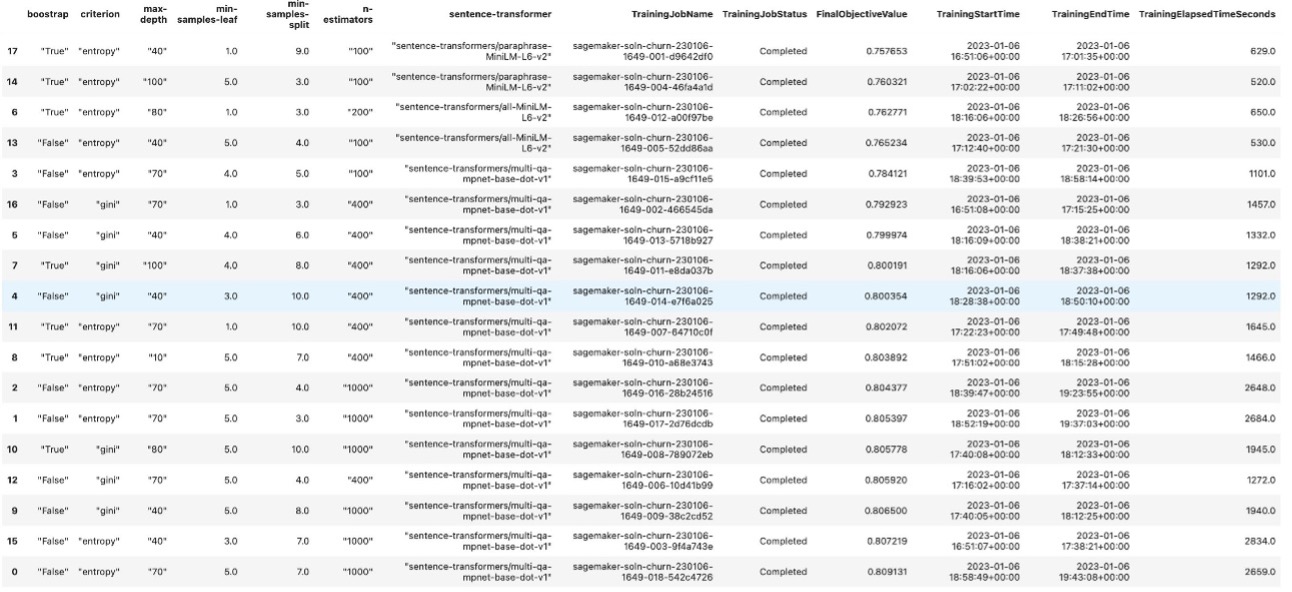

Ajuster un modèle multimodal avec HPO

Dans cette section, nous améliorons encore les performances du modèle en ajoutant le réglage HPO avec Réglage automatique du modèle SageMaker. Le réglage automatique du modèle SageMaker, également connu sous le nom de réglage des hyperparamètres, trouve la meilleure version d'un modèle en exécutant de nombreuses tâches de formation sur votre jeu de données à l'aide de l'algorithme et des plages d'hyperparamètres que vous spécifiez. Il choisit ensuite les valeurs d'hyperparamètres qui se traduisent par un modèle qui fonctionne le mieux, tel que mesuré par une métrique que vous choisissez. Le meilleur modèle et ses hyperparamètres correspondants sont sélectionnés sur les données de validation. Ensuite, le meilleur modèle est évalué sur les données de test retenues, qui sont les mêmes données de test que nous avons créées dans la section précédente. Enfin, nous montrons que les performances du modèle entraîné avec HPO sont significativement meilleures que celles entraînées sans HPO.

Voici les hyperparamètres statiques que nous ne réglons pas et les hyperparamètres dynamiques que nous voulons régler et leurs plages de recherche :

Nous définissons le nom de la métrique objective, la définition de la métrique (avec un modèle regex) et le type d'objectif pour la tâche de réglage.

Tout d'abord, nous définissons l'objectif comme le score de précision sur les données de validation (roc auc score on validation data) et défini des métriques pour la tâche de réglage en spécifiant le nom de la métrique objective et une expression régulière (regex). L'expression régulière est utilisée pour faire correspondre la sortie du journal de l'algorithme et capturer les valeurs numériques des métriques.

Ensuite, nous spécifions des plages d'hyperparamètres pour sélectionner les meilleures valeurs d'hyperparamètres. Nous fixons le nombre total de travaux de réglage à 10 et distribuons ces travaux sur cinq différents Cloud de calcul élastique Amazon (Amazon EC2) pour exécuter des tâches de réglage parallèles.

Enfin, nous transmettons ces valeurs pour instancier un objet SageMaker Estimator, similaire à ce que nous avons fait à l'étape de formation précédente. Au lieu d'appeler la fonction d'ajustement de l'objet Estimator, nous passons l'objet Estimator en tant que paramètre à la HyperparameterTuner constructor et appelez sa fonction fit pour lancer des tâches de réglage :

Lorsque la tâche de réglage est terminée, nous pouvons générer le tableau récapitulatif de toutes les tâches de réglage.

Une fois les tâches de réglage terminées, nous déployons le modèle qui donne le meilleur score de métrique d'évaluation sur l'ensemble de données de validation, effectuons l'inférence sur le même ensemble de données de test d'exclusion que nous avons fait dans la section précédente et calculons les métriques d'évaluation.

| Métrique | BERT + Forêt aléatoire | BERT + Forêt aléatoire avec HPO |

| Précision | 0.77463 | 0.9278 |

| AUC ROC | 0.75905 | 0.79861 |

Nous pouvons voir que l'exécution de HPO avec le réglage automatique du modèle SageMaker améliore considérablement les performances du modèle.

En plus de HPO, les performances du modèle dépendent également de l'algorithme. Il est important de former plusieurs algorithmes de pointe, de comparer leurs performances sur les mêmes données de test retenues et de choisir le meilleur. Par conséquent, nous formons deux autres modèles multimodaux AutoGluon dans les sections suivantes.

Ajuster un modèle d'ensemble multimodal pondéré/empilé AutoGluon

Il existe deux types de multimodalité AutoGluon :

- Entraînez plusieurs modèles tabulaires ainsi que

TextPredictormodèle (utilisant leTextPredictormodèle à l'intérieur deTabularPredictor), puis les combiner via un ensemble pondéré ou un ensemble empilé, comme expliqué dans AutoGluon-Tabular : AutoML robuste et précis pour les données structurées - Fusionnez directement plusieurs modèles de réseaux de neurones et gérez le texte brut (qui est également capable de gérer des colonnes numériques et catégorielles supplémentaires)

Nous formons d'abord un modèle d'ensemble multimodal pondéré ou empilé dans cette section, et formons un modèle de réseau neuronal de fusion dans la section suivante.

Tout d'abord, nous récupérons l'image d'entraînement AutoGluon :

Ensuite, on passe en hyperparamètres. Contrairement aux frameworks AutoML existants qui se concentrent principalement sur la sélection de modèles ou d'hyperparamètres, AutoGluonTabular réussit en assemblant plusieurs modèles et en les empilant sur plusieurs couches. Par conséquent, HPO n'est généralement pas requis pour les modèles d'ensemble AutoGluon.

Enfin, nous créons un Estimateur SageMaker et appelle estimator.fit() pour commencer un travail de formation :

Une fois la formation terminée, nous récupérons l'image d'inférence AutoGluon et déployons le modèle :

Après avoir déployé les points de terminaison, nous interrogeons le point de terminaison à l'aide du même ensemble de tests et calculons les métriques d'évaluation. Dans le tableau suivant, nous pouvons voir que l'ensemble multimodal AutoGluon améliore d'environ 3 % l'AUC ROC par rapport au transformateur de phrase BERT et à la forêt aléatoire avec HPO.

| Métrique | BERT + Forêt aléatoire | BERT + Forêt aléatoire avec HPO | Ensemble multimodal AutoGluon |

| Précision | 0.77463 | 0.9278 | 0.92625 |

| AUC ROC | 0.75905 | 0.79861 | 0.82918 |

Monter un modèle de fusion multimodal AutoGluon

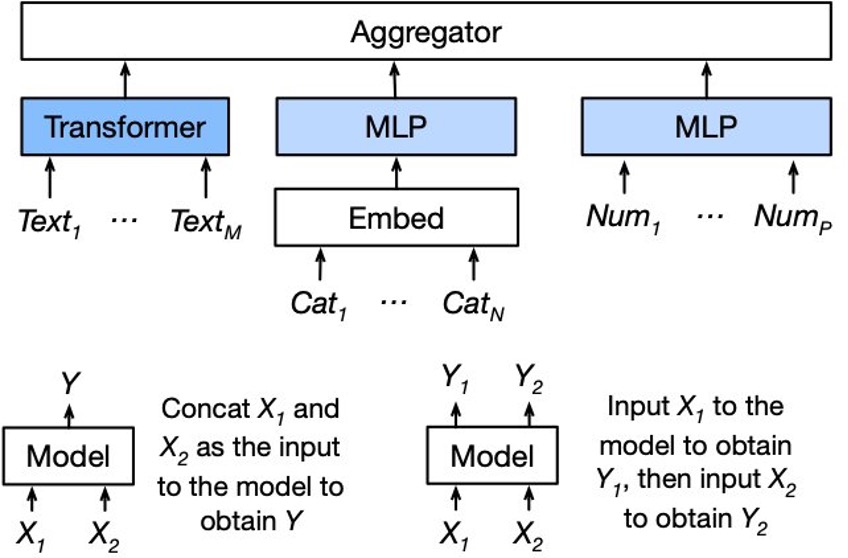

Le schéma suivant illustre l'architecture du modèle. Pour plus de détails, voir AutoMM pour Texte + Tabulaire – Démarrage rapide.

En interne, nous utilisons différents réseaux pour encoder les colonnes de texte, les colonnes catégorielles et les colonnes numériques. Les caractéristiques générées par les réseaux individuels sont agrégées par un agrégateur à fusion tardive. L'agrégateur peut produire à la fois les logits ou les prédictions de score.

Ici, nous utilisons le squelette NLP pré-entraîné pour extraire les caractéristiques textuelles, puis utilisons deux autres tours pour extraire la caractéristique de la colonne catégorielle et de la colonne numérique.

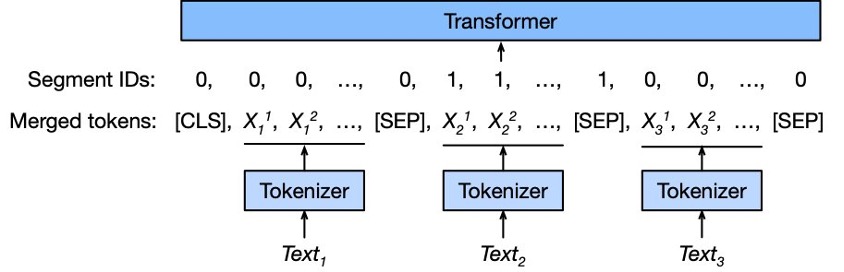

De plus, pour traiter plusieurs champs de texte, nous séparons ces champs avec le jeton [SEP] et alternons les 0 et les 1 comme ID de segment, comme illustré dans le diagramme suivant.

De même, nous suivons les instructions de la section précédente pour entraîner et déployer le modèle de fusion multimodal AutoGluon :

Le tableau suivant résume les résultats de l'évaluation du modèle de fusion multimodal AutoGluon, ainsi que ceux des trois modèles que nous avons évalués dans les sections précédentes. Nous pouvons voir que l'ensemble multimodal AutoGluon et les modèles de fusion multimodale atteignent les meilleures performances.

| Métrique | BERT + Forêt aléatoire | BERT + Forêt aléatoire avec HPO | Ensemble multimodal AutoGluon | AutoGluon Fusion Multimodale |

| Précision | 0.77463 | 0.9278 | 0.92625 | 0.9247 |

| AUC ROC | 0.75905 | 0.79861 | 0.82918 | 0.81115 |

Notez que les résultats et les performances relatives entre ces modèles dépendent de l'ensemble de données que vous utilisez pour l'entraînement. Ces résultats sont représentatifs, et même si la tendance de certains algorithmes à être plus performants est basée sur des facteurs pertinents, l'équilibre des performances peut changer en fonction d'une distribution de données différente. Vous pouvez remplacer l'exemple de jeu de données par vos propres données pour déterminer quel modèle vous convient le mieux.

Carnet de démonstration

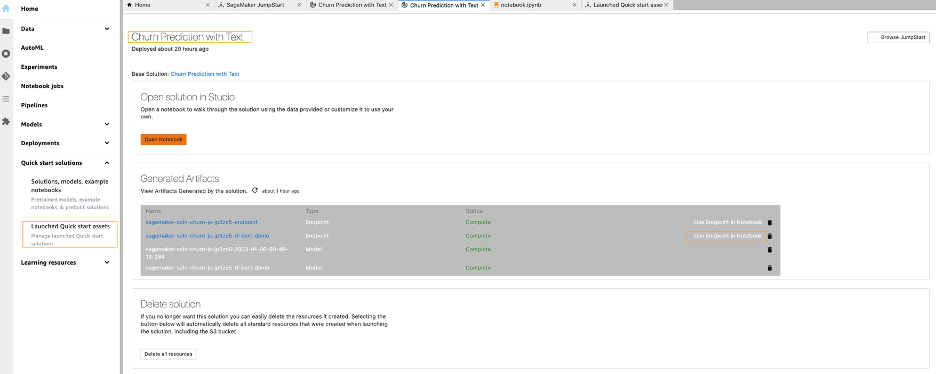

Vous pouvez utiliser le bloc-notes de démonstration pour envoyer des exemples de données à des points de terminaison de modèle déjà déployés. Le bloc-notes de démonstration vous permet d'acquérir rapidement une expérience pratique en interrogeant les exemples de données. Après avoir lancé la solution Churn Prediction with Text, ouvrez le bloc-notes de démonstration en choisissant Utiliser le point de terminaison dans Notebook.

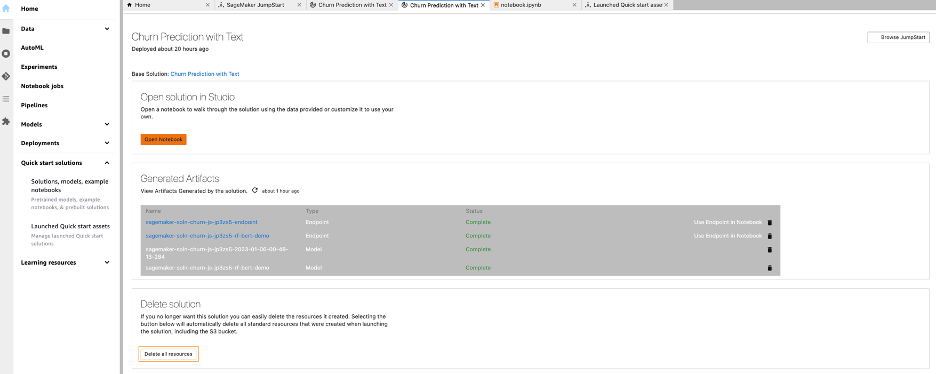

Nettoyer

Lorsque vous avez terminé avec cette solution, assurez-vous de supprimer toutes les ressources AWS indésirables en choisissant Supprimer toutes les ressources.

Notez que vous devez supprimer manuellement toutes les ressources supplémentaires que vous avez éventuellement créées dans ce bloc-notes.

Conclusion

Dans cet article, nous avons montré comment vous pouvez utiliser Sagemaker JumpStart pour prédire l'attrition en utilisant la multimodalité des fonctionnalités textuelles et tabulaires.

Si vous souhaitez en savoir plus sur les modèles de désabonnement des clients, consultez les articles suivants :

À propos des auteurs

Dr Xin Huang est un scientifique appliqué pour Amazon SageMaker JumpStart et les algorithmes intégrés d'Amazon SageMaker. Il se concentre sur le développement d'algorithmes d'apprentissage automatique évolutifs. Ses intérêts de recherche portent sur le traitement du langage naturel, l'apprentissage en profondeur explicable sur des données tabulaires et l'analyse robuste du clustering spatio-temporel non paramétrique. Il a publié de nombreux articles dans les conférences ACL, ICDM, KDD et Royal Statistical Society: Series A journal.

Dr Xin Huang est un scientifique appliqué pour Amazon SageMaker JumpStart et les algorithmes intégrés d'Amazon SageMaker. Il se concentre sur le développement d'algorithmes d'apprentissage automatique évolutifs. Ses intérêts de recherche portent sur le traitement du langage naturel, l'apprentissage en profondeur explicable sur des données tabulaires et l'analyse robuste du clustering spatio-temporel non paramétrique. Il a publié de nombreux articles dans les conférences ACL, ICDM, KDD et Royal Statistical Society: Series A journal.

Rajakumar Sampathkumar est responsable de compte technique principal chez AWS, fournissant des conseils aux clients sur l'alignement des technologies commerciales et soutenant la réinvention de leurs modèles et processus d'exploitation du cloud. Il est passionné par le cloud et l'apprentissage automatique. Raj est également un spécialiste de l'apprentissage automatique et travaille avec les clients AWS pour concevoir, déployer et gérer leurs charges de travail et architectures AWS.

Rajakumar Sampathkumar est responsable de compte technique principal chez AWS, fournissant des conseils aux clients sur l'alignement des technologies commerciales et soutenant la réinvention de leurs modèles et processus d'exploitation du cloud. Il est passionné par le cloud et l'apprentissage automatique. Raj est également un spécialiste de l'apprentissage automatique et travaille avec les clients AWS pour concevoir, déployer et gérer leurs charges de travail et architectures AWS.

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- Platoblockchain. Intelligence métaverse Web3. Connaissance Amplifiée. Accéder ici.

- La source: https://aws.amazon.com/blogs/machine-learning/churn-prediction-using-multimodality-of-text-and-tabular-features-with-amazon-sagemaker-jumpstart/

- 000

- 1

- 10

- 100

- 28

- 7

- 70

- 9

- a

- A Propos

- Compte

- précision

- Avec cette connaissance vient le pouvoir de prendre

- atteindre

- acquisition

- infection

- ajout

- Supplémentaire

- adresses

- Après

- Agent

- Aggregator

- vise

- algorithme

- algorithmes

- Tous

- permet

- aux côtés de

- Bien que

- Amazon

- Amazon EC2

- Amazon Sage Maker

- Amazon SageMaker JumpStart

- selon une analyse de l’Université de Princeton

- il analyse

- ainsi que le

- appliqué

- une approche

- architecture

- Réservé

- artificiel

- intelligence artificielle

- Outils

- Automatique

- AutoML

- disponibles

- AWS

- Colonne vertébrale

- Balance

- Services bancaires

- basé

- car

- LES MEILLEURS

- Améliorée

- jusqu'à XNUMX fois

- Bootstrap

- construire

- intégré

- la performance des entreprises

- acheter

- Appelez-nous

- appel

- Appels

- capable

- capturer

- porter

- maisons

- cas

- catégories

- certaines

- Chance

- Change

- vérifier

- Selectionnez

- choose

- conditions

- classification

- plus

- le cloud

- regroupement

- code

- Colonne

- Colonnes

- combiner

- Commun

- Sociétés

- De l'entreprise

- comparer

- par rapport

- concurrents

- complet

- composants électriques

- calcul

- conférences

- Console

- Contenant

- contrat

- contrats

- Correspondant

- Costs

- couverture

- engendrent

- créée

- des clients

- comportement de la clientèle

- Service à la clientèle

- Support à la clientèle

- Clients

- données

- affaire

- traitement

- décidé

- profond

- l'apprentissage en profondeur

- dépendant

- dépend

- déployer

- déployé

- Conception

- détails

- Déterminer

- développement

- DID

- différent

- directement

- distribuer

- distribution

- Docker

- document

- Ne fait pas

- Ne pas

- download

- Dynamic

- chacun

- efforts

- non plus

- end-to-end

- Endpoint

- ENGINEERING

- évalué

- évaluation

- Pourtant, la

- exemple

- exemples

- existant

- d'experience

- expliqué

- exploration

- explorez

- Exploré

- Explorer

- extrait

- extrêmement

- Visage

- face

- facteurs

- Fonctionnalité

- Fonctionnalités:

- champ

- Des champs

- Figure

- finalement

- Trouvez

- trouve

- Prénom

- s'adapter

- raccord

- Focus

- se concentre

- suivre

- Abonnement

- forêt

- le format

- cadres

- De

- fonction

- plus

- la fusion

- gagner

- générer

- généré

- obtenez

- donné

- donne

- gluon

- Objectifs

- Bien

- Croître

- guarantir

- manipuler

- Maniabilité

- hands-on

- vous aider

- utile

- Comment

- How To

- HTML

- HTTPS

- Moyeu

- Optimisation hyperparamétrique

- Réglage des hyperparamètres

- identifier

- image

- importer

- important

- améliorer

- in

- inclus

- Y compris

- Améliore

- Indicateurs

- individuel

- d'information

- Infrastructure

- contribution

- idées.

- installer

- instance

- plutôt ;

- Des instructions

- Intégration

- Intelligence

- intérêt

- intéressé

- intérêts

- impliqué

- vous aider à faire face aux problèmes qui vous perturbent

- IT

- Emploi

- Emplois

- Journal

- json

- ACTIVITES

- Genre

- connu

- atterrissage

- langue

- lancer

- poules pondeuses

- apprentissage

- Laisser

- Longueur

- Probable

- LIMIT

- Gamme

- Location

- Style

- click

- machine learning

- a prendre une

- gérer

- manager

- manuellement

- de nombreuses

- Match

- Maximisez

- maximales

- métrique

- Métrique

- pourrait

- l'esprit

- manquant

- ML

- modèle

- numériques jumeaux (digital twin models)

- Mois

- mois

- PLUS

- (en fait, presque toutes)

- multidisciplinaire

- plusieurs

- prénom

- Nature

- Traitement du langage naturel

- NAVIGUER

- Navigation

- nécessairement

- Besoin

- réseau et

- réseaux

- Réseau neuronal

- Nouveauté

- next

- nlp

- cahier

- nombre

- objet

- objectif

- présenté

- ONE

- ouvert

- opération

- optimaux

- à mettre en œuvre pour gérer une entreprise rentable. Ce guide est basé sur trois décennies d'expérience

- optimisé

- original

- Autre

- décrit

- propre

- Forfaits

- pain

- papiers

- Parallèle

- paramètre

- partie

- particulier

- passionné

- Patron de Couture

- Effectuer

- performant

- performances

- effectue

- Téléphone

- en particulier pendant la préparation

- Place

- plan

- Platon

- Intelligence des données Platon

- PlatonDonnées

- Post

- Poteaux

- prévoir

- prédiction

- Prédictions

- Predictor

- Préparer

- précédent

- qui se déroulent

- Directeur

- Problème

- processus

- Traité

- les process

- traitement

- propriété

- fournit

- aportando

- publiquement

- publié

- des fins

- Python

- pytorch

- Rapide

- vite.

- aléatoire

- gamme

- raw

- RE

- solutions

- regex

- Standard

- pertinent

- remplacer

- représentant

- nécessaire

- conditions

- un article

- Resources

- réponse

- sensible

- résultat

- Résultats

- de revenus

- robuste

- Royal

- Courir

- pour le running

- sagemaker

- Réglage automatique du modèle SageMaker

- même

- évolutive

- Scientifique

- scikit-apprendre

- Sdk

- Rechercher

- recherche

- Section

- les sections

- clignotant

- choisi

- sélection

- phrase

- Série

- de série A

- service

- set

- Sets

- plusieurs

- devrait

- montrer

- montré

- Spectacles

- signaux

- de façon significative

- similaires

- étapes

- So

- Société

- sur mesure

- Solutions

- RÉSOUDRE

- Résoudre

- quelques

- Identifier

- spécialiste

- groupe de neurones

- spécifiquement

- scission

- sprint

- empilé

- empilage

- Étape

- Standard

- Commencer

- j'ai commencé

- state-of-the-art

- statistique

- statistiques

- étapes

- Étapes

- storage

- Boutique

- structuré

- studio

- Par la suite

- Avec succès

- tel

- suffisant

- RÉSUMÉ

- Support

- Appuyer

- table

- Prenez

- Target

- technologie

- Technique

- monde de télécommunications

- modèle

- modèles

- conditions

- tester

- La

- La Région

- La Source

- leur

- donc

- trois

- à

- aujourd'hui

- jeton

- top

- Total

- traditionnel

- Train

- qualifié

- Formation

- transformé

- oui

- types

- typiquement

- sous

- compréhension

- illimité

- indésirable

- améliorer

- us

- utilisé

- cas d'utilisation

- Utilisateur

- d'habitude

- Utilisant

- VALIDER

- validation

- Précieux

- Plus-value

- Valeurs

- variété

- divers

- Ve

- Verizon

- version

- via

- Quoi

- que

- qui

- WHO

- large

- Large gamme

- sera

- sans

- activités principales

- vos contrats

- pourra

- faux

- X

- Vous n'avez

- Votre

- zéphyrnet