Dans le monde de la prise de décision basée sur les données, prévision de séries chronologiques est essentiel pour permettre aux entreprises d'utiliser des modèles de données historiques pour anticiper les résultats futurs. Que vous travailliez dans la gestion des risques liés aux actifs, le trading, la prévision météorologique, la prévision de la demande énergétique, la surveillance des signes vitaux ou l'analyse du trafic, la capacité de prévoir avec précision est cruciale pour réussir.

Dans ces applications, les données de séries chronologiques peuvent avoir à queue lourde distributions, où le queue représentent des valeurs extrêmes. Des prévisions précises dans ces régions sont importantes pour déterminer la probabilité d’un événement extrême et s’il faut déclencher une alarme. Cependant, ces valeurs aberrantes ont un impact significatif sur l’estimation de la distribution de base, ce qui rend difficile la prévision robuste. Les institutions financières s’appuient sur des modèles robustes pour prédire les cas aberrants tels que les krachs boursiers. Dans les secteurs de l’énergie, de la météorologie et de la santé, des prévisions précises d’événements peu fréquents mais à fort impact tels que les catastrophes naturelles et les pandémies permettent une planification et une allocation efficaces des ressources. Négliger le comportement de la queue peut entraîner des pertes, des opportunités manquées et une sécurité compromise. Donner la priorité à la précision au niveau des queues permet d’obtenir des prévisions fiables et exploitables. Dans cet article, nous formons un modèle de prévision de séries chronologiques robuste, capable de capturer de tels événements extrêmes en utilisant Amazon Sage Maker.

Pour former efficacement ce modèle, nous établissons une infrastructure MLOps pour rationaliser le processus de développement du modèle en automatisant le prétraitement des données, l'ingénierie des fonctionnalités, le réglage des hyperparamètres et la sélection du modèle. Cette automatisation réduit les erreurs humaines, améliore la reproductibilité et accélère le cycle de développement du modèle. Grâce à un pipeline de formation, les entreprises peuvent intégrer efficacement de nouvelles données et adapter leurs modèles à des conditions évolutives, ce qui contribue à garantir que les prévisions restent fiables et à jour.

Une fois le modèle de prévision de séries chronologiques formé, son déploiement dans un point de terminaison offre des capacités de prédiction en temps réel. Cela vous permet de prendre des décisions éclairées et réactives, basées sur les données les plus récentes. De plus, le déploiement du modèle sur un point de terminaison permet l'évolutivité, car plusieurs utilisateurs et applications peuvent accéder et utiliser le modèle simultanément. En suivant ces étapes, les entreprises peuvent exploiter la puissance de prévisions de séries chronologiques robustes pour prendre des décisions éclairées et garder une longueur d'avance dans un environnement en évolution rapide.

Présentation de la solution

Cette solution présente la formation d'un modèle de prévision de séries chronologiques, spécifiquement conçu pour gérer les valeurs aberrantes et la variabilité des données à l'aide d'un Réseau convolutionnel temporel (TCN) avec une distribution Pareto splicée en compartiments (SBP). Pour plus d'informations sur une version multimodale de cette solution, reportez-vous à La science derrière la nouvelle métrique de réussite de NFL Next Gen Stats. Pour illustrer davantage l'efficacité de la distribution SBP, nous la comparons avec le même modèle TCN mais en utilisant plutôt une distribution gaussienne.

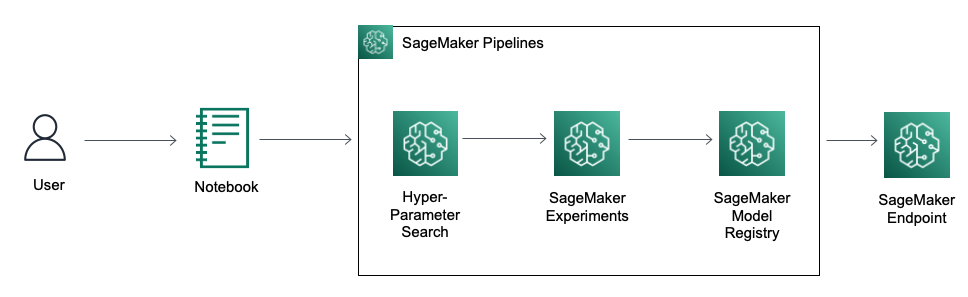

Ce processus bénéficie considérablement de Fonctionnalités MLOps de SageMaker, qui rationalise le flux de travail de la science des données en exploitant la puissante infrastructure cloud d'AWS. Dans notre solution, nous utilisons Réglage automatique du modèle Amazon SageMaker pour la recherche d'hyperparamètres, Expériences Amazon SageMaker pour gérer les expériences, Registre de modèles Amazon SageMaker pour gérer les versions de modèles, et Pipelines Amazon SageMaker pour orchestrer le processus. Nous déployons ensuite notre modèle sur un point de terminaison SageMaker pour obtenir des prédictions en temps réel.

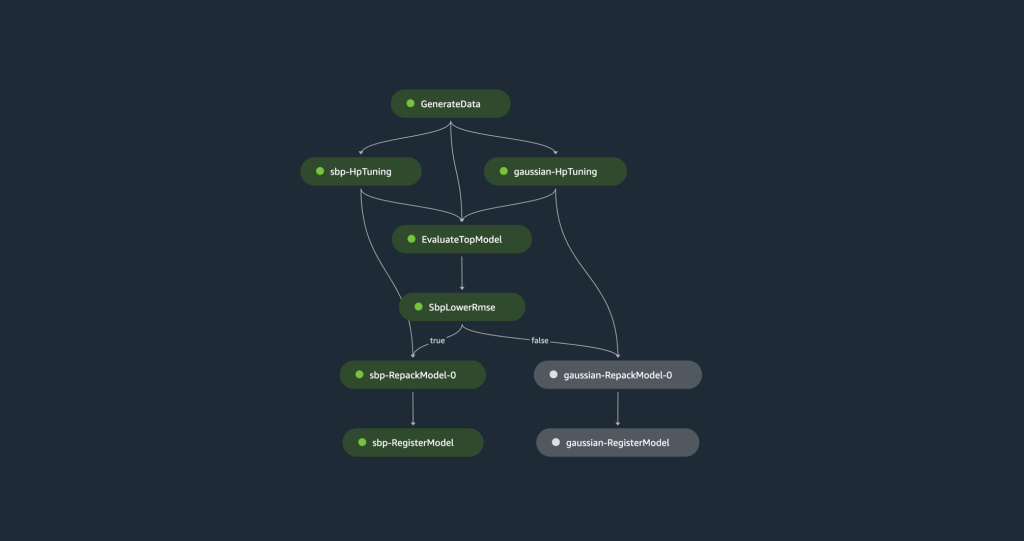

Le diagramme suivant illustre l’architecture du pipeline de formation.

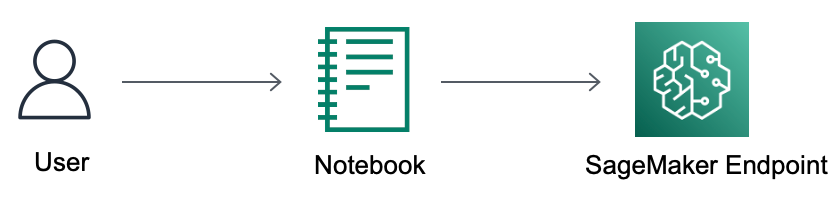

Le diagramme suivant illustre le pipeline d'inférence.

Vous pouvez trouver le code complet dans le GitHub repo. Pour mettre en œuvre la solution, exécutez les cellules dans SBP_main.ipynb.

Cliquez ici pour ouvrir la console AWS et suivre.

Pipeline SageMaker

SageMaker Pipelines offre une interface conviviale SDK Python pour créer des flux de travail d'apprentissage automatique (ML) intégrés. Ces flux de travail, représentés sous forme de graphiques acycliques dirigés (DAG), se composent d'étapes avec différents types et dépendances. Avec SageMaker Pipelines, vous pouvez rationaliser le processus de bout en bout de formation et d'évaluation des modèles, améliorant ainsi l'efficacité et la reproductibilité de vos flux de travail de ML.

Le pipeline de formation commence par la génération d'un ensemble de données synthétiques divisé en ensembles de formation, de validation et de test. L'ensemble de formation est utilisé pour former deux modèles TCN, l'un utilisant Distribution épissée Binned-Pareto et l'autre utilisant la distribution gaussienne. Les deux modèles passent par un réglage d'hyperparamètres à l'aide de l'ensemble de validation pour optimiser chaque modèle. Ensuite, une évaluation par rapport à l'ensemble de test est effectuée pour déterminer le modèle avec l'erreur quadratique moyenne (RMSE) la plus faible. Le modèle présentant la meilleure métrique de précision est téléchargé dans le registre des modèles.

Le diagramme suivant illustre les étapes du pipeline.

Discutons des étapes plus en détail.

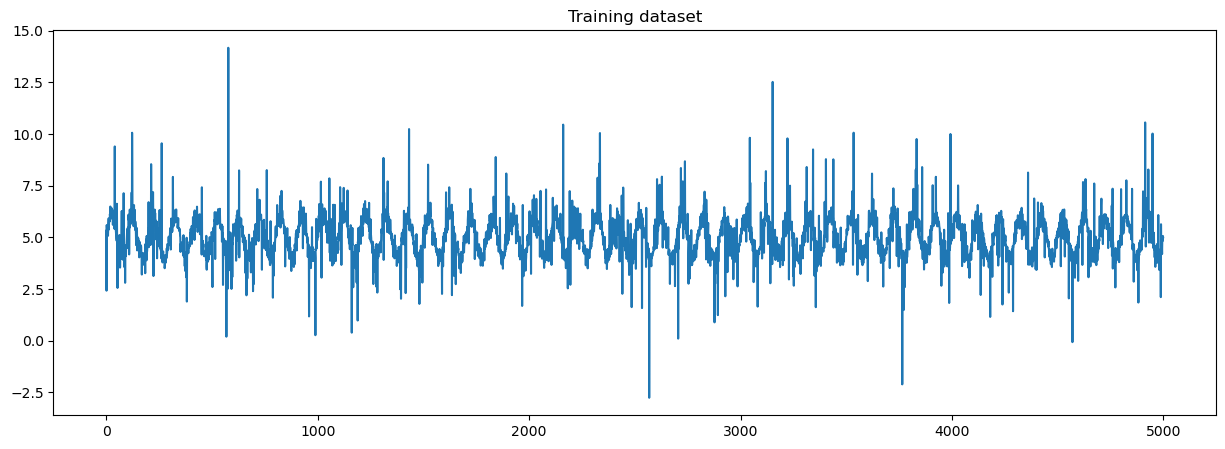

Génération de données

La première étape de notre pipeline génère un ensemble de données synthétiques, caractérisé par une forme d'onde sinusoïdale et un bruit asymétrique à queue lourde. Les données ont été créées à l'aide d'un certain nombre de paramètres, tels que des degrés de liberté, un multiplicateur de bruit et un paramètre d'échelle. Ces éléments influencent respectivement la forme de la distribution des données, modulent la variabilité aléatoire de nos données et ajustent la propagation de notre distribution de données.

Ce travail de traitement de données est réalisé à l'aide d'un Processeur PyTorch, qui exécute le code PyTorch (generate_data.py) au sein d'un conteneur géré par SageMaker. Les données et autres artefacts pertinents pour le débogage se trouvent dans le répertoire par défaut Service de stockage simple Amazon (Amazon S3) associé au compte SageMaker. Les journaux de chaque étape du pipeline peuvent être trouvés dans Amazon Cloud Watch.

La figure suivante est un échantillon des données générées par le pipeline.

Vous pouvez remplacer l'entrée par une grande variété de données de séries chronologiques, telles qu'une distribution symétrique, asymétrique, à queue légère, à queue lourde ou multimodale. La robustesse du modèle lui permet d'être applicable à un large éventail de problèmes de séries chronologiques, à condition que suffisamment d'observations soient disponibles.

Formation de modèle

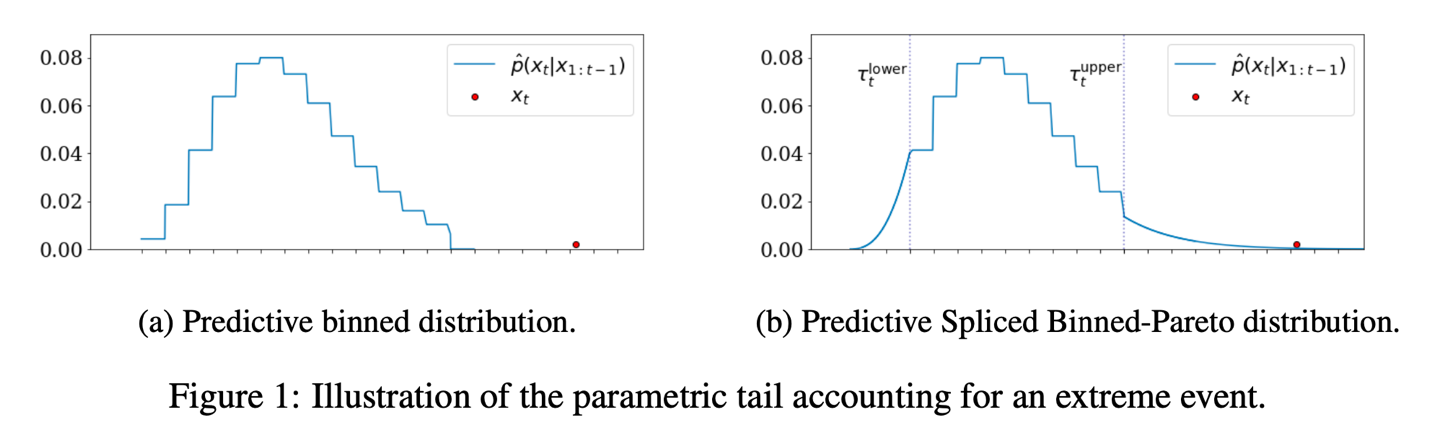

Après la génération des données, nous formons deux TCN : l'un utilisant la distribution SBP et l'autre utilisant la distribution gaussienne. La distribution SBP utilise une distribution groupée discrète comme base prédictive, où l'axe réel est divisé en catégories discrètes, et le modèle prédit la probabilité qu'une observation tombe dans chaque catégorie. Cette méthodologie permet de capturer des asymétries et des modes multiples car la probabilité de chaque compartiment est indépendante. Un exemple de distribution groupée est présenté dans la figure suivante.

La distribution prédictive groupée de gauche est robuste aux événements extrêmes car la log-vraisemblance ne dépend pas de la distance entre la moyenne prédite et le point observé, ce qui diffère des distributions paramétriques comme la gaussienne ou le t de Student. Par conséquent, l’événement extrême représenté par le point rouge ne biaisera pas la moyenne apprise de la distribution. Cependant, l’événement extrême aura une probabilité nulle. Pour capturer les événements extrêmes, nous formons une distribution SBP en définissant la queue inférieure au 5ème quantile et la queue supérieure au 95ème quantile, en remplaçant les deux queues par des distributions de Pareto généralisées (GPD) pondérées, qui peuvent quantifier la probabilité de l'événement. Le TCN affichera les paramètres de la base de distribution regroupée et des queues GPD.

Recherche d'hyperparamètres

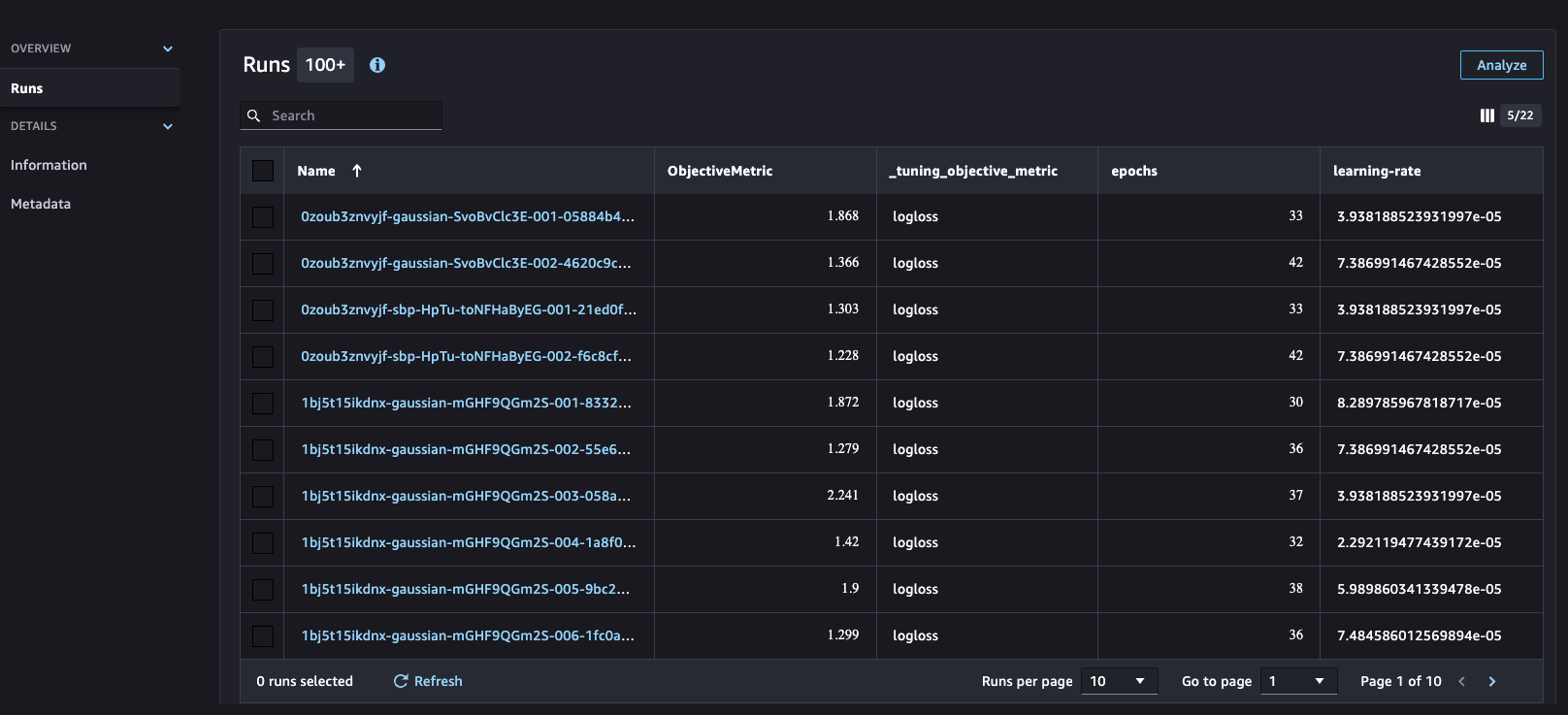

Pour un rendement optimal, nous utilisons réglage automatique du modèle pour trouver la meilleure version d'un modèle grâce réglage hyperparamètre. Cette étape est intégrée à SageMaker Pipelines et permet l'exécution parallèle de plusieurs tâches de formation, en utilisant diverses méthodes et plages d'hyperparamètres prédéfinis. Le résultat est la sélection du meilleur modèle en fonction de la métrique de modèle spécifiée, à savoir le RMSE. Dans notre pipeline, nous ajustons spécifiquement le taux d'apprentissage et le nombre d'époques de formation pour optimiser les performances de notre modèle. Grâce à la capacité de réglage des hyperparamètres de SageMaker, nous augmentons la probabilité que notre modèle atteigne une précision et une généralisation optimales pour la tâche donnée.

En raison de la nature synthétique de nos données, nous conservons la longueur du contexte et le délai d'exécution comme paramètres statiques. La longueur du contexte fait référence au nombre de pas de temps historiques entrés dans le modèle, et le délai de livraison représente le nombre de pas de temps dans notre horizon de prévision. Pour l'exemple de code, nous ajustons uniquement le taux d'apprentissage et le nombre d'époques pour économiser du temps et des coûts.

Les paramètres spécifiques au SBP sont maintenus constants sur la base de tests approfondis effectués par les auteurs sur l'article original sur différents ensembles de données :

- Nombre de bacs (100) – Ce paramètre détermine le nombre de compartiments utilisés pour modéliser la base de la distribution. Il est maintenu à 100, ce qui s’est avéré le plus efficace dans plusieurs secteurs.

- Queue centile (0.05) – Cela dénote la taille des distributions de Pareto généralisées à la queue. Comme le paramètre précédent, celui-ci a été testé de manière exhaustive et s’est révélé le plus efficace.

Expériences

Le processus d'hyperparamètres est intégré à Expériences SageMaker, qui permet d'organiser, d'analyser et de comparer les expériences itératives de ML, en fournissant des informations et en facilitant le suivi des modèles les plus performants. L'apprentissage automatique est un processus itératif impliquant de nombreuses expériences englobant des variations de données, des choix d'algorithmes et le réglage d'hyperparamètres. Ces expériences servent à affiner progressivement la précision du modèle. Cependant, le grand nombre d’exécutions de formation et d’itérations de modèles peut rendre difficile l’identification des modèles les plus performants et l’établissement de comparaisons significatives entre les expériences actuelles et passées. SageMaker Experiments résout ce problème en suivant automatiquement nos tâches de réglage des hyperparamètres et en nous permettant d'obtenir plus de détails et d'informations sur le processus de réglage, comme le montre la capture d'écran suivante.

Évaluation du modèle

Les modèles subissent un entraînement et un réglage des hyperparamètres, puis sont évalués via le évaluer.py scénario. Cette étape utilise l'ensemble de tests, distinct de l'étape de réglage des hyperparamètres, pour évaluer la précision réelle du modèle. Le RMSE est utilisé pour évaluer l’exactitude des prédictions.

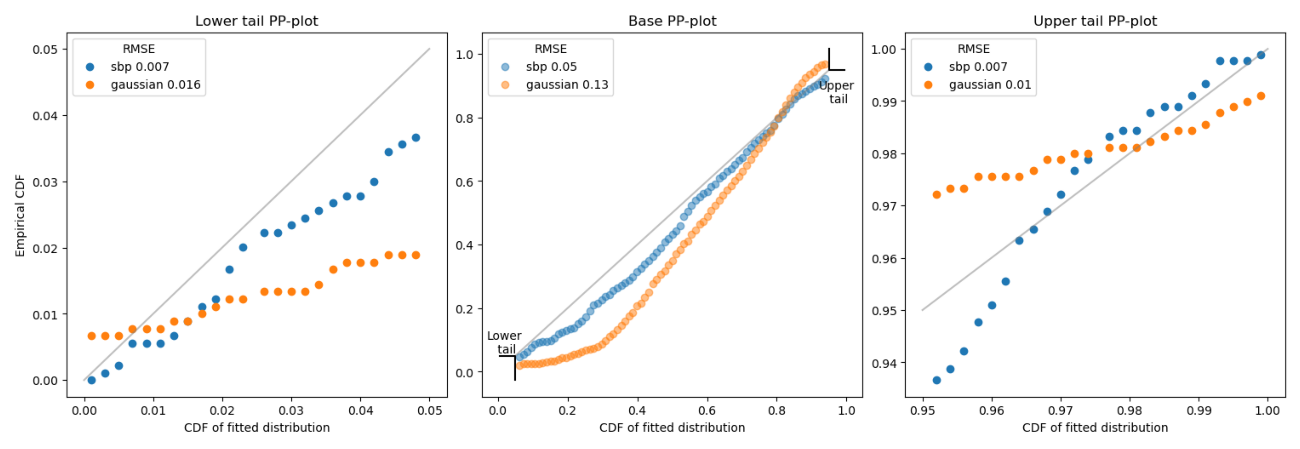

Pour la comparaison des distributions, nous utilisons un graphique probabilité-probabilité (PP), qui évalue l'adéquation entre les distributions réelles et prédites. La proximité des points avec la diagonale indique un ajustement parfait. Nos comparaisons entre les distributions prédites de SBP et de Gauss par rapport à la distribution réelle montrent que les prédictions de SBP s'alignent plus étroitement avec les données réelles.

Comme nous pouvons l’observer, SBP a un RMSE inférieur à la base, à la queue inférieure et à la queue supérieure. La distribution SBP a amélioré la précision de la distribution gaussienne de 61 % sur la base, de 56 % sur la queue inférieure et de 30 % sur la queue supérieure. Dans l’ensemble, la distribution SBP donne des résultats nettement meilleurs.

Sélection du modèle

Nous utilisons une étape de condition dans SageMaker Pipelines pour analyser les rapports d'évaluation du modèle, en optant pour le modèle avec le RMSE le plus bas pour une précision de distribution améliorée. Le modèle sélectionné est converti en objet modèle SageMaker, le préparant pour le déploiement. Cela implique de créer un package modèle avec des paramètres cruciaux et de le regrouper dans un ModèleÉtape.

Registre des modèles

Le modèle sélectionné est ensuite téléchargé sur Registre de modèles SageMaker, qui joue un rôle essentiel dans la gestion des modèles prêts pour la production. Il stocke les modèles, organise les versions des modèles, capture les métadonnées et les artefacts essentiels tels que les images de conteneurs et régit le statut d'approbation de chaque modèle. En utilisant le registre, nous pouvons déployer efficacement des modèles dans des environnements SageMaker accessibles et établir une base pour les pipelines d'intégration continue et de déploiement continu (CI/CD).

Inférence

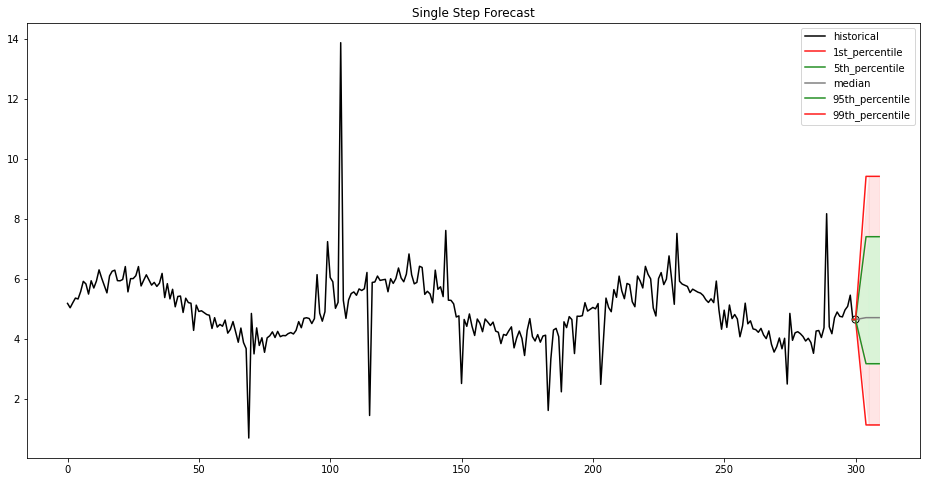

Une fois notre pipeline de formation terminé, notre modèle est ensuite déployé à l'aide de Services d'hébergement SageMaker, qui permet la création d'un point final d'inférence pour les prédictions en temps réel. Ce point de terminaison permet une intégration transparente avec les applications et les systèmes, fournissant un accès à la demande aux capacités prédictives du modèle via une interface HTTPS sécurisée. Les prévisions en temps réel peuvent être utilisées dans des scénarios tels que la prévision du cours des actions et de la demande énergétique. Notre point de terminaison fournit une prévision en une seule étape pour les données de séries chronologiques fournies, présentées sous forme de percentiles et de médiane, comme le montrent la figure et le tableau suivants.

| 1st centile | 5th centile | Moyenne | 95th centile | 99th centile |

| 1.12 | 3.16 | 4.70 | 7.40 | 9.41 |

Nettoyer

Après avoir exécuté cette solution, assurez-vous de nettoyer toutes les ressources AWS inutiles pour éviter des coûts inattendus. Vous pouvez nettoyer ces ressources à l'aide du SDK SageMaker Python, qui se trouve à la fin du bloc-notes. En supprimant ces ressources, vous évitez des frais supplémentaires pour les ressources que vous n'utilisez plus.

Conclusion

Disposer de prévisions précises peut avoir un impact considérable sur la planification future d'une entreprise et peut également fournir des solutions à divers problèmes dans différents secteurs. Notre exploration de prévisions robustes de séries chronologiques avec MLOps sur SageMaker a démontré une méthode permettant d'obtenir une prévision précise et l'efficacité d'un pipeline de formation rationalisé.

Notre modèle, alimenté par un réseau convolutif temporel avec une distribution de Pareto regroupée et épissée, a montré sa précision et son adaptabilité aux valeurs aberrantes en améliorant le RMSE de 61 % sur la base, de 56 % sur la queue inférieure et de 30 % sur la queue supérieure par rapport au même TCN avec distribution gaussienne. Ces chiffres en font une solution fiable pour les besoins de prévision du monde réel.

Le pipeline démontre la valeur de l'automatisation des fonctionnalités MLOps. Cela peut réduire l’effort humain manuel, permettre la reproductibilité et accélérer le déploiement du modèle. Les fonctionnalités de SageMaker telles que les pipelines SageMaker, le réglage automatique du modèle, les expériences SageMaker, le registre de modèles SageMaker et les points de terminaison rendent cela possible.

Notre solution utilise un TCN miniature, optimisant seulement quelques hyperparamètres avec un nombre limité de couches, suffisants pour mettre en évidence efficacement les performances du modèle. Pour des cas d'utilisation plus complexes, envisagez d'utiliser PyTorch ou d'autres bibliothèques basées sur PyTorch pour créer un TCN plus personnalisé qui correspond à vos besoins spécifiques. De plus, il serait intéressant d’explorer d’autres Fonctionnalités de SageMaker pour améliorer davantage les fonctionnalités de votre pipeline. Pour automatiser entièrement le processus de déploiement, vous pouvez utiliser le Kit de développement AWS Cloud (AWS CDK) ou AWS CloudFormation.

Pour plus d'informations sur les prévisions de séries chronologiques sur AWS, reportez-vous à ce qui suit :

N'hésitez pas à laisser un commentaire si vous avez des idées ou des questions !

À propos des auteurs

Nick Biso est ingénieur en apprentissage automatique chez AWS Professional Services. Il résout des défis organisationnels et techniques complexes en utilisant la science des données et l'ingénierie. De plus, il crée et déploie des modèles AI/ML sur le cloud AWS. Sa passion s'étend à sa propension aux voyages et aux diverses expériences culturelles.

Nick Biso est ingénieur en apprentissage automatique chez AWS Professional Services. Il résout des défis organisationnels et techniques complexes en utilisant la science des données et l'ingénierie. De plus, il crée et déploie des modèles AI/ML sur le cloud AWS. Sa passion s'étend à sa propension aux voyages et aux diverses expériences culturelles.

Alston Chan est ingénieur en développement logiciel chez Amazon Ads. Il crée des pipelines d'apprentissage automatique et des systèmes de recommandation pour les recommandations de produits sur la page détaillée. En dehors du travail, il aime le développement de jeux et l’escalade.

Alston Chan est ingénieur en développement logiciel chez Amazon Ads. Il crée des pipelines d'apprentissage automatique et des systèmes de recommandation pour les recommandations de produits sur la page détaillée. En dehors du travail, il aime le développement de jeux et l’escalade.

Maria Massoud se spécialise dans la création de pipelines de données et de visualisations de données sur AWS Commerce Platform. Elle possède une expertise en apprentissage automatique, couvrant le traitement du langage naturel, la vision par ordinateur et l'analyse de séries chronologiques. Passionnée de développement durable dans l’âme, Maria aime jardiner et jouer avec son chien pendant ses temps libres.

Maria Massoud se spécialise dans la création de pipelines de données et de visualisations de données sur AWS Commerce Platform. Elle possède une expertise en apprentissage automatique, couvrant le traitement du langage naturel, la vision par ordinateur et l'analyse de séries chronologiques. Passionnée de développement durable dans l’âme, Maria aime jardiner et jouer avec son chien pendant ses temps libres.

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- PlatoData.Network Ai générative verticale. Autonomisez-vous. Accéder ici.

- PlatoAiStream. Intelligence Web3. Connaissance Amplifiée. Accéder ici.

- PlatonESG. Carbone, Technologie propre, Énergie, Environnement, Solaire, La gestion des déchets. Accéder ici.

- PlatoHealth. Veille biotechnologique et essais cliniques. Accéder ici.

- La source: https://aws.amazon.com/blogs/machine-learning/robust-time-series-forecasting-with-mlops-on-amazon-sagemaker/

- :possède

- :est

- :ne pas

- :où

- $UP

- 100

- 5ème

- 7

- a

- capacité

- A Propos

- accélérer

- accélère

- accès

- accessible

- accompli

- Compte

- précision

- Avec cette connaissance vient le pouvoir de prendre

- avec précision

- Atteint

- à travers

- présenter

- acyclique

- adapter

- ajout

- En outre

- adresses

- annonces

- à opposer à

- devant

- AI / ML

- alarme

- algorithme

- aligner

- Aligne

- allocation

- Permettre

- permet

- le long de

- aussi

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- an

- selon une analyse de l’Université de Princeton

- il analyse

- et les

- anticiper

- tous

- en vigueur

- applications

- approbation

- architecture

- SONT

- AS

- Evaluer

- évalue

- atout

- associé

- At

- auteurs

- automatiser

- Automatique

- automatiquement

- automatiser

- Automation

- disponibles

- éviter

- AWS

- Services professionnels AWS

- Axis

- base

- basé

- BE

- car

- était

- humain

- derrière

- avantageux

- avantages.

- LES MEILLEURS

- Améliorée

- jusqu'à XNUMX fois

- biais

- BIN

- tous les deux

- vaste

- Développement

- construit

- entreprises

- mais

- bouton (dans la fenêtre de contrôle qui apparaît maintenant)

- by

- CAN

- capacités

- aptitude

- capable

- capturer

- captures

- Capturer

- cas

- Cellules

- globaux

- difficile

- en changeant

- caractérisé

- des charges

- choix

- cliquez

- Escalade

- étroitement

- le cloud

- infrastructure de cloud

- code

- commentaire

- Commerce

- comparer

- Comparaison

- complet

- achèvement

- complexe

- Compromise

- ordinateur

- Vision par ordinateur

- condition

- conditions

- menée

- Considérer

- Console

- constant

- construire

- Contenant

- contexte

- continu

- converti

- Prix

- Costs

- couvrant

- engendrent

- créée

- La création

- création

- critique

- crucial

- à la diversité

- Courant

- sont adaptées

- cycle

- données

- informatique

- science des données

- data-driven

- ensembles de données

- Date

- La prise de décision

- décisions

- Réglage par défaut

- définir

- Demande

- Prévision de la demande

- démontré

- démontre

- dénote

- dépendances

- dépendant

- déployer

- déployé

- déployer

- déploiement

- déploie

- un

- détail

- détails

- Déterminer

- détermine

- détermination

- Développement

- différent

- différent

- dirigé

- catastrophes

- discuter

- distance

- distinct

- distribution

- distributions

- plusieurs

- divisé

- Chien

- DOT

- les temps d'arrêt

- pendant

- chacun

- Efficace

- de manière efficace

- efficacité

- efficace

- efficace

- efficacement

- effort

- éléments

- employant

- emploie

- responsabilise

- permettre

- permet

- permettant

- englobant

- fin

- end-to-end

- Endpoint

- énergie

- ingénieur

- ENGINEERING

- de renforcer

- améliorer

- assurer

- passionné

- Environment

- environnements

- époques

- erreur

- essential

- établir

- évalué

- évaluer

- évaluation

- événement

- événements

- évolution

- exemple

- Expériences

- expériences

- nous a permis de concevoir

- exploration

- explorez

- S'étend

- les

- extrême

- faciliter

- Chute

- Fonctionnalité

- Fonctionnalités:

- few

- Figure

- Figures

- la traduction de documents financiers

- Institutions financières

- Trouvez

- Prénom

- s'adapter

- suivre

- Abonnement

- Pour

- Prévision

- prévisions

- formulaire

- trouvé

- Fondation

- gratuitement ici

- spirituelle

- De

- d’étiquettes électroniques entièrement

- plus

- En outre

- avenir

- Gain

- jeu

- développement de jeu

- jauge

- Gen

- généré

- génère

- générateur

- génération

- donné

- Go

- gouverne

- GPD

- subventions

- graphiques

- manipuler

- harnais

- Exploiter

- Vous avez

- he

- la médecine

- Cœur

- aide

- ici

- ici

- Soulignant

- très

- sa

- historique

- horizon

- hébergement

- Comment

- Cependant

- HTML

- HTTPS

- humain

- Réglage des hyperparamètres

- identifier

- illustre

- satellite

- Impact

- Mettre en oeuvre

- important

- amélioré

- améliore

- l'amélioration de

- in

- intégrer

- Améliore

- indépendant

- indique

- secteurs

- influencer

- d'information

- Actualités

- Infrastructure

- contribution

- perspicacité

- idées.

- plutôt ;

- les établissements privés

- des services

- l'intégration

- Interfaces

- développement

- impliquant

- IT

- itérations

- SES

- Emploi

- Emplois

- jpg

- juste

- en gardant

- conservé

- ACTIVITES

- langue

- gros

- poules pondeuses

- conduire

- savant

- apprentissage

- Laisser

- à gauche

- Longueur

- bibliothèques

- comme

- probabilité

- Probable

- limité

- situé

- plus long

- pertes

- baisser

- le plus bas

- click

- machine learning

- a prendre une

- Fabrication

- gérer

- gérés

- gestion

- les gérer

- Manuel

- maria

- Marché

- krachs boursiers

- signifier

- significative

- Métadonnées

- méthode

- Méthodologie

- méthodes

- métrique

- manqué

- ML

- MLOps

- modèle

- numériques jumeaux (digital twin models)

- modes

- Stack monitoring

- PLUS

- (en fait, presque toutes)

- plusieurs

- Nature

- Traitement du langage naturel

- Nature

- Besoins

- négliger

- réseau et

- Nouveauté

- next

- prochaine génération

- NFL

- aucune

- Bruit

- cahier

- nombre

- nombreux

- objet

- observer

- obtenir

- of

- Offres Speciales

- on

- À la demande

- ONE

- uniquement

- ouvert

- Opportunités

- optimaux

- Optimiser

- l'optimisation

- or

- organisationnel

- organise

- original

- Autre

- nos

- les résultats

- sortie

- au contrôle

- plus de

- global

- paquet

- l'emballage

- page

- Pandémies

- Papier

- Parallèle

- paramètre

- paramètres

- Pareto

- En passant

- passion

- passé

- motifs

- parfaite

- performant

- pipeline

- et la planification de votre patrimoine

- plateforme

- Platon

- Intelligence des données Platon

- PlatonDonnées

- jouer

- joue

- Point

- des notes bonus

- possible

- Post

- power

- alimenté

- solide

- prévoir

- prédit

- prédiction

- Prédictions

- Prévoit

- présenté

- empêcher

- précédent

- prix

- priorisation

- d'ouvrabilité

- processus

- traitement

- Produit

- Vidéo

- professionels

- proven

- fournir

- à condition de

- fournit

- aportando

- Python

- pytorch

- augmenter

- aléatoire

- gamme

- rapidement

- Tarif

- solutions

- Préparer

- réal

- monde réel

- en temps réel

- récent

- Recommandation

- recommandations

- Rouge

- réduire

- réduit

- reportez-vous

- se réfère

- affiner

- régions

- enregistrement

- pertinent

- fiable

- compter

- rester

- remplacer

- Rapports

- représentent

- représenté

- représente

- ressource

- Resources

- respectivement

- sensible

- résultat

- Résultats

- Analyse

- la gestion des risques

- robuste

- solidité

- Rock

- Rôle

- racine

- Courir

- fonctionne

- Sécurité

- sagemaker

- Pipelines SageMaker

- même

- Épargnez

- Évolutivité

- Escaliers intérieurs

- scénarios

- Sciences

- scénario

- Sdk

- fluide

- Rechercher

- Secteurs

- sécurisé

- choisi

- sélection

- Série

- besoin

- Services

- set

- Sets

- Forme

- elle

- montrer

- montré

- signer

- de façon significative

- étapes

- simultanément

- Taille

- Logiciels

- développement de logiciels

- sur mesure

- Solutions

- Résout

- spécialise

- groupe de neurones

- spécifiquement

- spécifié

- scission

- propagation

- quadrillé

- Étape

- Statut

- rester

- étapes

- Étapes

- stock

- storage

- STORES

- rationaliser

- rationalisé

- Par la suite

- succès

- tel

- suffisant

- sûr

- Durabilité

- haute

- Système

- table

- Tâche

- Technique

- tester

- examiné

- Essais

- qui

- Le

- le monde

- leur

- puis

- donc

- Ces

- this

- Avec

- fiable

- Des séries chronologiques

- à

- Tracking

- Commerce

- circulation

- Train

- qualifié

- Formation

- Voyage

- deux

- types

- subir

- Inattendu

- inutile

- téléchargé

- us

- utilisé

- d'utiliser

- convivial

- utilisateurs

- en utilisant

- utiliser

- utilise

- Utilisant

- validation

- Plus-value

- Valeurs

- variété

- divers

- version

- versions

- via

- vision

- vital

- vs

- était

- we

- Météo

- web

- services Web

- que

- qui

- large

- sera

- comprenant

- dans les

- activités principales

- workflow

- workflows

- de travail

- world

- pourra

- Vous n'avez

- Votre

- zéphyrnet

- zéro