Amazon Sage Maker propose une large sélection d'infrastructures d'apprentissage automatique (ML) et d'options de déploiement de modèles pour vous aider à répondre à vos besoins d'inférence ML. Il s'agit d'un service entièrement géré qui s'intègre aux outils MLOps afin que vous puissiez travailler pour faire évoluer le déploiement de votre modèle, réduire les coûts d'inférence, gérer les modèles plus efficacement en production et réduire la charge opérationnelle. SageMaker fournit plusieurs options d'inférence afin que vous puissiez choisir l'option qui convient le mieux à votre charge de travail.

Les nouvelles générations de processeurs offrent une amélioration significative des performances dans l'inférence ML grâce à des instructions intégrées spécialisées. Dans cet article, nous nous concentrons sur la façon dont vous pouvez tirer parti de la AWSGraviton3basé sur Amazon Elastic Compute Cloud (EC2) Instances C7g pour aider à réduire les coûts d'inférence jusqu'à 50 % par rapport aux instances EC2 comparables pour inférence en temps réel sur Amazon Sage Maker. Nous montrons comment vous pouvez évaluer les performances d'inférence et basculer vos charges de travail ML vers des instances AWS Graviton en quelques étapes seulement.

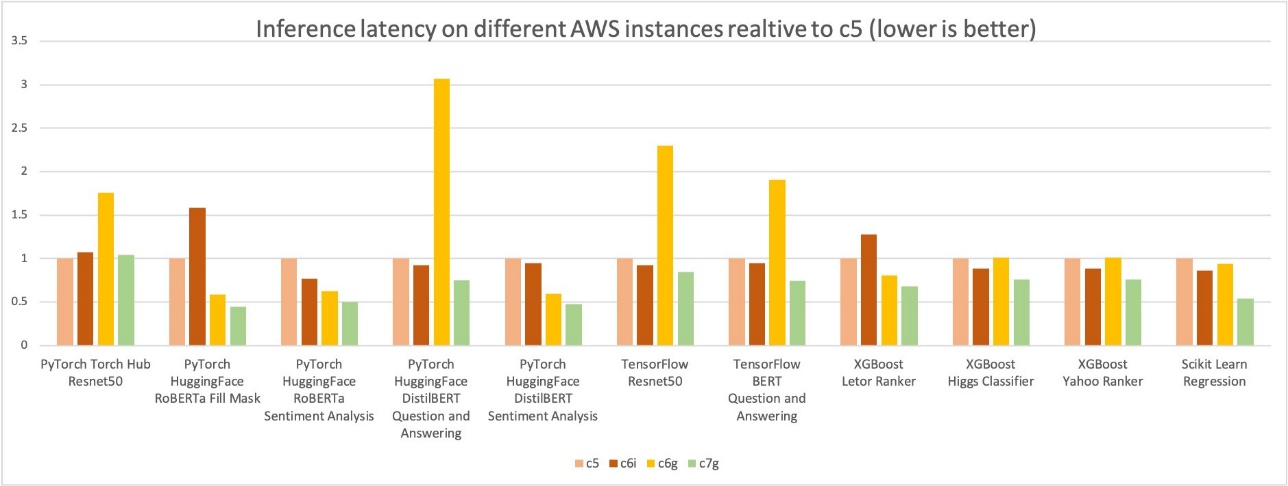

Pour couvrir la large gamme d'applications client populaires, nous discutons dans cet article des performances d'inférence des frameworks PyTorch, TensorFlow, XGBoost et scikit-learn. Nous couvrons la vision par ordinateur (CV), le traitement du langage naturel (NLP), la classification et les scénarios de classement pour les modèles et les instances ml.c6g, ml.c7g, ml.c5 et ml.c6i SageMaker pour l'analyse comparative.

Résultats de l'analyse comparative

AWS a mesuré jusqu'à 50 % d'économies de coûts pour PyTorch, TensorFlow, XGBoost et l'inférence de modèle scikit-learn avec des instances EC3 C2g basées sur AWS Graviton7 par rapport à des instances EC2 comparables sur Amazon SageMaker. Dans le même temps, la latence de l'inférence est également réduite.

À titre de comparaison, nous avons utilisé quatre types d'instances différents :

Les quatre instances disposent de 16 vCPU et de 32 Gio de mémoire.

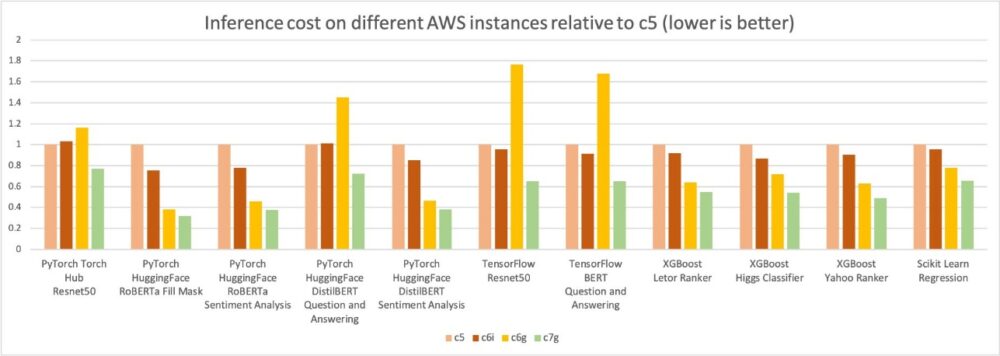

Dans le graphique suivant, nous avons mesuré le coût par million d'inférences pour les quatre types d'instance. Nous avons en outre normalisé les résultats d'inférence du coût par million sur une instance c5.4xlarge, qui est mesurée par 1 sur l'axe Y du graphique. Vous pouvez voir que pour les modèles XGBoost, le coût par million d'inférence pour c7g.4xlarge (AWS Graviton3) est d'environ 50 % de c5.4xlarge et 40 % de c6i.4xlarge ; pour les modèles PyTorch NLP, les économies de coûts sont d'environ 30 à 50 % par rapport aux instances c5 et c6i.4xlarge. Pour les autres modèles et frameworks, nous avons mesuré au moins 30 % d'économies de coûts par rapport aux instances c5 et c6i.4xlarge.

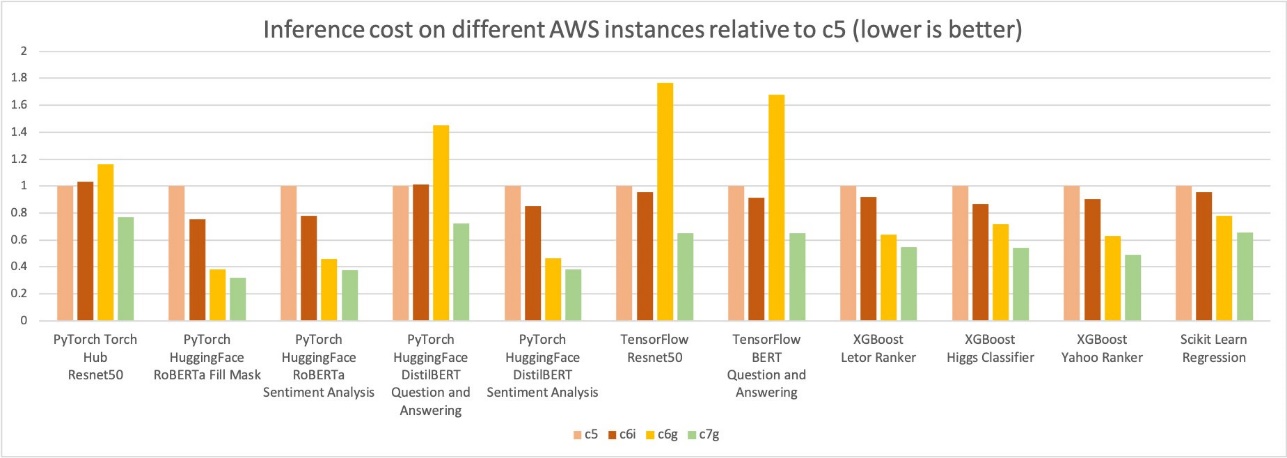

Semblable au graphique de comparaison des coûts d'inférence précédent, le graphique suivant montre la latence p90 du modèle pour les quatre mêmes types d'instance. Nous avons en outre normalisé les résultats de latence sur l'instance c5.4xlarge, qui est mesurée par 1 sur l'axe Y du graphique. La latence d'inférence du modèle c7g.4xlarge (AWS Graviton3) est jusqu'à 50 % meilleure que les latences mesurées sur c5.4xlarge et c6i.4xlarge.

Migrer vers des instances AWS Graviton

Pour déployer vos modèles sur des instances AWS Graviton, vous pouvez soit utiliser Conteneurs AWS Deep Learning (DLC) ou apportez vos propres contenants qui sont compatibles avec l'architecture ARMv8.2.

La migration (ou le nouveau déploiement) de vos modèles vers des instances AWS Graviton est simple, car non seulement AWS fournit des conteneurs pour héberger des modèles avec PyTorch, TensorFlow, scikit-learn et XGBoost, mais les modèles sont également indépendants de l'architecture. Vous pouvez également apporter vos propres bibliothèques, mais assurez-vous que votre conteneur est construit avec un environnement prenant en charge l'architecture ARMv8.2. Pour plus d'informations, voir Construire votre propre conteneur d'algorithmes.

Vous devrez suivre trois étapes pour déployer votre modèle :

- Créez un modèle SageMaker. Celui-ci contiendra, entre autres paramètres, les informations sur l'emplacement du fichier de modèle, le conteneur qui sera utilisé pour le déploiement et l'emplacement du script d'inférence. (Si vous avez un modèle existant déjà déployé dans une instance d'inférence optimisée pour le calcul, vous pouvez ignorer cette étape.)

- Créez une configuration de point de terminaison. Celui-ci contiendra des informations sur le type d'instance que vous souhaitez pour le point de terminaison (par exemple, ml.c7g.xlarge pour AWS Graviton3), le nom du modèle que vous avez créé à l'étape précédente et le nombre d'instances par point de terminaison.

- Lancez le point de terminaison avec la configuration de point de terminaison créée à l'étape précédente.

Pour des instructions détaillées, reportez-vous à Exécutez des charges de travail d'inférence d'apprentissage automatique sur des instances basées sur AWS Graviton avec Amazon SageMaker

Méthodologie d'analyse comparative

Nous avons utilisé Outil de recommandation d'inférence Amazon SageMaker pour automatiser l'analyse comparative des performances sur différentes instances. Ce service compare les performances de votre modèle ML en termes de latence et de coût sur différentes instances et recommande l'instance et la configuration qui offrent les meilleures performances au moindre coût. Nous avons collecté les données de performance susmentionnées à l'aide de l'outil de recommandation d'inférence. Pour plus de détails, reportez-vous au GitHub repo.

Vous pouvez utiliser le exemple de cahier exécuter les benchmarks et reproduire les résultats. Nous avons utilisé les modèles suivants pour l'analyse comparative :

Conclusion

AWS a mesuré jusqu'à 50 % d'économies de coûts pour PyTorch, TensorFlow, XGBoost et l'inférence de modèle scikit-learn avec des instances EC3 C2g basées sur AWS Graviton7 par rapport à des instances EC2 comparables sur Amazon SageMaker. Vous pouvez migrer vos cas d'utilisation d'inférence existants ou déployer de nouveaux modèles ML sur AWS Graviton en suivant les étapes fournies dans cet article. Vous pouvez également vous référer au Guide technique AWS Graviton, qui fournit la liste des bibliothèques optimisées et des meilleures pratiques qui vous aideront à réaliser des économies avec les instances AWS Graviton sur différentes charges de travail.

Si vous trouvez des cas d'utilisation où des gains de performances similaires ne sont pas observés sur AWS Graviton, veuillez nous contacter. Nous continuerons à ajouter d'autres améliorations de performances pour faire d'AWS Graviton le processeur polyvalent le plus rentable et le plus efficace pour l'inférence ML.

À propos des auteurs

Sunita Nadampalli est responsable du développement logiciel chez AWS. Elle dirige les optimisations des performances du logiciel Graviton pour l'apprentissage automatique, le HPC et les charges de travail multimédia. Elle est passionnée par le développement open source et la fourniture de solutions logicielles rentables avec les SoC Arm.

Sunita Nadampalli est responsable du développement logiciel chez AWS. Elle dirige les optimisations des performances du logiciel Graviton pour l'apprentissage automatique, le HPC et les charges de travail multimédia. Elle est passionnée par le développement open source et la fourniture de solutions logicielles rentables avec les SoC Arm.

Jaymin Desaï est ingénieur en développement logiciel au sein de l'équipe Amazon SageMaker Inference. Il est passionné par la diffusion de l'IA auprès des masses et l'amélioration de la convivialité des actifs d'IA de pointe en les transformant en fonctionnalités et services. Pendant son temps libre, il aime explorer la musique et voyager.

Jaymin Desaï est ingénieur en développement logiciel au sein de l'équipe Amazon SageMaker Inference. Il est passionné par la diffusion de l'IA auprès des masses et l'amélioration de la convivialité des actifs d'IA de pointe en les transformant en fonctionnalités et services. Pendant son temps libre, il aime explorer la musique et voyager.

Michel Schneider est un développeur de systèmes, basé à Phoenix AZ. Il est membre des conteneurs Deep Learning, prenant en charge diverses images de conteneurs Framework, y compris Graviton Inference. Il se consacre à l'efficacité et à la stabilité des infrastructures.

Michel Schneider est un développeur de systèmes, basé à Phoenix AZ. Il est membre des conteneurs Deep Learning, prenant en charge diverses images de conteneurs Framework, y compris Graviton Inference. Il se consacre à l'efficacité et à la stabilité des infrastructures.

Mohan Ghandi est ingénieur logiciel senior chez AWS. Il travaille chez AWS depuis 10 ans et a travaillé sur divers services AWS tels que EMR, EFA et RDS. Actuellement, il se concentre sur l'amélioration de l'expérience d'inférence SageMaker. Dans ses temps libres, il aime faire de la randonnée et des marathons.

Mohan Ghandi est ingénieur logiciel senior chez AWS. Il travaille chez AWS depuis 10 ans et a travaillé sur divers services AWS tels que EMR, EFA et RDS. Actuellement, il se concentre sur l'amélioration de l'expérience d'inférence SageMaker. Dans ses temps libres, il aime faire de la randonnée et des marathons.

Qingwei Li est un spécialiste de l'apprentissage automatique chez Amazon Web Services. Il a obtenu son doctorat. en recherche opérationnelle après avoir cassé le compte de subvention de recherche de son conseiller et échoué à décerner le prix Nobel promis. Actuellement, il aide les clients du secteur des services financiers et de l'assurance à créer des solutions d'apprentissage automatique sur AWS. Dans ses temps libres, il aime lire et enseigner.

Qingwei Li est un spécialiste de l'apprentissage automatique chez Amazon Web Services. Il a obtenu son doctorat. en recherche opérationnelle après avoir cassé le compte de subvention de recherche de son conseiller et échoué à décerner le prix Nobel promis. Actuellement, il aide les clients du secteur des services financiers et de l'assurance à créer des solutions d'apprentissage automatique sur AWS. Dans ses temps libres, il aime lire et enseigner.

Wayne Toh est un architecte de solutions spécialisé pour Graviton chez AWS. Il s'attache à aider les clients à adopter l'architecture ARM pour les charges de travail de conteneurs à grande échelle. Avant de rejoindre AWS, Wayne a travaillé pour plusieurs grands éditeurs de logiciels, dont IBM et Red Hat.

Wayne Toh est un architecte de solutions spécialisé pour Graviton chez AWS. Il s'attache à aider les clients à adopter l'architecture ARM pour les charges de travail de conteneurs à grande échelle. Avant de rejoindre AWS, Wayne a travaillé pour plusieurs grands éditeurs de logiciels, dont IBM et Red Hat.

Lauren Mullennex est une architecte de solutions basée à Denver, CO. Elle travaille avec les clients pour les aider à concevoir des solutions sur AWS. Dans ses temps libres, elle aime faire de la randonnée et cuisiner la cuisine hawaïenne.

Lauren Mullennex est une architecte de solutions basée à Denver, CO. Elle travaille avec les clients pour les aider à concevoir des solutions sur AWS. Dans ses temps libres, elle aime faire de la randonnée et cuisiner la cuisine hawaïenne.

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- PlatoAiStream. Intelligence des données Web3. Connaissance Amplifiée. Accéder ici.

- Frapper l'avenir avec Adryenn Ashley. Accéder ici.

- Achetez et vendez des actions de sociétés PRE-IPO avec PREIPO®. Accéder ici.

- La source: https://aws.amazon.com/blogs/machine-learning/reduce-amazon-sagemaker-inference-cost-with-aws-graviton/

- :possède

- :est

- :ne pas

- :où

- $UP

- 1

- 10

- 100

- 7

- 98

- a

- A Propos

- Compte

- atteindre

- à travers

- ajouter

- adopter

- Avantage

- Après

- AI

- algorithme

- déjà

- aussi

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- parmi

- an

- ainsi que

- applications

- architecture

- SONT

- BRAS

- AS

- Outils

- At

- automatiser

- AWS

- basé

- BE

- car

- était

- analyse comparative

- repères

- avantages.

- LES MEILLEURS

- les meilleures pratiques

- Améliorée

- apporter

- vaste

- Cassé

- construire

- construit

- intégré

- fardeau

- mais

- by

- CAN

- cas

- Graphique

- classification

- le cloud

- CO

- comparable

- par rapport

- Comparaison

- compatible

- complet

- calcul

- ordinateur

- Vision par ordinateur

- configuration

- contiennent

- Contenant

- Conteneurs

- continuer

- Prix

- les économies de coûts

- rentable

- Costs

- couverture

- créée

- Lecture

- des clients

- Clients

- données

- dévoué

- profond

- l'apprentissage en profondeur

- livrer

- livrer

- Denver

- déployer

- déployé

- déploiement

- détaillé

- détails

- Développeur

- Développement

- différent

- discuter

- deux

- de manière efficace

- efficace

- efficace

- non plus

- Endpoint

- ingénieur

- Environment

- évaluer

- exemple

- existant

- d'experience

- Explorer

- Échoué

- Fonctionnalités:

- few

- Déposez votre dernière attestation

- la traduction de documents financiers

- service financier

- Trouvez

- Focus

- concentré

- se concentre

- Abonnement

- Pour

- quatre

- Framework

- cadres

- Gratuit

- plus

- Gains

- à usage général

- Les générations

- donne

- subvention

- graphique

- chapeau

- Vous avez

- he

- vous aider

- aider

- aide

- ici

- sa

- hôte

- Comment

- hpc

- HTML

- HTTPS

- IBM

- if

- satellite

- amélioration

- améliorations

- l'amélioration de

- in

- comprendre

- Y compris

- industrie

- d'information

- Infrastructure

- instance

- Des instructions

- Assurance

- Intègre

- développement

- joindre

- jpg

- juste

- langue

- gros

- Nom de famille

- Latence

- Conduit

- apprentissage

- au

- bibliothèques

- comme

- aime

- Liste

- emplacement

- le plus bas

- click

- machine learning

- a prendre une

- gérer

- manager

- masses

- Découvrez

- membre

- Mémoire

- émigrer

- migration

- million

- ML

- MLOps

- modèle

- numériques jumeaux (digital twin models)

- PLUS

- (en fait, presque toutes)

- Multimédia

- plusieurs

- Musique

- prénom

- Nature

- Traitement du langage naturel

- Besoin

- Besoins

- Nouveauté

- nlp

- prix Nobel

- nombre

- of

- code

- on

- uniquement

- open source

- opérationnel

- Opérations

- optimisé

- Option

- Options

- or

- de commander

- Autre

- ande

- propre

- paramètres

- passionné

- performant

- phénix

- en particulier pendant la préparation

- Platon

- Intelligence des données Platon

- PlatonDonnées

- veuillez cliquer

- Populaire

- Post

- pratiques

- précédent

- Avant

- prix

- traitement

- Processeur

- Vidéo

- promis

- fournir

- à condition de

- fournit

- pytorch

- gamme

- Classement

- nous joindre

- en cours

- reçu

- recommande

- Rouge

- Red Hat

- réduire

- Prix Réduit

- un article

- Résultats

- Courir

- sagemaker

- Inférence SageMaker

- même

- Épargnes

- Escaliers intérieurs

- scénarios

- scikit-apprendre

- sur le lien

- sélection

- supérieur

- service

- Services

- plusieurs

- elle

- montrer

- Spectacles

- significative

- similaires

- So

- Logiciels

- développement de logiciels

- Software Engineer

- Solutions

- spécialiste

- spécialisé

- Stabilité

- state-of-the-art

- étapes

- Étapes

- simple

- Appuyer

- Les soutiens

- Interrupteur

- Système

- Prenez

- prise

- Enseignement

- équipe

- Technique

- tensorflow

- conditions

- que

- qui

- La

- les informations

- Les

- this

- trois

- fiable

- à

- les outils

- Voyages

- type

- types

- us

- convivialité

- utilisé

- d'utiliser

- en utilisant

- divers

- fournisseurs

- vision

- souhaitez

- we

- web

- services Web

- WELL

- qui

- sera

- comprenant

- activités principales

- travaillé

- vos contrats

- XGBoost

- années

- Vous n'avez

- Votre

- zéphyrnet