- Le 30 juin 2014

- Vassilis Vryniotis

- . Sans commentaires

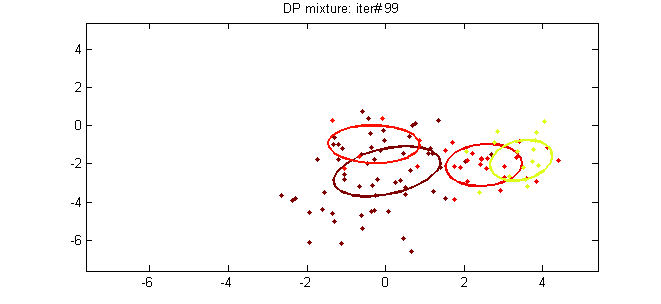

Cet article est la cinquième partie du tutoriel sur Clustering avec DPMM. Dans les articles précédents, nous avons couvert en détail le contexte théorique de la méthode et nous avons décrit ses représentations mathématiquesmu et les moyens de la construire. Dans cet article, nous allons essayer de relier la théorie à la pratique en introduisant deux modèles DPMM: le modèle de mélange normal multivarié de Dirichlet qui peut être utilisé pour regrouper les données gaussiennes et le modèle de mélange Dirichlet-multinomial qui est utilisé pour regrouper les documents.

Mise à jour: le Datumbox Machine Learning Framework est désormais open-source et gratuit pour download. Consultez le package com.datumbox.framework.machinelearning.clustering pour voir l'implémentation de Dirichlet Process Mixture Models en Java.

1. Le modèle de mélange normal multivarié de Dirichlet

Le premier modèle de mélange de processus de Dirichlet que nous examinerons est le modèle de mélange normal multivarié de Dirichlet qui peut être utilisé pour effectuer un clustering sur des ensembles de données continus. Le modèle de mélange est défini comme suit:

![]()

![]()

![]()

Équation 1: Modèle de mélange normal multivarié de Dirichlet

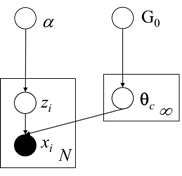

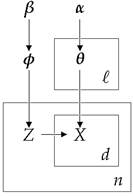

Comme nous pouvons le voir ci-dessus, le modèle particulier suppose que la distribution générative est la distribution gaussienne multinomiale et utilise le processus du restaurant chinois comme précédemment pour les affectations de cluster. De plus pour la distribution de base G0 il utilise le prior Normal-Inverse-Wishart qui est conjuguer avant de Distribution normale multivariée avec moyenne inconnue et matrice de covariance. Ci-dessous, nous présentons le modèle graphique du modèle de mélange:

Figure 1: Modèle graphique du modèle de mélange normal multivarié de Dirichlet

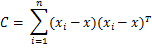

Comme nous l'avons vu précédemment, afin de pouvoir estimer les attributions de cluster, nous utiliserons le Échantillonnage de Gibbs réduit ce qui nécessite de sélectionner le priors conjugués appropriés. De plus nous devrons mettre à jour les paramètres postérieurs donnés le prieur et la preuve. Ci-dessous, nous voyons le Estimations MAP des paramètres pour l'un des clusters:

![]()

![]()

![]()

![]()

![]()

Équation 2: Estimations MAP sur les paramètres de cluster

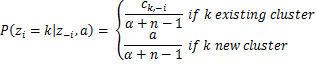

Où d est la dimensionnalité de nos données et ![]() est la moyenne de l'échantillon. De plus, nous avons plusieurs hyperparamètres du Normal-Inverse-Wishart tels que le μ0 qui est la moyenne initiale, κ0 est la fraction moyenne qui fonctionne comme un paramètre de lissage, ν0 est le degré de liberté qui correspond au nombre de dimensions et Ψ0 est le produit d'écart par paire qui est fixé à la matrice d'identité dxd multipliée par une constante. Désormais tous les hyperparamètres précédents de G0 sera noté λ pour simplifier la notation. Enfin, en ayant tout ce qui précède, nous pouvons estimer les probabilités requises par l'échantillonneur de Gibbs réduit. La probabilité que l'observation i appartienne au cluster k étant donné les attributions de cluster, l'ensemble de données et tous les hyperparamètres α et λ de DP et G0 est donné ci-dessous:

est la moyenne de l'échantillon. De plus, nous avons plusieurs hyperparamètres du Normal-Inverse-Wishart tels que le μ0 qui est la moyenne initiale, κ0 est la fraction moyenne qui fonctionne comme un paramètre de lissage, ν0 est le degré de liberté qui correspond au nombre de dimensions et Ψ0 est le produit d'écart par paire qui est fixé à la matrice d'identité dxd multipliée par une constante. Désormais tous les hyperparamètres précédents de G0 sera noté λ pour simplifier la notation. Enfin, en ayant tout ce qui précède, nous pouvons estimer les probabilités requises par l'échantillonneur de Gibbs réduit. La probabilité que l'observation i appartienne au cluster k étant donné les attributions de cluster, l'ensemble de données et tous les hyperparamètres α et λ de DP et G0 est donné ci-dessous:

![]()

![]()

Équation 3: Probabilités utilisées par Gibbs Sampler pour MNMM

Où zi est l'affectation de cluster de l'observation xi, X1: n est l'ensemble de données complet, z-i est l'ensemble des affectations de cluster sans celle des ith observation, x-i est l'ensemble de données complet excluant le ith observation, ck,-je est le nombre total d'observations attribuées à la grappe k à l'exclusion des ith observation pendant ![]() et les

et les ![]() sont la moyenne et la matrice de covariance de la grappe k excluant les ith observation.

sont la moyenne et la matrice de covariance de la grappe k excluant les ith observation.

2. Le modèle de mélange Dirichlet-multinomial

Le modèle de mélange Dirichlet-Multinomial est utilisé pour effectuer une analyse de cluster de documents. Le modèle particulier a une hiérarchie un peu plus compliquée car il modélise les sujets / catégories des documents, les probabilités de mots dans chaque sujet, les attributions de cluster et la distribution générative des documents. Son objectif est d'effectuer un apprentissage non supervisé et de regrouper une liste de documents en les affectant à des groupes. Le modèle de mélange est défini comme suit:

![]()

![]()

![]()

![]()

Équation 4: Modèle de mélange Dirichlet-multinomial

Où φ modélise les probabilités du sujet, zi est un sélecteur de sujet, θk sont les probabilités de mot dans chaque cluster et xje, j représente les mots du document. Il faut noter que cette technique utilise le cadre du sac de mots qui représente les documents comme une collection non ordonnée de mots, sans tenir compte de la grammaire et de l'ordre des mots. Cette représentation simplifiée est couramment utilisée dans le traitement du langage naturel et la recherche d'informations. Ci-dessous, nous présentons le modèle graphique du modèle de mélange:

Figure 2: Modèle graphique du modèle de mélange Dirichlet-multinomial

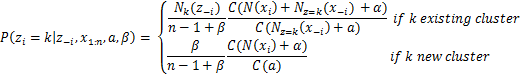

Le modèle particulier utilise Distribution discrète multinomiale pour la distribution générative et les distributions de Dirichlet pour les a priori. Le ℓ est la taille de nos clusters actifs, le n le nombre total de documents, le β contrôle le nombre de clusters a priori attendu tandis que α contrôle le nombre de mots attribués à chaque cluster. Pour estimer les probabilités requises par le Sampler de Gibbs effondré nous utilisons le équation suivante:

![]()

Équation 5: Probabilités utilisées par Gibbs Sampler pour DMMM

Où Γ est la fonction gamma, zi est l'affectation de cluster du document xi, X1: n est l'ensemble de données complet, z-i est l'ensemble des affectations de cluster sans celle des ith document, x-i est l'ensemble de données complet excluant le ith document, SUBSTk(z-i) est le nombre d'observations attribuées à la grappe k à l'exclusion de ith document, SUBSTz=k(x-i) est un vecteur avec les sommes des comptes pour chaque mot pour tous les documents affectés à la grappe k excluant ith document et N (xi) est le vecteur clairsemé avec le nombre de chaque mot dans le document xi. Enfin, comme nous pouvons le voir ci-dessus, en utilisant le Sampler Gibbs Collapsed avec le Chinese Restaurant Process, le θjk La variable qui stocke la probabilité du mot j dans le sujet k peut être intégrée.

- AI

- art de l'IA

- générateur d'art ai

- robot IA

- intelligence artificielle

- certification en intelligence artificielle

- robot d'intelligence artificielle

- robots d'intelligence artificielle

- logiciel d'intelligence artificielle

- blockchain

- conférence blockchain ai

- cognitif

- intelligence artificielle conversationnelle

- crypto conférence ai

- de dall

- Boîte de données

- l'apprentissage en profondeur

- google ai

- machine learning

- Apprentissage automatique et statistiques

- Platon

- platon ai

- Intelligence des données Platon

- Jeu de Platon

- PlatonDonnées

- jeu de platogamie

- échelle ai

- syntaxe

- zéphyrnet