Dans cet article, nous montrons comment configurer une nouvelle fonctionnalité d'authentification basée sur OAuth pour utiliser Flocon in Gestionnaire de données Amazon SageMaker. Snowflake est une plate-forme de données cloud qui fournit des solutions de données pour l'entreposage de données à la science des données. Le flocon de neige est un Partenaire AWS avec plusieurs accréditations AWS, y compris les compétences AWS en machine learning (ML), vente au détail, données et analyse.

Data Wrangler simplifie le processus de préparation des données et d'ingénierie des fonctionnalités, réduisant le temps qu'il faut de plusieurs semaines à quelques minutes en fournissant une interface visuelle unique aux scientifiques des données pour sélectionner et nettoyer les données, créer des fonctionnalités et automatiser la préparation des données dans les flux de travail ML sans écrire de code. Vous pouvez importer des données à partir de plusieurs sources de données, telles que Service de stockage simple Amazon (Amazon S3), Amazone Athéna, Redshift d'Amazon, Amazon DME, et Flocon de neige. Avec cette nouvelle fonctionnalité, vous pouvez utiliser votre propre fournisseur d'identité (IdP) tel que Okta, Entra IDou Ping fédéré pour se connecter à Snowflake via Data Wrangler.

Vue d'ensemble de la solution

Dans les sections suivantes, nous fournissons les étapes permettant à un administrateur de configurer l'IdP, Snowflake et Studio. Nous détaillons également les étapes que les data scientists peuvent suivre pour configurer le flux de données, analyser la qualité des données et ajouter des transformations de données. Enfin, nous montrons comment exporter le flux de données et entraîner un modèle à l'aide de Pilote automatique SageMaker.

Pré-requis

Pour cette procédure pas à pas, vous devez disposer des prérequis suivants:

- Pour l'administrateur :

- Un utilisateur Snowflake autorisé à créer des intégrations de stockage et des intégrations de sécurité dans Snowflake.

- Un compte AWS avec des autorisations de création Gestion des identités et des accès AWS (IAM) politiques et rôles.

- Accès et autorisations pour configurer IDP pour enregistrer l'application Data Wrangler et configurer le serveur d'autorisation ou l'API.

- Pour les scientifiques de données :

Configuration administrateur

Au lieu de demander à vos utilisateurs de saisir directement leurs informations d'identification Snowflake dans Data Wrangler, vous pouvez leur demander d'utiliser un IdP pour accéder à Snowflake.

Les étapes suivantes sont impliquées pour permettre l'accès Data Wrangler OAuth à Snowflake :

- Configurez le fournisseur d'identité.

- Configurez Snowflake.

- Configurez SageMaker Studio.

Configurer le fournisseur d'identité

Pour configurer votre IdP, vous devez enregistrer l'application Data Wrangler et configurer votre serveur d'autorisation ou votre API.

Enregistrez l'application Data Wrangler dans l'IdP

Reportez-vous à la documentation suivante pour les IdP pris en charge par Data Wrangler :

Utilisez la documentation fournie par votre IdP pour enregistrer votre application Data Wrangler. Les informations et les procédures de cette section vous aident à comprendre comment utiliser correctement la documentation fournie par votre fournisseur d'identité.

Des personnalisations spécifiques en plus des étapes des guides respectifs sont décrites dans les sous-sections.

- Sélectionnez la configuration qui démarre le processus d'enregistrement de Data Wrangler en tant qu'application.

- Fournissez aux utilisateurs de l'IdP un accès à Data Wrangler.

- Activez l'authentification du client OAuth en stockant les informations d'identification du client en tant que secret Secrets Manager.

- Spécifiez une URL de redirection au format suivant :

https://domain-ID.studio.AWS Region.sagemaker.aws/jupyter/default/lab.

Vous spécifiez l'ID de domaine SageMaker et la région AWS que vous utilisez pour exécuter Data Wrangler. Vous devez enregistrer une URL pour chaque domaine et région où vous exécutez Data Wrangler. Les utilisateurs d'un domaine et d'une région qui n'ont pas d'URL de redirection configurées pour eux ne pourront pas s'authentifier auprès de l'IdP pour accéder à la connexion Snowflake.

- Assurez-vous que le code d'autorisation et les types d'octroi de jeton d'actualisation sont autorisés pour votre application Data Wrangler.

Configurer le serveur d'autorisation ou l'API au sein de l'IdP

Au sein de votre IdP, vous devez configurer un serveur d'autorisation ou une interface de programmation d'application (API). Pour chaque utilisateur, le serveur d'autorisation ou l'API envoie des jetons à Data Wrangler avec Snowflake comme audience.

Snowflake utilise le concept de rôle distincts des rôles IAM utilisés dans AWS. Vous devez configurer l'IdP pour utiliser N'IMPORTE QUEL rôle afin d'utiliser le rôle par défaut associé au compte Snowflake. Par exemple, si un utilisateur a systems administrator comme rôle par défaut dans leur profil Snowflake, la connexion de Data Wrangler à Snowflake utilise systems administrator comme rôle.

Utilisez la procédure suivante pour configurer le serveur d'autorisation ou l'API au sein de votre fournisseur d'identité :

- À partir de votre fournisseur d'identité, commencez le processus de configuration du serveur ou de l'API.

- Configurez le serveur d'autorisation pour utiliser le code d'autorisation et actualisez les types d'octroi de jeton.

- Spécifiez la durée de vie du jeton d'accès.

- Définissez le délai d'inactivité du jeton d'actualisation.

Le délai d'inactivité est le délai d'expiration du jeton d'actualisation s'il n'est pas utilisé. Si vous planifiez des tâches dans Data Wrangler, nous vous recommandons de faire en sorte que le délai d'inactivité soit supérieur à la fréquence de la tâche de traitement. Sinon, certaines tâches de traitement risquent d'échouer car le jeton d'actualisation a expiré avant qu'elles ne puissent s'exécuter. Lorsque le jeton d'actualisation expire, l'utilisateur doit se ré-authentifier en accédant à la connexion qu'il a établie avec Snowflake via Data Wrangler.

Notez que Data Wrangler ne prend pas en charge les jetons d'actualisation rotatifs. L'utilisation de jetons d'actualisation rotatifs peut entraîner des échecs d'accès ou obliger les utilisateurs à se connecter fréquemment.

Si le jeton d'actualisation expire, vos utilisateurs doivent se réauthentifier en accédant à la connexion qu'ils ont établie avec Snowflake via Data Wrangler.

- Spécifier

session:role-anycomme nouvelle portée.

Pour Azure AD, vous devez également spécifier un identifiant unique pour l'étendue.

Après avoir configuré le fournisseur OAuth, vous fournissez à Data Wrangler les informations dont il a besoin pour se connecter au fournisseur. Vous pouvez utiliser la documentation de votre fournisseur d'identité pour obtenir des valeurs pour les champs suivants :

- URL du jeton – L'URL du jeton que l'IdP envoie à Data Wrangler

- URL d'autorisation – L'URL du serveur d'autorisation de l'IdP

- identité du client – L'identifiant de l'IdP

- Secret client – Le secret que seul le serveur d'autorisation ou l'API reconnaît

- Champ d'application OAuth – Ceci est pour Azure AD uniquement

Configurer le flocon de neige

Pour configurer Snowflake, suivez les instructions de Importer des données depuis Snowflake.

Utilisez la documentation Snowflake de votre IdP pour configurer une intégration OAuth externe dans Snowflake. Voir la section précédente Enregistrez l'application Data Wrangler dans l'IdP pour plus d'informations sur la configuration d'une intégration OAuth externe.

Lorsque vous configurez l'intégration de la sécurité dans Snowflake, assurez-vous d'activer external_oauth_any_role_mode.

Configurer SageMakerStudio

Vous stockez les champs et les valeurs dans un secret Secrets Manager et l'ajoutez à la configuration du cycle de vie de Studio que vous utilisez pour Data Wrangler. Une configuration de cycle de vie est un script shell qui charge automatiquement les informations d'identification stockées dans le secret lorsque l'utilisateur se connecte à Studio. Pour plus d'informations sur la création de secrets, consultez Déplacer des secrets codés en dur vers AWS Secrets Manager. Pour plus d'informations sur l'utilisation des configurations de cycle de vie dans Studio, consultez Utiliser les configurations de cycle de vie avec Amazon SageMaker Studio.

Créer un secret pour les identifiants Snowflake

Pour créer votre secret pour les identifiants Snowflake, procédez comme suit :

- Sur la console Secrets Manager, choisissez Stocker un nouveau secret.

- Pour Type secret, sélectionnez Autre type de secret.

- Spécifiez les détails de votre secret sous forme de paires clé-valeur.

Les noms de clé nécessitent des lettres minuscules en raison de la sensibilité à la casse. Data Wrangler donne un avertissement si vous entrez l'un de ces éléments de manière incorrecte. Entrez les valeurs secrètes sous forme de paires clé-valeur Clé/valeur si vous le souhaitez, ou utilisez la Plaintext option.

Voici le format du secret utilisé pour Okta. Si vous utilisez Azure AD, vous devez ajouter le datasource_oauth_scope champ.

- Mettez à jour les valeurs précédentes avec votre choix d'IdP et les informations recueillies après l'enregistrement de l'application.

- Selectionnez Suivant.

- Pour Nom secret, ajoutez le préfixe

AmazonSageMaker(par exemple, notre secret estAmazonSageMaker-DataWranglerSnowflakeCreds). - Dans le Tags section, ajoutez une balise avec la clé

SageMakeret valeurtrue. - Selectionnez Suivant.

- Les autres champs sont facultatifs ; choisir Suivant jusqu'à ce que vous ayez la possibilité de choisir Agence pour stocker le secret.

Après avoir stocké le secret, vous revenez à la console Secrets Manager.

- Choisissez le secret que vous venez de créer, puis récupérez l'ARN secret.

- Stockez-le dans votre éditeur de texte préféré pour une utilisation ultérieure lors de la création de la source de données Data Wrangler.

Créer une configuration de cycle de vie Studio

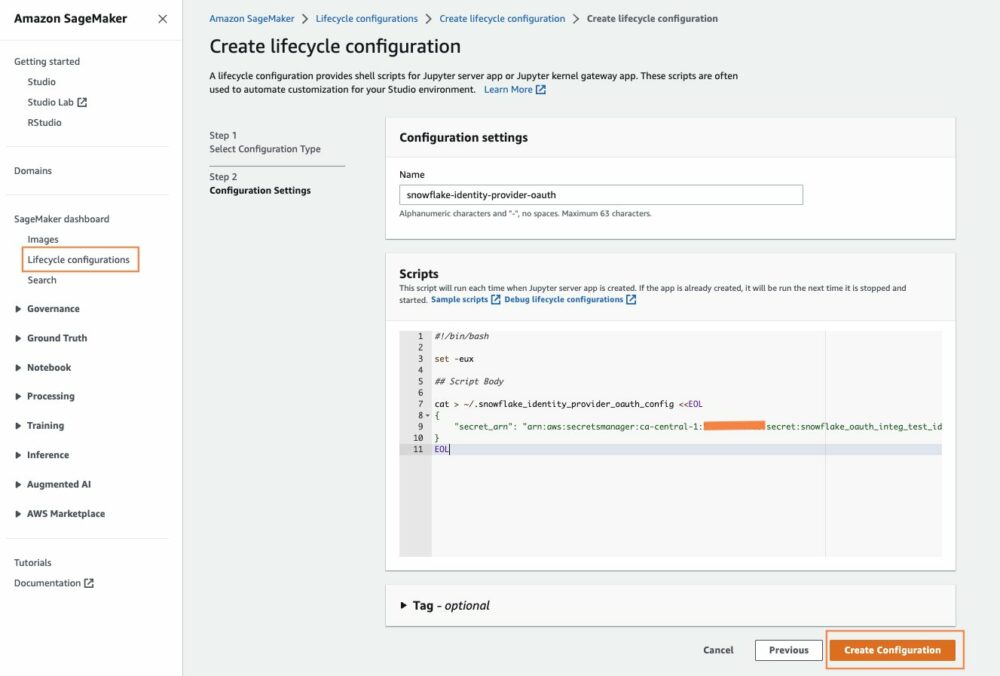

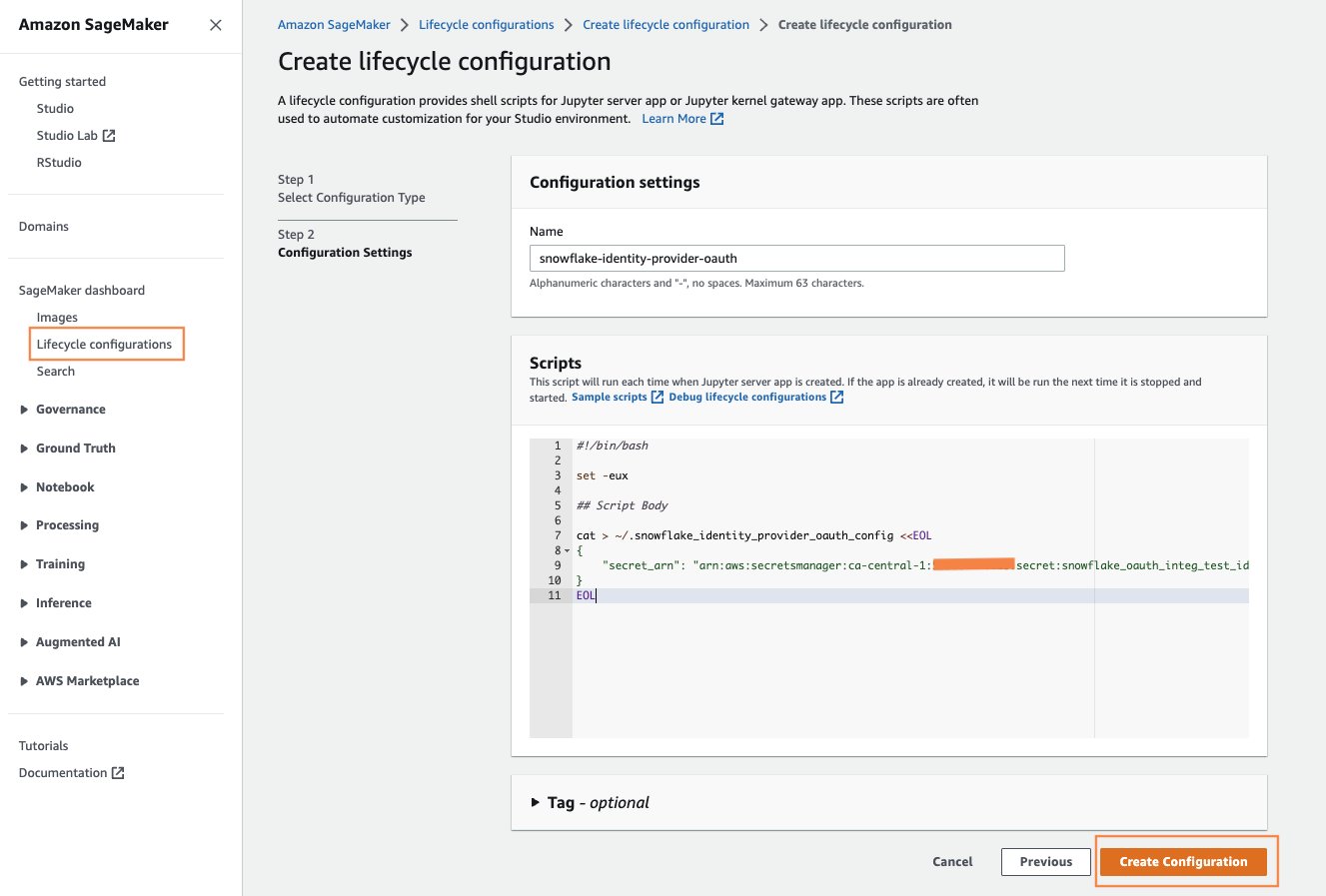

Pour créer une configuration de cycle de vie dans Studio, procédez comme suit :

- Sur la console SageMaker, choisissez Configurations du cycle de vie dans le volet de navigation.

- Selectionnez Créer une configuration.

- Selectionnez Application serveur Jupyter.

- Créez une nouvelle configuration de cycle de vie ou ajoutez-en une existante avec le contenu suivant :

La configuration crée un fichier avec le nom ".snowflake_identity_provider_oauth_config", contenant le secret dans le dossier de départ de l'utilisateur.

- Selectionnez Créer une configuration.

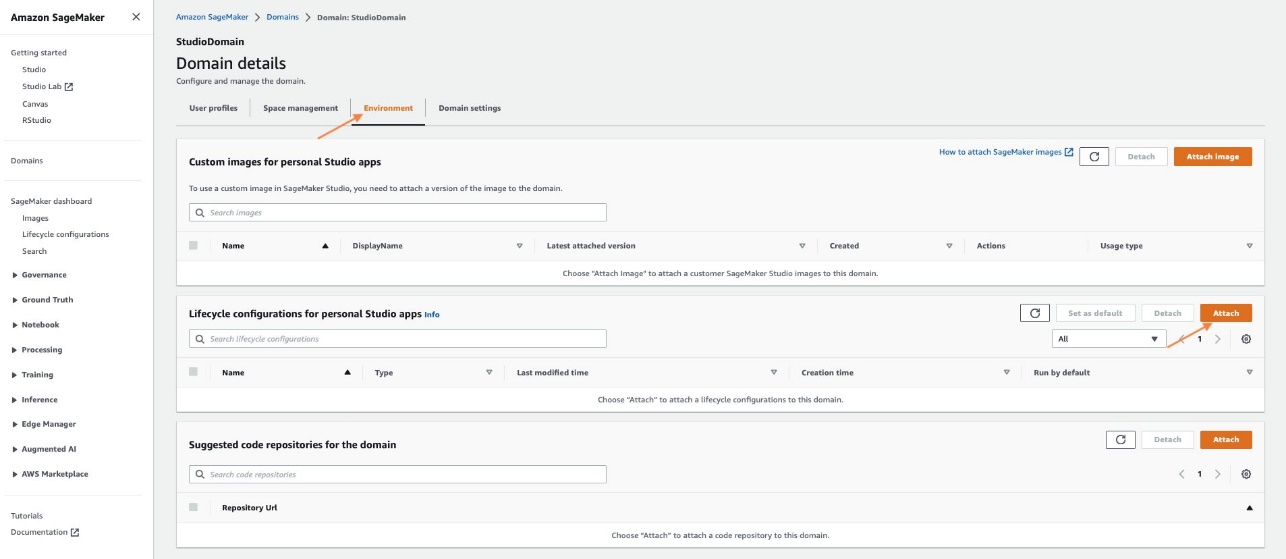

Définir la configuration du cycle de vie par défaut

Effectuez les étapes suivantes pour définir la configuration du cycle de vie que vous venez de créer par défaut :

- Sur la console SageMaker, choisissez Domaines dans le volet de navigation.

- Choisissez le domaine Studio que vous utiliserez pour cet exemple.

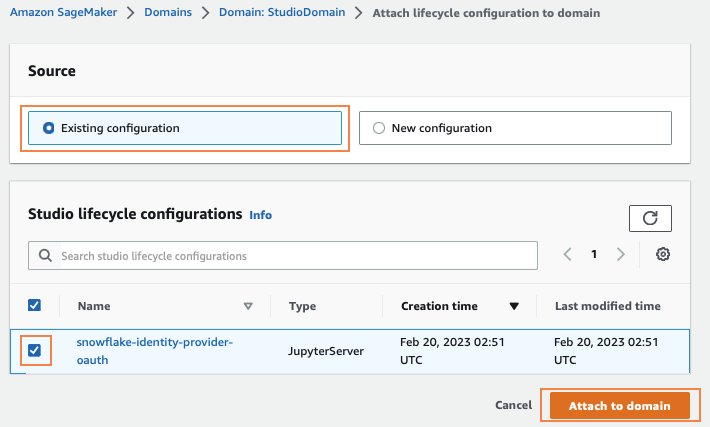

- Sur le Environment onglet, dans le Configurations du cycle de vie des applications Studio personnelles section, choisissez Attacher.

- Pour Identifier, sélectionnez Paramétrage existant.

- Sélectionnez la configuration que vous venez de faire, puis choisissez Attacher au domaine.

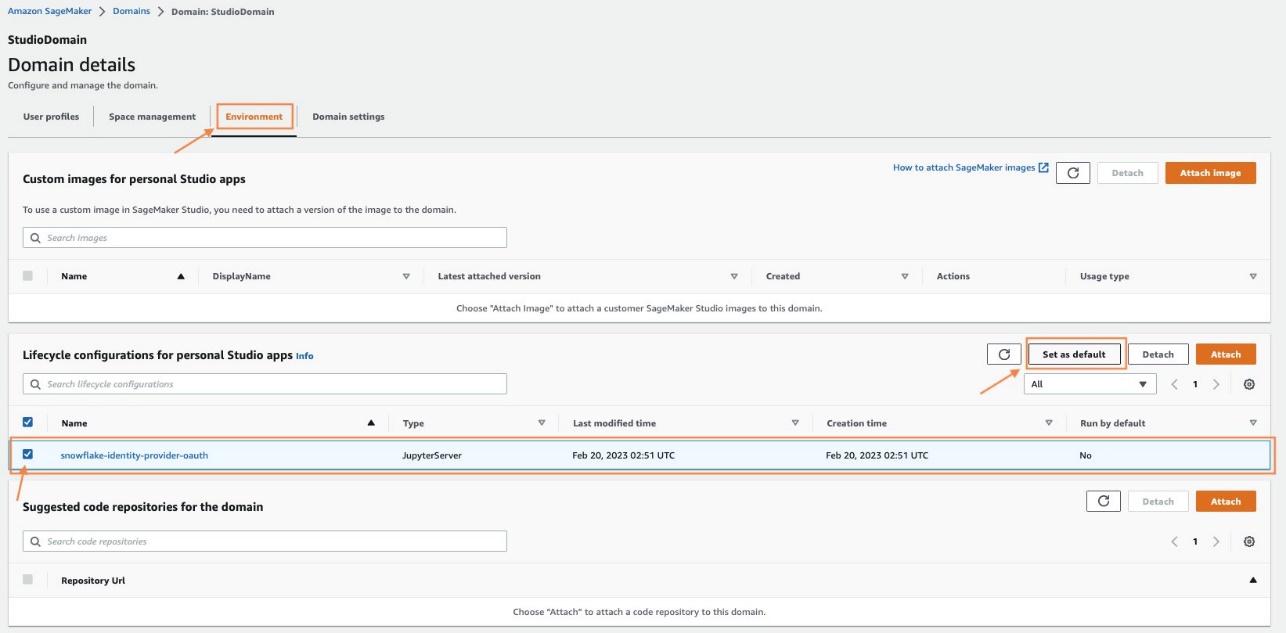

- Sélectionnez la nouvelle configuration et choisissez Définir par défaut, Puis choisissez Définir par défaut à nouveau dans le message contextuel.

Vos nouveaux paramètres devraient maintenant être visibles sous Configurations du cycle de vie des applications Studio personnelles par défaut.

- Fermez l'application Studio et relancez-la pour que les modifications prennent effet.

Expérience de data scientist

Dans cette section, nous expliquons comment les data scientists peuvent se connecter à Snowflake en tant que source de données dans Data Wrangler et préparer les données pour le ML.

Créer un nouveau flux de données

Pour créer votre flux de données, procédez comme suit :

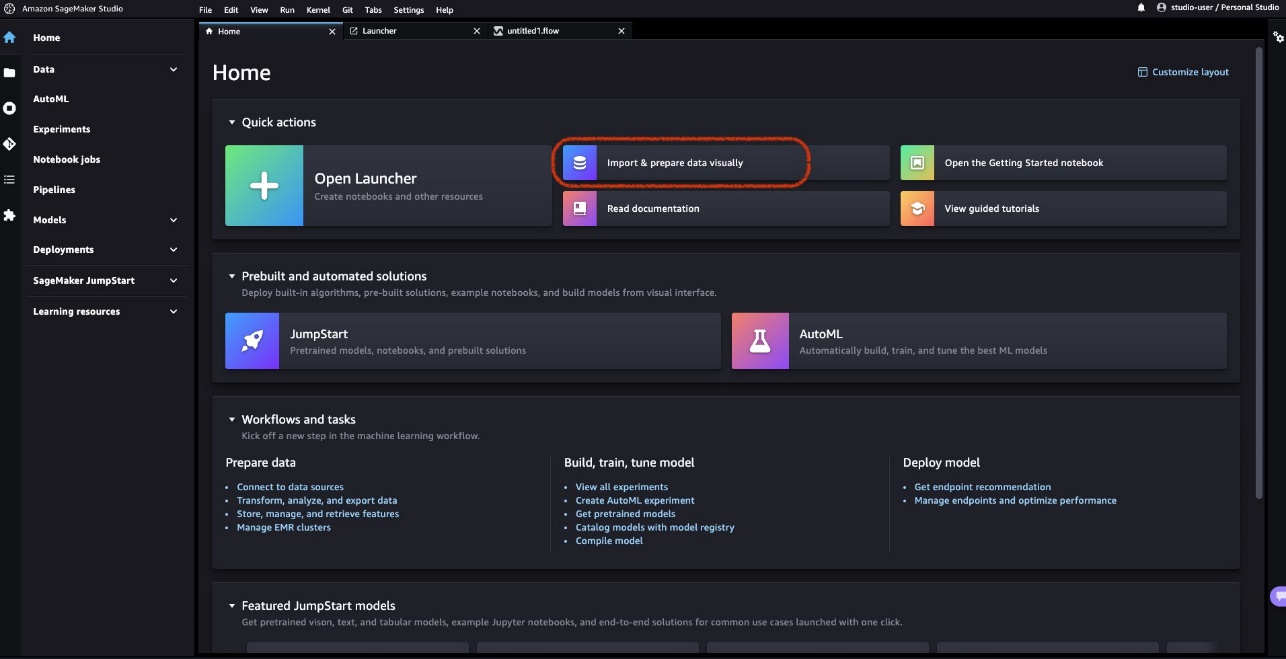

- Sur la console SageMaker, choisissez Amazon SageMakerStudio dans le volet de navigation.

- Selectionnez Open Studio.

- Sur l'atelier Accueil page, choisissez Importer et préparer visuellement les données. Alternativement, sur le Déposez votre dernière attestation liste déroulante, choisissez Nouveauté, Puis choisissez Flux SageMaker Data Wrangler.

La création d'un nouveau flux peut prendre quelques minutes.

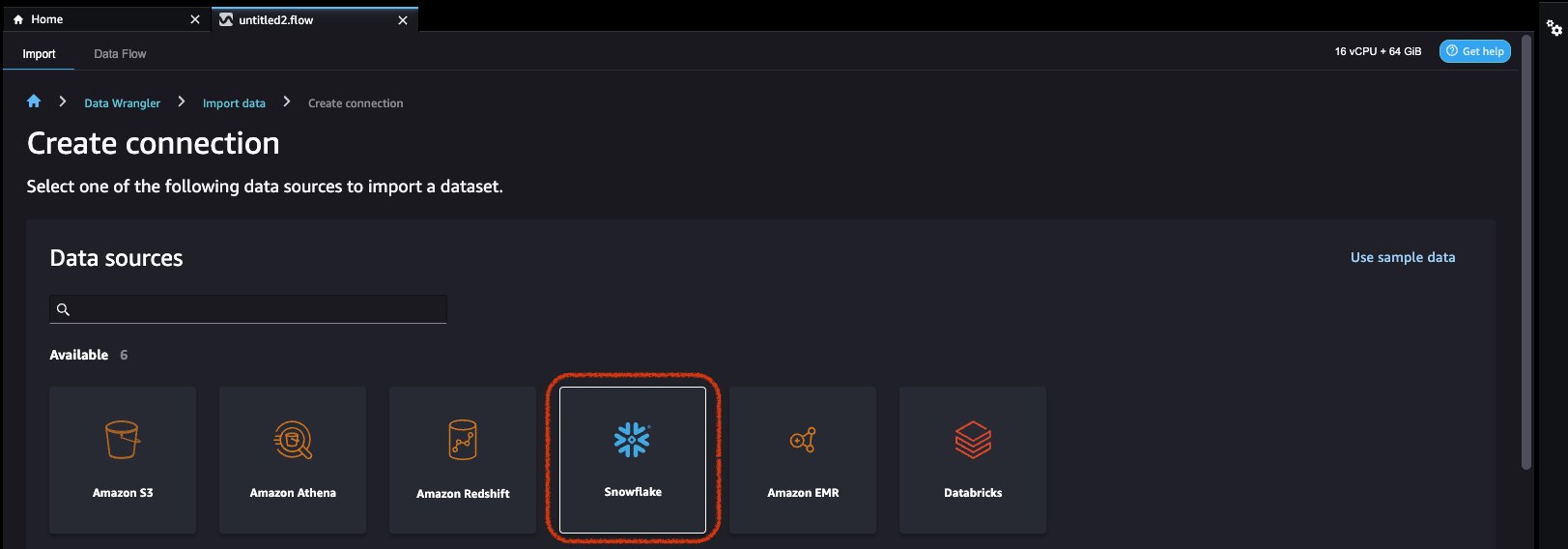

- Sur le Importer des dates page, choisissez Créer une connexion.

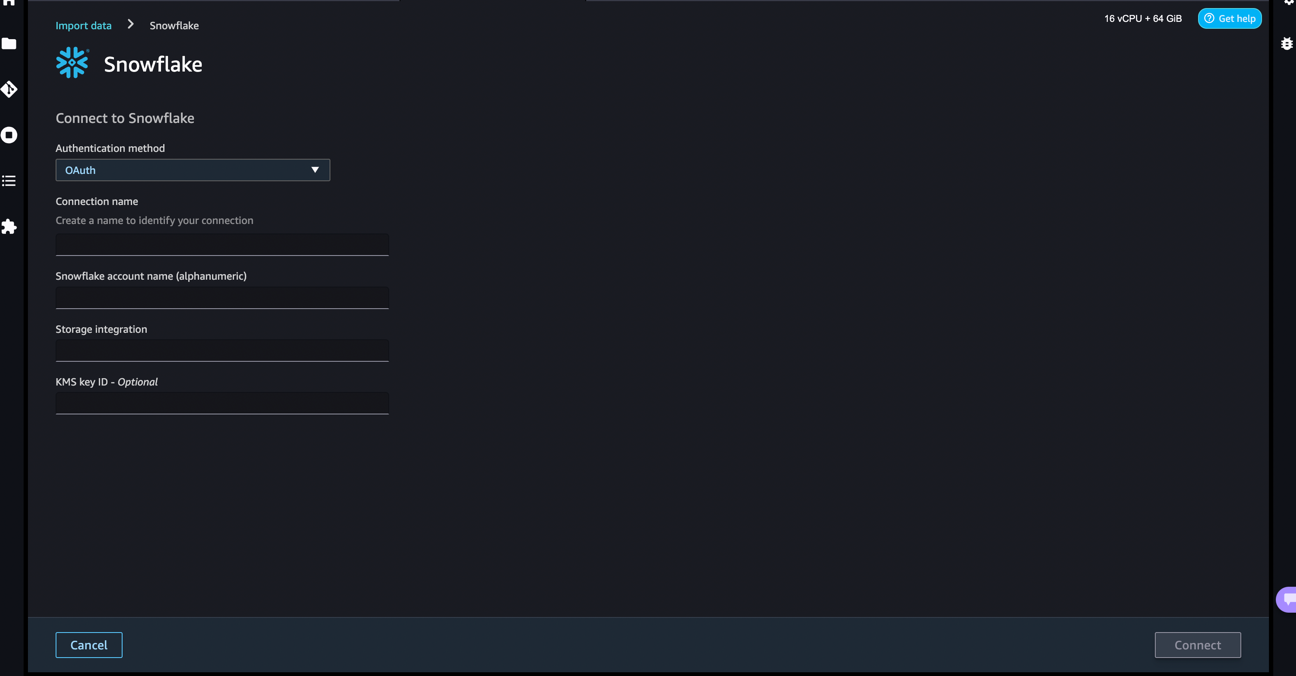

- Selectionnez Flocon de la liste des sources de données.

- Pour Méthode d'authentification, choisissez OAuth.

Si vous ne voyez pas OAuth, vérifiez les étapes précédentes de configuration du cycle de vie.

- Entrez les détails pour Nom du compte Snowflake et les Intégration du stockage.

- Entrez un nom de connexion et choisissez NOUS CONTACTER.

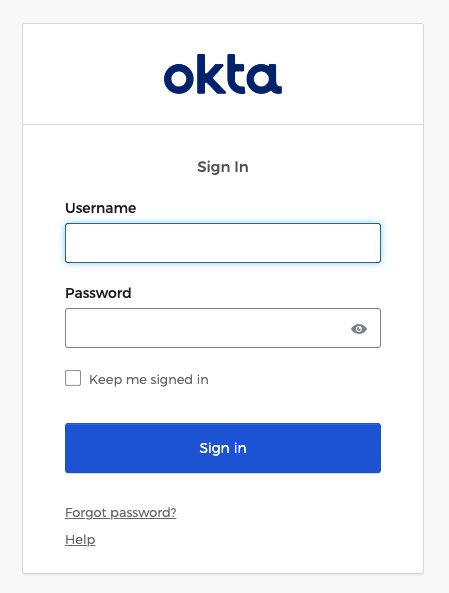

Vous êtes redirigé vers une page d'authentification IdP. Pour cet exemple, nous utilisons Okta.

- Entrez votre nom d'utilisateur et votre mot de passe, puis choisissez Connexion.

Une fois l'authentification réussie, vous êtes redirigé vers la page de flux de données Studio.

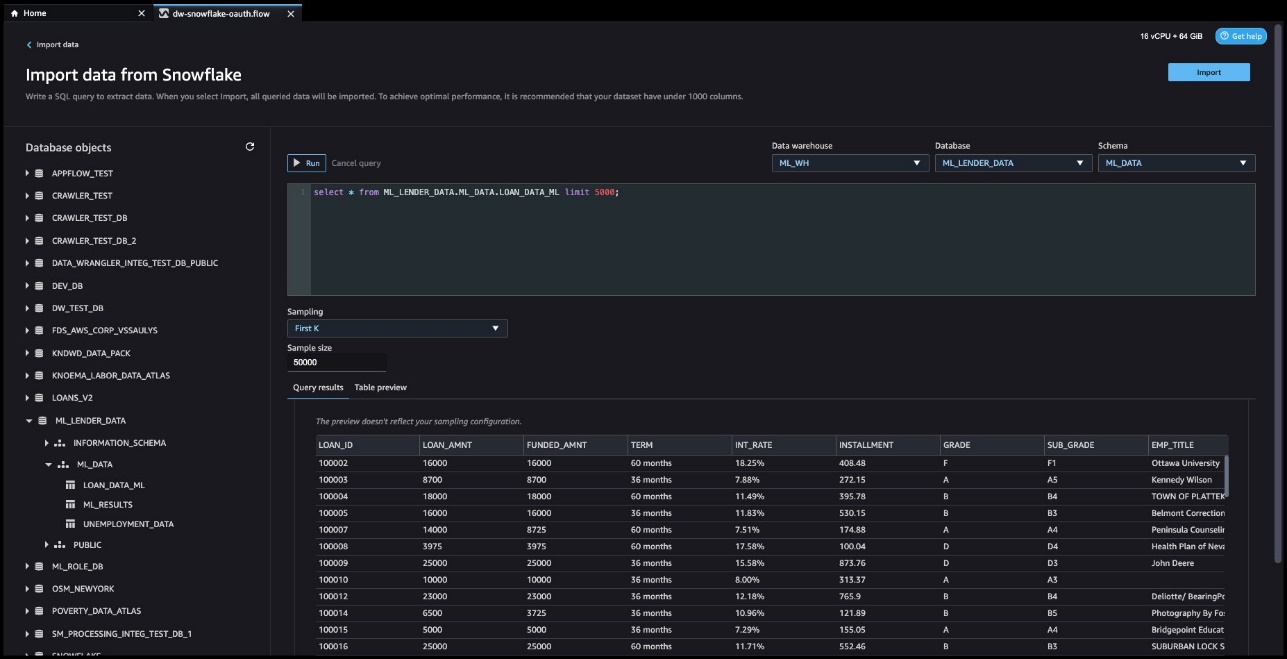

- Sur le Importer des données depuis Snowflake page, parcourir les objets de la base de données ou exécuter une requête pour les données ciblées.

- Dans l'éditeur de requêtes, saisissez une requête et prévisualisez les résultats.

Dans l'exemple suivant, nous chargeons Données de prêt et récupérez toutes les colonnes de 5,000 XNUMX lignes.

- Selectionnez L’.

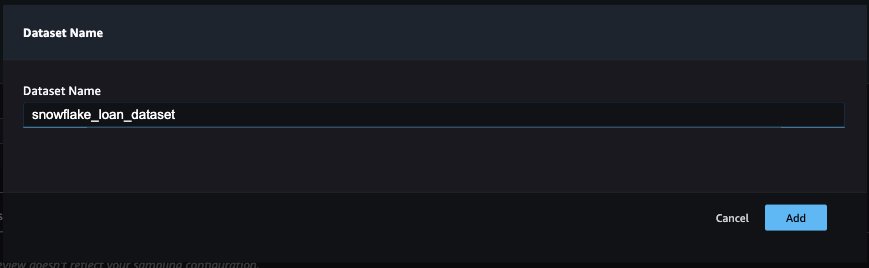

- Entrez un nom de jeu de données (pour cet article, nous utilisons

snowflake_loan_dataset) et choisissez Ajouter.

Vous êtes redirigé vers le Préparer page, où vous pouvez ajouter des transformations et des analyses aux données.

Data Wrangler facilite l'ingestion de données et l'exécution de tâches de préparation de données telles que l'analyse exploratoire de données, la sélection de fonctionnalités et l'ingénierie de fonctionnalités. Nous n'avons couvert que quelques-unes des fonctionnalités de Data Wrangler dans cet article sur la préparation des données ; vous pouvez utiliser Data Wrangler pour une analyse de données plus avancée, telle que l'importance des fonctionnalités, la fuite cible et l'explicabilité du modèle à l'aide d'une interface utilisateur simple et intuitive.

Analyser la qualité des données

Utilisez l'option Rapport sur la qualité des données et les informations pour effectuer une analyse des données que vous avez importées dans Data Wrangler. Data Wrangler crée le rapport à partir des données échantillonnées.

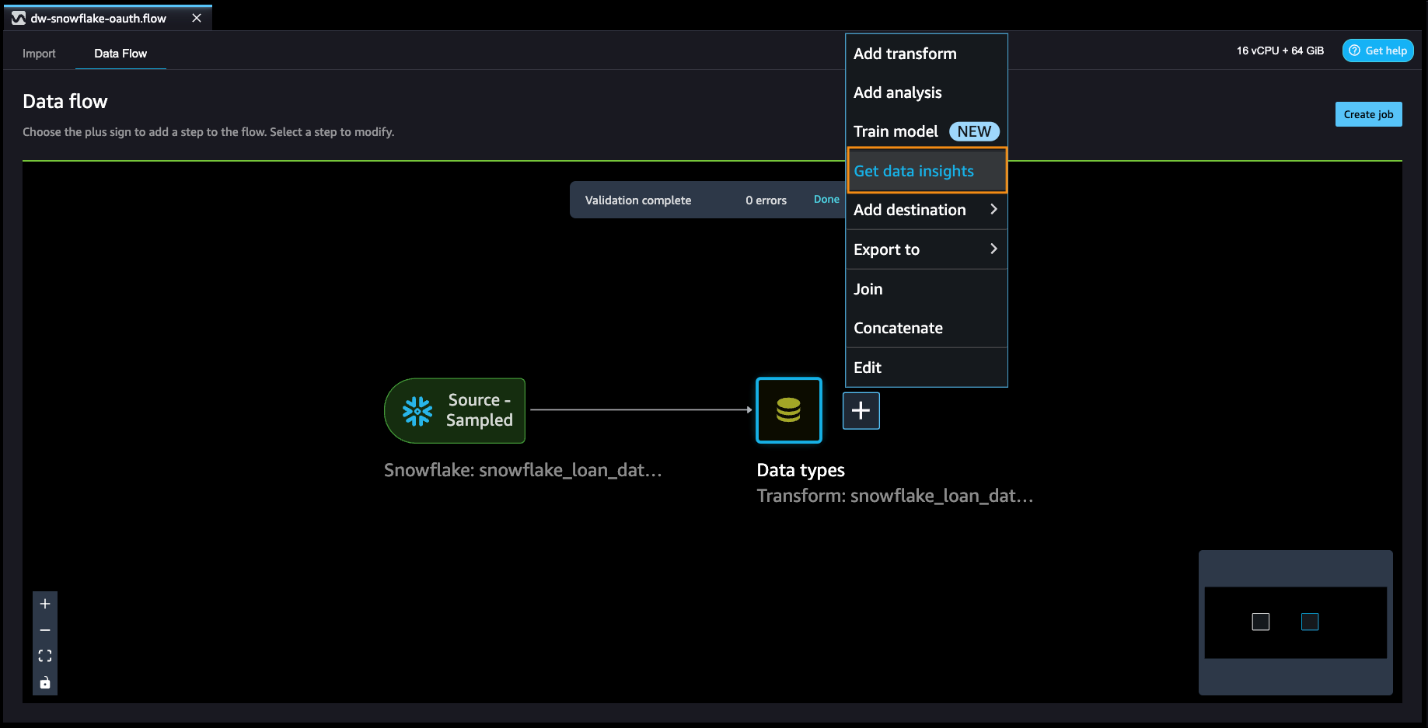

- Sur la page de flux Data Wrangler, choisissez le signe plus à côté de Types de données, Puis choisissez Obtenez des informations sur les données.

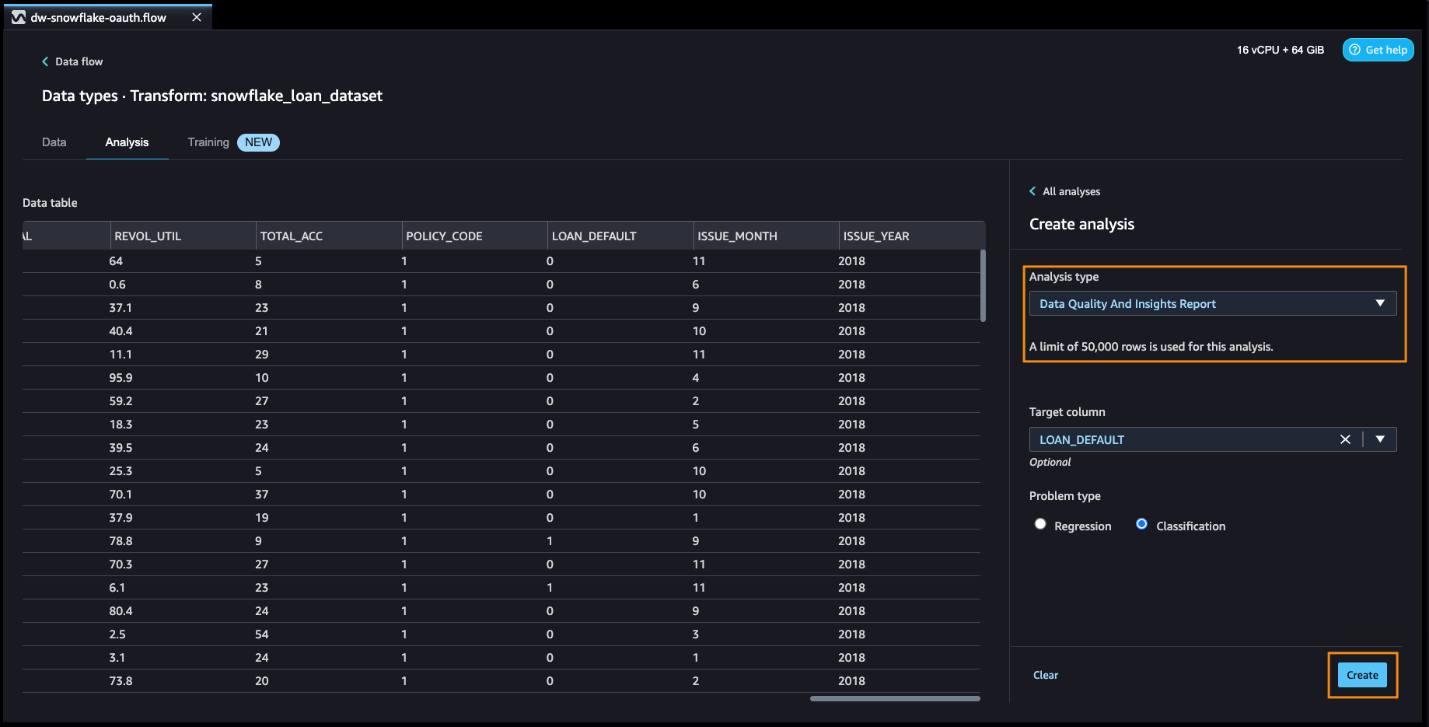

- Selectionnez Rapport sur la qualité des données et les informations en Type d'analyse.

- Pour Colonne cible, choisissez votre colonne cible.

- Pour Type de problème, sélectionnez Classification.

- Selectionnez Création.

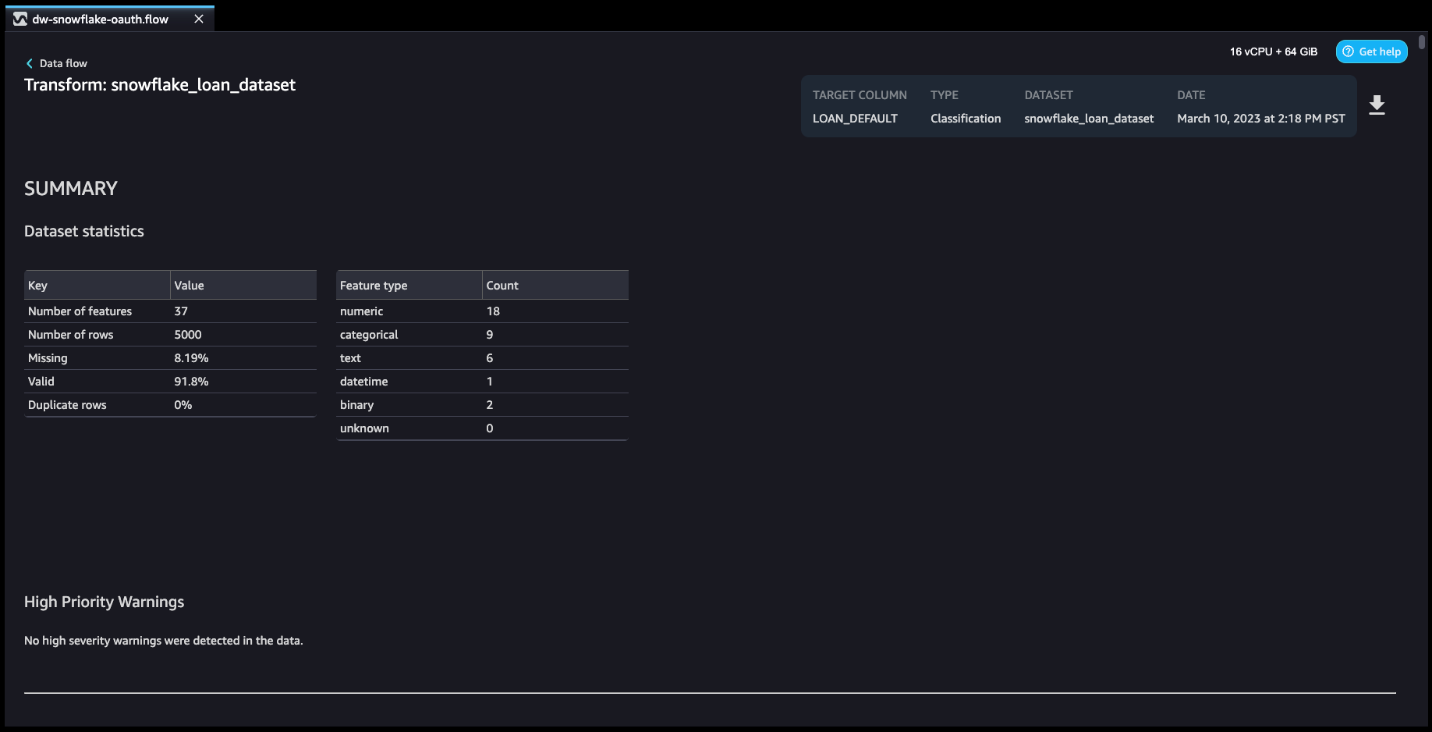

Le rapport d'informations contient un bref résumé des données, qui comprend des informations générales telles que les valeurs manquantes, les valeurs non valides, les types de caractéristiques, le nombre de valeurs aberrantes, etc. Vous pouvez soit télécharger le rapport, soit le consulter en ligne.

Ajouter des transformations aux données

Data Wrangler a plus de 300 transformations intégrées. Dans cette section, nous utilisons certaines de ces transformations pour préparer l'ensemble de données pour un modèle ML.

- Sur la page de flux Data Wrangler, choisissez le signe plus, puis choisissez Ajouter une transformation.

Si vous suivez les étapes du message, vous êtes automatiquement redirigé ici après avoir ajouté votre jeu de données.

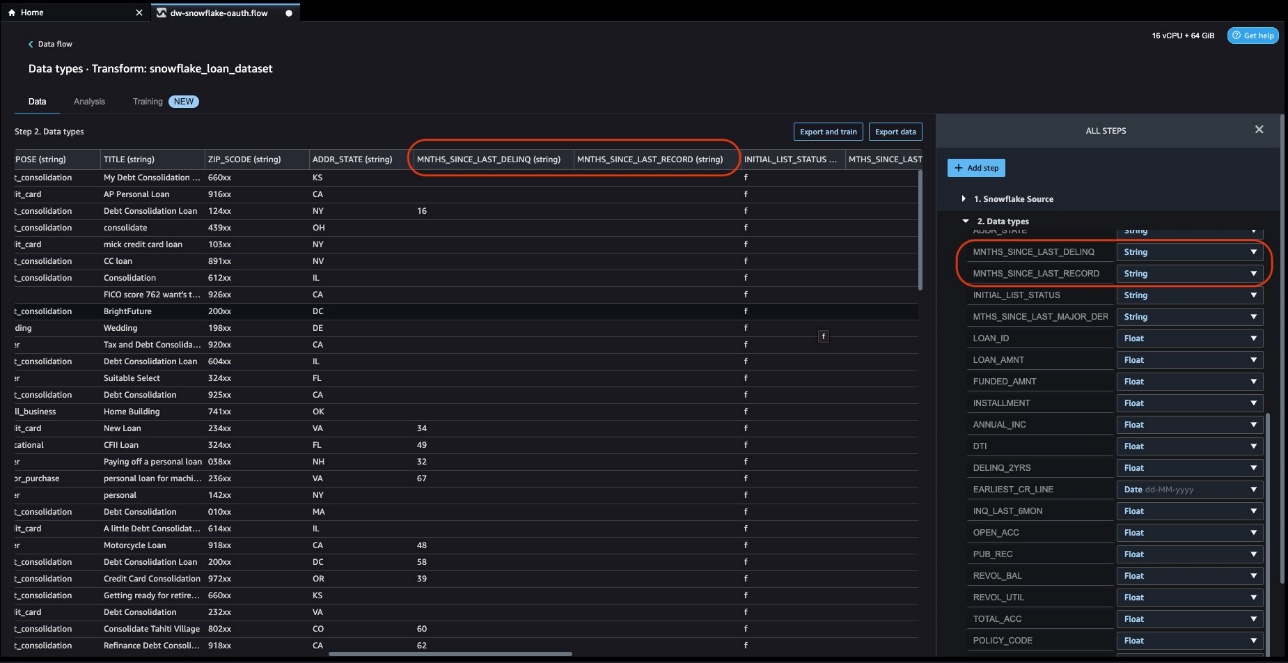

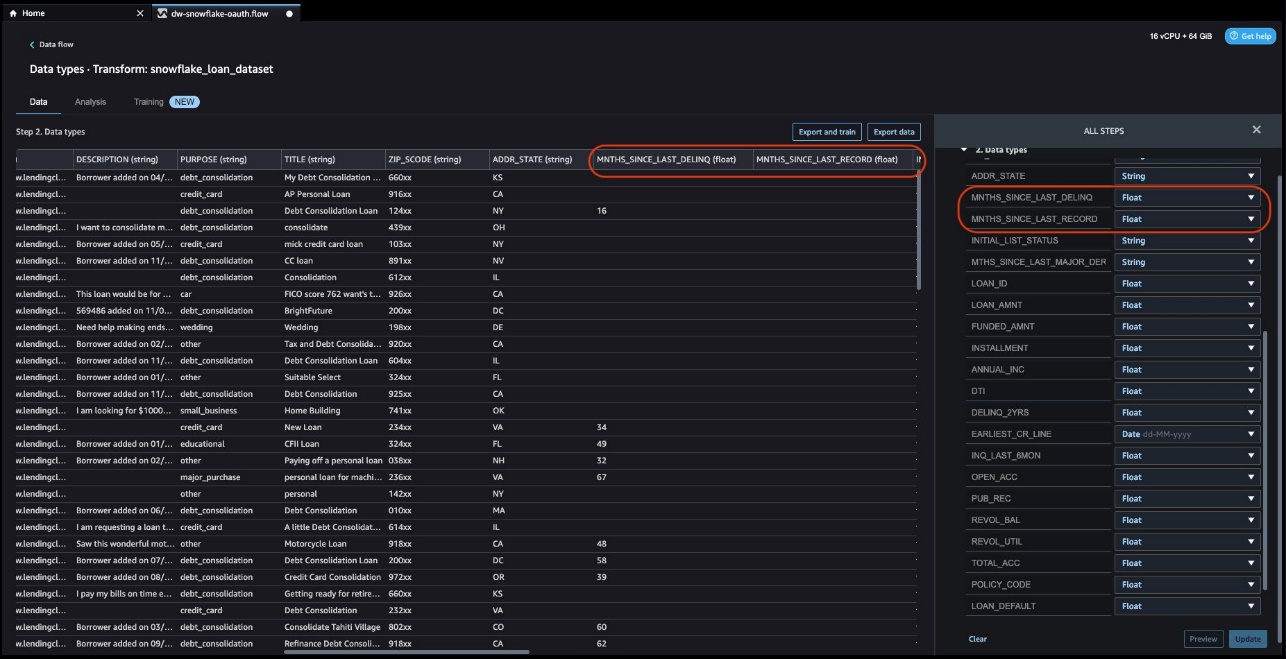

- Vérifiez et modifiez le type de données des colonnes.

En parcourant les colonnes, nous identifions que MNTHS_SINCE_LAST_DELINQ et les MNTHS_SINCE_LAST_RECORD devrait très probablement être représenté sous la forme d'un type numérique plutôt que d'une chaîne.

- Après avoir appliqué les modifications et ajouté l'étape, vous pouvez vérifier que le type de données de la colonne est remplacé par flottant.

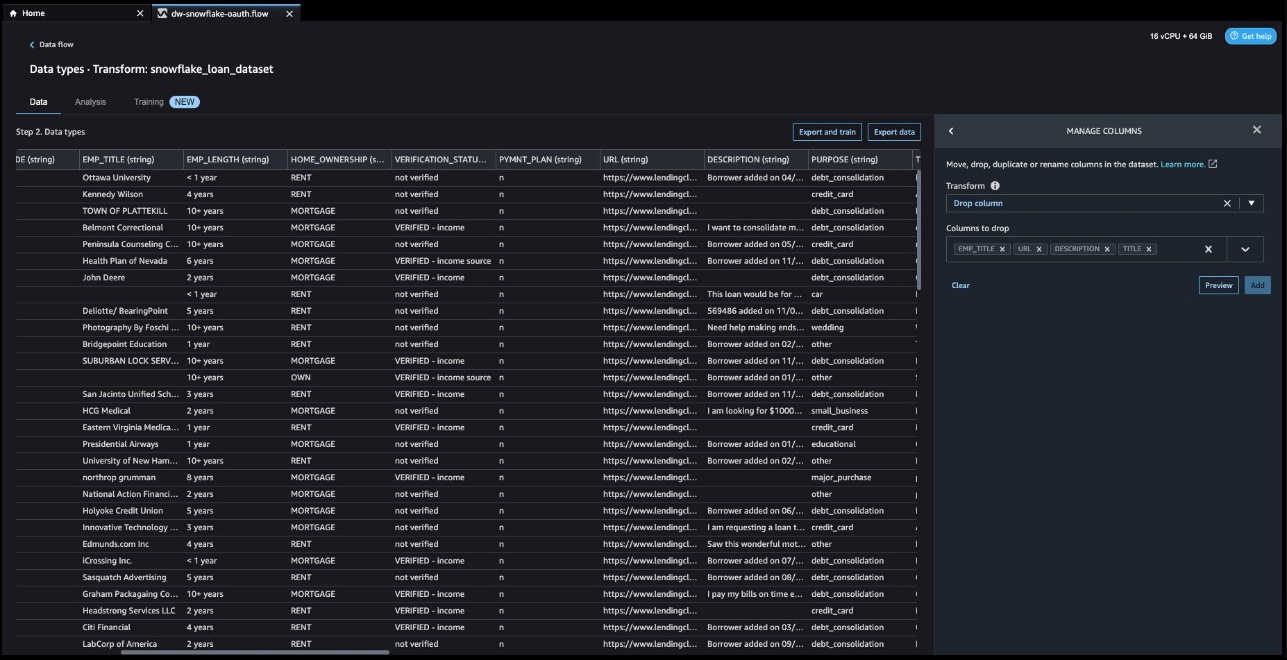

En parcourant les données, nous pouvons voir que les champs EMP_TITLE, URL, DESCRIPTIONet une TITLE n'apporteront probablement pas de valeur à notre modèle dans notre cas d'utilisation, nous pouvons donc les supprimer.

- Selectionnez Ajouter une étape, Puis choisissez Gérer les colonnes.

- Pour Transformer, choisissez Déposer la colonne.

- Pour Colonne à supprimer, Spécifiez

EMP_TITLE,URL,DESCRIPTIONet uneTITLE. - Selectionnez Aperçu et les Ajouter.

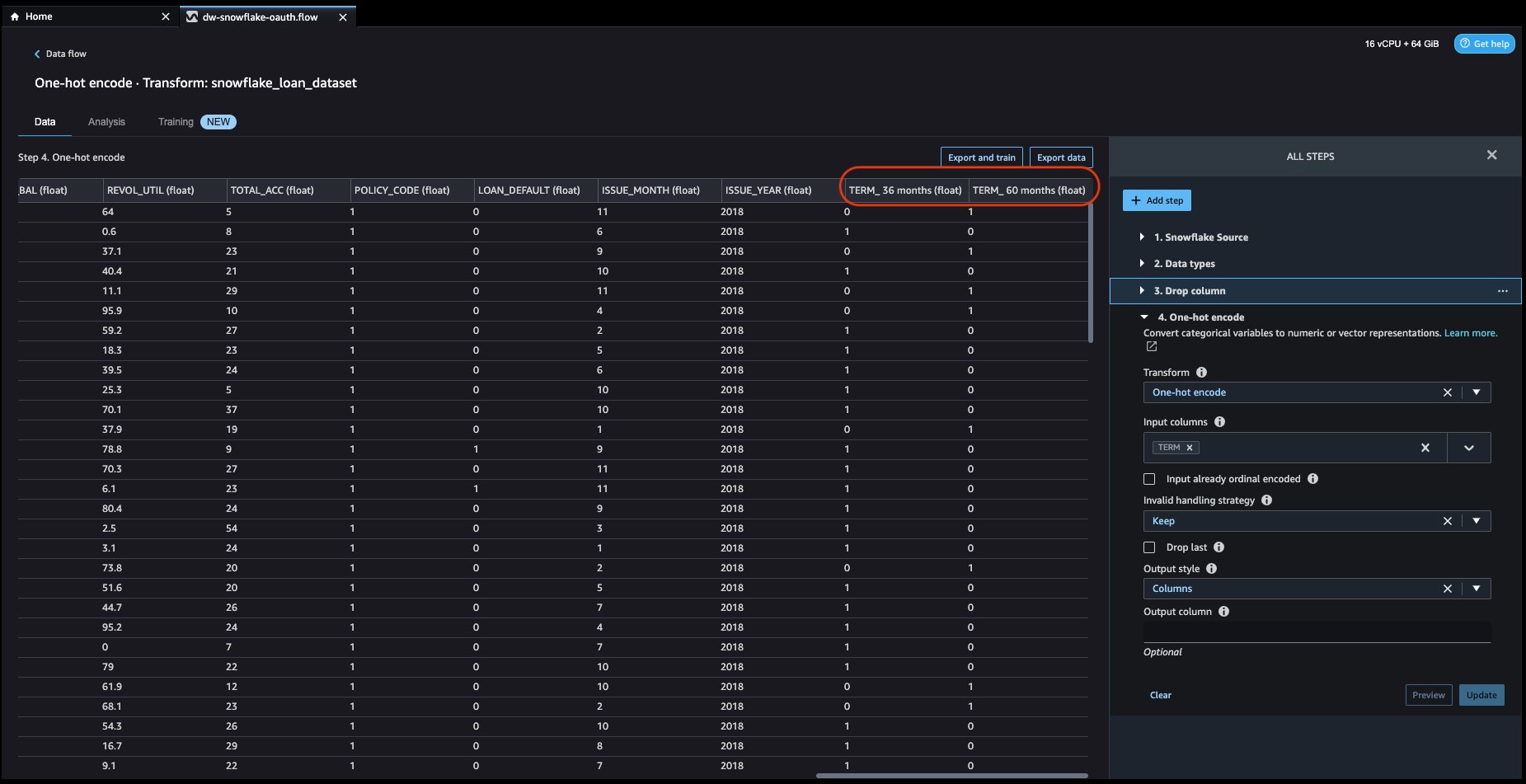

Ensuite, nous voulons rechercher des données catégorielles dans notre ensemble de données. Data Wrangler a une fonctionnalité intégrée pour encoder des données catégorielles en utilisant à la fois des encodages ordinaux et one-hot. En regardant notre ensemble de données, nous pouvons voir que le TERM, HOME_OWNERSHIPet une PURPOSE les colonnes semblent toutes être de nature catégorique.

- Ajoutez une autre étape et choisissez Encoder catégorique.

- Pour Transformer, choisissez Encodage à chaud.

- Pour Colonne d'entrée, choisissez

TERM. - Pour Style de sortie, choisissez Colonnes.

- Laissez tous les autres paramètres par défaut, puis choisissez Aperçu et les Ajouter.

Le HOME_OWNERSHIP colonne a quatre valeurs possibles : RENT, MORTGAGE, OWN, et autre.

- Répétez les étapes précédentes pour appliquer une approche d'encodage à chaud sur ces valeurs.

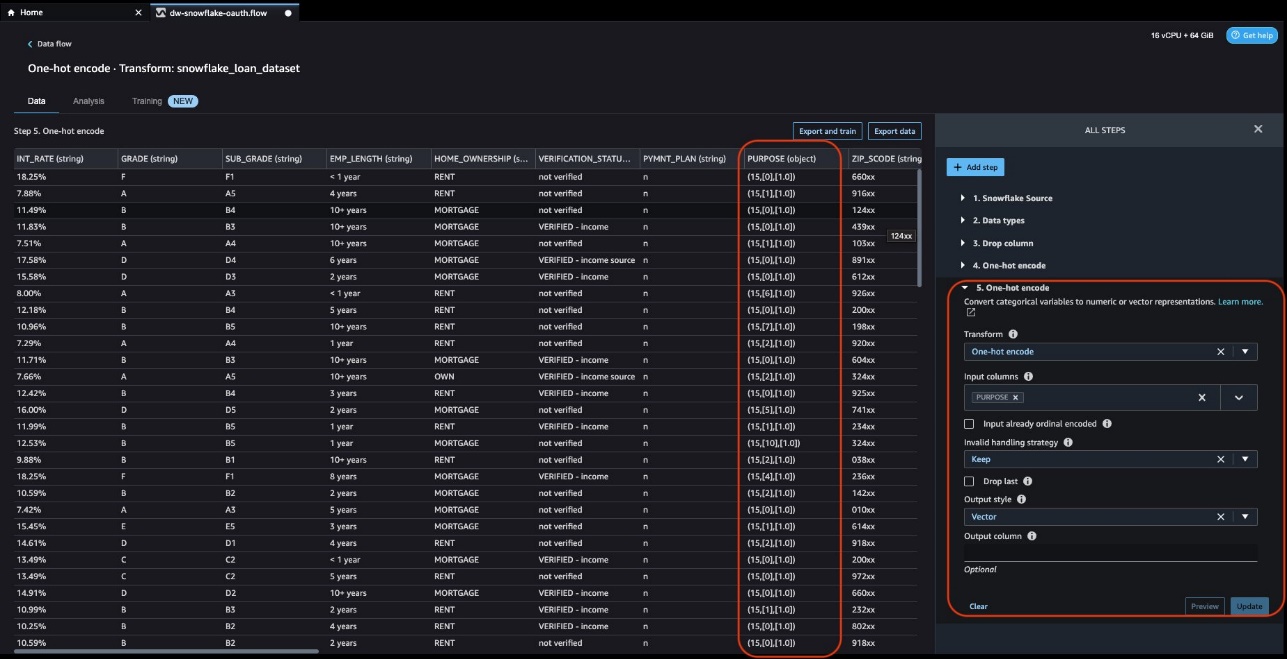

Enfin, le PURPOSE colonne a plusieurs valeurs possibles. Pour ces données, nous utilisons également une approche d'encodage à chaud, mais nous définissons la sortie sur un vecteur plutôt que sur des colonnes.

- Pour Transformer, choisissez Encodage à chaud.

- Pour Colonne d'entrée, choisissez

PURPOSE. - Pour Style de sortie, choisissez vecteur.

- Pour Colonne de sortie, nous appelons cette colonne

PURPOSE_VCTR.

Cela garde l'original PURPOSE colonne, si nous décidons de l'utiliser plus tard.

- Laissez tous les autres paramètres par défaut, puis choisissez Aperçu et les Ajouter.

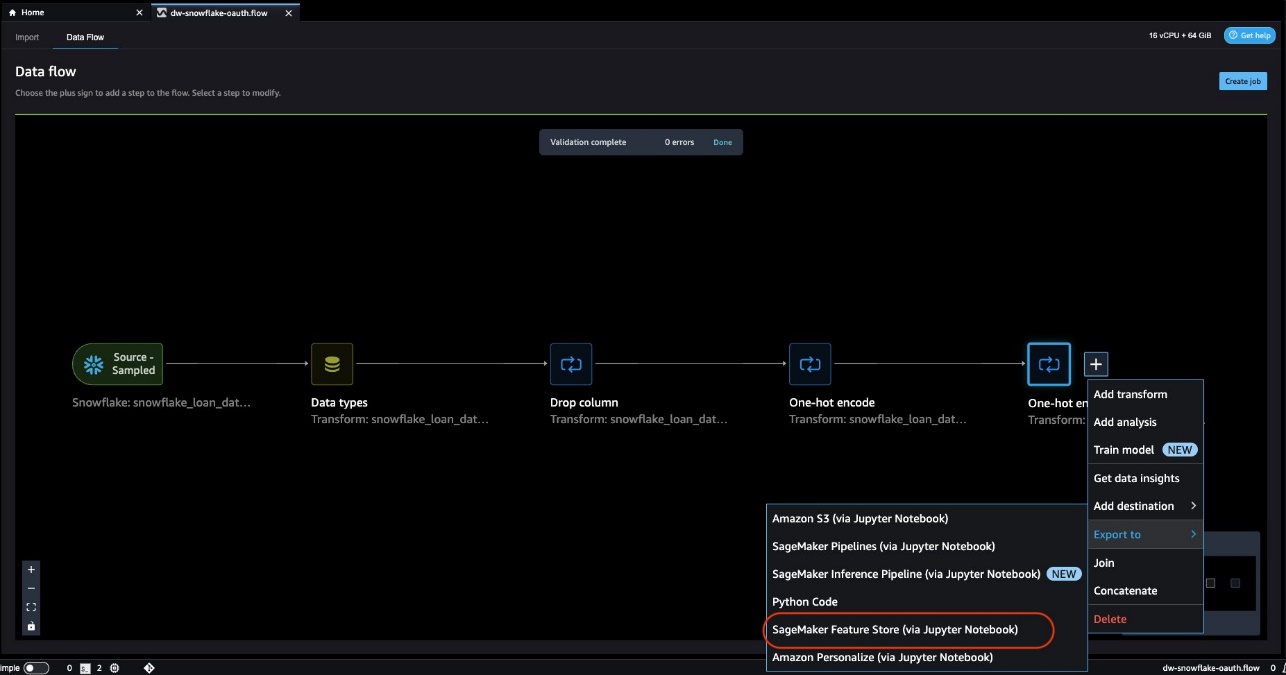

Exporter le flux de données

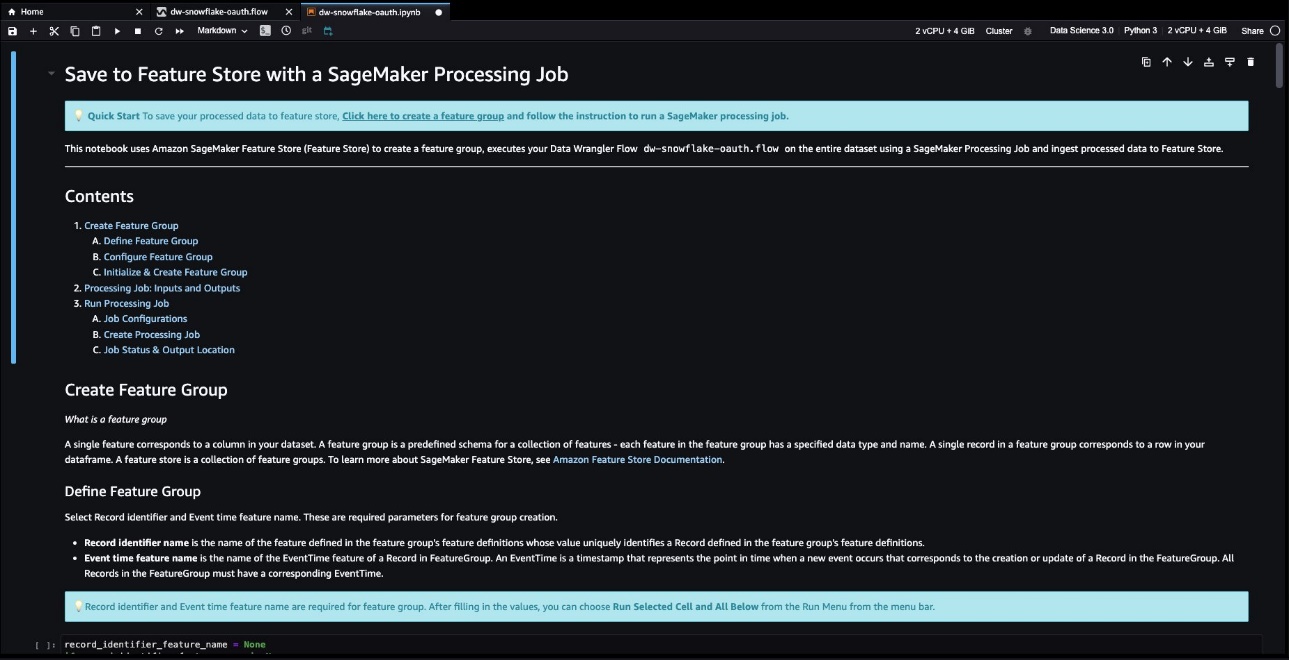

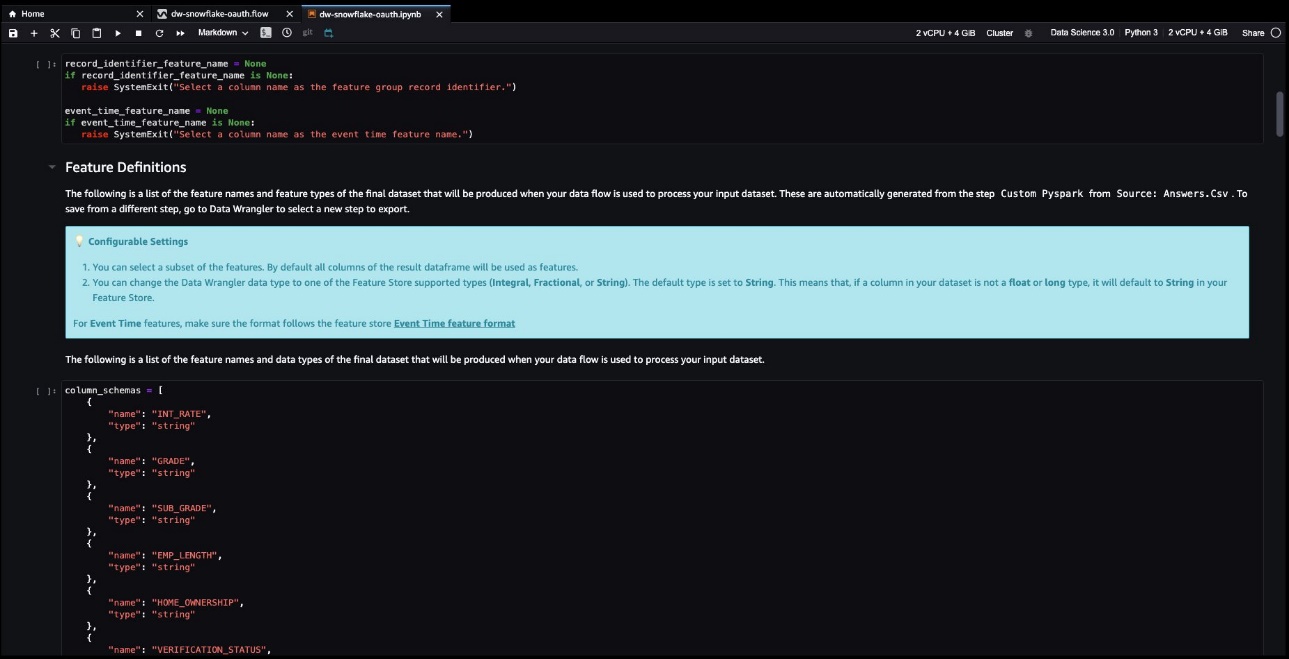

Enfin, nous exportons tout ce flux de données vers un magasin de fonctionnalités avec un travail de traitement SageMaker, qui crée un bloc-notes Jupyter avec le code pré-rempli.

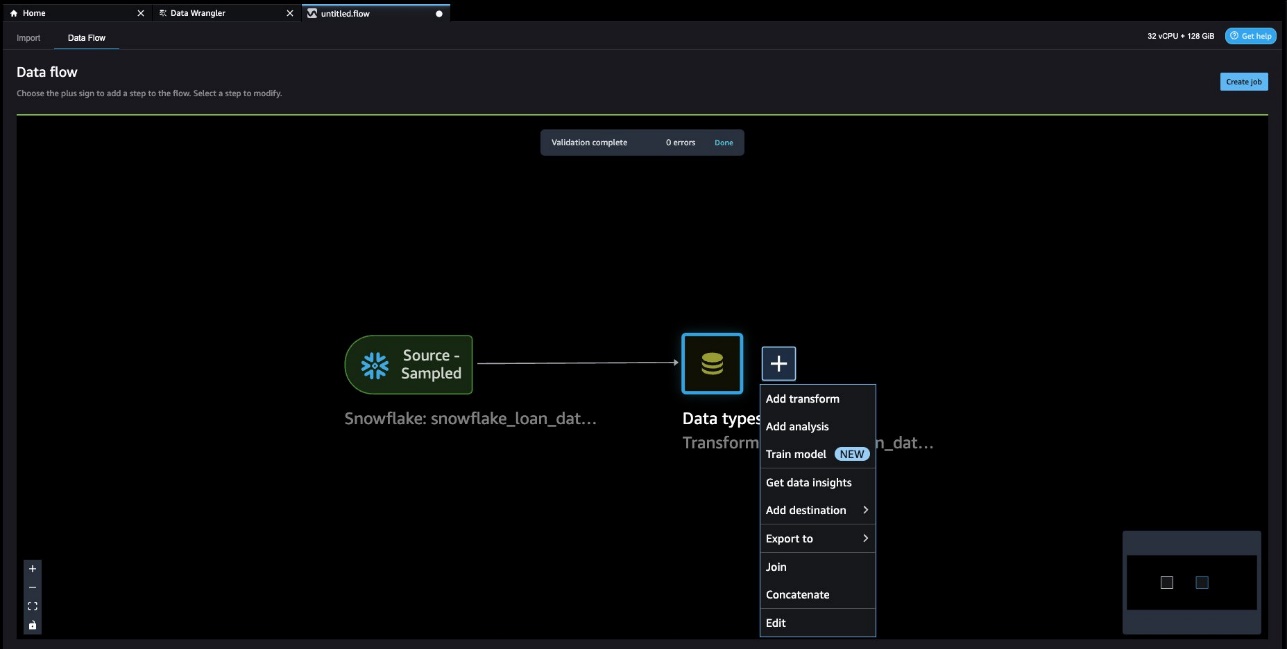

- Sur la page du flux de données , choisissez le signe plus et Exporter vers.

- Choisissez où exporter. Pour notre cas d'utilisation, nous choisissons Magasin de fonctionnalités SageMaker.

Le bloc-notes exporté est maintenant prêt à être exécuté.

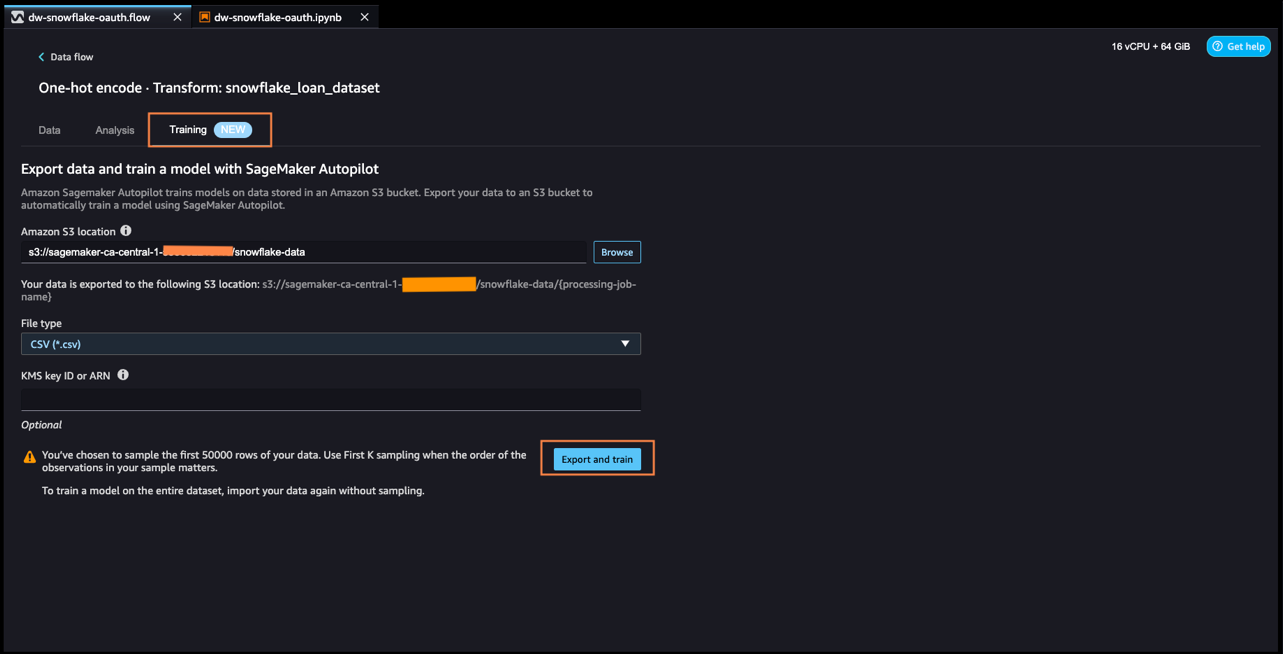

Exporter des données et former un modèle avec Autopilot

Nous pouvons maintenant former le modèle en utilisant Pilote automatique Amazon SageMaker.

- Sur la page de flux de données, choisissez le Formation languette.

- Pour Emplacement Amazon S3, entrez un emplacement pour les données à enregistrer.

- Selectionnez Exporter et former.

- Spécifiez les paramètres dans le Cible et fonctionnalités, Méthode de formation, Déploiement et paramètres avancéset une Examiner et créer sections.

- Selectionnez Créer une expérience pour trouver le meilleur modèle pour votre problème.

Nettoyer

Si votre travail avec Data Wrangler est terminé, arrêtez votre instance Data Wrangler pour éviter des frais supplémentaires.

Conclusion

Dans cet article, nous avons démontré la connexion Data Wrangler vers Snowflake en utilisant OAuth, transformer et analyser un ensemble de données, et enfin l'exporter vers le flux de données afin qu'il puisse être utilisé dans un bloc-notes Jupyter. Plus particulièrement, nous avons créé un pipeline pour la préparation des données sans avoir à écrire de code du tout.

Pour démarrer avec Data Wrangler, consultez Préparer les données de ML avec Amazon SageMaker Data Wrangler.

À propos des auteurs

Ajjay Govindaram est architecte de solutions senior chez AWS. Il travaille avec des clients stratégiques qui utilisent l'IA/ML pour résoudre des problèmes commerciaux complexes. Son expérience consiste à fournir une direction technique ainsi qu'une assistance à la conception pour les déploiements d'applications AI/ML à petite et grande échelle. Ses connaissances vont de l'architecture d'application au big data, à l'analyse et à l'apprentissage automatique. Il aime écouter de la musique tout en se reposant, profiter du plein air et passer du temps avec ses proches.

Ajjay Govindaram est architecte de solutions senior chez AWS. Il travaille avec des clients stratégiques qui utilisent l'IA/ML pour résoudre des problèmes commerciaux complexes. Son expérience consiste à fournir une direction technique ainsi qu'une assistance à la conception pour les déploiements d'applications AI/ML à petite et grande échelle. Ses connaissances vont de l'architecture d'application au big data, à l'analyse et à l'apprentissage automatique. Il aime écouter de la musique tout en se reposant, profiter du plein air et passer du temps avec ses proches.

Bosco Albuquerque est un architecte de solutions partenaire principal chez AWS et possède plus de 20 ans d'expérience dans le travail avec des produits de base de données et d'analyse de fournisseurs de bases de données d'entreprise et de fournisseurs de cloud. Il a aidé de grandes entreprises technologiques à concevoir des solutions d'analyse de données et a dirigé des équipes d'ingénieurs dans la conception et la mise en œuvre de plates-formes d'analyse de données et de produits de données.

Bosco Albuquerque est un architecte de solutions partenaire principal chez AWS et possède plus de 20 ans d'expérience dans le travail avec des produits de base de données et d'analyse de fournisseurs de bases de données d'entreprise et de fournisseurs de cloud. Il a aidé de grandes entreprises technologiques à concevoir des solutions d'analyse de données et a dirigé des équipes d'ingénieurs dans la conception et la mise en œuvre de plates-formes d'analyse de données et de produits de données.

Matt Marzillo est un ingénieur commercial partenaire senior chez Snowflake. Il a 10 ans d'expérience dans les domaines de la science des données et de l'apprentissage automatique, à la fois dans le conseil et auprès d'organisations industrielles. Matt a de l'expérience dans le développement et le déploiement de modèles d'IA et de ML dans de nombreuses organisations différentes dans des domaines tels que le marketing, les ventes, les opérations, la clinique et la finance, ainsi que dans le conseil dans des rôles consultatifs.

Matt Marzillo est un ingénieur commercial partenaire senior chez Snowflake. Il a 10 ans d'expérience dans les domaines de la science des données et de l'apprentissage automatique, à la fois dans le conseil et auprès d'organisations industrielles. Matt a de l'expérience dans le développement et le déploiement de modèles d'IA et de ML dans de nombreuses organisations différentes dans des domaines tels que le marketing, les ventes, les opérations, la clinique et la finance, ainsi que dans le conseil dans des rôles consultatifs.

Huong Nguyen est chef de produit pour Amazon SageMaker Data Wrangler chez AWS. Elle a 15 ans d'expérience dans la création de produits axés sur le client et axés sur les données pour les espaces d'entreprise et de consommation. Dans ses temps libres, elle aime les livres audio, le jardinage, la randonnée et passer du temps avec sa famille et ses amis.

Huong Nguyen est chef de produit pour Amazon SageMaker Data Wrangler chez AWS. Elle a 15 ans d'expérience dans la création de produits axés sur le client et axés sur les données pour les espaces d'entreprise et de consommation. Dans ses temps libres, elle aime les livres audio, le jardinage, la randonnée et passer du temps avec sa famille et ses amis.

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- Platoblockchain. Intelligence métaverse Web3. Connaissance Amplifiée. Accéder ici.

- La source: https://aws.amazon.com/blogs/machine-learning/access-snowflake-data-using-oauth-based-authentication-in-amazon-sagemaker-data-wrangler/

- :est

- $UP

- 000

- 10

- 100

- 15 ans

- 20 ans

- 7

- 8

- 9

- a

- Capable

- A Propos

- accès

- Accès aux données

- accès

- Compte

- à travers

- Ad

- ajout

- Supplémentaire

- admin

- avancer

- Avancée

- du conseil

- Après

- AI

- AI / ML

- Tous

- Amazon

- Amazon Sage Maker

- Gestionnaire de données Amazon SageMaker

- Analyses

- selon une analyse de l’Université de Princeton

- analytique

- il analyse

- l'analyse

- et les

- Une autre

- api

- appli

- apparaître

- Application

- Appliquer

- Application

- une approche

- applications

- architecture

- SONT

- domaines

- AS

- Assistance

- associé

- At

- joindre

- public

- acoustique

- authentifier

- Authentification

- autorisation

- automatiser

- automatiquement

- AWS

- Azure

- BE

- car

- before

- commencer

- LES MEILLEURS

- Big

- Big Data

- corps

- Livres

- intégré

- la performance des entreprises

- by

- Appelez-nous

- appelé

- CAN

- capacités

- maisons

- CHAT

- Modifications

- le choix

- Selectionnez

- client

- Infos sur les

- le cloud

- code

- Colonne

- Colonnes

- Sociétés

- complet

- complexe

- concept

- configuration

- NOUS CONTACTER

- Connecter les

- connexion

- Console

- consulting

- consommateur

- contenu

- pourriez

- couverture

- couvert

- engendrent

- créée

- crée des

- La création

- Lettres de créance

- Clients

- données

- l'analyse des données

- Analyse de Donnée

- Plateforme de données

- Préparation des données

- science des données

- Data Scientist

- data-driven

- Base de données

- décider

- Réglage par défaut

- démontré

- déployer

- déploiements

- Conception

- conception

- détail

- détails

- développement

- différent

- direction

- directement

- distinct

- Documentation

- Ne fait pas

- domaine

- Ne pas

- down

- download

- Goutte

- chacun

- éditeur

- effet

- non plus

- permettre

- ingénieur

- ENGINEERING

- Entrer

- Entreprise

- Environment

- exemple

- existant

- d'experience

- l'expérience

- L'analyse exploratoire des données

- Exporter

- externe

- FAIL

- famille

- Fonctionnalité

- Fonctionnalités:

- Frais

- few

- champ

- Des champs

- Déposez votre dernière attestation

- finalement

- finance

- Trouvez

- flotteur

- flux

- Abonnement

- Pour

- le format

- La fréquence

- fréquemment

- amis

- De

- Général

- obtenez

- donne

- subvention

- plus grand

- Guides

- Vous avez

- ayant

- aider

- a aidé

- ici

- Accueil

- Comment

- How To

- HTML

- http

- HTTPS

- ID

- identifiant

- identifier

- Identite

- Idle

- la mise en œuvre

- importer

- importance

- in

- inclut

- Y compris

- à tort

- industrie

- d'information

- contribution

- perspicacité

- idées.

- Des instructions

- l'intégration

- intégrations

- Interfaces

- intuitif

- impliqué

- IT

- Emploi

- Emplois

- jpg

- ACTIVITES

- spécialisées

- gros

- grande échelle

- leader

- apprentissage

- LED

- se trouve

- vos produits

- durée de vie

- comme

- Probable

- Liste

- Écoute

- charge

- charges

- emplacement

- Style

- recherchez-

- aimé

- click

- machine learning

- LES PLANTES

- a prendre une

- FAIT DU

- Fabrication

- manager

- de nombreuses

- Stratégie

- message

- pourrait

- Minutes

- manquant

- ML

- modèle

- numériques jumeaux (digital twin models)

- modifier

- PLUS

- (en fait, presque toutes)

- plusieurs

- Musique

- prénom

- noms

- Nature

- Navigation

- Besoin

- besoin

- Besoins

- Nouveauté

- next

- notamment

- cahier

- nombre

- oauth

- objets

- of

- OKTA

- on

- ONE

- en ligne

- Opérations

- Option

- organisations

- original

- Autre

- autrement

- l'extérieur

- sortie

- propre

- page

- paires

- pain

- les partenaires

- Mot de Passe

- Effectuer

- autorisations

- personnel

- pipeline

- plateforme

- Plateformes

- Platon

- Intelligence des données Platon

- PlatonDonnées

- plus

- politiques

- pop-up

- possible

- Post

- préféré

- Préparer

- conditions préalables

- Aperçu

- précédent

- Problème

- d'ouvrabilité

- procédures

- processus

- traitement

- Produit

- Produits

- Profil

- Programmation

- correctement

- fournir

- à condition de

- de voiture.

- fournisseurs

- fournit

- aportando

- qualité

- plutôt

- solutions

- recommander

- réorienter

- réduire

- région

- vous inscrire

- enregistrement

- Inscription

- relancer

- rapport

- représenté

- exigent

- ceux

- REST

- résultat

- Résultats

- détail

- Rôle

- rôle

- Courir

- pour le running

- sagemaker

- vente

- ordonnancement

- Sciences

- Scientifique

- scientifiques

- portée

- secret

- Section

- les sections

- sécurité

- sélection

- supérieur

- Sensibilité

- set

- mise

- Paramétres

- plusieurs

- coquillage

- devrait

- montrer

- signer

- étapes

- unique

- So

- Solutions

- RÉSOUDRE

- quelques

- Identifier

- Sources

- espaces

- Dépenses

- j'ai commencé

- départs

- étapes

- Étapes

- storage

- Boutique

- stockée

- stockage

- Stratégique

- Chaîne

- studio

- réussi

- tel

- RÉSUMÉ

- Support

- Les soutiens

- TAG

- Prenez

- prend

- Target

- des campagnes marketing ciblées,

- tâches

- équipes

- Technique

- Technologie

- entreprises technologiques

- qui

- Le

- les informations

- leur

- Les

- Ces

- Avec

- fiable

- à

- jeton

- Tokens

- Train

- Transformer

- transformations

- transformer

- types

- sous

- comprendre

- expérience unique et authentique

- Mises à jour

- URL

- utilisé

- cas d'utilisation

- Utilisateur

- Interface utilisateur

- utilisateurs

- Plus-value

- Valeurs

- fournisseurs

- vérifier

- via

- Voir

- visible

- walkthrough

- avertissement

- Semaines

- WELL

- qui

- tout en

- WHO

- la totalité

- sera

- comprenant

- dans les

- sans

- activités principales

- workflows

- de travail

- vos contrats

- écrire

- écriture

- années

- Vous n'avez

- Votre

- zéphyrnet