Le fléau de la création malveillante de deepfakes s'est étendu bien au-delà du domaine des célébrités et des personnalités publiques, et un nouveau rapport sur l'imagerie intime non consensuelle (NCII) révèle que cette pratique ne fait que croître à mesure que les générateurs d'images évoluent et prolifèrent.

Le « déshabillage de l’IA » est en hausse, un rapport par la société d'analyse des médias sociaux Graphika, a déclaré vendredi, décrivant la pratique comme utilisant IA générative des outils affinés pour supprimer les vêtements des images téléchargées par les utilisateurs.

La communauté des jeux vidéo et du streaming Twitch a été aux prises avec le problème plus tôt cette année lorsque l'éminent diffuseur Brandon 'Atrioc' Ewing a accidentellement révélé qu'il avait regardé du porno deepfake généré par l'IA de streameuses féminines qu'il appelait ses amis, selon un rapport by Kotaku.

Ewing est revenu sur la plate-forme en mars, contrit et rendant compte des semaines de travail qu'il avait entrepris pour atténuer les dégâts qu'il avait causés. Mais l’incident a ouvert les vannes à toute une communauté en ligne.

Le rapport de Graphika montre que l'incident n'était qu'une goutte d'eau dans l'océan.

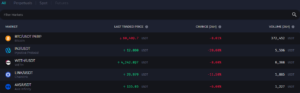

"En utilisant les données fournies par Meltwater, nous avons mesuré le nombre de commentaires et de publications sur Reddit et X contenant des liens de référence vers 34 sites Web et 52 chaînes Telegram fournissant des services NCII synthétiques", a écrit Santiago Lakatos, analyste du renseignement chez Graphika. "Ceux-ci ont totalisé 1,280 2022 en 32,100, contre plus de 2,408 XNUMX jusqu'à présent cette année, ce qui représente une augmentation de XNUMX XNUMX % en volume sur un an."

Graphika, basée à New York, affirme que l'explosion du NCII montre que les outils sont passés de forums de discussion de niche à une industrie artisanale.

"Ces modèles permettent à un plus grand nombre de fournisseurs de créer facilement et à moindre coût un NCII photoréaliste à grande échelle", a déclaré Graphika. "Sans ces fournisseurs, leurs clients devraient héberger, maintenir et exécuter leurs propres modèles de diffusion d'images personnalisés, un processus long et parfois coûteux."

Graphika prévient que la popularité croissante des outils de déshabillage IA pourrait conduire non seulement à de faux pornographique mais également le harcèlement, la sextorsion et la production de matériel pédopornographique (CSAM).

D'après le Graphika rapport, les développeurs d'outils de déshabillage de l'IA font de la publicité sur les réseaux sociaux pour diriger les utilisateurs potentiels vers leurs sites Web, leurs chats privés Telegram ou leurs serveurs Discord où les outils peuvent être trouvés.

"Certains prestataires sont manifestes dans leurs activités, déclarant qu'ils fournissent des services de 'déshabillage' et publiant des photos de personnes qui, selon eux, ont été 'déshabillées' comme preuve", a écrit Graphika. "D'autres sont moins explicites et se présentent comme des services d'art IA ou des galeries de photos Web3 tout en incluant des termes clés associés au NCII synthétique dans leurs profils et publications."

Alors que les IA de déshabillage se concentrent généralement sur les images, l'IA a également été utilisée pour créer vidéo deepfakes utilisant l'image de célébrités, y compris la personnalité de YouTube M. La bête et acteur emblématique d'Hollywood Tom Hanks.

Certains acteurs aiment Scarlett Johansson et acteur indien Anil Kapoor se tournent vers le système juridique pour lutter contre la menace persistante des deepfakes de l’IA. Pourtant, même si les artistes grand public peuvent attirer davantage l'attention des médias, animateurs pour adultes disent que leurs voix sont rarement entendues.

"C'est vraiment difficile", a déclaré Tanya Tate, interprète adulte légendaire et responsable des relations publiques de Star Factory. dit Décrypter plus tôt. "Si quelqu'un appartient au courant dominant, je suis sûr que c'est beaucoup plus facile."

Même sans l’essor de l’IA et de la technologie deepfake, Tate a expliqué que les réseaux sociaux regorgent déjà de faux comptes utilisant sa vraisemblance et son contenu. La stigmatisation constante à laquelle sont confrontées les travailleuses du sexe, les obligeant, elles et leurs fans, à rester dans l’ombre n’arrange pas les choses.

En octobre, l'Internet Watch Foundation (IWF), société de surveillance de l'Internet basée au Royaume-Uni, a noté dans un rapport distinct que plus de 20,254 XNUMX images de maltraitance d'enfants avaient été trouvées sur un seul forum du dark web en seulement un mois. L’IWF a averti que la pédopornographie générée par l’IA pourrait «submerger" l'Internet.

Grâce aux progrès de l’imagerie générative de l’IA, l’IWF prévient que deepfake la pornographie a progressé au point où faire la différence entre les images générées par l’IA et les images authentiques est devenu de plus en plus complexe, laissant les forces de l’ordre poursuivre des fantômes en ligne au lieu de véritables victimes d’abus.

"Il y a donc cette chose permanente selon laquelle vous ne pouvez pas savoir si les choses sont réelles ou non", a déclaré Dan Sexton, directeur technique de l'Internet Watch Foundation. Déchiffrert. "Les choses qui nous diront si les choses sont réelles ou non ne sont pas à 100 %, et par conséquent, vous ne pouvez pas non plus leur faire confiance."

Quant à Ewing, Kotaku a rapporté que le streamer était revenu en disant qu'il travaillait avec des journalistes, des technologues, des chercheurs et des femmes touchées par l'incident depuis sa transgression en Janvier. Ewing a également déclaré avoir envoyé des fonds au cabinet d'avocats de Ryan Morrison, basé à Los Angeles, Morrison Cooper, pour fournir des services juridiques à toute femme sur Twitch qui avait besoin de son aide pour émettre des avis de retrait aux sites publiant des images d'elles.

Ewing a ajouté qu'il avait reçu des recherches sur la profondeur du problème des deepfakes de la part de la mystérieuse chercheuse Geneviève Oh.

"J'ai essayé de trouver les 'points positifs' dans la lutte contre ce type de contenu", a déclaré Ewing.

Édité par Ryan Ozawa.

Restez au courant des actualités cryptographiques, recevez des mises à jour quotidiennes dans votre boîte de réception.

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- PlatoData.Network Ai générative verticale. Autonomisez-vous. Accéder ici.

- PlatoAiStream. Intelligence Web3. Connaissance Amplifiée. Accéder ici.

- PlatonESG. Carbone, Technologie propre, Énergie, Environnement, Solaire, La gestion des déchets. Accéder ici.

- PlatoHealth. Veille biotechnologique et essais cliniques. Accéder ici.

- La source: https://decrypt.co/209181/ai-undressing-deepfake-nude-services-skyrocket-in-popularity