Pilote automatique Amazon SageMaker vous aide à compléter un flux de travail d'apprentissage automatique (ML) de bout en bout en automatisant les étapes d'ingénierie des fonctionnalités, de formation, de réglage et de déploiement d'un modèle ML pour l'inférence. Vous fournissez à SageMaker Autopilot un ensemble de données tabulaires et un attribut cible à prédire. Ensuite, SageMaker Autopilot explore automatiquement vos données, forme, règle, classe et trouve le meilleur modèle. Enfin, vous pouvez déployer ce modèle en production pour l'inférence en un seul clic.

Quoi de neuf?

La fonctionnalité nouvellement lancée, Rapports de qualité du modèle SageMaker Autopilot, signale désormais les métriques de votre modèle afin d'offrir une meilleure visibilité sur les performances de votre modèle pour les problèmes de régression et de classification. Vous pouvez tirer parti de ces métriques pour recueillir plus d'informations sur le meilleur modèle dans le classement des modèles.

Ces métriques et rapports qui sont disponibles dans un nouvel onglet « Performance » sous les « Détails du modèle » du meilleur modèle incluent des matrices de confusion, une aire sous la courbe des caractéristiques de fonctionnement du récepteur (AUC-ROC) et une aire sous la courbe de précision-rappel. (AUC-PR). Ces métriques vous aident à comprendre les faux positifs/faux négatifs (FP/FN), les compromis entre vrais positifs (TP) et faux positifs (FP), ainsi que les compromis entre précision et rappel pour évaluer les meilleures caractéristiques de performance du modèle.

Exécution de l'expérience SageMaker Autopilot

L'ensemble de données

Nous utilisons Ensemble de données de marketing bancaire de l'UCI pour démontrer les rapports de qualité du modèle SageMaker Autopilot. Ces données contiennent des attributs client, tels que l'âge, le type d'emploi, l'état civil et d'autres que nous utiliserons pour prédire si le client ouvrira un compte auprès de la banque. L'ensemble de données fait référence à ce compte en tant que dépôt à terme. Cela fait de notre cas un problème de classification binaire - la prédiction sera soit "oui" soit "non". SageMaker Autopilot générera plusieurs modèles en notre nom pour prédire au mieux les clients potentiels. Ensuite, nous examinerons le rapport de qualité du modèle pour le pilote automatique SageMaker. meilleur modèle.

Pré-requis

Pour lancer une expérience SageMaker Autopilot, vous devez d'abord placer vos données dans un Service de stockage simple Amazon (Amazon S3). Spécifiez le compartiment et le préfixe que vous souhaitez utiliser pour la formation. Assurez-vous que le compartiment se trouve dans la même région que l'expérience SageMaker Autopilot. Vous devez également vous assurer que le pilote automatique du rôle Identity and Access Management (IAM) dispose des autorisations nécessaires pour accéder aux données dans Amazon S3.

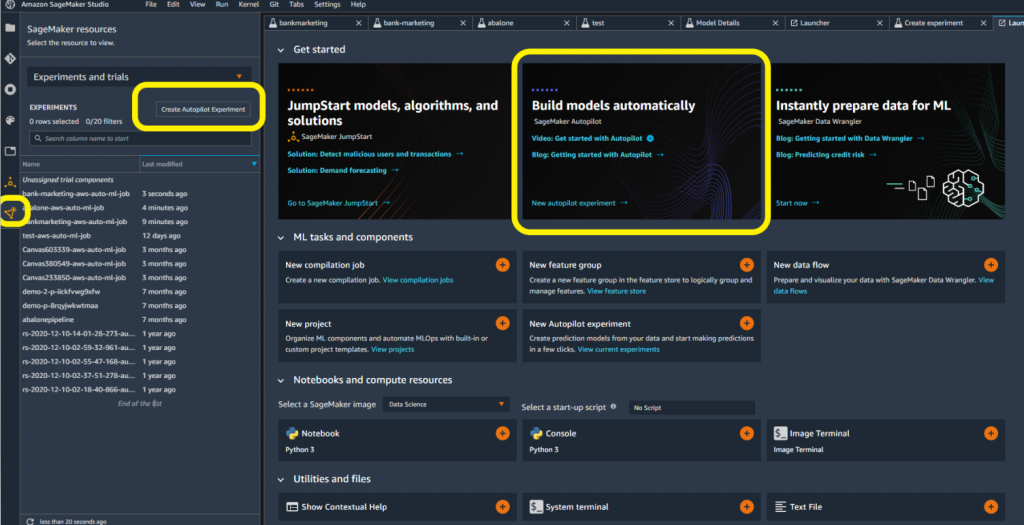

Création de l'expérience

Vous disposez de plusieurs options pour créer une expérience SageMaker Autopilot dans SageMaker Studio. En ouvrant un nouveau lanceur, vous pourrez peut-être accéder directement à SageMaker Autopilot. Si ce n'est pas le cas, vous pouvez sélectionner l'icône des ressources SageMaker sur le côté gauche. Ensuite, vous pouvez sélectionner Expériences et essais Dans le menu déroulant.

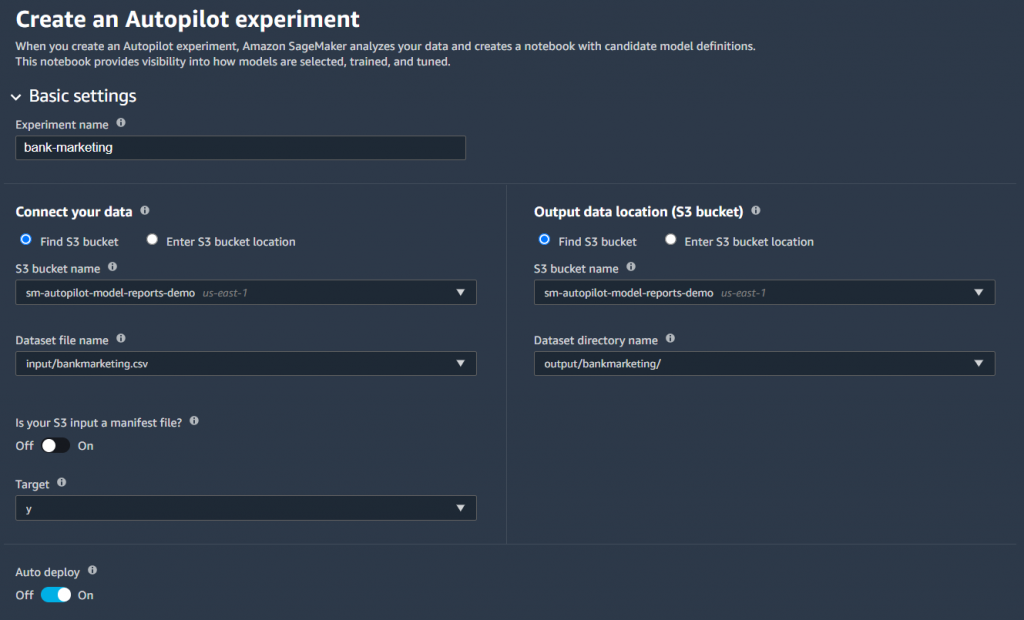

- Donnez un nom à votre expérience.

- Connectez-vous à votre source de données en sélectionnant le compartiment Amazon S3 et le nom du fichier.

- Choisissez l'emplacement des données de sortie dans Amazon S3.

- Sélectionnez la colonne cible pour votre ensemble de données. Dans ce cas, nous ciblons la colonne "y" pour indiquer oui/non.

- Si vous le souhaitez, indiquez un nom de point de terminaison si vous souhaitez que SageMaker Autopilot déploie automatiquement un point de terminaison de modèle.

- Laissez tous les autres paramètres avancés par défaut et sélectionnez Créer une expérience.

Une fois l'expérience terminée, vous pouvez voir les résultats dans SageMaker Studio. SageMaker Autopilot présentera le meilleur modèle parmi les différents modèles qu'il forme. Vous pouvez afficher les détails et les résultats de différents essais, mais nous utiliserons le meilleur modèle pour démontrer l'utilisation des rapports sur la qualité des modèles.

- Sélectionnez le modèle et cliquez avec le bouton droit pour Ouvrir dans les détails du modèle.

- Dans les détails du modèle, sélectionnez le Performance languette. Cela montre les métriques du modèle à travers des visualisations et des tracés.

- Sous Performance, sélectionnez Télécharger les rapports de performances au format PDF.

Interprétation du rapport de qualité du modèle SageMaker Autopilot

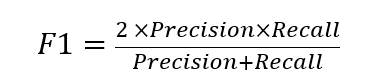

Le rapport sur la qualité du modèle résume les détails de la tâche et du modèle SageMaker Autopilot. Nous nous concentrerons sur le format PDF du rapport, mais vous pouvez également accéder aux résultats au format JSON. Étant donné que SageMaker Autopilot a déterminé que notre ensemble de données était un problème de classification binaire, SageMaker Autopilot visait à maximiser le Indicateur de qualité F1 pour trouver le meilleur modèle. SageMaker Autopilot le choisit par défaut. Cependant, il est possible de choisir d'autres mesures objectives, telles que la précision et l'AUC. Le score F1 de notre modèle est de 0.61. Pour interpréter un score F1, il est utile de comprendre d'abord une matrice de confusion, qui est expliquée par le rapport de qualité du modèle dans le PDF généré.

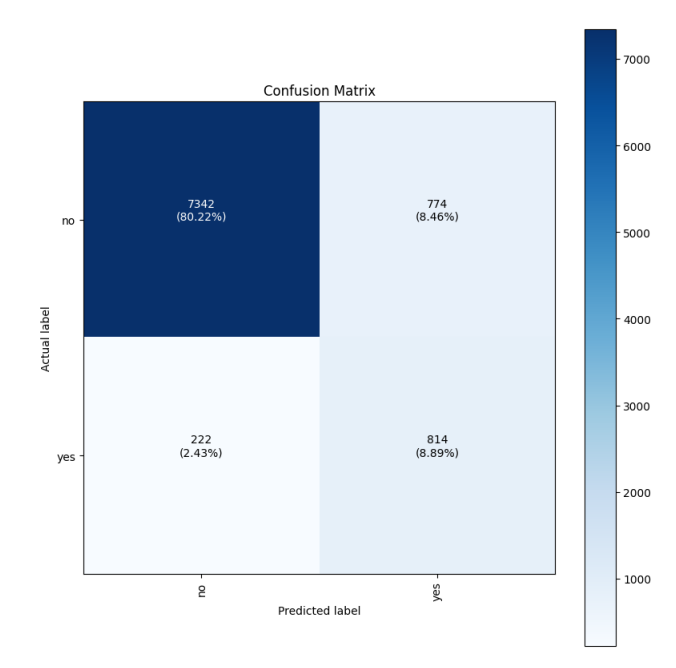

Matrice de confusion

Une matrice de confusion aide à visualiser les performances du modèle en comparant différentes classes et étiquettes. L'expérience SageMaker Autopilot a créé une matrice de confusion qui affiche les libellés réels sous forme de lignes et les libellés prédicats sous forme de colonnes dans le rapport sur la qualité du modèle. La case en haut à gauche montre les clients qui n'ont pas ouvert de compte auprès de la banque qui ont été correctement prédits comme « non » par le modèle. Ceux-ci sont vrais négatifs (TN). La case en bas à droite montre les clients qui ont ouvert un compte auprès de la banque qui ont été correctement prédits comme « oui » par le modèle. Ceux-ci sont vrais positifs (PT).

Le coin inférieur gauche indique le nombre de faux négatifs (FN). Le modèle a prédit que le client n'ouvrirait pas de compte, mais le client l'a fait. Le coin supérieur droit affiche le nombre de faux positifs (FP). Le modèle a prédit que le client ouvrirait un compte, mais le client l'a fait ne sauraient le faire réellement.

Métriques du rapport sur la qualité du modèle

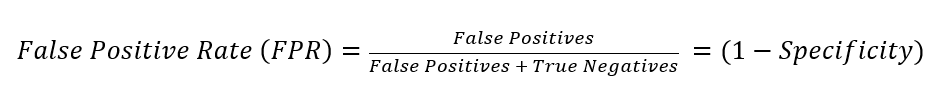

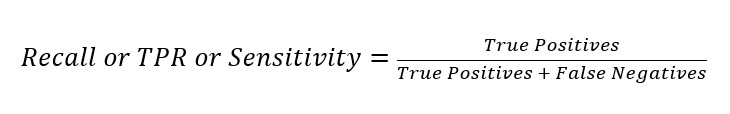

Le rapport sur la qualité du modèle explique comment calculer le taux de faux positifs (FPR) et par taux de vrais positifs (TPR).

Rappel ou taux de faux positifs (FPR) mesure la proportion de vrais négatifs qui ont été faussement prédits comme l'ouverture d'un compte (positifs). La plage est de 0 à 1, et une valeur plus petite indique une meilleure précision prédictive.

Notez que le FPR est également exprimé en 1-spécificité, où la spécificité ou le taux de vrais négatifs (TNR) est la proportion de TN correctement identifiés comme n'ouvrant pas de compte (négatifs).

Rappel/sensibilité/taux de vrais positifs (TPR) mesure la fraction des positifs réels qui ont été prédits comme l'ouverture d'un compte. La plage est également de 0 à 1, et une valeur plus grande indique une meilleure précision prédictive. Ceci est également connu sous le nom de rappel/sensibilité. Cette mesure exprime la capacité à trouver toutes les instances pertinentes dans un ensemble de données.

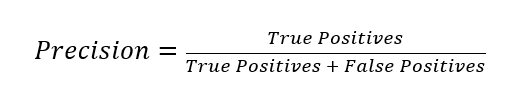

La précision mesure la fraction de positifs réels qui ont été prédits comme positifs sur tous ceux qui ont été prédits comme positifs. La plage est de 0 à 1, et une valeur plus grande indique une meilleure précision. La précision exprime la proportion de points de données qui, selon notre modèle, étaient pertinents et qui l'étaient réellement. La précision est une bonne mesure à prendre en compte, en particulier lorsque les coûts de FP sont élevés - par exemple avec la détection de spam par e-mail.

Notre modèle montre une précision de 0.53 et un rappel de 0.72.

Score F1 illustre notre métrique cible, qui est la moyenne harmonique de la précision et du rappel. Parce que notre ensemble de données est déséquilibré en faveur de nombreuses prédictions "non", F1 prend en compte à la fois FP et FN pour donner le même poids à la précision et au rappel.

Le rapport explique comment interpréter ces mesures. Cela peut vous aider si vous n'êtes pas familier avec ces termes. Dans notre exemple, la précision et le rappel sont des mesures importantes pour un problème de classification binaire, car ils sont utilisés pour calculer le score F1. Le rapport explique qu'un score F1 peut varier entre 0 et 1. La meilleure performance possible sera notée 1, tandis que 0 indiquera la pire. Rappelons que le score F1 de notre modèle est de 0.61.

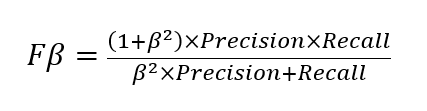

Score Fβ est la moyenne harmonique pondérée de la précision et du rappel. De plus, le score F1 est le même que Fβ avec β=1. Le rapport fournit le score Fβ du classificateur, où β prend 0.5, 1 et 2.

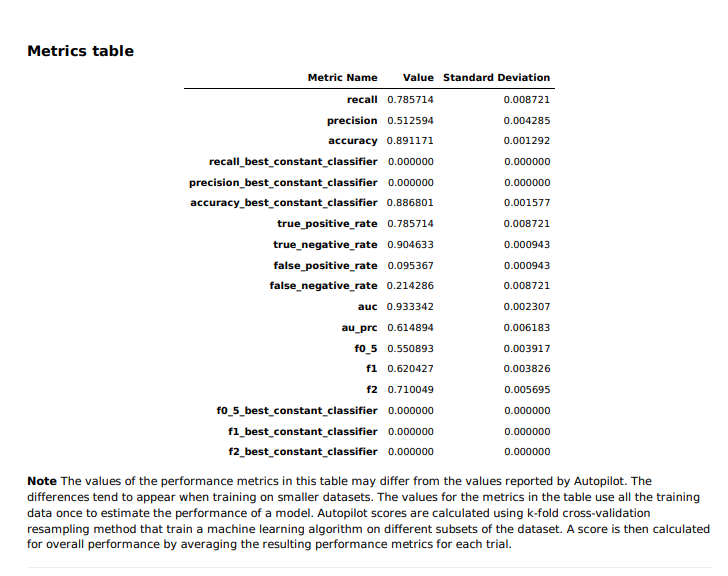

Tableau des mesures

Selon le problème, vous constaterez peut-être que SageMaker Autopilot maximise une autre mesure, telle que la précision, pour un problème de classification à plusieurs classes. Quel que soit le type de problème, les rapports sur la qualité des modèles produisent un tableau qui résume les métriques de votre modèle disponibles à la fois en ligne et dans le rapport PDF. Vous pouvez en savoir plus sur le tableau des métriques dans le Documentation.

Le meilleur classificateur constant - un classificateur qui sert de référence simple à comparer à d'autres classificateurs plus complexes - prédit toujours une étiquette de majorité constante fournie par l'utilisateur. Dans notre cas, un modèle « constant » prédirait « non », car il s'agit de la classe la plus fréquente et considérée comme une étiquette négative. Les métriques des modèles de classifieur entraînés (tels que f1, f2 ou rappel) peuvent être comparées à celles du classifieur constant, c'est-à-dire la ligne de base. Cela garantit que le modèle formé fonctionne mieux que le classifieur constant. Les scores Fβ (f0_5, f1 et f2, où β prend les valeurs de 0.5, 1 et 2 respectivement) sont la moyenne harmonique pondérée de la précision et du rappel. Celui-ci atteint sa valeur optimale à 1 et sa pire valeur à 0.

Dans notre cas, le meilleur classifieur constant prédit toujours « non ». Par conséquent, la précision est élevée à 0.89, mais les scores de rappel, de précision et Fβ sont de 0. Si l'ensemble de données est parfaitement équilibré lorsqu'il n'y a pas de classe majoritaire ou minoritaire, nous aurions vu des possibilités beaucoup plus intéressantes pour la précision, le rappel, et les scores Fβ du classificateur constant.

De plus, vous pouvez afficher ces résultats au format JSON, comme illustré dans l'exemple suivant. Vous pouvez accéder aux fichiers PDF et JSON via l'interface utilisateur, ainsi que SDK Amazon SageMaker Python en utilisant l'élément S3OutputPath dans OutputDataConfig structurer dans le Créer une tâche AutoML/DécrireAutoMLJob Réponse de l'API.

{ "version" : 0.0, "dataset" : { "item_count" : 9152, "evaluation_time" : "2022-03-16T20:49:18.661Z" }, "binary_classification_metrics" : { "confusion_matrix" : { "no" : { "no" : 7468, "yes" : 648 }, "yes" : { "no" : 295, "yes" : 741 } }, "recall" : { "value" : 0.7152509652509652, "standard_deviation" : 0.00439996600081394 }, "precision" : { "value" : 0.5334773218142549, "standard_deviation" : 0.007335840278445563 }, "accuracy" : { "value" : 0.8969624125874126, "standard_deviation" : 0.0011703516093899595 }, "recall_best_constant_classifier" : { "value" : 0.0, "standard_deviation" : 0.0 }, "precision_best_constant_classifier" : { "value" : 0.0, "standard_deviation" : 0.0 }, "accuracy_best_constant_classifier" : { "value" : 0.8868006993006993, "standard_deviation" : 0.0016707401772078998 }, "true_positive_rate" : { "value" : 0.7152509652509652, "standard_deviation" : 0.00439996600081394 }, "true_negative_rate" : { "value" : 0.9201577131591917, "standard_deviation" : 0.0010233756436643213 }, "false_positive_rate" : { "value" : 0.07984228684080828, "standard_deviation" : 0.0010233756436643403 }, "false_negative_rate" : { "value" : 0.2847490347490348, "standard_deviation" : 0.004399966000813983 },

………………….

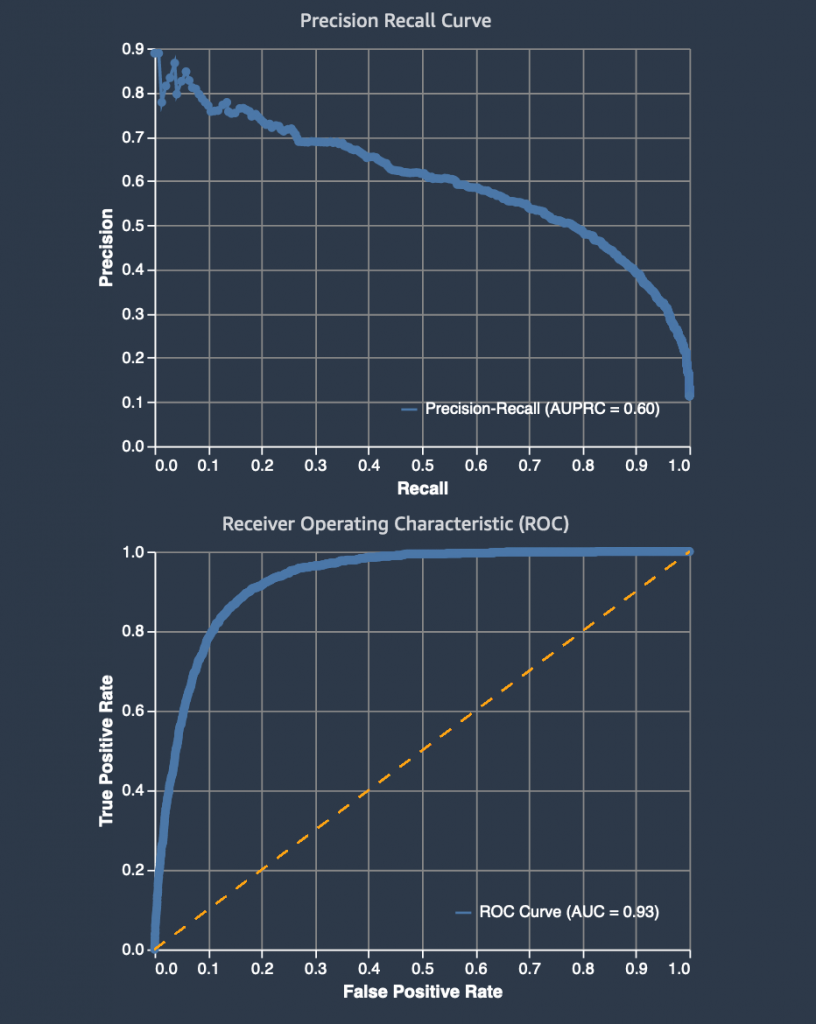

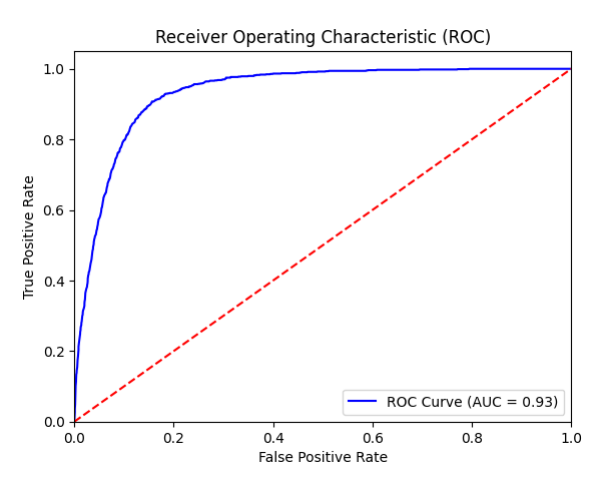

ROC et ASC

Selon le type de problème, vous pouvez avoir des seuils différents pour ce qui est acceptable en tant que FPR. Par exemple, si vous essayez de prédire si un client ouvrira un compte, il peut être plus acceptable pour l'entreprise d'avoir un taux de FP plus élevé. Il peut être plus risqué de ne pas proposer d'offres à des clients à qui on a mal prédit "non", plutôt que de proposer à des clients à qui on a mal prédit "oui". Changer ces seuils pour produire différents FPR nécessite de créer de nouvelles matrices de confusion.

Les algorithmes de classification renvoient des valeurs continues appelées probabilités de prédiction. Ces probabilités doivent être transformées en une valeur binaire (pour la classification binaire). Dans les problèmes de classification binaire, un seuil (ou seuil de décision) est une valeur qui divise les probabilités en une simple décision binaire. Pour les probabilités projetées normalisées comprises entre 0 et 1, le seuil est défini sur 0.5 par défaut.

Pour les modèles de classification binaire, une métrique d'évaluation utile est l'aire sous la courbe ROC (Receiver Operating Characteristic). Le rapport sur la qualité du modèle comprend un graphique ROC avec le taux de TP comme axe des y et le FPR comme axe des x. La zone sous la caractéristique de fonctionnement du récepteur (AUC-ROC) représente le compromis entre les TPR et les FPR.

Vous créez une courbe ROC en prenant un prédicteur de classification binaire, qui utilise une valeur de seuil, et en attribuant des étiquettes avec des probabilités de prédiction. Lorsque vous faites varier le seuil d'un modèle, vous couvrez les deux extrêmes. Lorsque le TPR et le FPR sont tous les deux 0, cela implique que tout est étiqueté "non", et lorsque le TPR et le FPR sont 1, cela implique que tout est étiqueté "oui".

Un prédicteur aléatoire qui étiquette "Oui" la moitié du temps et "Non" l'autre moitié du temps aurait un ROC qui est une ligne diagonale droite (ligne pointillée rouge). Cette ligne coupe le carré unité en deux triangles de taille égale. Par conséquent, l'aire sous la courbe est de 0.5. Une valeur AUC-ROC de 0.5 signifierait que votre prédicteur n'était pas meilleur pour faire la distinction entre les deux classes que de deviner au hasard si un client ouvrirait un compte ou non. Plus la valeur AUC-ROC est proche de 1.0, meilleures sont ses prédictions. Une valeur inférieure à 0.5 indique que nous pourrions en fait faire en sorte que notre modèle produise de meilleures prédictions en inversant la réponse qu'il nous donne. Pour notre meilleur modèle, l'ASC est de 0.93.

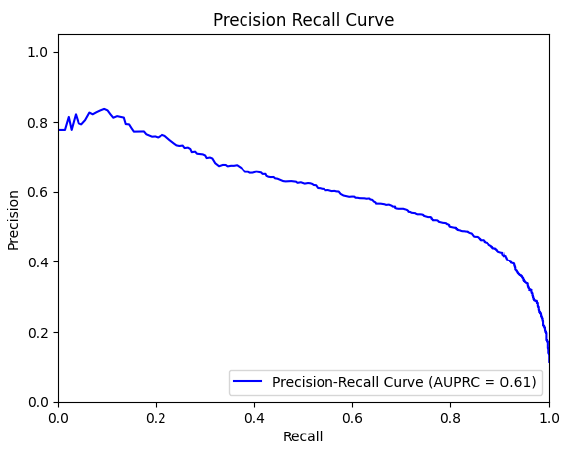

Courbe de rappel de précision

Le rapport sur la qualité du modèle a également créé une courbe de rappel de précision (PR) pour tracer la précision (axe y) et le rappel (axe x) pour différents seuils, un peu comme la courbe ROC. Les courbes PR, souvent utilisées dans la recherche d'informations, sont une alternative aux courbes ROC pour les problèmes de classification avec un grand biais dans la distribution des classes.

Pour ces ensembles de données déséquilibrés en classe, les courbes PR deviennent particulièrement utiles lorsque la classe positive minoritaire est plus intéressante que la classe négative majoritaire. Rappelons que notre modèle affiche une précision de 0.53 et un rappel de 0.72. De plus, rappelez-vous que le meilleur classificateur constant ne peut pas faire la distinction entre "oui" et "non". Il prédirait une classe aléatoire ou une classe constante à chaque fois.

La courbe d'un ensemble de données équilibré entre « oui » et « non » serait une ligne horizontale à 0.5, et aurait donc une aire sous la courbe PR (AUPRC) de 0.5. Pour créer le PRC, nous traçons différents modèles sur la courbe à des seuils variables, de la même manière que la courbe ROC. Pour nos données, l'AUPRC est de 0.61.

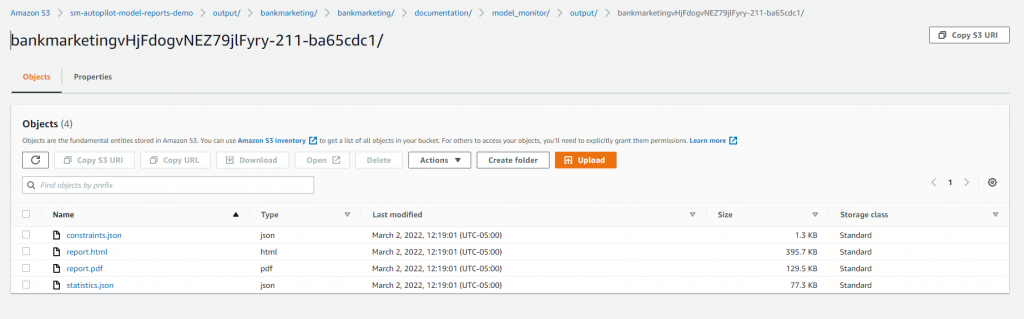

Sortie du rapport de qualité du modèle

Vous pouvez trouver le rapport sur la qualité du modèle dans le compartiment Amazon S3 que vous avez spécifié lors de la désignation du chemin de sortie avant d'exécuter l'expérience SageMaker AutoPilot. Vous trouverez les rapports sous le documentation/model_monitor/output/<autopilot model name>/ prefix enregistré au format PDF.

Conclusion

Les rapports de qualité du modèle SageMaker Autopilot vous permettent de visualiser et de partager rapidement les résultats d'une expérience SageMaker Autopilot. Vous pouvez facilement effectuer la formation et le réglage du modèle à l'aide de SageMaker Autopilot, puis référencer les rapports générés pour interpréter les résultats. Que vous finissiez par utiliser le meilleur modèle de SageMaker Autopilot ou un autre candidat, ces résultats peuvent constituer un point de départ utile pour évaluer un travail préliminaire de formation et de réglage du modèle. Les rapports sur la qualité des modèles SageMaker Autopilot permettent de réduire le temps nécessaire à l'écriture de code et à la production de visuels pour l'évaluation et la comparaison des performances.

Vous pouvez facilement intégrer dès aujourd'hui autoML à vos analyses de rentabilisation sans avoir à constituer une équipe de data science. Sage Maker Documentation fournit de nombreux exemples pour vous aider à démarrer.

À propos des auteurs

Pierre Chung est un architecte de solutions pour AWS et se passionne pour aider les clients à découvrir des informations à partir de leurs données. Il a développé des solutions pour aider les organisations à prendre des décisions basées sur les données dans les secteurs public et privé. Il détient toutes les certifications AWS ainsi que deux certifications GCP. Il aime le café, cuisiner, rester actif et passer du temps avec sa famille.

Pierre Chung est un architecte de solutions pour AWS et se passionne pour aider les clients à découvrir des informations à partir de leurs données. Il a développé des solutions pour aider les organisations à prendre des décisions basées sur les données dans les secteurs public et privé. Il détient toutes les certifications AWS ainsi que deux certifications GCP. Il aime le café, cuisiner, rester actif et passer du temps avec sa famille.

Arunprasath Shankar est un architecte de solutions spécialisé en intelligence artificielle et apprentissage automatique (AI / ML) avec AWS, qui aide les clients du monde entier à faire évoluer leurs solutions d'IA de manière efficace et efficiente dans le cloud. Dans ses temps libres, Arun aime regarder des films de science-fiction et écouter de la musique classique.

Arunprasath Shankar est un architecte de solutions spécialisé en intelligence artificielle et apprentissage automatique (AI / ML) avec AWS, qui aide les clients du monde entier à faire évoluer leurs solutions d'IA de manière efficace et efficiente dans le cloud. Dans ses temps libres, Arun aime regarder des films de science-fiction et écouter de la musique classique.

Ali Takbiri est un architecte de solutions spécialisé en IA/ML et aide les clients en utilisant l'apprentissage automatique pour résoudre leurs défis commerciaux sur le cloud AWS.

Ali Takbiri est un architecte de solutions spécialisé en IA/ML et aide les clients en utilisant l'apprentissage automatique pour résoudre leurs défis commerciaux sur le cloud AWS.

Pradeep Reddy est chef de produit senior au sein de l'équipe SageMaker Low/No Code ML, qui comprend SageMaker Autopilot, SageMaker Automatic Model Tuner. En dehors du travail, Pradeep aime lire, courir et s'amuser avec des ordinateurs de la taille d'une paume comme Raspberry Pi et d'autres technologies de domotique.

Pradeep Reddy est chef de produit senior au sein de l'équipe SageMaker Low/No Code ML, qui comprend SageMaker Autopilot, SageMaker Automatic Model Tuner. En dehors du travail, Pradeep aime lire, courir et s'amuser avec des ordinateurs de la taille d'une paume comme Raspberry Pi et d'autres technologies de domotique.

- Coinsmart. Le meilleur échange Bitcoin et Crypto d'Europe.

- Platoblockchain. Intelligence métaverse Web3. Connaissance amplifiée. ACCÈS LIBRE.

- CryptoHawk. Radar Altcoins. Essai gratuit.

- Source : https://aws.amazon.com/blogs/machine-learning/automatically-generate-model-evaluation-metrics-using-sagemaker-autopilot-model-quality-reports/

- "

- 100

- 7

- Qui sommes-nous

- accès

- Compte

- infection

- Avancée

- AI

- algorithmes

- Tous

- Amazon

- parmi

- Une autre

- api

- Réservé

- artificiel

- intelligence artificielle

- L'INTELLIGENCE ARTIFICIELLE ET LE MACHINE LEARNING

- attributs

- Automation

- disponibles

- AWS

- Banque

- Baseline

- devenez

- LES MEILLEURS

- frontière

- Box

- construire

- Développement

- la performance des entreprises

- cas

- globaux

- Selectionnez

- classe

- les classes

- classification

- plus

- le cloud

- code

- Café

- Colonne

- par rapport

- complexe

- ordinateurs

- confusion

- contient

- Costs

- pourriez

- créée

- La création

- courbe

- Clients

- données

- science des données

- ensemble de données

- démontrer

- déployer

- déployer

- Détection

- DID

- différent

- directement

- distribution

- même

- Endpoint

- ENGINEERING

- notamment

- peut

- exemple

- expérience

- famille

- Fonctionnalité

- finalement

- trouve

- Prénom

- Flexibilité

- Focus

- Abonnement

- le format

- générer

- Global

- Bien

- ayant

- vous aider

- utile

- aide

- Haute

- augmentation

- détient

- Accueil

- Automatisation de la maison

- Comment

- How To

- HTTPS

- ICON

- Identite

- important

- comprendre

- d'information

- idées.

- Intelligence

- IT

- Emploi

- connu

- Etiquettes

- gros

- plus importantes

- APPRENTISSAGE

- apprentissage

- Levier

- Gamme

- Écoute

- emplacement

- click

- machine learning

- Majorité

- FAIT DU

- gestion

- manager

- Stratégie

- Matrice

- mesurer

- Métrique

- minorité

- ML

- modèle

- numériques jumeaux (digital twin models)

- PLUS

- (en fait, presque toutes)

- Films

- Musique

- nombre

- nombreux

- offrant

- Offres Speciales

- ouvert

- ouverture

- d'exploitation

- Options

- organisations

- Autre

- passionné

- performant

- Point

- positif

- possibilités

- possible

- défaillances

- prévoir

- prédiction

- Prédictions

- représentent

- Privé

- Problème

- d'ouvrabilité

- produire

- Produit

- Vidéo

- fournir

- fournit

- public

- qualité

- vite.

- gamme

- en cours

- réduire

- pertinent

- rapport

- Rapports

- représente

- Resources

- réponse

- Résultats

- pour le running

- Escaliers intérieurs

- Sciences

- Secteurs

- set

- Partager

- étapes

- So

- Solutions

- RÉSOUDRE

- le spam

- Dépenses

- carré

- j'ai commencé

- Statut

- storage

- studio

- Target

- équipe

- technologie

- Avec

- fiable

- aujourd'hui

- TPR

- Formation

- les trains

- ui

- devoiler

- comprendre

- us

- utilisé

- Plus-value

- divers

- Voir

- définition

- que

- WHO

- sans

- activités principales

- pourra