L'apprentissage automatique (ML) aide les organisations à générer des revenus, à réduire les coûts, à atténuer les risques, à accroître l'efficacité et à améliorer la qualité en optimisant les fonctions commerciales essentielles dans plusieurs unités commerciales telles que le marketing, la fabrication, les opérations, les ventes, la finance et le service client. Avec AWS ML, les organisations peuvent accélérer la création de valeur de plusieurs mois à quelques jours. Toile Amazon SageMaker est un service visuel pointer-cliquer qui permet aux analystes commerciaux de générer des prédictions ML précises sans écrire une seule ligne de code ni nécessiter d'expertise en ML. Vous pouvez utiliser des modèles pour effectuer des prédictions de manière interactive et pour la notation par lots sur des ensembles de données en masse.

Dans cet article, nous présentons des modèles architecturaux sur la façon dont les équipes commerciales peuvent utiliser des modèles ML créés n'importe où en générant des prédictions dans Canvas et en obtenant des résultats commerciaux efficaces.

Cette intégration du développement et du partage de modèles crée une collaboration plus étroite entre les équipes commerciales et de science des données et réduit le délai de rentabilisation. Les équipes métier peuvent utiliser des modèles existants créés par leurs data scientists ou d'autres départements pour résoudre un problème métier au lieu de reconstruire de nouveaux modèles dans des environnements extérieurs.

Enfin, les analystes métier peuvent importer des modèles partagés dans Canvas et générer des prédictions avant de les déployer en production en quelques clics seulement.

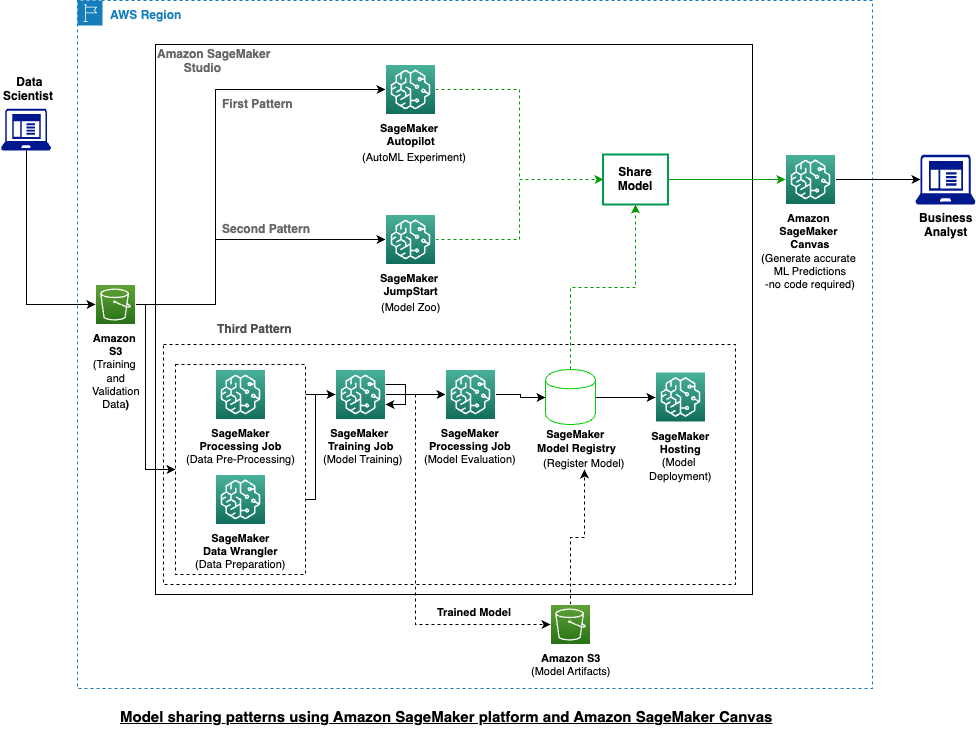

Vue d'ensemble de la solution

La figure suivante décrit trois modèles d'architecture différents pour montrer comment les data scientists peuvent partager des modèles avec des analystes métier, qui peuvent ensuite générer directement des prédictions à partir de ces modèles dans l'interface visuelle de Canvas :

Pré-requis

Pour entraîner et créer votre modèle à l'aide de SageMaker et importer votre modèle dans Canvas, remplissez les conditions préalables suivantes :

- Si vous n'avez pas encore de domaine SageMaker et d'utilisateur Studio, configurer et intégrer un utilisateur Studio à un domaine SageMaker.

- Activer et configurer Canvas autorisations de base pour vos utilisateurs et accorder aux utilisateurs des autorisations pour collaborer avec Studio.

- Vous devez disposer d'un modèle formé à partir d'Autopilot, de JumpStart ou du registre de modèles. Pour tout modèle que vous avez créé en dehors de SageMaker, vous devez enregistrer votre modèle dans le registre des modèles avant de l'importer dans Canvas.

Assumons maintenant le rôle d'un scientifique des données qui cherche à former, créer, déployer et partager des modèles ML avec un analyste métier pour chacun de ces trois modèles architecturaux.

Utiliser le pilote automatique et Canvas

Le pilote automatique automatise les tâches clés d'un processus de ML automatique (AutoML), comme l'exploration des données, la sélection de l'algorithme pertinent pour le type de problème, puis sa formation et son réglage. Tout cela peut être réalisé tout en vous permettant de conserver un contrôle total et une visibilité sur l'ensemble de données. Autopilot explore automatiquement différentes solutions pour trouver le meilleur modèle, et les utilisateurs peuvent soit itérer sur le modèle ML, soit déployer directement le modèle en production en un seul clic.

Dans cet exemple, nous utilisons un taux de désabonnement client synthétique jeu de données du domaine des télécoms et sont chargés d'identifier les clients potentiellement à risque d'attrition. Effectuez les étapes suivantes pour utiliser Autopilot AutoML afin de créer, d'entraîner, de déployer et de partager un modèle de ML avec un analyste métier :

- Télécharger jeu de données, chargez-le sur un Amazon S3 (Service de stockage simple Amazon) compartiment et notez l'URI S3.

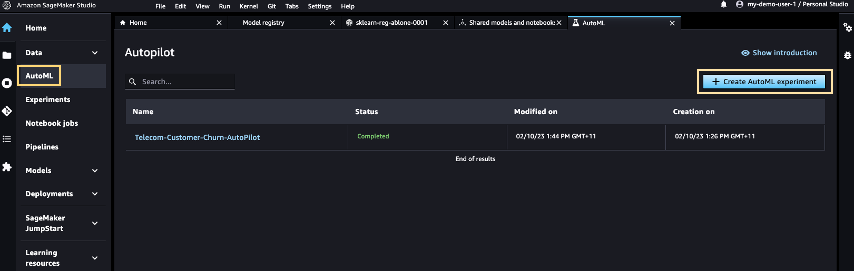

- Sur la console Studio, choisissez AutoML dans le volet de navigation.

- Selectionnez Créer un test AutoML.

- Spécifiez le nom de l'expérience (pour ce post,

Telecom-Customer-Churn-AutoPilot), entrée de données S3 et emplacement de sortie. - Définissez la colonne cible comme désabonnement.

- Dans les paramètres de déploiement, vous pouvez activer l'option de déploiement automatique pour créer un point de terminaison qui déploie votre meilleur modèle et exécute l'inférence sur le point de terminaison.

Pour plus d'informations, reportez-vous à Créer une expérience Amazon SageMaker Autopilot.

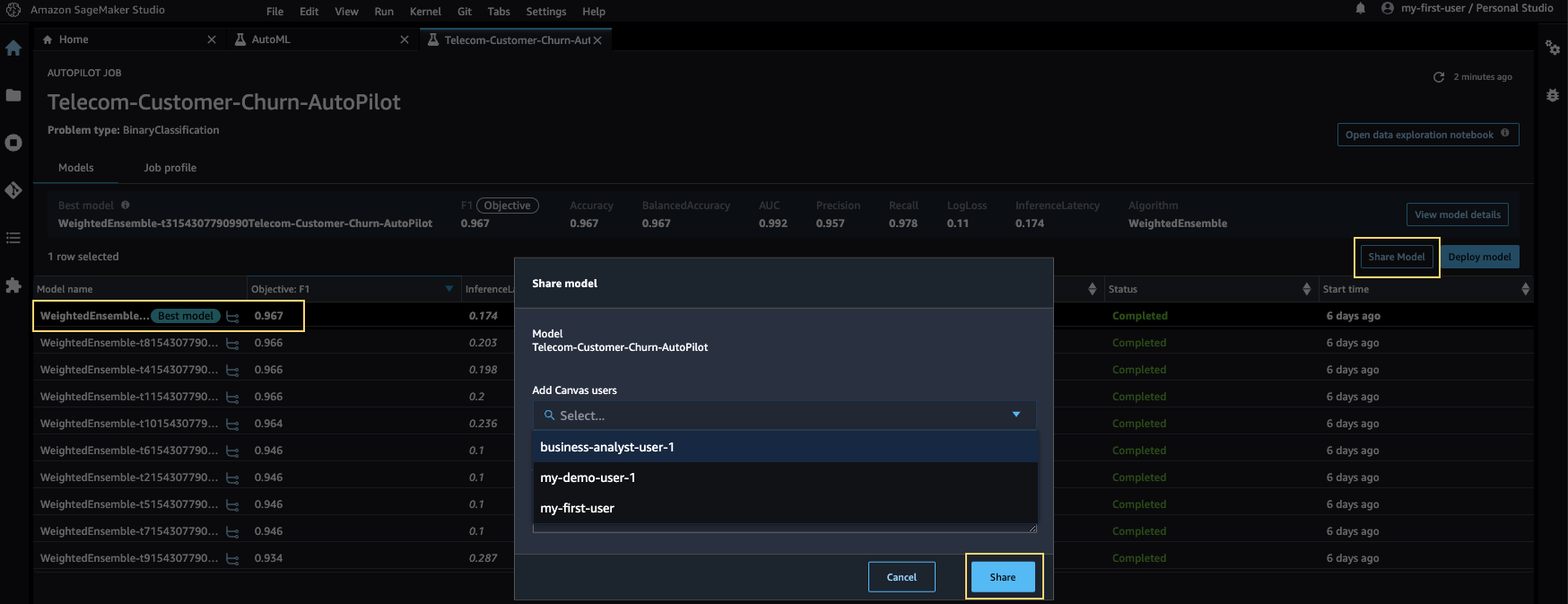

- Choisissez votre expérience, puis sélectionnez votre meilleur modèle et choisissez Partager le modèle.

- Ajoutez un utilisateur Canvas et choisissez Partager partager le modèle.

(Notes : Vous ne pouvez pas partager le modèle avec le même utilisateur Canvas que celui utilisé pour la connexion à Studio. Par exemple, l'utilisateur Studio A ne peut pas partager le modèle avec l'utilisateur Canvas A. Mais l'utilisateur-A peut partager le modèle avec l'utilisateur-B, donc choisir différentes utilisations pour le partage de modèle)

Pour plus d'informations, reportez-vous à Utilisateurs de Studio : Partager un modèle sur SageMaker Canvas.

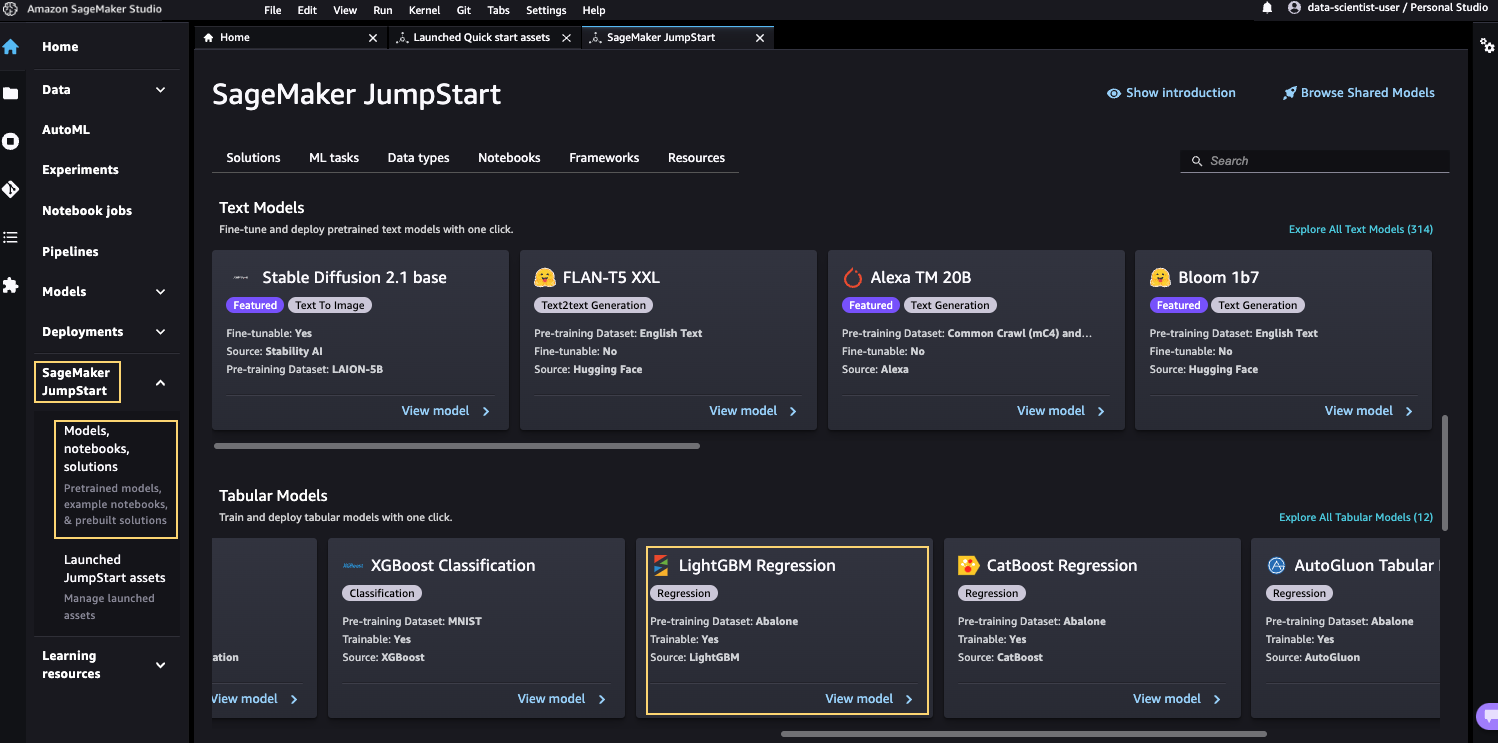

Utiliser JumpStart et Canvas

JumpStart est un hub ML qui fournit des modèles open source pré-formés pour un large éventail de cas d'utilisation ML tels que la détection des fraudes, la prédiction des risques de crédit et la détection des défauts des produits. Vous pouvez déployer plus de 300 modèles pré-formés pour les données tabulaires, visuelles, textuelles et audio.

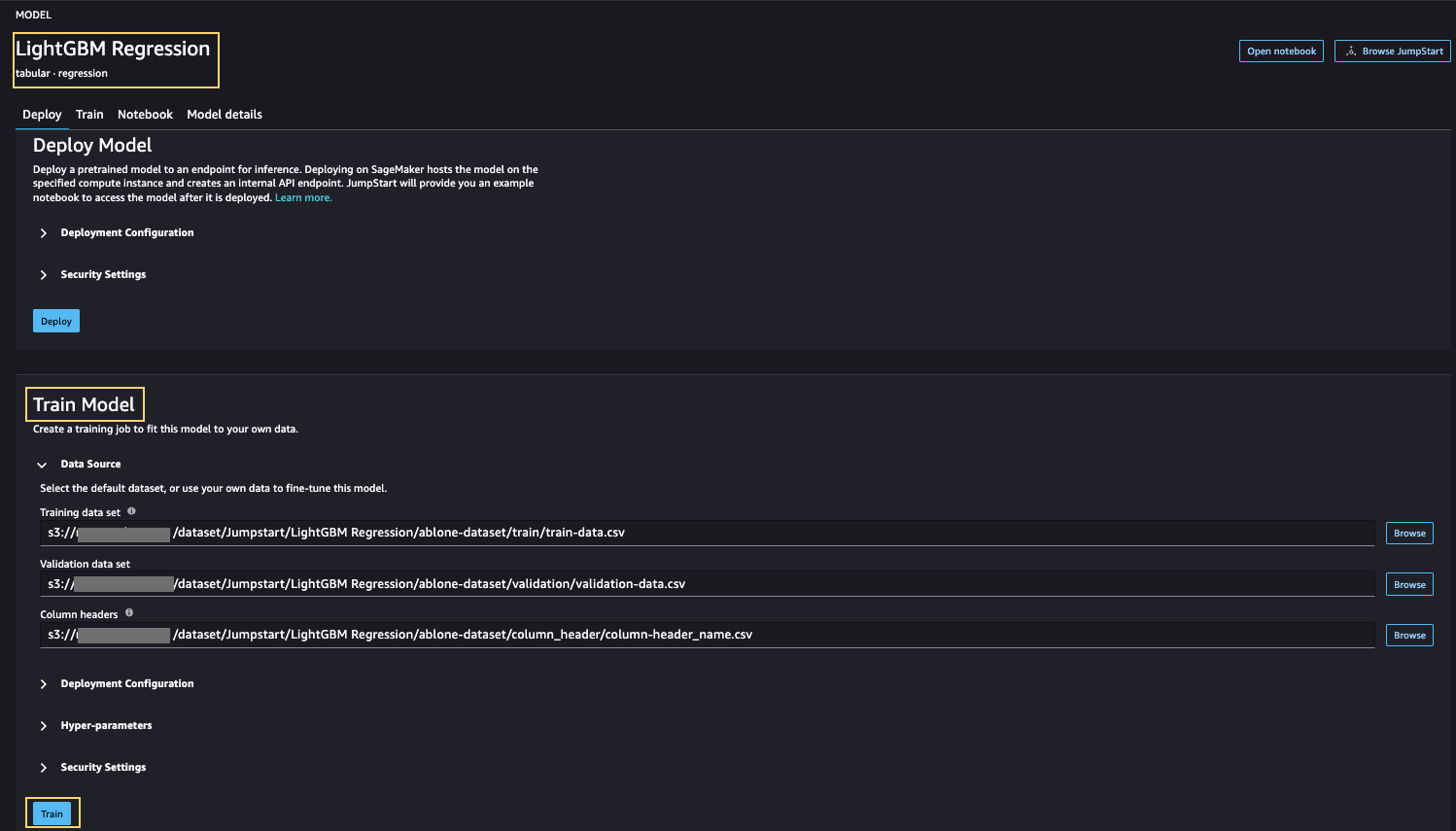

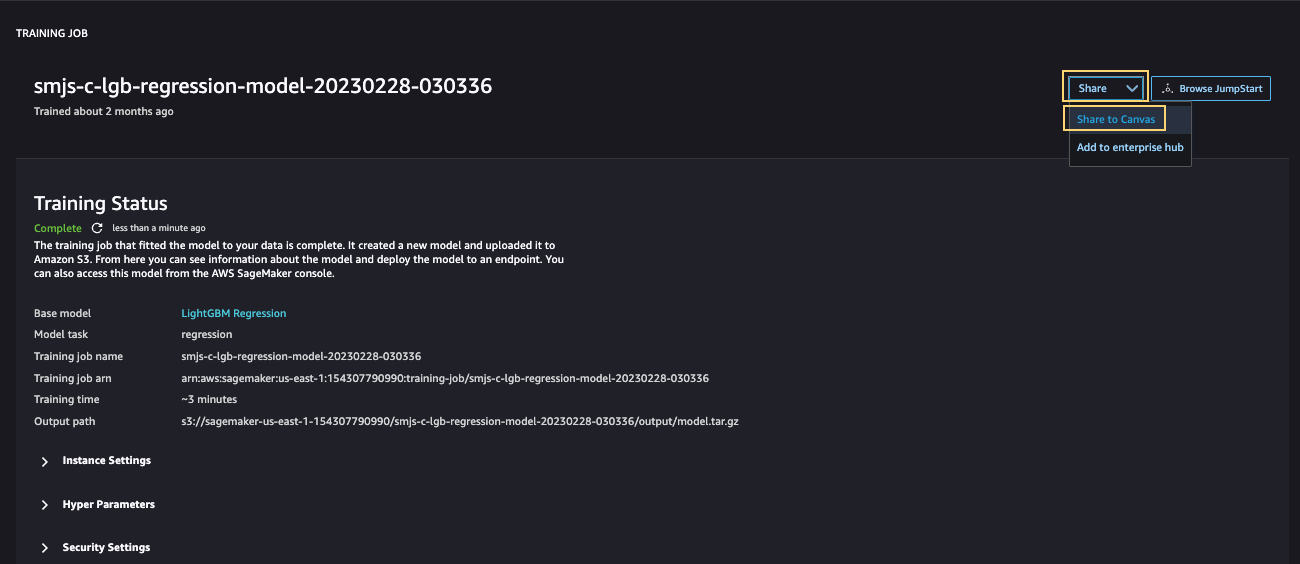

Pour cet article, nous utilisons un modèle pré-entraîné de régression LightGBM de JumpStart. Nous entraînons le modèle sur un jeu de données personnalisé et partageons le modèle avec un utilisateur Canvas (analyste métier). Le modèle pré-entraîné peut être déployé sur un point de terminaison pour l'inférence. JumpStart fournit un exemple de bloc-notes pour accéder au modèle après son déploiement.

Dans cet exemple, nous utilisons le ensemble de données abalone. L'ensemble de données contient des exemples de huit mesures physiques telles que la longueur, le diamètre et la hauteur pour prédire l'âge de l'ormeau (un problème de régression).

- Télécharger ensemble de données abalone de Kaggle.

- Créez un compartiment S3 et chargez les ensembles de données d'entraînement, de validation et d'en-tête personnalisés.

- Sur la console Studio, sous SageMaker JumpStart dans le volet de navigation, choisissez Modèles, cahiers, solutions.

- Sous Modèles tabulaires, choisissez Régression LightGBM.

- Sous Modèle de train, spécifiez les URI S3 pour les ensembles de données d'entraînement, de validation et d'en-tête de colonne.

- Selectionnez Train.

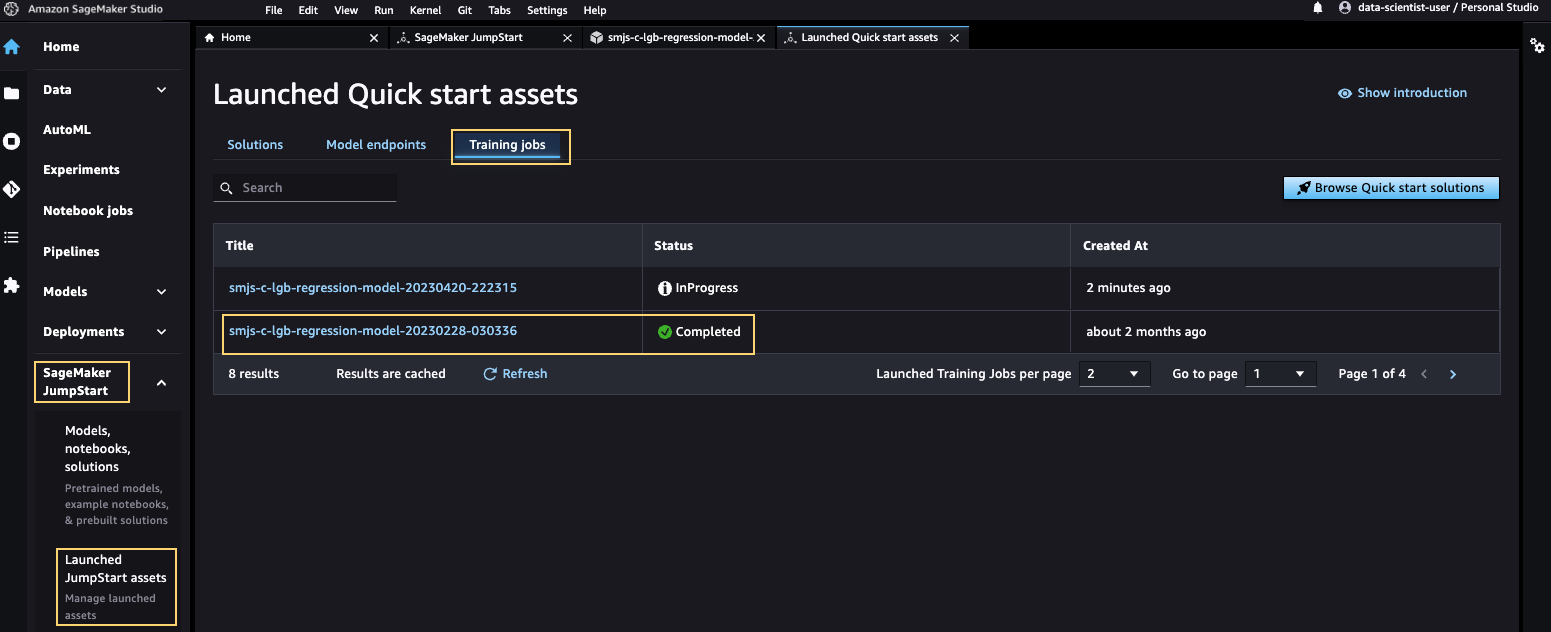

- Dans le volet de navigation, choisissez Lancement des ressources JumpStart.

- Sur le Emplois de formation onglet, choisissez votre travail de formation.

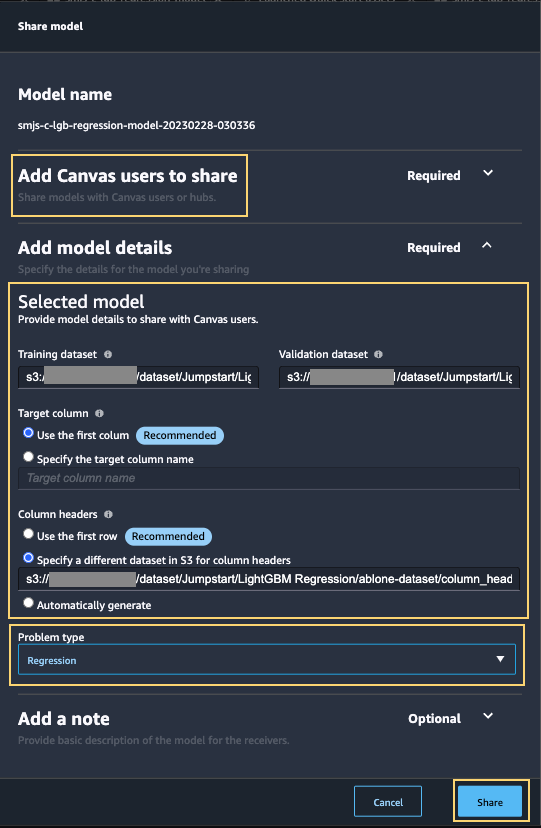

- Sur le Partager menu, choisissez Partager sur Canvas.

- Choisissez les utilisateurs Canvas avec lesquels partager, spécifiez les détails du modèle, puis choisissez Partager.

Pour plus d'informations, reportez-vous à Utilisateurs de Studio : Partager un modèle sur SageMaker Canvas.

Utiliser le registre de modèles SageMaker et Canvas

Avec le registre de modèles SageMaker, vous pouvez cataloguer des modèles pour la production, gérer des versions de modèle, associer des métadonnées, gérer le statut d'approbation d'un modèle, déployer des modèles en production et automatiser le déploiement de modèles avec CI/CD.

Assumons le rôle d'un data scientist. Pour cet exemple, vous créez un projet ML de bout en bout qui inclut la préparation des données, la formation des modèles, l'hébergement des modèles, le registre des modèles et le partage des modèles avec un analyste métier. En option, pour les étapes de préparation et de prétraitement ou de post-traitement des données, vous pouvez utiliser Gestionnaire de données Amazon SageMaker et le Tâche de traitement Amazon SageMaker. Dans cet exemple, nous utilisons le jeu de données Abalone téléchargé depuis LIBSVM. La variable cible est l'âge de l'ormeau.

- Dans Studio, clonez le GitHub repo.

- Effectuez les étapes répertoriées dans le fichier README.

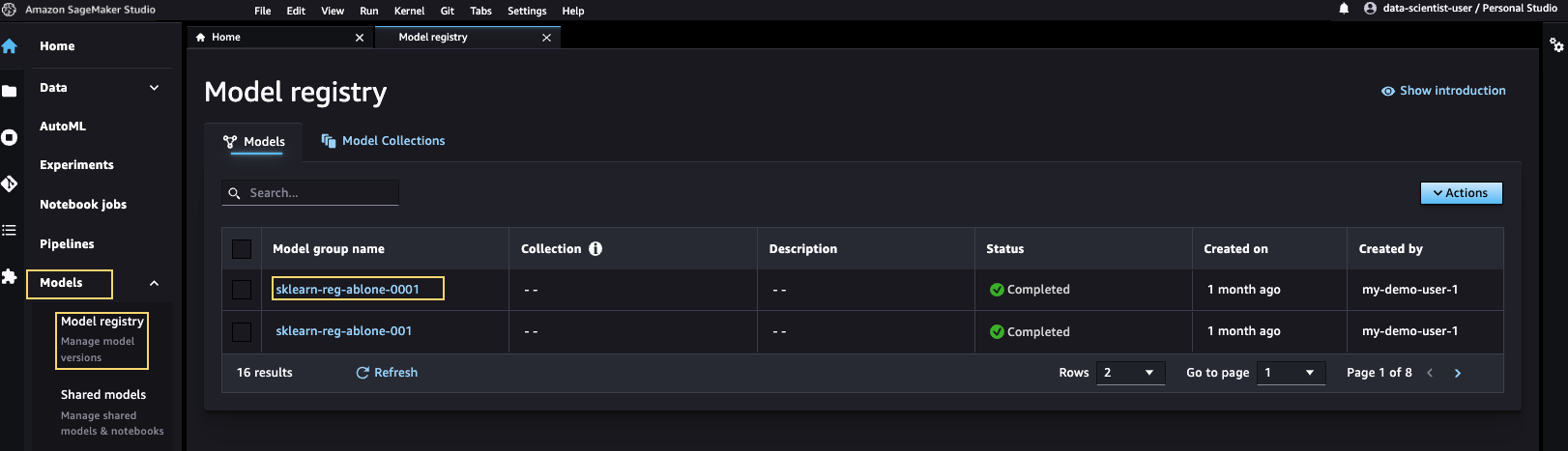

- Sur la console Studio, sous Des modèles photo dans le volet de navigation, choisissez Registre des modèles.

- Choisissez le modèle

sklearn-reg-ablone.

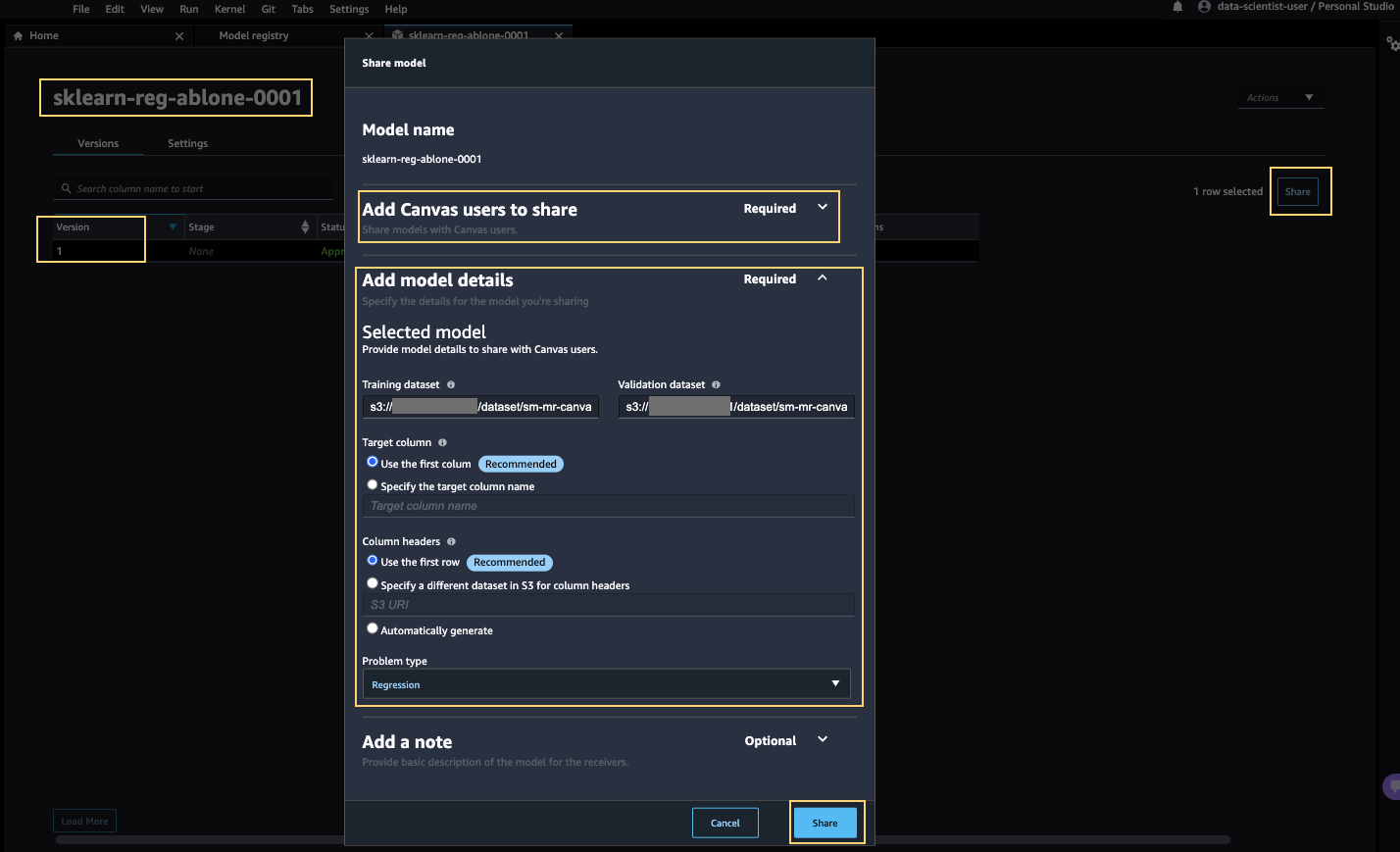

- Partagez la version 1 du modèle depuis le registre de modèles vers Canvas.

- Choisissez les utilisateurs Canvas avec lesquels partager, spécifiez les détails du modèle, puis choisissez Partager.

Pour obtenir des instructions, reportez-vous au Registre des modèles section Utilisateurs de Studio : Partager un modèle sur SageMaker Canvas.

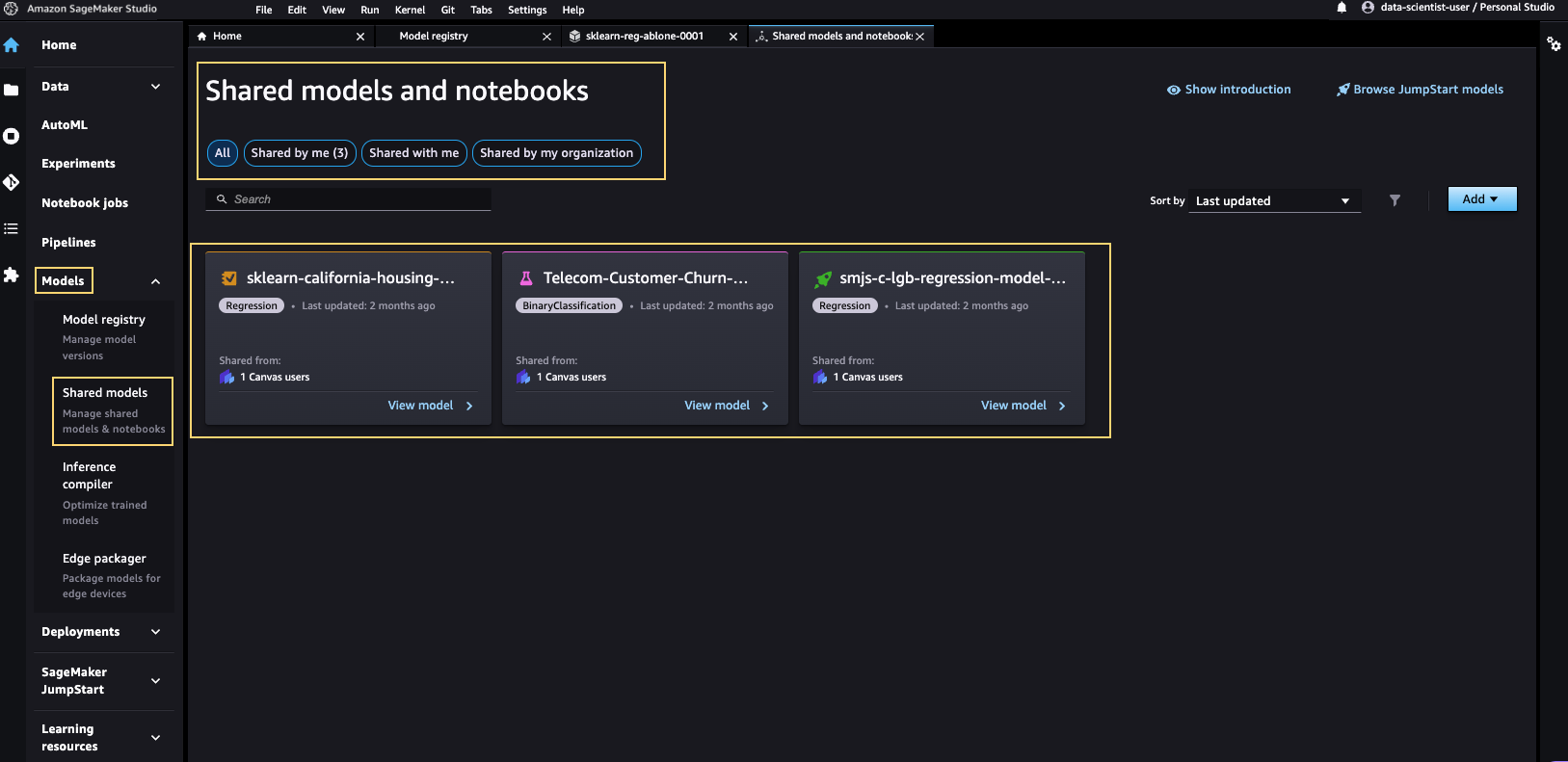

Gérer les modèles partagés

Après avoir partagé le modèle à l'aide de l'une des méthodes précédentes, vous pouvez accéder à la Des modèles photo section dans Studio et passez en revue tous les modèles partagés. Dans la capture d'écran suivante, nous voyons 3 modèles différents partagés par un utilisateur de Studio (data scientist) avec différents utilisateurs de Canvas (équipes commerciales).

Importer un modèle partagé et faire des prédictions avec Canvas

Assumons le rôle d'analyste métier et connectons-nous à Canvas avec votre utilisateur Canvas.

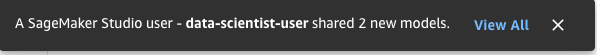

Lorsqu'un data scientist ou un utilisateur de Studio partage un modèle avec un utilisateur de Canvas, vous recevez une notification dans l'application Canvas indiquant qu'un utilisateur de Studio a partagé un modèle avec vous. Dans l'application Canvas, la notification est similaire à la capture d'écran suivante.

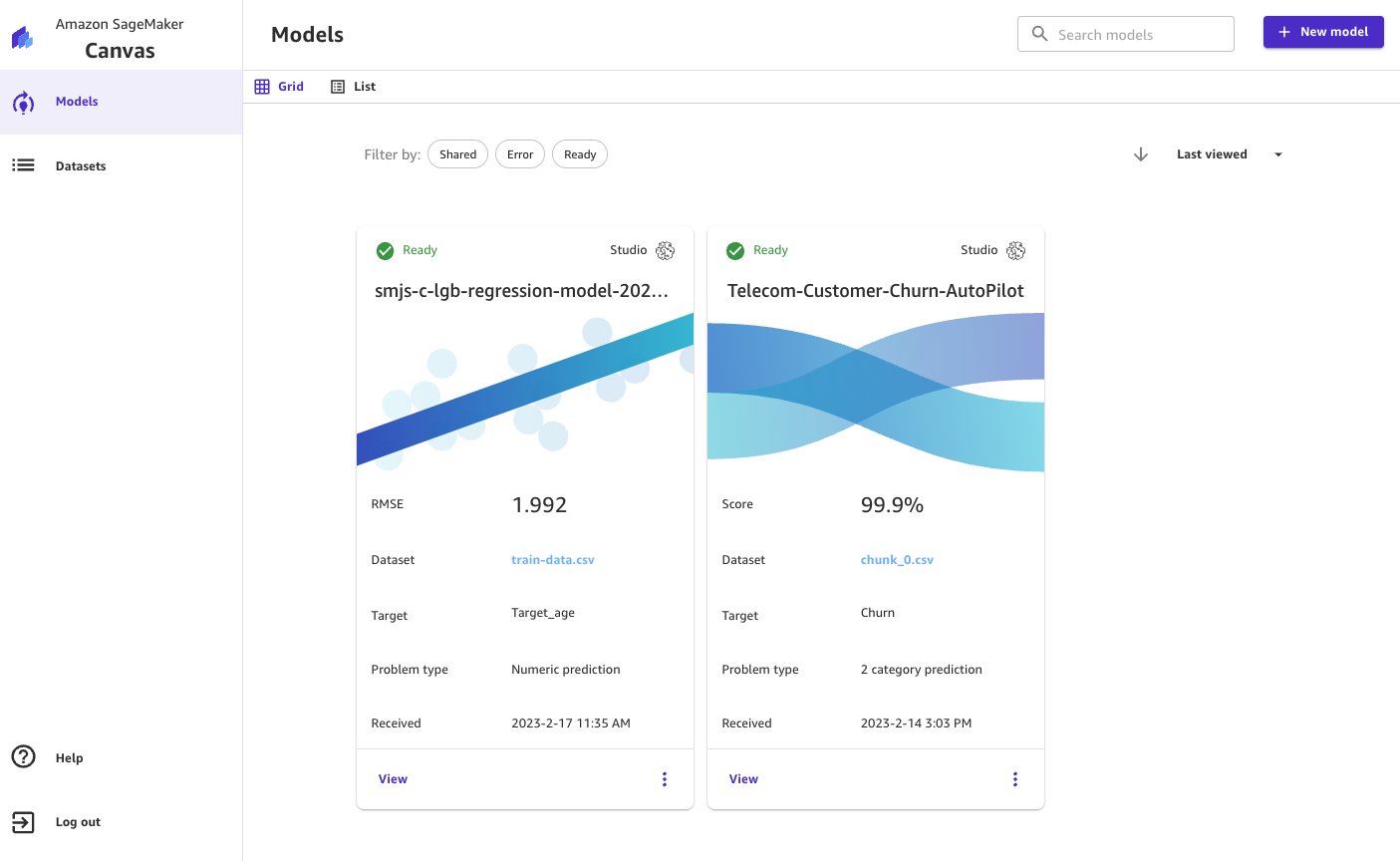

Vous pouvez choisir Afficher la mise à jour pour voir le modèle partagé, ou vous pouvez aller à la Des modèles photo dans l'application Canvas pour découvrir tous les modèles qui ont été partagés avec vous. L'importation du modèle depuis Studio peut prendre jusqu'à 20 minutes.

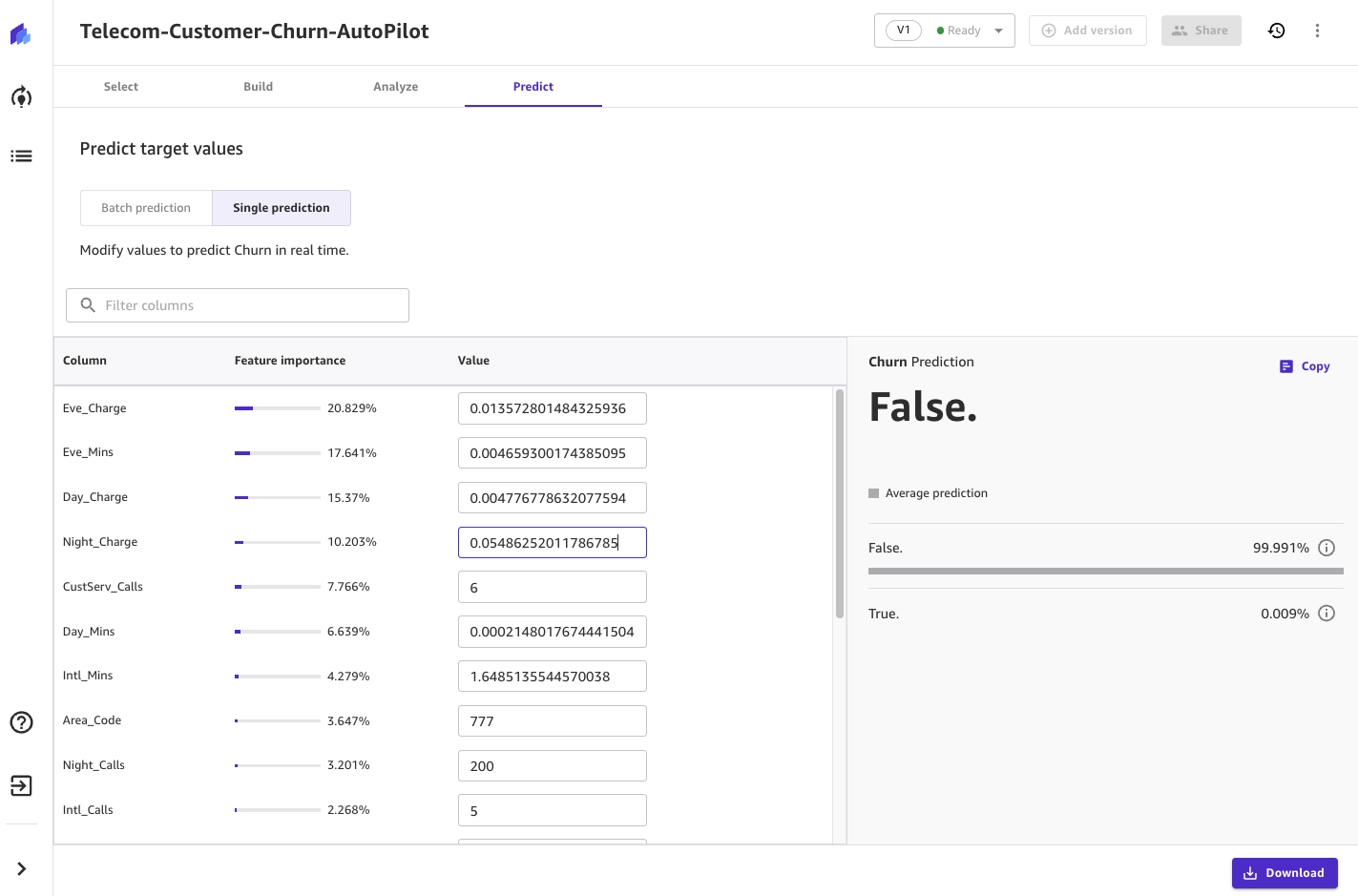

Après avoir importé le modèle, vous pouvez afficher ses métriques et générer prédictions en temps réel avec analyse de simulation ou prédictions par lots.

Considérations

Gardez à l'esprit ce qui suit lorsque vous partagez des modèles avec Canvas :

- Vous stockez les ensembles de données de formation et de validation dans Amazon S3, et les URI S3 sont transmis à Canvas avec Gestion des identités et des accès AWS (IAM).

- Fournissez la colonne cible à Canvas ou utilisez la première colonne par défaut.

- Pour qu'un conteneur Canvas analyse les données d'inférence, le point de terminaison Canvas accepte le texte (CSV) ou l'application (JSON).

- Canvas ne prend pas en charge plusieurs conteneurs ou pipelines d'inférence.

- Un schéma de données est fourni à Canvas si aucun en-tête n'est fourni dans les ensembles de données de formation et de validation. Par défaut, la plate-forme JumpStart ne fournit pas d'en-têtes dans les ensembles de données de formation et de validation.

- Avec Jumpstart, la tâche d'entraînement doit être terminée avant de pouvoir la partager avec Canvas.

Reportez-vous à Limitations et dépannage pour vous aider à résoudre les problèmes que vous rencontrez lors du partage de modèles.

Nettoyer

Pour éviter d'encourir des frais futurs, supprimez ou fermez les ressources que vous avez créées en suivant ce message. Faire référence à Déconnexion d'Amazon SageMaker Canvas pour plus de détails. Arrêtez les ressources individuelles, y compris les ordinateurs portables, le terminal, les noyaux, les applications et les instances. Pour plus d'informations, reportez-vous à Arrêter les ressources. Supprimer le version du modèle, Point de terminaison et ressources SageMaker, Ressources de test de pilote automatiqueet une Seau S3.

Conclusion

Studio permet aux data scientists de partager des modèles ML avec des analystes métier en quelques étapes simples. Les analystes métier peuvent bénéficier des modèles ML déjà créés par les scientifiques des données pour résoudre les problèmes métier au lieu de créer un nouveau modèle dans Canvas. Cependant, il peut être difficile d'utiliser ces modèles en dehors des environnements dans lesquels ils sont créés en raison des exigences techniques et des processus manuels d'importation des modèles. Cela oblige souvent les utilisateurs à reconstruire les modèles ML, ce qui entraîne une duplication des efforts et du temps et des ressources supplémentaires. Canvas supprime ces limitations afin que vous puissiez générer des prédictions dans Canvas avec des modèles que vous avez entraînés n'importe où. En utilisant les trois modèles illustrés dans cet article, vous pouvez enregistrer des modèles ML dans le registre de modèles SageMaker, qui est un magasin de métadonnées pour les modèles ML, et les importer dans Canvas. Les analystes métier peuvent ensuite analyser et générer des prédictions à partir de n'importe quel modèle dans Canvas.

Pour en savoir plus sur l'utilisation des services SageMaker, consultez les ressources suivantes :

Si vous avez des questions ou des suggestions, laissez un commentaire.

À propos des auteurs

Aman Sharma est un architecte de solutions senior avec AWS. Il travaille avec des start-ups, des petites et moyennes entreprises et des entreprises clientes de la région APJ, avec plus de 19 ans d'expérience dans le conseil, l'architecture et les solutions. Il est passionné par la démocratisation de l'IA et du ML et aide les clients à concevoir leurs stratégies de données et de ML. En dehors du travail, il aime explorer la nature et la faune.

Aman Sharma est un architecte de solutions senior avec AWS. Il travaille avec des start-ups, des petites et moyennes entreprises et des entreprises clientes de la région APJ, avec plus de 19 ans d'expérience dans le conseil, l'architecture et les solutions. Il est passionné par la démocratisation de l'IA et du ML et aide les clients à concevoir leurs stratégies de données et de ML. En dehors du travail, il aime explorer la nature et la faune.

Zichen Nie est l'ingénieur logiciel senior chez AWS SageMaker, à la tête du projet Bring Your Own Model to SageMaker Canvas l'année dernière. Elle travaille chez Amazon depuis plus de 7 ans et possède de l'expérience à la fois dans l'optimisation de la chaîne d'approvisionnement d'Amazon et les services AWS AI. Elle aime les entraînements Barre et la musique après le travail.

Zichen Nie est l'ingénieur logiciel senior chez AWS SageMaker, à la tête du projet Bring Your Own Model to SageMaker Canvas l'année dernière. Elle travaille chez Amazon depuis plus de 7 ans et possède de l'expérience à la fois dans l'optimisation de la chaîne d'approvisionnement d'Amazon et les services AWS AI. Elle aime les entraînements Barre et la musique après le travail.

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- PlatoAiStream. Intelligence des données Web3. Connaissance Amplifiée. Accéder ici.

- Frapper l'avenir avec Adryenn Ashley. Accéder ici.

- La source: https://aws.amazon.com/blogs/machine-learning/bring-your-own-ml-model-into-amazon-sagemaker-canvas-and-generate-accurate-predictions/

- :possède

- :est

- $UP

- 1

- 100

- 20

- 7

- a

- A Propos

- accélérer

- Accepte

- accès

- Avec cette connaissance vient le pouvoir de prendre

- atteindre

- atteint

- à travers

- Supplémentaire

- Après

- AI

- Services d'IA

- algorithme

- Tous

- Permettre

- permet

- déjà

- Amazon

- Amazon Sage Maker

- Pilote automatique Amazon SageMaker

- Toile Amazon SageMaker

- an

- selon une analyse de l’Université de Princeton

- analyste

- Analystes

- il analyse

- et les

- tous

- de n'importe où

- Application

- approbation

- applications

- architectural

- architecture

- SONT

- AS

- Associé(e)

- At

- acoustique

- auto

- automatiser

- Automates

- Automatique

- automatiquement

- AutoML

- éviter

- AWS

- base

- BE

- était

- before

- profiter

- LES MEILLEURS

- jusqu'à XNUMX fois

- tous les deux

- apporter

- construire

- Développement

- construit

- la performance des entreprises

- Fonctions commerciales

- entreprises

- mais

- by

- CAN

- la toile

- cas

- catalogue

- chaîne

- des charges

- vérifier

- Selectionnez

- cliquez

- code

- collaborons

- collaboration

- Colonne

- commentaire

- complet

- Console

- consulting

- Contenant

- contient

- des bactéries

- Core

- Costs

- engendrent

- créée

- crée des

- La création

- création

- crédit

- Customiser

- des clients

- Service à la clientèle

- Clients

- données

- Préparation des données

- science des données

- Data Scientist

- ensembles de données

- jours

- Réglage par défaut

- Démocratiser

- démontrer

- départements

- déployer

- déployé

- déployer

- déploiement

- déploie

- conception

- détails

- Détection

- Développement

- différent

- difficile

- directement

- découvrez

- Ne fait pas

- domaine

- Ne pas

- down

- motivation

- deux

- chacun

- Efficace

- efficacité

- effort

- non plus

- permettre

- end-to-end

- Endpoint

- ingénieur

- Entreprise

- environnements

- exemple

- exemples

- existant

- d'experience

- expérience

- nous a permis de concevoir

- explorez

- explore

- Explorer

- few

- Figure

- Déposez votre dernière attestation

- finance

- Trouvez

- Prénom

- Abonnement

- Pour

- Forces

- fraude

- détection de fraude

- De

- plein

- fonctions

- avenir

- générer

- générateur

- Go

- Vous avez

- he

- têtes

- la taille

- vous aider

- aider

- aide

- d'où

- hébergement

- Comment

- Cependant

- HTML

- http

- HTTPS

- Moyeu

- identifier

- Identite

- if

- importer

- l'importation

- améliorer

- in

- inclut

- Y compris

- individuel

- d'information

- contribution

- plutôt ;

- Des instructions

- l'intégration

- Interfaces

- développement

- vous aider à faire face aux problèmes qui vous perturbent

- IT

- SES

- Emploi

- jpg

- json

- juste

- ACTIVITES

- Nom

- L'année dernière

- conduisant

- APPRENTISSAGE

- apprentissage

- Laisser

- Longueur

- comme

- aime

- limites

- Gamme

- Listé

- emplacement

- enregistrer

- vous connecter

- recherchez-

- maintenir

- a prendre une

- gérer

- Manuel

- fabrication

- Stratégie

- des mesures

- moyenne

- Métadonnées

- méthodes

- Métrique

- pourrait

- l'esprit

- Minutes

- Réduire les

- ML

- modèle

- numériques jumeaux (digital twin models)

- mois

- PLUS

- plusieurs

- Musique

- must

- prénom

- Nature

- Navigation

- Besoins

- Nouveauté

- aucune

- cahier

- déclaration

- of

- souvent

- on

- Débuter

- ONE

- open source

- Opérations

- à mettre en œuvre pour gérer une entreprise rentable. Ce guide est basé sur trois décennies d'expérience

- l'optimisation

- Option

- or

- organisations

- Autre

- ande

- les résultats

- sortie

- au contrôle

- propre

- page

- pain

- passé

- passionné

- motifs

- autorisations

- Physique

- plateforme

- Platon

- Intelligence des données Platon

- PlatonDonnées

- Post

- l'éventualité

- prévoir

- prédiction

- Prédictions

- conditions préalables

- Problème

- d'ouvrabilité

- processus

- les process

- traitement

- Produit

- Vidéo

- Projet

- fournir

- à condition de

- fournit

- qualité

- fréquemment posées

- gamme

- recevoir

- réduire

- région

- vous inscrire

- enregistrement

- pertinent

- Exigences

- Resources

- résultant

- de revenus

- Avis

- Analyse

- Rôle

- sagemaker

- vente

- même

- Sciences

- Scientifique

- scientifiques

- marquant

- Section

- sur le lien

- la sélection

- supérieur

- service

- Services

- set

- Paramétres

- Partager

- commun

- Partages

- partage

- elle

- vitrine

- arrêter

- similaires

- étapes

- unique

- petit

- So

- Logiciels

- Software Engineer

- Solutions

- RÉSOUDRE

- start-ups

- Statut

- Étapes

- storage

- Boutique

- les stratégies

- studio

- tel

- la quantité

- chaîne d'approvisionnement

- Optimisation de la chaîne d'approvisionnement

- Support

- haute

- Prenez

- Target

- tâches

- équipes

- Technique

- télécommunications

- terminal

- que

- qui

- La

- leur

- Les

- puis

- Ces

- l'ont

- this

- ceux

- trois

- plus serré

- fiable

- à

- Train

- qualifié

- Formation

- type

- sous

- unités

- utilisé

- d'utiliser

- Utilisateur

- utilisateurs

- en utilisant

- validation

- Plus-value

- la création de valeur

- version

- Voir

- définition

- vision

- we

- quand

- qui

- tout en

- WHO

- large

- Large gamme

- comprenant

- dans les

- sans

- activités principales

- de travail

- vos contrats

- écriture

- an

- années

- Vous n'avez

- Votre

- zéphyrnet