Des clients de toutes tailles et de tous secteurs innovent sur AWS en intégrant l'apprentissage automatique (ML) dans leurs produits et services. Les développements récents dans les modèles d’IA générative ont encore accéléré le besoin d’adoption du ML dans tous les secteurs. Cependant, la mise en œuvre de contrôles de sécurité, de confidentialité des données et de gouvernance reste un défi majeur pour les clients lors de la mise en œuvre de charges de travail de ML à grande échelle. Relever ces défis crée le cadre et les bases nécessaires à l’atténuation des risques et à l’utilisation responsable des produits basés sur le ML. Bien que l’IA générative puisse nécessiter la mise en place de contrôles supplémentaires, tels que la suppression de la toxicité et la prévention du jailbreak et des hallucinations, elle partage les mêmes composants fondamentaux en matière de sécurité et de gouvernance que le ML traditionnel.

Les clients nous disent qu'ils ont besoin de connaissances spécialisées et d'un investissement pouvant aller jusqu'à 12 mois pour développer leur système personnalisé. Amazon Sage Maker Mise en œuvre de la plate-forme ML pour garantir des environnements ML évolutifs, fiables, sécurisés et gouvernés pour leurs secteurs d'activité (LOB) ou leurs équipes ML. Si vous ne disposez pas d'un cadre pour gouverner le cycle de vie du ML à grande échelle, vous pouvez rencontrer des défis tels que l'isolation des ressources au niveau de l'équipe, la mise à l'échelle des ressources d'expérimentation, l'opérationnalisation des flux de travail de ML, la mise à l'échelle de la gouvernance des modèles et la gestion de la sécurité et de la conformité des charges de travail de ML.

Gouverner le cycle de vie du ML à grande échelle est un cadre pour vous aider à créer une plateforme de ML avec des contrôles de sécurité et de gouvernance intégrés basés sur les meilleures pratiques du secteur et les normes de l'entreprise. Ce cadre répond aux défis en fournissant des conseils prescriptifs grâce à une approche de cadre modulaire étendant une Tour de contrôle AWS Environnement AWS multi-comptes et approche discutée dans l'article Mise en place d'environnements d'apprentissage automatique sécurisés et bien gouvernés sur AWS.

Il fournit des conseils prescriptifs pour les fonctions suivantes de la plateforme ML :

- Bases multi-comptes, sécurité et réseau – Cette fonction utilise AWS Control Tower et des principes bien architecturés pour la configuration et l'exploitation d'environnements multi-comptes, de sécurité et de services de mise en réseau.

- Fondements des données et de la gouvernance – Cette fonction utilise un architecture de maillage de données pour la configuration et l'exploitation du lac de données, du magasin central de fonctionnalités et des fondations de gouvernance des données afin de permettre un accès précis aux données.

- Services partagés et de gouvernance de la plateforme ML – Cette fonction permet de configurer et d'exploiter des services communs tels que CI/CD, Catalogue de services AWS pour les environnements de provisionnement et un registre central de modèles pour la promotion et le lignage des modèles.

- Environnements d'équipe ML – Cette fonction permet de configurer et d'exploiter des environnements pour les équipes ML pour le développement de modèles, les tests et le déploiement de leurs cas d'utilisation pour intégrer des contrôles de sécurité et de gouvernance.

- Observabilité de la plateforme ML – Cette fonction aide au dépannage et à l'identification de la cause première des problèmes dans les modèles ML grâce à la centralisation des journaux et à la fourniture d'outils de visualisation de l'analyse des journaux. Il fournit également des conseils pour générer des rapports de coûts et d’utilisation pour les cas d’utilisation du ML.

Bien que ce cadre puisse offrir des avantages à tous les clients, il est particulièrement avantageux pour les grandes entreprises matures, réglementées ou internationales qui souhaitent faire évoluer leurs stratégies de ML selon une approche contrôlée, conforme et coordonnée à l'échelle de l'organisation. Il permet l’adoption du ML tout en atténuant les risques. Ce framework est utile pour les clients suivants :

- Les grandes entreprises clientes qui ont de nombreux secteurs d'activité ou départements intéressés par l'utilisation du ML. Ce cadre permet à différentes équipes de créer et de déployer des modèles ML de manière indépendante tout en assurant une gouvernance centrale.

- Clients d'entreprise avec une maturité modérée à élevée en ML. Ils ont déjà déployé certains modèles de ML initiaux et cherchent à intensifier leurs efforts de ML. Ce cadre peut aider à accélérer l’adoption du ML dans toute l’organisation. Ces entreprises reconnaissent également la nécessité d'une gouvernance pour gérer des éléments tels que le contrôle d'accès, l'utilisation des données, les performances des modèles et les préjugés injustes.

- Entreprises de secteurs réglementés tels que les services financiers, la santé, la chimie et le secteur privé. Ces entreprises ont besoin d'une gouvernance solide et d'une audibilité pour tous les modèles de ML utilisés dans leurs processus commerciaux. L’adoption de ce cadre peut contribuer à faciliter la conformité tout en permettant le développement de modèles locaux.

- Les organisations mondiales qui doivent équilibrer le contrôle centralisé et local. L'approche fédérée de ce cadre permet à l'équipe centrale d'ingénierie de la plateforme de définir des politiques et des normes de haut niveau, mais donne également aux équipes métier la flexibilité de s'adapter en fonction des besoins locaux.

Dans la première partie de cette série, nous parcourons l'architecture de référence pour la mise en place de la plateforme ML. Dans un article ultérieur, nous fournirons des conseils prescriptifs sur la manière de mettre en œuvre les différents modules de l'architecture de référence dans votre organisation.

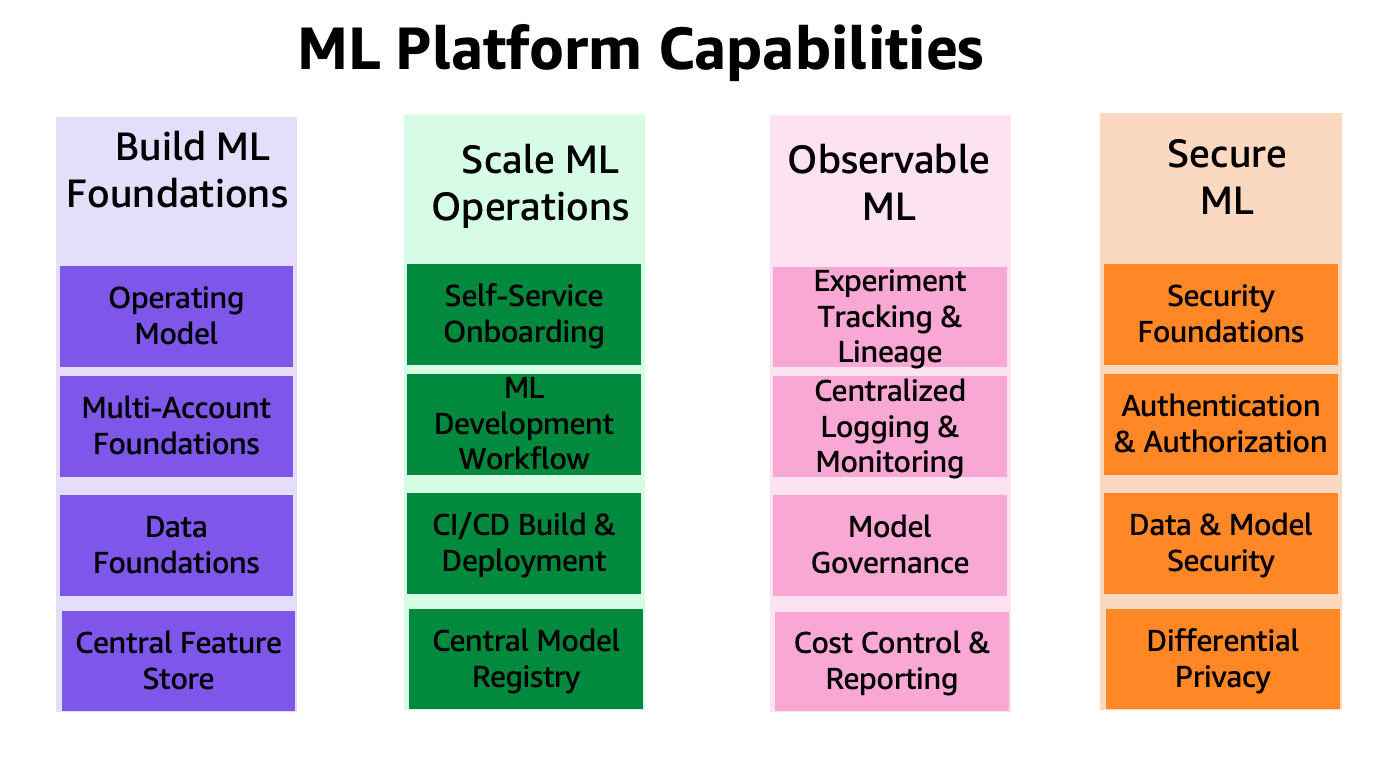

Les fonctionnalités de la plateforme ML sont regroupées en quatre catégories, comme le montre la figure suivante. Ces fonctionnalités constituent la base de l'architecture de référence abordée plus loin dans cet article :

- Construire les fondations du ML

- Faire évoluer les opérations de ML

- ML observable

- ML sécurisé

Vue d'ensemble de la solution

Le cadre de gouvernance du cycle de vie du ML à grande échelle permet aux organisations d'intégrer des contrôles de sécurité et de gouvernance tout au long du cycle de vie du ML, ce qui les aide à réduire les risques et à accélérer l'intégration du ML dans leurs produits et services. Le cadre permet d'optimiser la configuration et la gouvernance d'environnements de ML sécurisés, évolutifs et fiables, capables de prendre en charge un nombre croissant de modèles et de projets. Le framework permet les fonctionnalités suivantes :

- Provisionnement des comptes et de l'infrastructure avec des ressources d'infrastructure conformes aux règles de l'organisation

- Déploiement en libre-service d'environnements de science des données et de modèles d'opérations ML de bout en bout (MLOps) pour les cas d'utilisation du ML

- Isolation des ressources au niveau LOB ou au niveau de l'équipe pour assurer la conformité en matière de sécurité et de confidentialité

- Accès réglementé aux données de production pour l'expérimentation et les flux de travail prêts pour la production

- Gestion et gouvernance des référentiels de code, des pipelines de code, des modèles déployés et des fonctionnalités de données

- Un registre de modèles et un magasin de fonctionnalités (composants locaux et centraux) pour améliorer la gouvernance

- Contrôles de sécurité et de gouvernance pour le processus de développement et de déploiement de modèles de bout en bout

Dans cette section, nous fournissons un aperçu des conseils prescriptifs pour vous aider à créer cette plateforme de ML sur AWS avec des contrôles de sécurité et de gouvernance intégrés.

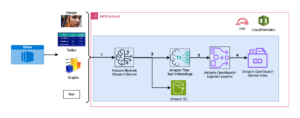

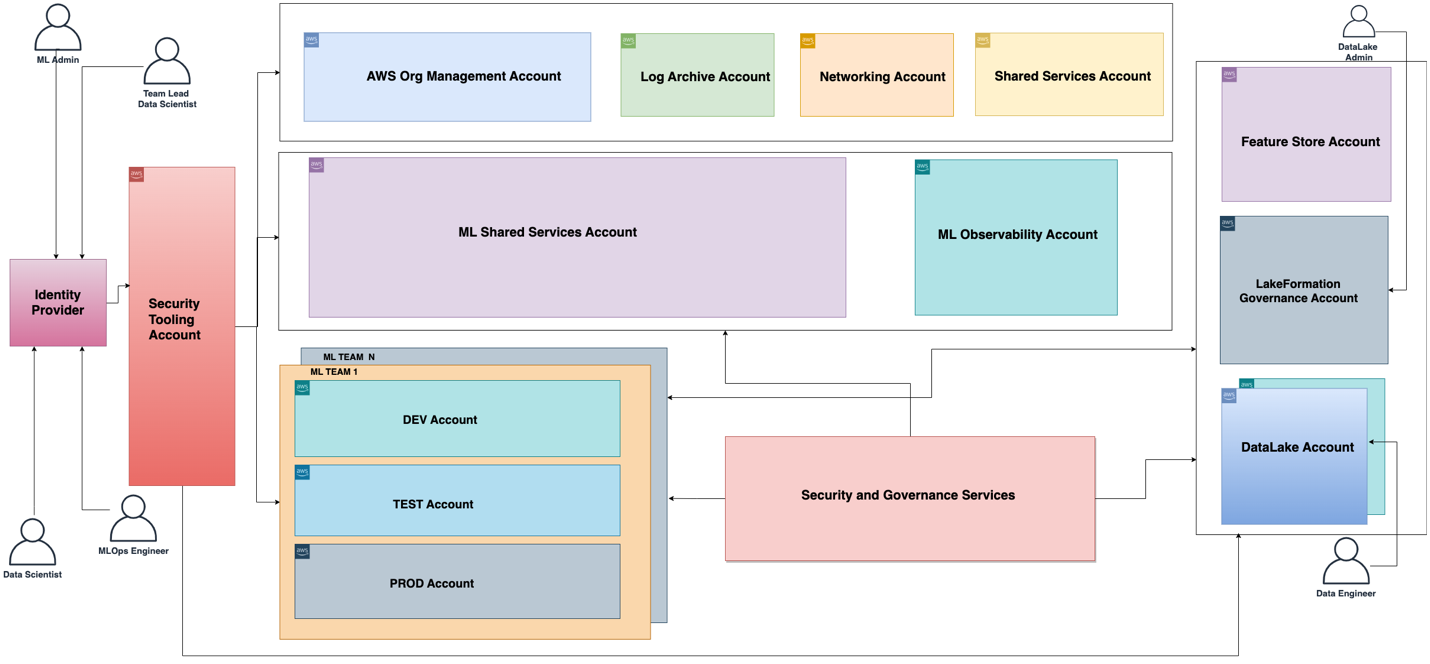

L'architecture fonctionnelle associée à la plateforme ML est présentée dans le schéma suivant. L'architecture mappe les différentes capacités de la plateforme ML aux comptes AWS.

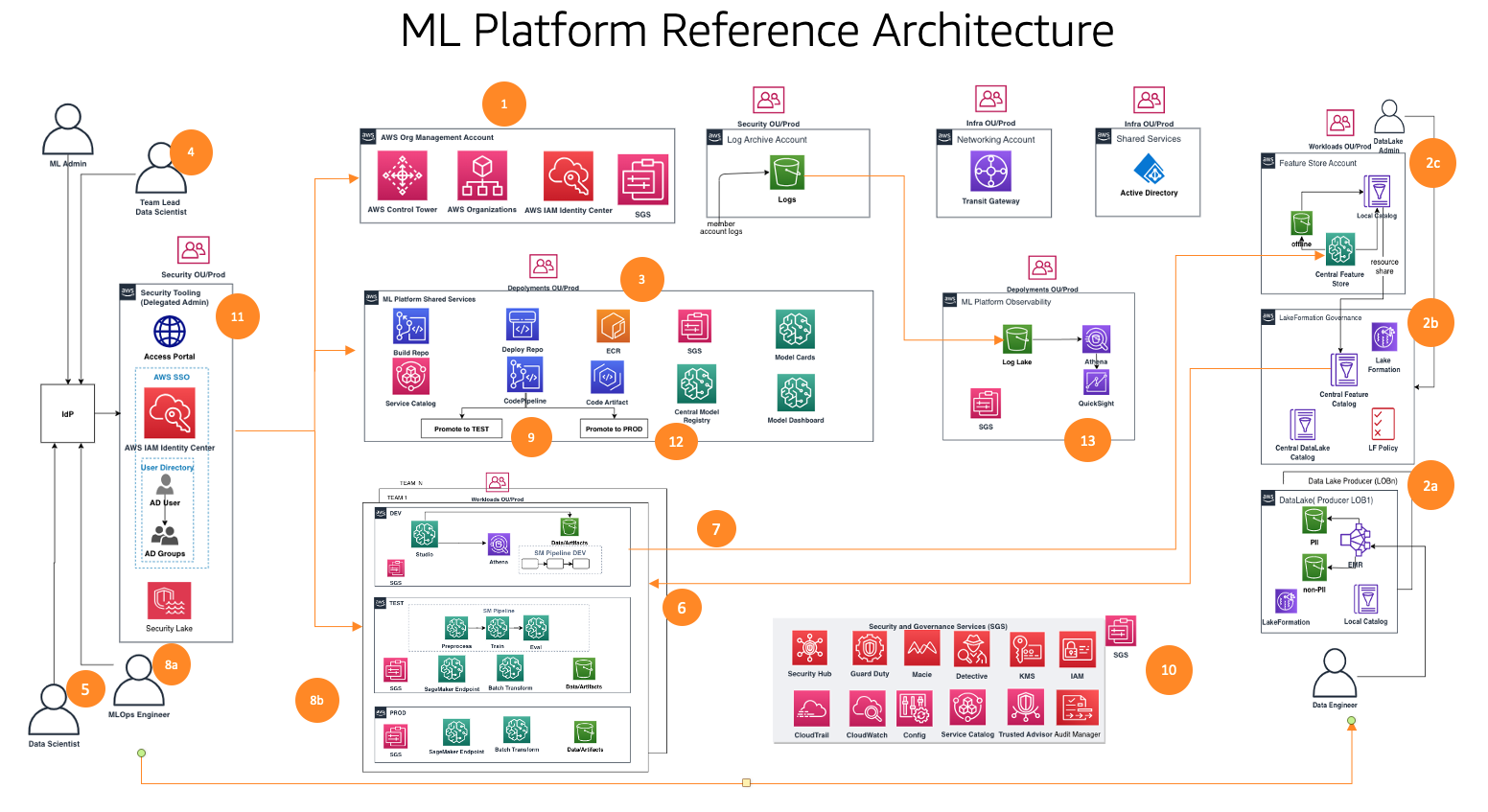

L'architecture fonctionnelle avec différentes capacités est implémentée à l'aide d'un certain nombre de services AWS, notamment Organisations AWS, SageMaker, les services AWS DevOps et un lac de données. L'architecture de référence pour la plateforme ML avec divers services AWS est présentée dans le diagramme suivant.

Ce cadre prend en compte plusieurs personnalités et services pour régir le cycle de vie du ML à grande échelle. Nous vous recommandons les étapes suivantes pour organiser vos équipes et services :

- À l'aide d'AWS Control Tower et des outils d'automatisation, votre administrateur cloud configure les bases multi-comptes telles que les organisations et Centre d'identité AWS IAM (successeur d'AWS Single Sign-On) et des services de sécurité et de gouvernance tels que Service de gestion des clés AWS (AWS KMS) et catalogue de services. De plus, l'administrateur configure diverses unités d'organisation (OU) et comptes initiaux pour prendre en charge vos flux de travail de ML et d'analyse.

- Les administrateurs de lac de données configurent votre lac de données et votre catalogue de données, ainsi que le magasin de fonctionnalités central en collaboration avec l'administrateur de la plateforme ML.

- L'administrateur de la plateforme ML fournit des services partagés ML tels que Code AWSCommit, AWS CodePipeline, Registre des conteneurs élastiques Amazon (Amazon ECR), un registre central de modèles, Cartes modèles SageMaker, Tableau de bord du modèle SageMakeret les produits Service Catalog pour les équipes ML.

- Le responsable de l'équipe ML se fédère via IAM Identity Center, utilise les produits Service Catalog et provisionne les ressources dans l'environnement de développement de l'équipe ML.

- Les data scientists des équipes ML de différentes unités commerciales se fédèrent dans l'environnement de développement de leur équipe pour créer le pipeline de modèles.

- Les data scientists recherchent et extraient des fonctionnalités du catalogue central du magasin de fonctionnalités, créent des modèles grâce à des expériences et sélectionnent le meilleur modèle à promouvoir.

- Les data scientists créent et partagent de nouvelles fonctionnalités dans le catalogue central du magasin de fonctionnalités pour les réutiliser.

- Un ingénieur ML déploie le pipeline de modèle dans l'environnement de test de l'équipe ML à l'aide d'un processus CI/CD de services partagés.

- Après validation des parties prenantes, le modèle ML est déployé dans l'environnement de production de l'équipe.

- Les contrôles de sécurité et de gouvernance sont intégrés à chaque couche de cette architecture à l'aide de services tels que Centre de sécurité AWS, Service de garde Amazon, Amazone Macieet plus encore.

- Les contrôles de sécurité sont gérés de manière centralisée à partir du compte d'outils de sécurité à l'aide de Security Hub.

- Les fonctionnalités de gouvernance de la plateforme ML telles que SageMaker Model Cards et SageMaker Model Dashboard sont gérées de manière centralisée à partir du compte des services de gouvernance.

- Amazon Cloud Watch ainsi que AWS CloudTrail les journaux de chaque compte membre sont rendus accessibles de manière centralisée à partir d'un compte d'observabilité à l'aide des services natifs AWS.

Ensuite, nous approfondissons les modules de l’architecture de référence pour ce framework.

Modules d'architecture de référence

L'architecture de référence comprend huit modules, chacun conçu pour résoudre un ensemble spécifique de problèmes. Collectivement, ces modules abordent la gouvernance dans diverses dimensions, telles que l'infrastructure, les données, le modèle et les coûts. Chaque module offre un ensemble distinct de fonctions et interagit avec d'autres modules pour fournir une plate-forme ML intégrée de bout en bout avec des contrôles de sécurité et de gouvernance intégrés. Dans cette section, nous présentons un bref résumé des capacités de chaque module.

Fondations multi-comptes

Ce module aide les administrateurs cloud à créer un Zone d'atterrissage de la tour de contrôle AWS comme cadre de base. Cela comprend la création d'une structure multi-comptes, l'authentification et l'autorisation via IAM Identity Center, une conception de réseau en étoile, des services de journalisation centralisés et de nouveaux comptes membres AWS avec des bases de sécurité et de gouvernance standardisées.

De plus, ce module donne des conseils sur les meilleures pratiques sur les structures d'unité d'organisation et de compte appropriées pour prendre en charge vos flux de travail de ML et d'analyse. Les administrateurs cloud comprendront l'objectif des comptes et des unités d'organisation requis, comment les déployer, ainsi que les principaux services de sécurité et de conformité qu'ils doivent utiliser pour gérer de manière centralisée leurs charges de travail de ML et d'analyse.

Un cadre de vente de nouveaux comptes est également couvert, qui utilise l'automatisation pour référencer les nouveaux comptes lorsqu'ils sont provisionnés. En mettant en place un processus automatisé de provisionnement de comptes, les administrateurs cloud peuvent fournir aux équipes de ML et d'analyse les comptes dont elles ont besoin pour effectuer leur travail plus rapidement, sans sacrifier une base solide de gouvernance.

Fondations des lacs de données

Ce module aide les administrateurs de lacs de données à configurer un lac de données pour ingérer des données, organiser des ensembles de données et utiliser les Formation AWS Lake modèle de gouvernance pour gérer l'accès aux données à granularité précise entre les comptes et les utilisateurs à l'aide d'un catalogue de données centralisé, de politiques d'accès aux données et de contrôles d'accès basés sur des balises. Vous pouvez commencer petit avec un seul compte pour les fondations de votre plateforme de données pour une preuve de concept ou quelques petites charges de travail. Pour la mise en œuvre d’une charge de travail de production à moyenne et grande échelle, nous vous recommandons d’adopter une stratégie multi-comptes. Dans un tel contexte, les LOB peuvent assumer le rôle de producteurs et de consommateurs de données en utilisant différents comptes AWS, et la gouvernance du lac de données est gérée à partir d'un compte AWS central partagé. Le producteur de données collecte, traite et stocke les données de son domaine de données, en plus de surveiller et d'assurer la qualité de ses actifs de données. Les consommateurs de données consomment les données du producteur de données après que le catalogue centralisé les partage à l'aide de Lake Formation. Le catalogue centralisé stocke et gère le catalogue de données partagé pour les comptes du producteur de données.

Services de plateforme ML

Ce module aide l'équipe d'ingénierie de la plateforme ML à configurer des services partagés qui sont utilisés par les équipes de science des données sur leurs comptes d'équipe. Les services comprennent un portefeuille de catalogues de services avec des produits pour Domaine SageMaker déploiement, Profil utilisateur du domaine SageMaker déploiement, modèles de modèles de science des données pour la création et le déploiement de modèles. Ce module dispose de fonctionnalités pour un registre de modèles centralisé, des fiches de modèles, un tableau de bord de modèles et des pipelines CI/CD utilisés pour orchestrer et automatiser les workflows de développement et de déploiement de modèles.

De plus, ce module explique comment mettre en œuvre les contrôles et la gouvernance requis pour activer les capacités de libre-service basées sur les personnalités, permettant aux équipes de science des données de déployer indépendamment leur infrastructure cloud et les modèles ML requis.

Développement de cas d'utilisation du ML

Ce module aide les LOB et les data scientists à accéder au domaine SageMaker de leur équipe dans un environnement de développement et à instancier un modèle de création de modèles pour développer leurs modèles. Dans ce module, les data scientists travaillent sur une instance de compte de développement du modèle pour interagir avec les données disponibles sur le lac de données centralisé, réutiliser et partager des fonctionnalités à partir d'un magasin de fonctionnalités central, créer et exécuter des expériences de ML, créer et tester leurs flux de travail de ML, et enregistrez leurs modèles dans un registre de modèles de compte de développement dans leurs environnements de développement.

Des fonctionnalités telles que le suivi des expériences, les rapports d'explicabilité des modèles, la surveillance des biais des données et des modèles et le registre des modèles sont également implémentées dans les modèles, permettant une adaptation rapide des solutions aux modèles développés par les scientifiques des données.

Opérations de ML

Ce module aide les LOB et les ingénieurs ML à travailler sur leurs instances de développement du modèle de déploiement de modèle. Une fois le modèle candidat enregistré et approuvé, ils configurent des pipelines CI/CD et exécutent des flux de travail ML dans l'environnement de test de l'équipe, qui enregistre le modèle dans le registre central des modèles exécuté dans un compte de services partagés de la plateforme. Lorsqu'un modèle est approuvé dans le registre central des modèles, cela déclenche un pipeline CI/CD pour déployer le modèle dans l'environnement de production de l'équipe.

Magasin de fonctionnalités centralisé

Une fois que les premiers modèles sont déployés en production et que plusieurs cas d'utilisation commencent à partager des fonctionnalités créées à partir des mêmes données, un magasin de fonctionnalités devient essentiel pour garantir la collaboration entre les cas d'utilisation et réduire le travail en double. Ce module aide l'équipe d'ingénierie de la plateforme ML à mettre en place un magasin de fonctionnalités centralisé pour fournir le stockage et la gouvernance des fonctionnalités ML créées par les cas d'utilisation ML, permettant ainsi la réutilisation des fonctionnalités dans tous les projets.

Journalisation et observabilité

Ce module aide les LOB et les praticiens du ML à obtenir une visibilité sur l'état des charges de travail de ML dans les environnements de ML grâce à la centralisation de l'activité des journaux tels que CloudTrail, CloudWatch, les journaux de flux VPC et les journaux de charge de travail ML. Les équipes peuvent filtrer, interroger et visualiser les journaux à des fins d'analyse, ce qui peut également contribuer à améliorer la sécurité.

Coût et reporting

Ce module aide diverses parties prenantes (administrateur cloud, administrateur de plate-forme, bureau d'affaires cloud) à générer des rapports et des tableaux de bord pour ventiler les coûts au niveau des utilisateurs ML, de l'équipe ML et des produits ML, et suivre l'utilisation telle que le nombre d'utilisateurs, les types d'instances et points finaux.

Les clients nous ont demandé de leur fournir des conseils sur le nombre de comptes à créer et sur la manière de structurer ces comptes. Dans la section suivante, nous fournissons des conseils sur cette structure de compte à titre de référence que vous pouvez modifier en fonction de vos besoins en fonction des exigences de gouvernance de votre entreprise.

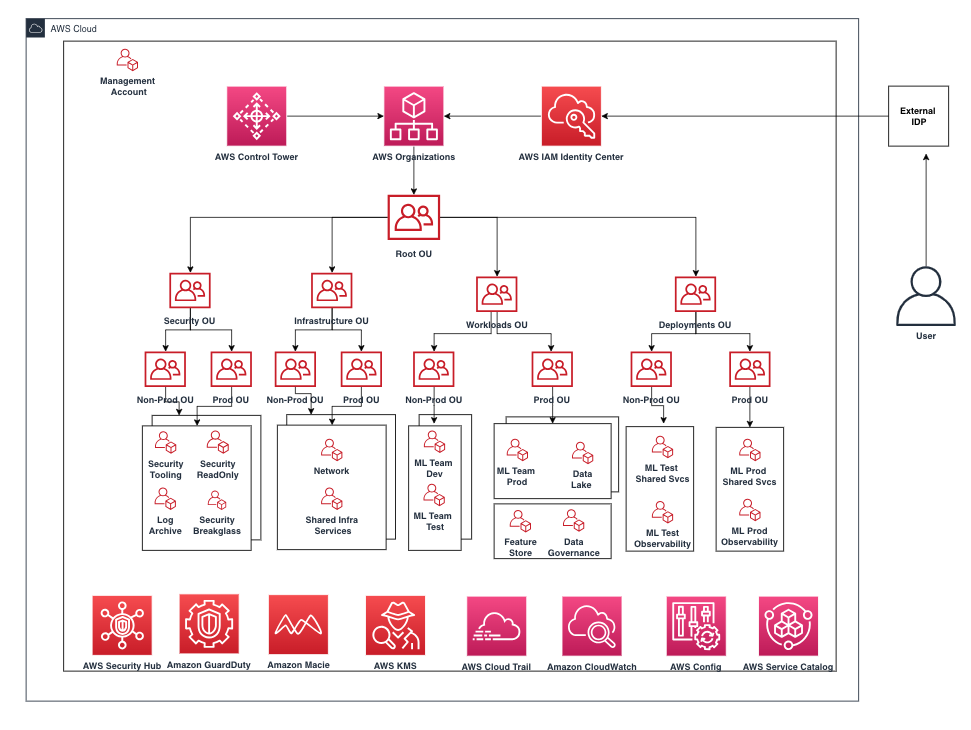

Dans cette section, nous discutons de nos recommandations pour organiser la structure de votre compte. Nous partageons une structure de compte de référence de base ; cependant, nous recommandons aux administrateurs de ML et de données de travailler en étroite collaboration avec leur administrateur cloud pour personnaliser cette structure de compte en fonction des contrôles de leur organisation.

Nous vous recommandons d'organiser les comptes par unité d'organisation pour la sécurité, l'infrastructure, les charges de travail et les déploiements. De plus, au sein de chaque unité d'organisation, organisez-vous par unité d'organisation de non-production et de production, car les comptes et les charges de travail déployés sous celles-ci ont des contrôles différents. Ensuite, nous discutons brièvement de ces unités d’organisation.

UO de sécurité

Les comptes de cette unité d'organisation sont gérés par l'administrateur cloud ou l'équipe de sécurité de l'organisation pour surveiller, identifier, protéger, détecter et répondre aux événements de sécurité.

UO Infrastructure

Les comptes de cette unité d'organisation sont gérés par l'administrateur cloud ou l'équipe réseau de l'organisation pour gérer les ressources et les réseaux partagés de l'infrastructure au niveau de l'entreprise.

Nous vous recommandons d'avoir les comptes suivants sous l'UO d'infrastructure :

- Réseau – Mettre en place une infrastructure réseau centralisée telle que Passerelle de transit AWS

- Services partagés – Configurer des services AD centralisés et des points de terminaison VPC

UO de charges de travail

Les comptes de cette unité d'organisation sont gérés par les administrateurs de l'équipe de plateforme de l'organisation. Si vous avez besoin d'implémenter différents contrôles pour chaque équipe de plateforme, vous pouvez imbriquer d'autres niveaux d'unité d'organisation à cet effet, tels qu'une unité d'organisation de charges de travail ML, une unité d'organisation de charges de travail de données, etc.

Nous recommandons les comptes suivants sous l'unité d'organisation des charges de travail :

- Comptes de développement, de test et de production ML au niveau de l'équipe – Configurez-le en fonction de vos exigences d’isolation de la charge de travail

- Comptes de lac de données – Partitionner les comptes selon votre domaine de données

- Compte central de gouvernance des données – Centralisez vos politiques d’accès aux données

- Compte du magasin de fonctionnalités central – Centraliser les fonctionnalités pour le partage entre les équipes

Unité d'organisation des déploiements

Les comptes de cette unité d'organisation sont gérés par les administrateurs de l'équipe de plateforme de l'organisation pour le déploiement des charges de travail et l'observabilité.

Nous recommandons les comptes suivants sous l'UO de déploiements, car l'équipe de la plateforme ML peut configurer différents ensembles de contrôles à ce niveau de l'UO pour gérer et gouverner les déploiements :

- Comptes de services partagés ML pour les tests et la production – Plateforme héberge les services partagés CI/CD et le registre de modèles

- L'observabilité ML prend en compte les tests et la production – Héberge les journaux CloudWatch, les journaux CloudTrail et d'autres journaux selon les besoins

Ensuite, nous discutons brièvement des contrôles de l'organisation qui doivent être pris en compte pour être intégrés dans les comptes des membres afin de surveiller les ressources de l'infrastructure.

Contrôles de l'environnement AWS

Un contrôle est une règle de haut niveau qui assure une gouvernance continue de votre environnement AWS global. C’est exprimé en langage simple. Dans ce cadre, nous utilisons AWS Control Tower pour mettre en œuvre les contrôles suivants qui vous aident à gérer vos ressources et à surveiller la conformité entre les groupes de comptes AWS :

- Contrôles préventifs – Un contrôle préventif garantit que vos comptes restent conformes car il interdit les actions qui conduisent à des violations de politique et sont mises en œuvre à l'aide d'une politique de contrôle de service (SCP). Par exemple, vous pouvez définir un contrôle préventif qui garantit que CloudTrail n'est pas supprimé ou arrêté dans les comptes ou régions AWS.

- Contrôles de détective – Un contrôle de détective détecte la non-conformité des ressources au sein de vos comptes, comme les violations de politique, fournit des alertes via le tableau de bord et est mis en œuvre à l'aide de Configuration AWS règles. Par exemple, vous pouvez créer un contrôle de détection pour détecter si l'accès public en lecture est activé sur le Service de stockage simple Amazon (Amazon S3) dans le compte partagé d'archive de journaux.

- Contrôles proactifs – Un contrôle proactif analyse vos ressources avant qu'elles ne soient provisionnées et s'assure que les ressources sont conformes à ce contrôle et sont mises en œuvre à l'aide de AWS CloudFormation crochets. Les ressources non conformes ne seront pas provisionnées. Par exemple, vous pouvez définir un contrôle proactif qui vérifie que l'accès direct à Internet n'est pas autorisé pour une instance de bloc-notes SageMaker.

Interactions entre les services de la plateforme ML, les cas d'utilisation du ML et les opérations de ML

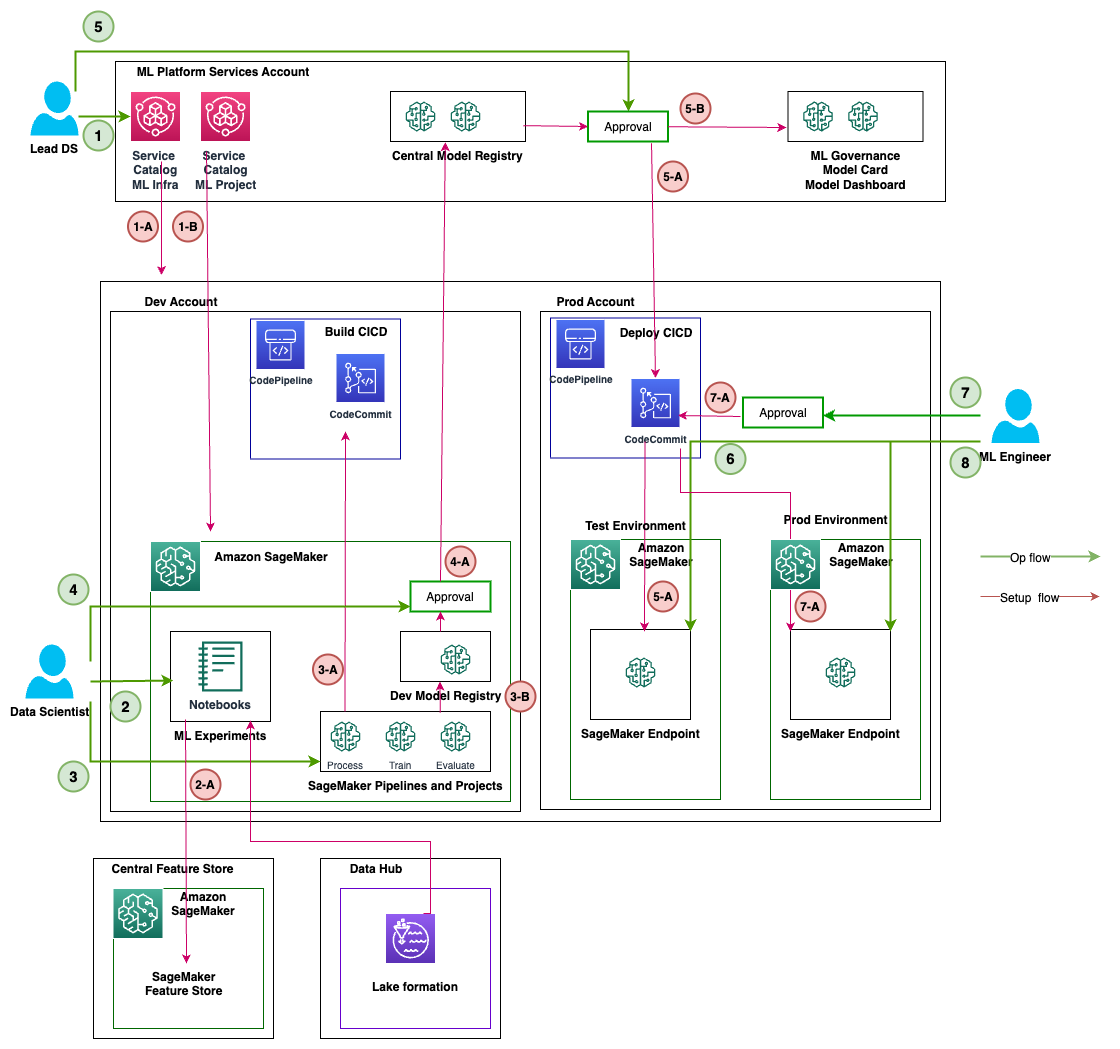

Différents personnages, tels que le responsable de la science des données (scientifique principal des données), le scientifique des données et l'ingénieur ML, exploitent les modules 2 à 6, comme indiqué dans le diagramme suivant pour les différentes étapes des services de la plateforme ML, du développement de cas d'utilisation ML et des opérations ML. ainsi que les fondations du lac de données et le magasin de fonctionnalités central.

Le tableau suivant résume l'activité du flux opérationnel et les étapes du flux de configuration pour différents personnages. Une fois qu'un personnage lance une activité ML dans le cadre du flux opérationnel, les services s'exécutent comme mentionné dans les étapes du flux de configuration.

| Persona | Activité de flux opérationnel – Nombre | Activité de flux opérationnel – Description | Étape du flux de configuration – Numéro | Étape du flux de configuration – Description |

| Chef d'équipe de science des données ou de ML |

1 |

Utilise Service Catalog dans le compte des services de plateforme ML et déploie les éléments suivants :

|

1-A |

|

|

1-B |

|

|||

| Scientifique de données |

2 |

Mener et suivre les expériences de ML dans les blocs-notes SageMaker |

2-A |

|

|

3 |

Automatise les expériences de ML réussies avec les projets et pipelines SageMaker |

3-A |

|

|

|

3-B |

Une fois les pipelines SageMaker exécutés, enregistre le modèle dans le registre de modèles local (dev) | |||

| Lead Data Scientist ou chef d’équipe ML |

4 |

Approuve le modèle dans le registre de modèles local (dev) |

4-A |

Les métadonnées du modèle et le package de modèle sont écrits depuis le registre de modèles local (dev) vers le registre de modèles central. |

|

5 |

Approuve le modèle dans le registre central des modèles |

5-A |

Lance le processus de déploiement CI/CD pour créer des points de terminaison SageMaker dans l'environnement de test | |

|

5-B |

Écrit les informations et les métadonnées du modèle dans le module de gouvernance ML (carte modèle, tableau de bord du modèle) dans le compte des services de plateforme ML à partir du compte local (dev). | |||

| Ingénieur ML |

6 |

Teste et surveille le point de terminaison SageMaker dans l'environnement de test après CI/CD | . | |

|

7 |

Approuve le déploiement des points de terminaison SageMaker dans l'environnement de production |

7-A |

Lance le processus de déploiement CI/CD pour créer des points de terminaison SageMaker dans l'environnement de production | |

|

8 |

Teste et surveille le point de terminaison SageMaker dans l'environnement de test après CI/CD | . | ||

Personas et interactions avec différents modules de la plateforme ML

Chaque module s'adresse à des personnalités cibles particulières au sein de divisions spécifiques qui utilisent le module le plus souvent, leur accordant un accès principal. Un accès secondaire est alors autorisé aux autres divisions qui nécessitent une utilisation occasionnelle des modules. Les modules sont adaptés aux besoins de rôles ou de personnalités particuliers afin d'optimiser les fonctionnalités.

Nous discutons des équipes suivantes :

- Ingénierie cloud centrale – Cette équipe opère au niveau du cloud d'entreprise sur toutes les charges de travail pour la configuration de services d'infrastructure cloud communs, tels que la configuration du réseau, de l'identité, des autorisations et de la gestion des comptes au niveau de l'entreprise.

- Ingénierie de plateforme de données – Cette équipe gère les lacs de données d’entreprise, la collecte de données, la conservation des données et la gouvernance des données.

- Ingénierie de plateforme ML – Cette équipe opère au niveau de la plate-forme ML dans tous les LOB pour fournir des services d'infrastructure ML partagés tels que le provisionnement de l'infrastructure ML, le suivi des expériences, la gouvernance des modèles, le déploiement et l'observabilité.

Le tableau suivant détaille quelles divisions ont un accès principal et secondaire pour chaque module en fonction des personnages cibles du module.

| Numéro de module | Modules | Accès principal | Accès secondaire | Personas cibles | Nombre de comptes |

|

1 |

Fondations multi-comptes | Ingénierie cloud centrale | LOB individuels |

|

Peu |

|

2 |

Fondations des lacs de données | Ingénierie centrale de cloud ou de plateforme de données | LOB individuels |

|

Multiple |

|

3 |

Services de plateforme ML | Ingénierie centrale de cloud ou de plateforme ML | LOB individuels |

|

UN |

|

4 |

Développement de cas d'utilisation du ML | LOB individuels | Ingénierie centrale de cloud ou de plateforme ML |

|

Multiple |

|

5 |

Opérations de ML | Ingénierie cloud centrale ou ML | LOB individuels |

|

Multiple |

|

6 |

Magasin de fonctionnalités centralisé | Cloud central ou ingénierie des données | LOB individuels |

|

UN |

|

7 |

Journalisation et observabilité | Ingénierie cloud centrale | LOB individuels |

|

UN |

|

8 |

Coût et reporting | LOB individuels | Ingénierie de plateforme centrale |

|

UN |

Conclusion

Dans cet article, nous avons présenté un cadre pour gouverner le cycle de vie du ML à grande échelle qui vous aide à mettre en œuvre des charges de travail de ML bien architecturées intégrant des contrôles de sécurité et de gouvernance. Nous avons expliqué comment ce cadre adopte une approche holistique pour créer une plate-forme de ML prenant en compte la gouvernance des données, la gouvernance des modèles et les contrôles au niveau de l'entreprise. Nous vous encourageons à expérimenter le cadre et les concepts présentés dans cet article et à partager vos commentaires.

À propos des auteurs

Bélier Vittal est architecte principal de solutions ML chez AWS. Il possède plus de trois décennies d'expérience dans l'architecture et la création d'applications distribuées, hybrides et cloud. Il est passionné par la création de solutions d'IA/ML et de Big Data sécurisées, évolutives et fiables pour aider les entreprises clientes dans leur parcours d'adoption et d'optimisation du cloud afin d'améliorer leurs résultats commerciaux. Dans ses temps libres, il fait de la moto et marche avec son mouton-doodle de trois ans !

Bélier Vittal est architecte principal de solutions ML chez AWS. Il possède plus de trois décennies d'expérience dans l'architecture et la création d'applications distribuées, hybrides et cloud. Il est passionné par la création de solutions d'IA/ML et de Big Data sécurisées, évolutives et fiables pour aider les entreprises clientes dans leur parcours d'adoption et d'optimisation du cloud afin d'améliorer leurs résultats commerciaux. Dans ses temps libres, il fait de la moto et marche avec son mouton-doodle de trois ans !

Sovik Kumar Nath est un architecte de solution AI/ML avec AWS. Il possède une vaste expérience dans la conception de solutions d'apprentissage automatique et d'analyse commerciale de bout en bout dans les domaines de la finance, des opérations, du marketing, de la santé, de la gestion de la chaîne d'approvisionnement et de l'IdO. Sovik a publié des articles et détient un brevet sur la surveillance des modèles ML. Il est titulaire d'un double master de l'Université de Floride du Sud, de l'Université de Fribourg, en Suisse, et d'un baccalauréat de l'Institut indien de technologie de Kharagpur. En dehors du travail, Sovik aime voyager, faire des promenades en ferry et regarder des films.

Sovik Kumar Nath est un architecte de solution AI/ML avec AWS. Il possède une vaste expérience dans la conception de solutions d'apprentissage automatique et d'analyse commerciale de bout en bout dans les domaines de la finance, des opérations, du marketing, de la santé, de la gestion de la chaîne d'approvisionnement et de l'IdO. Sovik a publié des articles et détient un brevet sur la surveillance des modèles ML. Il est titulaire d'un double master de l'Université de Floride du Sud, de l'Université de Fribourg, en Suisse, et d'un baccalauréat de l'Institut indien de technologie de Kharagpur. En dehors du travail, Sovik aime voyager, faire des promenades en ferry et regarder des films.

Maira Ladeira Tanké est un spécialiste senior des données chez AWS. En tant que responsable technique, elle aide les clients à accélérer la création de valeur commerciale grâce à des technologies émergentes et des solutions innovantes. Maira travaille chez AWS depuis janvier 2020. Avant cela, elle a travaillé comme data scientist dans plusieurs secteurs en se concentrant sur la création de valeur commerciale à partir des données. Pendant son temps libre, Maira aime voyager et passer du temps avec sa famille dans un endroit chaleureux.

Maira Ladeira Tanké est un spécialiste senior des données chez AWS. En tant que responsable technique, elle aide les clients à accélérer la création de valeur commerciale grâce à des technologies émergentes et des solutions innovantes. Maira travaille chez AWS depuis janvier 2020. Avant cela, elle a travaillé comme data scientist dans plusieurs secteurs en se concentrant sur la création de valeur commerciale à partir des données. Pendant son temps libre, Maira aime voyager et passer du temps avec sa famille dans un endroit chaleureux.

Ryan Lempka est architecte de solutions senior chez Amazon Web Services, où il aide ses clients à revenir en arrière par rapport aux objectifs commerciaux pour développer des solutions sur AWS. Il possède une vaste expérience en stratégie d’entreprise, en gestion de systèmes informatiques et en science des données. Ryan se consacre à apprendre tout au long de sa vie et aime se mettre au défi chaque jour pour apprendre quelque chose de nouveau.

Ryan Lempka est architecte de solutions senior chez Amazon Web Services, où il aide ses clients à revenir en arrière par rapport aux objectifs commerciaux pour développer des solutions sur AWS. Il possède une vaste expérience en stratégie d’entreprise, en gestion de systèmes informatiques et en science des données. Ryan se consacre à apprendre tout au long de sa vie et aime se mettre au défi chaque jour pour apprendre quelque chose de nouveau.

Sriharsh Adari est architecte de solutions senior chez Amazon Web Services (AWS), où il aide les clients à travailler à rebours des résultats commerciaux pour développer des solutions innovantes sur AWS. Au fil des ans, il a aidé plusieurs clients à transformer des plateformes de données dans des secteurs verticaux de l'industrie. Son domaine d'expertise principal comprend la stratégie technologique, l'analyse de données et la science des données. Dans ses temps libres, il aime faire du sport, regarder des émissions de télévision et jouer au tabla.

Sriharsh Adari est architecte de solutions senior chez Amazon Web Services (AWS), où il aide les clients à travailler à rebours des résultats commerciaux pour développer des solutions innovantes sur AWS. Au fil des ans, il a aidé plusieurs clients à transformer des plateformes de données dans des secteurs verticaux de l'industrie. Son domaine d'expertise principal comprend la stratégie technologique, l'analyse de données et la science des données. Dans ses temps libres, il aime faire du sport, regarder des émissions de télévision et jouer au tabla.

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- PlatoData.Network Ai générative verticale. Autonomisez-vous. Accéder ici.

- PlatoAiStream. Intelligence Web3. Connaissance Amplifiée. Accéder ici.

- PlatonESG. Carbone, Technologie propre, Énergie, Environnement, Solaire, La gestion des déchets. Accéder ici.

- PlatoHealth. Veille biotechnologique et essais cliniques. Accéder ici.

- La source: https://aws.amazon.com/blogs/machine-learning/governing-the-ml-lifecycle-at-scale-part-1-a-framework-for-architecting-ml-workloads-using-amazon-sagemaker/

- :possède

- :est

- :ne pas

- :où

- $UP

- 1

- 10

- 100

- 12

- 12 mois

- 2020

- 28

- 7

- 8

- 971

- a

- A Propos

- accélérer

- accès

- accessible

- Selon

- Compte

- hybrides

- réalisation

- la réalisation de

- à travers

- actes

- activité

- Ad

- adapter

- adaptation

- ajout

- Supplémentaire

- propos

- adresses

- adresser

- admin

- administrateurs

- L'adoption d'

- Adoption

- Après

- AI

- Modèles AI

- AI / ML

- Alertes

- Tous

- permis

- Permettre

- permet

- le long de

- déjà

- aussi

- Bien que

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- Amazon Web Services (AWS)

- an

- selon une analyse de l’Université de Princeton

- analytique

- ainsi que

- et infrastructure

- tous

- applications

- une approche

- approprié

- ,

- architecture

- Archive

- SONT

- Réservé

- sur notre blog

- AS

- Outils

- associé

- assumer

- At

- Authentification

- autorisation

- automatiser

- Automatisation

- Automation

- disponibles

- AWS

- Balance

- basé

- Baseline

- BE

- car

- devient

- était

- before

- va

- avantageux

- avantages.

- LES MEILLEURS

- les meilleures pratiques

- jusqu'à XNUMX fois

- biais

- Big

- Big Data

- Pause

- brièvement

- construire

- Développement

- construit

- la performance des entreprises

- stratégie d'entreprise

- mais

- by

- CAN

- candidat

- capacités

- carte

- Cartes

- maisons

- cas

- catalogue

- catégories

- répond

- Causes

- Canaux centraux

- central

- Centralisation

- centralisée

- chaîne

- globaux

- difficile

- Contrôles

- chimie

- étroitement

- le cloud

- adoption du cloud

- infrastructure de cloud

- code

- collaboration

- collection

- collectivement

- Commun

- Sociétés

- conformité

- composants électriques

- comprend

- concept

- concepts

- considéré

- considérant

- considère

- consommer

- Les consommateurs

- Contenant

- des bactéries

- Tour de contrôle

- contrôlée

- contrôles

- coordonné

- Core

- Prix

- Costs

- couvert

- engendrent

- créée

- curation

- Clients

- personnaliser

- sont adaptées

- tableau de bord

- tableaux de bord

- données

- accès aux données

- Analyse de Donnée

- Lac de données

- Plateforme de données

- confidentialité des données

- science des données

- Data Scientist

- ensembles de données

- journée

- décennies

- dévoué

- profond

- Degré

- départements

- déployer

- déployé

- déployer

- déploiement

- déploiements

- déploie

- Conception

- un

- conception

- détails

- dev

- développer

- développé

- Développement

- développements

- différent

- dimensions

- discuter

- discuté

- distinct

- distribué

- plongeon

- domaine

- double

- down

- chacun

- efforts

- enchâsser

- intégré

- enrobage

- économies émergentes.

- Technologie émergente

- permettre

- activé

- permet

- permettant

- encourager

- end-to-end

- Endpoint

- ingénieur

- ENGINEERING

- Les ingénieurs

- de renforcer

- assurer

- Assure

- assurer

- Entreprise

- niveau entreprise

- entreprises

- Environment

- environnements

- essential

- évaluer

- événements

- Chaque

- tous les jours

- exemple

- d'experience

- expérience

- expériences

- nous a permis de concevoir

- exprimé

- extension

- les

- Une vaste expérience

- face

- faciliter

- famille

- Fonctionnalité

- Fonctionnalités:

- Réactions

- few

- Figure

- une fonction filtre

- finance

- la traduction de documents financiers

- services financiers

- Prénom

- Flexibilité

- Floride

- flux

- mettant l'accent

- Abonnement

- Pour

- formulaire

- formation

- Fondation

- Fondations

- quatre

- Framework

- gratuitement ici

- De

- fonction

- fonctionnel

- fonctionnalités

- fonctions

- plus

- En outre

- Gain

- générer

- générateur

- génératif

- IA générative

- donne

- Global

- gouvernance

- Modèle de gouvernance

- module de gouvernance

- régie

- gouvernant

- octroi

- Groupes

- l'orientation

- Vous avez

- ayant

- he

- front

- la médecine

- entendre

- vous aider

- a aidé

- aide

- ici

- Haute

- de haut niveau

- sa

- détient

- holistique

- Crochets

- hôtes

- Comment

- How To

- Cependant

- HTML

- http

- HTTPS

- Moyeu

- Hybride

- identifier

- Identite

- if

- Mettre en oeuvre

- la mise en oeuvre

- mis en œuvre

- la mise en œuvre

- améliorer

- l'amélioration de

- in

- comprendre

- inclut

- Y compris

- croissant

- indépendamment

- Indian

- secteurs

- industrie

- d'information

- Infrastructure

- initiale

- Initie

- innover

- technologie innovante

- instance

- Institut

- des services

- interagir

- interactions

- intéressé

- Internet

- accès Internet

- développement

- introduit

- un investissement

- IOT

- seul

- IT

- Janvier

- Emploi

- chemin

- jpg

- ACTIVITES

- spécialisées

- kumar

- Peindre

- lac

- des lacs

- atterrissage

- langue

- gros

- plus tard

- couche

- conduire

- APPRENTISSAGE

- apprentissage

- Niveau

- niveaux

- vos produits

- comme

- lignage

- lignes

- locales

- enregistrer

- enregistrement

- recherchez-

- click

- machine learning

- LES PLANTES

- maintenir

- FAIT DU

- gérer

- gérés

- gestion

- gère

- les gérer

- de nombreuses

- Map

- Stratégie

- mature

- maturité

- Mai..

- membre

- mentionné

- engrener

- Métadonnées

- atténuer

- atténuer les risques

- ML

- MLOps

- modèle

- numériques jumeaux (digital twin models)

- modifier

- application

- Module

- Modules

- Surveiller

- Stack monitoring

- moniteurs

- mois

- PLUS

- (en fait, presque toutes)

- moto

- Films

- plusieurs

- indigène

- Besoin

- Besoins

- Nest

- réseau et

- de mise en réseau

- réseaux

- Nouveauté

- Nouvelles fonctionnalités

- next

- cahier

- nombre

- objectifs

- occasionnel

- of

- Offres Speciales

- Bureaux

- souvent

- Vieux

- on

- une fois

- ONE

- en cours

- fonctionner

- réalisés

- exploite

- d'exploitation

- Opérations

- à mettre en œuvre pour gérer une entreprise rentable. Ce guide est basé sur trois décennies d'expérience

- Optimiser

- or

- organisation

- organisations

- l'organisation

- Autre

- nos

- ande

- les résultats

- au contrôle

- plus de

- global

- vue d'ensemble

- paquet

- partie

- particulier

- passionné

- brevet

- Effectuer

- performant

- autorisations

- pipeline

- Place

- Plaine

- plateforme

- Platon

- Intelligence des données Platon

- PlatonDonnées

- jouer

- politiques

- politique

- portefeuille

- Post

- pratique

- pratiques

- représentent

- prévention

- primaire

- Directeur

- Avant

- la confidentialité

- Privé

- secteur privé

- Cybersécurité

- d'ouvrabilité

- processus

- les process

- producteur

- Nos producteurs

- Produit

- Vidéo

- Produits

- projets

- promotion

- preuve

- preuve de concept

- L'utilisation de sélénite dans un espace est un excellent moyen de neutraliser l'énergie instable ou négative.

- fournir

- fournit

- aportando

- public

- publié

- but

- qualité

- vite.

- Nos tests de diagnostic produisent des résultats rapides et précis sans nécessiter d'équipement de laboratoire complexe et coûteux,

- Lire

- récent

- reconnaître

- recommander

- Recommandation

- réduire

- référence

- régions

- vous inscrire

- inscrit

- registres

- enregistrement

- réglementé

- industries réglementées

- fiable

- enlever

- Rapports

- exigent

- conditions

- Exigences

- ressource

- Resources

- répondre

- responsables

- réutiliser

- manèges

- Analyse

- risques

- Rôle

- rôle

- racine

- Règle

- Courir

- pour le running

- Ryan

- sacrifier

- sagemaker

- Pipelines SageMaker

- même

- évolutive

- Escaliers intérieurs

- mise à l'échelle

- Sciences

- Scientifique

- scientifiques

- Rechercher

- secondaire

- Section

- secteur

- sécurisé

- sécurité

- Les événements de sécurité

- En libre service

- supérieur

- Série

- service

- Services

- set

- Sets

- mise

- installation

- Partager

- commun

- Partages

- partage

- elle

- Shorts

- devrait

- montré

- Spectacles

- étapes

- depuis

- unique

- Taille

- petit

- So

- sur mesure

- Solutions

- RÉSOUDRE

- quelques

- quelque chose

- Région Sud

- Sud de la Floride

- spécialiste

- spécialisé

- groupe de neurones

- Dépenses

- Sports

- étapes

- intervenant

- parties prenantes

- Normes

- Commencer

- Région

- étapes

- Étapes

- Encore

- arrêté

- storage

- Boutique

- STORES

- les stratégies

- de Marketing

- STRONG

- structure

- structures

- studio

- réussi

- tel

- Combinaison

- RÉSUMÉ

- la quantité

- chaîne d'approvisionnement

- gestion de la chaîne logistique

- Support

- Appuyer

- sûr

- Suisse

- Système

- table

- prend

- prise

- Target

- équipe

- équipes

- Technique

- Technologie

- Stratégie technologique

- modèle

- modèles

- tester

- Essais

- qui

- La

- L'État

- leur

- Les

- puis

- Ces

- l'ont

- des choses

- this

- ceux

- Avec

- tout au long de

- fiable

- à

- les outils

- vers

- La tour

- suivre

- Tracking

- traditionnel

- Train

- transformations

- transit

- Voyages

- TOUR

- tv

- types

- sous

- comprendre

- injuste

- unités

- université

- us

- Utilisation

- utilisé

- cas d'utilisation

- d'utiliser

- Utilisateur

- utilisateurs

- Usages

- en utilisant

- utiliser

- validation

- Plus-value

- variété

- divers

- verticales

- via

- Violations

- définition

- visualisation

- visualiser

- marcher

- souhaitez

- chaud

- personne(s) regarde(nt) cette fiche produit

- we

- web

- services Web

- WELL

- quand

- que

- qui

- tout en

- sera

- comprenant

- dans les

- sans

- activités principales

- travaillé

- workflows

- de travail

- années

- Vous n'avez

- Votre

- zéphyrnet