Cet article est co-écrit avec Jan Paul Assendorp, Thomas Lietzow, Christopher Masch, Alexander Meinert, Dr Lars Palzer, Jan Schillemans de SIGNAL IDUNA.

Chez SIGNAL IDUNA, grand assureur allemand, nous nous réinventons actuellement avec notre programme de transformation VISION2023 pour devenir encore plus orientés client. Deux aspects sont au cœur de cette transformation : la réorganisation d’une grande partie du personnel en équipes interfonctionnelles et agiles, et devenir une entreprise véritablement axée sur les données. Ici, la devise « Vous le construisez, vous l'exécutez » est une exigence importante pour une équipe interfonctionnelle qui crée un produit de données ou d'apprentissage automatique (ML). Cela impose des contraintes strictes sur la quantité de travail que l'équipe peut consacrer à la production et à l'exécution d'un produit.

Cet article montre comment SIGNAL IDUNA relève ce défi et utilise le AWS Cloud pour permettre aux équipes interfonctionnelles de créer et de mettre en œuvre leurs propres produits ML. À cette fin, nous introduisons d’abord la structure organisationnelle des équipes agiles, qui définit les exigences centrales de l’infrastructure cloud utilisée pour développer et exécuter un produit. Nous montrons ensuite comment trois équipes centrales de SIGNAL IDUNA permettent à des équipes interfonctionnelles de créer des produits de données dans le cloud AWS avec une assistance minimale, en fournissant un flux de travail et des solutions d'infrastructure adaptés qui peuvent facilement être utilisés et adaptés. Enfin, nous passons en revue notre approche et la comparons à une approche plus classique où développement et exploitation sont séparés plus strictement.

Agile@SI – le fondement du changement organisationnel

Depuis début 2021, SIGNAL IDUNA a commencé à mettre en œuvre sa stratégie Agile@SI et à mettre en place des méthodes agiles pour développer des solutions orientées client dans l'ensemble de l'entreprise [1]. Les tâches et objectifs antérieurs sont désormais entrepris par des équipes interfonctionnelles, appelées escouades. Ces équipes utilisent des méthodes agiles (telles que le framework Scrum), prennent leurs propres décisions et créent des produits orientés client. En règle générale, les équipes sont situées dans des divisions commerciales, telles que le marketing, et nombre d'entre elles mettent fortement l'accent sur la création de produits basés sur les données et alimentés par le ML. À titre d’exemple, les cas d’utilisation typiques dans le domaine de l’assurance sont la prévision du taux de désabonnement des clients et la recommandation de produits.

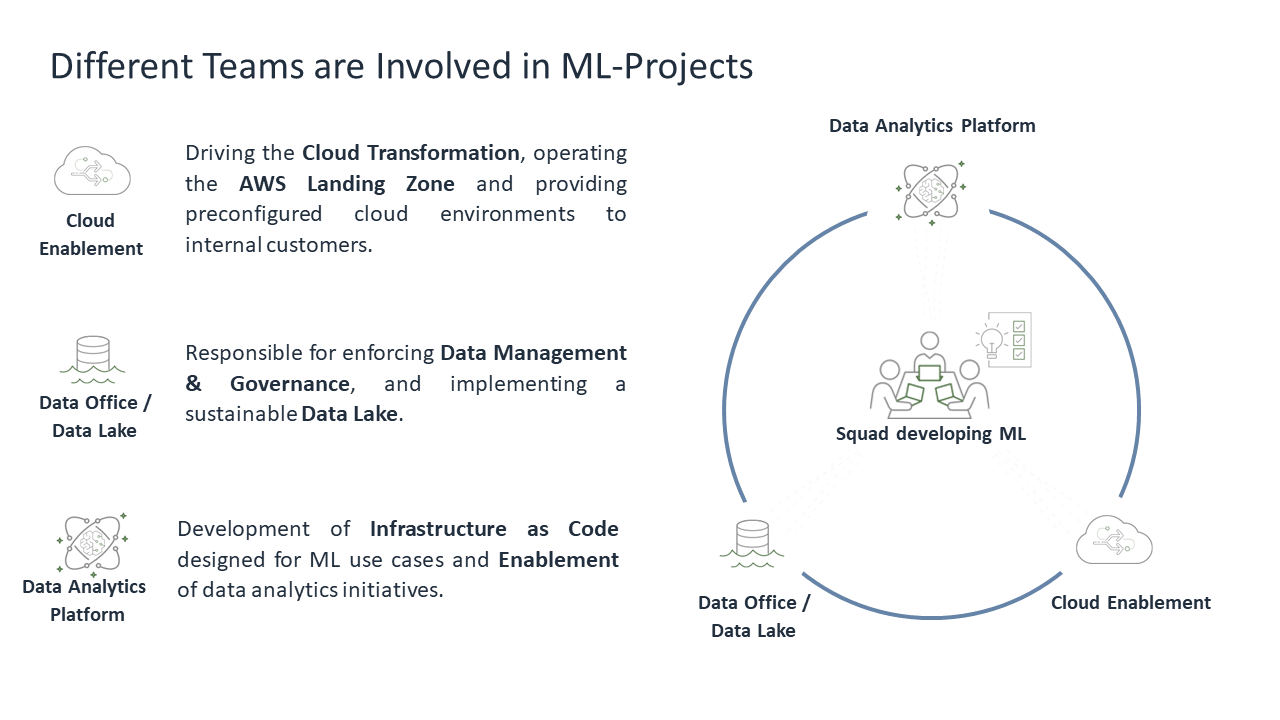

En raison de la complexité du ML, créer une solution ML par une seule équipe est un défi et nécessite donc la collaboration de différentes équipes.

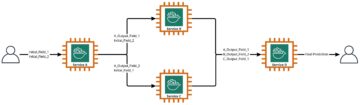

SIGNAL IDUNA dispose de trois équipes essentielles qui soutiennent la création de solutions ML. Entourée de ces trois escouades se trouve l'équipe qui est responsable du développement et de l'exploitation à long terme et de la solution ML. Cette approche suit le modèle de responsabilité partagée d'AWS [2].

Dans l’image ci-dessus, toutes les équipes sont représentées dans un aperçu.

Activation du cloud

L'infrastructure cloud sous-jacente pour l'ensemble de l'organisation est fournie par l'équipe Cloud Enablement. Il est de leur devoir de permettre aux équipes de créer elles-mêmes des produits basés sur les technologies cloud. Cela améliore le délai de mise sur le marché en créant de nouveaux produits comme le ML, et cela suit le principe « Vous le construisez, vous l'exécutez ».

Bureau de données/Lac de données

Le déplacement des données vers le cloud, ainsi que la recherche du bon ensemble de données, sont pris en charge par l'équipe Data Office/Data Lake. Ils mettent en place un catalogue de données qui peut être utilisé pour rechercher et sélectionner les ensembles de données requis. Leur objectif est d’établir la transparence et la gouvernance des données. De plus, ils sont responsables de l’établissement et de l’exploitation d’un Data Lake qui aide les équipes à accéder et à traiter les données pertinentes.

Plateforme d'analyse de données

Notre équipe Data Analytics Platform (DAP) est une équipe axée sur le cloud et le ML chez SIGNAL IDUNA qui maîtrise l'ingénierie ML, l'ingénierie des données ainsi que la science des données. Nous permettons aux équipes internes d'utiliser le cloud public pour le ML en fournissant des composants d'infrastructure et des connaissances. Nos produits et services sont présentés en détail dans la section suivante.

Permettre aux équipes interfonctionnelles de créer des solutions ML

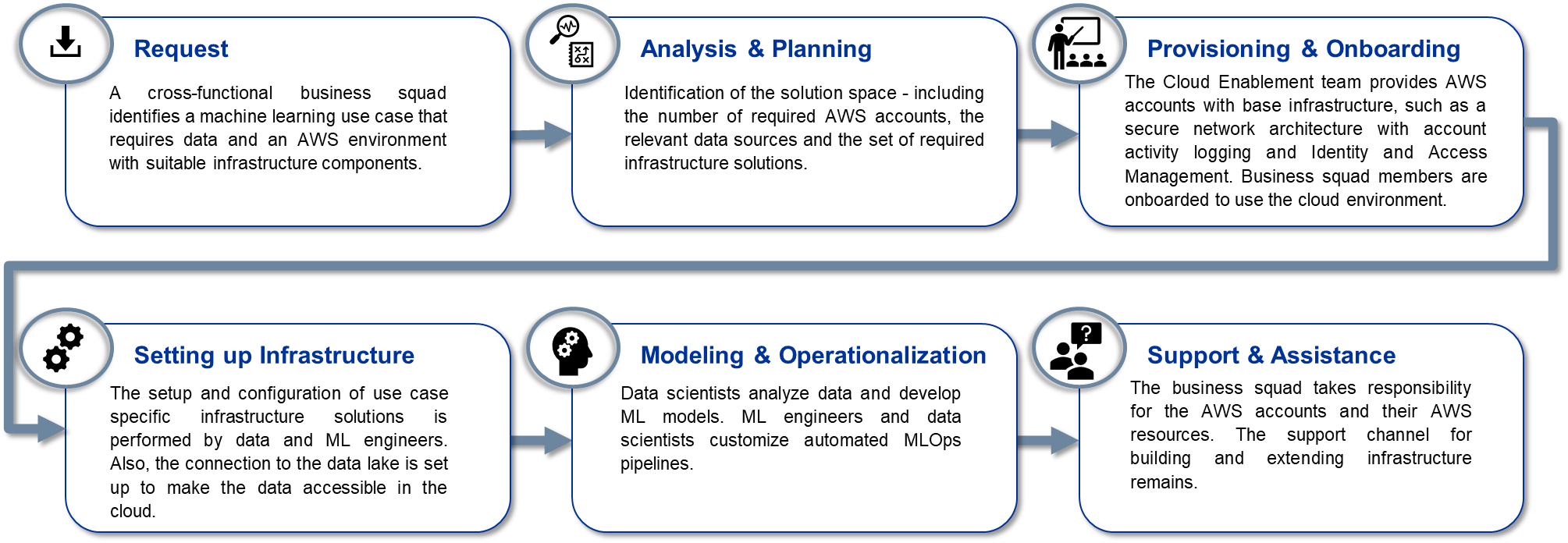

Pour permettre aux équipes interfonctionnelles de SIGNAL IDUNA de créer des solutions de ML, nous avons besoin d'un moyen rapide et polyvalent de provisionner une infrastructure cloud réutilisable ainsi que d'un flux de travail efficace permettant aux équipes d'intégration d'utiliser les capacités du cloud.

À cette fin, nous avons créé un processus d'intégration et de support standardisé, et fourni des modèles d'infrastructure modulaires sous forme d'Infrastructure as Code (IaC). Ces modèles contiennent des composants d'infrastructure conçus pour des cas d'utilisation courants de ML qui peuvent être facilement adaptés aux exigences d'un cas d'utilisation spécifique.

Le flux de travail de création de solutions ML

Il existe trois rôles techniques principaux impliqués dans la création et l'exploitation de solutions ML : le data scientist, l'ingénieur ML et l'ingénieur de données. Chaque rôle fait partie de l’équipe interfonctionnelle et a des responsabilités différentes. Le data scientist possède les connaissances requises dans le domaine des exigences fonctionnelles et techniques du cas d'utilisation. L'ingénieur ML est spécialisé dans la création de solutions ML automatisées et le déploiement de modèles. Et l’ingénieur de données s’assure que les données circulent sur site et dans le cloud.

Le processus de mise à disposition de la plateforme est le suivant :

L'infrastructure du cas d'utilisation spécifique est définie dans IaC et versionnée dans un référentiel de projet central. Cela inclut également des pipelines pour la formation et le déploiement de modèles, ainsi que d'autres artefacts de code liés à la science des données. Les data scientists, les ingénieurs ML et les ingénieurs de données ont accès au référentiel du projet et peuvent configurer et mettre à jour tout le code de l'infrastructure de manière autonome. Cela permet à l’équipe de modifier rapidement l’infrastructure si nécessaire. Cependant, l'ingénieur ML peut toujours aider au développement et à la mise à jour de l'infrastructure ou des modèles ML.

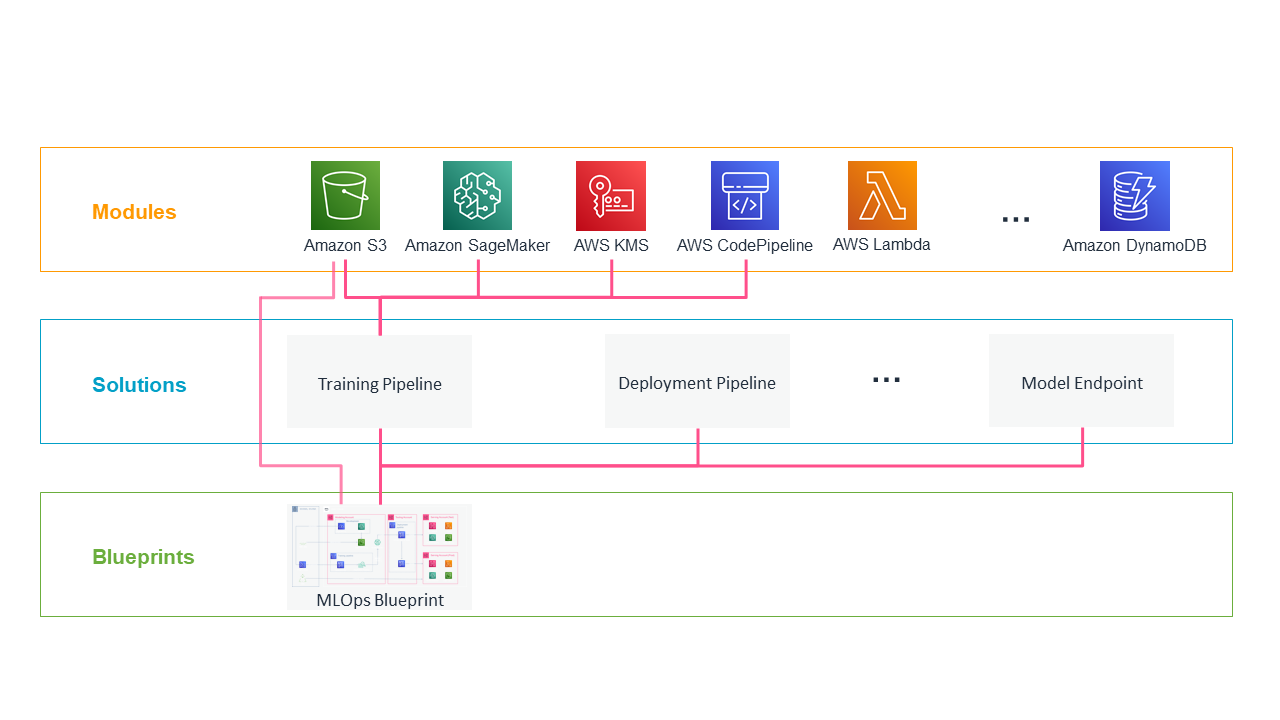

Composants d'infrastructure réutilisables et modulaires

Les ressources IaC hiérarchiques et modulaires sont implémentées dans Terraform et inclure une infrastructure pour la science des données commune et les cas d’utilisation ETL. Cela nous permet de réutiliser le code de l'infrastructure et d'appliquer les politiques de sécurité et de conformité requises, telles que l'utilisation Service de gestion de clés AWS (KMS) le chiffrement des données, ainsi que l'encapsulation de l'infrastructure dans Cloud privé virtuel Amazon (VPC) environnements sans accès direct à Internet.

La structure hiérarchique de l'IaC est la suivante :

- Modules encapsuler les services AWS de base avec la configuration requise pour la sécurité et la gestion des accès. Cela inclut des configurations de bonnes pratiques telles que la prévention de l'accès du public à Service de stockage simple Amazon (S3) buckets, ou en appliquant le cryptage pour tous les fichiers stockés.

- Dans certains cas, vous avez besoin de divers services pour automatiser les processus, par exemple pour déployer des modèles ML à différentes étapes. Nous avons donc défini Solutions comme un ensemble de différents modules dans une configuration commune pour différents types de tâches.

- De plus, nous proposons des Blueprints qui combinent des solutions dans différents environnements pour répondre aux nombreux besoins potentiels d'un projet. Dans notre plan MLOps, nous définissons une infrastructure déployable pour la formation, le provisionnement et la surveillance des modèles ML qui sont intégrés et distribués dans les comptes AWS. Nous discutons plus de détails dans la section suivante.

Ces produits sont versionnés dans un référentiel central par l'équipe DAP. Cela nous permet d'améliorer continuellement notre IaC et d'envisager de nouvelles fonctionnalités d'AWS, telles que Amazon Sage Maker Registre des modèles. Chaque équipe peut référencer ces ressources, les paramétrer selon ses besoins et enfin les déployer dans ses propres comptes AWS.

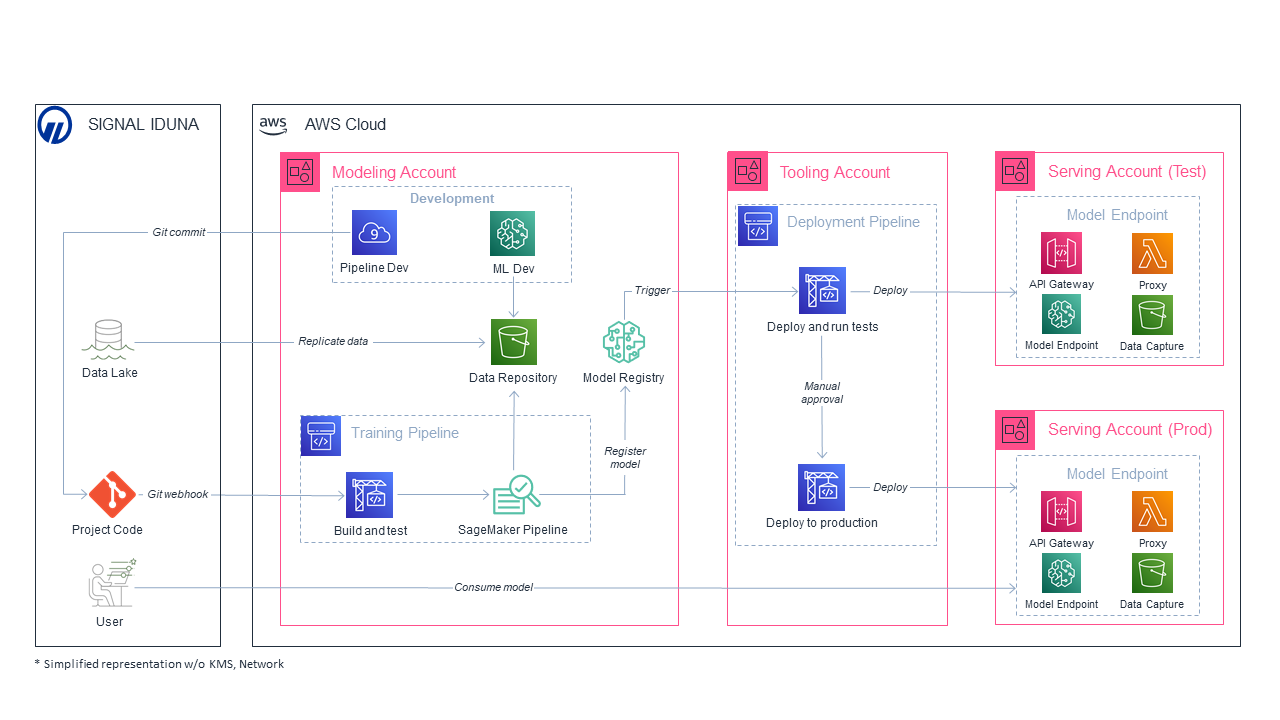

Architecture MLOps

Nous fournissons un plan prêt à l'emploi avec des solutions spécifiques pour couvrir l'ensemble du processus MLOps. Le plan contient une infrastructure répartie sur quatre comptes AWS pour la création et le déploiement de modèles ML. Cela nous permet d'isoler les ressources et les flux de travail pour les différentes étapes du processus MLOps. La figure suivante montre l'architecture multi-comptes et nous décrivons comment la responsabilité sur des étapes spécifiques du processus est répartie entre les différents rôles techniques.

La modélisation statistique Le compte comprend des services pour le développement de modèles ML. Tout d'abord, l'ingénieur de données utilise un processus ETL pour fournir des données pertinentes du lac de données SIGNAL IDUNA, la passerelle centralisée pour les flux de travail basés sur les données dans le cloud AWS. Par la suite, l'ensemble de données peut être utilisé par le data scientist pour former et évaluer des modèles candidats. Une fois prêt pour des expériences approfondies, un candidat modèle est intégré dans un pipeline de formation automatisé par l'ingénieur ML. Nous utilisons Amazon SageMaker Pipelines pour automatiser la formation, le réglage des hyperparamètres et l'évaluation des modèles à grande échelle. Cela inclut également la lignée des modèles et un mécanisme d'approbation standardisé pour les modèles à préparer pour le déploiement en production. Les tests unitaires automatisés et l'analyse du code garantissent la qualité et la fiabilité du code pour chaque étape du pipeline, comme le prétraitement des données, la formation du modèle et l'évaluation. Une fois qu'un modèle est évalué et approuvé, nous utilisons Amazon SageMaker ModelPackages comme interface avec le modèle formé et les métadonnées pertinentes.

La outillage Le compte contient des pipelines CI/CD automatisés avec différentes étapes pour tester et déployer des modèles formés. Lors de la phase de test, les modèles sont déployés dans le service-non-prod compte. Bien que la qualité du modèle soit évaluée dans le pipeline de formation avant que le modèle ne soit préparé pour la production, nous effectuons ici des tests de performances et d'intégration dans un environnement de test isolé. Après avoir passé la phase de test, les modèles sont déployés dans le service-prod compte à intégrer dans les flux de production.

Séparer les étapes du flux de travail MLOps en différents comptes AWS nous permet d'isoler le développement et les tests de la production. Par conséquent, nous pouvons appliquer une politique d’accès et de sécurité stricte. De plus, des rôles IAM personnalisés garantissent que des services spécifiques ne peuvent accéder qu'aux données et autres services requis pour leur portée, conformément aux principe du moindre privilège. Les services au sein des environnements de service peuvent en outre être rendus accessibles aux processus métier externes. Par exemple, un processus métier peut interroger un point de terminaison dans l'environnement de production de service pour obtenir des prédictions de modèle.

Avantages de notre approche

Ce processus présente de nombreux avantages par rapport à une séparation stricte du développement et de l'exploitation à la fois pour les modèles ML, ainsi que pour l'infrastructure requise :

- Isolement: Chaque équipe reçoit son propre ensemble de comptes AWS complètement isolés des environnements des autres équipes. Cela facilite la gestion des droits d'accès et garde les données privées pour ceux qui sont autorisés à travailler avec elles.

- Activation du cloud : Les membres de l’équipe ayant peu d’expérience en DevOps cloud (comme de nombreux data scientists) peuvent facilement suivre l’ensemble du processus de conception et de gestion de l’infrastructure puisque (presque) rien ne leur est caché derrière un service central. Cela crée une meilleure compréhension de l’infrastructure, ce qui peut à son tour les aider à créer des produits de science des données plus efficacement.

- Propriétaire du produit: L'utilisation de solutions d'infrastructure préconfigurées et de services gérés maintient très faible l'obstacle à la gestion d'un produit ML en production. Ainsi, un data scientist peut facilement s’approprier un modèle mis en production. Cela minimise le risque bien connu de ne pas mettre en production un modèle après le développement.

- Innovation: Étant donné que les ingénieurs ML sont impliqués bien avant qu'un modèle soit prêt à être mis en production, ils peuvent créer des solutions d'infrastructure adaptées à de nouveaux cas d'utilisation pendant que les data scientists développent un modèle ML.

- Adaptabilité: Les solutions IaC développées par DAP étant disponibles gratuitement, toute équipe peut facilement les adapter pour répondre à un besoin spécifique de son cas d'utilisation.

- Open source: Toutes les nouvelles solutions d'infrastructure peuvent facilement être mises à disposition via le référentiel de code DAP central pour être utilisées par d'autres équipes. Au fil du temps, cela créera une base de code riche avec des composants d'infrastructure adaptés à différents cas d'utilisation.

Résumé

Dans cet article, nous avons illustré comment les équipes interfonctionnelles de SIGNAL IDUNA peuvent créer et exécuter des produits ML sur AWS. Au cœur de notre approche se trouve l'utilisation d'un ensemble dédié de comptes AWS pour chaque équipe, en combinaison avec des plans et des solutions IaC sur mesure. Ces deux composants permettent à une équipe interfonctionnelle de créer et d’exploiter une infrastructure de qualité de production. À leur tour, ils peuvent s’approprier l’intégralité de leurs produits ML.

Reportez-vous à Pipelines de création de modèles Amazon SageMaker – Amazon SageMaker pour en savoir plus.

Trouvez plus d'informations sur ML sur AWS sur notre page officielle.

Bibliographie

[1] https://www.handelsblatt.com/finanzen/versicherungsbranche-vorbild-spotify-signal-iduna-wird-von-einer-handwerker-versicherung-zum-agilen-konzern/27381902.html

[2] https://blog.crisp.se/wp-content/uploads/2012/11/SpotifyScaling.pdf

[3] https://aws.amazon.com/compliance/shared-responsibility-model/

À propos des auteurs

Jan Paul Assendorp est un ingénieur ML avec une forte spécialisation en science des données. Il crée des modèles ML et automatise la formation des modèles et le déploiement dans des environnements de production.

Jan Paul Assendorp est un ingénieur ML avec une forte spécialisation en science des données. Il crée des modèles ML et automatise la formation des modèles et le déploiement dans des environnements de production.

Thomas Lietzow est le Scrum Master de la plateforme d'analyse de données de l'équipe.

Thomas Lietzow est le Scrum Master de la plateforme d'analyse de données de l'équipe.

Christophe Masch est le propriétaire du produit de la plateforme d'analyse de données Squad avec des connaissances en ingénierie des données, en science des données et en ingénierie ML.

Christophe Masch est le propriétaire du produit de la plateforme d'analyse de données Squad avec des connaissances en ingénierie des données, en science des données et en ingénierie ML.

Alexandre Meinert fait partie de l'équipe Data Analytics Platform et travaille en tant qu'ingénieur ML. J'ai commencé avec les statistiques, j'ai grandi sur des projets de science des données et j'ai découvert une passion pour les méthodes et l'architecture de ML.

Alexandre Meinert fait partie de l'équipe Data Analytics Platform et travaille en tant qu'ingénieur ML. J'ai commencé avec les statistiques, j'ai grandi sur des projets de science des données et j'ai découvert une passion pour les méthodes et l'architecture de ML.

Dr Lars Palzer est un data scientist et fait partie de l’équipe Data Analytics Platform. Après avoir contribué à la création des composants de l'architecture MLOps, il les utilise désormais pour créer des produits ML.

Dr Lars Palzer est un data scientist et fait partie de l’équipe Data Analytics Platform. Après avoir contribué à la création des composants de l'architecture MLOps, il les utilise désormais pour créer des produits ML.

Jan Schillemans est un ingénieur ML avec une formation en génie logiciel. Il se concentre sur l'application des meilleures pratiques d'ingénierie logicielle aux environnements ML (MLOps).

Jan Schillemans est un ingénieur ML avec une formation en génie logiciel. Il se concentre sur l'application des meilleures pratiques d'ingénierie logicielle aux environnements ML (MLOps).

- Coinsmart. Le meilleur échange Bitcoin et Crypto d'Europe.

- Platoblockchain. Intelligence métaverse Web3. Connaissance amplifiée. ACCÈS LIBRE.

- CryptoHawk. Radar Altcoins. Essai gratuit.

- Source : https://aws.amazon.com/blogs/machine-learning/how-signal-iduna-operationalizes-machine-learning-projects-on-aws/

- "

- 100

- 2021

- accès

- Compte

- à travers

- Action

- avantages

- agile

- Tous

- Bien que

- Amazon

- selon une analyse de l’Université de Princeton

- analytique

- Application

- une approche

- architecture

- Automatisation

- disponibles

- AWS

- va

- LES MEILLEURS

- les meilleures pratiques

- construire

- Développement

- Pack de blanchiment

- la performance des entreprises

- capacités

- cas

- challenge

- le cloud

- infrastructure de cloud

- code

- collaboration

- combinaison

- Commun

- Société

- par rapport

- conformité

- configuration

- contient

- La création

- données

- Analyse de Donnée

- science des données

- Data Scientist

- dévoué

- déployer

- déployer

- déploiement

- conception

- détail

- développer

- développé

- développement

- Développement

- différent

- discuter

- distribué

- domaine

- même

- chiffrement

- Endpoint

- ingénieur

- ENGINEERING

- Les ingénieurs

- Environment

- essential

- établir

- exemple

- Découvrez

- RAPIDE

- Fonctionnalités:

- Figure

- finalement

- Prénom

- Focus

- concentré

- Abonnement

- trouvé

- Fondation

- Framework

- plein

- Objectifs

- gouvernance

- aider

- aide

- ici

- Comment

- HTTPS

- image

- mis en œuvre

- important

- améliorer

- comprendre

- d'information

- Infrastructure

- Assurance

- des services

- l'intégration

- Interfaces

- Internet

- impliqué

- IT

- ACTIVITES

- spécialisées

- gros

- APPRENTISSAGE

- apprentissage

- peu

- Location

- click

- machine learning

- gestion

- les gérer

- Marché

- Stratégie

- Match

- Membres

- Meta

- ML

- modèle

- numériques jumeaux (digital twin models)

- application

- Stack monitoring

- Nouvelles fonctionnalités

- produits nouveaux

- code

- officiel

- Onboarding

- d'exploitation

- organisation

- Autre

- propriétaire

- performant

- plateforme

- politiques

- politique

- prédiction

- Prédictions

- Prévention

- Privé

- processus

- les process

- Produit

- Vidéo

- Produits

- Programme

- Projet

- projets

- fournir

- public

- cloud public

- qualité

- dépôt

- conditions

- Exigences

- Ressources

- responsables

- Avis

- Analyse

- Courir

- Escaliers intérieurs

- Sciences

- Scientifique

- scientifiques

- Rechercher

- sécurité

- service

- Services

- service

- set

- commun

- étapes

- Logiciels

- génie logiciel

- Solutions

- spécialise

- passer

- Étape

- Commencer

- j'ai commencé

- statistiques

- storage

- de Marketing

- STRONG

- Par la suite

- Support

- Appareils

- entouré

- tâches

- équipe

- Technique

- Les technologies

- tester

- Essais

- tests

- fiable

- Formation

- De La Carrosserie

- Transparence

- Mises à jour

- us

- utilisé

- utiliser

- Salle de conférence virtuelle

- Montres

- WHO

- dans les

- sans

- Activités principales

- Workforce

- vos contrats