Les jeux en ligne et les communautés sociales offrent des fonctionnalités de chat vocal et textuel permettant à leurs utilisateurs de communiquer. Bien que le chat vocal et textuel favorise souvent les plaisanteries amicales, il peut également entraîner des problèmes tels que des discours de haine, de la cyberintimidation, du harcèlement et des escroqueries. Aujourd’hui, de nombreuses entreprises s’appuient uniquement sur des modérateurs humains pour examiner les contenus toxiques. Cependant, la vérification des violations dans le chat prend du temps, est sujette aux erreurs et est difficile à mettre à l'échelle.

Dans cet article, nous présentons des solutions qui permettent la modération des discussions audio et textuelles à l'aide de divers services AWS, notamment Amazon Transcribe, Amazon comprendre, Socle amazonienet une Service Amazon OpenSearch.

Les plateformes sociales recherchent une solution de modération prête à l’emploi et simple à mettre en œuvre, mais elles nécessitent également une personnalisation pour gérer diverses politiques. La latence et le coût sont également des facteurs critiques à prendre en compte. En orchestrant la classification de la toxicité avec de grands modèles de langage (LLM) à l'aide de l'IA générative, nous proposons une solution qui équilibre simplicité, latence, coût et flexibilité pour répondre à diverses exigences.

L'exemple de code pour cet article est disponible dans le GitHub référentiel.

Flux de travail de modération du chat audio

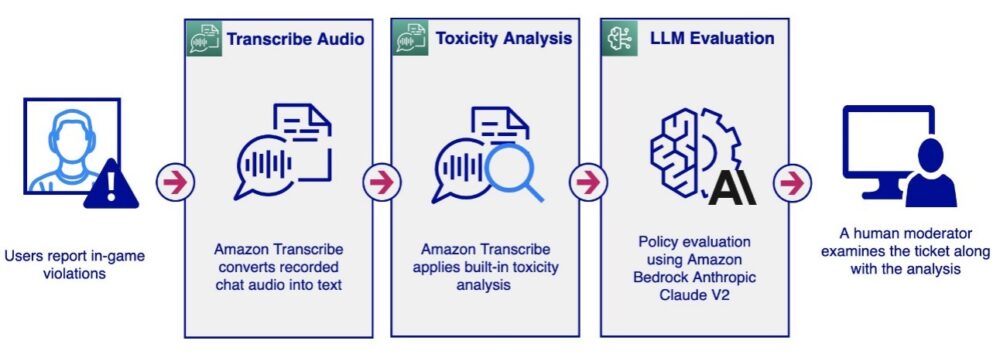

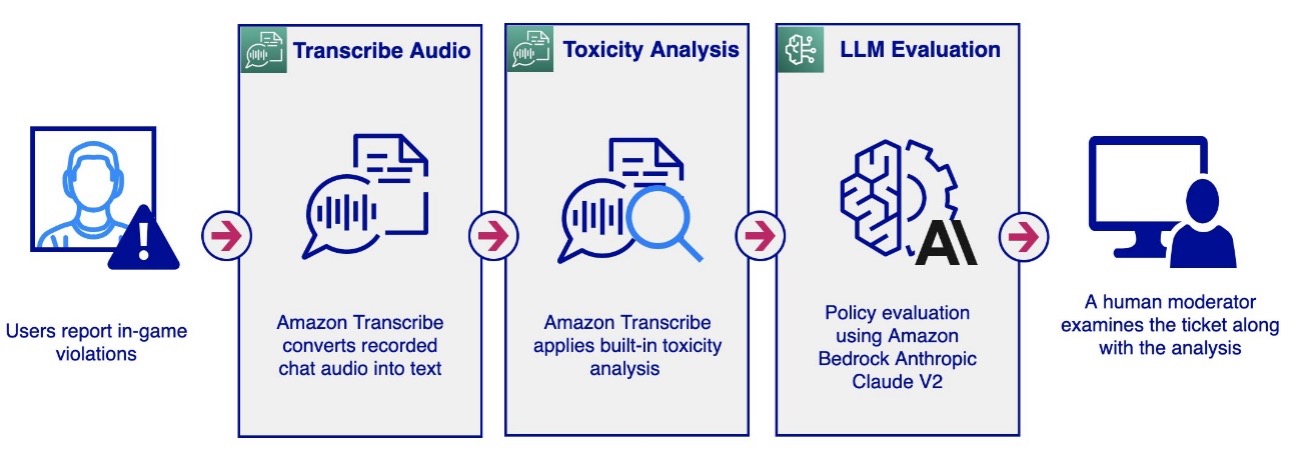

Un flux de travail de modération de chat audio peut être lancé par un utilisateur signalant à d'autres utilisateurs d'une plate-forme de jeu des violations des règles telles que des grossièretés, des discours de haine ou du harcèlement. Cela représente une approche passive de la modération audio. Le système enregistre toutes les conversations audio sans analyse immédiate. Lorsqu'un rapport est reçu, le flux de travail récupère les fichiers audio associés et lance le processus d'analyse. Un modérateur humain examine ensuite la conversation signalée et étudie son contenu pour déterminer si elle enfreint la politique de la plateforme.

Alternativement, le flux de travail pourrait être déclenché de manière proactive. Par exemple, dans une salle de discussion audio sociale, le système pourrait enregistrer toutes les conversations et appliquer une analyse.

Les approches passives et proactives peuvent déclencher le pipeline suivant pour l'analyse audio.

Le workflow de modération audio comprend les étapes suivantes :

- Le flux de travail commence par la réception du fichier audio et son stockage sur un Service de stockage simple Amazon (Amazon S3) auquel Amazon Transcribe peut accéder.

- La transcription d'Amazon

StartTranscriptionJobL'API est invoquée avec Détection de toxicité activé. Amazon Transcribe convertit l'audio en texte, fournissant des informations supplémentaires sur l'analyse de toxicité. Pour plus d'informations sur l'analyse de la toxicité, reportez-vous à Signalez les propos nuisibles dans les conversations orales avec Amazon Transcribe Toxicity Detection. - Si l'analyse de toxicité renvoie un score de toxicité dépassant un certain seuil (par exemple 50%), on peut utiliser Bases de connaissances pour Amazon Bedrock pour évaluer le message par rapport à des politiques personnalisées à l'aide de LLM.

- Le modérateur humain reçoit un rapport de modération audio détaillé mettant en évidence les segments de conversation considérés comme toxiques et en violation de la politique, lui permettant de prendre une décision éclairée.

La capture d'écran suivante montre un exemple d'application affichant une analyse de toxicité pour un segment audio. Il comprend la transcription originale, les résultats de l'analyse de toxicité Amazon Transcribe et l'analyse réalisée à l'aide d'une base de connaissances Amazon Bedrock via le modèle Amazon Bedrock Anthropic Claude V2.

L'analyse LLM fournit un résultat de violation (O ou N) et explique la justification de la décision du modèle concernant la violation de la politique. De plus, la base de connaissances comprend les documents politiques référencés utilisés par l'évaluation, fournissant aux modérateurs un contexte supplémentaire.

Amazon Transcribe Détection de la toxicité

Amazon Transcribe est un service de reconnaissance vocale automatique (ASR) qui permet aux développeurs d'ajouter facilement la fonctionnalité parole-texte à leurs applications. Le flux de travail de modération audio utilise Amazon Transcribe Toxicity Detection, une fonctionnalité basée sur l'apprentissage automatique (ML) qui utilise des signaux audio et textuels pour identifier et classer le contenu toxique vocal dans sept catégories, notamment le harcèlement sexuel, les discours de haine et les menaces. , abus, grossièretés, insultes et langage graphique. En plus d'analyser le texte, la détection de toxicité utilise des indices vocaux tels que les tons et la hauteur pour identifier l'intention toxique dans le discours.

Le workflow de modération audio active l'évaluation de la politique du LLM uniquement lorsque l'analyse de toxicité dépasse un seuil défini. Cette approche réduit la latence et optimise les coûts en appliquant sélectivement les LLM, filtrant une partie importante du trafic.

Utiliser l’ingénierie des invites LLM pour s’adapter aux politiques personnalisées

Les modèles de détection de toxicité pré-entraînés d'Amazon Transcribe et d'Amazon Comprehend fournissent une large taxonomie de toxicité, couramment utilisée par les plateformes sociales pour modérer le contenu généré par les utilisateurs aux formats audio et texte. Bien que ces modèles pré-entraînés détectent efficacement les problèmes avec une faible latence, vous aurez peut-être besoin d'une solution pour détecter les violations des politiques spécifiques de votre entreprise ou de votre domaine d'activité, ce que les modèles pré-entraînés ne peuvent pas réaliser à eux seuls.

De plus, la détection des violations dans les conversations contextuelles, comme l'identification toilettage sexuel des enfants conversations, nécessite une solution personnalisable qui implique de prendre en compte les messages de discussion et le contexte en dehors de ceux-ci, comme l'âge, le sexe et l'historique des conversations de l'utilisateur. C'est là que les LLM peuvent offrir la flexibilité nécessaire pour étendre ces exigences.

Amazon Bedrock est un service entièrement géré qui offre un choix de modèles de base (FM) hautes performances provenant de grandes sociétés d'IA. Ces solutions utilisent Anthropic Claude v2 d'Amazon Bedrock pour modérer les transcriptions audio et les messages de discussion textuels à l'aide d'un modèle d'invite flexible, comme indiqué dans le code suivant :

Le modèle contient des espaces réservés pour la description de la politique, le message de discussion et des règles supplémentaires nécessitant une modération. Le modèle Anthropic Claude V2 fournit des réponses dans le format indiqué (O ou N), ainsi qu'une analyse expliquant pourquoi il pense que le message viole la politique. Cette approche vous permet de définir des catégories de modération flexibles et d'articuler vos politiques en langage humain.

La méthode traditionnelle de formation d'un modèle de classification interne implique des processus fastidieux tels que l'annotation des données, la formation, les tests et le déploiement du modèle, nécessitant l'expertise de data scientists et d'ingénieurs ML. Les LLM, en revanche, offrent un haut degré de flexibilité. Les utilisateurs professionnels peuvent modifier les invites en langage humain, ce qui entraîne une efficacité améliorée et une réduction des cycles d'itération dans la formation du modèle ML.

Bases de connaissances Amazon Bedrock

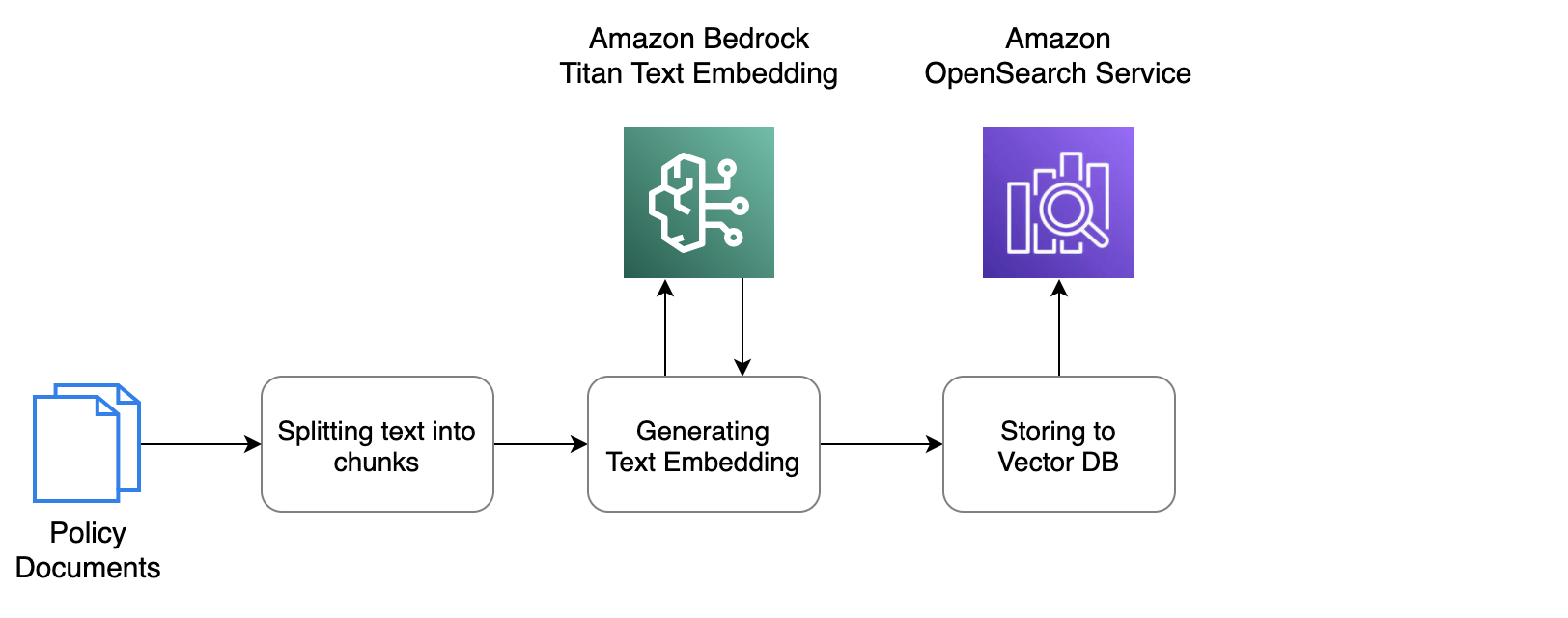

Bien que l’ingénierie des invites soit efficace pour personnaliser les politiques, l’injection de politiques et de règles longues directement dans les invites LLM pour chaque message peut introduire une latence et augmenter les coûts. Pour résoudre ce problème, nous utilisons les bases de connaissances Amazon Bedrock comme système géré de génération augmentée de récupération (RAG). Cela vous permet de gérer le document de politique de manière flexible, permettant au flux de travail de récupérer uniquement les segments de politique pertinents pour chaque message d'entrée. Cela minimise le nombre de jetons envoyés aux LLM pour analyse.

Vous pouvez utiliser le Console de gestion AWS pour télécharger les documents de politique dans un compartiment S3, puis indexer les documents dans une base de données vectorielle pour une récupération efficace. Ce qui suit est un flux de travail conceptuel géré par une base de connaissances Amazon Bedrock qui récupère des documents d'Amazon S3, divise le texte en morceaux et appelle le Modèle d'intégration de texte Amazon Bedrock Titan pour convertir les morceaux de texte en vecteurs, qui sont ensuite stockés dans la base de données de vecteurs.

Dans cette solution, on utilise Service Amazon OpenSearch comme magasin de vecteurs. Opensearch est une suite logicielle open source évolutive, flexible et extensible pour les applications de recherche, d'analyse, de surveillance de la sécurité et d'observabilité, sous licence Apache 2.0. OpenSearch Service est un service entièrement géré qui facilite le déploiement, la mise à l'échelle et l'exploitation d'OpenSearch dans le cloud AWS.

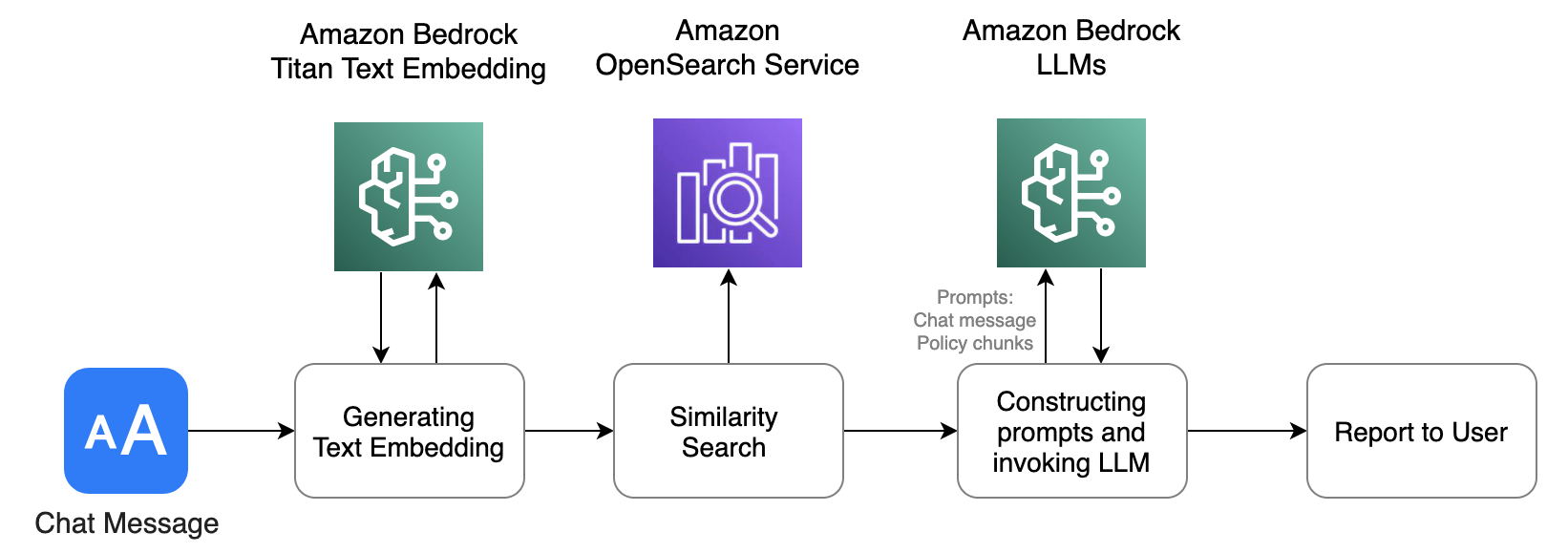

Une fois le document indexé dans OpenSearch Service, le flux de travail de modération audio et texte envoie des messages de discussion, déclenchant le flux de requête suivant pour une évaluation personnalisée des politiques.

Le processus est similaire au workflow d'initiation. Tout d'abord, le message texte est converti en intégrations de texte à l'aide de l'API Amazon Bedrock Titan Text Embedding. Ces intégrations sont ensuite utilisées pour effectuer une recherche de vecteur par rapport à la base de données OpenSearch Service, qui a déjà été remplie d'intégrations de documents. La base de données renvoie les morceaux de stratégie avec le score de correspondance le plus élevé, correspondant au message texte saisi. Nous composons ensuite des invites contenant à la fois le message de discussion d'entrée et le segment de politique, qui sont envoyés à Anthropic Claude V2 pour évaluation. Le modèle LLM renvoie un résultat d'analyse basé sur les instructions d'invite.

Pour obtenir des instructions détaillées sur la façon de créer une nouvelle instance avec votre document de stratégie dans une base de connaissances Amazon Bedrock, reportez-vous à Les bases de connaissances offrent désormais une expérience RAG entièrement gérée dans Amazon Bedrock.

Flux de travail de modération du chat textuel

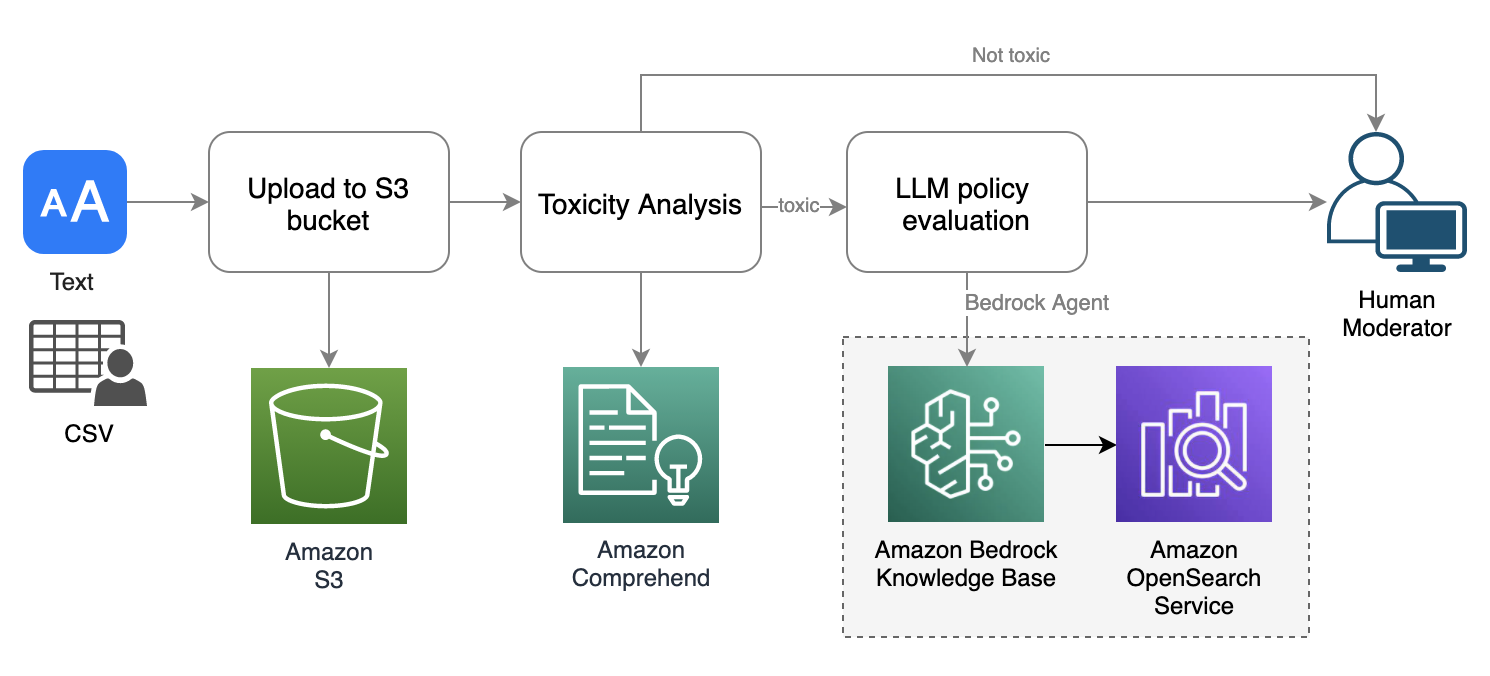

Le flux de travail de modération des discussions textuelles suit un modèle similaire à la modération audio, mais il utilise l'analyse de toxicité Amazon Comprehend, qui est adaptée à la modération des textes. L'exemple d'application prend en charge une interface pour le téléchargement de fichiers texte en masse au format CSV ou TXT et fournit une interface à message unique pour des tests rapides. Le diagramme suivant illustre le flux de travail.

Le workflow de modération de texte comprend les étapes suivantes :

- L'utilisateur télécharge un fichier texte dans un compartiment S3.

- L'analyse de toxicité Amazon Comprehend est appliquée au message texte.

- Si l'analyse de toxicité renvoie un score de toxicité dépassant un certain seuil (par exemple, 50 %), nous utilisons une base de connaissances Amazon Bedrock pour évaluer le message par rapport à des politiques personnalisées à l'aide du LLM Anthropic Claude V2.

- Un rapport d’évaluation de la politique est envoyé au modérateur humain.

Analyse de toxicité Amazon Comprehend

Dans le flux de travail de modération de texte, nous utilisons l'analyse de toxicité Amazon Comprehend pour évaluer le niveau de toxicité des messages texte. Amazon Comprehend est un service de traitement du langage naturel (NLP) qui utilise le ML pour découvrir des informations et des connexions précieuses dans le texte. L'API de détection de toxicité Amazon Comprehend attribue un score de toxicité global au contenu du texte, allant de 0 à 1, indiquant la probabilité qu'il soit toxique. Il classe également le texte dans les catégories suivantes et fournit un score de confiance pour chacune : hate_speech, graphique, harrassement_or_abuse, sexuel, violence_or_threat, insulte et grossièreté.

Dans ce flux de travail de modération de texte, l'analyse de toxicité d'Amazon Comprehend joue un rôle crucial pour identifier si le message texte entrant contient un contenu toxique. Semblable au workflow de modération audio, il inclut une condition pour activer l'évaluation de la politique LLM en aval uniquement lorsque l'analyse de toxicité renvoie un score dépassant un seuil prédéfini. Cette optimisation permet de réduire la latence globale et les coûts associés à l'analyse LLM.

Résumé

Dans cet article, nous avons présenté des solutions de modération des discussions audio et textuelles à l'aide des services AWS, notamment Amazon Transcribe, Amazon Comprehend, Amazon Bedrock et OpenSearch Service. Ces solutions utilisent des modèles pré-entraînés pour l'analyse de toxicité et sont orchestrées avec des LLM d'IA génératives pour atteindre l'équilibre optimal entre précision, latence et coût. Ils vous permettent également de définir avec flexibilité vos propres politiques.

Vous pouvez découvrir l'exemple d'application en suivant les instructions dans le GitHub repo.

A propos de l'auteure

Lana Zhang est architecte de solutions senior au sein de l'équipe AWS WWSO AI Services, spécialisée dans l'IA et le ML pour la modération de contenu, la vision par ordinateur, le traitement du langage naturel et l'IA générative. Grâce à son expertise, elle se consacre à la promotion des solutions AWS AI/ML et à aider les clients à transformer leurs solutions commerciales dans divers secteurs, notamment les médias sociaux, les jeux, le commerce électronique, les médias, la publicité et le marketing.

Lana Zhang est architecte de solutions senior au sein de l'équipe AWS WWSO AI Services, spécialisée dans l'IA et le ML pour la modération de contenu, la vision par ordinateur, le traitement du langage naturel et l'IA générative. Grâce à son expertise, elle se consacre à la promotion des solutions AWS AI/ML et à aider les clients à transformer leurs solutions commerciales dans divers secteurs, notamment les médias sociaux, les jeux, le commerce électronique, les médias, la publicité et le marketing.

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- PlatoData.Network Ai générative verticale. Autonomisez-vous. Accéder ici.

- PlatoAiStream. Intelligence Web3. Connaissance Amplifiée. Accéder ici.

- PlatonESG. Carbone, Technologie propre, Énergie, Environnement, Solaire, La gestion des déchets. Accéder ici.

- PlatoHealth. Veille biotechnologique et essais cliniques. Accéder ici.

- La source: https://aws.amazon.com/blogs/machine-learning/moderate-audio-and-text-chats-using-aws-ai-services-and-llms/

- :possède

- :est

- :ne pas

- :où

- 100

- 118

- 14

- 7

- a

- A Propos

- abus

- accès

- accommoder

- Compte

- précision

- atteindre

- à travers

- activer

- ajouter

- ajout

- Supplémentaire

- renseignements supplémentaires

- propos

- Numérique

- à opposer à

- âge

- AI

- Services d'IA

- AI / ML

- Tous

- Permettre

- permet

- seul

- le long de

- déjà

- aussi

- Bien que

- Amazon

- Amazon comprendre

- Amazon Transcribe

- Amazon Web Services

- an

- selon une analyse de l’Université de Princeton

- analytique

- l'analyse

- ainsi que

- Anthropique

- Apache

- api

- appli

- Application

- applications

- appliqué

- Appliquer

- Application

- une approche

- approches

- SONT

- AS

- Evaluer

- aider

- Assistante gérante

- assistant

- associé

- At

- acoustique

- augmentée

- auteur

- Automatique

- disponibles

- AWS

- Balance

- soldes

- base

- basé

- BE

- était

- commence

- derrière

- va

- tous les deux

- Rupture

- vaste

- la performance des entreprises

- mais

- by

- CAN

- aptitude

- catégories

- certaines

- difficile

- le chat

- chats

- le choix

- classification

- Classer

- le cloud

- code

- communément

- communiquer

- Communautés

- Sociétés

- Société

- comprendre

- ordinateur

- Vision par ordinateur

- conceptuel

- condition

- menée

- confiance

- Connexions

- Considérer

- considéré

- considérant

- contient

- contenu

- contexte

- contextuel

- contraste

- Conversation

- conversations

- convertir

- converti

- Prix

- Costs

- pourriez

- engendrent

- critique

- crucial

- lourd

- Clients

- personnalisables

- personnalisation

- sont adaptées

- cycles

- données

- Base de données

- décider

- décision

- dévoué

- Vous permet de définir

- Degré

- offre

- déployer

- déploiement

- la description

- détaillé

- détecter

- Détection

- Déterminer

- mobiles

- diagramme

- directement

- afficher

- plusieurs

- document

- INSTITUTIONNELS

- domaine

- down

- e-commerce

- chacun

- efficace

- efficace

- efficacement

- non plus

- enrobage

- vous accompagner

- permettre

- activé

- permet

- ENGINEERING

- Les ingénieurs

- améliorée

- évaluer

- évaluation

- exemple

- dépassement

- dépasse

- d'experience

- expert

- nous a permis de concevoir

- expliquant

- Explique

- étendre

- facteurs

- Déposez votre dernière attestation

- Fichiers

- filtration

- Trouvez

- Prénom

- Flexibilité

- flexible

- flexible

- flux

- Abonnement

- suit

- Pour

- le format

- Fondation

- friendly

- De

- d’étiquettes électroniques entièrement

- En outre

- jeux

- Plateforme de jeu

- Genre

- génération

- génératif

- IA générative

- Graphique

- nuisible

- haine

- aide

- ici

- Haute

- haute performance

- le plus élevé

- Soulignant

- Histoire

- Comment

- How To

- Cependant

- HTML

- http

- HTTPS

- humain

- identifier

- identifier

- if

- illustre

- Immédiat

- in

- inclut

- Y compris

- Nouveau

- Améliore

- indice

- indexé

- indique

- indiquant

- secteurs

- d'information

- Actualités

- initier

- initié

- Initie

- initiation

- contribution

- idées.

- instance

- Des instructions

- Insulter

- intention

- Interfaces

- développement

- introduire

- introduit

- enquête

- invoqué

- invoque

- implique

- vous aider à faire face aux problèmes qui vous perturbent

- IT

- itération

- SES

- Emploi

- jpg

- XNUMX éléments à

- spécialisées

- langue

- gros

- Latence

- conduire

- conduisant

- apprentissage

- Niveau

- Licence

- Autorisé

- probabilité

- LLM

- Faible

- click

- machine learning

- a prendre une

- FAIT DU

- gérer

- gérés

- gestion

- les gérer

- de nombreuses

- Stratégie

- assorti

- Mai..

- veux dire

- Médias

- message

- messages

- méthode

- minimise

- ML

- modèle

- numériques jumeaux (digital twin models)

- modérée

- modérer

- modération

- modifier

- Stack monitoring

- PLUS

- must

- Nature

- Traitement du langage naturel

- Besoin

- nécessaire

- Nouveauté

- nlp

- maintenant

- nombre

- of

- code

- Offres Speciales

- souvent

- on

- uniquement

- ouvert

- open source

- fonctionner

- optimaux

- à mettre en œuvre pour gérer une entreprise rentable. Ce guide est basé sur trois décennies d'expérience

- Optimise

- or

- orchestrée

- orchestrer

- original

- Autre

- ande

- décrit

- au contrôle

- global

- propre

- passif

- Patron de Couture

- Effectuer

- pipeline

- Emplacement

- plateforme

- Plateformes

- Platon

- Intelligence des données Platon

- PlatonDonnées

- joue

- veuillez cliquer

- politiques

- politique

- peuplé

- partieInvestir dans des appareils économes en énergie et passer à l'éclairage

- Post

- prédéfini

- Cybersécurité

- d'ouvrabilité

- processus

- les process

- traitement

- IMPIÉTÉ

- la promotion de

- instructions

- fournir

- fournit

- aportando

- question

- Rapide

- chiffon

- allant

- raisonnement

- reçu

- reçoit

- recevoir

- reconnaissance

- record

- Articles

- réduire

- Prix Réduit

- réduit

- reportez-vous

- référencé

- en ce qui concerne

- en relation

- pertinent

- compter

- rapport

- Signalé

- Rapports

- représente

- exigent

- Exigences

- a besoin

- Réagir

- réponses

- résultat

- Résultats

- récupération

- Retours

- Avis

- Avis

- Rôle

- Salle

- Règle

- des

- Sécurité

- échantillon

- répondre

- évolutive

- Escaliers intérieurs

- les escroqueries

- scientifiques

- But

- Rechercher

- Section

- sécurité

- Chercher

- clignotant

- segments

- envoie

- supérieur

- envoyé

- service

- Services

- set

- sept

- Sexuel

- elle

- Spectacles

- significative

- similaires

- étapes

- simplicité

- Réseaux sociaux

- réseaux sociaux

- plateformes sociales

- Logiciels

- uniquement

- sur mesure

- Solutions

- Identifier

- spécialisation

- groupe de neurones

- discours

- Reconnaissance vocale

- parole-texte

- splits

- parlé

- Étapes

- storage

- Boutique

- stockée

- stockage

- simple

- tel

- suite

- Support

- Les soutiens

- combustion propre

- TAG

- tâches

- taxonomie

- équipe

- modèle

- Essais

- texte

- qui

- La

- leur

- Les

- puis

- Ces

- l'ont

- Pense

- this

- des menaces

- порог

- Avec

- long

- Titan

- à

- aujourd'hui

- Tokens

- traditionnel

- circulation

- Formation

- transformer

- déclencher

- déclenché

- déclenchement

- La confiance

- devoiler

- sous

- Téléchargement

- utilisé

- d'utiliser

- Utilisateur

- utilisateurs

- Usages

- en utilisant

- Précieux

- divers

- vérifier

- VIOLATION

- Violations

- vision

- Voix

- we

- web

- services Web

- quand

- que

- qui

- tout en

- why

- Wikipédia

- sera

- comprenant

- dans les

- sans

- des mots

- workflow

- Vous n'avez

- Votre

- zéphyrnet