Amazon Reconnaissance est un service de vision par ordinateur qui simplifie l'ajout d'analyses d'images et de vidéos à vos applications à l'aide d'une technologie d'apprentissage en profondeur éprouvée et hautement évolutive qui ne nécessite pas d'expertise en apprentissage automatique (ML). Avec Amazon Rekognition, vous pouvez identifier des objets, des personnes, du texte, des scènes et des activités dans des images et des vidéos et détecter le contenu inapproprié. Amazon Rekognition fournit également des fonctionnalités d'analyse faciale et de recherche faciale très précises que vous pouvez utiliser pour détecter, analyser et comparer les visages pour une grande variété de cas d'utilisation.

Étiquettes personnalisées Amazon Rekognition est une fonctionnalité d'Amazon Rekognition qui simplifie la création de vos propres capacités spécialisées d'analyse d'images basées sur ML pour détecter des objets et des scènes uniques faisant partie intégrante de votre cas d'utilisation spécifique.

Certains cas d'utilisation courants des étiquettes personnalisées Rekognition incluent la recherche de votre logo dans les publications sur les réseaux sociaux, l'identification de vos produits sur les étagères des magasins, la classification des pièces de machine dans une chaîne de montage, la distinction entre les plantes saines et infectées, et plus encore.

Étiquettes de reconnaissance Amazon prend en charge des sites populaires tels que le pont de Brooklyn, le Colisée, la tour Eiffel, le Machu Picchu, le Taj Mahal, et plus. Si vous avez d'autres points de repère ou bâtiments qui ne sont pas encore pris en charge par Amazon Rekognition, vous pouvez toujours utiliser les étiquettes personnalisées Amazon Rekognition.

Dans cet article, nous montrons comment utiliser Rekognition Custom Labels pour détecter le bâtiment Amazon Spheres à Seattle.

Avec Rekognition Custom Labels, AWS s'occupe du gros du travail pour vous. Rekognition Custom Labels s'appuie sur les capacités existantes d'Amazon Rekognition, qui est déjà formé sur des dizaines de millions d'images dans de nombreuses catégories. Au lieu de milliers d'images, il vous suffit de télécharger un petit ensemble d'images de formation (généralement quelques centaines d'images ou moins) spécifiques à votre cas d'utilisation via notre console simple. Amazon Rekognition peut commencer la formation en quelques clics. Une fois qu'Amazon Rekognition a commencé l'entraînement à partir de votre ensemble d'images, il peut produire un modèle d'analyse d'image personnalisé pour vous en quelques minutes ou quelques heures. Dans les coulisses, Rekognition Custom Labels charge et inspecte automatiquement les données de formation, sélectionne les algorithmes ML appropriés, forme un modèle et fournit des mesures de performance du modèle. Vous pouvez ensuite utiliser votre modèle personnalisé via l'API Rekognition Custom Labels et l'intégrer dans vos applications.

Vue d'ensemble de la solution

Pour notre exemple, nous utilisons le Sphères amazoniennes bâtiment à Seattle. Nous formons un modèle à l'aide d'étiquettes personnalisées Rekognition ; chaque fois que des images similaires sont utilisées, l'algorithme doit l'identifier comme Amazon Spheres au lieu de Dome, Architecture, Glass building, ou d'autres étiquettes.

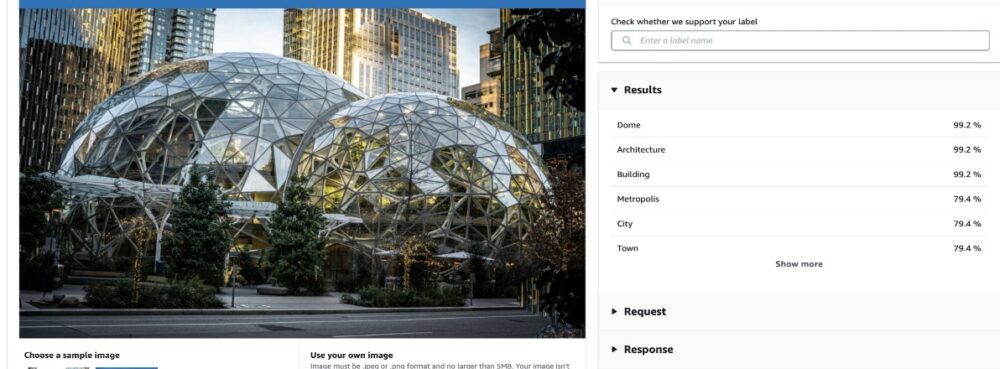

Montrons d'abord un exemple d'utilisation de la fonctionnalité de détection d'étiquettes d'Amazon Rekognition, où nous alimentons l'image d'Amazon Spheres sans aucune formation personnalisée. Nous utilisons la console Amazon Rekognition pour ouvrir la démo de détection d'étiquettes et télécharger notre photo.

Une fois l'image téléchargée et analysée, nous voyons des étiquettes avec leurs scores de confiance sous Résultats. Dans ce cas, Dome a été détecté avec un score de confiance de 99.2 %, Architecture avec 99.2%, Building avec 99.2%, Metropolis avec 79.4%, et ainsi de suite.

Nous voulons utiliser un étiquetage personnalisé pour produire un modèle de vision par ordinateur qui peut étiqueter l'image Amazon Spheres.

Dans les sections suivantes, nous vous expliquons comment préparer votre jeu de données, créer un projet d'étiquettes personnalisées Rekognition, entraîner le modèle, évaluer les résultats et le tester avec des images supplémentaires.

Pré-requis

Avant de commencer les étapes, il y a quotas pour les étiquettes personnalisées Rekognition dont vous devez être conscient. Si vous souhaitez modifier les limites, vous pouvez demander un augmentation de la limite de service.

Créez votre jeu de données

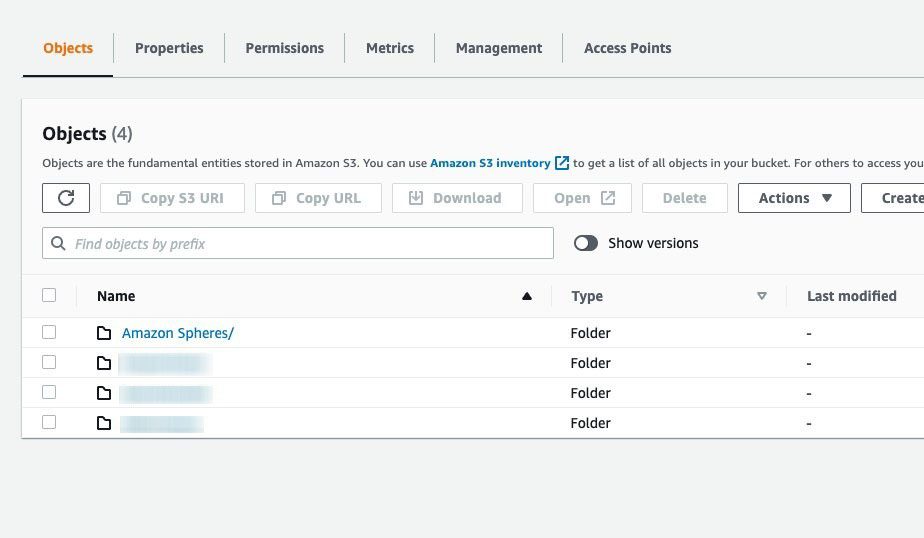

Si c'est la première fois que vous utilisez les étiquettes personnalisées de Rekognition, vous serez invité à créer un Service de stockage simple Amazon (Amazon S3) pour stocker votre ensemble de données.

Pour cette démonstration de blog, nous avons utilisé des images des sphères amazoniennes, que nous avons capturées lors de notre visite à Seattle, WA. N'hésitez pas à utiliser vos propres images selon vos besoins.

Copiez votre ensemble de données dans le compartiment nouvellement créé, qui stocke vos images dans leurs préfixes respectifs.

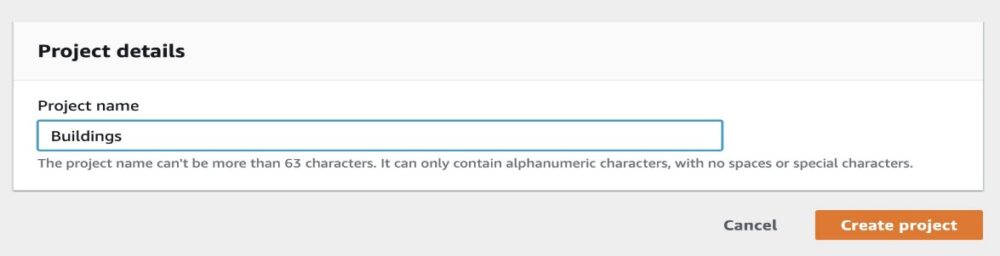

Créer un projet

Pour créer votre projet d'étiquettes personnalisées Rekognition, procédez comme suit :

- Dans la console Étiquettes personnalisées de Rekognition, choisissez Créer un projet.

- Pour Nom du projet, entrez un nom.

- Selectionnez Créer un projet.

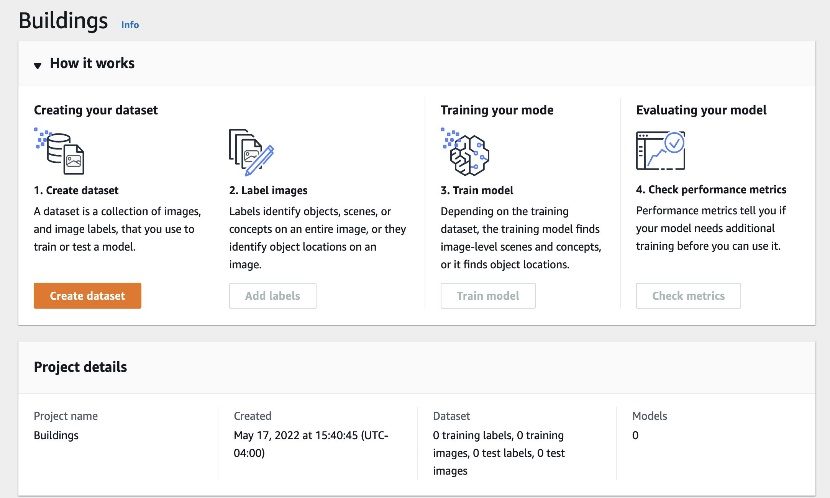

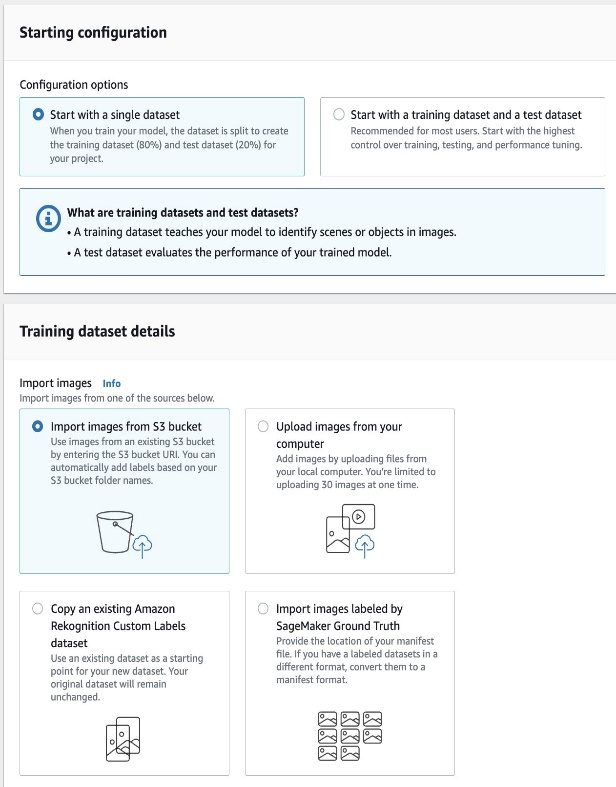

Nous spécifions maintenant la configuration et le chemin de votre ensemble de données d'entraînement et de test. - Selectionnez Créer un jeu de données.

Vous pouvez commencer avec un projet qui a un seul ensemble de données ou un projet qui a des ensembles de données d'apprentissage et de test distincts. Si vous commencez avec un seul jeu de données, Rekognition Custom Labels divise votre jeu de données pendant la formation pour créer un jeu de données de formation (80 %) et un jeu de données de test (20 %) pour votre projet.

De plus, vous pouvez créer des ensembles de données d'entraînement et de test pour un projet en important des images à partir de l'un des emplacements suivants :

Pour cet article, nous utilisons notre propre ensemble de données personnalisé d'Amazon Spheres.

- Sélectionnez Commencez avec un seul ensemble de données.

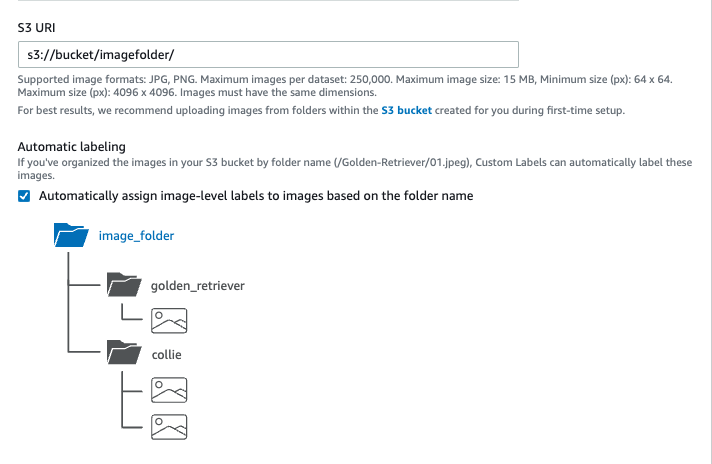

- Sélectionnez Importer des images à partir du compartiment S3.

- Pour URI S3, entrez le chemin d'accès à votre compartiment S3.

- Si vous souhaitez que Rekognition Custom Labels étiquette automatiquement les images pour vous en fonction des noms de dossier dans votre compartiment S3, sélectionnez Attribuez automatiquement des étiquettes au niveau de l'image aux images en fonction du nom du dossier.

- Selectionnez Créer un jeu de données.

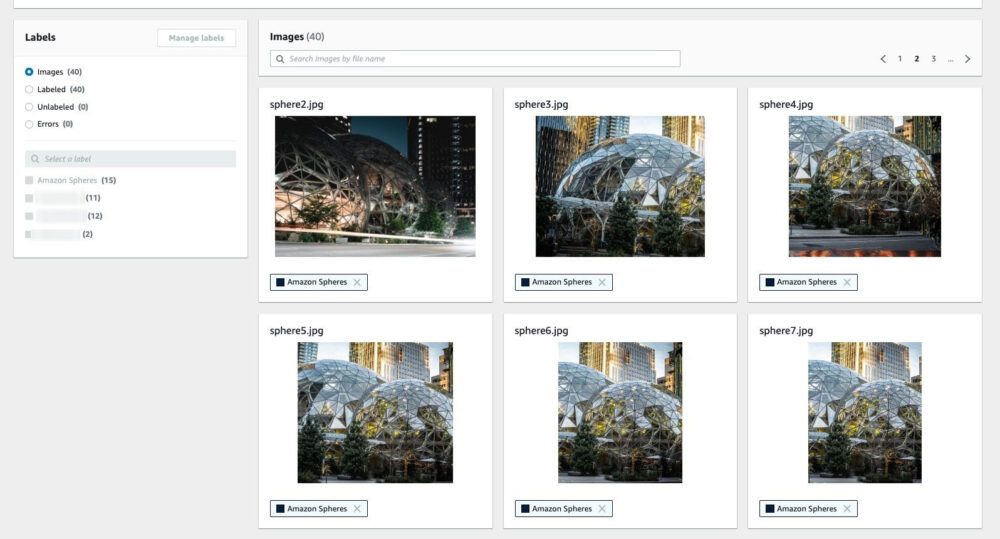

Une page s'ouvre qui vous montre les images avec leurs étiquettes. Si vous voyez des erreurs dans les étiquettes, consultez Déboguer des ensembles de données.

Former le modèle

Après avoir examiné votre ensemble de données, vous pouvez maintenant entraîner le modèle.

- Selectionnez modèle de train.

- Pour Choisissez un projet, saisissez l'ARN de votre projet s'il n'est pas déjà répertorié.

- Selectionnez Modèle de train.

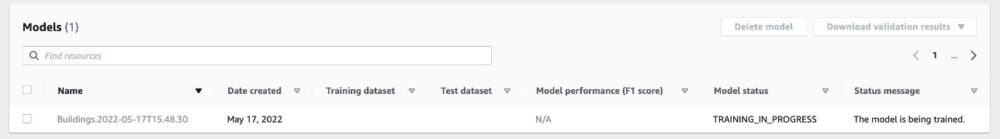

Dans le Des modèles photo section de la page du projet, vous pouvez vérifier l'état actuel dans la Statut du modèle colonne, où la formation est en cours. Le temps de formation prend généralement entre 30 minutes et 24 heures, en fonction de plusieurs facteurs tels que le nombre d'images et le nombre d'étiquettes dans l'ensemble de formation, et les types d'algorithmes ML utilisés pour former votre modèle.

Lorsque la formation du modèle est terminée, vous pouvez voir l'état du modèle comme TRAINING_COMPLETED. Si la formation échoue, reportez-vous à Débogage d'une formation de modèle ayant échoué.

Évaluer le modèle

Ouvrez la page des détails du modèle. La Evaluation L'onglet affiche les métriques pour chaque étiquette et la métrique moyenne pour l'ensemble du jeu de données de test.

La console Rekognition Custom Labels fournit les métriques suivantes sous forme de résumé des résultats de la formation et de métriques pour chaque étiquette :

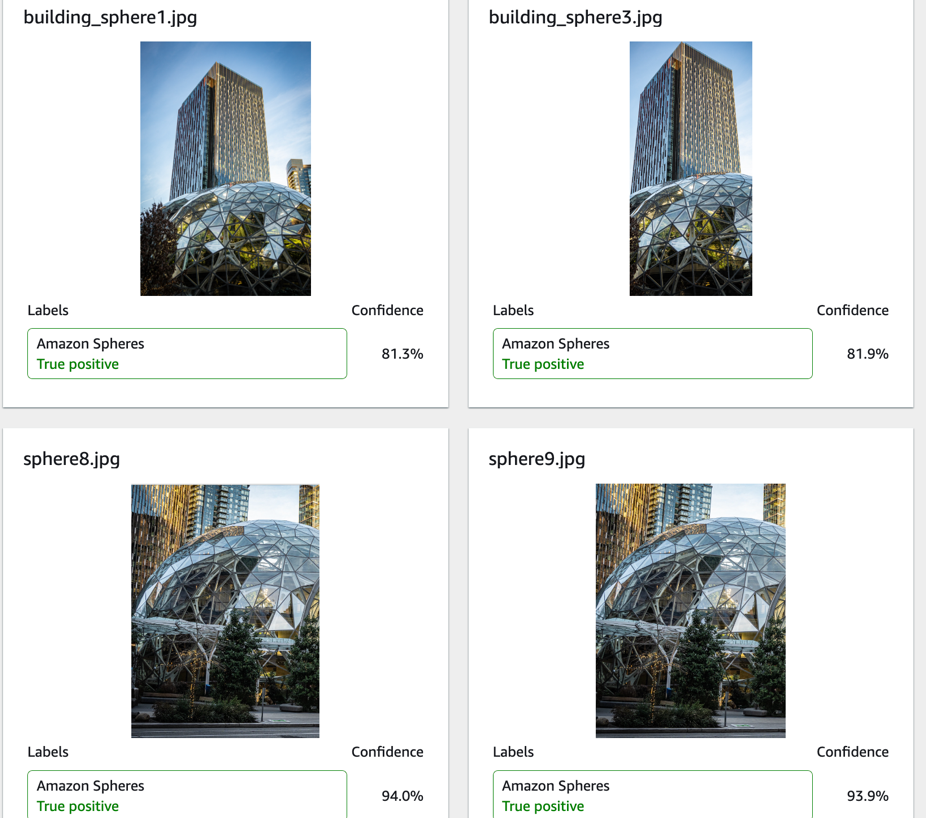

Vous pouvez afficher les résultats de votre modèle formé pour des images individuelles, comme illustré dans la capture d'écran suivante.

Tester le modèle

Maintenant que nous avons vu les résultats de l'évaluation, nous sommes prêts à démarrer le modèle et à analyser de nouvelles images.

Vous pouvez démarrer le modèle sur le Utiliser le modèle de la console Rekognition Custom Labels ou en utilisant l'onglet Démarrer la version du projet fonctionnement via le Interface de ligne de commande AWS (AWS CLI) ou SDK Python.

Lorsque le modèle est en cours d'exécution, nous pouvons analyser les nouvelles images à l'aide du Détecter les étiquettes personnalisées API. Le résultat de DetectCustomLabels est une prédiction que l'image contient des objets, des scènes ou des concepts spécifiques. Voir le code suivant :

Dans la sortie, vous pouvez voir l'étiquette avec son score de confiance :

Comme vous pouvez le voir sur le résultat, en quelques clics, vous pouvez utiliser les étiquettes personnalisées Rekognition pour obtenir des résultats d'étiquetage précis. Vous pouvez l'utiliser pour une multitude de cas d'utilisation d'images, tels que l'identification d'un étiquetage personnalisé pour les produits alimentaires, les animaux domestiques, les pièces de machines, etc.

Nettoyer

Pour nettoyer les ressources que vous avez créées dans le cadre de cet article et éviter d'éventuels coûts récurrents, procédez comme suit :

- Sur le Utiliser le modèle languette, arrêter le modèle.

Vous pouvez également arrêter le modèle à l'aide de la ArrêterVersionProjet opération via l'AWS CLI ou Python SDK. Attendez que le modèle soit dans leStoppedétat avant de passer aux étapes suivantes. - Supprimer le modèle.

- Supprimer le projet.

- Supprimer le jeu de données.

- Vide le contenu du bucket S3 et effacer le seau.

Conclusion

Dans cet article, nous avons montré comment utiliser les étiquettes personnalisées Rekognition pour détecter les images de bâtiments.

Vous pouvez commencer avec vos ensembles de données d'images personnalisées et, en quelques clics simples sur la console Rekognition Custom Labels, vous pouvez entraîner votre modèle et détecter des objets dans les images. Rekognition Custom Labels peut automatiquement charger et inspecter les données, sélectionner les bons algorithmes ML, former un modèle et fournir des métriques de performance du modèle. Vous pouvez consulter des mesures de performances détaillées telles que la précision, le rappel, les scores F1 et les scores de confiance.

Le jour est venu où nous pouvons désormais identifier des bâtiments populaires comme l'Empire State Building à New York, le Taj Mahal en Inde et bien d'autres à travers le monde pré-étiquetés et prêts à être utilisés pour l'intelligence dans vos applications. Mais si vous avez d'autres points de repère qui ne sont pas encore pris en charge par les étiquettes Amazon Rekognition, ne cherchez pas plus loin et essayez les étiquettes personnalisées Amazon Rekognition.

Pour plus d'informations sur l'utilisation d'étiquettes personnalisées, voir Qu'est-ce que les étiquettes personnalisées Amazon Rekognition? Aussi, visitez notre GitHub repo pour un flux de travail de bout en bout de détection de marque personnalisée Amazon Rekognition.

À propos des auteurs:

Suresh Patnam est un principal BDM - GTM AI/ML Leader chez AWS. Il travaille avec les clients pour élaborer une stratégie informatique, rendant la transformation numérique via le cloud plus accessible en tirant parti des données et de l'IA/ML. Dans ses temps libres, Suresh aime jouer au tennis et passer du temps avec sa famille.

Suresh Patnam est un principal BDM - GTM AI/ML Leader chez AWS. Il travaille avec les clients pour élaborer une stratégie informatique, rendant la transformation numérique via le cloud plus accessible en tirant parti des données et de l'IA/ML. Dans ses temps libres, Suresh aime jouer au tennis et passer du temps avec sa famille.

Lapin Kaushik est architecte de solutions chez AWS. Il est passionné par la création de solutions AI/ML sur AWS et aide les clients à innover sur la plate-forme AWS. En dehors du travail, il aime faire de la randonnée, de l'escalade et de la natation.

Lapin Kaushik est architecte de solutions chez AWS. Il est passionné par la création de solutions AI/ML sur AWS et aide les clients à innover sur la plate-forme AWS. En dehors du travail, il aime faire de la randonnée, de l'escalade et de la natation.

- AI

- art de l'IA

- générateur d'art ai

- robot IA

- Amazon Reconnaissance

- intelligence artificielle

- certification en intelligence artificielle

- intelligence artificielle en banque

- robot d'intelligence artificielle

- robots d'intelligence artificielle

- logiciel d'intelligence artificielle

- Apprentissage automatique AWS

- blockchain

- conférence blockchain ai

- cognitif

- intelligence artificielle conversationnelle

- crypto conférence ai

- de dall

- l'apprentissage en profondeur

- google ai

- machine learning

- Platon

- platon ai

- Intelligence des données Platon

- Jeu de Platon

- PlatonDonnées

- jeu de platogamie

- échelle ai

- syntaxe

- zéphyrnet