AutoML vous permet d'obtenir rapidement des informations générales à partir de vos données dès le début du cycle de vie d'un projet d'apprentissage automatique (ML). Comprendre dès le départ quelles techniques de prétraitement et quels types d'algorithmes fournissent les meilleurs résultats réduit le temps nécessaire pour développer, former et déployer le bon modèle. Il joue un rôle crucial dans le processus de développement de chaque modèle et permet aux data scientists de se concentrer sur les techniques de ML les plus prometteuses. De plus, AutoML fournit des performances de modèle de base qui peuvent servir de point de référence à l'équipe de science des données.

Un outil AutoML applique une combinaison de différents algorithmes et diverses techniques de prétraitement à vos données. Par exemple, il peut mettre à l'échelle les données, effectuer une sélection de caractéristiques univariées, effectuer une PCA à différents niveaux de seuil de variance et appliquer un clustering. De telles techniques de prétraitement pourraient être appliquées individuellement ou être combinées dans un pipeline. Par la suite, un outil AutoML entraînerait différents types de modèles, tels que la régression linéaire, Elastic-Net ou Random Forest, sur différentes versions de votre ensemble de données prétraité et effectuerait une optimisation des hyperparamètres (HPO). Pilote automatique Amazon SageMaker élimine le gros du travail lié à la création de modèles ML. Après avoir fourni l'ensemble de données, SageMaker Autopilot explore automatiquement différentes solutions pour trouver le meilleur modèle. Mais que se passe-t-il si vous souhaitez déployer votre version personnalisée d'un workflow AutoML ?

Cet article montre comment créer un workflow AutoML personnalisé sur Amazon Sage Maker en utilisant Réglage automatique du modèle Amazon SageMaker avec un exemple de code disponible dans un Repo GitHub.

Vue d'ensemble de la solution

Pour ce cas d'utilisation, supposons que vous fassiez partie d'une équipe de science des données qui développe des modèles dans un domaine spécialisé. Vous avez développé un ensemble de techniques de prétraitement personnalisées et sélectionné un certain nombre d'algorithmes qui, selon vous, fonctionneront généralement correctement avec votre problème de ML. Lorsque vous travaillez sur de nouveaux cas d'utilisation de ML, vous souhaitez d'abord effectuer une exécution AutoML à l'aide de vos techniques et algorithmes de prétraitement pour affiner la portée des solutions potentielles.

Pour cet exemple, vous n'utilisez pas d'ensemble de données spécialisé ; à la place, vous travaillez avec l'ensemble de données California Housing que vous importerez à partir de Service de stockage simple Amazon (Amazon S3). L'objectif est de démontrer la mise en œuvre technique de la solution à l'aide de SageMaker HPO, qui peut ensuite être appliquée à n'importe quel ensemble de données et domaine.

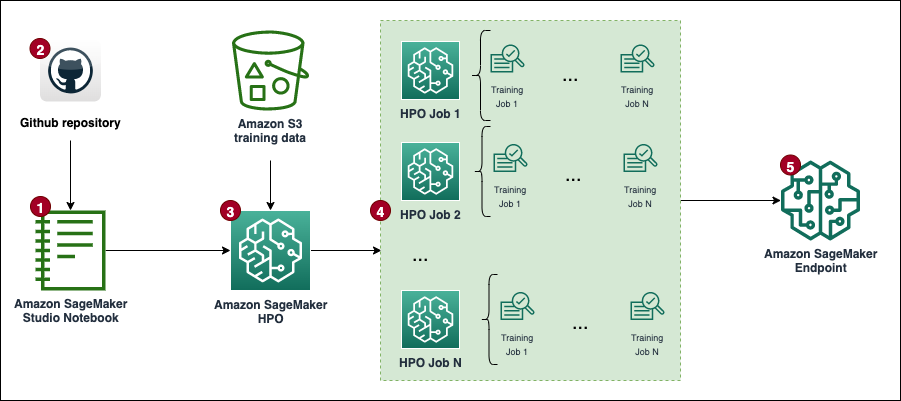

Le diagramme suivant présente le flux de travail global de la solution.

Pré-requis

Les conditions préalables suivantes sont requises pour effectuer la procédure pas à pas présentée dans cet article :

Mettre en œuvre la solution

Le code complet est disponible dans le GitHub repo.

Les étapes de mise en œuvre de la solution (comme indiqué dans le diagramme de flux de travail) sont les suivantes :

- Créer une instance de bloc-notes et précisez les éléments suivants :

- Pour Type d'instance de notebook, choisissez ml.t3.moyen.

- Pour Inférence élastique, choisissez aucun.

- Pour Identifiant de la plate-forme, choisissez Amazon Linux 2, Jupyter Lab 3.

- Pour Rôle IAM, choisissez la valeur par défaut

AmazonSageMaker-ExecutionRole. S'il n'existe pas, créez-en un nouveau Gestion des identités et des accès AWS (IAM) et attachez le Politique IAM AmazonSageMakerFullAccess.

Notez que vous devez créer un rôle d’exécution et une stratégie d’étendue minimale en production.

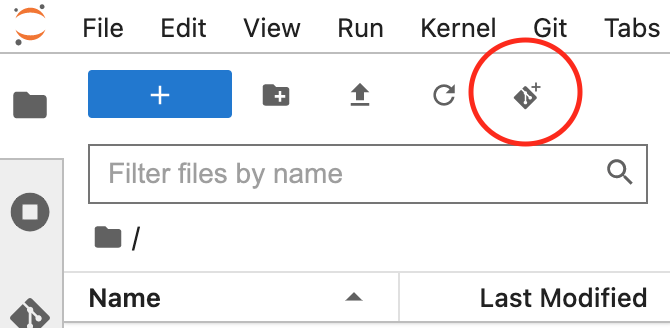

- Ouvrez l'interface JupyterLab pour votre instance de notebook et clonez le dépôt GitHub.

Vous pouvez le faire en démarrant une nouvelle session de terminal et en exécutant le git clone <REPO> ou en utilisant la fonctionnalité de l'interface utilisateur, comme indiqué dans la capture d'écran suivante.

- Ouvrez le

automl.ipynbfichier notebook, sélectionnez leconda_python3noyau et suivez les instructions pour déclencher un ensemble d'emplois HPO.

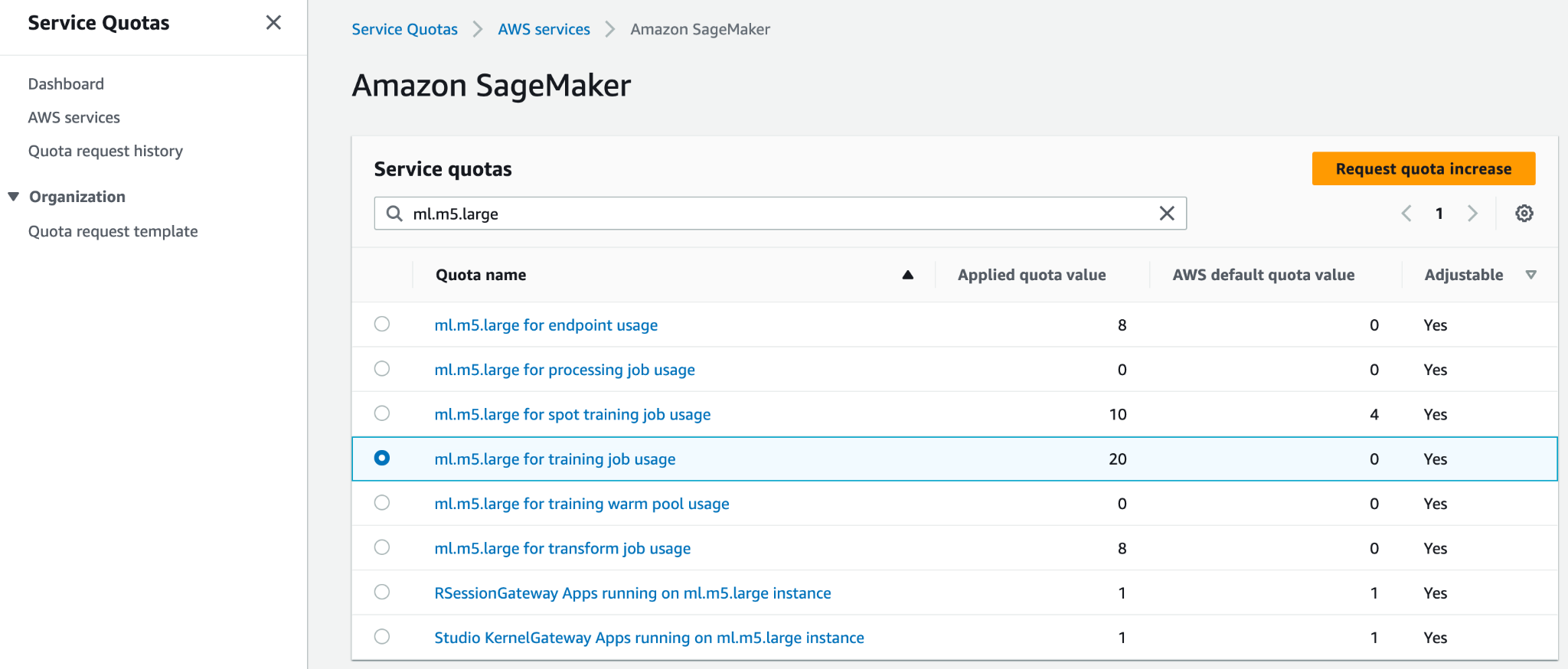

Pour exécuter le code sans aucune modification, vous devez augmenter le quota de service pour ml.m5.large pour l'utilisation des tâches de formation ainsi que le Nombre d'instances dans toutes les tâches de formation. AWS autorise par défaut uniquement 20 tâches de formation SageMaker parallèles pour les deux quotas. Vous devez demander une augmentation du quota à 30 pour les deux. Les deux modifications de quota devraient généralement être approuvées en quelques minutes. Faire référence à Demander une augmentation de quota pour plus d'information.

Si vous ne souhaitez pas modifier le quota, vous pouvez simplement modifier la valeur du MAX_PARALLEL_JOBS variable dans le script (par exemple, à 5).

- Chaque travail HPO complétera un ensemble de emploi de formation essais et indiquer le modèle avec les hyperparamètres optimaux.

- Analyser les résultats et déployer le modèle le plus performant.

Cette solution entraînera des frais sur votre compte AWS. Le coût de cette solution dépendra du nombre et de la durée des emplois de formation HPO. À mesure que ceux-ci augmentent, les coûts augmenteront également. Vous pouvez réduire les coûts en limitant le temps de formation et en configurant TuningJobCompletionCriteriaConfig selon les instructions discutées plus loin dans cet article. Pour obtenir des informations sur les prix, reportez-vous à Tarification d'Amazon SageMaker.

Dans les sections suivantes, nous discutons du notebook plus en détail avec des exemples de code et les étapes pour analyser les résultats et sélectionner le meilleur modèle.

La configuration initiale

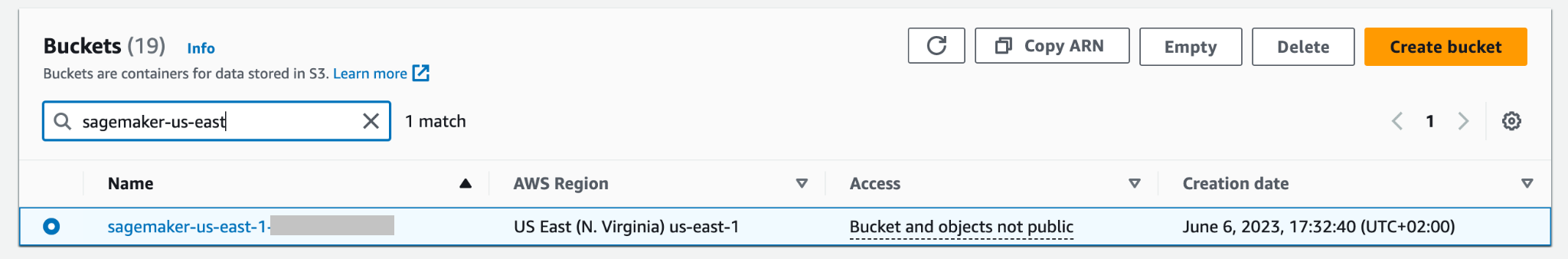

Commençons par exécuter le Importations et configuration section dans le custom-automl.ipynb carnet de notes. Il installe et importe toutes les dépendances requises, instancie une session et un client SageMaker et définit la région et le compartiment S3 par défaut pour le stockage des données.

Préparation des données

Téléchargez l'ensemble de données California Housing et préparez-le en exécutant le Télécharger les données section du cahier. L'ensemble de données est divisé en trames de données de formation et de test et téléchargé dans le compartiment S3 par défaut de la session SageMaker.

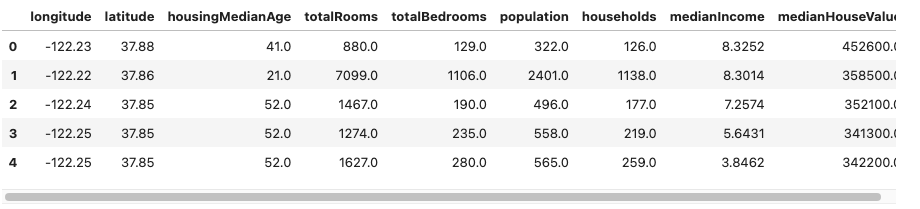

L'ensemble de données contient 20,640 9 enregistrements et XNUMX colonnes au total, y compris la cible. L'objectif est de prédire la valeur médiane d'une maison (medianHouseValue colonne). La capture d'écran suivante montre les premières lignes de l'ensemble de données.

Modèle de script de formation

Le flux de travail AutoML de cet article est basé sur scikit-apprendre pipelines et algorithmes de prétraitement. L’objectif est de générer une large combinaison de différents pipelines et algorithmes de prétraitement pour trouver la configuration la plus performante. Commençons par créer un script de formation générique, qui est conservé localement sur l'instance de notebook. Dans ce script, il y a deux blocs de commentaires vides : un pour l'injection d'hyperparamètres et l'autre pour l'objet pipeline du modèle de prétraitement. Ils seront injectés dynamiquement pour chaque modèle candidat de prétraitement. Le but d'avoir un script générique est de garder l'implémentation DRY (ne vous répétez pas).

Créer des combinaisons de prétraitement et de modèles

La preprocessors Le dictionnaire contient une spécification des techniques de prétraitement appliquées à toutes les fonctionnalités d'entrée du modèle. Chaque recette est définie à l'aide d'un Pipeline ou FeatureUnion objet de scikit-learn, qui enchaîne les transformations de données individuelles et les empile ensemble. Par exemple, mean-imp-scale est une recette simple qui garantit que les valeurs manquantes sont imputées à l'aide des valeurs moyennes des colonnes respectives et que toutes les caractéristiques sont mises à l'échelle à l'aide de la Échelle standard. En revanche, le mean-imp-scale-pca la recette enchaîne quelques opérations supplémentaires :

- Imputez les valeurs manquantes dans les colonnes avec leur moyenne.

- Appliquez la mise à l'échelle des caractéristiques en utilisant la moyenne et l'écart type.

- Calculez la PCA au-dessus des données d'entrée à une valeur de seuil de variance spécifiée et fusionnez-la avec les caractéristiques d'entrée imputées et mises à l'échelle.

Dans cet article, toutes les fonctionnalités d'entrée sont numériques. Si vous avez plus de types de données dans votre ensemble de données d'entrée, vous devez spécifier un pipeline plus complexe dans lequel différentes branches de prétraitement sont appliquées à différents ensembles de types d'entités.

La models Le dictionnaire contient les spécifications de différents algorithmes auxquels vous adaptez l'ensemble de données. Chaque type de modèle est accompagné de la spécification suivante dans le dictionnaire :

- script_output – Indique l'emplacement du script de formation utilisé par l'estimateur. Ce champ est rempli dynamiquement lorsque le

modelsle dictionnaire est combiné avec lepreprocessorsdictionnaire. - insertions – Définit le code qui sera inséré dans le

script_draft.pypuis enregistré sousscript_output. La clé“preprocessor”est intentionnellement laissé vide car cet emplacement est rempli par l'un des préprocesseurs afin de créer plusieurs combinaisons modèle-préprocesseur. - hyperparamètres – Un ensemble d'hyperparamètres optimisés par le travail HPO.

- include_cls_metadata – Plus de détails de configuration requis par SageMaker

Tunerclasse.

Un exemple complet de models Le dictionnaire est disponible dans le référentiel GitHub.

Ensuite, parcourons le preprocessors ainsi que le models dictionnaires et créez toutes les combinaisons possibles. Par exemple, si votre preprocessors Le dictionnaire contient 10 recettes et vous avez 5 définitions de modèles dans le models dictionnaire, le dictionnaire de pipelines nouvellement créé contient 50 pipelines de modèle de préprocesseur qui sont évalués lors de HPO. Notez que les scripts de pipeline individuels ne sont pas encore créés à ce stade. Le bloc de code suivant (cellule 9) du notebook Jupyter parcourt tous les objets de modèle de préprocesseur dans le pipelines dictionnaire, insère tous les éléments de code pertinents et conserve localement une version spécifique au pipeline du script dans le notebook. Ces scripts sont utilisés dans les étapes suivantes lors de la création d'estimateurs individuels que vous branchez au travail HPO.

Définir des estimateurs

Vous pouvez maintenant travailler sur la définition des estimateurs SageMaker que le travail HPO utilise une fois les scripts prêts. Commençons par créer une classe wrapper qui définit certaines propriétés communes à tous les estimateurs. Il hérite du SKLearn classe et spécifie le rôle, le nombre d'instances et le type, ainsi que les colonnes utilisées par le script comme fonctionnalités et cible.

Construisons le estimators dictionnaire en parcourant tous les scripts générés auparavant et situés dans le scripts annuaire. Vous instanciez un nouvel estimateur en utilisant le SKLearnBase classe, avec un nom d'estimateur unique et l'un des scripts. Notez que le estimators Le dictionnaire comporte deux niveaux : le niveau supérieur définit un pipeline_family. Il s'agit d'un regroupement logique basé sur le type de modèles à évaluer et qui est égal à la longueur du models dictionnaire. Le deuxième niveau contient des types de préprocesseurs individuels combinés avec les pipeline_family. Ce regroupement logique est requis lors de la création du travail HPO.

Définir les arguments du tuner HPO

Pour optimiser la transmission des arguments dans le HPO Tuner classe, le HyperparameterTunerArgs La classe de données est initialisée avec les arguments requis par la classe HPO. Il est livré avec un ensemble de fonctions qui garantissent que les arguments HPO sont renvoyés dans un format attendu lors du déploiement simultané de plusieurs définitions de modèle.

Le bloc de code suivant utilise le code introduit précédemment HyperparameterTunerArgs classe de données. Vous créez un autre dictionnaire appelé hp_args et générer un ensemble de paramètres d'entrée spécifiques à chaque estimator_family du estimators dictionnaire. Ces arguments sont utilisés à l'étape suivante lors de l'initialisation des tâches HPO pour chaque famille de modèles.

Créer des objets tuner HPO

Au cours de cette étape, vous créez des tuners individuels pour chaque estimator_family. Pourquoi créez-vous trois tâches HPO distinctes au lieu d’en lancer une seule sur tous les estimateurs ? Le HyperparameterTuner La classe est limitée à 10 définitions de modèles qui lui sont attachées. Par conséquent, chaque HPO est chargé de trouver le préprocesseur le plus performant pour une famille de modèles donnée et de régler les hyperparamètres de cette famille de modèles.

Voici quelques points supplémentaires concernant la configuration :

- La stratégie d'optimisation est bayésienne, ce qui signifie que le HPO surveille activement les performances de tous les essais et oriente l'optimisation vers des combinaisons d'hyperparamètres plus prometteuses. L'arrêt anticipé doit être réglé sur de or Automatique lorsque vous travaillez avec une stratégie bayésienne, qui gère cette logique elle-même.

- Chaque tâche HPO s'exécute pour un maximum de 100 tâches et exécute 10 tâches en parallèle. Si vous traitez des ensembles de données plus volumineux, vous souhaiterez peut-être augmenter le nombre total de tâches.

- De plus, vous souhaiterez peut-être utiliser des paramètres qui contrôlent la durée d'exécution d'une tâche et le nombre de tâches déclenchées par votre HPO. Une façon de procéder consiste à définir la durée d'exécution maximale en secondes (pour cet article, nous la fixons à 1 heure). Une autre consiste à utiliser le logiciel récemment publié

TuningJobCompletionCriteriaConfig. Il propose un ensemble de paramètres qui surveillent la progression de vos tâches et décident s'il est probable que davantage de tâches amélioreront le résultat. Dans cet article, nous avons fixé à 20 le nombre maximum de tâches de formation ne s'améliorant pas. De cette façon, si le score ne s'améliore pas (par exemple, à partir du quarantième essai), vous n'aurez pas à payer pour les essais restants jusqu'à ce quemax_jobsest atteinte.

Parcourons maintenant le tuners ainsi que le hp_args dictionnaires et déclencher toutes les tâches HPO dans SageMaker. Notez l'utilisation de l'argument wait défini sur False, ce qui signifie que le noyau n'attendra pas que les résultats soient complets et que vous puissiez déclencher toutes les tâches en même temps.

Il est probable que tous les emplois de formation ne seront pas terminés et que certains d'entre eux seront interrompus par l'emploi HPO. La raison en est la TuningJobCompletionCriteriaConfig: l'optimisation se termine si l'un des critères spécifiés est rempli. Dans ce cas, lorsque les critères d'optimisation ne s'améliorent pas pendant 20 tâches consécutives.

Analyser les résultats

La cellule 15 du cahier vérifie si toutes les tâches HPO sont terminées et combine tous les résultats sous la forme d'une trame de données pandas pour une analyse plus approfondie. Avant d'analyser les résultats en détail, jetons un coup d'œil de haut niveau à la console SageMaker.

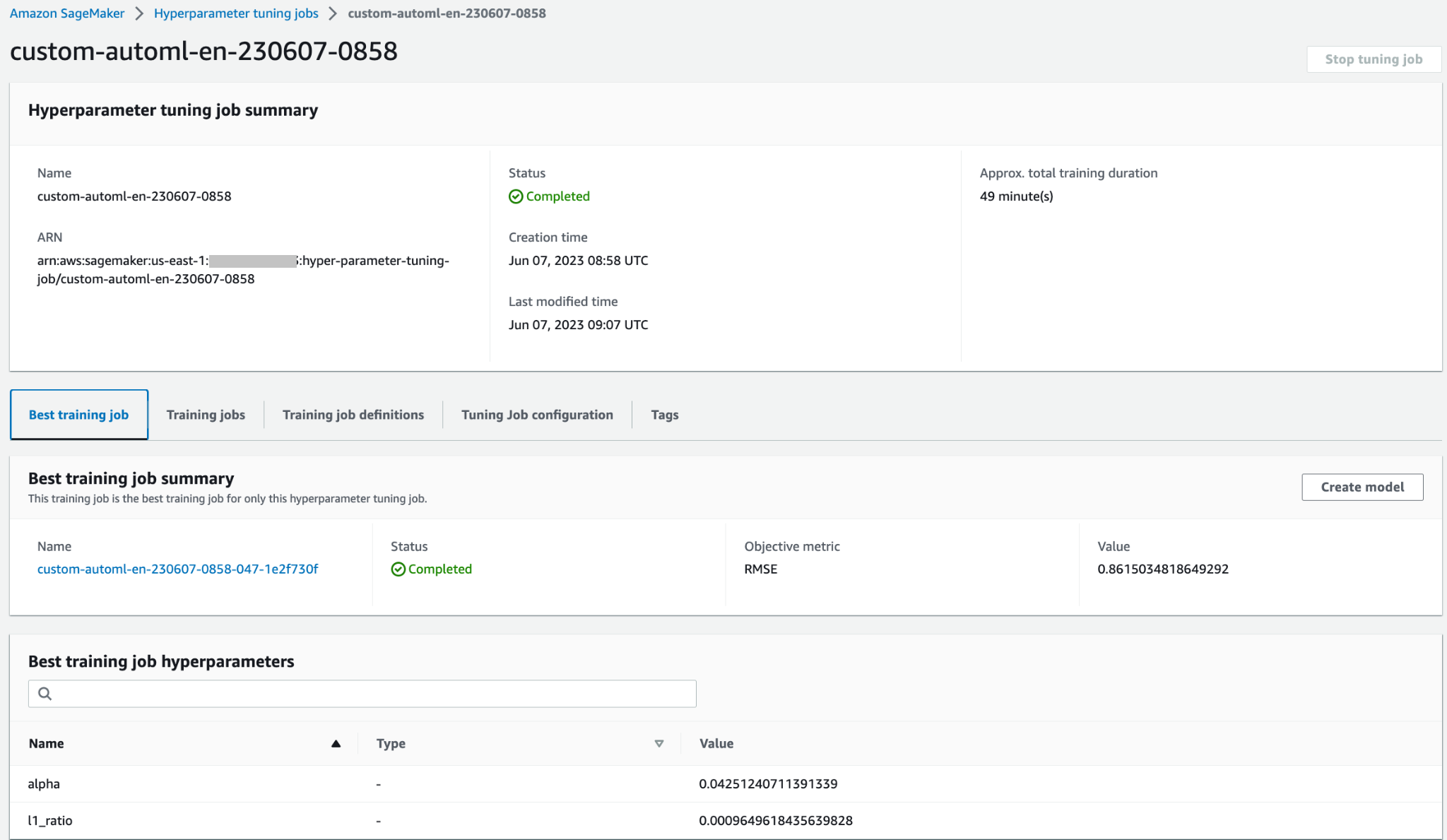

Au sommet de l' Tâches de réglage d'hyperparamètres page, vous pouvez voir vos trois tâches HPO lancées. Tous ont terminé tôt et n'ont pas effectué les 100 tâches de formation. Dans la capture d'écran suivante, vous pouvez voir que la famille de modèles Elastic-Net a effectué le plus grand nombre d'essais, alors que d'autres n'ont pas eu besoin d'autant de tâches de formation pour obtenir le meilleur résultat.

Vous pouvez ouvrir la tâche HPO pour accéder à plus de détails, tels que les tâches de formation individuelles, la configuration des tâches, ainsi que les meilleures informations et performances de la tâche de formation.

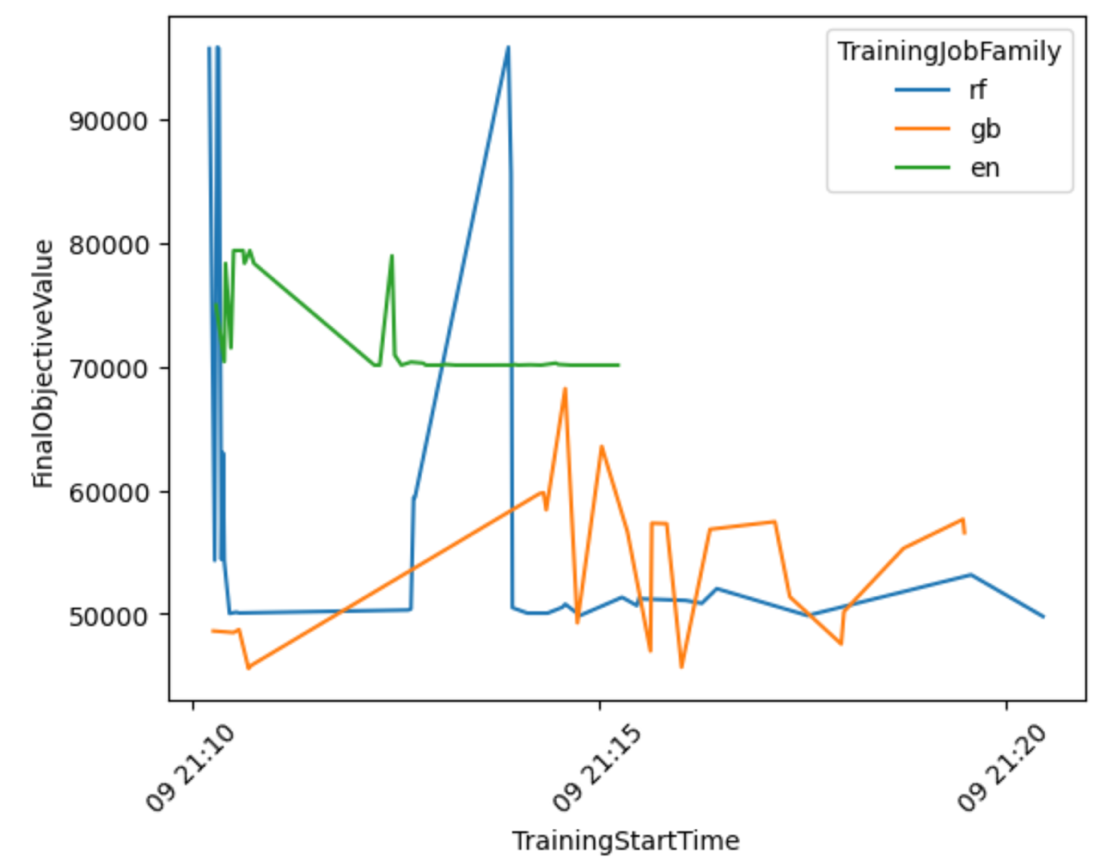

Produisons une visualisation basée sur les résultats pour obtenir plus d'informations sur les performances du flux de travail AutoML dans toutes les familles de modèles.

Du graphique suivant, on peut conclure que Elastic-Net les performances du modèle oscillaient entre 70,000 80,000 et XNUMX XNUMX RMSE et ont finalement stagné, car l'algorithme n'a pas été en mesure d'améliorer ses performances malgré les tentatives de diverses techniques de prétraitement et valeurs d'hyperparamètres. Il semble aussi que RandomForest les performances variaient beaucoup en fonction de l'ensemble d'hyperparamètres exploré par HPO, mais malgré de nombreux essais, elles ne pouvaient pas descendre en dessous de l'erreur RMSE de 50,000 XNUMX. GradientBoosting a réalisé dès le départ la meilleure performance en passant en dessous de 50,000 XNUMX RMSE. HPO a essayé d'améliorer encore ce résultat, mais n'a pas réussi à obtenir de meilleures performances avec d'autres combinaisons d'hyperparamètres. Une conclusion générale pour tous les travaux HPO est qu’il n’a pas fallu beaucoup de travaux pour trouver l’ensemble d’hyperparamètres le plus performant pour chaque algorithme. Pour améliorer encore le résultat, vous devrez expérimenter la création de davantage de fonctionnalités et effectuer une ingénierie de fonctionnalités supplémentaire.

Vous pouvez également examiner une vue plus détaillée de la combinaison modèle-préprocesseur pour tirer des conclusions sur les combinaisons les plus prometteuses.

Sélectionnez le meilleur modèle et déployez-le

L'extrait de code suivant sélectionne le meilleur modèle en fonction de la valeur objectif la plus basse atteinte. Vous pouvez ensuite déployer le modèle en tant que point de terminaison SageMaker.

Nettoyer

Pour éviter des frais indésirables sur votre compte AWS, nous vous recommandons de supprimer les ressources AWS que vous avez utilisées dans cet article :

- Sur la console Amazon S3, videz les données du compartiment S3 dans lequel les données de formation ont été stockées.

- Sur la console SageMaker, arrêtez l'instance de notebook.

- Supprimez le point de terminaison du modèle si vous l'avez déployé. Les points de terminaison doivent être supprimés lorsqu'ils ne sont plus utilisés, car ils sont facturés en fonction de la durée de déploiement.

Conclusion

Dans cet article, nous avons montré comment créer une tâche HPO personnalisée dans SageMaker à l'aide d'une sélection personnalisée d'algorithmes et de techniques de prétraitement. En particulier, cet exemple montre comment automatiser le processus de génération de nombreux scripts de formation et comment utiliser les structures de programmation Python pour un déploiement efficace de plusieurs tâches d'optimisation parallèles. Nous espérons que cette solution constituera l'échafaudage de toutes les tâches de réglage de modèles personnalisés que vous déploierez à l'aide de SageMaker pour obtenir des performances plus élevées et accélérer vos flux de travail de ML.

Consultez les ressources suivantes pour approfondir davantage vos connaissances sur l’utilisation de SageMaker HPO :

À propos des auteurs

Konrad Semsch est architecte senior de solutions ML au sein de l'équipe Amazon Web Services Data Lab. Il aide les clients à utiliser l'apprentissage automatique pour résoudre leurs défis commerciaux avec AWS. Il aime inventer et simplifier pour offrir aux clients des solutions simples et pragmatiques pour leurs projets IA/ML. Il est particulièrement passionné par MlOps et la science des données traditionnelle. En dehors du travail, il est un grand fan de planche à voile et de kitesurf.

Konrad Semsch est architecte senior de solutions ML au sein de l'équipe Amazon Web Services Data Lab. Il aide les clients à utiliser l'apprentissage automatique pour résoudre leurs défis commerciaux avec AWS. Il aime inventer et simplifier pour offrir aux clients des solutions simples et pragmatiques pour leurs projets IA/ML. Il est particulièrement passionné par MlOps et la science des données traditionnelle. En dehors du travail, il est un grand fan de planche à voile et de kitesurf.

Ersoy au thon est architecte de solutions senior chez AWS. Son objectif principal est d'aider les clients du secteur public à adopter les technologies cloud pour leurs charges de travail. Elle possède une expérience en développement d'applications, en architecture d'entreprise et en technologies de centre de contact. Ses intérêts incluent les architectures sans serveur et l'IA/ML.

Ersoy au thon est architecte de solutions senior chez AWS. Son objectif principal est d'aider les clients du secteur public à adopter les technologies cloud pour leurs charges de travail. Elle possède une expérience en développement d'applications, en architecture d'entreprise et en technologies de centre de contact. Ses intérêts incluent les architectures sans serveur et l'IA/ML.

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- PlatoData.Network Ai générative verticale. Autonomisez-vous. Accéder ici.

- PlatoAiStream. Intelligence Web3. Connaissance Amplifiée. Accéder ici.

- PlatonESG. Carbone, Technologie propre, Énergie, Environnement, Solaire, La gestion des déchets. Accéder ici.

- PlatoHealth. Veille biotechnologique et essais cliniques. Accéder ici.

- La source: https://aws.amazon.com/blogs/machine-learning/implement-a-custom-automl-job-using-pre-selected-algorithms-in-amazon-sagemaker-automatic-model-tuning/

- :possède

- :est

- :ne pas

- :où

- $UP

- 000

- 1

- 10

- 100

- 12

- 13

- 14

- 15%

- 20

- 2000

- 22

- 25

- 28

- 30

- 39

- 50

- 7

- 70

- 8

- 80

- 9

- a

- Capable

- A Propos

- accès

- Selon

- Compte

- atteindre

- atteint

- à travers

- activement

- Supplémentaire

- En outre

- adopter

- Après

- AI / ML

- objectif

- algorithme

- algorithmes

- Tous

- Permettre

- permet

- déjà

- aussi

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- an

- selon une analyse de l’Université de Princeton

- il analyse

- l'analyse

- ainsi que le

- Une autre

- tous

- Application

- Le développement d'applications

- appliqué

- s'applique

- Appliquer

- ,

- architecture

- SONT

- argument

- arguments

- AS

- assumer

- At

- joindre

- auto

- automatiser

- Automatique

- automatiquement

- AutoML

- disponibles

- AWS

- fond

- base

- basé

- Baseline

- Bayésien

- BE

- car

- before

- Début

- ci-dessous

- LES MEILLEURS

- Améliorée

- jusqu'à XNUMX fois

- Big

- Block

- Blocs

- tous les deux

- branches

- construire

- Développement

- la performance des entreprises

- mais

- bouton (dans la fenêtre de contrôle qui apparaît maintenant)

- by

- Californie

- Appelez-nous

- appelé

- CAN

- candidat

- maisons

- cas

- Canaux centraux

- Chaînes

- globaux

- Change

- Modifications

- des charges

- Contrôles

- Selectionnez

- classe

- CLF

- client

- le cloud

- Grappe

- regroupement

- code

- Colonne

- Colonnes

- combinaison

- комбинации

- combiné

- moissonneuses-batteuses

- vient

- commentaire

- Commun

- complet

- Complété

- compléter

- compliqué

- conclut

- conclusion

- Conduire

- configuration

- consécutif

- Console

- contact

- centre de contact

- contient

- contraste

- des bactéries

- Prix

- Costs

- pourriez

- engendrent

- créée

- La création

- critères

- crucial

- Lecture

- Customiser

- Clients

- données

- science des données

- ensembles de données

- traitement

- décider

- Approfondir

- Réglage par défaut

- défini

- Définit

- définir

- définitions

- démontrer

- démontre

- dépendre

- dépendances

- Selon

- déployer

- déployé

- déployer

- déploiement

- dériver

- Malgré

- détail

- détaillé

- détails

- développer

- développé

- Développement

- développe

- déviation

- DICT

- différent

- répertoires

- discuter

- discuté

- do

- Ne fait pas

- domaine

- Ne pas

- down

- dessiner

- sécher

- durée

- pendant

- dynamiquement

- chacun

- "Early Bird"

- efficace

- élimine

- permettre

- Endpoint

- ENGINEERING

- assurer

- Assure

- Entreprise

- Tout

- entièrement

- égal

- erreur

- évaluer

- évalué

- faire une éventuelle

- Chaque

- examiner

- exemple

- exemples

- exécution

- exister

- attendre

- attendu

- expérience

- expliqué

- Exploré

- explore

- non

- familles

- famille

- ventilateur

- Fonctionnalité

- Fonctionnalités:

- few

- champ

- Déposez votre dernière attestation

- rempli

- Trouvez

- trouver

- Prénom

- s'adapter

- cinq

- Focus

- suivre

- Abonnement

- suit

- Pour

- forêt

- formulaire

- le format

- CADRE

- De

- avant

- plein

- fonction

- fonctions

- plus

- Général

- générer

- généré

- générateur

- obtenez

- Git

- GitHub

- donné

- Go

- objectif

- aller

- graphique

- main

- Poignées

- Vous avez

- ayant

- he

- lourd

- levage de charges lourdes

- aider

- aide

- ici

- de haut niveau

- augmentation

- le plus élevé

- d'espérance

- heure

- Villa

- ménages

- logement

- Comment

- How To

- HTML

- http

- HTTPS

- Optimisation hyperparamétrique

- Réglage des hyperparamètres

- Identite

- if

- Mettre en oeuvre

- la mise en oeuvre

- importer

- importations

- améliorer

- l'amélioration de

- in

- comprendre

- Y compris

- Améliore

- indiquer

- individuel

- Individuellement

- d'information

- contribution

- entrées

- Inserts

- idées.

- instance

- plutôt ;

- Des instructions

- l'intégration

- intentionnellement

- intérêts

- Interfaces

- développement

- introduit

- IT

- SES

- lui-même

- Emploi

- Emplois

- jpg

- juste

- juste un

- XNUMX éléments à

- ACTIVITES

- spécialisées

- laboratoire

- gros

- plus importantes

- plus tard

- lancé

- lancement

- apprentissage

- à gauche

- Longueur

- Niveau

- niveaux

- vos produits

- lifting

- comme

- Probable

- limiter

- linux

- charge

- localement

- situé

- emplacement

- logique

- logique

- Location

- plus long

- Style

- Lot

- le plus bas

- click

- machine learning

- de nombreuses

- maximales

- Mai..

- signifier

- veux dire

- aller

- la ficelle d'étiquettes/étiquettes volantes en carton

- Métrique

- pourrait

- Minutes

- manquant

- ML

- MLOps

- modèle

- numériques jumeaux (digital twin models)

- modifier

- Surveiller

- moniteurs

- PLUS

- (en fait, presque toutes)

- plusieurs

- prénom

- étroit

- navigue

- Besoin

- Nouveauté

- nouvellement

- next

- aucune

- Aucun

- cahier

- noté

- maintenant

- nombre

- numpy

- objet

- objectif

- objets

- of

- de rabais

- Offres Speciales

- on

- une fois

- ONE

- uniquement

- ouvert

- Opérations

- optimaux

- à mettre en œuvre pour gérer une entreprise rentable. Ce guide est basé sur trois décennies d'expérience

- Optimiser

- optimisé

- or

- de commander

- OS

- Autre

- Autres

- ande

- sortie

- au contrôle

- plus de

- global

- page

- pandas

- Parallèle

- paramètres

- partie

- particulier

- En passant

- passionné

- chemin

- Payer

- Effectuer

- performant

- effectuer

- persiste

- pièces

- pipeline

- Platon

- Intelligence des données Platon

- PlatonDonnées

- joue

- fiche

- Point

- des notes bonus

- politique

- population

- possible

- Post

- défaillances

- pragmatique

- prévoir

- Predictor

- Préparer

- conditions préalables

- cadeaux

- empêcher

- précédemment

- établissement des prix

- primaire

- Imprimé

- Problème

- processus

- produire

- Vidéo

- Programmation

- Progrès

- Projet

- projets

- prometteur

- propriétés

- fournir

- fournit

- aportando

- public

- but

- Python

- aléatoire

- Nos tests de diagnostic produisent des résultats rapides et précis sans nécessiter d'équipement de laboratoire complexe et coûteux,

- atteint

- solutions

- raison

- récemment

- recette

- recommander

- Articles

- réduire

- réduit

- reportez-vous

- référence

- en ce qui concerne

- regex

- région

- libéré

- pertinent

- restant

- supprimez

- répéter

- dépôt

- nécessaire

- exigent

- conditions

- Resources

- ceux

- responsables

- limité

- résultat

- Résultats

- retourner

- bon

- Rôle

- Courir

- pour le running

- fonctionne

- d'exécution

- sagemaker

- Réglage automatique du modèle SageMaker

- sauvé

- Escaliers intérieurs

- mise à l'échelle

- Sciences

- scientifiques

- scikit-apprendre

- portée

- But

- scénario

- scripts

- Deuxièmement

- secondes

- Section

- les sections

- secteur

- sur le lien

- semble

- choisi

- sélection

- AUTO

- supérieur

- séparé

- besoin

- Sans serveur

- service

- Services

- Session

- set

- Sets

- Paramétres

- installation

- elle

- devrait

- présenté

- montré

- Spectacles

- étapes

- simplifiant

- simplement

- Fragment

- So

- sur mesure

- Solutions

- RÉSOUDRE

- quelques

- spécialisé

- groupe de neurones

- spécification

- caractéristiques

- spécifié

- vitesse

- scission

- empiler

- Standard

- Commencer

- Commencez

- Statut

- étapes

- Étapes

- Arrêter

- arrêté

- arrêt

- storage

- stockée

- stockage

- de Marketing

- structure

- structures

- Par la suite

- tel

- Appareils

- table

- Prenez

- Target

- équipe

- Technique

- techniques

- Les technologies

- terminal

- tester

- Essais

- qui

- La

- leur

- Les

- puis

- Là.

- donc

- Ces

- l'ont

- this

- ceux

- trois

- порог

- Avec

- fiable

- à

- ensemble

- outil

- top

- Total

- vers

- traditionnel

- Train

- Formation

- transformations

- procès

- essais cliniques

- essayé

- déclencher

- déclenché

- déclenchement

- essayer

- réglage

- deux

- type

- types

- typiquement

- ui

- sous

- compréhension

- expérience unique et authentique

- jusqu'à

- indésirable

- téléchargé

- Utilisation

- utilisé

- cas d'utilisation

- d'utiliser

- Usages

- en utilisant

- VALIDER

- Plus-value

- Valeurs

- variable

- varié

- divers

- version

- versions

- Voir

- visualisation

- W

- attendez

- walkthrough

- souhaitez

- était

- Façon..

- we

- web

- services Web

- WELL

- ont été

- Quoi

- quand

- Les

- que

- qui

- why

- sera

- comprenant

- dans les

- sans

- activités principales

- workflow

- workflows

- de travail

- pourra

- écrire

- encore

- Vous n'avez

- Votre

- vous-même

- zéphyrnet