À l'ère de l'information d'aujourd'hui, les vastes volumes de données hébergés dans d'innombrables documents constituent à la fois un défi et une opportunité pour les entreprises. Les méthodes traditionnelles de traitement des documents manquent souvent d’efficacité et de précision, laissant place à l’innovation, à la rentabilité et aux optimisations. Le traitement des documents a connu des progrès significatifs avec l'avènement du traitement intelligent des documents (IDP). Avec IDP, les entreprises peuvent transformer les données non structurées provenant de divers types de documents en informations structurées et exploitables, améliorant ainsi considérablement l'efficacité et réduisant les efforts manuels. Cependant, le potentiel ne s’arrête pas là. En intégrant l’intelligence artificielle (IA) générative dans le processus, nous pouvons améliorer encore les capacités IDP. L'IA générative introduit non seulement des capacités améliorées dans le traitement des documents, mais elle introduit également une adaptabilité dynamique à l'évolution des modèles de données. Cet article vous présente la synergie entre l'IDP et l'IA générative, dévoilant comment elles représentent la prochaine frontière du traitement des documents.

Nous discutons en détail de l'IDP dans notre série Traitement intelligent des documents avec les services AWS AI ( Partie 1 et de Partie 2). Dans cet article, nous expliquons comment étendre une architecture IDP nouvelle ou existante avec des modèles de langage étendus (LLM). Plus précisément, nous discutons de la manière dont nous pouvons intégrer Extrait d'Amazon comprenant LangChaîne comme chargeur de documents et Socle amazonien pour extraire des données de documents et utiliser les capacités d'IA générative au cours des différentes phases d'IDP.

Amazon Textract est un service d'apprentissage automatique (ML) qui extrait automatiquement le texte, l'écriture manuscrite et les données des documents numérisés. Amazon Bedrock est un service entièrement géré qui offre un choix de modèles de base (FM) hautes performances via des API faciles à utiliser.

Le diagramme suivant est une architecture de référence de haut niveau qui explique comment vous pouvez améliorer davantage un flux de travail IDP avec des modèles de base. Vous pouvez utiliser les LLM dans une ou toutes les phases de l'IDP en fonction du cas d'utilisation et du résultat souhaité.

Dans les sections suivantes, nous approfondissons la manière dont Amazon Textract est intégré aux flux de travail d'IA générative à l'aide de LangChain pour traiter les documents pour chacune de ces tâches spécifiques. Les blocs de code fournis ici ont été réduits par souci de concision. Référez-vous à notre GitHub référentiel pour des blocs-notes Python détaillés et une procédure pas à pas.

L'extraction de texte à partir de documents est un aspect crucial lorsqu'il s'agit de traiter des documents avec des LLM. Vous pouvez utiliser Amazon Textract pour extraire du texte brut non structuré à partir de documents et conserver les objets semi-structurés ou structurés d'origine tels que les paires clé-valeur et les tableaux présents dans le document. Les ensembles de documents tels que les réclamations de soins de santé et d'assurance ou les prêts hypothécaires se composent de formulaires complexes contenant de nombreuses informations dans des formats structurés, semi-structurés et non structurés. L'extraction de documents est ici une étape importante car les LLM bénéficient du contenu riche pour générer des réponses plus précises et pertinentes, ce qui pourrait autrement avoir un impact sur la qualité des résultats des LLM.

LangChain est un puissant framework open source pour l'intégration avec les LLM. Les LLM en général sont polyvalents mais peuvent avoir des difficultés avec des tâches spécifiques à un domaine où un contexte plus profond et des réponses nuancées sont nécessaires. LangChain permet aux développeurs dans de tels scénarios de créer des agents capables de diviser des tâches complexes en sous-tâches plus petites. Les sous-tâches peuvent ensuite introduire du contexte et de la mémoire dans les LLM en connectant et en chaînant les invites LLM.

Offres LangChain chargeurs de documents qui peut charger et transformer les données des documents. Vous pouvez les utiliser pour structurer des documents dans des formats préférés pouvant être traités par les LLM. Le AmazonTextractPDFLoader est un type de chargeur de documents de type chargeur de service qui fournit un moyen rapide d'automatiser le traitement des documents en utilisant Amazon Textract en combinaison avec LangChain. Pour plus de détails sur AmazonTextractPDFLoader, se référer au LangChaîne Documentation. Pour utiliser le chargeur de documents Amazon Textract, vous commencez par l'importer depuis la bibliothèque LangChain :

from langchain.document_loaders import AmazonTextractPDFLoaderhttps_loader = AmazonTextractPDFLoader("https://sample-website.com/sample-doc.pdf")

https_document = https_loader.load() s3_loader = AmazonTextractPDFLoader("s3://sample-bucket/sample-doc.pdf")

s3_document = s3_loader.load()Vous pouvez également stocker des documents dans Amazon S3 et y faire référence à l'aide du modèle d'URL s3://, comme expliqué dans Accéder à un compartiment à l'aide de S3://, et transmettez ce chemin S3 au chargeur PDF Amazon Textract :

import boto3

textract_client = boto3.client('textract', region_name='us-east-2') file_path = "s3://amazon-textract-public-content/langchain/layout-parser-paper.pdf"

loader = AmazonTextractPDFLoader(file_path, client=textract_client)

documents = loader.load()Un document de plusieurs pages contiendra plusieurs pages de texte, auxquelles on pourra ensuite accéder via l'objet documents, qui est une liste de pages. Le code suivant parcourt les pages de l'objet documents et imprime le texte du document, qui est disponible via le page_content attribut:

print(len(documents)) for document in documents: print(document.page_content)Amazon Comprehend et LLM peuvent être utilisés efficacement pour la classification des documents. Amazon Comprehend est un service de traitement du langage naturel (NLP) qui utilise le ML pour extraire des informations à partir d'un texte. Amazon Comprehend prend également en charge la formation de modèles de classification personnalisés avec une prise en compte de la mise en page sur des documents tels que les formats PDF, Word et image. Pour plus d'informations sur l'utilisation du classificateur de documents Amazon Comprehend, consultez Le classificateur de documents Amazon Comprehend ajoute la prise en charge de la mise en page pour une plus grande précision.

Lorsqu'elle est associée aux LLM, la classification des documents devient une approche puissante pour gérer de grands volumes de documents. Les LLM sont utiles dans la classification des documents car ils peuvent analyser le texte, les modèles et les éléments contextuels du document en utilisant la compréhension du langage naturel. Vous pouvez également les affiner pour des classes de documents spécifiques. Lorsqu'un nouveau type de document introduit dans le pipeline IDP nécessite une classification, le LLM peut traiter le texte et catégoriser le document en fonction d'un ensemble de classes. Voici un exemple de code qui utilise le chargeur de documents LangChain optimisé par Amazon Textract pour extraire le texte du document et l'utiliser pour classer le document. Nous utilisons le Anthropique Claude v2 modèle via Amazon Bedrock pour effectuer la classification.

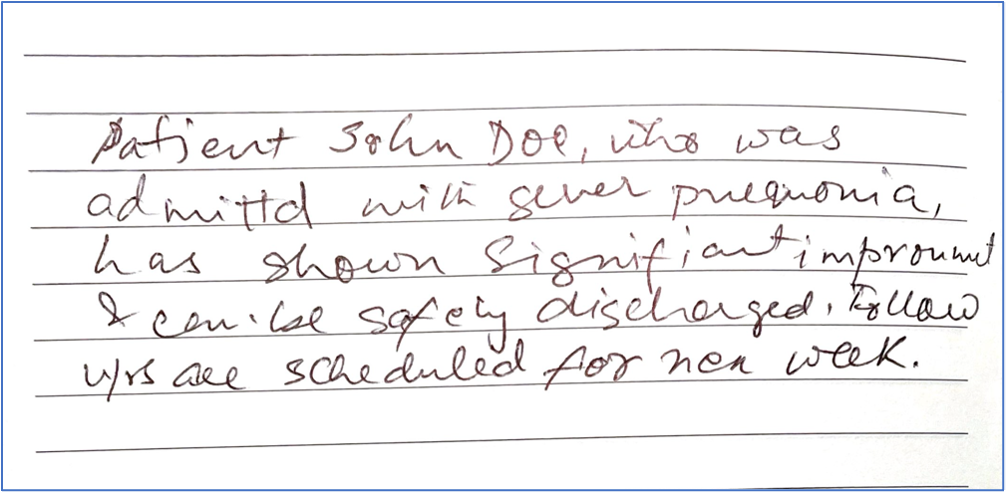

Dans l'exemple suivant, nous extrayons d'abord le texte d'un rapport de sortie d'un patient et utilisons un LLM pour le classer à partir d'une liste de trois types de documents différents :DISCHARGE_SUMMARY, RECEIPTet une PRESCRIPTION. La capture d'écran suivante montre notre rapport.

from langchain.document_loaders import AmazonTextractPDFLoader

from langchain.llms import Bedrock

from langchain.prompts import PromptTemplate

from langchain.chains import LLMChain loader = AmazonTextractPDFLoader("./samples/document.png")

document = loader.load() template = """ Given a list of classes, classify the document into one of these classes. Skip any preamble text and just give the class name. <classes>DISCHARGE_SUMMARY, RECEIPT, PRESCRIPTION</classes>

<document>{doc_text}<document>

<classification>""" prompt = PromptTemplate(template=template, input_variables=["doc_text"])

bedrock_llm = Bedrock(client=bedrock, model_id="anthropic.claude-v2") llm_chain = LLMChain(prompt=prompt, llm=bedrock_llm)

class_name = llm_chain.run(document[0].page_content) print(f"The provided document is = {class_name}")

La synthèse consiste à condenser un texte ou un document donné dans une version plus courte tout en conservant ses informations clés. Cette technique est bénéfique pour une recherche efficace des informations, qui permet aux utilisateurs de saisir rapidement les points clés d'un document sans lire l'intégralité du contenu. Bien qu'Amazon Textract n'effectue pas directement le résumé du texte, il fournit les fonctionnalités fondamentales permettant d'extraire l'intégralité du texte des documents. Ce texte extrait sert d'entrée à notre modèle LLM pour effectuer des tâches de résumé de texte.

En utilisant le même exemple de rapport de sortie, nous utilisons AmazonTextractPDFLoader pour extraire le texte de ce document. Comme auparavant, nous utilisons le modèle Claude v2 via Amazon Bedrock et l'initialisons avec une invite contenant les instructions sur ce qu'il faut faire avec le texte (dans ce cas, un résumé). Enfin, nous exécutons la chaîne LLM en transmettant le texte extrait du chargeur de documents. Cela exécute une action d'inférence sur le LLM avec l'invite composée des instructions à résumer et du texte du document marqué par Document. Voir le code suivant:

Le code génère le résumé d'un rapport récapitulatif de sortie d'un patient :

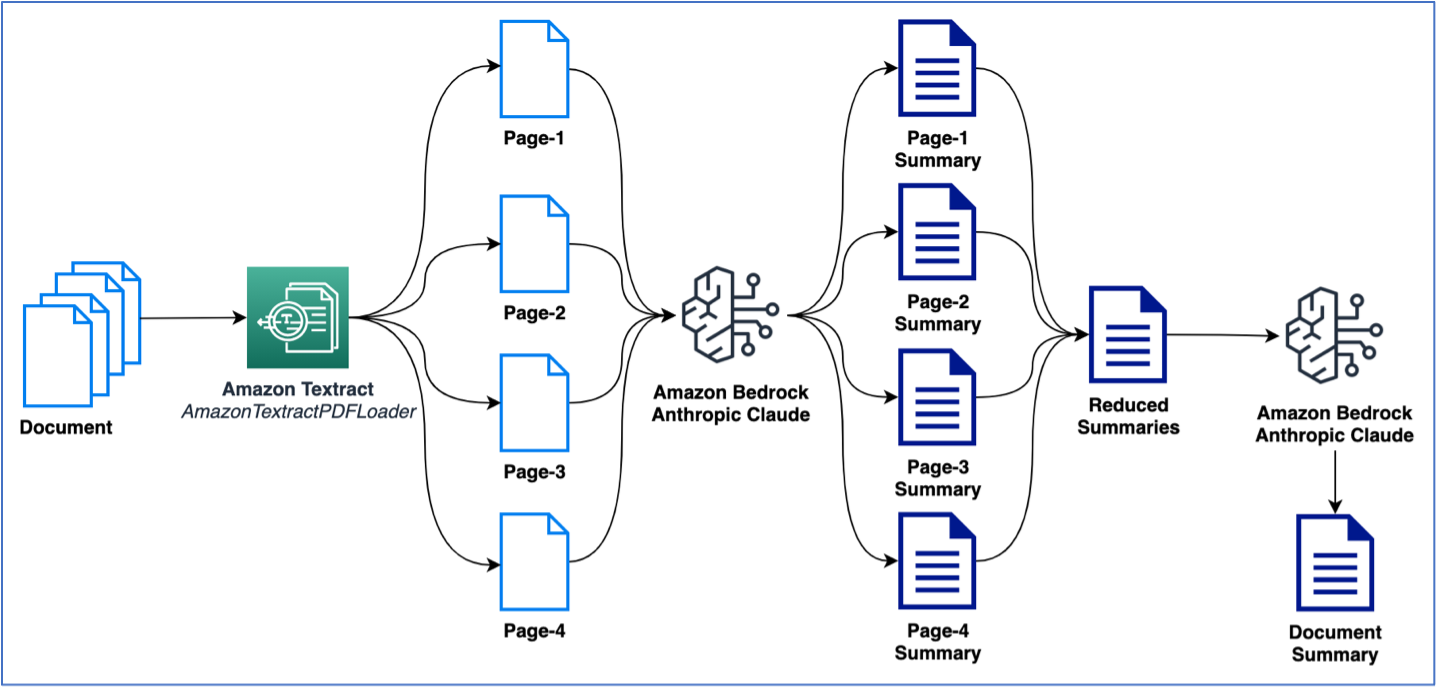

L'exemple précédent utilisait un document d'une seule page pour effectuer un résumé. Cependant, vous aurez probablement affaire à des documents contenant plusieurs pages nécessitant un résumé. Une manière courante d'effectuer un résumé sur plusieurs pages consiste à générer d'abord des résumés sur des morceaux de texte plus petits, puis à combiner les résumés plus petits pour obtenir un résumé final du document. Notez que cette méthode nécessite plusieurs appels au LLM. La logique de cela peut être élaborée facilement ; cependant, LangChain fournit une chaîne de synthèse intégrée qui peut résumer des textes volumineux (à partir de documents de plusieurs pages). Le résumé peut avoir lieu soit via map_reduce ou avec stuff options, qui sont disponibles en tant qu'options pour gérer les multiples appels au LLM. Dans l'exemple suivant, nous utilisons map_reduce pour résumer un document de plusieurs pages. La figure suivante illustre notre flux de travail.

Commençons par extraire le document et voir le nombre total de jetons par page et le nombre total de pages :

Ensuite, nous utilisons le module intégré de LangChain load_summarize_chain pour résumer l'ensemble du document :

from langchain.chains.summarize import load_summarize_chain summary_chain = load_summarize_chain(llm=bedrock_llm, chain_type='map_reduce')

output = summary_chain.run(document)

print(output.strip())Normalisation et questions-réponses

Dans cette section, nous discutons des tâches de normalisation et de questions-réponses.

Standardisation

La standardisation de la sortie est une tâche de génération de texte dans laquelle les LLM sont utilisés pour fournir un formatage cohérent du texte de sortie. Cette tâche est particulièrement utile pour l'automatisation de l'extraction d'entités clés qui nécessite que la sortie soit alignée sur les formats souhaités. Par exemple, nous pouvons suivre les meilleures pratiques d'ingénierie pour affiner un LLM afin de formater les dates au format MM/JJ/AAAA, qui peut être compatible avec une colonne DATE de base de données. Le bloc de code suivant montre un exemple de la façon dont cela est réalisé à l'aide d'un LLM et d'une ingénierie d'invite. Non seulement nous standardisons le format de sortie pour les valeurs de date, mais nous incitons également le modèle à générer la sortie finale au format JSON afin qu'elle soit facilement utilisable dans nos applications en aval. Nous utilisons Langage d'expression LangChain (LCEL) pour enchaîner deux actions. La première action invite le LLM à générer une sortie au format JSON contenant uniquement les dates du document. La deuxième action prend la sortie JSON et standardise le format de date. Notez que cette action en deux étapes peut également être effectuée en une seule étape avec une ingénierie d'invite appropriée, comme nous le verrons dans la normalisation et la création de modèles.

La sortie de l'exemple de code précédent est une structure JSON avec les dates 07/09/2020 et 08/09/2020, qui sont au format JJ/MM/AAAA et correspondent respectivement à la date d'admission et de sortie du patient de l'hôpital, selon au rapport sommaire de sortie.

Questions et réponses avec la génération augmentée de récupération

Les LLM sont connus pour conserver des informations factuelles, souvent appelées leur connaissance du monde ou leur vision du monde. Lorsqu’ils sont affinés, ils peuvent produire des résultats de pointe. Cependant, il existe des contraintes quant à l'efficacité avec laquelle un LLM peut accéder et manipuler ces connaissances. Par conséquent, dans les tâches qui reposent fortement sur des connaissances spécifiques, leurs performances peuvent ne pas être optimales pour certains cas d’utilisation. Par exemple, dans les scénarios de questions-réponses, il est essentiel que le modèle adhère strictement au contexte fourni dans le document sans s'appuyer uniquement sur sa connaissance du monde. S'en écarter peut conduire à des fausses déclarations, des inexactitudes ou même des réponses incorrectes. La méthode la plus couramment utilisée pour résoudre ce problème est connue sous le nom de Récupération Génération Augmentée (CHIFFON). Cette approche met en synergie les atouts des modèles de récupération et des modèles de langage, améliorant ainsi la précision et la qualité des réponses générées.

Les LLM peuvent également imposer des limitations de jetons en raison de leurs contraintes de mémoire et des limitations du matériel sur lequel ils s'exécutent. Pour résoudre ce problème, des techniques telles que le chunking sont utilisées pour diviser les documents volumineux en parties plus petites qui s'inscrivent dans les limites symboliques des LLM. D’un autre côté, les incorporations sont utilisées principalement en PNL pour capturer la signification sémantique des mots et leurs relations avec d’autres mots dans un espace de grande dimension. Ces intégrations transforment les mots en vecteurs, permettant aux modèles de traiter et de comprendre efficacement les données textuelles. En comprenant les nuances sémantiques entre les mots et les phrases, les intégrations permettent aux LLM de générer des résultats cohérents et contextuellement pertinents. Notez les termes clés suivants :

- Regrouper – Ce processus décompose de grandes quantités de texte provenant de documents en morceaux de texte plus petits et significatifs.

- embeddings – Il s’agit de transformations vectorielles de dimension fixe de chaque fragment qui conservent les informations sémantiques des fragments. Ces intégrations sont ensuite chargées dans une base de données vectorielles.

- Base de données vectorielle – Il s’agit d’une base de données d’intégrations de mots ou de vecteurs qui représentent le contexte des mots. Il agit comme une source de connaissances qui facilite les tâches de PNL dans les pipelines de traitement de documents. L'avantage de la base de données vectorielles ici est qu'elle permet uniquement de fournir le contexte nécessaire aux LLM lors de la génération de texte, comme nous l'expliquons dans la section suivante.

RAG utilise la puissance des intégrations pour comprendre et récupérer les segments de document pertinents pendant la phase de récupération. Ce faisant, RAG peut fonctionner dans les limites symboliques des LLM, garantissant que les informations les plus pertinentes sont sélectionnées pour la génération, ce qui aboutit à des résultats plus précis et contextuellement pertinents.

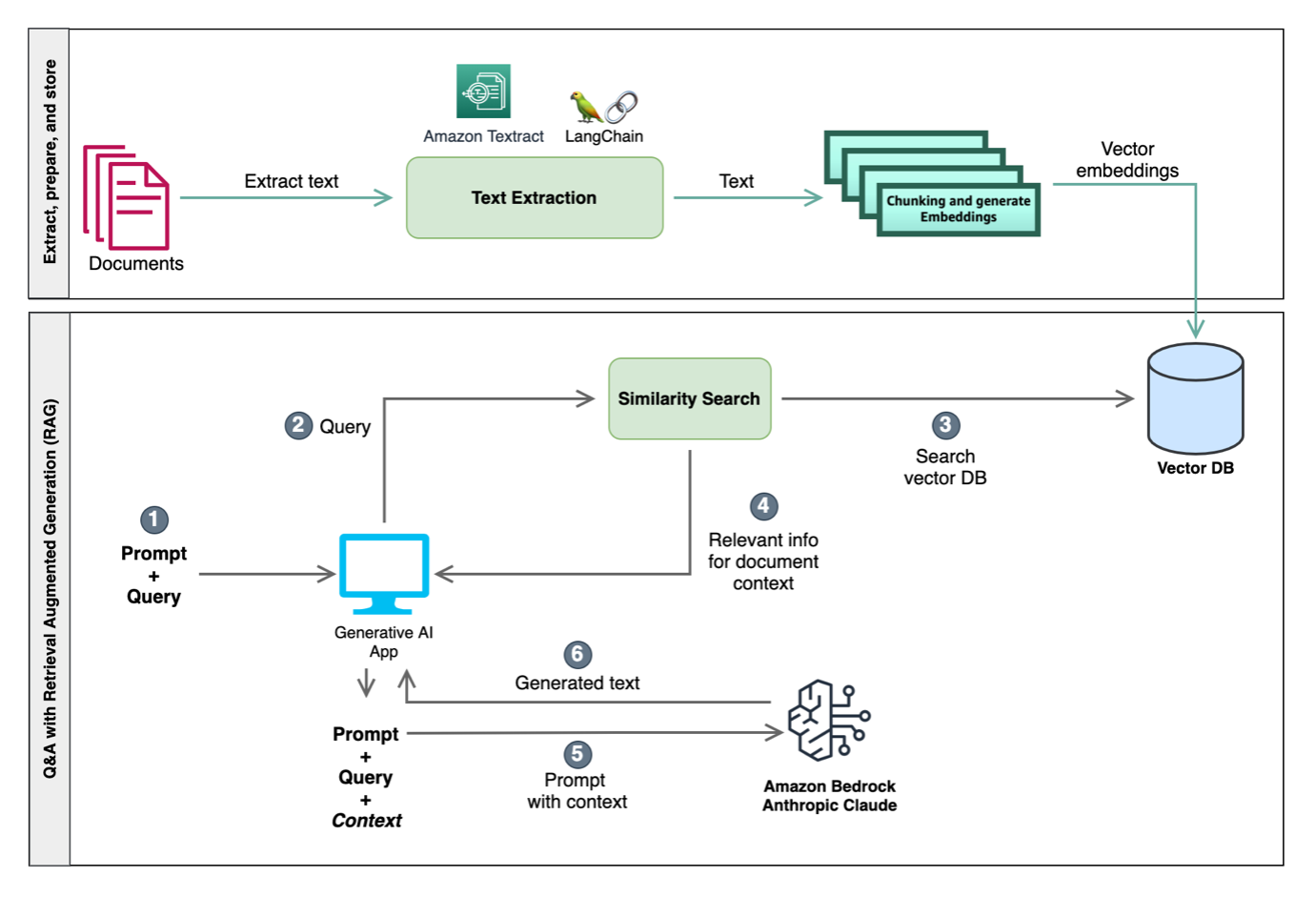

Le diagramme suivant illustre l'intégration de ces techniques pour élaborer la contribution aux LLM, améliorant leur compréhension contextuelle et permettant des réponses contextuelles plus pertinentes. Une approche implique une recherche de similarité, utilisant à la fois une base de données vectorielles et le découpage. La base de données vectorielle stocke des intégrations représentant des informations sémantiques, et la segmentation divise le texte en sections gérables. En utilisant ce contexte de recherche de similarité, les LLM peuvent exécuter des tâches telles que la réponse à des questions et des opérations spécifiques à un domaine telles que la classification et l'enrichissement.

Pour cet article, nous utilisons une approche basée sur RAG pour effectuer des questions-réponses en contexte avec des documents. Dans l’exemple de code suivant, nous extrayons le texte d’un document, puis divisons le document en morceaux de texte plus petits. Le découpage est nécessaire car nous pouvons avoir des documents volumineux de plusieurs pages et nos LLM peuvent avoir des limites de jetons. Ces morceaux sont ensuite chargés dans la base de données vectorielles pour effectuer une recherche de similarité dans les étapes suivantes. Dans l'exemple suivant, nous utilisons le modèle Amazon Titan Embed Text v1, qui effectue les intégrations vectorielles des morceaux de document :

Le code crée un contexte pertinent pour le LLM en utilisant les morceaux de texte renvoyés par l'action de recherche de similarité à partir de la base de données vectorielles. Pour cet exemple, nous utilisons un logiciel open source Magasin de vecteurs FAISS comme exemple de base de données vectorielles pour stocker les intégrations vectorielles de chaque morceau de texte. Nous définissons ensuite la base de données vectorielles comme un Récupérateur de LangChain, qui est transmis dans le RetrievalQA chaîne. Cela exécute en interne une requête de recherche de similarité sur la base de données vectorielles qui renvoie les n premiers morceaux de texte (où n = 3 dans notre exemple) pertinents pour la question. Enfin, la chaîne LLM est exécutée avec le contexte pertinent (un groupe de morceaux de texte pertinents) et la question à laquelle le LLM doit répondre. Pour une présentation étape par étape du code de questions-réponses avec RAG, reportez-vous au bloc-notes Python sur GitHub.

Comme alternative à FAISS, vous pouvez également utiliser Capacités de base de données vectorielles Amazon OpenSearch Service, Amazon Relational Database Service (Amazon RDS) pour PostgreSQL des pgvecteur extension en tant que bases de données vectorielles ou base de données Chroma open source.

Questions et réponses avec des données tabulaires

Les données tabulaires contenues dans les documents peuvent être difficiles à traiter pour les LLM en raison de leur complexité structurelle. Amazon Textract peut être complété par des LLM car il permet d'extraire des tableaux à partir de documents dans un format imbriqué d'éléments tels qu'une page, un tableau et des cellules. La réalisation de questions et réponses avec des données tabulaires est un processus en plusieurs étapes et peut être réalisé via auto-interrogation. Voici un aperçu des étapes :

- Extrayez des tableaux de documents à l'aide d'Amazon Textract. Avec Amazon Textract, la structure tabulaire (lignes, colonnes, en-têtes) peut être extraite d'un document.

- Stockez les données tabulaires dans une base de données vectorielle avec les informations de métadonnées, telles que les noms d'en-tête et la description de chaque en-tête.

- Utilisez l'invite pour construire une requête structurée, à l'aide d'un LLM, afin de dériver les données de la table.

- Utilisez la requête pour extraire les données de table pertinentes de la base de données vectorielles.

Par exemple, dans un relevé bancaire, à la demande « Quelles sont les transactions avec plus de 1000 XNUMX $ de dépôts », le LLM suivra les étapes suivantes :

- Créez une requête, telle que

“Query: transactions” , “filter: greater than (Deposit$)”. - Convertissez la requête en requête structurée.

- Appliquez la requête structurée à la base de données vectorielle où nos données de table sont stockées.

Pour un exemple de code pas à pas de questions-réponses avec un tableau, reportez-vous au bloc-notes Python dans GitHub.

Modèles et normalisations

Dans cette section, nous examinons comment utiliser les techniques d'ingénierie rapide et le mécanisme intégré de LangChain pour générer une sortie avec des extractions à partir d'un document dans un schéma spécifié. Nous effectuons également une certaine standardisation des données extraites, en utilisant les techniques évoquées précédemment. Nous commençons par définir un modèle pour le résultat souhaité. Cela servira de schéma et encapsulera les détails sur chaque entité que nous souhaitons extraire du texte du document.

Notez que pour chacune des entités, nous utilisons la description pour expliquer ce qu'est cette entité afin d'aider le LLM à extraire la valeur du texte du document. Dans l'exemple de code suivant, nous utilisons ce modèle pour créer notre invite pour le LLM ainsi que le texte extrait du document en utilisant AmazonTextractPDFLoader puis effectuez une inférence avec le modèle :

Comme vous pouvez le voir, la {keys} une partie de l'invite est constituée des clés de notre modèle, et le {details} sont les clés accompagnées de leur description. Dans ce cas, nous n'invitons pas explicitement le modèle avec le format de la sortie autre que la spécification dans l'instruction pour générer la sortie au format JSON. Cela fonctionne pour la plupart ; cependant, comme le résultat des LLM est une génération de texte non déterministe, nous souhaitons spécifier explicitement le format dans le cadre de l'instruction de l'invite. Pour résoudre ce problème, nous pouvons utiliser LangChain analyseur de sortie structurée pour profiter de l'ingénierie d'invite automatisée qui permet de convertir notre modèle en invite d'instructions de format. Nous utilisons le modèle défini précédemment pour générer l'invite d'instruction de format comme suit :

Nous utilisons ensuite cette variable dans notre invite d'origine comme instruction pour le LLM afin qu'il extraie et formate la sortie dans le schéma souhaité en apportant une petite modification à notre invite :

Jusqu'à présent, nous avons uniquement extrait les données du document selon un schéma souhaité. Cependant, nous devons encore procéder à une certaine normalisation. Par exemple, nous souhaitons que la date d'admission et la date de sortie du patient soient extraites au format JJ/MM/AAAA. Dans ce cas, on augmente le description de la clé avec l'instruction de formatage :

Reportez-vous au notebook Python dans GitHub pour une procédure complète et une explication étape par étape.

Vérification orthographique et corrections

Les LLM ont démontré des capacités remarquables à comprendre et à générer des textes de type humain. L'une des applications les moins discutées mais extrêmement utiles des LLM est leur potentiel en matière de vérification grammaticale et de correction de phrases dans les documents. Contrairement aux vérificateurs de grammaire traditionnels qui s'appuient sur un ensemble de règles prédéfinies, les LLM utilisent des modèles qu'ils ont identifiés à partir de grandes quantités de données textuelles pour déterminer ce qui constitue un langage correct ou fluide. Cela signifie qu’ils peuvent détecter les nuances, le contexte et les subtilités que les systèmes basés sur des règles pourraient manquer.

Imaginez le texte extrait d'un résumé de sortie d'un patient qui dit : « Le patient Jon Doe, qui a été admis pour une pneumonie grave, a montré une amélioration significative et peut sortir en toute sécurité. Des suivis sont prévus pour la semaine prochaine. Un correcteur orthographique traditionnel peut reconnaître « admis », « pneumonie », « amélioration » et « nex » comme des erreurs. Cependant, le contexte de ces erreurs pourrait conduire à d’autres erreurs ou à des suggestions génériques. Un LLM, doté d'une formation approfondie, pourrait suggérer : « Le patient John Doe, qui a été admis pour une pneumonie grave, a montré une amélioration significative et peut sortir en toute sécurité. Des suivis sont prévus pour la semaine prochaine.

Ce qui suit est un exemple de document mal manuscrit avec le même texte que celui expliqué précédemment.

Nous extrayons le document avec un chargeur de documents Amazon Textract, puis demandons au LLM, via une ingénierie rapide, de rectifier le texte extrait afin de corriger toute erreur d'orthographe et/ou de grammaire :

La sortie du code précédent montre le texte original extrait par le chargeur de documents suivi du texte corrigé généré par le LLM :

Gardez à l'esprit que, aussi puissants que soient les LLM, il est essentiel de considérer leurs suggestions comme des suggestions. Bien qu’ils capturent de manière impressionnante les subtilités du langage, ils ne sont pas infaillibles. Certaines suggestions peuvent modifier le sens ou le ton du texte original. Par conséquent, il est crucial que les réviseurs humains utilisent les corrections générées par LLM comme guide et non comme absolu. La collaboration de l'intuition humaine avec les capacités du LLM promet un avenir où notre communication écrite sera non seulement sans erreur, mais aussi plus riche et plus nuancée.

Conclusion

L'IA générative change la façon dont vous pouvez traiter les documents avec IDP pour en tirer des informations. Dans la poste Améliorer le traitement intelligent des documents AWS grâce à l'IA générative, nous avons discuté des différentes étapes du pipeline et de la manière dont Ricoh, client d'AWS, améliore son pipeline IDP avec des LLM. Dans cet article, nous avons discuté de divers mécanismes permettant d'augmenter le flux de travail IDP avec des LLM via Amazon Bedrock, Amazon Textract et le framework LangChain populaire. Vous pouvez commencer dès aujourd'hui avec le nouveau chargeur de documents Amazon Textract avec LangChain en utilisant les exemples de blocs-notes disponibles dans notre GitHub référentiel. Pour plus d'informations sur l'utilisation de l'IA générative sur AWS, reportez-vous à Annonce de nouveaux outils pour créer avec l'IA générative sur AWS.

À propos des auteurs

Sonali Sahou dirige le traitement intelligent des documents avec l'équipe des services AI/ML d'AWS. Elle est une auteure, une leader d'opinion et une technologue passionnée. Son principal domaine d'intérêt est l'IA et le ML, et elle intervient fréquemment lors de conférences et de rencontres sur l'IA et le ML dans le monde entier. Elle possède à la fois une expérience étendue et approfondie de la technologie et de l'industrie technologique, avec une expertise sectorielle dans les soins de santé, le secteur financier et l'assurance.

Sonali Sahou dirige le traitement intelligent des documents avec l'équipe des services AI/ML d'AWS. Elle est une auteure, une leader d'opinion et une technologue passionnée. Son principal domaine d'intérêt est l'IA et le ML, et elle intervient fréquemment lors de conférences et de rencontres sur l'IA et le ML dans le monde entier. Elle possède à la fois une expérience étendue et approfondie de la technologie et de l'industrie technologique, avec une expertise sectorielle dans les soins de santé, le secteur financier et l'assurance.

Anjan Biswas est un architecte senior de solutions de services d'IA avec un accent sur l'IA/ML et l'analyse de données. Anjan fait partie de l'équipe mondiale des services d'IA et travaille avec les clients pour les aider à comprendre et à développer des solutions aux problèmes commerciaux liés à l'IA et au ML. Anjan a plus de 14 ans d'expérience de travail avec des organisations mondiales de chaîne d'approvisionnement, de fabrication et de vente au détail, et aide activement les clients à démarrer et à évoluer sur les services AWS AI.

Anjan Biswas est un architecte senior de solutions de services d'IA avec un accent sur l'IA/ML et l'analyse de données. Anjan fait partie de l'équipe mondiale des services d'IA et travaille avec les clients pour les aider à comprendre et à développer des solutions aux problèmes commerciaux liés à l'IA et au ML. Anjan a plus de 14 ans d'expérience de travail avec des organisations mondiales de chaîne d'approvisionnement, de fabrication et de vente au détail, et aide activement les clients à démarrer et à évoluer sur les services AWS AI.

Chinmayee Rane est un architecte de solutions spécialisé en IA/ML chez Amazon Web Services. Elle est passionnée par les mathématiques appliquées et l'apprentissage automatique. Elle se concentre sur la conception de solutions intelligentes de traitement de documents et d'IA générative pour les clients AWS. En dehors du travail, elle aime danser la salsa et la bachata.

Chinmayee Rane est un architecte de solutions spécialisé en IA/ML chez Amazon Web Services. Elle est passionnée par les mathématiques appliquées et l'apprentissage automatique. Elle se concentre sur la conception de solutions intelligentes de traitement de documents et d'IA générative pour les clients AWS. En dehors du travail, elle aime danser la salsa et la bachata.

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- PlatoData.Network Ai générative verticale. Autonomisez-vous. Accéder ici.

- PlatoAiStream. Intelligence Web3. Connaissance Amplifiée. Accéder ici.

- PlatonESG. Carbone, Technologie propre, Énergie, Environnement, Solaire, La gestion des déchets. Accéder ici.

- PlatoHealth. Veille biotechnologique et essais cliniques. Accéder ici.

- La source: https://aws.amazon.com/blogs/machine-learning/intelligent-document-processing-with-amazon-textract-amazon-bedrock-and-langchain/

- :possède

- :est

- :ne pas

- :où

- .nex

- $1000

- $UP

- 1

- 10

- 100

- 11

- 12

- 13

- 14

- 15%

- 16

- 22

- 23

- 33

- 35%

- 7

- 9

- a

- capacités

- A Propos

- Absolute

- accès

- accédé

- Selon

- précision

- Avec cette connaissance vient le pouvoir de prendre

- atteint

- à travers

- Action

- actes

- activement

- activité

- actes

- Ad

- propos

- Ajoute

- adhérer

- admettre

- admis

- progrès

- Avantage

- avènement

- âge

- agents

- AI

- Services d'IA

- AI / ML

- aligné

- Tous

- Permettre

- permet

- le long de

- aussi

- alternative

- Bien que

- Amazon

- Amazon comprendre

- Amazon RDS

- Extrait d'Amazon

- Amazon Web Services

- quantités

- an

- analytique

- il analyse

- et de

- répondre

- Anthropique

- tous

- Apis

- applications

- appliqué

- Prendre rendez-vous

- une approche

- architecture

- SONT

- Réservé

- autour

- Art

- artificiel

- intelligence artificielle

- Intelligence artificielle (AI)

- AS

- d'aspect

- aider

- Assistante gérante

- At

- augmenter

- augmentée

- auteur

- automatiser

- Automatisation

- automatiquement

- Automation

- disponibles

- AWS

- Client AWS

- Banque

- BE

- car

- devient

- était

- before

- avantageux

- profiter

- LES MEILLEURS

- les meilleures pratiques

- jusqu'à XNUMX fois

- Block

- Blocs

- tous les deux

- largeur

- Pause

- pauses

- construire

- Développement

- intégré

- la performance des entreprises

- entreprises

- mais

- by

- Appels

- CAN

- Peut obtenir

- capacités

- capturer

- maisons

- cas

- Cellules

- certaines

- chaîne

- Chaînes

- challenge

- difficile

- Change

- Modifications

- en changeant

- Contrôles

- le choix

- prétentions

- classe

- les classes

- classification

- Classer

- code

- COHÉRENT

- collaboration

- Colonne

- Colonnes

- combinaison

- combiner

- vient

- Commun

- communément

- Communication

- compatible

- complet

- complexe

- complexité

- comprendre

- concis

- conférences

- Connecter les

- cohérent

- consiste

- contraintes

- construire

- contiennent

- contenu

- contient

- contenu

- contexte

- contextuel

- convertir

- Core

- correct

- corrigé

- Corrections

- pourriez

- élaborer

- Fabriqué

- crée des

- crucial

- Customiser

- des clients

- Clients

- Danse

- données

- Analyse de Donnée

- Base de données

- bases de données

- Date

- Dates

- affaire

- profond

- profond

- Vous permet de définir

- défini

- définir

- démontré

- Selon

- Cautions

- profondeur

- décrit

- la description

- conception

- voulu

- détail

- détaillé

- détails

- détecter

- Déterminer

- développer

- mobiles

- Alimentation

- différent

- directement

- discuter

- discuté

- plongeon

- diviser

- divise

- do

- Docteur

- document

- Documentation

- INSTITUTIONNELS

- biche

- Ne fait pas

- faire

- Don

- fait

- Ne pas

- down

- Dramatiquement

- deux

- pendant

- Dynamic

- e

- chacun

- Plus tôt

- même

- facile à utiliser

- de manière efficace

- efficace

- efficace

- efficacement

- efforts

- non plus

- éléments

- enchâsser

- employés

- responsabilise

- permettre

- permet

- permettant

- fin

- ENGINEERING

- de renforcer

- améliorée

- améliorer

- assurer

- assurer

- Tout

- entités

- entité

- équipé

- Erreurs

- essential

- Pourtant, la

- exemple

- Sauf

- exception

- existant

- d'experience

- nous a permis de concevoir

- Expliquer

- expliqué

- Explique

- explication

- explicitement

- expression

- étendre

- extension

- les

- extrait

- extraction

- Extraits

- Automne

- non

- loin

- sensation de fatigue

- Des champs

- Figure

- finale

- finalement

- la traduction de documents financiers

- Secteur financier

- Prénom

- s'adapter

- Focus

- se concentre

- suivre

- suivi

- Abonnement

- suit

- Pour

- le format

- document

- trouvé

- Fondation

- Framework

- gratuitement ici

- fréquemment

- De

- frontière

- plein

- d’étiquettes électroniques entièrement

- plus

- avenir

- Général

- générer

- généré

- génère

- générateur

- génération

- génératif

- IA générative

- obtenez

- Donner

- donné

- Global

- grammaire

- saisir

- plus grand

- Réservation de groupe

- guide

- main

- manipuler

- arriver

- EN COURS

- Matériel

- Vous avez

- têtes

- la médecine

- fortement

- aider

- utile

- aider

- aide

- ici

- ici

- de haut niveau

- haute performance

- augmentation

- détient

- hôpital

- Comment

- How To

- Cependant

- HTML

- HTTPS

- humain

- i

- ID

- identifié

- if

- illustre

- image

- immensément

- Impact

- importer

- important

- l'importation

- imposer

- amélioration

- in

- Y compris

- indice

- industrie

- d'information

- Ère de l'information

- Innovation

- contribution

- idées.

- instance

- Des instructions

- Assurance

- intégrer

- des services

- Intégration

- l'intégration

- Intelligence

- Intelligent

- Traitement intelligent des documents

- prévu

- intérieurement

- développement

- subtilités

- introduire

- introduit

- Introduit

- IT

- SES

- Jackson

- John

- JOHN DOE

- jon

- jpg

- json

- juste

- ACTIVITES

- clés

- Savoir

- spécialisées

- connu

- langue

- gros

- Disposition

- conduire

- leader

- conduisant

- apprentissage

- départ

- Bibliothèque

- comme

- Probable

- limites

- limites

- Liste

- LLM

- charge

- chargeur

- logique

- Style

- Lot

- click

- machine learning

- Fabrication

- gérer

- maniable

- gérés

- les gérer

- Manuel

- fabrication

- marqué

- mathématiques

- Mai..

- me

- sens

- significative

- veux dire

- mécanisme

- mécanismes

- Rencontres

- Mémoire

- Meta

- Métadonnées

- méthode

- méthodes

- pourrait

- l'esprit

- manquer

- erreurs

- ML

- modèle

- numériques jumeaux (digital twin models)

- Module

- PLUS

- Hypothèques

- (en fait, presque toutes)

- plusieurs

- prénom

- noms

- Nature

- Traitement du langage naturel

- nécessaire

- Besoin

- nécessaire

- Besoins

- Nouveauté

- next

- prochaine semaine

- nlp

- cahier

- maintenant

- nuances

- nombre

- objet

- objets

- of

- Offres Speciales

- souvent

- on

- ONE

- uniquement

- open source

- Opérations

- Opportunités

- optimaux

- Options

- or

- organisations

- original

- Autre

- autrement

- nos

- ande

- Résultat

- sortie

- sorties

- au contrôle

- plus de

- vue d'ensemble

- Forfaits

- page

- pages

- Pain

- apparié

- paires

- partie

- particulièrement

- pass

- passé

- En passant

- passionné

- chemin

- patientforward

- Patron de Couture

- motifs

- /

- Effectuer

- performant

- effectué

- effectuer

- effectue

- phase

- phd

- les expressions clés

- pipeline

- plan

- Platon

- Intelligence des données Platon

- PlatonDonnées

- veuillez cliquer

- pneumonie

- des notes bonus

- Populaire

- possible

- Post

- défaillances

- power

- alimenté

- solide

- pratiques

- précisément

- La précision

- préféré

- représentent

- précédemment

- qui se déroulent

- Imprimé

- impressions

- Problème

- d'ouvrabilité

- processus

- Traité

- traitement

- produire

- promet

- correct

- fournir

- à condition de

- de voiture.

- fournit

- Python

- Questions et réponses

- qualité

- question

- Rapide

- vite.

- raw

- en cours

- reconnaître

- réduire

- reportez-vous

- référence

- visée

- Les relations

- pertinent

- compter

- s'appuyer

- remarquables

- rapport

- représentent

- représentation

- conditions

- a besoin

- respectivement

- réponses

- restrictions

- résultat

- résultant

- Résultats

- détail

- conserver

- retenue

- Retours

- Rich

- Salle

- Courir

- fonctionne

- s

- en toute sécurité

- même

- dire

- Escaliers intérieurs

- scénarios

- prévu

- Rechercher

- Deuxièmement

- Section

- les sections

- secteur

- sur le lien

- segments

- choisi

- supérieur

- phrase

- Série

- besoin

- sert

- service

- Services

- set

- sévère

- elle

- Shorts

- devrait

- montré

- Spectacles

- significative

- unique

- petit

- faibles

- Fragment

- So

- uniquement

- Solutions

- RÉSOUDRE

- quelques

- Identifier

- l'espace

- parle

- spécialiste

- groupe de neurones

- spécifiquement

- spécifié

- orthographe

- scission

- étapes

- standardisation

- Commencer

- j'ai commencé

- state-of-the-art

- Déclaration

- étapes

- Étapes

- Encore

- Boutique

- stockée

- STORES

- forces

- Chaîne

- de construction

- structure

- structuré

- Lutter

- ultérieur

- Par la suite

- tel

- suggérer

- résumé

- RÉSUMÉ

- la quantité

- chaîne d'approvisionnement

- Support

- Les soutiens

- synergie

- Système

- table

- Prenez

- prend

- Tâche

- tâches

- équipe

- technique

- techniques

- technologue

- Technologie

- modèle

- conditions

- texte

- textuel

- que

- qui

- La

- le monde

- leur

- Les

- puis

- Là.

- donc

- Ces

- l'ont

- this

- pensée

- trois

- Avec

- Titan

- à

- aujourd'hui

- aujourd'hui

- ensemble

- jeton

- Tokens

- TON

- les outils

- top

- Total

- traditionnel

- Traînant

- Formation

- Transactions

- Transformer

- transformations

- oui

- Essai

- deux

- type

- types

- comprendre

- compréhension

- contrairement à

- dévoilement

- URL

- utilisé

- cas d'utilisation

- d'utiliser

- utilisateurs

- Usages

- en utilisant

- utilisé

- Utilisant

- v1

- Plus-value

- Valeurs

- variable

- divers

- Vaste

- polyvalente

- version

- via

- Voir

- volumes

- walkthrough

- souhaitez

- était

- Façon..

- we

- web

- services Web

- semaine

- WELL

- Quoi

- quand

- qui

- tout en

- WHO

- sera

- comprenant

- dans les

- sans

- témoin

- Word

- des mots

- activités principales

- workflow

- workflows

- de travail

- vos contrats

- world

- pourra

- code écrit

- X

- années

- Vous n'avez

- zéphyrnet