En 2021, la division de L'industrie pharmaceutique a généré 550 milliards de dollars de revenus aux États-Unis. Les sociétés pharmaceutiques vendent sur le marché une variété de médicaments différents, souvent nouveaux, qui peuvent parfois entraîner des effets indésirables graves, mais involontaires.

Ces événements peuvent être signalés n’importe où, depuis les hôpitaux ou à domicile, et doivent être surveillés de manière responsable et efficace. Le traitement manuel traditionnel des événements indésirables est rendu difficile par la quantité croissante de données sur la santé et les coûts. Au total, les activités de pharmacovigilance devraient coûter 384 milliards de dollars à l'ensemble du secteur de la santé d'ici 2022. Pour soutenir les activités globales de pharmacovigilance, nos clients pharmaceutiques souhaitent utiliser la puissance de l'apprentissage automatique (ML) pour automatiser la détection des événements indésirables à partir de diverses sources de données. , tels que les flux de réseaux sociaux, les appels téléphoniques, les e-mails et les notes manuscrites, et déclencher les actions appropriées.

Dans cet article, nous montrons comment développer une solution basée sur le ML en utilisant Amazon Sage Maker pour détecter les événements indésirables à l'aide de l'ensemble de données sur les effets indésirables des médicaments accessible au public sur Hugging Face. Dans cette solution, nous affinons une variété de modèles sur Hugging Face qui ont été pré-entraînés sur des données médicales et utilisons le modèle BioBERT, qui a été pré-entraîné sur les données médicales. Ensemble de données publié et donne le meilleur de ceux essayés.

Nous avons implémenté la solution en utilisant le Kit de développement AWS Cloud (AWSCDK). Cependant, nous n’abordons pas les détails de la création de la solution dans cet article. Pour plus d'informations sur la mise en œuvre de cette solution, reportez-vous à Créez un système pour détecter les événements indésirables en temps réel à l'aide d'Amazon SageMaker et d'Amazon QuickSight.

Cet article aborde plusieurs domaines clés, offrant une exploration complète des sujets suivants :

- Les défis de données rencontrés par AWS Professional Services

- Le paysage et l'application des grands modèles de langage (LLM) :

- Transformateurs, BERT et GPT

- Étreindre le visage

- La solution LLM optimisée et ses composants :

- Préparation des données

- Formation de modèle

Défi des données

L'asymétrie des données est souvent un problème lors de l'élaboration de tâches de classification. Idéalement, vous aimeriez disposer d’un ensemble de données équilibré, et ce cas d’utilisation ne fait pas exception.

Nous abordons ce biais avec IA générative modèles (Falcon-7B et Falcon-40B), qui ont été invités à générer des échantillons d'événements basés sur cinq exemples de l'ensemble de formation afin d'augmenter la diversité sémantique et d'augmenter la taille de l'échantillon des événements indésirables étiquetés. Il est avantageux pour nous d'utiliser les modèles Falcon ici car, contrairement à certains LLM sur Hugging Face, Falcon vous donne l'ensemble de données de formation qu'ils utilisent, vous pouvez donc être sûr qu'aucun de vos exemples d'ensemble de test n'est contenu dans l'ensemble de formation Falcon et évitez les données. contamination.

L’autre défi en matière de données pour les clients du secteur de la santé concerne les exigences de conformité HIPAA. Le chiffrement au repos et en transit doit être intégré à la solution pour répondre à ces exigences.

Transformateurs, BERT et GPT

L'architecture du transformateur est une architecture de réseau neuronal utilisée pour les tâches de traitement du langage naturel (NLP). Il a été introduit pour la première fois dans le journal « L'attention est tout ce dont vous avez besoin » par Vaswani et coll. (2017). L'architecture du transformateur est basée sur le mécanisme d'attention, qui permet au modèle d'apprendre les dépendances à longue portée entre les mots. Les transformateurs, comme indiqué dans l'article original, se composent de deux composants principaux : l'encodeur et le décodeur. L'encodeur prend la séquence d'entrée en entrée et produit une séquence d'états cachés. Le décodeur prend ensuite ces états cachés en entrée et produit la séquence de sortie. Le mécanisme d'attention est utilisé à la fois dans le codeur et dans le décodeur. Le mécanisme d'attention permet au modèle de prêter attention à des mots spécifiques dans la séquence d'entrée lors de la génération de la séquence de sortie. Cela permet au modèle d'apprendre les dépendances à longue portée entre les mots, ce qui est essentiel pour de nombreuses tâches de PNL, telles que la traduction automatique et le résumé de texte.

L'une des architectures de transformateur les plus populaires et les plus utiles, les représentations d'encodeurs bidirectionnels des transformateurs (BERT), est un modèle de représentation de langage qui a été introduit dans 2018. BERT est formé sur des séquences où certains mots d'une phrase sont masqués, et il doit remplir ces mots en tenant compte à la fois des mots avant et après les mots masqués. BERT peut être optimisé pour diverses tâches de PNL, notamment la réponse aux questions, l'inférence en langage naturel et l'analyse des sentiments.

L’autre architecture de transformateur populaire qui a pris d’assaut le monde est le transformateur génératif pré-entraîné (GPT). Le premier modèle GPT était introduit en 2018 par OpenAI. Il fonctionne en étant entraîné à prédire strictement le mot suivant dans une séquence, en étant uniquement conscient du contexte précédant le mot. Les modèles GPT sont formés sur un ensemble massif de données de texte et de code, et ils peuvent être ajustés pour une gamme de tâches NLP, notamment la génération de texte, la réponse aux questions et la synthèse.

En général, BERT est meilleur dans les tâches qui nécessitent une compréhension plus approfondie du contexte des mots, alors que GPT est mieux adapté aux tâches qui nécessitent la génération de texte.

Étreindre le visage

Hugging Face est une société d'intelligence artificielle spécialisée dans la PNL. Il fournit une plate-forme avec des outils et des ressources qui permettent aux développeurs de créer, former et déployer des modèles ML axés sur les tâches NLP. L'une des offres clés de Hugging Face est sa bibliothèque, Transformateurs, qui comprend des modèles pré-entraînés qui peuvent être ajustés pour diverses tâches linguistiques telles que la classification de texte, la traduction, le résumé et la réponse aux questions.

Hugging Face s'intègre parfaitement à SageMaker, un service entièrement géré qui permet aux développeurs et aux data scientists de créer, former et déployer des modèles ML à grande échelle. Cette synergie profite aux utilisateurs en fournissant une infrastructure robuste et évolutive pour gérer les tâches de PNL avec les modèles de pointe proposés par Hugging Face, combinés aux services ML puissants et flexibles d'AWS. Vous pouvez également accéder aux modèles Hugging Face directement depuis Amazon SageMaker JumpStart, ce qui permet de démarrer facilement avec des solutions prédéfinies.

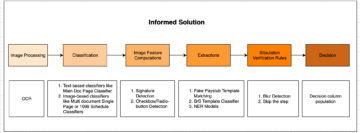

Vue d'ensemble de la solution

Nous avons utilisé la bibliothèque Hugging Face Transformers pour affiner les modèles de transformateurs sur SageMaker pour la tâche de classification des événements indésirables. La tâche de formation est construite à l'aide de l'estimateur SageMaker PyTorch. SageMaker JumpStart propose également des intégrations complémentaires avec Hugging Face qui facilitent la mise en œuvre. Dans cette section, nous décrivons les principales étapes impliquées dans la préparation des données et la formation du modèle.

Préparation des données

Nous avons utilisé les données sur les effets indésirables des médicaments (ade_corpus_v2) dans l'ensemble de données Hugging Face avec une répartition formation/test de 80/20. La structure de données requise pour notre formation et notre inférence de modèle comporte deux colonnes :

- Une colonne pour le contenu textuel en tant que données d'entrée du modèle.

- Une autre colonne pour la classe d'étiquette. Nous avons deux classes possibles pour un texte :

Not_AEet lesAdverse_Event.

Formation et expérimentation de modèles

Afin d'explorer efficacement l'espace des modèles Hugging Face possibles pour affiner nos données combinées d'événements indésirables, nous avons construit un travail d'optimisation d'hyperparamètres SageMaker (HPO) et transmis différents modèles Hugging Face en tant qu'hyperparamètre, ainsi que d'autres hyperparamètres importants. tels que la taille du lot de formation, la longueur de la séquence, les modèles et le taux d'apprentissage. Les tâches de formation utilisaient une instance ml.p3dn.24xlarge et prenaient en moyenne 30 minutes par tâche avec ce type d'instance. Les mesures de formation ont été capturées via le Expériences Amazon SageMaker outil, et chaque tâche de formation s'est déroulée sur 10 époques.

Nous précisons ce qui suit dans notre code :

- Taille du lot de formation – Nombre d'échantillons traités ensemble avant la mise à jour des poids du modèle

- Longueur de séquence – Longueur maximale de la séquence d’entrée que BERT peut traiter

- Taux d'apprentissage – À quelle vitesse le modèle met à jour ses poids pendant l’entraînement

- Des modèles photo – Modèles pré-entraînés Hugging Face

Résultats

Le modèle qui a le mieux fonctionné dans notre cas d'utilisation était le monologg/biobert_v1.1_pubmed modèle hébergé sur Hugging Face, qui est une version de l'architecture BERT pré-entraînée sur l'ensemble de données Pubmed, qui comprend 19,717 XNUMX publications scientifiques. La pré-formation BERT sur cet ensemble de données donne à ce modèle une expertise supplémentaire lorsqu'il s'agit d'identifier le contexte autour des termes scientifiques liés à la médecine. Cela améliore les performances du modèle pour la tâche de détection des événements indésirables, car il a été pré-entraîné sur une syntaxe médicalement spécifique qui apparaît souvent dans notre ensemble de données.

Le tableau suivant résume nos mesures d’évaluation.

| Modèle | La précision | Rappeler | F1 |

| Base BERT | 0.87 | 0.95 | 0.91 |

| BioBert | 0.89 | 0.95 | 0.92 |

| BioBERT avec HPO | 0.89 | 0.96 | 0.929 |

| BioBERT avec HPO et événement indésirable généré synthétiquement | 0.90 | 0.96 | 0.933 |

Bien qu'il s'agisse d'améliorations relativement faibles et progressives par rapport au modèle BERT de base, cela démontre néanmoins certaines stratégies viables pour améliorer les performances du modèle grâce à ces méthodes. La génération de données synthétiques avec Falcon semble être très prometteuse et potentielle en termes d'amélioration des performances, d'autant plus que ces modèles d'IA génératifs s'améliorent avec le temps.

Nettoyer

Pour éviter d'encourir des frais futurs, supprimez toutes les ressources créées telles que le modèle et les points de terminaison du modèle que vous avez créés avec le code suivant :

Conclusion

De nombreuses sociétés pharmaceutiques souhaitent aujourd’hui automatiser le processus d’identification des événements indésirables issus de leurs interactions avec leurs clients de manière systématique afin de contribuer à améliorer la sécurité et les résultats pour les clients. Comme nous l'avons montré dans cet article, le LLM BioBERT affiné avec des événements indésirables générés synthétiquement ajoutés aux données classe les événements indésirables avec des scores F1 élevés et peut être utilisé pour créer une solution conforme à la HIPAA pour nos clients.

Comme toujours, AWS accueille vos commentaires. Veuillez laisser vos réflexions et vos questions dans la section commentaires.

À propos des auteurs

Zack Peterson est un data scientist chez AWS Professional Services. Il s'occupe de fournir des solutions d'apprentissage automatique aux clients depuis de nombreuses années et est titulaire d'une maîtrise en économie.

Zack Peterson est un data scientist chez AWS Professional Services. Il s'occupe de fournir des solutions d'apprentissage automatique aux clients depuis de nombreuses années et est titulaire d'une maîtrise en économie.

Dr Adewale Akinfaderin est un data scientist senior dans le domaine de la santé et des sciences de la vie chez AWS. Son expertise réside dans les méthodes d'IA/ML reproductibles et de bout en bout, dans les mises en œuvre pratiques et dans l'aide aux clients mondiaux du secteur de la santé à formuler et développer des solutions évolutives à des problèmes interdisciplinaires. Il possède deux diplômes d'études supérieures en physique et un doctorat en ingénierie.

Dr Adewale Akinfaderin est un data scientist senior dans le domaine de la santé et des sciences de la vie chez AWS. Son expertise réside dans les méthodes d'IA/ML reproductibles et de bout en bout, dans les mises en œuvre pratiques et dans l'aide aux clients mondiaux du secteur de la santé à formuler et développer des solutions évolutives à des problèmes interdisciplinaires. Il possède deux diplômes d'études supérieures en physique et un doctorat en ingénierie.

Ekta Walia Bhullar, PhD, est consultant senior en IA/ML au sein de l'unité commerciale AWS Healthcare and Life Sciences (HCLS) Professional Services. Elle possède une vaste expérience dans l’application de l’IA/ML dans le domaine de la santé, notamment en radiologie. En dehors du travail, lorsqu’elle ne parle pas d’IA en radiologie, elle aime courir et faire de la randonnée.

Ekta Walia Bhullar, PhD, est consultant senior en IA/ML au sein de l'unité commerciale AWS Healthcare and Life Sciences (HCLS) Professional Services. Elle possède une vaste expérience dans l’application de l’IA/ML dans le domaine de la santé, notamment en radiologie. En dehors du travail, lorsqu’elle ne parle pas d’IA en radiologie, elle aime courir et faire de la randonnée.

Homme Han est un responsable senior de la science des données et de l'apprentissage automatique chez AWS Professional Services basé à San Diego, en Californie. Il est titulaire d'un doctorat en ingénierie de l'Université Northwestern et possède plusieurs années d'expérience en tant que consultant en gestion conseillant des clients dans les secteurs de la fabrication, des services financiers et de l'énergie. Aujourd'hui, il travaille avec passion avec des clients clés issus de divers secteurs verticaux pour développer et mettre en œuvre des solutions de ML et d'IA générative sur AWS.

Homme Han est un responsable senior de la science des données et de l'apprentissage automatique chez AWS Professional Services basé à San Diego, en Californie. Il est titulaire d'un doctorat en ingénierie de l'Université Northwestern et possède plusieurs années d'expérience en tant que consultant en gestion conseillant des clients dans les secteurs de la fabrication, des services financiers et de l'énergie. Aujourd'hui, il travaille avec passion avec des clients clés issus de divers secteurs verticaux pour développer et mettre en œuvre des solutions de ML et d'IA générative sur AWS.

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- PlatoData.Network Ai générative verticale. Autonomisez-vous. Accéder ici.

- PlatoAiStream. Intelligence Web3. Connaissance Amplifiée. Accéder ici.

- PlatonESG. Carbone, Technologie propre, Énergie, Environnement, Solaire, La gestion des déchets. Accéder ici.

- PlatoHealth. Veille biotechnologique et essais cliniques. Accéder ici.

- La source: https://aws.amazon.com/blogs/machine-learning/deploy-large-language-models-for-a-healthtech-use-case-on-amazon-sagemaker/

- :possède

- :est

- :ne pas

- :où

- $UP

- 1

- 10

- 100

- 16

- 19

- 2017

- 2018

- 2021

- 2022

- 30

- 32

- 7

- a

- accès

- Compte

- ACM

- actes

- d'activités

- ajoutée

- propos

- avantageux

- négatif

- du conseil

- Après

- AI

- Modèles AI

- AI / ML

- AL

- Tous

- permet

- le long de

- aussi

- toujours

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- montant

- an

- selon une analyse de l’Université de Princeton

- et les

- répondre

- tous

- de n'importe où

- Application

- approprié

- architecture

- architectures

- SONT

- domaines

- autour

- artificiel

- intelligence artificielle

- AS

- At

- pour participer

- précaution

- automatiser

- disponibles

- moyen

- éviter

- conscients

- AWS

- Services professionnels AWS

- balanced

- base

- basé

- BE

- car

- était

- before

- va

- avantages.

- LES MEILLEURS

- Améliorée

- jusqu'à XNUMX fois

- bidirectionnel

- Milliards

- l'attrait

- tous les deux

- frontières

- construire

- Développement

- construit

- la performance des entreprises

- mais

- by

- CA

- Appels

- CAN

- capturé

- maisons

- challenge

- globaux

- difficile

- des charges

- classe

- les classes

- classification

- CLIENTS

- le cloud

- code

- Colonne

- Colonnes

- combiné

- vient

- Venir

- commentaires

- Sociétés

- Société

- complémentaire

- conformité

- composants électriques

- complet

- consiste

- construit

- consultant

- contenu

- contenu

- contexte

- Pratique

- Prix

- Costs

- couverture

- engendrent

- créée

- des clients

- Clients

- données

- Préparation des données

- science des données

- Data Scientist

- Structure de données

- profond

- Vous permet de définir

- Degré

- livrer

- Delves

- démontre

- dépendances

- déployer

- décrire

- Détection

- développer

- mobiles

- Développement

- Diego

- différent

- directement

- discuter

- Diversité

- domaine

- Ne pas

- drogue

- Médicaments

- pendant

- E & T

- chacun

- Économie

- efficacement

- emails

- permettre

- permet

- chiffrement

- end-to-end

- énergie

- ENGINEERING

- époques

- notamment

- essential

- évaluation

- événement

- événements

- exemples

- exception

- d'experience

- nous a permis de concevoir

- exploration

- explorez

- les

- Une vaste expérience

- supplémentaire

- f1

- Visage

- Réactions

- remplir

- la traduction de documents financiers

- services financiers

- Prénom

- cinq

- flexible

- concentré

- Abonnement

- Pour

- De

- d’étiquettes électroniques entièrement

- avenir

- Général

- générer

- généré

- générateur

- génération

- génératif

- IA générative

- obtenez

- donne

- Global

- diplôme

- manipuler

- Mains

- Vous avez

- he

- Santé

- la médecine

- secteur de la santé

- HealthTech

- vous aider

- aider

- ici

- caché

- Haute

- Promenades

- sa

- appuyez en continu

- Accueil

- les hôpitaux

- organisé

- Comment

- How To

- Cependant

- HTTPS

- Optimisation hyperparamétrique

- idéalement

- identifier

- Mettre en oeuvre

- la mise en oeuvre

- implémentations

- mis en œuvre

- importer

- important

- améliorer

- améliorations

- in

- inclut

- Y compris

- Incorporée

- Améliore

- croissant

- incrémental

- industrie

- d'information

- Infrastructure

- contribution

- instance

- Intègre

- intégrations

- Intelligence

- interactions

- développement

- introduit

- impliqué

- IT

- SES

- Emploi

- Emplois

- jpg

- ACTIVITES

- Zones-clés

- Libellé

- vergé

- paysage d'été

- langue

- gros

- APPRENTISSAGE

- apprentissage

- Laisser

- Longueur

- Bibliothèque

- VIE

- Life Sciences

- comme

- aime

- LLM

- Lot

- click

- machine learning

- LES PLANTES

- Entrée

- majeur

- FAIT DU

- Fabrication

- man

- gérés

- gestion

- manager

- Manuel

- fabrication

- de nombreuses

- Marché

- massif

- maîtrise

- Maximisez

- maximales

- mécanisme

- Médias

- médical

- données médicales

- Découvrez

- méthodes

- Métrique

- Minutes

- ML

- modèle

- numériques jumeaux (digital twin models)

- surveillé

- PLUS

- must

- prénom

- Nature

- Traitement du langage naturel

- réseau et

- neural

- Réseau neuronal

- Néanmoins

- next

- nlp

- aucune

- Aucun

- Notes

- roman

- nombre

- se produire

- of

- Offrandes

- Offres Speciales

- souvent

- on

- ONE

- uniquement

- à mettre en œuvre pour gérer une entreprise rentable. Ce guide est basé sur trois décennies d'expérience

- or

- de commander

- original

- Autre

- nos

- ande

- les résultats

- sortie

- au contrôle

- plus de

- global

- global

- Papier

- passé

- /

- performant

- effectué

- effectue

- Pharmaceutique

- phd

- Téléphone

- appels téléphoniques

- Physique

- plateforme

- Platon

- Intelligence des données Platon

- PlatonDonnées

- veuillez cliquer

- Populaire

- possible

- Post

- défaillances

- power

- solide

- Méthode

- prévoir

- préparation

- Problème

- d'ouvrabilité

- processus

- Traité

- traitement

- produit

- professionels

- projetée

- PROMETTONS

- fournit

- aportando

- publications

- publiquement

- pytorch

- question

- fréquemment posées

- vite.

- gamme

- Tarif

- réaction

- en temps réel

- reportez-vous

- regex

- en relation

- relativement

- Signalé

- représentation

- exigent

- conditions

- Exigences

- Resources

- de manière responsable

- REST

- robuste

- Courir

- Sécurité

- sagemaker

- échantillon

- San

- San Diego

- évolutive

- Escaliers intérieurs

- Sciences

- STARFLEET SCIENCES

- sur une base scientifique

- Scientifique

- scientifiques

- de façon transparente

- Section

- semble

- vendre

- sémantique

- supérieur

- phrase

- sentiment

- Séquence

- grave

- service

- Services

- set

- plusieurs

- elle

- montrer

- montré

- Spectacles

- Taille

- biais

- petit

- So

- Réseaux sociaux

- réseaux sociaux

- sur mesure

- Solutions

- quelques

- parfois

- Sources

- Space

- spécialise

- groupe de neurones

- détails

- scission

- Commencer

- state-of-the-art

- États

- Étapes

- tempête

- simple

- les stratégies

- structure

- tel

- Support

- sûr

- synergie

- syntaxe

- haute

- données synthétiques

- synthétiquement

- combustion propre

- table

- tâches

- prend

- prise

- Tâche

- tâches

- conditions

- tester

- texte

- Classification du texte

- qui

- Le

- le monde

- leur

- puis

- Ces

- l'ont

- this

- ceux

- bien que?

- Avec

- fiable

- à

- aujourd'hui

- ensemble

- a

- outil

- les outils

- Les sujets

- traditionnel

- Train

- qualifié

- Formation

- transformateur

- transformateurs

- transit

- Traduction

- essayé

- déclencher

- deux

- type

- compréhension

- unité

- université

- contrairement à

- Actualités

- us

- utilisé

- cas d'utilisation

- d'utiliser

- incontournable

- utilisateurs

- en utilisant

- variété

- divers

- version

- verticales

- viable

- souhaitez

- était

- Façon..

- we

- web

- services Web

- se félicite

- ont été

- quand

- Les

- qui

- comprenant

- dans les

- Word

- des mots

- activités principales

- de travail

- vos contrats

- world

- pourra

- années

- Vous n'avez

- Votre

- zéphyrnet