La préparation des données est une étape critique dans tout projet axé sur les données, et disposer des bons outils peut grandement améliorer l'efficacité opérationnelle. Gestionnaire de données Amazon SageMaker réduit le temps nécessaire pour agréger et préparer les données tabulaires et d'image pour l'apprentissage automatique (ML) de quelques semaines à quelques minutes. Avec SageMaker Data Wrangler, vous pouvez simplifier le processus de préparation des données et d'ingénierie des fonctionnalités et effectuer chaque étape du workflow de préparation des données, y compris la sélection, le nettoyage, l'exploration et la visualisation des données à partir d'une interface visuelle unique.

Dans cet article, nous explorons les dernières fonctionnalités de SageMaker Data Wrangler qui sont spécifiquement conçues pour améliorer l'expérience opérationnelle. Nous nous penchons sur le soutien de Service de stockage simple (Amazon S3) manifeste fichiers, artefacts d'inférence dans un flux de données interactif et l'intégration transparente avec JSON (notation d'objet JavaScript) format pour l'inférence, soulignant comment ces améliorations rendent la préparation des données plus facile et plus efficace.

Présentation de nouvelles fonctionnalités

Dans cette section, nous abordons les nouvelles fonctionnalités de SageMaker Data Wrangler pour une préparation optimale des données.

Prise en charge des fichiers manifestes S3 avec SageMaker Autopilot pour l'inférence ML

SageMaker Data Wrangler permet une préparation de données unifiée et formation de modèles expérience avec Pilote automatique Amazon SageMaker en quelques clics. Vous pouvez utiliser SageMaker Autopilot pour former, régler et déployer automatiquement des modèles sur les données que vous avez transformées dans votre flux de données.

Cette expérience est maintenant encore simplifiée avec la prise en charge des fichiers manifestes S3. Un fichier manifeste S3 est un fichier texte qui répertorie les objets (fichiers) stockés dans un compartiment S3. Si votre ensemble de données exporté dans SageMaker Data Wrangler est assez volumineux et divisé en plusieurs fichiers de données dans Amazon S3, SageMaker Data Wrangler créera automatiquement un fichier manifeste dans SageMaker représentant tous ces fichiers de données. Ce fichier manifeste généré peut maintenant être utilisé avec l'interface utilisateur SageMaker Autopilot dans SageMaker Data Wrangler pour récupérer toutes les données partitionnées pour la formation.

Avant le lancement de cette fonctionnalité, lorsque vous utilisiez des modèles SageMaker Autopilot formés sur des données préparées à partir de SageMaker Data Wrangler, vous ne pouviez choisir qu'un seul fichier de données, qui pouvait ne pas représenter l'intégralité de l'ensemble de données, en particulier si l'ensemble de données est très volumineux. Avec cette nouvelle expérience de fichier manifeste, vous n'êtes pas limité à un sous-ensemble de votre ensemble de données. Vous pouvez créer un modèle ML avec SageMaker Autopilot représentant toutes vos données à l'aide du fichier manifeste et l'utiliser pour votre inférence ML et votre déploiement de production. Cette fonctionnalité améliore l'efficacité opérationnelle en simplifiant la formation des modèles ML avec SageMaker Autopilot et en rationalisant les workflows de traitement des données.

Ajout de la prise en charge du flux d'inférence dans les artefacts générés

Les clients souhaitent prendre les transformations de données qu'ils ont appliquées à leurs données de formation de modèle, telles que l'encodage à chaud, l'ACP et l'imputation des valeurs manquantes, et appliquer ces transformations de données à l'inférence en temps réel ou à l'inférence par lots en production. Pour ce faire, vous devez disposer d'un artefact d'inférence SageMaker Data Wrangler, qui est consommé par un modèle SageMaker.

Auparavant, les artefacts d'inférence ne pouvaient être générés qu'à partir de l'interface utilisateur lors de l'exportation vers la formation SageMaker Autopilot ou l'exportation d'un bloc-notes de pipeline d'inférence. Cela n'offrait pas de flexibilité si vous vouliez sortir vos flux SageMaker Data Wrangler en dehors du Amazon SageMakerStudio environnement. Désormais, vous pouvez générer un artefact d'inférence pour tout fichier de flux compatible via une tâche de traitement SageMaker Data Wrangler. Cela permet des MLOps programmatiques de bout en bout avec les flux SageMaker Data Wrangler pour les personnages MLOps code-first, ainsi qu'un chemin intuitif et sans code pour obtenir un artefact d'inférence en créant une tâche à partir de l'interface utilisateur.

Rationalisation de la préparation des données

JSON est devenu un format largement adopté pour l'échange de données dans les écosystèmes de données modernes. L'intégration de SageMaker Data Wrangler au format JSON vous permet de gérer de manière transparente les données JSON pour la transformation et le nettoyage. En fournissant une prise en charge native de JSON, SageMaker Data Wrangler simplifie le processus de travail avec des données structurées et semi-structurées, vous permettant d'extraire des informations précieuses et de préparer les données efficacement. SageMaker Data Wrangler prend désormais en charge le format JSON pour le déploiement de points de terminaison d'inférence par lots et en temps réel.

Vue d'ensemble de la solution

Pour notre cas d'utilisation, nous utilisons l'exemple Ensemble de données sur les avis des clients Amazon pour montrer comment SageMaker Data Wrangler peut simplifier l'effort opérationnel pour créer un nouveau modèle ML à l'aide de SageMaker Autopilot. L'ensemble de données sur les avis des clients d'Amazon contient des avis sur les produits et des métadonnées d'Amazon, dont 142.8 millions d'avis couvrant la période de mai 1996 à juillet 2014.

De manière générale, nous utilisons SageMaker Data Wrangler pour gérer ce grand ensemble de données et effectuer les actions suivantes :

- Développez un modèle ML dans SageMaker Autopilot en utilisant tout l'ensemble de données, pas seulement un échantillon.

- Créez un pipeline d'inférence en temps réel avec l'artefact d'inférence généré par SageMaker Data Wrangler et utilisez le formatage JSON pour l'entrée et la sortie.

Prise en charge des fichiers manifestes S3 avec SageMaker Autopilot

Lors de la création d'une expérience SageMaker Autopilot à l'aide de SageMaker Data Wrangler, vous ne pouviez auparavant spécifier qu'un seul fichier CSV ou Parquet. Désormais, vous pouvez également utiliser un fichier manifeste S3, ce qui vous permet d'utiliser de grandes quantités de données pour les expériences SageMaker Autopilot. SageMaker Data Wrangler divisera automatiquement les fichiers de données d'entrée en plusieurs fichiers plus petits et générera un manifeste pouvant être utilisé dans une expérience SageMaker Autopilot pour extraire toutes les données de la session interactive, et pas seulement un petit échantillon.

Effectuez les étapes suivantes:

- Importez les données d'avis de clients Amazon à partir d'un fichier CSV dans SageMaker Data Wrangler. Assurez-vous de désactiver l'échantillonnage lors de l'importation des données.

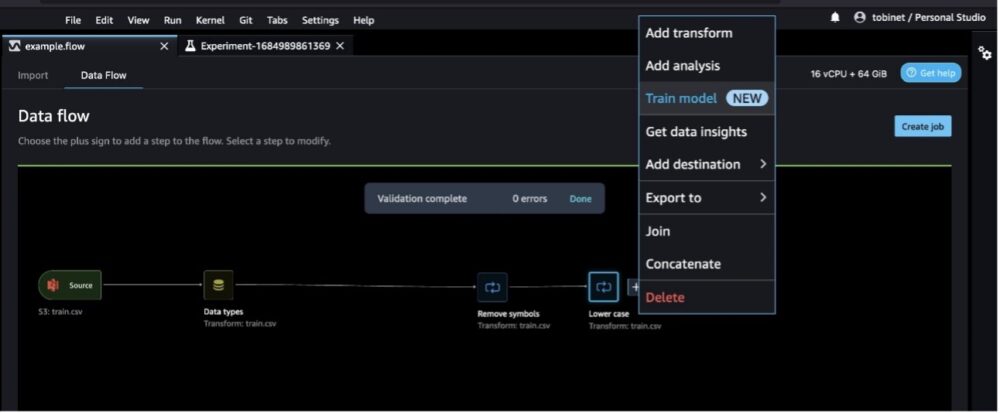

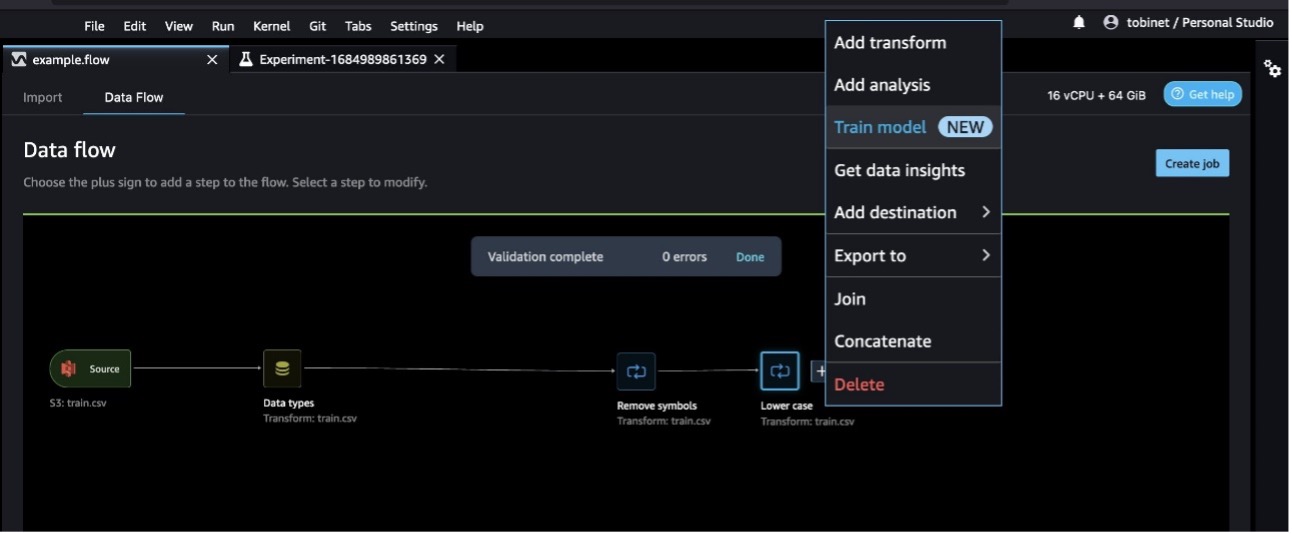

- Spécifiez les transformations qui normalisent les données. Pour cet exemple, supprimez les symboles et transformez tout en minuscules à l'aide des transformations intégrées de SageMaker Data Wrangler.

- Selectionnez Modèle de train pour commencer la formation.

Pour former un modèle avec SageMaker Autopilot, SageMaker exporte automatiquement les données vers un compartiment S3. Pour les grands ensembles de données comme celui-ci, il divisera automatiquement le fichier en fichiers plus petits et générera un manifeste qui inclut l'emplacement des fichiers plus petits.

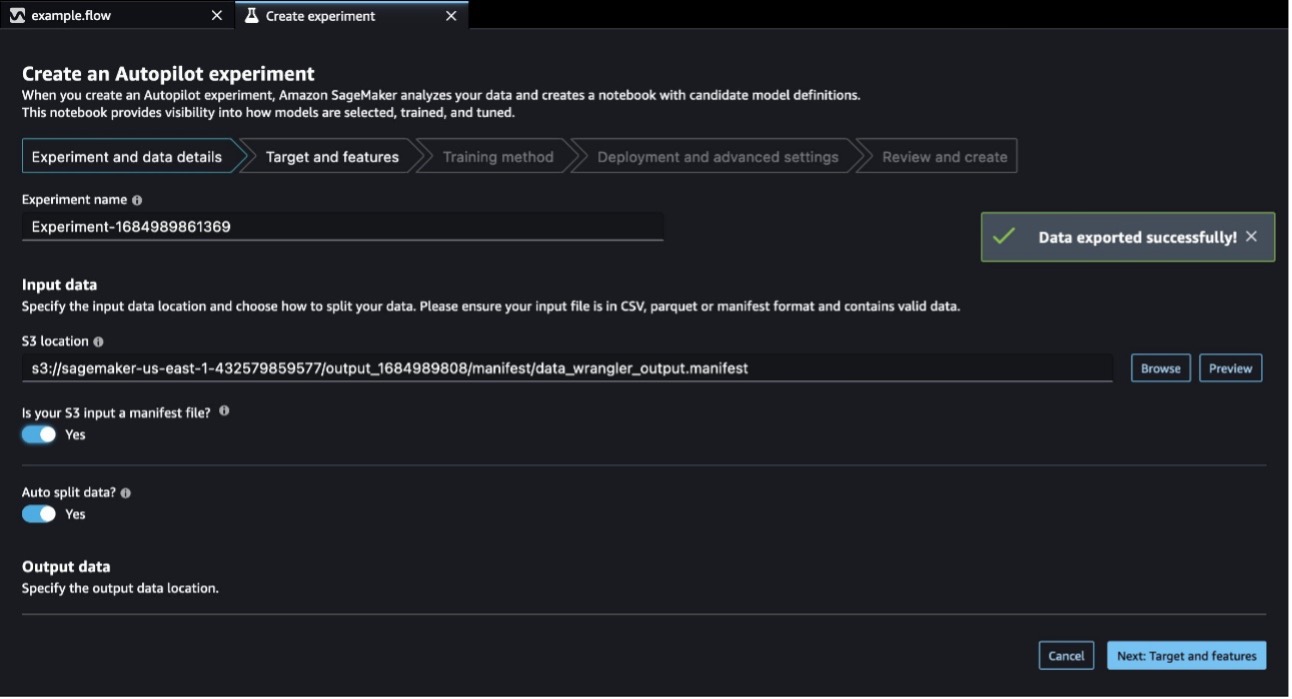

- Tout d'abord, sélectionnez vos données d'entrée.

Auparavant, SageMaker Data Wrangler n'avait pas la possibilité de générer un fichier manifeste à utiliser avec SageMaker Autopilot. Aujourd'hui, avec la sortie de la prise en charge des fichiers manifestes, SageMaker Data Wrangler exportera automatiquement un fichier manifeste vers Amazon S3, pré-remplira l'emplacement S3 de la formation SageMaker Autopilot avec l'emplacement S3 du fichier manifeste et basculera l'option de fichier manifeste sur Oui. Aucun travail n'est nécessaire pour générer ou utiliser le fichier manifeste.

- Configurez votre expérience en sélectionnant la cible du modèle à prédire.

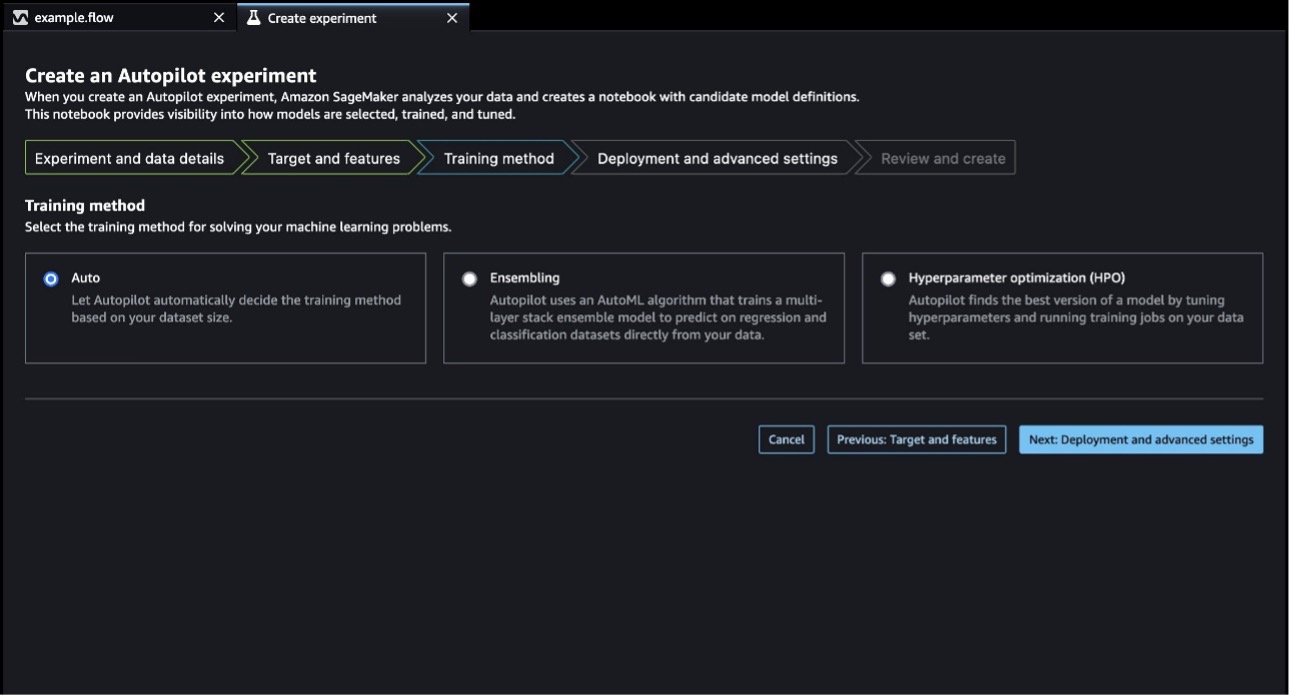

- Ensuite, sélectionnez une méthode d'entraînement. Dans ce cas, nous sélectionnons Automatique et laissez SageMaker Autopilot décider de la meilleure méthode de formation en fonction de la taille de l'ensemble de données.

- Spécifiez les paramètres de déploiement.

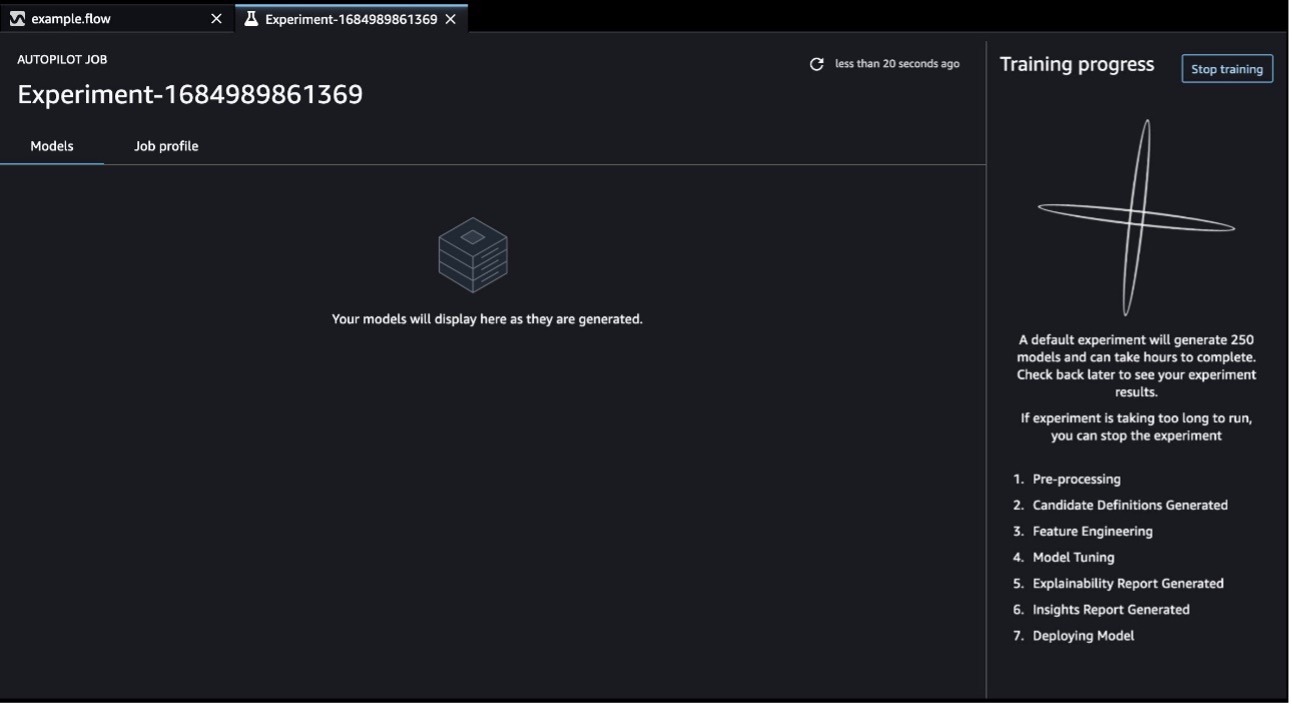

- Enfin, passez en revue la configuration de la tâche et soumettez l'expérience SageMaker Autopilot pour la formation. Lorsque SageMaker Autopilot termine l'expérience, vous pouvez afficher les résultats de la formation et explorer le meilleur modèle.

Grâce à la prise en charge des fichiers manifestes, vous pouvez utiliser l'ensemble de vos données pour l'expérience SageMaker Autopilot, et pas seulement un sous-ensemble de vos données.

Pour plus d'informations sur l'utilisation de SageMaker Autopilot avec SageMaker Data Wrangler, voir Préparation unifiée des données et formation des modèles avec Amazon SageMaker Data Wrangler et Amazon SageMaker Autopilot.

Générer des artefacts d'inférence à partir des tâches de traitement SageMaker

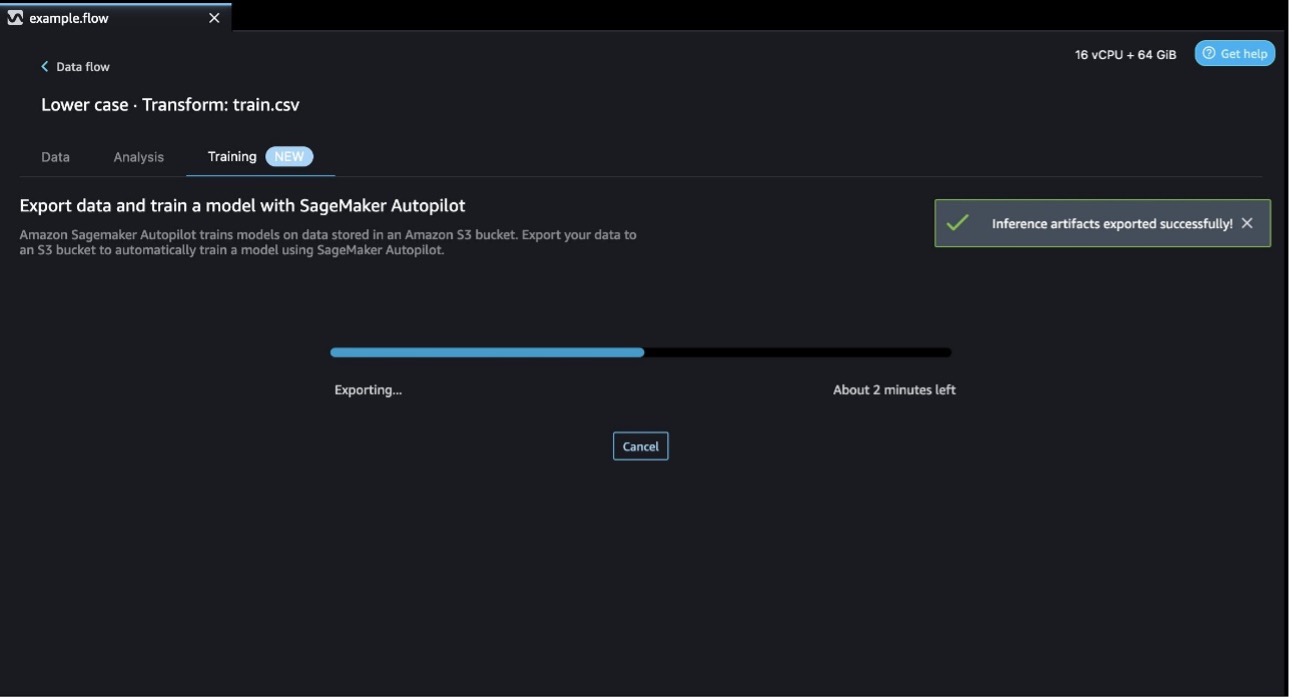

Voyons maintenant comment nous pouvons générer des artefacts d'inférence via l'interface utilisateur SageMaker Data Wrangler et les blocs-notes SageMaker Data Wrangler.

Interface utilisateur de SageMaker Data Wrangler

Pour notre cas d'utilisation, nous voulons traiter nos données via l'interface utilisateur, puis utiliser les données résultantes pour former et déployer un modèle via la console SageMaker. Effectuez les étapes suivantes :

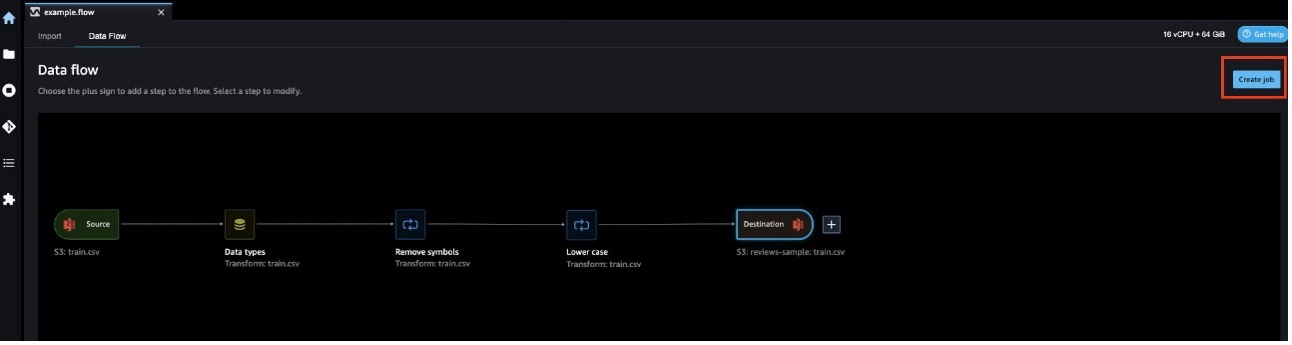

- Ouvrez le flux de données que vous avez créé dans la section précédente.

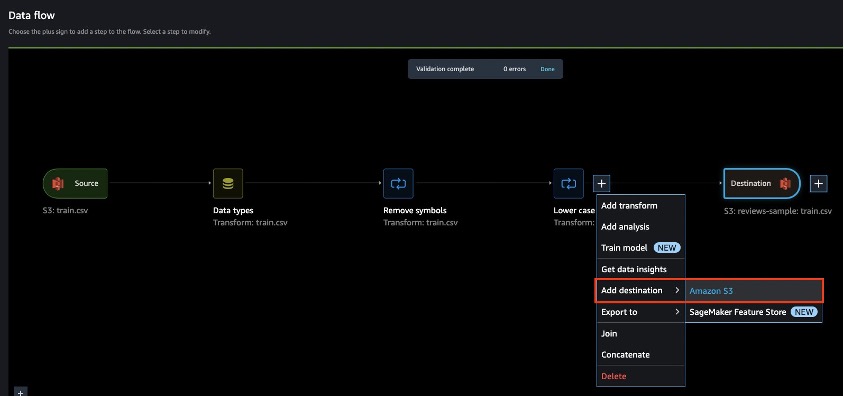

- Choisissez le signe plus à côté de la dernière transformation, choisissez Ajouter destinationet choisissez Amazon S3. Ce sera là que les données traitées seront stockées.

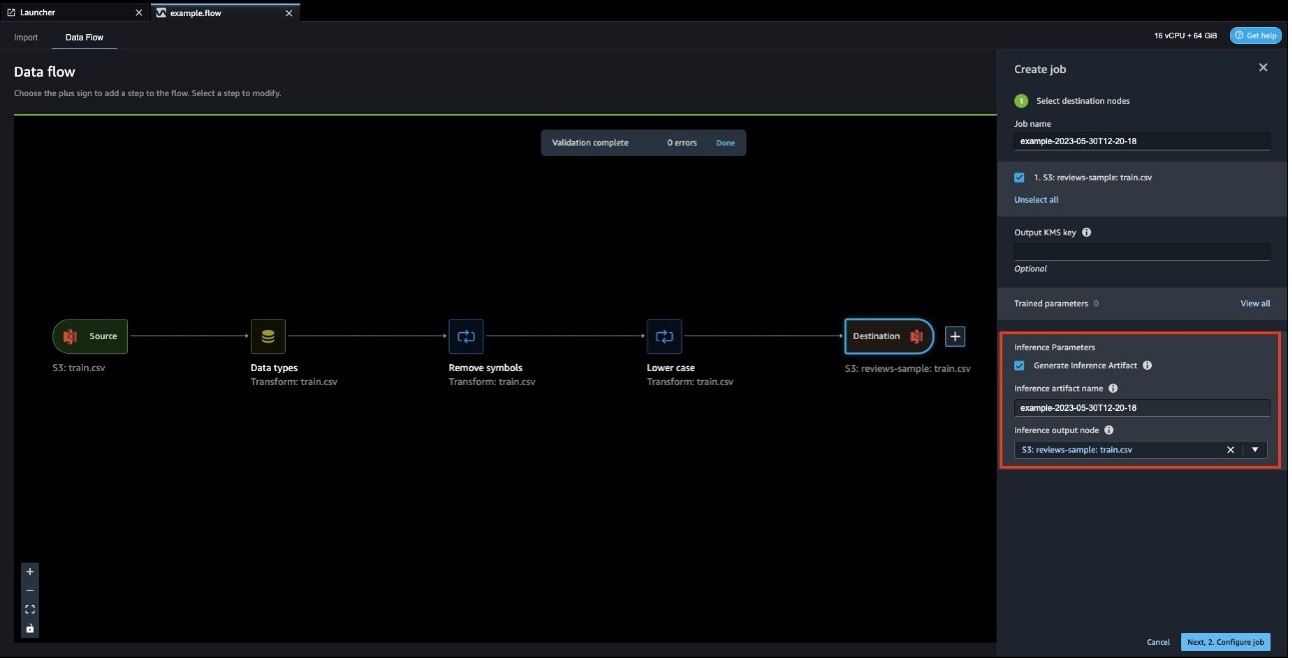

- Selectionnez Créer un emploi.

- Sélectionnez Générer des artefacts d'inférence dans la section Paramètres d'inférence pour générer un artefact d'inférence.

- Pour Nom de l'artefact d'inférence, entrez le nom de votre artefact d'inférence (avec .tar.gz comme extension de fichier).

- Pour Nœud de sortie d'inférence, saisissez le nœud de destination correspondant aux transformations appliquées à vos données d'apprentissage.

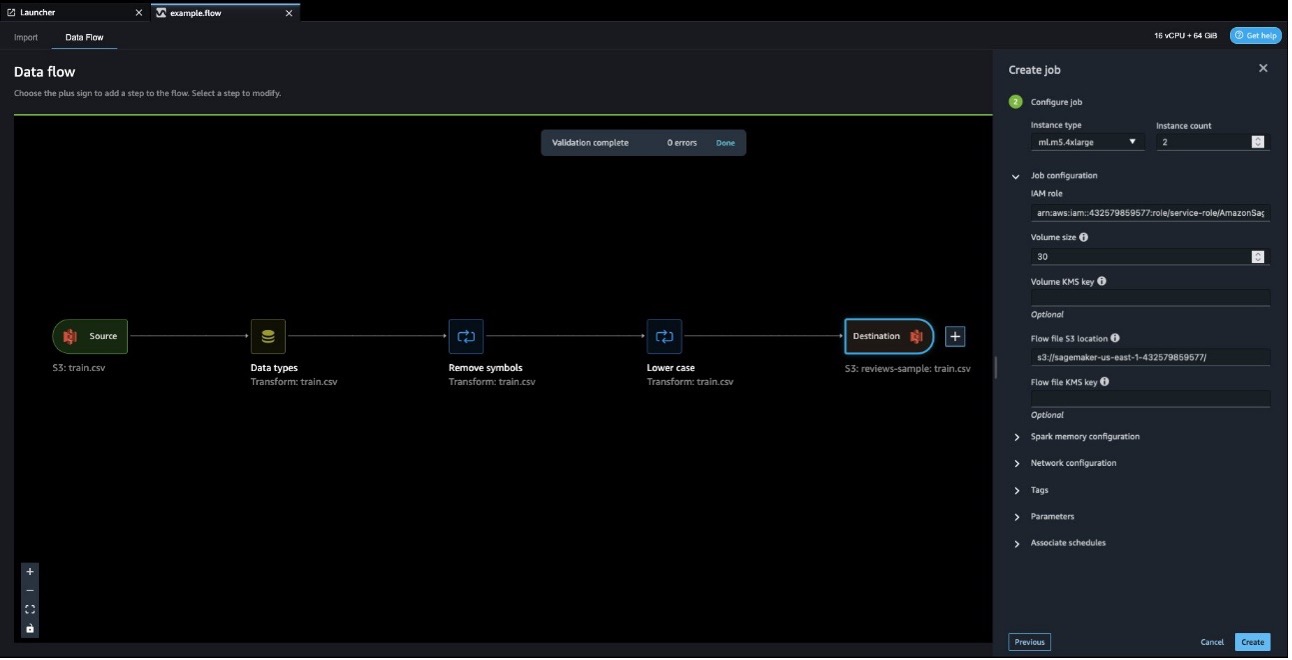

- Selectionnez Configurer le travail.

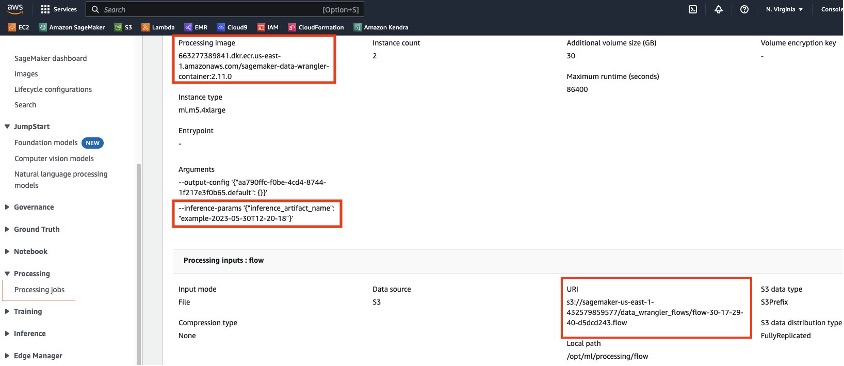

- Sous Configuration de la tâche, entrez un chemin pour Emplacement du fichier de flux S3. Un dossier appelé

data_wrangler_flowssera créé à cet emplacement et l'artefact d'inférence sera chargé dans ce dossier. Pour modifier l'emplacement de téléchargement, définissez un autre emplacement S3. - Laissez les valeurs par défaut pour toutes les autres options et choisissez Création pour créer la tâche de traitement.

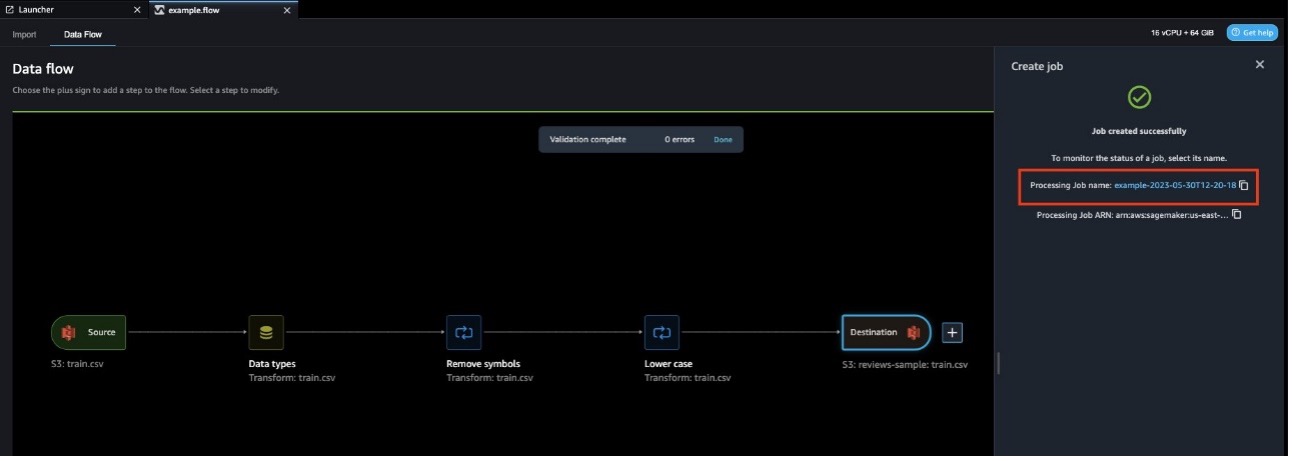

La tâche de traitement créera untarball (.tar.gz)contenant un fichier de flux de données modifié avec une section d'inférence nouvellement ajoutée qui vous permet de l'utiliser pour l'inférence. Vous avez besoin de l'URI (Uniform Resource Identifier) S3 de l'artefact d'inférence pour fournir l'artefact à un modèle SageMaker lors du déploiement de votre solution d'inférence. L'URI sera sous la forme{Flow file S3 location}/data_wrangler_flows/{inference artifact name}.tar.gz. - Si vous n'avez pas noté ces valeurs plus tôt, vous pouvez choisir le lien vers la tâche de traitement pour trouver les détails pertinents. Dans notre exemple, l'URI est

s3://sagemaker-us-east-1-43257985977/data_wrangler_flows/example-2023-05-30T12-20-18.tar.gz.

- Copiez la valeur de Traitement de l'image; nous avons également besoin de cet URI lors de la création de notre modèle.

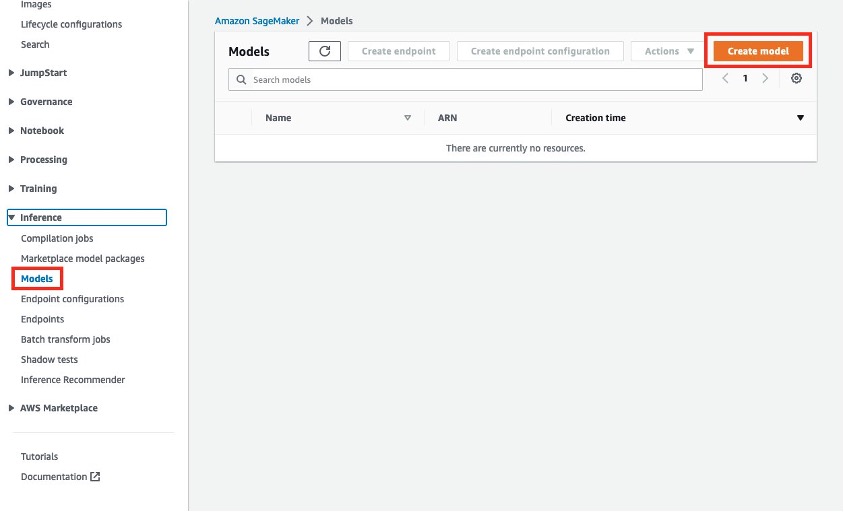

- Nous pouvons maintenant utiliser cet URI pour créer un modèle SageMaker sur la console SageMaker, que nous pourrons ensuite déployer sur un point de terminaison ou une tâche de transformation par lots.

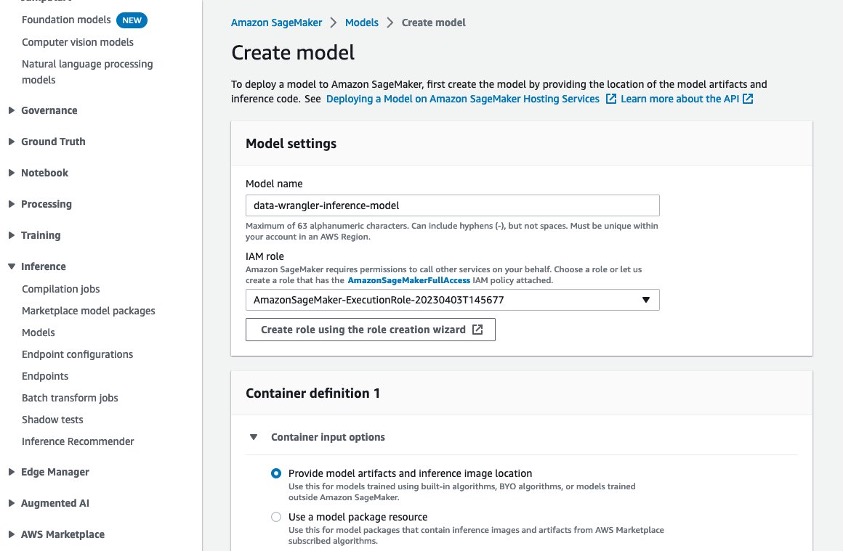

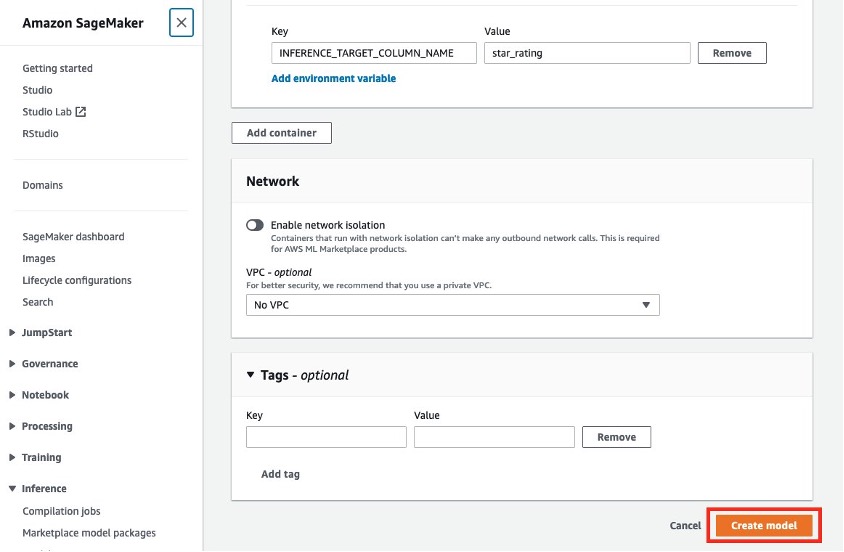

- Sous Paramètres du modèle¸ saisissez un nom de modèle et spécifiez votre rôle IAM.

- Pour Options d'entrée du conteneur, sélectionnez Fournir des artefacts de modèle et l'emplacement de l'image d'inférence.

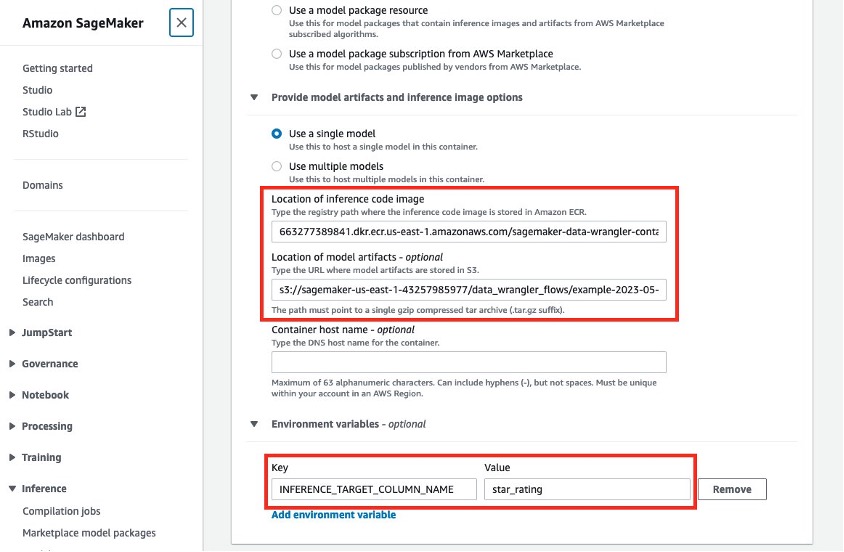

- Pour Emplacement de l'image du code d'inférence, entrez l'URI de l'image de traitement.

- Pour Emplacement des artefacts du modèle, entrez l'URI de l'artefact d'inférence.

- De plus, si vos données comportent une colonne cible qui sera prédite par un modèle de ML entraîné, spécifiez le nom de cette colonne sous Variables d'environnement, avec

INFERENCE_TARGET_COLUMN_NAMEas ACTIVITES et le nom de la colonne comme Valeur.

- Terminez la création de votre modèle en choisissant Créer un modèle.

Nous avons maintenant un modèle que nous pouvons déployer sur un point de terminaison ou une tâche de transformation par lots.

Blocs-notes SageMaker Data Wrangler

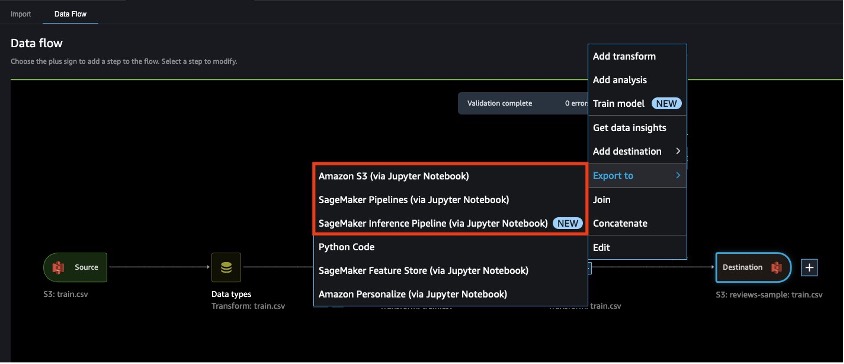

Pour une approche code-first pour générer l'artefact d'inférence à partir d'une tâche de traitement, nous pouvons trouver l'exemple de code en choisissant Exporter vers dans le menu du nœud et en choisissant soit Amazon S3, Pipelines SageMakerou Pipeline d'inférence SageMaker. Nous choisissons Pipeline d'inférence SageMaker dans cet exemple.

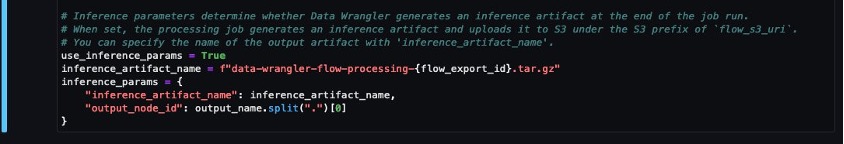

Dans ce cahier, il y a une section intitulée Créer un processeur (c'est identique dans le bloc-notes SageMaker Pipelines, mais dans le bloc-notes Amazon S3, le code équivalent sera sous le Configurations de travail section). Au bas de cette section se trouve une configuration pour notre artefact d'inférence appelé inference_params. Il contient les mêmes informations que celles que nous avons vues dans l'interface utilisateur, à savoir le nom de l'artefact d'inférence et le nœud de sortie d'inférence. Ces valeurs seront préremplies mais peuvent être modifiées. Il existe en outre un paramètre appelé use_inference_params, qui doit être réglé sur True pour utiliser cette configuration dans le travail de traitement.

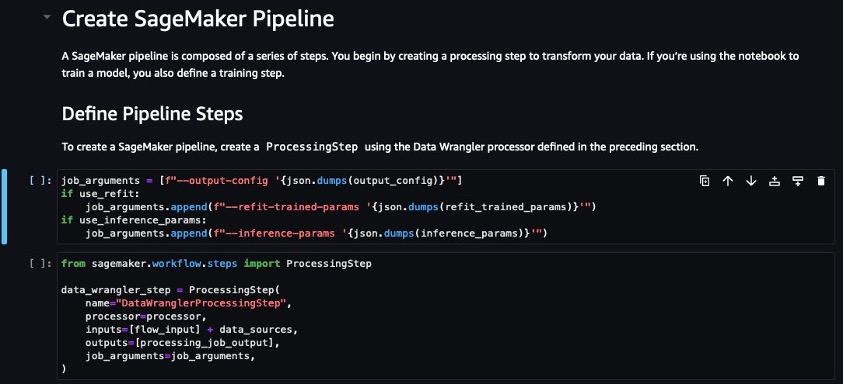

Plus bas se trouve une section intitulée Définir les étapes du pipeline, Où le inference_params La configuration est ajoutée à une liste d'arguments de travail et transmise dans la définition d'une étape de traitement SageMaker Data Wrangler. Dans le bloc-notes Amazon S3, job_arguments est défini immédiatement après le Configurations de travail .

Avec ces configurations simples, la tâche de traitement créée par ce bloc-notes générera un artefact d'inférence au même emplacement S3 que notre fichier de flux (défini précédemment dans notre bloc-notes). Nous pouvons déterminer par programmation cet emplacement S3 et utiliser cet artefact pour créer un modèle SageMaker à l'aide du Kit de développement logiciel (SDK) SageMaker Python, qui est illustré dans le bloc-notes SageMaker Inference Pipeline.

La même approche peut être appliquée à tout code Python qui crée une tâche de traitement SageMaker Data Wrangler.

Prise en charge du format de fichier JSON pour l'entrée et la sortie pendant l'inférence

Il est assez courant que les sites Web et les applications utilisent JSON comme demande/réponse pour les API afin que les informations soient faciles à analyser par différents langages de programmation.

Auparavant, après avoir formé un modèle, vous ne pouviez interagir avec lui que via CSV en tant que format d'entrée dans un pipeline d'inférence SageMaker Data Wrangler. Aujourd'hui, vous pouvez utiliser JSON comme format d'entrée et de sortie, offrant plus de flexibilité lors de l'interaction avec les conteneurs d'inférence SageMaker Data Wrangler.

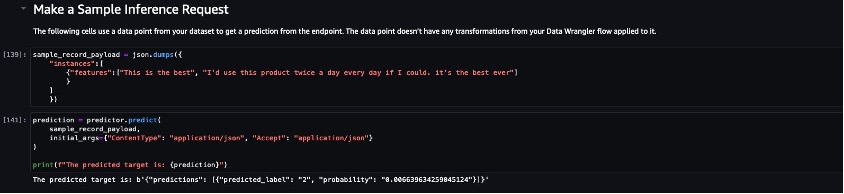

Pour commencer à utiliser JSON pour l'entrée et la sortie dans le notebook du pipeline d'inférence, procédez comme suit :

- Définissez une charge utile.

Pour chaque charge utile, le modèle attend une clé nommée instances. La valeur est une liste d'objets, chacun étant son propre point de données. Les objets nécessitent une clé appelée caractéristiques et les valeurs doivent être les caractéristiques d'un point de données unique destinées à être soumises au modèle. Plusieurs points de données peuvent être soumis dans une seule demande, jusqu'à une taille totale de 6 Mo par demande.

Voir le code suivant:

- Spécifie le

ContentTypeasapplication/json. - Fournissez des données au modèle et recevez une inférence au format JSON.

See Formats de données communs pour l'inférence pour des exemples d'entrée et de sortie JSON.

Nettoyer

Lorsque vous avez fini d'utiliser SageMaker Data Wrangler, nous vous recommandons d'arrêter l'instance sur laquelle il s'exécute pour éviter des frais supplémentaires. Pour obtenir des instructions sur la façon d'arrêter l'application SageMaker Data Wrangler et l'instance associée, voir Arrêter Data Wrangler.

Conclusion

Les nouvelles fonctionnalités de SageMaker Data Wrangler, notamment la prise en charge des fichiers manifestes S3, les capacités d'inférence et l'intégration du format JSON, transforment l'expérience opérationnelle de la préparation des données. Ces améliorations rationalisent l'importation de données, automatisent les transformations de données et simplifient le travail avec les données JSON. Grâce à ces fonctionnalités, vous pouvez améliorer votre efficacité opérationnelle, réduire les efforts manuels et extraire facilement des informations précieuses de vos données. Exploitez la puissance des nouvelles fonctionnalités de SageMaker Data Wrangler et libérez tout le potentiel de vos workflows de préparation de données.

Pour démarrer avec SageMaker Data Wrangler, consultez les dernières informations sur le Page produit SageMaker Data Wrangler.

À propos des auteurs

Munish Dabra est architecte principal de solutions chez Amazon Web Services (AWS). Ses domaines d'intérêt actuels sont l'IA/ML et l'observabilité. Il possède une solide expérience dans la conception et la construction de systèmes distribués évolutifs. Il aime aider les clients à innover et à transformer leur entreprise dans AWS. LinkedIn : /mdabra

Munish Dabra est architecte principal de solutions chez Amazon Web Services (AWS). Ses domaines d'intérêt actuels sont l'IA/ML et l'observabilité. Il possède une solide expérience dans la conception et la construction de systèmes distribués évolutifs. Il aime aider les clients à innover et à transformer leur entreprise dans AWS. LinkedIn : /mdabra

Patrick Lin est ingénieur en développement logiciel chez Amazon SageMaker Data Wrangler. Il s'est engagé à faire d'Amazon SageMaker Data Wrangler l'outil de préparation de données numéro un pour les flux de travail ML en production. En dehors du travail, vous pouvez le trouver en train de lire, d'écouter de la musique, d'avoir des conversations avec des amis et de servir dans son église.

Patrick Lin est ingénieur en développement logiciel chez Amazon SageMaker Data Wrangler. Il s'est engagé à faire d'Amazon SageMaker Data Wrangler l'outil de préparation de données numéro un pour les flux de travail ML en production. En dehors du travail, vous pouvez le trouver en train de lire, d'écouter de la musique, d'avoir des conversations avec des amis et de servir dans son église.

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- PlatoData.Network Ai générative verticale. Autonomisez-vous. Accéder ici.

- PlatoAiStream. Intelligence Web3. Connaissance Amplifiée. Accéder ici.

- PlatonESG. Automobile / VE, Carbone, Technologie propre, Énergie, Environnement, Solaire, La gestion des déchets. Accéder ici.

- Décalages de bloc. Modernisation de la propriété des compensations environnementales. Accéder ici.

- La source: https://aws.amazon.com/blogs/machine-learning/optimize-data-preparation-with-new-features-in-aws-sagemaker-data-wrangler/

- :possède

- :est

- :ne pas

- :où

- $UP

- 100

- 1996

- 2014

- 7

- 8

- 9

- a

- actes

- ajoutée

- Supplémentaire

- En outre

- adopté

- Après

- AI / ML

- Tous

- Permettre

- permet

- aussi

- Amazon

- Amazon Sage Maker

- Pilote automatique Amazon SageMaker

- Gestionnaire de données Amazon SageMaker

- Amazon Web Services

- Amazon Web Services (AWS)

- quantités

- an

- et les

- tous

- Apis

- appli

- applications

- appliqué

- Appliquer

- une approche

- SONT

- domaines

- arguments

- AS

- associé

- At

- automatiser

- automatiquement

- éviter

- AWS

- fond

- basé

- BE

- devenez

- va

- LES MEILLEURS

- Big

- tous les deux

- Bas et Leggings

- Pause

- construire

- Développement

- intégré

- la performance des entreprises

- mais

- by

- appelé

- CAN

- capacités

- maisons

- Change

- des charges

- vérifier

- Selectionnez

- choose

- église

- Nettoyage

- code

- Colonne

- engagé

- Commun

- compatible

- complet

- finalise

- configuration

- Console

- consommées

- Conteneurs

- contient

- conversations

- Correspondant

- pourriez

- engendrent

- créée

- crée des

- La création

- critique

- Courant

- des clients

- Clients

- données

- D'échange de données

- points de données

- Préparation des données

- informatique

- data-driven

- ensembles de données

- journée

- décider

- par défaut

- défini

- définition

- delve

- démontré

- déployer

- déployer

- déploiement

- un

- conception

- destination

- détails

- Déterminer

- Développement

- différent

- discuter

- distribué

- systèmes distribués

- do

- down

- pendant

- chacun

- Plus tôt

- facilité

- plus facilement

- Easy

- Écosystèmes

- efficace

- efficace

- efficacement

- effort

- non plus

- embrasser

- permet

- permettant

- end-to-end

- Endpoint

- ingénieur

- ENGINEERING

- de renforcer

- améliorations

- Améliore

- Entrer

- Tout

- Environment

- Équivalent

- notamment

- JAMAIS

- Chaque

- tous les jours

- peut

- exemple

- exemples

- échange

- attend

- d'experience

- expérience

- expériences

- exploration

- explorez

- Exporter

- exportations

- extension

- extrait

- Fonctionnalité

- Fonctionnalités:

- few

- Déposez votre dernière attestation

- Fichiers

- Trouvez

- Flexibilité

- flux

- Flux

- Focus

- suivre

- Abonnement

- Pour

- formulaire

- le format

- amis

- De

- plein

- plus

- générer

- généré

- obtenez

- considérablement

- ait eu

- manipuler

- Vous avez

- ayant

- he

- aider

- Haute

- Soulignant

- lui

- sa

- Comment

- How To

- HTML

- HTTPS

- i

- identique

- identifiant

- if

- image

- immédiatement

- importer

- l'importation

- améliorer

- in

- inclut

- Y compris

- d'information

- innovons

- contribution

- idées.

- instance

- Des instructions

- l'intégration

- prévu

- interagir

- interagissant

- Interactif

- Interfaces

- développement

- intuitif

- IT

- SES

- JavaScript

- Emploi

- jpg

- json

- Juillet

- juste

- ACTIVITES

- Langues

- gros

- Nom

- plus tard

- Nouveautés

- lancer

- apprentissage

- laisser

- Niveau

- comme

- limité

- LINK

- Liste

- Écoute

- Liste

- emplacement

- Style

- click

- machine learning

- a prendre une

- Fabrication

- gérer

- Manuel

- Mai..

- Menu

- Métadonnées

- méthode

- pourrait

- million

- Minutes

- manquant

- ML

- MLOps

- modèle

- numériques jumeaux (digital twin models)

- Villas Modernes

- modifié

- PLUS

- plus efficace

- plusieurs

- Musique

- must

- prénom

- Nommé

- à savoir

- indigène

- nécessaire

- Besoin

- Besoins

- Nouveauté

- Nouvelles fonctionnalités

- nouvellement

- next

- aucune

- nœud

- cahier

- maintenant

- nombre

- objet

- objets

- of

- on

- ONE

- uniquement

- opérationnel

- optimaux

- Optimiser

- Option

- Options

- or

- Autre

- nos

- ande

- sortie

- au contrôle

- propre

- paramètre

- paramètres

- passé

- chemin

- /

- Effectuer

- en particulier pendant la préparation

- pipeline

- Platon

- Intelligence des données Platon

- PlatonDonnées

- plus

- Point

- des notes bonus

- Post

- défaillances

- power

- prévoir

- prédit

- préparation

- Préparer

- préparé

- assez

- précédemment

- Directeur

- processus

- Traité

- traitement

- Produit

- Comparatifs

- Vidéo

- programmatiques

- Programmation

- langages de programmation

- Projet

- fournir

- aportando

- Python

- en cours

- en temps réel

- recevoir

- recommander

- réduire

- réduit

- libérer

- pertinent

- supprimez

- représentent

- représentation

- nécessaire

- exigent

- ressource

- résultant

- Résultats

- Avis

- Avis

- bon

- Rôle

- fonctionne

- s

- sagemaker

- Inférence SageMaker

- Pipelines SageMaker

- même

- scie

- évolutive

- fluide

- de façon transparente

- Section

- sur le lien

- la sélection

- sélection

- Services

- service

- Session

- set

- Paramétres

- plusieurs

- devrait

- montrer

- arrêter

- signer

- étapes

- simplifié

- simplifier

- simplifiant

- unique

- Taille

- petit

- faibles

- So

- Logiciels

- développement de logiciels

- sur mesure

- Solutions

- spécifiquement

- scission

- Commencer

- j'ai commencé

- étapes

- Étapes

- storage

- stockée

- rationaliser

- la rationalisation

- STRONG

- structuré

- soumettre

- soumis

- tel

- Support

- Les soutiens

- sûr

- Système

- Prenez

- prend

- Target

- qui

- Le

- les informations

- leur

- puis

- Là.

- Ces

- this

- ceux

- Avec

- fiable

- titré

- à

- aujourd'hui

- trop

- outil

- les outils

- Total

- Train

- qualifié

- Formation

- Transformer

- De La Carrosserie

- transformations

- transformé

- se transforme

- Twice

- ui

- sous

- ouvrir

- téléchargé

- utilisé

- cas d'utilisation

- d'utiliser

- en utilisant

- Précieux

- Plus-value

- Valeurs

- très

- via

- Voir

- visualisation

- souhaitez

- voulu

- we

- web

- services Web

- sites Internet

- Semaines

- WELL

- quand

- qui

- largement

- sera

- comprenant

- activités principales

- workflow

- workflows

- de travail

- Vous n'avez

- Votre

- zéphyrnet