Aujourd'hui, nous sommes ravis d'annoncer que le modèle de base Falcon 180B développé par le Technology Innovation Institute (TII) et formé sur Amazon SageMaker est disponible pour les clients via Amazon SageMaker JumpStart à déployer en un seul clic pour exécuter l'inférence. Avec une taille de 180 milliards de paramètres et formé sur un ensemble de données massif de 3.5 billions de jetons, le Falcon 180B est le modèle le plus grand et l'un des plus performants avec des poids librement accessibles. Vous pouvez essayer ce modèle avec SageMaker JumpStart, un hub d'apprentissage automatique (ML) qui donne accès à des algorithmes, des modèles et des solutions ML afin que vous puissiez rapidement démarrer avec le ML. Dans cet article, nous expliquons comment découvrir et déployer le modèle Falcon 180B via SageMaker JumpStart.

Qu'est-ce que le Falcon 180B

Falcon 180B est un modèle publié par TII qui fait suite aux versions précédentes de la famille Falcon. Il s'agit d'une version à grande échelle du Falcon 40B, qui utilise l'attention multi-requêtes pour une meilleure évolutivité. Il s'agit d'un modèle de langage auto-régressif qui utilise une architecture de transformateur optimisée. Il a été formé sur 3.5 XNUMX milliards de jetons de données, principalement constitués de données Web provenant de Web raffiné (environ 85 %). Le modèle existe en deux versions : 180B et 180B-Chat. 180B est un modèle brut pré-entraîné, qui doit être affiné davantage pour la plupart des cas d'utilisation. 180B-Chat est mieux adapté pour prendre des instructions génériques. Le modèle Chat a été affiné sur les ensembles de données de chat et d'instructions ainsi que sur plusieurs ensembles de données conversationnelles à grande échelle.

Le modèle est mis à disposition sous le Licence Falcon-180B TII ainsi que Politique d'utilisation acceptable.

Le Falcon 180B a été formé par TII le Amazon Sage Maker, sur un cluster d'environ 4K GPU A100. Il utilisait une base de code de formation distribuée personnalisée nommée Gigatron, qui utilise le parallélisme 3D avec ZeRO et des noyaux Triton personnalisés et hautes performances. L'architecture de formation distribuée utilisée Service de stockage simple Amazon (Amazon S3) en tant que seul service unifié pour le chargement des données et l'écriture et la lecture des points de contrôle, ce qui a particulièrement contribué à la fiabilité de la charge de travail et à la simplicité opérationnelle.

Qu'est-ce que SageMaker JumpStart

Avec SageMaker JumpStart, les praticiens du ML peuvent choisir parmi une liste croissante de modèles de fondation les plus performants. Les praticiens du ML peuvent déployer des modèles de base sur des instances SageMaker dédiées dans un environnement réseau isolé et personnaliser les modèles à l'aide d'Amazon SageMaker pour la formation et le déploiement des modèles.

Vous pouvez désormais découvrir et déployer le Falcon 180B en quelques clics Amazon SageMakerStudio ou par programmation via le SDK SageMaker Python, vous permettant de dériver les performances du modèle et les contrôles MLOps avec des fonctionnalités SageMaker telles que Pipelines Amazon SageMaker, Débogueur Amazon SageMakerou les journaux de conteneur. Le modèle est déployé dans un environnement sécurisé AWS et sous les contrôles de votre VPC, contribuant ainsi à garantir la sécurité des données. Falcon 180B est détectable et peut être déployé dans les régions où les instances requises sont disponibles. À l'heure actuelle, les instances ml.p4de sont disponibles dans la région USA Est (Virginie du Nord) et USA Ouest (Oregon).

Découvrez les modèles

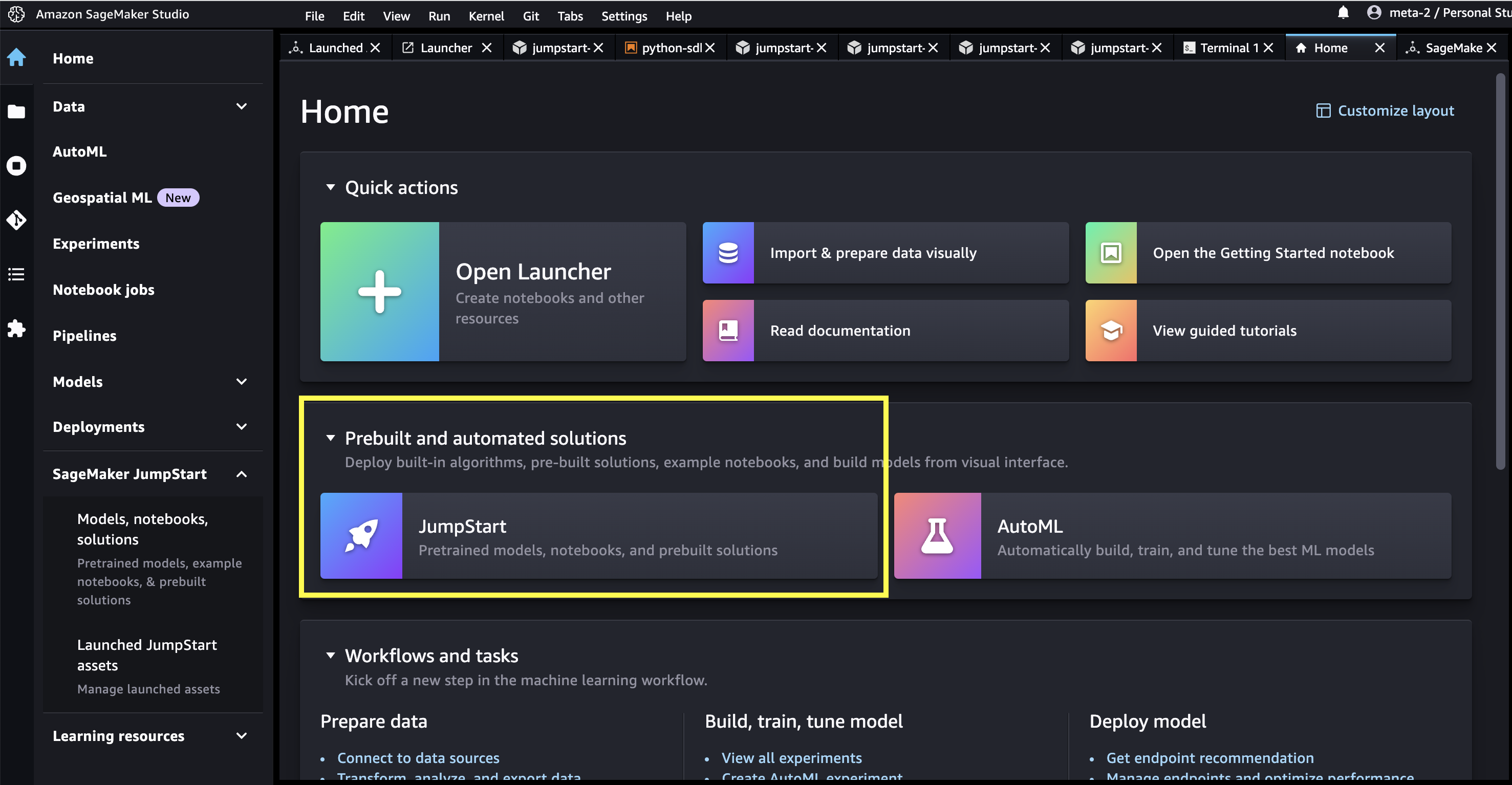

Vous pouvez accéder aux modèles de base via SageMaker JumpStart dans l'interface utilisateur SageMaker Studio et le SDK Python SageMaker. Dans cette section, nous allons voir comment découvrir les modèles dans SageMaker Studio.

SageMaker Studio est un environnement de développement intégré (IDE) qui fournit une interface visuelle Web unique où vous pouvez accéder à des outils spécialement conçus pour effectuer toutes les étapes de développement ML, de la préparation des données à la création, la formation et le déploiement de vos modèles ML. Pour plus de détails sur la façon de démarrer et de configurer SageMaker Studio, reportez-vous à Amazon SageMakerStudio.

Dans SageMaker Studio, vous pouvez accéder à SageMaker JumpStart, qui contient des modèles, des blocs-notes et des solutions prédéfinis, sous Solutions prédéfinies et automatisées.

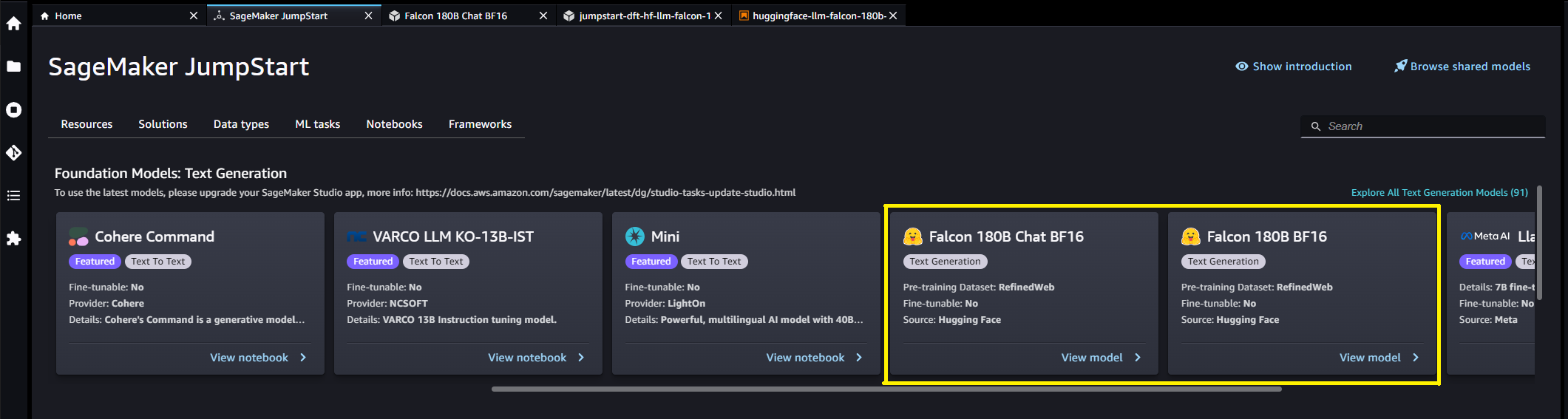

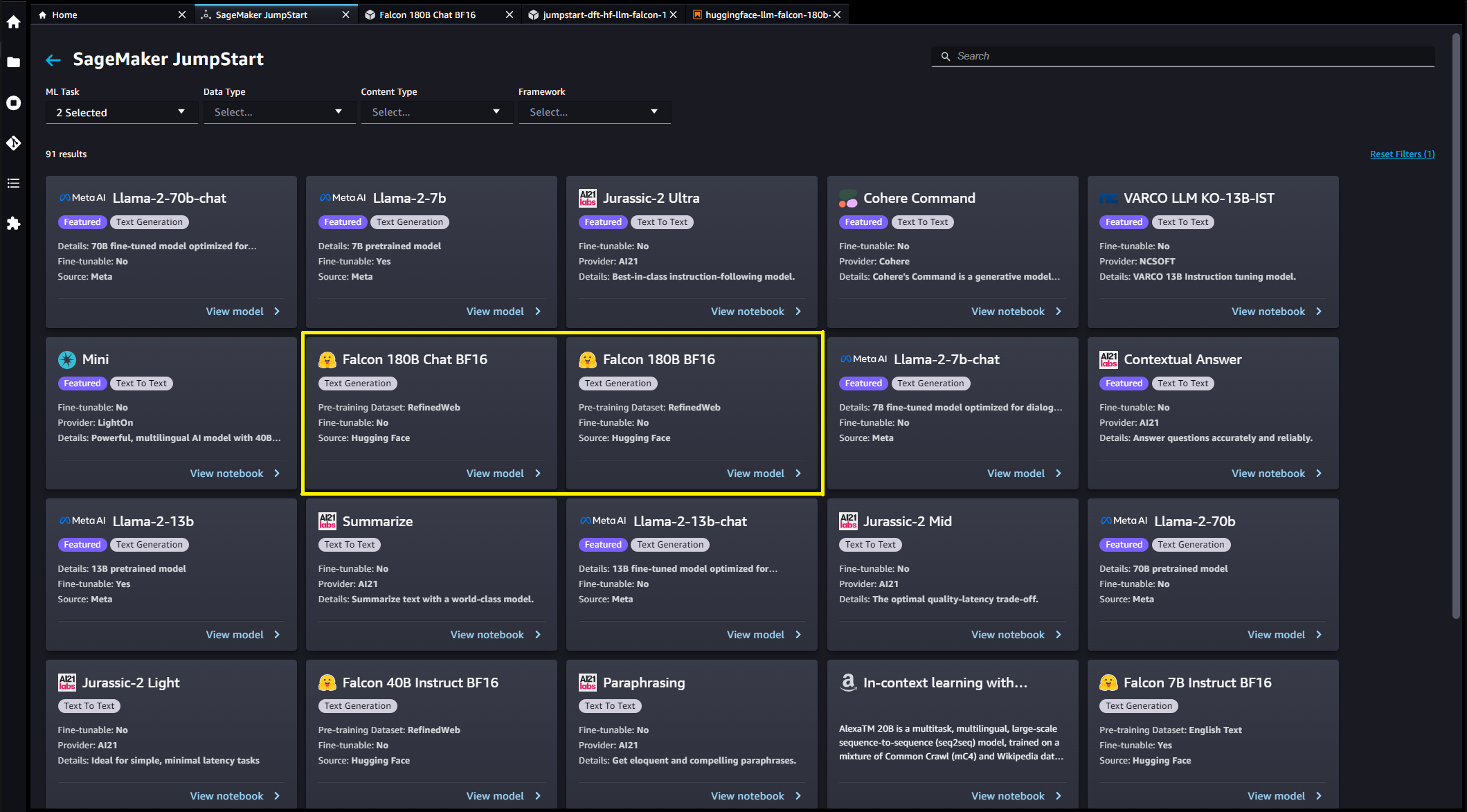

À partir de la page d'accueil de SageMaker JumpStart, vous pouvez rechercher des solutions, des modèles, des blocs-notes et d'autres ressources. Vous pouvez trouver le Falcon 180B dans le Modèles de base : génération de texte carrousel.

Vous pouvez également trouver d'autres variantes de modèles en choisissant Explorer tous les modèles de génération de texte ou à la recherche de Falcon.

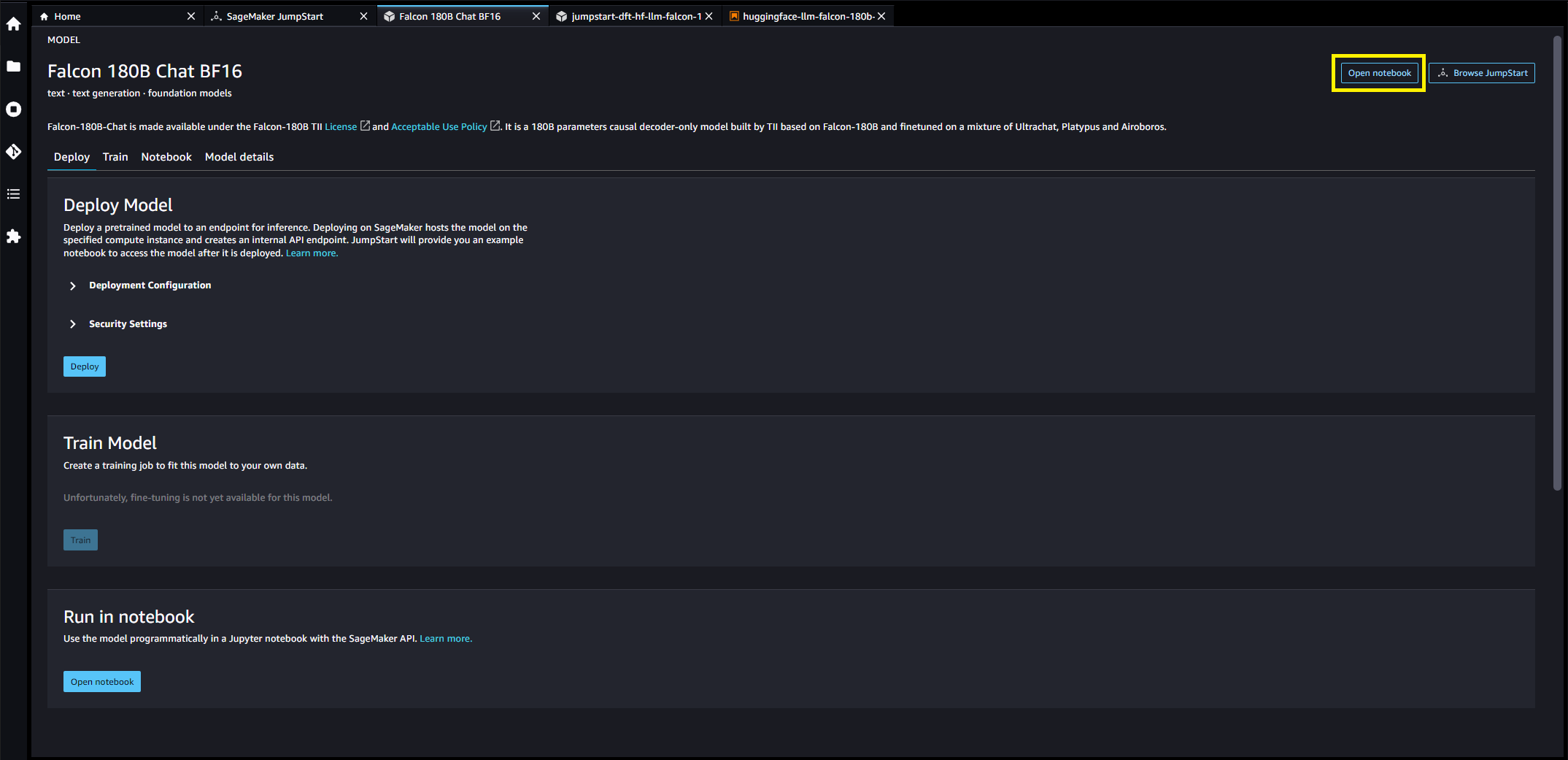

Vous pouvez choisir la fiche de modèle pour afficher les détails du modèle, tels que la licence, les données utilisées pour l'entraînement et la manière de l'utiliser. Vous trouverez également deux boutons, Déployer ainsi que Cahier ouvert, qui vous aidera à utiliser le modèle (la capture d'écran suivante montre le Déployer option).

Déployer des modèles

Quand vous choisissez Déployer, le déploiement du modèle va démarrer. Vous pouvez également déployer via l'exemple de bloc-notes qui s'affiche en choisissant Cahier ouvert. L'exemple de bloc-notes fournit des conseils de bout en bout sur la manière de déployer le modèle pour l'inférence et de nettoyer les ressources.

Pour déployer à l'aide d'un notebook, nous commençons par sélectionner un modèle approprié, spécifié par le model_id. Vous pouvez déployer n'importe lequel des modèles sélectionnés sur SageMaker avec le code suivant :

Cela déploie le modèle sur SageMaker avec les configurations par défaut, y compris le type d'instance par défaut et les configurations VPC par défaut. Vous pouvez modifier ces configurations en spécifiant des valeurs autres que celles par défaut dans JumpStartModel. Pour en savoir plus, reportez-vous au Documentation de l'API. Une fois déployé, vous pouvez exécuter une inférence sur le point de terminaison déployé via un prédicteur SageMaker. Voir le code suivant :

Les paramètres d'inférence contrôlent le processus de génération de texte au point final. Le contrôle maximum des nouveaux jetons fait référence à la taille de la sortie générée par le modèle. Notez que ce n'est pas la même chose que le nombre de mots car le vocabulaire du modèle n'est pas le même que le vocabulaire de la langue anglaise et chaque jeton ne peut pas être un mot de la langue anglaise. La température contrôle le caractère aléatoire de la sortie. Une température plus élevée entraîne des sorties plus créatives et hallucinées. Tous les paramètres d'inférence sont facultatifs.

Ce modèle de paramètres 180B fait 335 Go et nécessite encore plus de mémoire GPU pour effectuer suffisamment d'inférence avec une précision de 16 bits. Actuellement, JumpStart ne prend en charge ce modèle que sur les instances ml.p4de.24xlarge. Il est possible de déployer un modèle quantifié 8 bits sur une instance ml.p4d.24xlarge en fournissant le env={"HF_MODEL_QUANTIZE": "bitsandbytes"} argument de mot-clé au JumpStartModel constructeur et spécification instance_type="ml.p4d.24xlarge" à la méthode de déploiement. Cependant, veuillez noter que la latence par jeton est environ 5 fois plus lente pour cette configuration quantifiée.

Le tableau suivant répertorie tous les modèles Falcon disponibles dans SageMaker JumpStart ainsi que les ID de modèle, les types d'instances par défaut, le nombre maximum de jetons totaux (somme du nombre de jetons d'entrée et du nombre de jetons générés) pris en charge et la latence de réponse typique par jeton. pour chacun de ces modèles.

| Nom du modèle | ID du modèle | Type d'instance par défaut | Total maximum de jetons | Latence par jeton* |

| Falcon 7B | huggingface-llm-falcon-7b-bf16 |

ml.g5.2xlarge | 2048 | 34 ms |

| Instruire le Falcon 7B | huggingface-llm-falcon-7b-instruct-bf16 |

ml.g5.2xlarge | 2048 | 34 ms |

| Falcon 40B | huggingface-llm-falcon-40b-bf16 |

ml.g5.12xlarge | 2048 | 57 ms |

| Instruire le Falcon 40B | huggingface-llm-falcon-40b-instruct-bf16 |

ml.g5.12xlarge | 2048 | 57 ms |

| Falcon 180B | huggingface-llm-falcon-180b-bf16 |

ml.p4de.24xlarge | 2048 | 45 ms |

| Bavarder | huggingface-llm-falcon-180b-chat-bf16 |

ml.p4de.24xlarge | 2048 | 45 ms |

*la latence par jeton est fournie pour le temps de réponse médian des exemples d'invites fournis dans ce blog ; cette valeur varie en fonction de la longueur des séquences d'entrée et de sortie.

Inférence et exemples d'invites pour le Falcon 180B

Les modèles Falcon peuvent être utilisés pour compléter le texte de n’importe quel morceau de texte. Grâce à la génération de texte, vous pouvez effectuer diverses tâches, telles que répondre à des questions, traduire une langue, analyser des sentiments et bien d'autres encore. Le point de terminaison accepte le schéma de charge utile d'entrée suivant :

Vous pouvez explorer la définition de ceux-ci paramètres client et leurs valeurs par défaut dans le référentiel d'inférence de génération de texte.

Voici quelques exemples d’invites et le texte généré par le modèle. Toutes les sorties ici sont générées avec des paramètres d'inférence {"max_new_tokens": 768, "stop": ["<|endoftext|>", "###"]}.

Créer un site Web peut se faire en 10 étapes simples :

Vous remarquerez peut-être que ce modèle pré-entraîné génère de longues séquences de texte qui ne sont pas nécessairement idéales pour les cas d'utilisation de dialogues. Avant de montrer comment le modèle de discussion affiné fonctionne pour un ensemble plus large d'invites basées sur des dialogues, les deux exemples suivants illustrent comment utiliser les modèles Falcon avec un apprentissage contextuel en quelques étapes, où nous fournissons des exemples de formation disponibles pour le modèle. Notez que « l'apprentissage en quelques étapes » n'ajuste pas les poids du modèle : nous effectuons uniquement des inférences sur le modèle déployé au cours de ce processus tout en fournissant quelques exemples dans le contexte d'entrée pour faciliter la sortie du modèle de guilde.

Inférence et exemples d'invites pour Falcon 180B-Chat

Avec les modèles Falcon 180B-Chat, optimisés pour les cas d'utilisation de dialogue, l'entrée dans les points de terminaison du modèle de chat peut contenir l'historique précédent entre l'assistant de chat et l'utilisateur. Vous pouvez poser des questions contextuelles à la conversation qui a eu lieu jusqu'à présent. Vous pouvez également fournir la configuration du système, telle que les personnages, qui définissent le comportement de l'assistant de chat. La charge utile d'entrée vers le point final est la même que celle du modèle Falcon 180B, à l'exception du inputs La valeur de chaîne doit utiliser le format suivant :

Voici quelques exemples d'invites et le texte généré par le modèle. Toutes les sorties sont générées avec des paramètres d'inférence {"max_new_tokens":256, "stop": ["nUser:", "<|endoftext|>", " User:", "###"]}.

Dans l'exemple suivant, l'utilisateur a eu une conversation avec l'assistant sur les sites touristiques de Paris. Ensuite, l'utilisateur se renseigne sur la première option recommandée par l'assistant de chat.

Nettoyer

Une fois que vous avez terminé d'exécuter le bloc-notes, assurez-vous de supprimer toutes les ressources que vous avez créées au cours du processus afin que votre facturation soit arrêtée. Utilisez le code suivant :

Conclusion

Dans cet article, nous vous avons montré comment démarrer avec Falcon 180B dans SageMaker Studio et déployer le modèle pour l'inférence. Étant donné que les modèles de base sont pré-entraînés, ils peuvent contribuer à réduire les coûts de formation et d’infrastructure et permettre une personnalisation adaptée à votre cas d’utilisation. Visitez SageMaker JumpStart dans SageMaker Studio dès maintenant pour commencer.

Resources

À propos des auteurs

Dr Kyle Ulrich est un scientifique appliqué au sein de l'équipe Amazon SageMaker JumpStart. Ses intérêts de recherche comprennent les algorithmes d'apprentissage automatique évolutifs, la vision par ordinateur, les séries chronologiques, les processus bayésiens non paramétriques et gaussiens. Son doctorat est de l'Université Duke et il a publié des articles dans NeurIPS, Cell et Neuron.

Dr Kyle Ulrich est un scientifique appliqué au sein de l'équipe Amazon SageMaker JumpStart. Ses intérêts de recherche comprennent les algorithmes d'apprentissage automatique évolutifs, la vision par ordinateur, les séries chronologiques, les processus bayésiens non paramétriques et gaussiens. Son doctorat est de l'Université Duke et il a publié des articles dans NeurIPS, Cell et Neuron.

Dr Ashish Khetan est un scientifique appliqué senior chez Amazon SageMaker JumpStart et aide à développer des algorithmes d'apprentissage automatique. Il a obtenu son doctorat à l'Université de l'Illinois à Urbana-Champaign. Il est un chercheur actif en apprentissage automatique et en inférence statistique, et a publié de nombreux articles dans les conférences NeurIPS, ICML, ICLR, JMLR, ACL et EMNLP.

Dr Ashish Khetan est un scientifique appliqué senior chez Amazon SageMaker JumpStart et aide à développer des algorithmes d'apprentissage automatique. Il a obtenu son doctorat à l'Université de l'Illinois à Urbana-Champaign. Il est un chercheur actif en apprentissage automatique et en inférence statistique, et a publié de nombreux articles dans les conférences NeurIPS, ICML, ICLR, JMLR, ACL et EMNLP.

Olivier Cruchant est architecte principal de solutions spécialisé en apprentissage automatique chez AWS, basé en France. Olivier aide les clients AWS – des petites startups aux grandes entreprises – à développer et déployer des applications d'apprentissage automatique de niveau production. Dans ses temps libres, il aime lire des documents de recherche et explorer la nature avec ses amis et sa famille.

Olivier Cruchant est architecte principal de solutions spécialisé en apprentissage automatique chez AWS, basé en France. Olivier aide les clients AWS – des petites startups aux grandes entreprises – à développer et déployer des applications d'apprentissage automatique de niveau production. Dans ses temps libres, il aime lire des documents de recherche et explorer la nature avec ses amis et sa famille.

Karl Albertsen dirige les équipes du centre de modèles de base, des algorithmes et des partenariats d'Amazon SageMaker.

Karl Albertsen dirige les équipes du centre de modèles de base, des algorithmes et des partenariats d'Amazon SageMaker.

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- PlatoData.Network Ai générative verticale. Autonomisez-vous. Accéder ici.

- PlatoAiStream. Intelligence Web3. Connaissance Amplifiée. Accéder ici.

- PlatonESG. Automobile / VE, Carbone, Technologie propre, Énergie, Environnement, Solaire, La gestion des déchets. Accéder ici.

- PlatoHealth. Veille biotechnologique et essais cliniques. Accéder ici.

- GraphiquePrime. Élevez votre jeu de trading avec ChartPrime. Accéder ici.

- Décalages de bloc. Modernisation de la propriété des compensations environnementales. Accéder ici.

- La source: https://aws.amazon.com/blogs/machine-learning/falcon-180b-foundation-model-from-tii-is-now-available-via-amazon-sagemaker-jumpstart/

- :possède

- :est

- :ne pas

- :où

- $UP

- 1

- 10

- 100

- 11

- 12

- 13

- 14

- 150

- 20

- 25

- 26%

- 3d

- 4k

- 7

- 8

- 9

- a

- A Propos

- Accepte

- accès

- accessible

- atteindre

- infection

- ajouter

- En outre

- propos

- Après

- à opposer à

- algorithmes

- Tous

- permet

- le long de

- aussi

- toujours

- am

- Amazon

- Amazon Sage Maker

- Amazon SageMaker JumpStart

- Amazon Web Services

- an

- selon une analyse de l’Université de Princeton

- ainsi que

- et infrastructure

- Annoncer

- Une autre

- répondre

- tous

- chacun.e

- attirant

- applications

- appliqué

- approprié

- d'environ

- architecture

- SONT

- argument

- Art

- article

- AS

- demander

- Assistante gérante

- At

- précaution

- attirer

- attraction

- Automatisation

- disponibles

- pistes

- AWS

- basé

- batterie

- Bayésien

- BE

- pour créer les plus

- car

- était

- before

- humain

- Améliorée

- jusqu'à XNUMX fois

- facturation

- Blog

- bénéficie d'

- navigateur

- constructeur

- constructeurs

- Développement

- la performance des entreprises

- mais

- by

- cafés

- CAN

- aptitude

- carte

- carrousel

- maisons

- cas

- Change

- vérifier

- Selectionnez

- choose

- choisi

- Ville

- Classer

- Grappe

- Cms

- code

- Base de code

- collection

- Colonnes

- COM

- combiné

- Commun

- Société

- complet

- achèvement

- ordinateur

- Vision par ordinateur

- conférences

- configuration

- Qui consiste

- contact

- contiennent

- Contenant

- contient

- contenu

- contexte

- contextuel

- continuellement

- contribué

- des bactéries

- contrôles

- Conversation

- de la conversation

- Costs

- engendrent

- créée

- La création

- Conception

- Coupe

- Courant

- Lecture

- Customiser

- des clients

- Support à la clientèle

- Clients

- personnalisation

- personnaliser

- données

- la sécurité des données

- ensembles de données

- journée

- décision

- dévoué

- Réglage par défaut

- Vous permet de définir

- définition

- démontrer

- Selon

- déployer

- déployé

- déployer

- déploiement

- déploie

- Conception

- destination

- détails

- Déterminer

- développer

- développé

- Développement

- dialogue

- Dialogue

- différent

- découvrez

- distribué

- formation distribuée

- do

- domaine

- Services

- NOMS DE DOMAINE

- fait

- rêves

- Duc

- université de Duke

- pendant

- chacun

- facilité

- même

- Est

- Easy

- permettre

- permettant

- end-to-end

- Endpoint

- énergie

- ENGINEERING

- Anglais

- assurer

- entreprises

- Environment

- notamment

- Pourtant, la

- exemple

- exemples

- Sauf

- excité

- nous a permis de concevoir

- explorez

- Explorer

- exprimé

- extension

- extensions

- les

- famille

- célèbre

- loin

- fascinant

- Fonctionnalités:

- few

- Trouvez

- Prénom

- flotteur

- Abonnement

- suit

- Pour

- le format

- Ancien

- Fondation

- quatre

- CADRE

- France

- Français

- amis

- De

- fonctionnement

- plus

- Jardins

- Gemme

- générer

- généré

- génère

- génération

- obtenez

- en verre.

- Go

- objectif

- Objectifs

- aller

- Bien

- eu

- GPU

- GPU

- l'

- Croissance

- l'orientation

- guilde

- ait eu

- arrivé

- haine

- Vous avez

- ayant

- he

- Cœur

- vous aider

- utile

- aider

- aide

- ici

- caché

- gemme cachée

- haute performance

- augmentation

- sa

- Histoire

- Accueil

- hôte

- hébergement

- Comment

- How To

- Cependant

- HTML

- HTTPS

- Moyeu

- i

- iconique

- ID

- idéal

- ids

- if

- Illinois

- image

- satellite

- importer

- impressionnant

- in

- comprendre

- Y compris

- l'incroyable

- d'information

- Infrastructure

- Innovation

- contribution

- entrées

- instance

- Institut

- Des instructions

- des services

- intéressé

- intérêts

- Interfaces

- développement

- isolé

- IT

- SES

- jpg

- connu

- kyle

- atterrissage

- langue

- gros

- Grandes entreprises

- grande échelle

- plus importantes

- le plus grand

- Latence

- Nouveautés

- lancer

- Lois

- Disposition

- Conduit

- APPRENTISSAGE

- apprentissage

- Longueur

- Licence

- lumière

- doublé

- LINK

- Gauche

- Liste

- Liste

- chargement

- Location

- baisser

- Luxembourg

- click

- machine learning

- LES PLANTES

- a prendre une

- Fabrication

- gestion

- gère

- de nombreuses

- merveille

- Masse

- massif

- max

- maximales

- Mai..

- sens

- veux dire

- Médias

- médiéval

- Mémoire

- message

- méthode

- pourrait

- Mixage audio

- mélange

- ML

- MLOps

- modèle

- numériques jumeaux (digital twin models)

- PLUS

- (en fait, presque toutes)

- mouvement

- Musée

- Musique

- my

- prénom

- Nommé

- noms

- NAVIGUER

- Navigation

- nécessairement

- Besoin

- négatif

- net

- réseau et

- Neutri

- Nouveauté

- next

- nuit

- aucune

- cahier

- Remarquer..

- maintenant

- nombre

- observateurs

- of

- Offres Speciales

- Huile

- Olivier

- on

- une fois

- ONE

- uniquement

- ouvertement

- opérationnel

- optimisé

- Option

- Options

- or

- Oregon

- Autre

- ande

- décrit

- sortie

- plus de

- page

- pages

- Palais

- papiers

- paramètre

- paramètres

- Paris

- Parc

- particulièrement

- partenariats

- Paiement

- mode de paiement

- Personnes

- /

- parfaite

- Effectuer

- performant

- effectue

- phd

- Téléphone

- Physique

- pièce

- plan

- Platon

- Intelligence des données Platon

- PlatonDonnées

- veuillez cliquer

- positif

- possible

- Post

- Poteaux

- La précision

- Predictor

- en train de préparer

- représentent

- précédent

- qui se déroulent

- Directeur

- d'ouvrabilité

- processus

- les process

- Produit

- promouvoir

- correctement

- fournir

- à condition de

- de voiture.

- fournit

- aportando

- publié

- but

- mettre

- Python

- fréquemment posées

- vite.

- aléatoire

- raw

- en cours

- recette

- recommandé

- reportez-vous

- se réfère

- Indépendamment

- régions

- vous inscrire

- enregistrement

- greffier

- Inscription

- relatif

- relativité

- libéré

- de Presse

- pertinent

- fiabilité

- fiable

- rappeler

- dépôt

- représente

- a besoin

- requis

- un article

- chercheur

- Resources

- réponse

- Résultats

- Rich

- Rouler

- royalties

- Courir

- pour le running

- s

- sagemaker

- sel

- même

- Évolutivité

- évolutive

- Escaliers intérieurs

- Scientifique

- Sdk

- MER

- Rechercher

- recherche

- Saison

- Deuxièmement

- Section

- sécurisé

- sécurité

- sur le lien

- seed

- choisi

- la sélection

- supérieur

- sentiment

- Série

- service

- Services

- set

- Paramétres

- plusieurs

- Partager

- magasins

- Shorts

- devrait

- montrer

- montré

- Spectacles

- signer

- étapes

- simplicité

- simplement

- unique

- Sites

- Taille

- Lentement

- petit

- So

- jusqu'à présent

- Réseaux sociaux

- réseaux sociaux

- Publications sur les réseaux sociaux

- Solutions

- quelques

- quelque chose

- Identifier

- Space

- spécialiste

- spécifié

- vitesse

- Commencer

- j'ai commencé

- Startups

- États

- station

- statistique

- Étapes

- Arrêter

- arrêté

- storage

- Boutique

- rue

- Chaîne

- studio

- Étourdissant

- tel

- Support

- Appareils

- Les soutiens

- sûr

- symbole

- combustion propre

- table

- Prenez

- prise

- tâches

- clés

- équipe

- équipes

- Technologie

- Innovation technologique

- modèle

- tester

- texte

- qui

- La

- le monde

- leur

- Les

- thème

- puis

- théorie

- Là.

- Ces

- l'ont

- Troisièmement

- this

- Avec

- fiable

- Des séries chronologiques

- à

- ensemble

- jeton

- Tokens

- outil

- les outils

- Total

- La tour

- Train

- qualifié

- Formation

- transformateur

- traduire

- Traduction

- Billion

- voyage

- Triton

- Essai

- Tweet

- deux

- type

- types

- débutante

- ui

- sous

- unifiée

- expérience unique et authentique

- université

- jusqu'à

- Téléchargement

- us

- utilisé

- cas d'utilisation

- d'utiliser

- Utilisateur

- utilisateurs

- Usages

- en utilisant

- Vide

- Plus-value

- Valeurs

- variété

- divers

- version

- versions

- via

- La Vibe

- Vidéo

- Vidéos

- Voir

- vues

- Virginie

- vision

- Visiter

- visiteurs

- visuellement

- marcher

- souhaitez

- était

- filigrane

- we

- web

- services Web

- Basé sur le Web

- Site Web

- semaine

- Semaines

- WELL

- Ouest

- Quoi

- Qu’est ce qu'

- quand

- qui

- tout en

- sera

- fenêtres

- comprenant

- dans les

- sans

- Word

- des mots

- world

- écriture

- Oui

- Vous n'avez

- Votre

- zéphyrnet

- zéro