Le monde de l'intelligence artificielle (IA) et de l'apprentissage automatique (ML) a été témoin d'un changement de paradigme avec l'essor des modèles d'IA générative qui peuvent créer du texte, des images, du code et de l'audio de type humain. Par rapport aux modèles ML classiques, les modèles d'IA générative sont nettement plus volumineux et plus complexes. Cependant, leur complexité croissante s'accompagne également de coûts d'inférence élevés et d'un besoin croissant de ressources de calcul puissantes. Le coût élevé de l'inférence pour les modèles d'IA générative peut constituer un obstacle à l'entrée pour les entreprises et les chercheurs disposant de ressources limitées, ce qui nécessite des solutions plus efficaces et plus rentables. De plus, la majorité des cas d'utilisation de l'IA générative impliquent une interaction humaine ou des scénarios du monde réel, nécessitant un matériel capable de fournir des performances à faible latence. AWS innove avec des puces spécialement conçues pour répondre au besoin croissant de matériel de calcul puissant, efficace et rentable.

Aujourd'hui, nous sommes ravis d'annoncer que Amazon Sage Maker supports Inférence AWS2 (ml.inf2) et Formation AWS (ml.trn1) basées sur des instances SageMaker pour héberger des modèles d'IA génératifs pour l'inférence en temps réel et asynchrone. Les instances ml.inf2 sont disponibles pour le déploiement de modèles sur SageMaker dans la région USA Est (Ohio) et les instances ml.trn1 dans la région USA Est (Virginie du Nord).

Vous pouvez utiliser ces instances sur SageMaker pour obtenir des performances élevées à faible coût pour les modèles d'IA générative, y compris les grands modèles de langage (LLM), la diffusion stable et les transformateurs de vision. De plus, vous pouvez utiliser Outil de recommandation d'inférence Amazon SageMaker pour vous aider à exécuter des tests de charge et à évaluer les avantages prix-performances du déploiement de votre modèle sur ces instances.

Vous pouvez utiliser les instances ml.inf2 et ml.trn1 pour exécuter vos applications ML sur SageMaker pour la synthèse de texte, la génération de code, la génération de vidéos et d'images, la reconnaissance vocale, la personnalisation, la détection des fraudes, etc. Vous pouvez facilement commencer en spécifiant des instances ml.trn1 ou ml.inf2 lors de la configuration de votre point de terminaison SageMaker. Vous pouvez utiliser les conteneurs AWS Deep Learning (DLC) compatibles ml.trn1 et ml.inf2 pour PyTorch, TensorFlow, Hugging Face et l'inférence de grand modèle (LMI) pour démarrer facilement. Pour la liste complète des versions, voir Images de conteneurs de Deep Learning disponibles.

Dans cet article, nous montrons le processus de déploiement d'un grand modèle de langage sur AWS Inferentia2 à l'aide de SageMaker, sans nécessiter de codage supplémentaire, en tirant parti du conteneur LMI. Nous utilisons le GPT4ALL-J, un modèle GPT-J 7B affiné qui offre une interaction de type chatbot.

Présentation des instances ml.trn1 et ml.inf2

Les instances ml.trn1 sont alimentées par l'accélérateur Trainium, qui est spécialement conçu pour la formation d'apprentissage en profondeur haute performance des modèles d'IA générative, y compris les LLM. Cependant, ces instances prennent également en charge les charges de travail d'inférence pour les modèles qui sont encore plus volumineux que ce qui convient à Inf2. La plus grande taille d'instance, trn1.32xlarge instances, comporte 16 Accélérateurs Trainium avec 512 Go de mémoire accélératrice dans une seule instance offrant jusqu'à 3.4 pétaflops de puissance de calcul FP16/BF16. 16 accélérateurs Trainium sont connectés avec NeuronLinkv2 ultra-rapide pour des communications collectives simplifiées.

Les instances ml.Inf2 sont alimentées par le Accélérateur AWS Inferentia2, un accélérateur spécialement conçu pour l'inférence. Il offre des performances de calcul trois fois supérieures, un débit jusqu'à quatre fois supérieur et une latence jusqu'à 10 fois inférieure par rapport à AWS Inferentia de première génération. La plus grande taille d'instance, Inf2.48xlarge, comprend 12 accélérateurs AWS Inferentia2 avec 384 Go de mémoire d'accélérateur dans une seule instance pour une puissance de calcul combinée de 2.3 pétaflops pour BF16/FP16. Il vous permet de déployer jusqu'à un modèle de 175 milliards de paramètres en une seule instance. Inf2 est la seule instance optimisée pour l'inférence à offrir cette interconnexion, une fonctionnalité qui n'est disponible que dans les instances de formation plus coûteuses. Pour les modèles ultra-larges qui ne rentrent pas dans un seul accélérateur, les données circulent directement entre les accélérateurs avec NeuronLink, contournant complètement le CPU. Avec NeuronLink, Inf2 prend en charge une inférence distribuée plus rapide et améliore le débit et la latence.

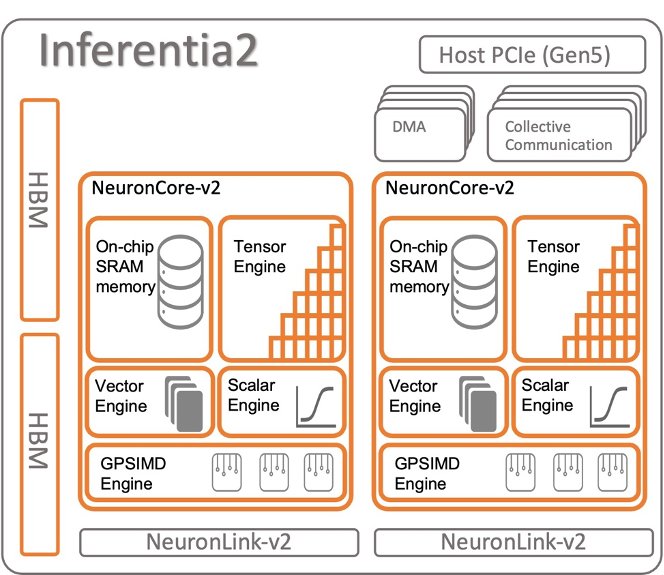

Les accélérateurs AWS Inferentia2 et Trainium ont deux NeuronCores-v2, des piles de mémoire HBM de 32 Go et des moteurs de calcul collectif dédiés, qui optimisent automatiquement le temps d'exécution en chevauchant le calcul et la communication lors de l'inférence multi-accélérateurs. Pour plus de détails sur l'architecture, consultez Appareils Trainium et Inferentia.

Le diagramme suivant montre un exemple d'architecture utilisant AWS Inferentia2.

SDK AWS Neuron

Neurone AWS est le SDK utilisé pour exécuter des charges de travail d'apprentissage en profondeur sur des instances basées sur AWS Inferentia et Trainium. AWS Neuron comprend un compilateur d'apprentissage en profondeur, un environnement d'exécution et des outils intégrés de manière native dans TensorFlow et PyTorch. Avec Neuron, vous pouvez développer, profiler et déployer des charges de travail ML hautes performances sur ml.trn1 et ml.inf2.

La Compilateur de neurones accepte les modèles ML dans différents formats (TensorFlow, PyTorch, XLA HLO) et les optimise pour fonctionner sur les appareils Neuron. Le compilateur Neuron est appelé dans le framework ML, où les modèles ML sont envoyés au compilateur par le plug-in du framework Neuron. L'artefact de compilateur résultant est appelé un fichier NEFF (Neuron Executable File Format) qui à son tour est chargé par le runtime Neuron sur le périphérique Neuron.

La Temps d'exécution des neurones se compose d'un pilote de noyau et de bibliothèques C/C++, qui fournissent des API pour accéder aux appareils AWS Inferentia et Trainium Neuron. Les plugins de cadres Neuron ML pour TensorFlow et PyTorch utilisent le runtime Neuron pour charger et exécuter des modèles sur les NeuronCores. Le runtime Neuron charge les modèles d'apprentissage en profondeur compilés (NEFF) sur les appareils Neuron et est optimisé pour un débit élevé et une faible latence.

Héberger des modèles NLP à l'aide d'instances SageMaker ml.inf2

Avant de plonger profondément dans le service des LLM avec transformateurs-neuronx, qui est une bibliothèque open source permettant de répartir les grandes matrices de poids du modèle sur plusieurs NeuronCores, passons brièvement en revue le flux de déploiement typique d'un modèle pouvant tenir sur un seul NeuronCore.

Vérifiez la liste des modèles pris en charge pour s'assurer que le modèle est pris en charge sur AWS Inferentia2. Ensuite, le modèle doit être pré-compilé par le compilateur Neuron. Vous pouvez utiliser un bloc-notes SageMaker ou un Cloud de calcul élastique Amazon (Amazon EC2) pour compiler le modèle. Vous pouvez utiliser le SDK Python SageMaker pour déployer des modèles à l'aide d'infrastructures d'apprentissage en profondeur populaires telles que PyTorch, comme illustré dans le code suivant. Vous pouvez déployer votre modèle sur les services d'hébergement SageMaker et obtenir un point de terminaison pouvant être utilisé pour l'inférence. Ces points de terminaison sont entièrement gérés et prennent en charge la mise à l'échelle automatique.

Reportez-vous à Flux de développement pour plus de détails sur les flux de développement typiques d'Inf2 sur SageMaker avec des exemples de scripts.

Héberger des LLM à l'aide d'instances SageMaker ml.inf2

Les grands modèles de langage avec des milliards de paramètres sont souvent trop volumineux pour tenir sur un seul accélérateur. Cela nécessite l'utilisation de techniques parallèles de modèles pour héberger des LLM sur plusieurs accélérateurs. Une autre exigence cruciale pour l'hébergement des LLM est la mise en œuvre d'une solution de service de modèle haute performance. Cette solution doit charger efficacement le modèle, gérer le partitionnement et répondre de manière transparente aux requêtes via des points de terminaison HTTP.

SageMaker comprend des conteneurs d'apprentissage en profondeur (DLC) spécialisés, des bibliothèques et des outils pour le parallélisme de modèles et l'inférence de grands modèles. Pour obtenir des ressources pour démarrer avec LMI sur SageMaker, reportez-vous à Parallélisme de modèles et inférence de grands modèles. SageMaker maintient des DLC avec des bibliothèques open source populaires pour l'hébergement de grands modèles tels que GPT, T5, OPT, BLOOM et Stable Diffusion sur l'infrastructure AWS. Ces DLC spécialisés sont appelés conteneurs SageMaker LMI.

Conteneurs IMT SageMaker utilisez DJLServing, un serveur de modèles intégré à la bibliothèque transformers-neuronx pour prendre en charge le parallélisme des tenseurs sur NeuronCores. Pour en savoir plus sur le fonctionnement de DJLServing, consultez Déployez de grands modèles sur Amazon SageMaker à l'aide de DJLServing et de l'inférence parallèle de modèle DeepSpeed. Le serveur de modèles DJL et la bibliothèque transformers-neuronx servent de composants de base du conteneur, qui comprend également le SDK Neuron. Cette configuration facilite le chargement des modèles sur les accélérateurs AWS Inferentia2, met en parallèle le modèle sur plusieurs NeuronCores et permet le service via des points de terminaison HTTP.

Le conteneur LMI prend en charge le chargement de modèles à partir d'un Service de stockage simple Amazon (Amazon S3) bucket ou Hugging Face Hub. Le script de gestionnaire par défaut charge le modèle, le compile et le convertit dans un format optimisé pour Neuron, puis le charge. Pour utiliser le conteneur LMI pour héberger des LLM, nous avons deux options :

- Un no-code (de préférence) – C'est le moyen le plus simple de déployer un LLM à l'aide d'un conteneur LMI. Dans cette méthode, vous pouvez utiliser le gestionnaire par défaut et passez simplement le nom du modèle et les paramètres requis dans

serving.propertiesfichier pour charger et héberger le modèle. Pour utiliser le gestionnaire par défaut, nous fournissons leentryPointparamètre commedjl_python.transformers-neuronx. - Apportez votre propre scénario – Dans cette approche, vous avez la possibilité de créer votre propre fichier model.py, qui contient le code nécessaire pour charger et servir le modèle. Ce fichier sert d'intermédiaire entre le

DJLServingles API et lestransformers-neuronxApis. Pour personnaliser le processus de chargement du modèle, vous pouvez fournirserving.propertiesavec des paramètres configurables. Pour une liste complète des paramètres configurables disponibles, reportez-vous à Toutes les options de configuration DJL. Voici un exemple de modèle.py fichier.

Architecture d'exécution

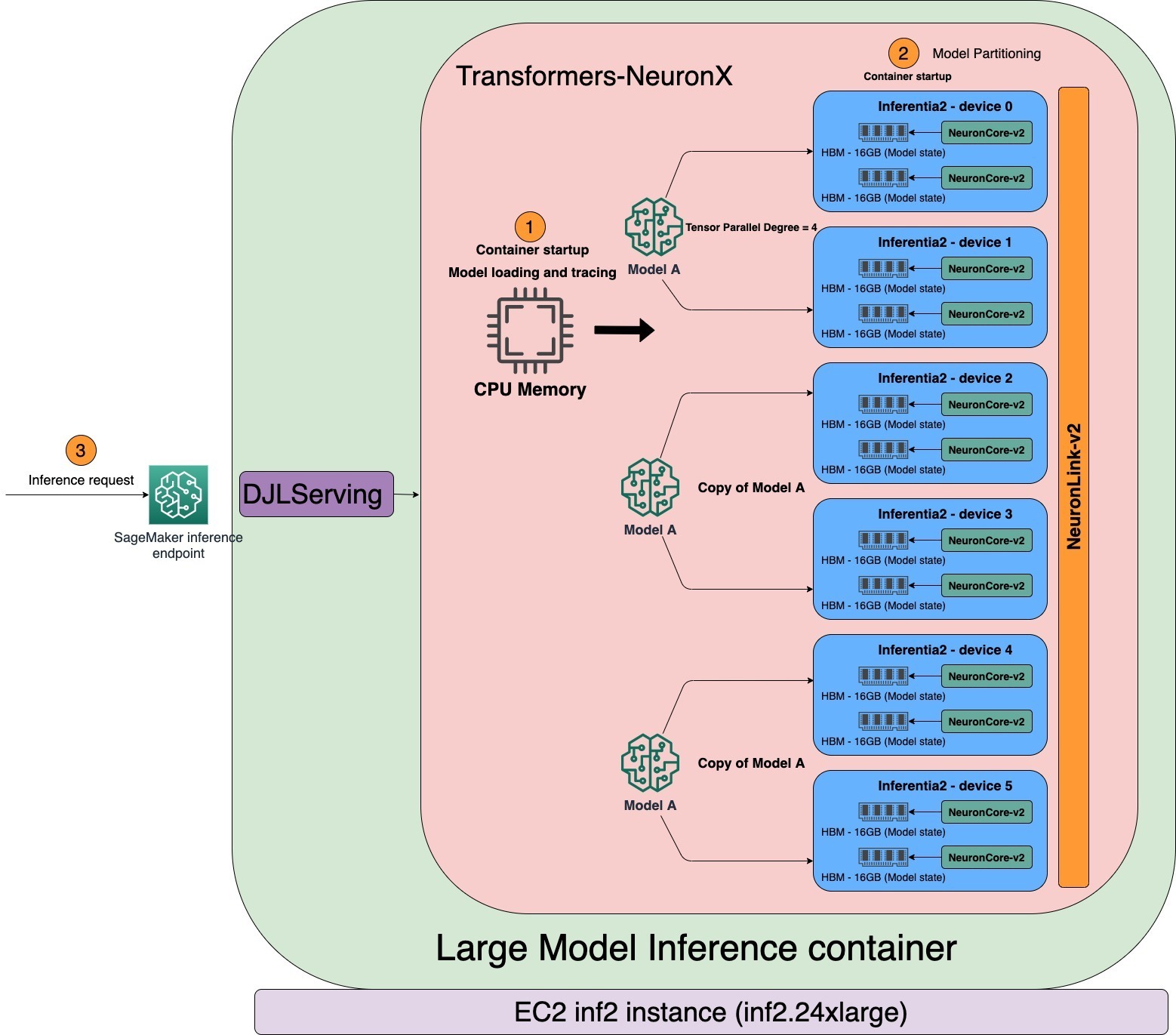

La tensor_parallel_degree La valeur de la propriété détermine la distribution des modules parallèles de tenseurs sur plusieurs NeuronCores. Par exemple, inf2.24xlarge dispose de six accélérateurs AWS Inferentia2. Chaque accélérateur AWS Inferentia2 possède deux NeuronCores. Chaque NeuronCore dispose d'une mémoire dédiée à large bande passante (HBM) de 16 Go stockant des modules parallèles de tenseur. Avec un degré parallèle de tenseur de 4, le LMI allouera trois copies modèles du même modèle, chacune utilisant quatre NeuronCores. Comme illustré dans le schéma suivant, lorsque le conteneur LMI démarre, le modèle est chargé et tracé en premier dans la mémoire adressable de la CPU. Lorsque le traçage est terminé, le modèle est partitionné sur les NeuronCores en fonction du degré parallèle du tenseur.

LMI utilise DJLServing comme modèle de pile de service. Une fois que la vérification de l'état du conteneur a réussi dans SageMaker, le conteneur est prêt à répondre à la demande d'inférence. DJLServing lance plusieurs processus Python équivalents au TOTAL NUMBER OF NEURON CORES/TENSOR_PARALLEL_DEGREE. Chaque processus Python contient des threads en C++ équivalents à TENSOR_PARALLEL_DEGREE. Chaque thread C++ contient une partition du modèle sur un NeuronCore.

De nombreux praticiens (processus Python) ont tendance à exécuter l'inférence de manière séquentielle lorsque le serveur est invoqué avec plusieurs requêtes indépendantes. Bien qu'il soit plus facile à configurer, il n'est généralement pas recommandé d'utiliser la puissance de calcul de l'accélérateur. Pour résoudre ce problème, DJLServing propose les optimisations intégrées du traitement par lots dynamique pour combiner ces demandes d'inférence indépendantes côté serveur pour former dynamiquement un lot plus important afin d'augmenter le débit. Toutes les demandes atteignent d'abord le doseur dynamique avant d'entrer dans les files d'attente de travaux réelles pour attendre l'inférence. Vous pouvez définir vos tailles de lot préférées pour le traitement par lots dynamique à l'aide de la batch_size paramètres dans serving.properties. Vous pouvez également configurer max_batch_delay pour spécifier le délai maximal dans le batcher pour attendre que d'autres demandes rejoignent le lot en fonction de vos exigences de latence. Le débit dépend également du nombre de copies de modèles et des groupes de processus Python lancés dans le conteneur. Comme illustré dans le diagramme suivant, avec le degré parallèle du tenseur défini sur 4, le conteneur LMI lance trois groupes de processus Python, chacun contenant la copie complète du modèle. Cela vous permet d'augmenter la taille du lot et d'obtenir un débit plus élevé.

Bloc-notes SageMaker pour le déploiement de LLM

Dans cette section, nous fournissons une procédure pas à pas pour déployer GPT4All-J, un modèle à 6 milliards de paramètres qui représente 24 Go dans FP32. GPT4All-J est un chatbot populaire qui a été formé sur une grande variété de contenus d'interaction comme les problèmes de mots, les dialogues, le code, les poèmes, les chansons et les histoires. GPT4all-J est un modèle GPT-J affiné qui génère des réponses similaires aux interactions humaines.

Le cahier complet de cet exemple est fourni sur GitHub. Nous pouvons utiliser le SDK Python SageMaker pour déployer le modèle sur une instance Inf2. Nous utilisons le fourni gestionnaire par défaut pour charger le modèle. Avec cela, nous avons juste besoin de fournir un portions.propriétés déposer. Ce fichier contient les configurations requises pour que le serveur de modèles DJL télécharge et héberge le modèle. Nous pouvons spécifier le nom du modèle Hugging Face en utilisant le model_id paramètre pour télécharger le modèle directement depuis le référentiel Hugging Face. Vous pouvez également télécharger le modèle à partir d'Amazon S3 en fournissant le s3url paramètre. le entryPoint Le paramètre est configuré pour pointer vers la bibliothèque pour charger le modèle. Pour plus de détails sur djl_python.fastertransformer, se référer au Code GitHub.

La tensor_parallel_degree La valeur de la propriété détermine la distribution des modules parallèles du tenseur sur plusieurs appareils. Par exemple, avec 12 NeuronCores et un degré parallèle de tenseur de 4, LMI allouera trois copies de modèle, chacune utilisant quatre NeuronCores. Vous pouvez également définir le type de précision à l'aide de la propriété dtype. n_position Le paramètre définit la somme de la longueur maximale des séquences d'entrée et de sortie pour le modèle. Voir le code suivant :

Construisez le tarball comprenant serving.properties et chargez-le dans un compartiment S3. Bien que le gestionnaire par défaut soit utilisé dans cet exemple, vous pouvez développer un model.py fichier pour personnaliser le processus de chargement et de service. Si des packages doivent être installés, incluez-les dans le requirements.txt déposer. Voir le code suivant :

Récupérez l'image du conteneur DJL et créez le modèle SageMaker :

Ensuite, nous créons le point de terminaison SageMaker avec la configuration du modèle définie précédemment. Le conteneur télécharge le modèle dans le /tmp car SageMaker mappe l'espace /tmp à Boutique de blocs élastiques Amazon (Amazon EBS). Nous devons ajouter un volume_size paramètre pour assurer la /tmp répertoire dispose de suffisamment d'espace pour télécharger et compiler le modèle. Nous fixons container_startup_health_check_timeout à 3,600 2.8 secondes pour s'assurer que la vérification de l'état commence une fois que le modèle est prêt. Nous utilisons l'instance ml.infXNUMXxlarge. Voir le code suivant :

Une fois le point de terminaison SageMaker créé, nous pouvons effectuer des prédictions en temps réel sur les points de terminaison SageMaker à l'aide de Predictor objet:

Nettoyer

Supprimez les points de terminaison pour réduire les coûts une fois vos tests terminés :

Conclusion

Dans cet article, nous avons présenté la capacité nouvellement lancée de SageMaker, qui prend désormais en charge les instances ml.inf2 et ml.trn1 pour l'hébergement de modèles d'IA génératifs. Nous avons montré comment déployer GPT4ALL-J, un modèle d'IA générative, sur AWS Inferentia2 à l'aide de SageMaker et du conteneur LMI, sans écrire de code. Nous avons également montré comment vous pouvez utiliser DJLServing et transformers-neuronx pour charger un modèle, le partitionner et le servir.

Les instances Inf2 offrent le moyen le plus rentable d'exécuter des modèles d'IA générative sur AWS. Pour plus de détails sur les performances, reportez-vous à Performances Inf2.

Jetez un coup d'œil au GitHub dépôt pour un exemple de bloc-notes. Essayez-le et faites-nous savoir si vous avez des questions!

À propos des auteurs

Vivek Gangasani est architecte principal de solutions d'apprentissage automatique chez Amazon Web Services. Il travaille avec des startups d'apprentissage automatique pour créer et déployer des applications AI/ML sur AWS. Il se concentre actuellement sur la fourniture de solutions pour MLOps, ML Inference et ML low-code. Il a travaillé sur des projets dans différents domaines, dont le traitement du langage naturel et la vision par ordinateur.

Vivek Gangasani est architecte principal de solutions d'apprentissage automatique chez Amazon Web Services. Il travaille avec des startups d'apprentissage automatique pour créer et déployer des applications AI/ML sur AWS. Il se concentre actuellement sur la fourniture de solutions pour MLOps, ML Inference et ML low-code. Il a travaillé sur des projets dans différents domaines, dont le traitement du langage naturel et la vision par ordinateur.

Hiroshi Tokoyo est architecte de solutions chez AWS Annapurna Labs. Basé au Japon, il a rejoint Annapurna Labs avant même l'acquisition par AWS et a toujours aidé les clients avec la technologie Annapurna Labs. Il s'est récemment concentré sur les solutions d'apprentissage automatique basées sur du silicium spécialement conçu, AWS Inferentia et Trainium.

Hiroshi Tokoyo est architecte de solutions chez AWS Annapurna Labs. Basé au Japon, il a rejoint Annapurna Labs avant même l'acquisition par AWS et a toujours aidé les clients avec la technologie Annapurna Labs. Il s'est récemment concentré sur les solutions d'apprentissage automatique basées sur du silicium spécialement conçu, AWS Inferentia et Trainium.

Dhawal Patel est architecte principal en apprentissage machine chez AWS. Il a travaillé avec des organisations allant des grandes entreprises aux startups de taille moyenne sur des problèmes liés à l'informatique distribuée et à l'intelligence artificielle. Il se concentre sur l'apprentissage en profondeur, y compris les domaines de la PNL et de la vision par ordinateur. Il aide les clients à obtenir une inférence de modèle haute performance sur SageMaker.

Dhawal Patel est architecte principal en apprentissage machine chez AWS. Il a travaillé avec des organisations allant des grandes entreprises aux startups de taille moyenne sur des problèmes liés à l'informatique distribuée et à l'intelligence artificielle. Il se concentre sur l'apprentissage en profondeur, y compris les domaines de la PNL et de la vision par ordinateur. Il aide les clients à obtenir une inférence de modèle haute performance sur SageMaker.

Lan Qing est ingénieur en développement logiciel chez AWS. Il a travaillé sur plusieurs produits stimulants chez Amazon, notamment des solutions d'inférence ML hautes performances et un système de journalisation hautes performances. L'équipe de Qing a lancé avec succès le premier modèle de milliards de paramètres dans Amazon Advertising avec une très faible latence requise. Qing possède une connaissance approfondie de l'optimisation de l'infrastructure et de l'accélération du Deep Learning.

Lan Qing est ingénieur en développement logiciel chez AWS. Il a travaillé sur plusieurs produits stimulants chez Amazon, notamment des solutions d'inférence ML hautes performances et un système de journalisation hautes performances. L'équipe de Qing a lancé avec succès le premier modèle de milliards de paramètres dans Amazon Advertising avec une très faible latence requise. Qing possède une connaissance approfondie de l'optimisation de l'infrastructure et de l'accélération du Deep Learning.

Qingwei Li est un spécialiste de l'apprentissage automatique chez Amazon Web Services. Il a obtenu son doctorat. en recherche opérationnelle après avoir cassé le compte de subvention de recherche de son conseiller et échoué à décerner le prix Nobel qu'il avait promis. Actuellement, il aide les clients du secteur des services financiers et de l'assurance à créer des solutions d'apprentissage automatique sur AWS. Dans ses temps libres, il aime lire et enseigner.

Qingwei Li est un spécialiste de l'apprentissage automatique chez Amazon Web Services. Il a obtenu son doctorat. en recherche opérationnelle après avoir cassé le compte de subvention de recherche de son conseiller et échoué à décerner le prix Nobel qu'il avait promis. Actuellement, il aide les clients du secteur des services financiers et de l'assurance à créer des solutions d'apprentissage automatique sur AWS. Dans ses temps libres, il aime lire et enseigner.

Alan Tan est chef de produit senior chez SageMaker et dirige les efforts sur l'inférence de grands modèles. Il est passionné par l'application de l'apprentissage automatique au domaine de l'analyse. En dehors du travail, il aime le plein air.

Alan Tan est chef de produit senior chez SageMaker et dirige les efforts sur l'inférence de grands modèles. Il est passionné par l'application de l'apprentissage automatique au domaine de l'analyse. En dehors du travail, il aime le plein air.

Varun Syal est un ingénieur en développement logiciel chez AWS Sagemaker travaillant sur des fonctionnalités critiques destinées aux clients pour la plate-forme ML Inference. Il est passionné par le travail dans le domaine des systèmes distribués et de l'IA. Dans ses temps libres, il aime lire et jardiner.

Varun Syal est un ingénieur en développement logiciel chez AWS Sagemaker travaillant sur des fonctionnalités critiques destinées aux clients pour la plate-forme ML Inference. Il est passionné par le travail dans le domaine des systèmes distribués et de l'IA. Dans ses temps libres, il aime lire et jardiner.

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- PlatoAiStream. Intelligence des données Web3. Connaissance Amplifiée. Accéder ici.

- Frapper l'avenir avec Adryenn Ashley. Accéder ici.

- Achetez et vendez des actions de sociétés PRE-IPO avec PREIPO®. Accéder ici.

- La source: https://aws.amazon.com/blogs/machine-learning/achieve-high-performance-with-lowest-cost-for-generative-ai-inference-using-aws-inferentia2-and-aws-trainium-on-amazon-sagemaker/

- :possède

- :est

- :ne pas

- :où

- $UP

- 10

- 100

- 12

- 13

- 14

- 15%

- 22

- 24

- 7

- 8

- 9

- a

- A Propos

- accélérateur

- accélérateurs

- Accepte

- accès

- Compte

- atteindre

- acquisition

- à travers

- actes

- ajouter

- ajout

- propos

- adressable

- Avantage

- Numérique

- Après

- à opposer à

- AI

- cas d'utilisation de l'IA

- AI / ML

- Tous

- permet

- aussi

- Bien que

- Amazon

- Amazon EC2

- Amazon Sage Maker

- Amazon Web Services

- an

- analytique

- ainsi que

- Annoncer

- Une autre

- tous

- Apis

- applications

- Application

- une approche

- architecture

- SONT

- Réservé

- artificiel

- intelligence artificielle

- Intelligence artificielle (AI)

- AS

- At

- acoustique

- auto

- automatiquement

- disponibles

- AWS

- Inférence AWS

- balle

- Bande passante

- une barrière

- basé

- BE

- car

- était

- before

- avantages.

- LES MEILLEURS

- jusqu'à XNUMX fois

- Big

- plus gros

- milliards

- Block

- Blog

- Bloom

- brièvement

- Cassé

- construire

- construit

- intégré

- entreprises

- by

- C + +

- appelé

- CAN

- cas

- difficile

- Chatbot

- vérifier

- chips

- code

- Codage

- Collective

- combiner

- combiné

- vient

- Communication

- Communications

- par rapport

- compatible

- complet

- complètement

- complexe

- complexité

- composants électriques

- complet

- calcul

- calcul

- ordinateur

- Vision par ordinateur

- informatique

- configuration

- connecté

- Contenant

- Conteneurs

- contient

- contenu

- Core

- Prix

- rentable

- Costs

- engendrent

- créée

- critique

- crucial

- Lecture

- des clients

- Clients

- personnaliser

- données

- dévoué

- profond

- l'apprentissage en profondeur

- Réglage par défaut

- défini

- Définit

- Degré

- retarder

- livrer

- livrer

- offre

- démontré

- dépend

- déployer

- déployer

- déploiement

- détails

- Détection

- détermine

- développer

- Développement

- dispositif

- Compatibles

- différent

- La diffusion

- directement

- distribué

- informatique distribuée

- systèmes distribués

- distribution

- faire

- domaines

- Ne pas

- download

- téléchargements

- driver

- Dynamic

- dynamiquement

- chacun

- Plus tôt

- plus facilement

- plus facile

- même

- Est

- efficace

- efficacement

- efforts

- permet

- fin

- Endpoint

- ingénieur

- Moteurs

- assez

- assurer

- entrant

- entreprises

- entrée

- Équivalent

- évaluer

- Pourtant, la

- exemple

- excité

- cher

- supplémentaire

- Visage

- facilite

- Échoué

- plus rapide

- Fonctionnalité

- Fonctionnalités:

- Déposez votre dernière attestation

- la traduction de documents financiers

- service financier

- finition

- Prénom

- s'adapter

- flux

- Flux

- Focus

- concentré

- se concentre

- Abonnement

- Pour

- formulaire

- le format

- quatre

- Framework

- cadres

- fraude

- détection de fraude

- De

- plein

- d’étiquettes électroniques entièrement

- En outre

- génère

- génération

- génératif

- IA générative

- obtenez

- Go

- subvention

- Groupes

- Croissance

- Matériel

- Vous avez

- he

- Santé

- vous aider

- a aidé

- aide

- ici

- Haute

- haute performance

- augmentation

- sa

- tenue

- détient

- hôte

- hébergement

- services d'hébergement

- Villa

- Comment

- How To

- Cependant

- HTML

- http

- HTTPS

- Moyeu

- humain

- if

- image

- satellite

- la mise en oeuvre

- importer

- in

- en profondeur

- comprendre

- inclut

- Y compris

- Améliore

- croissant

- indépendant

- industrie

- Infrastructure

- innover

- contribution

- entrées

- installation

- instance

- Assurance

- des services

- Intelligence

- l'interaction

- interactions

- intermédiaire

- développement

- invoqué

- impliquer

- IT

- SES

- Japon

- Emploi

- rejoindre

- rejoint

- jpg

- json

- juste

- Savoir

- spécialisées

- Labs

- langue

- gros

- Grandes entreprises

- plus importantes

- le plus grand

- Latence

- lancé

- lance

- conduisant

- APPRENTISSAGE

- apprentissage

- Longueur

- laisser

- bibliothèques

- Bibliothèque

- comme

- aime

- limité

- Liste

- LLM

- charge

- chargement

- charges

- enregistrement

- Faible

- baisser

- le plus bas

- click

- machine learning

- principalement

- maintient

- Majorité

- a prendre une

- gérer

- gérés

- manager

- Map

- max

- maximales

- Mémoire

- méthode

- ML

- MLOps

- modèle

- numériques jumeaux (digital twin models)

- Modules

- PLUS

- plus efficace

- (en fait, presque toutes)

- plusieurs

- prénom

- Nature

- Traitement du langage naturel

- nécessaire

- Besoin

- Besoins

- Nouveauté

- New York

- next

- nlp

- prix Nobel

- cahier

- maintenant

- nombre

- objet

- of

- code

- Offres Speciales

- souvent

- Ohio

- on

- ONE

- uniquement

- open source

- Opérations

- à mettre en œuvre pour gérer une entreprise rentable. Ce guide est basé sur trois décennies d'expérience

- Optimiser

- optimisé

- Optimise

- Option

- Options

- or

- organisations

- Autre

- nos

- ande

- l'extérieur

- sortie

- au contrôle

- propre

- Forfaits

- paradigme

- Parallèle

- paramètre

- paramètres

- pass

- passes

- passionné

- performant

- Personnalisation

- plateforme

- Platon

- Intelligence des données Platon

- PlatonDonnées

- plug-in

- plugins

- Point

- Populaire

- Post

- power

- alimenté

- solide

- pratique

- La précision

- Prédictions

- Predictor

- préféré

- Directeur

- prix

- d'ouvrabilité

- processus

- les process

- traitement

- Produit

- chef de produit

- Produits

- Profil

- projets

- promis

- propriétés

- propriété

- fournir

- à condition de

- fournit

- aportando

- but

- Python

- pytorch

- allant

- nous joindre

- en cours

- solutions

- monde réel

- en temps réel

- reçu

- récent

- reconnaissance

- visée

- en relation

- nécessaire

- demandes

- conditions

- exigence

- Exigences

- un article

- chercheurs

- Resources

- réponses

- résultant

- Augmenter

- Courir

- sagemaker

- Inférence SageMaker

- même

- Épargnez

- mise à l'échelle

- scénarios

- scripts

- Sdk

- de façon transparente

- secondes

- Section

- sur le lien

- supérieur

- Séquence

- besoin

- service

- Services

- service

- set

- Paramétres

- installation

- plusieurs

- décalage

- devrait

- montrer

- présenté

- montré

- Spectacles

- côté

- de façon significative

- Silicium

- similaires

- étapes

- unique

- SIX

- Taille

- tailles

- So

- Logiciels

- développement de logiciels

- sur mesure

- Solutions

- Space

- spécialiste

- spécialisé

- discours

- Reconnaissance vocale

- stable

- empiler

- Combos

- Commencer

- j'ai commencé

- départs

- Startups

- storage

- Stories

- stockage

- rationalisé

- Catégorie

- Avec succès

- tel

- Support

- Appareils

- Les soutiens

- combustion propre

- Système

- prise

- Enseignement

- équipe

- techniques

- Technologie

- tensorflow

- tests

- que

- qui

- La

- La Région

- leur

- Les

- Là.

- Ces

- this

- trois

- Avec

- débit

- fiable

- fois

- à

- trop

- les outils

- Traçant

- qualifié

- Formation

- transformateurs

- TOUR

- deux

- type

- débutante

- téléchargé

- us

- utilisé

- d'utiliser

- en utilisant

- d'habitude

- utiliser

- Utilisant

- Plus-value

- variété

- divers

- Vaste

- très

- via

- Vidéo

- Virginie

- vision

- attendez

- walkthrough

- Façon..

- we

- web

- services Web

- poids

- Quoi

- quand

- qui

- sera

- comprenant

- dans les

- sans

- Témoin

- Word

- activités principales

- travaillé

- de travail

- vos contrats

- world

- écrire

- écriture

- york

- Vous n'avez

- Votre

- zéphyrnet