Ceci est le deuxième article d'une série en quatre parties détaillant comment Groupe NatWest, une importante institution de services financiers, en partenariat avec Services professionnels AWS pour créer une nouvelle plateforme d’opérations d’apprentissage automatique (MLOps). Dans cet article, nous expliquons comment le groupe NatWest a utilisé AWS pour permettre le déploiement en libre-service de sa plateforme MLOps standardisée, sécurisée et conforme à l'aide de Catalogue de services AWS ainsi que Amazon Sage Maker. Cela a permis de réduire le temps nécessaire pour provisionner de nouveaux environnements de quelques jours à quelques heures seulement.

Nous pensons que les décideurs peuvent bénéficier de ce contenu. Les CTO, les CDAO, les data scientists seniors et les ingénieurs cloud seniors peuvent suivre ce modèle pour fournir des solutions innovantes à leurs équipes de science des données et d'ingénierie.

Lisez toute la série:

|

Technologie chez NatWest Group

NatWest Group est une banque relationnelle pour un monde numérique qui fournit des services financiers à plus de 19 millions de clients à travers le Royaume-Uni. Le Groupe dispose d'un portefeuille technologique diversifié, où les solutions aux défis commerciaux sont souvent fournies à l'aide de conceptions sur mesure et dans des délais longs.

Récemment, NatWest Group a adopté une stratégie axée sur le cloud, qui a permis à l'entreprise d'utiliser des services gérés pour fournir des ressources de calcul et de stockage à la demande. Cette évolution a conduit à une amélioration de la stabilité globale, de l'évolutivité et des performances des solutions d'entreprise, tout en réduisant les coûts et en accélérant la cadence de livraison. De plus, le passage au cloud permet à NatWest Group de simplifier sa pile technologique en appliquant un ensemble de conceptions de solutions cohérentes, reproductibles et pré-approuvées pour répondre aux exigences réglementaires et fonctionner de manière contrôlée.

Défis

Les étapes pilotes de l'adoption d'une approche cloud-first ont impliqué plusieurs phases d'expérimentation et d'évaluation utilisant une grande variété de services d'analyse sur AWS. Les premières itérations de la plateforme cloud de NatWest Group pour les charges de travail de science des données ont été confrontées à des défis liés à la fourniture d'environnements cloud cohérents, sécurisés et conformes. Le processus de création de nouveaux environnements a pris de quelques jours à des semaines, voire des mois. Le recours à des équipes de plateforme centrales pour créer, provisionner, sécuriser, déployer et gérer l'infrastructure et les sources de données a rendu difficile l'intégration de nouvelles équipes pour travailler dans le cloud.

En raison de la disparité de configuration de l'infrastructure entre les comptes AWS, les équipes qui ont décidé de migrer leurs charges de travail vers le cloud ont dû passer par un processus de conformité élaboré. Chaque composant de l'infrastructure a dû être analysé séparément, ce qui a allongé les délais d'audit de sécurité.

Démarrer avec le développement dans AWS impliquait la lecture d'un ensemble de guides de documentation rédigés par les équipes de la plateforme. Les étapes initiales de configuration de l'environnement comprenaient la gestion des clés publiques et privées pour l'authentification, la configuration des connexions aux services distants à l'aide du Interface de ligne de commande AWS (AWS CLI) ou SDK à partir d'environnements de développement locaux et exécution de scripts personnalisés pour relier les IDE locaux aux services cloud. Les défis techniques ont souvent rendu difficile l'intégration de nouveaux membres de l'équipe. Une fois les environnements de développement configurés, le processus de mise en production du logiciel était tout aussi complexe et long.

Comme décrit dans la première partie de cette série, l'équipe de projet commune a collecté de grandes quantités de commentaires sur l'expérience utilisateur et les exigences des équipes du groupe NatWest avant de créer la nouvelle plate-forme de science des données et MLOps. Un thème commun dans ces commentaires était le besoin d'automatisation et de standardisation en tant que précurseur d'une livraison rapide et efficace des projets sur AWS. La nouvelle plateforme utilise les services gérés AWS pour optimiser les coûts, réduire les efforts de configuration de la plateforme et réduire l'empreinte carbone liée à l'exécution de tâches de calcul inutilement volumineuses. La standardisation est intégrée au cœur de la plateforme, avec des composants d'infrastructure préapprouvés, entièrement configurés, sécurisés, conformes et réutilisables, partageables entre les équipes de données et d'analyse.

Pourquoi SageMaker Studio ?

L'équipe a choisi Amazon SageMakerStudio comme outil principal pour créer et déployer des pipelines ML. Studio fournit une interface Web unique qui offre aux utilisateurs un accès, un contrôle et une visibilité complets sur chaque étape requise pour créer, former et déployer des modèles. La maturité de l'IDE Studio (environnement de développement intégré) pour le développement de modèles, le suivi des métadonnées, la gestion des artefacts et le déploiement faisaient partie des fonctionnalités qui ont fortement séduit l'équipe de NatWest Group.

Les data scientists du NatWest Group travaillent avec les notebooks SageMaker dans Studio pendant les premières étapes du développement du modèle pour effectuer l'analyse des données, la gestion des données et l'ingénierie des fonctionnalités. Une fois que les utilisateurs sont satisfaits des résultats de ce travail initial, le code est facilement converti en fonctions composables pour la transformation des données, la formation de modèles, l'inférence, la journalisation et les tests unitaires afin qu'il soit prêt pour la production.

Les étapes ultérieures du cycle de vie du développement du modèle impliquent l'utilisation de Pipelines Amazon SageMaker, qui peut être inspecté visuellement et surveillé dans Studio. Les pipelines sont visualisés dans un DAG (Directed Acyclic Graph) qui code les étapes en couleur en fonction de leur état pendant l'exécution du pipeline. De plus, un résumé de Journaux Amazon CloudWatch s'affiche à côté du DAG pour faciliter le débogage des étapes ayant échoué. Les data scientists disposent d'un modèle de code composé de toutes les étapes fondamentales d'un pipeline SageMaker. Cela fournit un cadre standardisé (cohérent entre tous les utilisateurs de la plate-forme pour faciliter la collaboration et le partage des connaissances) dans lequel les développeurs peuvent ajouter la logique et le code d'application sur mesure spécifiques au défi commercial qu'ils résolvent.

Les développeurs exécutent les pipelines dans l'IDE Studio pour garantir que leurs modifications de code s'intègrent correctement aux autres étapes du pipeline. Une fois les modifications de code examinées et approuvées, ces pipelines sont créés et exécutés automatiquement en fonction d'un déclencheur de branche du référentiel Git principal. Pendant la formation du modèle, les métriques d'évaluation du modèle sont stockées et suivies dans SageMaker Experiments, qui peuvent être utilisées pour le réglage des hyperparamètres. Une fois qu'un modèle est entraîné, l'artefact du modèle est stocké dans le Registre de modèles SageMaker, ainsi que les métadonnées liées aux conteneurs de modèle, aux données utilisées lors de la formation, aux fonctionnalités du modèle et au code du modèle. Le registre de modèles joue un rôle clé dans le processus de déploiement de modèles car il regroupe toutes les informations sur les modèles et permet l'automatisation de la promotion des modèles vers les environnements de production.

Les ingénieurs MLOps déploient des solutions gérées Tâches de transformation par lots SageMaker, qui s'adaptent aux exigences de la charge de travail. Les tâches d'inférence par lots hors ligne et les modèles en ligne servis via un point de terminaison utilisent la fonctionnalité d'inférence gérée de SageMaker. Cela profite à la fois aux équipes de plate-forme et d'applications métier, car les ingénieurs de plate-forme ne perdent plus de temps à configurer les composants d'infrastructure pour l'inférence de modèle, et les équipes d'applications métier n'écrivent pas de code passe-partout supplémentaire pour configurer et interagir avec les instances de calcul.

Pourquoi le catalogue de services AWS ?

L'équipe a choisi AWS Service Catalog pour créer un catalogue de modèles d'infrastructure sécurisés, conformes et pré-approuvés. Les composants d'infrastructure d'un produit AWS Service Catalog sont préconfigurés pour répondre aux exigences de sécurité du groupe NatWest. La gestion de l'accès aux rôles, les politiques de ressources, la configuration réseau et les politiques de contrôle central sont configurées pour chaque ressource regroupée dans un produit AWS Service Catalog. Les produits sont versionnés et partagés avec les équipes d'application en suivant un processus standard qui permet aux équipes de science des données et d'ingénierie de se servir elles-mêmes et de déployer l'infrastructure immédiatement après avoir obtenu l'accès à leurs comptes AWS.

Les équipes de développement de plateforme peuvent facilement faire évoluer les produits AWS Service Catalog au fil du temps pour permettre la mise en œuvre de nouvelles fonctionnalités en fonction des exigences de l'entreprise. Les modifications itératives des produits sont apportées à l'aide de la gestion des versions des produits AWS Service Catalog. Lorsqu'une nouvelle version du produit est publiée, l'équipe de la plateforme fusionne les modifications de code dans la branche Git principale et incrémente la version du produit AWS Service Catalog. Il existe un certain degré d'autonomie et de flexibilité dans la mise à jour de l'infrastructure, car les comptes d'applications métier peuvent utiliser des versions antérieures des produits avant de migrer vers la dernière version.

Vue d'ensemble de la solution

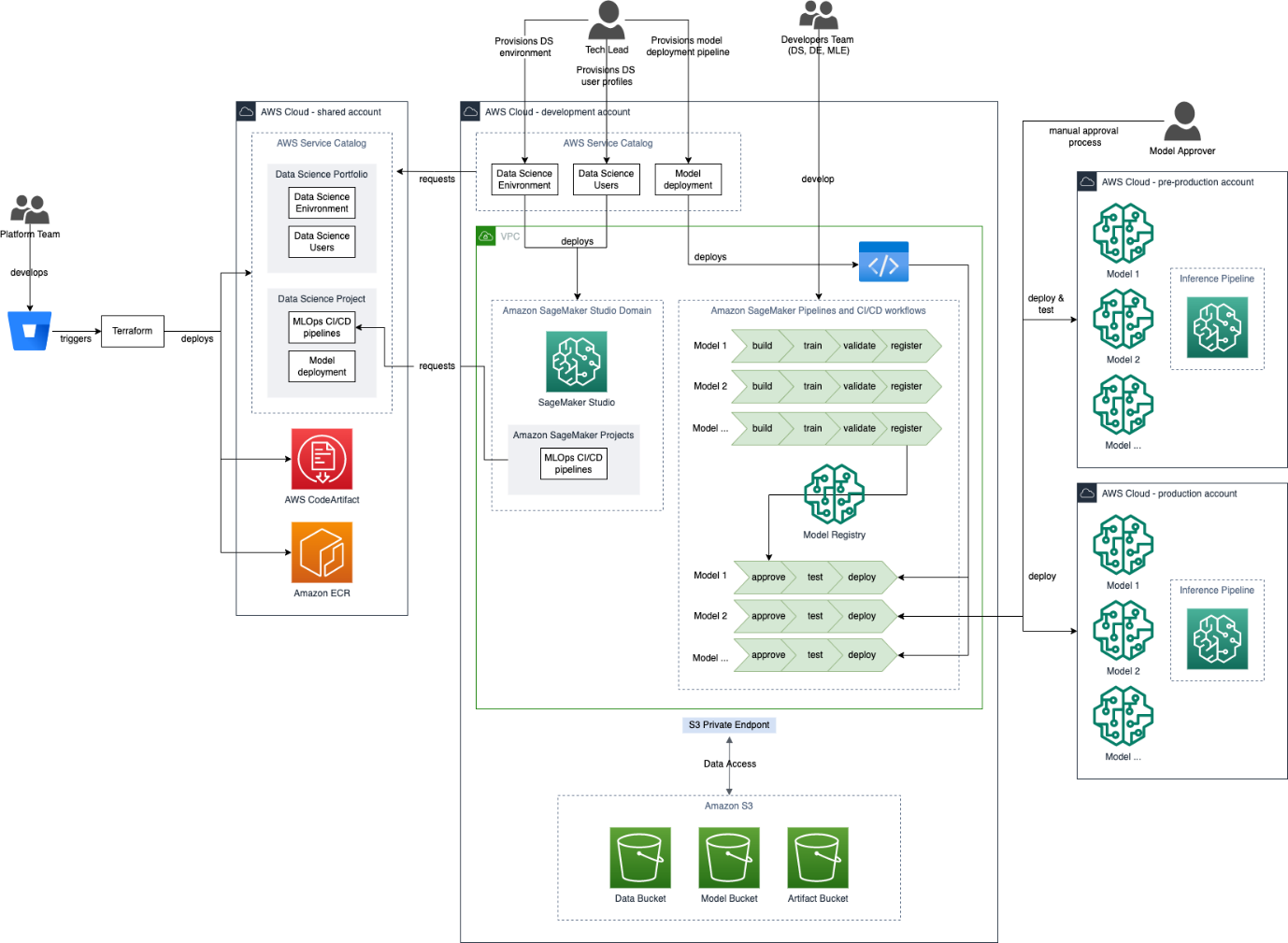

Le diagramme d'architecture de haut niveau suivant montre comment un cas d'utilisation d'application métier typique est déployé sur AWS. Les sections suivantes expliquent plus en détail l'architecture du compte, la manière dont l'infrastructure est déployée, la gestion des accès des utilisateurs et la manière dont les différents services AWS sont utilisés pour créer des solutions ML.

Comme le montre le diagramme d'architecture, les comptes suivent un modèle en étoile. Un compte de plateforme partagé sert de compte hub, où les ressources requises par les comptes (spoke) de l’équipe d’application métier sont hébergées par l’équipe de plateforme. Ces ressources comprennent les éléments suivants :

- Une bibliothèque de produits d'infrastructure sécurisés et standardisés utilisés pour les déploiements d'infrastructures en libre-service, hébergés par AWS Service Catalog

- Images Docker, stockées dans Registre des conteneurs élastiques Amazon (Amazon ECR), qui sont utilisés lors de l'exécution des étapes du pipeline SageMaker et de l'inférence de modèle

- Code AWSArtifact référentiels, qui hébergent des packages Python pré-approuvés

Ces ressources sont automatiquement partagées avec les comptes Spoke via la fonctionnalité de partage et d'importation de portefeuille AWS Service Catalog, et Gestion des identités et des accès AWS (IAM) dans le cas d'Amazon ECR et de CodeArtifact.

Chaque équipe d'applications métier dispose de trois comptes AWS dans l'environnement d'infrastructure du groupe NatWest : développement, pré-production et production. Les noms d'environnement font référence au rôle prévu du compte dans le cycle de vie du développement de la science des données. Le compte de développement est utilisé pour effectuer une analyse et une gestion des données, écrire du code de modèle et de pipeline de modèle, former des modèles et déclencher des déploiements de modèles dans des environnements de pré-production et de production via SageMaker Studio. Le compte de pré-production reflète la configuration du compte de production et est utilisé pour tester les déploiements de modèles et les tâches de transformation par lots avant leur mise en production. Le compte de production héberge des modèles et exécute des charges de travail d'inférence de production.

Gestion des utilisateurs

NatWest Group dispose de processus de gouvernance stricts pour appliquer la séparation des rôles des utilisateurs. Cinq rôles IAM distincts ont été créés pour chaque personnage d'utilisateur.

L'équipe de la plateforme utilise les rôles suivants :

- Ingénieur support plateforme – Ce rôle contient des autorisations pour les tâches habituelles et une vue en lecture seule du reste de l'environnement pour la surveillance et le débogage de la plateforme.

- Ingénieur de réparation de plateforme – Ce rôle a été créé avec des autorisations élevées. Il est utilisé en cas de problèmes avec la plate-forme nécessitant une intervention manuelle. Ce rôle n'est assumé que de manière approuvée et limitée dans le temps.

Les équipes de développement d’applications métiers ont trois rôles distincts :

- Responsable technique – Ce rôle est attribué au chef de l’équipe application, souvent un data scientist senior. Cet utilisateur est autorisé à déployer et gérer les produits AWS Service Catalog, à déclencher des versions en production et à examiner l'état de l'environnement, tel que AWS CodePipeline statuts et journaux. Ce rôle n'est pas autorisé à approuver un modèle dans le registre de modèles SageMaker.

- Développeur – Ce rôle est attribué à tous les membres de l'équipe qui travaillent avec SageMaker Studio, notamment les ingénieurs, les data scientists et souvent le chef d'équipe. Ce rôle dispose des autorisations nécessaires pour ouvrir Studio, écrire du code et exécuter et déployer des pipelines SageMaker. Tout comme le responsable technique, ce rôle n'est pas autorisé à approuver un modèle dans le registre des modèles.

- Approbateur du modèle – Ce rôle dispose d'autorisations limitées relatives à l'affichage, à l'approbation et au rejet des modèles dans le registre des modèles. La raison de cette séparation est d'empêcher les utilisateurs capables de créer et de former des modèles d'approuver et de publier leurs propres modèles dans des environnements escaladés.

Des profils utilisateur Studio distincts sont créés pour les développeurs et les approbateurs de modèles. La solution utilise une combinaison de déclarations de stratégie IAM et de balises de profil utilisateur SageMaker afin que les utilisateurs soient uniquement autorisés à ouvrir un profil utilisateur correspondant à leur type d'utilisateur. Cela garantit que l'utilisateur se voit attribuer le rôle IAM d'exécution SageMaker correct (et donc les autorisations) lorsqu'il ouvre l'IDE Studio.

Déploiements en libre-service avec AWS Service Catalog

Les utilisateurs finaux utilisent AWS Service Catalog pour déployer des produits d'infrastructure de science des données, tels que les suivants :

- Un environnement Studio

- Profils d'utilisateurs Studio

- Modèler des pipelines de déploiement

- Pipelines de formation

- Pipelines d'inférence

- Un système de surveillance et d’alerte

Les utilisateurs finaux déploient ces produits directement via l'interface utilisateur d'AWS Service Catalog, ce qui signifie qu'ils dépendent moins des équipes de plateforme centrales pour provisionner les environnements. Cela a considérablement réduit le temps nécessaire aux utilisateurs pour accéder aux nouveaux environnements cloud, de plusieurs jours à quelques heures seulement, ce qui a finalement conduit à une amélioration significative du délai de rentabilisation. L'utilisation d'un ensemble commun de produits AWS Service Catalog favorise la cohérence au sein des projets dans toute l'entreprise et réduit les obstacles à la collaboration et à la réutilisation.

Étant donné que toute l’infrastructure de science des données est désormais déployée via un catalogue de produits d’infrastructure développé de manière centralisée, des précautions ont été prises pour créer chacun de ces produits en gardant à l’esprit la sécurité. Les services ont été configurés pour communiquer au sein Cloud privé virtuel Amazon (Amazon VPC) afin que le trafic ne traverse pas l'Internet public. Les données sont chiffrées en transit et au repos à l'aide Service de gestion des clés AWS (AWS KMS). Les rôles IAM ont également été mis en place pour suivre le principe du moindre privilège.

Enfin, avec AWS Service Catalog, il est facile pour l'équipe de plateforme de publier continuellement de nouveaux produits et services à mesure qu'ils deviennent disponibles ou requis par les équipes d'applications métier. Ceux-ci peuvent prendre la forme de nouveaux produits d'infrastructure, offrant par exemple la possibilité aux utilisateurs finaux de déployer leurs propres produits. Amazon DME clusters ou mises à jour des produits d’infrastructure existants. Étant donné qu'AWS Service Catalog prend en charge la gestion des versions des produits et utilise AWS CloudFormation En coulisses, des mises à niveau sur place peuvent être utilisées lorsque de nouvelles versions de produits existants sont publiées. Cela permet aux équipes de la plateforme de se concentrer sur la création et l’amélioration des produits, plutôt que sur le développement de processus de mise à niveau complexes.

Intégration avec le logiciel IaC existant de NatWest

AWS Service Catalog est utilisé pour les déploiements d'infrastructures de science des données en libre-service. De plus, l'outil d'infrastructure en tant que code (IaC) standard de NatWest, Terraform, est utilisé pour créer une infrastructure dans les comptes AWS. Terraform est utilisé par les équipes de plateforme lors du processus initial de configuration du compte pour déployer des ressources d'infrastructure prérequises telles que des VPC, des groupes de sécurité, Gestionnaire de systèmes AWS paramètres, clés KMS et contrôles de sécurité standard. L'infrastructure du compte hub, telle que les portefeuilles AWS Service Catalog et les ressources utilisées pour créer des images Docker, sont également définies à l'aide de Terraform. Cependant, les produits AWS Service Catalog eux-mêmes sont créés à l'aide de modèles CloudFormation standard.

Améliorer la productivité des développeurs et la qualité du code avec les projets SageMaker

Projets SageMaker fournissez aux développeurs et aux data scientists un accès à des projets à démarrage rapide sans quitter SageMaker Studio. Ces projets à démarrage rapide vous permettent de déployer plusieurs ressources d'infrastructure en même temps en quelques clics seulement. Ceux-ci incluent un référentiel Git contenant un modèle de projet standardisé pour le type de modèle sélectionné, Service de stockage simple Amazon (Amazon S3) pour le stockage des données, des modèles et des artefacts sérialisés, ainsi que des pipelines CodePipeline de formation et d'inférence de modèles.

L'introduction d'architectures et d'outils de base de code standardisés permet désormais aux scientifiques et aux ingénieurs de passer facilement d'un projet à l'autre et garantit que la qualité du code reste élevée. Par exemple, les meilleures pratiques d'ingénierie logicielle telles que les contrôles de peluchage et de formatage (exécutés à la fois sous forme de contrôles automatisés et de hooks de pré-validation), les tests unitaires et les rapports de couverture sont désormais automatisés dans le cadre des pipelines de formation, offrant ainsi une standardisation dans tous les projets. Cela a amélioré la maintenabilité des projets ML et facilitera la mise en production de ces projets.

Automatisation des déploiements de modèles

Le processus de formation du modèle est orchestré à l'aide de SageMaker Pipelines. Une fois les modèles formés, ils sont stockés dans le registre de modèles SageMaker. Les utilisateurs affectés au rôle d'approbateur de modèle peuvent ouvrir le registre des modèles et rechercher des informations relatives au processus de formation, telles que la date à laquelle le modèle a été formé, les valeurs des hyperparamètres et les métriques d'évaluation. Ces informations aident l'utilisateur à décider d'approuver ou de rejeter un modèle. Le rejet d'un modèle empêche le déploiement du modèle dans un environnement intensifié, tandis que l'approbation d'un modèle déclenche un pipeline de promotion de modèle via CodePipeline qui copie automatiquement le modèle sur le compte AWS de pré-production, prêt pour les tests de charge de travail d'inférence. Une fois que l'équipe a confirmé que le modèle fonctionne correctement en pré-production, une étape manuelle dans le même pipeline est approuvée et le modèle est automatiquement copié sur le compte de production, prêt pour les charges de travail d'inférence de production.

Résultats

L'un des principaux objectifs de ce projet collaboratif entre NatWest et AWS était de réduire le temps nécessaire pour provisionner et déployer des environnements cloud de science des données et des modèles ML en production. Cet objectif a été atteint : NatWest peut désormais fournir de nouveaux environnements AWS évolutifs et sécurisés en quelques heures, au lieu de quelques jours, voire semaines. Les data scientists et les ingénieurs sont désormais habilités à déployer et à gérer eux-mêmes l'infrastructure de science des données à l'aide d'AWS Service Catalog, réduisant ainsi le recours aux équipes de plateforme centralisées. De plus, l'utilisation de projets SageMaker permet aux utilisateurs de commencer à coder et à former des modèles en quelques minutes, tout en fournissant également des structures et des outils de projet standardisés.

Étant donné qu'AWS Service Catalog constitue la méthode centrale pour déployer l'infrastructure de science des données, la plateforme peut facilement être étendue et mise à niveau à l'avenir. De nouveaux services AWS peuvent être proposés rapidement aux utilisateurs finaux lorsque le besoin s'en fait sentir, et les produits AWS Service Catalog existants peuvent être mis à niveau pour profiter de nouvelles fonctionnalités.

Enfin, l'évolution vers des services gérés sur AWS signifie que les ressources de calcul sont provisionnées et arrêtées à la demande. Cela a permis des économies de coûts et de la flexibilité, tout en s'alignant également sur L'ambition de NatWest d'être zéro net d'ici 2050 grâce à une réduction estimée de 75 % du CO2 .

Conclusion

L'adoption d'une stratégie axée sur le cloud au sein de NatWest Group a conduit à la création d'une solution AWS robuste capable de prendre en charge un grand nombre d'équipes d'applications métier dans toute l'organisation. La gestion de l'infrastructure avec AWS Service Catalog a considérablement amélioré le processus d'intégration dans le cloud en utilisant des éléments d'infrastructure sécurisés, conformes et pré-approuvés qui peuvent être facilement étendus. Les composants d'infrastructure gérés de SageMaker ont amélioré le processus de développement de modèles et accéléré la livraison de projets ML.

Pour en savoir plus sur le processus de création de modèles ML prêts pour la production au sein de NatWest Group, jetez un œil au reste de cette série en quatre parties sur la collaboration stratégique entre NatWest Group et AWS Professional Services :

- Partie 1 explique comment NatWest Group s'est associé à AWS Professional Services pour créer une plate-forme MLOps évolutive, sécurisée et durable

- Partie 3 fournit un aperçu de la façon dont NatWest Group utilise les services SageMaker pour créer des modèles ML auditables, reproductibles et explicables

- Partie 4 détaille comment les équipes de science des données de NatWest migrent leurs modèles existants vers les architectures SageMaker

À propos des auteurs

Junaïd Baba est consultant DevOps chez Services professionnels AWS Il met à profit son expérience dans Kubernetes, l'informatique distribuée et l'IA/MLOps pour accélérer l'adoption du cloud par les clients du secteur des services financiers au Royaume-Uni. Junaid travaille chez AWS depuis juin 2018. Avant cela, Junaid a travaillé avec un certain nombre de start-ups financières qui pilotent les pratiques DevOps. En dehors de son travail, il s'intéresse au trekking, à l'art moderne et à la photographie.

Junaïd Baba est consultant DevOps chez Services professionnels AWS Il met à profit son expérience dans Kubernetes, l'informatique distribuée et l'IA/MLOps pour accélérer l'adoption du cloud par les clients du secteur des services financiers au Royaume-Uni. Junaid travaille chez AWS depuis juin 2018. Avant cela, Junaid a travaillé avec un certain nombre de start-ups financières qui pilotent les pratiques DevOps. En dehors de son travail, il s'intéresse au trekking, à l'art moderne et à la photographie.

Yordanka Ivanova est ingénieur de données chez NatWest Group. Elle possède de l'expérience dans la création et la fourniture de solutions de données pour les entreprises du secteur des services financiers. Avant de rejoindre NatWest, Yordanka a travaillé comme consultante technique où elle a acquis de l'expérience dans l'exploitation d'une grande variété de services cloud et de technologies open source pour obtenir des résultats commerciaux sur plusieurs plates-formes cloud. Dans ses temps libres, Yordanka aime s'entraîner, voyager et jouer de la guitare.

Yordanka Ivanova est ingénieur de données chez NatWest Group. Elle possède de l'expérience dans la création et la fourniture de solutions de données pour les entreprises du secteur des services financiers. Avant de rejoindre NatWest, Yordanka a travaillé comme consultante technique où elle a acquis de l'expérience dans l'exploitation d'une grande variété de services cloud et de technologies open source pour obtenir des résultats commerciaux sur plusieurs plates-formes cloud. Dans ses temps libres, Yordanka aime s'entraîner, voyager et jouer de la guitare.

Michel Angleterre est ingénieur logiciel au sein de l'équipe Data Science et Innovation du NatWest Group. Il est passionné par le développement de solutions permettant d'exécuter des charges de travail d'apprentissage automatique à grande échelle dans le cloud. Avant de rejoindre NatWest Group, Michael a travaillé et dirigé des équipes d'ingénierie logicielle développant des applications critiques dans les secteurs des services financiers et du voyage. Dans ses temps libres, il aime jouer de la guitare, voyager et explorer la campagne à vélo.

Michel Angleterre est ingénieur logiciel au sein de l'équipe Data Science et Innovation du NatWest Group. Il est passionné par le développement de solutions permettant d'exécuter des charges de travail d'apprentissage automatique à grande échelle dans le cloud. Avant de rejoindre NatWest Group, Michael a travaillé et dirigé des équipes d'ingénierie logicielle développant des applications critiques dans les secteurs des services financiers et du voyage. Dans ses temps libres, il aime jouer de la guitare, voyager et explorer la campagne à vélo.

- Coinsmart. Le meilleur échange Bitcoin et Crypto d'Europe.

- Platoblockchain. Intelligence métaverse Web3. Connaissance amplifiée. ACCÈS LIBRE.

- CryptoHawk. Radar Altcoins. Essai gratuit.

- Source : https://aws.amazon.com/blogs/machine-learning/part-2-how-natwest-group-built-a-secure-compliant-self-service-mlops-platform-using-aws-service- catalogue-et-amazon-sagemaker/

- "

- 100

- À propos

- accéléré

- accélérer

- accès

- Compte

- à travers

- ajout

- Supplémentaire

- Adoption

- Avantage

- Tous

- Amazon

- parmi

- montant

- quantités

- selon une analyse de l’Université de Princeton

- analytique

- Candidature

- applications

- une approche

- approuver

- architecture

- L'art

- attribué

- audit

- Authentification

- Automatisation

- Automation

- Automatisation et normalisation

- disponibles

- AWS

- Banque

- devenez

- Dans les coulisses

- va

- profiter

- qui ne s'occupent pas de leur chez-soi.

- LES MEILLEURS

- les meilleures pratiques

- construire

- Développement

- la performance des entreprises

- carbone

- les soins

- centralisée

- challenge

- globaux

- Contrôles

- le cloud

- cloud Platform

- services de cloud computing

- code

- Codage

- collaboration

- combinaison

- Commun

- Sociétés

- Société

- par rapport

- complexe

- conformité

- composant

- calcul

- informatique

- configuration

- Connexions

- consultant

- Contenant

- Conteneurs

- contient

- contenu

- continuellement

- des bactéries

- créée

- La création

- création

- critique

- Customiser

- Clients

- données

- l'analyse des données

- science des données

- Data Scientist

- livré

- livrer

- page de livraison.

- Demande

- demandes

- déployer

- déployé

- déployer

- déploiement

- déploiements

- décrit

- Avec nos Bagues Halo

- détail

- détails

- développé

- Développeur

- mobiles

- développement

- Développement

- différent

- difficile

- numérique

- directement

- distribué

- informatique distribuée

- Docker

- Ne fait pas

- down

- conduite

- même

- efficace

- efforts

- Élaborer

- permettre

- Endpoint

- ingénieur

- ENGINEERING

- Les ingénieurs

- Entreprise

- Environment

- estimé

- évaluation

- évolue

- exemple

- exécution

- existant

- Découvrez

- Fonctionnalité

- Fonctionnalités:

- Réactions

- la traduction de documents financiers

- services financiers

- Prénom

- Fixer

- Flexibilité

- Focus

- suivre

- Abonnement

- numérique

- formulaire

- Framework

- avenir

- Git

- gouvernance

- Réservation de groupe

- Groupes

- Guides

- heureux vous

- aider

- aide

- Haute

- Comment

- HTTPS

- Active

- la mise en oeuvre

- amélioré

- comprendre

- inclus

- inclut

- increased

- secteurs

- industrie

- d'information

- Infrastructure

- Innovation

- technologie innovante

- Institution

- intégrer

- des services

- intérêts

- Interfaces

- Internet

- impliqué

- vous aider à faire face aux problèmes qui vous perturbent

- IT

- Emplois

- clés / KEY :

- clés

- spécialisées

- gros

- Nouveautés

- conduire

- APPRENTISSAGE

- apprentissage

- LED

- les leviers

- en tirant parti

- Bibliothèque

- limité

- Gamme

- lien

- locales

- click

- machine learning

- LES PLANTES

- majeur

- FAIT DU

- gérer

- gérés

- gestion

- les gérer

- manière

- Manuel

- Matière

- maturité

- sens

- Membres

- Métrique

- million

- l'esprit

- ML

- modèle

- numériques jumeaux (digital twin models)

- Stack monitoring

- mois

- PLUS

- Bougez

- en mouvement

- plusieurs

- noms

- de mise en réseau

- Nouvelles fonctionnalités

- Nouvelle plateforme

- nouveau produit

- produits nouveaux

- nombre

- présenté

- direct

- Onboarding

- en ligne

- ouvert

- Opérations

- Optimiser

- organisation

- Autre

- global

- propre

- particulier

- en partenariat

- passionné

- Patron de Couture

- performant

- photographie

- pilote

- plateforme

- Plateformes

- jouer

- politiques

- politique

- portefeuille

- portefeuilles

- principe

- Privé

- Clés privées

- processus

- les process

- Produit

- Vidéo

- productivité

- Produits

- professionels

- Profil

- Profils

- Projet

- projets

- promotion

- fournir

- fournit

- aportando

- public

- qualité

- Rapide

- vite.

- en cours

- réduire

- réduire

- régulateurs

- relation amoureuse

- libérer

- libéré

- de Presse

- dépendance

- Rapports

- dépôt

- exigent

- conditions

- Exigences

- ressource

- Ressources

- REST

- Résultats

- Avis

- Itinéraire

- Courir

- pour le running

- Évolutivité

- évolutive

- Escaliers intérieurs

- Scènes

- Sciences

- Scientifique

- scientifiques

- Sdk

- sécurisé

- sécurité

- choisi

- Série

- service

- Services

- set

- installation

- Partager

- commun

- significative

- De même

- étapes

- So

- Logiciels

- Software Engineer

- génie logiciel

- sur mesure

- Solutions

- passer

- Stabilité

- empiler

- Standard

- start-ups

- j'ai commencé

- Région

- déclarations

- Statut

- storage

- Stratégique

- de Marketing

- studio

- Support

- Les soutiens

- durable

- combustion propre

- Système

- tâches

- équipe

- Technique

- Les technologies

- Technologie

- modèles

- tester

- Essais

- tests

- Le joint

- thème

- donc

- Avec

- fiable

- outil

- vers

- Tracking

- circulation

- Formation

- Transformer

- De La Carrosserie

- transit

- Voyage

- Voyages

- La confiance

- ui

- Uk

- Actualités

- utilisé

- utilisateurs

- utiliser

- Utilisant

- variété

- Voir

- Salle de conférence virtuelle

- définition

- Basé sur le Web

- que

- tout en

- WHO

- dans les

- sans

- Activités:

- travaillé

- de travail

- s'entraîner

- vos contrats

- world