Dans cette série en deux parties, nous montrons comment étiqueter et former des modèles pour des tâches de détection d'objets 3D. Dans la partie 1, nous discutons de l'ensemble de données que nous utilisons, ainsi que de toutes les étapes de prétraitement, pour comprendre et étiqueter les données. Dans la partie 2, nous expliquons comment former un modèle sur votre jeu de données et le déployer en production.

LiDAR (détection et télémétrie de la lumière) est une méthode permettant de déterminer les distances en ciblant un objet ou une surface avec un laser et en mesurant le temps nécessaire à la lumière réfléchie pour revenir au récepteur. Les entreprises de véhicules autonomes utilisent généralement des capteurs LiDAR pour générer une compréhension 3D de l'environnement autour de leurs véhicules.

Alors que les capteurs LiDAR deviennent plus accessibles et plus rentables, les clients utilisent de plus en plus les données de nuages de points dans de nouveaux espaces comme la robotique, la cartographie des signaux et la réalité augmentée. Certains nouveaux appareils mobiles incluent même des capteurs LiDAR. La disponibilité croissante des capteurs LiDAR a accru l'intérêt pour les données de nuages de points pour les tâches d'apprentissage automatique (ML), telles que la détection et le suivi d'objets 3D, la segmentation 3D, la synthèse et la reconstruction d'objets 3D, et l'utilisation de données 3D pour valider l'estimation de profondeur 2D.

Dans cette série, nous vous montrons comment entraîner un modèle de détection d'objets qui s'exécute sur des données de nuage de points pour prédire l'emplacement des véhicules dans une scène 3D. Dans cet article, nous nous concentrons spécifiquement sur l'étiquetage des données LiDAR. La sortie standard du capteur LiDAR est une séquence d'images de nuages de points 3D, avec un taux de capture typique de 10 images par seconde. Pour étiqueter cette sortie de capteur, vous avez besoin d'un outil d'étiquetage capable de gérer des données 3D. Vérité au sol Amazon SageMaker facilite l'étiquetage d'objets dans une seule image 3D ou sur une séquence d'images de nuages de points 3D pour la création d'ensembles de données d'apprentissage ML. Ground Truth prend également en charge la fusion de capteurs de données de caméra et LiDAR avec jusqu'à huit entrées de caméra vidéo.

Les données sont essentielles à tout projet de ML. Les données 3D en particulier peuvent être difficiles à trouver, à visualiser et à étiqueter. Nous utilisons le Jeu de données A2D2 dans cet article et vous guidera à travers les étapes pour le visualiser et l'étiqueter.

A2D2 contient 40,000 12,499 cadres avec segmentation sémantique et étiquettes de nuage de points, dont 3 12,499 cadres avec étiquettes de boîte englobante 3D. Puisque nous nous concentrons sur la détection d'objets, nous nous intéressons aux 14 XNUMX images avec des étiquettes de boîte englobante XNUMXD. Ces annotations comprennent XNUMX classes pertinentes pour la conduite comme une voiture, un piéton, un camion, un bus, etc.

Le tableau suivant montre la liste complète des classes :

| Sommaire | Liste des classes |

| 1 | animal |

| 2 | vélo |

| 3 | bus |

| 4 | fournisseur |

| 5 | transporteur de caravane |

| 6 | cycliste |

| 7 | véhicule d'urgence |

| 8 | motard |

| 9 | moto |

| 10 | piéton |

| 11 | bande annonce |

| 12 | camion |

| 13 | véhicule utilitaire |

| 14 | camionnette/SUV |

Nous allons entraîner notre détecteur à détecter spécifiquement les voitures, car il s'agit de la classe la plus courante dans notre ensemble de données (32616 42816 des XNUMX XNUMX objets au total dans l'ensemble de données sont étiquetés comme des voitures).

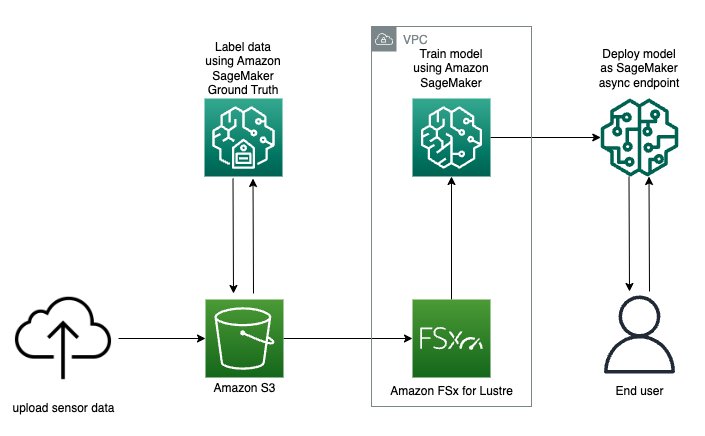

Vue d'ensemble de la solution

Dans cette série, nous expliquons comment visualiser et étiqueter vos données avec Amazon SageMaker Ground Truth et montrons comment utiliser ces données dans une tâche de formation Amazon SageMaker pour créer un modèle de détection d'objet, déployé sur un point de terminaison Amazon SageMaker. En particulier, nous utiliserons un bloc-notes Amazon SageMaker pour faire fonctionner la solution et lancer toute tâche d'étiquetage ou de formation.

Le schéma suivant illustre le flux global de données de capteur, de l'étiquetage à la formation et au déploiement :

Vous apprendrez à entraîner et à déployer un modèle de détection d'objets 3D en temps réel avec Amazon Sage Maker Ground Truth avec les étapes suivantes :

- Télécharger et visualiser un jeu de données de nuage de points

- Préparer les données à étiqueter avec le Outil de nuage de points Amazon SageMaker Ground Truth

- Lancer une tâche de formation distribuée Amazon SageMaker Ground Truth avec MMDétection3D

- Évaluez les résultats de votre travail de formation et dressez le profil de l'utilisation de vos ressources avec Débogueur Amazon SageMaker

- Déployer un asynchrone Point de terminaison SageMaker

- Appeler le point de terminaison et visualiser les prédictions d'objets 3D

Services AWS utilisés pour mettre en œuvre cette solution

Pré-requis

Le schéma suivant montre comment créer une main-d'œuvre privée. Pour obtenir des instructions écrites, étape par étape, consultez Créer une main-d'œuvre Amazon Cognito à l'aide de la page Labellisation des effectifs.

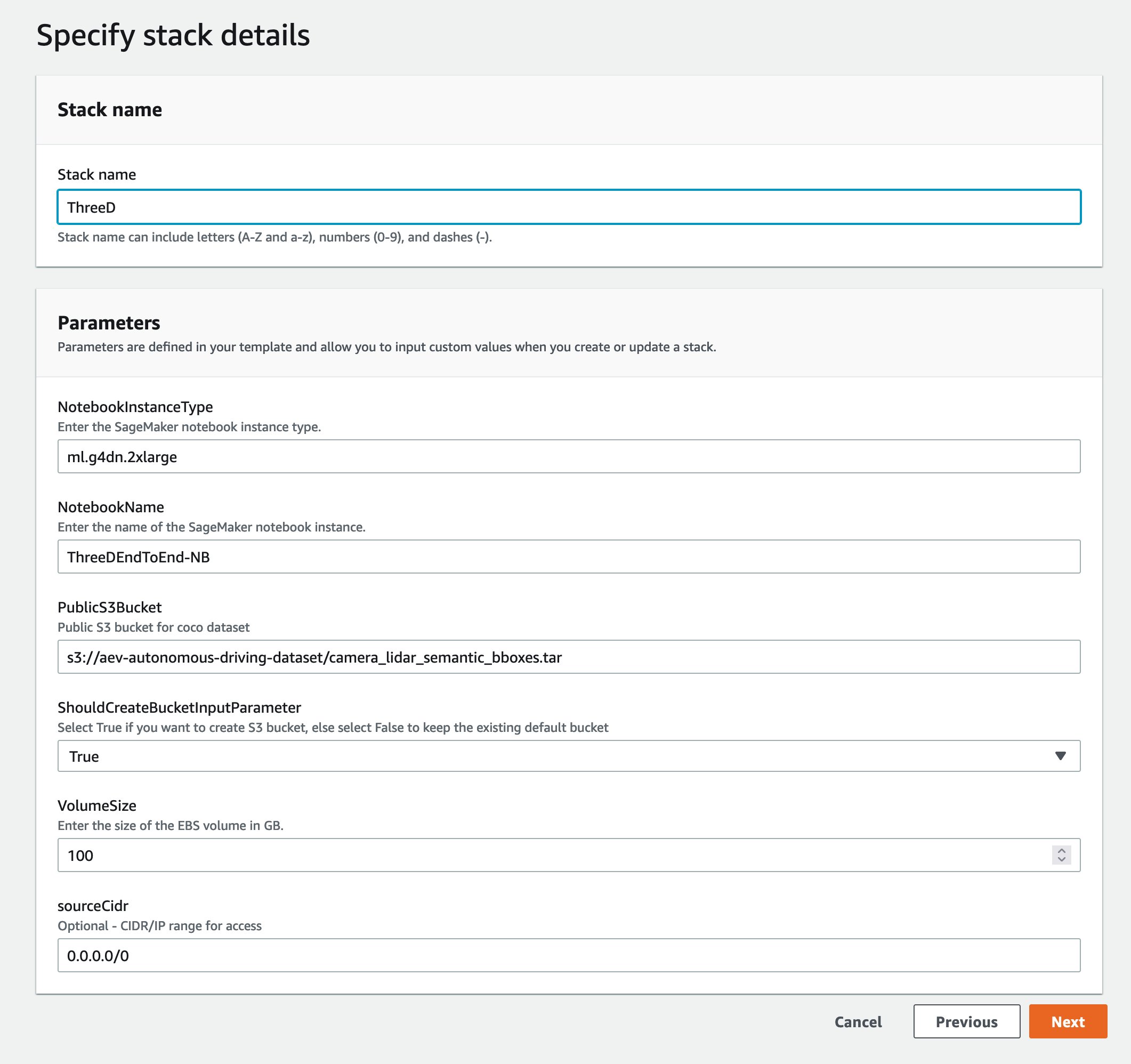

Lancement de la pile AWS CloudFormation

Maintenant que vous avez vu la structure de la solution, vous la déployez dans votre compte afin de pouvoir exécuter un exemple de workflow. Toutes les étapes de déploiement liées au pipeline d'étiquetage sont gérées par AWS CloudFormation. Cela signifie qu'AWS Cloudformation crée votre instance de bloc-notes ainsi que tous les rôles ou compartiments Amazon S3 pour prendre en charge l'exécution de la solution.

Vous pouvez lancer la pile dans la région AWS us-east-1 sur la console AWS CloudFormation à l'aide de Lancer la pile

bouton. Pour lancer la pile dans une autre région, utilisez les instructions trouvées dans le README du GitHub référentiel.

Cela prend environ 20 minutes pour créer toutes les ressources. Vous pouvez surveiller la progression à partir de l'interface utilisateur (UI) AWS CloudFormation.

Une fois l'exécution de votre modèle CloudFormation terminée, revenez à la console AWS.

Ouverture du carnet

Les instances de bloc-notes Amazon SageMaker sont des instances de calcul ML qui s'exécutent sur l'application Jupyter Notebook. Amazon SageMaker gère la création d'instances et de ressources associées. Utilisez des blocs-notes Jupyter dans votre instance de bloc-notes pour préparer et traiter des données, écrire du code pour former des modèles, déployer des modèles sur l'hébergement Amazon SageMaker et tester ou valider vos modèles.

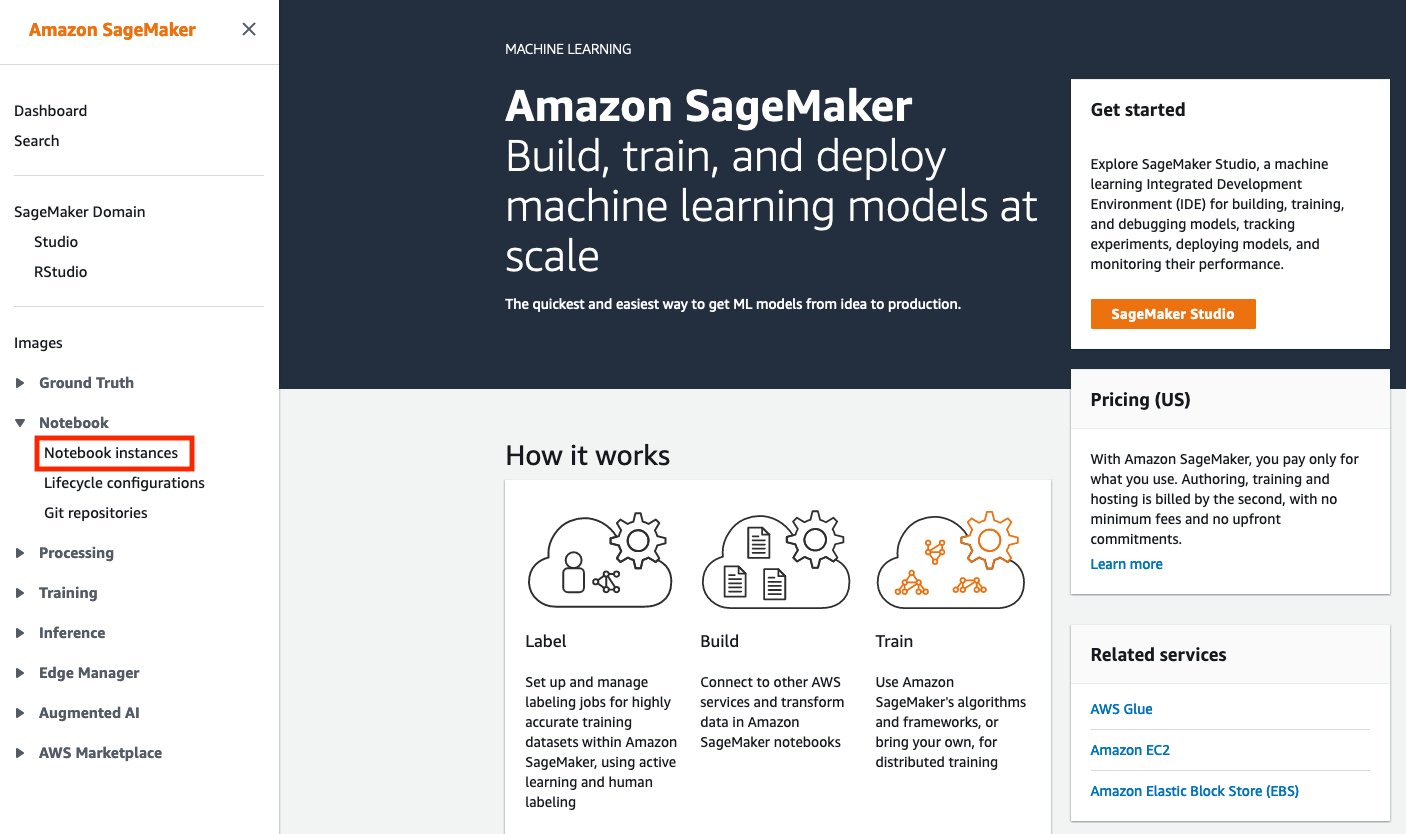

Suivez les étapes suivantes pour accéder à l'environnement Amazon SageMaker Notebook :

- Sous services, recherchez Amazon Sage Maker.

- Sous Cahier

, sélectionnez Instances de bloc-notes.

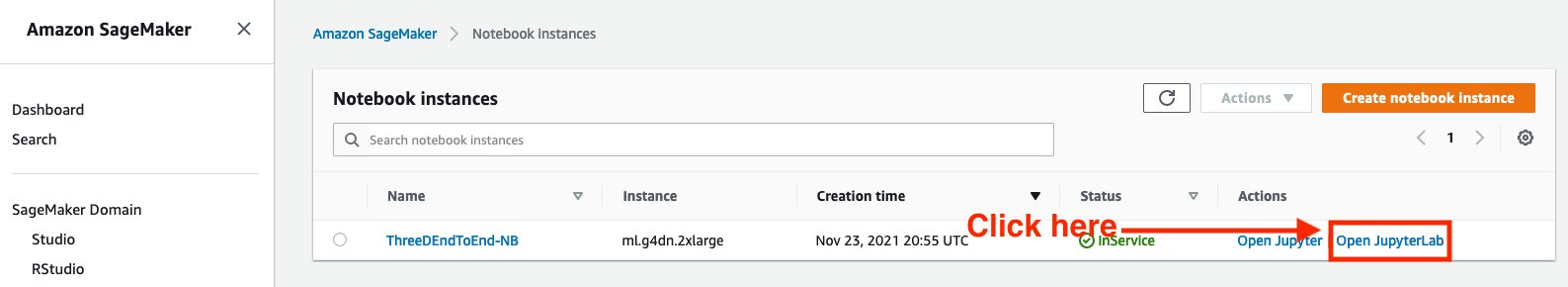

- Une instance Notebook doit être provisionnée. Sélectionnez Ouvrir laboratoire jupyter, qui se trouve sur le côté droit de l'instance Notebook pré-provisionnée sous Actions.

- Vous verrez une icône comme celle-ci lors du chargement de la page :

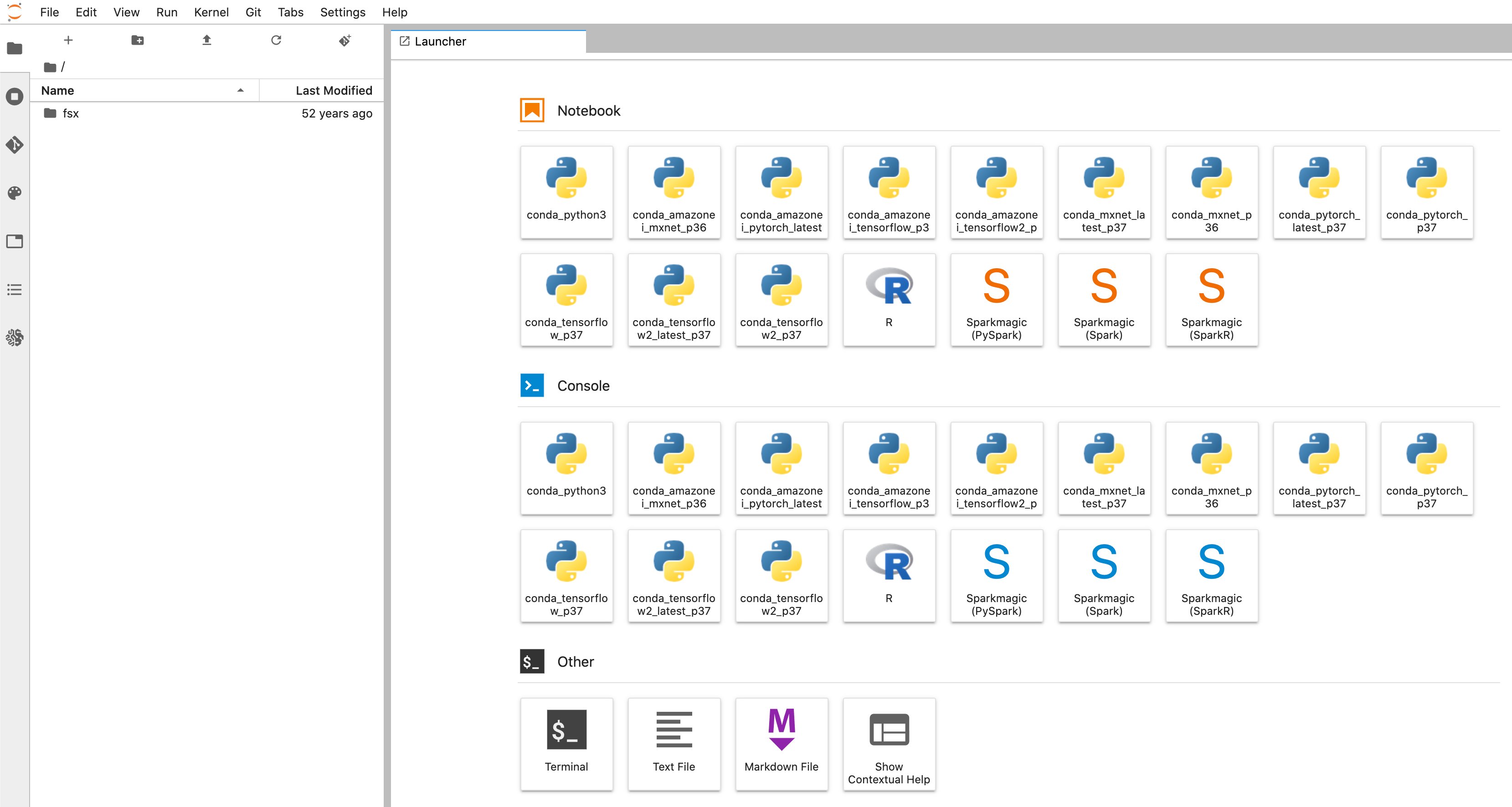

- Vous serez redirigé vers un nouvel onglet de navigateur qui ressemble au schéma suivant :

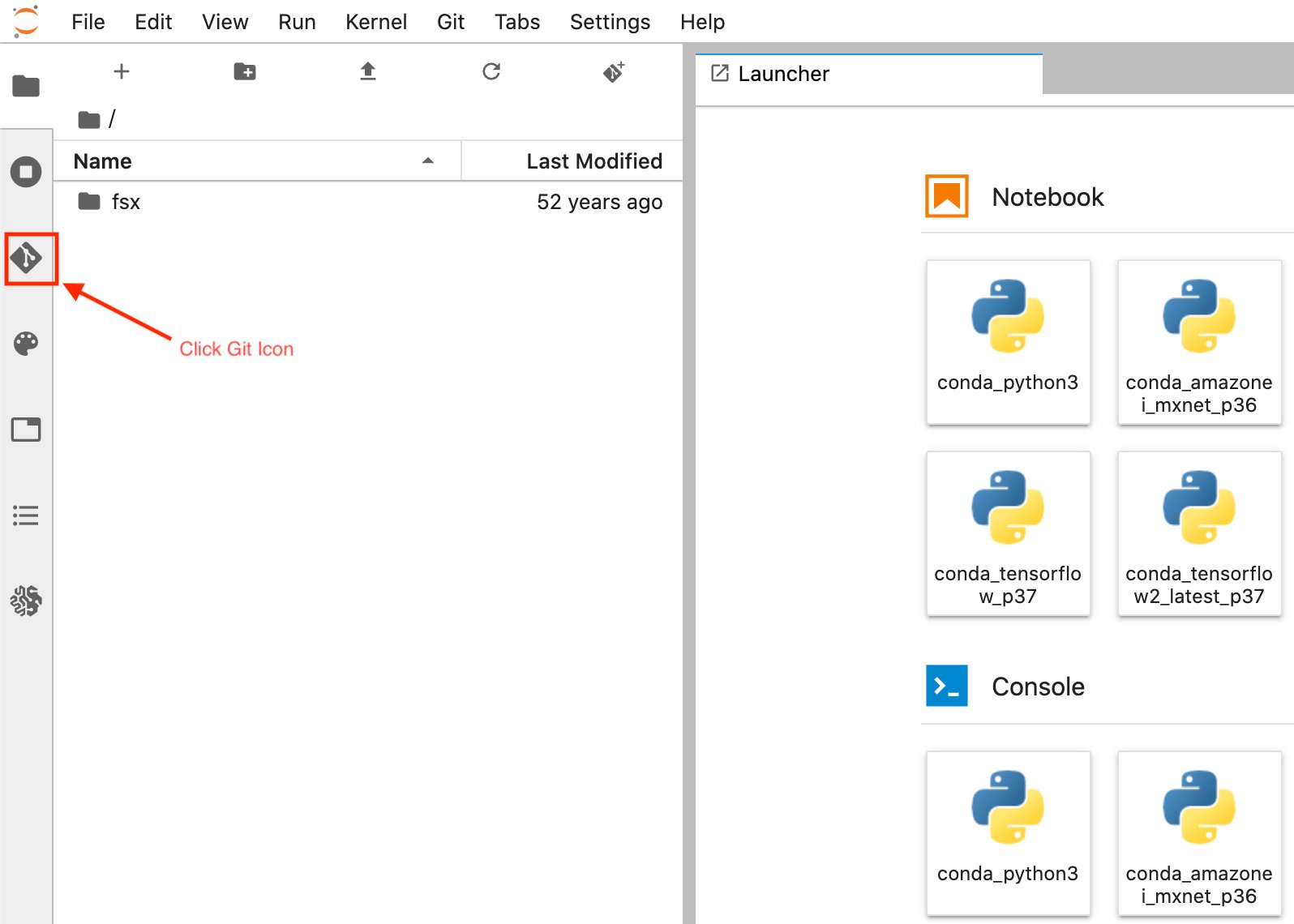

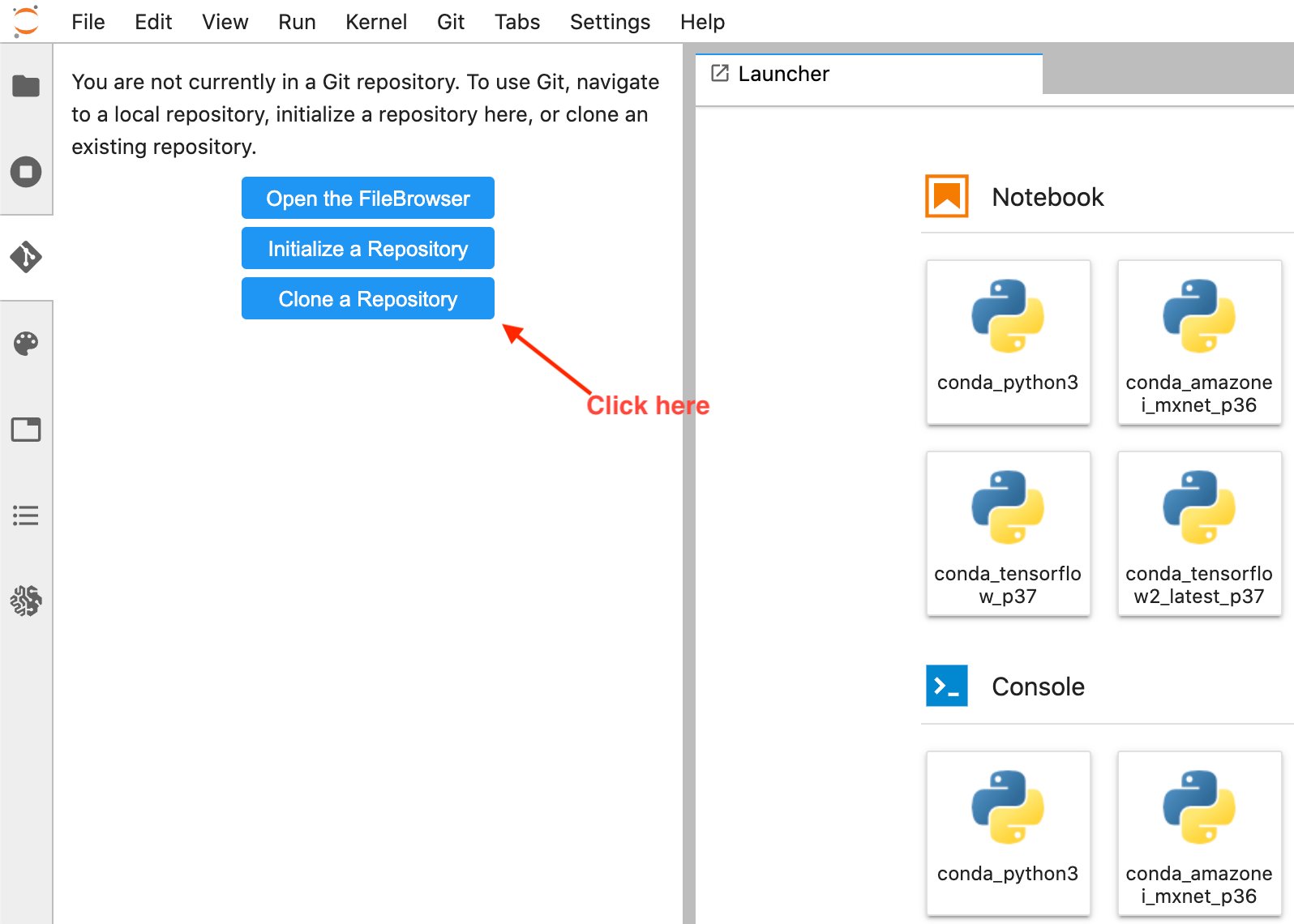

- Une fois que vous êtes dans l'interface utilisateur du lanceur d'instance de bloc-notes Amazon SageMaker. Dans la barre latérale gauche, sélectionnez le Git icône comme indiqué dans le schéma suivant.

- Sélectionnez Cloner un référentiel option.

- Entrez l'URL GitHub(https://github.com/aws-samples/end-2-end-3d-ml) dans la fenêtre contextuelle et choisissez cloner.

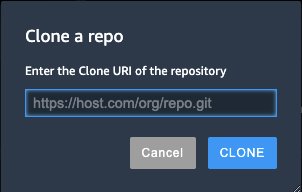

- Sélectionnez Navigateur de fichiers pour voir le dossier GitHub.

- Ouvrez le cahier intitulé

1_visualization.ipynb.

Utilisation de l'ordinateur portable

Vue d’ensemble

Les premières cellules du cahier dans la section intitulée Fichiers téléchargés explique comment télécharger l'ensemble de données et inspecter les fichiers qu'il contient. Une fois les cellules exécutées, le téléchargement des données prend quelques minutes.

Une fois téléchargé, vous pouvez revoir la structure de fichiers d'A2D2, qui est une liste de scènes ou de lecteurs. Une scène est un court enregistrement des données des capteurs de notre véhicule. A2D2 fournit 18 de ces scènes sur lesquelles nous pouvons nous entraîner, qui sont toutes identifiées par des dates uniques. Chaque scène contient des données de caméra 2D, des étiquettes 2D, des annotations cuboïdes 3D et des nuages de points 3D.

Vous pouvez afficher la structure du fichier pour l'ensemble de données A2D2 avec les éléments suivants :

Configuration du capteur A2D2

La section suivante décrit la lecture de certaines de ces données de nuage de points pour s'assurer que nous les interprétons correctement et que nous pouvons les visualiser dans le bloc-notes avant d'essayer de les convertir dans un format prêt pour l'étiquetage des données.

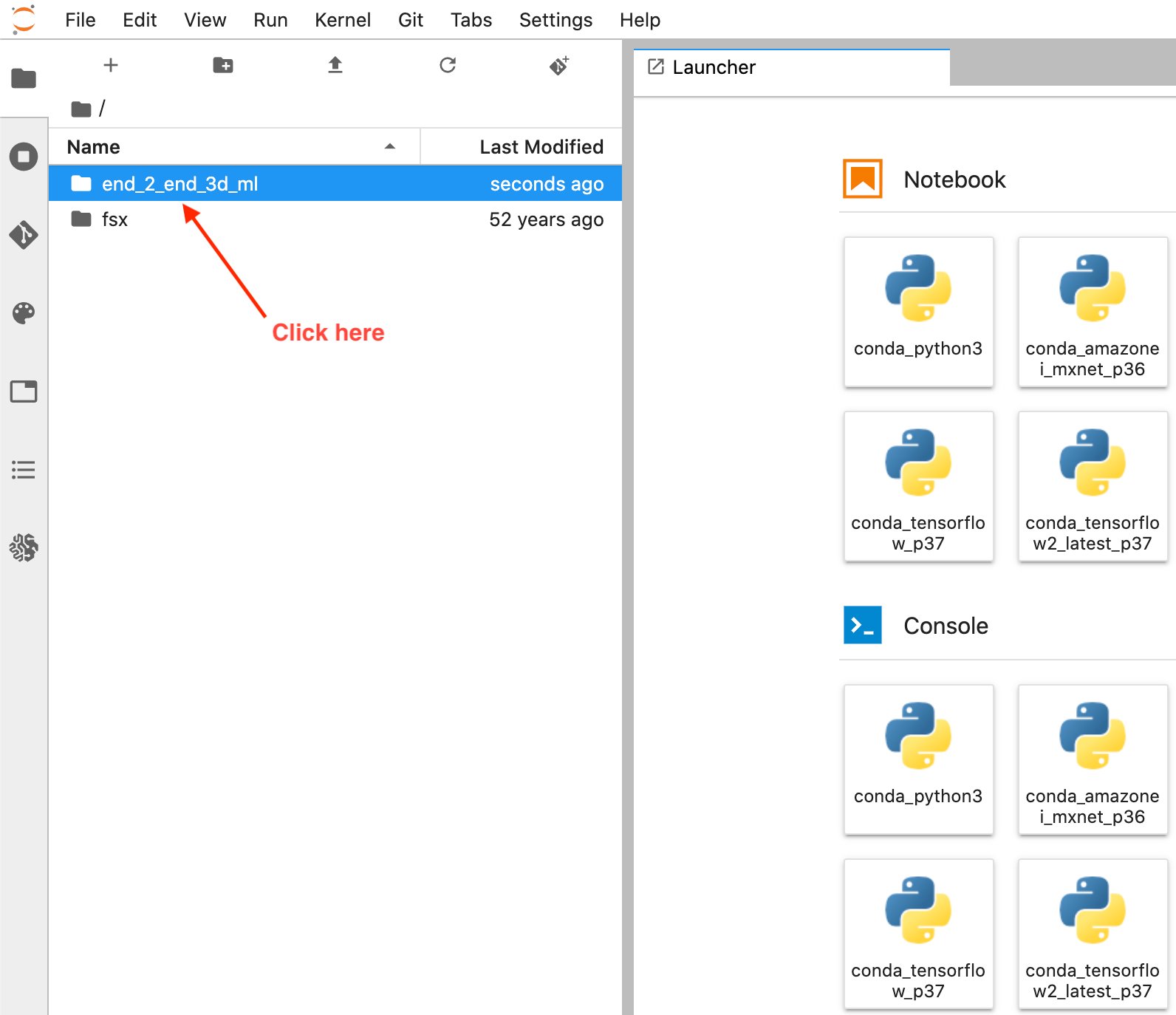

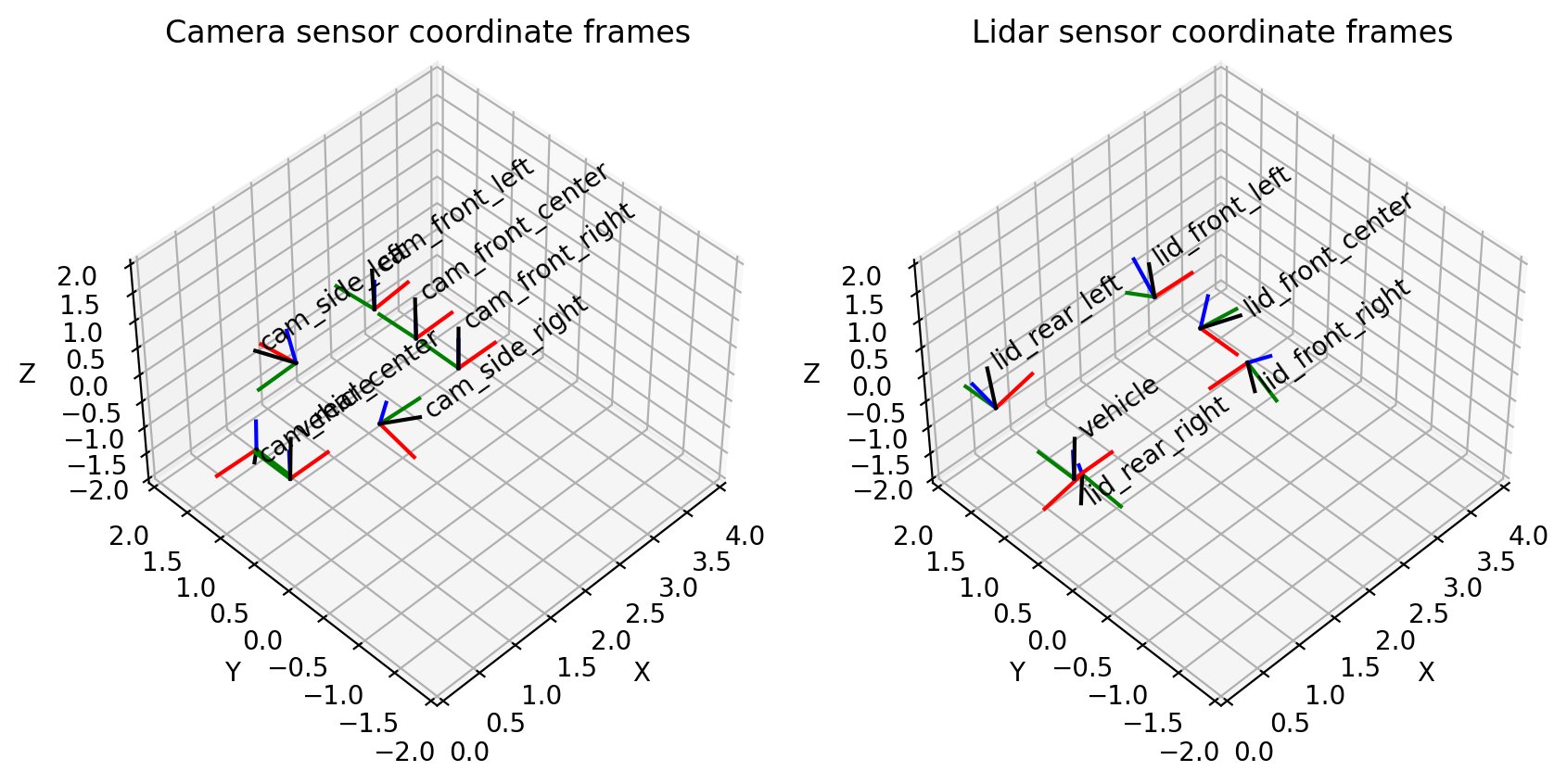

Pour tout type de configuration de conduite autonome où nous disposons de données de capteurs 2D et 3D, la capture des données d'étalonnage des capteurs est essentielle. En plus des données brutes, nous avons également téléchargé cams_lidar.json. Ce fichier contient la translation et l'orientation de chaque capteur par rapport au cadre de coordonnées du véhicule, cela peut également être appelé la pose du capteur ou sa position dans l'espace. Ceci est important pour convertir des points du cadre de coordonnées d'un capteur au cadre de coordonnées du véhicule. En d'autres termes, il est important de visualiser les capteurs 2D et 3D pendant que le véhicule roule. Le cadre de coordonnées du véhicule est défini comme un point statique au centre du véhicule, avec l'axe des x dans la direction du mouvement vers l'avant du véhicule, l'axe des y indiquant la gauche et la droite, la gauche étant positive, et le z- axe pointant vers le toit du véhicule. Un point (X,Y,Z) de (5,2,1) signifie que ce point est à 5 mètres devant notre véhicule, 2 mètres à gauche et 1 mètre au-dessus de notre véhicule. Ces étalonnages nous permettent également de projeter des points 3D sur notre image 2D, ce qui est particulièrement utile pour les tâches d'étiquetage de nuages de points.

Pour voir la configuration du capteur sur le véhicule, consultez le schéma suivant.

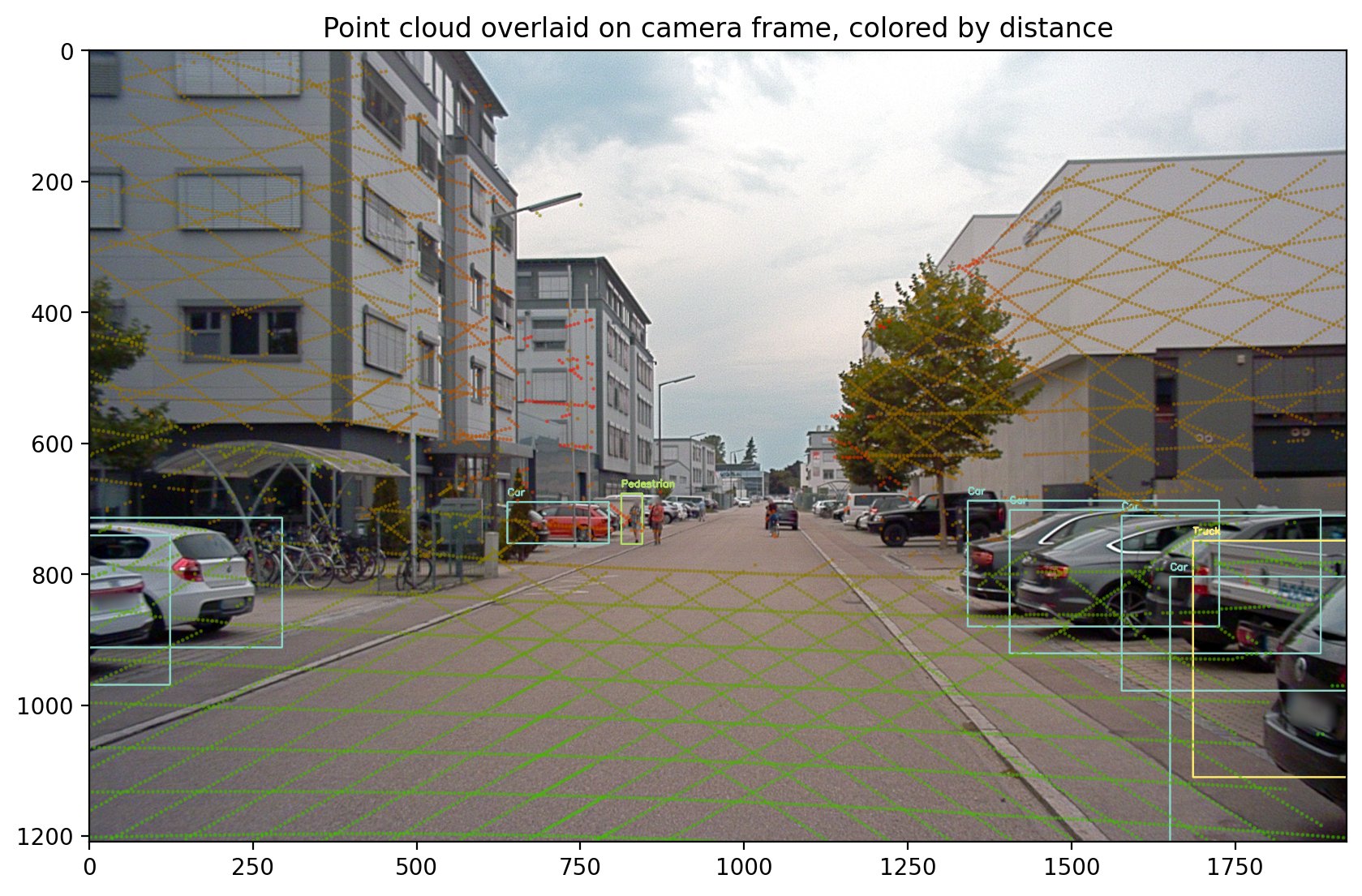

Les données du nuage de points sur lesquelles nous nous entraînons sont spécifiquement alignées avec la caméra frontale ou la caméra frontale :

Cela correspond à notre visualisation des capteurs de caméra en 3D :

Cette partie du bloc-notes permet de valider que l'ensemble de données A2D2 correspond à nos attentes concernant les positions des capteurs et que nous sommes en mesure d'aligner les données des capteurs de nuage de points dans le cadre de la caméra. N'hésitez pas à parcourir toutes les cellules à travers celle intitulée Projection de la 3D à la 2D pour voir la superposition de vos données de nuage de points sur l'image de caméra suivante.

Conversion vers Amazon SageMaker Ground Truth

Après avoir visualisé nos données dans notre carnet, nous pouvons convertir en toute confiance nos nuages de points en Amazon Format 3D de SageMaker Ground Truth pour vérifier et ajuster nos étiquettes. Cette section décrit la conversion du format de données d'A2D2 en Amazon Fichier de séquence SageMaker Ground Truth, avec le format d'entrée utilisé par la modalité de suivi d'objet.

Le format de fichier de séquence comprend les formats de nuage de points, les images associées à chaque nuage de points et toutes les données de position et d'orientation du capteur nécessaires pour aligner les images avec les nuages de points. Ces conversions sont effectuées à l'aide des informations du capteur lues dans la section précédente. L'exemple suivant est un format de fichier de séquence d'Amazon SageMaker Ground Truth, qui décrit une séquence avec un seul pas de temps.

Le nuage de points pour ce pas de temps est situé à s3://sagemaker-us-east-1-322552456788/a2d2_smgt/20180807_145028_out/20180807145028_lidar_frontcenter_000000091.txt et a un format de <x coordinate> <y coordinate> <z coordinate>.

Associée au nuage de points, se trouve une image de caméra unique située à s3://sagemaker-us-east-1-322552456788/a2d2_smgt/20180807_145028_out/undistort_20180807145028_camera_frontcenter_000000091.png. Notez que nous prenons le fichier de séquence qui définit tous les paramètres de la caméra pour permettre la projection du nuage de points vers la caméra et inversement.

La conversion vers ce format d'entrée nous oblige à écrire une conversion du format de données d'A2D2 vers des formats de données pris en charge par Amazon SageMaker Ground Truth. Il s'agit du même processus que toute personne doit suivre lorsqu'elle apporte ses propres données pour l'étiquetage. Nous verrons comment fonctionne cette conversion, étape par étape. Si vous suivez le cahier, regardez la fonction nommée a2d2_scene_to_smgt_sequence_and_seq_label.

Conversion en nuage de points

La première étape consiste à convertir les données d'un fichier compressé au format Numpy (NPZ), qui a été généré avec le numpy.Savez-vous méthode, à une format 3D brut accepté pour Amazon SageMaker Ground Truth. Plus précisément, nous générons un fichier avec une ligne par point. Chaque point 3D est défini par trois coordonnées en virgule flottante X, Y et Z. Lorsque nous spécifions notre format dans le fichier de séquence, nous utilisons la chaîne text/xyz pour représenter ce format. Amazon SageMaker Ground Truth prend également en charge l'ajout de valeurs d'intensité ou de points rouge vert bleu (RVB).

Les fichiers NPZ d'A2D2 contiennent plusieurs tableaux Numpy, chacun avec son propre nom. Pour effectuer une conversion, nous chargeons le fichier NPZ à l'aide de Numpy charge méthode, accédez au tableau appelé des notes bonus (c'est-à-dire un tableau Nx3, où N est le nombre de points dans le nuage de points), et enregistrez-le sous forme de texte dans un nouveau fichier à l'aide de Numpy enregistrertxt méthode.

Prétraitement d'image

Ensuite, nous préparons nos fichiers image. A2D2 fournit des images PNG et Amazon SageMaker Ground Truth prend en charge les images PNG ; cependant, ces images sont déformées. La distorsion se produit souvent parce que l'objectif de prise d'image n'est pas aligné parallèlement au plan d'imagerie, ce qui rend certaines zones de l'image plus proches que prévu. Cette distorsion décrit la différence entre une caméra physique et une modèle de caméra à sténopé idéalisé. Si la distorsion n'est pas prise en compte, alors Amazon SageMaker Ground Truth ne pourra pas restituer nos points 3D au-dessus des vues de la caméra, ce qui rend plus difficile l'étiquetage. Pour un didacticiel sur le calibrage de la caméra, consultez cette documentation à partir de OpenCV.

Alors qu'Amazon SageMaker Ground Truth prend en charge les coefficients de distorsion dans son fichier d'entrée, vous pouvez également effectuer un prétraitement avant la tâche d'étiquetage. Comme A2D2 fournit un code d'assistance pour effectuer la non-distorsion, nous l'appliquons à l'image et laissons les champs liés à la distorsion hors de notre fichier de séquence. Notez que les champs liés à la distorsion incluent k1, k2, k3, k4, p1, p2 et biais.

Conversion de la position, de l'orientation et de la projection de la caméra

Au-delà des fichiers de données brutes nécessaires à l'étiquetage, le fichier de séquence nécessite également des informations sur la position et l'orientation de la caméra pour effectuer la projection de points 3D dans les vues de caméra 2D. Nous devons savoir où la caméra regarde dans l'espace 3D pour comprendre comment les étiquettes cuboïdes 3D et les points 3D doivent être rendus au-dessus de nos images.

Parce que nous avons chargé nos positions de capteur dans un gestionnaire de transformation commun dans la section de configuration du capteur A2D2, nous pouvons facilement interroger le gestionnaire de transformation pour les informations que nous voulons. Dans notre cas, nous traitons la position du véhicule comme (0, 0, 0) dans chaque image car nous n'avons pas d'informations de position du capteur fournies par l'ensemble de données de détection d'objets d'A2D2. Ainsi, par rapport à notre véhicule, l'orientation et la position de la caméra sont décrites par le code suivant :

Maintenant que la position et l'orientation sont converties, nous devons également fournir des valeurs pour fx, fy, cx et cy, tous les paramètres de chaque caméra dans le format de fichier de séquence.

Ces paramètres font référence aux valeurs de la matrice de la caméra. Alors que la position et l'orientation décrivent la direction dans laquelle une caméra est orientée, la matrice de la caméra décrit le champ de vision de la caméra et exactement comment un point 3D par rapport à la caméra est converti en un emplacement de pixel 2D dans une image.

A2D2 fournit une matrice de caméra. Une matrice de caméra de référence est illustrée dans le code suivant, ainsi que la façon dont notre bloc-notes indexe cette matrice pour obtenir les champs appropriés.

Avec tous les champs analysés à partir du format A2D2, nous pouvons enregistrer le fichier de séquence et l'utiliser dans un Amazon Fichier manifeste d'entrée SageMaker Ground Truth pour démarrer une tâche d'étiquetage. Ce travail d'étiquetage nous permet de créer des étiquettes de boîte englobante 3D à utiliser en aval pour la formation de modèles 3D.

Exécutez toutes les cellules jusqu'à la fin du bloc-notes et assurez-vous de remplacer le workteam ARN avec Amazon SageMaker Ground Truth workteam ARN vous avez créé un prérequis. Après environ 10 minutes de temps de création de tâche d'étiquetage, vous devriez pouvoir vous connecter au portail des travailleurs et utiliser le interface utilisateur d'étiquetage pour visualiser votre scène.

Nettoyer

Supprimez la pile AWS CloudFormation que vous avez déployée à l'aide du Lancer la pile bouton nommé ThreeD dans la console AWS CloudFormation pour supprimer toutes les ressources utilisées dans cette publication, y compris toutes les instances en cours d'exécution.

Prix estimés

Le coût approximatif est de 5 $ pour 2 heures.

Conclusion

Dans cet article, nous avons montré comment prendre des données 3D et les convertir en un formulaire prêt à être étiqueté dans Amazon SageMaker Ground Truth. Avec ces étapes, vous pouvez étiqueter vos propres données 3D pour former des modèles de détection d'objets. Dans le prochain article de cette série, nous vous montrerons comment prendre A2D2 et former un modèle de détecteur d'objet sur les étiquettes déjà présentes dans l'ensemble de données.

Bonne Construction !

À propos des auteurs

Isaac Privitéra est Senior Data Scientist à la Laboratoire de solutions Amazon Machine Learning, où il développe des solutions d'apprentissage automatique et d'apprentissage en profondeur sur mesure pour résoudre les problèmes commerciaux des clients. Il travaille principalement dans le domaine de la vision par ordinateur, se concentrant sur l'offre aux clients AWS d'une formation distribuée et d'un apprentissage actif.

Isaac Privitéra est Senior Data Scientist à la Laboratoire de solutions Amazon Machine Learning, où il développe des solutions d'apprentissage automatique et d'apprentissage en profondeur sur mesure pour résoudre les problèmes commerciaux des clients. Il travaille principalement dans le domaine de la vision par ordinateur, se concentrant sur l'offre aux clients AWS d'une formation distribuée et d'un apprentissage actif.

Vidya Sagar Ravipati est directeur au Laboratoire de solutions Amazon Machine Learning, où il met à profit sa vaste expérience des systèmes distribués à grande échelle et sa passion pour l'apprentissage automatique pour aider les clients AWS de différents secteurs verticaux à accélérer leur adoption de l'IA et du cloud. Auparavant, il était ingénieur en apprentissage automatique dans les services de connectivité chez Amazon, qui a aidé à créer des plates-formes de personnalisation et de maintenance prédictive.

Vidya Sagar Ravipati est directeur au Laboratoire de solutions Amazon Machine Learning, où il met à profit sa vaste expérience des systèmes distribués à grande échelle et sa passion pour l'apprentissage automatique pour aider les clients AWS de différents secteurs verticaux à accélérer leur adoption de l'IA et du cloud. Auparavant, il était ingénieur en apprentissage automatique dans les services de connectivité chez Amazon, qui a aidé à créer des plates-formes de personnalisation et de maintenance prédictive.

Jérémy Feltracco est un ingénieur en développement logiciel avec th Laboratoire de solutions Amazon Machine Learning chez Amazon Web Services. Il utilise son expérience en vision par ordinateur, en robotique et en apprentissage automatique pour aider les clients d'AWS à accélérer leur adoption de l'IA.

Jérémy Feltracco est un ingénieur en développement logiciel avec th Laboratoire de solutions Amazon Machine Learning chez Amazon Web Services. Il utilise son expérience en vision par ordinateur, en robotique et en apprentissage automatique pour aider les clients d'AWS à accélérer leur adoption de l'IA.

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- Platoblockchain. Intelligence métaverse Web3. Connaissance Amplifiée. Accéder ici.

- La source: https://aws.amazon.com/blogs/machine-learning/using-amazon-sagemaker-with-point-clouds-part-1-ground-truth-for-3d-labeling/

- :est

- $UP

- 000

- 1

- 10

- 100

- 1996

- 2D

- 3d

- 7

- 9

- a

- Capable

- A Propos

- au dessus de

- accélérer

- accès

- accessible

- Compte

- à travers

- infection

- ajout

- propos

- Adoption

- Après

- devant

- AI

- aligné

- Tous

- permet

- déjà

- Amazon

- Amazon Cognito

- Amazon Sage Maker

- Vérité au sol Amazon SageMaker

- Amazon Web Services

- et les

- chacun.e

- appli

- Appliquer

- approprié

- d'environ

- architecture

- SONT

- domaines

- autour

- tableau

- AS

- associé

- At

- augmentée

- Réalité Augmentée

- autonome

- disponibilité

- AWS

- AWS CloudFormation

- RETOUR

- fond

- BE

- car

- devenez

- before

- va

- ci-dessous

- jusqu'à XNUMX fois

- Bleu

- Box

- Apporter

- navigateur

- construire

- Développement

- bus

- la performance des entreprises

- bouton (dans la fenêtre de contrôle qui apparaît maintenant)

- by

- appelé

- appareil photo

- CAN

- capturer

- Capturer

- fournisseur

- voitures

- maisons

- Cellules

- Canaux centraux

- difficile

- vérifier

- Selectionnez

- classe

- les classes

- plus

- le cloud

- adoption du cloud

- code

- Commun

- Sociétés

- complet

- calcul

- ordinateur

- Vision par ordinateur

- avec confiance

- Connectivité

- Console

- contiennent

- contient

- Conversion

- conversions

- convertir

- converti

- coordonner

- Prix

- rentable

- couverture

- engendrent

- créée

- crée des

- création

- Clients

- CX

- données

- Data Scientist

- ensembles de données

- Dates

- profond

- l'apprentissage en profondeur

- défini

- Définit

- démontrer

- démontré

- démontre

- déployer

- déployé

- déploiement

- profondeur

- décrire

- décrit

- Détection

- détermination

- Développement

- développe

- Compatibles

- différence

- différent

- difficile

- direction

- discuter

- distribué

- systèmes distribués

- formation distribuée

- Documentation

- Ne pas

- download

- conduite

- e

- chacun

- même

- permettant

- Endpoint

- ingénieur

- assurer

- Environment

- notamment

- essential

- etc

- Pourtant, la

- exactement

- exemple

- attentes

- attendu

- d'experience

- few

- champ

- Des champs

- Figure

- Déposez votre dernière attestation

- Fichiers

- finition

- Prénom

- flottant

- flux

- Focus

- mettant l'accent

- Abonnement

- Pour

- formulaire

- le format

- Avant

- trouvé

- CADRE

- gratuitement ici

- De

- avant

- fonction

- la fusion

- FX

- générer

- généré

- obtenez

- gif

- Git

- GitHub

- Go

- Goes

- Vert

- Sol

- Croissance

- manipuler

- Vous avez

- ayant

- Titre

- vous aider

- a aidé

- utile

- hébergement

- HEURES

- Comment

- How To

- Cependant

- HTML

- HTTPS

- i

- ICON

- identifié

- image

- satellite

- Imagerie

- Mettre en oeuvre

- important

- in

- Dans d'autres

- comprendre

- inclut

- Y compris

- increased

- de plus en plus

- index

- industrie

- d'information

- contribution

- instance

- Des instructions

- intérêt

- intéressé

- Interfaces

- IT

- SES

- Emploi

- Emplois

- jpg

- json

- Genre

- Savoir

- Libellé

- l'étiquetage

- Etiquettes

- grande échelle

- laser

- lancer

- APPRENTISSAGE

- apprentissage

- Laisser

- les leviers

- lumière

- comme

- Liste

- charge

- charges

- situé

- emplacement

- Style

- recherchez-

- LOOKS

- click

- machine learning

- facile

- a prendre une

- FAIT DU

- gérés

- manager

- gère

- cartographie

- Matrice

- veux dire

- mesure

- méthode

- Minutes

- ML

- Breeze Mobile

- appareils mobiles

- modèle

- numériques jumeaux (digital twin models)

- Surveiller

- PLUS

- (en fait, presque toutes)

- mouvement

- plusieurs

- prénom

- Nommé

- Besoin

- Nouveauté

- next

- cahier

- nombre

- numpy

- objet

- Détection d'objet

- objets

- of

- on

- ONE

- ouvert

- OpenCV

- fonctionner

- Option

- Autre

- sortie

- global

- propre

- page

- Parallèle

- paramètres

- partie

- particulier

- passion

- chemin

- Effectuer

- Personnalisation

- Physique

- pipeline

- pixel

- Plateformes

- Platon

- Intelligence des données Platon

- PlatonDonnées

- Point

- des notes bonus

- Portail

- position

- positions

- positif

- Post

- prévoir

- Préparer

- précédent

- précédemment

- qui se déroulent

- Privé

- d'ouvrabilité

- processus

- Vidéo

- profilage

- Progrès

- Projet

- Projection

- à condition de

- fournit

- allant

- Tarif

- raw

- Lire

- en cours

- solutions

- en temps réel

- Réalité

- l'enregistrement

- Rouge

- visée

- reflété

- région

- en relation

- pertinent

- restant

- supprimez

- remplacer

- représentent

- conditions

- a besoin

- ressource

- Resources

- Résultats

- retourner

- Avis

- RGB

- robotique

- rôle

- toit

- RANGÉE

- Courir

- pour le running

- s

- sagemaker

- même

- Épargnez

- scène

- Scènes

- Scientifique

- Rechercher

- Deuxièmement

- Section

- segmentation

- supérieur

- capteur

- Séquence

- Série

- Services

- installation

- Shorts

- devrait

- montrer

- montré

- Spectacles

- côté

- Signal

- depuis

- unique

- So

- Logiciels

- développement de logiciels

- sur mesure

- Solutions

- quelques

- Identifier

- Space

- espaces

- spécifiquement

- empiler

- Standard

- Commencer

- étapes

- Étapes

- structure

- la quantité

- Support

- Appareils

- Les soutiens

- Surface

- Système

- table

- Prenez

- prend

- ciblage

- tâches

- modèle

- tester

- qui

- Le

- les informations

- leur

- Ces

- trois

- Avec

- fiable

- titré

- à

- outil

- top

- Total

- Tracking

- Train

- Formation

- Transformer

- Traduction

- traiter

- camion

- tutoriel

- débutante

- typiquement

- ui

- sous

- comprendre

- compréhension

- expérience unique et authentique

- us

- utilisé

- Utilisateur

- Interface utilisateur

- VALIDER

- Valeurs

- Vaste

- véhicule

- Véhicules

- vérifier

- verticales

- Vidéo

- Voir

- vues

- vision

- visualisation

- Façon..

- web

- services Web

- WELL

- qui

- tout en

- WHO

- Wikipédia

- sera

- comprenant

- dans les

- des mots

- travailleur

- Nos inspecteurs

- vos contrats

- écrire

- écrire du code

- code écrit

- X

- yaml

- Vous n'avez

- Votre

- zéphyrnet