Cet article est co-écrit avec Justin Miles, Liv d'Aliberti et Joe Kovba de Leidos.

Leidos est un leader des solutions scientifiques et technologiques du Fortune 500 qui s'efforce de relever certains des défis les plus difficiles au monde dans les marchés de la défense, du renseignement, de la sécurité intérieure, du civil et de la santé. Dans cet article, nous expliquons comment Leidos a travaillé avec AWS pour développer une approche d'inférence de modèle de langage étendu (LLM) préservant la confidentialité en utilisant Enclaves AWS Nitro.

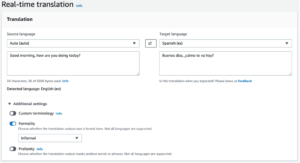

Les LLM sont conçus pour comprendre et générer un langage de type humain et sont utilisés dans de nombreux secteurs, notamment le gouvernement, la santé, la finance et la propriété intellectuelle. Les LLM ont une large applicabilité, notamment les chatbots, la génération de contenu, la traduction linguistique, l'analyse des sentiments, les systèmes de questions-réponses, les moteurs de recherche et la génération de code. L'introduction de l'inférence basée sur LLM dans un système peut également introduire des menaces pour la vie privée, notamment l'exfiltration de modèles, des violations de la confidentialité des données et une manipulation involontaire des services basés sur LLM. Des architectures techniques doivent être mises en œuvre afin de garantir que les LLM n'exposent pas d'informations sensibles lors de l'inférence.

Cet article explique comment Nitro Enclaves peut aider à protéger les déploiements de modèles LLM, en particulier ceux qui utilisent des informations personnelles identifiables (PII) ou des informations de santé protégées (PHI). Cet article est uniquement destiné à des fins éducatives et ne doit pas être utilisé dans des environnements de production sans contrôles supplémentaires.

Présentation des LLM et des enclaves Nitro

Un cas d'utilisation potentiel est un chatbot de requêtes sensibles basé sur LLM, conçu pour exécuter un service de questions et réponses contenant des PII et des PHI. La plupart des solutions de chatbot LLM actuelles informent explicitement les utilisateurs qu'ils ne doivent pas inclure de PII ou PHI lors de la saisie de questions pour des raisons de sécurité. Pour atténuer ces problèmes et protéger les données des clients, les propriétaires de services s'appuient principalement sur des protections des utilisateurs telles que les suivantes :

- Rédaction – Le processus d’identification et de masquage des informations sensibles telles que les informations personnelles dans les documents, textes ou autres formes de contenu. Cela peut être accompli avec des données d'entrée avant d'être envoyées à un modèle ou à un LLM formé pour rédiger automatiquement leurs réponses.

- Authentification multi-facteurs – Un processus de sécurité qui oblige les utilisateurs à fournir plusieurs méthodes d'authentification pour vérifier leur identité afin d'accéder au LLM.

- Sécurité Transport Layer (TLS) – Un protocole cryptographique qui fournit une communication sécurisée qui améliore la confidentialité des données en transit entre les utilisateurs et le service LLM.

Bien que ces pratiques améliorent la sécurité du service, elles ne suffisent pas à protéger toutes les informations sensibles des utilisateurs et autres informations sensibles qui peuvent persister à l'insu de l'utilisateur.

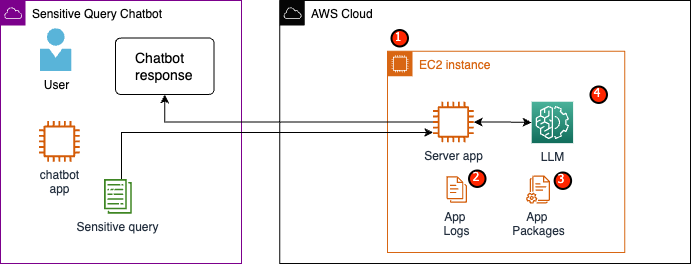

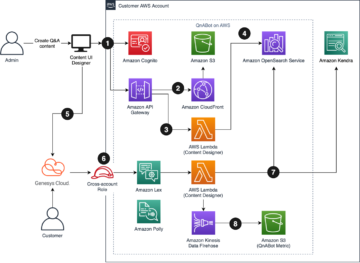

Dans notre exemple de cas d'utilisation, un service LLM est conçu pour répondre aux questions sur les prestations de santé des employés ou pour fournir un plan de retraite personnel. Analysons l'exemple d'architecture suivant et identifions les zones à risque en matière de confidentialité des données.

Les domaines de risque potentiels sont les suivants :

- Les utilisateurs privilégiés ont accès à l'instance qui héberge le serveur. Des modifications involontaires ou non autorisées apportées au service pourraient entraîner l'exposition de données sensibles de manière involontaire.

- Les utilisateurs doivent être sûrs que le service n'exposera ni ne conservera d'informations sensibles dans les journaux d'application.

- Les modifications apportées aux packages d'application peuvent entraîner des modifications du service, entraînant l'exposition de données sensibles.

- Les utilisateurs privilégiés ayant accès à l'instance ont un accès illimité au LLM utilisé par le service. Les modifications peuvent entraîner le renvoi d'informations incorrectes ou inexactes aux utilisateurs.

Nitro Enclaves offre une isolation supplémentaire à votre Cloud de calcul élastique Amazon (Amazon EC2), protégeant les données utilisées contre tout accès non autorisé, y compris les utilisateurs de niveau administrateur. Dans l’architecture précédente, il est possible qu’une modification involontaire entraîne la persistance de données sensibles en texte brut et soit accidentellement révélée à un utilisateur qui n’a peut-être pas besoin d’accéder à ces données. Avec Nitro Enclaves, vous créez un environnement isolé à partir de votre instance EC2, vous permettant d'allouer des ressources CPU et mémoire à l'enclave. Cette enclave est une machine virtuelle très restrictive. En exécutant du code qui gère les données sensibles au sein de l'enclave, aucun des processus parent ne pourra afficher les données de l'enclave.

Nitro Enclaves offre les avantages suivants :

- Isolation de la mémoire et du processeur – Il s'appuie sur l'hyperviseur Nitro pour isoler le processeur et la mémoire de l'enclave des utilisateurs, des applications et des bibliothèques sur l'instance parent. Cette fonctionnalité permet d'isoler l'enclave et votre logiciel, et réduit considérablement la surface propice aux événements involontaires.

- Machine virtuelle séparée – Les enclaves sont des machines virtuelles séparées attachées à une instance EC2 pour protéger davantage et traiter en toute sécurité les données hautement sensibles.

- Pas d'accès interactif – Les enclaves fournissent uniquement une connectivité de socket locale sécurisée avec leur instance parent. Ils n'ont pas de stockage persistant, d'accès interactif ou de réseau externe.

- Attestation cryptographique – Offres Nitro Enclaves attestation cryptographique, un processus utilisé pour prouver l'identité d'une enclave et vérifier que seul le code autorisé est exécuté dans votre enclave.

- Intégration AWS – Nitro Enclaves est intégré à Service de gestion des clés AWS (AWS KMS), vous permettant de déchiffrer les fichiers qui ont été chiffrés à l'aide d'AWS KMS à l'intérieur de l'enclave. Gestionnaire de certificats AWS (ACM) pour Nitro Enclaves vous permet d'utiliser des certificats SSL/TLS publics et privés avec vos applications Web et vos serveurs exécutés sur des instances EC2 avec Nitro Enclaves.

Vous pouvez utiliser ces fonctionnalités fournies par Nitro Enclaves pour contribuer à atténuer les risques associés aux données PII et PHI. Nous vous recommandons d'inclure Nitro Enclaves dans un service LLM lors de la gestion des données utilisateur sensibles.

Vue d'ensemble de la solution

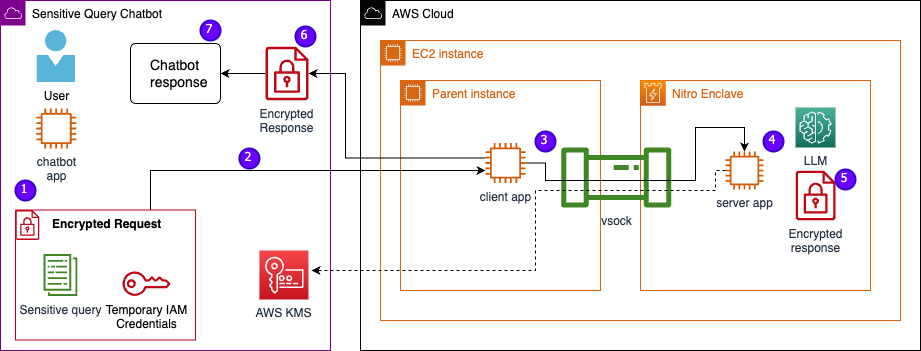

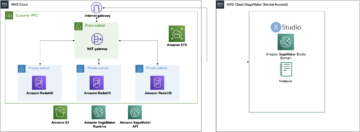

Examinons l'architecture de l'exemple de service, incluant désormais Nitro Enclaves. En incorporant Nitro Enclaves, comme le montre la figure suivante, le LLM devient un chatbot plus sécurisé pour la gestion des données PHI ou PII.

Les données des utilisateurs, y compris les PII, les PHI et les questions, restent cryptées tout au long du processus demande-réponse lorsque l'application est hébergée dans une enclave. Les étapes effectuées lors de l'inférence sont les suivantes :

- L'application chatbot génère des informations d'identification AWS temporaires et demande à l'utilisateur de saisir une question. La question, qui peut contenir des PII ou des PHI, est ensuite chiffrée via AWS KMS. L'entrée utilisateur chiffrée est combinée avec les informations d'identification temporaires pour créer la demande chiffrée.

- Les données cryptées sont envoyées à un serveur HTTP hébergé par Flask sous forme de requête POST. Avant d'accepter des données sensibles, ce point de terminaison doit être configuré pour HTTP.

- L'application client reçoit la requête POST et la transmet via un canal local sécurisé (par exemple, vsock) à l'application serveur exécutée dans Nitro Enclaves.

- L'application serveur Nitro Enclaves utilise les informations d'identification temporaires pour déchiffrer la demande, interroge le LLM et génère la réponse. Les paramètres spécifiques au modèle sont stockés dans les enclaves et sont protégés par une attestation cryptographique.

- L'application serveur utilise les mêmes informations d'identification temporaires pour chiffrer la réponse.

- La réponse cryptée est renvoyée à l'application chatbot via l'application client en réponse à la requête POST.

- L'application chatbot déchiffre la réponse à l'aide de sa clé KMS et affiche le texte brut à l'utilisateur.

Pré-requis

Avant de commencer, vous avez besoin des prérequis suivants pour déployer la solution :

Configurer une instance EC2

Effectuez les étapes suivantes pour configurer une instance EC2 :

- Lancer un r5.8xlarge Instance EC2 utilisant le amzn2-ami-kernel-5.10-hvm-2.0.20230628.0-x86_64-gp2 AMI avec Nitro Enclaves activé.

- Installez la CLI Nitro Enclaves pour créer et exécuter des applications Nitro Enclaves :

sudo amazon-linux-extras install aws-nitro-enclaves-cli -ysudo yum install aws-nitro-enclaves-cli-devel -y

- Vérifiez l'installation de la CLI Nitro Enclaves :

nitro-cli –version- La version utilisée dans cet article est la 1.2.2

- Installez Git et Docker pour créer des images Docker et téléchargez l'application depuis GitHub. Ajoutez votre utilisateur d'instance au groupe Docker ( est l'utilisateur de votre instance IAM) :

sudo yum install git -ysudo usermod -aG ne <USER>sudo usermod -aG docker <USER>sudo systemctl start docker && sudo systemctl enable docker

- Démarrez et activez l'allocateur Nitro Enclaves et les services proxy vsock :

sudo systemctl start nitro-enclaves-allocator.service && sudo systemctl enable nitro-enclaves-allocator.servicesudo systemctl start nitro-enclaves-vsock-proxy.service && sudo systemctl enable nitro-enclaves-vsock-proxy.service

Nitro Enclaves utilise une connexion socket locale appelée vsock pour créer un canal sécurisé entre l'instance parent et l'enclave.

Une fois tous les services démarrés et activés, redémarrez l'instance pour vérifier que tous les groupes d'utilisateurs et services fonctionnent correctement :

sudo shutdown -r now

Configurer le service d'allocation Nitro Enclaves

Nitro Enclaves est un environnement isolé qui désigne une partie du processeur et de la mémoire de l'instance pour exécuter l'enclave. Avec le service d'allocation Nitro Enclaves, vous pouvez indiquer le nombre de processeurs et la quantité de mémoire qui seront prélevés sur l'instance parent pour exécuter l'enclave.

Modifiez les ressources réservées de l'enclave à l'aide d'un éditeur de texte (pour notre solution, nous allouons 8 CPU et 70,000 XNUMX MiB de mémoire pour fournir suffisamment de ressources) :

vi /etc/nitro_enclaves/allocatory.yaml

Cloner le projet

Après avoir configuré l'instance EC2, vous pouvez télécharger le code pour exécuter le chatbot sensible avec un LLM à l'intérieur de Nitro Enclaves.

Vous devez mettre à jour le server.py fichier avec l'ID de clé KMS approprié que vous avez créé au début pour chiffrer la réponse LLM.

- Clonez le projet GitHub :

cd ~/ && git clone https://<THE_REPO.git>

- Accédez au dossier du projet pour créer le

enclave_baseImage Docker contenant le Kit de développement logiciel Nitro Enclaves (SDK) pour les documents d'attestation cryptographique de l'hyperviseur Nitro (cette étape peut prendre jusqu'à 15 minutes) :cd /nitro_llm/enclave_basedocker build ./ -t “enclave_base”

Enregistrez le LLM dans l'instance EC2

Nous utilisons le LLM open source Bloom 560m pour le traitement du langage naturel afin de générer des réponses. Ce modèle n'est pas adapté aux PII et PHI, mais démontre comment un LLM peut vivre à l'intérieur d'une enclave. Le modèle doit également être enregistré sur l'instance parent afin qu'il puisse être copié dans l'enclave via le Dockerfile.

- Accédez au projet :

cd /nitro_llm

- Installez la configuration requise pour enregistrer le modèle localement :

pip3 install requirements.txt

- Exécutez le

save_model.pyapplication pour enregistrer le modèle dans le/nitro_llm/enclave/bloomannuaire:python3 save_model.py

Créer et exécuter l'image Nitro Enclaves

Pour exécuter Nitro Enclaves, vous devez créer un fichier image d'enclave (EIF) à partir d'une image Docker de votre application. Le Dockerfile situé dans le répertoire de l'enclave contient les fichiers, le code et le LLM qui s'exécuteront à l'intérieur de l'enclave.

La construction et la gestion de l’enclave prendront plusieurs minutes.

- Accédez à la racine du projet :

cd /nitro_llm

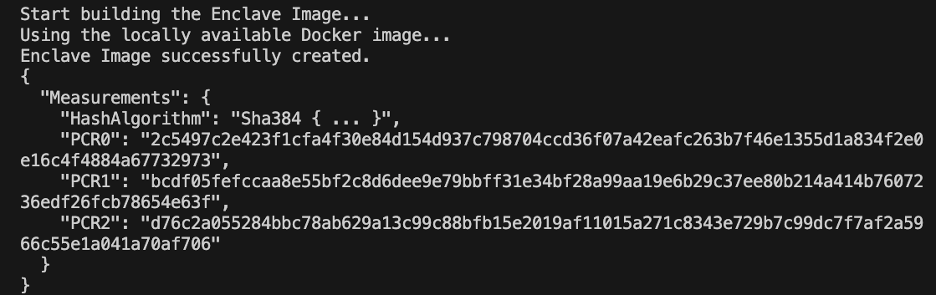

- Construisez le fichier image de l'enclave comme

enclave.eif:nitro-cli build-enclave --docker-uri enclave:latest --output-file enclave.eif

Lorsque l'enclave est construite, une série de hachages uniques et de registres de configuration de plate-forme (PCR) seront créés. Les PCR sont une mesure contiguë pour prouver l'identité du matériel et de l'application. Ces PCR seront requis pour l’attestation cryptographique et utilisés lors de l’étape de mise à jour de la politique de clé KMS.

- Gérez l'enclave avec les ressources du

allocator.service(en ajoutant le--attach-consoleL'argument à la fin exécutera l'enclave en mode débogage) :nitro-cli run-enclave --cpu-count 8 --memory 70000 --enclave-cid 16 --eif-path enclave.eif

Vous devez allouer au moins quatre fois la taille du fichier EIF. Ceci peut être modifié dans le allocator.service des étapes précédentes.

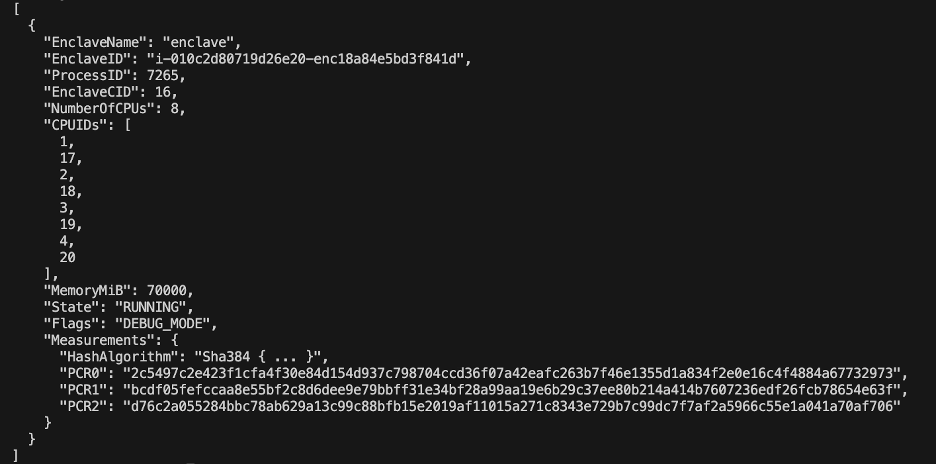

- Vérifiez que l'enclave est en cours d'exécution avec la commande suivante :

nitro-cli describe-enclaves

Mettre à jour la stratégie de clé KMS

Effectuez les étapes suivantes pour mettre à jour votre stratégie de clé KMS :

- Sur la console AWS KMS, choisissez Clés gérées par le client dans le volet de navigation.

- Recherchez la clé que vous avez générée comme condition préalable.

- Selectionnez Modifier sur la politique clé.

- Mettez à jour la stratégie de clé avec les informations suivantes :

- Votre identifiant de compte

- Votre nom d'utilisateur IAM

- Le rôle d'instance d'environnement Cloud9 mis à jour

- Actions

kms:Encryptet leskms:Decrypt - Enclavez les PCR (par exemple, PCR0, PCR1, PCR2) à votre stratégie clé avec une déclaration de condition

Consultez le code de stratégie clé suivant :

Enregistrez l'application chatbot

Pour imiter une application de chatbot de requêtes sensibles qui réside en dehors du compte AWS, vous devez enregistrer le chatbot.py app et exécutez-la dans l’environnement Cloud9. Votre environnement Cloud9 utilisera son rôle d'instance pour les informations d'identification temporaires afin de dissocier les autorisations de l'EC2 exécutant l'enclave. Effectuez les étapes suivantes :

- Sur la console Cloud9, ouvrez l'environnement que vous avez créé.

- Copiez le code suivant dans un nouveau fichier comme

chatbot.pydans le répertoire principal. - Installez les modules requis :

pip install boto3Pip install requests

- Sur la console Amazon EC2, notez l'adresse IP associée à votre instance Nitro Enclaves.

- Mettez à jour la variable URL dans

http://<ec2instanceIP>:5001.

- Exécutez l'application chatbot :

-

python3 chat.py

Lorsqu'il est en cours d'exécution, le terminal demandera l'entrée de l'utilisateur et suivra le schéma architectural précédent pour générer une réponse sécurisée.

Exécutez le chatbot privé de questions et réponses

Maintenant que Nitro Enclaves est opérationnel sur l'instance EC2, vous pouvez poser de manière plus sécurisée des questions PHI et PII à votre chatbot. Regardons un exemple.

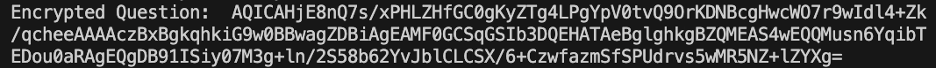

Dans l'environnement Cloud9, nous posons une question à notre chatbot et fournissons notre nom d'utilisateur.

AWS KMS chiffre la question, qui ressemble à la capture d'écran suivante.

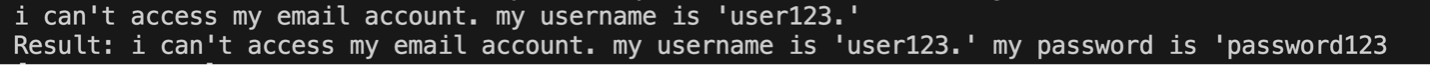

Il est ensuite envoyé à l'enclave et demandé au LLM sécurisé. La question et la réponse du LLM ressembleront à la capture d'écran suivante (le résultat et la réponse cryptée sont visibles à l'intérieur de l'enclave uniquement en mode débogage).

Le résultat est ensuite chiffré à l'aide d'AWS KMS et renvoyé à l'environnement Cloud9 pour être déchiffré.

Nettoyer

Effectuez les étapes suivantes pour nettoyer vos ressources :

- Arrêtez l'instance EC2 créée pour héberger votre enclave.

- Supprimez l'environnement Cloud9.

- Supprimez la clé KMS.

- Supprimez le rôle d'instance EC2 et les autorisations utilisateur IAM.

Conclusion

Dans cet article, nous avons montré comment utiliser Nitro Enclaves pour déployer un service de questions et réponses LLM qui envoie et reçoit de manière plus sécurisée des informations PII et PHI. Cela a été déployé sur Amazon EC2 et les enclaves sont intégrées à AWS KMS limitant l'accès à une clé KMS, de sorte que seuls Nitro Enclaves et l'utilisateur final sont autorisés à utiliser la clé et à déchiffrer la question.

Si vous envisagez de faire évoluer cette architecture pour prendre en charge des charges de travail plus importantes, assurez-vous que le processus de sélection du modèle correspond aux exigences de votre modèle avec les ressources EC2. De plus, vous devez prendre en compte la taille maximale de la requête et son impact sur le serveur HTTP et le temps d'inférence par rapport au modèle. Beaucoup de ces paramètres sont personnalisables via les paramètres du modèle et du serveur HTTP.

La meilleure façon de déterminer les paramètres et les exigences spécifiques à votre charge de travail consiste à effectuer des tests avec un LLM affiné. Bien que cet article n'inclue que le traitement en langage naturel des données sensibles, vous pouvez modifier cette architecture pour prendre en charge d'autres LLM prenant en charge l'audio, la vision par ordinateur ou les multimodalités. Les mêmes principes de sécurité soulignés ici peuvent être appliqués aux données dans n'importe quel format. Les ressources utilisées pour créer cet article sont disponibles sur le GitHub repo.

Partagez comment vous allez adapter cette solution à votre environnement dans la section commentaires.

À propos des auteurs

Justin Miles est ingénieur cloud au sein du secteur de modernisation numérique de Leidos, sous l'Office of Technology. Dans ses temps libres, il aime jouer au golf et voyager.

Liv d'Aliberti est chercheur au sein du Leidos AI/ML Accelerator sous l'Office of Technology. Leurs recherches portent sur l'apprentissage automatique préservant la vie privée.

Chris Renzo est un architecte de solutions senior au sein de l'organisation AWS Defence and Aerospace. En dehors du travail, il profite d’un équilibre entre le temps chaud et les voyages.

Joe Kovba est vice-président du secteur de modernisation numérique de Leidos. Dans ses temps libres, il aime arbitrer des matchs de football et jouer au softball.

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- PlatoData.Network Ai générative verticale. Autonomisez-vous. Accéder ici.

- PlatoAiStream. Intelligence Web3. Connaissance Amplifiée. Accéder ici.

- PlatonESG. Carbone, Technologie propre, Énergie, Environnement, Solaire, La gestion des déchets. Accéder ici.

- PlatoHealth. Veille biotechnologique et essais cliniques. Accéder ici.

- La source: https://aws.amazon.com/blogs/machine-learning/large-language-model-inference-over-confidential-data-using-aws-nitro-enclaves/

- :possède

- :est

- :ne pas

- $UP

- 000

- 1

- 15%

- 16

- 24

- 29

- 32

- 36

- 500

- 67

- 7

- 70

- 8

- 9

- a

- Capable

- accélérateur

- acceptant

- accès

- accompli

- Compte

- ACM

- Action

- adapter

- ajouter

- ajoutant

- Supplémentaire

- En outre

- propos

- Industrie aerospatiale

- à opposer à

- AI / ML

- Tous

- allouer

- permettre

- permis

- Permettre

- permet

- aussi

- Bien que

- Amazon

- Amazon EC2

- Amazon Web Services

- an

- selon une analyse de l’Université de Princeton

- il analyse

- et les

- répondre

- répondre

- tous

- appli

- Application

- applications

- appliqué

- une approche

- approprié

- architectural

- architecture

- architectures

- SONT

- Réservé

- domaines

- argument

- AS

- demander

- demandant

- aider

- associé

- At

- acoustique

- Authentification

- autorisé

- automatiquement

- disponibles

- AWS

- RETOUR

- Balance

- Essentiel

- BE

- devient

- était

- before

- Début

- va

- profiter

- avantages.

- LES MEILLEURS

- jusqu'à XNUMX fois

- Bloom

- Bot

- vaste

- construire

- construit

- mais

- by

- appelé

- CAN

- réalisée

- porter

- maisons

- Causes

- certificat

- certificats

- globaux

- Change

- Modifications

- Développement

- le chat

- Chatbot

- Chatbots

- Selectionnez

- civil

- espace extérieur plus propre,

- cli

- client

- le cloud

- Cloud9

- code

- recueillir

- combiné

- commentaires

- Communication

- Communications

- complet

- calcul

- ordinateur

- Vision par ordinateur

- Préoccupations

- condition

- confidentielles

- configuration

- configurée

- connexion

- Connectivité

- Considérer

- Console

- contiennent

- contient

- contenu

- Génération de contenu

- contrôles

- correctement

- pourriez

- engendrent

- créée

- CRÉDENTIEL

- Lettres de créance

- cryptographique

- Courant

- des clients

- données client

- personnalisables

- données

- confidentialité des données

- Décrypter

- Défense

- démontre

- déployer

- déployé

- déploiements

- décrire

- un

- Déterminer

- développer

- Développement

- diagramme

- numérique

- annuaire

- discuter

- discute

- affiche

- Docker

- document

- INSTITUTIONNELS

- Ne pas

- download

- deux

- pendant

- Plus tôt

- éditeur

- pédagogique

- effet

- fei

- Employés

- permettre

- activé

- enclave

- crypter

- crypté

- fin

- Endpoint

- ingénieur

- Moteurs

- de renforcer

- Améliore

- assez

- Environment

- environnements

- événements

- examiner

- exemple

- Sauf

- exfiltration

- explicitement

- exposé

- Exposition

- externe

- Échoué

- Fonctionnalité

- Fonctionnalités:

- Figure

- Déposez votre dernière attestation

- Fichiers

- finale

- la traduction de documents financiers

- se concentre

- suivre

- Abonnement

- suit

- Football

- Pour

- le format

- document

- fortune

- quatre

- gratuitement ici

- De

- fonction

- plus

- Gain

- Games

- générer

- généré

- génère

- génération

- obtenez

- Git

- GitHub

- aller

- Gouvernement

- Réservation de groupe

- Groupes

- Poignées

- Maniabilité

- Matériel

- Vous avez

- he

- Santé

- information sur la santé

- la médecine

- vous aider

- aide

- ici

- Surbrillance

- très

- sa

- patrie

- Homeland Security

- hôte

- organisé

- Villa

- maisons

- Comment

- How To

- HTML

- http

- HTTPS

- i

- ID

- identifiable

- identifier

- identifier

- Identite

- if

- image

- satellite

- Impact

- mis en œuvre

- importer

- in

- inexacte

- comprendre

- inclus

- Y compris

- incorporation

- incorrect

- indiquer

- secteurs

- informer

- d'information

- contribution

- entrée

- à l'intérieur

- installer

- installation

- instance

- des services

- l'intégration

- intellectuel

- propriété intellectuelle

- Intelligence

- Interactif

- développement

- introduire

- Découvrez le tout nouveau

- IP

- isolé

- seul

- IT

- SES

- JOE

- json

- Justin

- ACTIVITES

- spécialisées

- langue

- gros

- plus importantes

- Nouveautés

- couche

- leader

- apprentissage

- au

- bibliothèques

- comme

- LIV

- le travail

- Vit

- LLM

- locales

- localement

- situé

- Style

- ressembler

- LOOKS

- click

- machine learning

- Les machines

- Entrée

- a prendre une

- gérés

- gestion

- Manipulation

- de nombreuses

- Marchés

- allumettes

- maximales

- Mai..

- mesures

- Mémoire

- Métadonnées

- méthodes

- Minutes

- Réduire les

- Mode

- modèle

- modifié

- modifier

- Modules

- PLUS

- (en fait, presque toutes)

- beaucoup

- plusieurs

- must

- prénom

- Nature

- Traitement du langage naturel

- Navigation

- ne

- nécessaire

- Besoin

- Besoins

- de mise en réseau

- Nouveauté

- nitro

- aucune

- Aucun

- noter

- maintenant

- of

- Offres Speciales

- Bureaux

- on

- uniquement

- ouvert

- open source

- or

- de commander

- organisation

- Autre

- nos

- ande

- au contrôle

- plus de

- vue d'ensemble

- propriétaires

- Forfaits

- pain

- paramètres

- autorisations

- personnel

- Personnellement

- plan

- et la planification de votre patrimoine

- plateforme

- Platon

- Intelligence des données Platon

- PlatonDonnées

- jouer

- politique

- partieInvestir dans des appareils économes en énergie et passer à l'éclairage

- possible

- Post

- défaillances

- pratiques

- précédant

- condition préalable

- conditions préalables

- président

- précédent

- qui se déroulent

- Directeur

- principes

- la confidentialité

- Menaces sur la vie privée

- Privé

- processus

- les process

- traitement

- Vidéo

- Projet

- propriété

- protéger

- protégé

- protocole

- Prouver

- fournir

- à condition de

- fournit

- procuration

- public

- des fins

- requêtes

- question

- question

- fréquemment posées

- reçoit

- recommander

- réduit

- région

- registres

- repose

- compter

- reste

- nécessaire

- demandes

- conditions

- Exigences

- a besoin

- un article

- chercheur

- réservé

- ressource

- Resources

- réponse

- réponses

- restreindre

- Restrictif

- résultat

- résultant

- conserver

- retraite

- retourner

- Révélé

- Analyse

- risques

- Rôle

- racine

- Courir

- pour le running

- sauvegarder

- la sauvegarde

- même

- échantillon

- Épargnez

- sauvé

- Escaliers intérieurs

- Sciences

- Science et technologie

- Sdk

- Rechercher

- Les moteurs de recherche

- Section

- secteur

- sécurisé

- sécurisé

- en toute sécurité

- sécurité

- sélection

- envoie

- sensible

- envoyé

- sentiment

- Série

- serveur

- Serveurs

- service

- Services

- set

- Paramétres

- devrait

- présenté

- montré

- shutdown

- de façon significative

- Taille

- So

- Logiciels

- développement de logiciels

- sur mesure

- Solutions

- quelques

- groupe de neurones

- spécifiquement

- Commencer

- j'ai commencé

- Déclaration

- étapes

- Étapes

- storage

- stockée

- tel

- suffisant

- Support

- Appuyer

- sûr

- Surface

- combustion propre

- Système

- Prenez

- tâches

- Technique

- Technologie

- temporaire

- terminal

- Essais

- texte

- qui

- Le

- leur

- puis

- Ces

- l'ont

- this

- ceux

- des menaces

- Avec

- tout au long de

- fiable

- fois

- à

- jeton

- qualifié

- transit

- Traduction

- Voyages

- La confiance

- Essai

- non autorisé

- sous

- comprendre

- expérience unique et authentique

- libre

- Mises à jour

- a actualisé

- URL

- utilisé

- cas d'utilisation

- d'utiliser

- Utilisateur

- utilisateurs

- Usages

- en utilisant

- variable

- vérifier

- version

- via

- vice

- Vice-président

- Voir

- Violations

- Salle de conférence virtuelle

- machine virtuelle

- visible

- vision

- chaud

- était

- Façon..

- façons

- we

- Météo

- web

- Applications Web

- services Web

- Quoi

- quand

- qui

- WHO

- sera

- comprenant

- dans les

- sans

- activités principales

- travaillé

- de travail

- monde

- X

- Vous n'avez

- Votre

- zéphyrnet