आर्टिफिशियल इंटेलिजेंस (एआई) और मशीन लर्निंग (एमएल) की दुनिया जनरेटिव एआई मॉडल के उदय के साथ एक प्रतिमान बदलाव देख रही है जो मानव-जैसे पाठ, चित्र, कोड और ऑडियो बना सकते हैं। शास्त्रीय एमएल मॉडल की तुलना में, जनरेटिव एआई मॉडल काफी बड़े और अधिक जटिल हैं। हालांकि, उनकी बढ़ती जटिलता भी अनुमान के लिए उच्च लागत और शक्तिशाली कंप्यूटिंग संसाधनों की बढ़ती आवश्यकता के साथ आती है। जनरेटिव एआई मॉडल के लिए अनुमान की उच्च लागत सीमित संसाधनों वाले व्यवसायों और शोधकर्ताओं के लिए प्रवेश में बाधा बन सकती है, जिससे अधिक कुशल और लागत प्रभावी समाधानों की आवश्यकता होती है। इसके अलावा, अधिकांश जनरेटिव एआई उपयोग के मामलों में मानवीय संपर्क या वास्तविक दुनिया के परिदृश्य शामिल होते हैं, ऐसे हार्डवेयर की आवश्यकता होती है जो कम-विलंबता प्रदर्शन प्रदान कर सके। AWS शक्तिशाली, कुशल और लागत प्रभावी कंप्यूट हार्डवेयर की बढ़ती आवश्यकता को पूरा करने के लिए उद्देश्य-निर्मित चिप्स के साथ नवाचार कर रहा है।

आज, हम इसकी घोषणा करते हुए उत्साहित हैं अमेज़न SageMaker का समर्थन करता है एडब्ल्यूएस अनुमान 2 (मिली. inf2) और एडब्ल्यूएस ट्रेनियम (ml.trn1) वास्तविक समय और अतुल्यकालिक अनुमान के लिए जेनेरेटिव एआई मॉडल की मेजबानी करने के लिए सैजमेकर इंस्टेंसेस पर आधारित है। ml.inf2 उदाहरण US पूर्व (ओहियो) में SageMaker पर मॉडल परिनियोजन के लिए उपलब्ध हैं और US पूर्व (N. वर्जीनिया) में ml.trn1 उदाहरण हैं।

बड़े भाषा मॉडल (एलएलएम), स्थिर प्रसार, और दृष्टि ट्रांसफार्मर सहित जनरेटिव एआई मॉडल के लिए कम लागत पर उच्च प्रदर्शन प्राप्त करने के लिए आप इन उदाहरणों का उपयोग सेजमेकर पर कर सकते हैं। इसके अलावा आप इस्तेमाल कर सकते हैं अमेज़ॅन सेजमेकर अनुमान अनुशंसाकर्ता लोड परीक्षण चलाने और इन उदाहरणों पर अपने मॉडल को लागू करने के मूल्य-प्रदर्शन लाभों का मूल्यांकन करने में आपकी सहायता करने के लिए।

आप टेक्स्ट सारांश, कोड जनरेशन, वीडियो और इमेज जनरेशन, स्पीच रिकग्निशन, पर्सनलाइजेशन, फ्रॉड डिटेक्शन, और बहुत कुछ के लिए SageMaker पर अपने ML एप्लिकेशन चलाने के लिए ml.inf2 और ml.trn1 इंस्टेंसेस का उपयोग कर सकते हैं। आप अपने SageMaker समापन बिंदु को कॉन्फ़िगर करते समय ml.trn1 या ml.inf2 उदाहरणों को निर्दिष्ट करके आसानी से आरंभ कर सकते हैं। आप आसानी से आरंभ करने के लिए PyTorch, TensorFlow, Hugging Face, और बड़े मॉडल अनुमान (LMI) के लिए ml.trn1 और ml.inf2 संगत AWS डीप लर्निंग कंटेनर (DLCs) का उपयोग कर सकते हैं। संस्करणों के साथ पूरी सूची के लिए, देखें उपलब्ध डीप लर्निंग कंटेनर इमेज.

इस पोस्ट में, हम LMI कंटेनर का लाभ उठाकर, बिना किसी अतिरिक्त कोडिंग की आवश्यकता के, SageMaker का उपयोग करके AWS Inferentia2 पर एक बड़े भाषा मॉडल को तैनात करने की प्रक्रिया को दिखाते हैं। हम उपयोग करते हैं GPT4ALL-जे, एक बेहतर ट्यून किया हुआ GPT-J 7B मॉडल जो चैटबॉट स्टाइल इंटरेक्शन प्रदान करता है।

ml.trn1 और ml.inf2 उदाहरणों का अवलोकन

ml.trn1 उदाहरण ट्रेनियम त्वरक द्वारा संचालित होते हैं, जिसका उद्देश्य मुख्य रूप से एलएलएम सहित जनरेटिव एआई मॉडल के उच्च-प्रदर्शन गहन शिक्षण प्रशिक्षण के लिए बनाया गया है। हालाँकि, ये उदाहरण उन मॉडलों के लिए इंट्रेंस वर्कलोड का भी समर्थन करते हैं जो कि Inf2 में फिट होने से भी बड़े हैं। सबसे बड़ा उदाहरण आकार, trn1.32xlarge उदाहरण, 16 सुविधाएँ ट्रेनियम त्वरक FP512/BF3.4 कंप्यूट पावर के 16 पेटाफ्लॉप्स तक एकल उदाहरण में 16 GB की एक्सीलरेटर मेमोरी के साथ। सुव्यवस्थित सामूहिक संचार के लिए 16 ट्रेनियम त्वरक अल्ट्रा-हाई-स्पीड न्यूरॉनलिंकवी2 से जुड़े हैं।

ml.Inf2 उदाहरण इसके द्वारा संचालित होते हैं AWS Inferentia2 त्वरक, अनुमान के लिए एक उद्देश्य निर्मित त्वरक। यह पहली पीढ़ी के AWS Inferentia की तुलना में तीन गुना अधिक कंप्यूट प्रदर्शन, चार गुना अधिक थ्रूपुट और 10 गुना कम विलंबता प्रदान करता है। सबसे बड़ा उदाहरण आकार, Inf2.48xlarge, BF12/FP2 के लिए 384 पेटाफ्लॉप्स की संयुक्त गणना शक्ति के लिए एकल उदाहरण में 2.3 जीबी त्वरक मेमोरी के साथ 16 AWS Inferentia16 त्वरक की सुविधा देता है। यह आपको एक उदाहरण में 175 बिलियन-पैरामीटर मॉडल तक तैनात करने में सक्षम बनाता है। इस इंटरकनेक्ट की पेशकश करने के लिए Inf2 एकमात्र अनुमान-अनुकूलित उदाहरण है, एक ऐसी सुविधा जो केवल अधिक महंगे प्रशिक्षण उदाहरणों में उपलब्ध है। अल्ट्रा-बड़े मॉडल के लिए जो एकल त्वरक में फिट नहीं होते हैं, डेटा सीधे न्यूरॉनलिंक के साथ त्वरक के बीच प्रवाहित होता है, सीपीयू को पूरी तरह से बायपास करता है। न्यूरॉनलिंक के साथ, Inf2 तेजी से वितरित अनुमान का समर्थन करता है और थ्रूपुट और विलंबता में सुधार करता है।

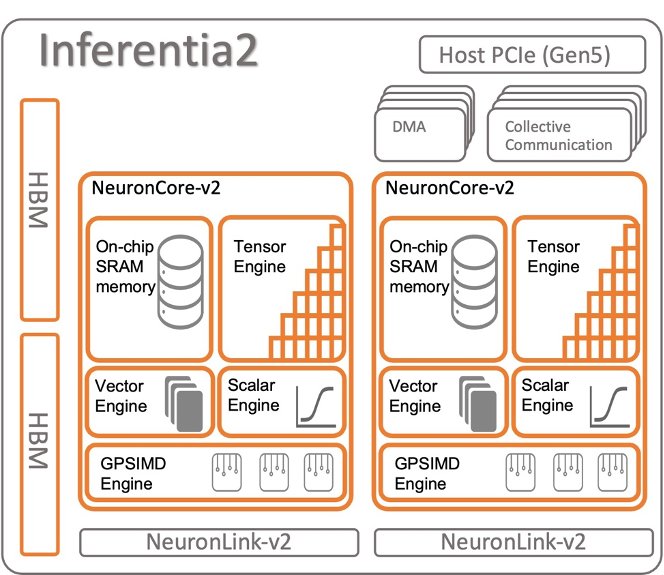

AWS Inferentia2 और Trainium त्वरक दोनों में दो हैं न्यूरॉनकोर्स-v2, 32 जीबी एचबीएम मेमोरी स्टैक, और समर्पित कलेक्टिव-कंप्यूट इंजन, जो बहु-त्वरक निष्कर्ष करते समय गणना और संचार को ओवरलैप करके स्वचालित रूप से रनटाइम का अनुकूलन करते हैं। आर्किटेक्चर पर अधिक जानकारी के लिए, देखें ट्रेनियम और इनफेरेंटिया डिवाइस.

निम्न आरेख AWS Inferentia2 का उपयोग करके एक उदाहरण आर्किटेक्चर दिखाता है।

एडब्ल्यूएस न्यूरॉन एसडीके

AWS न्यूरॉन SDK है जिसका उपयोग AWS Inferentia और Trainium आधारित उदाहरणों पर गहन शिक्षण कार्यभार चलाने के लिए किया जाता है। AWS न्यूरॉन में एक गहन शिक्षण संकलक, रनटाइम और उपकरण शामिल हैं जो मूल रूप से TensorFlow और PyTorch में एकीकृत हैं। न्यूरॉन के साथ, आप ml.trn1 और ml.inf2 पर उच्च-प्रदर्शन एमएल वर्कलोड को विकसित, प्रोफाइल और तैनात कर सकते हैं।

RSI न्यूरॉन संकलक विभिन्न स्वरूपों (TensorFlow, PyTorch, XLA HLO) में ML मॉडल स्वीकार करता है और उन्हें न्यूरॉन उपकरणों पर चलने के लिए अनुकूलित करता है। न्यूरॉन कंपाइलर को एमएल फ्रेमवर्क के भीतर लागू किया जाता है, जहां एमएल मॉडल न्यूरॉन फ्रेमवर्क प्लगइन द्वारा कंपाइलर को भेजे जाते हैं। परिणामी कंपाइलर आर्टिफैक्ट को एनईएफएफ फ़ाइल (न्यूरॉन निष्पादन योग्य फ़ाइल प्रारूप) कहा जाता है जो बदले में न्यूरॉन रनटाइम द्वारा न्यूरॉन डिवाइस पर लोड किया जाता है।

RSI न्यूरॉन रनटाइम कर्नेल ड्राइवर और C/C++ लाइब्रेरी से मिलकर बनता है, जो AWS Inferentia और Trainium neuron उपकरणों तक पहुँचने के लिए API प्रदान करता है। TensorFlow और PyTorch के लिए न्यूरॉन एमएल फ्रेमवर्क प्लगइन्स न्यूरॉनकोर पर मॉडल लोड करने और चलाने के लिए न्यूरॉन रनटाइम का उपयोग करते हैं। न्यूरॉन रनटाइम ने न्यूरॉन उपकरणों के लिए गहन शिक्षण मॉडल (एनईएफएफ) को संकलित किया है और उच्च थ्रूपुट और कम विलंबता के लिए अनुकूलित किया गया है।

SageMaker ml.inf2 उदाहरणों का उपयोग करके NLP मॉडल होस्ट करें

इससे पहले कि हम एलएलएम के साथ सेवा करने में गहरा गोता लगाएँ ट्रांसफॉर्मर-न्यूरॉनx, जो एक ओपन-सोर्स लाइब्रेरी है जो मॉडल के बड़े वेट मैट्रिसेस को कई न्यूरॉनकोर पर शार्प करने के लिए है, आइए संक्षेप में एक मॉडल के लिए विशिष्ट परिनियोजन प्रवाह से गुजरते हैं जो सिंगल न्यूरॉनकोर पर फिट हो सकता है।

चेक समर्थित मॉडलों की सूची यह सुनिश्चित करने के लिए कि मॉडल AWS Inferentia2 पर समर्थित है। अगला, मॉडल को न्यूरॉन कंपाइलर द्वारा पूर्व-संकलित करने की आवश्यकता है। आप एक SageMaker नोटबुक या a का उपयोग कर सकते हैं अमेज़ॅन इलास्टिक कम्प्यूट क्लाउड (अमेज़न EC2) उदाहरण मॉडल को संकलित करने के लिए। आप निम्नलिखित कोड में दिखाए गए अनुसार PyTorch जैसे लोकप्रिय डीप लर्निंग फ्रेमवर्क का उपयोग करके मॉडल को तैनात करने के लिए SageMaker Python SDK का उपयोग कर सकते हैं। आप अपने मॉडल को SageMaker होस्टिंग सेवाओं पर तैनात कर सकते हैं और एक समापन बिंदु प्राप्त कर सकते हैं जिसका उपयोग अनुमान के लिए किया जा सकता है। ये एंडपॉइंट पूरी तरह से प्रबंधित हैं और ऑटो स्केलिंग का समर्थन करते हैं।

का संदर्भ लें डेवलपर प्रवाह नमूना स्क्रिप्ट के साथ SageMaker पर Inf2 के विशिष्ट विकास प्रवाह पर अधिक विवरण के लिए।

SageMaker ml.inf2 उदाहरणों का उपयोग करके एलएलएम होस्ट करें

अरबों मापदंडों वाले बड़े भाषा मॉडल अक्सर एक त्वरक पर फिट होने के लिए बहुत बड़े होते हैं। यह कई त्वरक में एलएलएम की मेजबानी के लिए मॉडल समानांतर तकनीकों के उपयोग की आवश्यकता है। एलएलएम की मेजबानी के लिए एक अन्य महत्वपूर्ण आवश्यकता एक उच्च-प्रदर्शन मॉडल-सर्विंग समाधान का कार्यान्वयन है। इस समाधान को कुशलता से मॉडल को लोड करना चाहिए, विभाजन का प्रबंधन करना चाहिए, और HTTP एंडपॉइंट्स के माध्यम से अनुरोधों को निर्बाध रूप से पूरा करना चाहिए।

SageMaker में मॉडल समानता और बड़े मॉडल के अनुमान के लिए विशेष गहन शिक्षण कंटेनर (DLCs), पुस्तकालय और टूलिंग शामिल हैं। SageMaker पर LMI के साथ आरंभ करने के लिए संसाधनों के लिए, देखें मॉडल समानता और बड़े मॉडल का अनुमान. SageMaker GPT, T5, OPT, BLOOM, और AWS अवसंरचना पर स्थिर प्रसार जैसे बड़े मॉडलों की मेजबानी के लिए लोकप्रिय ओपन-सोर्स लाइब्रेरी के साथ DLC का रखरखाव करता है। इन विशेष डीएलसी को सेजमेकर एलएमआई कंटेनर के रूप में संदर्भित किया जाता है।

सेजमेकर एलएमआई कंटेनर DJLServing का उपयोग करें, एक मॉडल सर्वर जो न्यूरॉनकोर में टेंसर समानता का समर्थन करने के लिए ट्रांसफॉर्मर-न्यूरॉनक्स लाइब्रेरी के साथ एकीकृत है। DJLServing कैसे काम करता है, इसके बारे में अधिक जानने के लिए देखें DJLServing और DeepSpeed मॉडल के समानांतर अनुमान का उपयोग करके Amazon SageMaker पर बड़े मॉडल परिनियोजित करें. डीजेएल मॉडल सर्वर और ट्रांसफॉर्मर-न्यूरॉनक्स लाइब्रेरी कंटेनर के मुख्य घटकों के रूप में काम करते हैं, जिसमें न्यूरॉन एसडीके भी शामिल है। यह सेटअप AWS Inferentia2 त्वरक पर मॉडल को लोड करने की सुविधा प्रदान करता है, मॉडल को कई न्यूरॉनकोर में समानांतर करता है, और HTTP एंडपॉइंट्स के माध्यम से सेवा करने में सक्षम बनाता है।

एलएमआई कंटेनर एक से लोडिंग मॉडल का समर्थन करता है अमेज़न सरल भंडारण सेवा (अमेज़न S3) बाल्टी या हगिंग फेस हब। डिफ़ॉल्ट हैंडलर स्क्रिप्ट मॉडल को लोड करती है, संकलित करती है और इसे न्यूरॉन-अनुकूलित प्रारूप में परिवर्तित करती है और इसे लोड करती है। LLM को होस्ट करने के लिए LMI कंटेनर का उपयोग करने के लिए, हमारे पास दो विकल्प हैं:

- एक नो-कोड (पसंदीदा) - एलएमआई कंटेनर का उपयोग करके एलएलएम को तैनात करने का यह सबसे आसान तरीका है। इस विधि में, आप प्रदान किए गए का उपयोग कर सकते हैं डिफ़ॉल्ट हैंडलर और केवल मॉडल का नाम और आवश्यक पैरामीटर पास करें

serving.propertiesमॉडल को लोड और होस्ट करने के लिए फ़ाइल। डिफ़ॉल्ट हैंडलर का उपयोग करने के लिए, हम प्रदान करते हैंentryPointपैरामीटर के रूप मेंdjl_python.transformers-neuronx. - अपनी खुद की स्क्रिप्ट लाओ - इस दृष्टिकोण में, आपके पास अपनी खुद की model.py फ़ाइल बनाने का विकल्प होता है, जिसमें मॉडल को लोड करने और सर्व करने के लिए आवश्यक कोड होता है। यह फ़ाइल बीच में एक मध्यस्थ के रूप में कार्य करती है

DJLServingएपीआई औरtransformers-neuronxएपीआई। मॉडल लोड करने की प्रक्रिया को अनुकूलित करने के लिए, आप प्रदान कर सकते हैंserving.propertiesविन्यास योग्य मापदंडों के साथ। उपलब्ध विन्यास योग्य मापदंडों की एक व्यापक सूची के लिए, देखें सभी डीजेएल कॉन्फ़िगरेशन विकल्प. यहाँ a . का एक उदाहरण है model.py फ़ाइल.

रनटाइम आर्किटेक्चर

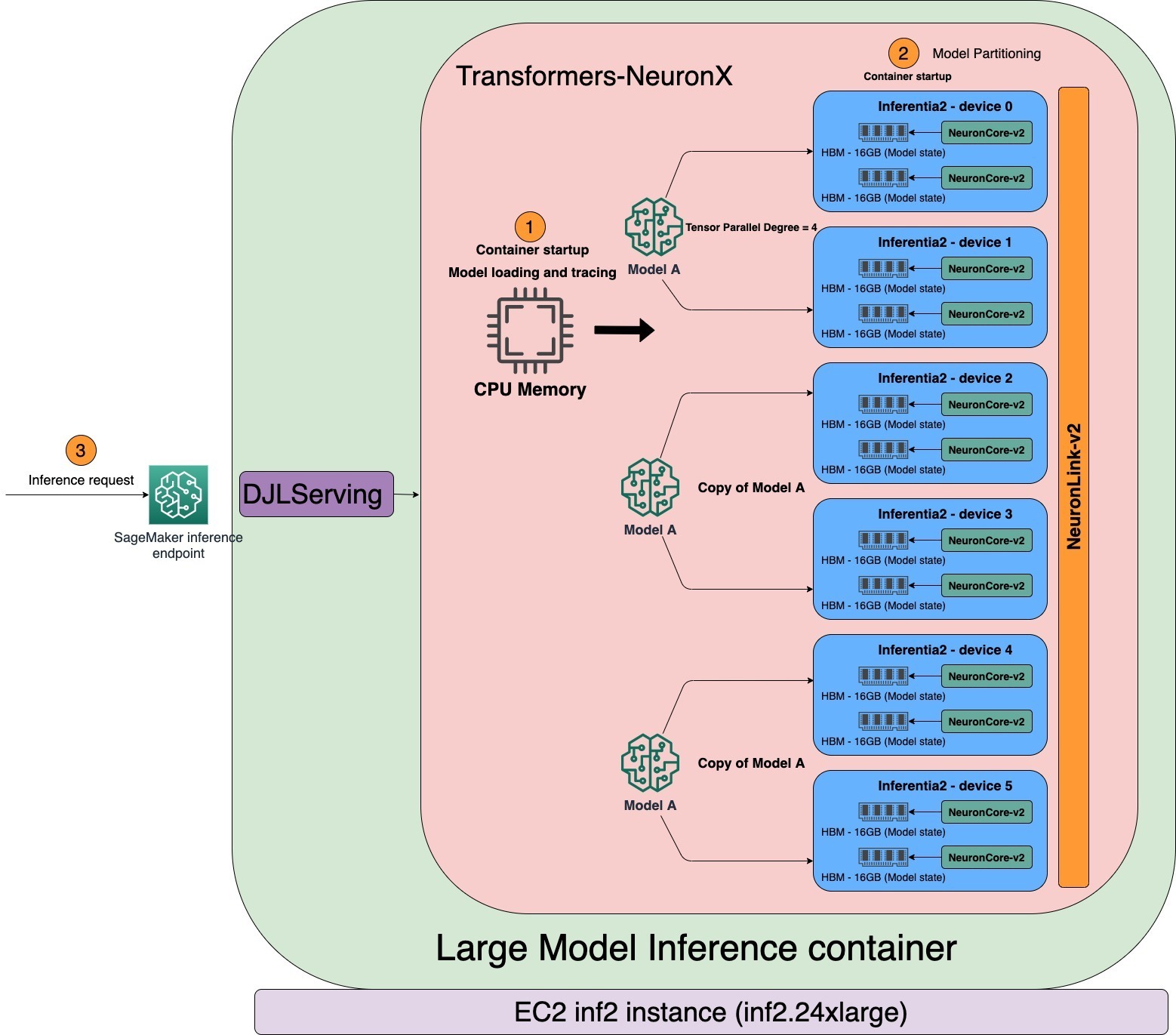

RSI tensor_parallel_degree संपत्ति मूल्य कई न्यूरॉनकोर्स में टेंसर समानांतर मॉड्यूल के वितरण को निर्धारित करता है। उदाहरण के लिए, inf2.24xlarge में छह AWS Inferentia2 त्वरक हैं। प्रत्येक AWS Inferentia2 त्वरक में दो न्यूरॉनकोर होते हैं। प्रत्येक न्यूरॉनकोर में 16 जीबी के टेंसर समानांतर मॉड्यूल के भंडारण के लिए समर्पित उच्च बैंडविड्थ मेमोरी (एचबीएम) है। 4 की टेंसर समानांतर डिग्री के साथ, एलएमआई एक ही मॉडल की तीन मॉडल प्रतियों को आवंटित करेगा, प्रत्येक चार न्यूरॉनकोर का उपयोग करेगा। जैसा कि निम्नलिखित आरेख में दिखाया गया है, जब एलएमआई कंटेनर शुरू होता है, तो मॉडल लोड किया जाएगा और पहले सीपीयू एड्रेसेबल मेमोरी में ट्रेस किया जाएगा। जब अनुरेखण पूरा हो जाता है, तो मॉडल को टेंसर समानांतर डिग्री के आधार पर न्यूरॉनकोर्स में विभाजित किया जाता है।

LMI अपने मॉडल सर्विंग स्टैक के रूप में DJLServing का उपयोग करता है। SageMaker में कंटेनर की स्वास्थ्य जांच पास होने के बाद, कंटेनर अनुमान अनुरोध को पूरा करने के लिए तैयार है। DJLServing ने इसके समतुल्य कई पायथन प्रक्रियाओं को लॉन्च किया TOTAL NUMBER OF NEURON CORES/TENSOR_PARALLEL_DEGREE. प्रत्येक पायथन प्रक्रिया में सी ++ के बराबर धागे होते हैं TENSOR_PARALLEL_DEGREE. प्रत्येक C ++ थ्रेड्स में एक न्यूरॉनकोर पर मॉडल का एक शार्ड होता है।

कई चिकित्सक (पायथन प्रक्रिया) क्रमिक रूप से अनुमान लगाते हैं जब सर्वर को कई स्वतंत्र अनुरोधों के साथ लागू किया जाता है। हालांकि इसे स्थापित करना आसान है, आमतौर पर त्वरक की गणना शक्ति का उपयोग करना सबसे अच्छा अभ्यास नहीं है। इसे संबोधित करने के लिए, डीजेएलसर्विंग थ्रूपुट बढ़ाने के लिए गतिशील रूप से एक बड़ा बैच बनाने के लिए सर्वर साइड पर इन स्वतंत्र अनुमान अनुरोधों को संयोजित करने के लिए गतिशील बैचिंग के अंतर्निहित अनुकूलन प्रदान करता है। अनुमान के लिए प्रतीक्षा करने के लिए वास्तविक कार्य कतार में प्रवेश करने से पहले सभी अनुरोध डायनेमिक बैचर तक पहुँचते हैं। आप डायनेमिक बैचिंग के लिए अपने पसंदीदा बैच आकार का उपयोग करके सेट कर सकते हैं batch_size में सेटिंग्स serving.properties. आप भी कॉन्फ़िगर कर सकते हैं max_batch_delay आपकी विलंबता आवश्यकताओं के आधार पर बैच में शामिल होने के लिए अन्य अनुरोधों की प्रतीक्षा करने के लिए बैचर में अधिकतम विलंब समय निर्दिष्ट करने के लिए। थ्रूपुट मॉडल प्रतियों की संख्या और कंटेनर में लॉन्च किए गए पायथन प्रक्रिया समूहों पर भी निर्भर करता है। जैसा कि निम्नलिखित आरेख में दिखाया गया है, टेन्सर समानांतर डिग्री 4 पर सेट होने के साथ, एलएमआई कंटेनर तीन पायथन प्रक्रिया समूहों को लॉन्च करता है, जिनमें से प्रत्येक में मॉडल की पूरी प्रति होती है। यह आपको बैच का आकार बढ़ाने और उच्च थ्रूपुट प्राप्त करने की अनुमति देता है।

एलएलएम की तैनाती के लिए सेजमेकर नोटबुक

इस अनुभाग में, हम GPT4All-J, एक 6-बिलियन-पैरामीटर मॉडल जो कि FP24 में 32 GB है, को परिनियोजित करने का चरण-दर-चरण पूर्वाभ्यास प्रदान करते हैं। GPT4All-J एक लोकप्रिय चैटबॉट है जिसे शब्द समस्याओं, संवादों, कोड, कविताओं, गीतों और कहानियों जैसी विभिन्न प्रकार की अंतःक्रियात्मक सामग्री पर प्रशिक्षित किया गया है। GPT4all-J एक ठीक-ठीक GPT-J मॉडल है जो मानवीय अंतःक्रियाओं के समान प्रतिक्रिया उत्पन्न करता है।

इस उदाहरण के लिए पूरी नोटबुक पर उपलब्ध कराई गई है GitHub. मॉडल को Inf2 उदाहरण में परिनियोजित करने के लिए हम SageMaker Python SDK का उपयोग कर सकते हैं। हम प्रदान का उपयोग करते हैं डिफ़ॉल्ट हैंडलर मॉडल लोड करने के लिए। इसके साथ, हमें केवल एक प्रदान करने की आवश्यकता है सर्विंग्स फ़ाइल। इस फ़ाइल में मॉडल को डाउनलोड और होस्ट करने के लिए डीजेएल मॉडल सर्वर के लिए आवश्यक कॉन्फ़िगरेशन हैं। हम हगिंग फेस मॉडल का उपयोग करके नाम निर्दिष्ट कर सकते हैं model_id मॉडल को सीधे हगिंग फेस रेपो से डाउनलोड करने के लिए पैरामीटर। वैकल्पिक रूप से, आप प्रदान करके मॉडल को Amazon S3 से डाउनलोड कर सकते हैं s3url पैरामीटर। entryPoint मॉडल को लोड करने के लिए लाइब्रेरी को इंगित करने के लिए पैरामीटर कॉन्फ़िगर किया गया है। अधिक जानकारी के लिए djl_python.fastertransformer, को देखें गिटहब कोड.

RSI tensor_parallel_degree संपत्ति का मूल्य कई उपकरणों में टेंसर समानांतर मॉड्यूल के वितरण को निर्धारित करता है। उदाहरण के लिए, 12 न्यूरॉनकोर और 4 की टेंसर समानांतर डिग्री के साथ, एलएमआई तीन मॉडल प्रतियों को आवंटित करेगा, प्रत्येक चार न्यूरॉनकोर का उपयोग करेगा। आप संपत्ति का उपयोग करके सटीक प्रकार को भी परिभाषित कर सकते हैं dtype. n_position पैरामीटर मॉडल के लिए अधिकतम इनपुट और आउटपुट अनुक्रम लंबाई के योग को परिभाषित करता है। निम्नलिखित कोड देखें:

का निर्माण tarball युक्त serving.properties और इसे S3 बकेट में अपलोड करें। यद्यपि इस उदाहरण में डिफ़ॉल्ट हैंडलर का उपयोग किया जाता है, आप एक विकसित कर सकते हैं model.py लोडिंग और सर्विंग प्रक्रिया को अनुकूलित करने के लिए फ़ाइल। यदि कोई पैकेज है जिसे संस्थापन की आवश्यकता है, तो उन्हें इसमें शामिल करें requirements.txt फ़ाइल। निम्नलिखित कोड देखें:

डीजेएल कंटेनर छवि को पुनः प्राप्त करें और सेजमेकर मॉडल बनाएं:

अगला, हम पहले परिभाषित मॉडल कॉन्फ़िगरेशन के साथ SageMaker समापन बिंदु बनाते हैं। कंटेनर मॉडल को इसमें डाउनलोड करता है /tmp अंतरिक्ष क्योंकि सैजमेकर मैप करता है /tmp सेवा मेरे अमेज़न इलास्टिक ब्लॉक स्टोर (अमेज़ॅन ईबीएस)। हमें एक जोड़ने की जरूरत है volume_size सुनिश्चित करने के लिए पैरामीटर /tmp निर्देशिका में मॉडल को डाउनलोड करने और संकलित करने के लिए पर्याप्त स्थान है। हमलोग तैयार हैं container_startup_health_check_timeout मॉडल तैयार होने के बाद स्वास्थ्य जांच शुरू करने के लिए 3,600 सेकेंड तक। हम ml.inf2.8xlarge उदाहरण का उपयोग करते हैं। निम्नलिखित कोड देखें:

SageMaker एंडपॉइंट बनने के बाद, हम उपयोग करके SageMaker एंडपॉइंट्स के खिलाफ वास्तविक समय की भविष्यवाणी कर सकते हैं Predictor वस्तु:

क्लीन अप

अपने परीक्षण समाप्त करने के बाद लागत बचाने के लिए समापन बिंदु हटाएं:

निष्कर्ष

इस पोस्ट में, हमने SageMaker की नई लॉन्च की गई क्षमता का प्रदर्शन किया, जो अब जनरेटिव AI मॉडल की मेजबानी के लिए ml.inf2 और ml.trn1 उदाहरणों का समर्थन करती है। हमने बिना किसी कोड को लिखे SageMaker और LMI कंटेनर का उपयोग करके AWS Inferentia4 पर GPT2ALL-J, एक जनरेटिव AI मॉडल को तैनात करने का तरीका दिखाया। हमने यह भी दिखाया कि आप DJLServing और का उपयोग कैसे कर सकते हैं transformers-neuronx किसी मॉडल को लोड करने, उसका विभाजन करने और सर्व करने के लिए।

Inf2 इंस्टेंस AWS पर जनरेटिव AI मॉडल चलाने के लिए सबसे अधिक लागत प्रभावी तरीका प्रदान करते हैं। प्रदर्शन विवरण के लिए, देखें Inf2 प्रदर्शन.

चेक आउट GitHub एक उदाहरण नोटबुक के लिए रेपो। इसे आज़माएं और यदि आपके कोई प्रश्न हैं तो हमें बताएं!

लेखक के बारे में

विवेक गंगासानी Amazon Web Services में सीनियर मशीन लर्निंग सॉल्यूशंस आर्किटेक्ट हैं। वह AWS पर AI/ML एप्लिकेशन बनाने और तैनात करने के लिए मशीन लर्निंग स्टार्टअप्स के साथ काम करता है। वह वर्तमान में MLOps, ML Inference और लो-कोड ML के लिए समाधान देने पर केंद्रित है। उन्होंने नेचुरल लैंग्वेज प्रोसेसिंग और कंप्यूटर विजन सहित विभिन्न डोमेन में परियोजनाओं पर काम किया है।

विवेक गंगासानी Amazon Web Services में सीनियर मशीन लर्निंग सॉल्यूशंस आर्किटेक्ट हैं। वह AWS पर AI/ML एप्लिकेशन बनाने और तैनात करने के लिए मशीन लर्निंग स्टार्टअप्स के साथ काम करता है। वह वर्तमान में MLOps, ML Inference और लो-कोड ML के लिए समाधान देने पर केंद्रित है। उन्होंने नेचुरल लैंग्वेज प्रोसेसिंग और कंप्यूटर विजन सहित विभिन्न डोमेन में परियोजनाओं पर काम किया है।

हिरोशी टोक्यो AWS अन्नपूर्णा लैब्स में एक समाधान वास्तुकार है। जापान में स्थित, वह AWS द्वारा अधिग्रहण से पहले ही अन्नपूर्णा लैब्स में शामिल हो गया और उसने अन्नपूर्णा लैब्स तकनीक के साथ ग्राहकों की लगातार मदद की। उनका हाल ही में उद्देश्य-निर्मित सिलिकॉन, AWS Inferentia और Trainium पर आधारित मशीन लर्निंग समाधानों पर ध्यान केंद्रित है।

हिरोशी टोक्यो AWS अन्नपूर्णा लैब्स में एक समाधान वास्तुकार है। जापान में स्थित, वह AWS द्वारा अधिग्रहण से पहले ही अन्नपूर्णा लैब्स में शामिल हो गया और उसने अन्नपूर्णा लैब्स तकनीक के साथ ग्राहकों की लगातार मदद की। उनका हाल ही में उद्देश्य-निर्मित सिलिकॉन, AWS Inferentia और Trainium पर आधारित मशीन लर्निंग समाधानों पर ध्यान केंद्रित है।

धवल पटेल AWS में प्रिंसिपल मशीन लर्निंग आर्किटेक्ट हैं। उन्होंने वितरित कंप्यूटिंग और आर्टिफिशियल इंटेलिजेंस से संबंधित समस्याओं पर बड़े उद्यमों से लेकर मध्यम आकार के स्टार्टअप तक के संगठनों के साथ काम किया है। वह एनएलपी और कंप्यूटर विज़न डोमेन सहित डीप लर्निंग पर ध्यान केंद्रित करता है। वह ग्राहकों को सेजमेकर पर उच्च प्रदर्शन मॉडल अनुमान प्राप्त करने में मदद करता है।

धवल पटेल AWS में प्रिंसिपल मशीन लर्निंग आर्किटेक्ट हैं। उन्होंने वितरित कंप्यूटिंग और आर्टिफिशियल इंटेलिजेंस से संबंधित समस्याओं पर बड़े उद्यमों से लेकर मध्यम आकार के स्टार्टअप तक के संगठनों के साथ काम किया है। वह एनएलपी और कंप्यूटर विज़न डोमेन सहित डीप लर्निंग पर ध्यान केंद्रित करता है। वह ग्राहकों को सेजमेकर पर उच्च प्रदर्शन मॉडल अनुमान प्राप्त करने में मदद करता है।

किंग लैन एडब्ल्यूएस में सॉफ्टवेयर डेवलपमेंट इंजीनियर हैं। वह अमेज़ॅन में कई चुनौतीपूर्ण उत्पादों पर काम कर रहा है, जिसमें उच्च प्रदर्शन एमएल अनुमान समाधान और उच्च प्रदर्शन लॉगिंग सिस्टम शामिल हैं। किंग की टीम ने बहुत कम विलंबता के साथ अमेज़ॅन विज्ञापन में पहला बिलियन-पैरामीटर मॉडल सफलतापूर्वक लॉन्च किया। किंग को इंफ्रास्ट्रक्चर ऑप्टिमाइजेशन और डीप लर्निंग एक्सेलेरेशन का गहन ज्ञान है।

किंग लैन एडब्ल्यूएस में सॉफ्टवेयर डेवलपमेंट इंजीनियर हैं। वह अमेज़ॅन में कई चुनौतीपूर्ण उत्पादों पर काम कर रहा है, जिसमें उच्च प्रदर्शन एमएल अनुमान समाधान और उच्च प्रदर्शन लॉगिंग सिस्टम शामिल हैं। किंग की टीम ने बहुत कम विलंबता के साथ अमेज़ॅन विज्ञापन में पहला बिलियन-पैरामीटर मॉडल सफलतापूर्वक लॉन्च किया। किंग को इंफ्रास्ट्रक्चर ऑप्टिमाइजेशन और डीप लर्निंग एक्सेलेरेशन का गहन ज्ञान है।

किंगवेई ली अमेज़न वेब सर्विसेज में मशीन लर्निंग स्पेशलिस्ट है। उन्होंने अपनी पीएच.डी. ऑपरेशन रिसर्च में जब उन्होंने अपने सलाहकार के अनुसंधान अनुदान खाते को तोड़ा और नोबेल पुरस्कार देने में असफल रहे, तो उन्होंने वादा किया था। वर्तमान में वह वित्तीय सेवा और बीमा उद्योग में ग्राहकों को AWS पर मशीन लर्निंग समाधान बनाने में मदद करता है। अपने खाली समय में, वह पढ़ना और पढ़ाना पसंद करते हैं।

किंगवेई ली अमेज़न वेब सर्विसेज में मशीन लर्निंग स्पेशलिस्ट है। उन्होंने अपनी पीएच.डी. ऑपरेशन रिसर्च में जब उन्होंने अपने सलाहकार के अनुसंधान अनुदान खाते को तोड़ा और नोबेल पुरस्कार देने में असफल रहे, तो उन्होंने वादा किया था। वर्तमान में वह वित्तीय सेवा और बीमा उद्योग में ग्राहकों को AWS पर मशीन लर्निंग समाधान बनाने में मदद करता है। अपने खाली समय में, वह पढ़ना और पढ़ाना पसंद करते हैं।

एलन तनु सेजमेकर के साथ एक वरिष्ठ उत्पाद प्रबंधक है जो बड़े मॉडल अनुमान पर अग्रणी प्रयास करता है। उन्हें एनालिटिक्स के क्षेत्र में मशीन लर्निंग को लागू करने का शौक है। काम के बाहर, वह बाहर का आनंद लेता है।

एलन तनु सेजमेकर के साथ एक वरिष्ठ उत्पाद प्रबंधक है जो बड़े मॉडल अनुमान पर अग्रणी प्रयास करता है। उन्हें एनालिटिक्स के क्षेत्र में मशीन लर्निंग को लागू करने का शौक है। काम के बाहर, वह बाहर का आनंद लेता है।

वरुण सयाल एडब्ल्यूएस सैजमेकर के साथ एक सॉफ्टवेयर डेवलपमेंट इंजीनियर है जो एमएल इनफेरेंस प्लेटफॉर्म के लिए महत्वपूर्ण ग्राहक सुविधाओं पर काम कर रहा है। उन्हें डिस्ट्रीब्यूटेड सिस्टम्स और एआई स्पेस में काम करने का शौक है। अपने खाली समय में उन्हें पढ़ना और बागवानी करना पसंद है।

वरुण सयाल एडब्ल्यूएस सैजमेकर के साथ एक सॉफ्टवेयर डेवलपमेंट इंजीनियर है जो एमएल इनफेरेंस प्लेटफॉर्म के लिए महत्वपूर्ण ग्राहक सुविधाओं पर काम कर रहा है। उन्हें डिस्ट्रीब्यूटेड सिस्टम्स और एआई स्पेस में काम करने का शौक है। अपने खाली समय में उन्हें पढ़ना और बागवानी करना पसंद है।

- एसईओ संचालित सामग्री और पीआर वितरण। आज ही प्रवर्धित हो जाओ।

- प्लेटोआईस्ट्रीम। Web3 डेटा इंटेलिजेंस। ज्ञान प्रवर्धित। यहां पहुंचें।

- मिंटिंग द फ्यूचर डब्ल्यू एड्रिएन एशले। यहां पहुंचें।

- PREIPO® के साथ PRE-IPO कंपनियों में शेयर खरीदें और बेचें। यहां पहुंचें।

- स्रोत: https://aws.amazon.com/blogs/machine-learning/achieve-high-performance-with-lowest-cost-for-generative-ai-inference-using-aws-inferentia2-and-aws-trainium-on-amazon-sagemaker/

- :हैस

- :है

- :नहीं

- :कहाँ

- $यूपी

- 10

- 100

- 12

- 13

- 14

- 15% तक

- 22

- 24

- 7

- 8

- 9

- a

- About

- त्वरक

- त्वरक

- स्वीकार करता है

- पहुँच

- लेखा

- पाना

- अर्जन

- के पार

- कार्य करता है

- जोड़ना

- इसके अलावा

- पता

- पता

- लाभ

- विज्ञापन

- बाद

- के खिलाफ

- AI

- ऐ मामलों का उपयोग करें

- ऐ / एमएल

- सब

- की अनुमति देता है

- भी

- हालांकि

- वीरांगना

- अमेज़ॅन EC2

- अमेज़न SageMaker

- अमेज़ॅन वेब सेवा

- an

- विश्लेषिकी

- और

- की घोषणा

- अन्य

- कोई

- एपीआई

- अनुप्रयोगों

- लागू

- दृष्टिकोण

- स्थापत्य

- हैं

- क्षेत्र

- कृत्रिम

- कृत्रिम बुद्धिमत्ता

- कृत्रिम बुद्धिमत्ता (AI)

- AS

- At

- ऑडियो

- स्वत:

- स्वतः

- उपलब्ध

- एडब्ल्यूएस

- एडब्ल्यूएस इन्फेंटेंटिया

- गेंद

- बैंडविड्थ

- अवरोध

- आधारित

- BE

- क्योंकि

- किया गया

- से पहले

- लाभ

- BEST

- के बीच

- बड़ा

- बड़ा

- अरबों

- खंड

- ब्लॉग

- फूल का खिलना

- संक्षिप्त

- तोड़ दिया

- निर्माण

- बनाया गया

- में निर्मित

- व्यवसायों

- by

- सी + +

- बुलाया

- कर सकते हैं

- मामलों

- चुनौतीपूर्ण

- chatbot

- चेक

- चिप्स

- कोड

- कोडन

- सामूहिक

- गठबंधन

- संयुक्त

- आता है

- संचार

- संचार

- तुलना

- संगत

- पूरा

- पूरी तरह से

- जटिल

- जटिलता

- घटकों

- व्यापक

- गणना

- गणना करना

- कंप्यूटर

- Computer Vision

- कंप्यूटिंग

- विन्यास

- जुड़ा हुआ

- कंटेनर

- कंटेनरों

- शामिल हैं

- सामग्री

- मूल

- लागत

- प्रभावी लागत

- लागत

- बनाना

- बनाया

- महत्वपूर्ण

- महत्वपूर्ण

- वर्तमान में

- ग्राहक

- ग्राहक

- अनुकूलित

- तिथि

- समर्पित

- गहरा

- ध्यान लगा के पढ़ना या सीखना

- चूक

- परिभाषित

- परिभाषित करता है

- डिग्री

- देरी

- उद्धार

- पहुंचाने

- बचाता है

- साबित

- निर्भर करता है

- तैनात

- तैनाती

- तैनाती

- विवरण

- खोज

- निर्धारित

- विकसित करना

- विकास

- युक्ति

- डिवाइस

- विभिन्न

- प्रसार

- सीधे

- वितरित

- वितरित अभिकलन

- वितरित प्रणाली

- वितरण

- कर

- डोमेन

- dont

- डाउनलोड

- डाउनलोड

- ड्राइवर

- गतिशील

- गतिशील

- से प्रत्येक

- पूर्व

- आसान

- सबसे आसान

- आसानी

- पूर्व

- कुशल

- कुशलता

- प्रयासों

- सक्षम बनाता है

- समाप्त

- endpoint

- इंजीनियर

- इंजन

- पर्याप्त

- सुनिश्चित

- में प्रवेश

- उद्यम

- प्रविष्टि

- बराबर

- मूल्यांकन करें

- और भी

- उदाहरण

- उत्तेजित

- महंगा

- अतिरिक्त

- चेहरा

- की सुविधा

- का सामना करना पड़

- विफल रहे

- और तेज

- Feature

- विशेषताएं

- पट्टिका

- वित्तीय

- वित्तीय सेवा

- खत्म

- प्रथम

- फिट

- प्रवाह

- प्रवाह

- फोकस

- ध्यान केंद्रित

- केंद्रित

- निम्नलिखित

- के लिए

- प्रपत्र

- प्रारूप

- चार

- ढांचा

- चौखटे

- धोखा

- धोखाधड़ी का पता लगाना

- से

- पूर्ण

- पूरी तरह से

- और भी

- उत्पन्न करता है

- पीढ़ी

- उत्पादक

- जनरेटिव एआई

- मिल

- Go

- अनुदान

- समूह की

- बढ़ रहा है

- हार्डवेयर

- है

- he

- स्वास्थ्य

- मदद

- मदद की

- मदद करता है

- यहाँ उत्पन्न करें

- हाई

- उच्च प्रदर्शन

- उच्चतर

- उसके

- पकड़े

- रखती है

- मेजबान

- होस्टिंग

- होस्टिंग सेवाएँ

- मकान

- कैसे

- How To

- तथापि

- एचटीएमएल

- http

- HTTPS

- हब

- मानव

- if

- की छवि

- छवियों

- कार्यान्वयन

- आयात

- in

- में गहराई

- शामिल

- शामिल

- सहित

- बढ़ना

- बढ़ती

- स्वतंत्र

- उद्योग

- इंफ्रास्ट्रक्चर

- innovating

- निवेश

- निविष्टियां

- स्थापना

- उदाहरण

- बीमा

- एकीकृत

- बुद्धि

- बातचीत

- बातचीत

- मध्यस्थ

- में

- लागू

- शामिल करना

- IT

- आईटी इस

- जापान

- काम

- में शामिल होने

- में शामिल हो गए

- जेपीजी

- JSON

- केवल

- जानना

- ज्ञान

- लैब्स

- भाषा

- बड़ा

- बड़े उद्यम

- बड़ा

- सबसे बड़ा

- विलंब

- शुभारंभ

- शुरूआत

- प्रमुख

- जानें

- सीख रहा हूँ

- लंबाई

- चलो

- पुस्तकालयों

- पुस्तकालय

- पसंद

- को यह पसंद है

- सीमित

- सूची

- एलएलएम

- भार

- लोड हो रहा है

- भार

- लॉगिंग

- निम्न

- कम

- सबसे कम

- मशीन

- यंत्र अधिगम

- मुख्यतः

- का कहना है

- बहुमत

- बनाना

- प्रबंधन

- कामयाब

- प्रबंधक

- मैप्स

- मैक्स

- अधिकतम

- याद

- तरीका

- ML

- एमएलओपीएस

- आदर्श

- मॉडल

- मॉड्यूल

- अधिक

- अधिक कुशल

- अधिकांश

- विभिन्न

- नाम

- प्राकृतिक

- प्राकृतिक भाषा संसाधन

- आवश्यक

- आवश्यकता

- की जरूरत है

- नया

- न्यूयॉर्क

- अगला

- NLP

- नोबेल पुरुस्कार

- नोटबुक

- अभी

- संख्या

- वस्तु

- of

- प्रस्ताव

- ऑफर

- अक्सर

- ओहियो

- on

- ONE

- केवल

- खुला स्रोत

- संचालन

- इष्टतमीकरण

- ऑप्टिमाइज़ करें

- अनुकूलित

- अनुकूलन

- विकल्प

- ऑप्शंस

- or

- संगठनों

- अन्य

- हमारी

- आउट

- सड़क पर

- उत्पादन

- बाहर

- अपना

- संकुल

- मिसाल

- समानांतर

- प्राचल

- पैरामीटर

- पास

- गुजरता

- आवेशपूर्ण

- प्रदर्शन

- निजीकरण

- मंच

- प्लेटो

- प्लेटो डेटा इंटेलिजेंस

- प्लेटोडाटा

- लगाना

- plugins

- बिन्दु

- लोकप्रिय

- पद

- बिजली

- संचालित

- शक्तिशाली

- अभ्यास

- शुद्धता

- भविष्यवाणियों

- Predictor

- वरीय

- प्रिंसिपल

- पुरस्कार

- समस्याओं

- प्रक्रिया

- प्रक्रियाओं

- प्रसंस्करण

- एस्ट्रो मॉल

- उत्पादन प्रबंधक

- उत्पाद

- प्रोफाइल

- परियोजनाओं

- वादा किया

- गुण

- संपत्ति

- प्रदान करना

- बशर्ते

- प्रदान करता है

- प्रदान कर

- उद्देश्य

- अजगर

- pytorch

- लेकर

- पहुंच

- पढ़ना

- तैयार

- असली दुनिया

- वास्तविक समय

- प्राप्त

- हाल

- मान्यता

- निर्दिष्ट

- सम्बंधित

- का अनुरोध

- अनुरोधों

- अपेक्षित

- आवश्यकता

- आवश्यकताएँ

- अनुसंधान

- शोधकर्ताओं

- उपयुक्त संसाधन चुनें

- प्रतिक्रियाएं

- जिसके परिणामस्वरूप

- वृद्धि

- रन

- sagemaker

- सेजमेकर अनुमान

- वही

- सहेजें

- स्केलिंग

- परिदृश्यों

- लिपियों

- एसडीके

- मूल

- सेकंड

- अनुभाग

- देखना

- वरिष्ठ

- अनुक्रम

- सेवा

- सेवा

- सेवाएँ

- सेवारत

- सेट

- सेटिंग्स

- व्यवस्था

- कई

- पाली

- चाहिए

- दिखाना

- प्रदर्शन

- दिखाया

- दिखाता है

- पक्ष

- काफी

- सिलिकॉन

- समान

- सरल

- एक

- छह

- आकार

- आकार

- So

- सॉफ्टवेयर

- सॉफ्टवेयर विकास

- समाधान

- समाधान ढूंढे

- अंतरिक्ष

- विशेषज्ञ

- विशेषीकृत

- भाषण

- वाक् पहचान

- स्थिर

- धुआँरा

- ढेर

- प्रारंभ

- शुरू

- शुरू होता है

- स्टार्टअप

- भंडारण

- कहानियों

- भंडारण

- बुद्धिसंगत

- अंदाज

- सफलतापूर्वक

- ऐसा

- समर्थन

- समर्थित

- समर्थन करता है

- प्रणाली

- सिस्टम

- ले जा

- शिक्षण

- टीम

- तकनीक

- टेक्नोलॉजी

- tensorflow

- परीक्षण

- से

- कि

- RSI

- क्षेत्र

- लेकिन हाल ही

- उन

- वहाँ।

- इन

- इसका

- तीन

- यहाँ

- THROUGHPUT

- पहर

- बार

- सेवा मेरे

- भी

- उपकरण

- ट्रेसिंग

- प्रशिक्षित

- प्रशिक्षण

- ट्रान्सफ़ॉर्मर

- मोड़

- दो

- टाइप

- ठेठ

- अपलोड की गई

- us

- उपयोग

- प्रयुक्त

- का उपयोग

- आमतौर पर

- उपयोग

- उपयोग

- मूल्य

- विविधता

- विभिन्न

- व्यापक

- बहुत

- के माध्यम से

- वीडियो

- वर्जीनिया

- दृष्टि

- प्रतीक्षा

- walkthrough

- मार्ग..

- we

- वेब

- वेब सेवाओं

- भार

- क्या

- कब

- कौन कौन से

- मर्जी

- साथ में

- अंदर

- बिना

- साक्षी

- शब्द

- काम

- काम किया

- काम कर रहे

- कार्य

- विश्व

- लिखना

- लिख रहे हैं

- यॉर्क

- आप

- आपका

- जेफिरनेट