आज हम की सामान्य उपलब्धता की घोषणा करते हैं Renate, स्वचालित मॉडल पुनर्प्रशिक्षण के लिए एक ओपन-सोर्स पायथन लाइब्रेरी। अधिक डेटा उपलब्ध होने पर पुस्तकालय एक तंत्रिका नेटवर्क को वृद्धिशील रूप से प्रशिक्षित करने में सक्षम निरंतर सीखने वाले एल्गोरिदम प्रदान करता है।

रेनेट को ओपन-सोर्स करके, हम एक ऐसा स्थान बनाना चाहते हैं जहां वास्तविक दुनिया मशीन लर्निंग सिस्टम पर काम करने वाले चिकित्सक और स्वचालित मशीन लर्निंग, निरंतर सीखने और आजीवन सीखने में कला की स्थिति को आगे बढ़ाने में रुचि रखने वाले शोधकर्ता एक साथ आएं। हमारा मानना है कि इन दो समुदायों के बीच तालमेल मशीन लर्निंग रिसर्च कम्युनिटी में नए विचार उत्पन्न करेगा और वास्तविक दुनिया के अनुप्रयोगों में एक ठोस सकारात्मक प्रभाव प्रदान करेगा।

मॉडल रिट्रेनिंग और भयावह भूल

तंत्रिका नेटवर्क को क्रमिक रूप से प्रशिक्षित करना कोई आसान काम नहीं है। व्यवहार में, समय के विभिन्न बिंदुओं पर प्रदान किए गए डेटा को अक्सर विभिन्न वितरणों से नमूना लिया जाता है। उदाहरण के लिए, प्रश्न-उत्तर प्रणाली में, प्रश्नों में विषयों का वितरण समय के साथ महत्वपूर्ण रूप से भिन्न हो सकता है। वर्गीकरण प्रणालियों में, दुनिया के विभिन्न हिस्सों में डेटा एकत्र किए जाने पर नई श्रेणियों को जोड़ने की आवश्यकता हो सकती है। इन मामलों में नए डेटा के साथ पहले से प्रशिक्षित मॉडल को फाइन-ट्यूनिंग करने से "विनाशकारी भूलने" नामक घटना हो सकती है। सबसे हाल के उदाहरणों पर अच्छा प्रदर्शन होगा, लेकिन अतीत में एकत्र किए गए डेटा के लिए किए गए पूर्वानुमानों की गुणवत्ता में काफी गिरावट आएगी। इसके अलावा, जब पुन: प्रशिक्षण संचालन नियमित रूप से होता है (उदाहरण के लिए, दैनिक या साप्ताहिक) तो प्रदर्शन में गिरावट और भी गंभीर हो जाएगी।

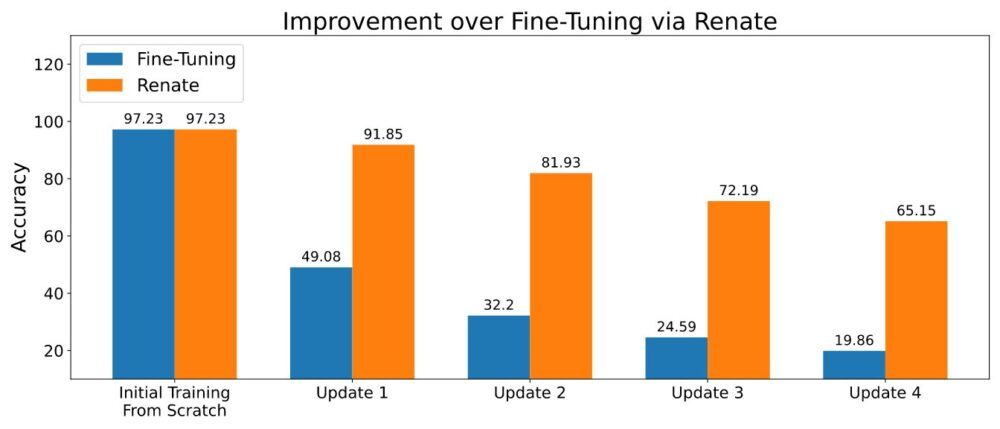

जब डेटा का एक छोटा सा हिस्सा संग्रहीत करना संभव होता है, तो पुनर्प्रशिक्षण के दौरान पुराने डेटा का पुन: उपयोग करने के आधार पर विधियां विनाशकारी भूलने की समस्या को आंशिक रूप से कम कर सकती हैं। इस विचार के बाद कई तरीके विकसित किए गए हैं। उनमें से कुछ केवल कच्चे डेटा को संग्रहित करते हैं, जबकि अधिक उन्नत वाले अतिरिक्त मेटाडेटा को भी सहेजते हैं (उदाहरण के लिए, स्मृति में डेटा बिंदुओं का मध्यवर्ती प्रतिनिधित्व)। डेटा की एक छोटी मात्रा (उदाहरण के लिए, हजारों डेटा बिंदु) संग्रहीत करना और उनका सावधानीपूर्वक उपयोग करने से नीचे दिए गए आंकड़े में बेहतर प्रदर्शन प्रदर्शित होता है।

अपना खुद का मॉडल और डेटासेट लाएँ

तंत्रिका नेटवर्क मॉडल को प्रशिक्षित करते समय, नेटवर्क संरचना, डेटा परिवर्तन और अन्य महत्वपूर्ण विवरणों को बदलना आवश्यक हो सकता है। जबकि कोड परिवर्तन सीमित हैं, यह एक जटिल कार्य बन सकता है जब ये मॉडल एक बड़े सॉफ़्टवेयर लाइब्रेरी का हिस्सा हों। इन असुविधाओं से बचने के लिए, रेनेट ग्राहकों को कॉन्फ़िगरेशन फ़ाइल के हिस्से के रूप में पूर्वनिर्धारित पायथन कार्यों में अपने मॉडल और डेटासेट को परिभाषित करने की क्षमता प्रदान करता है। यह ग्राहकों के कोड को बाकी लाइब्रेरी से स्पष्ट रूप से अलग रखने का लाभ है और ग्राहकों को रेनेट की आंतरिक संरचना के बारे में किसी भी जानकारी के बिना लाइब्रेरी का प्रभावी ढंग से उपयोग करने की अनुमति देता है।

इसके अलावा, मॉडल परिभाषा सहित सभी कार्य बहुत लचीले हैं। वास्तव में, मॉडल डेफिनिशन फ़ंक्शन उपयोगकर्ताओं को अपनी जरूरतों के अनुसार स्क्रैच से तंत्रिका नेटवर्क बनाने या ओपन-सोर्स लाइब्रेरी जैसे प्रसिद्ध मॉडल को तुरंत चालू करने की अनुमति देता है। ट्रान्सफ़ॉर्मर or मशाल. इसे केवल आवश्यकता फ़ाइल में आवश्यक निर्भरताएँ जोड़ने की आवश्यकता है।

कॉन्फ़िगरेशन फ़ाइल कैसे लिखें पर एक ट्यूटोरियल यहां उपलब्ध है कॉन्फ़िग फ़ाइल कैसे लिखें.

हाइपरपैरामीटर अनुकूलन का लाभ

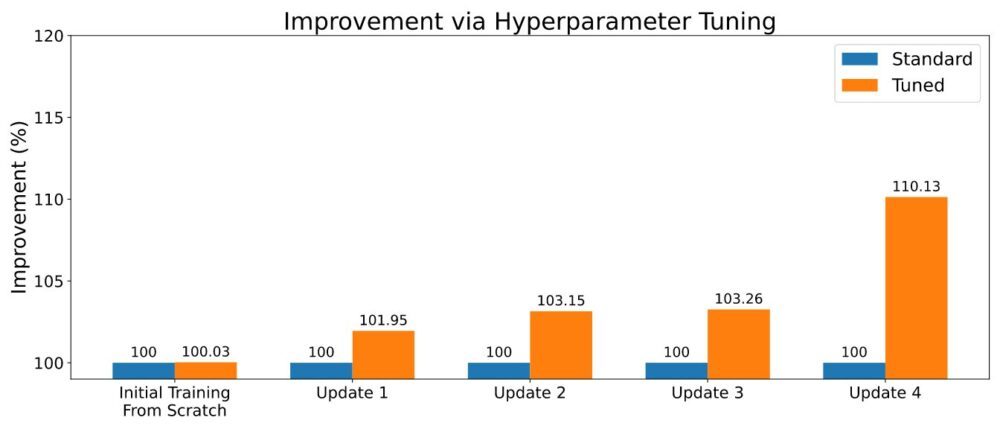

जैसा कि मशीन लर्निंग में अक्सर होता है, निरंतर सीखने वाले एल्गोरिदम कई हाइपरपैरामीटर के साथ आते हैं। इसकी सेटिंग्स समग्र प्रदर्शन में एक महत्वपूर्ण अंतर ला सकती हैं, और सावधानीपूर्वक ट्यूनिंग भविष्य कहनेवाला प्रदर्शन को सकारात्मक रूप से प्रभावित कर सकती है। एक नए मॉडल को प्रशिक्षित करते समय, Renate Amazon SageMaker पर कई समानांतर नौकरियों को चलाने की क्षमता का फायदा उठाने के लिए ASHA जैसे अत्याधुनिक एल्गोरिदम का उपयोग करके हाइपरपैरामीटर ऑप्टिमाइज़ेशन (HPO) को सक्षम कर सकता है। परिणामों का एक उदाहरण नीचे चित्र में प्रदर्शित किया गया है।

एचपीओ को सक्षम करने के लिए, उपयोगकर्ता को खोज स्थान को परिभाषित करने या पुस्तकालय के साथ उपलब्ध कराए गए डिफ़ॉल्ट खोज स्थानों में से एक का उपयोग करने की आवश्यकता होगी। पर उदाहरण देखें एचपीओ के साथ प्रशिक्षण कार्य चलाएं. जो ग्राहक तेजी से रीट्यूनिंग की तलाश कर रहे हैं, वे ट्रांसफर लर्निंग फंक्शनलिटीज के साथ एल्गोरिदम का चयन करके अपने पिछले ट्यूनिंग जॉब के परिणामों का लाभ उठा सकते हैं। इस तरह, ऑप्टिमाइज़र को सूचित किया जाएगा कि कौन से हाइपरपैरामीटर विभिन्न ट्यूनिंग नौकरियों में अच्छा प्रदर्शन कर रहे हैं और ट्यूनिंग समय को कम करते हुए उन पर ध्यान केंद्रित करने में सक्षम होंगे।

इसे क्लाउड में चलाएं

रेनेट उपयोगकर्ताओं को सैजमेकर का उपयोग करके बड़े पैमाने पर तंत्रिका नेटवर्क को प्रशिक्षित करने के लिए प्रयोग के लिए एक स्थानीय मशीन पर प्रशिक्षण मॉडल से जल्दी संक्रमण करने की अनुमति देता है। वास्तव में, स्थानीय मशीन पर प्रशिक्षण कार्य चलाना असामान्य है, खासकर जब बड़े पैमाने के मॉडल को प्रशिक्षित किया जाता है। उसी समय, विवरणों को सत्यापित करने और स्थानीय रूप से कोड का परीक्षण करने में सक्षम होना अत्यंत उपयोगी हो सकता है। इस आवश्यकता का उत्तर देने के लिए, रेनेट कॉन्फ़िगरेशन फ़ाइल में केवल एक साधारण ध्वज को बदलकर स्थानीय मशीन और सैजमेकर सेवा के बीच त्वरित स्विचिंग की अनुमति देता है।

उदाहरण के लिए, ट्यूनिंग जॉब लॉन्च करते समय, स्थानीय रूप से चलाना संभव है execute_tuning_job(..., backend='local') और जल्दी से SageMaker पर स्विच करें, कोड को निम्नानुसार बदलते हुए:

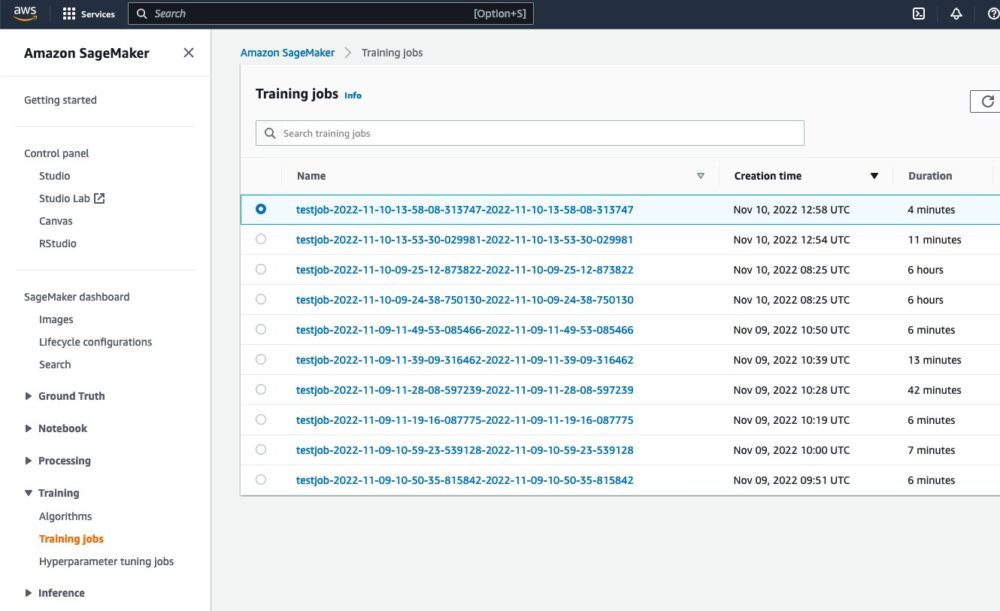

स्क्रिप्ट चलाने के बाद, SageMaker वेब इंटरफ़ेस से चल रहे कार्य को देखना संभव होगा:

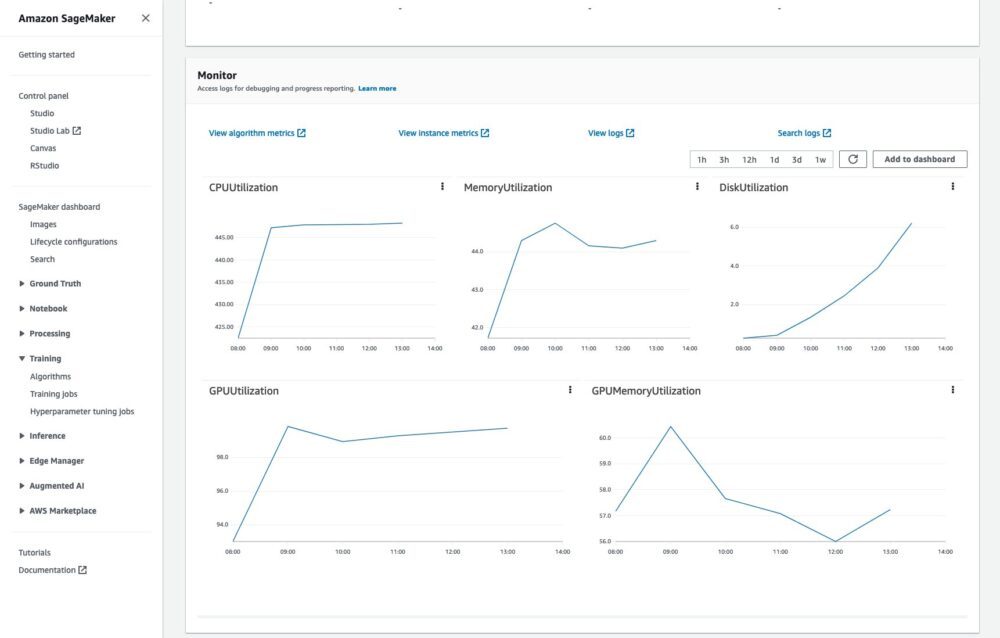

क्लाउडवॉच में प्रशिक्षण कार्य की निगरानी करना और लॉग पढ़ना भी संभव होगा:

यह सब बिना किसी अतिरिक्त कोड या प्रयास के।

क्लाउड में प्रशिक्षण कार्य चलाने का एक पूर्ण उदाहरण पर उपलब्ध है ट्रेनिंग जॉब कैसे चलाएं.

निष्कर्ष

इस पोस्ट में, हमने तंत्रिका नेटवर्क को फिर से प्रशिक्षित करने से जुड़ी समस्याओं और इस प्रक्रिया में रेनेट लाइब्रेरी के मुख्य लाभों का वर्णन किया है। पुस्तकालय के बारे में अधिक जानने के लिए, देखें गिटहब भंडार, जहां आपको इसका उच्च-स्तरीय अवलोकन मिलेगा पुस्तकालय और उसका एल्गोरिदम, के लिए निर्देश स्थापना, तथा उदाहरण जो आपको आरंभ करने में मदद कर सकता है।

हम आपकी प्रतीक्षा कर रहे हैं योगदान, फीडबैक और रुचि रखने वाले सभी के साथ इस पर आगे चर्चा करना, और पुस्तकालय को वास्तविक दुनिया के पुनर्प्रशिक्षण पाइपलाइनों में एकीकृत देखना।

लेखक के बारे में

जियोवन्नी ज़प्पेला एडब्ल्यूएस सैजमेकर में दीर्घकालिक विज्ञान पर काम कर रहे एक सीनियर एप्लाइड साइंटिस्ट हैं। वह वर्तमान में निरंतर सीखने, मॉडल निगरानी और AutoML पर काम करता है। इससे पहले उन्होंने Amazon Music में बड़े पैमाने की अनुशंसा प्रणाली के लिए मल्टी-आर्म्ड बैंडिट्स के एप्लिकेशन पर काम किया था।

जियोवन्नी ज़प्पेला एडब्ल्यूएस सैजमेकर में दीर्घकालिक विज्ञान पर काम कर रहे एक सीनियर एप्लाइड साइंटिस्ट हैं। वह वर्तमान में निरंतर सीखने, मॉडल निगरानी और AutoML पर काम करता है। इससे पहले उन्होंने Amazon Music में बड़े पैमाने की अनुशंसा प्रणाली के लिए मल्टी-आर्म्ड बैंडिट्स के एप्लिकेशन पर काम किया था।

मार्टिन विस्तुबा एडब्ल्यूएस सैजमेकर में दीर्घकालिक विज्ञान टीम में एक अनुप्रयुक्त वैज्ञानिक हैं। उनका शोध स्वचालित मशीन लर्निंग पर केंद्रित है।

मार्टिन विस्तुबा एडब्ल्यूएस सैजमेकर में दीर्घकालिक विज्ञान टीम में एक अनुप्रयुक्त वैज्ञानिक हैं। उनका शोध स्वचालित मशीन लर्निंग पर केंद्रित है।

लुकास बॉल्स AWS में एप्लाइड साइंटिस्ट हैं। वह निरंतर सीखने और मॉडल निगरानी से संबंधित विषयों पर काम करता है।

लुकास बॉल्स AWS में एप्लाइड साइंटिस्ट हैं। वह निरंतर सीखने और मॉडल निगरानी से संबंधित विषयों पर काम करता है।

सेड्रिक आर्कमब्यू एडब्ल्यूएस में प्रिंसिपल एप्लाइड साइंटिस्ट और लर्निंग एंड इंटेलिजेंट सिस्टम के लिए यूरोपीय लैब के फेलो हैं।

सेड्रिक आर्कमब्यू एडब्ल्यूएस में प्रिंसिपल एप्लाइड साइंटिस्ट और लर्निंग एंड इंटेलिजेंट सिस्टम के लिए यूरोपीय लैब के फेलो हैं।

- उन्नत (300)

- AI

- ai कला

- ऐ कला जनरेटर

- ऐ रोबोट

- अमेज़न SageMaker

- कृत्रिम बुद्धिमत्ता

- कृत्रिम बुद्धिमत्ता प्रमाणन

- बैंकिंग में आर्टिफिशियल इंटेलिजेंस

- आर्टिफिशियल इंटेलिजेंस रोबोट

- आर्टिफिशियल इंटेलिजेंस रोबोट

- कृत्रिम बुद्धि सॉफ्टवेयर

- AWS मशीन लर्निंग

- blockchain

- ब्लॉकचेन सम्मेलन एआई

- कॉइनजीनियस

- संवादी कृत्रिम बुद्धिमत्ता

- क्रिप्टो सम्मेलन एआई

- दल-ए

- ध्यान लगा के पढ़ना या सीखना

- इसे गूगल करें

- यंत्र अधिगम

- प्लेटो

- प्लेटो एआई

- प्लेटो डेटा इंटेलिजेंस

- प्लेटो गेम

- प्लेटोडाटा

- प्लेटोगेमिंग

- स्केल एआई

- वाक्यविन्यास

- जेफिरनेट