अमेज़ॅन इलास्टिक कम्प्यूट क्लाउड (अमेजन EC2) जी 5 उदाहरण क्लाउड में NVIDIA A10G Tensor Core GPU की सुविधा देने वाले पहले और एकमात्र उदाहरण हैं, जिनका उपयोग आप ग्राफ़िक्स-इंटेंसिव और मशीन लर्निंग (ML) उपयोग मामलों की एक विस्तृत श्रृंखला के लिए कर सकते हैं। G5 उदाहरणों के साथ, ML ग्राहकों को प्राकृतिक भाषा प्रसंस्करण (NLP), कंप्यूटर विज़न (CV), और अनुशंसाकर्ता इंजन उपयोग के मामलों के लिए बड़े और अधिक परिष्कृत मॉडल को प्रशिक्षित और तैनात करने के लिए उच्च प्रदर्शन और एक लागत प्रभावी बुनियादी ढांचा मिलता है।

इस पोस्ट का उद्देश्य बड़े पैमाने पर एमएल इंट्रेंस वर्कलोड के लिए G5 इंस्टेंस के प्रदर्शन लाभों को प्रदर्शित करना है। हम G4dn उदाहरणों के साथ NLP और CV मॉडल के लिए मूल्य-प्रदर्शन ($ प्रति मिलियन अनुमान के रूप में मापा गया) की तुलना करके ऐसा करते हैं। हम अपने बेंचमार्किंग दृष्टिकोण का वर्णन करके शुरू करते हैं और फिर बैच आकार और डेटा प्रकार परिशुद्धता में थ्रूपुट बनाम विलंबता वक्र प्रस्तुत करते हैं। G4dn उदाहरणों की तुलना में, हम पाते हैं कि G5 इंस्टेंस उच्च थ्रूपुट और कम विलंबता प्राप्त करते हुए NLP और CV मॉडल के लिए पूर्ण परिशुद्धता और मिश्रित सटीक मोड दोनों के लिए लगातार कम लागत प्रति मिलियन अनुमान प्रदान करते हैं।

बेंचमार्किंग दृष्टिकोण

G5 और G4dn के बीच मूल्य-प्रदर्शन अध्ययन विकसित करने के लिए, हमें बैच आकार के एक फ़ंक्शन के रूप में थ्रूपुट, विलंबता और लागत प्रति मिलियन अनुमानों को मापने की आवश्यकता है। हम पूर्ण परिशुद्धता बनाम मिश्रित परिशुद्धता के प्रभाव का भी अध्ययन करते हैं। मॉडल ग्राफ और इनपुट दोनों को अनुमान लगाने से पहले CUDA में लोड किया जाता है।

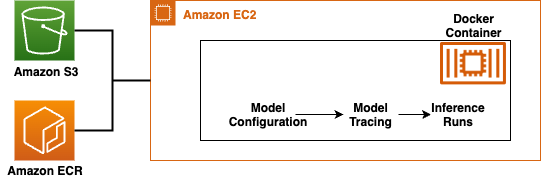

जैसा कि निम्नलिखित आर्किटेक्चर आरेख में दिखाया गया है, हम पहले अंतर्निहित EC2 इंस्टेंस (G4dn, G5) के लिए CUDA के साथ संबंधित बेस कंटेनर इमेज बनाते हैं। बेस कंटेनर इमेज बनाने के लिए, हम शुरुआत करते हैं AWS डीप लर्निंग कंटेनर, जो मिनटों में गहन शिक्षण वातावरण को परिनियोजित करने के लिए पूर्व-पैक डॉकर छवियों का उपयोग करते हैं। छवियों में आवश्यक गहन शिक्षण PyTorch पुस्तकालय और उपकरण हैं। निगरानी, अनुपालन और डेटा प्रोसेसिंग पर उच्च स्तर के नियंत्रण के लिए आप इन छवियों के शीर्ष पर अपने स्वयं के पुस्तकालय और उपकरण जोड़ सकते हैं।

फिर हम एक मॉडल-विशिष्ट कंटेनर छवि बनाते हैं जो आगे के पास चलाने के लिए मॉडल कॉन्फ़िगरेशन, मॉडल ट्रेसिंग और संबंधित कोड को समाहित करता है। सभी कंटेनर छवियों को में लोड किया जाता है अमेज़न ईसीआर विभिन्न मॉडल कॉन्फ़िगरेशन के लिए इन मॉडलों के क्षैतिज स्केलिंग की अनुमति देने के लिए। हम उपयोग करते हैं अमेज़न सरल भंडारण सेवा (अमेज़ॅन S3) कॉन्फ़िगरेशन को डाउनलोड करने और सारांश के लिए बेंचमार्क परिणाम अपलोड करने के लिए एक सामान्य डेटा स्टोर के रूप में। आप बेंचमार्क परिणामों को फिर से बनाने और पुन: पेश करने के लिए इस आर्किटेक्चर का उपयोग कर सकते हैं और ईसी 2 इंस्टेंस प्रकारों (सीपीयू, जीपीयू, इंफ 1) में विभिन्न मॉडल प्रकारों (जैसे हगिंग फेस मॉडल, पायटॉर्च मॉडल, अन्य कस्टम मॉडल) को बेंचमार्क करने के लिए पुन: उपयोग कर सकते हैं।

इस प्रयोग की स्थापना के साथ, हमारा लक्ष्य थ्रूपुट के एक कार्य के रूप में विलंबता का अध्ययन करना है। एप्लिकेशन डिज़ाइन के लिए लक्ष्य एप्लिकेशन के लिए लागत-इष्टतम बुनियादी ढांचे तक पहुंचने के लिए यह वक्र महत्वपूर्ण है। इसे प्राप्त करने के लिए, हम कई थ्रेड्स से प्रश्नों को कतारबद्ध करके और फिर प्रत्येक पूर्ण अनुरोध के लिए राउंड-ट्रिप समय को मापकर विभिन्न भारों का अनुकरण करते हैं। थ्रूपुट को प्रति यूनिट घड़ी समय में पूर्ण अनुरोधों की संख्या के आधार पर मापा जाता है। इसके अलावा, आप सांकेतिक प्रदर्शन मेट्रिक्स पर पहुंचने के लिए डिज़ाइन स्पेस को व्यापक रूप से स्वीप करने के लिए बैच आकार और अनुक्रम लंबाई और पूर्ण परिशुद्धता बनाम आधा परिशुद्धता जैसे अन्य चर बदल सकते हैं। हमारे अध्ययन में, बैच आकार के पैरामीट्रिक स्वीप और बहु-थ्रेडेड क्लाइंट से प्रश्नों के माध्यम से, थ्रूपुट बनाम विलंबता वक्र निर्धारित किया जाता है। त्वरक के पूर्ण उपयोग को सुनिश्चित करने के लिए प्रत्येक अनुरोध को बैच किया जा सकता है, विशेष रूप से छोटे अनुरोधों के लिए जो कंप्यूट नोड का पूरी तरह से उपयोग नहीं कर सकते हैं। आप इष्टतम प्रदर्शन के लिए क्लाइंट-साइड बैच आकार की पहचान करने के लिए भी इस सेटअप को अपना सकते हैं।

संक्षेप में, हम इस समस्या का गणितीय रूप से प्रतिनिधित्व कर सकते हैं: (थ्रूपुट, लेटेंसी) = फ़ंक्शन (बैच आकार, थ्रेड्स की संख्या, प्रेसिजन)।

इसका मतलब है, संपूर्ण स्थान को देखते हुए, प्रयोगों की संख्या बड़ी हो सकती है। सौभाग्य से, प्रत्येक प्रयोग स्वतंत्र रूप से चलाया जा सकता है। हम उपयोग करने की सलाह देते हैं AWS बैच परीक्षण के लिए एक रैखिक दृष्टिकोण की तुलना में बेंचमार्किंग लागत में वृद्धि के बिना संपीड़ित समय में क्षैतिज रूप से स्केल किए गए बेंचमार्किंग को निष्पादित करने के लिए। परिणामों को दोहराने के लिए कोड मौजूद है गिटहब भंडार AWS Re:Invent 2021 के लिए तैयार किया गया है। विभिन्न त्वरक पर बेंचमार्किंग करने के लिए भंडार व्यापक है। आप कंटेनर बनाने के लिए कोड के GPU पहलू का उल्लेख कर सकते हैं (Dockerfile-gpu) और फिर अंदर के कोड को देखें Container-Root BERT और ResNet50 के विशिष्ट उदाहरणों के लिए।

हमने दो मॉडल प्रकारों में प्रदर्शन अध्ययन विकसित करने के लिए पूर्ववर्ती दृष्टिकोण का उपयोग किया: बर्ट-बेस-अनकेस्ड (110 मिलियन पैरामीटर, एनएलपी) और रेसनेट 50 (25.6 मिलियन पैरामीटर, सीवी)। निम्न तालिका मॉडल विवरण को सारांशित करती है।

| मॉडल प्रकार | आदर्श | विवरण |

| एनएलपी | twmkn9/बर्ट-बेस-अनकेस्ड-स्क्वाड2 | 110 मिलियन पैरामीटर अनुक्रम लंबाई = 128 |

| CV | रेसनेट50 | 25.6 मिलियन पैरामीटर |

इसके अतिरिक्त, डेटा प्रकारों (पूर्ण, आधी परिशुद्धता) में बेंचमार्क करने के लिए, हम उपयोग करते हैं torch.cuda.amp, जो मिश्रित परिशुद्धता को संभालने के लिए सुविधाजनक तरीके प्रदान करता है जहां कुछ संचालन उपयोग करते हैं torch.float32 (फ्लोट) डेटा प्रकार और अन्य संचालन उपयोग torch.float16 (आधा)। उदाहरण के लिए, लीनियर लेयर्स और कनवल्शन जैसे ऑपरेटर्स फ्लोट16 के साथ बहुत तेज होते हैं, जबकि अन्य जैसे रिडक्शन को अक्सर फ्लोट 32 की डायनेमिक रेंज की आवश्यकता होती है। स्वचालित मिश्रित परिशुद्धता नेटवर्क के रनटाइम और मेमोरी फ़ुटप्रिंट को अनुकूलित करने के लिए प्रत्येक ऑपरेटर को उसके उपयुक्त डेटा प्रकार से मिलाने का प्रयास करती है।

बेंचमार्किंग परिणाम

निष्पक्ष तुलना के लिए, हमने चुना G4dn.4xबड़ा और G5.4xबड़ा समान विशेषताओं वाले उदाहरण, जैसा कि निम्न तालिका में सूचीबद्ध है।

| उदाहरण | GPUs | जीपीयू मेमोरी (जीआईबी) | वीसीपीयू | मेमोरी (जीआईबी) | इंस्टेंस स्टोरेज (GB) | नेटवर्क प्रदर्शन (जीबीपीएस) | ईबीएस बैंडविड्थ (जीबीपीएस) | लिनक्स ऑन-डिमांड प्राइसिंग (यूएस-ईस्ट-1) |

| G5.4xबड़ा | 1 | 24 | 16 | 64 | 1x 600 एनवीएमई एसएसडी | ऊपर 25 को | 8 | 1.204 घंटे $ / |

| G4dn.4xबड़ा | 1 | 16 | 16 | 64 | 1x 225 एनवीएमई एसएसडी | ऊपर 25 को | 4.75 | 1.624 घंटे $ / |

निम्नलिखित अनुभागों में, हम विशिष्ट बैच आकार (50, 32, 16, 8, 4) के लिए ग्रिड स्वीप दृष्टिकोण के साथ BERT और RESNET1 मॉडल के एमएल अनुमान प्रदर्शन की तुलना करते हैं और थ्रूपुट पर पहुंचने के लिए डेटा प्रकार परिशुद्धता (पूर्ण और आधा सटीक) बनाम विलंबता वक्र। इसके अतिरिक्त, हम पूर्ण और आधी सटीकता दोनों के लिए थ्रूपुट बनाम बैच आकार के प्रभाव की जांच करते हैं। अंत में, हम बैच आकार के फलन के रूप में लागत प्रति मिलियन अनुमानों को मापते हैं। इन प्रयोगों के समेकित परिणामों को बाद में इस पोस्ट में संक्षेपित किया गया है।

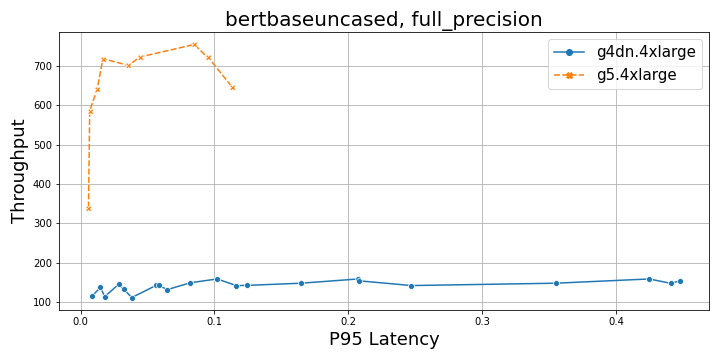

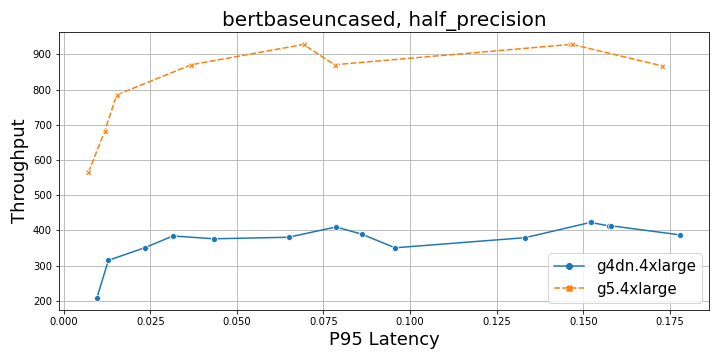

थ्रूपुट बनाम विलंबता

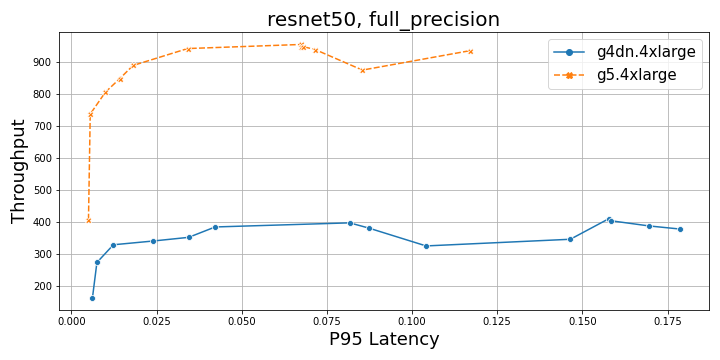

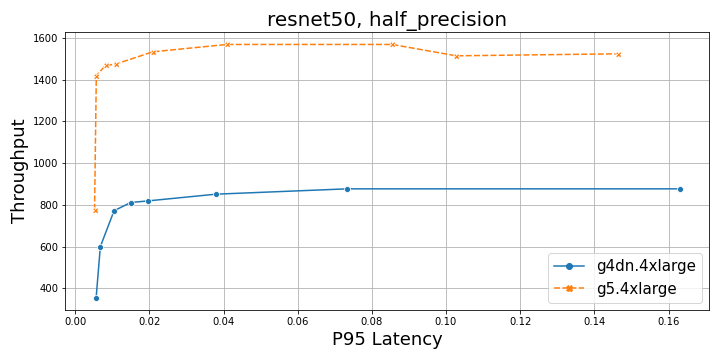

निम्नलिखित आंकड़े NLP और CV वर्कलोड के लिए G4dn और G5 इंस्टेंस की तुलना पूर्ण और आधी सटीकता के साथ करते हैं। G4dn इंस्टेंस की तुलना में, G5 इंस्टेंस BERT बेस मॉडल के लिए लगभग पांच गुना अधिक (पूर्ण परिशुद्धता) और लगभग 2.5 गुना अधिक (आधा सटीक) का थ्रूपुट प्रदान करता है, और एक ResNet2 मॉडल के लिए लगभग 2.5-50 गुना अधिक होता है। कुल मिलाकर, G5 एक पसंदीदा विकल्प है, जिसमें प्रदर्शन के दृष्टिकोण से पूर्ण और मिश्रित सटीकता दोनों के लिए दोनों मॉडलों के लिए बढ़ते बैच आकार हैं।

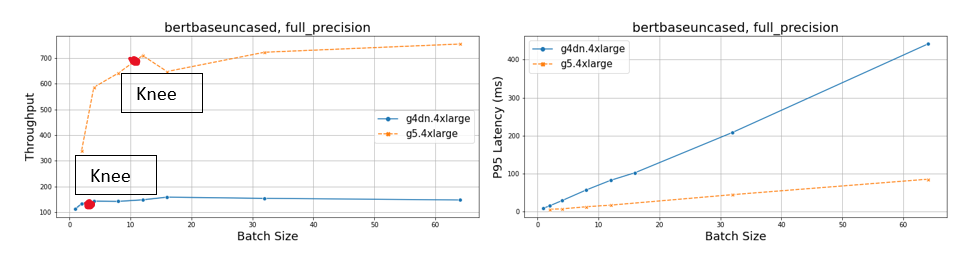

निम्नलिखित ग्राफ़ BERT के लिए पूर्ण और आधी सटीकता पर थ्रूपुट और P95 विलंबता की तुलना करते हैं।

|

|

निम्नलिखित ग्राफ़ ResNet95 के लिए पूर्ण और आधी सटीकता पर थ्रूपुट और P50 विलंबता की तुलना करते हैं।

|

|

थ्रूपुट और विलंबता बनाम बैच आकार

निम्नलिखित ग्राफ़ बैच आकार के एक फ़ंक्शन के रूप में थ्रूपुट दिखाते हैं। कम बैच आकारों में, त्वरक अपनी पूरी क्षमता से काम नहीं कर रहा है और जैसे-जैसे बैच का आकार बढ़ता है, विलंबता की कीमत पर थ्रूपुट बढ़ जाता है। थ्रूपुट वक्र अधिकतम मूल्य के लिए स्पर्शोन्मुख है जो त्वरक प्रदर्शन का एक कार्य है। वक्र की दो अलग-अलग विशेषताएं हैं: एक उभरता हुआ खंड और एक सपाट स्पर्शोन्मुख खंड। किसी दिए गए मॉडल के लिए, एक प्रदर्शन त्वरक (G5) बढ़ते खंड को G4dn की तुलना में उच्च बैच आकार और उच्च थ्रूपुट पर स्पर्शोन्मुख करने में सक्षम है। इसके अलावा, विलंबता और बैच आकार के बीच एक रैखिक व्यापार-बंद है। इसलिए, यदि एप्लिकेशन विलंबता बाध्य है, तो हम इष्टतम बैच आकार निर्धारित करने के लिए P95 विलंबता बनाम बैच आकार का उपयोग कर सकते हैं। हालांकि, यदि उद्देश्य न्यूनतम विलंबता पर थ्रूपुट को अधिकतम करना है, तो बढ़ते और स्पर्शोन्मुख वर्गों के बीच "घुटने" के अनुरूप बैच आकार का चयन करना बेहतर है, क्योंकि बैच आकार में किसी भी और वृद्धि के परिणामस्वरूप एक ही थ्रूपुट होगा बदतर विलंबता। सर्वोत्तम मूल्य-प्रदर्शन अनुपात प्राप्त करने के लिए, न्यूनतम विलंबता पर उच्च थ्रूपुट को लक्षित करने के लिए, आप बैच आकार को बढ़ाने के बजाय कई अनुमान सर्वरों के माध्यम से इस इष्टतम को क्षैतिज रूप से स्केल करना बेहतर समझते हैं।

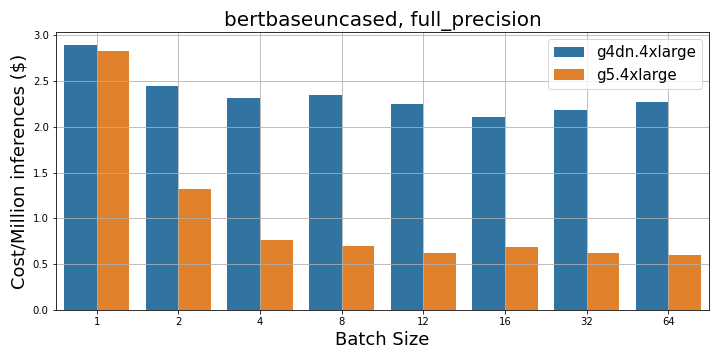

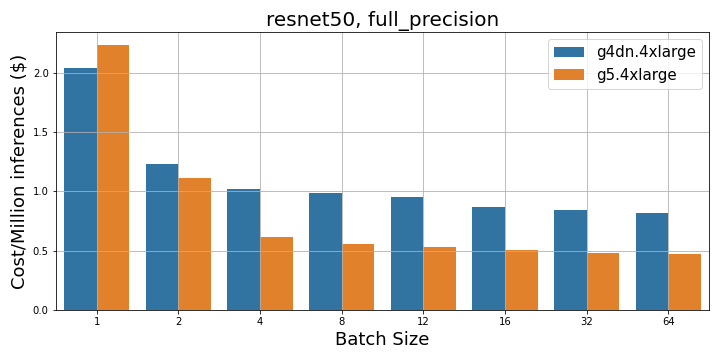

लागत बनाम बैच आकार

इस खंड में, हम अनुमान लागत ($ प्रति मिलियन अनुमान) बनाम बैच आकार के तुलनात्मक परिणाम प्रस्तुत करते हैं। निम्नलिखित आंकड़े से, हम स्पष्ट रूप से देख सकते हैं कि G5 बनाम G4dn दोनों (पूर्ण और आधी सटीकता) के साथ लागत ($ प्रति मिलियन अनुमान के रूप में मापा जाता है) लगातार कम है।

|

|

निम्न तालिका विशिष्ट बैच आकारों के लिए दोनों सटीक मोड में BERT और RESNET50 मॉडल के लिए थ्रूपुट, विलंबता और लागत ($ प्रति मिलियन अनुमान) की तुलना करती है। प्रति उदाहरण एक उच्च लागत के बावजूद, G5 सभी बैच आकारों के लिए अनुमान विलंबता, थ्रूपुट, और लागत ($ प्रति मिलियन अनुमान) के सभी पहलुओं में लगातार G4dn से बेहतर प्रदर्शन करता है। अलग-अलग मेट्रिक्स को लागत ($ प्रति मिलियन अनुमान) में मिलाना, BERT मॉडल (32 बैच आकार, पूर्ण परिशुद्धता) G5 के साथ G3.7dn की तुलना में 4 गुना अधिक अनुकूल है, और ResNet50 मॉडल (32 बैच आकार, पूर्ण परिशुद्धता) के साथ, यह 1.6 है। G4dn से कई गुना अधिक अनुकूल।

| आदर्श | बैच का आकार | शुद्धता |

प्रवाह (बैच आकार X अनुरोध/सेकंड) |

लेटेंसी (एमएस) |

$/मिलियन अनुमान (ऑन-डिमांड) |

लागत लाभ (G5 से अधिक G4dn) |

|||

| . | . | . | G5 | G4dn | G5 | G4dn | G5 | G4dn | |

| बर्ट-बेस-बिना आवरण | 32 | पूर्ण | 723 | 154 | 44 | 208 | $0.6 | $2.2 | 3.7X |

| मिश्रित | 870 | 410 | 37 | 79 | $0.5 | $0.8 | 1.6X | ||

| 16 | पूर्ण | 651 | 158 | 25 | 102 | $0.7 | $2.1 | 3.0X | |

| मिश्रित | 762 | 376 | 21 | 43 | $0.6 | $0.9 | 1.5X | ||

| 8 | पूर्ण | 642 | 142 | 13 | 57 | $0.7 | $2.3 | 3.3X | |

| मिश्रित | 681 | 350 | 12 | 23 | $0.7 | $1.0 | 1.4X | ||

| . | 1 | पूर्ण | 160 | 116 | 6 | 9 | $2.8 | $2.9 | 1.0X |

| मिश्रित | 137 | 102 | 7 | 10 | $3.3 | $3.3 | 1.0X | ||

| रेसनेट50 | 32 | पूर्ण | 941 | 397 | 34 | 82 | $0.5 | $0.8 | 1.6X |

| मिश्रित | 1533 | 851 | 21 | 38 | $0.3 | $0.4 | 1.3X | ||

| 16 | पूर्ण | 888 | 384 | 18 | 42 | $0.5 | $0.9 | 1.8X | |

| मिश्रित | 1474 | 819 | 11 | 20 | $0.3 | $0.4 | 1.3X | ||

| 8 | पूर्ण | 805 | 340 | 10 | 24 | $0.6 | $1.0 | 1.7X | |

| मिश्रित | 1419 | 772 | 6 | 10 | $0.3 | $0.4 | 1.3X | ||

| . | 1 | पूर्ण | 202 | 164 | 5 | 6 | $2.2 | $2 | 0.9X |

| मिश्रित | 196 | 180 | 5 | 6 | $2.3 | $1.9 | 0.8X | ||

अतिरिक्त अनुमान बेंचमार्क

पिछले अनुभागों में BERT आधार और ResNet50 परिणामों के अलावा, हम PyTorch में अन्य सामान्य रूप से उपयोग किए जाने वाले बड़े NLP और CV मॉडल के लिए अतिरिक्त बेंचमार्किंग परिणाम प्रस्तुत करते हैं। G5 की तुलना में G4dn के प्रदर्शन लाभ को BERT लार्ज मॉडल्स के लिए विभिन्न सटीकता पर प्रस्तुत किया गया है, और Yolo-v5 मॉडल विभिन्न आकारों के लिए प्रस्तुत किए गए हैं। बेंचमार्क को दोहराने के लिए कोड के लिए, देखें Tensor Cores के लिए NVIDIA डीप लर्निंग उदाहरण. ये परिणाम विभिन्न मॉडल प्रकारों में फैले अनुमान कार्यों की एक विस्तृत श्रृंखला के लिए G5dn पर G4 का उपयोग करने के लाभ को दर्शाते हैं।

| आदर्श | शुद्धता | बैच का आकार | अनुक्रम लंबाई | थ्रूपुट (भेजा/सेकंड) | थ्रूपुट: G4dn | G4dn . पर स्पीडअप |

| BERT-बड़ा | FP16 | 1 | 128 | 93.5 | 40.31 | 2.3 |

| BERT-बड़ा | FP16 | 4 | 128 | 264.2 | 87.4 | 3.0 |

| BERT-बड़ा | FP16 | 8 | 128 | 392.1 | 107.5 | 3.6 |

| BERT-बड़ा | FP32 | 1 | 128 | 68.4 | 22.67 | 3.0 |

| BERT-बड़ा | 4 | 128 | 118.5 | 32.21 | 3.7 | |

| BERT-बड़ा | 8 | 128 | 132.4 | 34.67 | 3.8 |

| आदर्श | GFLOPS | पैरामीटर्स की संख्या | प्रीप्रोसेसिंग (एमएस) | अनुमान (एमएस) | अनुमान (गैर-अधिकतम-दमन) (एनएमएस/छवि) |

| YOLOv5s | 16.5 | 7.2M | 0.2 | 3.6 | 4.5 |

| YOLOv5m | 49.1 | 21M | 0.2 | 6.5 | 4.5 |

| YOLOv5l | 109.3 | 46M | 0.2 | 9.1 | 3.5 |

| YOLOv5x | 205.9 | 86M | 0.2 | 14.4 | 1.3 |

निष्कर्ष

इस पोस्ट में, हमने दिखाया कि बड़े NLP और CV PyTorch मॉडल के अनुमान के लिए, EC2 G5 इंस्टेंस G4dn इंस्टेंस की तुलना में बेहतर विकल्प हैं। हालांकि G5 इंस्टेंस के लिए ऑन-डिमांड प्रति घंटा लागत G4dn इंस्टेंस से अधिक है, इसका उच्च प्रदर्शन NLP और CV मॉडल के लिए किसी भी सटीकता पर 2-5 गुना थ्रूपुट प्राप्त कर सकता है, जो लागत प्रति मिलियन अनुमानों की तुलना में 1.5-3.5 गुना अधिक अनुकूल बनाता है। G4dn उदाहरण। विलंबता बाध्य अनुप्रयोगों के लिए भी, G5 NLP और CV मॉडल के लिए G2.5dn से 5-4 गुना बेहतर है।

संक्षेप में, AWS G5 इंस्टेंस प्रदर्शन और लागत प्रति अनुमान के दृष्टिकोण से आपकी अनुमान आवश्यकताओं के लिए एक उत्कृष्ट विकल्प हैं। CUDA ढांचे की सार्वभौमिकता और AWS पर G5 इंस्टेंस पूल का पैमाना और गहराई आपको पैमाने पर अनुमान लगाने की एक अद्वितीय क्षमता प्रदान करती है।

लेखक के बारे में

अंकुर श्रीवास्तव एमएल फ्रेमवर्क टीम में सीनियर सॉल्यूशंस आर्किटेक्ट हैं। वह AWS के पैमाने पर स्व-प्रबंधित वितरित प्रशिक्षण और अनुमान के साथ ग्राहकों की मदद करने पर ध्यान केंद्रित करता है। उनके अनुभव में औद्योगिक भविष्य कहनेवाला रखरखाव, डिजिटल जुड़वाँ, संभाव्य डिजाइन अनुकूलन शामिल हैं और उन्होंने राइस विश्वविद्यालय में मैकेनिकल इंजीनियरिंग से डॉक्टरेट की पढ़ाई पूरी की है और मैसाचुसेट्स इंस्टीट्यूट ऑफ टेक्नोलॉजी से डॉक्टरेट के बाद का शोध किया है।

अंकुर श्रीवास्तव एमएल फ्रेमवर्क टीम में सीनियर सॉल्यूशंस आर्किटेक्ट हैं। वह AWS के पैमाने पर स्व-प्रबंधित वितरित प्रशिक्षण और अनुमान के साथ ग्राहकों की मदद करने पर ध्यान केंद्रित करता है। उनके अनुभव में औद्योगिक भविष्य कहनेवाला रखरखाव, डिजिटल जुड़वाँ, संभाव्य डिजाइन अनुकूलन शामिल हैं और उन्होंने राइस विश्वविद्यालय में मैकेनिकल इंजीनियरिंग से डॉक्टरेट की पढ़ाई पूरी की है और मैसाचुसेट्स इंस्टीट्यूट ऑफ टेक्नोलॉजी से डॉक्टरेट के बाद का शोध किया है।

सुंदर रंगनाथन Amazon EC2 टीम में बिजनेस डेवलपमेंट, एमएल फ्रेमवर्क के प्रमुख हैं। वह अमेज़ॅन ईकेएस, अमेज़ॅन ईसीएस, इलास्टिक फैब्रिक एडेप्टर, एडब्ल्यूएस बैच और अमेज़ॅन सेजमेकर जैसी एडब्ल्यूएस सेवाओं में बड़े पैमाने पर एमएल वर्कलोड पर ध्यान केंद्रित करता है। उनके अनुभव में नेटएप, माइक्रोन टेक्नोलॉजी, क्वालकॉम और मेंटर ग्राफिक्स में उत्पाद प्रबंधन और उत्पाद विकास में नेतृत्व की भूमिकाएं शामिल हैं।

सुंदर रंगनाथन Amazon EC2 टीम में बिजनेस डेवलपमेंट, एमएल फ्रेमवर्क के प्रमुख हैं। वह अमेज़ॅन ईकेएस, अमेज़ॅन ईसीएस, इलास्टिक फैब्रिक एडेप्टर, एडब्ल्यूएस बैच और अमेज़ॅन सेजमेकर जैसी एडब्ल्यूएस सेवाओं में बड़े पैमाने पर एमएल वर्कलोड पर ध्यान केंद्रित करता है। उनके अनुभव में नेटएप, माइक्रोन टेक्नोलॉजी, क्वालकॉम और मेंटर ग्राफिक्स में उत्पाद प्रबंधन और उत्पाद विकास में नेतृत्व की भूमिकाएं शामिल हैं।

महादेवन बालासुब्रमण्यम स्वायत्त कम्प्यूटिंग के लिए एक प्रमुख समाधान वास्तुकार है, जो भौतिक विज्ञान से प्रभावित गहन शिक्षण, निर्माण और बड़े पैमाने पर औद्योगिक प्रणालियों के लिए डिजिटल जुड़वाँ को तैनात करने के क्षेत्र में लगभग 20 वर्षों के अनुभव के साथ है। महादेवन ने मेसाचुसेट्स इंस्टीट्यूट ऑफ टेक्नोलॉजी से मैकेनिकल इंजीनियरिंग में पीएचडी की उपाधि प्राप्त की और उनके खाते में 25 से अधिक पेटेंट और प्रकाशन हैं।

महादेवन बालासुब्रमण्यम स्वायत्त कम्प्यूटिंग के लिए एक प्रमुख समाधान वास्तुकार है, जो भौतिक विज्ञान से प्रभावित गहन शिक्षण, निर्माण और बड़े पैमाने पर औद्योगिक प्रणालियों के लिए डिजिटल जुड़वाँ को तैनात करने के क्षेत्र में लगभग 20 वर्षों के अनुभव के साथ है। महादेवन ने मेसाचुसेट्स इंस्टीट्यूट ऑफ टेक्नोलॉजी से मैकेनिकल इंजीनियरिंग में पीएचडी की उपाधि प्राप्त की और उनके खाते में 25 से अधिक पेटेंट और प्रकाशन हैं।

अमर रगाबो AWS के लिए EC2 त्वरित प्लेटफॉर्म के लिए एक प्रमुख समाधान आर्किटेक्ट है, जो ग्राहकों को बड़े पैमाने पर कम्प्यूटेशनल वर्कलोड चलाने में मदद करने के लिए समर्पित है। अपने खाली समय में उन्हें यात्रा करना और दैनिक जीवन में प्रौद्योगिकी को एकीकृत करने के नए तरीके खोजना पसंद है।

अमर रगाबो AWS के लिए EC2 त्वरित प्लेटफॉर्म के लिए एक प्रमुख समाधान आर्किटेक्ट है, जो ग्राहकों को बड़े पैमाने पर कम्प्यूटेशनल वर्कलोड चलाने में मदद करने के लिए समर्पित है। अपने खाली समय में उन्हें यात्रा करना और दैनिक जीवन में प्रौद्योगिकी को एकीकृत करने के नए तरीके खोजना पसंद है।

- उन्नत (300)

- AI

- ai कला

- ऐ कला जनरेटर

- ऐ रोबोट

- अमेज़ॅन EC2

- कृत्रिम बुद्धिमत्ता

- कृत्रिम बुद्धिमत्ता प्रमाणन

- बैंकिंग में आर्टिफिशियल इंटेलिजेंस

- आर्टिफिशियल इंटेलिजेंस रोबोट

- आर्टिफिशियल इंटेलिजेंस रोबोट

- कृत्रिम बुद्धि सॉफ्टवेयर

- AWS मशीन लर्निंग

- blockchain

- ब्लॉकचेन सम्मेलन एआई

- कॉइनजीनियस

- संवादी कृत्रिम बुद्धिमत्ता

- क्रिप्टो सम्मेलन एआई

- दल-ए

- ध्यान लगा के पढ़ना या सीखना

- इसे गूगल करें

- यंत्र अधिगम

- प्लेटो

- प्लेटो एआई

- प्लेटो डेटा इंटेलिजेंस

- प्लेटो गेम

- प्लेटोडाटा

- प्लेटोगेमिंग

- स्केल एआई

- वाक्यविन्यास

- जेफिरनेट