आज, हम अमेज़न के अत्याधुनिक की सार्वजनिक उपलब्धता की घोषणा करते हैं एलेक्सा टीचर मॉडल 20 बिलियन पैरामीटर्स के साथ (AlexaTM 20B) के माध्यम से अमेज़न SageMaker जम्पस्टार्ट, सेजमेकर का मशीन लर्निंग हब। AlexaTM 20B Amazon द्वारा विकसित एक बहुभाषी बड़े पैमाने पर अनुक्रम-से-अनुक्रम (seq2seq) भाषा मॉडल है। आप एलेक्साटीएम 20बी का उपयोग वित्तीय रिपोर्ट के सारांश से लेकर ग्राहक सेवा चैटबॉट के लिए सवालों के जवाब देने तक उद्योग उपयोग के मामलों की एक विस्तृत श्रृंखला के लिए कर सकते हैं। इसे तब भी लागू किया जा सकता है जब प्रशिक्षण के कुछ ही उदाहरण उपलब्ध हों, या कोई भी न हो। एलेक्साटीएम 20बी Outperforms एक 175 अरब जीपीटी-3 मॉडल सुपरग्लू जैसे शून्य-शॉट सीखने के कार्यों पर और XNLI जैसे बहुभाषी शून्य-शॉट कार्यों के लिए अत्याधुनिक प्रदर्शन दिखाता है।

इस पोस्ट में, हम जम्पस्टार्ट एपीआई के माध्यम से प्रोग्रामेटिक रूप से एलेक्साटीएम 20बी मॉडल को तैनात करने और चलाने के तरीके का एक अवलोकन प्रदान करते हैं, जो इसमें उपलब्ध है। सेजमेकर पायथन एसडीके. हम उदाहरण देते हैं कि कैसे आप इस मॉडल का उपयोग कई भाषाओं के बीच अनुवाद करने के लिए कर सकते हैं, लंबे-रूप वाले पाठ को सारांशित कर सकते हैं, किसी दिए गए संदर्भ के आधार पर प्रश्नों का उत्तर दे सकते हैं और ऐसा पाठ उत्पन्न कर सकते हैं जो मानव-लिखित पाठ से अप्रभेद्य प्रतीत होता है।

AlexaTM 20B और इन-कॉन्टेक्स्ट लर्निंग

Amazon Alexa AI द्वारा Alexa Teacher Model (AlexaTM) प्रोग्राम को बड़े पैमाने पर, बहुभाषी गहन शिक्षण मॉडल (मुख्य रूप से ट्रांसफार्मर-आधारित) बनाने के लिए डिज़ाइन किया गया है, जिसका उद्देश्य सामान्यीकरण में सुधार करना और डाउनस्ट्रीम कार्यों के लिए डेटा की कमी को संभालना है। बड़े पैमाने पर पूर्व-प्रशिक्षण के साथ, शिक्षक मॉडल विरल डेटा से नए कार्यों को सीखने के लिए अच्छी तरह से सामान्यीकरण कर सकते हैं और डेवलपर्स को डाउनस्ट्रीम कार्यों पर प्रदर्शन में सुधार करने में मदद कर सकते हैं। AlexaTM 20B ने दिखाया है प्रतिस्पर्धी प्रदर्शन सामान्य प्राकृतिक भाषा प्रसंस्करण (एनएलपी) बेंचमार्क और कार्यों पर, जैसे मशीन अनुवाद, डेटा निर्माण और सारांश।

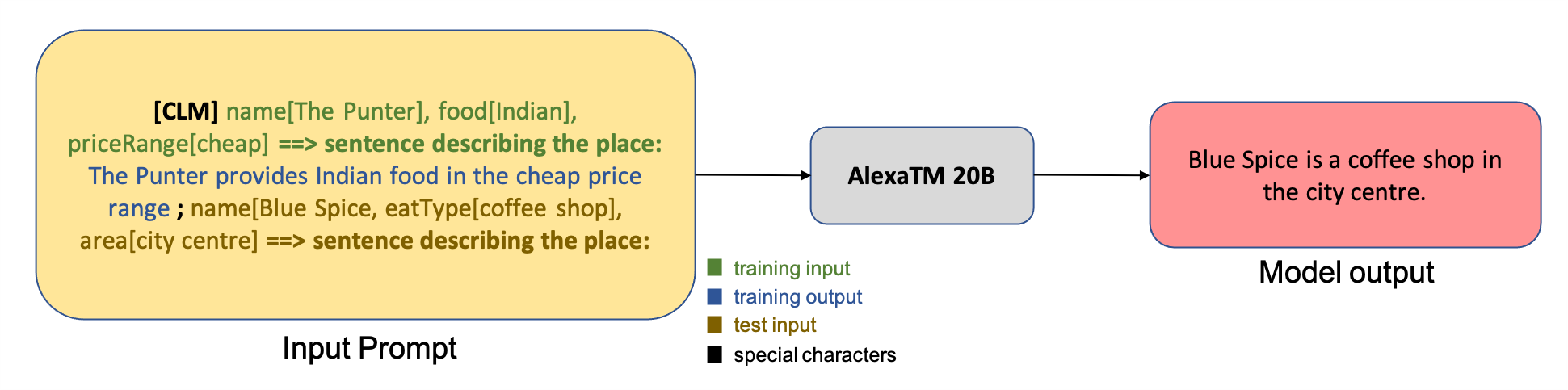

एलेक्साटीएम 20बी जैसे फाउंडेशन मॉडल का उपयोग करने से महंगे मॉडल पूर्व-प्रशिक्षण की आवश्यकता कम हो जाती है और कम प्रयास और कम कार्य-विशिष्ट प्रशिक्षण डेटा के साथ कार्य मॉडल विकसित करने के लिए एक अत्याधुनिक प्रारंभिक बिंदु प्रदान करता है। नींव मॉडल की प्रमुख क्षमताओं में से एक यह है कि हम एक मॉडल को बहुत कम मात्रा में इनपुट उदाहरणों और किसी फाइन-ट्यूनिंग या ग्रेडिएंट अपडेट की आवश्यकता के बिना विभिन्न भाषाओं में प्रश्न और उत्तर देने जैसे नए कार्य करना सिखा सकते हैं। इस रूप में जाना जाता है इन-कॉन्टेक्स्ट लर्निंग. अनुमान के लिए संदर्भ के रूप में प्रदान किए गए एक नए कार्य के केवल कुछ उदाहरणों के साथ, एलेक्साटीएम 20बी मॉडल बड़े पैमाने पर पूर्व-प्रशिक्षण के दौरान सीखे गए ज्ञान को सभी भाषाओं में स्थानांतरित कर सकता है। यह कहा जाता है कुछ-कुछ सीखना. कुछ मामलों में, मॉडल बिना किसी प्रशिक्षण डेटा के अच्छा प्रदर्शन कर सकता है, केवल एक स्पष्टीकरण के साथ कि क्या भविष्यवाणी की जानी चाहिए। यह कहा जाता है शून्य-शॉट सीखना. उदाहरण के लिए, मान लें कि हम एक-शॉट प्राकृतिक भाषा निर्माण के लिए AlexaTM 20B का उपयोग कर रहे हैं। मॉडल को दिया गया इनपुट विशेषता-मूल्य जोड़े के रूप में प्रशिक्षण उदाहरण है, इसके संबंधित आउटपुट टेक्स्ट कथा के साथ। परीक्षण उदाहरण को तब पूर्ण इनपुट प्रॉम्प्ट बनाने के लिए जोड़ा जाता है, जैसा कि निम्नलिखित चित्र में दिखाया गया है।

मॉडल के बारे में अधिक जानने के लिए देखें 20बी-पैरामीटर एलेक्सा मॉडल कुछ-शॉट सीखने में नए अंक स्थापित करता है या मूल काग़ज़.

AlexaTM 20B का उपयोग गैर-वाणिज्यिक उपयोग के लिए उपलब्ध कराया गया है और इसके तहत कवर किया गया है एलेक्सा शिक्षक मॉडल लाइसेंस समझौता.

समाधान अवलोकन

निम्नलिखित खंड चरण-दर-चरण डेमो प्रदान करते हैं कि मॉडल को कैसे तैनात किया जाए, अनुमान लगाया जाए, और कुछ-शॉट सीखने के कार्यों को हल करने के लिए इन-कॉन्टेक्स्ट-लर्निंग करें।

ध्यान दें कि निम्न अनुभाग में कोड स्निपेट शामिल हैं; इस डेमो के सभी चरणों के साथ पूरा कोड संलग्न नोटबुक में उपलब्ध है: सैजमेकर जम्पस्टार्ट में एलेक्साटीएम 20बी के साथ इन-कॉन्टेक्स्ट-लर्निंग.

मॉडल तैनात करें

SageMaker में एक बड़े भाषा मॉडल का उपयोग करने के लिए, आपको मॉडल के लिए विशिष्ट संदर्भ स्क्रिप्ट की आवश्यकता होती है, जिसमें मॉडल लोडिंग, समांतरता और अधिक जैसे चरण शामिल होते हैं। आपको यह सत्यापित करने के लिए कि तीनों एक साथ काम कर सकते हैं, स्क्रिप्ट, मॉडल और वांछित उदाहरण प्रकारों के लिए एंड-टू-एंड परीक्षण बनाने की भी आवश्यकता है। जम्पस्टार्ट उपयोग के लिए तैयार स्क्रिप्ट प्रदान करके इस प्रयास को हटा देता है जिनका मजबूत परीक्षण किया गया है।

सैजमेकर आपको प्रशिक्षण और अनुमान लगाने के लिए बड़े पैमाने पर डॉकटर कंटेनर चलाने की क्षमता देता है। जम्पस्टार्ट इन उपलब्ध ढाँचों-विशिष्ट का उपयोग करता है सेजमेकर डीप लर्निंग कंटेनर (डीएलसी)। हम अनुकूलित डीएलसी (deploy_image_uri) का उपयोग करते हुए model_id. फिर हम लाते हैं model_uri अनुमान प्रबंधन स्क्रिप्ट और किसी भी संबद्ध निर्भरता के साथ मॉडल पैरामीटर युक्त। अगला, हम एक बनाते हैं मॉडल उदाहरण सेजमेकर में और इसे रीयल-टाइम एंडपॉइंट पर तैनात करें। निम्नलिखित कोड देखें:

AlexaTM 20B को तैनात करने के लिए कम से कम 50 GB CPU मेमोरी और कम से कम 42 GB GPU मेमोरी के साथ GPU-समर्थित इंस्टेंस की आवश्यकता होती है। SageMaker कई ऐसे उदाहरण प्रदान करता है जो वास्तविक समय के अनुमान का समर्थन करते हैं। हमने तीन उदाहरणों पर इस समाधान का परीक्षण किया: एमएल.जी4डीएन.12एक्सलार्ज, एमएल.पी3.8एक्सलार्ज, एमएल.पी3.16एक्सलार्ज। निम्नलिखित कोड देखें:

अगला, हम मॉडल को एक सैजमेकर रीयल-टाइम एंडपॉइंट पर तैनात करते हैं:

एलेक्साटीएम 20बी को अनुमान कंटेनर में 40 जीबी डिस्क स्थान की आवश्यकता होती है। एक ml.g4dn.12xlarge उदाहरण इस आवश्यकता को पूरा करता है। उदाहरण के लिए प्रकार ml.p3.8xlarge और ml.p3.16xlarge, हम एक संलग्न करते हैं अमेज़न इलास्टिक ब्लॉक स्टोर (अमेज़ॅन ईबीएस) वॉल्यूम बड़े मॉडल आकार को संभालने के लिए। इसलिए, हम सेट करते हैं volume_size = None जब ml.g4dn.12xlarge पर तैनात किया जाता है और volume_size=256 जब ml.p3.8xlarge या ml.p3.16xlarge पर डिप्लॉय किया जाता है।

मॉडल को परिनियोजित करने में 10 मिनट तक लग सकते हैं। मॉडल को तैनात करने के बाद, हम वास्तविक समय में इससे भविष्यवाणियां प्राप्त कर सकते हैं!

अनुमान चलाएँ

AlexaTM 20B एक टेक्स्ट जेनरेशन मॉडल है, जिसे एक आंशिक अनुक्रम (एक वाक्य या पाठ का टुकड़ा) दिया जाता है, शब्दों का अगला सेट उत्पन्न करता है। निम्नलिखित कोड स्निपेट आपको एक झलक देता है कि हमारे द्वारा परिनियोजित समापन बिंदु को कैसे क्वेरी करें और ऑटो-पूर्ण कार्य के लिए आउटपुट को कैसे पार्स करें। एक परिनियोजित मॉडल को अनुरोध भेजने के लिए, हम UTF-8 प्रारूप में एन्कोडेड JSON शब्दकोश का उपयोग करते हैं। समापन बिंदु प्रतिक्रिया एक JSON ऑब्जेक्ट है जिसमें उत्पन्न ग्रंथों की सूची होती है।

अगला, हम समापन बिंदु को क्वेरी करते हैं और एक नमूना इनपुट पाठ पर प्रतिक्रिया को पार्स करते हैं:

AlexaTM 20B वर्तमान में अनुमान के दौरान 10 टेक्स्ट जनरेशन पैरामीटर का समर्थन करता है: max_length, num_return_sequences, num_beams, no_repeat_ngram_size, temperature, early_stopping, do_sample, top_k, top_p, तथा seed. प्रत्येक पैरामीटर के मान्य मानों और आउटपुट पर उनके प्रभाव के बारे में विस्तृत जानकारी के लिए, संलग्न नोटबुक देखें: सैजमेकर जम्पस्टार्ट में एलेक्साटीएम 20बी के साथ इन-कॉन्टेक्स्ट-लर्निंग.

इन-कॉन्टेक्स्ट लर्निंग

इन-कॉन्टेक्स्ट लर्निंग निम्नलिखित को संदर्भित करता है: हम एक प्रांप्ट के साथ भाषा मॉडल प्रदान करते हैं, जिसमें प्रशिक्षण इनपुट-आउटपुट जोड़े होते हैं जो कार्य को प्रदर्शित करते हैं। हम प्रॉम्प्ट में एक परीक्षण इनपुट जोड़ते हैं और भाषा मॉडल को प्रॉम्प्ट पर कंडीशनिंग करके और अगले टोकन या शब्दों की भविष्यवाणी करने की अनुमति देते हैं। कुछ शॉट-लर्निंग समस्याओं को हल करने के लिए यह एक अत्यधिक प्रभावी तकनीक है, जिसमें हम कुछ प्रशिक्षण नमूनों से एक कार्य सीखते हैं।

इसके बाद, हम दिखाते हैं कि कैसे आप प्रासंगिक शिक्षण के माध्यम से कई 20-शॉट और शून्य-शॉट कार्यों के लिए AlexaTM 1B का उपयोग कर सकते हैं। पिछले सीक्वेंस-टू-सीक्वेंस मॉडल के विपरीत, एलेक्साटीएम 20बी को डीनोइजिंग के अलावा कारणात्मक भाषा मॉडलिंग पर प्रशिक्षित किया गया था, जो इसे इन-कॉन्टेक्स्ट लर्निंग के लिए एक अच्छा मॉडल बनाता है।

1-शॉट पाठ सारांश

पाठ सारांशीकरण डेटा को छोटा करने और एक सारांश बनाने का कार्य है जो मूल पाठ में मौजूद सबसे महत्वपूर्ण जानकारी का प्रतिनिधित्व करता है। 1-शॉट टेक्स्ट सारांशीकरण उस सेटिंग को संदर्भित करता है जहां हम एकल प्रशिक्षण नमूने के आधार पर टेक्स्ट को सारांशित करना सीखते हैं। निम्नलिखित कोड से एक पाठ सारांश नमूना है एक्सएसयूएम डेटासेट:

जब केवल एक प्रशिक्षण नमूना प्रदान किया जाता है तो हम संक्षिप्तीकरण के लिए निम्नलिखित संकेत का उपयोग करते हैं। मॉडल से उत्पन्न पाठ की व्याख्या परीक्षण लेख के अनुमानित सारांश के रूप में की जाती है।

आउटपुट इस प्रकार है:

1-शॉट प्राकृतिक भाषा पीढ़ी

इनपुट टेक्स्ट दिए जाने पर टेक्स्ट नैरेटिव तैयार करने का काम नेचुरल लैंग्वेज जनरेशन है। निम्नलिखित नमूना से एक प्रशिक्षण नमूना दिखाता है E2E डेटासेट:

जब केवल एक प्रशिक्षण नमूना (1-शॉट) प्रदान किया जाता है, तो हम प्राकृतिक भाषा निर्माण के लिए निम्नलिखित संकेत का उपयोग करते हैं। मॉडल से उत्पन्न पाठ की व्याख्या परीक्षण इनपुट के लिए अनुमानित पाठ विवरण के रूप में की जाती है (test_inp).

आउटपुट इस प्रकार है:

1-शॉट मशीन अनुवाद

मशीनी अनुवाद एक भाषा से दूसरी भाषा में पाठ का अनुवाद करने का कार्य है। निम्नलिखित उदाहरण से एक प्रशिक्षण नमूना दिखाता है WMT19 डेटासेट जिसमें हमें जर्मन से अंग्रेजी में अनुवाद करने की आवश्यकता है:

जब केवल एक प्रशिक्षण नमूना (1-शॉट) प्रदान किया जाता है तो हम मशीनी अनुवाद के लिए निम्नलिखित संकेत का उपयोग करते हैं। मॉडल से उत्पन्न पाठ की व्याख्या परीक्षण इनपुट के अनुवाद के रूप में की जाती है (test_inp).

आउटपुट इस प्रकार है:

जीरो-शॉट एक्सट्रैक्टिव क्वेश्चन आंसरिंग

एक्स्ट्रेक्टिव क्वेश्चन आंसरिंग संदर्भ पैराग्राफ से किसी प्रश्न का उत्तर खोजने का कार्य है। निम्नलिखित एक संदर्भ का एक उदाहरण है और एक प्रश्न है SQuAD v2 डेटासेट:

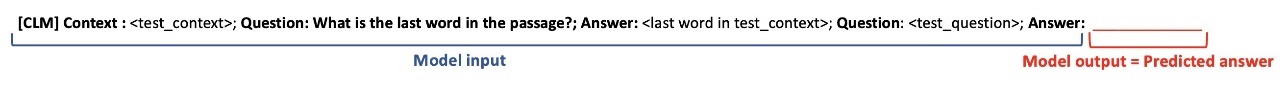

ध्यान दें कि हमारे कार्य के लिए हमारे पास कोई प्रशिक्षण नमूना नहीं है। इसके बजाय, हम संकेत के आधार पर अंतिम शब्द के बारे में एक डमी प्रश्न बनाते हैं test_context (डमी-शॉट)। इसलिए, हम वास्तव में जीरो-शॉट एक्सट्रैक्टिव क्वेश्चन आंसरिंग कर रहे हैं।

जब कोई प्रशिक्षण नमूना प्रदान नहीं किया जाता है तो हम प्रश्नों के उत्तर निकालने के लिए निम्नलिखित संकेत का उपयोग करते हैं। मॉडल से उत्पन्न पाठ की व्याख्या परीक्षण प्रश्न के उत्तर के रूप में की जाती है।

आउटपुट इस प्रकार है:

शीघ्र इंजीनियरिंग

शीघ्र इंजीनियरिंग कभी-कभी एक कला हो सकती है। प्रांप्ट टेम्पलेट में छोटे परिवर्तन भी किसी विशिष्ट कार्य पर मॉडल के प्रदर्शन में महत्वपूर्ण परिवर्तन ला सकते हैं। अच्छे प्रॉम्प्ट टेम्प्लेट लिखने के लिए निम्नलिखित सलाह के कुछ अंश हैं। सबसे पहले, यह याद रखना महत्वपूर्ण है कि मॉडल को वास्तविक वाक्यों की संरचना सीखने के लिए प्रशिक्षित किया गया था (कॉज़ल लैंग्वेज मॉडलिंग)। इस प्रकार, यह सुनिश्चित करना सबसे अच्छा है कि आपका प्रांप्ट टेम्पलेट प्राकृतिक भाषा में व्याकरणिक और संरचनात्मक रूप से सही है। दूसरा, यह विशेष मॉडल डमी शॉट्स से लाभ उठाता है ताकि उत्तर में अपेक्षित संरचना को सिखाने में मदद मिल सके, जैसा कि ऊपर दिखाया गया है। तीसरा, यह हमेशा सलाह दी जाती है कि विभिन्न प्रकार के उम्मीदवार संकेत टेम्पलेट्स पर कार्य प्रदर्शन की जांच करें। प्रॉम्प्टसोर्स और प्राकृतिक निर्देश प्रॉम्प्ट टेम्प्लेट के मानकीकरण के लिए दो ओपन-सोर्स फ्रेमवर्क हैं, और वे मौजूदा मॉडलिंग कार्यों के लिए उपयोग किए जाने वाले विभिन्न प्रकार के उदाहरण संकेत प्रदान करते हैं। इसके अतिरिक्त, परिशिष्ट बी एलेक्साटीएम 20बी पेपर कागज में प्रस्तुत परिणाम उत्पन्न करने के लिए उपयोग किए जाने वाले शीघ्र टेम्पलेट प्रदान करता है। प्राकृतिक भाषा और निरंतर संकेत दोनों सहित किसी कार्य के लिए स्वचालित निर्माण और सर्वोत्तम संकेतों को सीखने के लिए समर्पित एक बढ़ता हुआ उप-क्षेत्र है। यह इस ट्यूटोरियल के दायरे से बाहर है।

निष्कर्ष

इस पोस्ट में, हमने दिखाया कि कैसे एलेक्साटीएम 20बी मॉडल को एक सैजमेकर एंडपॉइंट पर तैनात किया जाए और अनुमान लगाया जाए। आप विभिन्न प्रकार के कुछ-शॉट सीखने के कार्यों के लिए इन-कॉन्टेक्स्ट-लर्निंग के लिए AlexaTM 20B मॉडल का उपयोग कर सकते हैं। एलेक्साटीएम 20बी के बारे में अधिक जानने के लिए देखें 20बी-पैरामीटर एलेक्सा मॉडल कुछ-शॉट सीखने में नए अंक स्थापित करता है या मूल काग़ज़.

लेखक इस लॉन्च को संभव बनाने के लिए मैसीज रुडनिकी, जैकब डेब्स्की, आशीष खेतान, अनास्तासिया डुबिनिना, विटाली कोरोलेव, कार्ल अल्बर्टसन, सालेह सोलटन और मारियस मोमोटको के तकनीकी योगदान को स्वीकार करना चाहते हैं।

जम्पस्टार्ट के बारे में

जम्पस्टार्ट Amazon SageMaker का मशीन लर्निंग (ML) हब है जो 350 से अधिक पूर्व-प्रशिक्षित मॉडल, बिल्ट-इन एल्गोरिदम और प्री-बिल्ट सॉल्यूशन टेम्प्लेट प्रदान करता है ताकि आपको ML तेज़ी से आरंभ करने में मदद मिल सके। जम्पस्टार्ट लोकप्रिय मॉडल हब जैसे TensorFlow, PyTorch, Hugging Face, और MXNet से अत्याधुनिक मॉडल होस्ट करता है, जो ऑब्जेक्ट डिटेक्शन, टेक्स्ट वर्गीकरण और टेक्स्ट जेनरेशन जैसे लोकप्रिय ML कार्यों का समर्थन करते हैं। एमएल अनुसंधान समुदाय ने हाल ही में विकसित अधिकांश मॉडलों को सार्वजनिक रूप से उपयोग के लिए उपलब्ध कराने के लिए बड़ी मात्रा में प्रयास किया है। जम्पस्टार्ट का उद्देश्य आपको सही एमएल मॉडल और एल्गोरिदम खोजने में मदद करना है, और तुरंत मॉडल बनाना शुरू करना है। विशेष रूप से, जम्पस्टार्ट निम्नलिखित लाभ प्रदान करता है:

- UI और SDK के साथ आसान पहुंच - आप SageMaker Python SDK का उपयोग करके या Amazon SageMaker Studio में जम्पस्टार्ट UI के माध्यम से जम्पस्टार्ट में प्रोग्रामेटिक रूप से मॉडल और एल्गोरिदम तक पहुँच सकते हैं। वर्तमान में, AlexaTM 20B को केवल SageMaker Python SDK के माध्यम से एक्सेस किया जा सकता है।

- SageMaker बिल्ट-इन एल्गोरिदम - जम्पस्टार्ट 350 से अधिक बिल्ट-इन एल्गोरिदम और पूर्व-प्रशिक्षित मॉडल प्रदान करता है, साथ ही संबंधित प्रशिक्षण स्क्रिप्ट (यदि समर्थित हो), स्क्रिप्ट का अनुमान, और उदाहरण नोटबुक। स्क्रिप्ट प्रत्येक ढांचे और कार्य के लिए अनुकूलित हैं, और GPU समर्थन, स्वचालित मॉडल ट्यूनिंग और वृद्धिशील प्रशिक्षण जैसी सुविधाएँ प्रदान करती हैं। SageMaker उदाहरणों और सुविधाओं के विरुद्ध लिपियों का भी परीक्षण किया जाता है ताकि आप संगतता समस्याओं में न पड़ें।

- पूर्व-निर्मित समाधान – जम्पस्टार्ट सामान्य एमएल उपयोग के मामलों के लिए 23 समाधानों का एक सेट प्रदान करता है, जैसे मांग पूर्वानुमान और औद्योगिक और वित्तीय अनुप्रयोग, जिन्हें आप कुछ ही क्लिक के साथ परिनियोजित कर सकते हैं। समाधान एंड-टू-एंड एमएल एप्लिकेशन हैं जो एक विशेष व्यावसायिक उपयोग के मामले को हल करने के लिए विभिन्न AWS सेवाओं को एक साथ जोड़ते हैं। वे त्वरित परिनियोजन के लिए AWS CloudFormation टेम्प्लेट और संदर्भ आर्किटेक्चर का उपयोग करते हैं, जिसका अर्थ है कि वे पूरी तरह से अनुकूलन योग्य हैं।

- समर्थन - SageMaker समर्थन की एक श्रृंखला प्रदान करता है, जैसे नए SageMaker सुविधाओं या डीप लर्निंग कंटेनर संस्करणों के रिलीज़ होने पर अप-टू-डेट संस्करणों को बनाए रखना, और SageMaker वातावरण में जम्पस्टार्ट सामग्री का उपयोग करने के तरीके पर प्रलेखन बनाना।

जम्पस्टार्ट के बारे में अधिक जानने के लिए और आप विभिन्न प्रकार के अन्य एमएल कार्यों के लिए ओपन-सोर्स पूर्व-प्रशिक्षित मॉडल का उपयोग कैसे कर सकते हैं, निम्नलिखित देखें एडब्ल्यूएस पुन: आविष्कार 2020 वीडियो.

लेखक के बारे में

डॉ विवेक मदनी अमेज़ॅन सेजमेकर जम्पस्टार्ट टीम के साथ एक अनुप्रयुक्त वैज्ञानिक है। उन्होंने अर्बाना-शैंपेन में इलिनोइस विश्वविद्यालय से पीएचडी प्राप्त की और जॉर्जिया टेक में पोस्ट डॉक्टरेट शोधकर्ता थे। वह मशीन लर्निंग और एल्गोरिथम डिज़ाइन में एक सक्रिय शोधकर्ता हैं और उन्होंने EMNLP, ICLR, COLT, FOCS और SODA सम्मेलनों में पेपर प्रकाशित किए हैं।

डॉ विवेक मदनी अमेज़ॅन सेजमेकर जम्पस्टार्ट टीम के साथ एक अनुप्रयुक्त वैज्ञानिक है। उन्होंने अर्बाना-शैंपेन में इलिनोइस विश्वविद्यालय से पीएचडी प्राप्त की और जॉर्जिया टेक में पोस्ट डॉक्टरेट शोधकर्ता थे। वह मशीन लर्निंग और एल्गोरिथम डिज़ाइन में एक सक्रिय शोधकर्ता हैं और उन्होंने EMNLP, ICLR, COLT, FOCS और SODA सम्मेलनों में पेपर प्रकाशित किए हैं।

जैक फिट्जगेराल्ड एलेक्सा एआई के साथ एक वरिष्ठ अनुप्रयुक्त वैज्ञानिक हैं, जहां वे वर्तमान में बड़े भाषा मॉडलिंग, बहुभाषी टेक्स्ट मॉडलिंग और मशीन लर्निंग ऑपरेशंस पर ध्यान केंद्रित करते हैं।

जैक फिट्जगेराल्ड एलेक्सा एआई के साथ एक वरिष्ठ अनुप्रयुक्त वैज्ञानिक हैं, जहां वे वर्तमान में बड़े भाषा मॉडलिंग, बहुभाषी टेक्स्ट मॉडलिंग और मशीन लर्निंग ऑपरेशंस पर ध्यान केंद्रित करते हैं।

जोआओ मौरा Amazon वेब सर्विसेज में AI/ML स्पेशलिस्ट सॉल्यूशंस आर्किटेक्ट हैं। वह ज्यादातर एनएलपी उपयोग के मामलों पर केंद्रित है और ग्राहकों को गहन शिक्षण मॉडल प्रशिक्षण और तैनाती को अनुकूलित करने में मदद करता है। वह लो-कोड एमएल सॉल्यूशंस और एमएल-स्पेशलाइज्ड हार्डवेयर के सक्रिय प्रस्तावक भी हैं।

जोआओ मौरा Amazon वेब सर्विसेज में AI/ML स्पेशलिस्ट सॉल्यूशंस आर्किटेक्ट हैं। वह ज्यादातर एनएलपी उपयोग के मामलों पर केंद्रित है और ग्राहकों को गहन शिक्षण मॉडल प्रशिक्षण और तैनाती को अनुकूलित करने में मदद करता है। वह लो-कोड एमएल सॉल्यूशंस और एमएल-स्पेशलाइज्ड हार्डवेयर के सक्रिय प्रस्तावक भी हैं।

जून जीता SageMaker जम्पस्टार्ट और बिल्ट-इन एल्गोरिदम के साथ एक उत्पाद प्रबंधक है। वह SageMaker ग्राहकों के लिए एमएल सामग्री को आसानी से खोजने योग्य और उपयोग करने योग्य बनाने पर ध्यान केंद्रित करता है।

जून जीता SageMaker जम्पस्टार्ट और बिल्ट-इन एल्गोरिदम के साथ एक उत्पाद प्रबंधक है। वह SageMaker ग्राहकों के लिए एमएल सामग्री को आसानी से खोजने योग्य और उपयोग करने योग्य बनाने पर ध्यान केंद्रित करता है।

पुलकित कपूर एलेक्सा एआई के साथ एलेक्सा टीचर मॉडल प्रोग्राम के लिए प्रोडक्ट लीड है, जो एलेक्सा के मल्टीटास्क मल्टीमॉडल फाउंडेशन मॉडल के सामान्य ज्ञान और अनुप्रयोगों पर ध्यान केंद्रित करता है।

पुलकित कपूर एलेक्सा एआई के साथ एलेक्सा टीचर मॉडल प्रोग्राम के लिए प्रोडक्ट लीड है, जो एलेक्सा के मल्टीटास्क मल्टीमॉडल फाउंडेशन मॉडल के सामान्य ज्ञान और अनुप्रयोगों पर ध्यान केंद्रित करता है।

- AI

- ai कला

- ऐ कला जनरेटर

- ऐ रोबोट

- अमेज़न SageMaker

- अमेज़न SageMaker जम्पस्टार्ट

- कृत्रिम बुद्धिमत्ता

- कृत्रिम बुद्धिमत्ता प्रमाणन

- बैंकिंग में आर्टिफिशियल इंटेलिजेंस

- आर्टिफिशियल इंटेलिजेंस रोबोट

- आर्टिफिशियल इंटेलिजेंस रोबोट

- कृत्रिम बुद्धि सॉफ्टवेयर

- AWS मशीन लर्निंग

- blockchain

- ब्लॉकचेन सम्मेलन एआई

- कॉइनजीनियस

- संवादी कृत्रिम बुद्धिमत्ता

- क्रिप्टो सम्मेलन एआई

- दल-ए

- ध्यान लगा के पढ़ना या सीखना

- फाउंडेशनल (100)

- इसे गूगल करें

- यंत्र अधिगम

- प्लेटो

- प्लेटो एआई

- प्लेटो डेटा इंटेलिजेंस

- प्लेटो गेम

- प्लेटोडाटा

- प्लेटोगेमिंग

- स्केल एआई

- वाक्यविन्यास

- जेफिरनेट