उद्योगों और उपयोग के मामलों में कृत्रिम बुद्धिमत्ता (एआई) अपनाने में तेजी आ रही है। गहन शिक्षण (डीएल), बड़े भाषा मॉडल (एलएलएम), और जेनरेटिव एआई में हालिया वैज्ञानिक सफलताएं ग्राहकों को लगभग मानव-जैसे प्रदर्शन के साथ उन्नत अत्याधुनिक समाधानों का उपयोग करने की अनुमति दे रही हैं। इन जटिल मॉडलों को अक्सर हार्डवेयर त्वरण की आवश्यकता होती है क्योंकि यह न केवल तेज़ प्रशिक्षण को सक्षम बनाता है बल्कि वास्तविक समय के अनुप्रयोगों में गहरे तंत्रिका नेटवर्क का उपयोग करते समय तेज़ अनुमान भी सक्षम बनाता है। जीपीयू की बड़ी संख्या में समानांतर प्रोसेसिंग कोर उन्हें इन डीएल कार्यों के लिए उपयुक्त बनाती है।

हालाँकि, मॉडल आमंत्रण के अलावा, उन डीएल एप्लिकेशन में अक्सर एक अनुमान पाइपलाइन में प्रीप्रोसेसिंग या पोस्टप्रोसेसिंग शामिल होती है। उदाहरण के लिए, ऑब्जेक्ट डिटेक्शन उपयोग के मामले के लिए इनपुट छवियों को कंप्यूटर विज़न मॉडल में पेश करने से पहले आकार बदलने या क्रॉप करने की आवश्यकता हो सकती है, या एलएलएम में उपयोग किए जाने से पहले टेक्स्ट इनपुट के टोकनाइजेशन की आवश्यकता हो सकती है। एनवीडिया ट्राइटन एक ओपन-सोर्स अनुमान सर्वर है जो उपयोगकर्ताओं को डायरेक्टेड एसाइक्लिक ग्राफ (डीएजी) के रूप में मॉडलों के समूह के रूप में ऐसी अनुमान पाइपलाइनों को परिभाषित करने में सक्षम बनाता है। इसे सीपीयू और जीपीयू दोनों पर बड़े पैमाने पर मॉडल चलाने के लिए डिज़ाइन किया गया है। अमेज़न SageMaker ट्राइटन को निर्बाध रूप से तैनात करने का समर्थन करता है, जिससे आप ट्राइटन की सुविधाओं का उपयोग करने के साथ-साथ लाभ भी उठा सकते हैं सेजमेकर क्षमताएं: एमएलओपीएस टूल एकीकरण, होस्ट किए गए मॉडलों की स्वचालित स्केलिंग और बहुत कुछ के साथ एक प्रबंधित, सुरक्षित वातावरण।

AWS ने, ग्राहकों को उच्चतम बचत प्राप्त करने में मदद करने के अपने समर्पण में, न केवल निरंतर नवाचार किया है मूल्य निर्धारण विकल्प और लागत-अनुकूलन सक्रिय सेवाएँ, बल्कि लागत बचत सुविधाओं को लॉन्च करने में भी बहु-मॉडल समापन बिंदु (एमएमई)। एमएमई आपके सभी मॉडलों को होस्ट करने के लिए संसाधनों के एक ही बेड़े और एक साझा सर्विंग कंटेनर का उपयोग करके बड़ी संख्या में मॉडल तैनात करने के लिए एक लागत प्रभावी समाधान है। एकाधिक एकल-मॉडल समापन बिंदुओं का उपयोग करने के बजाय, आप केवल एकल अनुमान परिवेश के लिए भुगतान करते हुए कई मॉडलों को तैनात करके अपनी होस्टिंग लागत को कम कर सकते हैं। इसके अतिरिक्त, एमएमई परिनियोजन ओवरहेड को कम करते हैं क्योंकि सेजमेकर मेमोरी में मॉडल लोड करने और उन्हें आपके एंडपॉइंट पर ट्रैफ़िक पैटर्न के आधार पर स्केल करने का प्रबंधन करता है।

इस पोस्ट में, हम दिखाते हैं कि SageMaker MME के साथ GPU इंस्टेंस पर कई गहन शिक्षण मॉडल कैसे चलाएं। इस उदाहरण का अनुसरण करने के लिए, आप सार्वजनिक रूप से कोड पा सकते हैं SageMaker उदाहरण रिपॉजिटरी.

जीपीयू के साथ सेजमेकर एमएमई कैसे काम करते हैं

एमएमई के साथ, एक एकल कंटेनर कई मॉडल होस्ट करता है। सेजमेकर एमएमई पर होस्ट किए गए मॉडलों को कंटेनर की मेमोरी में लोड और अनलोड करके उनके जीवनचक्र को नियंत्रित करता है। सभी मॉडलों को एंडपॉइंट इंस्टेंस पर डाउनलोड करने के बजाय, सेजमेकर गतिशील रूप से मॉडलों को लोड और कैश करता है जैसे ही वे लागू होते हैं।

जब किसी विशेष मॉडल के लिए आमंत्रण अनुरोध किया जाता है, तो सेजमेकर निम्नलिखित कार्य करता है:

- यह पहले अनुरोध को अंतिम बिंदु उदाहरण पर रूट करता है।

- यदि मॉडल लोड नहीं किया गया है, तो यह मॉडल आर्टिफैक्ट डाउनलोड करता है अमेज़न सरल भंडारण सेवा (अमेज़ॅन S3) उस उदाहरण के लिए अमेज़ॅन इलास्टिक ब्लॉक स्टोरेज वॉल्यूम (अमेज़ॅन ईबीएस)।

- यह मॉडल को GPU-त्वरित कंप्यूट इंस्टेंस पर कंटेनर की मेमोरी में लोड करता है। यदि मॉडल पहले से ही कंटेनर की मेमोरी में लोड किया गया है, तो आमंत्रण तेज़ है क्योंकि किसी और चरण की आवश्यकता नहीं है।

जब एक अतिरिक्त मॉडल को लोड करने की आवश्यकता होती है, और इंस्टेंस की मेमोरी का उपयोग अधिक होता है, तो यह सुनिश्चित करने के लिए कि पर्याप्त मेमोरी है, सेजमेकर उस इंस्टेंस के कंटेनर से अप्रयुक्त मॉडल को अनलोड करेगा। ये अनलोड किए गए मॉडल इंस्टेंस के ईबीएस वॉल्यूम पर बने रहेंगे ताकि उन्हें बाद में कंटेनर की मेमोरी में लोड किया जा सके, जिससे उन्हें एस 3 बकेट से फिर से डाउनलोड करने की आवश्यकता दूर हो जाएगी। हालाँकि, यदि इंस्टेंस का स्टोरेज वॉल्यूम अपनी क्षमता तक पहुँच जाता है, तो सेजमेकर अप्रयुक्त मॉडल को स्टोरेज वॉल्यूम से हटा देगा। ऐसे मामलों में जहां एमएमई को कई आमंत्रण अनुरोध प्राप्त होते हैं, और अतिरिक्त उदाहरण (या एक ऑटो-स्केलिंग नीति) मौजूद हैं, सेजमेकर उच्च ट्रैफ़िक को समायोजित करने के लिए अनुमान क्लस्टर में अन्य उदाहरणों के लिए कुछ अनुरोधों को रूट करता है।

यह न केवल लागत बचत तंत्र प्रदान करता है, बल्कि आपको नए मॉडलों को गतिशील रूप से तैनात करने और पुराने मॉडलों को हटाने में भी सक्षम बनाता है। एक नया मॉडल जोड़ने के लिए, आप इसे S3 बकेट पर अपलोड करें, MME को इसका उपयोग करने और इसे लागू करने के लिए कॉन्फ़िगर किया गया है। किसी मॉडल को हटाने के लिए, अनुरोध भेजना बंद करें और इसे S3 बकेट से हटा दें। एमएमई से मॉडल जोड़ने या उन्हें हटाने के लिए एंडपॉइंट को अपडेट करने की आवश्यकता नहीं है!

ट्राइटन पहनावा

ट्राइटन मॉडल पहनावा एक पाइपलाइन का प्रतिनिधित्व करता है जिसमें एक मॉडल, प्रीप्रोसेसिंग और पोस्टप्रोसेसिंग लॉजिक और उनके बीच इनपुट और आउटपुट टेंसर का कनेक्शन होता है। किसी समूह के लिए एक एकल अनुमान अनुरोध, समूह अनुसूचक का उपयोग करके चरणों की एक श्रृंखला के रूप में संपूर्ण पाइपलाइन को चलाने को ट्रिगर करता है। शेड्यूलर प्रत्येक चरण में आउटपुट टेंसर एकत्र करता है और उन्हें विनिर्देश के अनुसार अन्य चरणों के लिए इनपुट टेंसर के रूप में प्रदान करता है। स्पष्ट करने के लिए: पहनावा मॉडल को बाहरी दृष्टिकोण से अभी भी एकल मॉडल के रूप में देखा जाता है।

ट्राइटन सर्वर स्थापत्य एक भी शामिल है मॉडल भंडार: मॉडलों का एक फ़ाइल सिस्टम-आधारित भंडार जिसे ट्राइटन अनुमान लगाने के लिए उपलब्ध कराएगा। ट्राइटन एक या अधिक स्थानीय रूप से सुलभ फ़ाइल पथों से या अमेज़ॅन एस 3 जैसे दूरस्थ स्थानों से मॉडल तक पहुंच सकता है।

मॉडल रिपॉजिटरी में प्रत्येक मॉडल में एक मॉडल कॉन्फ़िगरेशन शामिल होना चाहिए जो मॉडल के बारे में आवश्यक और वैकल्पिक जानकारी प्रदान करता है। आमतौर पर, यह कॉन्फ़िगरेशन a में प्रदान किया जाता है config.pbtxt फ़ाइल के रूप में निर्दिष्ट ModelConfig Protobuf. एक न्यूनतम मॉडल कॉन्फ़िगरेशन को प्लेटफ़ॉर्म या बैकएंड (जैसे PyTorch या TensorFlow) निर्दिष्ट करना होगा max_batch_size संपत्ति, और मॉडल के इनपुट और आउटपुट टेंसर।

सेजमेकर पर ट्राइटन

सेजमेकर कस्टम कोड के साथ ट्राइटन सर्वर का उपयोग करके मॉडल परिनियोजन को सक्षम बनाता है। यह कार्यक्षमता सेजमेकर प्रबंधित के माध्यम से उपलब्ध है ट्राइटन अनुमान सर्वर कंटेनर. ये कंटेनर सामान्य मशीन लीनिंग (एमएल) फ्रेमवर्क (जैसे टेन्सरफ्लो, ओएनएनएक्स, और पायटोरच, साथ ही कस्टम मॉडल प्रारूप) और उपयोगी पर्यावरण चर का समर्थन करते हैं जो आपको सेजमेकर पर प्रदर्शन को अनुकूलित करने देते हैं। सेजमेकर डीप लर्निंग कंटेनर्स (डीएलसी) छवियों का उपयोग करने की अनुशंसा की जाती है क्योंकि उन्हें सुरक्षा पैच के साथ बनाए रखा जाता है और नियमित रूप से अपडेट किया जाता है।

समाधान वॉकथ्रू

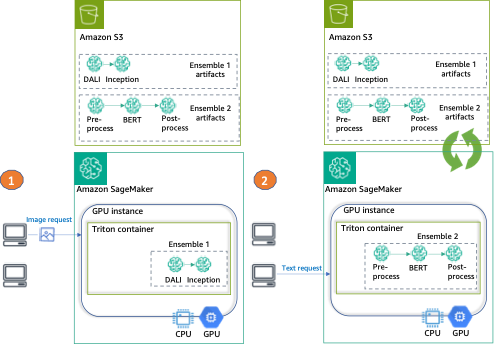

इस पोस्ट के लिए, हम ट्राइटन और एक सेजमेकर एंडपॉइंट का उपयोग करके एक जीपीयू इंस्टेंस पर दो अलग-अलग प्रकार के एन्सेम्बल तैनात करते हैं।

पहले समूह में दो मॉडल शामिल हैं: छवि प्रीप्रोसेसिंग के लिए एक DALI मॉडल और वास्तविक अनुमान के लिए एक TensorFlow Inception v3 मॉडल। पाइपलाइन समूह एन्कोडेड छवियों को एक इनपुट के रूप में लेता है, जिसे डिकोड करना होगा, 299×299 रिज़ॉल्यूशन में आकार बदलना होगा और सामान्यीकृत करना होगा। इस प्रीप्रोसेसिंग को DALI मॉडल द्वारा नियंत्रित किया जाएगा। DALI एक खुला स्रोत है डिकोडिंग और डेटा संवर्द्धन जैसे सामान्य छवि और भाषण प्रीप्रोसेसिंग कार्यों के लिए लाइब्रेरी। इंसेप्शन v3 एक छवि पहचान मॉडल है जिसमें सममित और असममित संकल्प, और औसत और अधिकतम पूलिंग पूरी तरह से जुड़ी परतें शामिल हैं (और इसलिए जीपीयू उपयोग के लिए बिल्कुल सही है)।

दूसरा पहनावा कच्चे प्राकृतिक भाषा के वाक्यों को एम्बेडिंग में बदल देता है और इसमें तीन मॉडल होते हैं। सबसे पहले, एक प्रीप्रोसेसिंग मॉडल इनपुट टेक्स्ट टोकनाइजेशन (पायथन में लागू) पर लागू किया जाता है। फिर हम पूर्व-प्रशिक्षित का उपयोग करते हैं BERT (अनकेस्ड) मॉडल से हगिंग फेस मॉडल हब टोकन एम्बेडिंग निकालने के लिए। BERT एक अंग्रेजी भाषा मॉडल है जिसे मास्क्ड लैंग्वेज मॉडलिंग (MLM) उद्देश्य का उपयोग करके प्रशिक्षित किया गया था। अंत में, हम एक पोस्टप्रोसेसिंग मॉडल लागू करते हैं जहां पिछले चरण से कच्चे टोकन एम्बेडिंग को वाक्य एम्बेडिंग में जोड़ा जाता है।

इन संयोजनों का उपयोग करने के लिए ट्राइटन को कॉन्फ़िगर करने के बाद, हम दिखाते हैं कि सेजमेकर एमएमई को कैसे कॉन्फ़िगर और चलाया जाए।

अंत में, हम प्रत्येक सामूहिक मंगलाचरण का एक उदाहरण प्रदान करते हैं, जैसा कि निम्नलिखित चित्र में देखा जा सकता है:

- सेट 1 - लक्ष्य समूह के रूप में DALI-इंसेप्शन को निर्दिष्ट करते हुए, एक छवि के साथ समापन बिंदु का आह्वान करें

- सेट 2 - इस बार टेक्स्ट इनपुट के साथ और प्रीप्रोसेस-बीईआरटी-पोस्टप्रोसेस संयोजन का अनुरोध करते हुए, उसी समापन बिंदु को लागू करें

पर्यावरण स्थापित करें

सबसे पहले, हम आवश्यक वातावरण स्थापित करते हैं। इसमें AWS लाइब्रेरीज़ को अपडेट करना शामिल है (जैसे बोटो3 और सेजमेकर एसडीके) और ट्राइटन का उपयोग करके हमारे एन्सेम्बल को पैकेज करने और अनुमान चलाने के लिए आवश्यक निर्भरताएँ स्थापित करना। हम सेजमेकर एसडीके डिफ़ॉल्ट निष्पादन भूमिका का भी उपयोग करते हैं। हम इस भूमिका का उपयोग सेजमेकर को अमेज़ॅन एस3 (जहां हमारे मॉडल कलाकृतियां संग्रहीत हैं) और तक पहुंचने में सक्षम बनाने के लिए करते हैं कंटेनर रजिस्ट्री (जहां NVIDIA ट्राइटन छवि का उपयोग किया जाएगा)। निम्नलिखित कोड देखें:

पहनावा तैयार करें

इस अगले चरण में, हम दो समूह तैयार करते हैं: DALI प्रीप्रोसेसिंग के साथ TensorFlow (TF) इंसेप्शन और Python प्रीप्रोसेसिंग और पोस्टप्रोसेसिंग के साथ BERT।

इसमें पूर्व-प्रशिक्षित मॉडलों को डाउनलोड करना, ट्राइटन कॉन्फ़िगरेशन फ़ाइलें प्रदान करना और तैनाती से पहले अमेज़ॅन एस 3 में संग्रहीत कलाकृतियों की पैकेजिंग करना शामिल है।

TF और DALI पहनावा तैयार करें

सबसे पहले, हम अपने मॉडलों और कॉन्फ़िगरेशन को संग्रहीत करने के लिए निर्देशिका तैयार करते हैं: टीएफ इंसेप्शन के लिए (inception_graphdef), DALI प्रीप्रोसेसिंग के लिए (dali), और समूह के लिए (ensemble_dali_inception). क्योंकि ट्राइटन मॉडल संस्करण का समर्थन करता है, हम मॉडल संस्करण को निर्देशिका पथ में भी जोड़ते हैं (1 के रूप में दर्शाया गया है क्योंकि हमारे पास केवल एक संस्करण है)। ट्राइटन संस्करण नीति के बारे में अधिक जानने के लिए, देखें संस्करण नीति. इसके बाद, हम इंसेप्शन v3 मॉडल डाउनलोड करते हैं, इसे निकालते हैं और कॉपी करते हैं inception_graphdef मॉडल निर्देशिका. निम्नलिखित कोड देखें:

अब, हम ट्राइटन को अपनी एसेम्बल पाइपलाइन का उपयोग करने के लिए कॉन्फ़िगर करते हैं। में एक config.pbtxt फ़ाइल में, हम इनपुट और आउटपुट टेंसर आकार और प्रकार निर्दिष्ट करते हैं, और ट्राइटन शेड्यूलर को जो कदम उठाने की आवश्यकता होती है (DALI प्रीप्रोसेसिंग और छवि वर्गीकरण के लिए इंसेप्शन मॉडल):

अगला, हम प्रत्येक मॉडल को कॉन्फ़िगर करते हैं। सबसे पहले, DALI बैकएंड के लिए मॉडल कॉन्फ़िगरेशन:

अगला, TensorFlow Inception v3 के लिए मॉडल कॉन्फ़िगरेशन जिसे हमने पहले डाउनलोड किया था:

क्योंकि यह एक वर्गीकरण मॉडल है, हमें इंसेप्शन मॉडल लेबल को भी कॉपी करने की आवश्यकता है inception_graphdef मॉडल रिपॉजिटरी में निर्देशिका। इन लेबलों में 1,000 वर्ग लेबल शामिल हैं IMAGEnet डाटासेट।

इसके बाद, हम DALI पाइपलाइन को कॉन्फ़िगर और क्रमबद्ध करते हैं जो फ़ाइल के लिए हमारी प्रीप्रोसेसिंग को संभालेगी। प्रीप्रोसेसिंग में छवि को पढ़ना (सीपीयू का उपयोग करके), डिकोडिंग (जीपीयू का उपयोग करके त्वरित करना), और छवि का आकार बदलना और सामान्य करना शामिल है।

अंत में, हम कलाकृतियों को एक साथ पैकेज करते हैं और उन्हें अमेज़ॅन S3 पर एक ही ऑब्जेक्ट के रूप में अपलोड करते हैं:

TensorRT और Python पहनावा तैयार करें

इस उदाहरण के लिए, हम पूर्व-प्रशिक्षित मॉडल का उपयोग करते हैं ट्रांसफार्मर पुस्तकालय.

आप सभी मॉडल (प्रीप्रोसेस और पोस्टप्रोसेस सहित) पा सकते हैं config.pbtxt फ़ाइलें) फ़ोल्डर में ensemble_hf. हमारी फ़ाइल सिस्टम संरचना में चार निर्देशिकाएँ (व्यक्तिगत मॉडल चरणों के लिए तीन और संयोजन के लिए एक) और साथ ही उनके संबंधित संस्करण शामिल होंगे:

में कार्यस्थान फ़ोल्डर, हम दो स्क्रिप्ट प्रदान करते हैं: पहला मॉडल को ONNX प्रारूप में परिवर्तित करने के लिए (onnx_exporter.py) और TensorRT संकलन स्क्रिप्ट (generate_model_trt.sh).

ट्राइटन मूल रूप से TensorRT रनटाइम का समर्थन करता है, जो आपको TensorRT इंजन को आसानी से तैनात करने में सक्षम बनाता है, जिससे चयनित GPU आर्किटेक्चर के लिए अनुकूलन होता है।

यह सुनिश्चित करने के लिए कि हम TensorRT संस्करण और निर्भरता का उपयोग करते हैं जो हमारे ट्राइटन कंटेनर में संगत हैं, हम NVIDIA के PyTorch कंटेनर छवि के संबंधित संस्करण का उपयोग करके मॉडल संकलित करते हैं:

फिर हम मॉडल कलाकृतियों को उस निर्देशिका में कॉपी करते हैं जिसे हमने पहले बनाया था और पथ में एक संस्करण जोड़ते हैं:

हम कॉनडा वातावरण तैयार करने के लिए कॉनडा पैक का उपयोग करते हैं जिसे ट्राइटन पायथन बैकएंड प्रीप्रोसेसिंग और पोस्टप्रोसेसिंग में उपयोग करेगा:

अंत में, हम मॉडल कलाकृतियों को Amazon S3 पर अपलोड करते हैं:

सेजमेकर एमएमई जीपीयू इंस्टेंस पर एन्सेम्बल चलाएँ

अब जबकि हमारी सामूहिक कलाकृतियाँ अमेज़न S3 में संग्रहीत हैं, हम SageMaker MME को कॉन्फ़िगर और लॉन्च कर सकते हैं।

हम कंटेनर छवि यूआरआई को पुनः प्राप्त करके प्रारंभ करते हैं ट्राइटन डीएलसी छवि जो मेल खाता है हमारे क्षेत्र में से एक कंटेनर रजिस्ट्री (और TensorRT मॉडल संकलन के लिए उपयोग की जाती है):

इसके बाद, हम सेजमेकर में मॉडल बनाते हैं। में create_model अनुरोध, हम उपयोग करने के लिए कंटेनर और मॉडल कलाकृतियों के स्थान का वर्णन करते हैं, और हम इसका उपयोग करके निर्दिष्ट करते हैं Mode पैरामीटर कि यह एक मल्टी-मॉडल है।

अपने समूह को होस्ट करने के लिए, हम इसके साथ एक समापन बिंदु कॉन्फ़िगरेशन बनाते हैं create_endpoint_config एपीआई कॉल करें, और फिर इसके साथ एक एंडपॉइंट बनाएं create_endpoint एपीआई. सेजमेकर तब होस्टिंग वातावरण में मॉडल के लिए आपके द्वारा परिभाषित सभी कंटेनरों को तैनात करता है।

हालाँकि इस उदाहरण में हम अपने मॉडल को होस्ट करने के लिए एक एकल उदाहरण सेट कर रहे हैं, सेजमेकर एमएमई एक ऑटो स्केलिंग नीति सेट करने का पूरी तरह से समर्थन करते हैं। इस सुविधा पर अधिक जानकारी के लिए देखें Amazon SageMaker मल्टी-मॉडल एंडपॉइंट के साथ GPU पर कई डीप लर्निंग मॉडल चलाएं.

अनुरोध पेलोड बनाएं और प्रत्येक मॉडल के लिए एमएमई को लागू करें

हमारे वास्तविक समय एमएमई तैनात होने के बाद, हमारे द्वारा उपयोग किए गए प्रत्येक मॉडल समूह के साथ हमारे समापन बिंदु को लागू करने का समय आ गया है।

सबसे पहले, हम DALI-इंसेप्शन समूह के लिए एक पेलोड बनाते हैं। हम उपयोग करते हैं shiba_inu_dog.jpg पालतू जानवरों की छवियों के सेजमेकर सार्वजनिक डेटासेट से छवि। हम DALI बैकएंड में उपयोग करने के लिए छवि को बाइट्स की एन्कोडेड सरणी के रूप में लोड करते हैं (अधिक जानने के लिए, देखें) छवि डिकोडर उदाहरण).

हमारी एन्कोडेड छवि और पेलोड तैयार होने के साथ, हम समापन बिंदु का आह्वान करते हैं।

ध्यान दें कि हम अपना लक्ष्य समूह निर्दिष्ट करते हैं model_tf_dali.tar.gz विरूपण साक्ष्य। टारगेटमॉडल पैरामीटर वह है जो एमएमई को सिंगल-मॉडल एंडपॉइंट से अलग करता है और हमें अनुरोध को सही मॉडल पर निर्देशित करने में सक्षम बनाता है।

प्रतिक्रिया में आह्वान के बारे में मेटाडेटा (जैसे मॉडल का नाम और संस्करण) और आउटपुट ऑब्जेक्ट के डेटा भाग में वास्तविक अनुमान प्रतिक्रिया शामिल है। इस उदाहरण में, हमें 1,001 मानों की एक सरणी मिलती है, जहां प्रत्येक मान उस वर्ग की संभावना है जिससे छवि संबंधित है (1,000 वर्ग और 1 अतिरिक्त मान दूसरों).

इसके बाद, हम अपने एमएमई को फिर से लागू करते हैं, लेकिन इस बार दूसरे समूह को लक्षित करते हैं। यहां डेटा केवल दो सरल पाठ वाक्य हैं:

ट्राइटन के साथ संचार को सरल बनाने के लिए, ट्राइटन परियोजना कई सुविधाएं प्रदान करती है ग्राहक पुस्तकालय. हम अपने अनुरोध में पेलोड तैयार करने के लिए उस लाइब्रेरी का उपयोग करते हैं:

अब हम समापन बिंदु लागू करने के लिए तैयार हैं - इस बार, लक्ष्य मॉडल है model_trt_python.tar.gz साथ में:

प्रतिक्रिया वाक्य एम्बेडिंग है जिसका उपयोग विभिन्न प्राकृतिक भाषा प्रसंस्करण (एनएलपी) अनुप्रयोगों में किया जा सकता है।

क्लीन अप

अंत में, हम एंडपॉइंट, एंडपॉइंट कॉन्फ़िगरेशन और मॉडल को साफ़ करते हैं और हटाते हैं:

निष्कर्ष

इस पोस्ट में, हमने दिखाया कि जीपीयू-त्वरित उदाहरण पर ट्राइटन एन्सेम्बल के साथ सेजमेकर एमएमई को कैसे कॉन्फ़िगर, तैनात और लागू किया जाए। हमने एक ही वास्तविक समय अनुमान वातावरण पर दो समूहों की मेजबानी की, जिससे हमारी लागत 50% कम हो गई (g4dn.4xlarge उदाहरण के लिए, जो वार्षिक बचत में $13,000 से अधिक का प्रतिनिधित्व करता है)। हालाँकि इस उदाहरण में केवल दो पाइपलाइनों का उपयोग किया गया है, सेजमेकर एमएमई हजारों मॉडल संयोजनों का समर्थन कर सकता है, जिससे यह एक असाधारण लागत बचत तंत्र बन जाता है। इसके अलावा, आप उत्पादन में मॉडल परिनियोजन के प्रबंधन के परिचालन ओवरहेड को कम करने के लिए मॉडल को लोड (और अनलोड) करने के लिए सेजमेकर एमएमई की गतिशील क्षमता का उपयोग कर सकते हैं।

लेखक के बारे में

सौरभ त्रिकंडे Amazon SageMaker Inference के वरिष्ठ उत्पाद प्रबंधक हैं। उन्हें ग्राहकों के साथ काम करने का शौक है और वह मशीन लर्निंग को लोकतांत्रिक बनाने के लक्ष्य से प्रेरित हैं। वह जटिल एमएल अनुप्रयोगों, बहु-किरायेदार एमएल मॉडल, लागत अनुकूलन, और गहन शिक्षण मॉडल की तैनाती को और अधिक सुलभ बनाने से संबंधित मुख्य चुनौतियों पर ध्यान केंद्रित करता है। अपने खाली समय में, सौरभ को हाइकिंग, नवीन तकनीकों के बारे में सीखने, टेकक्रंच का अनुसरण करने और अपने परिवार के साथ समय बिताने का आनंद मिलता है।

सौरभ त्रिकंडे Amazon SageMaker Inference के वरिष्ठ उत्पाद प्रबंधक हैं। उन्हें ग्राहकों के साथ काम करने का शौक है और वह मशीन लर्निंग को लोकतांत्रिक बनाने के लक्ष्य से प्रेरित हैं। वह जटिल एमएल अनुप्रयोगों, बहु-किरायेदार एमएल मॉडल, लागत अनुकूलन, और गहन शिक्षण मॉडल की तैनाती को और अधिक सुलभ बनाने से संबंधित मुख्य चुनौतियों पर ध्यान केंद्रित करता है। अपने खाली समय में, सौरभ को हाइकिंग, नवीन तकनीकों के बारे में सीखने, टेकक्रंच का अनुसरण करने और अपने परिवार के साथ समय बिताने का आनंद मिलता है।

निखिल कुलकर्णी AWS मशीन लर्निंग के साथ एक सॉफ्टवेयर डेवलपर है, जो मशीन लर्निंग वर्कलोड को क्लाउड पर अधिक प्रदर्शन करने वाला बनाने पर ध्यान केंद्रित करता है, और प्रशिक्षण और अनुमान के लिए AWS डीप लर्निंग कंटेनर्स का सह-निर्माता है। उन्हें वितरित डीप लर्निंग सिस्टम का शौक है। काम के अलावा, उन्हें किताबें पढ़ना, गिटार बजाना और पिज़्ज़ा बनाना पसंद है।

निखिल कुलकर्णी AWS मशीन लर्निंग के साथ एक सॉफ्टवेयर डेवलपर है, जो मशीन लर्निंग वर्कलोड को क्लाउड पर अधिक प्रदर्शन करने वाला बनाने पर ध्यान केंद्रित करता है, और प्रशिक्षण और अनुमान के लिए AWS डीप लर्निंग कंटेनर्स का सह-निर्माता है। उन्हें वितरित डीप लर्निंग सिस्टम का शौक है। काम के अलावा, उन्हें किताबें पढ़ना, गिटार बजाना और पिज़्ज़ा बनाना पसंद है।

उरी रोसेनबर्ग यूरोप, मध्य पूर्व और अफ्रीका के लिए एआई और एमएल विशेषज्ञ तकनीकी प्रबंधक हैं। इज़राइल में स्थित, उरी बड़े पैमाने पर एमएल वर्कलोड को डिजाइन, निर्माण और संचालित करने के लिए उद्यम ग्राहकों को सशक्त बनाने के लिए काम करता है। अपने खाली समय में, वह साइकिल चलाना, बैकपैकिंग और बैकप्रॉपैगेटिंग का आनंद लेते हैं।

उरी रोसेनबर्ग यूरोप, मध्य पूर्व और अफ्रीका के लिए एआई और एमएल विशेषज्ञ तकनीकी प्रबंधक हैं। इज़राइल में स्थित, उरी बड़े पैमाने पर एमएल वर्कलोड को डिजाइन, निर्माण और संचालित करने के लिए उद्यम ग्राहकों को सशक्त बनाने के लिए काम करता है। अपने खाली समय में, वह साइकिल चलाना, बैकपैकिंग और बैकप्रॉपैगेटिंग का आनंद लेते हैं।

एलीउथ ट्रायना इज़ाज़ा NVIDIA-AWS टीम में डेवलपर रिलेशंस मैनेजर हैं। वह अमेज़ॅन और एडब्ल्यूएस उत्पाद नेताओं, डेवलपर्स और वैज्ञानिकों को एनवीआईडीआईए प्रौद्योगिकीविदों और उत्पाद नेताओं के साथ जोड़ता है ताकि अमेज़ॅन एमएल / डीएल वर्कलोड, ईसी 2 उत्पादों और एडब्ल्यूएस एआई सेवाओं को तेज किया जा सके। इसके अलावा, Eliuth एक भावुक पर्वत बाइकर, स्कीयर और पोकर खिलाड़ी है।

एलीउथ ट्रायना इज़ाज़ा NVIDIA-AWS टीम में डेवलपर रिलेशंस मैनेजर हैं। वह अमेज़ॅन और एडब्ल्यूएस उत्पाद नेताओं, डेवलपर्स और वैज्ञानिकों को एनवीआईडीआईए प्रौद्योगिकीविदों और उत्पाद नेताओं के साथ जोड़ता है ताकि अमेज़ॅन एमएल / डीएल वर्कलोड, ईसी 2 उत्पादों और एडब्ल्यूएस एआई सेवाओं को तेज किया जा सके। इसके अलावा, Eliuth एक भावुक पर्वत बाइकर, स्कीयर और पोकर खिलाड़ी है।

- एसईओ संचालित सामग्री और पीआर वितरण। आज ही प्रवर्धित हो जाओ।

- प्लेटोडेटा.नेटवर्क वर्टिकल जेनरेटिव एआई। स्वयं को शक्तिवान बनाएं। यहां पहुंचें।

- प्लेटोआईस्ट्रीम। Web3 इंटेलिजेंस। ज्ञान प्रवर्धित। यहां पहुंचें।

- प्लेटोईएसजी. ऑटोमोटिव/ईवीएस, कार्बन, क्लीनटेक, ऊर्जा, पर्यावरण, सौर, कचरा प्रबंधन। यहां पहुंचें।

- BlockOffsets. पर्यावरणीय ऑफसेट स्वामित्व का आधुनिकीकरण। यहां पहुंचें।

- स्रोत: https://aws.amazon.com/blogs/machine-learning/deploy-thousands-of-model-ensembles-with-amazon-sagemaker-multi-model-endpoints-on-gpu-to-minimize-your-hosting-costs/

- :हैस

- :है

- :नहीं

- :कहाँ

- $यूपी

- 000

- 1

- 10

- 100

- 11

- 12

- 14

- 16

- 22

- 224

- 23

- 7

- 8

- a

- क्षमता

- About

- में तेजी लाने के

- त्वरित

- तेज

- पहुँच

- सुलभ

- समायोजित

- अनुसार

- पाना

- के पार

- वास्तविक

- अचक्रीय

- जोड़ना

- जोड़ने

- इसके अलावा

- अतिरिक्त

- इसके अतिरिक्त

- दत्तक ग्रहण

- उन्नत

- अफ्रीका

- फिर

- AI

- ऐ सेवा

- सब

- की अनुमति दे

- साथ में

- पहले ही

- भी

- हालांकि

- वीरांगना

- अमेज़न SageMaker

- अमेज़ॅन वेब सेवा

- an

- और

- एपीआई

- आवेदन

- अनुप्रयोगों

- लागू

- लागू करें

- दृष्टिकोण

- स्थापत्य

- हैं

- ऐरे

- AS

- At

- स्वत:

- स्वचालित

- उपलब्ध

- औसत

- एडब्ल्यूएस

- AWS मशीन लर्निंग

- बैकएण्ड

- आधार

- आधारित

- BE

- क्योंकि

- किया गया

- से पहले

- जा रहा है

- अंतर्गत आता है

- लाभ

- के बीच

- खंड

- पुस्तकें

- के छात्रों

- सफलताओं

- निर्माण

- लेकिन

- by

- कॉल

- कर सकते हैं

- क्षमता

- मामला

- मामलों

- केंद्रीय

- चुनौतियों

- कक्षा

- कक्षाएं

- वर्गीकरण

- बादल

- समूह

- कोड

- COM

- संयुक्त

- सामान्य

- संचार

- संगत

- जटिल

- गणना करना

- कंप्यूटर

- Computer Vision

- विन्यास

- कॉन्फ़िगर किया गया

- जुड़ा हुआ

- संबंध

- जोड़ता है

- होते हैं

- कंटेनर

- कंटेनरों

- लगातार

- नियंत्रण

- बदलना

- मूल

- इसी

- लागत

- लागत बचत

- प्रभावी लागत

- लागत

- बनाना

- बनाया

- रिवाज

- ग्राहक

- डेग

- तिथि

- डिकोडिंग

- समर्पण

- गहरा

- ध्यान लगा के पढ़ना या सीखना

- चूक

- परिभाषित

- परिभाषित

- लोकतंत्रीकरण

- निर्भरता

- तैनात

- तैनात

- तैनाती

- तैनाती

- तैनाती

- तैनात

- वर्णन

- डिज़ाइन

- बनाया गया

- खोज

- डेवलपर

- डेवलपर्स

- विभिन्न

- प्रत्यक्ष

- निर्देशिकाओं

- वितरित

- डाक में काम करनेवाला मज़दूर

- कर देता है

- नहीं करता है

- डाउनलोड

- डाउनलोड

- गतिशील

- गतिशील

- से प्रत्येक

- पूर्व

- आसानी

- पूर्व

- अन्य

- सशक्त

- सक्षम

- सक्षम बनाता है

- endpoint

- इंजन

- अंग्रेज़ी

- पर्याप्त

- सुनिश्चित

- उद्यम

- संपूर्ण

- वातावरण

- यूरोप

- उदाहरण

- उदाहरण

- निष्पादन

- विस्तारित

- बाहरी

- अतिरिक्त

- उद्धरण

- असाधारण

- चेहरा

- परिवार

- और तेज

- Feature

- विशेषताएं

- पट्टिका

- फ़ाइलें

- अंत में

- खोज

- प्रथम

- बेड़ा

- नाव

- केंद्रित

- ध्यान केंद्रित

- का पालन करें

- निम्नलिखित

- के लिए

- प्रपत्र

- प्रारूप

- चार

- चौखटे

- से

- पूरी तरह से

- कार्यक्षमता

- आगे

- और भी

- उत्पन्न

- उत्पादक

- जनरेटिव एआई

- मिल

- लक्ष्य

- GPU

- ग्राफ

- संभालना

- हार्डवेयर

- है

- he

- मदद

- यहाँ उत्पन्न करें

- हाई

- उच्चतम

- उसके

- मेजबान

- मेजबानी

- होस्टिंग

- होस्टिंग लागत

- मेजबान

- कैसे

- How To

- तथापि

- एचटीएमएल

- http

- HTTPS

- i

- if

- की छवि

- छवि वर्गीकरण

- छवि मान्यता

- छवियों

- कार्यान्वित

- आयात

- in

- आरंभ

- शामिल

- शामिल

- व्यक्ति

- उद्योगों

- करें-

- अभिनव

- नवीन प्रौद्योगिकियां

- निवेश

- निविष्टियां

- स्थापित कर रहा है

- उदाहरण

- बजाय

- एकीकरण

- बुद्धि

- में

- लागू

- इजराइल

- IT

- आईटी इस

- जेपीजी

- JSON

- केवल

- कुंजी

- बच्चा

- लेबल

- भाषा

- बड़ा

- बाद में

- लांच

- शुरू करने

- परतों

- नेताओं

- जानें

- सीख रहा हूँ

- चलो

- पुस्तकालयों

- पुस्तकालय

- जीवन चक्र

- पसंद

- एलएलएम

- भार

- लोड हो रहा है

- भार

- स्थानीय स्तर पर

- स्थान

- स्थानों

- तर्क

- मशीन

- यंत्र अधिगम

- बनाया गया

- बनाना

- बनाता है

- निर्माण

- कामयाब

- प्रबंधक

- प्रबंधन करता है

- प्रबंध

- बहुत

- मास्क

- मैक्स

- तंत्र

- याद

- मेटाडाटा

- मध्यम

- मध्य पूर्व

- हो सकता है

- कम से कम

- मिश्रित

- ML

- एमएलओपीएस

- मोड

- आदर्श

- मोडलिंग

- मॉडल

- अधिक

- प्रेरित

- पहाड़

- विभिन्न

- चाहिए

- नाम

- प्राकृतिक

- प्राकृतिक भाषा संसाधन

- आवश्यकता

- जरूरत

- की जरूरत है

- नेटवर्क

- तंत्रिका जाल

- नया

- अगला

- NLP

- नहीं

- संख्या

- numpy

- Nvidia

- वस्तु

- ऑब्जेक्ट डिटेक्शन

- उद्देश्य

- of

- अक्सर

- पुराना

- on

- ONE

- लोगों

- केवल

- खुला स्रोत

- संचालित

- परिचालन

- ऑप्टिमाइज़ करें

- के अनुकूलन के

- or

- अन्य

- हमारी

- आउट

- उत्पादन

- बाहर

- के ऊपर

- पैक

- पैकेज

- पैकेजिंग

- समानांतर

- प्राचल

- पैरामीटर

- भाग

- विशेष

- आवेशपूर्ण

- पैच

- पथ

- पैटर्न उपयोग करें

- का भुगतान

- उत्तम

- प्रदर्शन

- PHP

- पाइपलाइन

- पिज़्ज़ा

- जगह

- योजना

- मंच

- प्लेटो

- प्लेटो डेटा इंटेलिजेंस

- प्लेटोडाटा

- खिलाड़ी

- पोकर

- नीति

- पद

- तैयार करना

- पिछला

- प्रोएक्टिव

- प्रसंस्करण

- एस्ट्रो मॉल

- उत्पादन प्रबंधक

- उत्पादन

- उत्पाद

- परियोजना

- संपत्ति

- आद्य

- प्रदान करना

- बशर्ते

- प्रदान करता है

- प्रदान कर

- सार्वजनिक

- अजगर

- pytorch

- उठाना

- कच्चा

- पहुँचती है

- पढ़ना

- तैयार

- वास्तविक समय

- प्राप्त

- हाल

- मान्यता

- की सिफारिश की

- को कम करने

- घटी

- क्षेत्र

- रजिस्ट्री

- नियमित तौर पर

- सम्बंधित

- संबंधों

- रहना

- दूरस्थ

- हटाने

- कोष

- का प्रतिनिधित्व करता है

- का अनुरोध

- अनुरोधों

- की आवश्यकता होती है

- अपेक्षित

- संकल्प

- उपयुक्त संसाधन चुनें

- कि

- प्रतिक्रिया

- वापसी

- रिटर्न

- आरजीबी

- सही

- भूमिका

- मार्गों

- रन

- sagemaker

- सेजमेकर अनुमान

- वही

- बचत

- बचत

- स्केल

- स्केलिंग

- वैज्ञानिक

- वैज्ञानिकों

- लिपियों

- एसडीके

- मूल

- दूसरा

- सिक्योर्ड

- सुरक्षा

- देखना

- देखा

- चयनित

- भेजना

- वरिष्ठ

- वाक्य

- कई

- सेवाएँ

- सेवारत

- सेट

- की स्थापना

- कई

- आकार

- आकार

- साझा

- दिखाना

- पता चला

- सरल

- को आसान बनाने में

- एक

- आकार

- So

- सॉफ्टवेयर

- समाधान

- समाधान ढूंढे

- कुछ

- विशेषज्ञ

- विनिर्देश

- विनिर्दिष्ट

- भाषण

- खर्च

- प्रारंभ

- राज्य के-the-कला

- कदम

- कदम

- फिर भी

- रुकें

- भंडारण

- संग्रहित

- भंडारण

- संरचना

- ऐसा

- समर्थन

- समर्थन करता है

- निश्चित

- प्रणाली

- सिस्टम

- लेना

- लेता है

- लक्ष्य

- कार्य

- टीम

- TechCrunch

- तकनीकी

- टेक्नोलॉजीज

- प्रौद्योगिकीविदों

- tensorflow

- कि

- RSI

- लेकिन हाल ही

- उन

- फिर

- वहाँ।

- जिसके चलते

- इसलिये

- इन

- वे

- इसका

- उन

- हजारों

- तीन

- यहाँ

- पहर

- सेवा मेरे

- एक साथ

- टोकन

- tokenization

- उपकरण

- यातायात

- प्रशिक्षित

- प्रशिक्षण

- रूपांतरण

- नरमीन

- दो

- प्रकार

- ठेठ

- आम तौर पर

- अप्रयुक्त

- अद्यतन

- अद्यतन

- us

- प्रयोग

- उपयोग

- उदाहरण

- प्रयुक्त

- उपयोगकर्ताओं

- का उपयोग

- मूल्य

- मान

- विविधता

- संस्करण

- संस्करणों

- देखें

- दृष्टि

- आयतन

- करना चाहते हैं

- था

- we

- वेब

- वेब सेवाओं

- कुंआ

- क्या

- कब

- कौन कौन से

- जब

- मर्जी

- साथ में

- काम

- काम कर रहे

- कार्य

- सालाना

- आप

- आपका

- जेफिरनेट