आज के तेजी से विकसित हो रहे स्वास्थ्य देखभाल परिदृश्य में, डॉक्टरों को विभिन्न स्रोतों, जैसे देखभालकर्ता नोट्स, इलेक्ट्रॉनिक स्वास्थ्य रिकॉर्ड और इमेजिंग रिपोर्ट से बड़ी मात्रा में नैदानिक डेटा का सामना करना पड़ता है। जानकारी का यह खजाना, हालांकि रोगी की देखभाल के लिए आवश्यक है, चिकित्सा पेशेवरों के लिए इसे छानने और विश्लेषण करने में भारी और समय लेने वाला भी हो सकता है। बेहतर रोगी देखभाल और निर्णय लेने के लिए इस डेटा का कुशलतापूर्वक सारांश बनाना और अंतर्दृष्टि निकालना महत्वपूर्ण है। सारांशित रोगी जानकारी कई डाउनस्ट्रीम प्रक्रियाओं के लिए उपयोगी हो सकती है जैसे डेटा एकत्रीकरण, रोगियों को प्रभावी ढंग से कोडिंग करना, या समीक्षा के लिए समान निदान वाले रोगियों को समूहीकृत करना।

कृत्रिम बुद्धिमत्ता (एआई) और मशीन लर्निंग (एमएल) मॉडल ने इन चुनौतियों से निपटने में काफी संभावनाएं दिखाई हैं। मॉडलों को बड़ी मात्रा में टेक्स्ट डेटा का विश्लेषण और व्याख्या करने के लिए प्रशिक्षित किया जा सकता है, जिससे जानकारी को संक्षिप्त सारांशों में प्रभावी ढंग से संक्षेपित किया जा सके। सारांशीकरण प्रक्रिया को स्वचालित करके, डॉक्टर तुरंत प्रासंगिक जानकारी तक पहुंच प्राप्त कर सकते हैं, जिससे उन्हें रोगी की देखभाल पर ध्यान केंद्रित करने और अधिक सूचित निर्णय लेने की अनुमति मिलती है। निम्नलिखित देखें मामले का अध्ययन वास्तविक दुनिया के उपयोग के मामले के बारे में अधिक जानने के लिए।

अमेज़न SageMaker, एक पूरी तरह से प्रबंधित एमएल सेवा, विभिन्न एआई/एमएल-आधारित सारांश मॉडल और दृष्टिकोण की मेजबानी और कार्यान्वयन के लिए एक आदर्श मंच प्रदान करती है। इस पोस्ट में, हम सेजमेकर पर संक्षेपण तकनीकों को लागू करने के लिए विभिन्न विकल्पों का पता लगाते हैं, जिसमें उपयोग भी शामिल है अमेज़न SageMaker जम्पस्टार्ट फाउंडेशन मॉडल, हगिंग फेस से पूर्व-प्रशिक्षित मॉडल को ठीक करना और कस्टम सारांश मॉडल बनाना। हम प्रत्येक दृष्टिकोण के पेशेवरों और विपक्षों पर भी चर्चा करते हैं, जिससे स्वास्थ्य पेशेवरों को जटिल नैदानिक डेटा के संक्षिप्त और सटीक सारांश तैयार करने के लिए सबसे उपयुक्त समाधान चुनने में मदद मिलती है।

शुरू करने से पहले जानने योग्य दो महत्वपूर्ण शब्द: पूर्व प्रशिक्षित और फ़ाइन ट्यूनिंग. एक पूर्व-प्रशिक्षित या फाउंडेशन मॉडल वह है जिसे डेटा के एक बड़े भंडार पर बनाया और प्रशिक्षित किया गया है, आमतौर पर सामान्य भाषा ज्ञान के लिए। फाइन-ट्यूनिंग वह प्रक्रिया है जिसके द्वारा एक पूर्व-प्रशिक्षित मॉडल को किसी विशिष्ट कार्य पर अपना प्रदर्शन बढ़ाने के लिए एक और अधिक डोमेन-विशिष्ट डेटासेट दिया जाता है। स्वास्थ्य देखभाल सेटिंग में, इसका मतलब मॉडल को विशेष रूप से रोगी देखभाल से संबंधित वाक्यांशों और शब्दावली सहित कुछ डेटा देना होगा।

सेजमेकर पर कस्टम सारांश मॉडल बनाएं

हालांकि सबसे अधिक प्रयास वाला दृष्टिकोण, कुछ संगठन शुरू से ही सेजमेकर पर कस्टम सारांश मॉडल बनाना पसंद कर सकते हैं। इस दृष्टिकोण के लिए एआई/एमएल मॉडल के अधिक गहन ज्ञान की आवश्यकता होती है और इसमें स्क्रैच से एक मॉडल आर्किटेक्चर बनाना या विशिष्ट आवश्यकताओं के अनुरूप मौजूदा मॉडल को अनुकूलित करना शामिल हो सकता है। कस्टम मॉडल का निर्माण सारांश प्रक्रिया पर अधिक लचीलापन और नियंत्रण प्रदान कर सकता है, लेकिन पूर्व-प्रशिक्षित मॉडल से शुरू होने वाले दृष्टिकोण की तुलना में अधिक समय और संसाधनों की भी आवश्यकता होती है। आगे बढ़ने से पहले इस विकल्प के लाभों और कमियों पर सावधानीपूर्वक विचार करना आवश्यक है, क्योंकि यह सभी उपयोग के मामलों के लिए उपयुक्त नहीं हो सकता है।

सेजमेकर जम्पस्टार्ट फाउंडेशन मॉडल

सेजमेकर पर संक्षेपण लागू करने का एक बढ़िया विकल्प जम्पस्टार्ट फाउंडेशन मॉडल का उपयोग करना है। अग्रणी एआई अनुसंधान संगठनों द्वारा विकसित ये मॉडल, पाठ सारांश सहित विभिन्न कार्यों के लिए अनुकूलित पूर्व-प्रशिक्षित भाषा मॉडल की एक श्रृंखला प्रदान करते हैं। सेजमेकर जम्पस्टार्ट दो प्रकार के फाउंडेशन मॉडल प्रदान करता है: मालिकाना मॉडल और ओपन-सोर्स मॉडल। सेजमेकर जम्पस्टार्ट HIPAA पात्रता भी प्रदान करता है, जो इसे स्वास्थ्य देखभाल कार्यभार के लिए उपयोगी बनाता है। अनुपालन सुनिश्चित करना अंततः ग्राहक पर निर्भर है, इसलिए उचित कदम उठाना सुनिश्चित करें। देखना अमेज़ॅन वेब सेवाओं पर HIPAA सुरक्षा और अनुपालन के लिए आर्किटेक्चरिंग अधिक जानकारी के लिए.

मालिकाना फाउंडेशन मॉडल

मालिकाना मॉडल, जैसे AI21 से जुरासिक मॉडल और कोहेयर से कोहेयर जेनरेट मॉडल, को सेजमेकर जम्पस्टार्ट के माध्यम से खोजा जा सकता है एडब्ल्यूएस प्रबंधन कंसोल और अभी पूर्वावलोकन में हैं। संक्षेपण के लिए मालिकाना मॉडल का उपयोग करना आदर्श है जब आपको कस्टम डेटा पर अपने मॉडल को ठीक करने की आवश्यकता नहीं है। यह उपयोग में आसान, आउट-ऑफ़-द-बॉक्स समाधान प्रदान करता है जो न्यूनतम कॉन्फ़िगरेशन के साथ आपकी सारांश आवश्यकताओं को पूरा कर सकता है। इन पूर्व-प्रशिक्षित मॉडलों की क्षमताओं का उपयोग करके, आप समय और संसाधनों को बचा सकते हैं जो अन्यथा किसी कस्टम मॉडल को प्रशिक्षण और फाइन-ट्यूनिंग पर खर्च किए जाएंगे। इसके अलावा, मालिकाना मॉडल आम तौर पर उपयोगकर्ता के अनुकूल एपीआई और एसडीके के साथ आते हैं, जो आपके मौजूदा सिस्टम और अनुप्रयोगों के साथ एकीकरण प्रक्रिया को सुव्यवस्थित करते हैं। यदि आपकी सारांशीकरण आवश्यकताओं को विशिष्ट अनुकूलन या फाइन-ट्यूनिंग की आवश्यकता के बिना पूर्व-प्रशिक्षित मालिकाना मॉडल द्वारा पूरा किया जा सकता है, तो वे आपके पाठ सारांशीकरण कार्यों के लिए एक सुविधाजनक, लागत प्रभावी और कुशल समाधान प्रदान करते हैं। क्योंकि इन मॉडलों को विशेष रूप से स्वास्थ्य देखभाल के उपयोग के मामलों के लिए प्रशिक्षित नहीं किया गया है, इसलिए बेहतर ट्यूनिंग के बिना चिकित्सा भाषा के लिए गुणवत्ता की गारंटी नहीं दी जा सकती है।

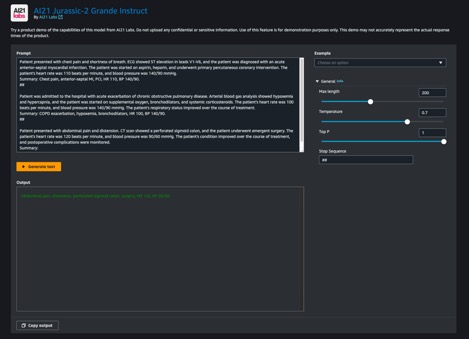

जुरासिक-2 ग्रांडे इंस्ट्रक्ट AI21 लैब्स द्वारा एक बड़ा भाषा मॉडल (एलएलएम) है, जो प्राकृतिक भाषा निर्देशों के लिए अनुकूलित है और विभिन्न भाषा कार्यों पर लागू होता है। यह गुणवत्ता और सामर्थ्य को संतुलित करते हुए उपयोग में आसान एपीआई और पायथन एसडीके प्रदान करता है। लोकप्रिय उपयोगों में मार्केटिंग कॉपी तैयार करना, चैटबॉट्स को सशक्त बनाना और टेक्स्ट सारांशीकरण शामिल है।

सेजमेकर कंसोल पर, सेजमेकर जम्पस्टार्ट पर जाएँ, AI21 जुरासिक-2 ग्रांडे इंस्ट्रक्ट मॉडल ढूंढें, और चुनें मॉडल ट्राई करें.

यदि आप मॉडल को सेजमेकर एंडपॉइंट पर तैनात करना चाहते हैं जिसे आप प्रबंधित करते हैं, तो आप इस नमूने में दिए गए चरणों का पालन कर सकते हैं नोटबुक, जो आपको दिखाता है कि सेजमेकर का उपयोग करके जुरासिक-2 लार्ज को कैसे तैनात किया जाए।

ओपन-सोर्स फाउंडेशन मॉडल

ओपन-सोर्स मॉडल में FLAN T5, ब्लूम और GPT-2 मॉडल शामिल हैं जिन्हें सेजमेकर जम्पस्टार्ट के माध्यम से खोजा जा सकता है अमेज़ॅन सैजमेकर स्टूडियो सेजमेकर कंसोल पर यूआई, सेजमेकर जंपस्टार्ट और सेजमेकर जंपस्टार्ट एपीआई। इन मॉडलों को आपके AWS खाते के अंतर्गत अंतिम बिंदुओं पर ठीक-ठीक और तैनात किया जा सकता है, जिससे आपको मॉडल भार और स्क्रिप्ट कोड का पूर्ण स्वामित्व मिलता है।

फ़्लान-टी5 एक्सएल एक शक्तिशाली और बहुमुखी मॉडल है जिसे विभिन्न प्रकार के भाषाई कार्यों के लिए डिज़ाइन किया गया है। अपने डोमेन-विशिष्ट डेटा के साथ मॉडल को ठीक करके, आप अपने विशेष उपयोग के मामले, जैसे पाठ सारांश या किसी अन्य एनएलपी कार्य के लिए इसके प्रदर्शन को अनुकूलित कर सकते हैं। सेजमेकर स्टूडियो यूआई का उपयोग करके फ़्लान-टी5 एक्सएल को फाइन-ट्यून करने के तरीके के विवरण के लिए, देखें Amazon SageMaker जम्पस्टार्ट के साथ FLAN T5 XL के लिए फाइन-ट्यूनिंग निर्देश.

सेजमेकर पर हगिंग फेस के साथ पूर्व-प्रशिक्षित मॉडलों को फाइन-ट्यूनिंग

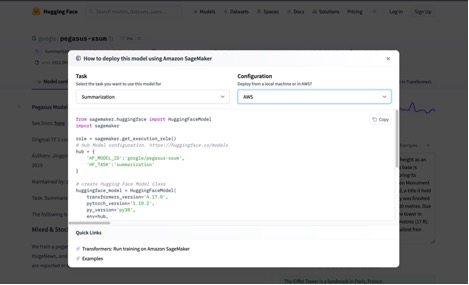

सेजमेकर पर संक्षेपण लागू करने के लिए सबसे लोकप्रिय विकल्पों में से एक हगिंग फेस का उपयोग करके पूर्व-प्रशिक्षित मॉडल को ठीक करना है ट्रान्सफ़ॉर्मर पुस्तकालय। हगिंग फेस पूर्व-प्रशिक्षित ट्रांसफार्मर मॉडल की एक विस्तृत श्रृंखला प्रदान करता है जो विशेष रूप से पाठ सारांश सहित विभिन्न प्राकृतिक भाषा प्रसंस्करण (एनएलपी) कार्यों के लिए डिज़ाइन किया गया है। हगिंग फेस ट्रांसफॉर्मर्स लाइब्रेरी के साथ, आप सेजमेकर का उपयोग करके अपने डोमेन-विशिष्ट डेटा पर इन पूर्व-प्रशिक्षित मॉडलों को आसानी से फाइन-ट्यून कर सकते हैं। इस दृष्टिकोण के कई फायदे हैं, जैसे तेज़ प्रशिक्षण समय, विशिष्ट डोमेन पर बेहतर प्रदर्शन, और अंतर्निहित सेजमेकर टूल और सेवाओं का उपयोग करके आसान मॉडल पैकेजिंग और तैनाती। यदि आप सेजमेकर जंपस्टार्ट में एक उपयुक्त मॉडल नहीं ढूंढ पा रहे हैं, तो आप हगिंग फेस द्वारा पेश किए गए किसी भी मॉडल को चुन सकते हैं और सेजमेकर का उपयोग करके इसे ठीक कर सकते हैं।

एमएल की क्षमताओं के बारे में जानने के लिए एक मॉडल के साथ काम करना शुरू करने के लिए, आपको बस सेजमेकर स्टूडियो खोलना होगा, एक पूर्व-प्रशिक्षित मॉडल ढूंढना होगा जिसे आप उपयोग करना चाहते हैं हगिंग फेस मॉडल हब, और अपनी परिनियोजन विधि के रूप में सेजमेकर चुनें। हगिंग फेस आपको कॉपी करने, पेस्ट करने और अपनी नोटबुक में चलाने के लिए कोड देगा। यह उतना ही आसान है! किसी एमएल इंजीनियरिंग अनुभव की आवश्यकता नहीं है।

हगिंग फेस ट्रांसफॉर्मर्स लाइब्रेरी बिल्डरों को पूर्व-प्रशिक्षित मॉडलों पर काम करने और फाइन-ट्यूनिंग जैसे उन्नत कार्य करने में सक्षम बनाती है, जिसे हम निम्नलिखित अनुभागों में देखेंगे।

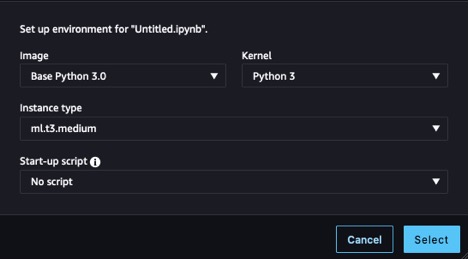

प्रावधान संसाधन

शुरू करने से पहले, हमें एक नोटबुक का प्रावधान करना होगा। निर्देशों के लिए, चरण 1 और 2 देखें स्थानीय स्तर पर मशीन लर्निंग मॉडल बनाएं और प्रशिक्षित करें. इस उदाहरण के लिए, हमने निम्नलिखित स्क्रीनशॉट में दिखाई गई सेटिंग्स का उपयोग किया।

हमें भी एक बनाने की जरूरत है अमेज़न सरल भंडारण सेवा (अमेज़ॅन S3) प्रशिक्षण डेटा और प्रशिक्षण कलाकृतियों को संग्रहीत करने के लिए बाल्टी। निर्देशों के लिए, देखें एक बाल्टी बनाना.

डेटासेट तैयार करें

बेहतर डोमेन ज्ञान के लिए अपने मॉडल को बेहतर बनाने के लिए, हमें कार्य के लिए उपयुक्त डेटा प्राप्त करने की आवश्यकता है। किसी एंटरप्राइज़ उपयोग के मामले में प्रशिक्षण देते समय, आपको प्रशिक्षण के लिए तैयार होने के लिए अपना स्वयं का डेटा तैयार करने के लिए कई डेटा इंजीनियरिंग कार्यों से गुजरना होगा। वे कार्य इस पोस्ट के दायरे से बाहर हैं. इस उदाहरण के लिए, हमने नर्सिंग नोट्स का अनुकरण करने के लिए कुछ सिंथेटिक डेटा तैयार किया है और इसे अमेज़ॅन S3 में संग्रहीत किया है। Amazon S3 में अपना डेटा संग्रहीत करना हमें सक्षम बनाता है HIPAA अनुपालन के लिए हमारे कार्यभार को व्यवस्थित करें. हम उन नोट्स को प्राप्त करके और उन्हें उस इंस्टेंस पर लोड करके शुरू करते हैं जहां हमारी नोटबुक चल रही है:

नोट्स एक कॉलम से बने होते हैं जिसमें पूर्ण प्रविष्टि, नोट और एक कॉलम होता है जिसमें एक संक्षिप्त संस्करण होता है जो दर्शाता है कि हमारा वांछित आउटपुट क्या होना चाहिए, सारांश। इस डेटासेट का उपयोग करने का उद्देश्य हमारे मॉडल की जैविक और चिकित्सा शब्दावली में सुधार करना है ताकि यह स्वास्थ्य देखभाल संदर्भ में संक्षेपण के लिए अधिक उपयुक्त हो, जिसे कहा जाता है डोमेन फाइन-ट्यूनिंग, और हमारे मॉडल को दिखाएं कि इसके सारांशित आउटपुट को कैसे संरचित किया जाए। कुछ संक्षेपण मामलों में, हम किसी लेख से एक सार या किसी समीक्षा का एक-पंक्ति सारांश बनाना चाह सकते हैं, लेकिन इस मामले में, हम अपने मॉडल को लक्षणों और किए गए कार्यों के संक्षिप्त संस्करण को आउटपुट करने का प्रयास कर रहे हैं। एक मरीज के लिए अब तक.

मॉडल लोड करें

जिस मॉडल को हम अपनी नींव के रूप में उपयोग करते हैं वह Google के पेगासस का एक संस्करण है, जिसे हगिंग फेस हब में उपलब्ध कराया गया है, जिसे कहा जाता है पेगासस-xsum. इसे संक्षेपण के लिए पहले से ही प्रशिक्षित किया गया है, इसलिए हमारी फाइन-ट्यूनिंग प्रक्रिया इसके डोमेन ज्ञान को बढ़ाने पर ध्यान केंद्रित कर सकती है। हमारे मॉडल द्वारा चलाए जा रहे कार्य को संशोधित करना एक अलग प्रकार की फाइन-ट्यूनिंग है जिसे इस पोस्ट में शामिल नहीं किया गया है। ट्रांसफार्मर लाइब्रेरी हमें मॉडल परिभाषा को लोड करने के लिए एक क्लास प्रदान करती है model_checkpoint: google/pegasus-xsum. यह मॉडल को हब से लोड करेगा और इसे हमारी नोटबुक में इंस्टेंट करेगा ताकि हम इसे बाद में उपयोग कर सकें। क्योंकि pegasus-xsum एक अनुक्रम-से-अनुक्रम मॉडल है, हम Seq2Seq प्रकार का उपयोग करना चाहते हैं ऑटो मॉडल वर्ग:

अब जब हमारे पास अपना मॉडल है, तो अब समय आ गया है कि हम अपना ध्यान अन्य घटकों पर लगाएं जो हमें अपना प्रशिक्षण लूप चलाने में सक्षम बनाएंगे।

एक टोकननाइज़र बनाएं

इन घटकों में से पहला है टोकननाइज़र। tokenization वह प्रक्रिया है जिसके द्वारा इनपुट डेटा से शब्दों को संख्यात्मक निरूपण में बदल दिया जाता है जिसे हमारा मॉडल समझ सकता है। फिर से, ट्रांसफॉर्मर लाइब्रेरी हमें उसी चेकपॉइंट से टोकननाइज़र परिभाषा लोड करने के लिए एक क्लास प्रदान करती है जिसका उपयोग हमने मॉडल को इंस्टेंट करने के लिए किया था:

इस टोकननाइज़र ऑब्जेक्ट के साथ, हम एक प्रीप्रोसेसिंग फ़ंक्शन बना सकते हैं और इसे मॉडल में फीड करने के लिए तैयार टोकन देने के लिए इसे अपने डेटासेट पर मैप कर सकते हैं। अंत में, हम टोकनयुक्त आउटपुट को प्रारूपित करते हैं और हमारे मूल पाठ वाले कॉलम को हटा देते हैं, क्योंकि मॉडल उनकी व्याख्या करने में सक्षम नहीं होगा। अब हमारे पास मॉडल में फीड किए जाने के लिए तैयार एक टोकनयुक्त इनपुट बचा है। निम्नलिखित कोड देखें:

हमारे डेटा को टोकनयुक्त करने और हमारे मॉडल को तत्काल चालू करने के साथ, हम एक प्रशिक्षण लूप चलाने के लिए लगभग तैयार हैं। अगले घटक जो हम बनाना चाहते हैं वे डेटा कोलेटर और ऑप्टिमाइज़र हैं। डेटा कोलेटर ट्रांसफॉर्मर्स लाइब्रेरी के माध्यम से हगिंग फेस द्वारा प्रदान किया गया एक अन्य वर्ग है, जिसका उपयोग हम प्रशिक्षण के लिए अपने टोकनयुक्त डेटा के बैच बनाने के लिए करते हैं। हम इसे आसानी से हमारे पास पहले से मौजूद टोकननाइज़र और मॉडल ऑब्जेक्ट का उपयोग करके बना सकते हैं, बस कोलेटर क्लास के लिए हमारे मॉडल (Seq2Seq) के लिए पहले इस्तेमाल किए गए संबंधित क्लास प्रकार को ढूंढकर। ऑप्टिमाइज़र का कार्य प्रशिक्षण स्थिति को बनाए रखना और लूप के माध्यम से काम करते समय हमारे प्रशिक्षण हानि के आधार पर मापदंडों को अद्यतन करना है। एक ऑप्टिमाइज़र बनाने के लिए, हम आयात कर सकते हैं आशा है टॉर्च मॉड्यूल से पैकेज, जहां कई अनुकूलन एल्गोरिदम उपलब्ध हैं। कुछ सामान्य चीजें जिनका आपने पहले सामना किया होगा वे हैं स्टोचैस्टिक ग्रेडिएंट डिसेंट और ऐडम , जिसका उत्तरार्द्ध हमारे उदाहरण में लागू किया गया है। एडम का कंस्ट्रक्टर दिए गए प्रशिक्षण रन के लिए मॉडल मापदंडों और पैरामीटरयुक्त सीखने की दर को ध्यान में रखता है। निम्नलिखित कोड देखें:

प्रशिक्षण शुरू करने से पहले अंतिम चरण त्वरक और सीखने की दर अनुसूचक का निर्माण करना है। एक्सेलेरेटर हगिंग फेस द्वारा निर्मित एक अलग लाइब्रेरी (हम मुख्य रूप से ट्रांसफॉर्मर का उपयोग कर रहे हैं) से आता है, जिसे एक्सेलरेट नाम दिया गया है, और प्रशिक्षण के दौरान उपकरणों को प्रबंधित करने के लिए आवश्यक तर्क को दूर कर देगा (उदाहरण के लिए कई जीपीयू का उपयोग करके)। अंतिम घटक के लिए, हम अपने सीखने की दर अनुसूचक को लागू करने के लिए हमेशा उपयोगी ट्रांसफॉर्मर्स लाइब्रेरी पर दोबारा जाते हैं। शेड्यूलर प्रकार, हमारे लूप में प्रशिक्षण चरणों की कुल संख्या और पहले बनाए गए ऑप्टिमाइज़र को निर्दिष्ट करके get_scheduler फ़ंक्शन एक ऑब्जेक्ट लौटाता है जो हमें प्रशिक्षण प्रक्रिया के दौरान हमारी प्रारंभिक सीखने की दर को समायोजित करने में सक्षम बनाता है:

अब हम प्रशिक्षण के लिए पूरी तरह तैयार हैं! आइए एक प्रशिक्षण कार्य स्थापित करें, जिसकी शुरुआत तत्काल करने से होती है प्रशिक्षण_आर्ग ट्रांसफॉर्मर लाइब्रेरी का उपयोग करना और पैरामीटर मान चुनना। हम इन्हें अपने अन्य तैयार घटकों और डेटासेट के साथ सीधे पास कर सकते हैं ट्रेनर और प्रशिक्षण शुरू करें, जैसा कि निम्नलिखित कोड में दिखाया गया है। आपके डेटासेट के आकार और चुने गए मापदंडों के आधार पर, इसमें काफी समय लग सकता है।

अनुमान के लिए मॉडल को पैकेज करें

प्रशिक्षण चलाने के बाद, मॉडल ऑब्जेक्ट अनुमान के लिए उपयोग करने के लिए तैयार है। सर्वोत्तम अभ्यास के रूप में, आइए भविष्य में उपयोग के लिए अपना काम सहेजें। हमें अपनी मॉडल कलाकृतियाँ बनाने, उन्हें एक साथ ज़िप करने और भंडारण के लिए अपने टारबॉल को अमेज़न S3 पर अपलोड करने की आवश्यकता है। ज़िपिंग के लिए अपने मॉडल को तैयार करने के लिए, हमें अब ठीक किए गए मॉडल को खोलना होगा, फिर मॉडल बाइनरी और संबंधित कॉन्फ़िगरेशन फ़ाइलों को सहेजना होगा। हमें अपने टोकननाइज़र को उसी निर्देशिका में सहेजने की भी आवश्यकता है जिसमें हमने अपने मॉडल कलाकृतियों को सहेजा है ताकि जब हम अनुमान के लिए मॉडल का उपयोग करें तो यह उपलब्ध हो। हमारा model_dir फ़ोल्डर अब निम्न कोड जैसा कुछ दिखना चाहिए:

हमारी निर्देशिका को ज़िप करने और अमेज़न S3 पर tar.gz फ़ाइल अपलोड करने के लिए एक टार कमांड चलाना बाकी है:

हमारा नया परिष्कृत मॉडल अब तैयार है और अनुमान लगाने के लिए उपलब्ध है।

अनुमान लगाना

अनुमान के लिए इस मॉडल आर्टिफैक्ट का उपयोग करने के लिए, एक नई फ़ाइल खोलें और इसे संशोधित करते हुए निम्नलिखित कोड का उपयोग करें model_data अमेज़ॅन S3 में आपके आर्टिफैक्ट सेव स्थान को फिट करने के लिए पैरामीटर। HuggingFaceModel कंस्ट्रक्टर हमारे मॉडल को उस चेकपॉइंट से फिर से बनाएगा जिसे हमने सहेजा था model.tar.gz, जिसे हम परिनियोजन विधि का उपयोग करके अनुमान के लिए तैनात कर सकते हैं। समापन बिंदु को तैनात करने में कुछ मिनट लगेंगे।

समापन बिंदु तैनात होने के बाद, हम इसका परीक्षण करने के लिए अपने द्वारा बनाए गए भविष्यवक्ता का उपयोग कर सकते हैं। इधर दें predict डेटा पेलोड को व्यवस्थित करें और सेल चलाएं, और आपको अपने परिष्कृत मॉडल से प्रतिक्रिया मिलेगी:

किसी मॉडल को फाइन-ट्यूनिंग करने का लाभ देखने के लिए, आइए एक त्वरित परीक्षण करें। निम्न तालिका में एक प्रॉम्प्ट और फ़ाइन-ट्यूनिंग से पहले और बाद में मॉडल को उस प्रॉम्प्ट को पास करने के परिणाम शामिल हैं।

| शीघ्र | बिना किसी फ़ाइन-ट्यूनिंग के प्रतिक्रिया | फ़ाइन-ट्यूनिंग के साथ प्रतिक्रिया |

| रोगी जिन लक्षणों का अनुभव कर रहा है उन्हें संक्षेप में बताएं। रोगी 45 वर्षीय पुरुष है और उसे सीने में दर्द की शिकायत है जो बायीं बांह तक फैल रहा है। जब वह यार्ड में काम कर रहा था तो दर्द अचानक शुरू हो गया, जो सांस की हल्की तकलीफ और डायफोरेसिस से जुड़ा था। आगमन पर मरीज की हृदय गति 120, श्वसन दर 24, रक्तचाप 170/95 था। आपातकालीन विभाग में आने पर 12 लीड इलेक्ट्रोकार्डियोग्राम किया गया और सीने में दर्द से राहत के बिना तीन सब्लिंगुअल नाइट्रोग्लिसरीन प्रशासित किया गया। इलेक्ट्रोकार्डियोग्राम पूर्वकाल में एसटी उन्नयन को दर्शाता है जो तीव्र पूर्वकाल रोधगलन को दर्शाता है। हमने कार्डियक कैथीटेराइजेशन लैब से संपर्क किया है और कार्डियोलॉजिस्ट द्वारा कार्डियक कैथीटेराइजेशन की तैयारी की जा रही है। | हम तीव्र रोधगलन का एक मामला प्रस्तुत करते हैं। | सीने में दर्द, पूर्वकाल एमआई, पीसीआई। |

जैसा कि आप देख सकते हैं, हमारा परिष्कृत मॉडल स्वास्थ्य शब्दावली का अलग-अलग उपयोग करता है, और हम अपने उद्देश्यों को पूरा करने के लिए प्रतिक्रिया की संरचना को बदलने में सक्षम हैं। ध्यान दें कि परिणाम आपके डेटासेट और प्रशिक्षण के दौरान चुने गए डिज़ाइन विकल्पों पर निर्भर होते हैं। मॉडल का आपका संस्करण बहुत भिन्न परिणाम पेश कर सकता है।

क्लीन अप

जब आप अपनी सेजमेकर नोटबुक का काम पूरा कर लें, तो लंबे समय तक चलने वाले संसाधनों की लागत से बचने के लिए इसे बंद करना सुनिश्चित करें। ध्यान दें कि इंस्टेंस को बंद करने से आप इंस्टेंस की क्षणिक मेमोरी में संग्रहीत किसी भी डेटा को खो देंगे, इसलिए आपको क्लीनअप से पहले अपने सभी काम को लगातार स्टोरेज में सहेजना चाहिए। आपको भी जाना होगा endpoints सेजमेकर कंसोल पर पेज बनाएं और अनुमान के लिए तैनात किसी भी एंडपॉइंट को हटा दें। सभी कलाकृतियों को हटाने के लिए, आपको अपने बकेट पर अपलोड की गई फ़ाइलों को हटाने के लिए अमेज़ॅन S3 कंसोल पर भी जाना होगा।

निष्कर्ष

इस पोस्ट में, हमने स्वास्थ्य पेशेवरों को कुशलतापूर्वक संसाधित करने और बड़ी मात्रा में नैदानिक डेटा से अंतर्दृष्टि निकालने में मदद करने के लिए सेजमेकर पर पाठ सारांश तकनीकों को लागू करने के लिए विभिन्न विकल्पों की खोज की। हमने सेजमेकर जम्पस्टार्ट फाउंडेशन मॉडल का उपयोग करने, हगिंग फेस से पूर्व-प्रशिक्षित मॉडल को ठीक करने और कस्टम सारांश मॉडल बनाने पर चर्चा की। प्रत्येक दृष्टिकोण के अपने फायदे और नुकसान हैं, जो विभिन्न आवश्यकताओं और आवश्यकताओं को पूरा करते हैं।

सेजमेकर पर कस्टम सारांश मॉडल बनाने से बहुत लचीलापन और नियंत्रण मिलता है लेकिन पूर्व-प्रशिक्षित मॉडल का उपयोग करने की तुलना में अधिक समय और संसाधनों की आवश्यकता होती है। सेजमेकर जम्पस्टार्ट फाउंडेशन मॉडल उन संगठनों के लिए उपयोग में आसान और लागत प्रभावी समाधान प्रदान करते हैं जिन्हें विशिष्ट अनुकूलन या फाइन-ट्यूनिंग की आवश्यकता नहीं होती है, साथ ही सरलीकृत फाइन-ट्यूनिंग के लिए कुछ विकल्प भी प्रदान करते हैं। हगिंग फेस से पूर्व-प्रशिक्षित मॉडलों की फाइन-ट्यूनिंग तेजी से प्रशिक्षण समय, बेहतर डोमेन-विशिष्ट प्रदर्शन और मॉडलों की एक विस्तृत सूची में सेजमेकर टूल और सेवाओं के साथ सहज एकीकरण प्रदान करती है, लेकिन इसके लिए कुछ कार्यान्वयन प्रयास की आवश्यकता होती है। इस पोस्ट को लिखते समय अमेज़न ने एक और विकल्प की घोषणा की है, अमेज़ॅन बेडरॉक, जो और भी अधिक प्रबंधित वातावरण में सारांशीकरण क्षमताएं प्रदान करेगा।

प्रत्येक दृष्टिकोण के फायदे और नुकसान को समझकर, स्वास्थ्य देखभाल पेशेवर और संगठन जटिल नैदानिक डेटा के संक्षिप्त और सटीक सारांश तैयार करने के लिए सबसे उपयुक्त समाधान पर सूचित निर्णय ले सकते हैं। अंततः, सेजमेकर पर एआई/एमएल-आधारित सारांश मॉडल का उपयोग करने से चिकित्सा पेशेवरों को प्रासंगिक जानकारी तक तुरंत पहुंचने और गुणवत्तापूर्ण देखभाल प्रदान करने पर ध्यान केंद्रित करने में सक्षम बनाकर रोगी देखभाल और निर्णय लेने में काफी वृद्धि हो सकती है।

उपयुक्त संसाधन चुनें

इस पोस्ट में चर्चा की गई पूरी स्क्रिप्ट और कुछ नमूना डेटा के लिए, देखें गीथहब रेपो. AWS पर ML वर्कलोड कैसे चलाएं, इसके बारे में अधिक जानकारी के लिए, निम्नलिखित संसाधन देखें:

लेखक के बारे में

कोडी कोलिन्स अमेज़ॅन वेब सर्विसेज में न्यूयॉर्क स्थित सॉल्यूशंस आर्किटेक्ट हैं। वह क्लाउड में उद्योग के अग्रणी समाधान बनाने के लिए आईएसवी ग्राहकों के साथ काम करता है। उन्होंने दक्षता और मापनीयता को अनुकूलित करते हुए विविध उद्योगों के लिए जटिल परियोजनाओं को सफलतापूर्वक वितरित किया है। अपने खाली समय में, उन्हें पढ़ना, यात्रा करना और जिउ जित्सु का प्रशिक्षण लेना पसंद है।

कोडी कोलिन्स अमेज़ॅन वेब सर्विसेज में न्यूयॉर्क स्थित सॉल्यूशंस आर्किटेक्ट हैं। वह क्लाउड में उद्योग के अग्रणी समाधान बनाने के लिए आईएसवी ग्राहकों के साथ काम करता है। उन्होंने दक्षता और मापनीयता को अनुकूलित करते हुए विविध उद्योगों के लिए जटिल परियोजनाओं को सफलतापूर्वक वितरित किया है। अपने खाली समय में, उन्हें पढ़ना, यात्रा करना और जिउ जित्सु का प्रशिक्षण लेना पसंद है।

अमीर हक्मे पेंसिल्वेनिया में रहने वाले एक AWS सॉल्यूशंस आर्किटेक्ट हैं। उनके पेशेवर फोकस में पूरे पूर्वोत्तर में स्वतंत्र सॉफ्टवेयर विक्रेताओं के साथ सहयोग करना, उन्हें एडब्ल्यूएस क्लाउड पर स्केलेबल, अत्याधुनिक प्लेटफार्मों के डिजाइन और निर्माण में मार्गदर्शन करना शामिल है।

अमीर हक्मे पेंसिल्वेनिया में रहने वाले एक AWS सॉल्यूशंस आर्किटेक्ट हैं। उनके पेशेवर फोकस में पूरे पूर्वोत्तर में स्वतंत्र सॉफ्टवेयर विक्रेताओं के साथ सहयोग करना, उन्हें एडब्ल्यूएस क्लाउड पर स्केलेबल, अत्याधुनिक प्लेटफार्मों के डिजाइन और निर्माण में मार्गदर्शन करना शामिल है।

- एसईओ संचालित सामग्री और पीआर वितरण। आज ही प्रवर्धित हो जाओ।

- प्लेटोडेटा.नेटवर्क वर्टिकल जेनरेटिव एआई। स्वयं को शक्तिवान बनाएं। यहां पहुंचें।

- प्लेटोआईस्ट्रीम। Web3 इंटेलिजेंस। ज्ञान प्रवर्धित। यहां पहुंचें।

- प्लेटोईएसजी. ऑटोमोटिव/ईवीएस, कार्बन, क्लीनटेक, ऊर्जा, पर्यावरण, सौर, कचरा प्रबंधन। यहां पहुंचें।

- BlockOffsets. पर्यावरणीय ऑफसेट स्वामित्व का आधुनिकीकरण। यहां पहुंचें।

- स्रोत: https://aws.amazon.com/blogs/machine-learning/exploring-summarization-options-for-healthcare-with-amazon-sagemaker/

- :हैस

- :है

- :नहीं

- :कहाँ

- $यूपी

- 1

- 10

- 100

- 12

- 14

- 15% तक

- 24

- 33

- 7

- 8

- 9

- a

- योग्य

- About

- अमूर्त

- में तेजी लाने के

- त्वरक

- पहुँच

- लेखा

- सही

- के पार

- कार्रवाई

- ऐडम

- को संबोधित

- प्रशासित

- उन्नत

- फायदे

- बाद

- फिर

- एकत्रीकरण

- AI

- ai शोध

- ऐ / एमएल

- एल्गोरिदम

- सब

- की अनुमति दे

- की अनुमति देता है

- साथ में

- पहले ही

- भी

- वीरांगना

- अमेज़न SageMaker

- अमेज़ॅन वेब सेवा

- राशि

- राशियाँ

- an

- विश्लेषण करें

- और

- की घोषणा

- अन्य

- कोई

- एपीआई

- एपीआई

- उपयुक्त

- अनुप्रयोगों

- लागू

- दृष्टिकोण

- दृष्टिकोण

- उपयुक्त

- स्थापत्य

- हैं

- एआरएम

- आगमन

- लेख

- AS

- जुड़े

- At

- ध्यान

- स्वचालित

- उपलब्ध

- से बचने

- दूर

- एडब्ल्यूएस

- संतुलन

- आधारित

- BE

- क्योंकि

- किया गया

- से पहले

- शुरू करना

- लाभ

- लाभ

- BEST

- बेहतर

- बिन

- रक्त

- रक्तचाप

- फूल का खिलना

- मुक्केबाज़ी

- सांस

- विस्तृत

- निर्माण

- बिल्डरों

- इमारत

- बनाया गया

- में निर्मित

- लेकिन

- by

- कॉल

- बुलाया

- कर सकते हैं

- क्षमताओं

- कौन

- सावधानी से

- मामला

- मामलों

- सूची

- कारण

- चुनौतियों

- परिवर्तन

- chatbots

- विकल्प

- चुनें

- चुनने

- करने के लिए चुना

- कक्षा

- क्लिनिकल

- बादल

- कोड

- कोड

- कोडन

- सहयोग

- स्तंभ

- स्तंभ

- कैसे

- आता है

- सामान्य

- तुलना

- शिकायतों

- जटिल

- अनुपालन

- अंग

- घटकों

- प्रकृतिस्थ

- संक्षिप्त

- विन्यास

- नुकसान

- कंसोल

- निर्माण

- प्रसंग

- नियंत्रण

- सुविधाजनक

- इसी

- प्रभावी लागत

- लागत

- सका

- कवर

- बनाना

- बनाया

- बनाना

- महत्वपूर्ण

- वर्तमान में

- रिवाज

- ग्राहक

- ग्राहक

- अनुकूलन

- तिथि

- डेटासेट

- निर्णय

- निर्णय

- परिभाषा

- दिया गया

- प्रदर्शन

- विभाग

- निर्भर

- निर्भर करता है

- तैनात

- तैनात

- तैनाती

- तैनाती

- डिज़ाइन

- बनाया गया

- डिज़ाइन बनाना

- वांछित

- विवरण

- विकसित

- डिवाइस

- विभिन्न

- सीधे

- की खोज

- चर्चा करना

- चर्चा की

- कई

- do

- डॉक्टरों

- कर

- डोमेन

- डोमेन

- किया

- dont

- नीचे

- कमियां

- दौरान

- से प्रत्येक

- आसान

- आसानी

- आसान

- आसान करने के लिए उपयोग

- प्रभावी रूप से

- दक्षता

- कुशल

- कुशलता

- प्रयास

- इलेक्ट्रोनिक

- इलेक्ट्रॉनिक स्वास्थ्य रिकॉर्ड

- पात्रता

- आपात स्थिति

- सक्षम

- सक्षम बनाता है

- समर्थकारी

- endpoint

- अभियांत्रिकी

- बढ़ाना

- सुनिश्चित

- उद्यम

- प्रविष्टि

- वातावरण

- युग

- आवश्यक

- और भी

- उद्विकासी

- उदाहरण

- मौजूदा

- अनुभव

- सामना

- का पता लगाने

- पता लगाया

- तलाश

- का विस्तार

- उद्धरण

- चेहरा

- का सामना करना पड़ा

- दूर

- और तेज

- फेड

- कुछ

- पट्टिका

- फ़ाइलें

- अंतिम

- अंत में

- खोज

- खोज

- प्रथम

- फिट

- लचीलापन

- फोकस

- का पालन करें

- निम्नलिखित

- के लिए

- प्रारूप

- बुनियाद

- से

- पूर्ण

- पूरी तरह से

- समारोह

- और भी

- भविष्य

- लाभ

- सामान्य जानकारी

- उत्पन्न

- उत्पन्न

- सृजन

- मिल

- मिल रहा

- देना

- दी

- देते

- Go

- गूगल की

- GPUs

- महान

- अधिक से अधिक

- गारंटी

- है

- he

- स्वास्थ्य

- स्वास्थ्य सेवा

- दिल

- मदद

- उसके

- होस्टिंग

- कैसे

- How To

- एचटीएमएल

- http

- HTTPS

- हब

- हगिंग फ़ेस

- आदर्श

- if

- इमेजिंग

- लागू करने के

- कार्यान्वयन

- कार्यान्वयन

- आयात

- महत्वपूर्ण

- में सुधार

- in

- में गहराई

- शामिल

- शामिल

- सहित

- स्वतंत्र

- उद्योगों

- उद्योग

- करें-

- सूचित

- प्रारंभिक

- निवेश

- निविष्टियां

- अंतर्दृष्टि

- उदाहरण

- निर्देश

- एकीकरण

- बुद्धि

- में

- शामिल करना

- IT

- आईटी इस

- काम

- JSON

- केवल

- जानना

- ज्ञान

- प्रयोगशाला

- लैब्स

- परिदृश्य

- भाषा

- बड़ा

- पिछली बार

- बाद में

- नेतृत्व

- प्रमुख

- बिक्रीसूत्र

- जानें

- सीख रहा हूँ

- बाएं

- पुस्तकालय

- पसंद

- एलएलएम

- भार

- लोड हो रहा है

- स्थान

- तर्क

- देखिए

- खोना

- बंद

- मशीन

- यंत्र अधिगम

- बनाया गया

- बनाए रखना

- बनाना

- निर्माण

- प्रबंधन

- कामयाब

- प्रबंध

- नक्शा

- विपणन (मार्केटिंग)

- मई..

- मतलब

- मेडिकल

- मिलना

- याद

- घास का मैदान

- तरीका

- हो सकता है

- कम से कम

- मिनटों

- ML

- आदर्श

- मॉडल

- मॉड्यूल

- अधिक

- अधिकांश

- सबसे लोकप्रिय

- विभिन्न

- नामांकित

- प्राकृतिक

- प्राकृतिक भाषा संसाधन

- नेविगेट करें

- आवश्यकता

- की जरूरत है

- नया

- न्यूयॉर्क

- नए नए

- अगला

- NLP

- नहीं

- नोटबुक

- नोट्स

- अभी

- संख्या

- वस्तु

- वस्तुओं

- of

- प्रस्ताव

- प्रस्तुत

- ऑफर

- पुराना

- on

- ONE

- लोगों

- शुरुआत

- पर

- खुला

- खुला स्रोत

- संचालित

- इष्टतमीकरण

- ऑप्टिमाइज़ करें

- अनुकूलित

- के अनुकूलन के

- विकल्प

- ऑप्शंस

- or

- आदेश

- संगठनों

- मूल

- अन्य

- अन्यथा

- हमारी

- आउट

- उत्पादन

- बाहर

- के ऊपर

- अपना

- स्वामित्व

- पैकेज

- पैकेजिंग

- पृष्ठ

- दर्द

- प्राचल

- पैरामीटर

- विशेष

- पास

- पासिंग

- रोगी

- रोगियों

- कवि की उमंग

- पेंसिल्वेनिया

- प्रदर्शन

- संबंधित

- मुहावरों

- मंच

- प्लेटफार्म

- प्लेटो

- प्लेटो डेटा इंटेलिजेंस

- प्लेटोडाटा

- बिन्दु

- लोकप्रिय

- पद

- शक्तिशाली

- शक्ति

- अभ्यास

- Predictor

- पसंद करते हैं

- तैयार करना

- तैयार

- वर्तमान

- दबाव

- पूर्वावलोकन

- पहले से

- मुख्यत

- प्रक्रिया

- प्रक्रियाओं

- प्रसंस्करण

- प्रस्तुत

- पेशेवर

- पेशेवरों

- परियोजनाओं

- वादा

- मालिकाना

- PROS

- प्रदान करना

- बशर्ते

- प्रदान करता है

- प्रदान कर

- प्रावधान

- उद्देश्य

- प्रयोजनों

- रखना

- अजगर

- गुणवत्ता

- त्वरित

- जल्दी से

- रेंज

- तेजी

- मूल्यांकन करें

- पढ़ना

- तैयार

- असली दुनिया

- अभिलेख

- प्रासंगिक

- राहत

- हटाना

- रिपोर्ट

- की आवश्यकता होती है

- अपेक्षित

- आवश्यकताएँ

- की आवश्यकता होती है

- अनुसंधान

- उपयुक्त संसाधन चुनें

- प्रतिक्रिया

- परिणाम

- रिटर्न

- की समीक्षा

- भूमिका

- रन

- दौड़ना

- चलाता है

- sagemaker

- वही

- सहेजें

- अनुमापकता

- स्केलेबल

- क्षेत्र

- खरोंच

- एसडीके

- एसडीकेएस

- निर्बाध

- वर्गों

- सुरक्षा

- देखना

- अलग

- सेवा

- सेवाएँ

- सेट

- की स्थापना

- सेटिंग्स

- कई

- छोटा

- चाहिए

- दिखाना

- दिखाया

- दिखाता है

- बंद करना

- झारना

- महत्वपूर्ण

- काफी

- समान

- सरल

- सरलीकृत

- आकार

- So

- अब तक

- सॉफ्टवेयर

- समाधान

- समाधान ढूंढे

- कुछ

- कुछ

- सूत्रों का कहना है

- विशिष्ट

- विशेष रूप से

- खर्च

- प्रारंभ

- शुरुआत में

- राज्य

- राज्य के-the-कला

- कदम

- भंडारण

- की दुकान

- संग्रहित

- भंडारण

- व्यवस्थित बनाने

- संरचना

- स्टूडियो

- मांसल

- सफलतापूर्वक

- ऐसा

- अचानक

- सूट

- उपयुक्त

- सारांश

- निश्चित

- लक्षण

- सार

- कृत्रिम

- सिंथेटिक डेटा

- सिस्टम

- तालिका

- लेना

- लिया

- लेता है

- कार्य

- कार्य

- तकनीक

- शब्दावली

- शर्तों

- परीक्षण

- से

- कि

- RSI

- केंद्र

- उन

- फिर

- इन

- वे

- इसका

- उन

- तीन

- यहाँ

- भर

- पहर

- बहुत समय लगेगा

- बार

- सेवा मेरे

- आज का दि

- एक साथ

- tokenized

- टोकन

- उपकरण

- मशाल

- कुल

- रेलगाड़ी

- प्रशिक्षित

- प्रशिक्षण

- तब्दील

- ट्रांसफार्मर

- ट्रान्सफ़ॉर्मर

- यात्रा का

- दो

- टाइप

- प्रकार

- आम तौर पर

- ui

- अंत में

- असमर्थ

- के अंतर्गत

- समझना

- समझ

- अपडेट

- अपलोड की गई

- us

- उपयोग

- उदाहरण

- प्रयुक्त

- उपयोगकर्ता के अनुकूल

- का उपयोग करता है

- का उपयोग

- उपयोग

- सत्यापन

- मान

- विभिन्न

- व्यापक

- विक्रेताओं

- बहुमुखी

- संस्करण

- बहुत

- संस्करणों

- करना चाहते हैं

- था

- we

- धन

- वेब

- वेब सेवाओं

- तौलना

- कुंआ

- क्या

- कब

- कौन कौन से

- जब

- चौड़ा

- विस्तृत श्रृंखला

- मर्जी

- साथ में

- बिना

- शब्द

- काम

- काम कर रहे

- कार्य

- होगा

- लिख रहे हैं

- वर्ष

- यॉर्क

- आप

- आपका

- जेफिरनेट

- ज़िप