इस पोस्ट में, हम पैरामीटर-कुशल फाइन-ट्यूनिंग (पीईएफटी) विधि का उपयोग करके लामा 2 मॉडल को फाइन-ट्यूनिंग दिखाते हैं और फाइन-ट्यून किए गए मॉडल को तैनात करते हैं एडब्ल्यूएस अनुमान 2। हम उपयोग करते हैं AWS न्यूरॉन AWS Inferentia2 डिवाइस तक पहुंचने और इसके उच्च प्रदर्शन से लाभ उठाने के लिए सॉफ़्टवेयर डेवलपमेंट किट (SDK)। फिर हम द्वारा संचालित एक बड़े मॉडल अनुमान कंटेनर का उपयोग करते हैं डीप जावा लाइब्रेरी (डीजेएलसर्विंग) हमारे मॉडल सर्विंग समाधान के रूप में।

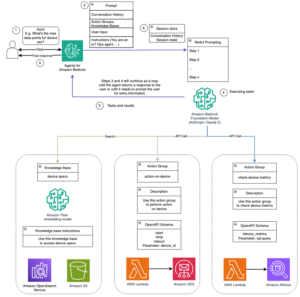

समाधान अवलोकन

QLoRa का उपयोग करके Llama2 को कुशल फाइन-ट्यूनिंग

बड़े भाषा मॉडल (एलएलएम) का लामा 2 परिवार 7 अरब से 70 अरब मापदंडों के पैमाने पर पूर्व-प्रशिक्षित और ठीक-ठीक जेनरेटिव टेक्स्ट मॉडल का एक संग्रह है। लामा 2 को सार्वजनिक रूप से उपलब्ध स्रोतों से 2 ट्रिलियन टोकन डेटा पर पूर्व-प्रशिक्षित किया गया था। AWS ग्राहक कभी-कभी डाउनस्ट्रीम कार्यों के लिए बेहतर प्रदर्शन प्राप्त करने के लिए ग्राहकों के स्वयं के डेटा का उपयोग करके लामा 2 मॉडल को फाइन-ट्यून करना चुनते हैं। हालाँकि, लामा 2 मॉडल के मापदंडों की बड़ी संख्या के कारण, पूर्ण फाइन-ट्यूनिंग अत्यधिक महंगी और समय लेने वाली हो सकती है। पैरामीटर-कुशल फाइन-ट्यूनिंग (पीईएफटी) दृष्टिकोण पूर्व-प्रशिक्षित मॉडल के अधिकांश पैरामीटर को फ्रीज करते समय केवल अतिरिक्त मॉडल पैरामीटर की एक छोटी संख्या को ठीक करके इस समस्या का समाधान कर सकता है। पीईएफटी पर अधिक जानकारी के लिए कोई इसे पढ़ सकता है पद. इस पोस्ट में हम प्रयोग करते हैं QLoRa लामा 2 7बी मॉडल को फाइन-ट्यून करने के लिए।

Amazon SageMaker का उपयोग करके Inf2 पर एक सुव्यवस्थित मॉडल तैनात करें

AWS Inferentia2 एक उद्देश्य-निर्मित मशीन लर्निंग (ML) एक्सेलेरेटर है जो अनुमान वर्कलोड के लिए डिज़ाइन किया गया है और AWS पर अन्य अनुमान अनुकूलित उदाहरणों की तुलना में जेनरेटिव AI और LLM वर्कलोड के लिए 40% कम लागत पर उच्च प्रदर्शन प्रदान करता है। इस पोस्ट में, हम अमेज़ॅन इलास्टिक कंप्यूट क्लाउड का उपयोग करते हैं (अमेज़ॅन EC2) Inf2 उदाहरण, AWS Inferentia2 की विशेषता, दूसरी पीढ़ी Inferentia2 त्वरक, प्रत्येक में दो शामिल हैं न्यूरॉनकोर्स-v2. प्रत्येक न्यूरॉनकोर-वी2 एक स्वतंत्र, विषम गणना-इकाई है, जिसमें चार मुख्य इंजन हैं: टेन्सर, वेक्टर, स्केलर और जीपीएसआईएमडी इंजन। इसमें डेटा स्थानीयता को अधिकतम करने के लिए एक ऑन-चिप सॉफ़्टवेयर-प्रबंधित SRAM मेमोरी शामिल है। चूँकि Inf2 पर कई ब्लॉग प्रकाशित हो चुके हैं, पाठक इसका संदर्भ ले सकते हैं पद और हमारे दस्तावेज़ीकरण Inf2 पर अधिक जानकारी के लिए।

Inf2 पर मॉडल तैनात करने के लिए, हमें Inf2 हार्डवेयर के शीर्ष पर चलने वाली सॉफ़्टवेयर परत के रूप में AWS न्यूरॉन SDK की आवश्यकता है। AWS न्यूरॉन एक SDK है जिसका उपयोग AWS Inferentia पर गहन शिक्षण कार्यभार चलाने के लिए किया जाता है एडब्ल्यूएस ट्रेनियम आधारित उदाहरण। यह नए मॉडल बनाने, इन मॉडलों को प्रशिक्षित करने और अनुकूलित करने और उन्हें उत्पादन के लिए तैनात करने के लिए एंड-टू-एंड एमएल विकास जीवनचक्र को सक्षम बनाता है। AWS न्यूरॉन में गहन शिक्षा शामिल है संकलक, क्रम, तथा उपकरण जो मूल रूप से TensorFlow और PyTorch जैसे लोकप्रिय ढांचे के साथ एकीकृत हैं। इस ब्लॉग में हम उपयोग करने जा रहे हैं transformers-neuronx, जो ट्रांसफार्मर डिकोडर अनुमान वर्कफ़्लो के लिए AWS न्यूरॉन SDK का हिस्सा है। यह का समर्थन करता है लामा 2 सहित लोकप्रिय मॉडलों की एक श्रृंखला।

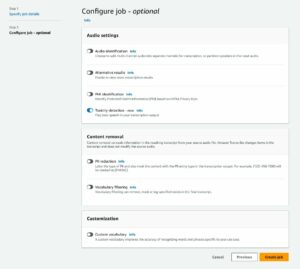

मॉडलों को तैनात करने के लिए अमेज़न SageMaker, हम आम तौर पर एक कंटेनर का उपयोग करते हैं जिसमें आवश्यक लाइब्रेरीज़ होती हैं, जैसे कि न्यूरॉन एसडीके और transformers-neuronx साथ ही मॉडल सर्विंग घटक भी। अमेज़ॅन सेजमेकर बनाए रखता है डीप लर्निंग कंटेनर (डीएलसी) बड़े मॉडलों की मेजबानी के लिए लोकप्रिय ओपन सोर्स लाइब्रेरी के साथ। इस पोस्ट में, हम इसका उपयोग करते हैं न्यूरॉन के लिए बड़ा मॉडल अनुमान कंटेनर. इस कंटेनर में वह सब कुछ है जो आपको अपने लामा 2 मॉडल को Inf2 पर तैनात करने के लिए चाहिए। अमेज़ॅन सेजमेकर पर एलएमआई के साथ आरंभ करने के लिए संसाधनों के लिए, कृपया हमारे कई मौजूदा पोस्ट देखें (ब्लॉग 1, ब्लॉग 2, ब्लॉग 3) इस टॉपिक पर। संक्षेप में, आप बिना कोई अतिरिक्त कोड लिखे कंटेनर चला सकते हैं। आप इसका उपयोग कर सकते हैं डिफ़ॉल्ट हैंडलर एक सहज उपयोगकर्ता अनुभव के लिए और समर्थित मॉडल नामों और किसी भी लोड समय कॉन्फ़िगर करने योग्य पैरामीटर में से एक में पास करें। यह Inf2 इंस्टेंस पर LLM संकलित और प्रस्तुत करता है। उदाहरण के लिए, तैनात करना OpenAssistant/llama2-13b-orca-8k-3319, आप निम्नलिखित कॉन्फ़िगरेशन प्रदान कर सकते हैं (जैसे serving.properties फ़ाइल)। में serving.properties, हम मॉडल प्रकार को इस प्रकार निर्दिष्ट करते हैं llama2-13b-orca-8k-3319, बैच का आकार 4 है, टेंसर समानांतर डिग्री 2 है, और बस इतना ही। कॉन्फ़िगर करने योग्य पैरामीटरों की पूरी सूची के लिए, देखें सभी डीजेएल कॉन्फ़िगरेशन विकल्प.

वैकल्पिक रूप से, आप अपनी स्वयं की मॉडल हैंडलर फ़ाइल लिख सकते हैं जैसा कि इसमें दिखाया गया है उदाहरण, लेकिन इसके लिए डीजेएलसर्विंग एपीआई के बीच एक सेतु के रूप में काम करने के लिए मॉडल लोडिंग और अनुमान विधियों को लागू करने की आवश्यकता है।

.. पूर्वापेक्षाएँ

निम्नलिखित सूची इस ब्लॉग पोस्ट में वर्णित मॉडल को तैनात करने के लिए आवश्यक शर्तें बताती है। आप इनमें से किसी एक को कार्यान्वित कर सकते हैं एडब्ल्यूएस प्रबंधन कंसोल या के नवीनतम संस्करण का उपयोग कर रहे हैं AWS कमांड लाइन इंटरफ़ेस (AWS CLI)।

Walkthrough

निम्नलिखित अनुभाग में, हम कोड को दो भागों में देखेंगे:

- Llama2-7b मॉडल को फाइन-ट्यूनिंग करें, और मॉडल कलाकृतियों को निर्दिष्ट Amazon S3 बकेट स्थान पर अपलोड करें।

- Amazon SageMaker में होस्ट किए गए DJL सर्विंग कंटेनर का उपयोग करके मॉडल को Inferentia2 में तैनात करें।

निर्देशों के साथ संपूर्ण कोड नमूने इसमें पाए जा सकते हैं GitHub भंडार।

भाग 1: PEFT का उपयोग करके Llama2-7b मॉडल को फाइन-ट्यून करें

हम पेपर में हाल ही में शुरू की गई पद्धति का उपयोग करने जा रहे हैं QLoRA: भाषा निर्माण के लिए क्वांटाइज़ेशन-जागरूक निम्न-रैंक एडाप्टर ट्यूनिंग टिम डेटमर्स एट अल द्वारा। QLoRA प्रदर्शन से समझौता किए बिना, फाइन-ट्यूनिंग के दौरान बड़े भाषा मॉडल की मेमोरी फ़ुटप्रिंट को कम करने की एक नई तकनीक है।

नोट: निम्नलिखित में दिखाए गए llama2-7b मॉडल की फ़ाइन-ट्यूनिंग का अमेज़न पर परीक्षण किया गया था सेजमेकर स्टूडियो नोटबुक Python 2.0 GPU अनुकूलित कर्नेल के साथ a एमएल.g5.2xबड़ा उदाहरण प्रकार. सर्वोत्तम अभ्यास के रूप में, हम इसका उपयोग करने की सलाह देते हैं अमेज़ॅन सैजमेकर स्टूडियो आपके यहां एकीकृत विकास पर्यावरण (आईडीई) लॉन्च किया गया अमेज़ॅन वर्चुअल प्राइवेट क्लाउड (अमेज़ॅन वीपीसी)। यह आपको मानक VWS नेटवर्किंग और सुरक्षा क्षमताओं का उपयोग करके अपने VPC के भीतर और बाहर नेटवर्क ट्रैफ़िक को नियंत्रित करने, मॉनिटर करने और निरीक्षण करने की अनुमति देता है। अधिक जानकारी के लिए देखें निजी वीपीसी का उपयोग करके अमेज़ॅन सैजमेकर स्टूडियो कनेक्टिविटी को सुरक्षित करना.

आधार मॉडल को परिमाणित करें

हम पहले 4-बिट क्वांटिज़ेशन का उपयोग करके एक क्वांटाइज़्ड मॉडल लोड करते हैं हगिंगफेस ट्रांसफॉर्मर पुस्तकालय इस प्रकार है:

प्रशिक्षण डेटासेट लोड करें

इसके बाद, हम निम्न प्रकार दिखाए गए फाइन-ट्यूनिंग चरण के लिए मॉडल को फीड करने के लिए डेटासेट लोड करते हैं:

एक एडाप्टर परत संलग्न करें

यहां हम एक छोटी, प्रशिक्षित करने योग्य एडाप्टर परत संलग्न करते हैं, जिसे इस प्रकार कॉन्फ़िगर किया गया है लोराकॉन्फिग हगिंग फेस में परिभाषित peft पुस्तकालय।

एक मॉडल को प्रशिक्षित करें

ऊपर दिखाए गए LoRA कॉन्फ़िगरेशन का उपयोग करके, हम हाइपर-पैरामीटर के साथ Llama2 मॉडल को ठीक करेंगे। मॉडल के प्रशिक्षण के लिए एक कोड स्निपेट निम्नलिखित में दिखाया गया है:

मॉडल वजन मर्ज करें

ऊपर निष्पादित फाइन-ट्यून किए गए मॉडल ने प्रशिक्षित लोआरए एडाप्टर वजन युक्त एक नया मॉडल बनाया। निम्नलिखित कोड स्निपेट में, हम एडॉप्टर को बेस मॉडल के साथ मर्ज करेंगे ताकि हम अनुमान के लिए फाइन-ट्यून किए गए मॉडल का उपयोग कर सकें।

मॉडल का वजन Amazon S3 पर अपलोड करें

भाग 1 के अंतिम चरण में, हम मर्ज किए गए मॉडल वज़न को निर्दिष्ट अमेज़ॅन S3 स्थान पर सहेजेंगे। मॉडल वजन का उपयोग अमेज़ॅन सेजमेकर में एक मॉडल सर्विंग कंटेनर द्वारा इनफेरेंटिया2 इंस्टेंस का उपयोग करके मॉडल को होस्ट करने के लिए किया जाएगा।

भाग 2: SageMaker LMI कंटेनर का उपयोग करके AWS Inf2 के अनुमान के लिए QLoRA मॉडल होस्ट करें

इस अनुभाग में, हम Amazon SageMaker होस्टिंग वातावरण में QLoRA फाइन-ट्यून मॉडल को तैनात करने के चरणों के बारे में जानेंगे। हम एक का उपयोग करेंगे डीजेएल सेवारत सेजमेकर से कंटेनर डीएलसी, जो के साथ एकीकृत होता है ट्रांसफॉर्मर-न्यूरॉनx इस मॉडल को होस्ट करने के लिए लाइब्रेरी। सेटअप AWS Inferentia2 एक्सेलेरेटर पर मॉडलों को लोड करने की सुविधा देता है, कई न्यूरॉनकोर में मॉडल को समानांतर करता है, और HTTP एंडपॉइंट के माध्यम से सेवा प्रदान करने में सक्षम बनाता है।

मॉडल कलाकृतियाँ तैयार करें

डीजेएल कई गहन शिक्षण अनुकूलन पुस्तकालयों का समर्थन करता है, जिनमें शामिल हैं गहरा, तेज़ ट्रांसफार्मर और अधिक। मॉडल विशिष्ट कॉन्फ़िगरेशन के लिए, हम एक प्रदान करते हैं serving.properties जैसे प्रमुख मापदंडों के साथ tensor_parallel_degree और model_id मॉडल लोडिंग विकल्पों को परिभाषित करने के लिए। model_id हगिंग फेस मॉडल आईडी, या अमेज़ॅन एस3 पथ हो सकता है जहां मॉडल वजन संग्रहीत किया जाता है। हमारे उदाहरण में, हम अपने परिष्कृत मॉडल का अमेज़न S3 स्थान प्रदान करते हैं। निम्नलिखित कोड स्निपेट मॉडल सर्विंग के लिए उपयोग किए गए गुणों को दिखाता है:

कृपया इसका संदर्भ लें दस्तावेज़ीकरण के माध्यम से उपलब्ध कॉन्फ़िगर करने योग्य विकल्पों के बारे में अधिक जानकारी के लिए serving.properties. कृपया ध्यान दें कि हम उपयोग करते हैं option.n_position=512 तेज़ AWS न्यूरॉन संकलन के लिए इस ब्लॉग में। यदि आप बड़ी इनपुट टोकन लंबाई आज़माना चाहते हैं, तो हम पाठक को समय से पहले मॉडल को संकलित करने की सलाह देते हैं (देखें)। EC2 पर AOT प्री-कंपाइल मॉडल). अन्यथा, यदि संकलन समय बहुत अधिक है तो आपको टाइमआउट त्रुटि का सामना करना पड़ सकता है।

के बाद serving.properties फ़ाइल परिभाषित है, हम फ़ाइल को इसमें पैकेज करेंगे tar.gz प्रारूप, इस प्रकार:

फिर, हम tar.gz को Amazon S3 बकेट स्थान पर अपलोड करेंगे:

एक Amazon SageMaker मॉडल एंडपॉइंट बनाएं

सेवा के लिए Inf2 इंस्टेंस का उपयोग करने के लिए, हम Amazon का उपयोग करते हैं सेजमेकर एलएमआई कंटेनर डीजेएल न्यूरॉनएक्स समर्थन के साथ। कृपया इसका संदर्भ लें पद अनुमान के लिए डीजेएल न्यूरॉनएक्स कंटेनर का उपयोग करने के बारे में अधिक जानकारी के लिए। निम्नलिखित कोड दिखाता है कि Amazon SageMaker Python SDK का उपयोग करके एक मॉडल को कैसे तैनात किया जाए:

परीक्षण मॉडल समापन बिंदु

मॉडल के सफलतापूर्वक तैनात होने के बाद, हम भविष्यवक्ता को एक नमूना अनुरोध भेजकर समापन बिंदु को मान्य कर सकते हैं:

नमूना आउटपुट इस प्रकार दिखाया गया है:

डेटा विश्लेषण के संदर्भ में, मशीन लर्निंग (एमएल) एक सांख्यिकीय तकनीक को संदर्भित करता है जो किसी आंकड़े के दायरे को पुनरावृत्त रूप से कम करके बढ़ती जटिलता और सटीकता के साथ डेटासेट से पूर्वानुमानित शक्ति निकालने में सक्षम है।

मशीन लर्निंग कोई नई सांख्यिकीय तकनीक नहीं है, बल्कि मौजूदा तकनीकों का एक संयोजन है। इसके अलावा, इसे किसी विशिष्ट डेटासेट के साथ उपयोग करने या कोई विशिष्ट परिणाम उत्पन्न करने के लिए डिज़ाइन नहीं किया गया है। बल्कि, इसे किसी भी डेटासेट के अनुकूल होने और किसी भी परिणाम के बारे में भविष्यवाणी करने के लिए पर्याप्त लचीला बनाया गया था।

क्लीन अप

यदि आप तय करते हैं कि आप अब सेजमेकर एंडपॉइंट को चालू नहीं रखना चाहते हैं, तो आप इसका उपयोग करके इसे हटा सकते हैं पायथन (boto3), AWS CLI या Amazon SageMaker कंसोल के लिए AWS SDK। इसके अतिरिक्त, आप यह भी कर सकते हैं अमेज़ॅन सेजमेकर स्टूडियो रिसोर्सेज को बंद करें जिसकी अब आवश्यकता नहीं है.

निष्कर्ष

इस पोस्ट में, हमने आपको दिखाया कि एकल GPU उदाहरण का उपयोग करके 2-बिट परिमाणीकरण के साथ LoRA एडाप्टर का उपयोग करके Llama7-4b मॉडल को कैसे ठीक किया जाए। फिर हमने डीजेएल सर्विंग कंटेनर का उपयोग करके मॉडल को अमेज़ॅन सेजमेकर में होस्ट किए गए Inf2 इंस्टेंस पर तैनात किया। अंत में, हमने सेजमेकर पायथन एसडीके का उपयोग करके टेक्स्ट जेनरेशन भविष्यवाणी के साथ अमेज़ॅन सेजमेकर मॉडल एंडपॉइंट को मान्य किया। आगे बढ़ें और इसे आज़माएं, हमें आपकी प्रतिक्रिया सुनना अच्छा लगेगा। AWS Inferentia के साथ अधिक क्षमताओं और नए नवाचारों पर अपडेट के लिए बने रहें।

AWS न्यूरॉन के बारे में अधिक उदाहरणों के लिए देखें aws-न्यूरॉन-नमूने.

लेखक के बारे में

वी तेह AWS में एक वरिष्ठ AI/ML विशेषज्ञ समाधान वास्तुकार हैं। वह अमेज़न मशीन लर्निंग सेवाओं और मशीन लर्निंग-आधारित समाधानों पर ध्यान केंद्रित करते हुए, ग्राहकों को उनकी AWS यात्रा को आगे बढ़ाने में मदद करने को लेकर उत्साहित हैं। काम के अलावा, वह अपने परिवार के साथ कैंपिंग, मछली पकड़ने और लंबी पैदल यात्रा जैसी बाहरी गतिविधियों का आनंद लेते हैं।

वी तेह AWS में एक वरिष्ठ AI/ML विशेषज्ञ समाधान वास्तुकार हैं। वह अमेज़न मशीन लर्निंग सेवाओं और मशीन लर्निंग-आधारित समाधानों पर ध्यान केंद्रित करते हुए, ग्राहकों को उनकी AWS यात्रा को आगे बढ़ाने में मदद करने को लेकर उत्साहित हैं। काम के अलावा, वह अपने परिवार के साथ कैंपिंग, मछली पकड़ने और लंबी पैदल यात्रा जैसी बाहरी गतिविधियों का आनंद लेते हैं।

क्विंगवेमैं ली अमेज़न वेब सर्विसेज में मशीन लर्निंग स्पेशलिस्ट है। उन्होंने अपनी पीएच.डी. ऑपरेशन रिसर्च में जब उन्होंने अपने सलाहकार के अनुसंधान अनुदान खाते को तोड़ा और नोबेल पुरस्कार देने में असफल रहे, तो उन्होंने वादा किया था। वर्तमान में वह वित्तीय सेवा और बीमा उद्योग में ग्राहकों को AWS पर मशीन लर्निंग समाधान बनाने में मदद करता है। अपने खाली समय में, वह पढ़ना और पढ़ाना पसंद करते हैं।

क्विंगवेमैं ली अमेज़न वेब सर्विसेज में मशीन लर्निंग स्पेशलिस्ट है। उन्होंने अपनी पीएच.डी. ऑपरेशन रिसर्च में जब उन्होंने अपने सलाहकार के अनुसंधान अनुदान खाते को तोड़ा और नोबेल पुरस्कार देने में असफल रहे, तो उन्होंने वादा किया था। वर्तमान में वह वित्तीय सेवा और बीमा उद्योग में ग्राहकों को AWS पर मशीन लर्निंग समाधान बनाने में मदद करता है। अपने खाली समय में, वह पढ़ना और पढ़ाना पसंद करते हैं।

- एसईओ संचालित सामग्री और पीआर वितरण। आज ही प्रवर्धित हो जाओ।

- प्लेटोडेटा.नेटवर्क वर्टिकल जेनरेटिव एआई। स्वयं को शक्तिवान बनाएं। यहां पहुंचें।

- प्लेटोआईस्ट्रीम। Web3 इंटेलिजेंस। ज्ञान प्रवर्धित। यहां पहुंचें।

- प्लेटोईएसजी. कार्बन, क्लीनटेक, ऊर्जा, पर्यावरण, सौर, कचरा प्रबंधन। यहां पहुंचें।

- प्लेटोहेल्थ। बायोटेक और क्लिनिकल परीक्षण इंटेलिजेंस। यहां पहुंचें।

- स्रोत: https://aws.amazon.com/blogs/machine-learning/fine-tune-llama-2-using-qlora-and-deploy-it-on-amazon-sagemaker-with-aws-inferentia2/

- :हैस

- :है

- :नहीं

- :कहाँ

- $यूपी

- 1

- 10

- 100

- 11

- 15% तक

- 16

- 19

- 24

- 300

- 7

- 70

- 8

- a

- About

- ऊपर

- त्वरक

- त्वरक

- पहुँच

- लेखा

- शुद्धता

- पाना

- के पार

- गतिविधियों

- अनुकूलन

- अतिरिक्त

- इसके अतिरिक्त

- पता

- उन्नत

- बाद

- आगे

- AI

- ऐ / एमएल

- AL

- की अनुमति देता है

- साथ में

- अल्फा

- भी

- वीरांगना

- अमेज़ॅन मशीन लर्निंग

- अमेज़न SageMaker

- अमेज़ॅन सैजमेकर स्टूडियो

- अमेज़ॅन वेब सेवा

- an

- विश्लेषण

- और

- कोई

- एपीआई

- लागू करें

- दृष्टिकोण

- हैं

- AS

- At

- संलग्न करना

- स्वत:

- उपलब्ध

- एडब्ल्यूएस

- एडब्ल्यूएस इन्फेंटेंटिया

- गेंद

- आधार

- आधारित

- बैचिंग

- BE

- किया गया

- लाभ

- BEST

- बेहतर

- के बीच

- बिलियन

- ब्लॉग

- ब्लॉग

- पुल

- तोड़ दिया

- निर्माण

- लेकिन

- by

- कर सकते हैं

- क्षमताओं

- सक्षम

- चुनें

- बादल

- कोड

- संग्रह

- संयोजन

- पूरा

- जटिलता

- अंग

- गणना करना

- विन्यास

- कॉन्फ़िगर किया गया

- कनेक्टिविटी

- कंसोल

- उपभोक्ता

- कंटेनर

- शामिल हैं

- प्रसंग

- नियंत्रण

- लागत

- सका

- बनाया

- वर्तमान में

- ग्राहक

- तिथि

- डेटा विश्लेषण

- तय

- गहरा

- ध्यान लगा के पढ़ना या सीखना

- चूक

- परिभाषित

- परिभाषित

- डिग्री

- उद्धार

- बचाता है

- तैनात

- तैनात

- तैनाती

- वर्णित

- बनाया गया

- विकास

- युक्ति

- डाक में काम करनेवाला मज़दूर

- नीचे

- दो

- दौरान

- गतिशील

- ई एंड टी

- से प्रत्येक

- भी

- सक्षम बनाता है

- शुरू से अंत तक

- endpoint

- इंजन

- इंजन

- पर्याप्त

- वातावरण

- त्रुटि

- आदि

- सब कुछ

- उदाहरण

- उदाहरण

- मार डाला

- मौजूदा

- महंगा

- अनुभव

- अतिरिक्त

- चेहरा

- की सुविधा

- विफल रहे

- असत्य

- परिवार

- और तेज

- की विशेषता

- प्रतिक्रिया

- पट्टिका

- अंतिम

- अंत में

- वित्तीय

- वित्तीय सेवा

- प्रथम

- मछली पकड़ना

- लचीला

- ध्यान केंद्रित

- का पालन करें

- पीछा किया

- निम्नलिखित

- इस प्रकार है

- पदचिह्न

- के लिए

- प्रारूप

- पाया

- चार

- चौखटे

- बर्फ़ीली

- से

- पूर्ण

- और भी

- पीढ़ी

- उत्पादक

- जनरेटिव एआई

- मिल

- देना

- Go

- जा

- GPU

- अनुदान

- हार्डवेयर

- he

- सुनना

- मदद

- मदद करता है

- यहाँ उत्पन्न करें

- हाई

- उच्च प्रदर्शन

- उसके

- मेजबान

- मेजबानी

- होस्टिंग

- मकान

- कैसे

- How To

- तथापि

- एचटीएमएल

- http

- HTTPS

- ID

- if

- की छवि

- लागू करने के

- कार्यान्वयन

- in

- शामिल

- शामिल

- सहित

- बढ़ती

- स्वतंत्र

- उद्योग

- करें-

- नवाचारों

- निवेश

- निविष्टियां

- उदाहरण

- निर्देश

- बीमा

- एकीकृत

- एकीकृत

- में

- शुरू की

- IT

- यात्रा

- आईटी इस

- जावा

- यात्रा

- जेपीजी

- JSON

- रखना

- कुंजी

- किट (एसडीके)

- भाषा

- बड़ा

- बड़ा

- ताज़ा

- शुभारंभ

- परत

- परतों

- सीख रहा हूँ

- लंबाई

- स्तर

- पुस्तकालयों

- पुस्तकालय

- जीवन चक्र

- पसंद

- को यह पसंद है

- लाइन

- सूची

- लामा

- एलएलएम

- भार

- लोड हो रहा है

- स्थान

- लंबे समय तक

- मोहब्बत

- कम

- मशीन

- यंत्र अधिगम

- मुख्य

- का कहना है

- बनाना

- प्रबंध

- बहुत

- अधिकतम

- याद

- मर्ज

- तरीका

- तरीकों

- हो सकता है

- ML

- आदर्श

- मॉडल

- मॉड्यूल

- मॉनिटर

- अधिक

- अधिकांश

- बहुत

- विभिन्न

- नामों

- में

- आवश्यकता

- नेटवर्क

- प्रसार यातायात

- शुद्ध कार्यशील

- नया

- नहीं

- नोबेल पुरुस्कार

- कोई नहीं

- नोट

- संख्या

- of

- on

- ONE

- केवल

- पर

- खुला

- खुला स्रोत

- संचालन

- इष्टतमीकरण

- ऑप्टिमाइज़ करें

- अनुकूलित

- विकल्प

- ऑप्शंस

- or

- अन्य

- अन्यथा

- हमारी

- परिणाम

- रूपरेखा

- उत्पादन

- बाहर

- के ऊपर

- अपना

- पैकेज

- काग़ज़

- समानांतर

- प्राचल

- पैरामीटर

- भाग

- भागों

- पास

- आवेशपूर्ण

- पथ

- प्रदर्शन

- प्रदर्शन

- योजना

- प्लेटो

- प्लेटो डेटा इंटेलिजेंस

- प्लेटोडाटा

- कृप्या अ

- लोकप्रिय

- पद

- पोस्ट

- बिजली

- संचालित

- अभ्यास

- शुद्धता

- भविष्यवाणी

- भविष्यवाणियों

- Predictor

- आवश्यक शर्तें

- निजी

- पुरस्कार

- मुसीबत

- प्रक्रिया

- उत्पादन

- उत्पादन

- वादा किया

- गुण

- प्रदान करना

- सार्वजनिक रूप से

- प्रकाशित

- अजगर

- pytorch

- रेंज

- लेकर

- बल्कि

- पढ़ना

- पाठक

- पढ़ना

- प्राप्त

- हाल ही में

- की सिफारिश

- को कम करने

- उल्लेख

- संदर्भित करता है

- कोष

- का अनुरोध

- अनुरोधों

- अपेक्षित

- की आवश्यकता होती है

- अनुसंधान

- उपयुक्त संसाधन चुनें

- प्रतिक्रिया

- प्रतिक्रियाएं

- सही

- रन

- दौड़ना

- त्याग

- sagemaker

- सहेजें

- स्केल

- स्केलिंग

- क्षेत्र

- एसडीके

- निर्बाध

- दूसरा

- दूसरी पीढी

- अनुभाग

- सुरक्षा

- देखना

- भेजना

- वरिष्ठ

- अनुक्रम

- सेवा

- सेवा

- सेवाएँ

- सेवारत

- सेट

- की स्थापना

- व्यवस्था

- कई

- कम

- प्रदर्शन

- पता चला

- दिखाया

- दिखाता है

- के बाद से

- एक

- आकार

- छोटा

- टुकड़ा

- So

- सॉफ्टवेयर

- सॉफ्टवेयर विकास

- सॉफ़्टवेयर विकास किट

- समाधान

- समाधान ढूंढे

- कभी कभी

- स्रोत

- सूत्रों का कहना है

- विशेषज्ञ

- विशिष्ट

- विनिर्दिष्ट

- मानक

- शुरू

- सांख्यिकीय

- रहना

- कदम

- कदम

- संग्रहित

- स्टूडियो

- सफलतापूर्वक

- ऐसा

- समर्थन

- समर्थित

- समर्थन करता है

- कार्य

- शिक्षण

- तकनीक

- तकनीक

- tensorflow

- परीक्षण किया

- टेक्स्ट

- कि

- RSI

- लेकिन हाल ही

- उन

- फिर

- इन

- इसका

- यहाँ

- टिम

- पहर

- सेवा मेरे

- टोकन

- टोकन

- भी

- ऊपर का

- विषय

- मशाल

- यातायात

- रेलगाड़ी

- प्रशिक्षित

- प्रशिक्षण

- ट्रांसफार्मर

- खरब

- <strong>उद्देश्य</strong>

- कोशिश

- देखते

- ट्यूनिंग

- दो

- टाइप

- अपडेट

- अपलोड की गई

- यूआरएल

- उपयोग

- प्रयुक्त

- उपयोगकर्ता

- उपयोगकर्ता अनुभव

- का उपयोग

- आमतौर पर

- सत्यापित करें

- मान्य

- संस्करण

- के माध्यम से

- वास्तविक

- चलना

- walkthrough

- करना चाहते हैं

- था

- we

- वेब

- वेब सेवाओं

- भार

- कुंआ

- क्या

- एचएमबी क्या है?

- कौन कौन से

- जब

- मर्जी

- साथ में

- अंदर

- बिना

- काम

- कामगार

- workflows

- लिखना

- लिख रहे हैं

- आप

- आपका

- जेफिरनेट