Lehet, hogy egy vadászpuska kunyhóban élsz. És előfordulhat, hogy a GPT-4-gyel dolgozik. És felteheti magának a kérdést: „Futtatja a GPT-4 a Doomot?” És felteheted magadnak a kérdést: „Igazam van? Tévedek?"

Adrian de Wynter, a Microsoft vezető alkalmazott tudósa és az angliai Yorki Egyetem kutatója ezeket a kérdéseket tette fel egy friss kutatási cikkében:A GPT-4 futtatja a Doomot?"

Sajnos a GPT-4, a Microsoft által támogatott OpenAI nagy nyelvi modellje nem képes a Doom forráskódjának közvetlen végrehajtására.

De multimodális változata, a GPT-4V, amely képes bemenetként képeket és szöveget is elfogadni, ugyanazt a megnyerő alkompetenciát mutatja. Végzet mint a tele szöveg alapú modellek, amelyek számtalan mesterséges intelligenciát indítottak el.

„A papír beállításai szerint a GPT-4 (és a GPT-4 látással, vagy a GPT-4V) nem igazán tudja futtatni a Doomot önmagában, mert korlátozza a bemeneti mérete (és nyilván az is, hogy valószínűleg csak kitalál valamit). tényleg nem akarja, hogy a fordítója ötpercenként hallucináljon)” – írta de Wynter a magyarázatában; megjegyezni lapjáról. "Ez azt jelenti, hogy határozottan működhet a motor proxyjaként, nem úgy, mint a többi "futja a Doomot?" megvalósítások, mint pl E. Coli or Jegyzettömb. "

Vagyis a GPT-4V nem futtatja a Doomot mint egy John Deere traktor de speciális képzés nélkül is lejátssza a Doomot.

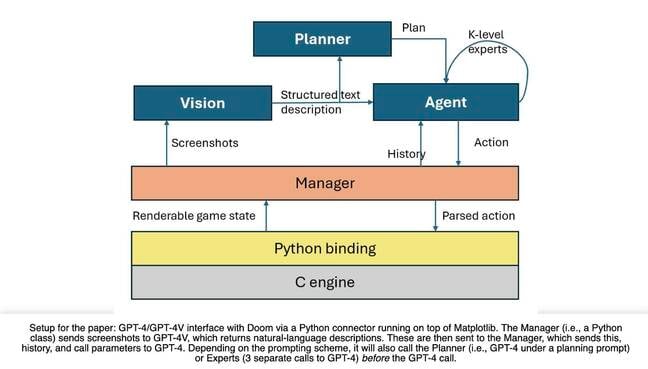

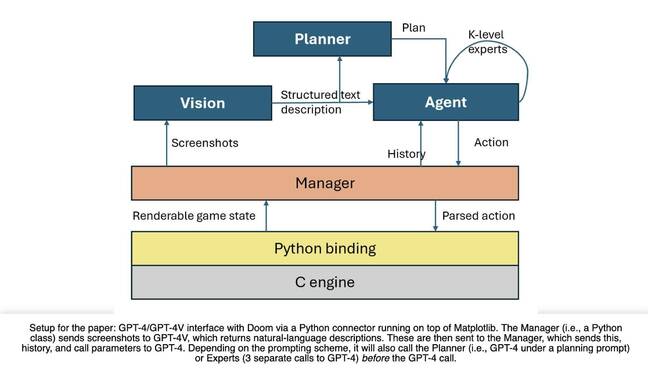

Ennek kezelésére de Wynter tervezett egy Vision komponenst, amely GPT-4V-nek hívja, amely képernyőképeket rögzít a játékmotorból, és visszaadja a játék állapotának szerkezeti leírását. És ezt kombinálta egy ügynökmodellel, amely meghívja a GPT-4-et, hogy döntéseket hozzon a vizuális bemenet és a korábbi előzmények alapján. Az Agent modellnek azt mondták, hogy a válaszait billentyűleütési parancsokká fordítsa le, amelyek a játékmotor számára jelentenek valamit.

Az interakciókat egy menedzserrétegen keresztül kezelik, amely egy nyílt forráskódú Python-kötésből áll a következőhöz C Doom motor Matplotliben fut.

De Wynter diagramja egy GPT-4V rendszer kialakítását mutatja a Doom játékhoz… Kattintson a nagyításhoz

Az újság szerint a mesterséges intelligencia modellek és kódok keveréke ajtókat nyithat, ellenségekkel harcolhat, és fegyvereket lőhet. És képes végrehajtani egy szélesebb körű utasításkészletet, például egy szintű áttekintést saját teljesítményének javítása érdekében.

Ennek a GPT-4V-alapú rendszernek a fő hiányossága az objektumok állandóságának hiánya – elfelejti a játékon belüli zombikat, amikor kikerülnek a képernyőről.

A GPT-4 megfeledkezik a zombiról, és csak megy tovább

„Például nagyon gyakori, hogy a modell egy zombit lát a képernyőn, és addig lövöldözni kezd, amíg el nem találta (vagy meghal)” – magyarázza de Wynter. „Nos, ez a mesterséges intelligencia az 1993-as hardverrel való együttműködésre van írva, úgyhogy azt hiszem, nincs túl mély döntési fája. Tehát a zombi rád lő, majd rohanni kezd a szobában.

"Mi itt a probléma? Nos, először is, hogy a zombi eltűnjön a látókörből. Ami még rosszabb, még mindig életben van, és egy bizonyos ponton el fog ütni. Szóval utána kell menned, igaz? Végtére is, a Doomban ez ütés, vagy ütés.

„Kiderült, hogy a GPT-4 megfeledkezik a zombiról, és csak megy tovább. Megjegyzés: a prompt kifejezetten megmondja a modellnek, hogy mit tegyen, ha sebzést szenved, és nem lát ellenséget. Még jobb, ha csak elindul a vidám útjára, beszorul a sarokban, és meghal. Néhányszor megfordult, de közel 50-60 futás alatt megfigyeltem… kétszer, azt akarom mondani.

Ezenkívül a GPT-4 nem tud túl jól érvelni. Amikor arra kérték, hogy magyarázza el cselekedeteit, amelyek a kontextusban általában helyesek voltak, magyarázatai szegényesek voltak, és gyakran tartalmaztak hallucinációkat (más néven helytelen információkat).

De Wynter mindazonáltal figyelemre méltónak tartja, hogy a GPT-4 képes a Doom lejátszására előzetes képzés nélkül.

Ugyanakkor aggasztónak tartja ezt.

„Az etikai osztályon eléggé aggasztó, hogy (a) mennyire könnyű volt kódot építeni, hogy rávegyem a modellt, hogy lőjön valamit; és (b) hogy a modell pontosan lőjön le valamit anélkül, hogy ténylegesen kitalálná az utasításokat” – írta összefoglaló bejegyzésében.

„Tehát, bár ez egy nagyon érdekes feltárás a tervezés és az érvelés körül, és alkalmazhatók lehetnek az automatizált videojáték-tesztelésben, teljesen nyilvánvaló, hogy ez a modell nincs tisztában azzal, hogy mit csinál. Nyomatékosan arra buzdítok mindenkit, hogy gondolja át, mit jelent ezeknek a modelleknek a társadalom számára való alkalmazása és az esetleges visszaélések.”

És mondhatod magadnak:Istenem, mit tettem?”®

- SEO által támogatott tartalom és PR terjesztés. Erősödjön még ma.

- PlatoData.Network Vertical Generative Ai. Erősítse meg magát. Hozzáférés itt.

- PlatoAiStream. Web3 Intelligence. Felerősített tudás. Hozzáférés itt.

- PlatoESG. Carbon, CleanTech, Energia, Környezet, Nap, Hulladékgazdálkodás. Hozzáférés itt.

- PlatoHealth. Biotechnológiai és klinikai vizsgálatok intelligencia. Hozzáférés itt.

- Forrás: https://go.theregister.com/feed/www.theregister.com/2024/03/11/gpt4_wont_run_doom/

- :van

- :is

- :nem

- $ UP

- 369

- 7

- a

- Rólunk

- Elfogad!

- Szerint

- pontosan

- törvény

- cselekvések

- tulajdonképpen

- Után

- Ügynök

- AI

- AI modellek

- aka

- elevenen

- Minden termék

- am

- an

- és a

- alkalmazások

- alkalmazott

- VANNAK

- körül

- AS

- kérdez

- At

- Automatizált

- tudatában van

- alapján

- BE

- mert

- óta

- Jobb

- kötés

- tágabb

- épít

- de

- by

- kéri

- TUD

- nem tud

- képes

- Kapacitás

- fogások

- Táblázatos

- kettyenés

- CO

- kód

- kombinált

- Közös

- összetevő

- úgy véli,

- Összeáll

- kontextus

- Sarok

- kijavítására

- tudott

- Pár

- kár

- de

- döntés

- határozatok

- mély

- minden bizonnyal

- osztály

- bevetés

- Design

- tervezett

- diagram

- DID

- meghalt

- közvetlenül

- do

- nem

- Ennek

- Don

- csinált

- végzet

- ajtók

- könnyű

- Motor

- Anglia

- etika

- Minden

- mindenki

- példa

- kivégez

- kiállítási

- Magyarázza

- Elmagyarázza

- magyarázatok

- kifejezetten

- kutatás

- harc

- Találjon

- leletek

- természet

- égetés

- vezetéknév

- öt

- A

- teli

- ból ből

- játék

- általában

- kap

- jelentkeznek

- GitHub

- Go

- Jó

- Goes

- megy

- Szerintem

- hardver

- Legyen

- he

- itt

- övé

- történelem

- Találat

- Hogyan

- HTML

- HTTPS

- i

- if

- képek

- megvalósítások

- javul

- in

- játékban

- beleértve

- hibás

- információ

- bemenet

- utasítás

- érdekes

- bele

- kérdés

- IT

- ITS

- maga

- János

- jpg

- éppen

- tartja

- hiány

- nyelv

- nagy

- indított

- réteg

- szint

- mint

- Korlátozott

- élő

- Fő

- csinál

- kezelése

- menedzser

- matplotlib

- Lehet..

- me

- jelenti

- vidám

- microsoft

- Perc

- visszaélés

- MIT

- keverje

- modell

- modellek

- közel

- megjegyezni

- Most

- tárgy

- Nyilvánvaló

- of

- kedvezmény

- gyakran

- on

- nyitva

- nyílt forráskódú

- OpenAI

- or

- Más

- ki

- saját

- Papír

- teljesítmény

- tervezés

- Plató

- Platón adatintelligencia

- PlatoData

- játszani

- játék

- pont

- szegény

- jelent

- állás

- potenciális

- előző

- Fő

- Előzetes

- valószínűleg

- meghatalmazott

- Piton

- Kérdések

- egészen

- tényleg

- ok

- új

- figyelemre méltó

- kutatás

- kutató

- válaszok

- Visszatér

- jobb

- Szoba

- futás

- futás

- fut

- s

- Mondott

- azonos

- azt mondják

- Tudós

- Képernyő

- screenshotok

- lát

- készlet

- felépítés

- Lő

- mutató

- Méret

- So

- Társadalom

- néhány

- valami

- forrás

- forráskód

- különleges

- kezdet

- kezdődik

- Startups

- Állami

- Még mindig

- erősen

- struktúra

- ilyen

- ÖSSZEFOGLALÓ

- szuper

- rendszer

- bevétel

- megmondja

- Tesztelés

- szöveg

- hogy

- A

- azok

- akkor

- Ezek

- ők

- Szerintem

- ezt

- Keresztül

- idő

- alkalommal

- nak nek

- mondta

- Képzések

- fordít

- fa

- nyugtalanító

- FORDULAT

- fordul

- Kétszer

- alatt

- egyetemi

- nem úgy mint

- -ig

- Változat

- nagyon

- videó

- videojáték

- Megnézem

- látomás

- vizuális

- végigjátszás

- akar

- volt

- Út..

- Fegyverek

- JÓL

- voltak

- Mit

- amikor

- ami

- míg

- lesz

- val vel

- nélkül

- Nyerte

- Munka

- dolgozó

- rosszabb

- lenne

- írott

- Rossz

- írt

- még

- york

- te

- A te

- magad

- zephyrnet

- zombi