Az OpenAI, a Cambridge-i Egyetem, a Harvard Egyetem és a Torontói Egyetem kutatói „feltáró” lehetőséget kínáltak. ötletek az AI chipek és hardver szabályozására vonatkozóanés hogyan akadályozhatják meg a biztonsági politikák a fejlett AI-val való visszaélést.

Az ajánlások módot adnak a fejlett AI-rendszerek és az azokat tápláló chipek fejlesztésének és használatának mérésére és auditálására. Az irányelvek végrehajtására vonatkozó ajánlások közé tartozik a rendszerek teljesítményének korlátozása és olyan biztonsági funkciók bevezetése, amelyek távolról letilthatják a csaló chipeket.

„A nagy teljesítményű AI-rendszerek betanítása jelenleg több ezer mesterségesintelligencia-chip felhalmozását és összehangolását követeli meg” – írták a kutatók. "[Ha] ezek a rendszerek potenciálisan veszélyesek, akkor ennek a felhalmozott számítási teljesítménynek a korlátozása korlátozhatja a potenciálisan veszélyes mesterséges intelligencia rendszerek előállítását."

Nathan Brookwood, az Insight 64 vezető elemzője szerint a kormányok nagyrészt a szoftverekre összpontosítottak a mesterséges intelligencia politikájában, és a cikk a vita hardveres oldalát is lefedi.

Az ipar azonban nem fogad szívesen semmilyen biztonsági funkciót, amely befolyásolná az AI teljesítményét, figyelmeztet. A mesterséges intelligencia biztonságossá tétele hardveren keresztül „nemes törekvés, de nem látom, hogy egyikük is ezt tenné. A dzsinn kifogyott a lámpából, és sok szerencsét a visszahelyezéshez” – mondja.

A klaszterek közötti kapcsolatok szabályozása

A kutatók egyik javaslata az AI-modellek számítási feldolgozási kapacitásának korlátozása. Az ötlet az, hogy olyan biztonsági intézkedéseket hozzanak életbe, amelyek azonosítani tudják az AI-rendszerekkel való visszaéléseket, valamint a chipek használatának leállítását és korlátozását.

Pontosabban, célzott megközelítést javasolnak a memória és a chip klaszterek közötti sávszélesség korlátozására. A könnyebb alternatíva – a chipekhez való hozzáférés megszakítása – nem volt ideális, mivel befolyásolná az általános mesterséges intelligencia teljesítményét – írták a kutatók.

A lap nem javasolta az ilyen biztonsági korlátok bevezetésének módját, vagy azt, hogy miként lehetne kimutatni az AI-rendszerekkel való visszaéléseket.

"A külső kommunikáció optimális sávszélesség-határának meghatározása olyan terület, amely további kutatást érdemel" - írták a kutatók.

A nagyméretű mesterséges intelligencia rendszerek óriási hálózati sávszélességet igényelnek, és az olyan mesterséges intelligencia rendszerek, mint a Microsoft Eagle és az Nvidia Eos a A világ 10 leggyorsabb szuperszámítógépe. Vannak módok a hálózati teljesítmény korlátozására a P4 programozási nyelvet támogató eszközök esetében, amelyek képesek elemezni a hálózati forgalmat, és újrakonfigurálni az útválasztókat és a kapcsolókat.

De sok sikert, ha arra kéri a chipgyártókat, hogy alkalmazzanak mesterséges intelligencia biztonsági mechanizmusokat, amelyek lelassíthatják a chipeket és a hálózatokat, mondja Brookwood.

„Az Arm, az Intel és az AMD mindannyian elfoglaltak a leggyorsabb és legrosszabb chipek gyártásával, amelyeket meg tudnak építeni, hogy versenyképesek legyenek. Nem tudom, hogyan lehet lassítani” – mondja.

A távoli lehetőségek bizonyos kockázattal járnak

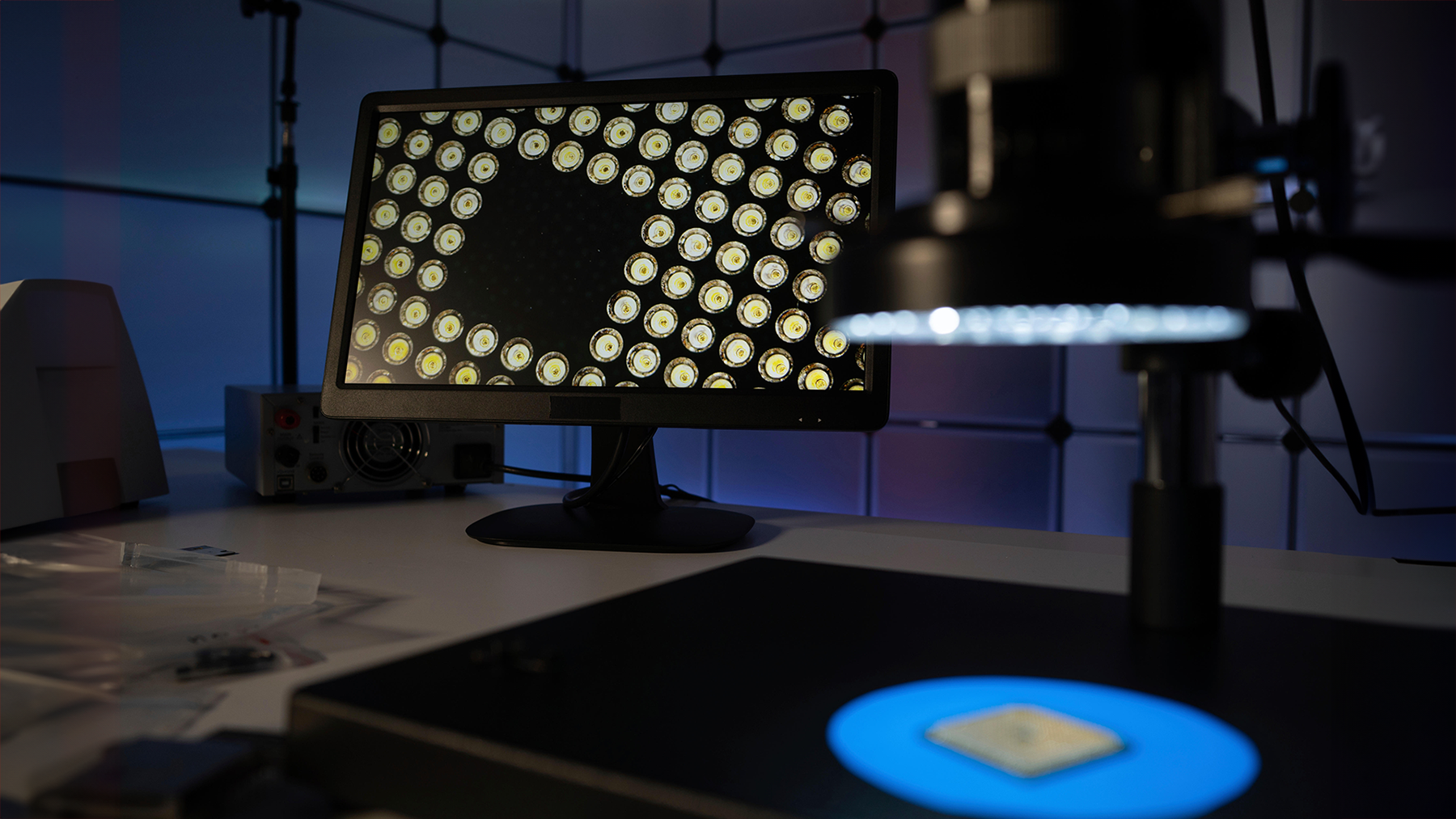

A kutatók a chipek távoli letiltását is javasolták, amit az Intel a legújabb szerverchipekbe épített be. Az On Demand szolgáltatás egy előfizetéses szolgáltatás, amely lehetővé teszi az Intel ügyfelei számára, hogy be- és kikapcsolhassák a chip-szolgáltatásokat, például az AI-bővítményeket, mint pl. fűthető ülések egy Teslában.

A kutatók egy olyan tanúsítási rendszert is javasoltak, amelyben a chipek csak az arra jogosult felek számára teszik lehetővé a mesterséges intelligencia-rendszerekhez való hozzáférést kriptográfiailag aláírt digitális tanúsítványokon keresztül. A firmware útmutatást nyújthat a jogosult felhasználókról és alkalmazásokról, amelyek frissítésekkel módosíthatók.

Bár a kutatók nem adtak technikai ajánlásokat ennek mikéntjére, az ötlet hasonló ahhoz, hogy a bizalmas számítástechnika hogyan védi a chipeken lévő alkalmazásokat a jogosult felhasználók tanúsítása. Intel és a AMD bizalmas számítástechnika van a chipjeiken, de ez még a kezdeti napok a feltörekvő technológia számára.

A házirendek távolról történő betartatása is kockázatokat rejt magában. "A távoli végrehajtási mechanizmusok jelentős árnyoldalakkal járnak, és csak akkor indokolt, ha a mesterséges intelligencia várható kára rendkívül magas" - írták a kutatók.

Brookwood egyetért.

„Még ha tehetné is, lesznek rosszfiúk, akik folytatni fogják. A jó fiúk mesterséges megszorítása hatástalan lesz” – mondja.

- SEO által támogatott tartalom és PR terjesztés. Erősödjön még ma.

- PlatoData.Network Vertical Generative Ai. Erősítse meg magát. Hozzáférés itt.

- PlatoAiStream. Web3 Intelligence. Felerősített tudás. Hozzáférés itt.

- PlatoESG. Carbon, CleanTech, Energia, Környezet, Nap, Hulladékgazdálkodás. Hozzáférés itt.

- PlatoHealth. Biotechnológiai és klinikai vizsgálatok intelligencia. Hozzáférés itt.

- Forrás: https://www.darkreading.com/cyber-risk/what-using-security-to-regulate-ai-chips-could-look-like

- :van

- :is

- :nem

- :ahol

- 10

- 7

- a

- visszaélés

- AC

- hozzáférés

- Felgyülemlett

- fejlett

- érint

- egyetért

- AI

- AI modellek

- AI rendszerek

- Minden termék

- lehetővé

- Is

- alternatív

- AMD

- között

- an

- elemző

- elemez

- és a

- bármilyen

- alkalmazások

- megközelítés

- VANNAK

- TERÜLET

- ARM

- mesterséges

- AS

- kér

- törekvés

- könyvvizsgálat

- felhatalmazott

- elérhető

- vissza

- Rossz

- Sávszélesség

- BE

- között

- épít

- Épület

- épült

- elfoglalt

- de

- by

- Cambridge

- TUD

- sapka

- képes

- Kapacitás

- visz

- tanúsítványok

- megváltozott

- csip

- játékpénz

- hogyan

- közlés

- társ

- versenyképes

- Kiszámít

- számítástechnika

- számítási teljesítmény

- bizalmas

- kapcsolatok

- korlátok

- tudott

- fedő

- rejtjelezéssel

- Jelenleg

- Ügyfelek

- vágás

- vágás

- Veszélyes

- Nap

- vita

- Kereslet

- észlelt

- meghatározó

- Fejlesztés

- Eszközök

- DID

- digitális

- do

- Don

- csinált

- le-

- hátrányok

- sas

- Korai

- könnyebb

- csiszolókő

- Feltörekvő technológia

- végrehajtás

- érvényesítése

- EOS

- Még

- létezik

- várható

- kiterjesztések

- külső

- rendkívüli módon

- leggyorsabb

- Funkció

- Jellemzők

- összpontosított

- A

- ból ből

- további

- Dzsinn

- szerzés

- megy

- jó

- irányelvek

- hardver

- kárt

- Harvard

- Harvard Egyetem

- Legyen

- he

- Magas

- nagyon

- Hogyan

- How To

- HTTPS

- i

- ötlet

- ideális

- azonosítani

- if

- végre

- végrehajtási

- in

- tartalmaz

- ipar

- Insight

- Intel

- bele

- IT

- ITS

- Ismer

- nyelv

- nagymértékben

- mint

- LIMIT

- korlátozó

- néz

- hasonló

- szerencse

- Makers

- Gyártás

- Lehet..

- intézkedés

- intézkedések

- mechanizmusok

- Memory design

- érdem

- microsoft

- modellek

- hálózat

- hálózati forgalom

- hálózatok

- legújabb

- Előkelő

- Nvidia

- of

- kedvezmény

- felajánlott

- on

- ONE

- csak

- OpenAI

- optimálisan

- or

- hangszerelésben

- ki

- átfogó

- Papír

- fél

- teljesítmény

- darab

- Hely

- Plató

- Platón adatintelligencia

- PlatoData

- Politikák

- politika

- lehetőségek

- potenciálisan

- hatalom

- megakadályozása

- Fő

- feldolgozás

- Termelés

- Programozás

- javaslatok

- ad

- folytatni

- tesz

- elhelyezés

- ajánlások

- Szabályoz

- távoli

- távolról

- megköveteli,

- kutatás

- kutatók

- Kockázat

- kockázatok

- s

- biztonságos

- azt mondja,

- rendszer

- Biztosítja

- biztonság

- Biztonsági intézkedések

- biztonsági politikák

- lát

- szolgál

- szerver

- szolgáltatás

- oldal

- aláírt

- jelentős

- hasonló

- lassú

- szoftver

- néhány

- valami

- Szponzorált

- Még mindig

- előfizetés

- ilyen

- javasol

- Támogató

- Systems

- célzott

- Műszaki

- Technológia

- hogy

- A

- azok

- Őket

- akkor

- Ott.

- Ezek

- ők

- ezt

- azok

- ezer

- Keresztül

- nak nek

- toronto

- forgalom

- Képzések

- borzasztó

- FORDULAT

- egyetemi

- Frissítés

- használ

- Felhasználók

- segítségével

- keresztül

- figyelmeztet

- módon

- fogadtatás

- Mit

- ami

- WHO

- lesz

- val vel

- lenne

- írt

- még

- te

- zephyrnet