Az adatvédelemre szakosodott jogász végigjárja a mesterséges intelligencia kockázati környezetét.

A mesterséges intelligencia rohamos fejlődése sok zűrzavarhoz vezet az üzleti világban. De a zavartság nem feltétlenül rossz dolog. Ha őszinte kíváncsisággal és megértési vággyal találkozunk, akkor bölcsességgé alakulhat át.

Chris Hart, a bostoni székhelyű Foley Hoag ügyvédi iroda partnere jól érti ezt. A cég adatvédelmi adatbiztonsági csoportjának társelnökeként Hart tanácsot ad az üzleti ügyfeleknek a szabályozási megfeleléssel kapcsolatban, segít nekik azonosítani a kockázatokat és elfogadni a jogi problémák elkerülésére irányuló irányelveket.

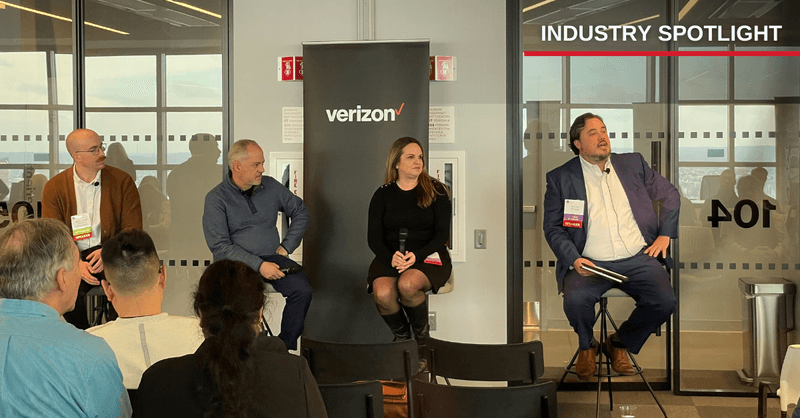

A közelmúltban Hart az Institute for Experiential MI két tagjával (Matthew Sample, mesterséges intelligencia-etikus és Cansu Canca, a MI igazgatója) beszélt. Felelős mesterséges intelligencia gyakorlat) által szervezett rendezvényen Mass Technology Leadership Council. A sokszínű résztvevőt vonzott esemény célja, hogy segítsen a vállalkozásoknak megérteni, hogyan optimalizálhatják működésüket az AI segítségével.

Jogi veszély

Általános tévhit, hogy a mesterséges intelligencia nem szabályozott. Bár nincs sok mesterséges intelligencia-specifikus törvény, rengeteg törvény vonatkozik az AI-technológiákra. Hart munkájának része, hogy tanácsot adjon az ügyfeleknek azokkal a törvényekkel kapcsolatos kockázatokról, amelyekre az ügyfelek esetleg nem ismerik. Elmagyarázza, hogy az első lépés az, hogy különbséget tegyünk: a jelenleg fejlesztés alatt álló AI-rendszerekről vagy a vállalatok által használt harmadik féltől származó rendszerekről beszélünk?

"Az egyik dolog, ami világossá vált a nagy nyelvi modelleknél, amelyeket ma már eléggé mindenütt használnak munkahelyi célokra, az az, hogy bármi legyen is a hasznosságuk, adatvédelemmel kapcsolatos aggályok merülhetnek fel" - mondja Hart. „Igazán óvatosnak kell lennie azzal kapcsolatban, hogy ne adjon meg bizalmas információkat az ügyvédi irodáknak, ne adjon meg privilegizált információkat, ne adjon meg olyan érzékeny információkat, amelyek aztán képzési adatokként használhatók fel, és véletlenül nyilvánosságra kerülhetnek.”

Szellemi tulajdonnal kapcsolatos aggodalmak is vannak, különösen a generatív mesterséges intelligencia esetében, amely szerzői jogi perekhez vezetett az AI-cégek ellen. Leginkább a The New York Times benyújtott öltöny az OpenAI ellen; Getty Images beperelte Stabil diffúzió; és egy csoport szerző, köztük John Grisham, Jodi Picoult és George RR Martin beperelte OpenAI a „tömeges léptékű szisztematikus lopás” kifejezésre.

Hogy ezek a perek hogyan tartanak, az még nem látható, de az érintett vállalatokra nehezedő károkat aligha lehet alábecsülni, és a tanulság egyértelmű: az AI-t használó vállalatoknak – különösen az új eszközöket fejlesztőknek – könnyedén kell lépniük.

"Mennyire fog ez az eszköz hátrányos döntéseket hozni a szervezetek számára?" – kérdezi Hart. „Van-e benne elfogultság, vagy lehet? Hogyan védekezel ez ellen a mérnöki fázisban? Hogyan ellenőrizheti a teljes folyamatot, miután összeállította, hogy megbizonyosodjon arról, hogy vissza tud lépni és kijavítani a problémákat?”

Új perspektívák

Ezek nehéz kérdések, amelyekre adott válaszok a konkrét felhasználási esetektől függenek. Arról is beszélnek, hogy fontos a Responsible AI (RAI) keretrendszer kialakítása a fejlesztés és a telepítés minden szakaszában. Úgy tűnik, az AI sikerét egyre inkább az határozza meg, hogy a vállalatok milyen mértékben tudják tiszteletben tartani a multidiszciplináris megközelítést.

Ezért a Institute for Experiential AI mérnökökkel, filozófusokkal, jogászokkal, közgazdászokkal és még sok mással büszkélkedhet. Ez az oka annak is, hogy az Intézet és Foley Hoag is tagja a Mass Technology Leadership Council (MTLC) nevű technológiai egyesületnek, amely „változatos perspektívákkal” rendelkező vezetőket hív össze a sürgető jogi és gazdasági kihívások megoldására.

„Olyan emberekre van szükség, akik értik a technológiát” – mondja Hart. „Be kell vonni a mérnököket, de jogilag is részt kell venniük. Olyan emberekre van szükség, akik számos különböző nézőpontból nézik a dolgot, és hajlandóak kritikusan átgondolni, hogy mire tervezték a technológiát, és hogy képes-e ismert vagy nem szándékos káros következményeket okozni.”

Türelem erény

A sok mesterséges intelligencia-felhajtás közepette könnyű elfelejteni a türelem fontosságát. A dolgok gyorsan haladnak, és így érthető módon a vállalatok attól tartanak, hogy ha nem „gyorsan haladnak, és nem törik össze a dolgokat”, akkor elveszítik versenyelőnyüket. Hart egy körültekintőbb megközelítést szorgalmaz.

„Néhány vállalat kénytelen volt korábban megjelenni a piacon, mint gondolták volna, mert a ChatGPT mindent felrobbant” – magyarázza Hart. „A szervezeteknek alaposan meg kell fontolniuk, mennyire érettek az AI-szállítóik, különösen azért, mert meg kell érteniük, mi történik az adataikkal.”

Egyrészt a szakértők szerint az AI forradalmi ígéreteket rejt magában. A generatív AI-tól az orvosi diagnosztikáig a benne rejlő lehetőségek szélessége nem csapódik le könnyen egyetlen pontra. Másrészt az ilyen nyers előrejelző erő nem csak türelemre, hanem perspektívára is szükség van. Kevés vállalat képes önállóan eligazodni ezen az új tájon.

Hogy megtanulják, hogyan az Institute for Experiential AI– a mesterséges intelligencia mérnökeiből, akadémikusaiból és gyakorlóiból álló névsorával – segíthet vállalkozásának eligazodni ezeken a nehéz vizeken, kattints ide.

- SEO által támogatott tartalom és PR terjesztés. Erősödjön még ma.

- PlatoData.Network Vertical Generative Ai. Erősítse meg magát. Hozzáférés itt.

- PlatoAiStream. Web3 Intelligence. Felerősített tudás. Hozzáférés itt.

- PlatoESG. Carbon, CleanTech, Energia, Környezet, Nap, Hulladékgazdálkodás. Hozzáférés itt.

- PlatoHealth. Biotechnológiai és klinikai vizsgálatok intelligencia. Hozzáférés itt.

- Forrás: https://www.mtlc.co/ai-the-law-a-lawyer-explains-the-risks-for-companies/

- :is

- :nem

- $ UP

- a

- Rólunk

- tudósok

- elfogadja

- előre

- kedvezőtlen

- tanácsot ad

- támogatja

- ellen

- AI

- AI rendszerek

- Minden termék

- mellett

- Is

- között

- an

- és a

- válaszok

- alkalmaz

- megközelítés

- VANNAK

- körül

- AS

- Egyesület

- At

- résztvevők

- vonzott

- könyvvizsgálat

- szerzők

- elkerülése érdekében

- vissza

- Rossz

- BE

- mert

- válik

- óta

- hogy

- előítélet

- dicsekszik

- mindkét

- szélesség

- szünet

- üzleti

- vállalkozások

- de

- by

- TUD

- óvatos

- gondosan

- eset

- esetek

- kihívások

- ChatGPT

- világos

- ügyfél részére

- Társelnök

- hogyan

- Közös

- Companies

- versenyképes

- teljesítés

- aggodalmak

- bizalmas

- zavar

- Fontolja

- összeül

- copyright

- kijavítására

- tudott

- Tanács

- teremt

- kíváncsiság

- Jelenleg

- dátum

- Adatvédelem

- adatbiztonság

- határozatok

- meghatározott

- Fok

- függ

- bevetés

- tervezett

- vágy

- fejlesztése

- Fejlesztés

- diagnosztika

- különböző

- nehéz

- Diffusion

- Igazgató

- megkülönböztetés

- számos

- do

- nem

- ne

- le-

- húz

- minden

- Korábban

- könnyen

- könnyű

- Gazdasági

- közgazdászok

- él

- bármelyik

- Mérnöki

- Mérnökök

- Egész

- felszerelt

- különösen

- esemény

- minden

- tapasztalati

- szakértők

- Elmagyarázza

- mérték

- GYORS

- félelem

- kevés

- Cég

- cégek

- vezetéknév

- Foley Hoag

- A

- kényszerű

- Keretrendszer

- ból ből

- nemző

- Generatív AI

- valódi

- György

- megy

- Csoport

- kéz

- Esemény

- Legyen

- he

- segít

- segít

- tart

- tart

- becsület

- házigazdája

- Hogyan

- How To

- HTTPS

- hype

- azonosítani

- if

- fontosság

- in

- véletlenül

- Beleértve

- egyre inkább

- információ

- bemenet

- Intézet

- szellemi

- szellemi tulajdon

- szándékolt

- bele

- részt

- kérdések

- IT

- ITS

- Munka

- János

- ismert

- táj

- nyelv

- nagy

- Törvény

- ügyvédi Iroda

- ügyvédi irodák

- törvények

- perek

- ügyvéd

- ügyvédek

- vezetők

- Vezetés

- vezető

- TANUL

- Led

- Jogi

- Jogi kérdések

- lecke

- könnyen

- keres

- veszít

- Sok

- csinál

- sok

- piacára

- Tömeg

- matthew

- érett

- orvosi

- Partnerek

- találkozott

- esetleg

- modellek

- több

- a legtöbb

- mozgó

- multidiszciplináris

- Keresse

- szükségszerűen

- Szükség

- Új

- New York

- Most

- szám

- of

- on

- egyszer

- ONE

- csak

- OpenAI

- Művelet

- Optimalizálja

- or

- szervezetek

- Más

- eredmények

- saját

- rész

- partner

- Türelem

- Emberek (People)

- perspektíva

- perspektívák

- fázis

- Hangmagasság

- Plató

- Platón adatintelligencia

- PlatoData

- bőséges

- Politikák

- potenciális

- hatalom

- sürgős

- szép

- magánélet

- kiváltságos

- problémák

- folyamat

- ígéret

- ingatlan

- védelme

- célokra

- tesz

- elhelyezés

- Kérdések

- gyorsan

- R

- soraiban

- kiütés

- Nyers

- tényleg

- szabályozók

- Előírásoknak való megfelelés

- maradványok

- felelős

- forradalmi

- Kockázat

- kockázatok

- minta

- mondás

- azt mondja,

- Skála

- biztonság

- Úgy tűnik,

- látott

- érzékeny

- kellene

- óta

- egyetlen

- So

- SOLVE

- beszél

- szakosodott

- különleges

- stabil

- Színpad

- Lépés

- siker

- ilyen

- biztos

- Systems

- beszéd

- tech

- Technologies

- Technológia

- mint

- hogy

- A

- törvény

- lopás

- azok

- Őket

- akkor

- Ott.

- Ezek

- ők

- dolog

- dolgok

- Szerintem

- harmadik fél

- ezt

- azok

- Keresztül

- egész

- nak nek

- együtt

- szerszám

- Képzések

- Átalakítás

- futófelület

- kettő

- megért

- Érthetően

- megérti

- használ

- használt

- segítségével

- hasznosság

- gyártók

- sétál

- akar

- szavatolja

- volt

- Waters

- we

- JÓL

- Mit

- bármi

- vajon

- ami

- míg

- WHO

- akinek

- miért

- hajlandó

- bölcsesség

- val vel

- Munka

- világ

- york

- te

- A te

- zephyrnet