Annak érdekében, hogy megosszák a varázslatos DALL E 2 széles közönség mellett csökkentenünk kellett a hatékony képgeneráló modellekkel kapcsolatos kockázatokat. Ebből a célból különféle védőkorlátok helyén, hogy a generált képek ne sértsék a mi tartalompolitika. Ez a bejegyzés arra összpontosít edzés előtti enyhítések, ezeknek a védőkorlátoknak egy részhalmaza, amely közvetlenül módosítja azokat az adatokat, amelyekből a DALL·E 2 tanul. A DALL·E 2-t az internetről származó, több százmillió feliratos képre tanítják, és ezek közül néhányat eltávolítunk és súlyozunk, hogy megváltoztassuk a modell által tanultakat.

Ez a bejegyzés három részből áll, amelyek mindegyike más-más edzés előtti enyhítést ír le:

- Az első részben leírjuk, hogyan szűrtük ki az erőszakos és szexuális képeket a DALL·E 2 képzési adatkészletéből. E mérséklés nélkül a modell megtanulna grafikus vagy explicit képeket készíteni, amikor kérik, és akár véletlenül is visszaadhat ilyen képeket, válaszul az ártalmatlannak tűnő felszólításokra.

- A második részben azt találjuk, hogy a képzési adatok szűrése felerősítheti a torzításokat, és leírjuk technikánkat ennek a hatásnak a mérséklésére. Például ezen enyhítés nélkül azt vettük észre, hogy a szűrt adatokon betanított modellek időnként több férfit és kevesebb nőt ábrázoló képet generáltak, mint az eredeti adathalmazra képzett modellek.

- Az utolsó részben rátérünk a memorizálás kérdésére, és azt találjuk, hogy az olyan modellek, mint a DALL·E 2, néha képesek reprodukálni azokat a képeket, amelyekre betanították őket, ahelyett, hogy új képeket hoznának létre. A gyakorlatban azt tapasztaltuk, hogy ez képregurgitáció az adatkészletben sokszor replikált képek okozzák, és enyhíti a problémát azáltal, hogy eltávolítja azokat a képeket, amelyek vizuálisan hasonlítanak az adatkészletben lévő többi képhez.

Grafikus és explicit képzési adatok csökkentése

Mivel az adatok betanítása alakítja bármely tanult modell képességeit, az adatszűrés hatékony eszköz a nemkívánatos modell képességeinek korlátozására. Ezt a megközelítést két kategóriában alkalmaztuk – a grafikus erőszakot és a szexuális tartalmat ábrázoló képekre – azáltal, hogy osztályozók segítségével kiszűrtük az ezekbe a kategóriákba tartozó képeket az adatkészletből a DALL·E 2 betanítása előtt. Ezeket a képosztályozókat házon belül képeztük ki, és folytatjuk a az adatkészlet-szűrés hatásai a betanított modellünkre.

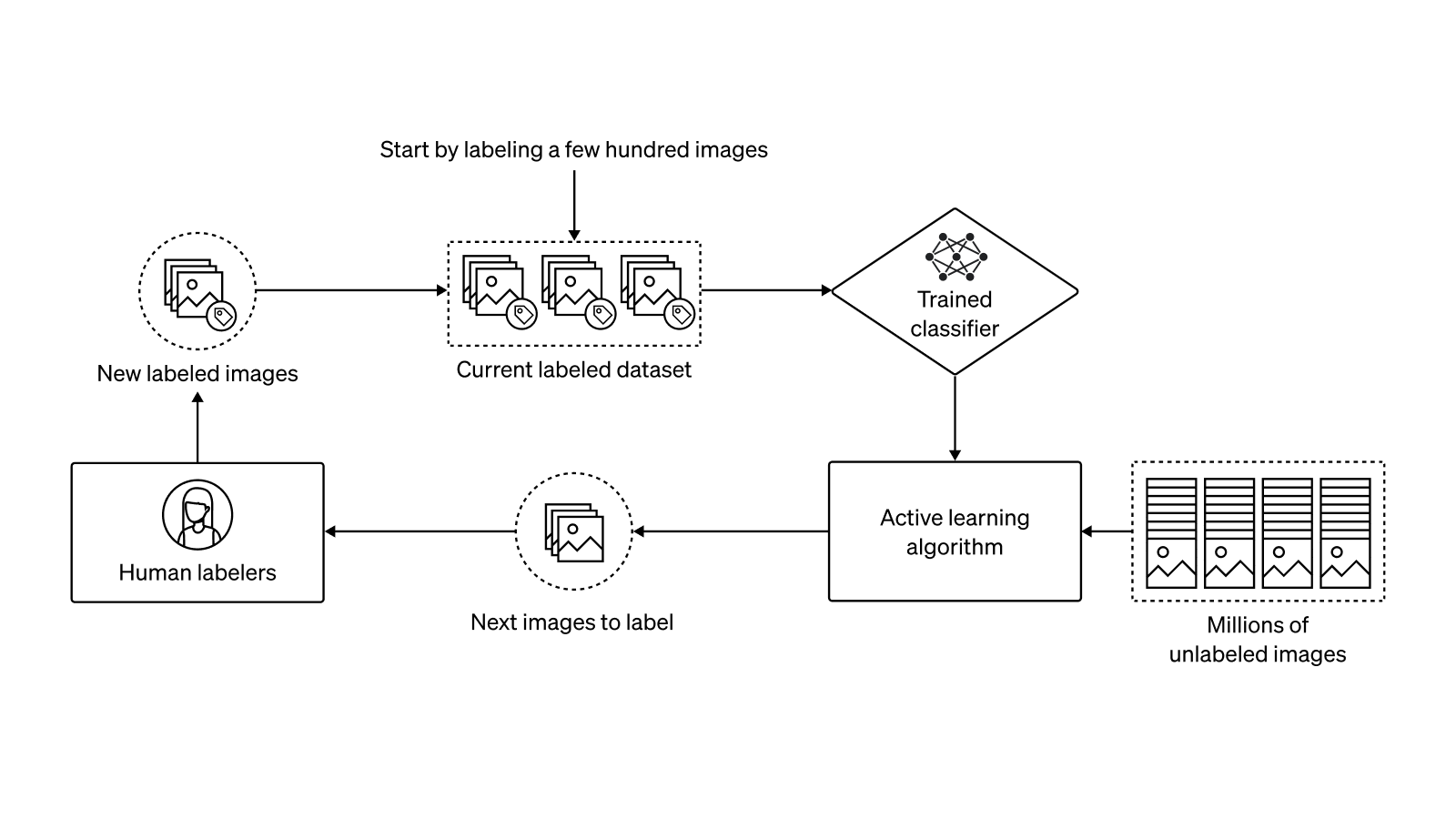

Képosztályozóink betanításához újra felhasználtuk azt a megközelítést, amelyet korábban a képzési adatok szűrésére alkalmaztunk SIKLIK. Ennek a megközelítésnek az alapvető lépései a következők: először létrehozunk egy specifikációt a címkézni kívánt képkategóriákhoz; másodszor, minden kategóriához összegyűjtünk néhány száz pozitív és negatív példát; harmadszor, aktív tanulási eljárást alkalmazunk, hogy több adatot gyűjtsünk, és javítsuk a pontosság/visszahívás kompromisszumot; és végül az eredményül kapott osztályozót a teljes adatkészleten futtatjuk egy konzervatív osztályozási küszöbértékkel, hogy előnyben részesítsük a visszahívást a pontosság helyett. E küszöbértékek beállításához prioritásként kezeltük az összes kiszűrését rossz adatok a távozás felett az összesben jó adat. Ennek az az oka, hogy a modellünket később mindig több adattal finomhangolhatjuk, hogy új dolgokat taníthassunk neki, de sokkal nehezebb elfelejteni a modellt, amit már megtanult.

Az aktív tanulási szakaszban iteratív módon javítottuk osztályozóinkat azáltal, hogy emberi címkéket gyűjtöttünk a potenciálisan nehéz vagy rosszul besorolt képekhez. Nevezetesen, hogy két aktív tanulási technikát használtunk a képek kiválasztásához az adatkészletünkből (amely több száz millió címkézetlen képet tartalmaz), amelyeket bemutatunk az embereknek címkézés céljából. Először is, hogy csökkentsük osztályozónk hamis pozitív arányát (vagyis azt a gyakoriságot, amellyel egy jóindulatú képet tévesen erőszakosnak vagy szexuálisnak minősít), emberi címkéket rendeltünk azokhoz a képekhez, amelyeket a jelenlegi modell pozitívnak minősített. Ahhoz, hogy ez a lépés jól működjön, besorolási küszöbünket közel 100%-os visszahívásra, de magas hamis pozitív arányra hangoltuk; így címkézőink többnyire valóban negatív eseteket címkéztek fel. Bár ez a technika segít csökkenteni a hamis pozitívumot, és csökkenti annak szükségességét, hogy a címkézők potenciálisan káros képeket nézzenek meg, nem segít több olyan pozitív eset felderítésében, amelyek jelenleg hiányoznak a modellből.

Az osztályozó téves negatív arányának csökkentése érdekében egy második aktív tanulási technikát alkalmaztunk: a legközelebbi szomszéd keresését. Különösen sokszoros keresztellenőrzést végeztünk, hogy pozitív mintákat találjunk a jelenlegi címkézett adatkészletünkben, amelyeket a modell hajlamos volt rosszul negatívnak minősíteni (ehhez szó szerint az osztályozó több száz változatát betanítottuk különböző vonat-validációs felosztásokkal). Ezután beszkenneltük a címkézetlen képeink nagy gyűjteményét, hogy megkeressük ezeknek a mintáknak a legközelebbi szomszédait egy észlelési jellemző térben, és emberi címkéket rendeltünk a felfedezett képekhez. Számítási infrastruktúránknak köszönhetően triviális volt az osztályozó képzést és a legközelebbi szomszéd keresését is számos GPU-ra bővíteni, lehetővé téve, hogy az aktív tanulási lépés órák vagy napok helyett percek alatt menjen végbe.

Adatszűrőink hatékonyságának ellenőrzésére két GLIDE modellt tanítottunk be azonos hiperparaméterekkel: egyet a szűretlen adatokra, egyet pedig a szűrés utáni adatkészletre. Az előbbi modellt a szűretlen modell, az utóbbi pedig mint a szűrt modell. Ahogy az várható volt, azt tapasztaltuk, hogy a szűretlen modell általában kevésbé egyértelmű vagy grafikus tartalmat produkált az ilyen jellegű tartalom iránti kérésekre. Azonban találtunk egy váratlan mellékhatást is az adatszűrésnek: létrehozta vagy felerősítette a modell bizonyos demográfiai csoportokhoz való torzítását.

Az adatszűrők által bevezetett torzítás javítása

A generatív modellek megpróbálják összeegyeztetni a képzési adataik eloszlását, beleértve az esetleges torzításokat is. Ennek eredményeként a betanítási adatok szűrése képes torzításokat létrehozni vagy felerősíteni a downstream modellekben. Általánosságban elmondható, hogy az eredeti adatkészletben lévő torzítások rögzítése nehéz szociotechnikai feladat, amelyet továbbra is tanulmányozunk, és túlmutat e bejegyzés keretein. A probléma, amellyel itt foglalkozunk, a torzítások felerősítése, amelyet kifejezetten maga az adatszűrés okoz. Megközelítésünkkel arra törekszünk, hogy megakadályozzuk a szűrt modell létrejöttét több elfogultabb, mint a szűretlen modell, lényegében csökkentve az adatszűrés okozta eloszláseltolódást.

A szűrés miatti torzítás-erősítés konkrét példájaként tekintsük az „a vezérigazgató” promptot. Amikor a szűretlen modellünk képeket generált ehhez a felszólításhoz, általában több képet produkált férfiakról, mint nőkről, és arra számítunk, hogy ez az elfogultság nagy része a jelenlegi edzési adatainkat tükrözi. Amikor azonban ugyanazt a promptot futtattuk a szűrt modellünkön, a torzítás felerősödött; a nemzedékek szinte kizárólag férfiak képei voltak.

Feltételezzük, hogy az elfogultság erősödésének ez a sajátos esete két helyről származik: először is, még ha a nők és a férfiak nagyjából egyenlő arányban képviseltetik magukat az eredeti adatkészletben, az adatkészlet elfogulhat a nők szexualizáltabb kontextusban való bemutatása felé; másodszor pedig maguk az osztályozóink is elfogultak lehetnek az implementáció vagy az osztálydefiníció miatt, annak ellenére, hogy igyekeztünk biztosítani, hogy ez ne így legyen az adatgyűjtési és érvényesítési szakaszban. Mindkét hatás miatt a szűrőnk több női képet távolíthat el, mint férfit, ami megváltoztatja a nemek arányát, amelyet a modell az edzés során megfigyel.

A szűrők által kiváltott torzítás alaposabb vizsgálata érdekében módot kerestünk annak mérésére, hogy adatszűrőink mennyire befolyásolják a különböző fogalmak iránti torzítást. Az erőszakra és a szexuális tartalomra vonatkozó szűrőink tisztán képalapúak, de adatkészletünk multimodális jellege lehetővé teszi, hogy közvetlenül mérjük ezeknek a szűrőknek a szövegre gyakorolt hatását. Mivel minden képhez szöveges felirat tartozik, meg tudtuk nézni a kézzel kiválasztott kulcsszavak relatív gyakoriságát a szűrt és a szűretlen adatkészletben, hogy megbecsülhessük, hogy a szűrők mennyire hatnak az adott koncepcióra.

Ennek gyakorlati megvalósítása érdekében az Apache Spark segítségével kiszámítottuk néhány kulcsszó (pl. „szülő”, „nő”, „gyerek”) gyakoriságát a szűrt és szűretlen adatkészleteink összes feliratában. Annak ellenére, hogy adatkészletünk több száz millió szöveg-képpárt tartalmaz, a kulcsszó-gyakoriságok kiszámítása csak néhány percet vett igénybe számítási klaszterünk segítségével.

A kulcsszavak gyakoriságának kiszámítása után meg tudtuk győződni arról, hogy adatkészlet-szűrőink bizonyos kulcsszavak gyakoriságát valóban jobban torzították, mint másokét. Például a szűrők a „nő” szó gyakoriságát 14%-kal, míg a „férfi” szó gyakoriságát csak 6%-kal csökkentették. Ez nagy léptékben megerősítette azt, amit már anekdotikusan megfigyeltünk mindkét adatkészleten betanított GLIDE modellekből vett mintavétellel.

Most, hogy rendelkezünk proxyval a szűrő által kiváltott torzítás mérésére, szükségünk volt egy módra annak csökkentésére. Ennek a problémának a megoldása érdekében a szűrt adathalmaz újrasúlyozását céloztuk meg, hogy eloszlása jobban megfeleljen a szűretlen képek eloszlásának. Tegyük fel, hogy az adatkészletünk 50%-ban macskafotókból és 50%-ban kutyafotókból áll, de adatszűrőink a kutyák 75%-át eltávolítják, a macskáknak azonban csak 50%-át. A végső adatkészlet ⅔ macska és ⅓ kutya lenne, és az ezen az adatkészleten kiképzett valószínűség-alapú generatív modell valószínűleg több képet generálna macskákról, mint kutyákról. Ezt a kiegyensúlyozatlanságot úgy javíthatjuk, hogy a kutyáról készült minden kép edzésveszteségét megszorozzuk 2-vel, emulálva minden kutyakép kétszeri megismétlésének hatását. Kiderült, hogy ezt a megközelítést a valós adatkészleteinkhez és modelljeinkhez igazíthatjuk nagyrészt automatikus módon – vagyis nem kell kézzel kiválasztanunk azokat a szolgáltatásokat, amelyeket át akarunk súlyozni.

A szűrt adatkészletben lévő képek súlyát egy speciális osztályozóból származó valószínűségek segítségével számítjuk ki, hasonlóan a Choi és mtsai. (2019). Ennek az osztályozónak a betanításához egységesen mintát veszünk a képekről mindkét adatkészletből, és megjósoljuk, hogy a kép melyik adatkészletből származik. Ez a modell különösen előrevetíti P(szűretlen|kép), előzetesen adott P(szűretlen) = 0.5. A gyakorlatban nem akarjuk, hogy ez a modell túl erős legyen, különben eleve megtanulja a szűrőink által megvalósított pontos funkciót. Ehelyett azt szeretnénk, hogy a modell simább legyen, mint az eredeti adatszűrőink, széles kategóriákat rögzítve, amelyekre a szűrők hatással vannak, miközben nem biztosak abban, hogy egy adott képet kiszűrnek-e vagy sem. Ebből a célból egy lineáris szondát képeztünk ki egy kicsi tetejére CLIP modell.

Ha már van egy osztályozónk, amely megjósolja annak valószínűségét, hogy egy kép a szűretlen adatkészletből származik, akkor is át kell alakítanunk ezt az előrejelzést a kép súlyozására. Például tegyük fel, hogy P(szűretlen|kép) = 0.8. Ez azt jelenti, hogy a minta 4-szer nagyobb valószínűséggel található a szűretlen adatokban, mint a szűrt adatokban, és a 4-es súlyozásnak ki kell javítania az egyensúlyhiányt. Általánosabban, használhatjuk a súlyt P(szűretlen|kép)/P(szűrt|kép).[1]

Mennyire csökkenti valójában ez az átsúlyozási séma a felerősített torzítást? Amikor finomhangoltuk korábbi szűrt modellünket az új súlyozási sémával, a finomhangolt modell viselkedése sokkal jobban megegyezett a szűretlen modellel a korábban talált torzított példákon. Bár ez biztató volt, mi is szerettük volna alaposabban értékelni ezt a mérséklést a kulcsszóalapú torzítási heurisztika segítségével. Ahhoz, hogy új súlyozási sémánk figyelembevétele mellett a kulcsszavak gyakoriságát mérjük, egyszerűen súlyozhatjuk a kulcsszó minden példányát a szűrt adatkészletben az azt tartalmazó minta súlyával. Ezzel egy új kulcsszó-gyakoriság-készletet kapunk, amely tükrözi a szűrt adatkészletben lévő mintasúlyokat.

Az általunk ellenőrzött kulcsszavak többségénél az újrasúlyozási séma csökkentette a szűrés által kiváltott gyakoriságváltozást. Korábbi „férfi” és „nő” példáink esetében a relatív gyakoriságcsökkenés 1% és –1% volt, míg korábbi értékeik 14%, illetve 6% voltak. Bár ez a mérőszám csak a tényleges szűrési torzítás proxyja, megnyugtató, hogy a képalapú újrasúlyozási sémánk valóban jelentősen javítja a szövegalapú mérőszámot.

Folytatjuk a DALL·E 2 fennmaradó torzításainak vizsgálatát, részben a modell viselkedésének átfogóbb értékelése és annak vizsgálata révén, hogy a szűrés hogyan befolyásolta a torzítást és a képességfejlesztést.

Képregurgitáció megelőzése

Megfigyeltük, hogy a DALL·E 2 belső elődjei néha szó szerint reprodukálták a képzési képeket. Ez a viselkedés nem volt kívánatos, mivel azt szeretnénk, hogy a DALL·E 2 alapértelmezés szerint eredeti, egyedi képeket hozzon létre, és ne csak „összefűzze” a meglévő képek darabjait. Ezenkívül a képzési képek szó szerinti reprodukálása jogi kérdéseket vethet fel a szerzői jogok megsértésével, a tulajdonjoggal és a magánélet védelmével kapcsolatban (ha az emberek fényképei szerepeltek a képzési adatok között).

A képregurgitáció problémájának jobb megértése érdekében összegyűjtöttünk egy adatsort olyan felszólításokról, amelyek gyakran duplikált képeket eredményeztek. Ehhez egy betanított modellt használtunk, hogy 50,000 50 prompthoz mintát vettünk a képzési adatkészletünkből, és a mintákat a megfelelő képzési képhez való észlelési hasonlóság alapján rendeztük. Végül kézzel megvizsgáltuk a legjobb egyezéseket, és az összesen 1 0 promptból csak néhány száz valódi ismétlődő párt találtunk. Annak ellenére, hogy a regurgitációs ráta XNUMX% alattinak tűnt, úgy éreztük, hogy a fenti okok miatt szükségesnek tartottuk a ráta XNUMX-ra csökkentését.

Amikor megvizsgáltuk a regurgitált képek adatkészletét, két mintát vettünk észre. Először is, a képek szinte mind egyszerű vektorgrafikák voltak, amelyeket valószínűleg könnyű megjegyezni alacsony információtartalmuk miatt. Másodszor, és ami még ennél is fontosabb, a képek mindegyike sok szinte ismétlődést tartalmazott a képzési adatkészletben. Például lehet egy vektorgrafika, amely úgy néz ki, mint egy óra, amely az 1 órát mutatja – de akkor felfedeznénk egy edzésmintát, amely ugyanazt az órát mutatja, 2 órát, majd 3 órát stb. rájöttünk erre, elosztott legközelebbi szomszéd keresést használtunk annak ellenőrzésére, hogy valóban az összes visszatorlódott kép észlelésilag hasonló ismétlődést tartalmaz-e az adatkészletben. Más művek hasonló jelenséget figyeltek meg nagy nyelvi modellekben, és azt találták, hogy az adatkettőzés szorosan összefügg a memorizálással.

A fenti megállapítás arra utalt, hogy ha deduplikálnánk az adatkészletünket, megoldhatnánk a regurgitációs problémát. Ennek elérése érdekében azt terveztük, hogy neurális hálózat segítségével azonosítjuk a hasonlónak tűnő képcsoportokat, majd eltávolítjuk az összes képet egy kivételével az egyes csoportokból.[2] Ehhez azonban minden egyes kép esetében ellenőrizni kell, hogy az adatkészletben lévő összes többi kép másolata-e. Mivel a teljes adatkészletünk több száz millió képet tartalmaz, naiv módon több száz kvadrillió képpárt kellene ellenőriznünk, hogy megtaláljuk az összes másolatot. Noha ez technikailag elérhető, különösen egy nagy számítási klaszteren, találtunk egy sokkal hatékonyabb alternatívát, amely szinte ugyanolyan jól működik a költségek kis töredékéért.

Fontolja meg, mi történik, ha az adatkészletünket a deduplikáció végrehajtása előtt fürtözzük. Mivel a közeli minták gyakran ugyanabba a klaszterbe esnek, a legtöbb ismétlődő pár nem lépi át a klaszter döntési határait. Ezután deduplikálhattuk a mintákat az egyes klasztereken belül anélkül, hogy ellenőriznénk a fürtön kívüli duplikációkat, miközben az összes duplikált párnak csak egy kis része hiányzik. Ez sokkal gyorsabb, mint a naiv megközelítés, hiszen már nem kell minden egyes képpárt ellenőriznünk.[3] Amikor ezt a megközelítést empirikusan teszteltük adataink egy kis részhalmazán, az összes duplikált pár 85%-át találta, amikor K = 1024 klaszterek.

A fenti algoritmus sikerarányának javítása érdekében egy kulcsfontosságú megfigyelést használtunk: amikor egy adathalmaz különböző véletlenszerű részhalmazait klaszterezi, a kapott klaszter-döntési határok gyakran meglehetősen eltérőek. Ezért, ha egy duplikált pár átlépi a fürt határát az adatok egyik klaszterezésénél, ugyanaz a pár egy másik fürtben lévő egyetlen fürtbe kerülhet. Minél több klaszterezést próbál ki, annál valószínűbb, hogy felfedez egy adott ismétlődő párt. A gyakorlatban öt klaszterezés mellett döntöttünk, ami azt jelenti, hogy öt különböző klaszter egyesülésében keresünk minden egyes kép másolatát. A gyakorlatban ez az összes duplikált pár 97%-át találta adataink egy részhalmazán.

Meglepő módon az adatkészletünk csaknem egynegyedét eltávolítottuk a deduplikációval. Amikor megvizsgáltuk a talált szinte ismétlődő párokat, sok közülük jelentős változásokat tartalmazott. Idézzük fel a fenti órára vonatkozó példát: az adatkészlet tartalmazhat sok képet ugyananról az óráról a nap különböző szakaszaiban. Bár ezek a képek valószínűleg arra késztetik a modellt, hogy megjegyezze az adott óra megjelenését, segíthetnek abban, hogy a modell megtanuljon különbséget tenni a napszakok között. Tekintettel az eltávolított adatok mennyiségére, attól tartunk, hogy az ilyen képek eltávolítása ronthatta a modell teljesítményét.

A deduplikáció modelljeinkre gyakorolt hatásának teszteléséhez két modellt tanítottunk be azonos hiperparaméterekkel: egyet a teljes adatkészletre, egyet pedig az adatkészlet deduplikált verziójára. A modellek összehasonlításához ugyanazokat az emberi értékeléseket használtuk, mint az eredeti GLIDE modellünk értékelésénél. Meglepő módon azt tapasztaltuk, hogy az emberi értékelők kissé előnyben részesített a modell a deduplikált adatokra oktatott, ami arra utal, hogy az adatkészletben lévő nagy mennyiségű redundáns kép valójában rontotta a teljesítményt.

Miután egy modellt betanítottunk a deduplikált adatokra, újra futtattuk a regurgitációs keresést, amelyet korábban több mint 50 50 prompt végeztünk a betanítási adatkészletből. Megállapítottuk, hogy az új modell soha nem térítette vissza a képzési képet, amikor a képzési adatkészletből pontosan kérte a képet. Ahhoz, hogy ezt a tesztet még egy lépéssel tovább tegyük, elvégeztük a legközelebbi szomszéd keresését a teljes képzési adathalmazban az XNUMX XNUMX generált kép mindegyikénél. Így arra gondoltunk, hogy elkaphatjuk a modellt, hogy egy másik képet regurgitál, mint az adott prompthoz társított. Még ennél az alaposabb ellenőrzésnél sem találtunk képregurgitációs esetet.

Következő lépések

Bár a fent tárgyalt valamennyi mérséklés jelentős előrelépést jelent a DALL·E 2-vel kapcsolatos kockázatok csökkentésére irányuló célunk felé, mindegyik mérséklésen van még mit javítani:

- A jobb előképzési szűrők lehetővé tennék, hogy a DALL·E 2-t több adatra tanítsuk, és potenciálisan tovább csökkentsék a modell torzítását. Jelenlegi szűrőink alacsony hibaarányra vannak hangolva, sok téves pozitív eredmény árán. Ennek eredményeként a teljes adatkészletünk nagyjából 5%-át kiszűrtük, bár ezeknek a szűrt képeknek a többsége egyáltalán nem sérti tartalmi irányelveinket. A szűrőink fejlesztése lehetővé teheti, hogy visszanyerjük a képzési adatok egy részét.

- A torzítást a rendszerfejlesztés és telepítés számos szakaszában bevezetik és potenciálisan felerősítik. A DALL·E 2-hez hasonló rendszerekben tapasztalható torzítás és az ebből adódó károk értékelése és mérséklése fontos interdiszciplináris probléma, amelyet szélesebb küldetésünk részeként továbbra is tanulmányozunk az OpenAI-nál. Az ezzel kapcsolatos munkánk magában foglalja a probléma jobb megértését célzó értékelések elkészítését, új adatkészletek összegyűjtését, valamint olyan technikák alkalmazását, mint az emberi visszajelzés és a finomhangolás robusztusabb és reprezentatívabb technológiák létrehozása érdekében.

- Az is kulcsfontosságú, hogy továbbra is tanulmányozzuk a memorizálást és az általánosítást a mély tanulási rendszerekben. Bár a deduplikáció jó első lépés a memorizálás megelőzése felé, nem árul el mindent, hogy megtudjuk, miért vagy hogyan memorizálják az olyan modellek, mint a DALL·E 2 a képzési adatokat.

- 000

- 2019

- a

- Rólunk

- Fiók

- Elérése

- át

- aktív

- cím

- érintő

- algoritmus

- Minden termék

- lehetővé téve

- lehetővé teszi, hogy

- már

- alternatív

- mindig

- összeg

- Másik

- megjelent

- alkalmazott

- Alkalmazása

- megközelítés

- körül

- kijelölt

- társult

- közönség

- mert

- előtt

- hogy

- Jobb

- között

- Túl

- épít

- Épület

- képességek

- feliratok

- eset

- esetek

- Fogás

- Kategória

- okozott

- bizonyos

- változik

- ellenőrzése

- A pop-art design, négy időzóna kijelzése egyszerre és méretének arányai azok az érvek, amelyek a NeXtime Time Zones-t kiváló választássá teszik. Válassza a

- osztály

- besorolás

- osztályozott

- óra

- gyűjtemény

- képest

- Kiszámít

- számítástechnika

- koncepció

- Fontolja

- tartalmaz

- tartalom

- kontextusok

- folytatódik

- copyright

- szerzői jogok megsértése

- Megfelelő

- tudott

- teremt

- készítette

- létrehozása

- kritikus

- Jelenlegi

- Jelenleg

- dátum

- nap

- Nap

- döntés

- mély

- Demográfiai

- bevetés

- leírni

- Ellenére

- Fejlesztés

- különböző

- nehéz

- közvetlenül

- felfedez

- felfedezett

- távolság

- megosztott

- terjesztés

- le-

- ismétlődések

- alatt

- minden

- hatás

- hatékonyan

- hatékonyság

- hatások

- hatékony

- erőfeszítések

- bátorító

- különösen

- lényegében

- becslés

- stb.

- értékelni

- minden

- példa

- példák

- kizárólagosan

- létező

- vár

- várható

- gyorsabb

- Funkció

- Jellemzők

- Visszacsatolás

- Ábra

- szűrő

- Szűrők

- Végül

- megtalálása

- vezetéknév

- Rögzít

- koncentrál

- következik

- talált

- ból ből

- Tele

- funkció

- további

- gyűjtése

- nem

- általános

- általában

- generál

- generált

- generáció

- generációk

- nemző

- cél

- jó

- GPU

- grafika

- Csoport

- Csoportok

- Garantált

- maréknyi

- segít

- segít

- itt

- Magas

- Hogyan

- azonban

- HTTPS

- emberi

- Az emberek

- Több száz

- ötlet

- azonosítani

- kép

- képek

- végrehajtás

- végre

- fontos

- javul

- javított

- javuló

- tartalmaz

- beleértve

- magában foglalja a

- Beleértve

- információ

- Infrastruktúra

- példa

- Internet

- vizsgálja

- kérdés

- IT

- maga

- Kulcs

- Címke

- címkézés

- Címkék

- nyelv

- nagy

- nagyobb

- TANUL

- tanult

- tanulás

- Jogi

- Valószínű

- néz

- nézett

- csinál

- jel

- Mérkőzés

- jelentőségteljes

- eszközök

- intézkedés

- mérő

- Férfi

- esetleg

- Katonai

- Több millió

- Küldetés

- modell

- modellek

- több

- a legtöbb

- szaporodását

- Természet

- elengedhetetlen

- negatív

- hálózat

- szám

- érdekében

- Szervezett

- eredeti

- Más

- tulajdon

- rész

- különös

- teljesítmény

- előadó

- fázis

- darabok

- tervezett

- politika

- pozitív

- lehetséges

- potenciális

- erős

- gyakorlat

- előre

- előrejelzés

- be

- megakadályozása

- előző

- magánélet

- szonda

- Probléma

- folyamat

- gyárt

- Készült

- tiltakozás

- meghatalmazott

- Negyed

- emel

- el

- realizált

- miatt

- csökkenteni

- Csökkent

- csökkentő

- tükröznie

- visszaverődés

- megmaradó

- eltávolítása

- képvisel

- képviselet

- reprezentatív

- kéri

- szükség

- megköveteli,

- válasz

- kapott

- visszatérés

- kockázatok

- futás

- azonos

- Skála

- rendszer

- Keresés

- készlet

- formák

- Megosztás

- váltás

- jelentős

- hasonló

- Egyszerű

- óta

- egyetlen

- Méret

- kicsi

- So

- SOLVE

- néhány

- valami

- Hely

- speciális

- kifejezetten

- leírás

- szakadások

- állapota

- kezdet

- meghatározott

- Még mindig

- Tanulmány

- siker

- rendszer

- Systems

- bevétel

- technikák

- Technologies

- teszt

- A

- ebből adódóan

- dolgok

- alaposan

- három

- küszöb

- Keresztül

- idő

- alkalommal

- szerszám

- felső

- felé

- Vonat

- Képzések

- megért

- unió

- egyedi

- us

- használ

- érvényesítés

- különféle

- ellenőrzése

- változat

- kívánatos

- Mit

- vajon

- míg

- belül

- nélkül

- Női

- Munka

- művek

- aggódik

- lenne

- X