A kutatók továbbra is új modellarchitektúrákat fejlesztenek ki az általános gépi tanulási (ML) feladatokhoz. Az egyik ilyen feladat a képosztályozás, ahol a képeket a rendszer bemenetként fogadja el, és a modell objektumcímke kimenetekkel kísérli meg a kép egészének osztályozását. A jelenleg rendelkezésre álló számos modellnek köszönhetően, amelyek elvégzik ezt a képosztályozási feladatot, az ML-szakember ilyen kérdéseket tehet fel: „Milyen modellt kell finomhangolni, majd telepíteni, hogy a legjobb teljesítményt érjem el az adatkészletemen?” Az ML-kutató pedig feltehet olyan kérdéseket, mint például: „Hogyan hozhatom létre saját tisztességes összehasonlításomat több modellarchitektúra és egy meghatározott adatkészlet között, miközben szabályozom a betanítási hiperparamétereket és a számítógép-specifikációkat, például a GPU-kat, a CPU-kat és a RAM-ot?” Az előbbi kérdés a modellarchitektúrák közötti modellválasztásra vonatkozik, míg az utóbbi kérdés a betanított modellek összehasonlítására vonatkozik egy tesztadatkészlethez képest.

Ebben a bejegyzésben látni fogod, hogyan a TensorFlow képosztályozás algoritmusa Amazon SageMaker JumpStart leegyszerűsítheti az e kérdések megválaszolásához szükséges megvalósításokat. A megvalósítás részleteivel együtt egy megfelelő példa Jupyter notebook, akkor rendelkezésre állnak majd eszközök a modell kiválasztásához a pareto határok feltárásával, ahol az egyik teljesítménymutató, például a pontosság javítása nem lehetséges egy másik mutató, például az átviteli sebesség romlása nélkül.

Megoldás áttekintése

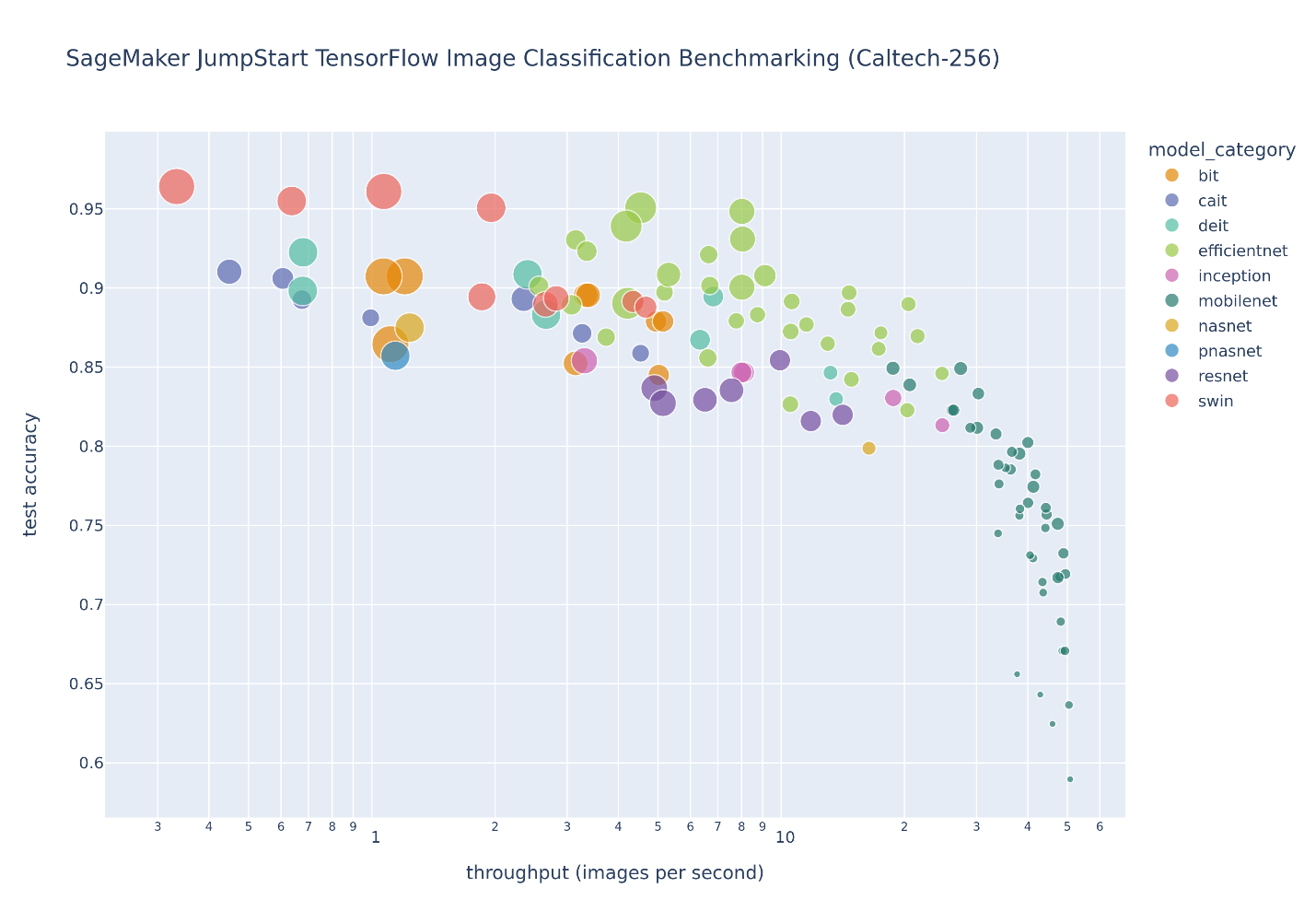

A következő ábra bemutatja a modellválasztás kompromisszumát nagyszámú képbesorolási modell esetében, amelyek finomhangolása a Caltech-256 adatkészlet, amely 30,607 256 valós képből álló, XNUMX objektumkategóriát felölelő, kihívásokkal teli halmaz. Minden pont egyetlen modellt képvisel, a pontméretek a modellt alkotó paraméterek számához képest skálázva vannak, és a pontok színkóddal vannak ellátva a modell architektúrája alapján. Például a világoszöld pontok az EfficientNet architektúrát képviselik; minden világoszöld pont ennek az architektúrának a különböző konfigurációja, egyedi, finomhangolt modellteljesítmény mérésekkel. Az ábra azt mutatja, hogy létezik egy pareto-határ a modellválasztáshoz, ahol a nagyobb pontosság kisebb áteresztőképességre cserélődik. Végső soron egy modell kiválasztása a pareto határ mentén vagy a pareto hatékony megoldások halmaza a modell telepítési teljesítménykövetelményeitől függ.

Ha megfigyeli a teszt pontosságát és a vizsgált átviteli határokat, az előző ábrán látható pareto-hatékony megoldások halmazát a következő táblázat foglalja össze. A sorok úgy vannak rendezve, hogy a teszt átviteli sebessége nő, és a teszt pontossága csökken.

| Modell neve | Paraméterek száma | Teszt pontossága | Teszt Top 5 pontosság | Átbocsátóképesség (kép/mp) | Időtartam korszakonként |

| swin-large-patch4-window12-384 | 195.6M | 96.4% | 99.5% | 0.3 | 2278.6 |

| swin-large-patch4-window7-224 | 195.4M | 96.1% | 99.5% | 1.1 | 698.0 |

| efficientnet-v2-imagenet21k-ft1k-l | 118.1M | 95.1% | 99.2% | 4.5 | 1434.7 |

| efficientnet-v2-imagenet21k-ft1k-m | 53.5M | 94.8% | 99.1% | 8.0 | 769.1 |

| efficientnet-v2-imagenet21k-m | 53.5M | 93.1% | 98.5% | 8.0 | 765.1 |

| hatékony net-b5 | 29.0M | 90.8% | 98.1% | 9.1 | 668.6 |

| efficientnet-v2-imagenet21k-ft1k-b1 | 7.3M | 89.7% | 97.3% | 14.6 | 54.3 |

| efficientnet-v2-imagenet21k-ft1k-b0 | 6.2M | 89.0% | 97.0% | 20.5 | 38.3 |

| efficientnet-v2-imagenet21k-b0 | 6.2M | 87.0% | 95.6% | 21.5 | 38.2 |

| mobilenet-v3-large-100-224 | 4.6M | 84.9% | 95.4% | 27.4 | 28.8 |

| mobilenet-v3-large-075-224 | 3.1M | 83.3% | 95.2% | 30.3 | 26.6 |

| mobilenet-v2-100-192 | 2.6M | 80.8% | 93.5% | 33.5 | 23.9 |

| mobilenet-v2-100-160 | 2.6M | 80.2% | 93.2% | 40.0 | 19.6 |

| mobilenet-v2-075-160 | 1.7M | 78.2% | 92.8% | 41.8 | 19.3 |

| mobilenet-v2-075-128 | 1.7M | 76.1% | 91.1% | 44.3 | 18.3 |

| mobilenet-v1-075-160 | 2.0M | 75.7% | 91.0% | 44.5 | 18.2 |

| mobilenet-v1-100-128 | 3.5M | 75.1% | 90.7% | 47.4 | 17.4 |

| mobilenet-v1-075-128 | 2.0M | 73.2% | 90.0% | 48.9 | 16.8 |

| mobilenet-v2-075-96 | 1.7M | 71.9% | 88.5% | 49.4 | 16.6 |

| mobilenet-v2-035-96 | 0.7M | 63.7% | 83.1% | 50.4 | 16.3 |

| mobilenet-v1-025-128 | 0.3M | 59.0% | 80.7% | 50.8 | 16.2 |

Ez a bejegyzés részletesen ismerteti a nagyszabású megvalósítás módját Amazon SageMaker benchmarking és modellválasztási feladatok. Először bemutatjuk a JumpStartot és a beépített TensorFlow képosztályozási algoritmusokat. Ezután megvitatjuk a magas szintű megvalósítási szempontokat, például a JumpStart hiperparaméter-konfigurációit, a metrika kivonását Amazon CloudWatch naplókés aszinkron hiperparaméter-hangolási feladatok indítása. Végül kitérünk az implementációs környezetre és a pareto hatékony megoldásokhoz vezető paraméterezésre az előző táblázatban és ábrán.

A JumpStart TensorFlow képosztályozás bemutatása

A JumpStart az előre betanított modellek széles skálájának egy kattintással történő finomhangolását és telepítését biztosítja a népszerű ML-feladatok között, valamint a gyakori üzleti problémákat megoldó végpontok közötti megoldások választékát. Ezek a funkciók eltávolítják az ML folyamat minden egyes lépéséből adódó nehézségeket, megkönnyítve a kiváló minőségű modellek fejlesztését, és lerövidítve a telepítéshez szükséges időt. A JumpStart API-k lehetővé teszi az előre betanított modellek széles választékának programozott telepítését és finomhangolását saját adatkészletein.

A JumpStart modellközpont nagyszámú hozzáférést biztosít TensorFlow képosztályozási modellek amelyek lehetővé teszik a tanulás átvitelét és az egyéni adatkészletek finomhangolását. Jelen pillanatban a JumpStart modellközpont 135 TensorFlow képbesorolási modellt tartalmaz számos népszerű modellarchitektúrán keresztül. TensorFlow Hub, hogy tartalmazza a maradék hálózatokat (ResNet), MobileNet, EfficientNet, Inception, Neural Architecture Search Networks (NASNet), Nagy transzfer (Bit), eltolt ablak (Sertés) transzformátorok, osztályfigyelem a képtranszformátorokban (CaiT), és adathatékony képátalakítók (DeiT).

Nagyon eltérő belső struktúrák alkotják az egyes modellarchitektúrákat. Például a ResNet modellek átugrási kapcsolatokat használnak, hogy lényegesen mélyebb hálózatokat hozzanak létre, míg a transzformátor alapú modellek önfigyelő mechanizmusokat használnak, amelyek kiküszöbölik a konvolúciós műveletek belső lokalizációját a globálisabb befogadó mezők javára. A különféle struktúrák által biztosított sokrétű szolgáltatáskészleten kívül minden modellarchitektúra számos konfigurációval rendelkezik, amelyek beállítják a modell méretét, alakját és összetettségét az adott architektúrán belül. Ennek eredményeként több száz egyedi képbesorolási modell érhető el a JumpStart modellközpontban. A beépített átviteli tanulási és következtetési szkriptekkel kombinálva, amelyek számos SageMaker funkciót tartalmaznak, a JumpStart API nagyszerű kiindulópont az ML-gyakorlók számára, hogy gyorsan elkezdhessék a képzést és a modellek bevezetését.

Hivatkozni Tanulás átvitele a TensorFlow képosztályozási modellekhez az Amazon SageMakerben és a következőket példafüzet a SageMaker TensorFlow képosztályozás alaposabb megismeréséhez, beleértve azt is, hogyan lehet következtetéseket lefuttatni egy előre betanított modellen, valamint finomhangolni az előre betanított modellt egy egyéni adatkészleten.

Nagyméretű modellválasztási szempontok

A modellválasztás az a folyamat, amely során kiválasztják a legjobb modellt a jelölt modellek halmazából. Ez az eljárás alkalmazható azonos típusú, eltérő paramétersúllyal rendelkező modelleken és különböző típusú modelleken. Az azonos típusú modellek közötti modellválasztás példái közé tartozik az azonos modell illesztése különböző hiperparaméterekkel (például tanulási sebesség), valamint a korai leállítás, hogy megakadályozzák a modellsúlyok túlillesztését a vonatadatkészletbe. A különböző típusú modellek közötti modellválasztás magában foglalja a legjobb modellarchitektúra kiválasztását (például Swin vs. MobileNet), valamint a legjobb modellkonfigurációk kiválasztását egyetlen modellarchitektúrán belül (például mobilenet-v1-025-128 vs mobilenet-v3-large-100-224).

Az ebben a szakaszban felvázolt megfontolások lehetővé teszik az összes ilyen modellkiválasztási folyamatot egy érvényesítési adatkészleten.

Válassza ki a hiperparaméter-konfigurációkat

A TensorFlow képbesorolás a JumpStartban számos elérhető hiperparaméterek amely egységesen állíthatja be az átviteli tanulási szkript viselkedését az összes modellarchitektúrához. Ezek a hiperparaméterek az adatok bővítésére és előfeldolgozására, az optimalizáló specifikációjára, a túlillesztési vezérlőkre és a betanítható rétegjelzőkre vonatkoznak. Javasoljuk, hogy módosítsa ezen hiperparaméterek alapértelmezett értékeit, ha az alkalmazásához szükséges:

Ehhez az elemzéshez és a kapcsolódó jegyzetfüzethez minden hiperparaméter alapértelmezett értékre van állítva, kivéve a tanulási sebességet, a korszakok számát és a korai leállítási specifikációt. A tanulási arány a kategorikus paraméter valami által SageMaker automatikus modelltuning munka. Mivel minden modell egyedi alapértelmezett hiperparaméterértékekkel rendelkezik, a lehetséges tanulási arányok diszkrét listája tartalmazza az alapértelmezett tanulási sebességet, valamint az alapértelmezett tanulási sebesség egyötödét. Ez két betanítási feladatot indít el egyetlen hiperparaméter-hangolási feladathoz, és az érvényesítési adatkészleten a legjobb jelentett teljesítményt nyújtó betanítási feladat kerül kiválasztásra. Mivel az epochák száma 10-re van állítva, ami nagyobb, mint az alapértelmezett hiperparaméter-beállítás, a kiválasztott legjobb képzési feladat nem mindig felel meg az alapértelmezett tanulási sebességnek. Végül egy korai leállítási kritériumot használnak ki türelemmel, vagy három korszakos korszakok számával, amelyekkel javulás nélkül kell folytatni az edzést.

Az egyik különösen fontos alapértelmezett hiperparaméter-beállítás train_only_on_top_layer, ahol, ha be van állítva True, a modell jellemző kinyerési rétegei nincsenek finomhangolva a megadott képzési adatkészleten. Az optimalizáló csak a legfelső, teljesen összekapcsolt osztályozási réteg paramétereit tanítja, amelyek kimeneti dimenziója megegyezik az adatkészletben lévő osztálycímkék számával. Alapértelmezés szerint ez a hiperparaméter a következőre van állítva True, amely egy kis adathalmazokon történő tanulás átvitelére szolgáló beállítás. Előfordulhat, hogy olyan egyéni adatkészlettel rendelkezik, amelynél az ImageNet adatkészlet előképzéséből származó jellemzők kinyerése nem elegendő. Ilyen esetekben be kell állítani train_only_on_top_layer nak nek False. Bár ez a beállítás megnöveli az edzési időt, az Ön érdeklődésére számot tartó problémához sokkal értelmesebb funkciókat nyer ki, ezáltal növelve a pontosságot.

Kivonat mérőszámokat a CloudWatch naplókból

A JumpStart TensorFlow képosztályozási algoritmus megbízhatóan naplózza az edzés során a SageMaker számára elérhető mérőszámokat. Estimator és HyperparameterTuner objektumok. A SageMaker konstruktora Estimator egy metric_definitions kulcsszó argumentum, amely felhasználható a betanítási feladat kiértékelésére úgy, hogy megadja a szótárak listáját két kulccsal: Név a metrika nevéhez, és Regex a metrika naplókból való kinyerésére használt reguláris kifejezéshez. A kísérő jegyzetfüzet megmutatja a megvalósítás részleteit. A következő táblázat felsorolja az összes JumpStart TensorFlow képbesorolási modell elérhető mérőszámait és a kapcsolódó reguláris kifejezéseket.

| Metrika neve | Reguláris kifejezés |

| paraméterek száma | "- A paraméterek száma: ([0-9\.]+)" |

| a betanítható paraméterek száma | "- Tanítható paraméterek száma: ([0-9\.]+)" |

| a nem tanítható paraméterek száma | "- A nem betanítható paraméterek száma: ([0-9\.]+)" |

| vonat adatkészlet mérőszáma | f”- {metrika}: ([0-9\.]+)” |

| érvényesítési adatkészlet metrika | f”- érték_{metrika}: ([0-9\.]+)” |

| teszt adatkészlet metrika | f” – Teszt {metrika}: ([0-9\.]+)” |

| vonat időtartama | "- A képzés teljes időtartama: ([0-9\.]+)" |

| vonat időtartama korszakonként | "- Átlagos edzésidő korszakonként: ([0-9\.]+)" |

| teszt kiértékelési késleltetés | "- A teszt kiértékelésének késleltetése: ([0-9\.]+)" |

| teszt késleltetés mintánként | "- Átlagos teszt késleltetés mintánként: ([0-9\.]+)" |

| tesztelési teljesítmény | "- Átlagos vizsgálati teljesítmény: ([0-9\.]+)" |

A beépített átviteli tanulószkript számos betanítási, érvényesítési és tesztadatkészlet-metrikát biztosít ezeken a definíciókon belül, amint azt az f-karakterlánc helyettesítési értékei képviselik. A rendelkezésre álló pontos mérőszámok az elvégzett besorolás típusától függően változnak. Minden összeállított modell rendelkezik a loss metrika, amelyet egy keresztentrópia veszteség képvisel akár bináris, akár kategorikus osztályozási probléma esetén. Az előbbi akkor használatos, ha egy osztálycímke van; ez utóbbit akkor használjuk, ha két vagy több osztálycímke van. Ha csak egyetlen osztálycímke van, akkor a következő metrikákat számítja ki, naplózza és kinyeri az előző táblázat f-string reguláris kifejezéseivel: valódi pozitív értékek száma (true_pos), téves pozitív eredmények száma (false_pos), valódi negatívok száma (true_neg), hamis negatívok száma (false_neg), precision, recall, a vevő működési jellemzői (ROC) görbe alatti terület (auc), és a precíziós visszahívás (PR) görbe alatti terület (prc). Hasonlóképpen, ha hat vagy több osztálycímke van, a legjobb 5 pontossági mutató (top_5_accuracy) is kiszámítható, naplózható és kibontható az előző reguláris kifejezésekkel.

A képzés során a SageMakernek megadott mérőszámok Estimator a CloudWatch naplókba kerülnek. Amikor a képzés befejeződött, meghívhatja a SageMaker DescribeTrainingJob API és megvizsgálja a FinalMetricDataList írja be a JSON választ:

Ehhez az API-hoz csak a feladat nevét kell megadni a lekérdezésnek, így a befejezést követően a metrikák beszerezhetők a jövőbeli elemzésekben, mindaddig, amíg a betanítási feladat neve megfelelően naplózott és helyreállítható. Ehhez a modellkiválasztási feladathoz a hiperparaméter-hangolási feladatok nevei tárolódnak, és a későbbi elemzések újra csatolják a HyperparameterTuner a hangolási feladat nevét kapott objektumhoz, bontsa ki a legjobb betanítási feladat nevét a csatolt hiperparaméteres hangolóból, majd hívja meg a DescribeTrainingJob API-t a korábban leírtak szerint a legjobb képzési munkához társított metrikák lekéréséhez.

Indítsa el az aszinkron hiperparaméter-hangolási feladatokat

Lásd a megfelelőt jegyzetfüzet A Python szabványos könyvtárát használó hiperparaméter-hangolási feladatok aszinkron elindításának részleteiért egyidejű határidők modul, egy magas szintű interfész a hívható fájlok aszinkron futtatásához. Ebben a megoldásban számos, a SageMakerrel kapcsolatos megfontolás érvényesül:

- Minden AWS-fiók kapcsolódik a következőhöz SageMaker szolgáltatási kvóták. Meg kell tekintenie jelenlegi korlátait, hogy teljes mértékben kihasználhassa erőforrásait, és szükség esetén kérheti az erőforráskorlát növelését.

- A gyakori API-hívások sok egyidejű hiperparaméter-hangolási feladat létrehozásához vezethetnek túllépi a Python SDK sebességét, és szabályozási kivételeket dob. Ennek megoldása egy SageMaker Boto3 kliens létrehozása egyéni újrapróbálkozási konfigurációval.

- Mi történik, ha a szkript hibát észlel, vagy a szkriptet leállítják a befejezés előtt? Egy ilyen nagy modellválaszték vagy benchmarking tanulmány esetén naplózhatja a hangolási feladatok neveit, és kényelmi funkciókat biztosíthat csatolja újra a hiperparaméter-hangolási feladatokat amelyek már léteznek:

Elemzés részletei és vita

Az ebben a bejegyzésben szereplő elemzés átviteli tanulást hajt végre modellazonosítók a JumpStart TensorFlow képosztályozási algoritmusban a Caltech-256 adatkészleten. Az összes képzési feladatot az ml.g4dn.xlarge SageMaker képzési példányon hajtották végre, amely egyetlen NVIDIA T4 GPU-t tartalmaz.

A tesztadatkészlet kiértékelése a betanítási példányon történik a képzés végén. A modell kiválasztását a tesztadatkészlet-értékelés előtt hajtják végre, hogy a modellsúlyokat a legjobb érvényesítési halmazteljesítményű korszakra állítsák be. A teszt átviteli sebessége nincs optimalizálva: az adatkészlet kötegmérete az alapértelmezett betanítási hiperparaméter kötegméretre van állítva, amely nincs beállítva a GPU memóriahasználat maximalizálása érdekében; a jelentett tesztátviteli sebesség magában foglalja az adatbetöltési időt, mivel az adatkészlet nincs előre gyorsítótárban; és a több GPU között elosztott következtetést nem használják fel. Ezen okok miatt ez az átviteli sebesség jó relatív mérés, de a tényleges átviteli sebesség nagymértékben függ a betanított modell következtetési végpont-telepítési konfigurációitól.

Bár a JumpStart modellközpont számos képosztályozási architektúratípust tartalmaz, ezt a pareto határvonalat a kiválasztott Swin, EfficientNet és MobileNet modellek uralják. A Swin modellek nagyobbak és viszonylag pontosabbak, míg a MobileNet modellek kisebbek, viszonylag kevésbé pontosak, és alkalmasak a mobileszközök erőforrás-korlátaira. Fontos megjegyezni, hogy ez a határ számos tényezőtől függ, beleértve a használt pontos adatkészletet és a kiválasztott finomhangoló hiperparamétereket. Előfordulhat, hogy egyéni adatkészlete a pareto-hatékony megoldások eltérő halmazát állítja elő, és hosszabb betanítási időre vágyhat különböző hiperparaméterekkel, például több adatkiegészítéssel vagy finomhangolással, nem csupán a modell felső osztályozási rétegével.

Következtetés

Ebben a bejegyzésben bemutattuk, hogyan lehet nagyméretű modellkiválasztási vagy benchmarking feladatokat futtatni a JumpStart modellközpont használatával. Ez a megoldás segíthet kiválasztani az igényeinek leginkább megfelelő modellt. Javasoljuk, hogy próbálja ki és fedezze fel ezt megoldások a saját adatkészletén.

Referenciák

További információ a következő forrásokban érhető el:

A szerzőkről

Dr. Kyle Ulrich egy alkalmazott tudós a Amazon SageMaker beépített algoritmusok csapat. Kutatási területei közé tartoznak a skálázható gépi tanulási algoritmusok, a számítógépes látás, az idősorok, a Bayes-féle nem-paraméterek és a Gauss-folyamatok. Doktori fokozatát a Duke Egyetemen szerezte, és publikációkat publikált a NeurIPS-ben, a Cell-ben és a Neuron-ban.

Dr. Kyle Ulrich egy alkalmazott tudós a Amazon SageMaker beépített algoritmusok csapat. Kutatási területei közé tartoznak a skálázható gépi tanulási algoritmusok, a számítógépes látás, az idősorok, a Bayes-féle nem-paraméterek és a Gauss-folyamatok. Doktori fokozatát a Duke Egyetemen szerezte, és publikációkat publikált a NeurIPS-ben, a Cell-ben és a Neuron-ban.

Dr. Ashish Khetan vezető alkalmazott tudós Amazon SageMaker beépített algoritmusok és segít a gépi tanulási algoritmusok fejlesztésében. PhD fokozatát az Illinois Urbana Champaign Egyetemen szerezte. A gépi tanulás és a statisztikai következtetések aktív kutatója, és számos közleményt publikált NeurIPS, ICML, ICLR, JMLR, ACL és EMNLP konferenciákon.

Dr. Ashish Khetan vezető alkalmazott tudós Amazon SageMaker beépített algoritmusok és segít a gépi tanulási algoritmusok fejlesztésében. PhD fokozatát az Illinois Urbana Champaign Egyetemen szerezte. A gépi tanulás és a statisztikai következtetések aktív kutatója, és számos közleményt publikált NeurIPS, ICML, ICLR, JMLR, ACL és EMNLP konferenciákon.

- SEO által támogatott tartalom és PR terjesztés. Erősödjön még ma.

- Platoblockchain. Web3 metaverzum intelligencia. Felerősített tudás. Hozzáférés itt.

- Forrás: https://aws.amazon.com/blogs/machine-learning/image-classification-model-selection-using-amazon-sagemaker-jumpstart/

- 10

- 100

- 7

- 9

- a

- Rólunk

- hozzáférés

- hozzáférhető

- Fiók

- pontosság

- pontos

- Elérése

- át

- aktív

- mellett

- cím

- címek

- Beállított

- Társult

- ellen

- algoritmus

- algoritmusok

- Minden termék

- már

- Bár

- mindig

- amazon

- Amazon SageMaker

- Amazon SageMaker JumpStart

- elemzések

- elemzés

- és a

- Másik

- api

- Alkalmazás

- alkalmazott

- megfelelő

- építészet

- TERÜLET

- érv

- társult

- csatolja

- Kísérletek

- Automatikus

- elérhető

- átlagos

- AWS

- alapján

- bayesi

- mert

- előtt

- hogy

- benchmarking

- BEST

- Nagy

- beépített

- üzleti

- kéri

- jelölt

- esetek

- kategóriák

- kihívást

- jellegzetes

- A pop-art design, négy időzóna kijelzése egyszerre és méretének arányai azok az érvek, amelyek a NeXtime Time Zones-t kiváló választássá teszik. Válassza a

- osztály

- besorolás

- osztályoz

- vásárló

- kombinált

- Közös

- összehasonlítás

- teljes

- Befejezett

- befejezés

- bonyolultság

- számítógép

- Számítógépes látás

- aggodalmak

- konferenciák

- Configuration

- összefüggő

- kapcsolatok

- megfontolások

- korlátok

- tartalmaz

- folytatódik

- kontrolling

- ellenőrzések

- kényelem

- Megfelelő

- terjed

- teremt

- Jelenlegi

- görbe

- szokás

- dátum

- adatkészletek

- mélyebb

- alapértelmezett

- függ

- telepíteni

- bevezetéséhez

- bevetés

- mélység

- leírt

- leírás

- részletek

- Fejleszt

- Eszközök

- különböző

- megvitatni

- megosztott

- számos

- Nem

- Herceg

- herceg egyetem

- alatt

- minden

- Korábban

- Korai

- könnyebb

- hatékony

- bármelyik

- megszüntetése

- lehetővé

- ösztönzése

- ösztönözni

- végtől végig

- Endpoint

- Környezet

- korszak

- korszakok

- hiba

- értékelni

- értékelték

- értékelés

- példa

- példák

- Kivéve

- feltárása

- Feltárása

- kifejezések

- kivonat

- tényezők

- igazságos

- kedvez

- Funkció

- Jellemzők

- Fields

- Ábra

- Végül

- Találjon

- vezetéknév

- szerelvény

- következő

- Korábbi

- ból ből

- Határ

- Frontiers

- teljesen

- funkciók

- jövő

- Futures

- generál

- kap

- adott

- Globális

- jó

- GPU

- GPU

- nagy

- nagyobb

- Zöld

- megtörténik

- súlyosan

- segít

- segít

- magas szinten

- jó minőségű

- <p></p>

- Hogyan

- How To

- HTML

- HTTPS

- Kerékagy

- Több száz

- Hiperparaméter hangolás

- Illinois

- kép

- Képosztályozás

- képek

- végre

- végrehajtás

- végre

- fontosság

- fontos

- javulás

- javuló

- in

- tartalmaz

- magában foglalja a

- Beleértve

- Növelje

- Növeli

- növekvő

- mutatók

- információ

- bemenet

- példa

- kamat

- érdekek

- Felület

- belső

- belső

- bevezet

- IT

- Munka

- Állások

- json

- Kulcs

- kulcsok

- Címke

- Címkék

- nagy

- nagyarányú

- nagyobb

- Késleltetés

- elindítja

- indítás

- réteg

- tojók

- vezető

- TANUL

- tanulás

- emelő

- fény

- LIMIT

- határértékek

- Lista

- listák

- betöltés

- Hosszú

- hosszabb

- le

- gép

- gépi tanulás

- Gyártás

- sok

- Maximize

- jelentőségteljes

- mérések

- Memory design

- metrikus

- Metrics

- ML

- Mobil

- mobil eszközök

- modell

- modellek

- Modulok

- több

- többszörös

- név

- nevek

- elengedhetetlen

- igények

- hálózatok

- Új

- jegyzetfüzet

- szám

- Nvidia

- tárgy

- objektumok

- megfigyelni

- szerez

- kapott

- ONE

- üzemeltetési

- Művelet

- optimalizált

- vázolt

- saját

- papírok

- paraméter

- paraméterek

- különös

- Türelem

- Teljesít

- teljesítmény

- Előadja

- Plató

- Platón adatintelligencia

- PlatoData

- pont

- pont

- Népszerű

- lehetséges

- állás

- potenciálisan

- pr

- megakadályozása

- Előzetes

- Probléma

- problémák

- folyamat

- Folyamatok

- ad

- feltéve,

- biztosít

- amely

- közzétett

- Piton

- kérdés

- Kérdések

- gyorsan

- RAM

- Arány

- Az árak

- való Világ

- miatt

- csökkentő

- szabályos

- viszonylag

- eltávolítása

- Számolt

- képvisel

- képviselők

- jelentése

- kérni

- kötelező

- követelmények

- megköveteli,

- kutatás

- kutató

- Felbontás

- forrás

- Tudástár

- válasz

- Eredmények

- futás

- futás

- sagemaker

- azonos

- skálázható

- Tudós

- szkriptek

- sdk

- Keresés

- Rész

- kiválasztott

- kiválasztása

- kiválasztás

- idősebb

- Series of

- szolgáltatás

- ülés

- készlet

- Szettek

- beállítás

- számos

- Alak

- kellene

- Műsorok

- Hasonlóképpen

- egyszerűsítése

- egyetlen

- SIX

- Méret

- méretek

- kicsi

- kisebb

- So

- megoldások

- Megoldások

- SOLVE

- leírás

- specifikációk

- meghatározott

- standard

- kezdődött

- statisztikai

- Lépés

- megállt

- megállítás

- memorizált

- Tanulmány

- későbbi

- ilyen

- elegendő

- megfelelő

- táblázat

- célzott

- Feladat

- feladatok

- csapat

- tensorflow

- teszt

- A

- azok

- ezáltal

- három

- áteresztőképesség

- idő

- Idősorok

- alkalommal

- nak nek

- Ma

- együtt

- szerszámok

- felső

- top 5

- Végösszeg

- Vonat

- kiképzett

- Képzések

- átruházás

- transzformerek

- igaz

- típusok

- Végül

- alatt

- egyedi

- egyetemi

- Használat

- használ

- hasznosít

- hasznosított

- érvényesítés

- Értékek

- fajta

- Hatalmas

- keresztül

- Megnézem

- látomás

- ami

- míg

- egész

- széles

- lesz

- belül

- nélkül

- lenne

- írás

- te

- A te

- zephyrnet