Az azonnali tervezés elengedhetetlen készségévé vált mindenki számára, aki nagy nyelvi modellekkel (LLM) dolgozik, hogy kiváló minőségű és releváns szövegeket állítson elő. Bár a szöveges promptok tervezését széles körben vitatták meg, a vizuális felszólítás tervezése egy feltörekvő terület, amely figyelmet igényel. A vizuális üzenetek tartalmazhatnak határolókereteket vagy maszkokat, amelyek a látásmodelleket irányítják a releváns és pontos kimenetek generálásához. Ebben a bejegyzésben megvizsgáljuk a vizuális azonnali tervezés alapjait, előnyeit, és azt, hogyan használható fel egy konkrét használati eset megoldására: képszegmentálás az autonóm vezetéshez.

Az elmúlt években a számítógépes látás területén jelentős előrelépések történtek a képszegmentálás területén. Az egyik ilyen áttörés a Bármilyen modell szegmentálása (SAM) a Meta AI, amely képes forradalmasítani az objektum szintű szegmentálást nulla vagy néhány felvételes képzéssel. Ebben a bejegyzésben a SAM-modellt használjuk példakénti látásmodellként, és megvizsgáljuk annak alkalmazását a BDD100K adatkészlet, egy változatos autonóm vezetési adatkészlet a heterogén multitask tanuláshoz. A SAM erősségeit a BDD100K által biztosított gazdag adatokkal kombinálva bemutatjuk a vizuális azonnali tervezésben rejlő lehetőségeket a SAM különböző verzióival. Ihlette a LangChain A nyelvi modellek keretrendszerében egy vizuális láncot javasolunk vizuális felszólítások végrehajtására az objektumészlelési modellek és a SAM kombinálásával.

Bár ez a bejegyzés az autonóm vezetésre összpontosít, a tárgyalt fogalmak széles körben alkalmazhatók olyan területeken, amelyek gazdag látásalapú alkalmazásokkal rendelkeznek, mint például az egészségügy és az élettudományok, valamint a média és a szórakoztatás. Kezdjük azzal, hogy tudjunk meg egy kicsit többet arról, hogy mi rejlik az olyan alapvető látásmódmodellben, mint a SAM. Használtuk Amazon SageMaker Studio egy ml.g5.16xlarge példányon ehhez a bejegyzéshez.

Bármilyen modell szegmentálása (SAM)

Az alapmodellek nagyméretű gépi tanulási (ML) modellek, amelyek hatalmas mennyiségű adatra vannak kiképezve, és feladat-specifikus felhasználási esetekre kérhetők vagy finomhangolhatók. Itt megvizsgáljuk a Segment Anything Model (SAM) modellt, amely a látás, különösen a képszegmentálás alapmodellje. Előképzett egy 11 millió képből és 1.1 milliárd maszkból álló hatalmas adatkészletre, így ez a legnagyobb szegmentációs adatkészlet az írás pillanatában. Ez a kiterjedt adatkészlet az objektumok és kategóriák széles skáláját fedi le, és sokrétű és nagyszabású képzési adatforrást biztosít a SAM számára.

A SAM-modell az objektumok megértésére lett kiképezve, és képes szegmentációs maszkokat kiadni bármely objektumhoz a képekben vagy a videokockákban. A modell lehetővé teszi a vizuális azonnali tervezést, lehetővé téve olyan bemenetek megadását, mint például szöveg, pontok, határolókeretek vagy maszkok a címkék létrehozásához az eredeti kép megváltoztatása nélkül. A SAM három méretben kapható: alap (ViT-B, 91 millió paraméter), nagy (ViT-L, 308 millió paraméter) és hatalmas (ViT-H, 636 millió paraméter), különböző számítási követelményeknek és felhasználási eseteknek megfelelően.

A SAM mögött meghúzódó elsődleges motiváció az objektumszintű szegmentálás javítása minimális betanítási mintákkal és korszakokkal bármilyen érdekes objektumhoz. A SAM ereje abban rejlik, hogy képes alkalmazkodni az új képeloszlásokhoz és feladatokhoz előzetes ismeretek nélkül, ezt a funkciót ún zéró felvétel átvitel. Ezt az alkalmazkodóképességet a kiterjedt SA-1B adatkészleten való betanítás révén éri el, amely lenyűgöző nullapontos teljesítményt mutatott, felülmúlva sok korábbi, teljesen felügyelt eredményt.

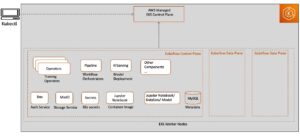

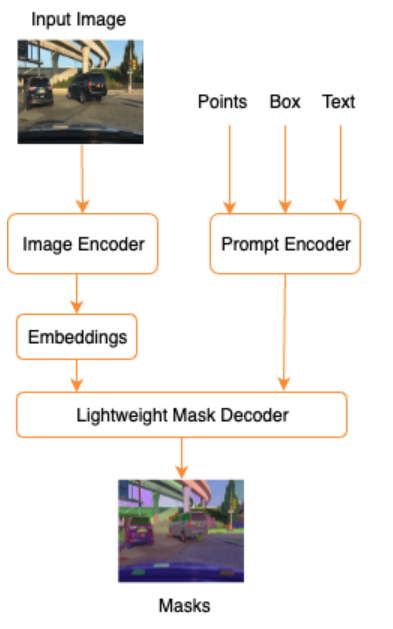

Amint az a SAM következő architektúrájában látható, a szegmentációs maszkok létrehozásának folyamata három lépésből áll:

- A képkódoló egyszeri beágyazást hoz létre a képhez.

- A prompt kódoló bármely promptot a prompt beágyazási vektorává alakít.

- A könnyű dekóder egyesíti a képkódolóból és a prompt kódolóból származó információkat a szegmentációs maszkok előrejelzéséhez.

Példaként megadhatunk egy bemenetet egy képpel és határolókerettel az adott képen egy érdekes objektum körül (pl. ezüst autó vagy forgalmi sáv), és a SAM modell szegmentációs maszkokat állít elő az adott objektumhoz.

Vizuális azonnali tervezés

Az azonnali tervezés a bemenetek olyan modellhez való strukturálására utal, amely megérti a modellt a szándékkal, és a kívánt eredményt hozza létre. A szöveges prompt tervezéssel a kívánt kimenet elérése érdekében a bemeneti szöveget olyan módosításokkal strukturálhatja, mint a szavak kiválasztása, formázása, sorrendje stb. A vizuális prompt tervezés feltételezi, hogy a felhasználó vizuális módban dolgozik (kép vagy videó), és bemeneteket biztosít. Az alábbiakban felsoroljuk azokat a lehetséges módokat, amelyek a vizuális tartományban a generatív AI-modellhez inputot adhatnak:

- Pont – szinguláris (x, y) koordinátapont a képsíkban

- Pontok – Több (x, y) koordinátapont, amelyek nem feltétlenül kapcsolódnak egymáshoz

- Határolókeret – Négy érték halmaza (x, y, w, h), amelyek egy téglalap alakú területet határoznak meg a képsíkban

- Kontúr – (x, y) koordinátapontok halmaza a képsíkban, amelyek zárt alakzatot alkotnak

- Maszk – A képpel megegyező méretű tömb, amely az érdeklődési tárgy részleges maszkját tartalmazza

A vizuális azonnali tervezési technikákat szem előtt tartva vizsgáljuk meg, hogyan alkalmazható ez a SAM előre betanított modelljére. Az előre betanított modell alapváltozatát használjuk.

Zero-shot felszólítás az előre betanított SAM modellel

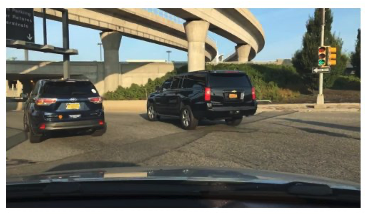

Kezdésként vizsgáljuk meg a nullapontos megközelítést. Az alábbi mintakép látható az edzési adatkészletből, amelyet egy jármű elülső kamerájából vettünk.

A képből minden objektumhoz kaphatunk szegmentációs maszkot, kifejezett vizuális felszólítás nélkül automatikusan generál maszkokat csak egy bemeneti képpel. A következő képen az autó részeit látjuk, az út, a közlekedési tábla, a rendszámok, a felüljáró, az oszlopok, a táblák és egyebek szegmentálva vannak.

Ez a kimenet azonban nem azonnal hasznos a következő okok miatt:

- Az autók nem egy egészben vannak szegmentálva, hanem részenként. A legtöbb észlelési modell esetében például nem igazán törődünk azzal, hogy minden abroncsnak külön kimeneti maszkja legyen. Ez akkor is igaz, ha más ismert érdekes objektumokat keresünk, mint például út, növényzet, táblák stb.

- A kép azon részei, amelyek hasznosak az alsóbb szintű feladatokhoz, például a vezethető területhez, magyarázat nélkül fel vannak osztva. Másrészt a hasonló példányokat külön azonosítjuk, és érdekelhet bennünket a hasonló objektumok csoportosítása (panoptikus vs. példányszegmentálás).

Vizuális azonnali tervezés az előre betanított SAM modellel

Szerencsére a SAM támogatja a beviteli promptok biztosítását, és bemenetként használhatunk pontokat, ponttömböket és határolódobozokat. Ezekkel a konkrét utasításokkal azt várjuk, hogy a SAM jobban teljesít a meghatározott pontokra vagy területekre összpontosító szegmentálásoknál. Ez összehasonlítható a nyelvi prompt sablonnal"What is a good name for a company that makes {product}?"

ahol a bemenet ezzel a prompt sablonnal együtt a felhasználótól a {product}. {product} egy bemeneti nyílás. A vizuális felszólításban a határoló dobozok, pontok vagy maszkok a beviteli helyek.

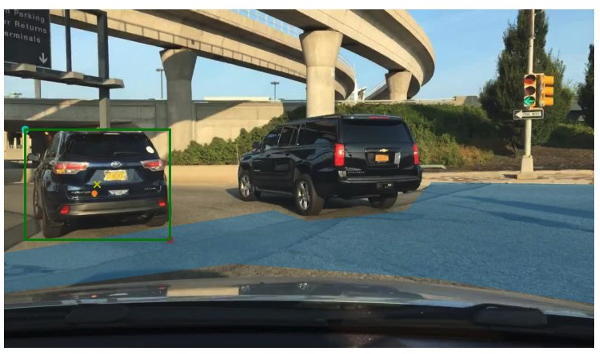

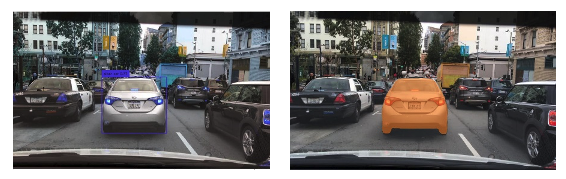

A következő képen látható az eredeti alapigazság-határoló doboz a járművek körül, valamint a BDD100K alapigazság-adatokból származó vezethető terület foltja. A képen egy bemeneti pont (sárga X) is látható a zöld határolókeret közepén, amelyre a következő néhány részben hivatkozni fogunk.

Próbáljunk meg egy maszkot generálni a bal oldali autóhoz a zöld határolókerettel a SAM bemeneteként. Amint az a következő példában látható, a SAM alapmodellje nem igazán talál semmit. Ez látszik az alacsony szegmentációs pontszámon is. Ha közelebbről megvizsgáljuk a szegmentációs maszkokat, azt látjuk, hogy vannak olyan kis régiók, amelyek maszkként vannak visszaadva (a piros nyilak segítségével), amelyek nem igazán használhatók semmilyen downstream alkalmazáshoz.

Próbáljuk meg egy határolókeret és egy pont kombinációját bemeneti vizuális promptként. Az előző képen látható sárga kereszt a határolókeret közepe. Ennek a pontnak (x,y) koordinátáinak megadása promptként a határolókeret-kényszer mellett a következő maszkot és valamivel magasabb pontszámot kapjuk. Ez továbbra sem használható semmilyen módon.

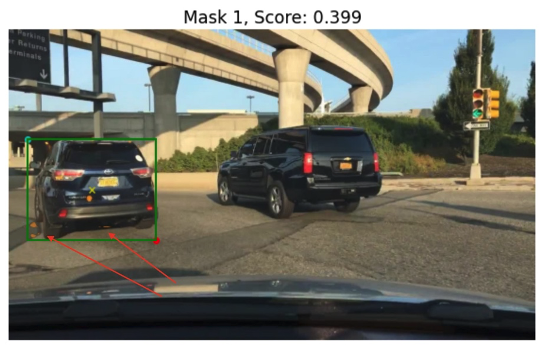

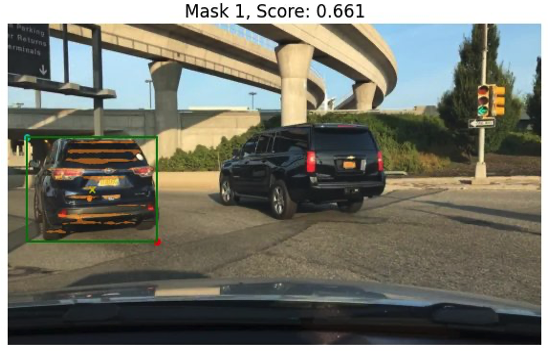

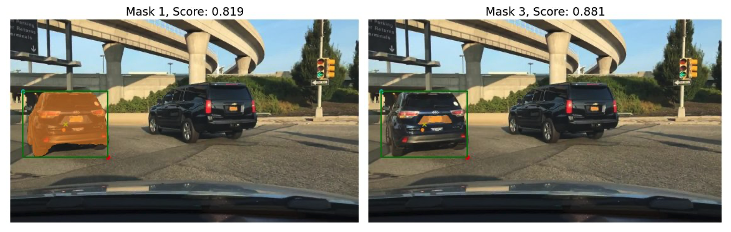

Végül az alap előre betanított modellel csak a bemeneti pontot tudjuk megadni promptként (határoló doboz nélkül). A következő képek az általunk érdekesnek tartott három legnépszerűbb maszk közül kettőt mutatnak be.

Az 1. maszk szegmentálja a teljes autót, míg a 3. maszk egy területet, amely az autó rendszámtábláját tartja a sárga kereszt közelében (beviteli prompt). Az 1. maszk még mindig nem feszes, tiszta maszk az autó körül; ez a modell minőségére utal, amely feltételezhető, hogy a modell méretével nő.

Kipróbálhatjuk a nagyobb, előre betanított modelleket ugyanazzal a beviteli prompttal. Az alábbi képeken az eredményeink láthatók. A hatalmas SAM előképzett modell használatakor a Mask 3 a teljes autó, míg az 1. és 2. maszk a rendszám kiemelésére használható.

A SAM modell nagy változata is hasonló kimeneteket biztosít.

Az itt végigvitt folyamat hasonló a szöveges promptok kézi szerkesztéséhez, amelyet már ismerhet. Ne feledje, hogy a SAM-modellben a közelmúltban végzett fejlesztés, hogy bármit jó minőségben szegmentáljon, sokkal jobb objektum- és kontextus-specifikus kimeneteket biztosít. A mi esetünkben azt tapasztaljuk, hogy a szöveges és vizuális felszólításokkal (point, box, point and box bevitel) végzett nullapontos felszólítás nem javítja drasztikusan az eredményeket, amint azt fentebb láttuk.

Prompt sablonok és vizuális láncok

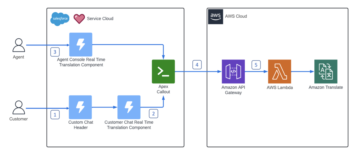

Amint az előző nullás példákból láthatjuk, a SAM nehezen azonosítja a jelenetben lévő összes objektumot. Ez egy jó példa arra, hogy hol tudjuk kihasználni a prompt sablonokat és vizuális láncokat. A vizuális láncot a nyelvi alkalmazások népszerű LangChain keretrendszerében található lánc koncepció ihlette. Segít láncolni az adatforrásokat és egy LLM-et a kimenet előállításához. Például egy API-lánc segítségével meghívhatunk egy API-t, és meghívhatunk egy LLM-et a kérdés megválaszolásához az API-válasz alapján.

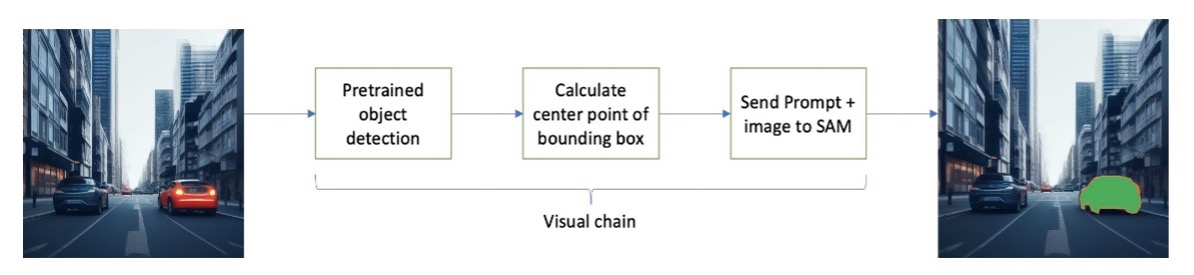

A LangChain ihlette szekvenciális vizuális láncot javasolunk, amely az alábbi ábrához hasonlóan néz ki. Eszközt használunk (például egy előre betanított objektumészlelési modellt), hogy megkapjuk a kezdeti határolókereteket, kiszámítsuk a határolókeret közepén lévő pontot, és ezzel a bemeneti képpel kérjük a SAM-modellt.

A következő kép például a lánc futtatásának eredményeként megjelenő szegmentációs maszkokat mutatja.

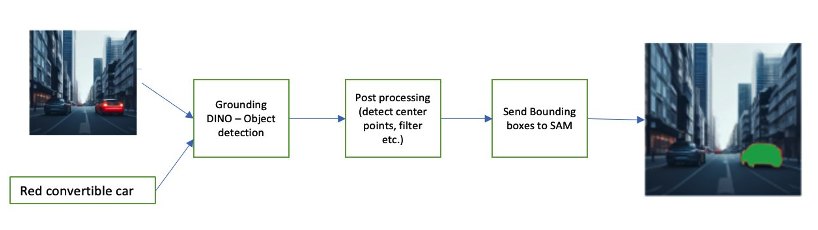

Egy másik példalánc tartalmazhatja a felhasználó által azonosítani kívánt objektum szövegbevitelét. Ennek megvalósítására csővezetéket építettünk a segítségével DINO földelés, egy objektumészlelési modell, amely felszólítja a SAM-ot a szegmentálásra.

Földelés A DINO egy nulla lövésű tárgyészlelési modell, amely képes objektumészlelést végrehajtani kategórianeveket (például „közlekedési lámpák” vagy „teherautó”) és kifejezéseket (például „sárga teherautó”) tartalmazó szöveggel. Szöveg és kép párokat fogad el az objektumészlelés végrehajtásához. Transzformátor-architektúrán alapul, és lehetővé teszi a szöveges és képi adatokkal való keresztezést. Ha többet szeretne megtudni a DINO földeléséről, lásd: DINO földelése: A DINO összeházasítása földelt előképzéssel a nyílt készletű objektumészleléshez. Ez határolókereteket és címkéket generál, és tovább feldolgozható középpontok generálásához, címkék, küszöbértékek és egyebek alapján történő szűréshez. Ezt használják (dobozok vagy pontok) a SAM felszólítására a szegmentáláshoz, amely maszkokat ad ki.

Az alábbiakban néhány példa mutat be a bemeneti szöveget, a DINO kimenetet (határoló dobozok) és a végső SAM kimenetet (szegmentációs maszkok).

A következő képek a „sárga teherautó” kimenetét mutatják.

A következő képek az „ezüst autó” kimenetét mutatják.

A következő kép a „vezetési sáv” kimenetét mutatja.

Ezt a folyamatot használhatjuk vizuális lánc felépítésére. A következő kódrészlet magyarázza ezt a fogalmat:

pipeline = [object_predictor, segment_predictor]

image_chain = ImageChain.from_visual_pipeline(pipeline, image_store, verbose=True)

image_chain.run('All silver cars', image_id='5X3349')Noha ez egy egyszerű példa, ez a koncepció kiterjeszthető a járművek kameráiból származó adatfolyamok feldolgozására, hogy objektumkövetést, személyazonosításra alkalmas információk (PII) adatszerkesztést végezzenek, és még sok minden mást. A határolódobozokat kisebb modellekből is beszerezhetjük, vagy bizonyos esetekben szabványos számítógépes látáseszközökkel. Meglehetősen egyszerű egy előre betanított modell vagy egy olyan szolgáltatás, mint az Amazon Rekognition használata, hogy kezdeti (vizuális) címkéket kapjon a felszólításhoz. Ennek írásakor több mint 70 modell érhető el az Amazon SageMaker Jumpstartban objektumészlelésre, és Amazon felismerés már számos hasznos tárgykategóriát azonosít a képeken, beleértve az autókat, a gyalogosokat és más járműveket.

Ezután megvizsgálunk néhány kvantitatív eredményt a SAM-modellek teljesítményével kapcsolatban a BDD100K adatok egy részhalmazával.

Kvantitatív eredmények

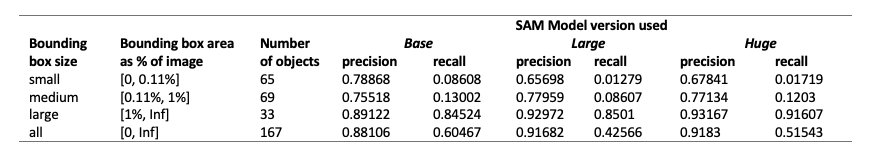

Célunk három előre betanított modell teljesítményének összehasonlítása, ha ugyanazt a vizuális felszólítást kapjuk. Ebben az esetben az objektum helyének középpontját használjuk vizuális bemenetként. Összehasonlítjuk a teljesítményt az objektumméretek tekintetében (a képméret arányában) – kicsi (terület <0.11%), közepes (0.11% < terület < 1%) és nagy (terület > 1%). A határolókeret-terület küszöbértékeit a Common Objects in Context (COCO) határozza meg. értékelési mérőszámok [Lin et al., 2014].

Az értékelés pixel szinten történik, és a következő értékelési mérőszámokat használjuk:

- Pontosság = (releváns és lekért példányok száma) / (lekért példányok teljes száma)

- Visszahívás = (releváns példányok száma és lekérése) / (releváns példányok száma összesen)

- A példányok itt minden pixel a tárgy határoló dobozán belül

A következő táblázat a SAM-modell három különböző verziójának (alap, nagy és hatalmas) teljesítményét mutatja be. Ezek a verziók három különböző kódolóval rendelkeznek: ViT-B (alap), ViT-L (nagy), ViT-H (hatalmas). A kódolók eltérő paraméterszámmal rendelkeznek, ahol az alapmodell kevesebb paraméterrel rendelkezik, mint a nagy, a nagy pedig kisebb, mint a hatalmas. Bár a paraméterek számának növelése jobb teljesítményt mutat nagyobb objektumok esetén, ez nem így van a kisebb objektumok esetében.

A SAM finomhangolása az Ön használati esetéhez

Sok esetben az előre betanított SAM-modell közvetlen használata nem feltétlenül hasznos. Nézzünk például egy tipikus forgalmi jelenetet – a következő kép a SAM-modell kimenetét mutatja be, bal oldalon véletlenszerűen mintavételezett promptpontokkal, jobb oldalon pedig a BDD100K szemantikai szegmentálási feladatának tényleges címkéit. Ezek nyilvánvalóan nagyon különbözőek.

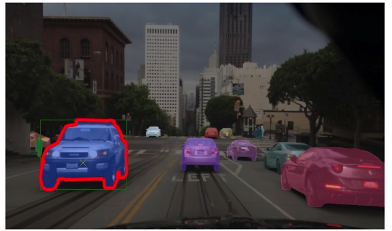

Az AV-k észlelési veremei könnyen használhatják a második képet, de az elsőt nem. Másrészt van néhány hasznos kimenet az első képből, amelyeket fel lehet használni, és hogy a modellt nem kifejezetten képezték, például a sávjelölések, a járdaszegmentálás, a rendszámtábla maszkok stb. Finomhangolhatjuk a SAM modellt a szegmentálási eredmények javítása érdekében. A finomhangolás végrehajtásához létrehoztunk egy képzési adatkészletet a BDD500K adatkészletből származó példányszegmentációs részhalmaz (10 kép) felhasználásával. Ez a képek nagyon kicsi részhalmaza, de a célunk annak bizonyítása, hogy az alapvető látásmodellek (hasonlóan az LLM-ekhez) meglepően kis számú képpel is jól teljesítenek az Ön használati esetére. A következő képen látható a bemeneti kép, a kimeneti maszk (kék színben, az autó piros szegéllyel a bal oldalon) és a lehetséges promptok (zöld a határolókeret és sárga az X középpont).

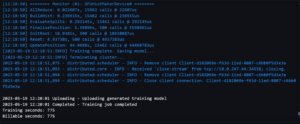

A finomhangolást a Hugging Face könyvtár segítségével végeztük el Amazon SageMaker Studio. A SAM alapmodell-tesztekhez az ml.g4dn.xlarge példányt, a SAM hatalmas modelltesztekhez pedig az ml.g4dn.2xlarge példányt használtuk. Kezdeti kísérleteink során azt tapasztaltuk, hogy az alapmodell finomhangolása csak határoló dobozokkal nem volt sikeres. A finomhangolt és előre betanított modellek nem tudták megtanulni az autóspecifikus alapigazság-maszkokat az eredeti adatkészletekből. A lekérdezési pontok hozzáadása a finomhangoláshoz szintén nem javította a képzést.

Ezután megpróbálhatjuk a SAM hatalmas modelljének finomhangolását 30 korszakra, nagyon kis adatkészlettel (500 kép). Az eredeti földi igazság maszk a következő képen néz ki a címke típusú autóhoz.

Amint az a következő képeken is látható, a hatalmas modell eredeti, előre betanított változata speciális határolókeret-prompttal (zöld színben) nem ad kimenetet, míg a finomhangolt változat ad kimenetet (még mindig nem pontos, de a finomhangolás megtörtént 40 korszak után, és egy nagyon kis, 500 képből álló képzési adatkészlettel). Az eredeti, előre kiképzett hatalmas modell nem volt képes megjósolni a maszkokat az általunk tesztelt képek egyikéhez sem. Példaként lefelé irányuló alkalmazásként a finomhangolt modell felhasználható olyan előcímkézési munkafolyamatokban, mint például a Automatikus címkézési modul az AWS-en futó, mély tanuláson alapuló fejlett vezetőtámogató rendszerekhez.

Következtetés

Ebben a bejegyzésben a Segment Anything Model (SAM) néven ismert alapvető jövőkép-modellt és annak architektúráját tárgyaltuk. A SAM modellt használtuk a vizuális felszólítás és a vizuális felszólítás mérnöki bemeneteinek megvitatására. Megvizsgáltuk, hogyan teljesítenek a különböző vizuális felszólítások, és milyen korlátai vannak. Azt is leírtuk, hogy a vizuális láncok hogyan növelik a teljesítményt egyetlen prompt használatával, hasonlóan a LangChain API-hoz. Ezt követően három előre betanított modell mennyiségi értékelését adtuk meg. Végül megvitattuk a finomhangolt SAM modellt és annak eredményeit az eredeti alapmodellhez képest. Az alapmodellek finomhangolása javítja a modell teljesítményét bizonyos feladatokhoz, például a szegmentáláshoz. Meg kell jegyezni, hogy a SAM-modell erőforrásigényei miatt jelenlegi állapotában korlátozza a valós idejű használati esetek használatát és a széleken történő következtetést. Reméljük, hogy a jövőbeli iterációk és továbbfejlesztett technikák csökkentik a számítási követelményeket és javítják a várakozási időt.

Reméljük, hogy ez a bejegyzés arra ösztönzi Önt, hogy fedezze fel a használati esetekre vonatkozó vizuális felszólításokat. Mivel ez még mindig az azonnali tervezés feltörekvő formája, sok felfedeznivaló van a vizuális felszólítások, vizuális láncok és ezen eszközök teljesítménye tekintetében. Amazon SageMaker egy teljesen felügyelt ML platform, amely lehetővé teszi az építők számára, hogy nagy nyelvi és vizuális modelleket fedezzenek fel, és generatív AI-alkalmazásokat készítsenek. Kezdje el építeni a jövőt az AWS segítségével még ma.

A szerzőkről

Gopi Krishnamurthy a New York-i székhelyű Amazon Web Services vezető AI/ML megoldások építésze. Megbízható tanácsadóként dolgozik nagy Automotive-ügyfelekkel, hogy átalakítsák gépi tanulási munkaterhelésüket és áttérjenek a felhőbe. Fő érdeklődési köre a mély tanulás és a szerver nélküli technológiák. A munkán kívül szeret időt tölteni családjával és a zene széles skáláját felfedezni.

Gopi Krishnamurthy a New York-i székhelyű Amazon Web Services vezető AI/ML megoldások építésze. Megbízható tanácsadóként dolgozik nagy Automotive-ügyfelekkel, hogy átalakítsák gépi tanulási munkaterhelésüket és áttérjenek a felhőbe. Fő érdeklődési köre a mély tanulás és a szerver nélküli technológiák. A munkán kívül szeret időt tölteni családjával és a zene széles skáláját felfedezni.

Shreyas Subramanian vezető AI/ML-specialista megoldástervező, és a Machine Learning segítségével segíti ügyfeleit üzleti kihívásaik megoldásában az AWS platform használatával. Shreyas nagyszabású optimalizálási és gépi tanulási háttérrel rendelkezik, valamint a Machine Learning és az Inforcement Learning használatában az optimalizálási feladatok felgyorsítására szolgál.

Shreyas Subramanian vezető AI/ML-specialista megoldástervező, és a Machine Learning segítségével segíti ügyfeleit üzleti kihívásaik megoldásában az AWS platform használatával. Shreyas nagyszabású optimalizálási és gépi tanulási háttérrel rendelkezik, valamint a Machine Learning és az Inforcement Learning használatában az optimalizálási feladatok felgyorsítására szolgál.

Sujitha Martin a Generatív AI Innovációs Központ (GAIIC) alkalmazott tudósa. Szakértelme a számítógépes látást és a természetes nyelvi feldolgozást magában foglaló gépi tanulási megoldások kidolgozásában áll különböző iparági területek számára. Különösen nagy tapasztalattal rendelkezik az emberközpontú helyzetfelismerés és a tudással átitatott tanulás terén a rendkívül autonóm rendszerek számára.

Sujitha Martin a Generatív AI Innovációs Központ (GAIIC) alkalmazott tudósa. Szakértelme a számítógépes látást és a természetes nyelvi feldolgozást magában foglaló gépi tanulási megoldások kidolgozásában áll különböző iparági területek számára. Különösen nagy tapasztalattal rendelkezik az emberközpontú helyzetfelismerés és a tudással átitatott tanulás terén a rendkívül autonóm rendszerek számára.

Francisco Calderon a Generatív AI Innovációs Központ (GAIIC) adatkutatója. A GAIIC tagjaként segít felfedezni a lehetséges művészetet az AWS-ügyfelekkel a Generative AI technológiák segítségével. Szabadidejében Francisco szeret zenélni és gitározni, focizni a lányaival, és a családjával tölti az idejét.

Francisco Calderon a Generatív AI Innovációs Központ (GAIIC) adatkutatója. A GAIIC tagjaként segít felfedezni a lehetséges művészetet az AWS-ügyfelekkel a Generative AI technológiák segítségével. Szabadidejében Francisco szeret zenélni és gitározni, focizni a lányaival, és a családjával tölti az idejét.

- SEO által támogatott tartalom és PR terjesztés. Erősödjön még ma.

- PlatoData.Network Vertical Generative Ai. Erősítse meg magát. Hozzáférés itt.

- PlatoAiStream. Web3 Intelligence. Felerősített tudás. Hozzáférés itt.

- PlatoESG. Carbon, CleanTech, Energia, Környezet, Nap, Hulladékgazdálkodás. Hozzáférés itt.

- PlatoHealth. Biotechnológiai és klinikai vizsgálatok intelligencia. Hozzáférés itt.

- Forrás: https://aws.amazon.com/blogs/machine-learning/foundational-vision-models-and-visual-prompt-engineering-for-autonomous-driving-applications/

- :van

- :is

- :nem

- :ahol

- $ UP

- 1

- 100

- 11

- 179

- 2014

- 214

- 225

- 30

- 40

- 500

- 7

- 70

- 804

- 91

- 97

- a

- képesség

- Képes

- Rólunk

- felett

- gyorsuló

- elfogadja

- pontos

- elért

- tényleges

- alkalmazkodni

- hozzáadásával

- fejlett

- fejlesztések

- Előny

- tanácsadó

- Után

- AI

- AI / ML

- AL

- Minden termék

- lehetővé teszi, hogy

- mentén

- már

- Is

- Bár

- amazon

- Amazon felismerés

- Amazon SageMaker

- Amazon SageMaker JumpStart

- Az Amazon Web Services

- an

- és a

- válasz

- bármilyen

- bárki

- bármi

- api

- alkalmazható

- Alkalmazás

- alkalmazások

- alkalmazott

- megközelítés

- építészet

- VANNAK

- TERÜLET

- területek

- körül

- Sor

- Művészet

- AS

- Támogatás

- feltételezni

- feltételezi

- At

- figyelem

- autóipari

- autonóm

- elérhető

- tudatosság

- AWS

- háttér

- bázis

- alapján

- Alapjai

- BE

- mert

- válik

- óta

- kezdődik

- mögött

- Előnyök

- Jobb

- Billió

- Kék

- határ

- Doboz

- dobozok

- áttörés

- nagyjából

- épít

- építők

- Épület

- épült

- üzleti

- de

- by

- számít

- hívás

- szoba

- kamerák

- TUD

- Kaphat

- autó

- ami

- autók

- eset

- esetek

- kategóriák

- Kategória

- ellátás

- Központ

- lánc

- láncok

- kihívások

- választás

- Város

- ragadozó ölyv

- közel

- zárt

- szorosan

- felhő

- kókuszdió

- kód

- kombináció

- kombájnok

- kombinálása

- Közös

- vállalat

- összehasonlítani

- képest

- számítási

- Kiszámít

- számítógép

- Számítógépes látás

- koncepció

- fogalmak

- kontextus

- koordináta

- Mag

- Covers

- készítette

- Kereszt

- Jelenlegi

- Jelenlegi állapot

- Ügyfelek

- vágás

- dátum

- adattudós

- adatkészletek

- mély

- mély tanulás

- meghatározott

- meghatározott

- igazolták

- leírt

- kívánatos

- Érzékelés

- különböző

- dino

- közvetlenül

- felfedez

- megvitatni

- tárgyalt

- disztribúció

- számos

- do

- Nem

- domain

- domainek

- ne

- drasztikusan

- gépkocsivezető

- vezetés

- két

- e

- E&T

- minden

- könnyen

- él

- beágyazás

- csiszolókő

- lehetővé teszi

- lehetővé téve

- ösztönzi

- Mérnöki

- Szórakozás

- Egész

- korszakok

- alapvető

- értékelés

- példa

- példák

- kiterjedt

- vár

- tapasztalat

- kísérletek

- szakvélemény

- Elmagyarázza

- magyarázat

- kifejezetten

- feltárása

- feltárt

- kifejezések

- kiterjedt

- Átfogó tapasztalat

- kivonat

- Arc

- meglehetősen

- ismerős

- család

- Funkció

- kevés

- mező

- Ábra

- szűrő

- utolsó

- Találjon

- vezetéknév

- koncentrál

- összpontosítás

- következő

- A

- forma

- Alapítvány

- alapítványi

- négy

- Keretrendszer

- Francisco

- ból ből

- front

- Tele

- teljesen

- további

- jövő

- generál

- generál

- generáló

- nemző

- Generatív AI

- kap

- adott

- ad

- jó

- Zöld

- Földi

- útmutató

- kéz

- Legyen

- tekintettel

- he

- egészségügyi

- segít

- neki

- itt

- Magas

- jó minőségű

- <p></p>

- nagyon

- övé

- tart

- motorháztető

- remény

- Hogyan

- HTML

- HTTPS

- hatalmas

- azonosított

- azonosítja

- azonosítani

- azonosító

- kép

- képek

- azonnal

- végre

- hatásos

- javul

- javított

- javulás

- in

- tartalmaz

- Beleértve

- Növelje

- Növeli

- növekvő

- ipar

- információ

- infúzióban

- kezdetben

- Innováció

- bemenet

- bemenet

- inspirálta

- példa

- Példányszegmentálás

- utasítás

- A szándék

- kamat

- érdekelt

- érdekes

- érdekek

- bele

- vonja

- bevonásával

- IT

- iterációk

- ITS

- jpg

- éppen

- csak egy

- tudás

- ismert

- Címke

- Címkék

- Ösvény

- nyelv

- nagy

- nagyarányú

- nagyobb

- legnagyobb

- végül

- Késleltetés

- TANUL

- tanulás

- balra

- kevesebb

- szint

- könyvtár

- Engedély

- fekszik

- élet

- Life Sciences

- könnyűsúlyú

- mint

- Kedvencek

- korlátozások

- határértékek

- lin

- Lista

- kis

- LLM

- elhelyezkedés

- néz

- keres

- MEGJELENÉS

- Elő/Utó

- gép

- gépi tanulás

- KÉSZÍT

- Gyártás

- sikerült

- kézikönyv

- sok

- házasságkötés

- maszk

- maszkok

- tömeges

- Lehet..

- eszközök

- Média

- közepes

- tag

- meta

- Metrics

- vándorol

- millió

- bánja

- minimális

- ML

- modell

- modellek

- Módosítások

- Modulok

- több

- a legtöbb

- Motiváció

- sok

- többszörös

- zene

- név

- nevek

- Természetes

- Természetes nyelvi feldolgozás

- szükségszerűen

- Új

- New York

- new york city

- következő

- nem

- neves

- szám

- tárgy

- Objektumfelismerés

- célkitűzés

- objektumok

- of

- kedvezmény

- on

- ONE

- optimalizálás

- or

- eredeti

- Más

- mi

- ki

- Eredmény

- teljesítmény

- kimenetek

- kívül

- felett

- párok

- paraméter

- paraméterek

- különös

- alkatrészek

- Tapasz

- észlelés

- Teljesít

- teljesítmény

- teljesített

- Személyesen

- kép

- pilléreket

- csővezeték

- pixel

- repülőgép

- emelvény

- Plató

- Platón adatintelligencia

- PlatoData

- játszani

- játék

- pont

- pont

- Népszerű

- lehetséges

- állás

- potenciális

- hatalom

- előre

- elsődleges

- Fő

- Előzetes

- folyamat

- Feldolgozott

- feldolgozás

- gyárt

- termel

- arány

- javasol

- Bizonyít

- ad

- feltéve,

- biztosít

- amely

- cél

- világítás

- mennyiségi

- mennyiség

- kérdés

- hatótávolság

- real-time

- tényleg

- miatt

- új

- Piros

- csökkenteni

- utal

- kifejezés

- vidék

- régiók

- összefüggő

- Jelentések

- követelmények

- megköveteli,

- forrás

- tisztelet

- válasz

- eredményez

- Eredmények

- forradalmasítani

- Gazdag

- jobb

- út

- futás

- sagemaker

- Sam

- azonos

- látta

- Skála

- színhely

- TUDOMÁNYOK

- Tudós

- pontszám

- Második

- szakaszok

- lát

- látott

- részes

- szegmentáció

- szegmensek

- idősebb

- különálló

- vagy szerver

- szolgáltatás

- Szolgáltatások

- készlet

- számos

- ő

- kellene

- előadás

- kirakat

- mutatott

- Műsorok

- <p></p>

- jelentős

- Jelek

- Ezüst

- hasonló

- Egyszerű

- egyedülálló

- Méret

- méretek

- jártasság

- rés

- nyílások

- kicsi

- kisebb

- töredék

- So

- Futball

- Megoldások

- SOLVE

- néhány

- forrás

- Források

- szakember

- különleges

- kifejezetten

- költ

- osztott

- Stacks

- standard

- kezdet

- Állami

- Lépései

- Még mindig

- egyértelmű

- erősségek

- struktúra

- strukturálása

- küzdelmek

- sikeres

- ilyen

- Támogatja

- kimagasló

- Systems

- táblázat

- Vesz

- meghozott

- Feladat

- feladatok

- technikák

- Technologies

- sablon

- sablonok

- feltételek

- kipróbált

- tesztek

- szöveg

- szövegi

- mint

- hogy

- A

- A terület

- Az alapok

- A jövő

- az információ

- azok

- Ott.

- Ezek

- ezt

- gondoltam

- három

- Keresztül

- idő

- gumiabroncsok

- nak nek

- Ma

- szerszám

- szerszámok

- felső

- Végösszeg

- Csomagkövetés

- forgalom

- kiképzett

- Képzések

- Átalakítás

- transzformátor

- teherautó

- igaz

- Megbízható

- igazság

- megpróbál

- kettő

- típus

- tipikus

- alatt

- megért

- us

- használható

- Használat

- használ

- használati eset

- felhasználási esetek

- használt

- használó

- segítségével

- Értékek

- különféle

- Hatalmas

- növényzet

- Járművek

- változat

- verzió

- függőlegesek

- nagyon

- videó

- látomás

- vizuális

- vs

- W

- volt

- módon

- we

- háló

- webes szolgáltatások

- JÓL

- ment

- voltak

- Mit

- Mi

- amikor

- mivel

- ami

- egész

- széles

- Széleskörű

- széles körben

- lesz

- val vel

- belül

- nélkül

- tanúi

- szavak

- Munka

- munkafolyamatok

- dolgozó

- művek

- lenne

- írás

- X

- év

- york

- te

- A te

- zephyrnet