A mai információs korban a számtalan dokumentumban tárolt hatalmas adatmennyiség egyszerre jelent kihívást és lehetőséget a vállalkozások számára. A hagyományos dokumentumfeldolgozási módszerek gyakran elmaradnak a hatékonyságban és a pontosságban, teret engedve az innovációnak, a költséghatékonyságnak és az optimalizálásnak. A dokumentumfeldolgozás az Intelligens Dokumentumfeldolgozás (IDP) megjelenésével jelentős fejlődésen ment keresztül. Az IDP segítségével a vállalkozások a különféle dokumentumtípusokból származó strukturálatlan adatokat strukturált, használható betekintést nyerhetnek, ami jelentősen növeli a hatékonyságot és csökkenti a manuális erőfeszítéseket. A potenciál azonban ezzel nem ér véget. A generatív mesterséges intelligencia (AI) integrálásával a folyamatba tovább fejleszthetjük az IDP képességeit. A generatív mesterséges intelligencia nemcsak továbbfejlesztett képességeket vezet be a dokumentumfeldolgozásban, hanem dinamikus alkalmazkodóképességet is kínál a változó adatmintákhoz. Ez a bejegyzés végigvezeti az IDP és a generatív mesterséges intelligencia szinergiáján, és bemutatja, hogyan jelentik a dokumentumfeldolgozás következő határát.

Az IDP-t részletesen tárgyaljuk Intelligens dokumentumfeldolgozás AWS AI szolgáltatásokkal című sorozatunkban (rész 1 és a rész 2). Ebben a bejegyzésben megvitatjuk, hogyan lehet kiterjeszteni egy új vagy meglévő IDP architektúrát nagy nyelvi modellekkel (LLM). Pontosabban megbeszéljük, hogyan tudunk integrálódni Amazon szöveg val vel LangChain dokumentumbetöltőként és Amazon alapkőzet adatok kinyerésére a dokumentumokból és generatív mesterséges intelligencia képességek használatára a különböző IDP fázisokon belül.

Az Amazon Textract egy gépi tanulási (ML) szolgáltatás, amely automatikusan kivonja a szöveget, a kézírást és az adatokat a beolvasott dokumentumokból. Az Amazon Bedrock egy teljesen felügyelt szolgáltatás, amely könnyen használható API-kon keresztül nagy teljesítményű alapozó modellek (FM-ek) választékát kínálja.

A következő diagram egy magas szintű referencia-architektúra, amely elmagyarázza, hogyan javíthatja tovább az IDP-munkafolyamatot alapmodellekkel. Az LLM-eket az IDP egy vagy összes fázisában használhatja, a használati esettől és a kívánt eredménytől függően.

A következő szakaszokban mélyen belemerülünk abba, hogy az Amazon Textract hogyan épül be a generatív mesterséges intelligencia munkafolyamataiba a LangChain segítségével az egyes feladatokhoz szükséges dokumentumok feldolgozásához. Az itt megadott kódblokkokat a rövidség kedvéért levágtuk. Lásd a mi GitHub tárház a részletes Python-jegyzetfüzetekért és a lépésenkénti áttekintésért.

A dokumentumokból a szövegek kinyerése kulcsfontosságú szempont a dokumentumok LLM-ekkel történő feldolgozása során. Az Amazon Textract segítségével strukturálatlan nyers szöveget vonhat ki a dokumentumokból, és megőrizheti az eredeti félig strukturált vagy strukturált objektumokat, például kulcs-érték párokat és a dokumentumban lévő táblázatokat. Az olyan dokumentumcsomagok, mint az egészségügyi és biztosítási igények vagy jelzáloghitelek, összetett űrlapokból állnak, amelyek sok információt tartalmaznak strukturált, félig strukturált és strukturálatlan formátumokban. A dokumentumok kinyerése itt fontos lépés, mivel az LLM-ek előnyben részesítik a gazdag tartalom előnyeit, így pontosabb és relevánsabb válaszokat generálnak, amelyek egyébként befolyásolhatják az LLM-ek kimenetének minőségét.

A LangChain egy hatékony nyílt forráskódú keretrendszer az LLM-ekkel való integrációhoz. Az LLM-ek általában sokoldalúak, de megküzdhetnek a tartományspecifikus feladatokkal, ahol mélyebb kontextusra és árnyalt válaszokra van szükség. A LangChain felhatalmazza a fejlesztőket ilyen forgatókönyvekben, hogy olyan ügynököket építsenek, amelyek az összetett feladatokat kisebb részfeladatokra bontják. Az alfeladatok ezután kontextust és memóriát vezethetnek be az LLM-ekbe az LLM promptok összekapcsolásával és láncolásával.

LangChain kínál dokumentumbetöltők amely képes adatokat betölteni és átalakítani dokumentumokból. Segítségükkel a dokumentumokat előnyben részesített formátumokba strukturálhatja, amelyeket az LLM-ek feldolgozhatnak. A AmazonTextractPDFLoader egy szolgáltatásbetöltő típusú dokumentumbetöltő, amely gyors módot biztosít a dokumentumfeldolgozás automatizálására az Amazon Textract és a LangChain kombináció használatával. További részletekért AmazonTextractPDFLoader, utal LangChain dokumentáció. Az Amazon Textract dokumentumbetöltő használatához először importálja azt a LangChain könyvtárból:

from langchain.document_loaders import AmazonTextractPDFLoaderhttps_loader = AmazonTextractPDFLoader("https://sample-website.com/sample-doc.pdf")

https_document = https_loader.load() s3_loader = AmazonTextractPDFLoader("s3://sample-bucket/sample-doc.pdf")

s3_document = s3_loader.load()A dokumentumokat az Amazon S3-ban is tárolhatja, és az s3:// URL-mintával hivatkozhat rájuk, ahogyan az itt olvasható Vödör elérése az S3:// használatával, és adja át ezt az S3 elérési utat az Amazon Textract PDF betöltőjének:

import boto3

textract_client = boto3.client('textract', region_name='us-east-2') file_path = "s3://amazon-textract-public-content/langchain/layout-parser-paper.pdf"

loader = AmazonTextractPDFLoader(file_path, client=textract_client)

documents = loader.load()Egy többoldalas dokumentum több oldalas szöveget tartalmaz, amely azután a dokumentumok objektumon keresztül érhető el, amely egy oldallista. A következő kód végigfut a dokumentumok objektum oldalain, és kinyomtatja a dokumentum szövegét, amely a következőn keresztül érhető el page_content tulajdonság:

print(len(documents)) for document in documents: print(document.page_content)Az Amazon Comprehend és az LLM-ek hatékonyan használhatók dokumentumok osztályozására. Az Amazon Comprehend egy természetes nyelvi feldolgozó (NLP) szolgáltatás, amely az ML-t használja a szövegből való betekintéshez. Az Amazon Comprehend támogatja az egyéni osztályozási modellek képzését is az olyan dokumentumok elrendezésével, mint a PDF, Word és képformátumok. Az Amazon Comprehend dokumentumosztályozó használatával kapcsolatos további információkért lásd: Az Amazon Comprehend dokumentumosztályozója elrendezési támogatást ad a nagyobb pontosság érdekében.

Az LLM-ekkel párosítva a dokumentumosztályozás hatékony módszerré válik nagy mennyiségű dokumentum kezeléséhez. Az LLM-ek hasznosak a dokumentumok osztályozásában, mert a természetes nyelv megértésével elemezhetik a dokumentum szövegét, mintáit és kontextuális elemeit. Finomhangolhatja őket bizonyos dokumentumosztályokhoz is. Amikor az IDP folyamatban bevezetett új dokumentumtípus osztályozásra szorul, az LLM képes szöveget feldolgozni, és osztályok alapján kategorizálni tudja a dokumentumot. A következő egy mintakód, amely az Amazon Textract által hajtott LangChain dokumentumbetöltőt használja a szöveg kinyerésére a dokumentumból, és a dokumentum osztályozására. Használjuk a Antropikus Claude v2 az Amazon Bedrock segítségével az osztályozás elvégzéséhez.

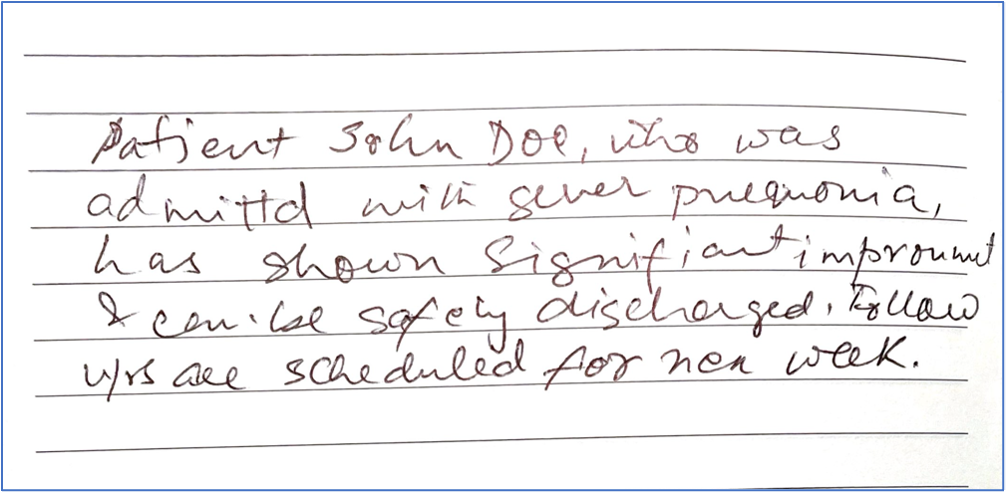

A következő példában először kivonunk egy szöveget a betegelbocsátási jelentésből, és egy LLM segítségével osztályozzuk azt egy három különböző dokumentumtípusból álló lista alapján:DISCHARGE_SUMMARY, RECEIPTés PRESCRIPTION. Az alábbi képernyőkép a jelentésünket mutatja.

from langchain.document_loaders import AmazonTextractPDFLoader

from langchain.llms import Bedrock

from langchain.prompts import PromptTemplate

from langchain.chains import LLMChain loader = AmazonTextractPDFLoader("./samples/document.png")

document = loader.load() template = """ Given a list of classes, classify the document into one of these classes. Skip any preamble text and just give the class name. <classes>DISCHARGE_SUMMARY, RECEIPT, PRESCRIPTION</classes>

<document>{doc_text}<document>

<classification>""" prompt = PromptTemplate(template=template, input_variables=["doc_text"])

bedrock_llm = Bedrock(client=bedrock, model_id="anthropic.claude-v2") llm_chain = LLMChain(prompt=prompt, llm=bedrock_llm)

class_name = llm_chain.run(document[0].page_content) print(f"The provided document is = {class_name}")

Az összegzés azt jelenti, hogy egy adott szöveget vagy dokumentumot rövidebb változatba tömörítenek, miközben megőrzik a legfontosabb információkat. Ez a technika előnyös a hatékony információ-visszakereséshez, amely lehetővé teszi a felhasználók számára, hogy gyorsan megértsék a dokumentum legfontosabb pontjait anélkül, hogy a teljes tartalmat elolvasnák. Bár az Amazon Textract közvetlenül nem végez szövegösszegzést, biztosítja az alapvető lehetőségeket a teljes szöveg kinyeréséhez a dokumentumokból. Ez a kivonatolt szöveg bemenetként szolgál az LLM modellünkhöz a szövegösszegzési feladatok végrehajtásához.

Ugyanazt a minta mentesítési jelentést használjuk AmazonTextractPDFLoader szöveg kinyeréséhez ebből a dokumentumból. A korábbiakhoz hasonlóan most is a Claude v2 modellt használjuk az Amazon Bedrock-on keresztül, és inicializáljuk egy prompttal, amely tartalmazza a szöveggel (jelen esetben az összefoglalás) vonatkozó utasításokat. Végül lefuttatjuk az LLM-láncot a dokumentumbetöltőből kivont szöveg átadásával. Ez lefuttat egy következtetési műveletet az LLM-en az összegzésre vonatkozó utasításokból és a dokumentum szövegéből, amelyet Document. Lásd a következő kódot:

A kód létrehozza a betegelbocsátási összefoglaló jelentés összefoglalóját:

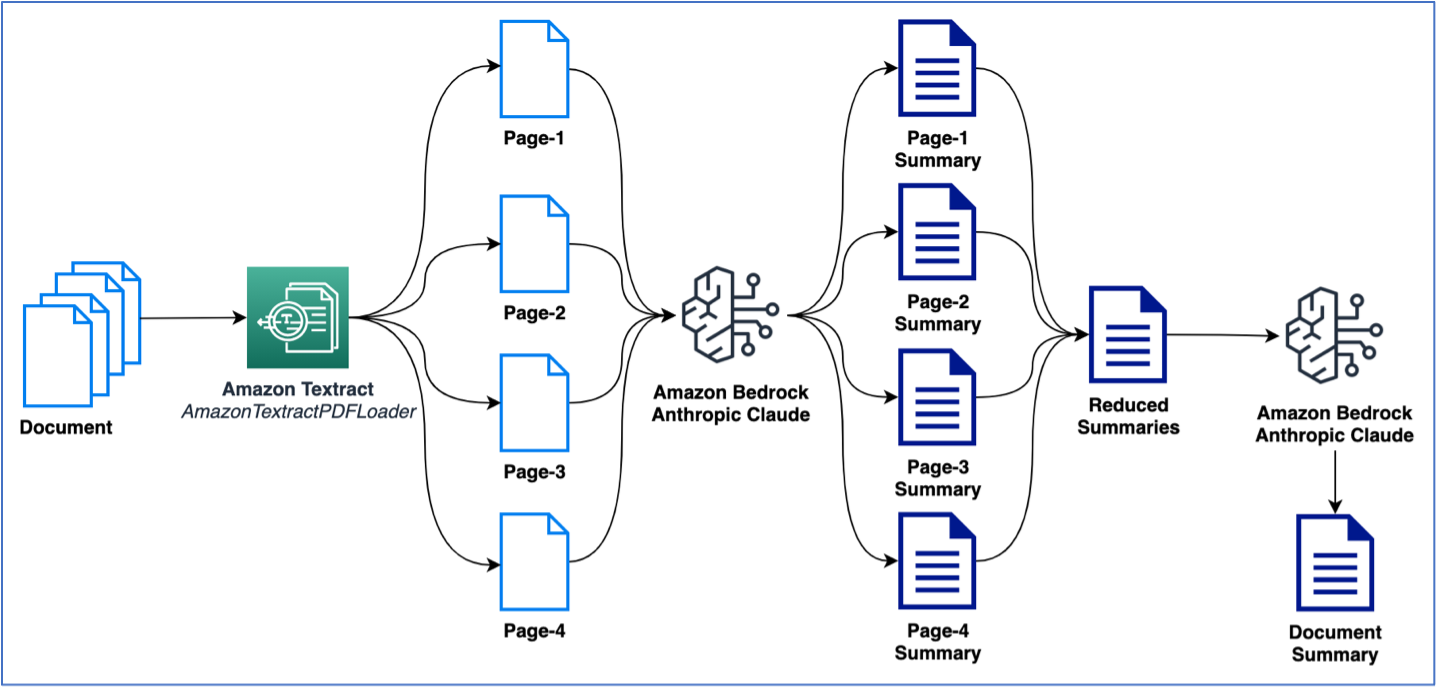

Az előző példa egyoldalas dokumentumot használt az összegzés végrehajtásához. Valószínűleg azonban több oldalt tartalmazó dokumentumokkal fog foglalkozni, amelyek összefoglalásra szorulnak. A többoldalas összegzés általános módja az, hogy először összefoglalókat generál kisebb szövegrészekről, majd a kisebb összegzéseket kombinálja a dokumentum végső összegzéséhez. Vegye figyelembe, hogy ehhez a módszerhez több hívás szükséges az LLM felé. Ennek logikája könnyen kialakítható; a LangChain azonban egy beépített összegző láncot biztosít, amely nagy szövegeket tud összefoglalni (többoldalas dokumentumokból). Az összegzés történhet bármelyik módon map_reduce vagy stuff opciók, amelyek opcióként állnak rendelkezésre az LLM felé irányuló többszöri hívások kezelésére. A következő példában használjuk map_reduce egy többoldalas dokumentum összefoglalására. A következő ábra szemlélteti munkafolyamatunkat.

Először is kezdjük a dokumentum kibontásával, és nézzük meg az oldalankénti teljes tokenszámot és az oldalak teljes számát:

Ezután a LangChain beépített elemét használjuk load_summarize_chain a teljes dokumentum összefoglalásához:

from langchain.chains.summarize import load_summarize_chain summary_chain = load_summarize_chain(llm=bedrock_llm, chain_type='map_reduce')

output = summary_chain.run(document)

print(output.strip())Szabványosítás és Q&A

Ebben a részben a szabványosítási és a Q&A feladatokat tárgyaljuk.

Szabványosítás

A kimenet szabványosítása egy szöveggenerálási feladat, ahol LLM-eket használnak a kimeneti szöveg egységes formázásának biztosítására. Ez a feladat különösen hasznos a kulcsentitás-kivonás automatizálásához, amelyhez a kimenetet a kívánt formátumokhoz kell igazítani. Például követhetjük az azonnali mérnöki bevált gyakorlatokat az LLM finomhangolásához, hogy a dátumokat HH/NN/ÉÉÉÉ formátumba formázzák, ami kompatibilis lehet az adatbázis DÁTUM oszlopával. A következő kódblokk példát mutat be arra, hogy ez hogyan történik LLM és prompt tervezés használatával. Nemcsak a dátumértékek kimeneti formátumát szabványosítjuk, hanem arra is felszólítjuk a modellt, hogy a végső kimenetet JSON formátumban hozza létre, hogy az könnyen felhasználható legyen a későbbi alkalmazásainkban. Használjuk LangChain kifejezési nyelv (LCEL) két intézkedést összekapcsolni. Az első művelet arra kéri az LLM-et, hogy hozzon létre egy JSON formátumú kimenetet, amely csak a dokumentumból származó dátumokat tartalmazza. A második művelet a JSON-kimenetet veszi át, és szabványosítja a dátumformátumot. Ne feledje, hogy ez a kétlépéses művelet egy lépésben is végrehajtható megfelelő azonnali tervezéssel, amint azt a normalizálás és a sablonozás során látni fogjuk.

Az előző kódminta kimenete egy JSON-struktúra 07. és 09. dátummal, amelyek DD/HH/ÉÉÉÉ formátumúak, és a páciens kórházból való felvételének és elbocsátásának dátuma. a mentesítést összefoglaló jelentéshez.

Kérdések és válaszok a Retrieval kiterjesztett generációval

Az LLM-ek köztudottan megőrzik a tényszerű információkat, amelyeket gyakran világismeretüknek vagy világnézetüknek neveznek. Finomhangolással a legmodernebb eredményeket produkálhatják. Vannak azonban korlátok annak, hogy egy LLM milyen hatékonyan férhet hozzá ehhez a tudáshoz és hogyan tudja azokat manipulálni. Ennek eredményeként az olyan feladatokban, amelyek nagymértékben támaszkodnak speciális tudásra, előfordulhat, hogy teljesítményük bizonyos felhasználási esetekben nem optimális. Például a Q&A forgatókönyveknél elengedhetetlen, hogy a modell szigorúan ragaszkodjon a dokumentumban megadott kontextushoz, anélkül, hogy kizárólag a világismeretére hagyatkozna. Az ettől való eltérés félrevezetésekhez, pontatlanságokhoz vagy akár helytelen válaszokhoz is vezethet. A probléma megoldására leggyakrabban használt módszer az ún Visszakeresés kiterjesztett generáció (RONGY). Ez a megközelítés szinergizálja a visszakeresési modellek és a nyelvi modellek erősségeit, javítva a generált válaszok pontosságát és minőségét.

Az LLM-ek token korlátozásokat is előírhatnak memóriakorlátaik és az általuk futtatott hardver korlátai miatt. A probléma kezelésére olyan technikákat alkalmaznak, mint a darabolás, hogy a nagy dokumentumokat kisebb részekre osztják, amelyek beleférnek az LLM-ek token korlátain. Másrészt az NLP-ben a beágyazásokat elsősorban a szavak szemantikai jelentésének és más szavakkal való kapcsolatának megragadására használják egy nagy dimenziós térben. Ezek a beágyazások a szavakat vektorokká alakítják, lehetővé téve a modelleknek a szöveges adatok hatékony feldolgozását és megértését. A szavak és kifejezések közötti szemantikai árnyalatok megértésével a beágyazások lehetővé teszik az LLM-ek számára, hogy koherens és kontextuálisan releváns kimeneteket hozzanak létre. Vegye figyelembe a következő kulcsfontosságú kifejezéseket:

- Dobogó – Ez a folyamat nagy mennyiségű szöveget bont le dokumentumokból kisebb, értelmes szövegrészekre.

- embeddings – Ezek az egyes darabok fix dimenziós vektortranszformációi, amelyek megtartják a csonkokból származó szemantikai információkat. Ezek a beágyazások ezután betöltődnek egy vektoradatbázisba.

- Vektoros adatbázis – Ez a szavak kontextusát reprezentáló szóbeágyazások vagy vektorok adatbázisa. Tudásforrásként működik, amely segíti az NLP-feladatokat a dokumentumfeldolgozási folyamatokban. A vektoros adatbázis előnye itt az, hogy csak a szükséges kontextus biztosítását teszi lehetővé az LLM-eknek a szöveggenerálás során, amint azt a következő részben elmagyarázzuk.

A RAG a beágyazások erejét használja fel a releváns dokumentumszegmensek megértésére és lekérésére a visszakeresési fázis során. Ezzel a RAG az LLM-ek token korlátain belül tud dolgozni, biztosítva, hogy a legrelevánsabb információ kerüljön kiválasztásra a generáláshoz, ami pontosabb és kontextus szempontjából relevánsabb kimeneteket eredményez.

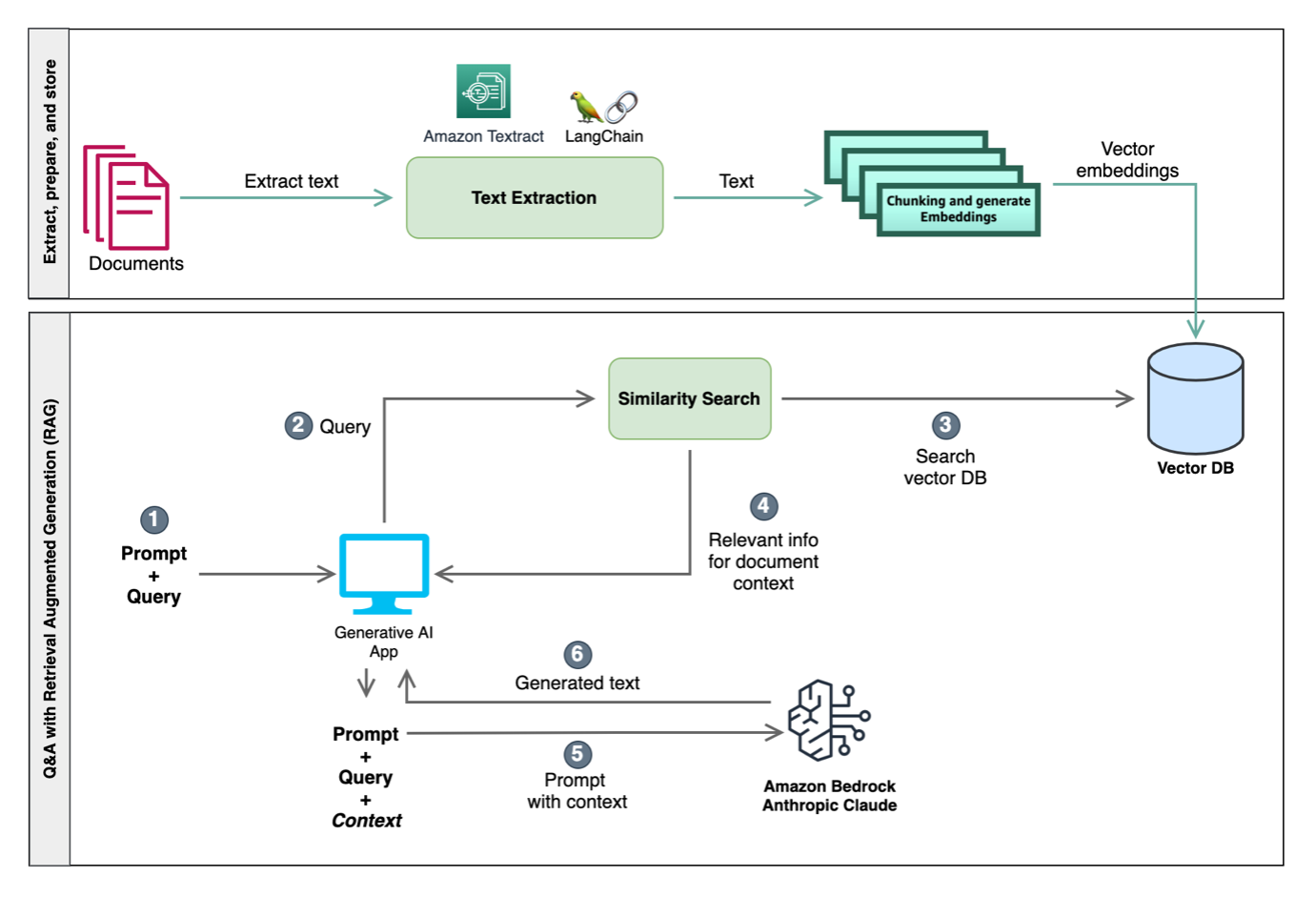

A következő ábra szemlélteti e technikák integrálását az LLM-ek bemenetének kialakításához, javítva a kontextus megértését, és relevánsabb kontextuson belüli válaszokat tesz lehetővé. Az egyik megközelítés a hasonlóságkeresést foglalja magában, amely vektoradatbázist és darabolást is használ. A vektoros adatbázis szemantikai információkat reprezentáló beágyazásokat tárol, a csonkolt szöveg pedig kezelhető szakaszokra osztja fel. A hasonlóságkeresésből származó kontextus felhasználásával az LLM-ek olyan feladatokat futtathatnak, mint a kérdések megválaszolása és a tartományspecifikus műveletek, például az osztályozás és a gazdagítás.

Ebben a bejegyzésben RAG-alapú megközelítést alkalmazunk a dokumentumokkal kapcsolatos kontextusbeli kérdések és válaszok végrehajtására. A következő kódmintában szöveget vonunk ki egy dokumentumból, majd a dokumentumot kisebb szövegrészekre osztjuk. A darabolás azért szükséges, mert előfordulhat, hogy nagy, többoldalas dokumentumaink vannak, és LLM-einknek tokenkorlátai lehetnek. Ezek a darabok ezután betöltődnek a vektoradatbázisba a hasonlóságkeresés végrehajtásához a következő lépésekben. A következő példában az Amazon Titan Embed Text v1 modelljét használjuk, amely a dokumentumdarabok vektoros beágyazását hajtja végre:

A kód releváns kontextust hoz létre az LLM számára a vektoradatbázisból a hasonlóságkeresési művelet által visszaadott szövegrészek felhasználásával. Ebben a példában nyílt forráskódot használunk FAISS vektor bolt minta vektoradatbázisként az egyes szövegrészek vektoros beágyazásainak tárolására. Ezután definiáljuk a vektor adatbázist a LangChain retriever, amely átkerül a RetrievalQA lánc. Ez belsőleg lefuttat egy hasonlósági keresési lekérdezést a vektoradatbázison, amely a kérdés szempontjából releváns szöveg felső n (a példánkban n=3) szövegrészét adja vissza. Végül az LLM-lánc a releváns kontextussal (releváns szövegrészek csoportjával) és az LLM-nek megválaszolandó kérdéssel fut. A RAG-val kapcsolatos kérdések és válaszok lépésről lépésre történő kódbevezetéséhez tekintse meg a Python jegyzetfüzetet GitHub.

A FAISS alternatívájaként használhatja azt is Amazon OpenSearch Service vektoros adatbázis-képességek, Amazon Relational Database Service (Amazon RDS) a PostgreSQL-hez a ... val pgvector kiterjesztést vektoros adatbázisokként vagy nyílt forráskódú Chroma Databaseként.

Kérdések és válaszok táblázatos adatokkal

A dokumentumokon belüli táblázatos adatok feldolgozása kihívást jelenthet az LLM-eknek szerkezeti összetettségük miatt. Az Amazon Textract kiegészíthető LLM-ekkel, mert lehetővé teszi a táblázatok kibontását a dokumentumokból olyan elemek beágyazott formátumában, mint az oldal, táblázat és cellák. A táblázatos adatokkal kapcsolatos kérdések és válaszok végrehajtása többlépcsős folyamat, és ezen keresztül érhető el önkérdező. Az alábbiakban a lépések áttekintése látható:

- Táblázatok kibontása a dokumentumokból az Amazon Textract segítségével. Az Amazon Textract segítségével a táblázatos szerkezet (sorok, oszlopok, fejlécek) kinyerhető a dokumentumból.

- Tárolja a táblázatos adatokat egy vektoros adatbázisban metaadat-információkkal, például a fejlécek neveivel és az egyes fejlécek leírásával együtt.

- Használja a promptot egy strukturált lekérdezés létrehozásához LLM segítségével az adatok táblából való származtatásához.

- Használja a lekérdezést a releváns táblaadatok kinyerésére a vektoradatbázisból.

Például egy bankszámlakivonatban, ha a „Mik azok a tranzakciók, amelyeknél több mint 1000 dollár betét van”, az LLM a következő lépéseket hajtja végre:

- Készítsen lekérdezést, mint pl

“Query: transactions” , “filter: greater than (Deposit$)”. - Konvertálja a lekérdezést strukturált lekérdezéssé.

- Alkalmazza a strukturált lekérdezést arra a vektoradatbázisra, ahol táblaadataink vannak.

A táblázatos Kérdések és válaszok lépésenkénti mintakód-áttekintését a Python jegyzetfüzetben találja. GitHub.

Sablonozás és normalizálások

Ebben a részben azt nézzük meg, hogyan használhatunk gyors mérnöki technikákat és a LangChain beépített mechanizmusát, hogy egy adott sémában egy dokumentumból kivonatokat tartalmazó kimenetet állítsunk elő. A kinyert adatokon némi szabványosítást is végzünk, a korábban tárgyalt technikák segítségével. Kezdjük azzal, hogy meghatározunk egy sablont a kívánt kimenethez. Ez sémaként fog szolgálni, és magába foglalja az egyes entitások részleteit, amelyeket ki akarunk kinyerni a dokumentum szövegéből.

Vegye figyelembe, hogy mindegyik entitásnál a leírást használjuk annak elmagyarázására, hogy mi ez az entitás, hogy segítsük az LLM-et az érték kinyerésében a dokumentum szövegéből. A következő mintakódban ezt a sablont használjuk az LLM-re vonatkozó prompt elkészítéséhez, valamint a dokumentumból kinyert szöveget. AmazonTextractPDFLoader és ezt követően hajtson végre következtetést a modellből:

Amint látja, a {keys} a prompt része a sablonunk kulcsai, és a {details} a kulcsok a leírásukkal együtt. Ebben az esetben nem kérjük kifejezetten a modellt a kimenet formátumával azon kívül, hogy az utasításban megadjuk, hogy a kimenetet JSON formátumban kell előállítani. Ez többnyire működik; mivel azonban az LLM-ek kimenete nem determinisztikus szöveggenerálás, a formátumot kifejezetten a prompt utasításának részeként szeretnénk megadni. Ennek megoldására használhatjuk a LangChain-t strukturált kimeneti elemző modult, hogy kihasználhassa az automatizált prompt tervezés előnyeit, amely segít sablonunkat formátumutasítássá alakítani. A korábban definiált sablont használjuk a formázási utasítások generálásához az alábbiak szerint:

Ezután ezt a változót használjuk az eredeti promptunkban utasításként az LLM-hez, hogy kibontsa és formázza a kimenetet a kívánt sémában, kis módosítással a prompton:

Eddig csak a kívánt sémában vettük ki az adatokat a dokumentumból. Néhány szabványosítást azonban még végre kell hajtanunk. Például azt szeretnénk, hogy a beteg felvételi dátuma és elbocsátási dátuma DD/MM/YYYY formátumban kerüljön kibontásra. Ebben az esetben növeljük a description a kulcsot a formázási utasítással:

Tekintse meg a Python jegyzetfüzetet GitHub a teljes, lépésről lépésre bemutatott áttekintéshez és magyarázathoz.

Helyesírás-ellenőrzés és javítás

Az LLM-ek figyelemre méltó képességekről tettek tanúbizonyságot az emberszerű szöveg megértésében és létrehozásában. Az LLM-ek egyik kevésbé tárgyalt, de rendkívül hasznos alkalmazása a nyelvtani ellenőrzésekben és a dokumentumok mondatjavításában rejlő lehetőségek. A hagyományos nyelvtani ellenőrzőkkel ellentétben, amelyek előre meghatározott szabályokra támaszkodnak, az LLM-ek hatalmas mennyiségű szöveges adatból azonosított mintákat használnak annak meghatározására, hogy mi számít helyes vagy folyékony nyelvnek. Ez azt jelenti, hogy felismerik azokat az árnyalatokat, kontextust és finomságokat, amelyeket a szabályalapú rendszerek esetleg figyelmen kívül hagynak.

Képzelje el a betegelbocsátási összefoglalóból kivont szöveget, amely így szól: „Jon Doe beteg, akit súlyos tüdőgyulladással fogadtak, jelentős javulást mutatott, és biztonságosan elbocsátható. A nyomon követést a jövő hétre tervezik.” A hagyományos helyesírás-ellenőrző hibákként ismerheti fel az „admittd”, „pneumonia”, „javulás” és „nex” szavakat. E hibák kontextusa azonban további hibákhoz vagy általános javaslatokhoz vezethet. Egy kiterjedt képzéssel ellátott LLM a következőket javasolhatja: „A súlyos tüdőgyulladással felvett John Doe beteg jelentős javulást mutatott, és biztonságosan elbocsátható. A nyomon követést a jövő hétre tervezik.”

A következő egy rosszul kézzel írt mintadokumentum, ugyanazzal a szöveggel, mint korábban kifejtettük.

A dokumentumot egy Amazon Textract dokumentumbetöltővel bontjuk ki, majd azonnali tervezéssel utasítjuk az LLM-et, hogy javítsa ki a kibontott szöveget a helyesírási és/vagy nyelvtani hibák kijavítása érdekében:

Az előző kód kimenete a dokumentumbetöltő által kinyert eredeti szöveget mutatja, majd az LLM által generált javított szöveget:

Ne feledje, hogy bármennyire is erősek az LLM-ek, elengedhetetlen, hogy javaslataikat csak úgy tekintse – javaslatoknak. Bár lenyűgözően jól megragadják a nyelv bonyolultságát, mégsem tévedhetetlenek. Egyes javaslatok megváltoztathatják az eredeti szöveg szándékolt jelentését vagy hangját. Ezért kulcsfontosságú, hogy az emberi felülvizsgálók az LLM által generált korrekciókat útmutatóként használják, nem pedig abszolútumként. Az emberi intuíció és az LLM képességek együttműködése olyan jövőt ígér, ahol írásbeli kommunikációnk nem csak hibamentes, hanem gazdagabb és árnyaltabb is.

Következtetés

A generatív mesterséges intelligencia megváltoztatja a dokumentumok IDP segítségével történő feldolgozásának módját, hogy betekintést nyerjen. A posztban Az AWS intelligens dokumentumfeldolgozás fejlesztése generatív mesterséges intelligencia segítségével, megvitattuk a folyamat különböző szakaszait, és azt, hogy az AWS-ügyfél, a Ricoh hogyan fejleszti IDP-folyamatát LLM-ekkel. Ebben a bejegyzésben megvitattuk az IDP-munkafolyamat LLM-ekkel való bővítésének különféle mechanizmusait az Amazon Bedrock, az Amazon Textract és a népszerű LangChain keretrendszer segítségével. Már ma elkezdheti használni az új Amazon Textract dokumentumbetöltőt a LangChain segítségével a nálunk elérhető mintafüzetek segítségével. GitHub tárház. A generatív mesterséges intelligencia AWS rendszeren végzett munkájáról további információkért lásd: Új eszközök bejelentése a generatív AI-val való építéshez az AWS-en.

A szerzőkről

Sonali Sahu vezető szerepet tölt be az intelligens dokumentumfeldolgozásban az AI/ML szolgáltatási csapattal az AWS-ben. Szerző, gondolatvezető és szenvedélyes technológus. Fő területe az AI és az ML, és gyakran felszólal AI és ML konferenciákon és találkozókon szerte a világon. Széles és mély tapasztalattal rendelkezik a technológia és a technológiai ipar területén, valamint iparági szakértelemmel rendelkezik az egészségügy, a pénzügyi szektor és a biztosítás területén.

Sonali Sahu vezető szerepet tölt be az intelligens dokumentumfeldolgozásban az AI/ML szolgáltatási csapattal az AWS-ben. Szerző, gondolatvezető és szenvedélyes technológus. Fő területe az AI és az ML, és gyakran felszólal AI és ML konferenciákon és találkozókon szerte a világon. Széles és mély tapasztalattal rendelkezik a technológia és a technológiai ipar területén, valamint iparági szakértelemmel rendelkezik az egészségügy, a pénzügyi szektor és a biztosítás területén.

Anjan Biswas vezető mesterséges intelligencia-szolgáltatási építész, aki az AI/ML-re és az adatelemzésre összpontosít. Anjan a világméretű mesterséges intelligencia-szolgáltatások csapatának tagja, és az ügyfelekkel dolgozik, hogy segítsen nekik megérteni és megoldásokat kidolgozni az AI és az ML üzleti problémáira. Anjan több mint 14 éves tapasztalattal rendelkezik a globális ellátási lánc, gyártó és kiskereskedelmi szervezetekkel kapcsolatban, és aktívan segíti az ügyfeleket az AWS AI-szolgáltatások megkezdésében és bővítésében.

Anjan Biswas vezető mesterséges intelligencia-szolgáltatási építész, aki az AI/ML-re és az adatelemzésre összpontosít. Anjan a világméretű mesterséges intelligencia-szolgáltatások csapatának tagja, és az ügyfelekkel dolgozik, hogy segítsen nekik megérteni és megoldásokat kidolgozni az AI és az ML üzleti problémáira. Anjan több mint 14 éves tapasztalattal rendelkezik a globális ellátási lánc, gyártó és kiskereskedelmi szervezetekkel kapcsolatban, és aktívan segíti az ügyfeleket az AWS AI-szolgáltatások megkezdésében és bővítésében.

Chinmayee Rane AI/ML Specialist Solutions Architect az Amazon Web Servicesnél. Szenvedélye az alkalmazott matematika és a gépi tanulás. Arra összpontosít, hogy intelligens dokumentumfeldolgozást és generatív AI-megoldásokat tervezzen az AWS-ügyfelek számára. Munkán kívül szeret salsát és bachatát táncolni.

Chinmayee Rane AI/ML Specialist Solutions Architect az Amazon Web Servicesnél. Szenvedélye az alkalmazott matematika és a gépi tanulás. Arra összpontosít, hogy intelligens dokumentumfeldolgozást és generatív AI-megoldásokat tervezzen az AWS-ügyfelek számára. Munkán kívül szeret salsát és bachatát táncolni.

- SEO által támogatott tartalom és PR terjesztés. Erősödjön még ma.

- PlatoData.Network Vertical Generative Ai. Erősítse meg magát. Hozzáférés itt.

- PlatoAiStream. Web3 Intelligence. Felerősített tudás. Hozzáférés itt.

- PlatoESG. Carbon, CleanTech, Energia, Környezet, Nap, Hulladékgazdálkodás. Hozzáférés itt.

- PlatoHealth. Biotechnológiai és klinikai vizsgálatok intelligencia. Hozzáférés itt.

- Forrás: https://aws.amazon.com/blogs/machine-learning/intelligent-document-processing-with-amazon-textract-amazon-bedrock-and-langchain/

- :van

- :is

- :nem

- :ahol

- .nex

- $1000

- $ UP

- 1

- 10

- 100

- 11

- 12

- 13

- 14

- 15%

- 16

- 22

- 23

- 33

- 35%

- 7

- 9

- a

- képességek

- Rólunk

- Abszolút

- hozzáférés

- igénybe vett

- Szerint

- pontosság

- pontos

- elért

- át

- Akció

- cselekvések

- aktívan

- tevékenység

- cselekmények

- Ad

- cím

- Hozzáteszi

- tapad

- beismerni

- felvételt nyer

- fejlesztések

- Előny

- megérkezés

- kor

- szerek

- AI

- AI szolgáltatások

- AI / ML

- igazított

- Minden termék

- lehetővé téve

- lehetővé teszi, hogy

- mentén

- Is

- alternatív

- Bár

- amazon

- Amazon Comprehend

- Amazon RDS

- Amazon szöveg

- Az Amazon Web Services

- Összegek

- an

- analitika

- elemez

- és a

- válasz

- Antropikus

- bármilyen

- API-k

- alkalmazások

- alkalmazott

- kinevezések

- megközelítés

- építészet

- VANNAK

- TERÜLET

- körül

- Művészet

- mesterséges

- mesterséges intelligencia

- Mesterséges intelligencia (AI)

- AS

- megjelenés

- segít

- Helyettes

- At

- fokozza

- bővített

- szerző

- automatizált

- Automatizált

- automatikusan

- Automatizálás

- elérhető

- tudatosság

- AWS

- AWS Ügyfél

- Bank

- BE

- mert

- válik

- óta

- előtt

- előnyös

- haszon

- BEST

- legjobb gyakorlatok

- között

- Blokk

- Blocks

- mindkét

- szélesség

- szünet

- szünetek

- épít

- Épület

- beépített

- üzleti

- vállalkozások

- de

- by

- kéri

- TUD

- Kaphat

- képességek

- elfog

- eset

- esetek

- Cellák

- bizonyos

- lánc

- láncok

- kihívás

- kihívást

- változik

- Változások

- változó

- Ellenőrzések

- választás

- követelések

- osztály

- osztályok

- besorolás

- osztályoz

- kód

- ÖSSZEFÜGGŐ

- együttműködés

- Oszlop

- Oszlopok

- kombináció

- össze

- jön

- Közös

- általában

- közlés

- összeegyeztethető

- teljes

- bonyolult

- bonyolultság

- megért

- tömör

- konferenciák

- Csatlakozó

- következetes

- áll

- korlátok

- konstrukció

- tartalmaz

- tartalmazott

- tartalmaz

- tartalom

- kontextus

- szövegre vonatkozó

- megtérít

- Mag

- kijavítására

- korrigált

- Hiba

- tudott

- kézműves

- kidolgozott

- teremt

- kritikus

- szokás

- vevő

- Ügyfelek

- Tánc

- dátum

- Adatelemzés

- adatbázis

- adatbázisok

- találka

- Időpontok

- üzlet

- mély

- mélyebb

- meghatározott

- meghatározott

- meghatározó

- igazolták

- attól

- betétek

- mélység

- leírt

- leírás

- tervezés

- kívánatos

- részlet

- részletes

- részletek

- kimutatására

- Határozzuk meg

- Fejleszt

- fejlesztők

- Diéta

- különböző

- közvetlenül

- megvitatni

- tárgyalt

- merülés

- osszuk

- oszt

- do

- Orvos

- dokumentum

- dokumentáció

- dokumentumok

- dámvadtehén

- Nem

- Ennek

- Don

- csinált

- ne

- le-

- drámaian

- két

- alatt

- dinamikus

- e

- minden

- Korábban

- könnyen

- könnyen használható

- hatékonyan

- hatékonyság

- hatékony

- eredményesen

- erőfeszítések

- bármelyik

- elemek

- Beágyaz

- munkavállaló

- felhatalmazza

- lehetővé

- lehetővé teszi

- lehetővé téve

- végén

- Mérnöki

- növelése

- fokozott

- fokozása

- biztosítására

- biztosítása

- Egész

- Szervezetek

- egység

- felszerelt

- hibák

- alapvető

- Még

- példa

- Kivéve

- kivétel

- létező

- tapasztalat

- szakvélemény

- Magyarázza

- magyarázható

- Elmagyarázza

- magyarázat

- kifejezetten

- kifejezés

- terjed

- kiterjesztés

- kiterjedt

- kivonat

- kitermelés

- kivonatok

- Esik

- hamis

- messze

- fáradtság

- Fields

- Ábra

- utolsó

- Végül

- pénzügyi

- Pénzügyi szektor

- vezetéknév

- megfelelő

- Összpontosít

- koncentrál

- következik

- követ

- következő

- következik

- A

- formátum

- formák

- talált

- Alapítvány

- Keretrendszer

- Ingyenes

- gyakran

- ból ből

- Határ

- Tele

- teljesen

- további

- jövő

- általános

- generál

- generált

- generál

- generáló

- generáció

- nemző

- Generatív AI

- kap

- Ad

- adott

- Globális

- nyelvtan

- fogás

- nagyobb

- Csoport

- útmutató

- kéz

- fogantyú

- történik

- Esemény

- hardver

- Legyen

- fejlécek

- egészségügyi

- súlyosan

- segít

- hasznos

- segít

- segít

- neki

- itt

- magas szinten

- nagy teljesítményű

- <p></p>

- tart

- kórház

- Hogyan

- How To

- azonban

- HTML

- HTTPS

- emberi

- i

- ID

- azonosított

- if

- illusztrálja

- kép

- nagyon

- Hatás

- importál

- fontos

- importáló

- szabhat

- javulás

- in

- Beleértve

- index

- ipar

- információ

- Információs kor

- Innováció

- bemenet

- meglátások

- példa

- utasítás

- biztosítás

- integrálni

- integrált

- integrálása

- integráció

- Intelligencia

- Intelligens

- Intelligens dokumentumfeldolgozás

- szándékolt

- belsőleg

- bele

- bonyodalmak

- bevezet

- Bevezetett

- Bemutatja

- IT

- ITS

- Jackson

- János

- GIPSZ JAKAB

- jon

- jpg

- json

- éppen

- Kulcs

- kulcsok

- Ismer

- tudás

- ismert

- nyelv

- nagy

- elrendezés

- vezet

- vezető

- vezető

- tanulás

- kilépő

- könyvtár

- mint

- Valószínű

- korlátozások

- határértékek

- Lista

- LLM

- kiszámításának

- rakodó

- logika

- néz

- Sok

- gép

- gépi tanulás

- Gyártás

- kezelése

- kezelhető

- sikerült

- kezelése

- kézikönyv

- gyártási

- megjelölt

- matematika

- Lehet..

- me

- jelenti

- jelentőségteljes

- eszközök

- mechanizmus

- mechanizmusok

- Meetups

- Memory design

- meta

- Metaadatok

- módszer

- mód

- esetleg

- bánja

- hiányzik

- hibákat

- ML

- modell

- modellek

- Modulok

- több

- Jelzálog

- a legtöbb

- többszörös

- név

- nevek

- Természetes

- Természetes nyelvi feldolgozás

- elengedhetetlen

- Szükség

- szükséges

- igények

- Új

- következő

- jövő héten

- NLP

- jegyzetfüzet

- Most

- árnyalatok

- szám

- tárgy

- objektumok

- of

- Ajánlatok

- gyakran

- on

- ONE

- csak

- nyílt forráskódú

- Művelet

- Alkalom

- optimálisan

- Opciók

- or

- szervezetek

- eredeti

- Más

- másképp

- mi

- ki

- Eredmény

- teljesítmény

- kimenetek

- kívül

- felett

- áttekintés

- csomagok

- oldal

- oldalak

- Fájdalom

- párosított

- párok

- rész

- különösen

- elhalad

- Elmúlt

- Múló

- szenvedélyes

- ösvény

- beteg

- Mintás

- minták

- mert

- Teljesít

- teljesítmény

- teljesített

- előadó

- Előadja

- fázis

- phd

- kifejezés

- csővezeték

- terv

- Plató

- Platón adatintelligencia

- PlatoData

- kérem

- tüdőgyulladás

- pont

- Népszerű

- lehetséges

- állás

- potenciális

- hatalom

- powered

- erős

- gyakorlat

- pontosan

- Pontosság

- előnyben részesített

- be

- korábban

- elsősorban

- Plakátok

- Probléma

- problémák

- folyamat

- Feldolgozott

- feldolgozás

- gyárt

- ígér

- megfelelő

- ad

- feltéve,

- ellátó

- biztosít

- Piton

- Kérdések és válaszok

- világítás

- kérdés

- Quick

- gyorsan

- Nyers

- Olvasás

- elismerik

- csökkentő

- utal

- referencia

- említett

- Kapcsolatok

- támaszkodnak

- támaszkodva

- figyelemre méltó

- jelentést

- képvisel

- képviselő

- kötelező

- megköveteli,

- illetőleg

- válaszok

- korlátozások

- eredményez

- kapott

- Eredmények

- kiskereskedelem

- megtartása

- visszatartó

- Visszatér

- Gazdag

- Szoba

- szabályok

- futás

- fut

- s

- biztosan

- azonos

- azt mondják

- Skála

- forgatókönyvek

- tervezett

- Keresés

- Második

- Rész

- szakaszok

- szektor

- lát

- szegmensek

- kiválasztott

- idősebb

- mondat

- Series of

- szolgál

- szolgálja

- szolgáltatás

- Szolgáltatások

- készlet

- szigorú

- ő

- rövid

- kellene

- mutatott

- Műsorok

- jelentős

- egyetlen

- kicsi

- kisebb

- töredék

- So

- Kizárólag

- Megoldások

- SOLVE

- néhány

- forrás

- Hely

- beszél

- szakember

- különleges

- kifejezetten

- meghatározott

- helyesírás

- osztott

- állapota

- szabványosítás

- kezdet

- kezdődött

- csúcs-

- nyilatkozat

- Lépés

- Lépései

- Még mindig

- tárolni

- memorizált

- árnyékolók

- erősségek

- Húr

- szerkezeti

- struktúra

- szerkesztett

- Küzdelem

- későbbi

- Később

- ilyen

- javasol

- összegez

- ÖSSZEFOGLALÓ

- kínálat

- ellátási lánc

- támogatás

- Támogatja

- szinergia

- Systems

- táblázat

- Vesz

- tart

- Feladat

- feladatok

- csapat

- technika

- technikák

- technológus

- Technológia

- sablon

- feltételek

- szöveg

- szövegi

- mint

- hogy

- A

- a világ

- azok

- Őket

- akkor

- Ott.

- ebből adódóan

- Ezek

- ők

- ezt

- gondoltam

- három

- Keresztül

- titán-

- nak nek

- Ma

- mai

- együtt

- jelképes

- tokenek

- TONE

- szerszámok

- felső

- Végösszeg

- hagyományos

- Utánfutó

- Képzések

- Tranzakciók

- Átalakítás

- transzformációk

- igaz

- megpróbál

- kettő

- típus

- típusok

- megért

- megértés

- nem úgy mint

- leleplezés

- URL

- használ

- használati eset

- használt

- Felhasználók

- használ

- segítségével

- hasznosított

- kihasználva

- v1

- érték

- Értékek

- változó

- különféle

- Hatalmas

- sokoldalú

- változat

- keresztül

- Megnézem

- kötetek

- végigjátszás

- akar

- volt

- Út..

- we

- háló

- webes szolgáltatások

- hét

- JÓL

- Mit

- amikor

- ami

- míg

- WHO

- lesz

- val vel

- belül

- nélkül

- tanúi

- szó

- szavak

- Munka

- munkafolyamat

- munkafolyamatok

- dolgozó

- művek

- világ

- lenne

- írott

- X

- év

- te

- zephyrnet