Ebben a bejegyzésben bemutatjuk, hogyan használható a neurális architektúra-keresés (NAS) alapú szerkezeti metszés a finomhangolt BERT-modell tömörítésére a modell teljesítményének javítása és a következtetési idő csökkentése érdekében. Az előre betanított nyelvi modellek (PLM) gyors kereskedelmi és vállalati elfogadáson mennek keresztül a termelékenységi eszközök, az ügyfélszolgálat, a keresés és ajánlások, az üzleti folyamatok automatizálása és a tartalomkészítés területén. A PLM következtetési végpontok telepítése általában magasabb késleltetéssel és magasabb infrastrukturális költségekkel jár a számítási követelmények miatt, valamint a nagyszámú paraméter miatt csökkent számítási hatékonysággal. A PLM levágása csökkenti a modell méretét és összetettségét, miközben megtartja előrejelző képességeit. A levágott PLM-ek kisebb memóriaterületet és alacsonyabb késleltetést érnek el. Bemutatjuk, hogy a PLM levágásával és a paraméterek számának és érvényesítési hibájának kiváltásával egy adott célfeladathoz, és gyorsabb válaszidőt tudunk elérni az alap PLM modellhez képest.

A többcélú optimalizálás a döntéshozatal azon területe, amely egynél több célfüggvényt optimalizál, mint például a memóriafelhasználást, a képzési időt és a számítási erőforrásokat, hogy egyszerre optimalizálható legyen. A strukturális metszés egy olyan technika, amely csökkenti a PLM méretét és számítási követelményeit rétegek vagy neuronok/csomópontok metszésével, miközben megpróbálja megőrizni a modell pontosságát. A rétegek eltávolításával a szerkezeti metszés nagyobb tömörítési arányt ér el, ami hardverbarát strukturált ritkasághoz vezet, ami csökkenti a futási időt és a válaszidőt. A strukturális metszéstechnika alkalmazása egy PLM-modellre egy könnyebb modellt eredményez, kisebb memóriaigénnyel, amely a SageMakerben következtetési végpontként tárolva jobb erőforrás-hatékonyságot és alacsonyabb költségeket kínál az eredeti finomhangolt PLM-hez képest.

Az ebben a bejegyzésben bemutatott fogalmak alkalmazhatók olyan alkalmazásokra, amelyek PLM-szolgáltatásokat használnak, mint például az ajánlási rendszerek, a hangulatelemzés és a keresőmotorok. Konkrétan akkor használhatja ezt a megközelítést, ha dedikált gépi tanulási (ML) és adattudományi csapatai vannak, akik saját PLM-modelleik finomhangolását végzik tartományspecifikus adatkészletek segítségével, és nagyszámú következtetési végpontot telepítenek Amazon SageMaker. Az egyik példa egy online kereskedő, aki nagyszámú következtetési végpontot alkalmaz szöveges összefoglaláshoz, termékkatalógus-besoroláshoz és termék-visszajelzési vélemény osztályozáshoz. Egy másik példa lehet egy egészségügyi szolgáltató, aki PLM-következtetési végpontokat használ a klinikai dokumentumok osztályozására, az orvosi jelentésekből származó elnevezett entitások felismerésére, az orvosi chatbotokra és a betegek kockázati rétegzésére.

Megoldás áttekintése

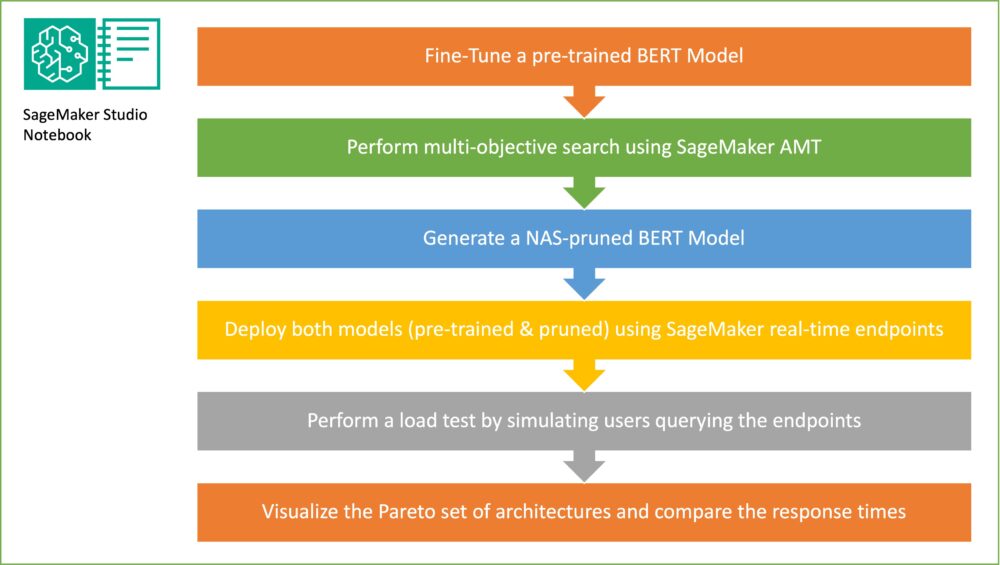

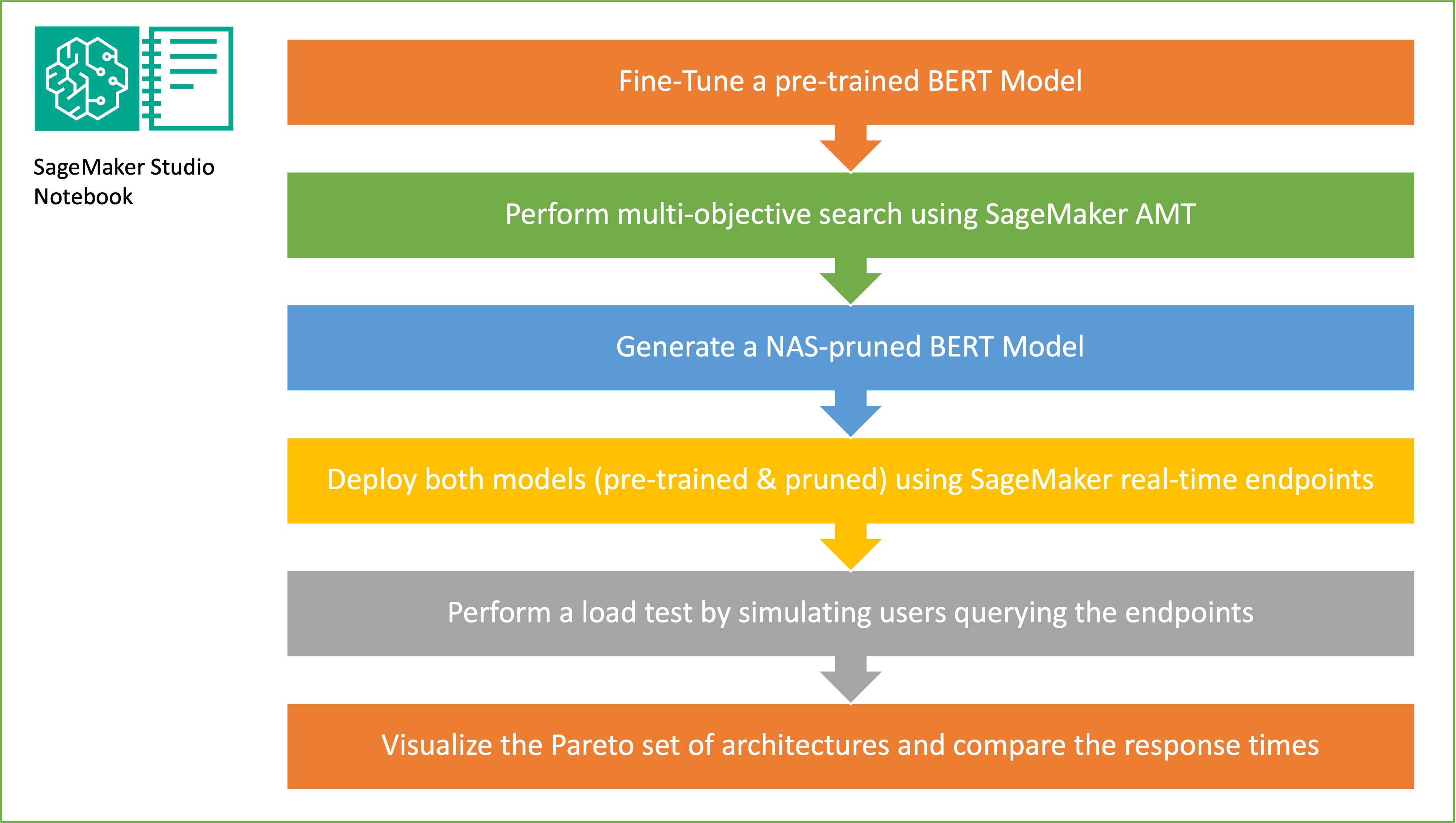

Ebben a részben bemutatjuk az általános munkafolyamatot és elmagyarázzuk a megközelítést. Először is használunk egy Amazon SageMaker Studio jegyzetfüzet egy előre betanított BERT-modell finomhangolása egy célfeladaton egy tartományspecifikus adatkészlet segítségével. BERTI (Bidirectional Encoder Representations from Transformers) egy előre betanított nyelvi modell, amely a transzformátor architektúra természetes nyelvi feldolgozási (NLP) feladatokhoz használják. A neurális architektúra keresés (NAS) egy megközelítés a mesterséges neurális hálózatok tervezésének automatizálására, és szorosan kapcsolódik a hiperparaméter-optimalizáláshoz, amely egy széles körben alkalmazott megközelítés a gépi tanulás területén. A NAS célja, hogy megtalálja az adott problémához az optimális architektúrát, olyan technikák segítségével, mint a gradiensmentes optimalizálás vagy a kívánt metrikák optimalizálása a jelölt architektúrák nagy halmazán. Az architektúra teljesítményét általában olyan mérőszámok segítségével mérik, mint például az érvényesítési veszteség. SageMaker automatikus modellhangolás (AMT) automatizálja az ML modell hiperparaméterei optimális kombinációinak megtalálásának fáradságos és összetett folyamatát, amelyek a legjobb modellteljesítményt biztosítják. Az AMT intelligens keresési algoritmusokat és iteratív kiértékeléseket használ az Ön által megadott hiperparaméterek tartományával. Kiválasztja azokat a hiperparaméter-értékeket, amelyek egy olyan modellt hoznak létre, amely a legjobb teljesítményt nyújtja, olyan teljesítménymutatókkal mérve, mint a pontosság és az F-1 pontszám.

Az ebben a bejegyzésben leírt finomhangolási megközelítés általános, és bármely szöveges adatkészletre alkalmazható. A BERT PLM-hez rendelt feladat lehet szöveges feladat, például hangulatelemzés, szövegosztályozás vagy kérdezz-felelek. Ebben a demóban a célfeladat egy bináris osztályozási probléma, ahol a BERT segítségével egy szövegtöredékpárok gyűjteményéből álló adatkészletből azonosítható, hogy az egyik szövegrészlet jelentése kikövetkeztethető-e a másik töredékből. Használjuk a Szöveges kitétel adatkészlet felismerése a GLUE benchmarking csomagból. Többcélú keresést végzünk a SageMaker AMT segítségével, hogy azonosítsuk azokat az alhálózatokat, amelyek optimális kompromisszumot kínálnak a paraméterek száma és az előrejelzési pontosság között a célfeladathoz. A többcélú keresés végrehajtásakor a pontosság és a paraméterek számának meghatározásával kezdjük, mint az optimalizálni kívánt célokat.

A BERT PLM hálózaton belül lehetnek moduláris, önálló alhálózatok, amelyek lehetővé teszik, hogy a modell olyan speciális képességekkel rendelkezzen, mint a nyelvi megértés és a tudás reprezentációja. A BERT PLM egy többfejű önfigyelő alhálózatot és egy előrecsatolt alhálózatot használ. A többfejű, önfigyelő réteg lehetővé teszi a BERT számára, hogy egyetlen szekvencia különböző pozícióit összekapcsolja a szekvencia reprezentációjának kiszámítása érdekében, lehetővé téve, hogy több fej több kontextusjelre figyeljen. A bemenet több altérre van felosztva, és az önfigyelem mindegyik altérre külön-külön kerül alkalmazásra. A transzformátor PLM-ben található több fej lehetővé teszi a modell számára, hogy közösen kezelje a különböző reprezentációs alterekből származó információkat. Az előrecsatolt alhálózat egy egyszerű neurális hálózat, amely átveszi a többfejű önfigyelő alhálózat kimenetét, feldolgozza az adatokat, és visszaadja a végső kódoló reprezentációkat.

A véletlenszerű alhálózati mintavétel célja olyan kisebb BERT modellek betanítása, amelyek elég jól teljesítenek a célfeladatokon. A finomhangolt BERT alapmodellből 100 véletlenszerű alhálózatot veszünk mintát, és egyszerre 10 hálózatot értékelünk. A betanított alhálózatokat kiértékeli az objektív mérőszámok szempontjából, és a végső modellt az objektív mérőszámok között talált kompromisszumok alapján választják ki. Vizualizáljuk a Pareto front a mintavételezett alhálózatokhoz, amely tartalmazza azt a levágott modellt, amely optimális kompromisszumot kínál a modell pontossága és a modell mérete között. A jelölt alhálózatot (NAS által megvágott BERT-modell) a modell mérete és a modell pontossága alapján választjuk ki, amellyel hajlandóak vagyunk lecserélni. Ezután a végpontokat, az előre betanított BERT alapmodellt és a NAS által metszett BERT-modellt a SageMaker segítségével tároljuk. Terhelésvizsgálat elvégzéséhez használjuk Sáska, egy nyílt forráskódú terhelési tesztelő eszköz, amelyet a Python használatával valósíthat meg. Mindkét végponton terhelési tesztet futtatunk a Locust segítségével, és az eredményeket a Pareto front segítségével vizualizáljuk, hogy szemléltesse a válaszidő és a pontosság közötti kompromisszumot mindkét modell esetében. A következő diagram áttekintést nyújt az ebben a bejegyzésben ismertetett munkafolyamatról.

Előfeltételek

Ehhez a poszthoz a következő előfeltételek szükségesek:

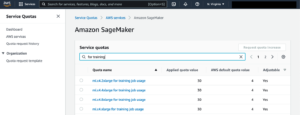

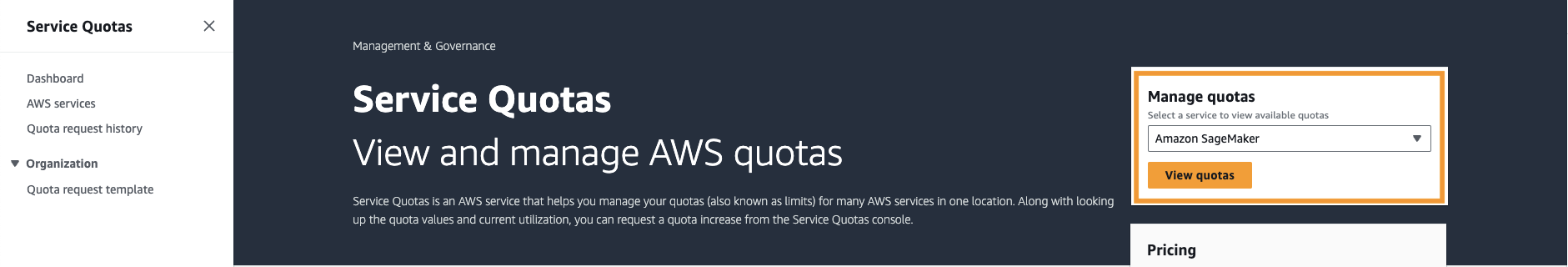

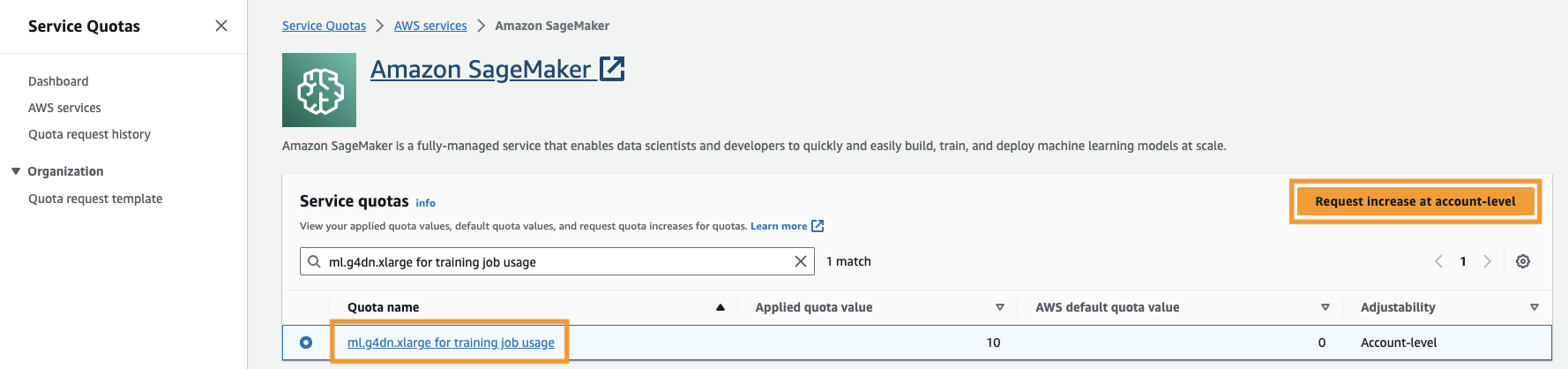

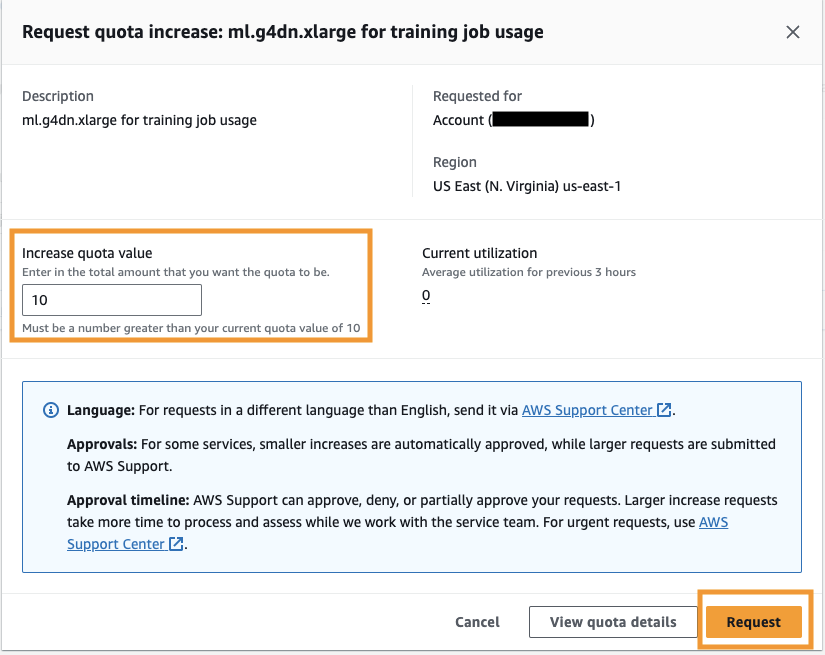

Emellett növelni kell a szolgáltatási kvóta hogy elérje legalább három ml.g4dn.xlarge példányt a SageMakerben. Az ml.g4dn.xlarge példánytípus a költséghatékony GPU-példány, amely lehetővé teszi a PyTorch natív futtatását. A szolgáltatási kvóta növeléséhez hajtsa végre a következő lépéseket:

- A konzolon lépjen a Szolgáltatási kvóták oldalra.

- A Kvóták kezelése, választ Amazon SageMaker, majd válassza ki Kvóták megtekintése.

- Keresse meg az „ml-g4dn.xlarge for training job use” kifejezést, és válassza ki a kvótaelemet.

- A pop-art design, négy időzóna kijelzése egyszerre és méretének arányai azok az érvek, amelyek a NeXtime Time Zones-t kiváló választássá teszik. Válassza a Számlaszintű növelés kérése.

- A Növelje a kvóta értékét, adjon meg egy 5-ös vagy nagyobb értéket.

- A pop-art design, négy időzóna kijelzése egyszerre és méretének arányai azok az érvek, amelyek a NeXtime Time Zones-t kiváló választássá teszik. Válassza a Kérjen.

A kért kvóta-jóváhagyás a fiók engedélyeitől függően eltarthat egy ideig.

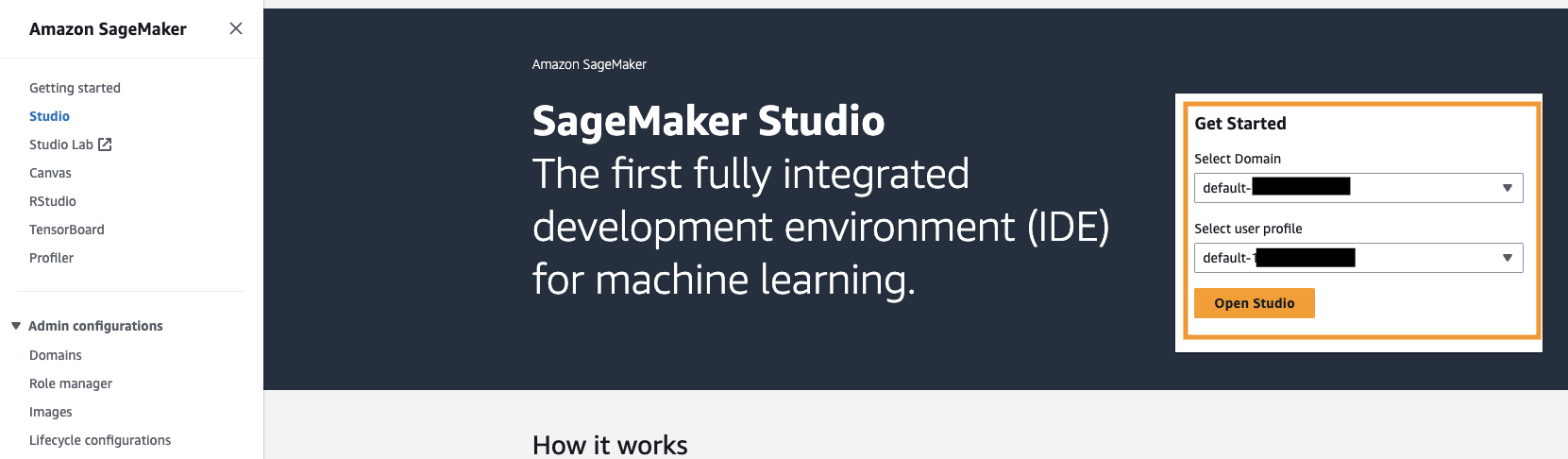

- Nyissa meg a SageMaker Studio-t a SageMaker konzolról.

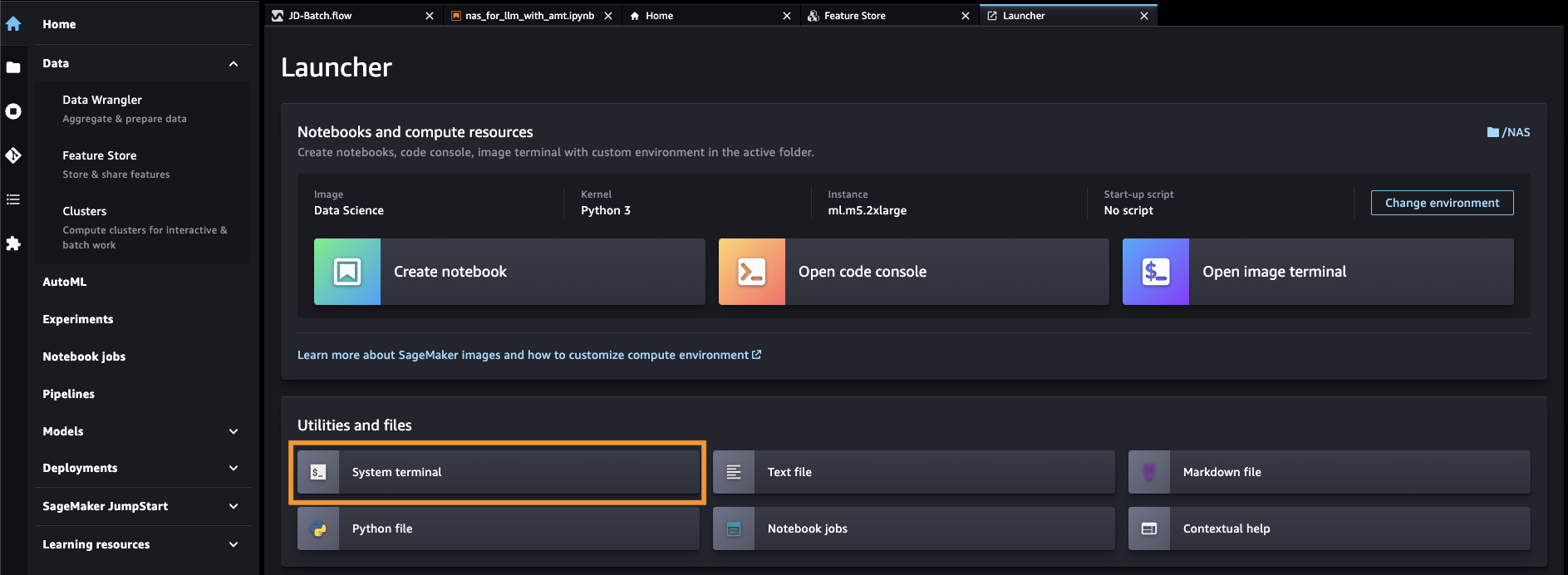

- A pop-art design, négy időzóna kijelzése egyszerre és méretének arányai azok az érvek, amelyek a NeXtime Time Zones-t kiváló választássá teszik. Válassza a Rendszerterminál alatt Segédprogramok és fájlok.

- Futtassa a következő parancsot a klónozáshoz GitHub repo a SageMaker Studio példányhoz:

- navigáljon

amazon-sagemaker-examples/hyperparameter_tuning/neural_architecture_search_llm. - Nyissa meg a fájlt

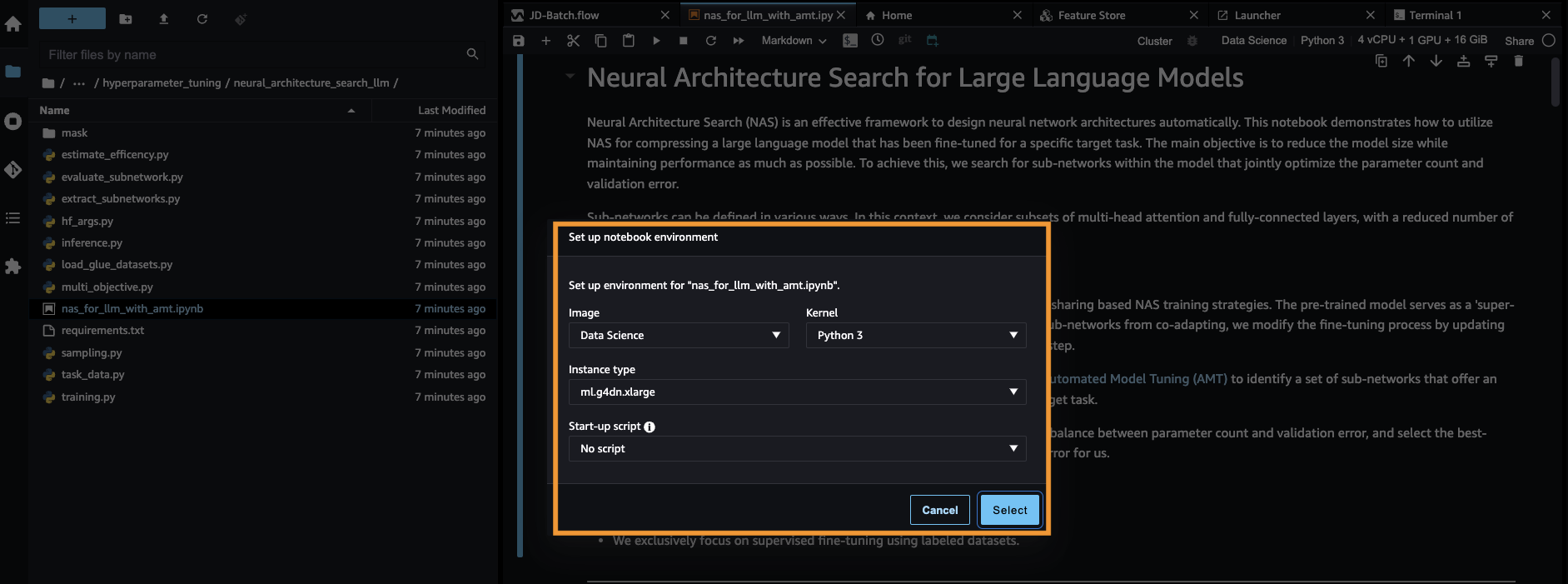

nas_for_llm_with_amt.ipynb. - Állítsa be a környezetet egy

ml.g4dn.xlargepéldát és válassza ki választ.

Állítsa be az előre betanított BERT-modellt

Ebben a szakaszban importáljuk a Recognizing Textual Entailment adatkészletet az adatkészlet-könyvtárból, és felosztjuk az adatkészletet oktatási és érvényesítési készletekre. Ez az adatkészlet mondatpárokból áll. A BERT PLM feladata annak felismerése, hogy két szövegtöredék ismeretében kikövetkeztethető-e az egyik szövegrészlet jelentése a másik töredékből. A következő példában az első kifejezés jelentésére következtethetünk a második kifejezésből:

A szöveges felismerési következmény adatkészletet betöltjük a ragasztó benchmarking suite keresztül a adatkészlet könyvtár a Hugging Face-től a képzési forgatókönyvünkön belül (./training.py). A GLUE eredeti betanítási adatkészletét egy betanítási és érvényesítési készletre osztottuk. Megközelítésünkben finomhangoljuk az alap BERT-modellt a betanítási adatkészlet segítségével, majd többcélú keresést végzünk, hogy azonosítsuk azokat az alhálózatokat, amelyek optimálisan egyensúlyoznak az objektív metrikák között. A képzési adatkészletet kizárólag a BERT modell finomhangolására használjuk. Mindazonáltal érvényesítési adatokat használunk a többcélú kereséshez a visszatartási érvényesítési adatkészlet pontosságának mérésével.

Finomhangolja a BERT PLM-et egy tartományspecifikus adatkészlet segítségével

A nyers BERT-modell tipikus használati esetei közé tartozik a következő mondat előrejelzése vagy a maszkolt nyelvi modellezés. Ahhoz, hogy az alap BERT-modellt olyan downstream feladatokhoz használhassuk, mint például a szöveges felismerési következmények, tovább kell finomítanunk a modellt egy tartományspecifikus adatkészlet segítségével. A finomhangolt BERT-modellt olyan feladatokhoz használhatja, mint a sorozatok osztályozása, a kérdések megválaszolása és a token osztályozás. Ennek a demónak a céljaira azonban a finomhangolt modellt használjuk a bináris osztályozáshoz. Finomhangoljuk az előre betanított BERT-modellt a korábban elkészített betanítási adatkészlettel, a következő hiperparaméterek használatával:

A modellképzés ellenőrzőpontját elmentjük egy Amazon egyszerű tárolási szolgáltatás (Amazon S3) vödör, így a modell betölthető a NAS alapú többcélú keresés során. A modell betanítása előtt meghatározzuk az olyan mérőszámokat, mint az epocha, a betanítási veszteség, a paraméterek száma és az érvényesítési hiba:

A finomhangolási folyamat megkezdése után a képzési feladat körülbelül 15 percet vesz igénybe.

Végezzen többcélú keresést az alhálózatok kiválasztásához és az eredmények megjelenítéséhez

A következő lépésben egy többcélú keresést végzünk a finomhangolt BERT alapmodellben véletlenszerű alhálózatok mintavételével a SageMaker AMT segítségével. A szuperhálózaton belüli alhálózat eléréséhez (a finomhangolt BERT-modell) a PLM összes olyan összetevőjét elrejtjük, amelyek nem részei az alhálózatnak. A szuperhálózatok maszkolása az alhálózatok PLM-ben történő megtalálásához a modell viselkedési mintáinak elkülönítésére és azonosítására szolgáló technika. Vegye figyelembe, hogy a Hugging Face transzformátoroknak a rejtett méretnek a fejek számának többszörösének kell lennie. A transzformátor PLM rejtett mérete szabályozza a rejtett állapotvektortér méretét, ami befolyásolja a modell azon képességét, hogy megtanuljon összetett reprezentációkat és mintákat az adatokban. A BERT PLM-ben a rejtett állapotvektor rögzített méretű (768). A rejtett méretet nem tudjuk megváltoztatni, ezért a fejek számának [1, 3, 6, 12]-ben kell lennie.

Az egycélú optimalizálással ellentétben a többcélú beállításnál jellemzően nincs egyetlen olyan megoldásunk sem, amely egyszerre optimalizálna minden célt. Ehelyett arra törekszünk, hogy olyan megoldásokat gyűjtsünk össze, amelyek uralják az összes többi megoldást legalább egy célkitűzésben (például érvényesítési hiba). Most elindíthatjuk a többcélú keresést az AMT-n keresztül a csökkenteni kívánt metrikák (érvényesítési hiba és paraméterek száma) beállításával. A véletlenszerű alhálózatokat a paraméter határozza meg max_jobs az egyidejű munkák számát pedig a paraméter határozza meg max_parallel_jobs. A modell-ellenőrzőpont betöltéséhez és az alhálózat kiértékeléséhez szükséges kód elérhető a evaluate_subnetwork.py szkripteket.

Az AMT hangolási feladat körülbelül 2 óra 20 percet vesz igénybe. Miután az AMT hangolási feladat sikeresen lefut, elemezzük a job előzményeit, és összegyűjtjük az alhálózat konfigurációit, például a fejek számát, a rétegek számát, az egységek számát és a megfelelő mérőszámokat, mint például az érvényesítési hiba és a paraméterek száma. A következő képernyőképen egy sikeres AMT tuner munka összefoglalása látható.

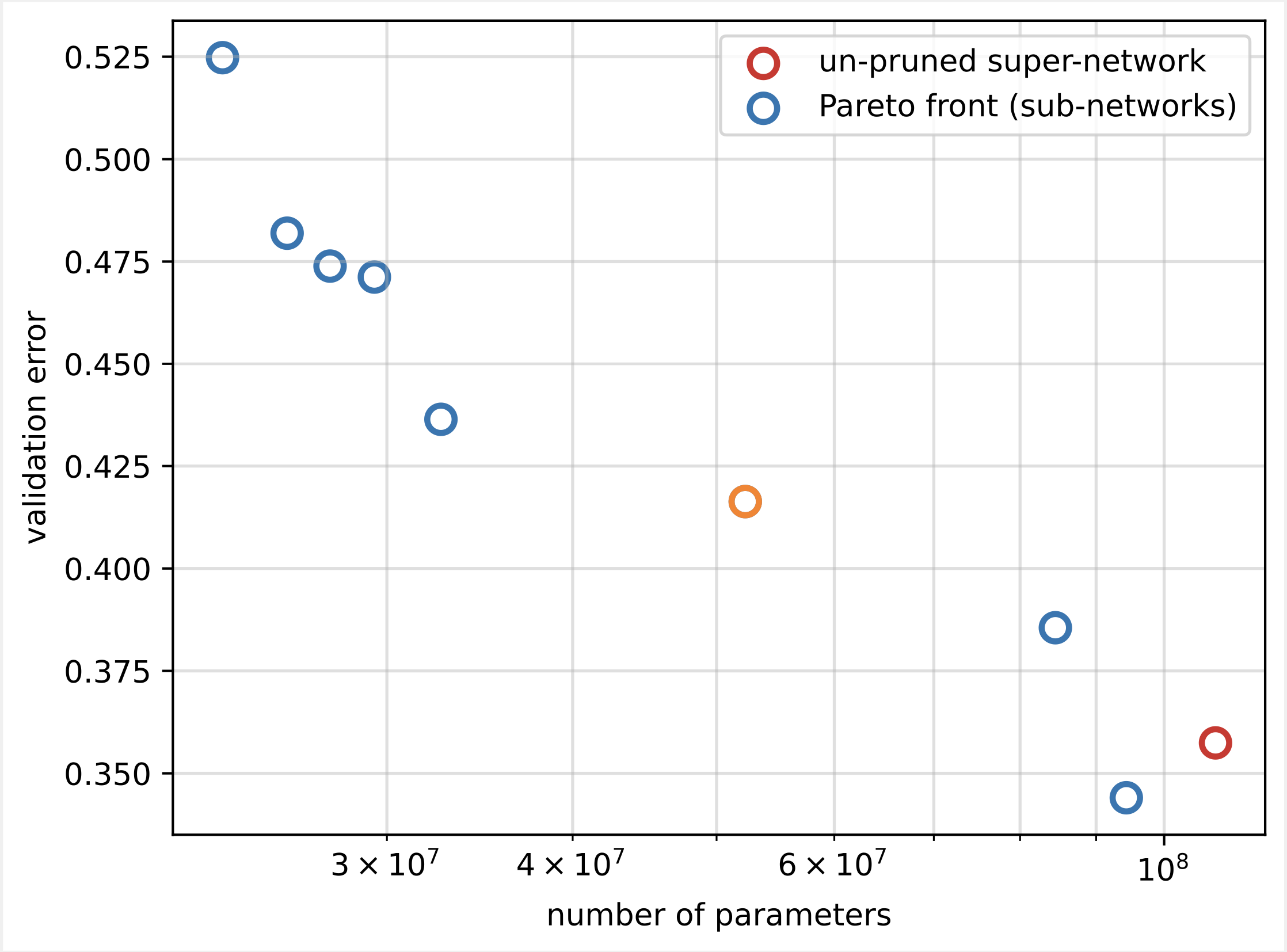

Ezután egy Pareto-halmaz (más néven Pareto-határ vagy Pareto-optimális halmaz) segítségével vizualizáljuk az eredményeket, amely segít azonosítani az alhálózatok azon optimális halmazait, amelyek az összes többi alhálózatot uralják az objektív metrikában (érvényesítési hiba):

Először az AMT hangolási feladatból gyűjtjük össze az adatokat. Ezután ábrázoljuk a Pareto halmazt a segítségével matplotlob.pyplot paraméterek számával az x tengelyen és érvényesítési hibával az y tengelyen. Ez azt jelenti, hogy amikor a Pareto halmaz egyik alhálózatáról a másikra lépünk, vagy fel kell áldoznunk a teljesítményt vagy a modellméretet, de javítanunk kell a másikat. Végső soron a Pareto készlet rugalmasságot biztosít számunkra, hogy kiválaszthassuk a preferenciáinknak leginkább megfelelő alhálózatot. Eldönthetjük, hogy mennyivel szeretnénk csökkenteni hálózatunk méretét, és mennyi teljesítményt vagyunk hajlandók feláldozni.

Telepítse a finomhangolt BERT-modellt és a NAS-optimalizált alhálózati modellt a SageMaker segítségével

Ezután telepítjük a Pareto-készletünk legnagyobb modelljét, amely a legkisebb mértékű teljesítményromláshoz vezet. SageMaker végpont. A legjobb modell az, amely optimális kompromisszumot biztosít az érvényesítési hiba és a paraméterek száma között a mi használati esetünkben.

Modell-összehasonlítás

Felvettünk egy előre betanított BERT-alapmodellt, finomhangoltuk egy tartományspecifikus adatkészlettel, lefuttattunk egy NAS-keresést a domináns alhálózatok azonosítására az objektív mérőszámok alapján, és a levágott modellt egy SageMaker végponton telepítettük. Ezenkívül az előre betanított BERT alapmodellt vettük, és az alapmodellt egy második SageMaker-végponton telepítettük. Ezután futottunk terheléses tesztelés a Locust mindkét következtetési végponton használta, és értékelte a teljesítményt a válaszidő szempontjából.

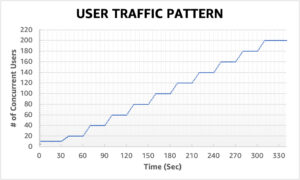

Először importáljuk a szükséges Locust és Boto3 könyvtárakat. Ezután összeállítunk egy kérés metaadatokat, és rögzítjük a terhelési teszteléshez használandó kezdési időpontot. Ezután a hasznos terhelés a BotoClient-en keresztül a SageMaker végpont meghívó API-jához kerül, hogy szimulálja a valós felhasználói kéréseket. A Locust segítségével több virtuális felhasználót generálunk, hogy párhuzamosan küldjenek kéréseket, és mérjék a végpont teljesítményét terhelés alatt. A tesztek végrehajtása a felhasználók számának növelésével történik mind a két végpont esetében. A tesztek befejezése után a Locust minden telepített modellhez kiad egy kérésstatisztikai CSV-fájlt.

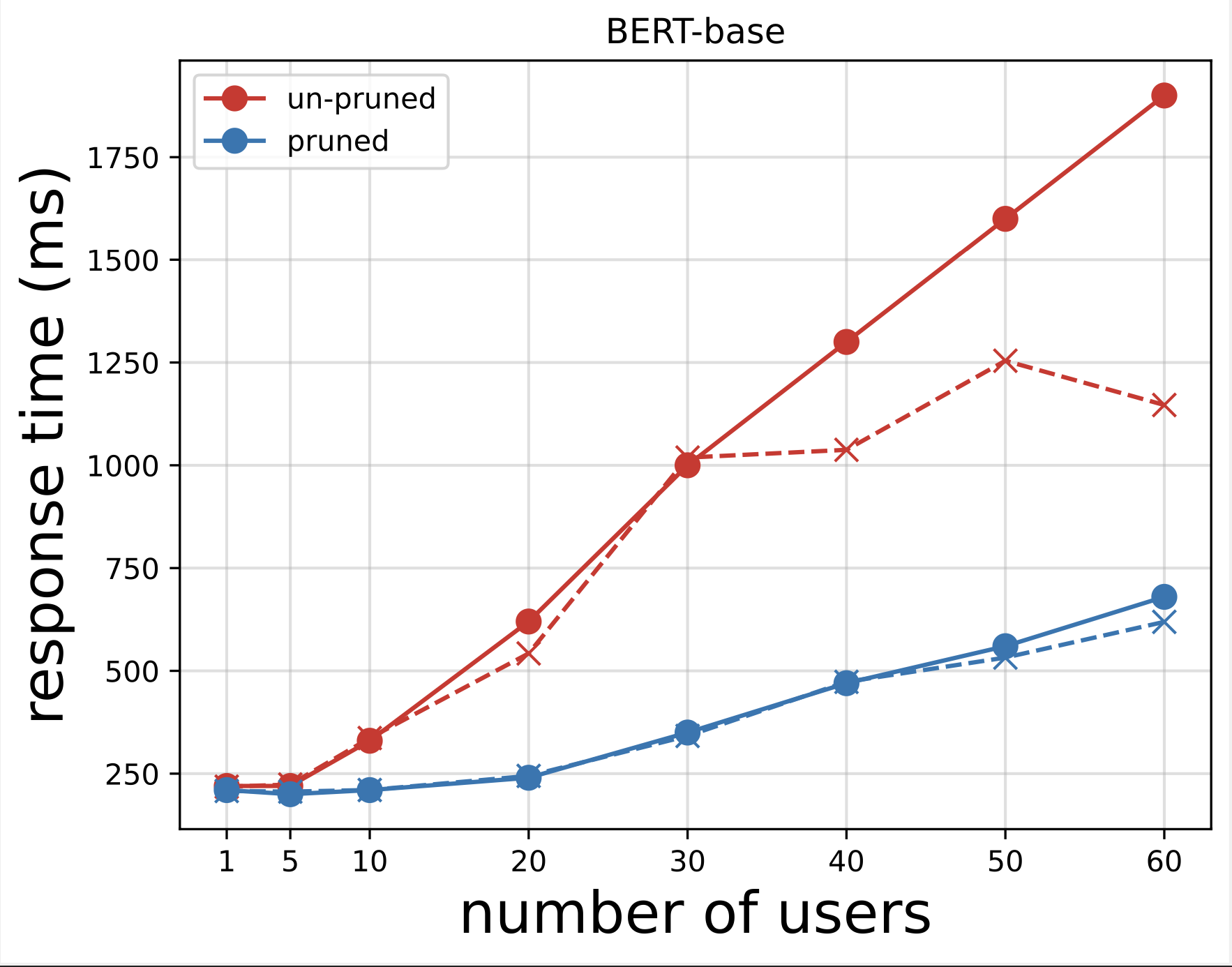

Ezután létrehozzuk a válaszidő diagramokat a Locust tesztek futtatása után letöltött CSV-fájlokból. A válaszidő és a felhasználók számának ábrázolásának célja a terhelési tesztek eredményeinek elemzése a modell végpontjainak válaszidejének hatásának megjelenítésével. A következő diagramon láthatjuk, hogy a NAS által levágott modellvégpont alacsonyabb válaszidőt ér el az alap BERT-modell végpontjához képest.

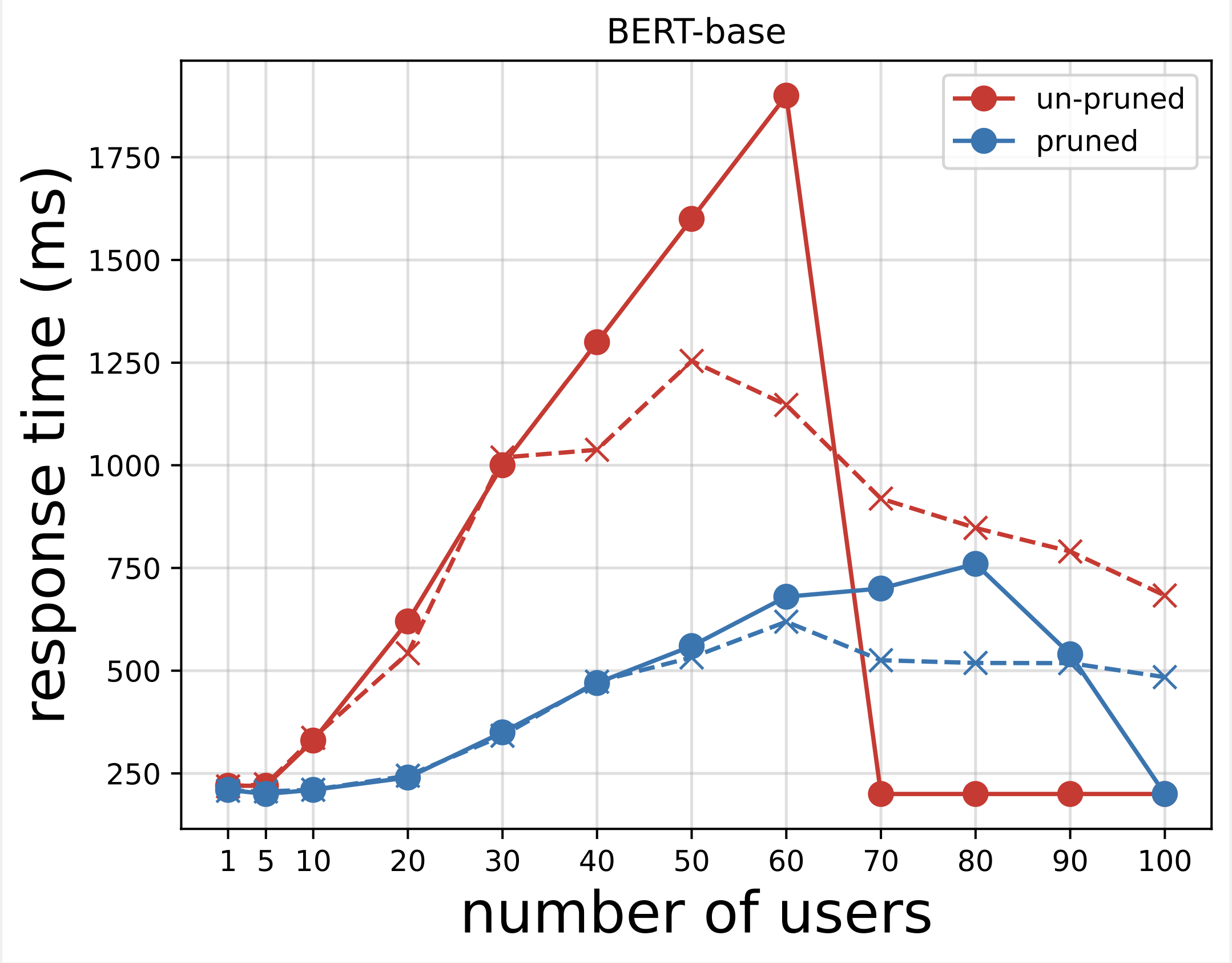

A második diagramon, amely az első diagram kiterjesztése, azt látjuk, hogy körülbelül 70 felhasználó után a SageMaker elkezdi lefojtani az alap BERT-modell végpontját, és kivételt dob. A NAS által levágott modell végpontja esetén azonban a szabályozás 90–100 felhasználónál és alacsonyabb válaszidővel történik.

A két diagramból azt látjuk, hogy a metszett modell gyorsabb reakcióidővel és jobban skálázódik, mint a metszetlen modellel. Ahogy skálázzuk a következtetési végpontok számát, ahogy az azoknál a felhasználóknál történik, akik nagyszámú következtetési végpontot telepítenek PLM-alkalmazásaikhoz, a költséghaszon és a teljesítménynövekedés kezd meglehetősen jelentőssé válni.

Tisztítsuk meg

A finomhangolt BERT alapmodell és a NAS által metszett modell SageMaker végpontjainak törléséhez hajtsa végre a következő lépéseket:

- A SageMaker konzolon válassza a lehetőséget Következtetés és a Végpontok a navigációs ablaktáblában.

- Válassza ki a végpontot, és törölje.

Alternatív megoldásként a SageMaker Studio notebookból futtassa a következő parancsokat a végpontnevek megadásával:

Következtetés

Ebben a bejegyzésben megvitattuk, hogyan használhatjuk a NAS-t egy finomhangolt BERT-modell metszésére. Először egy tartományspecifikus adatok felhasználásával betanítottunk egy alap BERT-modellt, és egy SageMaker-végponton telepítettük. Többcélú keresést végeztünk a finomhangolt alap BERT modellen a SageMaker AMT segítségével egy célfeladathoz. Megjelenítettük a Pareto frontot, és kiválasztottuk a Pareto optimális NAS által megvágott BERT modellt, és telepítettük a modellt egy második SageMaker végpontra. Terhelésvizsgálatot végeztünk a Locust segítségével, hogy szimuláljuk a felhasználókat, akik mindkét végpontot lekérdezik, és mértük és rögzítettük a válaszidőket egy CSV-fájlban. Mindkét modellnél ábrázoltuk a válaszidőt a felhasználók számának függvényében.

Megfigyeltük, hogy a metszett BERT modell szignifikánsan jobban teljesített mind a válaszidő, mind a példányfojtási küszöb tekintetében. Arra a következtetésre jutottunk, hogy a NAS által levágott modell ellenállóbb volt a végpont megnövekedett terhelésével szemben, így alacsonyabb válaszidőt tartott fenn, még akkor is, ha több felhasználó stresszelte a rendszert az alap BERT modellhez képest. Az ebben a bejegyzésben ismertetett NAS-technikát bármilyen nagy nyelvi modellre alkalmazhatja, hogy megtalálja azt a levágott modellt, amely lényegesen rövidebb válaszidővel képes végrehajtani a célfeladatot. Tovább optimalizálhatja a megközelítést, ha a késleltetést paraméterként használja az érvényesítési veszteség mellett.

Bár ebben a bejegyzésben NAS-t használunk, a kvantálás egy másik gyakori módszer a PLM-modellek optimalizálására és tömörítésére. A kvantálás csökkenti a súlyozások és aktiválások pontosságát egy betanított hálózatban a 32 bites lebegőpontosról az alacsonyabb bitszélességekre, például a 8 bites vagy 16 bites egészekre, ami egy tömörített modellt eredményez, amely gyorsabb következtetéseket generál. A kvantálás nem csökkenti a paraméterek számát; ehelyett csökkenti a meglévő paraméterek pontosságát, hogy tömörített modellt kapjon. A NAS metszés eltávolítja a redundáns hálózatokat a PLM-ben, ami egy ritka modellt hoz létre kevesebb paraméterrel. Általában a NAS-metszés és kvantálás együtt használatos a nagy PLM-ek tömörítésére a modell pontosságának megőrzése, az érvényesítési veszteségek csökkentése, a teljesítmény javítása és a modell méretének csökkentése érdekében. A PLM-ek méretének csökkentésére szolgáló egyéb általánosan használt technikák közé tartozik tudás lepárlása, mátrixfaktorizálásés desztillációs kaszkádok.

A blogbejegyzésben javasolt megközelítés olyan csapatok számára alkalmas, amelyek a SageMaker-t használják a modellek képzésére és finomhangolására tartomány-specifikus adatok felhasználásával, valamint a végpontok telepítésével következtetések generálására. Ha egy teljesen felügyelt szolgáltatást keres, amely a generatív AI-alkalmazások készítéséhez szükséges nagy teljesítményű alapmodellek választékát kínálja, fontolja meg Amazon alapkőzet. Ha előre betanított, nyílt forráskódú modelleket keres üzleti felhasználási esetek széles skálájához, és megoldássablonokhoz és példajegyzetfüzetekhez szeretne hozzáférni, fontolja meg Amazon SageMaker JumpStart. A Hugging Face BERT alaptokos modelljének előre betanított változata, amelyet ebben a bejegyzésben használtunk, szintén elérhető a SageMaker JumpStart-tól.

A szerzőkről

Aparajithan Vaidyanathan az AWS vállalati megoldások vezető építésze. Cloud Architect, több mint 24 éves tapasztalattal vállalati, nagyméretű és elosztott szoftverrendszerek tervezésében és fejlesztésében. Szakterülete a Generatív AI és a Machine Learning Data Engineering. Aspiráns maratoni futó, hobbija a túrázás, a kerékpározás, valamint a feleségével és két fiúval való időtöltés.

Aparajithan Vaidyanathan az AWS vállalati megoldások vezető építésze. Cloud Architect, több mint 24 éves tapasztalattal vállalati, nagyméretű és elosztott szoftverrendszerek tervezésében és fejlesztésében. Szakterülete a Generatív AI és a Machine Learning Data Engineering. Aspiráns maratoni futó, hobbija a túrázás, a kerékpározás, valamint a feleségével és két fiúval való időtöltés.

Aaron Klein az AWS Sr Applied Scientist, aki automatizált gépi tanulási módszerekkel dolgozik mély neurális hálózatokhoz.

Aaron Klein az AWS Sr Applied Scientist, aki automatizált gépi tanulási módszerekkel dolgozik mély neurális hálózatokhoz.

Jacek Golebiowski az AWS Sr alkalmazott tudósa.

Jacek Golebiowski az AWS Sr alkalmazott tudósa.

- SEO által támogatott tartalom és PR terjesztés. Erősödjön még ma.

- PlatoData.Network Vertical Generative Ai. Erősítse meg magát. Hozzáférés itt.

- PlatoAiStream. Web3 Intelligence. Felerősített tudás. Hozzáférés itt.

- PlatoESG. Carbon, CleanTech, Energia, Környezet, Nap, Hulladékgazdálkodás. Hozzáférés itt.

- PlatoHealth. Biotechnológiai és klinikai vizsgálatok intelligencia. Hozzáférés itt.

- Forrás: https://aws.amazon.com/blogs/machine-learning/reduce-inference-time-for-bert-models-using-neural-architecture-search-and-sagemaker-automated-model-tuning/

- :van

- :is

- :nem

- :ahol

- ][p

- $ UP

- 1

- 10

- 100

- 11

- 12

- 13

- 15%

- 17

- 19

- 20

- 26%

- 30

- 31

- 320

- 7

- 70

- 72

- 8

- 9

- a

- képesség

- Képes

- hozzáférés

- Fiók

- pontosság

- Elérése

- ér

- aktiválások

- mellett

- Örökbefogadás

- Után

- AI

- cél

- Célzás

- algoritmusok

- Minden termék

- lehetővé

- lehetővé téve

- lehetővé teszi, hogy

- Is

- amazon

- Az Amazon Web Services

- összeg

- an

- elemzés

- analitika

- elemez

- és a

- Másik

- üzenetrögzítő

- bármilyen

- api

- alkalmazások

- alkalmazott

- alkalmaz

- Alkalmazása

- megközelítés

- jóváhagyás

- körülbelül

- építészet

- VANNAK

- TERÜLET

- területek

- érvek

- körül

- mesterséges

- AS

- becsvágyó

- kijelölt

- társult

- At

- megkísérlése

- részt vesz

- Automatizált

- automaták

- Automatikus

- automatizálás

- Automatizálás

- elérhető

- AWS

- Tengely

- Egyenleg

- bázis

- alapján

- BE

- válik

- előtt

- viselkedés

- benchmarking

- Előnyök

- BEST

- Jobb

- között

- Bit

- test

- mindkét

- épít

- üzleti

- Üzleti folyamat

- de

- by

- TUD

- jelölt

- képességek

- eset

- esetek

- katalógus

- változik

- Táblázatos

- táblázatok

- chatbots

- választás

- A pop-art design, négy időzóna kijelzése egyszerre és méretének arányai azok az érvek, amelyek a NeXtime Time Zones-t kiváló választássá teszik. Válassza a

- választott

- osztály

- besorolás

- Klinikai

- szorosan

- felhő

- kód

- gyűjt

- gyűjtemény

- kombinációk

- kereskedelmi

- Közös

- általában

- képest

- teljes

- Befejezett

- bonyolult

- bonyolultság

- alkatrészek

- számítási

- Kiszámít

- fogalmak

- megkötött

- Fontolja

- áll

- Konzol

- korlátok

- konstrukció

- fogyasztás

- tartalmaz

- tartalom

- tartalomalkotás

- kontextus

- folytatódik

- kontraszt

- ellenőrzések

- Megfelelő

- Költség

- kiadások

- számít

- teremt

- teremt

- teremtés

- vevő

- Vevőszolgálat

- dátum

- adat-tudomány

- adatkészletek

- dátum idő

- dönt

- Döntéshozatal

- elszánt

- mély

- meghatározott

- meghatározott

- meghatározó

- demó

- bizonyítani

- attól

- telepíteni

- telepített

- bevezetéséhez

- bevet

- leírt

- Design

- tervezés

- kívánatos

- fejlesztése

- különböző

- tárgyalt

- megosztott

- dokumentum

- Nem

- uralkodó

- dominálnak

- ne

- két

- alatt

- e

- minden

- hatékonyság

- hatékony

- bármelyik

- Endpoint

- Mérnöki

- Motorok

- elég

- belép

- Vállalkozás

- vállalati elfogadás

- egység

- belépés

- Környezet

- korszak

- hiba

- értékelni

- értékelték

- értékelések

- Még

- események

- példa

- Kivéve

- kivétel

- kizárólagosan

- létező

- tapasztalat

- Magyarázza

- magyarázható

- kiterjesztés

- Arc

- hamis

- gyorsabb

- Jellemzők

- Visszacsatolás

- kevesebb

- mező

- filé

- Fájlok

- utolsó

- Találjon

- megtalálása

- vezetéknév

- rögzített

- Rugalmasság

- úszó

- következő

- Lábnyom

- A

- talált

- Alapítvány

- ból ből

- front

- Határ

- teljesen

- funkció

- további

- generál

- generál

- nemző

- Generatív AI

- kap

- adott

- cél

- GPU

- szürke

- megtörténik

- Legyen

- he

- fej

- fejek

- egészségügyi

- segít

- Rejtett

- nagy teljesítményű

- <p></p>

- övé

- történelem

- vendéglátó

- házigazdája

- NYITVATARTÁS

- Hogyan

- How To

- azonban

- HTML

- http

- HTTPS

- HuggingFace

- Hiperparaméter optimalizálás

- Hiperparaméter hangolás

- i

- azonosítani

- IDX

- if

- ábrázol

- Hatás

- Hatások

- végre

- importál

- javul

- javított

- javulás

- javuló

- in

- tartalmaz

- Növelje

- <p></p>

- növekvő

- információ

- Infrastruktúra

- bemenet

- példa

- helyette

- Intelligens

- bele

- IT

- ITS

- Munka

- Állások

- jpg

- json

- tudás

- ismert

- nyelv

- nagy

- nagyarányú

- legnagyobb

- Késleltetés

- réteg

- tojók

- vezetékek

- TANUL

- tanulás

- legkevésbé

- hadd

- könyvtárak

- könyvtár

- vonal

- kiszámításának

- log

- fakitermelés

- keres

- le

- veszteség

- alacsonyabb

- gép

- gépi tanulás

- fenntartása

- fenntartása

- férfi

- sikerült

- Marathon

- maszk

- matplotlib

- maximális

- Lehet..

- jelenti

- intézkedés

- mérő

- orvosi

- Találkozik

- Memory design

- Metaadatok

- mód

- metrikus

- Metrics

- esetleg

- Perc

- ML

- modell

- modellezés

- modellek

- moduláris

- több

- mozog

- sok

- többszörös

- kell

- név

- Nevezett

- nevek

- nas

- Természetes

- Természetes nyelvi feldolgozás

- Keresse

- Navigáció

- elengedhetetlen

- Szükség

- szükséges

- igények

- hálózat

- hálózatok

- ideg-

- neurális hálózat

- neurális hálózatok

- következő

- NLP

- Egyik sem

- megjegyezni

- jegyzetfüzet

- Most

- szám

- tárgy

- célkitűzés

- célok

- megfigyelni

- of

- kedvezmény

- ajánlat

- Ajánlatok

- on

- ONE

- online

- online kiskereskedő

- csak

- nyitva

- nyílt forráskódú

- optimálisan

- optimalizálás

- Optimalizálja

- optimalizált

- Optimalizálja

- optimalizálása

- or

- érdekében

- eredeti

- Más

- mi

- ki

- teljesítmény

- kimenetek

- felett

- átfogó

- áttekintés

- saját

- párok

- üvegtábla

- Párhuzamos

- paraméter

- paraméterek

- Pareto

- rész

- Elmúlt

- ösvény

- beteg

- minták

- Teljesít

- teljesítmény

- teljesített

- előadó

- Előadja

- engedélyek

- Plató

- Platón adatintelligencia

- PlatoData

- pont

- pont

- pozíciók

- állás

- Pontosság

- előrejelzés

- Predictor

- preferenciák

- előkészített

- előfeltételek

- be

- korábban

- Fő

- Probléma

- folyamat

- Folyamat automatizálás

- Folyamatok

- feldolgozás

- Termékek

- termelékenység

- javasolt

- ellátó

- biztosít

- amely

- vontatás

- Húz

- cél

- célokra

- Piton

- pytorch

- Kérdések és válaszok

- kérdés

- egészen

- véletlen

- hatótávolság

- gyors

- Az árak

- Nyers

- igazi

- elismerés

- elismerik

- felismerés

- Ajánlást

- ajánlások

- rekord

- feljegyzett

- Piros

- csökkenteni

- Csökkent

- csökkenti

- regex

- összefüggő

- elmozdít

- eltávolítása

- Jelentések

- képviselet

- kérni

- kéri

- kötelező

- követelmények

- rugalmas

- forrás

- Tudástár

- illetőleg

- válasz

- Eredmények

- kiskereskedő

- visszatartó

- Visszatér

- lovaglás

- Kockázat

- SOR

- futás

- futó

- futás

- fut

- s

- sacrificar

- sagemaker

- SageMaker következtetés

- Megtakarítás

- Skála

- Mérleg

- Tudomány

- Tudós

- pontszám

- forgatókönyv

- Keresés

- Keresők

- keres

- Második

- Rész

- lát

- válasszuk

- kiválasztott

- MAGA

- küld

- mondat

- érzés

- Sorozat

- szolgáltatás

- Szolgáltatások

- ülés

- készlet

- Szettek

- beállítás

- Műsorok

- jelek

- jelentősen

- Egyszerű

- egyszerre

- egyetlen

- Méret

- kisebb

- So

- szoftver

- megoldások

- Megoldások

- néhány

- forrás

- Hely

- specializált

- specializálódott

- különleges

- kifejezetten

- Költési

- osztott

- kezdet

- kezdődik

- Állami

- statisztika

- Lépés

- Lépései

- tárolás

- szerkezeti

- szerkesztett

- stúdió

- lényeges

- sikeres

- sikeresen

- ilyen

- megfelelő

- kíséret

- ÖSSZEFOGLALÓ

- rendszer

- Systems

- Vesz

- tart

- cél

- Feladat

- feladatok

- csapat

- technika

- technikák

- sablonok

- feltételek

- Tesztelés

- tesztek

- szöveg

- Szöveg osztályozása

- szövegi

- mint

- hogy

- A

- azok

- akkor

- Ott.

- ebből adódóan

- Ezek

- ezt

- három

- küszöb

- Keresztül

- idő

- alkalommal

- nak nek

- együtt

- jelképes

- vett

- szerszám

- szerszámok

- kereskedelem

- Kereskedés

- Vonat

- kiképzett

- Képzések

- transzformátor

- transzformerek

- igaz

- megpróbál

- hangolás

- kettő

- típus

- típusok

- tipikus

- jellemzően

- Végül

- alatt

- folyamatban lévő

- megértés

- egységek

- us

- használ

- használati eset

- használt

- használó

- Felhasználók

- használ

- segítségével

- érvényesítés

- érték

- Értékek

- változat

- keresztül

- Tényleges

- Képzeld

- vs

- akar

- volt

- we

- háló

- webes szolgáltatások

- JÓL

- amikor

- vajon

- ami

- míg

- WHO

- széles

- Széleskörű

- széles körben

- feleség

- Wikipedia

- lesz

- hajlandó

- val vel

- belül

- Munka

- munkafolyamat

- dolgozó

- X

- év

- Hozam

- te

- A te

- zephyrnet