Amazon SageMaker a gépi tanulási (ML) infrastruktúra és modelltelepítési lehetőségek széles választékát kínálja, hogy megfeleljen az ML következtetési igényeinek. Ez egy teljesen felügyelt szolgáltatás, és az MLOps eszközökkel integrálható, így Ön a modell üzembe helyezésének méretezésére, a következtetési költségek csökkentésére, a modellek hatékonyabb kezelésére a termelésben és a működési terhek csökkentésén dolgozik. A SageMaker többféle lehetőséget kínál következtetési lehetőségek így kiválaszthatja a munkaterhelésének leginkább megfelelő lehetőséget.

A CPU-k új generációi a speciális beépített utasításoknak köszönhetően jelentős teljesítménynövekedést kínálnak az ML következtetések terén. Ebben a bejegyzésben arra összpontosítunk, hogyan használhatod ki a AWS Graviton3alapú Amazon Elastic Compute Cloud (EC2) C7g példányok a következtetések költségeinek akár 50%-os csökkentését a hasonló EC2 példányokhoz képest valós idejű következtetés az Amazon SageMakeren. Megmutatjuk, hogyan értékelheti ki a következtetési teljesítményt, és hogyan válthatja át az ML munkaterhelését az AWS Graviton példányokra néhány lépésben.

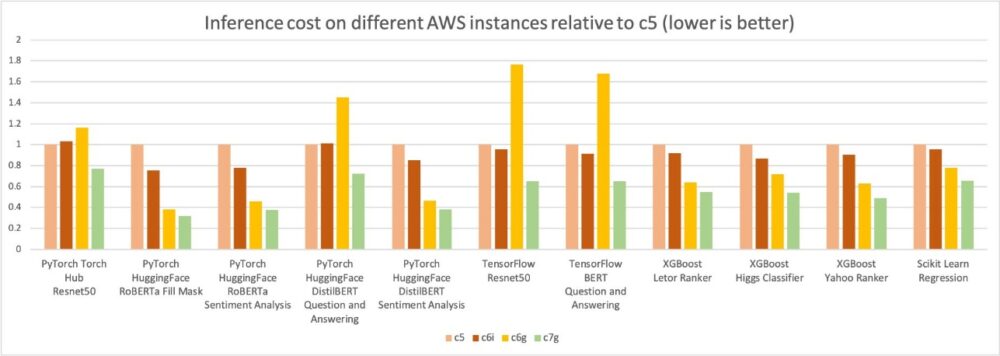

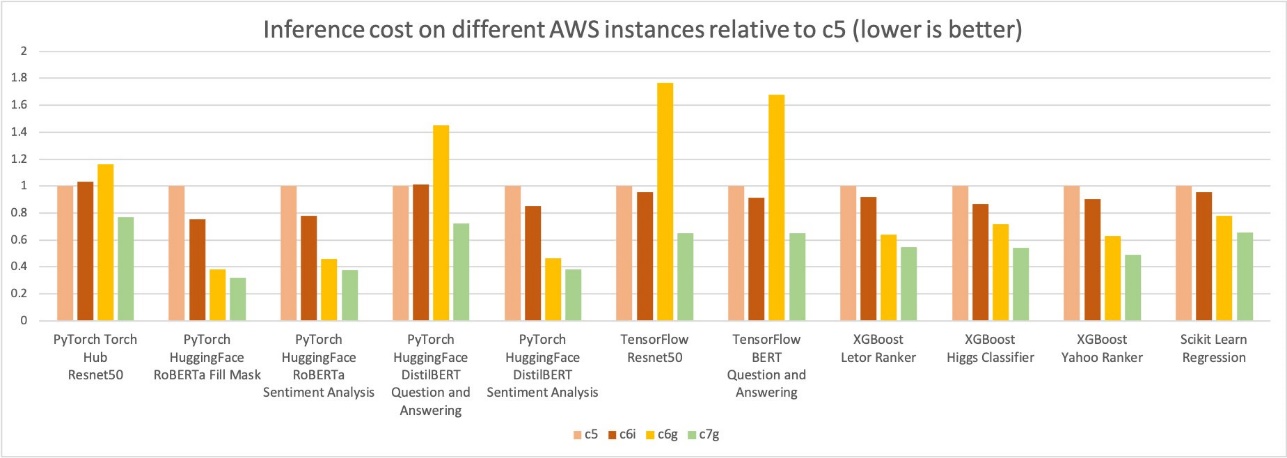

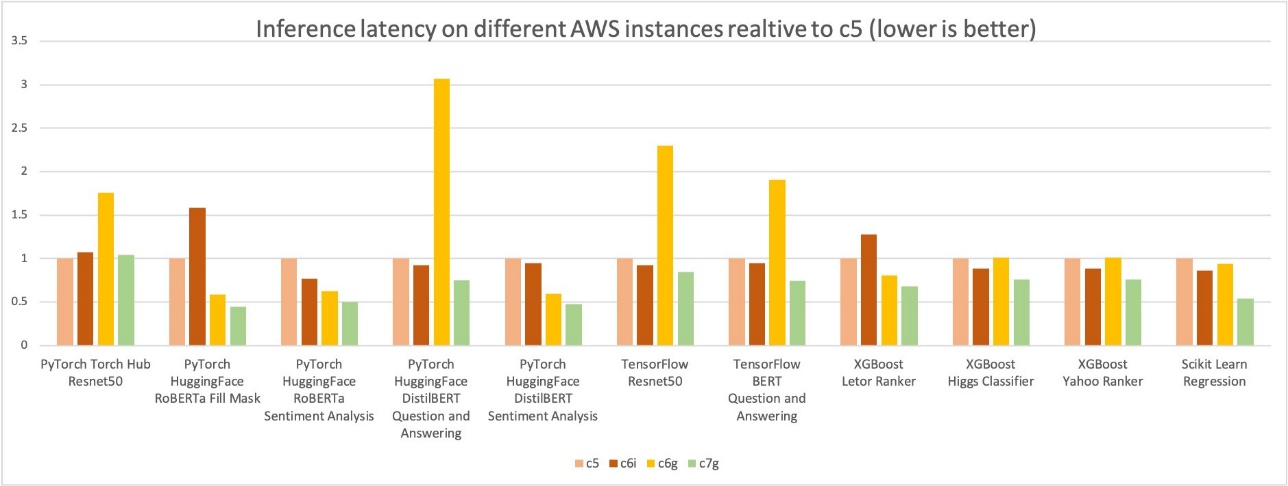

Az ügyfélalkalmazások népszerű és széles körének lefedése érdekében ebben a bejegyzésben a PyTorch, TensorFlow, XGBoost és a scikit-learn keretrendszerek következtetési teljesítményét tárgyaljuk. Lefedjük a számítógépes látást (CV), a természetes nyelvi feldolgozást (NLP), az osztályozást és a rangsorolási forgatókönyveket a modellekhez, valamint az ml.c6g, ml.c7g, ml.c5 és ml.c6i SageMaker példányokat a teljesítményértékeléshez.

Benchmarking eredmények

Az AWS 50%-os költségmegtakarítást mért a PyTorch, TensorFlow, XGBoost és a scikit-learn modellkövetkeztetések esetén az AWS Graviton3-alapú EC2 C7g példányokkal az Amazon SageMaker hasonló EC2 példányaihoz képest. Ugyanakkor a következtetés késleltetése is csökken.

Összehasonlításképpen négy különböző példánytípust használtunk:

Mind a négy példány 16 vCPU-val és 32 GiB memóriával rendelkezik.

A következő grafikonon a négy példánytípus millióra eső költségét mértük. Tovább normalizáltuk az egymillióankénti költséget egy c5.4xlarge példányra, amely a diagram Y tengelyén 1-ként van mérve. Látható, hogy az XGBoost modelleknél a c7g.4xlarge (AWS Graviton3) millióra jutó költsége a c50xlarge körülbelül 5.4%-a és a c40i.6xlarge 4%-a; a PyTorch NLP modellek esetében a költségmegtakarítás körülbelül 30–50% a c5 és c6i.4xlarge példányokhoz képest. Más modelleknél és keretrendszereknél legalább 30%-os költségmegtakarítást mértünk a c5 és c6i.4xlarge példányokhoz képest.

Az előző következtetési költség-összehasonlítási grafikonhoz hasonlóan a következő grafikon a p90 modell késleltetését mutatja ugyanazon négy példánytípusra. Tovább normalizáltuk a késleltetési eredményeket a c5.4xlarge példányra, amelyet 1-ben mérünk a diagram Y tengelyén. A c7g.4xlarge (AWS Graviton3) modell következtetési késleltetése akár 50%-kal jobb, mint a c5.4xlarge és c6i.4xlarge modelleken mért késések.

Migráció az AWS Graviton példányokra

A modellek AWS Graviton példányokra való üzembe helyezéséhez használhatja bármelyiket AWS Deep Learning Containers (DLC-k) ill hozza a saját konténereit amelyek kompatibilisek az ARMv8.2 architektúrával.

A modellek áttelepítése (vagy új telepítése) az AWS Graviton-példányokra egyszerű, mert az AWS nemcsak konténereket biztosít a PyTorch, TensorFlow, scikit-learn és XGBoost-modellek számára, hanem a modellek építészetileg agnosztikusak is. Saját könyvtárakat is hozhat, de ügyeljen arra, hogy a tároló olyan környezettel készüljön, amely támogatja az ARMv8.2 architektúrát. További információkért lásd Saját algoritmustároló építése.

A modell üzembe helyezéséhez három lépést kell végrehajtania:

- Hozzon létre egy SageMaker modellt. Ez többek között tartalmazza a modellfájl helyére, a telepítéshez használt tárolóra és a következtetési parancsfájl helyére vonatkozó információkat. (Ha egy számításra optimalizált következtetéspéldányban már telepített egy létező modellt, akkor ezt a lépést kihagyhatja.)

- Hozzon létre egy végpont konfigurációt. Ez információkat tartalmaz a végponthoz kívánt példány típusáról (például ml.c7g.xlarge az AWS Graviton3 esetében), az előző lépésben létrehozott modell nevéről és a végpontonkénti példányok számáról.

- Indítsa el a végpontot az előző lépésben létrehozott végpont-konfigurációval.

A részletes utasításokért lásd: Futtasson gépi tanulási következtetési munkaterheléseket AWS Graviton alapú példányokon az Amazon SageMaker segítségével

Benchmarking módszertana

Használtuk Amazon SageMaker Inference Recommender a teljesítmény-benchmarking automatizálása a különböző példányokon. Ez a szolgáltatás összehasonlítja az Ön ML-modelljének teljesítményét a késleltetés és a költségek tekintetében a különböző példányokon, és azt a példányt és konfigurációt ajánlja, amely a legjobb teljesítményt nyújtja a legalacsonyabb költség mellett. A fent említett teljesítményadatokat az Inference Recommender segítségével gyűjtöttük össze. További részletekért lásd a GitHub repo.

Használhatja a mintafüzet a benchmarkok futtatásához és az eredmények reprodukálásához. A benchmarkinghoz a következő modelleket használtuk:

Következtetés

Az AWS 50%-os költségmegtakarítást mért a PyTorch, TensorFlow, XGBoost és a scikit-learn modellkövetkeztetések esetén az AWS Graviton3-alapú EC2 C7g példányokkal az Amazon SageMaker hasonló EC2 példányaihoz képest. A jelen bejegyzésben ismertetett lépéseket követve migrálhatja meglévő következtetési használati eseteit, vagy telepíthet új ML-modelleket az AWS Gravitonon. Arra is hivatkozhat AWS Graviton műszaki útmutató, amely az optimalizált könyvtárak és a bevált gyakorlatok listáját tartalmazza, amelyek segítenek költségelőnyök elérésében az AWS Graviton-példányokkal különböző munkaterheléseken.

Ha olyan használati eseteket talál, amikor az AWS Graviton nem tapasztal hasonló teljesítménynövekedést, forduljon hozzánk. Továbbra is további teljesítményjavításokat fogunk végezni, hogy az AWS Graviton a legköltséghatékonyabb és leghatékonyabb általános célú processzor legyen az ML következtetésekhez.

A szerzőkről

Sunita Nadampalli az AWS szoftverfejlesztési menedzsere. Ő vezeti a Graviton szoftverek teljesítményoptimalizálását a gépi tanuláshoz, a HPC-hez és a multimédiás munkaterhelésekhez. Szenvedélye a nyílt forráskódú fejlesztés és költséghatékony szoftvermegoldások szállítása az Arm SoC-kkel.

Sunita Nadampalli az AWS szoftverfejlesztési menedzsere. Ő vezeti a Graviton szoftverek teljesítményoptimalizálását a gépi tanuláshoz, a HPC-hez és a multimédiás munkaterhelésekhez. Szenvedélye a nyílt forráskódú fejlesztés és költséghatékony szoftvermegoldások szállítása az Arm SoC-kkel.

Jaymin Desai szoftverfejlesztő mérnök az Amazon SageMaker Inference csapatánál. Szenvedélyesen törekszik a mesterséges intelligencia tömegekhez való eljuttatására és a legmodernebb mesterségesintelligencia-eszközök használhatóságának javítására azáltal, hogy azokat funkciókká és szolgáltatásokká alakítja. Szabadidejében szeret zenélni és utazni.

Jaymin Desai szoftverfejlesztő mérnök az Amazon SageMaker Inference csapatánál. Szenvedélyesen törekszik a mesterséges intelligencia tömegekhez való eljuttatására és a legmodernebb mesterségesintelligencia-eszközök használhatóságának javítására azáltal, hogy azokat funkciókká és szolgáltatásokká alakítja. Szabadidejében szeret zenélni és utazni.

Mike Schneider rendszerfejlesztő, székhelye Phoenix AZ. Tagja a Deep Learning konténereknek, támogatva a különböző Framework konténerképeket, beleértve a Graviton Inference-t is. Az infrastruktúra hatékonyságának és stabilitásának elkötelezettje.

Mike Schneider rendszerfejlesztő, székhelye Phoenix AZ. Tagja a Deep Learning konténereknek, támogatva a különböző Framework konténerképeket, beleértve a Graviton Inference-t is. Az infrastruktúra hatékonyságának és stabilitásának elkötelezettje.

Mohan Gandhi az AWS vezető szoftvermérnöke. Az elmúlt 10 évben az AWS-nél dolgozott, és különféle AWS-szolgáltatásokon dolgozott, mint például az EMR, az EFA és az RDS. Jelenleg a SageMaker Inference Experience fejlesztésére összpontosít. Szabadidejében szeret túrázni és maratonozni.

Mohan Gandhi az AWS vezető szoftvermérnöke. Az elmúlt 10 évben az AWS-nél dolgozott, és különféle AWS-szolgáltatásokon dolgozott, mint például az EMR, az EFA és az RDS. Jelenleg a SageMaker Inference Experience fejlesztésére összpontosít. Szabadidejében szeret túrázni és maratonozni.

Qingwei Li az Amazon Web Services gépi tanulási szakértője. Ph.D fokozatot szerzett. az Operations Researchben, miután feltörte tanácsadója kutatási támogatási számláját, és nem teljesítette az ígért Nobel-díjat. Jelenleg a pénzügyi szolgáltatások és a biztosítási ágazat ügyfelei számára segít gépi tanulási megoldások kiépítésében az AWS-en. Szabadidejében szeret olvasni és tanítani.

Qingwei Li az Amazon Web Services gépi tanulási szakértője. Ph.D fokozatot szerzett. az Operations Researchben, miután feltörte tanácsadója kutatási támogatási számláját, és nem teljesítette az ígért Nobel-díjat. Jelenleg a pénzügyi szolgáltatások és a biztosítási ágazat ügyfelei számára segít gépi tanulási megoldások kiépítésében az AWS-en. Szabadidejében szeret olvasni és tanítani.

Wayne Toh a Graviton megoldások specialistája az AWS-nél. Arra összpontosít, hogy segítse az ügyfeleket az ARM architektúra átvételében a nagyméretű konténermunka során. Mielőtt csatlakozott az AWS-hez, Wayne több nagy szoftvergyártónál dolgozott, köztük az IBM-nél és a Red Hatnél.

Wayne Toh a Graviton megoldások specialistája az AWS-nél. Arra összpontosít, hogy segítse az ügyfeleket az ARM architektúra átvételében a nagyméretű konténermunka során. Mielőtt csatlakozott az AWS-hez, Wayne több nagy szoftvergyártónál dolgozott, köztük az IBM-nél és a Red Hatnél.

Lauren Mullennex Megoldástervezőként dolgozik Denverben, CO. Ügyfelekkel dolgozik, hogy segítsen nekik megoldásokat készíteni az AWS-en. Szabadidejében szeret túrázni és hawaii konyhát főzni.

Lauren Mullennex Megoldástervezőként dolgozik Denverben, CO. Ügyfelekkel dolgozik, hogy segítsen nekik megoldásokat készíteni az AWS-en. Szabadidejében szeret túrázni és hawaii konyhát főzni.

- SEO által támogatott tartalom és PR terjesztés. Erősödjön még ma.

- PlatoAiStream. Web3 adatintelligencia. Felerősített tudás. Hozzáférés itt.

- A jövő pénzverése – Adryenn Ashley. Hozzáférés itt.

- Részvények vásárlása és eladása PRE-IPO társaságokban a PREIPO® segítségével. Hozzáférés itt.

- Forrás: https://aws.amazon.com/blogs/machine-learning/reduce-amazon-sagemaker-inference-cost-with-aws-graviton/

- :van

- :is

- :nem

- :ahol

- $ UP

- 1

- 10

- 100

- 7

- 98

- a

- Rólunk

- Fiók

- Elérése

- át

- hozzá

- elfogadja

- Előny

- Után

- AI

- algoritmus

- már

- Is

- amazon

- Amazon SageMaker

- Az Amazon Web Services

- között

- an

- és a

- alkalmazások

- építészet

- VANNAK

- ARM

- AS

- Eszközök

- At

- automatizált

- AWS

- alapján

- BE

- mert

- óta

- benchmarking

- referenciaértékek

- Előnyök

- BEST

- legjobb gyakorlatok

- Jobb

- hoz

- széles

- Törött

- épít

- épült

- beépített

- teher

- de

- by

- TUD

- esetek

- Táblázatos

- besorolás

- felhő

- CO

- hasonló

- képest

- összehasonlítás

- összeegyeztethető

- teljes

- Kiszámít

- számítógép

- Számítógépes látás

- Configuration

- tartalmaz

- Konténer

- Konténerek

- folytatódik

- Költség

- költségmegtakarítás

- költséghatékony

- kiadások

- terjed

- készítette

- Jelenleg

- vevő

- Ügyfelek

- dátum

- elszánt

- mély

- mély tanulás

- szállít

- átadó

- Denver

- telepíteni

- telepített

- bevetés

- részletes

- részletek

- Fejlesztő

- Fejlesztés

- különböző

- megvitatni

- nem

- két

- hatékonyan

- hatékonyság

- hatékony

- bármelyik

- Endpoint

- mérnök

- Környezet

- értékelni

- példa

- létező

- tapasztalat

- Feltárása

- Sikertelen

- Jellemzők

- kevés

- filé

- pénzügyi

- pénzügyi szolgáltatás

- Találjon

- Összpontosít

- összpontosított

- koncentrál

- következő

- A

- négy

- Keretrendszer

- keretek

- Ingyenes

- további

- Nyereség

- Általános rendeltetésű

- generációk

- ad

- biztosít

- grafikon

- kalap

- Legyen

- he

- segít

- segít

- segít

- neki

- övé

- vendéglátó

- Hogyan

- hpc

- HTML

- HTTPS

- IBM

- if

- képek

- javulás

- fejlesztések

- javuló

- in

- tartalmaz

- Beleértve

- ipar

- információ

- Infrastruktúra

- példa

- utasítás

- biztosítás

- integrál

- bele

- csatlakozott

- jpg

- éppen

- nyelv

- nagy

- keresztnév

- Késleltetés

- vezetékek

- tanulás

- legkevésbé

- könyvtárak

- mint

- Kedvencek

- Lista

- elhelyezkedés

- legalacsonyabb

- gép

- gépi tanulás

- csinál

- kezelése

- menedzser

- tömegek

- Találkozik

- tag

- Memory design

- vándorol

- elvándorlás

- millió

- ML

- MLOps

- modell

- modellek

- több

- a legtöbb

- multimédia

- többszörös

- zene

- név

- Természetes

- Természetes nyelvi feldolgozás

- Szükség

- igények

- Új

- NLP

- Nóbel díj

- szám

- of

- ajánlat

- on

- csak

- nyílt forráskódú

- operatív

- Művelet

- optimalizált

- opció

- Opciók

- or

- érdekében

- Más

- ki

- saját

- paraméterek

- szenvedélyes

- teljesítmény

- főnix

- vedd

- Plató

- Platón adatintelligencia

- PlatoData

- kérem

- Népszerű

- állás

- gyakorlat

- előző

- Előzetes

- díj

- feldolgozás

- Processzor

- Termelés

- igért

- ad

- feltéve,

- biztosít

- pytorch

- hatótávolság

- Ranking

- el

- Olvasás

- kapott

- ajánlja

- Piros

- Red Hat

- csökkenteni

- Csökkent

- kutatás

- Eredmények

- futás

- sagemaker

- SageMaker következtetés

- azonos

- Megtakarítás

- Skála

- forgatókönyvek

- scikit elsajátítható

- lát

- kiválasztás

- idősebb

- szolgáltatás

- Szolgáltatások

- számos

- ő

- előadás

- Műsorok

- jelentős

- hasonló

- So

- szoftver

- szoftverfejlesztés

- Software Engineer

- Megoldások

- szakember

- specializált

- Stabilitás

- csúcs-

- Lépés

- Lépései

- egyértelmű

- Támogató

- Támogatja

- kapcsoló

- Systems

- Vesz

- bevétel

- Tanítási

- csapat

- Műszaki

- tensorflow

- feltételek

- mint

- hogy

- A

- az információ

- Őket

- ezt

- három

- idő

- nak nek

- szerszámok

- Utazó

- típus

- típusok

- us

- használhatóság

- használ

- használt

- segítségével

- különféle

- gyártók

- látomás

- akar

- we

- háló

- webes szolgáltatások

- JÓL

- ami

- lesz

- val vel

- Munka

- dolgozott

- művek

- XGBoost

- év

- te

- A te

- zephyrnet