Postingan ini ditulis bersama Greg Benson, Kepala Ilmuwan; Aaron Kesler, Manajer Produk Senior; dan Rich Dill, Arsitek Solusi Perusahaan dari SnapLogic.

Banyak pelanggan yang membangun aplikasi AI generatif Batuan Dasar Amazon dan Pembisik Kode Amazon untuk membuat artefak kode berdasarkan bahasa alami. Kasus penggunaan ini menyoroti bagaimana model bahasa besar (LLM) mampu menjadi penerjemah antara bahasa manusia (Inggris, Spanyol, Arab, dan lainnya) dan bahasa yang dapat ditafsirkan mesin (Python, Java, Scala, SQL, dan sebagainya) serta bahasa yang canggih. penalaran internal. Kemampuan yang muncul dalam LLM ini telah memaksa pengembang perangkat lunak untuk menggunakan LLM sebagai alat otomatisasi dan peningkatan UX yang mengubah bahasa alami menjadi bahasa khusus domain (DSL): instruksi sistem, permintaan API, artefak kode, dan banyak lagi. Dalam posting ini, kami menunjukkan caranya Logika Snap, pelanggan AWS, menggunakan Amazon Bedrock untuk memberi daya pada mereka SnapGPT produk melalui pembuatan otomatis artefak DSL kompleks ini dari bahasa manusia.

Saat pelanggan membuat objek DSL dari LLM, DSL yang dihasilkan merupakan replika yang tepat atau turunan dari data antarmuka dan skema yang ada yang membentuk kontrak antara UI dan logika bisnis di layanan pendukung. Pola ini terutama menjadi tren pada vendor perangkat lunak independen (ISV) dan ISV perangkat lunak sebagai layanan (SaaS) karena cara unik mereka dalam merepresentasikan konfigurasi melalui kode dan keinginan untuk menyederhanakan pengalaman pengguna bagi pelanggan mereka. Contoh kasus penggunaan meliputi:

Cara paling mudah untuk membangun dan menskalakan aplikasi text-to-pipeline dengan LLM di AWS adalah menggunakan Amazon Bedrock. Amazon Bedrock adalah cara termudah untuk membangun dan menskalakan aplikasi AI generatif dengan model dasar (FM). Ini adalah layanan terkelola sepenuhnya yang menawarkan akses ke pilihan FM dasar berkinerja tinggi dari AI terkemuka melalui satu API, bersama dengan serangkaian kemampuan yang Anda perlukan untuk membangun aplikasi AI generatif dengan privasi dan keamanan. Anthropic, laboratorium penelitian dan keselamatan AI yang membangun sistem AI yang andal, dapat diinterpretasikan, dan dikendalikan, adalah salah satu perusahaan AI terkemuka yang menawarkan akses ke LLM canggih mereka, Claude, di Amazon Bedrock. Claude adalah LLM yang unggul dalam berbagai tugas, mulai dari dialog yang bijaksana, pembuatan konten, penalaran kompleks, kreativitas, dan pengkodean. Anthropic menawarkan model Claude dan Claude Instan, semuanya tersedia melalui Amazon Bedrock. Claude dengan cepat mendapatkan popularitas dalam aplikasi text-to-pipeline ini karena kemampuan penalarannya yang ditingkatkan, yang memungkinkannya unggul dalam pemecahan masalah teknis yang ambigu. Claude 2 di Amazon Bedrock mendukung jendela konteks 100,000 token, yang setara dengan sekitar 200 halaman teks bahasa Inggris. Ini adalah fitur yang sangat penting yang dapat Anda andalkan saat membuat aplikasi text-to-pipeline yang memerlukan penalaran kompleks, petunjuk mendetail, dan contoh komprehensif.

Latar belakang SnapLogic

SnapLogic adalah pelanggan AWS yang memiliki misi menghadirkan otomatisasi perusahaan ke dunia. SnapLogic Intelligent Integration Platform (IIP) memungkinkan organisasi mewujudkan otomatisasi di seluruh perusahaan dengan menghubungkan seluruh ekosistem aplikasi, database, big data, mesin dan perangkat, API, dan banyak lagi dengan konektor cerdas siap pakai yang disebut Snaps. SnapLogic baru-baru ini merilis fitur bernama SnapGPT, yang menyediakan antarmuka teks tempat Anda dapat mengetikkan alur integrasi yang diinginkan yang ingin Anda buat dalam bahasa manusia yang sederhana. SnapGPT menggunakan model Claude Anthropic melalui Amazon Bedrock untuk mengotomatiskan pembuatan jalur integrasi ini sebagai kode, yang kemudian digunakan melalui solusi integrasi andalan SnapLogic. Namun, perjalanan SnapLogic ke SnapGPT telah menjadi puncak dari bertahun-tahun beroperasi di bidang AI.

Perjalanan AI SnapLogic

Dalam bidang platform integrasi, SnapLogic secara konsisten menjadi yang terdepan, memanfaatkan kekuatan transformatif dari kecerdasan buatan. Selama bertahun-tahun, komitmen perusahaan untuk berinovasi dengan AI telah terlihat jelas, terutama jika kita menelusuri perjalanannya Selaput pelangi untuk TautanOtomatis.

Awal yang sederhana dengan Iris

Pada tahun 2017, SnapLogic meluncurkan Iris, asisten integrasi bertenaga AI pertama di industri. Iris dirancang untuk menggunakan algoritme pembelajaran mesin (ML) untuk memprediksi langkah selanjutnya dalam membangun saluran data. Dengan menganalisis jutaan elemen metadata dan aliran data, Iris dapat memberikan saran cerdas kepada pengguna, mendemokratisasi integrasi data, dan memungkinkan bahkan mereka yang tidak memiliki latar belakang teknis yang mendalam untuk menciptakan alur kerja yang kompleks.

Tautan Otomatis: Membangun momentum

Berdasarkan kesuksesan dan pembelajaran dari Iris, SnapLogic memperkenalkan AutoLink, sebuah fitur yang bertujuan untuk lebih menyederhanakan proses pemetaan data. Tugas membosankan dalam memetakan bidang secara manual antara sistem sumber dan target menjadi mudah dengan AutoLink. Menggunakan AI, AutoLink secara otomatis mengidentifikasi dan menyarankan potensi kecocokan. Integrasi yang dulunya memakan waktu berjam-jam kini dapat dijalankan hanya dalam hitungan menit.

Lompatan generatif dengan SnapGPT

Upaya terbaru SnapLogic dalam AI menghadirkan SnapGPT, yang bertujuan untuk merevolusi integrasi lebih jauh lagi. Dengan SnapGPT, SnapLogic memperkenalkan solusi integrasi generatif pertama di dunia. Hal ini bukan hanya tentang menyederhanakan proses yang sudah ada, namun sepenuhnya menata ulang bagaimana integrasi dirancang. Kekuatan AI generatif dapat menciptakan seluruh jalur integrasi dari awal, mengoptimalkan alur kerja berdasarkan hasil dan karakteristik data yang diinginkan.

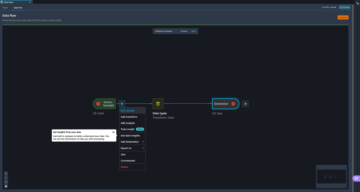

SnapGPT sangat berdampak bagi pelanggan SnapLogic karena mereka dapat secara drastis mengurangi jumlah waktu yang diperlukan untuk menghasilkan saluran SnapLogic pertama mereka. Biasanya, pelanggan SnapLogic perlu menghabiskan waktu berhari-hari atau berminggu-minggu untuk mengonfigurasi jalur integrasi dari awal. Sekarang, pelanggan ini cukup meminta SnapGPT untuk, misalnya, “membuat saluran yang akan memindahkan semua pelanggan aktif SFDC saya ke WorkDay.” Draf alur pertama yang berfungsi secara otomatis dibuat untuk pelanggan ini, sehingga secara drastis mengurangi waktu pengembangan yang diperlukan untuk pembuatan dasar alur integrasi mereka. Hal ini memungkinkan pelanggan akhir menghabiskan lebih banyak waktu untuk fokus pada dampak bisnis sebenarnya bagi mereka daripada mengerjakan konfigurasi jalur integrasi. Contoh berikut menunjukkan bagaimana pelanggan SnapLogic dapat memasukkan deskripsi ke dalam fitur SnapGPT untuk membuat alur dengan cepat, menggunakan bahasa alami.

AWS dan SnapLogic telah berkolaborasi erat dalam pembuatan produk ini dan telah belajar banyak selama proses tersebut. Sisa postingan ini akan fokus pada pembelajaran teknis yang dimiliki AWS dan SnapLogic seputar penggunaan LLM untuk aplikasi text-to-pipeline.

Ikhtisar solusi

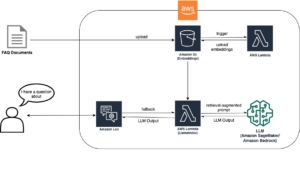

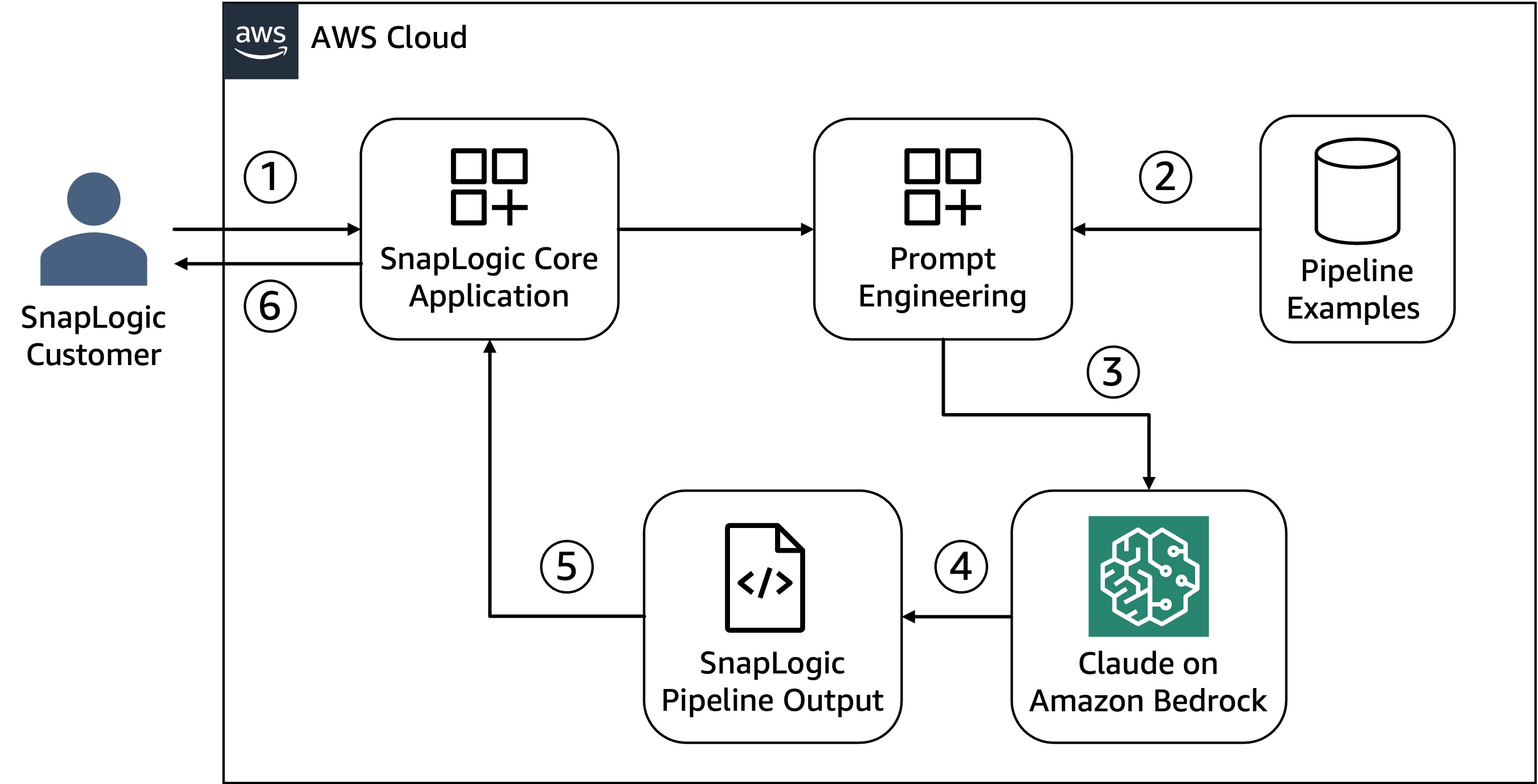

Untuk mengatasi masalah text-to-pipeline ini, AWS dan SnapLogic merancang solusi komprehensif yang ditunjukkan dalam arsitektur berikut.

Permintaan ke SnapGPT melewati alur kerja berikut:

- Seorang pengguna mengirimkan deskripsi ke aplikasi.

- SnapLogic menggunakan pendekatan Retrieval Augmented Generation (RAG) untuk mengambil contoh alur SnapLogic yang relevan dan serupa dengan permintaan pengguna.

- Contoh-contoh relevan yang diekstraksi ini digabungkan dengan input pengguna dan menjalani beberapa prapemrosesan teks sebelum dikirim ke Claude di Amazon Bedrock.

- Claude menghasilkan artefak JSON yang mewakili saluran SnapLogic.

- Artefak JSON terintegrasi langsung ke platform integrasi inti SnapLogic.

- Pipa SnapLogic dirender kepada pengguna dengan cara yang ramah visual.

Melalui berbagai eksperimen antara AWS dan SnapLogic, kami menemukan bahwa langkah rekayasa cepat diagram solusi sangatlah penting untuk menghasilkan keluaran berkualitas tinggi untuk keluaran text-to-pipeline ini. Bagian selanjutnya membahas lebih jauh beberapa teknik khusus yang digunakan dengan Claude di ruang ini.

Eksperimen yang cepat

Sepanjang fase pengembangan SnapGPT, AWS dan SnapLogic menemukan bahwa iterasi cepat pada perintah yang dikirim ke Claude merupakan tugas pengembangan penting untuk meningkatkan akurasi dan relevansi keluaran text-to-pipeline dalam keluaran SnapLogic. Dengan menggunakan Studio Amazon SageMaker buku catatan interaktif, tim AWS dan SnapLogic dapat dengan cepat mengerjakan berbagai versi perintah dengan menggunakan Koneksi Boto3 SDK ke Amazon Bedrock. Pengembangan berbasis notebook memungkinkan tim dengan cepat membuat koneksi sisi klien ke Amazon Bedrock, menyertakan deskripsi berbasis teks di samping kode Python untuk mengirimkan perintah ke Amazon Bedrock, dan mengadakan sesi rekayasa cepat bersama di mana iterasi dilakukan dengan cepat antara beberapa persona.

Metode rekayasa cepat Anthropic Claude

Di bagian ini, kami menjelaskan beberapa teknik berulang yang kami gunakan untuk membuat prompt berkinerja tinggi berdasarkan permintaan pengguna ilustratif: “Buat saluran yang menggunakan database ContohPerusahaan yang mengambil semua pelanggan aktif.” Perhatikan bahwa contoh ini bukan skema yang didukung oleh SnapGPT, dan hanya digunakan untuk mengilustrasikan aplikasi text-to-pipeline.

Untuk mendasari rekayasa cepat kami, kami menggunakan perintah asli berikut:

Buat saluran pipa yang menggunakan database ContohPerusahaan yang mengambil semua pelanggan aktif

Output yang diharapkan adalah sebagai berikut:

{ "database": "ExampleCompany", "query": "SELECT * FROM ec_prod.customers WHERE status = 'active'" }

Peningkatan #1: Menggunakan anotasi Manusia dan Asisten

Prosedur pelatihan Claude mengajarkan FM untuk memahami dialog antara manusia dan asisten dalam struktur cepatnya. Pengguna Claude dapat memanfaatkan struktur ini dengan mengakhiri perintah mereka di Asisten:, yang akan memicu Claude untuk mulai menghasilkan respons terhadap kueri berdasarkan apa yang dikatakan manusia. Perhatikan bahwa karena Claude akan terus menghasilkan teks hingga diminta berhenti, pastikan Anda menggunakan urutan penghentian nnHuman: dalam permintaan API ke Amazon Bedrock saat menggunakan Claude. Hal ini akan memastikan Anda hanya menerima respons dari asisten dan bukan prediksi respons selanjutnya dari manusia dalam rantai dialog. Indikator nnHuman dan nnAssistant ini tidak hanya membantu membatasi respons Claude terhadap informasi yang relevan, namun juga membantu memberikan batasan yang jelas antara masukan utama manusia dan respons asisten dari interaksi lain. Hal ini terutama membantu dalam pengaturan prompt beberapa langkah di mana Anda dapat memiliki beberapa pertanyaan dan tanggapan dengan pertanyaan yang ditandai dengan nnHuman dan tanggapan sebelumnya yang ditandai dengan nnAssistant. Mari kita lihat permintaan yang ditingkatkan dan panggilan API ilustratif terkait ke Amazon Bedrock melalui Boto3 SDK.

Kami menggunakan perintah berikut:

Manusia: Buat saluran pipa yang menggunakan database ContohPerusahaan yang mengambil semua pelanggan aktif

Asisten:

Outputnya adalah sebagai berikut:

Berikut adalah saluran MongoDB untuk mengambil semua pelanggan aktif dari database ContohPerusahaan:

pipeline = [ { '$match': { 'database': 'ExampleCompany', 'status': 'active' } } ] db.customers.aggregate(pipeline)Langkah-langkah utamanya adalah:

– `$match` untuk memfilter dokumen hanya pada dokumen yang ada di database ContohPerusahaan dan dengan status sama dengan “aktif”.

– `db.customers.aggregate()` menjalankan pipeline pada koleksi pelanggan dan mengembalikan hasil yang difilter.

Jadi ini akan mengembalikan semua dokumen pelanggan dari database ContohPerusahaan di mana bidang status diatur ke “aktif”.

Perhatikan bagaimana dalam keluarannya, Claude membuat jawaban atas pertanyaan kita tanpa konteks apa pun. Jawabannya berpotensi membantu, namun tidak spesifik untuk masalah yang ingin kita selesaikan karena tidak diberikan konteks yang cukup. Penting juga untuk dicatat bahwa Anthropic memerlukan format manusia dan asisten ini saat menggunakan model Claude; jika Anda tidak menyertakan langkah ini, Amazon Bedrock akan mengembalikan kesalahan.

Peningkatan #2: Sertakan konteks yang sangat spesifik untuk Claude sebelum diberitahu apa yang harus dilakukan

Claude berkinerja paling baik ketika diberikan konteks yang baik tentang apa yang perlu dicapai serta bagaimana seharusnya menyelesaikan tugas itu. Berikut adalah beberapa contoh hal yang perlu disertakan sebagai konteks untuk Claude sebelum Anda memberi tahu tugasnya:

- Jelaskan fungsi pekerjaan yang ingin Claude penuhi. Dengan melakukan ini, Anda membuat Claude berpikir tentang peran seseorang yang bekerja dalam pekerjaan itu, atau lebih seperti seseorang yang baru saja dipekerjakan dalam peran pekerjaan tertentu. Ini akan membantu Claude merumuskan jawaban dari sudut pandang peran pekerjaan tertentu, mengurangi halusinasi dan keacakan dalam jawabannya.

- Sertakan detail teknis mengenai format keluaran. Model dasar umumnya bagus dalam mengikuti tindakan, jadi meminta Claude untuk menghasilkan output dalam format atau skema tertentu dengan satu atau beberapa contoh akan membantu Claude memberikan jawaban dalam format yang tepat, sehingga mengurangi kebutuhan untuk memfilter dan pasca-pemrosesan output. Contoh pada prompt berikut menunjukkan skema fiktif yang cocok dengan keluaran yang diharapkan.

Mari gabungkan saran-saran ini untuk menyempurnakan perintah awal kita:

Manusia: Tugas Anda adalah bertindak sebagai ahli dalam jaringan pipa ETL. Secara khusus, tugas Anda adalah membuat representasi JSON dari saluran ETL yang akan menyelesaikan permintaan pengguna yang diberikan kepada Anda.

Output JSON harus mengikuti format berikut:

Inilah tugas Anda: membuat saluran pipa yang menggunakan database ContohPerusahaan yang mengambil semua pelanggan aktif

Asisten:

Outputnya adalah sebagai berikut:

Berikut adalah representasi JSON dari saluran ETL untuk mengambil semua pelanggan aktif dari database ContohPerusahaan:

Alur ini menggunakan database ContohPerusahaan dan kueri SQL untuk memilih semua rekaman dari tabel pelanggan yang statusnya 'aktif'.

Dengan tambahan konteks, model tersebut kini dapat memberikan sebagian besar jawaban kita. Sekarang ia mengetahui cara menyusun output dan memahami bahwa ia perlu menulis pernyataan SQL untuk menyelesaikan tugas tersebut. Namun, Anda akan melihat bahwa model tersebut tidak menggunakan nomenklatur ec_prod.customers yang kami harapkan dengan benar. Ruang untuk perbaikan! Perhatikan juga, dalam praktiknya, Anda perlu menyertakan lebih banyak konteks daripada yang kami berikan dalam contoh ini untuk mendapatkan hasil berkualitas tinggi dalam kasus penggunaan text-to-pipeline.

Perbaikan #3: Melampirkan contoh dalam tag XML

Pembelajaran singkat adalah cara populer untuk meningkatkan akurasi FM di mana Anda memiliki contoh relevan untuk memandu FM dalam tugasnya. Hal ini sangat penting ketika bekerja dalam aplikasi text-to-pipeline karena output pipeline yang sangat spesifik ini biasanya tidak disertakan dalam kumpulan data publik mana pun karena output tersebut spesifik untuk representasi data pelanggan individual. Saat menggunakan Claude, Anda dapat memanfaatkan pengetahuan bawaannya tentang tag XML arbitrer untuk memberikan contoh ini dalam format beberapa contoh. Pada prompt yang ditingkatkan berikut ini, perhatikan penambahan contoh yang disertakan tag XML. Selain itu, Anda dapat menggunakan singkatan untuk manusia dan asisten dengan H dan A untuk memberikan konteks kepada Claude tanpa membuatnya berpikir bahwa ini adalah bagian spesifik dari dialog yang telah terjadi.

Kami menggunakan perintah berikut:

Manusia: Tugas Anda adalah bertindak sebagai ahli dalam jaringan pipa ETL. Secara khusus, tugas Anda adalah membuat representasi JSON dari saluran ETL yang akan menyelesaikan permintaan pengguna yang diberikan kepada Anda.

Output JSON harus mengikuti format berikut:

Berikut adalah beberapa contoh permintaan pengguna dan artefak JSON keluaran terkait yang menyelesaikan tugas yang diberikan dengan benar. Pastikan untuk menggunakan nomenklatur yang sama seperti yang diberikan dalam contoh jika Anda menggunakan database yang sama.

H: menanyakan database ContohPerusahaan untuk setiap pesanan aktif untuk pelanggan #1234

A:

Alasan untuk kueri ini adalah bahwa pelanggan #1234 difilter dan kami mencari tabel “pesanan” untuk setiap catatan yang ada setelah filter “aktif”.

H: menghapus semua pelanggan di database ContohPerusahaan yang belum aktif dalam sebulan terakhir

A:

Alasan untuk kueri ini adalah bahwa tabel “ec_prod.customers” adalah satu-satunya tabel di database ContohPerusahaan yang berisi catatan pelanggan.

Inilah tugas Anda: membuat saluran pipa yang menggunakan database ContohPerusahaan yang mengambil semua pelanggan aktif.

Asisten:

Outputnya adalah sebagai berikut:

Berikut adalah representasi JSON untuk saluran ETL untuk mengambil semua pelanggan aktif dari database ContohPerusahaan:

Alasannya adalah:

Basis data ContohPerusahaan ditentukan sebagai basis data yang akan digunakan

Tabel ec_prod.customers berisi data pelanggan

Bidang status menunjukkan apakah pelanggan aktif sehingga kueri memfilter hanya untuk pelanggan aktif

Ini harus mengambil semua catatan pelanggan aktif dari database ContohPerusahaan. Beri tahu saya jika Anda memerlukan klarifikasi atau memiliki persyaratan tambahan untuk pipeline ETL!

Output JSON sekarang memiliki tata nama database yang benar, yang dapat digunakan Claude karena contoh yang kami berikan. Menggabungkan indikator manusia dan asisten dengan tag XML memudahkan Claude untuk memahami apa tugasnya dan apa jawabannya dalam contoh serupa dengan pemisahan yang sangat jelas antara beberapa contoh beberapa contoh. Semakin mudah bagi Claude untuk memahaminya, semakin baik dan relevan jawabannya, sehingga semakin mengurangi kemungkinan model berhalusinasi dan memberikan jawaban acak yang tidak relevan.

Perbaikan #4: Memicu Claude untuk memulai pembuatan JSON dengan tag XML

Tantangan kecil pada aplikasi text-to-pipeline yang menggunakan FM adalah kebutuhan untuk mengurai output dari teks yang dihasilkan secara tepat sehingga dapat diinterpretasikan sebagai kode dalam aplikasi hilir. Salah satu cara untuk mengatasi masalah ini dengan Claude adalah dengan memanfaatkan pemahaman tag XML-nya dan menggabungkannya dengan urutan penghentian khusus. Pada prompt berikut, kami telah menginstruksikan Claude untuk menyertakan outputnya tag XML. Kemudian, kami telah menambahkan tag ke akhir prompt. Hal ini memastikan bahwa teks pertama yang keluar dari Claude akan menjadi awal keluaran JSON. Jika Anda tidak melakukan ini, Claude sering merespons dengan beberapa teks percakapan, lalu respons kode yang sebenarnya. Dengan menginstruksikan Claude untuk segera mulai menghasilkan output, Anda dapat dengan mudah menghentikan pembangkitan ketika Anda melihat penutupannya menandai. Hal ini ditunjukkan dalam panggilan API Boto3 yang diperbarui. Manfaat teknik ini ada dua. Pertama, Anda dapat mengurai dengan tepat respons kode dari Claude. Kedua, Anda dapat mengurangi biaya karena Claude hanya menghasilkan keluaran kode dan tidak ada teks tambahan. Hal ini mengurangi biaya di Amazon Bedrock karena Anda dikenakan biaya untuk setiap token yang dihasilkan sebagai output dari semua FM.

Kami menggunakan perintah berikut:

Manusia: Tugas Anda adalah bertindak sebagai ahli dalam jaringan pipa ETL. Secara khusus, tugas Anda adalah membuat representasi JSON dari saluran ETL yang akan menyelesaikan permintaan pengguna yang diberikan kepada Anda.

Output JSON harus mengikuti format berikut:

Berikut adalah beberapa contoh permintaan pengguna dan artefak JSON keluaran terkait yang menyelesaikan tugas yang diberikan dengan benar. Pastikan untuk menggunakan nomenklatur yang sama seperti yang diberikan dalam contoh jika Anda menggunakan database yang sama.

H: menanyakan database ContohPerusahaan untuk setiap pesanan aktif untuk pelanggan #1234

A:

Alasan untuk kueri ini adalah bahwa pelanggan #1234 difilter dan kami mencari tabel “pesanan” untuk setiap catatan yang ada setelah filter “aktif”.

H: menghapus semua pelanggan di database ContohPerusahaan yang belum aktif dalam sebulan terakhir

A:

Alasan untuk kueri ini adalah bahwa tabel “ec_prod.customers” adalah satu-satunya tabel di database ContohPerusahaan yang berisi catatan pelanggan.

Selalu ingat untuk menyertakan output JSON Anda tag.

Inilah tugas Anda: membuat saluran pipa yang menggunakan database ContohPerusahaan yang mengambil semua pelanggan aktif.

Asisten:

Kami menggunakan kode berikut:

body = json.dumps({"prompt": prompt, "stop_sequences": ['nnHuman:', '</json>']})

response = bedrock.invoke_model( body=body, modelId='anthropic.claude-v2'

)Outputnya adalah sebagai berikut:

{ "database": "ExampleCompany", "query": "SELECT * FROM ec_prod.customers WHERE status = 'active'" }

Sekarang kita telah sampai pada keluaran yang diharapkan dengan hanya objek JSON yang dikembalikan! Dengan menggunakan metode ini, kami dapat menghasilkan artefak teknis yang dapat segera digunakan serta mengurangi biaya pembuatan dengan mengurangi token keluaran.

Kesimpulan

Untuk memulai hari ini dengan SnapGPT, minta a uji coba gratis SnapLogic or meminta demo produk. Jika Anda ingin menggunakan konsep ini untuk membangun aplikasi saat ini, kami merekomendasikannya bereksperimen secara langsung dengan bagian rekayasa cepat di postingan ini, menggunakan alur yang sama pada kasus penggunaan generasi DSL berbeda yang sesuai dengan bisnis Anda, dan mendalami lebih dalam Fitur RAG yang tersedia melalui Amazon Bedrock.

SnapLogic dan AWS telah mampu bermitra secara efektif untuk membangun penerjemah tingkat lanjut antara bahasa manusia dan skema kompleks alur integrasi SnapLogic yang didukung oleh Amazon Bedrock. Sepanjang perjalanan ini, kita telah melihat bagaimana keluaran yang dihasilkan dengan Claude dapat ditingkatkan dalam aplikasi text-to-pipeline menggunakan teknik rekayasa cepat tertentu. AWS dan SnapLogic sangat antusias untuk melanjutkan kemitraan dalam AI Generatif dan menantikan kolaborasi dan inovasi di masa depan dalam bidang yang bergerak cepat ini.

Tentang Penulis

Greg Benson adalah Profesor Ilmu Komputer di Universitas San Francisco dan Kepala Ilmuwan di SnapLogic. Ia bergabung dengan Departemen Ilmu Komputer USF pada tahun 1998 dan telah mengajar program sarjana dan pascasarjana termasuk sistem operasi, arsitektur komputer, bahasa pemrograman, sistem terdistribusi, dan pengantar pemrograman. Greg telah menerbitkan penelitian di bidang sistem operasi, komputasi paralel, dan sistem terdistribusi. Sejak bergabung dengan SnapLogic pada tahun 2010, Greg telah membantu merancang dan mengimplementasikan beberapa fitur platform utama termasuk pemrosesan cluster, pemrosesan big data, arsitektur cloud, dan pembelajaran mesin. Dia saat ini sedang mengerjakan AI Generatif untuk integrasi data.

Greg Benson adalah Profesor Ilmu Komputer di Universitas San Francisco dan Kepala Ilmuwan di SnapLogic. Ia bergabung dengan Departemen Ilmu Komputer USF pada tahun 1998 dan telah mengajar program sarjana dan pascasarjana termasuk sistem operasi, arsitektur komputer, bahasa pemrograman, sistem terdistribusi, dan pengantar pemrograman. Greg telah menerbitkan penelitian di bidang sistem operasi, komputasi paralel, dan sistem terdistribusi. Sejak bergabung dengan SnapLogic pada tahun 2010, Greg telah membantu merancang dan mengimplementasikan beberapa fitur platform utama termasuk pemrosesan cluster, pemrosesan big data, arsitektur cloud, dan pembelajaran mesin. Dia saat ini sedang mengerjakan AI Generatif untuk integrasi data.

Aaron Kesler adalah Manajer Produk Senior untuk produk dan layanan AI di SnapLogic, Aaron menerapkan keahlian manajemen produk selama lebih dari sepuluh tahun untuk memelopori pengembangan produk AI/ML dan menginjili layanan di seluruh organisasi. Dia adalah penulis buku mendatang “What's Your Problem?” bertujuan untuk membimbing manajer produk baru melalui karir manajemen produk. Perjalanan kewirausahaannya dimulai dengan startup kampusnya, STAK, yang kemudian diakuisisi oleh Carvertise dan Aaron memberikan kontribusi signifikan terhadap pengakuan mereka sebagai Tech Startup of the Year 2015 di Delaware. Di luar aktivitas profesionalnya, Aaron menemukan kegembiraan dalam bermain golf bersama ayahnya, menjelajahi budaya dan makanan baru dalam perjalanannya, dan berlatih ukulele.

Aaron Kesler adalah Manajer Produk Senior untuk produk dan layanan AI di SnapLogic, Aaron menerapkan keahlian manajemen produk selama lebih dari sepuluh tahun untuk memelopori pengembangan produk AI/ML dan menginjili layanan di seluruh organisasi. Dia adalah penulis buku mendatang “What's Your Problem?” bertujuan untuk membimbing manajer produk baru melalui karir manajemen produk. Perjalanan kewirausahaannya dimulai dengan startup kampusnya, STAK, yang kemudian diakuisisi oleh Carvertise dan Aaron memberikan kontribusi signifikan terhadap pengakuan mereka sebagai Tech Startup of the Year 2015 di Delaware. Di luar aktivitas profesionalnya, Aaron menemukan kegembiraan dalam bermain golf bersama ayahnya, menjelajahi budaya dan makanan baru dalam perjalanannya, dan berlatih ukulele.

Dill yang kaya adalah Arsitek Solusi Utama dengan pengalaman luas di berbagai bidang spesialisasi. Rekam jejak kesuksesan yang mencakup perangkat lunak perusahaan multi-platform dan SaaS. Terkenal karena mengubah advokasi pelanggan (berfungsi sebagai suara pelanggan) menjadi fitur dan produk baru yang menghasilkan pendapatan. Kemampuan yang terbukti untuk mendorong produk-produk mutakhir ke pasar dan proyek-proyek selesai sesuai jadwal dan sesuai anggaran di lingkungan darat dan lepas pantai yang bergerak cepat. Cara sederhana untuk mendeskripsikan saya: pikiran seorang ilmuwan, hati seorang penjelajah, dan jiwa seorang seniman.

Dill yang kaya adalah Arsitek Solusi Utama dengan pengalaman luas di berbagai bidang spesialisasi. Rekam jejak kesuksesan yang mencakup perangkat lunak perusahaan multi-platform dan SaaS. Terkenal karena mengubah advokasi pelanggan (berfungsi sebagai suara pelanggan) menjadi fitur dan produk baru yang menghasilkan pendapatan. Kemampuan yang terbukti untuk mendorong produk-produk mutakhir ke pasar dan proyek-proyek selesai sesuai jadwal dan sesuai anggaran di lingkungan darat dan lepas pantai yang bergerak cepat. Cara sederhana untuk mendeskripsikan saya: pikiran seorang ilmuwan, hati seorang penjelajah, dan jiwa seorang seniman.

Tanah Liat Elmore adalah Arsitek Solusi Spesialis AI/ML di AWS. Setelah menghabiskan berjam-jam di laboratorium penelitian material, latar belakangnya di bidang teknik kimia dengan cepat ditinggalkan untuk mengejar minatnya pada pembelajaran mesin. Dia telah mengerjakan aplikasi ML di berbagai industri mulai dari perdagangan energi hingga pemasaran perhotelan. Pekerjaan Clay saat ini di AWS berpusat pada membantu pelanggan menerapkan praktik pengembangan perangkat lunak ke ML dan beban kerja AI generatif, sehingga memungkinkan pelanggan membangun solusi yang dapat diulang dan terukur di lingkungan yang kompleks ini. Di waktu luangnya, Clay menikmati bermain ski, memecahkan kubus Rubik, membaca, dan memasak.

Tanah Liat Elmore adalah Arsitek Solusi Spesialis AI/ML di AWS. Setelah menghabiskan berjam-jam di laboratorium penelitian material, latar belakangnya di bidang teknik kimia dengan cepat ditinggalkan untuk mengejar minatnya pada pembelajaran mesin. Dia telah mengerjakan aplikasi ML di berbagai industri mulai dari perdagangan energi hingga pemasaran perhotelan. Pekerjaan Clay saat ini di AWS berpusat pada membantu pelanggan menerapkan praktik pengembangan perangkat lunak ke ML dan beban kerja AI generatif, sehingga memungkinkan pelanggan membangun solusi yang dapat diulang dan terukur di lingkungan yang kompleks ini. Di waktu luangnya, Clay menikmati bermain ski, memecahkan kubus Rubik, membaca, dan memasak.

Sina Sojoodi adalah seorang eksekutif teknologi, insinyur sistem, pemimpin produk, mantan pendiri dan penasihat startup. Dia bergabung dengan AWS pada bulan Maret 2021 sebagai Arsitek Solusi Utama. Sina saat ini menjabat sebagai Arsitek Solusi yang memimpin wilayah ISV AS-Barat. Dia bekerja dengan perusahaan perangkat lunak SaaS dan B2B untuk membangun dan mengembangkan bisnis mereka di AWS. Sebelum menjabat di Amazon, Sina adalah eksekutif teknologi di VMware, dan Pivotal Software (IPO pada tahun 2018, M&A VMware pada tahun 2020) dan menjabat berbagai peran kepemimpinan termasuk insinyur pendiri di Xtreme Labs (akuisisi penting pada tahun 2013). Sina telah mendedikasikan pengalaman kerjanya selama 15 tahun terakhir untuk membangun platform dan praktik perangkat lunak untuk perusahaan, bisnis perangkat lunak, dan sektor publik. Dia adalah pemimpin industri dengan hasrat terhadap inovasi. Sina meraih gelar BA dari University of Waterloo di mana ia belajar Teknik Elektro dan Psikologi.

Sina Sojoodi adalah seorang eksekutif teknologi, insinyur sistem, pemimpin produk, mantan pendiri dan penasihat startup. Dia bergabung dengan AWS pada bulan Maret 2021 sebagai Arsitek Solusi Utama. Sina saat ini menjabat sebagai Arsitek Solusi yang memimpin wilayah ISV AS-Barat. Dia bekerja dengan perusahaan perangkat lunak SaaS dan B2B untuk membangun dan mengembangkan bisnis mereka di AWS. Sebelum menjabat di Amazon, Sina adalah eksekutif teknologi di VMware, dan Pivotal Software (IPO pada tahun 2018, M&A VMware pada tahun 2020) dan menjabat berbagai peran kepemimpinan termasuk insinyur pendiri di Xtreme Labs (akuisisi penting pada tahun 2013). Sina telah mendedikasikan pengalaman kerjanya selama 15 tahun terakhir untuk membangun platform dan praktik perangkat lunak untuk perusahaan, bisnis perangkat lunak, dan sektor publik. Dia adalah pemimpin industri dengan hasrat terhadap inovasi. Sina meraih gelar BA dari University of Waterloo di mana ia belajar Teknik Elektro dan Psikologi.

Sandeep Rohilla adalah Arsitek Solusi Senior di AWS, yang mendukung pelanggan ISV di wilayah AS Barat. Dia fokus membantu pelanggan merancang solusi yang memanfaatkan container dan AI generatif di cloud AWS. Sandeep bersemangat memahami masalah bisnis pelanggan dan membantu mereka mencapai tujuan melalui teknologi. Dia bergabung dengan AWS setelah bekerja lebih dari satu dekade sebagai arsitek solusi, dengan memanfaatkan pengalamannya selama 17 tahun. Sandeep memegang gelar MSc. di bidang Rekayasa Perangkat Lunak dari University of the West of England di Bristol, Inggris.

Sandeep Rohilla adalah Arsitek Solusi Senior di AWS, yang mendukung pelanggan ISV di wilayah AS Barat. Dia fokus membantu pelanggan merancang solusi yang memanfaatkan container dan AI generatif di cloud AWS. Sandeep bersemangat memahami masalah bisnis pelanggan dan membantu mereka mencapai tujuan melalui teknologi. Dia bergabung dengan AWS setelah bekerja lebih dari satu dekade sebagai arsitek solusi, dengan memanfaatkan pengalamannya selama 17 tahun. Sandeep memegang gelar MSc. di bidang Rekayasa Perangkat Lunak dari University of the West of England di Bristol, Inggris.

Dr.Farooq Sabir adalah Arsitek Solusi Spesialis Kecerdasan Buatan dan Pembelajaran Mesin Senior di AWS. Dia memegang gelar PhD dan MS di bidang Teknik Listrik dari University of Texas di Austin dan MS di bidang Ilmu Komputer dari Georgia Institute of Technology. Dia memiliki lebih dari 15 tahun pengalaman kerja dan juga suka mengajar dan membimbing mahasiswa. Di AWS, dia membantu pelanggan merumuskan dan memecahkan masalah bisnis mereka dalam ilmu data, pembelajaran mesin, visi komputer, kecerdasan buatan, pengoptimalan numerik, dan domain terkait. Berbasis di Dallas, Texas, dia dan keluarganya suka bepergian dan melakukan perjalanan jauh.

Dr.Farooq Sabir adalah Arsitek Solusi Spesialis Kecerdasan Buatan dan Pembelajaran Mesin Senior di AWS. Dia memegang gelar PhD dan MS di bidang Teknik Listrik dari University of Texas di Austin dan MS di bidang Ilmu Komputer dari Georgia Institute of Technology. Dia memiliki lebih dari 15 tahun pengalaman kerja dan juga suka mengajar dan membimbing mahasiswa. Di AWS, dia membantu pelanggan merumuskan dan memecahkan masalah bisnis mereka dalam ilmu data, pembelajaran mesin, visi komputer, kecerdasan buatan, pengoptimalan numerik, dan domain terkait. Berbasis di Dallas, Texas, dia dan keluarganya suka bepergian dan melakukan perjalanan jauh.

- Konten Bertenaga SEO & Distribusi PR. Dapatkan Amplifikasi Hari Ini.

- PlatoData.Jaringan Vertikal Generatif Ai. Berdayakan Diri Anda. Akses Di Sini.

- PlatoAiStream. Intelijen Web3. Pengetahuan Diperkuat. Akses Di Sini.

- PlatoESG. Karbon, teknologi bersih, energi, Lingkungan Hidup, Tenaga surya, Penanganan limbah. Akses Di Sini.

- PlatoHealth. Kecerdasan Uji Coba Biotek dan Klinis. Akses Di Sini.

- Sumber: https://aws.amazon.com/blogs/machine-learning/how-snaplogic-built-a-text-to-pipeline-application-with-amazon-bedrock-to-translate-business-intent-into-action/

- :memiliki

- :adalah

- :bukan

- :Di mana

- $NAIK

- 10

- 100

- 121

- 14

- 15 tahun

- 15%

- 150

- 17

- 1998

- 200

- 2013

- 2015

- 2017

- 2018

- 2020

- 2021

- 31

- 33

- 7

- 8

- 9

- a

- Aaron

- kemampuan

- Sanggup

- Tentang Kami

- mengakses

- menyelesaikan

- ketepatan

- Mencapai

- diperoleh

- perolehan

- di seluruh

- Bertindak

- Tindakan

- tindakan

- aktif

- menambahkan

- tambahan

- Tambahan

- maju

- Keuntungan

- penasihat

- pembelaan

- Setelah

- AI

- Sistem AI

- Bertenaga AI

- AI / ML

- ditujukan

- bertujuan

- algoritma

- Semua

- diizinkan

- Membiarkan

- memungkinkan

- sepanjang

- di samping

- sudah

- juga

- Amazon

- Amazon Web Services

- jumlah

- an

- menganalisis

- dan

- menjawab

- jawaban

- Antropik

- Apa pun

- api

- Lebah

- Aplikasi

- aplikasi

- berlaku

- pendekatan

- aplikasi

- Arab

- arsitektur

- ADALAH

- DAERAH

- daerah

- sekitar

- tiba

- Seni

- buatan

- kecerdasan buatan

- Kecerdasan Buatan dan Pembelajaran Mesin

- artis

- AS

- meminta

- meminta

- Asisten

- terkait

- At

- ditambah

- austin

- penulis

- mengotomatisasikan

- Otomatis

- secara otomatis

- Otomatisasi

- tersedia

- AWS

- Pelanggan AWS

- B2B

- latar belakang

- beking

- mendasarkan

- berdasarkan

- Dasar

- BE

- Beruang

- menjadi

- karena

- menjadi

- menjadi

- sebelum

- mulai

- mulai

- di belakang

- makhluk

- Manfaat

- TERBAIK

- Lebih baik

- antara

- Luar

- Besar

- Big data

- Book

- kedua

- angin sepoi-sepoi

- membawa

- Membawa

- Membawa

- bristol

- luas

- secara luas

- anggaran belanja

- membangun

- Bangunan

- membangun

- dibangun di

- bisnis

- bisnis

- tapi

- by

- panggilan

- bernama

- CAN

- kemampuan

- Lowongan Kerja

- kasus

- kasus

- Pusat

- rantai

- menantang

- kesempatan

- karakteristik

- dibebankan

- kimia

- kepala

- pilihan

- jelas

- rapat

- penutupan

- awan

- Kelompok

- kode

- Pengkodean

- berkolaborasi

- kolaborasi

- koleksi

- Perguruan tinggi

- menggabungkan

- bergabung

- datang

- komitmen

- Perusahaan

- Perusahaan

- dipaksa

- penyelesaian

- kompleks

- luas

- komputer

- Komputer Ilmu

- Visi Komputer

- komputasi

- konsep

- mengkonfigurasi

- Menghubungkan

- koneksi

- Koneksi

- secara konsisten

- Wadah

- mengandung

- Konten

- pembuatan konten

- konteks

- terus

- kontrak

- berkontribusi

- percakapan

- Core

- benar

- benar

- Biaya

- bisa

- Pelatihan

- membuat

- dibuat

- penciptaan

- kreativitas

- kritis

- terbaru

- Sekarang

- adat

- pelanggan

- pelanggan

- pemotongan

- canggih

- Dallas

- data

- pengolahan data

- ilmu data

- Basis Data

- database

- Hari

- dasawarsa

- mengurangi

- dedicated

- mendalam

- lebih dalam

- Delaware

- demo

- Demokratisasi

- Departemen

- turunan

- menggambarkan

- deskripsi

- Mendesain

- dirancang

- keinginan

- diinginkan

- terperinci

- rincian

- pengembang

- Pengembangan

- Devices

- Dialog

- berbeda

- langsung

- didistribusikan

- sistem terdistribusi

- penyelaman

- do

- dokumen

- Tidak

- melakukan

- domain

- Dont

- turun

- draf

- secara drastis

- mendorong

- dua

- setiap

- mudah

- termudah

- mudah

- ekosistem

- efektif

- antara

- elemen

- memungkinkan

- akhir

- akhir

- energi

- insinyur

- Teknik

- Inggris

- Inggris

- cukup

- memastikan

- Memastikan

- Enter

- Enterprise

- perangkat lunak perusahaan

- perusahaan

- Seluruh

- sepenuhnya

- kewirausahaan

- lingkungan

- sama

- Setara

- kesalahan

- terutama

- Bahkan

- jelas

- persis

- contoh

- contoh

- Excel

- gembira

- eksekutif

- ada

- diharapkan

- mengharapkan

- pengalaman

- ahli

- keahlian

- penjelajah

- Menjelajahi

- tambahan

- sangat

- keluarga

- bergerak cepat

- serba cepat

- Fitur

- Fitur

- beberapa

- bidang

- Fields

- menyaring

- penyaringan

- filter

- menemukan

- Pertama

- Flagship

- aliran

- Mengalir

- Fokus

- berfokus

- berfokus

- mengikuti

- berikut

- berikut

- makanan

- Untuk

- Perampokan

- garis terdepan

- format

- bentuk

- Depan

- ditemukan

- Prinsip Dasar

- pembinaan

- Francisco

- ramah

- dari

- Memenuhi

- sepenuhnya

- fungsi

- lebih lanjut

- masa depan

- diperoleh

- umumnya

- menghasilkan

- dihasilkan

- menghasilkan

- menghasilkan

- generasi

- generatif

- AI generatif

- Georgia

- mendapatkan

- gif

- diberikan

- Go

- Anda

- Pergi

- baik

- lulus

- Tumbuh

- membimbing

- memiliki

- tangan

- Memanfaatkan

- Memiliki

- he

- Hati

- membantu

- membantu

- bermanfaat

- membantu

- membantu

- di sini

- berkinerja tinggi

- berkualitas tinggi

- highlight

- -nya

- memegang

- memegang

- keramahan

- JAM

- Seterpercayaapakah Olymp Trade? Kesimpulan

- How To

- Namun

- HTML

- HTTPS

- manusia

- merendahkan

- diidentifikasi

- if

- menjelaskan

- segera

- Dampak

- berdampak

- melaksanakan

- penting

- memperbaiki

- ditingkatkan

- meningkatkan

- in

- memasukkan

- termasuk

- Termasuk

- Meningkatkan

- independen

- menunjukkan

- indikator

- sendiri-sendiri

- industri

- industri

- informasi

- bawaan

- berinovasi

- Innovation

- memasukkan

- input

- saat

- sebagai gantinya

- Lembaga

- instruksi

- terpadu

- integrasi

- integrasi

- Intelijen

- Cerdas

- maksud

- interaksi

- interaktif

- bunga

- Antarmuka

- intern

- ke

- diperkenalkan

- Memperkenalkan

- pengantar

- IPO

- isv

- IT

- perulangan

- iterasi

- NYA

- Jawa

- Pekerjaan

- bergabung

- bergabung

- bersama

- perjalanan

- kegembiraan

- jpg

- json

- hanya

- kunci

- Tahu

- pengetahuan

- dikenal

- tahu

- laboratorium

- Labs

- bahasa

- Bahasa

- besar

- Terakhir

- kemudian

- Terbaru

- memimpin

- pemimpin

- Kepemimpinan

- terkemuka

- Melompat

- belajar

- pengetahuan

- meninggalkan

- membiarkan

- leveraging

- 'like'

- 'like

- membatasi

- LLM

- logika

- Panjang

- melihat

- Lot

- cinta

- HANTU

- mesin

- Mesin belajar

- Mesin

- terbuat

- membuat

- MEMBUAT

- Membuat

- berhasil

- pengelolaan

- manajer

- Manajer

- cara

- manual

- banyak

- pemetaan

- March

- Pasar

- Marketing

- korek api

- bahan

- me

- penasihat

- mer

- Metadata

- metode

- jutaan

- keberatan

- menit

- Misi

- ML

- model

- model

- MongoDB

- lebih

- paling

- pindah

- MS

- Multi-Platform

- beberapa

- my

- nama

- Alam

- Perlu

- kebutuhan

- New

- Fitur Baru

- produk baru

- berikutnya

- tidak

- mencatat

- Melihat..

- sekarang

- obyek

- objek

- terjadi

- of

- Penawaran

- sering

- on

- sekali

- ONE

- hanya

- operasi

- sistem operasi

- optimasi

- mengoptimalkan

- or

- urutan

- perintah

- organisasi

- organisasi

- asli

- Lainnya

- kami

- di luar

- Hasil

- keluaran

- output

- lebih

- halaman

- Paralel

- khususnya

- pasangan

- Kemitraan

- gairah

- bergairah

- lalu

- pola

- melakukan

- perspektif

- tahap

- phd

- potongan-potongan

- pelopor

- pipa saluran

- sangat penting

- Tempat

- Platform

- Platform

- plato

- Kecerdasan Data Plato

- Data Plato

- Populer

- kepopuleran

- Pos

- potensi

- berpotensi

- kekuasaan

- didukung

- praktek

- praktek

- meramalkan

- diprediksi

- sebelumnya

- primer

- Utama

- pribadi

- Keamanan dan Privasi

- Masalah

- masalah

- Prosedur

- proses

- proses

- pengolahan

- Diproduksi

- menghasilkan

- Produk

- pengembangan produk

- manajemen Produk

- manajer produk

- Produk

- profesional

- Profesor

- Pemrograman

- bahasa pemrograman

- memprojeksikan

- meminta

- terbukti

- memberikan

- disediakan

- menyediakan

- menyediakan

- Psikologi

- publik

- diterbitkan

- mengejar

- Ular sanca

- query

- pertanyaan

- segera

- acak

- keserampangan

- jarak

- mulai

- cepat

- Bacaan

- menyadari

- dunia

- menerima

- baru-baru ini

- pengakuan

- sarankan

- catatan

- arsip

- menurunkan

- mengurangi

- mengurangi

- mengenai

- wilayah

- menata kembali

- terkait

- dirilis

- relevan

- dapat diandalkan

- mengandalkan

- ingat

- menghapus

- diberikan

- berulang

- menjawab

- perwakilan

- mewakili

- merupakan

- permintaan

- permintaan

- membutuhkan

- wajib

- Persyaratan

- membutuhkan

- penelitian

- tanggapan

- tanggapan

- ISTIRAHAT

- dihasilkan

- Hasil

- kembali

- Pengembalian

- merevolusionerkan

- Kaya

- benar

- jalan

- Peran

- peran

- Kamar

- Run

- berjalan

- SaaS

- Safety/keselamatan

- pembuat bijak

- Tersebut

- sama

- San

- San Fransisco

- terukur

- Skala

- menjadwalkan

- Ilmu

- ilmuwan

- menggaruk

- SDK

- mencari

- Kedua

- Bagian

- sektor

- keamanan

- melihat

- terlihat

- memilih

- mengirim

- senior

- mengirim

- Urutan

- yang telah dilayani

- layanan

- Layanan

- porsi

- sesi

- set

- pengaturan

- beberapa

- harus

- Menunjukkan

- ditunjukkan

- Pertunjukkan

- signifikan

- mirip

- Sederhana

- menyederhanakan

- menyederhanakan

- hanya

- sejak

- tunggal

- kecil

- So

- Perangkat lunak

- perangkat lunak sebagai layanan

- Pengembang Perangkat Lunak

- pengembangan perangkat lunak

- rekayasa Perangkat Lunak

- larutan

- Solusi

- MEMECAHKAN

- Memecahkan

- beberapa

- Seseorang

- mutakhir

- sumber

- Space

- Spanyol

- ketegangan

- spesialis

- tertentu

- Secara khusus

- ditentukan

- menghabiskan

- Pengeluaran

- awal

- mulai

- startup

- Pernyataan

- Status

- Langkah

- Tangga

- berhenti

- mudah

- struktur

- Siswa

- belajar

- sukses

- pendukung

- Mendukung

- Seharusnya

- yakin

- sistem

- sistem

- tabel

- MENANDAI

- Mengambil

- target

- tugas

- tugas

- diajarkan

- tim

- tim

- tech

- startup teknologi

- Teknis

- teknik

- teknik

- Teknologi

- mengatakan

- sepuluh

- texas

- teks

- dari

- bahwa

- Grafik

- Barat

- Dunia

- mereka

- Mereka

- kemudian

- Ini

- mereka

- hal

- berpikir

- ini

- itu

- Melalui

- di seluruh

- waktu

- untuk

- hari ini

- token

- Token

- mengatakan

- mengambil

- alat

- Jejak

- jalur

- rekam jejak

- Trading

- secara tradisional

- Pelatihan

- transformatif

- transformasi

- menterjemahkan

- perjalanan

- perjalanan

- trending

- percobaan

- memicu

- memicu

- benar

- Kode Sejati

- mencoba

- Putar

- mengetik

- ui

- Uk

- bawah

- memahami

- pemahaman

- mengerti

- unik

- universitas

- sampai

- meluncurkan

- mendatang

- diperbarui

- atas

- us

- dapat digunakan

- menggunakan

- gunakan case

- bekas

- Pengguna

- Pengguna Pengalaman

- Pengguna

- kegunaan

- menggunakan

- biasanya

- ux

- berbagai

- vendor

- Versi

- sangat

- melalui

- penglihatan

- visual

- vmware

- Suara

- ingin

- adalah

- Cara..

- we

- jaringan

- layanan web

- minggu

- BAIK

- adalah

- Barat

- Apa

- Apa itu

- ketika

- yang

- lebar

- Rentang luas

- akan

- jendela

- dengan

- tanpa

- Kerja

- Hari kerja

- bekerja

- alur kerja

- Alur kerja

- kerja

- bekerja

- dunia

- dunia

- akan

- menulis

- XML

- tahun

- tahun

- Kamu

- Anda

- Youtube

- zephyrnet.dll