Puluhan ribu pelanggan AWS menggunakan layanan pembelajaran mesin (ML) AWS untuk mempercepat pengembangan ML mereka dengan infrastruktur dan alat yang dikelola sepenuhnya. Untuk pelanggan yang telah mengembangkan model ML secara lokal, seperti desktop lokal mereka, mereka ingin memigrasikan model ML lama mereka ke AWS Cloud untuk sepenuhnya memanfaatkan kumpulan layanan, infrastruktur, dan sumber daya implementasi ML terlengkap yang tersedia di AWS .

Istilah Kode Warisan mengacu pada kode yang dikembangkan untuk dijalankan secara manual di desktop lokal, dan tidak dibuat dengan SDK cloud-ready seperti AWS SDK untuk Python (Boto3) or SDK Python Amazon SageMaker. Dengan kata lain, kode lama ini tidak dioptimalkan untuk penerapan cloud. Praktik terbaik untuk migrasi adalah memfaktorkan ulang kode lawas ini menggunakan API Amazon SageMaker atau SageMaker Python SDK. Namun, dalam beberapa kasus, organisasi dengan banyak model lama mungkin tidak memiliki waktu atau sumber daya untuk menulis ulang semua model tersebut.

Dalam postingan ini, kami membagikan pendekatan yang dapat diskalakan dan mudah diterapkan untuk memigrasikan kode ML lama ke AWS Cloud untuk inferensi menggunakan Amazon SageMaker dan Fungsi Langkah AWS, dengan jumlah minimum pemfaktoran ulang kode yang diperlukan. Anda dapat dengan mudah memperluas solusi ini untuk menambahkan lebih banyak fungsi. Kami mendemonstrasikan bagaimana dua persona berbeda, ilmuwan data dan insinyur MLOps, dapat berkolaborasi untuk mengangkat dan menggeser ratusan model lama.

Ikhtisar solusi

Dalam kerangka kerja ini, kami menjalankan kode warisan dalam wadah sebagai a Pengolahan SageMaker pekerjaan. SageMaker menjalankan skrip lama di dalam wadah pemrosesan. Gambar wadah pemrosesan dapat berupa gambar bawaan SageMaker atau gambar khusus. Infrastruktur dasar untuk tugas Pemrosesan dikelola sepenuhnya oleh SageMaker. Tidak diperlukan perubahan pada kode lama. Keakraban dengan membuat pekerjaan Pemrosesan SageMaker adalah semua yang diperlukan.

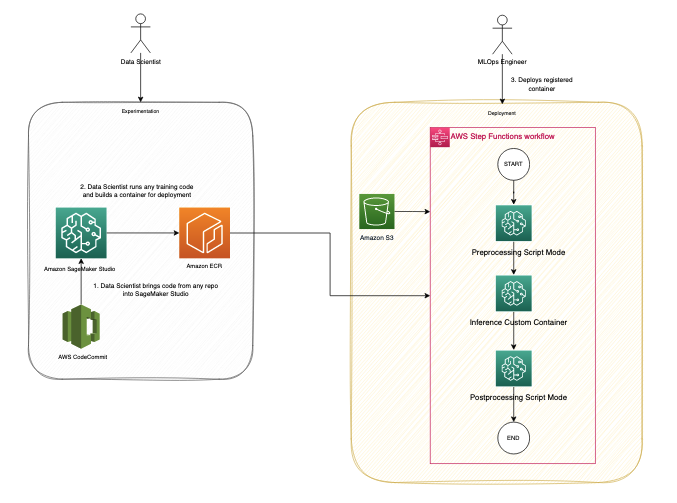

Kami mengasumsikan keterlibatan dua persona: ilmuwan data dan insinyur MLOps. Ilmuwan data bertanggung jawab untuk memindahkan kode ke SageMaker, baik secara manual atau dengan mengkloningnya dari repositori kode seperti Komitmen Kode AWS. Studio Amazon SageMaker menyediakan lingkungan pengembangan terintegrasi (IDE) untuk mengimplementasikan berbagai langkah dalam siklus proses ML, dan data scientist menggunakannya untuk secara manual membuat container khusus yang berisi artefak kode yang diperlukan untuk penerapan. Kontainer akan didaftarkan dalam registri kontainer seperti Registry Kontainer Elastis Amazon (Amazon ECR) untuk tujuan penyebaran.

Insinyur MLOps bertanggung jawab membangun alur kerja Step Functions yang dapat kami gunakan kembali untuk menerapkan wadah khusus yang dikembangkan oleh ilmuwan data dengan parameter yang sesuai. Alur kerja Step Functions dapat bersifat modular sesuai kebutuhan agar sesuai dengan kasus penggunaan, atau hanya terdiri dari satu langkah untuk memulai satu proses. Untuk meminimalkan upaya yang diperlukan untuk memigrasikan kode, kami telah mengidentifikasi tiga komponen modular untuk membangun proses penerapan yang berfungsi penuh:

- Pemrosesan awal

- Kesimpulan

- Pengolahan pasca

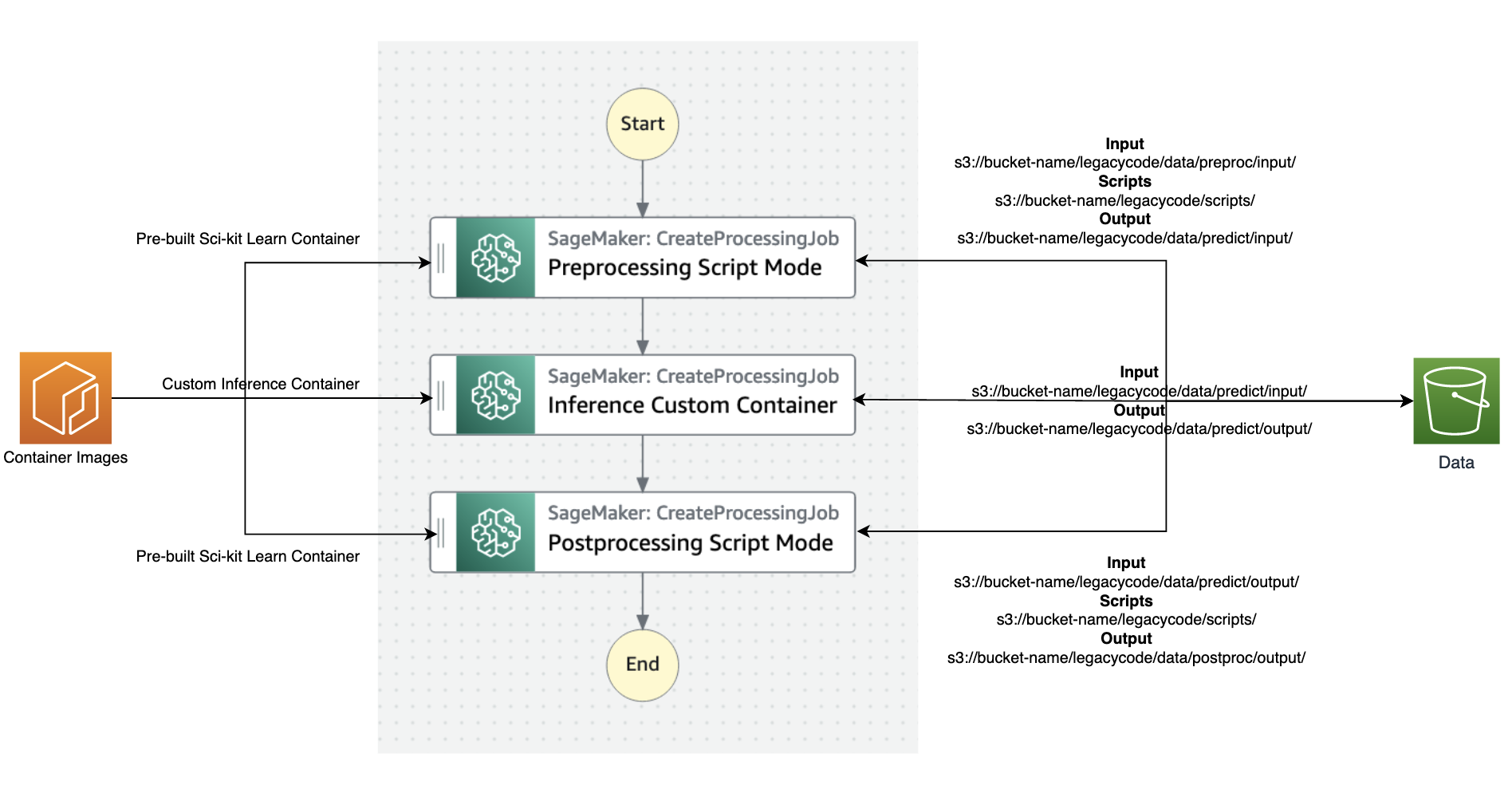

Diagram berikut mengilustrasikan arsitektur solusi dan alur kerja kami.

Langkah-langkah berikut terlibat dalam solusi ini:

- Persona data scientist menggunakan Studio untuk mengimpor kode lama melalui kloning dari repositori kode, lalu memodulasi kode menjadi komponen terpisah yang mengikuti langkah-langkah siklus hidup ML (prapemrosesan, inferensi, dan pascapemrosesan).

- Ilmuwan data menggunakan Studio, dan khususnya Studio Gambar Membangun CLI alat yang disediakan oleh SageMaker, untuk membuat image Docker. Alat CLI ini memungkinkan ilmuwan data untuk membuat gambar langsung di dalam Studio dan secara otomatis mendaftarkan gambar ke Amazon ECR.

- Insinyur MLOps menggunakan image container terdaftar dan membuat penerapan untuk kasus penggunaan tertentu menggunakan Step Functions. Step Functions adalah layanan alur kerja tanpa server yang dapat mengontrol API SageMaker secara langsung melalui penggunaan Amazon States Language.

Pekerjaan SageMaker Processing

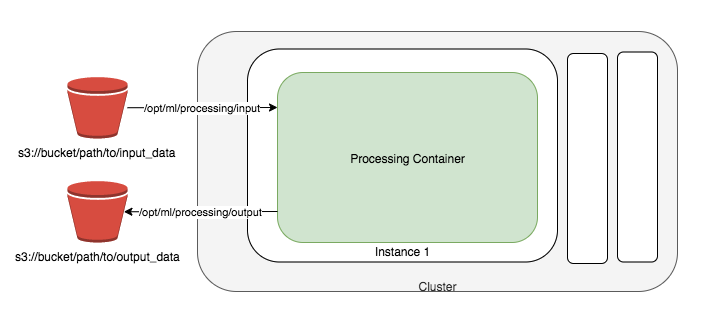

Mari kita pahami caranya a Pekerjaan SageMaker Processing berjalan. Diagram berikut menampilkan cara SageMaker menjalankan tugas Pemrosesan.

SageMaker mengambil skrip Anda, menyalin data Anda dari Layanan Penyimpanan Sederhana Amazon (Amazon S3), lalu menarik wadah pemrosesan. Gambar wadah pemrosesan dapat berupa gambar bawaan SageMaker atau gambar khusus yang Anda berikan. Infrastruktur dasar untuk tugas Pemrosesan dikelola sepenuhnya oleh SageMaker. Sumber daya cluster disediakan selama pekerjaan Anda, dan dibersihkan saat pekerjaan selesai. Output dari tugas Processing disimpan di bucket S3 yang Anda tentukan. Untuk mempelajari lebih lanjut tentang membuat wadah Anda sendiri, lihat Bangun Kontainer Pemrosesan Anda Sendiri (Skenario Lanjutan).

Tugas Pemrosesan SageMaker menyiapkan gambar pemrosesan Anda menggunakan skrip titik masuk kontainer Docker. Anda juga dapat menyediakan entrypoint kustom Anda sendiri dengan menggunakan parameter ContainerEntrypoint dan ContainerArguments dari Spesifikasi Aplikasi API. Jika Anda menggunakan entrypoint kustom Anda sendiri, Anda memiliki fleksibilitas tambahan untuk menjalankannya sebagai skrip mandiri tanpa membuat ulang gambar Anda.

Untuk contoh ini, kami membuat wadah khusus dan menggunakan tugas Pemrosesan SageMaker untuk inferensi. Pekerjaan preprocessing dan postprocessing menggunakan mode skrip dengan wadah scikit-learn yang telah dibuat sebelumnya.

Prasyarat

Untuk mengikuti posting ini, selesaikan langkah-langkah prasyarat berikut:

- Buat domain Studio. Untuk instruksi, lihat Onboard ke Domain Amazon SageMaker Menggunakan Pengaturan cepat.

- Buat bucket S3.

- Kloning yang disediakan GitHub repo ke Studio.

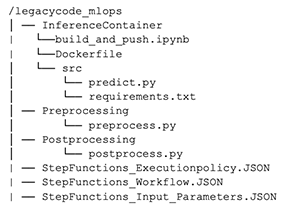

Repo GitHub diatur ke dalam folder berbeda yang sesuai dengan berbagai tahapan dalam siklus hidup ML, memfasilitasi navigasi dan pengelolaan yang mudah:

Migrasikan kode lawas

Pada langkah ini, kami bertindak sebagai ilmuwan data yang bertanggung jawab untuk memigrasikan kode lama.

Kita mulai dengan membuka build_and_push.ipynb buku catatan.

Sel awal di notebook memandu Anda dalam menginstal Studio Gambar Membangun CLI. CLI ini menyederhanakan proses penyiapan dengan secara otomatis membuat lingkungan build yang dapat digunakan kembali yang dapat Anda gunakan untuk berinteraksi melalui perintah tingkat tinggi. Dengan CLI, membuat gambar semudah menyuruhnya membuat, dan hasilnya berupa tautan ke lokasi gambar Anda di Amazon ECR. Pendekatan ini meniadakan kebutuhan untuk mengelola alur kerja dasar yang rumit yang diatur oleh CLI, menyederhanakan proses pembuatan gambar.

Sebelum kita menjalankan perintah build, penting untuk memastikan bahwa peran yang menjalankan perintah tersebut memiliki izin yang diperlukan, sebagaimana ditentukan dalam CLI GitHub readme atau pos terkait. Gagal memberikan izin yang diperlukan dapat menyebabkan kesalahan selama proses pembuatan.

Lihat kode berikut:

Untuk merampingkan kode lawas Anda, bagi menjadi tiga skrip Python berbeda bernama preprocessing.py, predict.py, dan postprocessing.py. Patuhi praktik pemrograman terbaik dengan mengubah kode menjadi fungsi yang dipanggil dari fungsi utama. Pastikan bahwa semua pustaka yang diperlukan telah diimpor dan file requirements.txt diperbarui untuk menyertakan pustaka khusus apa pun.

Setelah Anda mengatur kode, kemas kode tersebut bersama dengan file persyaratan ke dalam wadah Docker. Anda dapat dengan mudah membuat wadah dari dalam Studio menggunakan perintah berikut:

Secara default, gambar akan didorong ke repositori ECR bernama sagemakerstudio dengan tag latest. Selain itu, peran eksekusi aplikasi Studio akan digunakan, bersama dengan bucket SageMaker Python SDK S3 default. Namun, pengaturan ini dapat dengan mudah diubah menggunakan opsi CLI yang sesuai. Lihat kode berikut:

Sekarang penampung telah dibuat dan didaftarkan di repositori ECR, saatnya untuk menyelami lebih dalam bagaimana kita dapat menggunakannya untuk menjalankan predict.py. Kami juga menunjukkan kepada Anda proses menggunakan pre-built scikit-belajar wadah untuk menjalankan preprocessing.py dan postprocessing.py.

Produksi wadah

Pada langkah ini, kami bertindak sebagai insinyur MLOps yang memproduksi wadah yang dibuat pada langkah sebelumnya.

Kami menggunakan Step Functions untuk mengatur alur kerja. Step Functions memungkinkan fleksibilitas luar biasa dalam mengintegrasikan beragam layanan ke dalam alur kerja, mengakomodasi semua ketergantungan yang ada yang mungkin ada di sistem lama. Pendekatan ini memastikan bahwa semua komponen yang diperlukan terintegrasi dengan mulus dan dijalankan dalam urutan yang diinginkan, sehingga menghasilkan solusi alur kerja yang efisien dan efektif.

Step Functions dapat mengontrol layanan AWS tertentu langsung dari Amazon States Language. Untuk mempelajari selengkapnya tentang bekerja dengan Step Functions dan integrasinya dengan SageMaker, lihat Kelola SageMaker dengan Step Functions. Menggunakan kapabilitas integrasi Step Functions dengan SageMaker, kami menjalankan skrip prapemrosesan dan pascapemrosesan menggunakan tugas Pemrosesan SageMaker dalam mode skrip dan menjalankan inferensi sebagai tugas Pemrosesan SageMaker menggunakan wadah kustom. Kami melakukannya menggunakan AWS SDK untuk Python (Boto3) Membuat Pekerjaan Pemrosesan panggilan API.

Pemrosesan awal

SageMaker menawarkan beberapa opsi untuk menjalankan kode khusus. Jika Anda hanya memiliki skrip tanpa ketergantungan khusus, Anda dapat menjalankan skrip sebagai Bawa Skrip Anda Sendiri (BYOS). Untuk melakukannya, cukup teruskan skrip Anda ke wadah kerangka kerja scikit-learn bawaan dan jalankan tugas Pemrosesan SageMaker dalam mode skrip menggunakan parameter ContainerArguments dan ContainerEntrypoint di Spesifikasi Aplikasi API. Ini adalah metode yang mudah dan nyaman untuk menjalankan skrip sederhana.

Lihat konfigurasi status "Preprocessing Script Mode" di contoh alur kerja Step Functions untuk memahami cara mengonfigurasi panggilan API CreateProcessingJob untuk menjalankan skrip kustom.

Kesimpulan

Anda dapat menjalankan wadah khusus menggunakan Bangun Wadah Pemrosesan Anda Sendiri mendekati. Pekerjaan Pemrosesan SageMaker beroperasi dengan /opt/ml jalur lokal, dan Anda dapat menentukan ProcessingInputs dan jalur lokalnya dalam konfigurasi. Pekerjaan Pemrosesan kemudian menyalin artefak ke penampung lokal dan memulai pekerjaan. Setelah pekerjaan selesai, itu menyalin artefak yang ditentukan di jalur lokal dari ProcessingOutputs ke lokasi eksternal yang ditentukan.

Lihat konfigurasi status "Kontainer Kustom Inferensi" di contoh alur kerja Step Functions untuk memahami cara mengonfigurasi panggilan API CreateProcessingJob untuk menjalankan wadah khusus.

Pengolahan pasca

Anda dapat menjalankan skrip postprocessing seperti skrip preprocessing menggunakan langkah Step Functions CreateProcessingJob. Menjalankan skrip pascapemrosesan memungkinkan Anda melakukan tugas pemrosesan khusus setelah pekerjaan inferensi selesai.

Buat alur kerja Step Functions

Untuk membuat prototipe dengan cepat, kami menggunakan Step Functions Bahasa Negara Bagian Amazon. Anda dapat mengedit definisi Step Functions secara langsung dengan menggunakan Bahasa Negara. Mengacu kepada contoh alur kerja Step Functions.

Anda dapat membuat mesin status Step Functions baru di konsol Step Functions dengan memilih Tulis alur kerja Anda dalam kode.

Step Functions dapat melihat sumber daya yang Anda gunakan dan membuat peran. Namun, Anda mungkin melihat pesan berikut:

“Step Functions tidak dapat membuat kebijakan IAM jika RoleArn untuk SageMaker berasal dari Path. Buat hardcode RoleArn SageMaker dalam definisi mesin negara Anda, atau pilih peran yang ada dengan izin yang tepat untuk Step Functions untuk memanggil SageMaker.”

Untuk mengatasinya, Anda harus membuat sebuah Identitas AWS dan Manajemen Akses (IAM) untuk Step Functions. Untuk instruksi, lihat Membuat peran IAM untuk mesin negara Anda. Kemudian lampirkan kebijakan IAM berikut untuk memberikan izin yang diperlukan untuk menjalankan alur kerja:

Gambar berikut mengilustrasikan alur data dan gambar container ke dalam setiap langkah alur kerja Step Functions.

Berikut ini adalah daftar parameter minimum yang diperlukan untuk diinisialisasi di Step Functions; Anda juga dapat merujuk ke contoh parameter masukan JSON:

- masukan_uri – URI S3 untuk file masukan

- keluaran_uri – S3 URI untuk file keluaran

- kode_uri – S3 URI untuk file skrip

- custom_image_uri – URI wadah untuk wadah khusus yang telah Anda buat

- scikit_image_uri – Wadah URI untuk kerangka kerja scikit-learn pra-bangun

- peran – Peran eksekusi untuk menjalankan pekerjaan

- contoh_tipe – Jenis instans yang perlu Anda gunakan untuk menjalankan wadah

- ukuran_volume – Ukuran volume penyimpanan yang Anda butuhkan untuk wadah

- max_runtime – Waktu proses maksimum untuk wadah, dengan nilai default 1 jam

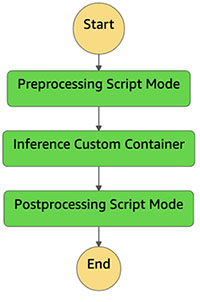

Jalankan alur kerja

Kami telah memecah kode lama menjadi bagian yang dapat dikelola: preprocessing, inference, dan postprocessing. Untuk mendukung kebutuhan inferensi kami, kami membuat wadah khusus yang dilengkapi dengan dependensi perpustakaan yang diperlukan. Rencana kami adalah menggunakan Step Functions, memanfaatkan kemampuannya untuk memanggil API SageMaker. Kami telah menunjukkan dua metode untuk menjalankan kode khusus menggunakan SageMaker API: tugas Pemrosesan SageMaker yang menggunakan gambar bawaan dan menggunakan skrip khusus pada waktu proses, dan tugas Pemrosesan SageMaker yang menggunakan wadah khusus, yang dipaketkan dengan yang diperlukan artefak untuk menjalankan inferensi khusus.

Gambar berikut menunjukkan proses alur kerja Step Functions.

Kesimpulan

Dalam postingan ini, kami membahas proses migrasi kode Python ML lama dari lingkungan pengembangan lokal dan penerapan prosedur MLOps standar. Dengan pendekatan ini, Anda dapat dengan mudah mentransfer ratusan model dan menggabungkan praktik penerapan perusahaan yang Anda inginkan. Kami menyajikan dua metode berbeda untuk menjalankan kode khusus di SageMaker, dan Anda dapat memilih salah satu yang paling sesuai dengan kebutuhan Anda.

Jika Anda memerlukan solusi yang sangat dapat disesuaikan, disarankan untuk menggunakan pendekatan wadah khusus. Anda mungkin merasa lebih cocok menggunakan gambar siap pakai untuk menjalankan skrip khusus jika Anda memiliki skrip dasar dan tidak perlu membuat penampung khusus, seperti yang dijelaskan dalam langkah prapemrosesan yang disebutkan sebelumnya. Selain itu, jika diperlukan, Anda dapat menerapkan solusi ini untuk mengemas langkah-langkah pelatihan dan evaluasi model lama, seperti bagaimana langkah inferensi dikemas dalam postingan ini.

Tentang Penulis

Bhavana Chirumamilla adalah Arsitek Residen Senior di AWS dengan hasrat kuat untuk operasi data dan pembelajaran mesin. Dia membawa banyak pengalaman dan antusiasme untuk membantu perusahaan membangun data yang efektif dan strategi ML. Di waktu luangnya, Bhavana menikmati menghabiskan waktu bersama keluarganya dan melakukan berbagai kegiatan seperti jalan-jalan, hiking, berkebun, dan menonton film dokumenter.

Bhavana Chirumamilla adalah Arsitek Residen Senior di AWS dengan hasrat kuat untuk operasi data dan pembelajaran mesin. Dia membawa banyak pengalaman dan antusiasme untuk membantu perusahaan membangun data yang efektif dan strategi ML. Di waktu luangnya, Bhavana menikmati menghabiskan waktu bersama keluarganya dan melakukan berbagai kegiatan seperti jalan-jalan, hiking, berkebun, dan menonton film dokumenter.

Shyam Namavaram adalah arsitek solusi spesialis kecerdasan buatan (AI) dan pembelajaran mesin (ML) senior di Amazon Web Services (AWS). Dia dengan penuh semangat bekerja dengan pelanggan untuk mempercepat adopsi AI dan ML mereka dengan memberikan panduan teknis dan membantu mereka berinovasi dan membangun solusi cloud yang aman di AWS. Dia berspesialisasi dalam AI dan ML, wadah, dan teknologi analitik. Di luar pekerjaan, ia suka berolahraga dan menikmati alam dengan trekking.

Shyam Namavaram adalah arsitek solusi spesialis kecerdasan buatan (AI) dan pembelajaran mesin (ML) senior di Amazon Web Services (AWS). Dia dengan penuh semangat bekerja dengan pelanggan untuk mempercepat adopsi AI dan ML mereka dengan memberikan panduan teknis dan membantu mereka berinovasi dan membangun solusi cloud yang aman di AWS. Dia berspesialisasi dalam AI dan ML, wadah, dan teknologi analitik. Di luar pekerjaan, ia suka berolahraga dan menikmati alam dengan trekking.

Qing Wei Li adalah Spesialis Pembelajaran Mesin di Amazon Web Services. Dia menerima gelar PhD dalam Riset Operasi setelah dia melanggar akun hibah penelitian penasihatnya dan gagal memberikan Hadiah Nobel yang dia janjikan. Saat ini, dia membantu pelanggan di industri layanan keuangan dan asuransi membangun solusi pembelajaran mesin di AWS. Di waktu luangnya, dia suka membaca dan mengajar.

Qing Wei Li adalah Spesialis Pembelajaran Mesin di Amazon Web Services. Dia menerima gelar PhD dalam Riset Operasi setelah dia melanggar akun hibah penelitian penasihatnya dan gagal memberikan Hadiah Nobel yang dia janjikan. Saat ini, dia membantu pelanggan di industri layanan keuangan dan asuransi membangun solusi pembelajaran mesin di AWS. Di waktu luangnya, dia suka membaca dan mengajar.

Srinivasa Shaik adalah Arsitek Solusi di AWS yang berbasis di Boston. Dia membantu pelanggan perusahaan mempercepat perjalanan mereka ke cloud. Dia sangat tertarik dengan wadah dan teknologi pembelajaran mesin. Di waktu senggangnya, ia senang menghabiskan waktu bersama keluarga, memasak, dan jalan-jalan.

Srinivasa Shaik adalah Arsitek Solusi di AWS yang berbasis di Boston. Dia membantu pelanggan perusahaan mempercepat perjalanan mereka ke cloud. Dia sangat tertarik dengan wadah dan teknologi pembelajaran mesin. Di waktu senggangnya, ia senang menghabiskan waktu bersama keluarga, memasak, dan jalan-jalan.

- Konten Bertenaga SEO & Distribusi PR. Dapatkan Amplifikasi Hari Ini.

- Platoblockchain. Intelijen Metaverse Web3. Pengetahuan Diperkuat. Akses Di Sini.

- Sumber: https://aws.amazon.com/blogs/machine-learning/bring-legacy-machine-learning-code-into-amazon-sagemaker-using-aws-step-functions/

- :adalah

- $NAIK

- 1

- 10

- 100

- 214

- 7

- 8

- a

- kemampuan

- Tentang Kami

- mempercepat

- mengakses

- Akun

- Bertindak

- Tindakan

- kegiatan

- menambahkan

- Selain itu

- alamat

- mengikuti

- Adopsi

- maju

- Keuntungan

- Setelah

- AI

- Semua

- memungkinkan

- Amazon

- Amazon SageMaker

- Amazon Web Services

- Layanan Web Amazon (AWS)

- jumlah

- analisis

- dan

- api

- Lebah

- aplikasi

- Mendaftar

- pendekatan

- sesuai

- arsitektur

- ADALAH

- buatan

- kecerdasan buatan

- Kecerdasan buatan (AI)

- AS

- At

- melampirkan

- secara otomatis

- tersedia

- AWS

- Pembelajaran Mesin AWS

- Fungsi Langkah AWS

- berdasarkan

- dasar

- BE

- mulai

- TERBAIK

- boston

- membawa

- Membawa

- Broke

- Rusak

- membangun

- Bangunan

- dibangun di

- built-in

- by

- panggilan

- bernama

- Panggilan

- CAN

- tidak bisa

- kasus

- kasus

- tertentu

- perubahan

- Pilih

- klien

- awan

- Kelompok

- kode

- Berkolaborasi

- COM

- lengkap

- kompleks

- komponen

- luas

- kondisi

- konfigurasi

- konsul

- membangun

- Wadah

- Wadah

- mengandung

- kontrol

- Mudah

- membuat

- menciptakan

- membuat

- Sekarang

- adat

- pelanggan

- disesuaikan

- data

- ilmuwan data

- lebih dalam

- Default

- menyampaikan

- mendemonstrasikan

- menyebarkan

- penyebaran

- dijelaskan

- diinginkan

- Desktop

- dikembangkan

- berkembang

- Pengembangan

- berbeda

- langsung

- dibahas

- berbeda

- beberapa

- Buruh pelabuhan

- dokumenter

- domain

- Dont

- turun

- selama

- setiap

- Terdahulu

- mudah

- efek

- Efektif

- efisien

- usaha

- antara

- menghilangkan

- menarik

- insinyur

- memastikan

- Memastikan

- Enterprise

- perusahaan

- antusiasme

- Lingkungan Hidup

- lingkungan

- lengkap

- kesalahan

- evaluasi

- contoh

- luar biasa

- eksekusi

- ada

- pengalaman

- mengalami

- memperpanjang

- luar

- memfasilitasi

- Gagal

- Keakraban

- keluarga

- Angka

- File

- keuangan

- servis keuangan

- Menemukan

- cocok

- keluwesan

- aliran

- mengikuti

- berikut

- Untuk

- Kerangka

- dari

- sepenuhnya

- fungsi

- fungsionil

- fungsi

- fungsi

- Selanjutnya

- menghasilkan

- GitHub

- memberikan

- bimbingan

- Panduan

- Memiliki

- membantu

- membantu

- membantu

- tingkat tinggi

- sangat

- Seterpercayaapakah Olymp Trade? Kesimpulan

- How To

- Namun

- HTML

- http

- HTTPS

- Ratusan

- diidentifikasi

- identitas

- gambar

- gambar

- implementasi

- mengimplementasikan

- mengimpor

- penting

- in

- Di lain

- memasukkan

- menggabungkan

- industri

- Infrastruktur

- mulanya

- memulai

- berinovasi

- memasukkan

- install

- Instalasi

- contoh

- instruksi

- asuransi

- terpadu

- Mengintegrasikan

- integrasi

- Intelijen

- berinteraksi

- terlibat

- keterlibatan

- IT

- NYA

- Pekerjaan

- Jobs

- perjalanan

- jpg

- json

- hanya satu

- bahasa

- besar

- Terbaru

- BELAJAR

- pengetahuan

- Warisan

- perpustakaan

- Perpustakaan

- siklus hidup

- 'like'

- LINK

- Daftar

- lokal

- tempat

- melihat

- mesin

- Mesin belajar

- Utama

- mengelola

- berhasil

- pengelolaan

- manual

- maksimum

- tersebut

- pesan

- metode

- metode

- bermigrasi

- migrasi

- minimum

- ML

- MLOps

- mode

- model

- model

- modular

- lebih

- paling

- bergerak

- Bernama

- Alam

- Navigasi

- perlu

- Perlu

- kebutuhan

- New

- Penghargaan Nobel

- buku catatan

- jumlah

- of

- Penawaran

- on

- ONE

- pembukaan

- beroperasi

- Operasi

- dioptimalkan

- Opsi

- diatur

- organisasi

- terorganisir

- Lainnya

- keluaran

- di luar

- sendiri

- kepemilikan

- paket

- parameter

- bagian

- gairah

- bergairah

- path

- Melakukan

- Izin

- rencana

- plato

- Kecerdasan Data Plato

- Data Plato

- bermain

- kebijaksanaan

- Pos

- praktek

- praktek

- meramalkan

- disajikan

- sebelumnya

- hadiah

- proses

- pengolahan

- Pemrograman

- dijanjikan

- tepat

- prototyping

- memberikan

- disediakan

- menyediakan

- menyediakan

- Menarik

- tujuan

- terdorong

- Ular sanca

- Cepat

- segera

- jarak

- Bacaan

- diterima

- direkomendasikan

- Faktor ulang

- mengacu

- terdaftar

- register

- pendaftaran

- gudang

- membutuhkan

- wajib

- Persyaratan

- penelitian

- sumber

- Sumber

- tanggung jawab

- mengakibatkan

- dihasilkan

- dapat digunakan kembali

- Peran

- Run

- berjalan

- pembuat bijak

- terukur

- skenario

- ilmuwan

- scikit-belajar

- script

- SDK

- mulus

- aman

- memilih

- senior

- terpisah

- Urutan

- Tanpa Server

- layanan

- Layanan

- set

- set

- pengaturan

- penyiapan

- beberapa

- Share

- bergeser

- Menunjukkan

- ditunjukkan

- Pertunjukkan

- Sederhana

- hanya

- tunggal

- Ukuran

- So

- larutan

- Solusi

- beberapa

- spesialis

- spesialisasi

- tertentu

- Secara khusus

- ditentukan

- Pengeluaran

- berputar

- Olahraga

- magang

- standalone

- dimulai

- Negara

- Pernyataan

- Negara

- Langkah

- Tangga

- penyimpanan

- tersimpan

- mudah

- strategi

- mempersingkat

- pelurusan

- kuat

- studio

- seperti itu

- cocok

- mendukung

- SYS

- sistem

- MENANDAI

- Mengambil

- Dibutuhkan

- pengambilan

- tugas

- Pengajaran

- Teknis

- Teknologi

- bahwa

- Grafik

- mereka

- Mereka

- Ini

- ribuan

- tiga

- Melalui

- waktu

- untuk

- alat

- alat

- Pelatihan

- transfer

- Perjalanan

- pokok

- memahami

- diperbarui

- menggunakan

- gunakan case

- kegunaan

- Penggunaan

- dimanfaatkan

- memanfaatkan

- nilai

- berbagai

- versi

- volume

- menonton

- Kekayaan

- jaringan

- layanan web

- yang

- SIAPA

- akan

- dengan

- dalam

- tanpa

- kata

- Kerja

- kerja

- bekerja

- Kamu

- Anda

- zephyrnet.dll