Google dan Intel pada hari Selasa meluncurkan chip AI mereka sendiri untuk menantang Nvidia ketika perlombaan untuk memproduksi semikonduktor canggih untuk mendukung model AI generatif seperti ChatGPT atau Gemini semakin intensif.

Google merilis Cloud TPU v5p dan Intel meluncurkan prosesor Gaudi 3 AI-nya. Chip tersebut dirancang untuk meningkatkan kinerja dalam pelatihan sistem AI serta 'menjalankan perangkat lunak yang sudah jadi.'

Baca juga: Gempa Taiwan Mengganggu Pusat Chip AI Utama, Mengancam Pasokan Global

Melatih LLM dengan kecepatan lebih

Google pertama kali mengumumkan TPU barunya, atau unit pemrosesan tensor, pada bulan Desember, bersama Gemini. Dikatakan bahwa TPU v5p, yang sekarang tersedia untuk pengembang, adalah prosesor AI yang paling “kuat dan terukur”.

Perusahaan mengklaim bahwa chip yang diperbarui dapat melatih model bahasa besar (LLM), seperti teknologi di balik chatbot AI Gemini dan ChatGPT, tiga kali lebih cepat dari pendahulunya, Google TPU v4. Dikatakan bahwa chip AI memberikan throughput 12 kali lipat dibandingkan versi lama.

“Sekarang di generasi kelima, kemajuan ini [pada TPU Google] telah membantu pelanggan melatih dan menyajikan model bahasa mutakhir,” kata CEO Google Sundar Pichai pada acara perusahaan di Las Vegas, menurut ke media industri.

[Embedded content]

Meskipun tujuannya adalah untuk menantang Nvidia, perusahaan AS yang memasok hingga 90% chip AI yang dikenal sebagai unit pemrosesan grafis, atau GPU, Google menunjukkan bahwa mereka masih bergantung pada Nvidia.

Pada bagian yang sama posting blog mengumumkan TPU terbarunya, Google mengatakan sedang meningkatkan superkomputer A3-nya, yang ditenagai oleh NVIDIA H100 unit pemrosesan grafis. Perusahaan juga mengungkapkan bahwa mereka menggunakan GPU terbaru Nvidia, yaitu Blackwell, di AI Hypercomputer-nya.

Google juga merilis Axion, unit pemrosesan pusat (CPU) khusus baru untuk pusat data yang dibangun menggunakan teknologi Arm dari perusahaan Inggris. Dikatakan Axion, yang menyaingi CPU dari Microsoft, Amazon, dan Meta, dapat menangani berbagai tugas, termasuk pencarian Google dan operasi AI.

Menurut Google, Axion memberikan “kinerja 30% lebih baik dibandingkan instance berbasis Arm tujuan umum tercepat yang tersedia di cloud saat ini” dan “kinerja hingga 50% lebih baik dan efisiensi energi hingga 60% lebih baik” dibandingkan Arm tujuan umum lainnya. keripik.

Intel: AI di mana-mana

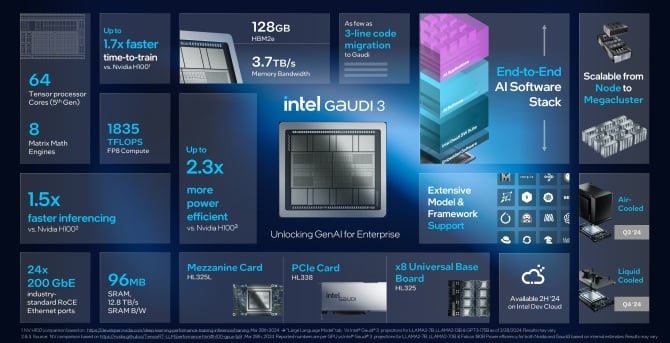

Pada hari Selasa, Intel juga mengumumkan peluncuran versi baru prosesor kecerdasan buatannya, Gaudi 3. Perusahaan mengatakan chip Gaudi 3 dua kali lebih hemat daya dibandingkan GPU H100 Nvidia dan dapat menjalankan model AI satu-satu. setengah kali lebih cepat.

“Inovasi berkembang dengan kecepatan yang belum pernah terjadi sebelumnya, semuanya dimungkinkan oleh silikon – dan setiap perusahaan dengan cepat menjadi perusahaan AI,” kata CEO Intel Pat Gelsinger, dalam sebuah pernyataan. pernyataan. “Intel menghadirkan AI ke mana pun di seluruh perusahaan, mulai dari PC, pusat data, hingga edge.

🔎

_🔥🔥🔥_

****🤖****— Mundia Brian (@Mundia_Brian_) 9 April, 2024

Gelsinger tidak menyebutkan berapa biaya Gaudi 3, Bloomberg laporan, namun mengatakan apa yang disebut chip akselerator perusahaannya akan “jauh di bawah” harga chip Nvidia saat ini dan masa depan. Mereka akan menawarkan total biaya kepemilikan yang “sangat bagus”, tambahnya.

Intel mengklaim bahwa chip terbarunya akan memberikan “lompatan signifikan” dalam pelatihan dan inferensi AI untuk entitas yang bekerja pada AI generatif. Perusahaan yang melatih sistem AI memerlukannya untuk dapat membuat prediksi sebagai jawaban atas pertanyaan nyata – yang dikenal sebagai inferensi.

Menurut Intel, Gaudi 3 akan lebih cepat dan lebih hemat daya dibandingkan H100, dan semua model bahasa besar dilatih menggunakan GPU seperti Llama dari Meta atau Falcon multibahasa dari Abu Dhabi. Dikatakan bahwa chip tersebut dapat membantu melatih model seperti Difusi Stabil atau Whisper dari OpenAI, untuk pengenalan suara.

Perusahaan mengatakan dalam jenis pelatihan ini, Gaudi 3 1.7 kali lebih cepat dan 1.5 kali lebih baik dalam menjalankan perangkat lunak. Kinerja chip AI ini sebanding dengan B200 baru Nvidia, kata Intel, unggul di beberapa bidang dan tertinggal di bidang lain.

Intel mengatakan chip Gaudi 3 baru akan tersedia untuk pelanggan pada kuartal ketiga, dan perusahaan termasuk Supermicro, Dell dan HP akan membangun sistem dengan akselerator AI.

Menantang Nvidia

Perusahaan yang membangun sistem AI generatif berupaya menurunkan biaya dengan berhenti mengandalkan GPU Nvidia, yang harganya mahal.

Pada tahun 2023, Amazon menghabiskan sekitar $65 juta untuk satu kali pelatihan, menurut insinyur perangkat lunak James Hamilton. Dia memperkirakan angka itu akan segera mencapai lebih dari $1 miliar.

Seminggu yang lalu, OpenAI dan Microsoft mengungkapkan berencana membangun pusat data senilai $100 miliar untuk pelatihan AI yang diberi nama 'Stargate.” Dan pada bulan Januari, CEO Meta Mark Zuckerberg mengatakan perusahaannya berencana menghabiskan $9 miliar hanya untuk GPU Nvidia saja.

Semua perusahaan teknologi besar membeli chip dari Nvidia, namun mereka juga mulai membuatnya sendiri, atau membeli dari AMD, yang memperkenalkan GPU pusat data baru yang disebut MI300X tahun lalu. AMD berencana untuk memperluas dan menjual lebih banyak chip kecerdasan buatan ke server tahun ini.

Pesaing Google, Microsoft, Meta [keduanya pelanggan AMD] dan Amazon, juga telah mengembangkan chip AI mereka sendiri. Namun, hal ini tidak akan mudah. Awal tahun ini, Nvidia merilis GPU B100 dan B200, penerus H100, yang menjanjikan peningkatan kinerja. Chip tersebut diharapkan mulai dikirimkan pada akhir tahun 2024.

Perkembangan AI dan H100 membantu dua kali lipat pendapatan Nvidia dan meningkatkan valuasi pasarnya menjadi lebih dari $2 triliun, menjadikannya salah satu perusahaan paling sukses di Wall Street.

- Konten Bertenaga SEO & Distribusi PR. Dapatkan Amplifikasi Hari Ini.

- PlatoData.Jaringan Vertikal Generatif Ai. Berdayakan Diri Anda. Akses Di Sini.

- PlatoAiStream. Intelijen Web3. Pengetahuan Diperkuat. Akses Di Sini.

- PlatoESG. Karbon, teknologi bersih, energi, Lingkungan Hidup, Tenaga surya, Penanganan limbah. Akses Di Sini.

- PlatoHealth. Kecerdasan Uji Coba Biotek dan Klinis. Akses Di Sini.

- Sumber: https://metanews.com/google-and-intel-launch-own-ai-chips-as-nvidia-rivalry-heats-up/

- :adalah

- :bukan

- $ 1 miliar

- $ 65 juta

- $ 9 Billion

- $NAIK

- 1

- 12

- 2023

- 2024

- 7

- 800

- 9

- a

- Sanggup

- akselerator

- Menurut

- di seluruh

- menambahkan

- maju

- kemajuan

- maju

- silam

- AI

- Model AI

- Sistem AI

- Pelatihan AI

- tujuan

- Semua

- sendirian

- di samping

- juga

- Amazon

- AMD

- an

- dan

- mengumumkan

- Mengumumkan

- ADALAH

- daerah

- ARM

- sekitar

- buatan

- kecerdasan buatan

- AS

- At

- tersedia

- BE

- menjadi

- di belakang

- dibalik layar

- Lebih baik

- Milyar

- Bloomberg

- ledakan

- mendorong

- kedua

- Brian

- membawa

- Membawa

- membangun

- Bangunan

- dibangun di

- tapi

- membeli

- by

- bernama

- CAN

- pusat

- Pusat

- pusat

- ceo

- menantang

- chatbots

- ChatGPT

- keping

- Keripik

- klaim

- awan

- Perusahaan

- perusahaan

- Perusahaan

- sebanding

- pesaing

- Konten

- Biaya

- Biaya

- terbaru

- adat

- pelanggan

- pemotongan

- data

- Data Center

- Pusat Data

- Datacenter

- Desember

- menyampaikan

- memberikan

- Dell

- tergantung

- dirancang

- dikembangkan

- pengembang

- MELAKUKAN

- Difusi

- mengganggu

- dua kali lipat

- turun

- dijuluki

- Terdahulu

- Mudah

- Tepi

- tertanam

- diaktifkan

- insinyur

- Enterprise

- entitas

- Acara

- Setiap

- di mana-mana

- Lihat lebih lanjut

- diharapkan

- mengharapkan

- mahal

- lebih cepat

- tercepat

- Angka

- Perusahaan

- perusahaan

- Pertama

- Untuk

- dari

- masa depan

- Keuntungan

- Gemini

- Umum

- tujuan umum

- generasi

- generatif

- AI generatif

- Aksi

- akan

- Google Cloud

- GPU

- GPU

- grafis

- Hamilton

- menangani

- Memiliki

- he

- membantu

- membantu

- High

- -nya

- Seterpercayaapakah Olymp Trade? Kesimpulan

- Namun

- HTTPS

- Pusat

- in

- Termasuk

- industri

- Intel

- Intelijen

- Mengintensifkan

- diperkenalkan

- IT

- NYA

- james

- Januari

- jpg

- hanya

- dikenal

- bahasa

- besar

- LAS

- Las Vegas

- Terakhir

- Tahun lalu

- kemudian

- Terbaru

- jalankan

- diluncurkan

- 'like'

- Llama

- mencari

- Lot

- utama

- membuat

- Membuat

- tanda

- Mark Zuckerberg

- Pasar

- max-width

- Media

- meta

- Microsoft

- juta

- model

- lebih

- paling

- banyak

- Perlu

- New

- sekarang

- Nvidia

- of

- menawarkan

- Tua

- on

- ONE

- OpenAI

- Operasi

- or

- Lainnya

- Lainnya

- lebih

- sendiri

- kepemilikan

- Perdamaian

- PC

- prestasi

- rencana

- plato

- Kecerdasan Data Plato

- Data Plato

- kekuasaan

- didukung

- pendahulu

- Prediksi

- pengolahan

- Prosesor

- menjanjikan

- menyediakan

- tujuan

- gempa

- Perempat

- Pertanyaan

- segera

- Ras

- mencapai

- Baca

- nyata

- pengakuan

- dirilis

- mengandalkan

- tanggapan

- Terungkap

- persaingan

- saingan

- Run

- berjalan

- Tersebut

- sama

- mengatakan

- adegan

- pencarian

- menjual

- Semikonduktor

- melayani

- Server

- Pengiriman

- menunjukkan

- penting

- Silikon

- tunggal

- Perangkat lunak

- Software Engineer

- beberapa

- segera

- pidato

- Speech Recognition

- menghabiskan

- menghabiskan

- stabil

- awal

- mulai

- Negara

- Masih

- jalan

- sukses

- seperti itu

- Sundar Pichai

- superkomputer

- perbekalan

- sistem

- tugas

- tech

- Teknologi

- dari

- bahwa

- Grafik

- mereka

- Mereka

- diri

- Ini

- mereka

- Ketiga

- ini

- tahun ini

- tiga

- keluaran

- kali

- untuk

- Total

- Pelatihan VE

- terlatih

- Pelatihan

- pelatihan

- Triliun

- benar

- Selasa

- Dua kali

- mengetik

- Uk

- satuan

- unit

- belum pernah terjadi sebelumnya

- meluncurkan

- diperbarui

- us

- menggunakan

- Penilaian

- berbagai

- Vegas

- versi

- Dinding

- wall Street

- minggu

- BAIK

- yang

- Berbisik

- akan

- dengan

- kerja

- akan

- tahun

- namun

- Youtube

- zephyrnet.dll

- Zuckerberg