Deteksi penipuan adalah masalah penting yang memiliki aplikasi di layanan keuangan, media sosial, e-niaga, game, dan industri lainnya. Posting ini menyajikan implementasi solusi deteksi penipuan menggunakan model Relational Graph Convolutional Network (RGCN) untuk memprediksi kemungkinan bahwa suatu transaksi adalah penipuan melalui mode inferensi transduktif dan induktif. Anda dapat menerapkan implementasi kami ke sebuah Amazon SageMaker endpoint sebagai solusi deteksi penipuan real-time, tanpa memerlukan penyimpanan grafik eksternal atau orkestrasi, sehingga secara signifikan mengurangi biaya penerapan model.

Bisnis yang mencari layanan AI AWS yang terkelola sepenuhnya untuk deteksi penipuan juga dapat menggunakan Detektor Penipuan Amazon, yang dapat Anda gunakan untuk mengidentifikasi pembayaran online yang mencurigakan, mendeteksi penipuan akun baru, mencegah penyalahgunaan program uji coba dan loyalitas, atau meningkatkan deteksi pengambilalihan akun.

Ikhtisar solusi

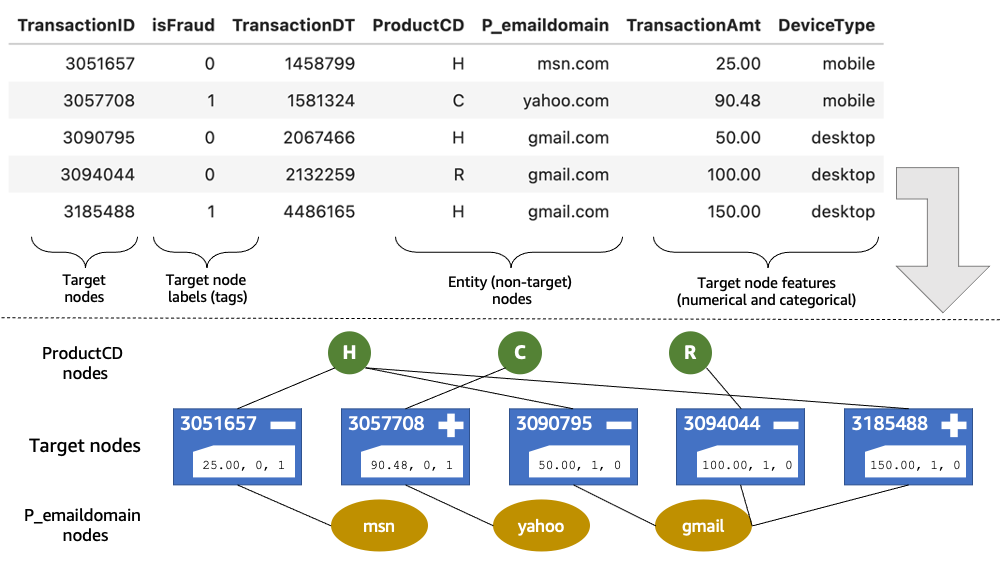

Diagram berikut menjelaskan contoh jaringan transaksi keuangan yang mencakup berbagai jenis informasi. Setiap transaksi berisi informasi seperti pengidentifikasi perangkat, ID Wi-Fi, alamat IP, lokasi fisik, nomor telepon, dan lainnya. Kami merepresentasikan kumpulan data transaksi melalui grafik heterogen yang berisi berbagai jenis node dan edge. Kemudian, masalah deteksi penipuan ditangani sebagai tugas klasifikasi simpul pada grafik heterogen ini.

Jaringan neural grafik (GNN) telah menunjukkan harapan besar dalam mengatasi masalah deteksi penipuan, mengungguli metode pembelajaran terawasi yang populer seperti pohon keputusan yang ditingkatkan gradien atau jaringan feed-forward yang terhubung sepenuhnya pada dataset pembandingan. Dalam penyiapan deteksi pemalsuan tipikal, selama fase pelatihan, model GNN dilatih pada serangkaian transaksi berlabel. Setiap transaksi pelatihan dilengkapi dengan label biner yang menunjukkan apakah itu penipuan. Model terlatih ini kemudian dapat digunakan untuk mendeteksi transaksi curang di antara serangkaian transaksi tanpa label selama fase inferensi. Ada dua mode inferensi yang berbeda: inferensi transduktif vs. inferensi induktif (yang akan kita bahas lebih lanjut di posting ini).

Model berbasis GNN, seperti RGCN, dapat memanfaatkan informasi topologi, menggabungkan struktur grafik dan fitur node dan edge untuk mempelajari representasi bermakna yang membedakan transaksi berbahaya dari transaksi yang sah. RGCN dapat secara efektif belajar merepresentasikan berbagai jenis node dan edge (relasi) melalui penyisipan grafik heterogen. Dalam diagram sebelumnya, setiap transaksi dimodelkan sebagai node target, dan beberapa entitas yang terkait dengan setiap transaksi dimodelkan sebagai tipe node non-target, seperti ProductCD dan P_emaildomain. Node target memiliki fitur numerik dan kategori yang ditetapkan, sedangkan tipe node lainnya tidak memiliki fitur. Model RGCN mempelajari embedding untuk setiap jenis node non-target. Untuk penyematan node target, operasi konvolusional digunakan untuk menghitung penyisipannya menggunakan fitur dan penyematan lingkungannya. Di sisa postingan, kami menggunakan istilah GNN dan RGCN secara bergantian.

Perlu dicatat bahwa strategi alternatif, seperti memperlakukan entitas non-target sebagai fitur dan pengkodean satu-panas, seringkali tidak layak karena kardinalitas besar dari entitas ini. Sebaliknya, pengkodean mereka sebagai entitas grafik memungkinkan model GNN untuk mengambil keuntungan dari topologi implisit dalam hubungan entitas. Misalnya, transaksi yang menggunakan nomor telepon yang sama dengan transaksi penipuan yang diketahui, kemungkinan besar juga merupakan penipuan.

Representasi grafik yang digunakan oleh GNN menciptakan beberapa kerumitan dalam penerapannya. Hal ini terutama berlaku untuk aplikasi seperti deteksi penipuan, di mana representasi grafik dapat ditambah selama inferensi dengan node yang baru ditambahkan yang sesuai dengan entitas yang tidak diketahui selama pelatihan model. Skenario inferensi ini biasanya disebut sebagai modus induktif. Sebaliknya, modus transduktif adalah skenario yang mengasumsikan representasi grafik yang dibangun selama pelatihan model tidak akan berubah selama inferensi. Model GNN sering dievaluasi dalam mode transduktif dengan membangun representasi grafik dari kumpulan contoh pelatihan dan pengujian gabungan, sambil menutupi label pengujian selama propagasi balik. Ini memastikan representasi grafik statis, dan di sana model GNN tidak memerlukan implementasi operasi untuk memperluas grafik dengan node baru selama inferensi. Sayangnya, representasi grafik statis tidak dapat diasumsikan saat mendeteksi transaksi penipuan di dunia nyata. Oleh karena itu, dukungan untuk inferensi induktif diperlukan saat menerapkan model GNN untuk deteksi penipuan ke lingkungan produksi.

Selain itu, mendeteksi transaksi penipuan secara real time sangatlah penting, terutama dalam kasus bisnis di mana hanya ada satu peluang untuk menghentikan aktivitas ilegal. Misalnya, pengguna penipu dapat berperilaku jahat sekali saja dengan akun dan tidak pernah menggunakan akun yang sama lagi. Inferensi real-time pada model GNN memperkenalkan kompleksitas tambahan pada implementasinya. Seringkali diperlukan untuk mengimplementasikan operasi ekstraksi subgraf untuk mendukung inferensi real-time. Operasi ekstraksi subgraf diperlukan untuk mengurangi latensi inferensi saat representasi grafik besar dan melakukan inferensi pada seluruh grafik menjadi sangat mahal. Algoritma untuk inferensi induktif real-time dengan model RGCN berjalan sebagai berikut:

- Mengingat sekumpulan transaksi dan model RGCN yang terlatih, perluas representasi grafik dengan entitas dari kumpulan tersebut.

- Tetapkan vektor penyematan node non-target baru dengan vektor penyematan rata-rata dari tipe node masing-masing.

- Ekstrak subgraf yang diinduksi oleh k-hop out-neighborhood dari target node dari batch.

- Lakukan inferensi pada subgraf dan kembalikan skor prediksi untuk node target kumpulan.

- Bersihkan representasi grafik dengan menghapus node yang baru ditambahkan (langkah ini memastikan persyaratan memori untuk inferensi model tetap konstan).

Kontribusi utama dari posting ini adalah menyajikan model RGCN yang mengimplementasikan algoritma inferensi induktif waktu nyata. Anda dapat menerapkan implementasi RGCN kami ke titik akhir SageMaker sebagai solusi deteksi penipuan waktu nyata. Solusi kami tidak memerlukan penyimpanan atau orkestrasi grafik eksternal, dan secara signifikan mengurangi biaya penerapan model RGCN untuk tugas deteksi penipuan. Model ini juga menerapkan mode inferensi transduktif, memungkinkan kami melakukan eksperimen untuk membandingkan kinerja model dalam mode induktif dan transduktif. Kode model dan notebook dengan eksperimen dapat diakses dari Contoh AWS GitHub repo.

Posting ini dibuat di atas postingan Bangun solusi deteksi penipuan real-time berbasis GNN menggunakan Amazon SageMaker, Amazon Neptune, dan Deep Graph Library. Posting sebelumnya membangun solusi deteksi penipuan real-time berbasis RGCN menggunakan SageMaker, Amazon Neptunus, Dan Perpustakaan Grafik Dalam (DGL). Solusi sebelumnya menggunakan database Neptunus sebagai penyimpanan grafik eksternal, diperlukan AWS Lambda untuk orkestrasi untuk inferensi real-time, dan hanya menyertakan eksperimen dalam mode transduktif.

Model RGCN yang diperkenalkan dalam posting ini mengimplementasikan semua operasi dari algoritma inferensi induktif real-time hanya menggunakan DGL sebagai ketergantungan, dan tidak memerlukan penyimpanan grafik eksternal atau orkestrasi untuk penerapan.

Kami pertama-tama mengevaluasi kinerja model RGCN dalam mode transduktif dan induktif pada dataset benchmark. Seperti yang diharapkan, kinerja model dalam mode induktif sedikit lebih rendah daripada mode transduktif. Kami juga mempelajari efek dari hyperparameter k pada kinerja model. Hiperparameter k mengontrol jumlah lompatan yang dilakukan untuk mengekstraksi subgraf pada Langkah 3 dari algoritme inferensi real-time. Nilai yang lebih tinggi dari k akan menghasilkan subgraf yang lebih besar dan dapat menghasilkan kinerja inferensi yang lebih baik dengan mengorbankan latensi yang lebih tinggi. Karena itu, kami juga melakukan percobaan waktu untuk mengevaluasi kelayakan model RGCN untuk aplikasi waktu nyata.

Dataset

Kami menggunakan Dataset penipuan IEEE-CIS, kumpulan data yang sama yang digunakan sebelumnya pos. Kumpulan data berisi lebih dari 590,000 catatan transaksi yang memiliki label penipuan biner (file isFraud kolom). Data dibagi menjadi dua tabel: transaksi dan identitas. Namun, tidak semua catatan transaksi memiliki informasi identitas yang sesuai. Kami bergabung dengan dua tabel di TransactionID kolom, yang menyisakan total 144,233 catatan transaksi. Kami mengurutkan tabel berdasarkan stempel waktu transaksi (file TransactionDT kolom) dan membuat persentase 80/20 dibagi berdasarkan waktu, masing-masing menghasilkan 115,386 dan 28,847 transaksi untuk pelatihan dan pengujian.

Untuk detail lebih lanjut tentang dataset dan cara memformatnya agar sesuai dengan persyaratan input DGL, lihat Mendeteksi penipuan di jaringan heterogen menggunakan Amazon SageMaker dan Deep Graph Library.

Konstruksi grafik

Kami menggunakan TransactionID kolom untuk menghasilkan node target. Kami menggunakan kolom berikut untuk menghasilkan 11 jenis node non-target:

card1melaluicard6ProductCDaddr1danaddr2P_emaildomaindanR_emaildomain

Kami menggunakan 38 kolom sebagai fitur kategori dari node target:

M1melaluiM9DeviceTypedanDeviceInfoid_12melaluiid_38

Kami menggunakan 382 kolom sebagai fitur numerik dari node target:

TransactionAmtdist1dandist2id_01melaluiid_11C1melaluiC14D1melaluiD15V1melaluiV339

Grafik kami yang dibuat dari transaksi pelatihan berisi 217,935 node dan 2,653,878 edge.

Hyperparameter

Parameter lain diatur agar sesuai dengan parameter yang dilaporkan sebelumnya pos. Cuplikan berikut mengilustrasikan pelatihan model RGCN dalam mode transduktif dan induktif:

Mode induktif vs transduktif

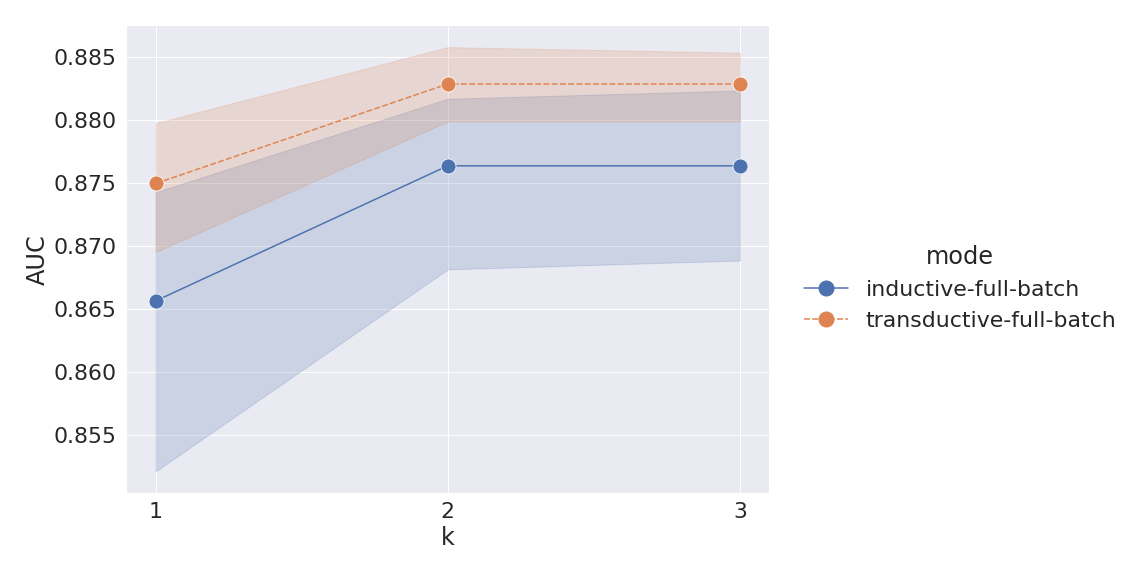

Kami melakukan lima percobaan untuk mode induktif dan lima percobaan untuk mode transduktif. Untuk setiap percobaan, kami melatih model RGCN dan menyimpannya ke disk, mendapatkan 10 model. Kami mengevaluasi setiap model pada contoh uji sambil meningkatkan jumlah hop (parameter k) digunakan untuk mengekstrak subgraf untuk inferensi, pengaturan k ke 1, 2, dan 3. Kami memprediksi semua contoh pengujian sekaligus, dan menghitung skor ROC AUC untuk setiap percobaan. Plot berikut menunjukkan rata-rata dan interval kepercayaan 95% dari skor AUC.

Kita dapat melihat bahwa kinerja dalam mode transduktif sedikit lebih tinggi daripada mode induktif. Untuk k= 2, skor rata-rata AUC untuk mode induktif dan transduktif masing-masing adalah 0.876 dan 0.883. Ini diharapkan karena model RGCN dapat mempelajari penyematan semua node entitas dalam mode transduktif, termasuk yang ada di set pengujian. Sebaliknya, mode induktif hanya memungkinkan model untuk mempelajari penyematan node entitas yang ada dalam contoh pelatihan, dan oleh karena itu beberapa node harus diisi rata-rata selama inferensi. Pada saat yang sama, penurunan kinerja antara mode transduktif dan induktif tidak signifikan, dan bahkan dalam mode induktif, model RGCN mencapai kinerja yang baik dengan AUC 0.876. Kami juga mengamati bahwa kinerja model tidak meningkat untuk nilai k>2. Ini menyiratkan pengaturan itu k=2 akan mengekstraksi subgraf yang cukup besar selama inferensi, menghasilkan kinerja yang optimal. Pengamatan ini juga dikonfirmasi oleh percobaan kami berikutnya.

Perlu juga dicatat bahwa, untuk mode transduktif, AUC model kami sebesar 0.883 lebih tinggi daripada AUC yang sesuai sebesar 0.870 yang dilaporkan di model sebelumnya. pos. Kami menggunakan lebih banyak kolom sebagai fitur numerik dan kategorikal dari node target, yang dapat menjelaskan skor AUC yang lebih tinggi. Kami juga mencatat bahwa percobaan di posting sebelumnya hanya melakukan satu percobaan.

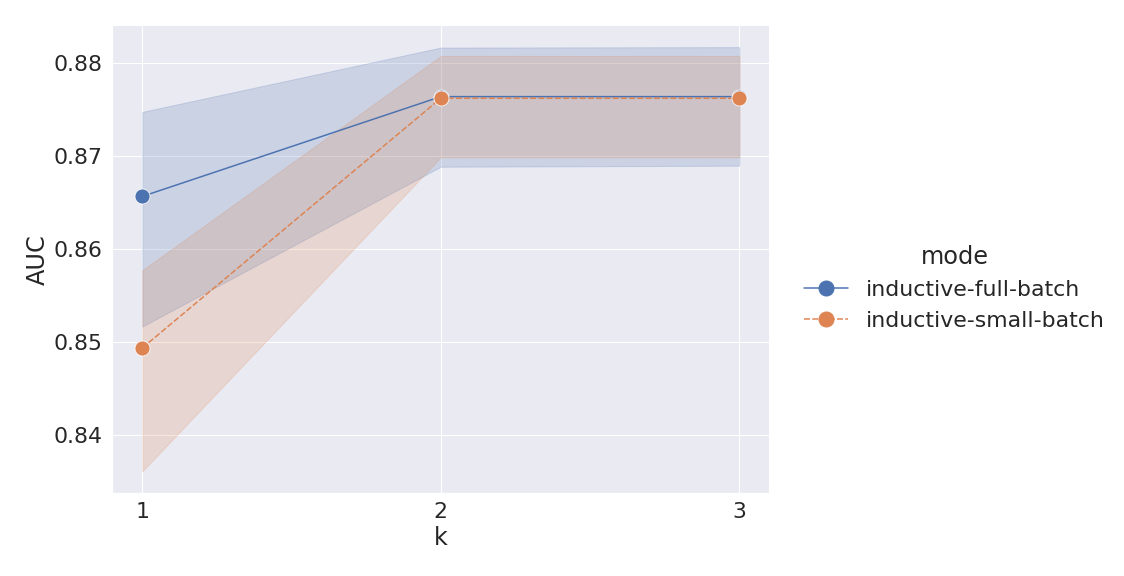

Inferensi pada batch kecil

Untuk percobaan ini, kami mengevaluasi model RGCN dalam pengaturan inferensi batch kecil. Kami menggunakan lima model yang dilatih dalam mode induktif pada percobaan sebelumnya. Kami membandingkan performa model ini saat memprediksi dalam dua pengaturan: inferensi batch penuh dan kecil. Untuk inferensi batch penuh, kami memprediksi seluruh set pengujian, seperti yang dilakukan pada percobaan sebelumnya. Untuk inferensi batch kecil, kami memprediksi dalam batch kecil dengan mempartisi set pengujian menjadi 28 batch dengan ukuran yang sama dengan sekitar 1,000 transaksi di setiap batch. Kami menghitung skor AUC untuk kedua pengaturan menggunakan nilai yang berbeda dari k. Plot berikut menunjukkan interval kepercayaan rata-rata dan 95% untuk pengaturan inferensi batch penuh dan kecil.

Kami mengamati bahwa kinerja untuk inferensi batch kecil ketika k=1 lebih rendah daripada batch penuh. Namun, kinerja inferensi batch kecil cocok dengan batch penuh saat k>1. Ini dapat dikaitkan dengan subgraf yang jauh lebih kecil yang diekstraksi untuk batch kecil. Kami mengonfirmasi hal ini dengan membandingkan ukuran subgraf dengan ukuran keseluruhan grafik yang dibuat dari transaksi pelatihan. Kami membandingkan ukuran grafik dalam hal jumlah node. Untuk k=1, ukuran subgraf rata-rata untuk inferensi batch kecil kurang dari 2% dari grafik pelatihan. Dan untuk inferensi batch penuh kapan k=1, ukuran subgraf adalah 22%. Kapan k=2, ukuran subgraf untuk inferensi batch kecil dan penuh masing-masing adalah 54% dan 64%. Terakhir, ukuran subgraf untuk kedua pengaturan inferensi mencapai 100% untuk k=3. Dengan kata lain, kapan k>1, subgraf untuk batch kecil menjadi cukup besar, memungkinkan inferensi batch kecil mencapai kinerja yang sama dengan inferensi batch penuh.

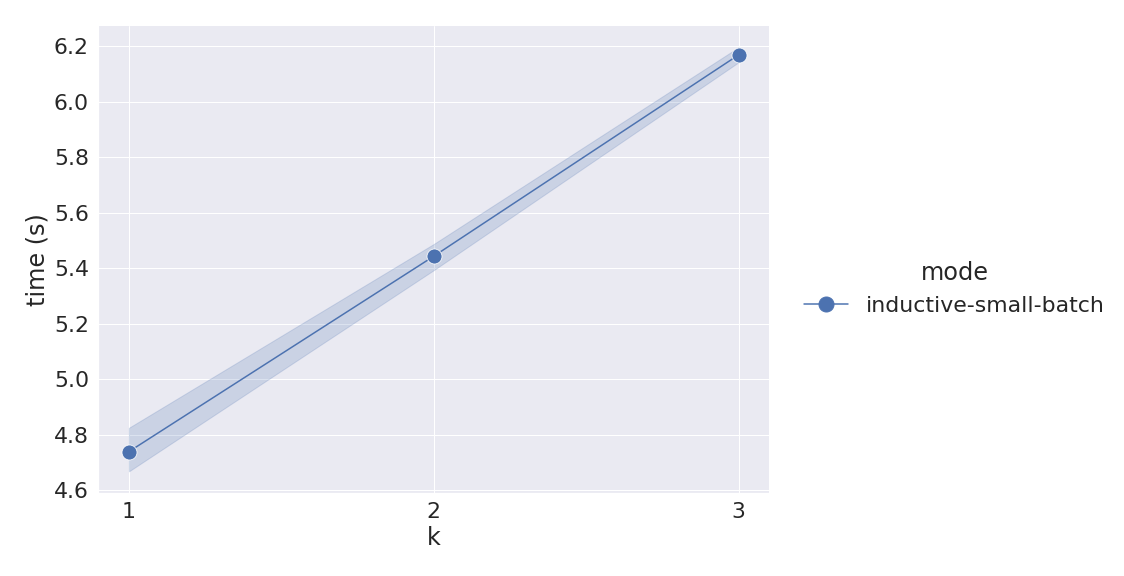

Kami juga mencatat latensi prediksi untuk setiap batch. Kami melakukan eksperimen pada instans ml.r5.12xlarge, tetapi Anda dapat menggunakan instans yang lebih kecil dengan memori 64 G untuk menjalankan eksperimen yang sama. Plot berikut menunjukkan interval kepercayaan rata-rata dan 95% dari latensi prediksi batch kecil untuk nilai yang berbeda dari k.

Latensi mencakup kelima langkah dari algoritme inferensi induktif waktu nyata. Kami melihat bahwa ketika k=2, memprediksi 1,030 transaksi membutuhkan waktu rata-rata 5.4 detik, menghasilkan throughput 190 transaksi per detik. Hal ini menegaskan bahwa implementasi model RGCN cocok untuk deteksi penipuan secara real-time. Kami juga mencatat bahwa sebelumnya pos tidak memberikan nilai latensi keras untuk penerapannya.

Kesimpulan

Model RGCN yang dirilis dengan posting ini mengimplementasikan algoritme untuk inferensi induktif waktu nyata, dan tidak memerlukan penyimpanan atau orkestrasi grafik eksternal. Parameter k pada Langkah 3 algoritme menentukan jumlah lompatan yang dilakukan untuk mengekstraksi subgraf untuk inferensi, dan menghasilkan trade-off antara akurasi model dan latensi prediksi. Kami menggunakan Dataset penipuan IEEE-CIS dalam percobaan kami, dan secara empiris memvalidasi bahwa nilai parameter yang optimal k untuk dataset ini adalah 2, mencapai skor AUC 0.876 dan latensi prediksi kurang dari 6 detik per 1,000 transaksi.

Posting ini memberikan proses langkah demi langkah untuk melatih dan mengevaluasi model RGCN untuk deteksi penipuan waktu nyata. Kelas model yang disertakan mengimplementasikan metode untuk seluruh siklus hidup model, termasuk metode serialisasi dan deserialisasi. Ini memungkinkan model untuk digunakan untuk deteksi penipuan waktu-nyata. Anda dapat melatih model sebagai estimator PyTorch SageMaker lalu menerapkannya ke titik akhir SageMaker dengan menggunakan yang berikut ini buku catatan sebagai templat. Titik akhir dapat memprediksi penipuan pada sejumlah kecil transaksi mentah secara real time. Anda juga bisa menggunakan Rekomendasi Inferensi Amazon SageMaker untuk memilih jenis dan konfigurasi instans terbaik untuk titik akhir inferensi berdasarkan beban kerja Anda.

Untuk informasi lebih lanjut tentang topik dan implementasi ini, kami mendorong Anda untuk menjelajahi dan menguji skrip kami sendiri. Anda dapat mengakses buku catatan dan kode kelas model terkait dari Contoh AWS GitHub repo.

Tentang Penulis

Dmitriy Bespalov adalah Ilmuwan Terapan Senior di Lab Solusi Pembelajaran Mesin Amazon, di mana dia membantu pelanggan AWS di berbagai industri mempercepat adopsi AI dan cloud mereka.

Dmitriy Bespalov adalah Ilmuwan Terapan Senior di Lab Solusi Pembelajaran Mesin Amazon, di mana dia membantu pelanggan AWS di berbagai industri mempercepat adopsi AI dan cloud mereka.

Ryan Merek adalah Ilmuwan Terapan di Lab Solusi Pembelajaran Mesin Amazon. Dia memiliki pengalaman khusus dalam menerapkan pembelajaran mesin untuk masalah kesehatan dan ilmu kehidupan. Di waktu luangnya, dia senang membaca sejarah dan fiksi ilmiah.

Ryan Merek adalah Ilmuwan Terapan di Lab Solusi Pembelajaran Mesin Amazon. Dia memiliki pengalaman khusus dalam menerapkan pembelajaran mesin untuk masalah kesehatan dan ilmu kehidupan. Di waktu luangnya, dia senang membaca sejarah dan fiksi ilmiah.

Yanjunqi adalah Manajer Sains Terapan Senior di Lab Solusi Pembelajaran Mesin Amazon. Dia berinovasi dan menerapkan pembelajaran mesin untuk membantu pelanggan AWS mempercepat penerapan AI dan cloud mereka.

Yanjunqi adalah Manajer Sains Terapan Senior di Lab Solusi Pembelajaran Mesin Amazon. Dia berinovasi dan menerapkan pembelajaran mesin untuk membantu pelanggan AWS mempercepat penerapan AI dan cloud mereka.

- Konten Bertenaga SEO & Distribusi PR. Dapatkan Amplifikasi Hari Ini.

- Platoblockchain. Intelijen Metaverse Web3. Pengetahuan Diperkuat. Akses Di Sini.

- Sumber: https://aws.amazon.com/blogs/machine-learning/build-a-gnn-based-real-time-fraud-detection-solution-using-the-deep-graph-library-without-using-external-graph-storage/

- 000

- 1

- 10

- 100

- 11

- 2%

- 28

- 7

- 95%

- a

- Sanggup

- Tentang Kami

- penyalahgunaan

- mempercepat

- mengakses

- diakses

- Akun

- ketepatan

- Mencapai

- mencapai

- di seluruh

- kegiatan

- menambahkan

- tambahan

- Tambahan

- alamat

- Adopsi

- Keuntungan

- AI

- algoritma

- Semua

- memungkinkan

- alternatif

- Amazon

- Pembelajaran Mesin Amazon

- Amazon Neptunus

- Amazon SageMaker

- antara

- dan

- Aplikasi

- aplikasi

- terapan

- Menerapkan

- sekitar

- susunan

- ditugaskan

- terkait

- diasumsikan

- ditambah

- rata-rata

- AWS

- berdasarkan

- karena

- menjadi

- makhluk

- patokan

- benchmarking

- TERBAIK

- Lebih baik

- antara

- merek

- membangun

- membangun

- dibangun di

- bisnis

- membawa

- kasus

- kesempatan

- perubahan

- kelas

- klasifikasi

- awan

- adopsi cloud

- kode

- Kolom

- Kolom

- bergabung

- menggabungkan

- membandingkan

- pembandingan

- kompleksitas

- menghitung

- Mengadakan

- kepercayaan

- konfigurasi

- Memastikan

- DIKONFIRMASI

- terhubung

- konstan

- membangun

- konstruksi

- mengandung

- kontras

- kontribusi

- kontrol

- Sesuai

- Biaya

- membuat

- menciptakan

- sangat penting

- pelanggan

- data

- Basis Data

- kumpulan data

- keputusan

- mendalam

- Default

- didefinisikan

- Ketergantungan

- menyebarkan

- penggelaran

- penyebaran

- rincian

- Deteksi

- alat

- dgl

- MELAKUKAN

- berbeda

- membahas

- Tidak

- Menjatuhkan

- selama

- setiap

- e-commerce

- efek

- efektif

- memungkinkan

- memungkinkan

- mendorong

- Titik akhir

- Memastikan

- Seluruh

- entitas

- entitas

- lingkungan

- terutama

- mengevaluasi

- dievaluasi

- mengevaluasi

- Bahkan

- Setiap

- contoh

- contoh

- diharapkan

- mahal

- pengalaman

- eksperimen

- Menjelaskan

- menyelidiki

- memperpanjang

- luar

- ekstrak

- Fitur

- Fiksi

- Akhirnya

- keuangan

- jasa keuangan

- Pertama

- berikut

- berikut

- format

- penipuan

- deteksi penipuan

- curang

- Gratis

- dari

- penuh

- sepenuhnya

- game

- menghasilkan

- mendapatkan

- GitHub

- baik

- grafik

- besar

- Sulit

- kesehatan

- membantu

- membantu

- lebih tinggi

- sejarah

- Seterpercayaapakah Olymp Trade? Kesimpulan

- How To

- Namun

- HTML

- HTTPS

- mengenali

- identitas

- liar

- melaksanakan

- implementasi

- mengimplementasikan

- mengimplementasikan

- mengimpor

- penting

- memperbaiki

- in

- Di lain

- termasuk

- termasuk

- Termasuk

- meningkatkan

- industri

- informasi

- memasukkan

- contoh

- diperkenalkan

- Memperkenalkan

- IP

- Alamat IP

- IT

- ikut

- kunci

- dikenal

- laboratorium

- label

- Label

- besar

- lebih besar

- Latensi

- memimpin

- BELAJAR

- pengetahuan

- Perpustakaan

- Hidup

- Biologi

- siklus hidup

- Mungkin

- memuat

- lokasi

- mencari

- Loyalitas

- program loyalitas

- mesin

- Mesin belajar

- manajer

- Cocok

- berarti

- Media

- Memori

- metode

- ML

- mode

- model

- model

- mode

- lebih

- perlu

- Neptunus

- jaringan

- jaringan

- jaringan saraf

- New

- berikutnya

- simpul

- node

- jumlah

- nomor

- mengamati

- mendapatkan

- ONE

- secara online

- pembayaran online

- operasi

- Operasi

- optimal

- teknik mengatur musik

- Lainnya

- mengungguli

- sendiri

- panda

- parameter

- parameter

- Lulus

- pembayaran

- persentase

- Melakukan

- prestasi

- melakukan

- tahap

- telepon

- fisik

- plato

- Kecerdasan Data Plato

- Data Plato

- Populer

- Pos

- meramalkan

- memprediksi

- ramalan

- menyajikan

- hadiah

- mencegah

- sebelumnya

- Sebelumnya

- Masalah

- masalah

- proses

- menghasilkan

- Produksi

- program

- janji

- memberikan

- disediakan

- pytorch

- Qi

- Mentah

- mencapai

- Bacaan

- nyata

- dunia nyata

- real-time

- catatan

- arsip

- menurunkan

- mengurangi

- mengurangi

- disebut

- terkait

- hubungan

- Hubungan

- dirilis

- menghapus

- Dilaporkan

- mewakili

- perwakilan

- membutuhkan

- wajib

- kebutuhan

- itu

- ISTIRAHAT

- dihasilkan

- Hasil

- kembali

- Run

- Ryan

- pembuat bijak

- Inferensi SageMaker

- sama

- Save

- skenario

- Ilmu

- Fiksi Ilmiah

- ILMU PENGETAHUAN

- ilmuwan

- script

- Kedua

- detik

- senior

- layanan

- Layanan

- set

- pengaturan

- pengaturan

- penyiapan

- beberapa

- Share

- ditunjukkan

- Pertunjukkan

- penting

- signifikan

- tunggal

- Ukuran

- ukuran

- kecil

- lebih kecil

- So

- Sosial

- media sosial

- larutan

- Solusi

- beberapa

- tertentu

- kecepatan

- membagi

- Berpisah

- Langkah

- Tangga

- henti

- penyimpanan

- strategi

- struktur

- Belajar

- subgraf

- subgraph

- seperti itu

- setelan

- cocok

- mendukung

- mencurigakan

- tabel

- Mengambil

- pengambilalihan

- Dibutuhkan

- target

- tugas

- tugas

- Template

- istilah

- uji

- pengujian

- Grafik

- Grafik

- mereka

- dengan demikian

- karena itu

- Melalui

- keluaran

- waktu

- timestamp

- waktu

- untuk

- terlalu

- tema

- Total

- Pelatihan VE

- terlatih

- Pelatihan

- .

- Transaksi

- mengobati

- Pohon

- percobaan

- uji

- benar

- jenis

- khas

- us

- menggunakan

- Pengguna

- biasanya

- divalidasi

- nilai

- Nilai - Nilai

- melalui

- yang

- sementara

- Wi-fi

- akan

- tanpa

- kata

- bernilai

- akan

- Kamu

- Anda

- zephyrnet.dll