Amazon SageMaker titik akhir multi-model (MME) adalah kemampuan inferensi SageMaker yang terkelola sepenuhnya yang memungkinkan Anda menerapkan ribuan model pada satu titik akhir. Sebelumnya, MME telah mengalokasikan daya komputasi CPU ke model secara statis, terlepas dari beban lalu lintas model, dengan menggunakan Server Multi Model (MMS) sebagai server modelnya. Dalam postingan ini, kami membahas solusi di mana MME dapat secara dinamis menyesuaikan daya komputasi yang ditetapkan ke setiap model berdasarkan pola lalu lintas model. Solusi ini memungkinkan Anda menggunakan komputasi dasar MME dengan lebih efisien dan menghemat biaya.

MME secara dinamis memuat dan membongkar model berdasarkan lalu lintas masuk ke titik akhir. Saat menggunakan MMS sebagai server model, MME mengalokasikan sejumlah pekerja model untuk setiap model. Untuk informasi lebih lanjut, lihat Pola hosting model di Amazon SageMaker, Bagian 3: Menjalankan dan mengoptimalkan inferensi multi-model dengan titik akhir multi-model Amazon SageMaker.

Namun, hal ini dapat menyebabkan beberapa masalah jika pola lalu lintas Anda bervariasi. Katakanlah Anda memiliki satu atau beberapa model yang menerima lalu lintas dalam jumlah besar. Anda dapat mengonfigurasi MMS untuk mengalokasikan sejumlah besar pekerja untuk model ini, namun ini akan ditetapkan ke semua model di belakang MME karena ini merupakan konfigurasi statis. Hal ini menyebabkan sejumlah besar pekerja menggunakan komputasi perangkat keras—bahkan model yang menganggur. Masalah sebaliknya bisa terjadi jika Anda menetapkan nilai kecil untuk jumlah pekerja. Model populer tidak akan memiliki cukup pekerja di tingkat server model untuk mengalokasikan cukup perangkat keras di belakang titik akhir model ini. Masalah utamanya adalah sulit untuk tetap agnostik pola lalu lintas jika Anda tidak dapat secara dinamis menskalakan pekerja Anda di tingkat server model untuk mengalokasikan jumlah komputasi yang diperlukan.

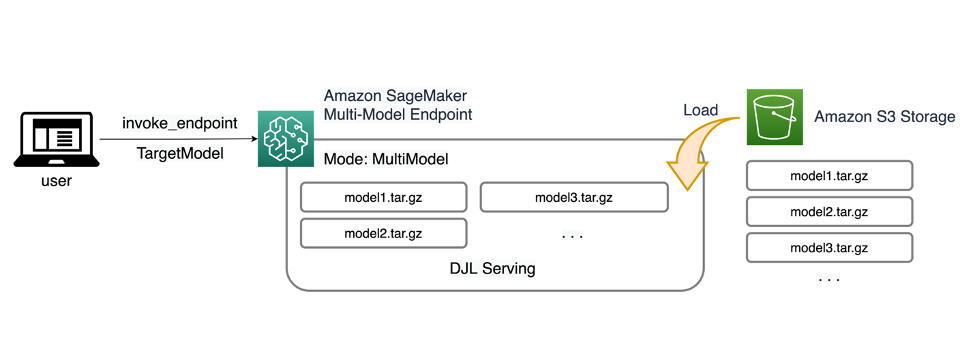

Solusi yang kita bahas dalam posting ini menggunakan DJL Melayani sebagai server model, yang dapat membantu mengurangi beberapa masalah yang kita diskusikan dan mengaktifkan penskalaan per model dan memungkinkan MME menjadi agnostik pola lalu lintas.

arsitektur MME

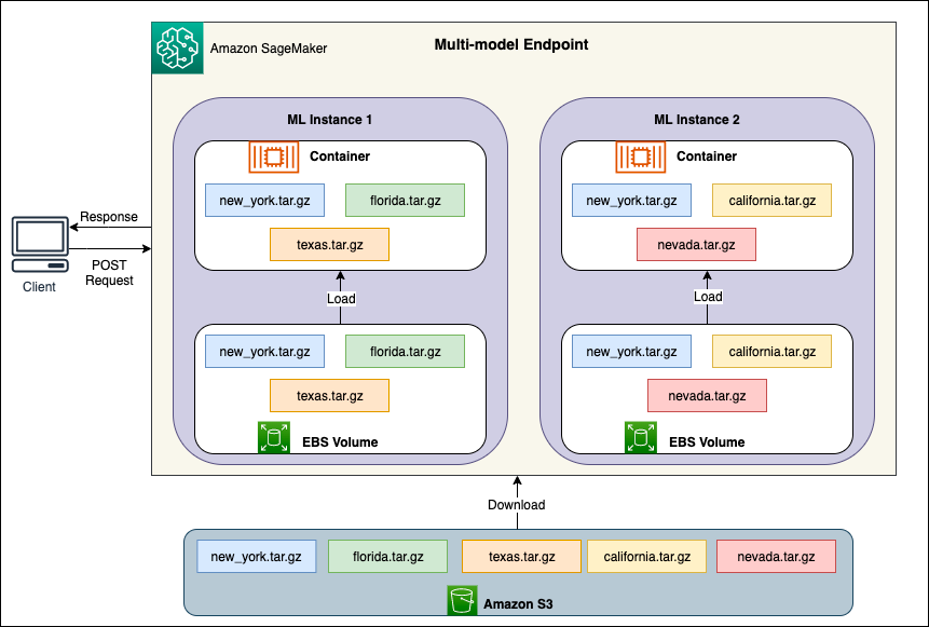

MME SageMaker memungkinkan Anda menerapkan beberapa model di belakang satu titik akhir inferensi yang mungkin berisi satu atau lebih instans. Setiap instance dirancang untuk memuat dan melayani beberapa model hingga kapasitas memori dan CPU/GPU-nya. Dengan arsitektur ini, bisnis perangkat lunak sebagai layanan (SaaS) dapat menghentikan peningkatan biaya hosting beberapa model secara linear dan mencapai penggunaan kembali infrastruktur yang konsisten dengan model multi-tenancy yang diterapkan di tempat lain dalam tumpukan aplikasi. Diagram berikut menggambarkan arsitektur ini.

MME SageMaker secara dinamis memuat model dari Layanan Penyimpanan Sederhana Amazon (Amazon S3) saat dipanggil, alih-alih mengunduh semua model saat titik akhir pertama kali dibuat. Akibatnya, pemanggilan awal ke suatu model mungkin menghasilkan latensi inferensi yang lebih tinggi dibandingkan inferensi berikutnya, yang diselesaikan dengan latensi rendah. Jika model sudah dimuat pada kontainer saat dipanggil, maka langkah pengunduhan dilewati dan model mengembalikan inferensi dengan latensi rendah. Misalnya, asumsikan Anda memiliki model yang hanya digunakan beberapa kali dalam sehari. Ini secara otomatis dimuat sesuai permintaan, sedangkan model yang sering diakses disimpan dalam memori dan dipanggil dengan latensi rendah secara konsisten.

Di belakang setiap MME terdapat contoh model hosting, seperti yang digambarkan dalam diagram berikut. Instance ini memuat dan mengeluarkan beberapa model ke dan dari memori berdasarkan pola lalu lintas ke model tersebut.

SageMaker terus merutekan permintaan inferensi untuk model ke instans di mana model sudah dimuat sehingga permintaan dilayani dari salinan model yang di-cache (lihat diagram berikut, yang menunjukkan jalur permintaan untuk permintaan prediksi pertama vs. prediksi yang di-cache jalur permintaan). Namun, jika model menerima banyak permintaan pemanggilan, dan ada instans tambahan untuk MME, SageMaker merutekan beberapa permintaan ke instans lain untuk mengakomodasi peningkatan tersebut. Untuk memanfaatkan penskalaan model otomatis di SageMaker, pastikan Anda memilikinya contoh pengaturan penskalaan otomatis untuk menyediakan kapasitas instans tambahan. Siapkan kebijakan penskalaan tingkat titik akhir Anda dengan parameter khusus atau permintaan per menit (disarankan) untuk menambahkan lebih banyak instans ke armada titik akhir.

Ikhtisar server model

Server model adalah komponen perangkat lunak yang menyediakan lingkungan runtime untuk menerapkan dan menyajikan model pembelajaran mesin (ML). Ini bertindak sebagai antarmuka antara model terlatih dan aplikasi klien yang ingin membuat prediksi menggunakan model tersebut.

Tujuan utama server model adalah untuk memungkinkan integrasi yang mudah dan penerapan model ML yang efisien ke dalam sistem produksi. Daripada menyematkan model secara langsung ke dalam aplikasi atau kerangka kerja tertentu, server model menyediakan platform terpusat tempat beberapa model dapat diterapkan, dikelola, dan disajikan.

Server model biasanya menawarkan fungsionalitas berikut:

- Pemuatan model – Server memuat model ML terlatih ke dalam memori, sehingga siap untuk menyajikan prediksi.

- API Inferensi – Server memaparkan API yang memungkinkan aplikasi klien mengirim data masukan dan menerima prediksi dari model yang diterapkan.

- Scaling – Server model dirancang untuk menangani permintaan bersamaan dari beberapa klien. Mereka menyediakan mekanisme untuk pemrosesan paralel dan mengelola sumber daya secara efisien untuk memastikan throughput yang tinggi dan latensi yang rendah.

- Integrasi dengan mesin backend – Server model memiliki integrasi dengan kerangka backend seperti DeepSpeed dan FasterTransformer untuk mempartisi model besar dan menjalankan inferensi yang sangat optimal.

Arsitektur DJL

Melayani DJL adalah server model universal sumber terbuka, berkinerja tinggi. DJL Serving dibangun di atas Djl, perpustakaan pembelajaran mendalam yang ditulis dalam bahasa pemrograman Java. Hal ini dapat memerlukan model pembelajaran mendalam, beberapa model, atau alur kerja dan membuatnya tersedia melalui titik akhir HTTP. DJL Serving mendukung penerapan model dari berbagai kerangka kerja seperti PyTorch, TensorFlow, Apache MXNet, ONNX, TensorRT, Hugging Face Transformers, DeepSpeed, FasterTransformer, dan banyak lagi.

DJL Serving menawarkan banyak fitur yang memungkinkan Anda menerapkan model Anda dengan performa tinggi:

- Mudah digunakan – DJL Serving dapat melayani sebagian besar model secara langsung. Cukup bawa artefak modelnya, dan DJL Serving dapat menampungnya.

- Dukungan berbagai perangkat dan akselerator – DJL Serving mendukung penerapan model pada CPU, GPU, dan Inferensi AWS.

- Performance – DJL Serving menjalankan inferensi multithread dalam satu JVM untuk meningkatkan throughput.

- Pengelompokan dinamis – DJL Serving mendukung batching dinamis untuk meningkatkan throughput.

- Penskalaan otomatis – DJL Serving akan secara otomatis menaikkan dan menurunkan skala pekerja berdasarkan beban lalu lintas.

- Dukungan multi-mesin – DJL Serving dapat menghosting model secara bersamaan menggunakan kerangka kerja yang berbeda (seperti PyTorch dan TensorFlow).

- Model ansambel dan alur kerja – DJL Serving mendukung penerapan alur kerja kompleks yang terdiri dari beberapa model, dan menjalankan sebagian alur kerja pada CPU dan sebagian pada GPU. Model dalam alur kerja dapat menggunakan kerangka kerja yang berbeda.

Secara khusus, fitur penskalaan otomatis DJL Serving memudahkan untuk memastikan model diskalakan secara tepat untuk lalu lintas masuk. Secara default, DJL Serving menentukan jumlah maksimum pekerja untuk model yang dapat didukung berdasarkan perangkat keras yang tersedia (inti CPU, perangkat GPU). Anda dapat menetapkan batas bawah dan atas untuk setiap model guna memastikan tingkat lalu lintas minimum selalu dapat dilayani, dan bahwa satu model tidak menggunakan semua sumber daya yang tersedia.

DJL Melayani menggunakan a Netty frontend di atas kumpulan thread pekerja backend. Frontend menggunakan pengaturan Netty tunggal dengan beberapa pengaturan HttpRequestHandlers. Penangan permintaan yang berbeda akan memberikan dukungan untuk API Inferensi, API Manajemen, atau API lain yang tersedia dari berbagai plugin.

Backend didasarkan pada Manajer Beban Kerja (WLM). WLM menangani beberapa thread pekerja untuk setiap model bersama dengan pengelompokan dan perutean permintaan ke model tersebut. Ketika beberapa model disajikan, WLM memeriksa ukuran antrian permintaan inferensi setiap model terlebih dahulu. Jika ukuran antrian lebih besar dari dua kali ukuran batch model, WLM meningkatkan jumlah pekerja yang ditugaskan pada model tersebut.

Ikhtisar solusi

Implementasi DJL dengan MME berbeda dengan pengaturan MMS default. Untuk Penyajian DJL dengan MME, kami mengompresi file berikut dalam format model.tar.gz yang diharapkan oleh SageMaker Inference:

- model.joblib – Untuk implementasi ini, kami langsung memasukkan metadata model ke dalam tarball. Dalam hal ini, kami bekerja dengan a

.joblibfile, jadi kami menyediakan file itu di tarball kami agar skrip inferensi kami dapat dibaca. Jika artefaknya terlalu besar, Anda juga dapat mendorongnya ke Amazon S3 dan mengarahkannya ke konfigurasi penyajian yang Anda tentukan untuk DJL. - melayani.properti – Di sini Anda dapat mengonfigurasi model apa pun yang terkait dengan server variabel lingkungan. Kekuatan DJL di sini adalah Anda dapat mengonfigurasinya

minWorkersdanmaxWorkersuntuk setiap tarball model. Hal ini memungkinkan setiap model untuk meningkatkan dan menurunkan skala di tingkat server model. Misalnya, jika model tunggal menerima sebagian besar lalu lintas untuk MME, server model akan meningkatkan skala pekerja secara dinamis. Dalam contoh ini, kami tidak mengonfigurasi variabel-variabel ini dan membiarkan DJL menentukan jumlah pekerja yang diperlukan bergantung pada pola lalu lintas kami. - model.py – Ini adalah skrip inferensi untuk prapemrosesan atau pascapemrosesan khusus apa pun yang ingin Anda terapkan. model.py mengharapkan logika Anda dienkapsulasi dalam metode pegangan secara default.

- persyaratan.txt (opsional) – Secara default, DJL sudah terinstal dengan PyTorch, tetapi dependensi tambahan apa pun yang Anda perlukan dapat diterapkan di sini.

Untuk contoh ini, kami menampilkan kekuatan DJL dengan MME dengan mengambil contoh model SKLearn. Kami menjalankan tugas pelatihan dengan model ini dan kemudian membuat 1,000 salinan artefak model ini untuk mendukung MME kami. Kami kemudian menunjukkan bagaimana DJL dapat menskalakan secara dinamis untuk menangani segala jenis pola lalu lintas yang mungkin diterima MME Anda. Hal ini dapat mencakup pemerataan lalu lintas di semua model atau bahkan beberapa model populer yang menerima sebagian besar lalu lintas. Anda dapat menemukan semua kode berikut ini GitHub repo.

Prasyarat

Untuk contoh ini, kami menggunakan instance notebook SageMaker dengan kernel conda_python3 dan instance ml.c5.xlarge. Untuk melakukan tes beban, Anda dapat menggunakan Cloud komputasi elastis Amazon (Amazon EC2) atau instans notebook SageMaker yang lebih besar. Dalam contoh ini, kami menskalakan hingga lebih dari seribu transaksi per detik (TPS), jadi kami menyarankan pengujian pada instans EC2 yang lebih berat seperti ml.c5.18xlarge sehingga Anda memiliki lebih banyak komputasi untuk digunakan.

Buat artefak model

Pertama-tama kita perlu membuat artefak model dan data yang kita gunakan dalam contoh ini. Untuk kasus ini, kami menghasilkan beberapa data buatan dengan NumPy dan melatihnya menggunakan model regresi linier SKLearn dengan cuplikan kode berikut:

Setelah Anda menjalankan kode sebelumnya, Anda seharusnya memiliki a model.joblib file yang dibuat di lingkungan lokal Anda.

Tarik gambar DJL Docker

Gambar Docker djl-inference:0.23.0-cpu-full-v1.0 adalah wadah penyajian DJL yang digunakan dalam contoh ini. Anda dapat menyesuaikan URL berikut tergantung pada Wilayah Anda:

inference_image_uri = "474422712127.dkr.ecr.us-east-1.amazonaws.com/djl-serving-cpu:latest"

Secara opsional, Anda juga dapat menggunakan image ini sebagai image dasar dan memperluasnya untuk membuat image Docker Anda sendiri Registry Kontainer Elastis Amazon (Amazon ECR) dengan dependensi lain yang Anda perlukan.

Buat file modelnya

Pertama, kita buat file bernama serving.properties. Ini menginstruksikan DJLServing untuk menggunakan mesin Python. Kami juga mendefinisikan max_idle_time seorang pekerja menjadi 600 detik. Hal ini memastikan bahwa kami membutuhkan waktu lebih lama untuk mengurangi jumlah pekerja yang kami miliki per model. Kami tidak menyesuaikan minWorkers dan maxWorkers yang dapat kita tentukan dan biarkan DJL secara dinamis menghitung jumlah pekerja yang dibutuhkan bergantung pada lalu lintas yang diterima setiap model. Properti serve.properties ditampilkan sebagai berikut. Untuk melihat daftar lengkap opsi konfigurasi, lihat Konfigurasi Mesin.

Selanjutnya, kita membuat file model.py, yang mendefinisikan pemuatan model dan logika inferensi. Untuk MME, setiap file model.py dikhususkan untuk suatu model. Model disimpan di jalurnya sendiri di bawah penyimpanan model (biasanya /opt/ml/model/). Saat memuat model, model tersebut akan dimuat di bawah jalur penyimpanan model di direktorinya sendiri. Contoh lengkap model.py pada demo ini dapat dilihat di GitHub repo.

Kami membuat model.tar.gz file yang menyertakan model kita (model.joblib), model.py, dan serving.properties:

Untuk tujuan demonstrasi, kami membuat 1,000 eksemplar model.tar.gz file untuk mewakili sejumlah besar model yang akan dihosting. Dalam produksi, Anda perlu membuat a model.tar.gz file untuk setiap model Anda.

Terakhir, kami mengunggah model ini ke Amazon S3.

Buat model SageMaker

Kami sekarang membuat Model SageMaker. Kami menggunakan gambar ECR yang ditentukan sebelumnya dan artefak model dari langkah sebelumnya untuk membuat model SageMaker. Dalam pengaturan model, kami mengonfigurasi Mode sebagai MultiModel. Ini memberi tahu DJLServing bahwa kami sedang membuat MME.

Buat titik akhir SageMaker

Dalam demo ini, kami menggunakan 20 instans ml.c5d.18xlarge untuk menskalakan ke TPS dalam kisaran ribuan. Pastikan untuk mendapatkan peningkatan batas pada jenis instans Anda, jika perlu, untuk mencapai TPS yang Anda targetkan.

Uji beban

Pada saat penulisan, alat pengujian beban internal SageMaker Rekomendasi Inferensi Amazon SageMaker tidak secara asli mendukung pengujian untuk MME. Oleh karena itu, kami menggunakan alat Python open source Belalang. Locust mudah diatur dan dapat melacak metrik seperti TPS dan latensi ujung ke ujung. Untuk pemahaman lengkap tentang cara mengaturnya dengan SageMaker, lihat Praktik terbaik untuk pengujian beban titik akhir inferensi real-time Amazon SageMaker.

Dalam kasus penggunaan ini, kami memiliki tiga pola lalu lintas berbeda yang ingin kami simulasikan dengan MME, jadi kami memiliki tiga skrip Python berikut yang selaras dengan setiap pola. Tujuan kami di sini adalah untuk membuktikan bahwa, apa pun pola lalu lintas kami, kami dapat mencapai target TPS yang sama dan melakukan penskalaan dengan tepat.

Kita dapat menentukan bobot dalam skrip Locust untuk menetapkan lalu lintas di berbagai bagian model kita. Misalnya, dengan model hot tunggal, kami menerapkan dua metode sebagai berikut:

Kami kemudian dapat menetapkan bobot tertentu untuk setiap metode, yaitu ketika metode tertentu menerima persentase lalu lintas tertentu:

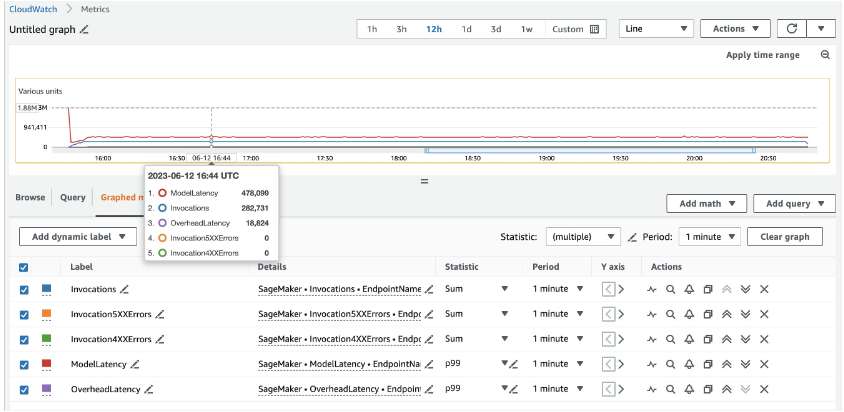

Untuk instans 20 ml.c5d.18xlarge, kami melihat metrik pemanggilan berikut di amazoncloudwatch menghibur. Nilai-nilai ini tetap konsisten di ketiga pola lalu lintas. Untuk memahami metrik CloudWatch untuk inferensi real-time SageMaker dan MME dengan lebih baik, lihat Metrik Pemanggilan Titik Akhir SageMaker.

Anda dapat menemukan skrip Locust lainnya di direktori belalang-utils di repositori GitHub.

Kesimpulan

Dalam postingan ini, kita membahas bagaimana MME dapat secara dinamis menyesuaikan daya komputasi yang ditetapkan ke setiap model berdasarkan pola lalu lintas model. Fitur yang baru diluncurkan ini tersedia di semua Wilayah AWS tempat SageMaker tersedia. Perhatikan bahwa pada saat pengumuman, hanya instans CPU yang didukung. Untuk mempelajari lebih lanjut, lihat Algoritme, framework, dan instance yang didukung.

Tentang Penulis

Ram Vegaraju adalah Arsitek ML dengan tim Layanan SageMaker. Dia berfokus untuk membantu pelanggan membangun dan mengoptimalkan solusi AI/ML mereka di Amazon SageMaker. Di waktu luangnya, dia suka bepergian dan menulis.

Ram Vegaraju adalah Arsitek ML dengan tim Layanan SageMaker. Dia berfokus untuk membantu pelanggan membangun dan mengoptimalkan solusi AI/ML mereka di Amazon SageMaker. Di waktu luangnya, dia suka bepergian dan menulis.

Qing Wei Li adalah Spesialis Pembelajaran Mesin di Amazon Web Services. Dia menerima gelar Ph.D. dalam Riset Operasi setelah dia melanggar akun hibah penelitian penasihatnya dan gagal memberikan Hadiah Nobel yang dia janjikan. Saat ini dia membantu pelanggan di industri layanan keuangan dan asuransi membangun solusi pembelajaran mesin di AWS. Di waktu luangnya, dia suka membaca dan mengajar.

Qing Wei Li adalah Spesialis Pembelajaran Mesin di Amazon Web Services. Dia menerima gelar Ph.D. dalam Riset Operasi setelah dia melanggar akun hibah penelitian penasihatnya dan gagal memberikan Hadiah Nobel yang dia janjikan. Saat ini dia membantu pelanggan di industri layanan keuangan dan asuransi membangun solusi pembelajaran mesin di AWS. Di waktu luangnya, dia suka membaca dan mengajar.

James Wu adalah Arsitek Solusi Spesialis AI/ML Senior di AWS. membantu pelanggan merancang dan membangun solusi AI/ML. Pekerjaan James mencakup berbagai kasus penggunaan ML, dengan minat utama pada visi komputer, pembelajaran mendalam, dan penskalaan ML di seluruh perusahaan. Sebelum bergabung dengan AWS, James adalah seorang arsitek, pengembang, dan pemimpin teknologi selama lebih dari 10 tahun, termasuk 6 tahun di bidang teknik dan 4 tahun di industri pemasaran & periklanan.

James Wu adalah Arsitek Solusi Spesialis AI/ML Senior di AWS. membantu pelanggan merancang dan membangun solusi AI/ML. Pekerjaan James mencakup berbagai kasus penggunaan ML, dengan minat utama pada visi komputer, pembelajaran mendalam, dan penskalaan ML di seluruh perusahaan. Sebelum bergabung dengan AWS, James adalah seorang arsitek, pengembang, dan pemimpin teknologi selama lebih dari 10 tahun, termasuk 6 tahun di bidang teknik dan 4 tahun di industri pemasaran & periklanan.

Saurabh Trikande adalah Manajer Produk Senior untuk Inferensi Amazon SageMaker. Dia bersemangat bekerja dengan pelanggan dan termotivasi oleh tujuan mendemokratisasi pembelajaran mesin. Dia berfokus pada tantangan inti yang terkait dengan penerapan aplikasi ML yang kompleks, model ML multi-penyewa, pengoptimalan biaya, dan membuat penerapan model pembelajaran mendalam lebih mudah diakses. Di waktu luangnya, Saurabh menikmati hiking, belajar tentang teknologi inovatif, mengikuti TechCrunch, dan menghabiskan waktu bersama keluarganya.

Saurabh Trikande adalah Manajer Produk Senior untuk Inferensi Amazon SageMaker. Dia bersemangat bekerja dengan pelanggan dan termotivasi oleh tujuan mendemokratisasi pembelajaran mesin. Dia berfokus pada tantangan inti yang terkait dengan penerapan aplikasi ML yang kompleks, model ML multi-penyewa, pengoptimalan biaya, dan membuat penerapan model pembelajaran mendalam lebih mudah diakses. Di waktu luangnya, Saurabh menikmati hiking, belajar tentang teknologi inovatif, mengikuti TechCrunch, dan menghabiskan waktu bersama keluarganya.

Xu Deng adalah Manajer Insinyur Perangkat Lunak dengan tim SageMaker. Dia berfokus untuk membantu pelanggan membangun dan mengoptimalkan pengalaman inferensi AI/ML mereka di Amazon SageMaker. Di waktu luangnya, dia suka jalan-jalan dan seluncur salju.

Xu Deng adalah Manajer Insinyur Perangkat Lunak dengan tim SageMaker. Dia berfokus untuk membantu pelanggan membangun dan mengoptimalkan pengalaman inferensi AI/ML mereka di Amazon SageMaker. Di waktu luangnya, dia suka jalan-jalan dan seluncur salju.

Siddharth Venkatesan adalah Insinyur Perangkat Lunak di AWS Deep Learning. Dia saat ini berfokus pada membangun solusi untuk inferensi model besar. Sebelum di AWS, dia bekerja di Amazon Grocery org yang membangun fitur pembayaran baru untuk pelanggan di seluruh dunia. Di luar pekerjaan, ia menikmati bermain ski, alam terbuka, dan menonton olahraga.

Siddharth Venkatesan adalah Insinyur Perangkat Lunak di AWS Deep Learning. Dia saat ini berfokus pada membangun solusi untuk inferensi model besar. Sebelum di AWS, dia bekerja di Amazon Grocery org yang membangun fitur pembayaran baru untuk pelanggan di seluruh dunia. Di luar pekerjaan, ia menikmati bermain ski, alam terbuka, dan menonton olahraga.

Rohith Nalamaddi adalah Insinyur Pengembangan Perangkat Lunak di AWS. Dia berupaya mengoptimalkan beban kerja pembelajaran mendalam pada GPU, membangun inferensi ML berperforma tinggi, dan menyajikan solusi. Sebelumnya, dia bekerja membangun layanan mikro berdasarkan AWS untuk bisnis Amazon F3. Di luar pekerjaan dia senang bermain dan menonton olahraga.

Rohith Nalamaddi adalah Insinyur Pengembangan Perangkat Lunak di AWS. Dia berupaya mengoptimalkan beban kerja pembelajaran mendalam pada GPU, membangun inferensi ML berperforma tinggi, dan menyajikan solusi. Sebelumnya, dia bekerja membangun layanan mikro berdasarkan AWS untuk bisnis Amazon F3. Di luar pekerjaan dia senang bermain dan menonton olahraga.

- Konten Bertenaga SEO & Distribusi PR. Dapatkan Amplifikasi Hari Ini.

- PlatoData.Jaringan Vertikal Generatif Ai. Berdayakan Diri Anda. Akses Di Sini.

- PlatoAiStream. Intelijen Web3. Pengetahuan Diperkuat. Akses Di Sini.

- PlatoESG. Karbon, teknologi bersih, energi, Lingkungan Hidup, Tenaga surya, Penanganan limbah. Akses Di Sini.

- PlatoHealth. Kecerdasan Uji Coba Biotek dan Klinis. Akses Di Sini.

- Sumber: https://aws.amazon.com/blogs/machine-learning/run-ml-inference-on-unplanned-and-spiky-traffic-using-amazon-sagemaker-multi-model-endpoints/

- :adalah

- :Di mana

- $NAIK

- 000

- 1

- 10

- 100

- 116

- 118

- 12

- 16

- 17

- 20

- 23

- 31

- 600

- 7

- 9

- a

- Tentang Kami

- akselerator

- diakses

- dapat diakses

- menampung

- Akun

- Mencapai

- di seluruh

- tindakan

- menambahkan

- Tambahan

- Keuntungan

- pengiklanan

- Setelah

- AI / ML

- algoritma

- meluruskan

- Semua

- mengalokasikan

- dialokasikan

- mengizinkan

- memungkinkan

- sepanjang

- sudah

- juga

- selalu

- Amazon

- Amazon EC2

- Amazon SageMaker

- Amazon Web Services

- jumlah

- an

- dan

- Pengumuman

- Lain

- Apa pun

- Apache

- api

- Lebah

- Aplikasi

- aplikasi

- terapan

- tepat

- arsitektur

- ADALAH

- sekitar

- buatan

- AS

- ditugaskan

- menganggap

- At

- mobil

- Otomatis

- secara otomatis

- tersedia

- AWS

- kembali

- Backend

- mendasarkan

- berdasarkan

- pengelompokan

- BE

- karena

- di belakang

- Lebih baik

- antara

- tubuh

- mendorong

- batas

- Kotak

- Istirahat

- membawa

- Broke

- membangun

- Bangunan

- dibangun di

- bisnis

- tapi

- by

- bernama

- CAN

- kemampuan

- Kapasitas

- yang

- kasus

- kasus

- sel

- terpusat

- tertentu

- tantangan

- Cek

- kelas

- klien

- klien

- kode

- datang

- lengkap

- Lengkap

- kompleks

- komponen

- Terdiri dari

- menghitung

- komputer

- Visi Komputer

- komputasi

- daya komputasi

- bersamaan

- konfigurasi

- konsisten

- secara konsisten

- konsul

- memakan

- mengandung

- Wadah

- konteks

- terus

- Core

- Biaya

- Biaya

- Meliputi

- membuat

- dibuat

- membuat

- Sekarang

- adat

- pelanggan

- data

- hari

- mendalam

- belajar mendalam

- Default

- menetapkan

- didefinisikan

- Mendefinisikan

- menyampaikan

- Permintaan

- demo

- Demokratisasi

- ketergantungan

- Tergantung

- digambarkan

- menyebarkan

- dikerahkan

- penggelaran

- penyebaran

- Mendesain

- dirancang

- Menentukan

- ditentukan

- Pengembang

- Pengembangan

- alat

- Devices

- diagram

- berbeda

- sulit

- langsung

- direktori

- membahas

- dibahas

- distribusi

- Buruh pelabuhan

- Tidak

- Dont

- turun

- Download

- download

- dinamis

- dinamis

- setiap

- Terdahulu

- efisien

- efisien

- tanpa usaha

- antara

- di tempat lain

- embedding

- aktif

- memungkinkan

- dienkapsulasi

- ujung ke ujung

- Titik akhir

- Mesin

- insinyur

- Teknik

- cukup

- memastikan

- Enterprise

- Lingkungan Hidup

- kesalahan

- Bahkan

- contoh

- pengecualian

- mengharapkan

- mengharapkan

- pengalaman

- memperpanjang

- Menghadapi

- Gagal

- hampir

- keluarga

- Fitur

- Fitur

- beberapa

- File

- File

- keuangan

- servis keuangan

- Menemukan

- Pertama

- tetap

- ARMADA KAPAL

- berfokus

- berikut

- berikut

- Untuk

- format

- Kerangka

- kerangka

- sering

- dari

- Frontend

- penuh

- sepenuhnya

- fungsionalitas

- menghasilkan

- mendapatkan

- mendapat

- GitHub

- tujuan

- GPU

- GPU

- memberikan

- lebih besar

- menangani

- terjadi

- Perangkat keras

- Memiliki

- he

- membantu

- membantu

- membantu

- di sini

- High

- lebih tinggi

- sangat

- -nya

- tuan rumah

- host

- tuan

- PANAS

- Seterpercayaapakah Olymp Trade? Kesimpulan

- How To

- Namun

- HTML

- http

- HTTPS

- Siaga

- if

- menggambarkan

- gambar

- melaksanakan

- implementasi

- mengimpor

- in

- memasukkan

- termasuk

- Termasuk

- masuk

- Meningkatkan

- meningkatkan

- industri

- industri

- informasi

- Infrastruktur

- mulanya

- inovatif

- teknologi inovatif

- memasukkan

- diinstal

- contoh

- sebagai gantinya

- asuransi

- integrasi

- integrasi

- bunga

- Antarmuka

- ke

- dipanggil

- isu

- masalah

- IT

- NYA

- james

- Jawa

- Pekerjaan

- bergabung

- jpg

- hanya

- bahasa

- besar

- lebih besar

- Latensi

- Terbaru

- diluncurkan

- memimpin

- pemimpin

- Memimpin

- BELAJAR

- pengetahuan

- membiarkan

- Tingkat

- Perpustakaan

- 'like'

- 'like

- MEMBATASI

- linear

- Daftar

- memuat

- pemuatan

- beban

- lokal

- logika

- lagi

- mencintai

- Rendah

- menurunkan

- mesin

- Mesin belajar

- Utama

- Mayoritas

- membuat

- MEMBUAT

- Membuat

- berhasil

- manajer

- pelaksana

- banyak

- Marketing

- Pemasaran & Periklanan

- maksimum

- Mungkin..

- mekanisme

- Memori

- Metadata

- metode

- metode

- Metrik

- microservices

- mungkin

- minimum

- menit

- Mengurangi

- ML

- mode

- model

- model

- Modul

- lebih

- paling

- termotivasi

- beberapa

- nama

- secara asli

- perlu

- Perlu

- dibutuhkan

- New

- baru saja

- Penghargaan Nobel

- None

- mencatat

- buku catatan

- sekarang

- jumlah

- mati rasa

- of

- menawarkan

- Penawaran

- on

- ONE

- hanya

- Buka

- open source

- Operasi

- seberang

- optimisasi

- Optimize

- dioptimalkan

- mengoptimalkan

- Opsi

- or

- Lainnya

- kami

- di luar

- di luar rumah

- keluaran

- di luar

- lebih

- sendiri

- Paralel

- parameter

- bagian

- tertentu

- bagian

- bergairah

- path

- jalan

- pola

- pola

- pembayaran

- untuk

- persentase

- Melakukan

- prestasi

- pipa

- Platform

- plato

- Kecerdasan Data Plato

- Data Plato

- bermain

- plugin

- Titik

- kebijaksanaan

- Kolam renang

- Populer

- Pos

- kekuasaan

- praktek

- mendahului

- ramalan

- Prediksi

- sebelumnya

- sebelumnya

- primer

- Sebelumnya

- hadiah

- Masalah

- proses

- pengolahan

- Produk

- manajer produk

- Produksi

- Pemrograman

- dijanjikan

- tepat

- properties

- Rasakan itu

- memberikan

- menyediakan

- ketentuan

- tujuan

- tujuan

- Dorong

- terdorong

- Ular sanca

- pytorch

- acak

- jarak

- Baca

- Bacaan

- siap

- real-time

- menerima

- diterima

- menerima

- menerima

- direkomendasikan

- lihat

- Bagaimanapun juga

- wilayah

- daerah

- terkait

- tinggal

- menggantikan

- gudang

- mewakili

- permintaan

- permintaan

- Persyaratan

- penelitian

- Sumber

- tanggapan

- ISTIRAHAT

- mengakibatkan

- Pengembalian

- menggunakan kembali

- Rute

- rute

- rute

- Run

- berjalan

- runtime

- SaaS

- pembuat bijak

- Inferensi SageMaker

- sama

- mencicipi

- Save

- mengatakan

- Skala

- diskalakan

- sisik

- skala

- naskah

- script

- Kedua

- detik

- melihat

- terlihat

- DIRI

- mengirim

- senior

- melayani

- yang telah dilayani

- Server

- Server

- layanan

- Layanan

- porsi

- set

- set

- penyiapan

- beberapa

- harus

- menampilkan

- ditunjukkan

- Pertunjukkan

- Sederhana

- mensimulasikan

- serentak

- tunggal

- tunggal

- Ukuran

- kecil

- potongan

- So

- Perangkat lunak

- perangkat lunak sebagai layanan

- pengembangan perangkat lunak

- Software Engineer

- larutan

- Solusi

- beberapa

- sumber

- spesialis

- tertentu

- Pengeluaran

- membagi

- Olahraga

- tumpukan

- statis

- Langkah

- penyimpanan

- menyimpan

- tersimpan

- mudah

- selanjutnya

- seperti itu

- menyarankan

- mendukung

- Didukung

- Mendukung

- yakin

- sistem

- Mengambil

- Dibutuhkan

- pengambilan

- target

- penargetan

- Pengajaran

- tim

- TechCrunch

- Teknologi

- Teknologi

- mengatakan

- tensorflow

- pengujian

- tes

- dari

- bahwa

- Grafik

- mereka

- Mereka

- kemudian

- Sana.

- karena itu

- Ini

- mereka

- ini

- itu

- ribu

- ribuan

- tiga

- Melalui

- keluaran

- waktu

- kali

- untuk

- terlalu

- alat

- puncak

- terhadap

- terima kasih

- jalur

- lalu lintas

- Pelatihan VE

- terlatih

- Pelatihan

- Transaksi

- transformer

- Perjalanan

- mencoba

- dua

- mengetik

- khas

- bawah

- pokok

- memahami

- pemahaman

- Universal

- URL

- menggunakan

- gunakan case

- bekas

- kegunaan

- menggunakan

- biasanya

- Memanfaatkan

- nilai

- Nilai - Nilai

- variabel

- berbagai

- penglihatan

- vs

- ingin

- adalah

- menonton

- we

- jaringan

- layanan web

- berat

- Apa

- ketika

- sedangkan

- yang

- lebar

- Rentang luas

- akan

- dengan

- dalam

- Kerja

- bekerja

- pekerja

- pekerja

- alur kerja

- Alur kerja

- kerja

- bekerja

- akan

- penulisan

- tertulis

- X

- tahun

- Kamu

- Anda

- zephyrnet.dll