Saat ini, model AI generatif mencakup berbagai tugas mulai dari peringkasan teks, tanya jawab, serta pembuatan gambar dan video. Untuk meningkatkan kualitas keluaran, pendekatan seperti n-short learning, Prompt engineering, Pengambilan Augmented Generation (RAG) dan penyetelan halus digunakan. Penyempurnaan memungkinkan Anda menyesuaikan model AI generatif ini untuk mencapai peningkatan kinerja pada tugas spesifik domain Anda.

Dengan Amazon SageMaker, sekarang Anda dapat menjalankan tugas pelatihan SageMaker hanya dengan memberi anotasi pada kode Python Anda @dekorator jarak jauh. itu SDK Python SageMaker secara otomatis menerjemahkan lingkungan ruang kerja Anda yang ada, serta kode pemrosesan data dan kumpulan data apa pun yang terkait, ke dalam tugas pelatihan SageMaker yang berjalan di platform pelatihan. Keuntungannya adalah penulisan kode dengan cara yang lebih alami dan berorientasi objek, dan masih menggunakan kemampuan SageMaker untuk menjalankan tugas pelatihan pada cluster jarak jauh dengan sedikit perubahan.

Dalam posting ini, kami menunjukkan cara menyempurnakan a Elang-7B Foundation Models (FM) menggunakan dekorator @remote dari SageMaker Python SDK. Itu juga menggunakan Penyesuaian parameter yang efisien dari Hugging Face (PEFT) perpustakaan dan teknik kuantisasi melalui bitsandbytes untuk mendukung penyesuaian. Kode yang disajikan di blog ini juga dapat digunakan untuk menyempurnakan FM lainnya, seperti Llama-2 13b.

Representasi presisi penuh dari model ini mungkin memiliki tantangan untuk dimasukkan ke dalam memori pada satu atau bahkan beberapa model Unit Pemrosesan Grafis (GPU) — atau bahkan mungkin memerlukan instance yang lebih besar. Oleh karena itu, untuk menyempurnakan model ini tanpa menambah biaya, kami menggunakan teknik yang disebut LLM terkuantisasi dengan Low-Rank Adapters (QLoRA). QLoRA adalah pendekatan penyesuaian efisien yang mengurangi penggunaan memori LLM sekaligus mempertahankan kinerja yang sangat baik.

Keuntungan menggunakan dekorator @remote

Sebelum melangkah lebih jauh, mari kita pahami bagaimana dekorator jarak jauh meningkatkan produktivitas pengembang saat bekerja dengan SageMaker:

- @remote dekorator memicu tugas pelatihan secara langsung menggunakan kode python asli, tanpa pemanggilan eksplisit SageMaker Estimators dan saluran input SageMaker

- Hambatan masuk yang rendah bagi pengembang model pelatihan di SageMaker.

- Tidak perlu beralih Lingkungan pengembangan terintegrasi (IDE). Lanjutkan menulis kode dalam IDE pilihan Anda dan aktifkan tugas pelatihan SageMaker.

- Tidak perlu belajar tentang container. Lanjutkan menyediakan dependensi di a

requirements.txtdan berikan itu ke dekorator jarak jauh.

Prasyarat

Akun AWS diperlukan dengan Identitas AWS dan Manajemen Akses (AWS IAM) peran yang memiliki izin untuk mengelola sumber daya yang dibuat sebagai bagian dari solusi. Untuk detailnya, lihat Membuat akun AWS.

Dalam posting ini, kami menggunakan Studio Amazon SageMaker pada pengatur terkenal. Pengatur ini menawarkan bantuan hukum kepada traderapabila trader berselisih dengan broker yang terdaftar dengan mereka. Data Science 3.0 gambar dan a ml.t3.medium contoh peluncuran cepat. Namun, Anda dapat menggunakan lingkungan pengembangan terintegrasi (IDE) pilihan Anda. Anda hanya perlu mengaturnya Antarmuka Baris Perintah AWS (AWS CLI) kredensial dengan benar. Untuk informasi lebih lanjut, lihat Konfigurasikan AWS CLI.

Untuk penyempurnaan, Falcon-7B, an ml.g5.12xlarge contoh digunakan dalam posting ini. Harap pastikan kapasitas yang cukup untuk instans ini di akun AWS.

Anda perlu mengkloning ini Gudang Github untuk mereplikasi solusi yang ditunjukkan dalam posting ini.

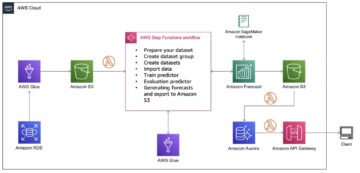

Ikhtisar solusi

- Instal prasyarat untuk menyempurnakan model Falcon-7B

- Siapkan konfigurasi dekorator jarak jauh

- Pra-proses kumpulan data yang berisi FAQ layanan AWS

- Menyempurnakan FAQ Falcon-7B pada layanan AWS

- Uji model penyempurnaan pada contoh pertanyaan terkait layanan AWS

1. Instal prasyarat untuk menyempurnakan model Falcon-7B

Luncurkan notebook falcon-7b-qlora-remote-decorator_qa.ipynb di SageMaker Studio dengan memilih Ibijaksana as Data Science dan Inti as Python 3. Instal semua perpustakaan yang diperlukan yang disebutkan di requirements.txt. Beberapa perpustakaan perlu diinstal pada instance notebook itu sendiri. Lakukan operasi lain yang diperlukan untuk pemrosesan himpunan data dan memicu tugas pelatihan SageMaker.

2. Atur konfigurasi dekorator jarak jauh

Buat file konfigurasi tempat semua konfigurasi yang terkait dengan tugas pelatihan Amazon SageMaker ditentukan. File ini dibaca oleh dekorator @remote saat menjalankan tugas pelatihan. File ini berisi pengaturan seperti dependensi, gambar pelatihan, instance, dan peran eksekusi yang akan digunakan untuk tugas pelatihan. Untuk referensi mendetail tentang semua pengaturan yang didukung oleh file konfigurasi, lihat Mengonfigurasi dan menggunakan default dengan SageMaker Python SDK.

Tidak wajib untuk menggunakan config.yaml file agar dapat bekerja dengan dekorator @remote. Ini hanyalah cara yang lebih bersih untuk menyediakan semua konfigurasi ke dekorator @remote. Hal ini membuat parameter terkait SageMaker dan AWS tetap berada di luar kode dengan upaya satu kali untuk menyiapkan file konfigurasi yang digunakan di seluruh anggota tim. Semua konfigurasi juga dapat diberikan langsung dalam argumen dekorator, namun hal ini mengurangi keterbacaan dan pemeliharaan perubahan dalam jangka panjang. Selain itu, file konfigurasi dapat dibuat oleh administrator dan dibagikan dengan semua pengguna di suatu lingkungan.

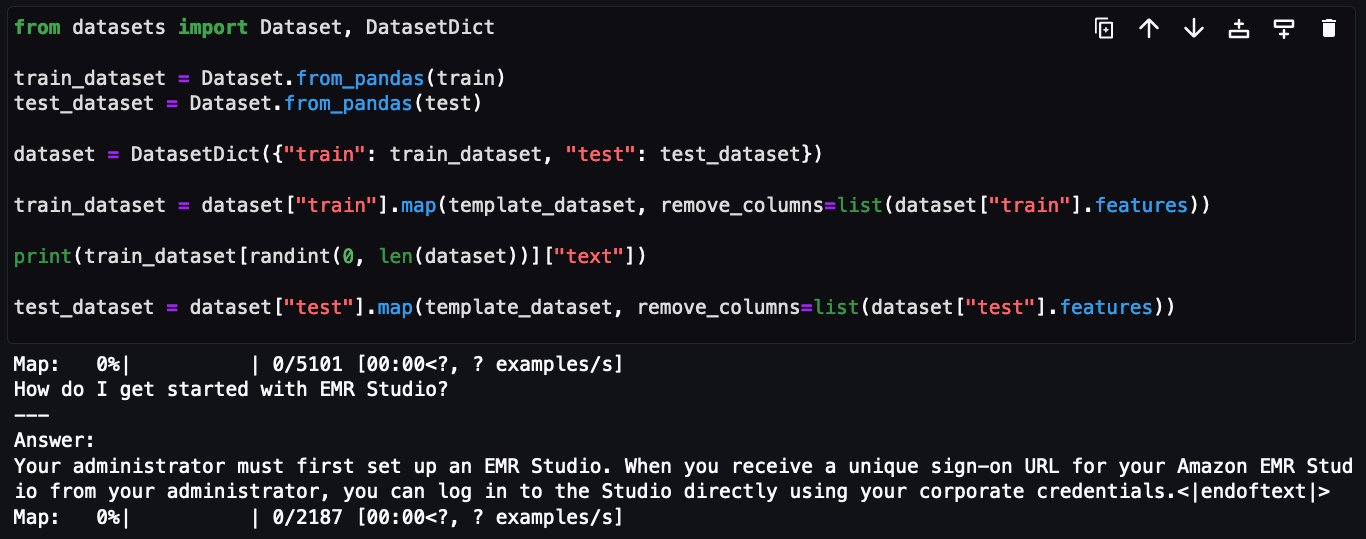

Pra-proses kumpulan data yang berisi FAQ layanan AWS

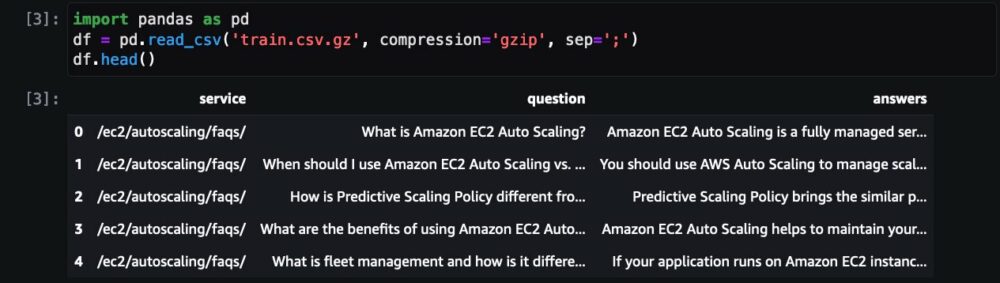

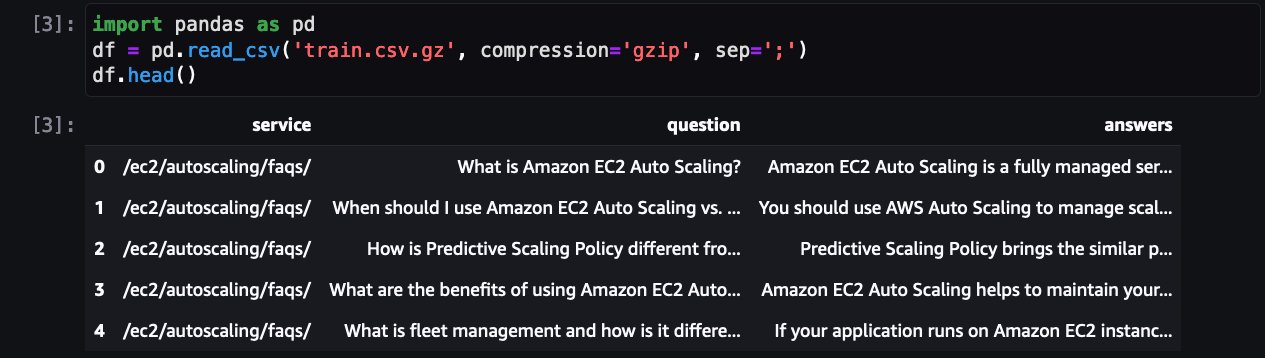

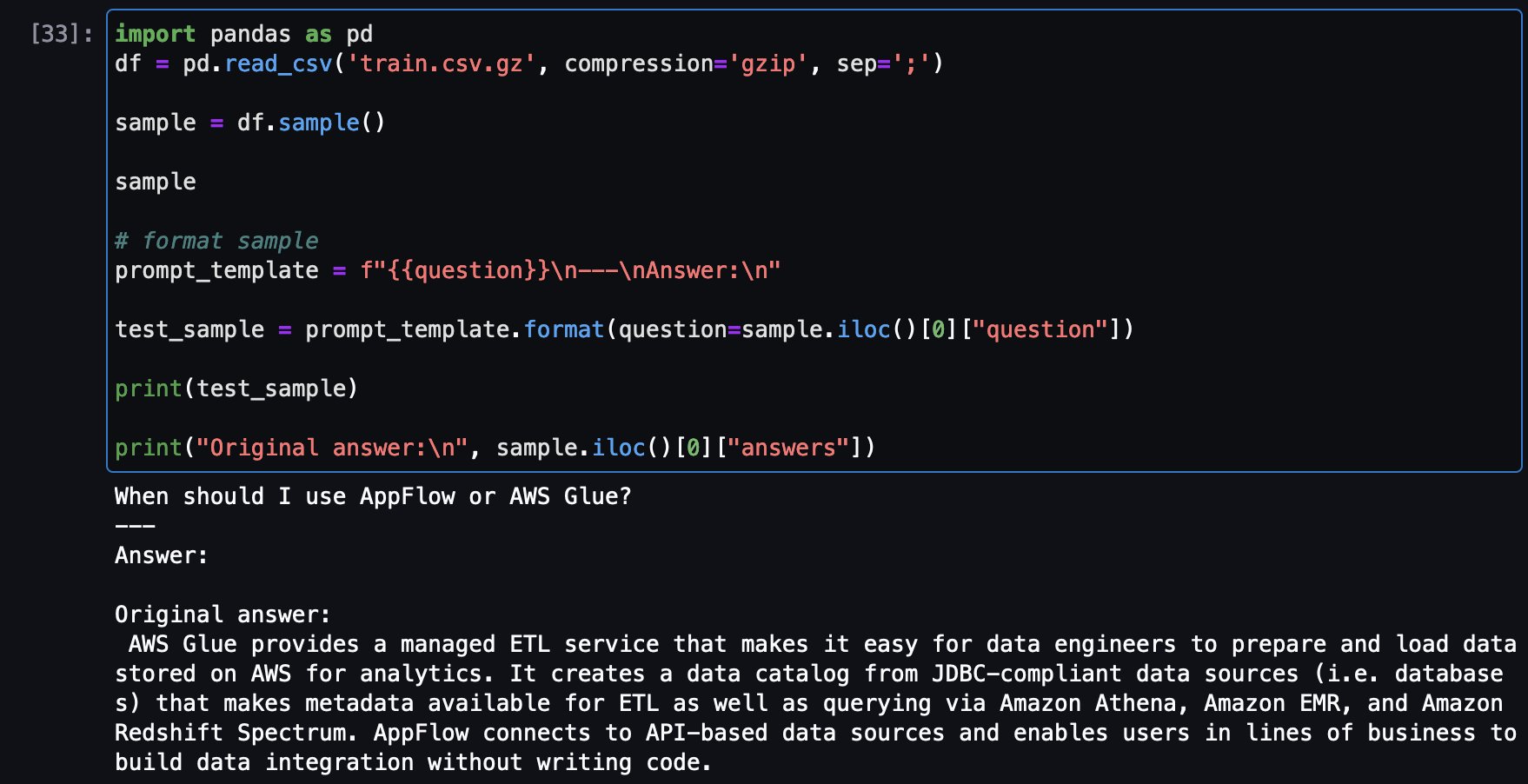

Langkah selanjutnya adalah memuat dan memproses kumpulan data terlebih dahulu agar siap untuk tugas pelatihan. Pertama, mari kita lihat kumpulan datanya:

Ini menunjukkan FAQ untuk salah satu layanan AWS. Selain QLoRA, bitsanbytes digunakan untuk mengonversi ke presisi 4-bit untuk mengkuantisasi LLM beku menjadi 4-bit dan melampirkan LoRA adaptor di atasnya.

Buat template prompt untuk mengonversi setiap sampel FAQ ke format prompt:

Langkah selanjutnya adalah mengonversi input (teks) menjadi ID token. Hal ini dilakukan oleh a Tokenizer Transformers Wajah Memeluk.

Sekarang cukup gunakan prompt_template berfungsi untuk mengonversi semua FAQ ke format prompt dan menyiapkan kumpulan data pelatihan dan pengujian.

4. Menyempurnakan FAQ Falcon-7B pada layanan AWS

Sekarang Anda dapat menyiapkan skrip pelatihan dan menentukan fungsi pelatihan train_fn dan letakkan dekorator @remote pada fungsinya.

Fungsi pelatihan melakukan hal berikut:

- memberi token dan membagi kumpulan data

- mendirikan

BitsAndBytesConfig, yang menentukan model harus dimuat dalam 4-bit tetapi sementara komputasi harus dikonversi kebfloat16. - Muat modelnya

- Temukan modul target dan perbarui matriks yang diperlukan dengan menggunakan metode utilitas

find_all_linear_names - membuat LoRA konfigurasi yang menentukan peringkat matriks pembaruan (

s), faktor skala (lora_alpha), modul untuk menerapkan matriks pembaruan LoRA (target_modules), probabilitas putus sekolah untuk lapisan Lora(lora_dropout),task_type, Dll - Mulai pelatihan dan evaluasi

Dan panggil train_fn()

Pekerjaan penyetelan akan berjalan di klaster pelatihan Amazon SageMaker. Tunggu hingga pekerjaan penyetelan selesai.

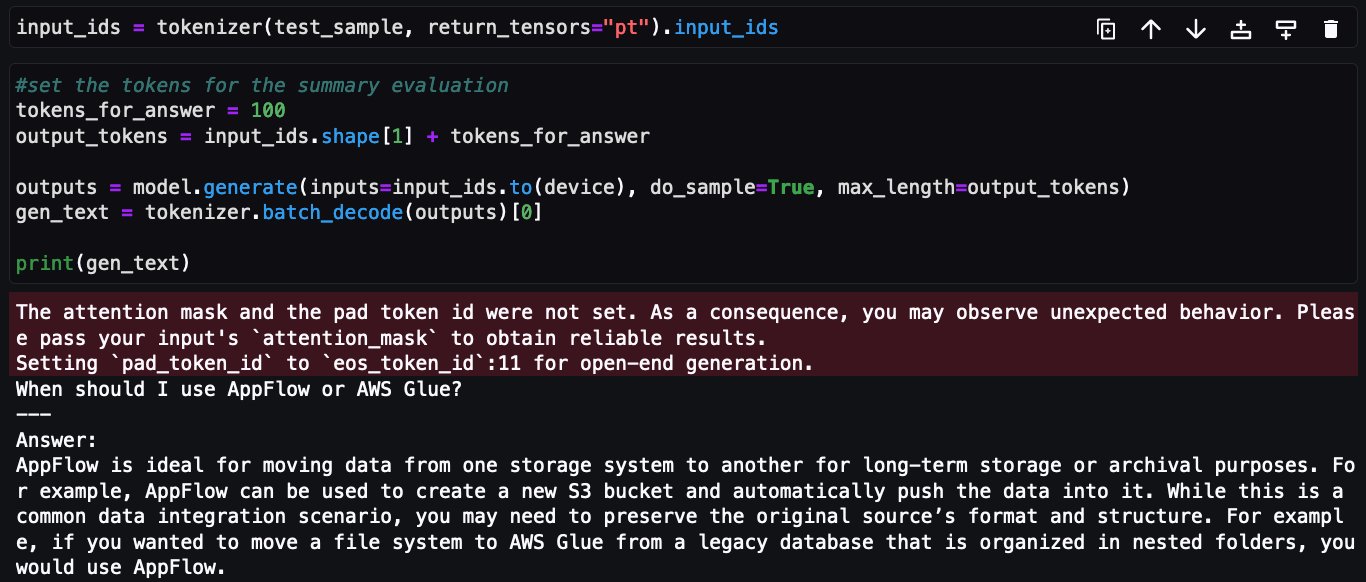

5. Uji model penyempurnaan pada contoh pertanyaan terkait layanan AWS

Sekarang, saatnya menjalankan beberapa pengujian pada model. Pertama, mari kita muat modelnya:

Sekarang muat contoh pertanyaan dari kumpulan data pelatihan untuk melihat jawaban asli, lalu ajukan pertanyaan yang sama dari model yang disetel untuk melihat jawabannya sebagai perbandingan.

Berikut ini contoh pertanyaan dari set pelatihan dan jawaban aslinya:

Sekarang, pertanyaan yang sama ditanyakan pada model Falcon-7B yang disetel:

Ini menyimpulkan implementasi penyempurnaan Falcon-7B pada kumpulan data FAQ layanan AWS menggunakan dekorator @remote dari Amazon SageMaker Python SDK.

Membersihkan

Selesaikan langkah-langkah berikut untuk membersihkan sumber daya Anda:

- Matikan instans Amazon SageMaker Studio untuk menghindari biaya tambahan.

- Bersihkan Sistem File Amazon Elastic Anda (Amazon EFS) dengan mengosongkan direktori cache Hugging Face:

Kesimpulan

Dalam postingan ini, kami menunjukkan kepada Anda cara efektif menggunakan kemampuan dekorator @remote untuk menyempurnakan model Falcon-7B menggunakan QLoRA, Hugging Face PEFT dengan bitsandbtyes tanpa menerapkan perubahan signifikan pada notebook pelatihan, dan menggunakan kemampuan Amazon SageMaker untuk menjalankan tugas pelatihan pada klaster jarak jauh.

Semua kode yang ditampilkan sebagai bagian dari posting ini untuk menyempurnakan Falcon-7B tersedia di Repositori GitHub. Repositori juga berisi buku catatan yang menunjukkan cara menyempurnakan Llama-13B.

Sebagai langkah berikutnya, kami mendorong Anda untuk memeriksa fungsi dekorator @remote dan API Python SDK dan gunakan dalam lingkungan dan IDE pilihan Anda. Contoh tambahan tersedia di amazon-sagemaker-contoh repositori untuk membantu Anda memulai dengan cepat. Anda juga dapat melihat postingan berikut:

Tentang Penulis

Bruno Piston adalah Arsitek Solusi Spesialis AI/ML untuk AWS yang berbasis di Milan. Dia bekerja dengan pelanggan besar untuk membantu mereka memahami secara mendalam kebutuhan teknis mereka dan merancang solusi AI dan Machine Learning yang memanfaatkan AWS Cloud dan tumpukan Amazon Machine Learning dengan sebaik-baiknya. Keahliannya meliputi: Machine Learning end to end, Machine Learning Industrialization, dan Generative AI. Dia senang menghabiskan waktu bersama teman-temannya dan menjelajahi tempat-tempat baru, serta bepergian ke destinasi baru.

Bruno Piston adalah Arsitek Solusi Spesialis AI/ML untuk AWS yang berbasis di Milan. Dia bekerja dengan pelanggan besar untuk membantu mereka memahami secara mendalam kebutuhan teknis mereka dan merancang solusi AI dan Machine Learning yang memanfaatkan AWS Cloud dan tumpukan Amazon Machine Learning dengan sebaik-baiknya. Keahliannya meliputi: Machine Learning end to end, Machine Learning Industrialization, dan Generative AI. Dia senang menghabiskan waktu bersama teman-temannya dan menjelajahi tempat-tempat baru, serta bepergian ke destinasi baru.

Vikesh Pandey adalah Arsitek Solusi Spesialis Pembelajaran Mesin di AWS, membantu pelanggan dari industri keuangan merancang dan membangun solusi pada AI dan ML generatif. Di luar pekerjaan, Vikesh senang mencoba masakan yang berbeda dan berolahraga di luar ruangan.

Vikesh Pandey adalah Arsitek Solusi Spesialis Pembelajaran Mesin di AWS, membantu pelanggan dari industri keuangan merancang dan membangun solusi pada AI dan ML generatif. Di luar pekerjaan, Vikesh senang mencoba masakan yang berbeda dan berolahraga di luar ruangan.

- Konten Bertenaga SEO & Distribusi PR. Dapatkan Amplifikasi Hari Ini.

- PlatoData.Jaringan Vertikal Generatif Ai. Berdayakan Diri Anda. Akses Di Sini.

- PlatoAiStream. Intelijen Web3. Pengetahuan Diperkuat. Akses Di Sini.

- PlatoESG. Otomotif / EV, Karbon, teknologi bersih, energi, Lingkungan Hidup, Tenaga surya, Penanganan limbah. Akses Di Sini.

- PlatoHealth. Kecerdasan Uji Coba Biotek dan Klinis. Akses Di Sini.

- ChartPrime. Tingkatkan Game Trading Anda dengan ChartPrime. Akses Di Sini.

- BlockOffset. Modernisasi Kepemilikan Offset Lingkungan. Akses Di Sini.

- Sumber: https://aws.amazon.com/blogs/machine-learning/fine-tune-falcon-7b-and-other-llms-on-amazon-sagemaker-with-remote-decorator/

- :memiliki

- :adalah

- :bukan

- :Di mana

- $NAIK

- 1

- 10

- 100

- 12

- 13

- 150

- 28

- 31

- 40

- 7

- 8

- 9

- a

- Tentang Kami

- mengakses

- Akun

- Mencapai

- di seluruh

- menambahkan

- tambahan

- Tambahan

- Keuntungan

- AI

- Model AI

- AI / ML

- Semua

- mengizinkan

- memungkinkan

- juga

- Amazon

- Pembelajaran Mesin Amazon

- Amazon SageMaker

- Studio Amazon SageMaker

- Amazon Web Services

- an

- dan

- menjawab

- jawaban

- Apa pun

- Mendaftar

- Menerapkan

- pendekatan

- pendekatan

- arsitektur

- ADALAH

- argumen

- AS

- meminta

- terkait

- At

- melampirkan

- ditambah

- penulis

- mobil

- secara otomatis

- tersedia

- menghindari

- AWS

- pembatas

- berdasarkan

- BE

- karena

- makhluk

- TERBAIK

- lebih besar

- Blog

- bnb

- membangun

- tapi

- by

- Cache

- CAN

- kemampuan

- Kapasitas

- tantangan

- Perubahan

- memeriksa

- pilihan

- pembersih

- Pembukaan hutan

- awan

- Kelompok

- kode

- perbandingan

- komputasi

- konfigurasi

- Wadah

- mengandung

- terus

- mengubah

- dikonversi

- Biaya

- Biaya

- bisa

- menutupi

- dibuat

- Surat kepercayaan

- adat

- pelanggan

- data

- pengolahan data

- kumpulan data

- default

- menetapkan

- menunjukkan

- ketergantungan

- Mendesain

- tujuan

- terperinci

- rincian

- Pengembang

- pengembang

- Pengembangan

- alat

- berbeda

- langsung

- tidak

- dilakukan

- turun

- setiap

- efektif

- efisien

- usaha

- lain

- mendorong

- akhir

- Teknik

- memastikan

- masuk

- Lingkungan Hidup

- lingkungan

- dll

- Bahkan

- contoh

- eksekusi

- ada

- keahlian

- Menjelajahi

- Menghadapi

- faktor

- palsu

- FAQ

- FAST

- Fitur

- beberapa

- File

- keuangan

- industri keuangan

- akhir

- menyelesaikan

- Pertama

- cocok

- berikut

- Untuk

- format

- ditemukan

- Prinsip Dasar

- teman

- dari

- beku

- penuh

- fungsi

- lebih lanjut

- generasi

- generatif

- AI generatif

- mendapatkan

- akan

- baik

- GPU

- Memiliki

- he

- membantu

- karenanya

- -nya

- Seterpercayaapakah Olymp Trade? Kesimpulan

- How To

- Namun

- HTML

- http

- HTTPS

- identitas

- id

- if

- gambar

- implementasi

- mengimpor

- memperbaiki

- ditingkatkan

- meningkatkan

- in

- memasukkan

- meningkatkan

- industri

- informasi

- memasukkan

- input

- install

- diinstal

- contoh

- terpadu

- ke

- IT

- Diri

- Pekerjaan

- Jobs

- jpg

- hanya

- dikenal

- besar

- jalankan

- BELAJAR

- pengetahuan

- membiarkan

- perpustakaan

- Perpustakaan

- 'like'

- baris

- LLM

- memuat

- Panjang

- melihat

- mesin

- Mesin belajar

- mempertahankan

- membuat

- mengelola

- wajib

- Mungkin..

- Anggota

- Memori

- tersebut

- mungkin

- MILAN

- minimal

- ML

- model

- model

- Modul

- Modul

- lebih

- nama

- nama

- asli

- Alam

- perlu

- Perlu

- dibutuhkan

- kebutuhan

- New

- berikutnya

- tidak

- None

- buku catatan

- sekarang

- jumlah

- of

- on

- ONE

- Operasi

- or

- urutan

- asli

- Lainnya

- di luar

- keluaran

- di luar

- parameter

- bagian

- Melakukan

- prestasi

- Izin

- Tempat

- Platform

- plato

- Kecerdasan Data Plato

- Data Plato

- bermain

- silahkan

- Pos

- Posts

- Ketelitian

- Mempersiapkan

- prasyarat

- disajikan

- Mencetak

- pengolahan

- produktifitas

- disediakan

- menyediakan

- menempatkan

- Ular sanca

- Q & A

- kualitas

- pertanyaan

- Pertanyaan

- segera

- acak

- Peringkat

- Baca

- siap

- mengurangi

- lihat

- terkait

- terpencil

- gudang

- wajib

- Persyaratan

- membutuhkan

- Sumber

- kembali

- Peran

- Run

- berjalan

- berjalan

- pembuat bijak

- sama

- skala

- Ilmu

- naskah

- SDK

- melihat

- memilih

- Layanan

- set

- pengaturan

- pengaturan

- penyiapan

- beberapa

- berbagi

- harus

- menampilkan

- menunjukkan

- ditunjukkan

- Pertunjukkan

- penting

- hanya

- tunggal

- larutan

- Solusi

- beberapa

- spesialis

- ditentukan

- Pengeluaran

- Olahraga

- tumpukan

- awal

- mulai

- Langkah

- Tangga

- Masih

- studio

- seperti itu

- cukup

- dipasok

- menyediakan

- mendukung

- Didukung

- Beralih

- sistem

- target

- tugas

- tim

- Anggota tim

- Teknis

- teknik

- Template

- uji

- tes

- teks

- bahwa

- Grafik

- mereka

- Mereka

- kemudian

- Ini

- ini

- Melalui

- waktu

- untuk

- token

- tokenisasi

- obor

- Total

- Pelatihan VE

- Pelatihan

- transformer

- memicu

- mencoba

- memahami

- unit

- Memperbarui

- us

- penggunaan

- menggunakan

- bekas

- Pengguna

- kegunaan

- menggunakan

- kegunaan

- variasi

- sangat

- Video

- menunggu

- Cara..

- we

- jaringan

- layanan web

- BAIK

- yang

- sementara

- Wikipedia

- dengan

- tanpa

- Kerja

- kerja

- bekerja

- akan

- penulisan

- namun

- Kamu

- Anda

- zephyrnet.dll