Potensi AI sedang berkembang, tetapi teknologi yang mengandalkan data pribadi nyata memerlukan penggunaan yang bertanggung jawab atas teknologi tersebut, kata International Association of Privacy Professionals. Itu penggunaan AI diperkirakan akan tumbuh lebih dari 25% setiap tahun selama lima tahun ke depan, menurut PricewaterhouseCoopers.

“Kerangka kerja yang jelas memungkinkan konsistensi, standarisasi, dan penggunaan yang bertanggung jawab adalah elemen kunci keberhasilan AI,” IAPP tulisnya baru-baru ini Laporan Tata Kelola Privasi dan AI.

AI yang bertanggung jawab adalah praktik teknologi yang berpusat pada privasi, pengawasan manusia, ketahanan, akuntabilitas, keamanan, kejelasan, dan keadilan. Namun, 80% organisasi yang disurvei belum memformalkan pilihan alat untuk menilai penggunaan AI yang bertanggung jawab. Organisasi merasa sulit untuk mendapatkan alat teknis yang tepat untuk mengatasi privasi dan risiko etika yang berasal dari AI, tulis IAPP dalam laporan tersebut.

Sementara organisasi memiliki niat baik, mereka tidak memiliki gambaran yang jelas tentang teknologi apa yang akan membawa mereka ke AI yang bertanggung jawab. Dalam 80% organisasi yang disurvei, pedoman AI etis hampir selalu terbatas pada deklarasi kebijakan tingkat tinggi dan tujuan strategis, kata IAPP.

“Tanpa pemahaman yang jelas tentang kategori alat yang tersedia yang diperlukan untuk mengoperasionalkan AI yang bertanggung jawab, pembuat keputusan individu yang mengikuti persyaratan hukum atau melakukan tindakan khusus untuk menghindari bias atau kotak hitam tidak dapat, dan tidak, mendasarkan keputusan mereka pada tempat yang sama,” kata laporan.

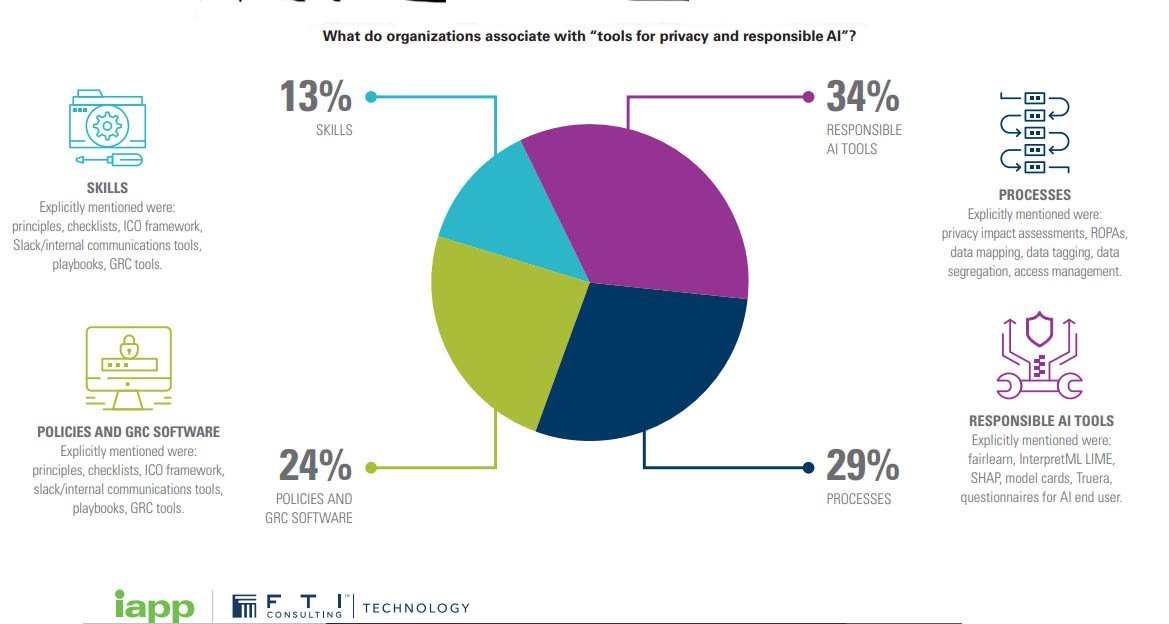

Ketika diminta untuk menentukan “alat untuk privasi dan AI yang bertanggung jawab”, 34% menyebutkan alat AI yang bertanggung jawab, 29% menyebutkan proses, 24% menyebutkan kebijakan, dan 13% menyebutkan keahlian.

- Keterampilan dan kebijakan termasuk daftar periksa, menggunakan kerangka kerja ICO, mengembangkan dan mengikuti buku pedoman, dan menggunakan kendur dan alat komunikasi internal lainnya. Alat GRC juga disebutkan dalam dua kategori ini.

- Proses mencakup penilaian dampak privasi, pemetaan/penandaan/segregasi data, manajemen akses, dan catatan aktivitas pemrosesan (RoPA).

- Alat AI yang bertanggung jawab mencakup fairlearn, InterpreML LIME, SHAP, kartu model, Truera, dan kuesioner yang diisi oleh pengguna.

Sementara organisasi menyadari teknologi baru seperti teknologi peningkatan privasi, mereka kemungkinan belum menerapkannya, menurut IAPP. PET menawarkan peluang baru untuk analitik data kolaboratif yang menjaga privasi dan privasi berdasarkan desain. Namun, 80% organisasi mengatakan bahwa mereka tidak menggunakan PET di organisasi mereka karena khawatir akan risiko implementasi.

- Konten Bertenaga SEO & Distribusi PR. Dapatkan Amplifikasi Hari Ini.

- Platoblockchain. Intelijen Metaverse Web3. Pengetahuan Diperkuat. Akses Di Sini.

- Sumber: https://www.darkreading.com/tech-trends/enterprises-don-t-know-what-to-buy-for-responsible-ai

- 7

- a

- mengakses

- Menurut

- akuntabilitas

- kegiatan

- alamat

- AI

- Tata kelola AI

- selalu

- analisis

- dan

- sesuai

- sekitar

- penilaian

- Asosiasi

- tersedia

- mendasarkan

- prasangka

- Black

- Kotak

- membeli

- tidak bisa

- Kartu-kartu

- kategori

- berpusat

- pilihan

- dikutip

- jelas

- kolaboratif

- Komunikasi

- Kekhawatiran

- data

- Data Analytics

- keputusan

- keputusan

- menyebarkan

- dikerahkan

- Mendesain

- berkembang

- sulit

- setiap

- elemen

- memungkinkan

- meningkatkan

- perusahaan

- etis

- keadilan

- Menemukan

- berikut

- Kerangka

- kerangka

- dari

- mendapatkan

- baik

- pemerintahan

- Tumbuh

- Pertumbuhan

- pedoman

- tingkat tinggi

- Namun

- HTML

- HTTPS

- manusia

- ICO

- Dampak

- implementasi

- in

- memasukkan

- termasuk

- sendiri-sendiri

- niat

- intern

- Internasional

- IT

- kunci

- Tahu

- Informasi

- Mungkin

- Kapur

- Terbatas

- Daftar

- Pembuat

- pengelolaan

- ukuran

- tersebut

- model

- lebih

- New

- Teknologi baru

- berikutnya

- target

- menawarkan

- Peluang

- organisasi

- Lainnya

- Kelalaian

- pribadi

- data pribadi

- Hewan Peliharaan

- gambar

- plato

- Kecerdasan Data Plato

- Data Plato

- Kebijakan

- kebijaksanaan

- potensi

- praktek

- diprediksi

- pribadi

- proses

- pengolahan

- profesional

- PWC

- baru

- catatan

- melaporkan

- Persyaratan

- membutuhkan

- tanggung jawab

- risiko

- kesegaran

- Tersebut

- sama

- keamanan

- keterampilan

- kendur

- tertentu

- Strategis

- sukses

- seperti itu

- disurvei

- Teknis

- teknologi

- Teknologi

- Teknologi

- Grafik

- mereka

- untuk

- alat

- pemahaman

- menggunakan

- Pengguna

- Apa

- akan

- tanpa

- tahun

- tahun

- zephyrnet.dll