Ini adalah kiriman tamu dari Modal yang Dapat diskalakan, FinTech terkemuka di Eropa yang menawarkan manajemen kekayaan digital dan platform pialang dengan tarif perdagangan tetap.

Sebagai perusahaan yang berkembang pesat, tujuan Scalable Capital tidak hanya membangun infrastruktur yang inovatif, kuat, dan andal, namun juga memberikan pengalaman terbaik bagi klien kami, terutama dalam hal layanan klien.

Scalable menerima ratusan pertanyaan email dari klien kami setiap hari. Dengan menerapkan model pemrosesan bahasa alami (NLP) modern, proses respons menjadi jauh lebih efisien, dan waktu tunggu klien menjadi sangat berkurang. Model pembelajaran mesin (ML) mengklasifikasikan permintaan pelanggan baru yang masuk segera setelah permintaan tersebut tiba dan mengalihkannya ke antrean yang telah ditentukan sebelumnya, yang memungkinkan agen sukses klien kami yang berdedikasi untuk fokus pada konten email sesuai dengan keahlian mereka dan memberikan respons yang sesuai.

Dalam postingan ini, kami mendemonstrasikan manfaat teknis menggunakan transformator Hugging Face yang diterapkan Amazon SageMaker, seperti pelatihan dan eksperimen dalam skala besar, serta peningkatan produktivitas dan efisiensi biaya.

Pernyataan masalah

Scalable Capital adalah salah satu FinTech dengan pertumbuhan tercepat di Eropa. Dengan tujuan untuk mendemokratisasi investasi, perusahaan memberikan kliennya akses mudah ke pasar keuangan. Klien Scalable dapat berpartisipasi aktif di pasar melalui platform perdagangan pialang perusahaan, atau menggunakan Scalable Wealth Management untuk berinvestasi dengan cara yang cerdas dan otomatis. Pada tahun 2021, Scalable Capital mengalami peningkatan sepuluh kali lipat basis kliennya, dari puluhan ribu menjadi ratusan ribu.

Untuk memberikan pengalaman pengguna kelas atas (dan konsisten) kepada klien kami di seluruh produk dan layanan klien, perusahaan mencari solusi otomatis untuk menghasilkan efisiensi demi solusi yang terukur sambil mempertahankan keunggulan operasional. Tim ilmu data dan layanan klien Scalable Capital mengidentifikasi bahwa salah satu hambatan terbesar dalam melayani klien kami adalah menanggapi pertanyaan email. Secara khusus, hambatannya adalah pada langkah klasifikasi, di mana karyawan harus membaca dan memberi label pada teks permintaan setiap hari. Setelah email dialihkan ke antrean yang sesuai, masing-masing pakar dengan cepat terlibat dan menyelesaikan kasus tersebut.

Untuk menyederhanakan proses klasifikasi ini, tim ilmu data di Scalable membuat dan menerapkan model NLP multitugas menggunakan arsitektur transformator canggih, berdasarkan pelatihan yang telah dilatih sebelumnya. distilbert-base-Jerman-casing model yang diterbitkan oleh Hugging Face. distilbert-base-Jerman-casing menggunakan distilasi pengetahuan metode untuk melatih model representasi bahasa tujuan umum yang lebih kecil daripada model dasar BERT asli. Versi sulingan mencapai kinerja yang sebanding dengan versi aslinya, namun lebih kecil dan lebih cepat. Untuk memfasilitasi proses siklus hidup ML, kami memutuskan untuk mengadopsi SageMaker untuk membangun, menerapkan, menyajikan, dan memantau model kami. Di bagian berikut, kami memperkenalkan desain arsitektur proyek kami.

Ikhtisar solusi

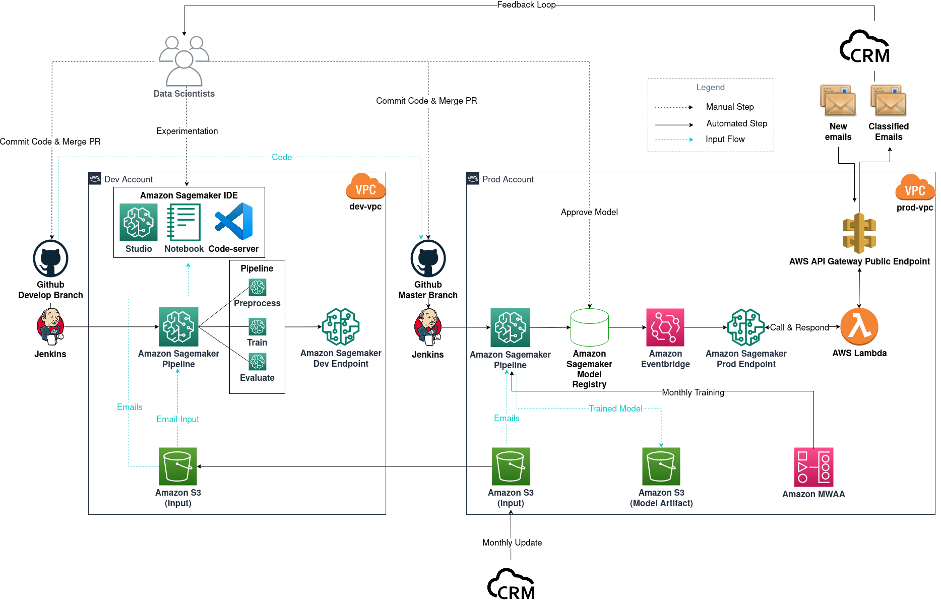

Infrastruktur ML Scalable Capital terdiri dari dua akun AWS: satu sebagai lingkungan untuk tahap pengembangan dan yang lainnya untuk tahap produksi.

Diagram berikut menunjukkan alur kerja untuk proyek pengklasifikasi email kami, namun juga dapat digeneralisasikan ke proyek ilmu data lainnya.

Diagram proyek klasifikasi email

Alur kerja terdiri dari komponen-komponen berikut:

- Eksperimen model – Data yang digunakan oleh para ilmuwan Studio Amazon SageMaker untuk melakukan langkah pertama dalam siklus hidup ilmu data: analisis data eksplorasi (EDA), pembersihan dan persiapan data, dan pembuatan model prototipe. Ketika fase eksplorasi selesai, kami beralih ke VSCode yang dihosting oleh notebook SageMaker sebagai alat pengembangan jarak jauh untuk memodulasi dan memproduksi basis kode kami. Untuk menjelajahi berbagai jenis model dan konfigurasi model, dan pada saat yang sama untuk melacak eksperimen kami, kami menggunakan Pelatihan SageMaker dan Eksperimen SageMaker.

- Pembuatan model – Setelah kita memutuskan model untuk kasus penggunaan produksi kita, dalam hal ini multi-tugas distilbert-base-Jerman-casing model, yang disempurnakan dari model terlatih dari Hugging Face, kami berkomitmen dan memasukkan kode kami ke cabang pengembangan Github. Peristiwa penggabungan Github memicu pipeline Jenkins CI kami, yang kemudian memulai pekerjaan SageMaker Pipelines dengan data pengujian. Ini bertindak sebagai tes untuk memastikan bahwa kode berjalan seperti yang diharapkan. Titik akhir pengujian disebarkan untuk tujuan pengujian.

- Penerapan model – Setelah memastikan semuanya berjalan sesuai harapan, data scientist menggabungkan cabang pengembangan menjadi cabang utama. Peristiwa penggabungan ini sekarang memicu pekerjaan SageMaker Pipelines menggunakan data produksi untuk tujuan pelatihan. Setelah itu, artefak model diproduksi dan disimpan dalam sebuah output Layanan Penyimpanan Sederhana Amazon (Amazon S3), dan versi model baru dicatat di registri model SageMaker. Ilmuwan data memeriksa performa model baru, lalu menyetujui apakah model tersebut sesuai dengan ekspektasi. Peristiwa persetujuan model ditangkap oleh Jembatan Acara Amazon, yang kemudian menyebarkan model ke titik akhir SageMaker di lingkungan produksi.

- MLOps – Karena titik akhir SageMaker bersifat pribadi dan tidak dapat dijangkau oleh layanan di luar VPC, dan AWS Lambda fungsi dan Gerbang API Amazon titik akhir publik diperlukan untuk berkomunikasi dengan CRM. Setiap kali email baru masuk ke kotak masuk CRM, CRM memanggil titik akhir publik API Gateway, yang pada gilirannya memicu fungsi Lambda untuk memanggil titik akhir pribadi SageMaker. Fungsi tersebut kemudian meneruskan klasifikasi kembali ke CRM melalui titik akhir publik API Gateway. Untuk memantau kinerja model yang kami terapkan, kami menerapkan putaran umpan balik antara CRM dan ilmuwan data untuk melacak metrik prediksi dari model tersebut. Setiap bulan, CRM memperbarui data historis yang digunakan untuk eksperimen dan pelatihan model. Kita gunakan Alur Kerja Terkelola Amazon untuk Apache Airflow (Amazon MWAA) sebagai penjadwal pelatihan ulang bulanan kami.

Di bagian berikut, kami menguraikan langkah-langkah persiapan data, eksperimen model, dan penerapan model secara lebih rinci.

Persiapan data

Scalable Capital menggunakan alat CRM untuk mengelola dan menyimpan data email. Isi email yang relevan terdiri dari subjek, badan, dan bank kustodian. Ada tiga label untuk ditetapkan pada setiap email: dari lini bisnis mana email tersebut berasal, antrean mana yang sesuai, dan topik spesifik email tersebut.

Sebelum kami mulai melatih model NLP apa pun, kami memastikan bahwa data masukan bersih dan label diberikan sesuai harapan.

Untuk mengambil konten pertanyaan yang bersih dari klien Scalable, kami menghapus data email mentah serta teks dan simbol tambahan, seperti tanda tangan email, kesan, kutipan pesan sebelumnya dalam rantai email, simbol CSS, dan sebagainya. Jika tidak, model terlatih kami di masa mendatang mungkin akan mengalami penurunan performa.

Label untuk email berkembang seiring waktu seiring tim layanan klien yang Scalable menambahkan label baru dan menyempurnakan atau menghapus label yang sudah ada untuk mengakomodasi kebutuhan bisnis. Untuk memastikan bahwa label untuk data pelatihan serta klasifikasi yang diharapkan untuk prediksi adalah yang terbaru, tim ilmu data bekerja sama erat dengan tim layanan klien untuk memastikan kebenaran label tersebut.

Eksperimen model

Kami memulai percobaan kami dengan pra-terlatih yang tersedia distilbert-base-Jerman-casing model yang diterbitkan oleh Hugging Face. Karena model terlatih adalah model representasi bahasa untuk tujuan umum, kita dapat mengadaptasi arsitektur untuk melakukan tugas hilir tertentu—seperti klasifikasi dan menjawab pertanyaan—dengan memasang head yang sesuai ke jaringan saraf. Dalam kasus penggunaan kami, tugas hilir yang kami minati adalah klasifikasi urutan. Tanpa memodifikasi arsitektur yang ada, kami memutuskan untuk menyempurnakan tiga model terlatih terpisah untuk setiap kategori yang kami perlukan. Dengan SageMaker Memeluk Wadah Pembelajaran Mendalam Wajah (DLC), memulai dan mengelola eksperimen NLP menjadi sederhana dengan wadah Hugging Face dan SageMaker Experiments API.

Berikut cuplikan kodenya train.py:

Kode berikut adalah estimator Hugging Face:

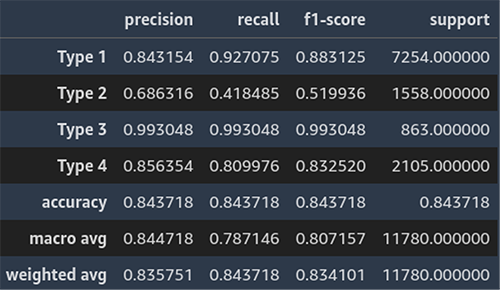

Untuk memvalidasi model yang telah disesuaikan, kami menggunakan Skor F1 karena sifat kumpulan data email kami yang tidak seimbang, tetapi juga untuk menghitung metrik lain seperti akurasi, presisi, dan perolehan. Agar SageMaker Experiments API mendaftarkan metrik tugas pelatihan, pertama-tama kita harus mencatat metrik tersebut ke konsol lokal tugas pelatihan, yang diambil oleh amazoncloudwatch. Kemudian kami menentukan format regex yang benar untuk mengambil log CloudWatch. Definisi metrik mencakup nama metrik dan validasi ekspresi reguler untuk mengekstraksi metrik dari tugas pelatihan:

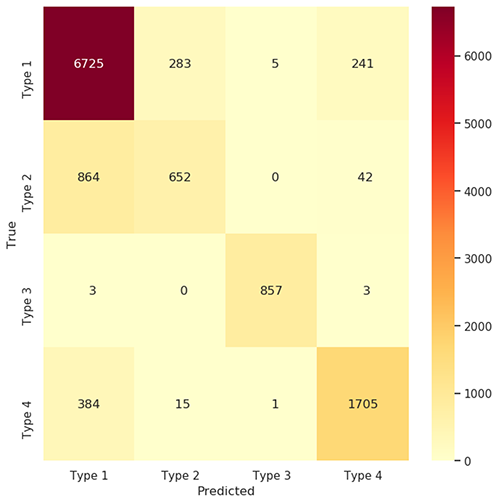

Sebagai bagian dari iterasi pelatihan untuk model pengklasifikasi, kami menggunakan matriks konfusi dan laporan klasifikasi untuk mengevaluasi hasilnya. Gambar berikut menunjukkan matriks konfusi untuk prediksi lini bisnis.

Matriks Kebingungan

Tangkapan layar berikut menunjukkan contoh laporan klasifikasi untuk prediksi lini bisnis.

Laporan Klasifikasi

Sebagai iterasi berikutnya dari eksperimen kami, kami akan memanfaatkannya pembelajaran multi-tugas untuk meningkatkan model kami. Pembelajaran multi-tugas adalah suatu bentuk pelatihan di mana suatu model belajar menyelesaikan banyak tugas secara bersamaan, karena berbagi informasi antar tugas dapat meningkatkan efisiensi pembelajaran. Dengan melampirkan dua kepala klasifikasi lagi ke arsitektur distilbert asli, kami dapat melakukan penyesuaian multi-tugas, yang menghasilkan metrik yang masuk akal untuk tim layanan klien kami.

Penerapan model

Dalam kasus penggunaan kami, pengklasifikasi email akan diterapkan ke titik akhir, di mana saluran CRM kami dapat mengirimkan sejumlah email yang tidak diklasifikasikan dan mendapatkan kembali prediksi. Karena kita memiliki logika lain—seperti pembersihan data masukan dan prediksi multitugas—selain inferensi model Hugging Face, kita perlu menulis skrip inferensi khusus yang mematuhi Standar SageMaker.

Berikut cuplikan kodenya inference.py:

Ketika semuanya sudah siap dan siap, kami menggunakan SageMaker Pipelines untuk mengelola jalur pelatihan kami dan melampirkannya ke infrastruktur kami untuk menyelesaikan penyiapan MLOps kami.

Untuk memantau kinerja model yang diterapkan, kami membangun putaran umpan balik untuk memungkinkan CRM memberi kami status email rahasia ketika kasus ditutup. Berdasarkan informasi ini, kami melakukan penyesuaian untuk menyempurnakan model yang diterapkan.

Kesimpulan

Dalam postingan ini, kami berbagi bagaimana SageMaker memfasilitasi tim ilmu data di Scalable untuk mengelola siklus hidup proyek ilmu data secara efisien, yaitu proyek pengklasifikasi email. Siklus hidup dimulai dengan tahap awal analisis dan eksplorasi data dengan SageMaker Studio; beralih ke eksperimen model dan penerapan dengan pelatihan SageMaker, inferensi, dan DLC Hugging Face; dan dilengkapi dengan pipeline pelatihan dengan SageMaker Pipelines yang terintegrasi dengan layanan AWS lainnya. Berkat infrastruktur ini, kami dapat mengulangi dan menerapkan model-model baru dengan lebih efisien, sehingga dapat meningkatkan proses yang ada dalam Scalable serta pengalaman klien kami.

Untuk mempelajari lebih lanjut tentang Hugging Face dan SageMaker, lihat sumber daya berikut:

Tentang Penulis

Dr Sandra Schmid adalah Kepala Analisis Data di Scalable GmbH. Dia bertanggung jawab atas pendekatan berbasis data dan kasus penggunaan di perusahaan bersama timnya. Fokus utamanya adalah menemukan kombinasi terbaik antara model pembelajaran mesin dan ilmu data serta tujuan bisnis untuk mendapatkan nilai bisnis dan efisiensi data sebanyak mungkin.

Dr Sandra Schmid adalah Kepala Analisis Data di Scalable GmbH. Dia bertanggung jawab atas pendekatan berbasis data dan kasus penggunaan di perusahaan bersama timnya. Fokus utamanya adalah menemukan kombinasi terbaik antara model pembelajaran mesin dan ilmu data serta tujuan bisnis untuk mendapatkan nilai bisnis dan efisiensi data sebanyak mungkin.

Hui Dang Ilmuwan Data di Scalable GmbH. Tanggung jawabnya mencakup analisis data, membangun dan menerapkan model pembelajaran mesin, serta mengembangkan dan memelihara infrastruktur untuk tim ilmu data. Di waktu luangnya, dia senang membaca, mendaki gunung, panjat tebing, dan mengikuti perkembangan pembelajaran mesin terkini.

Hui Dang Ilmuwan Data di Scalable GmbH. Tanggung jawabnya mencakup analisis data, membangun dan menerapkan model pembelajaran mesin, serta mengembangkan dan memelihara infrastruktur untuk tim ilmu data. Di waktu luangnya, dia senang membaca, mendaki gunung, panjat tebing, dan mengikuti perkembangan pembelajaran mesin terkini.

Mia Chang adalah Arsitek Solusi Spesialis ML untuk Amazon Web Services. Dia bekerja dengan pelanggan di EMEA dan berbagi praktik terbaik untuk menjalankan beban kerja AI/ML di cloud dengan latar belakangnya di bidang matematika terapan, ilmu komputer, dan AI/ML. Dia berfokus pada beban kerja khusus NLP, dan berbagi pengalamannya sebagai pembicara konferensi dan penulis buku. Di waktu luangnya, dia menikmati yoga, permainan papan, dan menyeduh kopi.

Mia Chang adalah Arsitek Solusi Spesialis ML untuk Amazon Web Services. Dia bekerja dengan pelanggan di EMEA dan berbagi praktik terbaik untuk menjalankan beban kerja AI/ML di cloud dengan latar belakangnya di bidang matematika terapan, ilmu komputer, dan AI/ML. Dia berfokus pada beban kerja khusus NLP, dan berbagi pengalamannya sebagai pembicara konferensi dan penulis buku. Di waktu luangnya, dia menikmati yoga, permainan papan, dan menyeduh kopi.

Moritz Guertler adalah Account Executive di segmen Digital Native Businesses di AWS. Dia berfokus pada pelanggan di bidang FinTech dan mendukung mereka dalam mempercepat inovasi melalui infrastruktur cloud yang aman dan terukur.

Moritz Guertler adalah Account Executive di segmen Digital Native Businesses di AWS. Dia berfokus pada pelanggan di bidang FinTech dan mendukung mereka dalam mempercepat inovasi melalui infrastruktur cloud yang aman dan terukur.

- Konten Bertenaga SEO & Distribusi PR. Dapatkan Amplifikasi Hari Ini.

- PlatoData.Jaringan Vertikal Generatif Ai. Berdayakan Diri Anda. Akses Di Sini.

- PlatoAiStream. Intelijen Web3. Pengetahuan Diperkuat. Akses Di Sini.

- PlatoESG. Otomotif / EV, Karbon, teknologi bersih, energi, Lingkungan Hidup, Tenaga surya, Penanganan limbah. Akses Di Sini.

- PlatoHealth. Kecerdasan Uji Coba Biotek dan Klinis. Akses Di Sini.

- ChartPrime. Tingkatkan Game Trading Anda dengan ChartPrime. Akses Di Sini.

- BlockOffset. Modernisasi Kepemilikan Offset Lingkungan. Akses Di Sini.

- Sumber: https://aws.amazon.com/blogs/machine-learning/accelerate-client-success-management-through-email-classification-with-hugging-face-on-amazon-sagemaker/

- :memiliki

- :adalah

- :bukan

- :Di mana

- $NAIK

- 1

- 100

- 13

- 15%

- 17

- 2021

- 26%

- 32

- 500

- 7

- a

- Sanggup

- Tentang Kami

- atas

- mempercepat

- mempercepat

- Setuju

- mengakses

- menampung

- Menurut

- Akun

- Akun

- ketepatan

- Mencapai

- di seluruh

- aktif

- tindakan

- menyesuaikan

- menambahkan

- tambahan

- penyesuaian

- mengambil

- Keuntungan

- Setelah

- setelah itu

- agen

- AI / ML

- tujuan

- memungkinkan

- juga

- Amazon

- Amazon SageMaker

- Amazon Web Services

- antara

- an

- analisis

- analisis

- dan

- Apa pun

- Apache

- api

- terapan

- pendekatan

- sesuai

- persetujuan

- menyetujui

- arsitektur

- ADALAH

- argumen

- AS

- ditugaskan

- At

- melampirkan

- penulis

- Otomatis

- tersedia

- AWS

- kembali

- latar belakang

- Bank

- mendasarkan

- berdasarkan

- dasar

- BE

- karena

- menjadi

- makhluk

- Manfaat

- TERBAIK

- Praktik Terbaik

- antara

- papan

- Permainan papan

- tubuh

- Book

- Cabang

- Istirahat

- perdagangan perantara

- membangun

- Bangunan

- dibangun di

- bisnis

- bisnis

- tapi

- by

- CAN

- modal

- Modal

- menangkap

- ditangkap

- membawa

- kasus

- kasus

- kategori

- rantai

- klasifikasi

- tergolong

- Pembersihan

- klien

- klien

- Pendakian

- Penyelesaian

- tertutup

- awan

- infrastruktur cloud

- kode

- basis kode

- Kode

- Tanaman

- kolaborasi

- kombinasi

- datang

- melakukan

- menyampaikan

- perusahaan

- Perusahaan

- sebanding

- lengkap

- Selesaikan

- komponen

- menghitung

- komputer

- Komputer Ilmu

- Konferensi

- kebingungan

- konsisten

- terdiri

- konsul

- Wadah

- Konten

- isi

- benar

- CRM

- CSS

- pemelihara

- adat

- pelanggan

- pelanggan

- harian

- data

- analisis data

- Data Analytics

- Persiapan data

- ilmu data

- ilmuwan data

- Data-driven

- Tanggal

- memutuskan

- memutuskan

- dedicated

- mendalam

- belajar mendalam

- Default

- menetapkan

- didefinisikan

- definisi

- mendemokrasikan

- mendemonstrasikan

- menyebarkan

- dikerahkan

- penggelaran

- penyebaran

- menyebarkan

- Mendesain

- rinci

- mengembangkan

- berkembang

- Pengembangan

- Perkembangan

- berbeda

- digital

- manajemen kekayaan digital

- turun

- dua

- setiap

- Mudah

- efisiensi

- efisien

- lain

- EMEA

- karyawan

- aktif

- Titik akhir

- bertunangan

- memastikan

- Lingkungan Hidup

- masa

- terutama

- Eropa

- mengevaluasi

- evaluasi

- Acara

- segala sesuatu

- berkembang

- memeriksa

- contoh

- Keunggulan

- eksekutif

- ada

- harapan

- harapan

- diharapkan

- pengalaman

- berpengalaman

- Pengalaman

- eksperimen

- eksperimen

- eksplorasi

- Analisis Data Eksplorasi

- menyelidiki

- tambahan

- f1

- Menghadapi

- memudahkan

- memfasilitasi

- Fashion

- lebih cepat

- tercepat

- tercepat

- umpan balik

- Angka

- keuangan

- temuan

- fintech

- fintechs

- Pertama

- langkah pertama

- datar

- Fokus

- berfokus

- berikut

- Untuk

- bentuk

- format

- Gratis

- dari

- fungsi

- masa depan

- Mendapatkan

- Games

- pintu gerbang

- tujuan umum

- menghasilkan

- mendapatkan

- GitHub

- GmBH

- Anda

- Pertumbuhan

- Tamu

- tamu Post

- memiliki

- Memiliki

- he

- kepala

- kepala

- dia

- -nya

- historis

- host

- Seterpercayaapakah Olymp Trade? Kesimpulan

- HTML

- http

- HTTPS

- Ratusan

- diidentifikasi

- if

- melaksanakan

- mengimplementasikan

- memperbaiki

- in

- memasukkan

- masuk

- Meningkatkan

- Pada meningkat

- informasi

- Infrastruktur

- mulanya

- Innovation

- inovatif

- memasukkan

- Pertanyaan

- penyelidikan

- terpadu

- Cerdas

- tertarik

- ke

- memperkenalkan

- Menginvestasikan

- investasi

- memanggil

- IT

- perulangan

- NYA

- Pekerjaan

- json

- Menjaga

- kunci

- label

- Label

- bahasa

- terbesar

- Terbaru

- terkemuka

- BELAJAR

- pengetahuan

- siklus hidup

- baris

- memuat

- lokal

- mencatat

- login

- mencari

- lepas

- mesin

- Mesin belajar

- terbuat

- mempertahankan

- membuat

- Membuat

- mengelola

- berhasil

- pengelolaan

- pelaksana

- Pasar

- pasar

- matematika

- Matriks

- Bergabung

- menggabungkan acara

- pesan

- metode

- metrik

- Metrik

- mungkin

- ML

- MLOps

- model

- model

- modern

- Memantau

- bulanan

- lebih

- bergerak

- banyak

- beberapa

- nama

- yaitu

- asli

- Alam

- Pengolahan Bahasa alami

- Alam

- Perlu

- kebutuhan

- jaringan

- saraf

- saraf jaringan

- New

- berikutnya

- nLP

- buku catatan

- sekarang

- jumlah

- of

- Penawaran

- on

- ONE

- yang

- hanya

- operasional

- or

- urutan

- asli

- Lainnya

- jika tidak

- kami

- di luar

- keluaran

- di luar

- lebih

- bagian

- ikut

- Melakukan

- prestasi

- tahap

- terpilih

- pipa saluran

- Platform

- plato

- Kecerdasan Data Plato

- Data Plato

- mungkin

- Pos

- praktek

- Ketelitian

- ramalan

- Prediksi

- persiapan

- sebelumnya

- primer

- swasta

- proses

- proses

- pengolahan

- Diproduksi

- Produksi

- produktifitas

- Produk

- proyek

- memprojeksikan

- tepat

- prototipe

- memberikan

- menyediakan

- publik

- diterbitkan

- tujuan

- Dorong

- pertanyaan

- segera

- tanda kutip

- menaikkan

- Penilaian

- Mentah

- tercapai

- Baca

- Bacaan

- siap

- masuk akal

- menerima

- arsip

- mengurangi

- lihat

- memperhalus

- regex

- daftar

- pendaftaran

- relevan

- dapat diandalkan

- terpencil

- menghapus

- melaporkan

- perwakilan

- permintaan

- permintaan

- wajib

- diselesaikan

- Sumber

- itu

- menanggapi

- tanggapan

- tanggapan

- tanggung jawab

- tanggung jawab

- mengakibatkan

- kembali

- kuat

- batu

- berjalan

- pembuat bijak

- Pipa SageMaker

- sama

- terukur

- Skala

- Ilmu

- ilmuwan

- ilmuwan

- naskah

- Bagian

- bagian

- aman

- ruas

- mengirim

- terpisah

- Urutan

- melayani

- layanan

- Layanan

- penyiapan

- berbentuk

- berbagi

- saham

- dia

- Pertunjukkan

- Tanda tangan

- Sederhana

- serentak

- keterampilan

- lebih kecil

- potongan

- So

- larutan

- Solusi

- MEMECAHKAN

- segera

- Space

- Pembicara

- spesialis

- spesialis

- tertentu

- Secara khusus

- Tahap

- awal

- Mulai

- dimulai

- state-of-the-art

- Status

- tinggal

- Langkah

- Tangga

- penyimpanan

- tersimpan

- menyimpan

- mempersingkat

- studio

- subyek

- sukses

- seperti itu

- Mendukung

- yakin

- Mengambil

- tugas

- tugas

- tim

- tim

- Teknis

- memiliki

- uji

- pengujian

- teks

- dari

- Terima kasih

- bahwa

- Grafik

- mereka

- Mereka

- kemudian

- Sana.

- karena itu

- mereka

- ini

- ribuan

- tiga

- Melalui

- waktu

- untuk

- bersama

- alat

- tema

- obor

- jalur

- Trading

- Trading Platform

- Pelatihan VE

- terlatih

- Pelatihan

- transformator

- transformer

- sangat

- MENGHIDUPKAN

- dua

- mengetik

- jenis

- Pembaruan

- us

- menggunakan

- gunakan case

- bekas

- Pengguna

- Pengguna Pengalaman

- kegunaan

- menggunakan

- MENGESAHKAN

- pengesahan

- nilai

- versi

- Menunggu

- adalah

- we

- Kekayaan

- manajemen kekayaan

- jaringan

- layanan web

- BAIK

- adalah

- ketika

- kapan saja

- yang

- sementara

- dengan

- dalam

- tanpa

- alur kerja

- Alur kerja

- bekerja

- menulis

- Yoga

- zephyrnet.dll