Pelanggan layanan kesehatan dan ilmu kehidupan (HCLS) mengadopsi AI generatif sebagai alat untuk mendapatkan lebih banyak manfaat dari data mereka. Kasus penggunaan mencakup peringkasan dokumen untuk membantu pembaca fokus pada poin-poin penting dokumen dan mengubah teks tidak terstruktur menjadi format standar untuk menyorot atribut penting. Dengan format data yang unik dan persyaratan peraturan yang ketat, pelanggan mencari pilihan untuk memilih model yang paling berkinerja dan hemat biaya, serta kemampuan untuk melakukan penyesuaian (penyempurnaan) yang diperlukan agar sesuai dengan kasus penggunaan bisnis mereka. Dalam postingan ini, kami memandu Anda dalam menerapkan model bahasa besar (LLM) Falcon menggunakan Mulai Lompatan Amazon SageMaker dan menggunakan model untuk meringkas dokumen panjang dengan LangChain dan Python.

Ikhtisar solusi

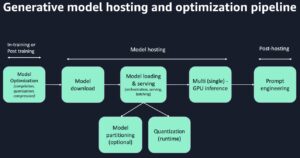

Amazon SageMaker dibangun berdasarkan pengalaman Amazon selama dua dekade dalam mengembangkan aplikasi ML dunia nyata, termasuk rekomendasi produk, personalisasi, belanja cerdas, robotika, dan perangkat berbantuan suara. SageMaker adalah layanan terkelola yang memenuhi syarat HIPAA yang menyediakan alat yang memungkinkan ilmuwan data, teknisi ML, dan analis bisnis berinovasi dengan ML. Di dalam SageMaker adalah Studio Amazon SageMaker, lingkungan pengembangan terintegrasi (IDE) yang dibuat khusus untuk alur kerja ML kolaboratif, yang, pada gilirannya, berisi beragam solusi mulai cepat dan model ML terlatih di hub terintegrasi yang disebut SageMaker JumpStart. Dengan SageMaker JumpStart, Anda dapat menggunakan model terlatih, seperti Falcon LLM, dengan notebook sampel bawaan dan dukungan SDK untuk bereksperimen dan menerapkan model transformator canggih ini. Anda dapat menggunakan SageMaker Studio dan SageMaker JumpStart untuk menerapkan dan menanyakan model generatif Anda sendiri di akun AWS Anda.

Anda juga dapat memastikan bahwa data payload inferensi tidak meninggalkan VPC Anda. Anda dapat menyediakan model sebagai titik akhir penyewa tunggal dan menyebarkannya dengan isolasi jaringan. Selain itu, Anda dapat menyusun dan mengelola kumpulan model terpilih yang memenuhi persyaratan keamanan Anda sendiri dengan menggunakan kemampuan hub model pribadi dalam SageMaker JumpStart dan menyimpan model yang disetujui di sana. SageMaker berada dalam cakupannya HIPAA BAA, SOC123, dan CSF HITRUST.

Grafik Falcon LLM adalah model bahasa besar, dilatih oleh para peneliti di Technology Innovation Institute (TII) pada lebih dari 1 triliun token menggunakan AWS. Falcon memiliki banyak variasi berbeda, dengan dua konstituen utamanya, Falcon 40B dan Falcon 7B, masing-masing terdiri dari 40 miliar dan 7 miliar parameter, dengan versi yang telah disesuaikan dan dilatih untuk tugas tertentu, seperti mengikuti instruksi. Falcon berkinerja baik dalam berbagai tugas, termasuk peringkasan teks, analisis sentimen, menjawab pertanyaan, dan percakapan. Posting ini memberikan panduan yang dapat Anda ikuti untuk menerapkan Falcon LLM ke akun AWS Anda, menggunakan instans notebook terkelola melalui SageMaker JumpStart untuk bereksperimen dengan peringkasan teks.

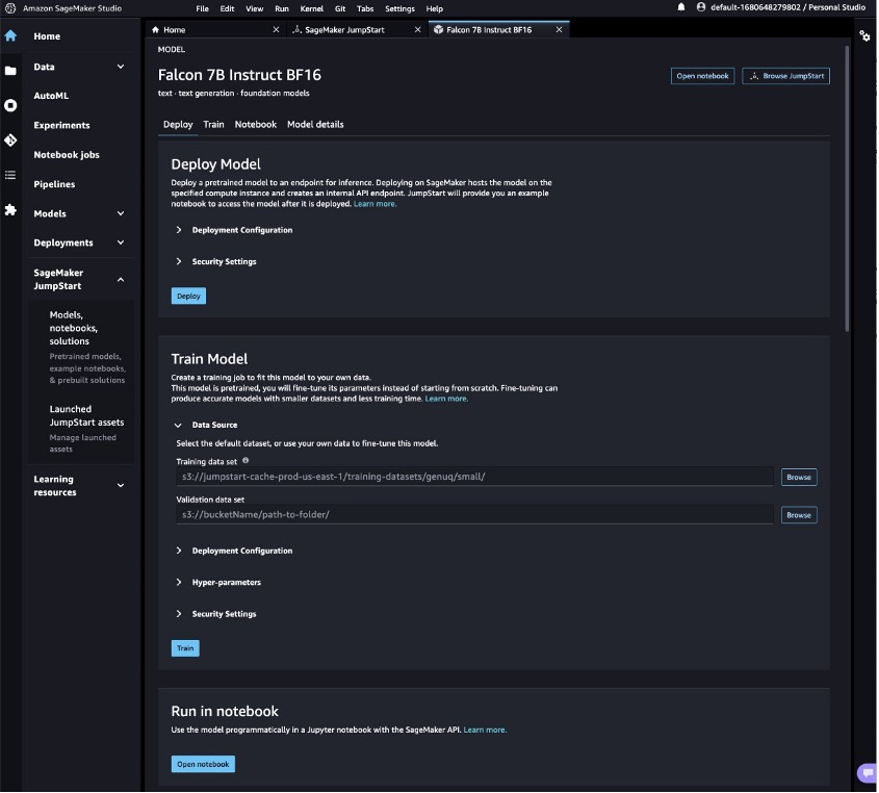

Hub model SageMaker JumpStart mencakup notebook lengkap untuk menyebarkan dan mengkueri setiap model. Saat tulisan ini dibuat, ada enam versi Falcon yang tersedia di hub model SageMaker JumpStart: Falcon 40B Instruct BF16, Falcon 40B BF16, Falcon 180B BF16, Falcon 180B Chat BF16, Falcon 7B Instruct BF16, dan Falcon 7B BF16. Posting ini menggunakan model Instruksi Falcon 7B.

Di bagian berikut, kami menunjukkan cara memulai peringkasan dokumen dengan menerapkan Falcon 7B di SageMaker Jumpstart.

Prasyarat

Untuk tutorial ini, Anda memerlukan akun AWS dengan domain SageMaker. Jika Anda belum memiliki domain SageMaker, lihat Masuk ke Domain Amazon SageMaker untuk membuat satu.

Terapkan Falcon 7B menggunakan SageMaker JumpStart

Untuk menerapkan model Anda, selesaikan langkah-langkah berikut:

- Navigasikan ke lingkungan SageMaker Studio Anda dari konsol SageMaker.

- Di dalam IDE, di bawah SageMaker JumpStart di panel navigasi, pilih Model, notebook, solusi.

- Terapkan model Instruksi Falcon 7B ke titik akhir untuk inferensi.

Ini akan membuka kartu model untuk model Falcon 7B Instruct BF16. Di halaman ini, Anda dapat menemukan Menyebarkan or Pelatihan VE opsi serta tautan untuk membuka contoh buku catatan di SageMaker Studio. Postingan ini akan menggunakan contoh notebook dari SageMaker JumpStart untuk menerapkan model.

- Pilih Buka buku catatan.

- Jalankan empat sel pertama notebook untuk menyebarkan titik akhir Falcon 7B Instruct.

Anda dapat melihat model JumpStart yang Anda terapkan di Meluncurkan aset JumpStart .

- Di panel navigasi, di bawah Jumpstart SageMaker, pilih Meluncurkan aset JumpStart.

- Pilih Titik akhir model tab untuk melihat status titik akhir Anda.

Dengan titik akhir Falcon LLM disebarkan, Anda siap untuk mengkueri model.

Jalankan kueri pertama Anda

Untuk menjalankan kueri, selesaikan langkah-langkah berikut:

- pada File menu, pilih New dan buku catatan untuk membuka buku catatan baru.

Anda juga dapat mengunduh buku catatan yang sudah selesai di sini.

- Pilih image, kernel, dan tipe instans saat diminta. Untuk postingan ini, kami memilih image Data Science 3.0, kernel Python 3, dan instance ml.t3.medium.

- Impor modul Boto3 dan JSON dengan memasukkan dua baris berikut ke dalam sel pertama:

- Tekan Shift + Enter untuk menjalankan sel.

- Selanjutnya, Anda dapat menentukan fungsi yang akan memanggil titik akhir Anda. Fungsi ini mengambil muatan kamus dan menggunakannya untuk memanggil klien runtime SageMaker. Kemudian ia melakukan deserialisasi respons dan mencetak input dan teks yang dihasilkan.

Payload menyertakan prompt sebagai masukan, bersama dengan parameter inferensi yang akan diteruskan ke model.

- Anda dapat menggunakan parameter berikut dengan perintah untuk menyesuaikan keluaran model untuk kasus penggunaan Anda:

Kueri dengan perintah ringkasan

Posting ini menggunakan contoh makalah penelitian untuk menunjukkan ringkasan. Contoh file teks mengenai peringkasan teks otomatis dalam literatur biomedis. Selesaikan langkah-langkah berikut:

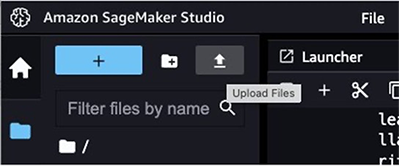

- Unduh PDF dan salin teks ke dalam file bernama

document.txt. - Di SageMaker Studio, pilih ikon unggah dan unggah file ke instans SageMaker Studio Anda.

Falcon LLM menyediakan dukungan untuk peringkasan teks.

- Mari kita buat fungsi yang menggunakan teknik rekayasa cepat untuk meringkasnya

document.txt:

Anda akan melihat bahwa untuk dokumen yang lebih panjang, kesalahan muncul—Falcon, bersama semua LLM lainnya, memiliki batasan jumlah token yang diteruskan sebagai input. Kita dapat mengatasi batas ini dengan menggunakan kemampuan peringkasan LangChain yang ditingkatkan, yang memungkinkan masukan yang jauh lebih besar untuk diteruskan ke LLM.

Impor dan jalankan rantai ringkasan

LangChain adalah pustaka perangkat lunak sumber terbuka yang memungkinkan pengembang dan ilmuwan data dengan cepat membangun, menyempurnakan, dan menerapkan aplikasi generatif khusus tanpa mengelola interaksi ML yang rumit, biasanya digunakan untuk mengabstraksi banyak kasus penggunaan umum model bahasa AI generatif hanya dalam beberapa baris kode. Dukungan LangChain untuk layanan AWS mencakup dukungan untuk titik akhir SageMaker.

LangChain menyediakan antarmuka yang dapat diakses oleh LLM. Fitur-fiturnya mencakup alat untuk templating cepat dan rangkaian cepat. Rantai ini dapat digunakan untuk meringkas dokumen teks yang lebih panjang dari yang didukung model bahasa dalam satu panggilan. Anda dapat menggunakan strategi pengurangan peta untuk meringkas dokumen panjang dengan memecahnya menjadi bagian-bagian yang dapat dikelola, meringkasnya, dan menggabungkannya (dan meringkasnya lagi, jika diperlukan).

- Mari instal LangChain untuk memulai:

- Impor modul yang relevan dan bagi dokumen panjang menjadi beberapa bagian:

- Agar LangChain bekerja secara efektif dengan Falcon, Anda perlu menentukan kelas pengendali konten default untuk input dan output yang valid:

- Anda dapat menentukan perintah khusus sebagai

PromptTemplateobjek, sarana utama untuk mendorong dengan LangChain, untuk pendekatan peringkasan pengurangan peta. Ini adalah langkah opsional karena perintah pemetaan dan penggabungan disediakan secara default jika parameter dalam panggilan memuat rantai ringkasan (load_summarize_chain) tidak terdefinisi.

- LangChain mendukung LLM yang dihosting di titik akhir inferensi SageMaker, jadi alih-alih menggunakan AWS Python SDK, Anda dapat menginisialisasi koneksi melalui LangChain untuk aksesibilitas yang lebih baik:

- Terakhir, Anda dapat memuat rantai ringkasan dan menjalankan ringkasan pada dokumen masukan menggunakan kode berikut:

Karena verbose parameter disetel ke True, Anda akan melihat semua keluaran perantara dari pendekatan pengurangan peta. Hal ini berguna untuk mengikuti rangkaian kejadian hingga sampai pada ringkasan akhir. Dengan pendekatan pengurangan peta ini, Anda dapat meringkas dokumen secara efektif lebih lama dari biasanya yang diperbolehkan oleh batas token input maksimum model.

Membersihkan

Setelah Anda selesai menggunakan titik akhir inferensi, penting untuk menghapusnya untuk menghindari timbulnya biaya yang tidak perlu melalui baris kode berikut:

Menggunakan model fondasi lain di SageMaker JumpStart

Memanfaatkan model dasar lain yang tersedia di SageMaker JumpStart untuk peringkasan dokumen memerlukan overhead minimal untuk penyiapan dan penerapan. LLM terkadang bervariasi menurut struktur format input dan output, dan saat model baru dan solusi siap pakai ditambahkan ke SageMaker JumpStart, bergantung pada implementasi tugas, Anda mungkin harus membuat perubahan kode berikut:

- Jika Anda melakukan peringkasan melalui

summarize()metode (metode tanpa menggunakan LangChain), Anda mungkin harus mengubah struktur JSONpayloadparameter, serta penanganan variabel respon diquery_endpoint()fungsi - Jika Anda melakukan peringkasan melalui LangChain

load_summarize_chain()metode, Anda mungkin harus memodifikasiContentHandlerTextSummarizationkelas, khususnyatransform_input()dantransform_output()berfungsi, untuk menangani muatan yang diharapkan LLM dengan benar dan keluaran yang dikembalikan LLM

Model dasar bervariasi tidak hanya dalam faktor seperti kecepatan dan kualitas inferensi, namun juga format input dan output. Lihat halaman informasi LLM yang relevan tentang masukan dan keluaran yang diharapkan.

Kesimpulan

Model Instruksi Falcon 7B tersedia di hub model SageMaker JumpStart dan berfungsi pada sejumlah kasus penggunaan. Postingan ini menunjukkan bagaimana Anda dapat menerapkan titik akhir Falcon LLM Anda sendiri ke lingkungan Anda menggunakan SageMaker JumpStart dan melakukan eksperimen pertama Anda dari SageMaker Studio, memungkinkan Anda membuat prototipe model dengan cepat dan bertransisi dengan lancar ke lingkungan produksi. Dengan Falcon dan LangChain, Anda dapat secara efektif meringkas dokumen kesehatan dan ilmu hayati jangka panjang dalam skala besar.

Untuk informasi selengkapnya tentang bekerja dengan AI generatif di AWS, lihat Mengumumkan Alat Baru untuk Membangun dengan AI Generatif di AWS. Anda dapat mulai bereksperimen dan membuat bukti konsep ringkasan dokumen untuk aplikasi GenAI yang berorientasi pada perawatan kesehatan dan ilmu kehidupan menggunakan metode yang diuraikan dalam postingan ini. Kapan Batuan Dasar Amazon tersedia secara umum, kami akan menerbitkan postingan tindak lanjut yang menunjukkan bagaimana Anda dapat menerapkan peringkasan dokumen menggunakan Amazon Bedrock dan LangChain.

Tentang Penulis

John Kitaoka adalah Arsitek Solusi di Amazon Web Services. John membantu pelanggan merancang dan mengoptimalkan beban kerja AI/ML di AWS untuk membantu mereka mencapai tujuan bisnis mereka.

John Kitaoka adalah Arsitek Solusi di Amazon Web Services. John membantu pelanggan merancang dan mengoptimalkan beban kerja AI/ML di AWS untuk membantu mereka mencapai tujuan bisnis mereka.

Josh Famestad adalah Arsitek Solusi di Amazon Web Services. Josh bekerja dengan pelanggan sektor publik untuk membangun dan melaksanakan pendekatan berbasis cloud untuk mewujudkan prioritas bisnis.

Josh Famestad adalah Arsitek Solusi di Amazon Web Services. Josh bekerja dengan pelanggan sektor publik untuk membangun dan melaksanakan pendekatan berbasis cloud untuk mewujudkan prioritas bisnis.

- Konten Bertenaga SEO & Distribusi PR. Dapatkan Amplifikasi Hari Ini.

- PlatoData.Jaringan Vertikal Generatif Ai. Berdayakan Diri Anda. Akses Di Sini.

- PlatoAiStream. Intelijen Web3. Pengetahuan Diperkuat. Akses Di Sini.

- PlatoESG. Karbon, teknologi bersih, energi, Lingkungan Hidup, Tenaga surya, Penanganan limbah. Akses Di Sini.

- PlatoHealth. Kecerdasan Uji Coba Biotek dan Klinis. Akses Di Sini.

- Sumber: https://aws.amazon.com/blogs/machine-learning/create-an-hcls-document-summarization-application-with-falcon-using-amazon-sagemaker-jumpstart/

- :memiliki

- :adalah

- :bukan

- $NAIK

- 1

- 10

- 100

- 11

- 12

- 14

- 150

- 16

- 1M

- 20

- 40

- 400

- 50

- 500

- 7

- a

- kemampuan

- ABSTRAK

- Menerima

- aksesibilitas

- dapat diakses

- Akun

- Mencapai

- menambahkan

- Mengadopsi

- lagi

- AI

- AI / ML

- Semua

- diizinkan

- Membiarkan

- memungkinkan

- di samping

- sudah

- juga

- Amazon

- Amazon SageMaker

- Mulai Lompatan Amazon SageMaker

- Amazon Web Services

- an

- analisis

- Analis

- dan

- hewan

- hewan

- Aplikasi

- aplikasi

- pendekatan

- pendekatan

- disetujui

- ADALAH

- sekitar

- AS

- At

- atribut

- secara otomatis

- tersedia

- menghindari

- AWS

- berdasarkan

- BE

- karena

- mulai

- percaya

- Milyar

- biomedis

- tubuh

- pin

- Kotak

- Istirahat

- Melanggar

- membangun

- Bangunan

- dibangun di

- bisnis

- tapi

- by

- panggilan

- bernama

- CAN

- Bisa Dapatkan

- kemampuan

- kemampuan

- kartu

- kasus

- kasus

- Sel

- rantai

- rantai

- perubahan

- Perubahan

- pilihan

- Pilih

- memilih

- kelas

- kelas-kelas

- klien

- awan

- kode

- kolaboratif

- menggabungkan

- menggabungkan

- Umum

- umum

- dibandingkan

- lengkap

- Lengkap

- kompleks

- Terdiri dari

- konsep

- ringkas

- koneksi

- konsul

- mengandung

- Konten

- hemat biaya

- Biaya

- membuat

- adat

- pelanggan

- kustomisasi

- data

- ilmu data

- dekade

- Default

- menetapkan

- menyampaikan

- mendemonstrasikan

- menunjukkan

- Tergantung

- menyebarkan

- dikerahkan

- penggelaran

- penyebaran

- Mendesain

- pengembang

- berkembang

- Pengembangan

- Devices

- berbeda

- do

- dokumen

- dokumen

- Tidak

- domain

- Dont

- turun

- Download

- setiap

- bumi

- efektif

- aktif

- Titik akhir

- Teknik

- Insinyur

- ditingkatkan

- memastikan

- memasuki

- Lingkungan Hidup

- kesalahan

- peristiwa

- contoh

- menjalankan

- diharapkan

- mengharapkan

- pengalaman

- eksperimen

- eksperimen

- Menghadapi

- faktor

- palsu

- Fitur

- beberapa

- File

- terakhir

- Menemukan

- Pertama

- cocok

- Fokus

- mengikuti

- berikut

- Untuk

- Prinsip Dasar

- empat

- dari

- fungsi

- fungsi

- Selanjutnya

- umumnya

- menghasilkan

- dihasilkan

- generatif

- AI generatif

- mendapatkan

- Anda

- lebih besar

- menangani

- Penanganan

- Memiliki

- kesehatan

- membantu

- membantu

- Menyoroti

- host

- Seterpercayaapakah Olymp Trade? Kesimpulan

- How To

- HTML

- HTTPS

- Pusat

- ICON

- if

- gambar

- melaksanakan

- implementasi

- mengimpor

- penting

- in

- memasukkan

- termasuk

- Termasuk

- informasi

- berinovasi

- Innovation

- memasukkan

- input

- install

- contoh

- sebagai gantinya

- Lembaga

- instruksi

- terpadu

- Cerdas

- interaksi

- Antarmuka

- ke

- isolasi

- IT

- NYA

- John

- json

- hanya

- kunci

- bahasa

- besar

- lebih besar

- diluncurkan

- Meninggalkan

- Perpustakaan

- Hidup

- Biologi

- MEMBATASI

- baris

- link

- literatur

- LLM

- memuat

- Panjang

- lagi

- mencari

- Utama

- membuat

- mengelola

- dikelola

- berhasil

- pelaksana

- banyak

- pemetaan

- maksimum

- Mungkin..

- medium

- menu

- metode

- minimal

- ML

- model

- model

- memodifikasi

- Modul

- lebih

- paling

- banyak

- Navigasi

- perlu

- Perlu

- dibutuhkan

- jaringan

- New

- NIH

- biasanya

- buku catatan

- Melihat..

- jumlah

- objek

- of

- on

- ONE

- hanya

- Buka

- open source

- Perangkat Lunak Sumber Terbuka

- Optimize

- Opsi

- Lainnya

- diuraikan

- keluaran

- lebih

- sendiri

- halaman

- pane

- kertas

- parameter

- parameter

- Lulus

- Melakukan

- melakukan

- melakukan

- Personalisasi

- plato

- Kecerdasan Data Plato

- Data Plato

- poin

- Pos

- kuat

- Mencetak

- cetakan

- swasta

- proses

- Produk

- Produksi

- bukti

- prototipe

- memberikan

- disediakan

- menyediakan

- ketentuan

- publik

- menerbitkan

- Ular sanca

- kualitas

- pertanyaan

- segera

- cepat

- pembaca

- siap

- dunia nyata

- rekomendasi

- lihat

- regulator

- relevan

- Persyaratan

- membutuhkan

- penelitian

- peneliti

- masing-masing

- tanggapan

- kembali

- robotika

- Run

- pembuat bijak

- Inferensi SageMaker

- Skala

- Ilmu

- ILMU PENGETAHUAN

- ilmuwan

- cakupan

- SDK

- mulus

- bagian

- sektor

- keamanan

- melihat

- terpilih

- DIRI

- sentimen

- Urutan

- layanan

- Layanan

- set

- pengaturan

- tas

- Pendek

- Menunjukkan

- tunggal

- ENAM

- So

- Perangkat lunak

- Solusi

- tertentu

- Secara khusus

- kecepatan

- awal

- mulai

- Status

- Langkah

- Tangga

- menyimpan

- Penyelarasan

- Ketat

- struktur

- studio

- seperti itu

- meringkaskan

- RINGKASAN

- mendukung

- Mendukung

- Dibutuhkan

- tugas

- tugas

- teknik

- Teknologi

- Inovasi Teknologi

- teks

- dari

- bahwa

- Grafik

- mereka

- Mereka

- kemudian

- Sana.

- Ini

- ini

- Melalui

- untuk

- bersama

- token

- Token

- alat

- alat

- terlatih

- transformator

- mengubah

- transisi

- Triliun

- benar

- MENGHIDUPKAN

- tutorial

- dua

- mengetik

- tidak terdefinisi

- unik

- tidak perlu

- Mengunggah

- menggunakan

- gunakan case

- bekas

- kegunaan

- menggunakan

- variabel

- variasi

- kendaraan

- Versi

- melalui

- View

- berjalan

- walkthrough

- we

- jaringan

- layanan web

- BAIK

- Apa

- ketika

- yang

- lebar

- akan

- dengan

- dalam

- tanpa

- Kerja

- Alur kerja

- kerja

- bekerja

- menulis

- penulisan

- Kamu

- Anda

- zephyrnet.dll